Ten post został napisany wspólnie przez Ramdev Wudali i Kiran Mantripragada z Thomson Reuters.

W 1992, Thomson Reuters (TR) wydało swoją pierwszą usługę badań prawnych AI, WIN (Westlaw Is Natural), innowację w tamtym czasie, ponieważ większość wyszukiwarek obsługiwała tylko terminy i łączniki logiczne. Od tego czasu TR osiągnął o wiele więcej kamieni milowych, ponieważ jego produkty i usługi AI stale rosną pod względem liczby i różnorodności, wspierając profesjonalistów z branży prawnej, podatkowej, księgowej, zgodności i serwisów informacyjnych na całym świecie, z miliardami spostrzeżeń dotyczących uczenia maszynowego (ML) generowanych każdego roku .

Wraz z tym ogromnym wzrostem usług AI kolejnym kamieniem milowym dla TR było usprawnienie innowacji i ułatwienie współpracy. Standaryzuj tworzenie i ponowne wykorzystywanie rozwiązań AI w różnych funkcjach biznesowych i osobach praktyków AI, zapewniając jednocześnie zgodność z najlepszymi praktykami przedsiębiorstwa:

- Automatyzuj i standaryzuj powtarzalne, niezróżnicowane prace inżynierskie

- Zapewnij wymaganą izolację i kontrolę wrażliwych danych zgodnie ze wspólnymi standardami zarządzania

- Zapewnij łatwy dostęp do skalowalnych zasobów obliczeniowych

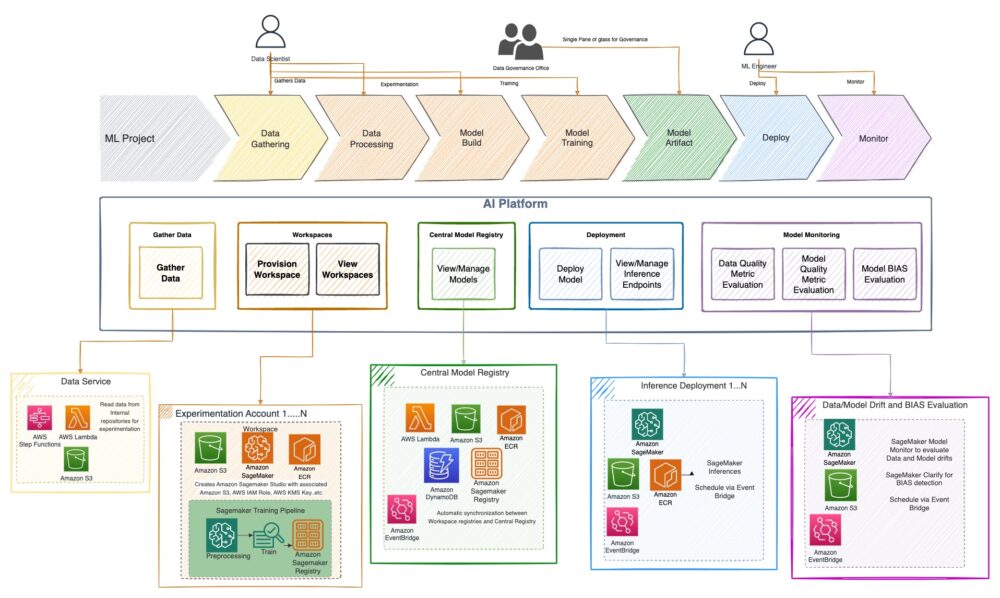

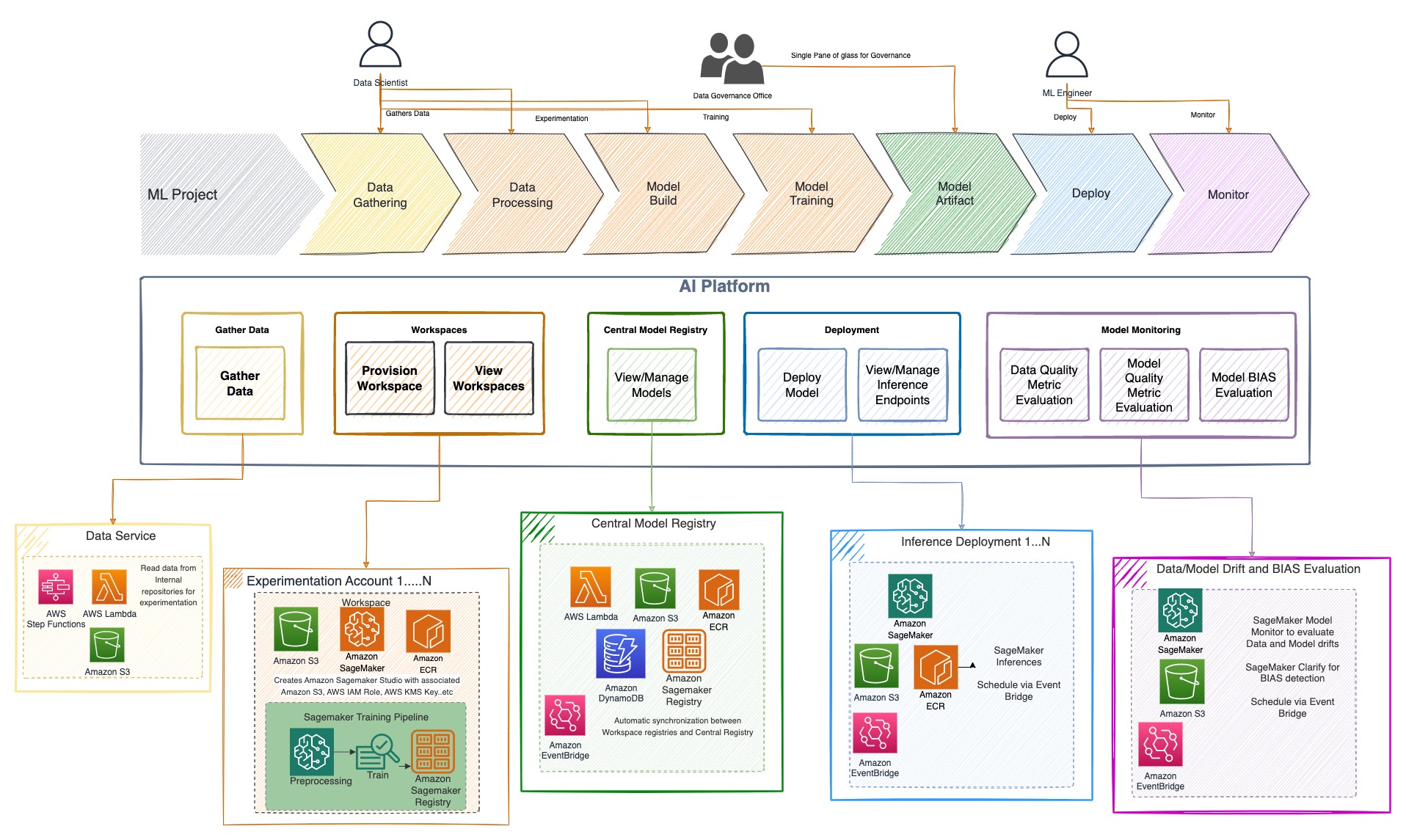

Aby spełnić te wymagania, firma TR zbudowała platformę Enterprise AI opartą na następujących pięciu filarach: usłudze danych, obszarze roboczym eksperymentów, centralnym rejestrze modeli, usłudze wdrażania modeli i monitorowaniu modeli.

W tym poście omawiamy, w jaki sposób TR i AWS współpracowały w celu opracowania pierwszej w historii TR Enterprise AI Platform, narzędzia internetowego, które zapewniłoby możliwości w zakresie od eksperymentowania ML, szkolenia, centralnego rejestru modeli, wdrażania modeli i monitorowania modeli. Wszystkie te możliwości zostały stworzone, aby sprostać stale zmieniającym się standardom bezpieczeństwa TR i zapewnić użytkownikom końcowym proste, bezpieczne i zgodne z przepisami usługi. Dzielimy się również tym, jak TR umożliwił monitorowanie i zarządzanie modelami ML tworzonymi w różnych jednostkach biznesowych za pomocą jednego panelu.

Wyzwania

Historycznie w TR, uczenie maszynowe było możliwością dla zespołów z zaawansowanymi analitykami danych i inżynierami. Zespoły dysponujące wysoko wykwalifikowanymi zasobami były w stanie wdrożyć złożone procesy ML zgodnie ze swoimi potrzebami, ale szybko stały się silosowe. Podejścia silosowe nie zapewniały żadnej widoczności umożliwiającej zarządzanie niezwykle krytycznymi prognozami dotyczącymi podejmowania decyzji.

Zespoły biznesowe TR dysponują rozległą wiedzą dziedzinową; jednak umiejętności techniczne i duży wysiłek inżynierski wymagany w ML utrudniają wykorzystanie ich głębokiej wiedzy specjalistycznej do rozwiązywania problemów biznesowych z mocą ML. TR chce zdemokratyzować umiejętności, udostępniając je większej liczbie osób w organizacji.

Różne zespoły w TR stosują własne praktyki i metodologie. TR chce zbudować użytkownikom możliwości obejmujące cały cykl życia ML, aby przyspieszyć realizację projektów ML, umożliwiając zespołom skupienie się na celach biznesowych, a nie na powtarzalnych, niezróżnicowanych wysiłkach inżynierskich.

Ponadto przepisy dotyczące danych i etycznej sztucznej inteligencji wciąż ewoluują, nakazując wspólne standardy zarządzania w rozwiązaniach AI TR.

Omówienie rozwiązania

Platforma Enterprise AI Platform firmy TR została zaprojektowana w celu zapewnienia prostych i ustandaryzowanych usług dla różnych osób, oferując możliwości na każdym etapie cyklu życia uczenia maszynowego. TR zidentyfikował pięć głównych kategorii, które modularyzują wszystkie wymagania TR:

- usługa transmisji danych – Aby umożliwić łatwy i bezpieczny dostęp do zasobów danych przedsiębiorstwa

- Obszar roboczy eksperymentów – Zapewnienie możliwości eksperymentowania i trenowania modeli ML

- Centralny rejestr modeli – Katalog korporacyjny dla modeli zbudowanych w różnych jednostkach biznesowych

- Usługa wdrażania modelu – Zapewnienie różnych opcji wdrażania wnioskowania zgodnie z praktykami CI/CD w przedsiębiorstwach TR

- Usługi monitorowania modeli – Zapewnienie możliwości monitorowania danych oraz odchyleń i dryfów modeli

Jak pokazano na poniższym diagramie, te mikrousługi są tworzone z uwzględnieniem kilku kluczowych zasad:

- Usuń niezróżnicowany wysiłek inżynieryjny od użytkowników

- Zapewnij wymagane możliwości jednym kliknięciem

- Zabezpiecz i zarządzaj wszystkimi możliwościami zgodnie ze standardami korporacyjnymi TR

- Przynieś pojedynczą taflę szkła na zajęcia ML

Mikrousługi AI Platform TR są zbudowane z Amazon Sage Maker jako główny silnik, bezserwerowe komponenty AWS do przepływów pracy oraz usługi AWS DevOps do praktyk CI/CD. Studio SageMaker służy do eksperymentowania i szkolenia, a rejestr modeli SageMaker służy do rejestrowania modeli. Centralny rejestr modeli składa się zarówno z rejestru modeli SageMaker, jak i pliku Amazon DynamoDB tabela. Usługi hostingowe SageMaker są używane do wdrażania modeli, podczas gdy Monitor modelu SageMaker i SageMaker Wyjaśnij są używane do monitorowania modeli pod kątem dryfu, odchylenia, niestandardowych kalkulatorów metrycznych i możliwości wyjaśnienia.

Poniższe sekcje szczegółowo opisują te usługi.

usługa transmisji danych

Tradycyjny cykl życia projektu ML rozpoczyna się od znalezienia danych. Ogólnie rzecz biorąc, analitycy danych spędzają co najmniej 60% swojego czasu na znajdowaniu odpowiednich danych wtedy, gdy ich potrzebują. Jak każda organizacja, TR ma wiele magazynów danych, które służą jako pojedynczy punkt prawdy dla różnych domen danych. TR zidentyfikował dwa kluczowe magazyny danych przedsiębiorstwa, które dostarczają danych dla większości ich przypadków użycia ML: magazyn obiektowy i relacyjny magazyn danych. Firma TR stworzyła usługę danych AI Platform, aby bezproblemowo zapewnić dostęp do obu magazynów danych z obszarów roboczych eksperymentów użytkowników i odciążyć użytkowników w zakresie samodzielnego nawigowania po złożonych procesach w celu pozyskiwania danych. Platforma AI TR jest zgodna ze wszystkimi zgodnościami i najlepszymi praktykami określonymi przez zespół Data and Model Governance. Obejmuje to obowiązkową ocenę wpływu na dane, która pomaga praktykom ML zrozumieć i przestrzegać etycznego i odpowiedniego wykorzystania danych, wraz z formalnymi procesami zatwierdzania w celu zapewnienia odpowiedniego dostępu do danych. Istotą tej usługi, podobnie jak wszystkich usług platformowych, jest bezpieczeństwo i zgodność z najlepszymi praktykami określonymi przez TR i branżę.

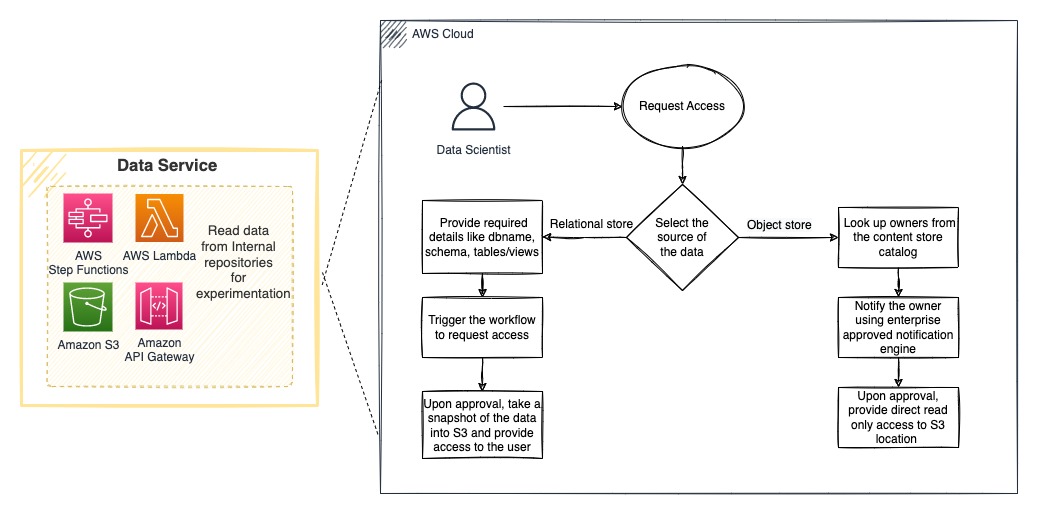

Usługa Amazon Simple Storage (Amazon S3) obiektowa pamięć masowa działa jak jezioro danych treści. Firma TR zbudowała procesy umożliwiające bezpieczny dostęp do danych z jeziora danych zawartości do obszarów roboczych eksperymentów użytkowników przy jednoczesnym zachowaniu wymaganej autoryzacji i możliwości audytu. Płatek śniegu jest używany jako podstawowy relacyjny magazyn danych przedsiębiorstwa. Na żądanie użytkownika i na podstawie zgody właściciela danych usługa danych AI Platform zapewnia użytkownikowi migawkę danych, która jest łatwo dostępna w obszarze roboczym eksperymentów.

Dostęp do danych z różnych źródeł to problem techniczny, który można łatwo rozwiązać. Jednak złożoność, którą rozwiązał TR, polega na zbudowaniu przepływów pracy zatwierdzania, które automatyzują identyfikację właściciela danych, wysyłanie prośby o dostęp, upewnianie się, że właściciel danych jest powiadamiany, że ma oczekującą prośbę o dostęp, i na podstawie statusu zatwierdzenia podejmuje działania w celu dostarczenia danych do wnioskodawca. Wszystkie zdarzenia w trakcie tego procesu są śledzone i rejestrowane pod kątem możliwości kontroli i zgodności.

Jak pokazano na poniższym diagramie, TR używa Funkcje kroków AWS zorganizować przepływ pracy i AWS Lambda aby uruchomić funkcję. Brama Amazon API służy do udostępniania funkcjonalności z punktem końcowym API, który ma być używany z ich portalu internetowego.

Eksperymentowanie i rozwój modeli

Podstawową zdolnością do standaryzacji cyklu życia uczenia maszynowego jest środowisko, które umożliwia naukowcom danych eksperymentowanie z różnymi strukturami uczenia maszynowego i rozmiarami danych. Umożliwienie takiego bezpiecznego, zgodnego środowiska w chmurze w ciągu kilku minut uwalnia analityków danych od ciężaru obsługi infrastruktury chmury, wymagań sieciowych i środków standardów bezpieczeństwa, aby zamiast tego skupić się na problemie analizy danych.

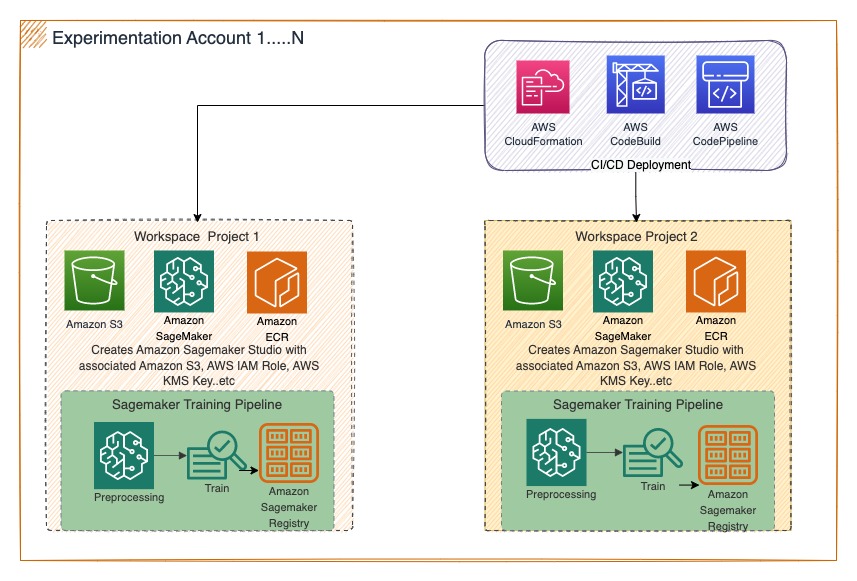

TR tworzy eksperymentalną przestrzeń roboczą, która oferuje dostęp do usług, takich jak Klej AWS, Amazon EMR, oraz SageMaker Studio, aby umożliwić przetwarzanie danych i funkcje uczenia maszynowego zgodnie ze standardami bezpieczeństwa chmury korporacyjnej i wymaganą izolacją kont dla każdej jednostki biznesowej. Podczas wdrażania rozwiązania firma TR napotkała następujące wyzwania:

- Orkiestracja na wczesnym etapie nie była w pełni zautomatyzowana i obejmowała kilka ręcznych czynności. Śledzenie, gdzie występowały problemy, nie było łatwe. Firma TR pokonała ten błąd, koordynując przepływy pracy za pomocą funkcji krokowych. Dzięki zastosowaniu funkcji krokowych budowanie złożonych przepływów pracy, zarządzanie stanami i obsługa błędów stały się znacznie łatwiejsze.

- właściwy AWS Zarządzanie tożsamością i dostępem Definicja roli (IAM) dla obszaru roboczego eksperymentów była trudna do zdefiniowania. Aby zachować zgodność z wewnętrznymi standardami bezpieczeństwa TR i modelem najmniejszych uprawnień, pierwotnie rola obszaru roboczego została zdefiniowana za pomocą wbudowanych zasad. W konsekwencji polityka wbudowana rozrosła się z czasem i stała się rozwlekła, przekraczając limit rozmiaru polityki dozwolony dla roli IAM. Aby temu zaradzić, firma TR przeszła na stosowanie większej liczby zasad zarządzanych przez klienta i odwoływanie się do nich w definicji roli obszaru roboczego.

- TR sporadycznie osiągał domyślne limity zasobów stosowane na poziomie konta AWS. Spowodowało to sporadyczne awarie uruchamiania zadań SageMaker (na przykład zadań szkoleniowych) z powodu osiągnięcia żądanego limitu typu zasobu. W tej kwestii TR ściśle współpracował z zespołem serwisowym SageMaker. Ten problem został rozwiązany po tym, jak zespół AWS uruchomił SageMaker jako obsługiwaną usługę w Limity usług w czerwcu 2022.

Dzisiaj analitycy danych w TR mogą uruchomić projekt ML, tworząc niezależną przestrzeń roboczą i dodając wymaganych członków zespołu do współpracy. Nieograniczona skala oferowana przez SageMaker jest na wyciągnięcie ręki, dostarczając im niestandardowe obrazy jądra o różnych rozmiarach. SageMaker Studio szybko stało się kluczowym komponentem platformy AI TR i zmieniło zachowanie użytkowników z korzystania z ograniczonych aplikacji komputerowych na skalowalne i efemeryczne, specjalnie zaprojektowane silniki. Poniższy diagram ilustruje tę architekturę.

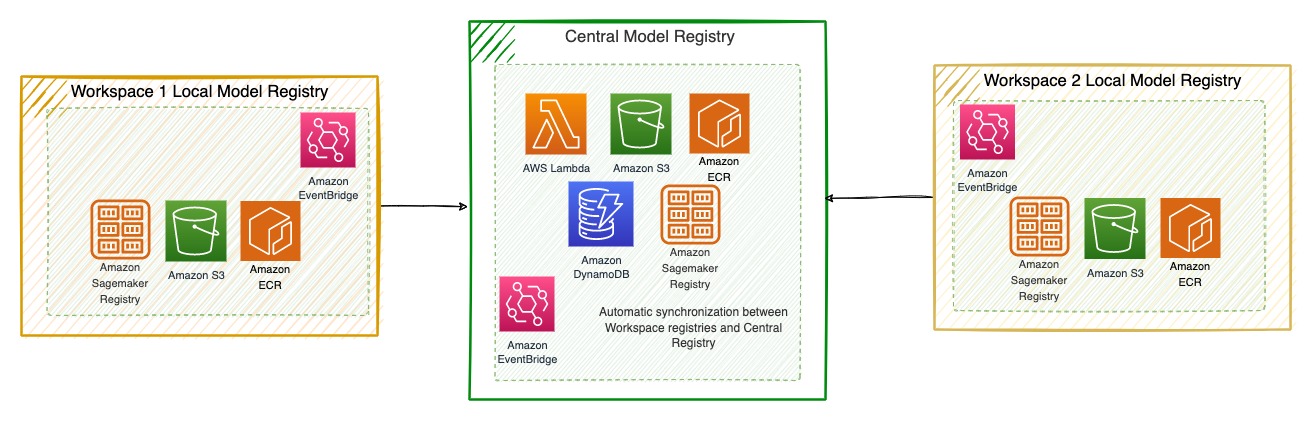

Centralny rejestr modeli

Rejestr modeli stanowi centralne repozytorium wszystkich modeli uczenia maszynowego TR, umożliwia zarządzanie ryzykiem i kondycją tych modeli w znormalizowany sposób w różnych funkcjach biznesowych oraz usprawnia ponowne wykorzystanie potencjalnych modeli. W związku z tym serwis musiał wykonać następujące czynności:

- Zapewnij możliwość rejestrowania zarówno nowych, jak i starszych modeli, opracowanych w SageMaker lub poza nim

- Implementuj przepływy pracy nadzoru, umożliwiając analitykom danych, programistom i zainteresowanym stronom przeglądanie i wspólne zarządzanie cyklem życia modeli

- Zwiększ przejrzystość i współpracę, tworząc scentralizowany widok wszystkich modeli w TR wraz z metadanymi i wskaźnikami kondycji

TR rozpoczęło projektowanie tylko z rejestrem modeli SageMaker, ale jednym z kluczowych wymagań TR jest zapewnienie możliwości rejestrowania modeli utworzonych poza SageMaker. TR ocenił różne relacyjne bazy danych, ale ostatecznie wybrał DynamoDB, ponieważ schemat metadanych dla modeli pochodzących ze starszych źródeł będzie bardzo różny. TR również nie chciał narzucać użytkownikom żadnej dodatkowej pracy, więc zaimplementował bezproblemową automatyczną synchronizację między rejestrami SageMaker obszaru roboczego AI Platform z centralnym rejestrem SageMaker za pomocą Most zdarzeń Amazona zasady i wymagane role IAM. TR rozszerzył rejestr centralny o DynamoDB, aby rozszerzyć możliwości rejestrowania starszych modeli utworzonych na komputerach użytkowników.

Centralny rejestr modeli AI Platform firmy TR jest zintegrowany z portalem AI Platform i zapewnia wizualny interfejs do wyszukiwania modeli, aktualizowania metadanych modeli oraz zrozumienia podstawowych metryk modeli i okresowych niestandardowych metryk monitorowania. Poniższy diagram ilustruje tę architekturę.

Wdrożenie modelu

TR zidentyfikował dwa główne wzorce automatyzacji wdrażania:

- Modele opracowane przy użyciu SageMaker poprzez zadania przekształcania wsadowego SageMaker w celu uzyskania wniosków zgodnie z preferowanym harmonogramem

- Modele opracowane poza SageMaker na lokalnych komputerach stacjonarnych przy użyciu bibliotek open source, dzięki podejściu „wprowadź własny kontener” z wykorzystaniem zadań przetwarzania SageMaker w celu uruchomienia niestandardowego kodu wnioskowania, jako wydajnego sposobu migracji tych modeli bez refaktoryzacji kodu

Dzięki usłudze wdrażania platformy AI użytkownicy TR (analitycy danych i inżynierowie ML) mogą zidentyfikować model z katalogu i wdrożyć zadanie wnioskowania na wybranym koncie AWS, podając wymagane parametry za pośrednictwem przepływu pracy opartego na interfejsie użytkownika.

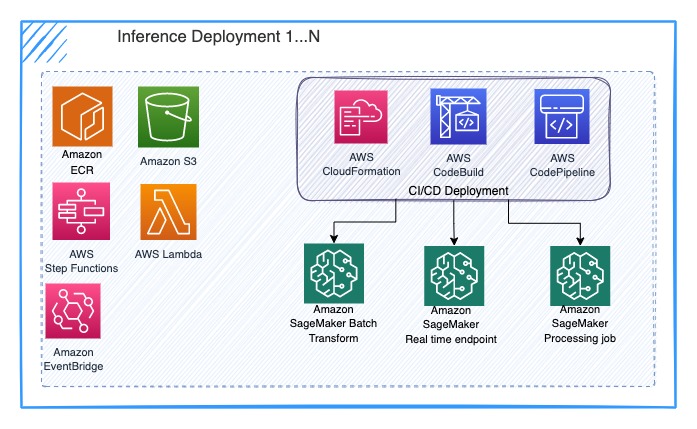

TR zautomatyzował to wdrożenie za pomocą usług AWS DevOps, takich jak AWS Code Pipeline i Tworzenie kodu AWS. TR wykorzystuje funkcje krokowe do orkiestracji przepływu pracy polegającego na odczytywaniu i wstępnym przetwarzaniu danych w celu tworzenia zadań wnioskowania SageMaker. TR wdraża wymagane komponenty jako kod przy użyciu Tworzenie chmury AWS szablony. Poniższy diagram ilustruje tę architekturę.

Monitorowanie modelu

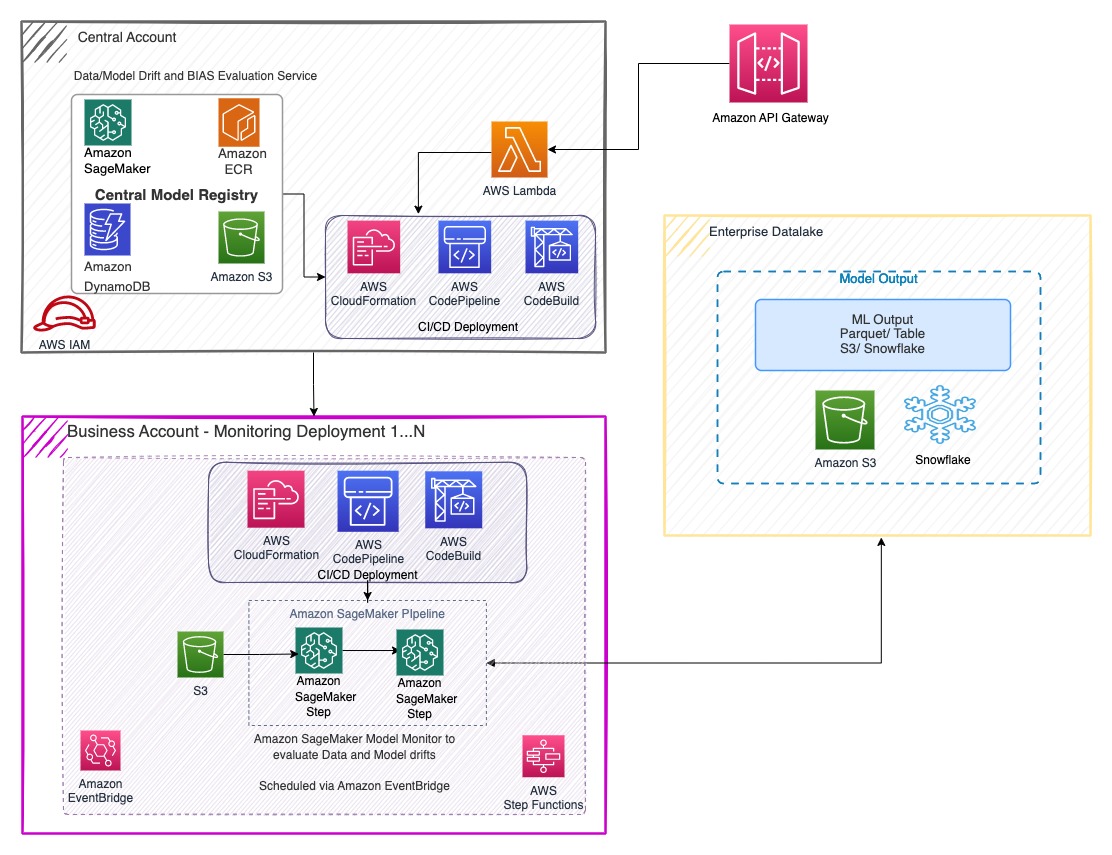

Cykl życia ML nie jest kompletny bez możliwości monitorowania modeli. Zespół zarządzania przedsiębiorstwem TR również upoważnia i zachęca zespoły biznesowe do monitorowania wydajności swoich modeli w czasie, aby sprostać wszelkim wyzwaniom regulacyjnym. TR rozpoczęło się od modeli monitorowania i danych dotyczących dryfu. TR wykorzystał SageMaker Model Monitor, aby zapewnić linię bazową danych i podstawę wnioskowania, aby okresowo monitorować dryfowanie danych i wniosków TR. Wraz z metrykami monitorowania modelu SageMaker, TR rozszerzyło możliwości monitorowania, opracowując niestandardowe metryki specyficzne dla swoich modeli. Pomoże to analitykom danych TR zrozumieć, kiedy należy przeszkolić swój model.

Wraz z monitorowaniem dryfu TR chce również zrozumieć błąd systematyczny w modelach. Gotowe do użycia możliwości SageMaker Clarify są wykorzystywane do budowania usługi stronniczości TR. TR monitoruje stronniczość zarówno danych, jak i modeli oraz udostępnia te metryki swoim użytkownikom za pośrednictwem portalu AI Platform.

Aby pomóc wszystkim zespołom w przyjęciu tych standardów korporacyjnych, TR uczynił te usługi niezależnymi i łatwo dostępnymi za pośrednictwem portalu AI Platform. Zespoły biznesowe TR mogą wejść do portalu i samodzielnie wdrożyć zadanie monitorowania modelu lub zadanie monitorowania odchyleń i uruchomić je zgodnie z preferowanym harmonogramem. Są powiadamiani o stanie zadania i metrykach dla każdego uruchomienia.

TR wykorzystał usługi AWS do wdrażania CI/CD, orkiestracji przepływu pracy, frameworków bezserwerowych i punktów końcowych API do tworzenia mikrousług, które można uruchamiać niezależnie, jak pokazano na poniższej architekturze.

Wyniki i przyszłe ulepszenia

Platforma sztucznej inteligencji TR została uruchomiona w trzecim kwartale 3 r. wraz ze wszystkimi pięcioma głównymi komponentami: usługą danych, obszarem roboczym eksperymentów, centralnym rejestrem modeli, wdrażaniem modeli i monitorowaniem modeli. Firma TR przeprowadziła wewnętrzne sesje szkoleniowe dla swoich jednostek biznesowych w zakresie wdrażania platformy i zaoferowała im filmy szkoleniowe z przewodnikiem.

Platforma AI zapewniła zespołom TR możliwości, które nigdy wcześniej nie istniały; otworzyło szeroki wachlarz możliwości dla zespołu ds. ładu korporacyjnego TR w celu ulepszenia standardów zgodności i scentralizowania rejestru, zapewniając jednolitą panoramę wszystkich modeli ML w TR.

TR przyznaje, że żaden produkt nie jest najlepszy w chwili premiery. Wszystkie komponenty TR są na różnych poziomach dojrzałości, a zespół TR Enterprise AI Platform jest w fazie ciągłego ulepszania, aby iteracyjnie ulepszać funkcje produktu. Bieżący proces rozwoju TR obejmuje dodanie dodatkowych opcji wnioskowania SageMaker, takich jak punkty końcowe w czasie rzeczywistym, asynchroniczne i wielomodelowe. TR planuje również dodać wyjaśnialność modelu jako funkcję do swojej usługi monitorowania modeli. TR planuje wykorzystać możliwości wyjaśniania SageMaker Clarify do rozwijania swojej wewnętrznej usługi wyjaśnialności.

Wnioski

TR może teraz bezpiecznie przetwarzać ogromne ilości danych i wykorzystywać zaawansowane możliwości AWS, aby przenieść projekt ML od pomysłu do produkcji w ciągu kilku tygodni, w porównaniu do miesięcy, które zajmowały wcześniej. Dzięki gotowym funkcjom usług AWS zespoły w TR mogą po raz pierwszy rejestrować i monitorować modele ML, osiągając zgodność z ich zmieniającymi się standardami zarządzania modelami. TR umożliwił analitykom danych i zespołom produktowym skuteczne uwolnienie kreatywności w celu rozwiązywania najbardziej złożonych problemów.

Aby dowiedzieć się więcej o Enterprise AI Platform firmy TR w AWS, sprawdź Sesja AWS re:Invent 2022. Jeśli chcesz dowiedzieć się, jak TR przyspieszyło korzystanie z uczenia maszynowego za pomocą Laboratorium danych AWS programu, zapoznaj się z studium przypadku.

O autorach

Ramdev Wudali jest architektem danych, pomagając w architekturze i budowie platformy AI/ML, aby umożliwić naukowcom i badaczom danych opracowywanie rozwiązań uczenia maszynowego, koncentrując się na analizie danych, a nie na potrzebach infrastruktury. W wolnym czasie uwielbia składać papier, tworząc teselacje origami, i nosić prześmiewcze T-shirty.

Ramdev Wudali jest architektem danych, pomagając w architekturze i budowie platformy AI/ML, aby umożliwić naukowcom i badaczom danych opracowywanie rozwiązań uczenia maszynowego, koncentrując się na analizie danych, a nie na potrzebach infrastruktury. W wolnym czasie uwielbia składać papier, tworząc teselacje origami, i nosić prześmiewcze T-shirty.

Kiran Mantripragada jest starszym dyrektorem AI Platform w Thomson Reuters. Zespół AI Platform jest odpowiedzialny za udostępnianie aplikacji oprogramowania AI klasy produkcyjnej oraz umożliwianie pracy analityków danych i badaczy uczenia maszynowego. Z zamiłowaniem do nauki, sztucznej inteligencji i inżynierii Kiran lubi wypełniać lukę między badaniami a produktywnictwem, aby dostarczać konsumentom końcowym prawdziwą innowację sztucznej inteligencji.

Kiran Mantripragada jest starszym dyrektorem AI Platform w Thomson Reuters. Zespół AI Platform jest odpowiedzialny za udostępnianie aplikacji oprogramowania AI klasy produkcyjnej oraz umożliwianie pracy analityków danych i badaczy uczenia maszynowego. Z zamiłowaniem do nauki, sztucznej inteligencji i inżynierii Kiran lubi wypełniać lukę między badaniami a produktywnictwem, aby dostarczać konsumentom końcowym prawdziwą innowację sztucznej inteligencji.

Bhavana Chirumamilla jest starszym architektem-rezydentem w AWS. Jest pasjonatką operacji na danych i uczenia maszynowego oraz wnosi wiele entuzjazmu, pomagając przedsiębiorstwom w budowaniu strategii dotyczących danych i uczenia maszynowego. W wolnym czasie lubi spędzać czas z rodziną podróżując, wędrując, uprawiając ogród i oglądając filmy dokumentalne.

Bhavana Chirumamilla jest starszym architektem-rezydentem w AWS. Jest pasjonatką operacji na danych i uczenia maszynowego oraz wnosi wiele entuzjazmu, pomagając przedsiębiorstwom w budowaniu strategii dotyczących danych i uczenia maszynowego. W wolnym czasie lubi spędzać czas z rodziną podróżując, wędrując, uprawiając ogród i oglądając filmy dokumentalne.

Srinivasa Shaik jest architektem rozwiązań w firmie AWS z siedzibą w Bostonie. Pomaga klientom korporacyjnym przyspieszyć ich podróż do chmury. Pasjonuje się kontenerami i technologiami uczenia maszynowego. W wolnym czasie lubi spędzać czas z rodziną, gotować i podróżować.

Srinivasa Shaik jest architektem rozwiązań w firmie AWS z siedzibą w Bostonie. Pomaga klientom korporacyjnym przyspieszyć ich podróż do chmury. Pasjonuje się kontenerami i technologiami uczenia maszynowego. W wolnym czasie lubi spędzać czas z rodziną, gotować i podróżować.

Qingwei Li jest specjalistą ds. uczenia maszynowego w Amazon Web Services. Otrzymał tytuł doktora w dziedzinie badań operacyjnych po tym, jak złamał konto grantu badawczego swojego doradcy i nie przekazał obiecanej Nagrody Nobla. Obecnie pomaga klientom z branży usług finansowych i ubezpieczeniowych budować rozwiązania machine learning na AWS. W wolnym czasie lubi czytać i uczyć.

Qingwei Li jest specjalistą ds. uczenia maszynowego w Amazon Web Services. Otrzymał tytuł doktora w dziedzinie badań operacyjnych po tym, jak złamał konto grantu badawczego swojego doradcy i nie przekazał obiecanej Nagrody Nobla. Obecnie pomaga klientom z branży usług finansowych i ubezpieczeniowych budować rozwiązania machine learning na AWS. W wolnym czasie lubi czytać i uczyć.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- Platoblockchain. Web3 Inteligencja Metaverse. Wzmocniona wiedza. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/how-thomson-reuters-built-an-ai-platform-using-amazon-sagemaker-to-accelerate-delivery-of-ml-projects/

- 100

- 2022

- 7

- a

- Zdolny

- O nas

- przyśpieszyć

- przyśpieszony

- dostęp

- dostępny

- Stosownie

- Konto

- Księgowość

- osiągnięty

- osiągnięcia

- nabyć

- w poprzek

- Działania

- Dzieje Apostolskie

- Dodatkowy

- adres

- przyjąć

- zaawansowany

- Po

- AI

- Platforma AI

- Usługi AI

- AI / ML

- Wszystkie kategorie

- pozwala

- wzdłuż

- Amazonka

- Amazon Sage Maker

- Amazon Web Services

- kwoty

- i

- api

- aplikacje

- stosowany

- podejście

- awanse

- zatwierdzenie

- architektura

- na około

- autoryzacja

- zautomatyzować

- zautomatyzowane

- automatycznie

- dostępny

- AWS

- na podstawie

- Baseline

- bo

- zanim

- jest

- BEST

- Najlepsze praktyki

- pomiędzy

- stronniczość

- miliardy

- boston

- BRIDGE

- przynieść

- Przynosi

- Zepsuł się

- budować

- Budowanie

- Buduje

- wybudowany

- ciężar

- biznes

- Funkcje biznesowe

- możliwości

- Etui

- katalog

- kategorie

- powodowany

- centralny

- scentralizowane

- wyzwania

- ZOBACZ

- Wybierając

- wybrany

- dokładnie

- Chmura

- infrastruktura chmurowa

- Cloud Security

- kod

- współpracować

- współpracował

- współpraca

- zbiorowo

- przyjście

- wspólny

- w porównaniu

- kompletny

- kompleks

- kompleksowość

- spełnienie

- zgodny

- składnik

- składniki

- Składa się

- computing

- spożywane

- Konsumenci

- Pojemnik

- Pojemniki

- zawartość

- kontynuować

- ciągły

- kontrola

- rdzeń

- Stwórz

- stworzony

- Tworzenie

- kreatywność

- krytyczny

- istotny

- Aktualny

- Obecnie

- zwyczaj

- Klientów

- dane

- Jezioro danych

- analiza danych

- nauka danych

- Bazy danych

- Podejmowanie decyzji

- głęboko

- głęboka ekspertyza

- Domyślnie

- dostarczyć

- dostawa

- zdemokratyzować

- rozwijać

- Wdrożenie

- wdraża się

- opisać

- Wnętrze

- stacjonarny

- detal

- ustalona

- rozwijać

- rozwinięty

- deweloperzy

- rozwijanie

- oprogramowania

- różne

- trudny

- Dyrektor

- dyskutować

- dokumentalne

- domena

- domeny

- na dół

- Wcześnie

- łatwiej

- z łatwością

- faktycznie

- wydajny

- wysiłek

- upoważniony

- umożliwiać

- włączony

- Umożliwia

- umożliwiając

- zachęca

- Punkt końcowy

- silnik

- Inżynieria

- Inżynierowie

- silniki

- wzmocnione

- zapewnić

- zapewnienie

- Enterprise

- przedsiębiorstwa

- entuzjazm

- Środowisko

- błąd

- niezbędny

- etyczny

- oceniane

- wydarzenia

- EVER

- ewoluuje

- ewoluuje

- przykład

- eksperyment

- ekspertyza

- rozciągać się

- niezwykle

- ułatwiać

- Failed

- członków Twojej rodziny

- Cecha

- Korzyści

- kilka

- finał

- budżetowy

- usługi finansowe

- Znajdź

- znalezieniu

- i terminów, a

- pierwszy raz

- Skupiać

- skupienie

- obserwuj

- następujący

- następujący sposób

- formalny

- Ramy

- od

- Spełnić

- w pełni

- Funkcjonalność

- Funkcje

- przyszłość

- szczelina

- Ogólne

- wygenerowane

- otrzymać

- szkło

- Go

- Gole

- zarządzanie

- przyznać

- Ziemia

- Rozwój

- Prowadzenie

- Ciężko

- Zdrowie

- pomoc

- pomoc

- pomaga

- wysoko

- Hosting

- W jaki sposób

- Jednak

- HTML

- HTTPS

- zidentyfikowane

- zidentyfikować

- identyfikacja

- tożsamość

- zdjęcia

- Rezultat

- wdrożenia

- realizowane

- wykonawczych

- nałożone

- podnieść

- in

- obejmuje

- Zwiększać

- niezależny

- niezależnie

- przemysł

- Infrastruktura

- początkowy

- Innowacja

- spostrzeżenia

- zamiast

- ubezpieczenie

- zintegrowany

- Interfejs

- wewnętrzny

- zaangażowany

- izolacja

- problem

- IT

- Praca

- Oferty pracy

- podróż

- Klawisz

- Wiedzieć

- wiedza

- jezioro

- uruchomić

- uruchomiona

- wodowanie

- UCZYĆ SIĘ

- nauka

- Dziedzictwo

- Regulamin

- poziom

- poziomy

- biblioteki

- LIMIT

- Limity

- relacja na żywo

- miejscowy

- maszyna

- uczenie maszynowe

- zrobiony

- poważny

- WYKONUJE

- Dokonywanie

- zarządzanie

- i konserwacjami

- zarządzający

- mandaty

- sposób

- podręcznik

- wiele

- dojrzałość

- środków

- Użytkownicy

- Metadane

- metodologie

- metryczny

- Metryka

- mikroserwisy

- migrować

- kamień milowy

- Kamienie milowe

- nic

- minut

- Złagodzić

- ML

- model

- modele

- monitor

- monitorowanie

- monitory

- miesięcy

- jeszcze

- większość

- wielokrotność

- Naturalny

- Nawigacja

- Potrzebować

- wymagania

- sieci

- Nowości

- aktualności

- Następny

- nagroda Nobla

- numer

- przedmiot

- okolicznościowy

- oferowany

- oferuje

- Oferty

- Onboard

- ONE

- open source

- otwierany

- operacje

- Opcje

- orkiestracja

- organizacja

- pierwotnie

- zewnętrzne

- własny

- właściciel

- chleb

- Papier

- parametry

- pasja

- namiętny

- wzory

- Ludzie

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- periodycznie

- faza

- rurociąg

- planowanie

- plany

- Platforma

- plato

- Analiza danych Platona

- PlatoDane

- punkt

- polityka

- polityka

- Portal

- możliwości

- Post

- potencjał

- power

- praktyki

- Przewidywania

- Korzystny

- pierwotny

- Zasady

- nagroda

- Problem

- problemy

- wygląda tak

- procesów

- przetwarzanie

- Produkt

- Produkcja

- Produkty

- specjalistów

- Program

- projekt

- projektowanie

- obiecał

- zapewniać

- pod warunkiem,

- zapewnia

- że

- Q3

- q3 2022

- szybko

- zasięg

- nośny

- RE

- osiągnięty

- Czytający

- real

- w czasie rzeczywistym

- Odebrane

- zarejestrować

- rejestr

- regulamin

- regulacyjne

- zwolnić

- wydany

- usunąć

- składnica

- zażądać

- wymagany

- wymagania

- Badania naukowe

- Badacze

- Zasób

- Zasoby

- odpowiedzialny

- Reuters

- Ryzyko

- Rola

- role

- reguły

- run

- sagemaker

- Wnioskowanie SageMakera

- skalowalny

- Skala

- rozkład

- nauka

- Naukowcy

- bezszwowy

- płynnie

- Szukaj

- Wyszukiwarki

- działy

- bezpieczne

- zabezpieczone

- bezpiecznie

- bezpieczeństwo

- wysyłanie

- senior

- wrażliwy

- służyć

- Bezserwerowe

- usługa

- Usługi

- Sesje

- kilka

- Share

- pokazane

- Prosty

- ponieważ

- pojedynczy

- Rozmiar

- rozmiary

- wykwalifikowany

- umiejętności

- Migawka

- So

- Tworzenie

- rozwiązanie

- Rozwiązania

- ROZWIĄZANIA

- Źródła

- specjalista

- specyficzny

- wydać

- Spędzanie

- STAGE

- interesariusze

- normalizująca

- standardy

- rozpoczęty

- rozpocznie

- Zjednoczone

- Rynek

- Ewolucja krok po kroku

- Cel

- przechowywanie

- sklep

- sklep

- strategie

- opływowy

- studio

- taki

- Utrzymany

- Wspierający

- przełączane

- synchronizacja

- stół

- Brać

- podatek

- Nauczanie

- zespół

- Zespoły

- Techniczny

- umiejętności techniczne

- Technologies

- Szablony

- REGULAMIN

- Połączenia

- ich

- w związku z tym

- Thomson Reuters

- Przez

- poprzez

- czas

- do

- narzędzie

- Śledzenie

- tradycyjny

- Pociąg

- Trening

- Przekształcać

- Przezroczystość

- Podróżowanie

- ogromny

- rozsierdzony

- zrozumieć

- jednostka

- jednostek

- rozpętać

- nieograniczone

- Aktualizacja

- posługiwać się

- Użytkownik

- Użytkownicy

- różnorodność

- różnorodny

- Naprawiono

- przez

- Filmy

- Zobacz i wysłuchaj

- widoczność

- oglądania

- sieć

- usługi internetowe

- Web-based

- tygodni

- czy

- Podczas

- szeroki

- Szeroki zasięg

- będzie

- wygrać

- w ciągu

- bez

- Praca

- pracował

- przepływów pracy

- na calym swiecie

- by

- rok

- Twój

- zefirnet