W miarę jak technologie sztucznej inteligencji (AI) i uczenia maszynowego (ML) stały się głównym nurtem, wiele przedsiębiorstw z sukcesem tworzyło w środowisku produkcyjnym krytyczne aplikacje biznesowe oparte na modelach ML. Ponieważ jednak te modele uczenia maszynowego podejmują krytyczne decyzje biznesowe dla firmy, ważne jest, aby przedsiębiorstwa dodały odpowiednie zabezpieczenia w całym cyklu życia uczenia maszynowego. Guardrails zapewniają, że bezpieczeństwo, prywatność i jakość kodu, konfiguracji oraz konfiguracji danych i modelu używanych w cyklu życia modelu są wersjonowane i zachowywane.

Wdrażanie tych barier staje się coraz trudniejsze dla przedsiębiorstw, ponieważ procesy i działania ML w przedsiębiorstwach stają się coraz bardziej złożone ze względu na włączenie głęboko zaangażowanych procesów, które wymagają wkładu wielu interesariuszy i osób. Oprócz inżynierów danych i analityków danych uwzględniono procesy operacyjne w celu automatyzacji i usprawnienia cyklu życia uczenia maszynowego. Ponadto gwałtowny wzrost liczby interesariuszy biznesowych, a w niektórych przypadkach przeglądy prawne i zgodności, wymagają możliwości zwiększenia przejrzystości w zarządzaniu kontrolą dostępu, śledzeniem działań i raportowaniem w całym cyklu życia uczenia maszynowego.

Struktura zapewniająca systematyczny wgląd w rozwój, walidację i wykorzystanie modelu ML nazywa się zarządzaniem ML. Podczas AWS re:Invent 2022, AWS wprowadził nowe narzędzia do zarządzania ML dla Amazon Sage Maker co upraszcza kontrolę dostępu i zwiększa przejrzystość projektów ML. Jednym z narzędzi dostępnych w ramach zarządzania ML jest Karty modelu Amazon SageMaker, który ma możliwość stworzenia jednego źródła prawdy dla informacji o modelu poprzez centralizację i standaryzację dokumentacji w całym cyklu życia modelu.

Karty modeli SageMaker umożliwiają standaryzację sposobu dokumentowania modeli, zapewniając w ten sposób wgląd w cykl życia modelu, od projektowania, przez budowanie, szkolenie i ocenę. Karty modeli mają być pojedynczym źródłem prawdy dla metadanych biznesowych i technicznych na temat modelu, które można wiarygodnie wykorzystać do celów audytu i dokumentacji. Stanowią one arkusz informacyjny modelu, który jest ważny dla zarządzania modelem.

W miarę skalowania modeli, projektów i zespołów jako najlepszą praktykę zalecamy przyjęcie strategii wielu kont, która zapewnia izolację projektów i zespołów na potrzeby opracowywania i wdrażania modeli uczenia maszynowego. Aby uzyskać więcej informacji na temat poprawy zarządzania modelami uczenia maszynowego, zobacz Usprawnij zarządzanie modelami uczenia maszynowego dzięki Amazon SageMaker.

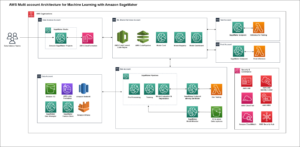

Przegląd architektury

Architektura jest implementowana w następujący sposób:

- Konto analityki danych – badacze danych przeprowadzają swoje eksperymenty w Studio SageMaker i zbuduj konfigurację MLOps, aby wdrożyć modele w środowiskach przejściowych/produkcyjnych przy użyciu Projekty SageMakera.

- Konto usług wspólnych ML — MLOps skonfigurowane na koncie Data Science uruchomią potoki ciągłej integracji i ciągłego dostarczania (CI/CD) przy użyciu Zatwierdzenie kodu AWS i AWS Code Pipeline.

- Konto deweloperskie — potoki CI/CD będą w dalszym ciągu uruchamiać potoki ML na tym koncie, obejmujące wstępne przetwarzanie danych, szkolenie modeli i przetwarzanie końcowe, takie jak ocena i rejestracja modelu. Dane wyjściowe tych potoków zostaną wdrożone w modelu Punkty końcowe programu SageMaker do wykorzystania w celach wnioskowania. W zależności od wymagań dotyczących zarządzania konta Data Science & Dev można połączyć w jedno konto AWS.

- Konto danych — potoki ML działające na koncie dewelopera będą pobierać dane z tego konta.

- Konta testowe i produkcyjne — potoki CI/CD będą kontynuować wdrażanie po utworzeniu konta deweloperskiego w celu skonfigurowania konfiguracji punktu końcowego SageMaker na tych kontach.

- Bezpieczeństwo i zarządzanie — usługi takie jak AWS Identity and Access Management (IAM), AWS IAM Identity Center, AWS CloudTrail, AWS Key Management Service (AWS KMS), Amazon CloudWatch i AWS Security Hub będą używane na tych kontach w ramach bezpieczeństwa i zarządzanie.

Poniższy diagram ilustruje tę architekturę.

Aby uzyskać więcej informacji na temat ustawiania skalowalnej architektury ML dla wielu kont, zobacz Fundacja MLOps dla przedsiębiorstw z Amazon SageMaker.

Nasi klienci potrzebują możliwości udostępniania kart modeli między kontami, aby poprawić widoczność swoich modeli i zarządzanie nimi dzięki informacjom udostępnianym na karcie modelu. Teraz, dzięki udostępnianiu modeli kart dla wielu kont, klienci mogą cieszyć się korzyściami płynącymi ze strategii wielu kont, mając jednocześnie dostęp do modeli kart dostępnych w swojej organizacji, dzięki czemu mogą przyspieszyć współpracę i zapewnić nadzór.

W tym poście pokazujemy, jak skonfigurować karty modeli i uzyskać do nich dostęp na kontach cyklu rozwoju modelu (MDLC), korzystając z nowej funkcji udostępniania kart modelowych między kontami. Najpierw opiszemy scenariusz i architekturę konfigurowania funkcji udostępniania między kontami karty modelowej, a następnie szczegółowo omówimy każdy element konfiguracji współdzielonych kart modeli i uzyskiwania do nich dostępu na różnych kontach, aby poprawić widoczność i zarządzanie modelami.

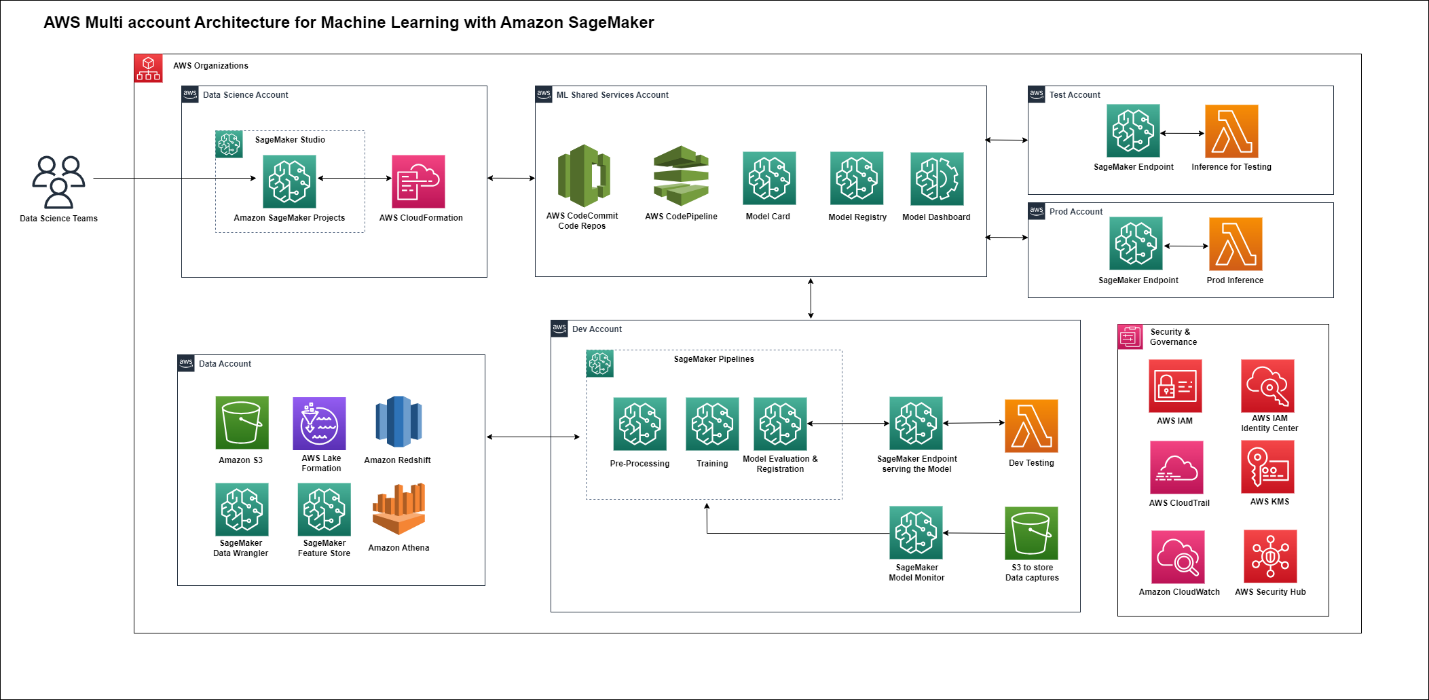

Omówienie rozwiązania

Podczas kompilowania modeli uczenia maszynowego zalecamy skonfigurowanie architektury z wieloma kontami, aby zapewnić izolację obciążenia, poprawiając bezpieczeństwo, niezawodność i skalowalność. W tym poście założymy, że zbudujemy i wdrożymy model dla przypadku użycia rezygnacji klienta. Poniższy diagram architektury przedstawia jedno z zalecanych podejść — scentralizowaną kartę modelu — do zarządzania kartą modelu w architekturze cyklu życia modelu uczenia maszynowego (MDLC) z wieloma kontami. Można jednak zastosować także inne podejście – kartę modelu typu hub-and-szprychy. W tym poście skupimy się wyłącznie na scentralizowanym podejściu do kart modelowych, ale te same zasady można rozszerzyć na podejście typu hub-and-spoke. Główna różnica polega na tym, że każde konto szprychowe będzie utrzymywać własną wersję karty modelowej i będzie posiadać procesy agregowania i kopiowania na scentralizowane konto.

Poniższy diagram ilustruje tę architekturę.

Architektura jest implementowana w następujący sposób:

- Lead Data Scientist zostaje powiadomiony o rozwiązaniu przypadku użycia Customer Churn przy użyciu ML i rozpoczyna projekt ML poprzez utworzenie karty modelowej dla modelu Customer Churn V1 w statusie Wersja robocza na koncie usług wspólnych ML

- Dzięki automatyzacji ta karta modelu jest udostępniana kontu ML Dev

- Analityk danych buduje model i zaczyna wprowadzać informacje za pośrednictwem interfejsów API do karty modelu w oparciu o wyniki eksperymentów, a stan karty modelu jest ustawiony na Oczekuje na sprawdzenie

- Dzięki automatyzacji ta karta modelu jest udostępniana kontu testowemu ML

- Inżynier ML (MLE) przeprowadza testy integracyjne i walidacyjne na koncie ML Test, a model w rejestrze centralnym jest oznaczony jako Oczekujący na zatwierdzenie

- Osoba zatwierdzająca model przegląda wyniki modelu z dokumentacją uzupełniającą dostarczoną na centralnej karcie modelu i zatwierdza kartę modelu do wdrożenia produkcyjnego.

- Dzięki automatyzacji ten model karty jest udostępniany kontu ML Prod w trybie tylko do odczytu.

Wymagania wstępne

Zanim zaczniesz, upewnij się, że masz następujące wymagania wstępne:

- dwa Konta AWS.

- Na obu kontach AWS rola federacyjna IAM z uprawnieniami administratora umożliwiającymi wykonywanie następujących czynności:

- Twórz, edytuj, przeglądaj i usuwaj karty modeli w Amazon SageMaker.

- Twórz, edytuj, przeglądaj i usuwaj udział zasobów w pamięci RAM AWS.

Aby uzyskać więcej informacji, zobacz Przykładowe zasady uprawnień dla pamięci RAM AWS.

Konfigurowanie udostępniania kart modelowych

Rachunkiem karty modelowej jest konto, na którym tworzone są karty modelowe. Użytkownicy na koncie karty modelowej udostępniają je na kontach współdzielonych, gdzie można je aktualizować. Użytkownicy konta karty modelowej mogą udostępniać swoje karty modelowe Menedżer dostępu do zasobów AWS (AWS RAM). AWS RAM pomaga dzielić zasoby między kontami AWS.

W poniższej sekcji pokażemy, jak udostępniać karty modeli.

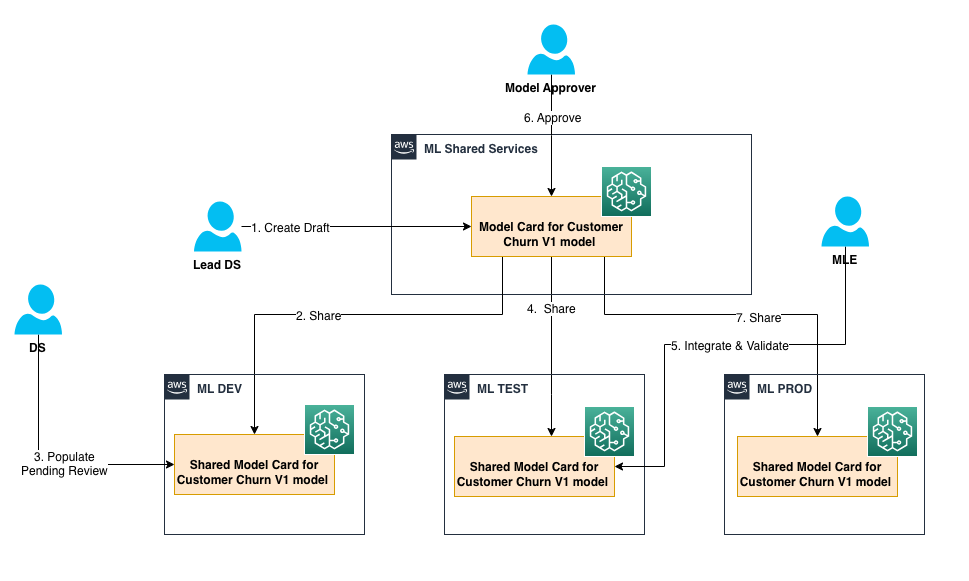

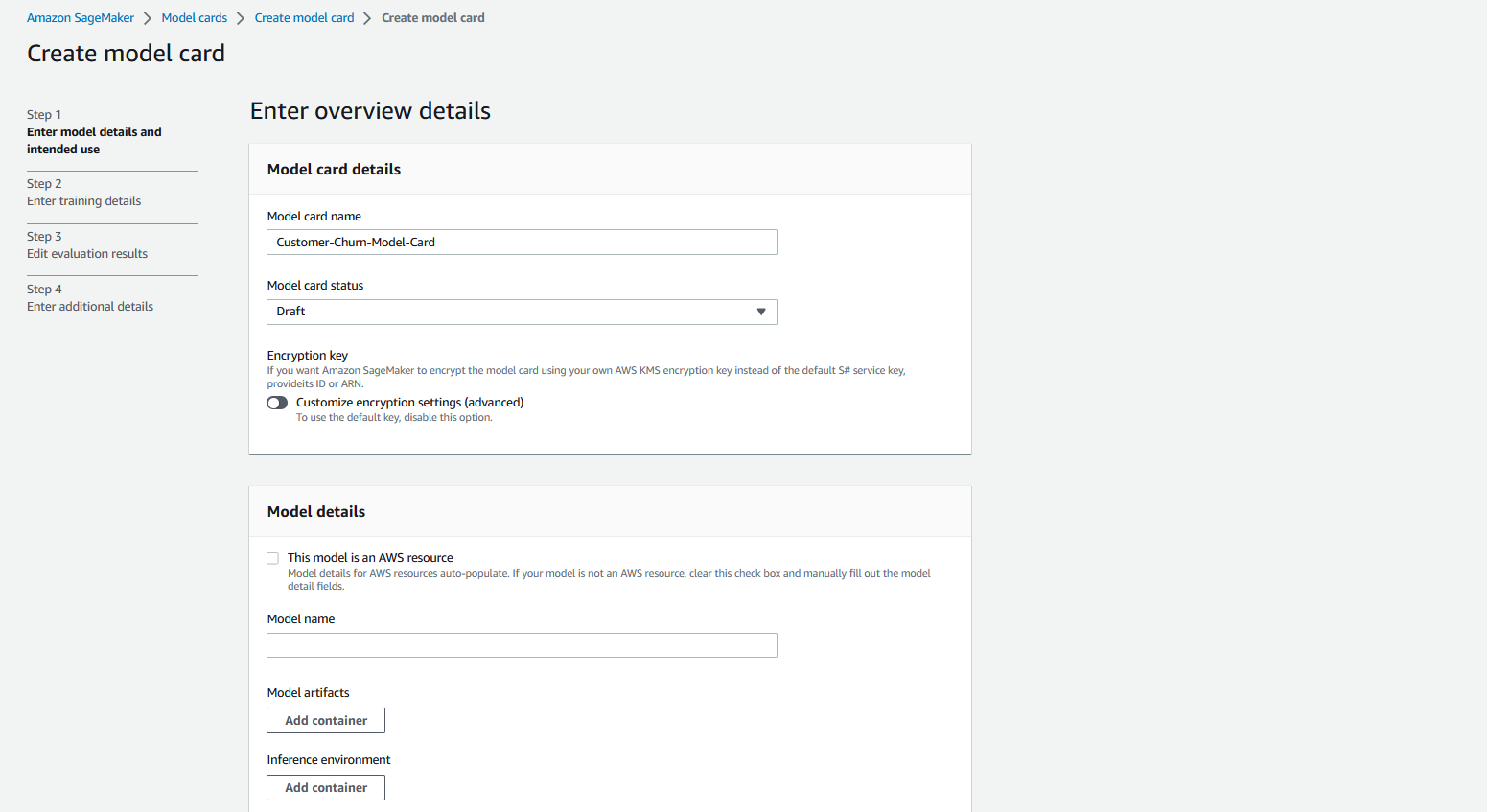

Najpierw utwórz kartę modelową dla przypadku użycia rezygnacji klienta, jak opisano wcześniej. W konsoli Amazon SageMaker rozwiń sekcję Zarządzanie i wybierz Karty modeli.

Tworzymy kartę modelu w Projekt stan z nazwą Karta modelu rezygnacji klienta. Aby uzyskać więcej informacji, zobacz Utwórz kartę modelu. W tej demonstracji możesz pozostawić pozostałe pola puste i utworzyć kartę modelu.

Alternatywnie możesz użyć następującego polecenia AWS CLI, aby utworzyć kartę modelu:

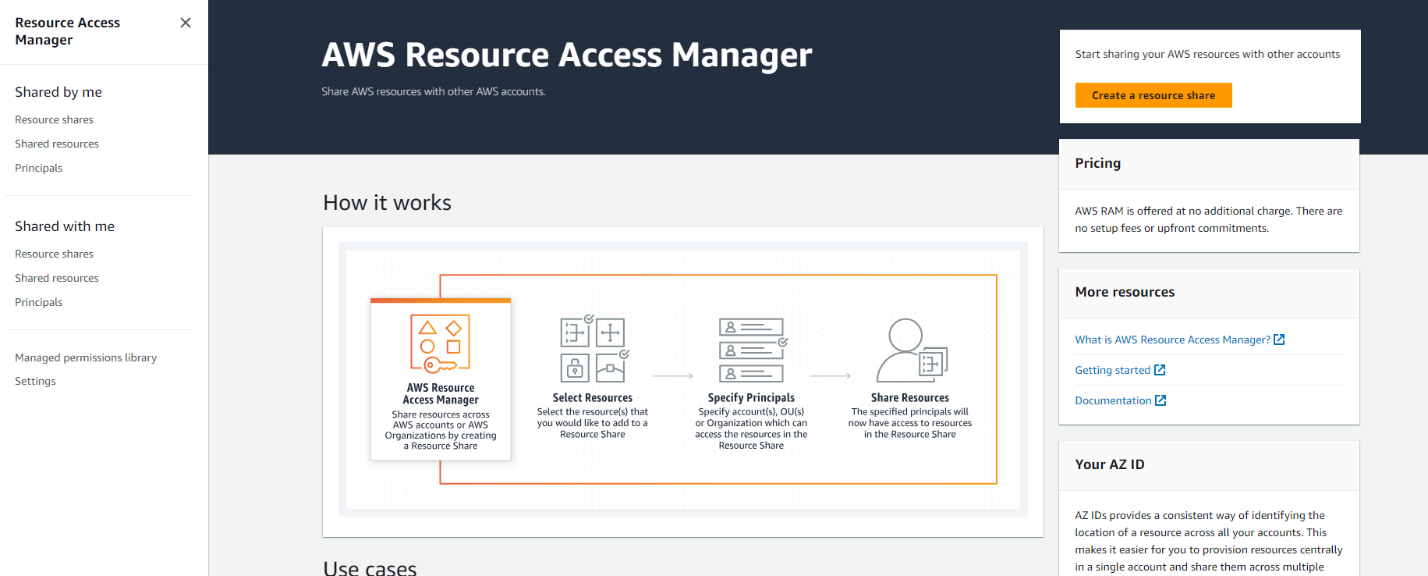

Teraz utwórz udział dla wielu kont, korzystając z pamięci RAM AWS. W konsoli AWS RAM wybierz Utwórz udział zasobów.

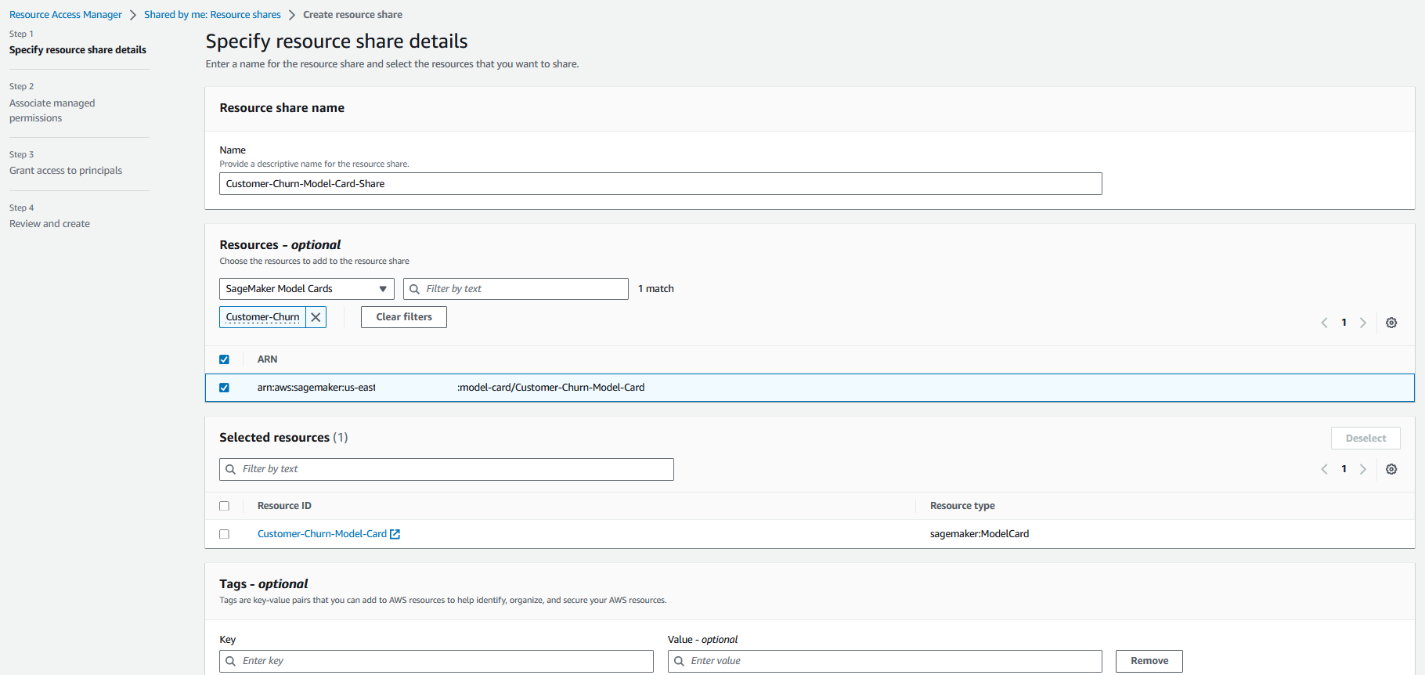

Wprowadź nazwę udziału w zasobach, na przykład „Customer-Churn-Model-Card-Share”. W zasobach – fakultatywny sekcji wybierz typ zasobu jako Karty modeli SageMaker. Na liście pojawi się karta modelu, którą utworzyliśmy w poprzednim kroku.

Wybierz ten model, a pojawi się on w sekcji Wybrane zasoby. Wybierz ponownie ten zasób, jak pokazano w poniższych krokach, i wybierz Następna.

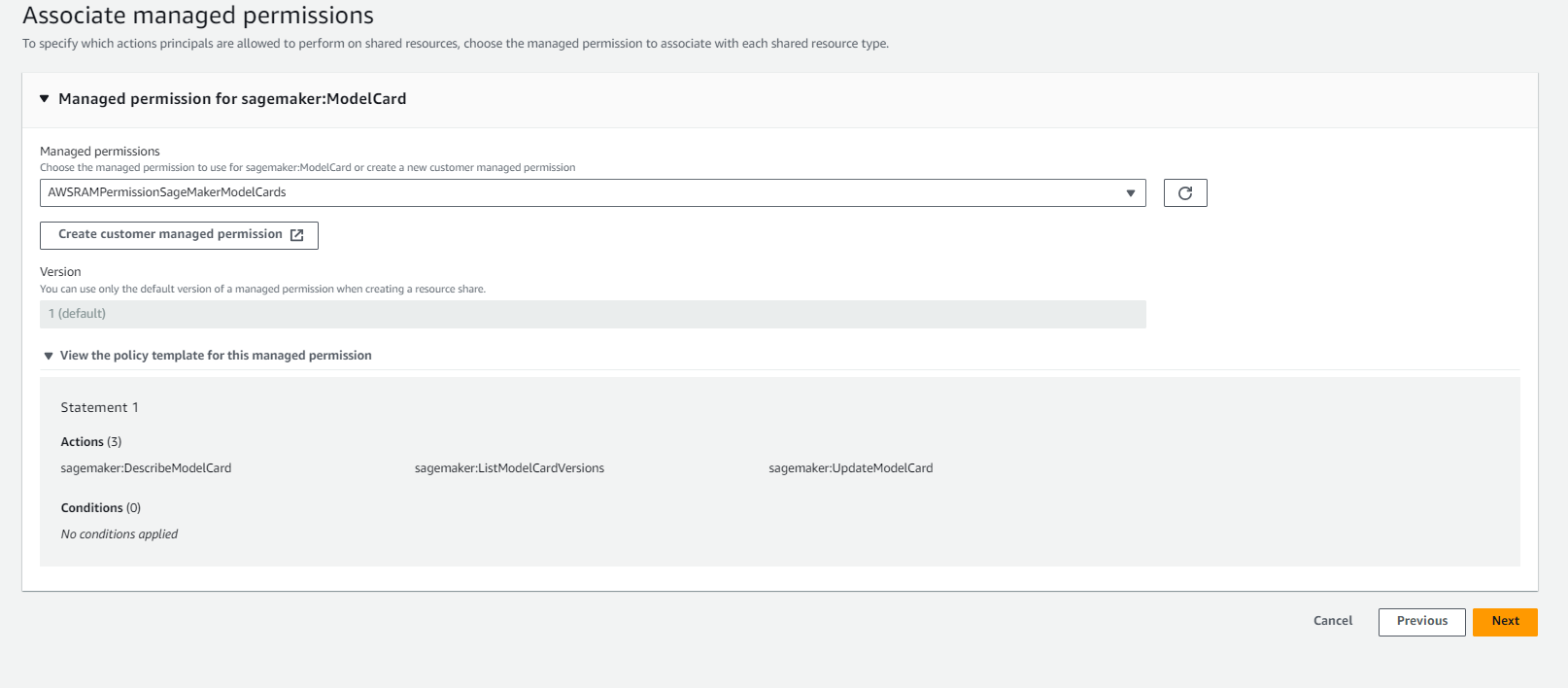

Na następnej stronie możesz wybrać uprawnienia zarządzane. Możesz utworzyć niestandardowe uprawnienia lub użyć opcji domyślnej „AWSRAMPermissionSageMakerModelCards”I wybierz Następna. Aby uzyskać więcej informacji, zobacz Zarządzanie uprawnieniami w AWS RAM.

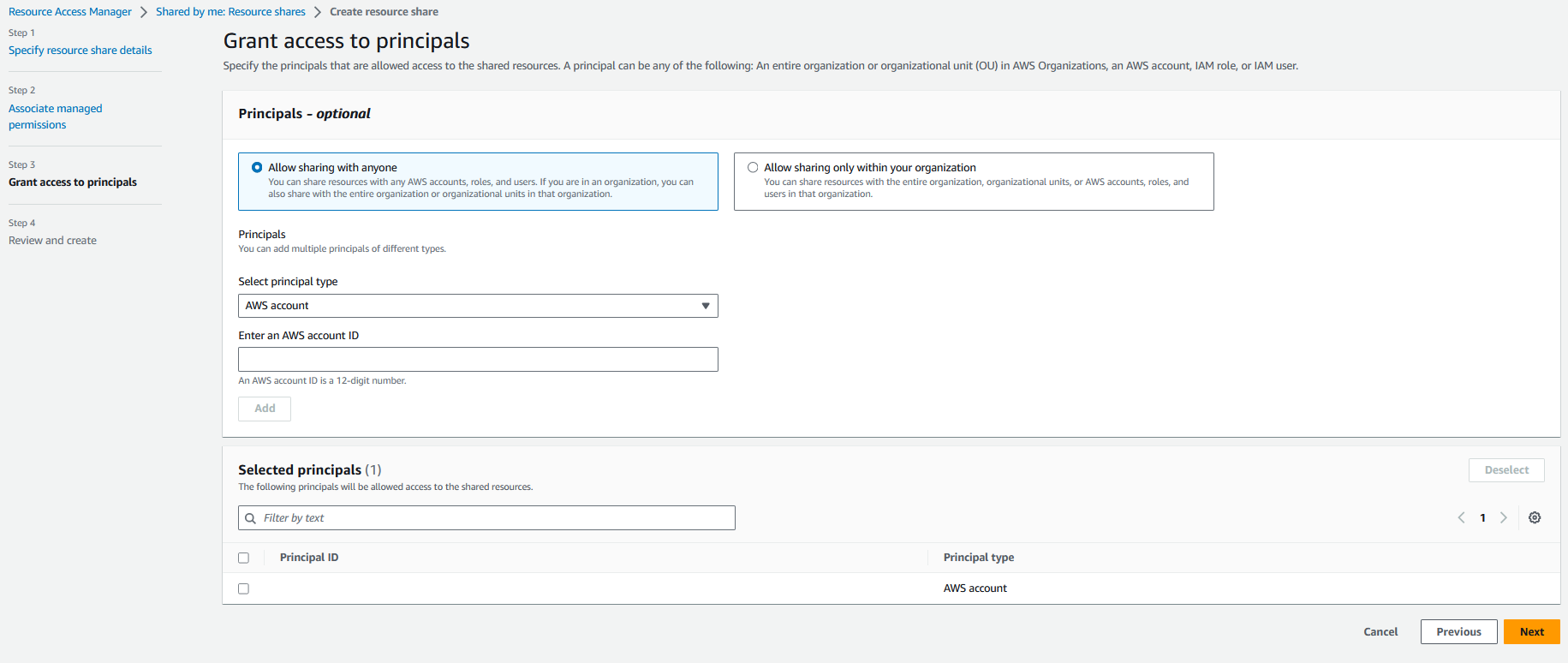

Na następnej stronie możesz wybrać Podmioty zabezpieczeń. W obszarze Wybierz typ podmiotu zabezpieczeń wybierz Konto AWS i wprowadź identyfikator rachunku udostępnionego modelu karty. Wybierać Dodaj i przejdź do następnej strony.

Na ostatniej stronie przejrzyj informacje i wybierz „Utwórz udział w zasobach”. Alternatywnie możesz użyć poniższych AWS CLI . polecenie utworzenia udziału zasobów:

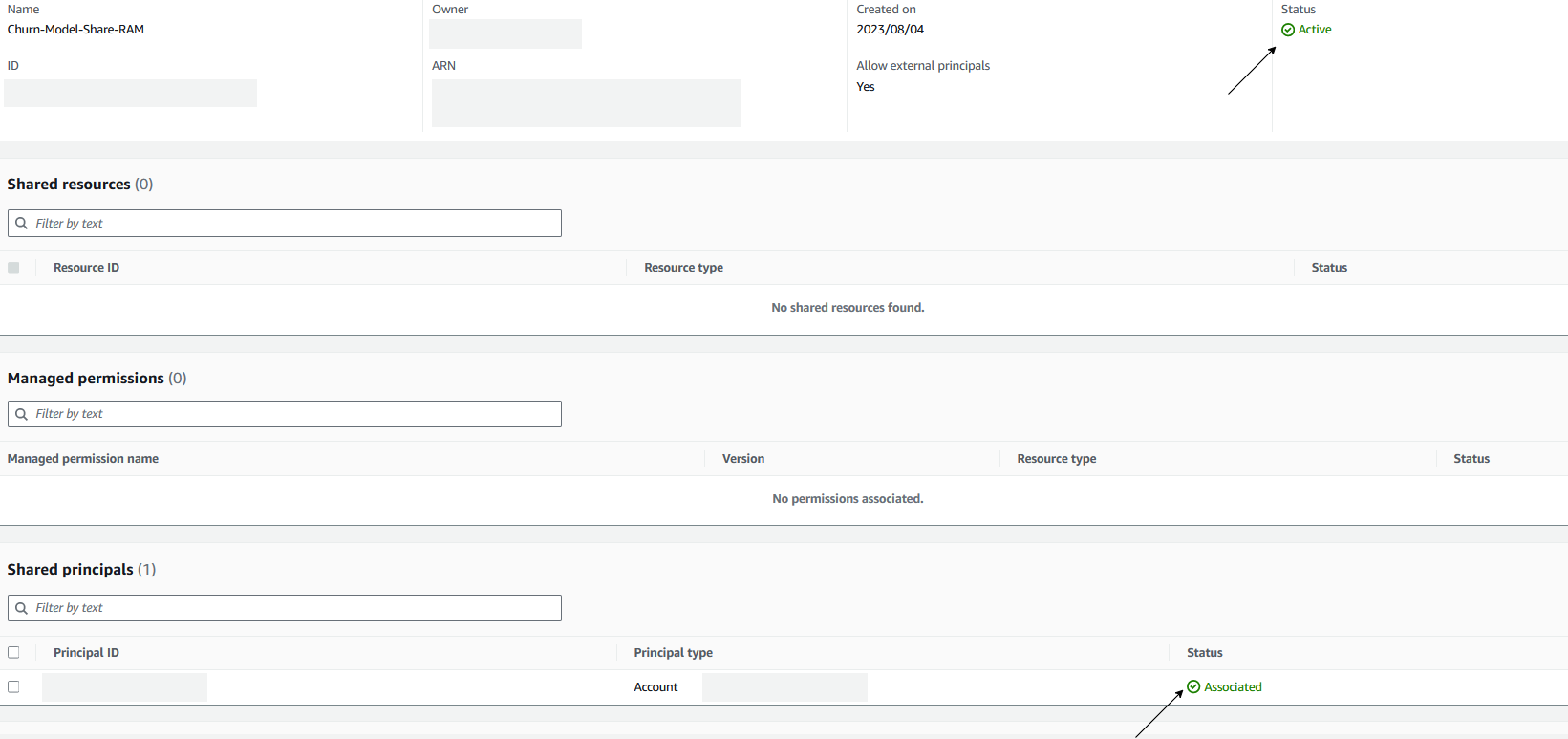

W konsoli AWS RAM zobaczysz atrybuty udziału zasobów. Upewnij się, że zasoby udostępnione, uprawnienia zarządzane i podmioty zabezpieczeń udostępnione znajdują się w „Associated” stan.

Po użyciu pamięci RAM AWS do utworzenia udziału zasobów podmiotom zabezpieczeń określonym w udziale zasobów można przyznać dostęp do zasobów udziału.

- Jeśli włączysz udostępnianie pamięci RAM AWS organizacjom AWS, a podmioty zabezpieczeń, którym udostępniasz dane, znajdują się w tej samej organizacji co konto udostępniania, podmioty zabezpieczeń te będą mogły uzyskać dostęp, gdy tylko administrator konta przyzna im uprawnienia.

- Jeśli nie włączysz udostępniania pamięci RAM AWS organizacjom, nadal możesz udostępniać zasoby poszczególnym kontom AWS w Twojej organizacji. Administrator konta korzystającego otrzymuje zaproszenie do przyłączenia się do udziału zasobów i musi zaakceptować zaproszenie, zanim podmioty zabezpieczeń określone w udziale zasobów będą mogły uzyskać dostęp do udostępnionych zasobów.

- Możesz także udostępniać treści kontom spoza organizacji, jeśli typ zasobu to obsługuje. Administrator konta korzystającego otrzymuje zaproszenie do przyłączenia się do udziału zasobów i musi zaakceptować zaproszenie, zanim podmioty zabezpieczeń określone w udziale zasobów będą mogły uzyskać dostęp do udostępnionych zasobów.

Aby uzyskać więcej informacji na temat pamięci RAM AWS, zobacz Terminy i koncepcje dotyczące pamięci RAM AWS.

Dostęp do udostępnionych kart modeli

Teraz możemy zalogować się na wspólne konto AWS, aby uzyskać dostęp do karty modelu. Upewnij się, że uzyskujesz dostęp do konsoli AWS przy użyciu uprawnień IAM (rola IAM), które umożliwiają dostęp do pamięci RAM AWS.

Dzięki AWS RAM możesz przeglądać udziały zasobów, do których zostałeś dodany, udostępnione zasoby, do których masz dostęp, oraz konta AWS, które udostępniły Ci zasoby. Możesz także opuścić udział zasobu, gdy nie potrzebujesz już dostępu do jego udostępnionych zasobów.

Aby wyświetlić kartę modelu na współdzielonym koncie AWS:

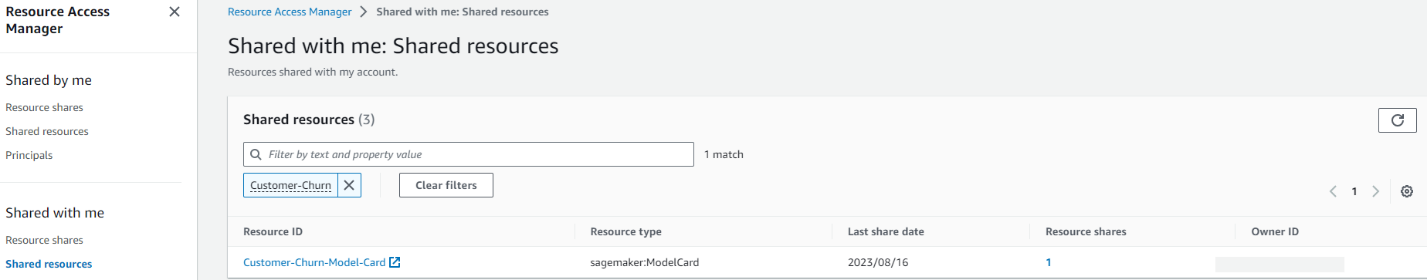

- Nawiguj do Udostępnione mi: udostępnione zasoby strona w konsoli AWS RAM.

- Upewnij się, że działasz w tym samym regionie AWS, w którym utworzono udział.

- Model udostępniony z konta modelki będzie dostępny w aukcji. Jeśli lista zasobów jest długa, możesz zastosować filtr, aby znaleźć określone zasoby udostępnione. Możesz zastosować wiele filtrów, aby zawęzić wyszukiwanie.

- Dostępne są następujące informacje:

- Identyfikator zasobu – Identyfikator zasobu. Jest to nazwa karty modelu, którą utworzyliśmy wcześniej w koncie karty modelu.

- Typ zasobu – Rodzaj zasobu.

- Data ostatniego udostępnienia – Data udostępnienia Ci zasobu.

- Udziały zasobów – Liczba udziałów zasobu, w których znajduje się zasób. Wybierz wartość, aby wyświetlić udziały w zasobach.

- Identyfikator właściciela – Identyfikator podmiotu zabezpieczeń będącego właścicielem zasobu.

Dostęp do karty modelu można również uzyskać za pomocą opcji AWS CLI. W przypadku polityki AWS IAM skonfigurowanej z poprawnymi poświadczeniami upewnij się, że masz uprawnienia do tworzenia, edytowania i usuwania kart modeli w Amazon SageMaker. Aby uzyskać więcej informacji, zobacz Skonfiguruj interfejs AWS CLI.

Jako szablonu możesz użyć następującej polityki uprawnień AWS IAM:

Możesz uruchomić następujące polecenie AWS CLI, aby uzyskać dostęp do szczegółów udostępnionej karty modelu.

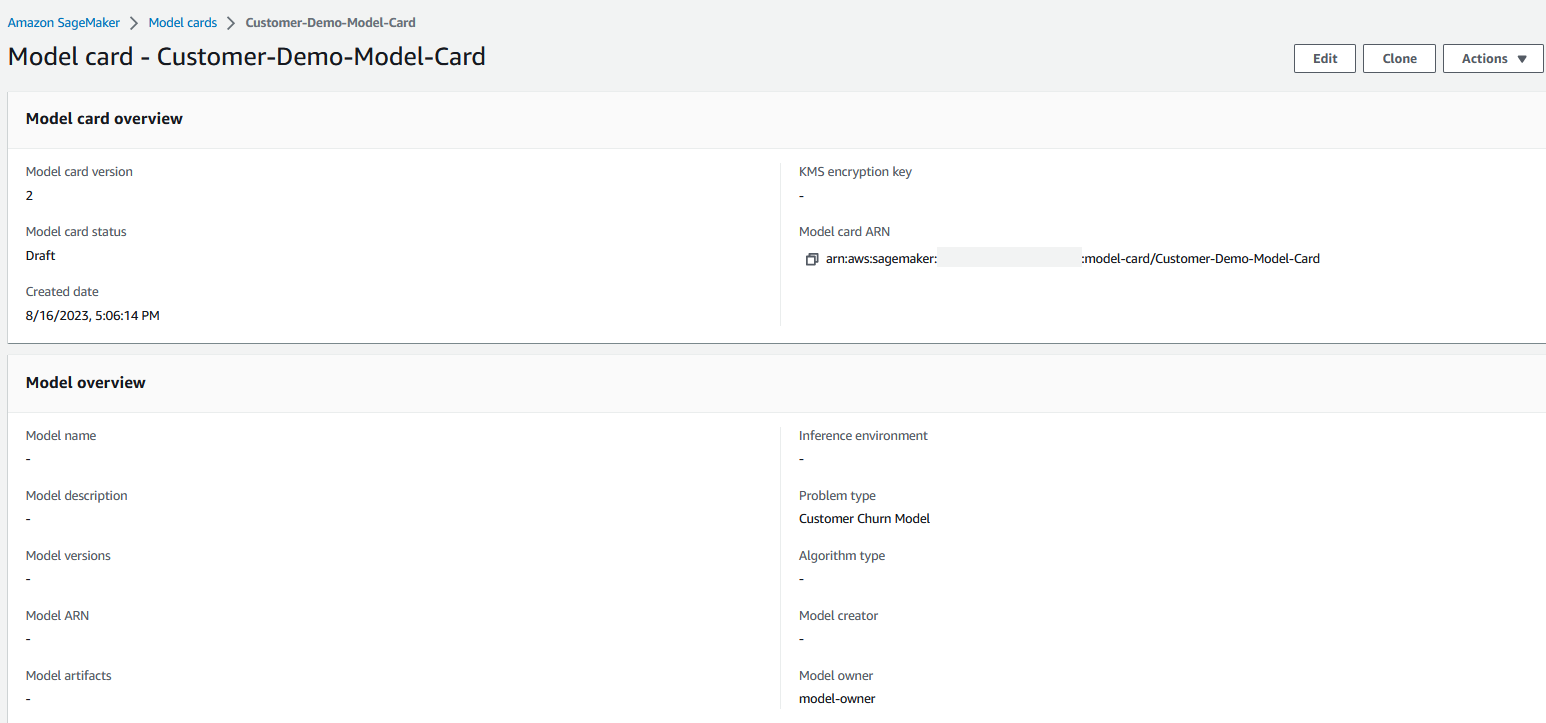

Teraz możesz wprowadzać zmiany na karcie tego modelu z tego konta.

Po dokonaniu zmian wróć do konta karty modelowej, aby zobaczyć zmiany, które wprowadziliśmy na tym koncie współdzielonym.

Typ problemu został zaktualizowany do „Customer Churn Model”, który udostępniliśmy jako część danych wejściowych polecenia AWS CLI.

Sprzątać

Możesz teraz usunąć utworzoną kartę modelu. Upewnij się, że usunąłeś udział zasobów AWS RAM utworzony w celu udostępnienia karty modelu.

Wnioski

W tym poście przedstawiliśmy omówienie architektury wielokontowej umożliwiającej bezpieczne i niezawodne skalowanie obciążeń ML i zarządzanie nimi. Omówiliśmy wzorce architektury służące do konfigurowania udostępniania kart modelowych i zilustrowaliśmy, jak działają scentralizowane wzorce udostępniania kart modelowych. Na koniec skonfigurowaliśmy udostępnianie kart modeli na wielu kontach, aby poprawić widoczność i zarządzanie w cyklu życia rozwoju modelu. Zachęcamy do wypróbowania nowej funkcji udostępniania kart modelowych i podzielenia się z nami swoją opinią.

O autorach

Vishal Naik jest starszym architektem rozwiązań w Amazon Web Services (AWS). Jest konstruktorem, który lubi pomagać klientom w realizacji ich potrzeb biznesowych i rozwiązywaniu złożonych problemów za pomocą rozwiązań AWS i najlepszych praktyk. Jego główne obszary zainteresowań to uczenie maszynowe, DevOps i kontenery. W wolnym czasie Vishal uwielbia kręcić krótkie filmy o podróżach w czasie i alternatywnej tematyce wszechświata.

Vishal Naik jest starszym architektem rozwiązań w Amazon Web Services (AWS). Jest konstruktorem, który lubi pomagać klientom w realizacji ich potrzeb biznesowych i rozwiązywaniu złożonych problemów za pomocą rozwiązań AWS i najlepszych praktyk. Jego główne obszary zainteresowań to uczenie maszynowe, DevOps i kontenery. W wolnym czasie Vishal uwielbia kręcić krótkie filmy o podróżach w czasie i alternatywnej tematyce wszechświata.

Rama Vittal jest głównym architektem rozwiązań ML w AWS. Ma ponad 20-letnie doświadczenie w architekturze i budowaniu aplikacji rozproszonych, hybrydowych i chmurowych. Pasjonuje się tworzeniem bezpiecznych i skalowalnych rozwiązań AI/ML i big data, aby pomóc klientom korporacyjnym w ich wdrażaniu i optymalizacji w chmurze w celu poprawy wyników biznesowych. W wolnym czasie jeździ na motocyklu i spaceruje ze swoją 2-letnią owcą-doodlem!

Rama Vittal jest głównym architektem rozwiązań ML w AWS. Ma ponad 20-letnie doświadczenie w architekturze i budowaniu aplikacji rozproszonych, hybrydowych i chmurowych. Pasjonuje się tworzeniem bezpiecznych i skalowalnych rozwiązań AI/ML i big data, aby pomóc klientom korporacyjnym w ich wdrażaniu i optymalizacji w chmurze w celu poprawy wyników biznesowych. W wolnym czasie jeździ na motocyklu i spaceruje ze swoją 2-letnią owcą-doodlem!

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Motoryzacja / pojazdy elektryczne, Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- ChartPrime. Podnieś poziom swojej gry handlowej dzięki ChartPrime. Dostęp tutaj.

- Przesunięcia bloków. Modernizacja własności offsetu środowiskowego. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/use-amazon-sagemaker-model-card-sharing-to-improve-model-governance/

- :ma

- :Jest

- :Gdzie

- $W GÓRĘ

- 10

- 100

- 20

- 20 roku

- 2022

- 361

- 7

- 700

- 9

- a

- O nas

- przyśpieszyć

- Akceptuj

- dostęp

- dostępność

- Dostęp

- wykonać

- Konto

- Konta

- osiągnięcia

- w poprzek

- Działania

- zajęcia

- działalność

- Dodaj

- w dodatku

- dodatek

- do tego

- przyjąć

- Przyjęcie

- Po

- ponownie

- agregat

- AI

- AI / ML

- dopuszczać

- również

- Amazonka

- Amazon Sage Maker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- i

- Inne

- Pszczoła

- zjawić się

- aplikacje

- Aplikuj

- podejście

- awanse

- architektura

- SĄ

- POWIERZCHNIA

- sztuczny

- sztuczna inteligencja

- Sztuczna inteligencja (AI)

- AS

- założyć

- At

- atrybuty

- audytu

- zautomatyzować

- Automatyzacja

- dostępny

- AWS

- Zarządzanie tożsamością i dostępem AWS (IAM)

- AWS re: Invent

- z powrotem

- na podstawie

- BE

- bo

- stają się

- staje

- być

- zanim

- Korzyści

- BEST

- Najlepsze praktyki

- Duży

- Big Data

- obie

- budować

- budowniczy

- Budowanie

- Buduje

- biznes

- Aplikacje biznesowe

- ale

- by

- nazywa

- CAN

- możliwości

- zdolność

- karta

- Kartki okolicznosciowe

- walizka

- Etui

- Centrum

- centralny

- scentralizowane

- wyzwania

- Zmiany

- Dodaj

- Chmura

- adopcja chmury

- kod

- współpraca

- kompleks

- spełnienie

- składnik

- Koncepcje

- Prowadzenie

- systemu

- skonfigurowany

- Konsola

- spożywane

- Pojemniki

- kontynuować

- ciągły

- składki

- kontrola

- rdzeń

- skorygowania

- pokrycie

- Stwórz

- stworzony

- tworzenie

- Listy uwierzytelniające

- krytyczny

- zwyczaj

- klient

- Klientów

- dane

- nauka danych

- naukowiec danych

- Data

- Decyzje

- głęboko

- Domyślnie

- dostawa

- W zależności

- rozwijać

- wdrażanie

- Wdrożenie

- opisać

- opisane

- projektowanie

- detale

- dev

- oprogramowania

- różnica

- omówione

- dystrybuowane

- nurkować

- do

- dokumentacja

- nie

- projekt

- z powodu

- podczas

- każdy

- Wcześniej

- efekt

- umożliwiać

- zachęcać

- Punkt końcowy

- inżynier

- Inżynierowie

- Poprawia

- cieszyć się

- zapewnić

- Wchodzę

- Enterprise

- przedsiębiorstwa

- środowiska

- ewaluację

- przykład

- Rozszerzać

- doświadczenie

- eksperymenty

- fakt

- Cecha

- Federacja

- informacja zwrotna

- Łąka

- filmy

- filtrować

- filtry

- W końcu

- Znajdź

- i terminów, a

- Skupiać

- następujący

- następujący sposób

- W razie zamówieenia projektu

- Fundacja

- Framework

- od

- dalej

- otrzymać

- miejsce

- daje

- Go

- zarządzanie

- rządzić

- udzielony

- Dotacje

- miał

- trudniej

- Have

- mający

- he

- pomoc

- pomoc

- pomaga

- jego

- W jaki sposób

- How To

- Jednak

- HTML

- HTTPS

- Piasta

- Hybrydowy

- ID

- tożsamość

- if

- ilustruje

- realizowane

- ważny

- podnieść

- poprawy

- in

- włączony

- obejmuje

- włączenie

- indywidualny

- Informacja

- wkład

- integracja

- Inteligencja

- zamierzony

- najnowszych

- wprowadzono

- zaproszenie

- zaangażowany

- izolacja

- IT

- JEGO

- przystąpić

- podróż

- jpg

- Klawisz

- Wiedzieć

- Nazwisko

- nauka

- Pozostawiać

- Regulamin

- niech

- wifecycwe

- lubić

- Lista

- wymienianie kolejno

- log

- długo

- dłużej

- kocha

- maszyna

- uczenie maszynowe

- zrobiony

- Główny

- Mainstream

- utrzymać

- robić

- Dokonywanie

- zarządzane

- i konserwacjami

- kierownik

- zarządzający

- wiele

- wyraźny

- me

- Metadane

- ML

- MLOps

- Moda

- model

- modele

- jeszcze

- motocykl

- wielo

- wielokrotność

- musi

- Nazwa

- wąski

- Potrzebować

- wymagania

- Nowości

- Następny

- Nie

- już dziś

- numer

- of

- on

- ONE

- tylko

- operacyjny

- operacyjny

- optymalizacja

- Option

- or

- organizacja

- organizacji

- na zewnątrz

- wyniki

- wydajność

- zewnętrzne

- koniec

- przegląd

- własny

- posiada

- strona

- część

- namiętny

- wzory

- w oczekiwaniu

- uprawnienia

- plato

- Analiza danych Platona

- PlatoDane

- polityka

- polityka

- Post

- powered

- praktyka

- praktyki

- warunki wstępne

- poprzedni

- poprzednio

- Główny

- zleceniodawcy

- Zasady

- prywatność

- Problem

- procesów

- przetwarzanie

- Produkcja

- projekt

- projektowanie

- właściwy

- zapewniać

- pod warunkiem,

- zapewnia

- cele

- jakość

- RAM

- RE

- Tryb tylko do odczytu

- otrzymać

- otrzymuje

- polecić

- Zalecana

- region

- Rejestracja

- rejestr

- niezawodność

- reszta

- Raportowanie

- wymagać

- wymagania

- Zasób

- Zasoby

- Efekt

- przeglądu

- Recenzje

- Rola

- run

- bieganie

- działa

- sagemaker

- taki sam

- Skalowalność

- skalowalny

- Skala

- skalowaniem

- scenariusz

- nauka

- Naukowiec

- Naukowcy

- Szukaj

- Sekcja

- bezpieczne

- bezpiecznie

- bezpieczeństwo

- widzieć

- wybrany

- usługa

- Usługi

- zestaw

- ustawienie

- ustawienie

- Share

- shared

- Akcje

- dzielenie

- arkusz

- Short

- pokazać

- pokazane

- Targi

- ponieważ

- pojedynczy

- So

- Rozwiązania

- ROZWIĄZANIA

- kilka

- wkrótce

- Źródło

- specyficzny

- określony

- interesariusze

- normalizująca

- początek

- rozpoczęty

- rozpocznie

- Zestawienie sprzedaży

- Rynek

- Ewolucja krok po kroku

- Cel

- Nadal

- Strategia

- opływowy

- udany

- Wspierający

- podpory

- pewnie

- powstaje

- zespół

- Zespoły

- Techniczny

- Technologies

- szablon

- test

- Testy

- że

- Połączenia

- Informacje

- ich

- Im

- motywy

- następnie

- Tam.

- a tym samym

- Te

- one

- to

- tych

- Przez

- poprzez

- czas

- podróż w czasie

- do

- narzędzia

- Śledzenie

- Trening

- Przezroczystość

- podróżować

- wyzwalać

- Prawda

- próbować

- SKRĘCAĆ

- rodzaj

- dla

- Wszechświat

- zaktualizowane

- us

- Stosowanie

- posługiwać się

- przypadek użycia

- używany

- Użytkownicy

- za pomocą

- v1

- uprawomocnienie

- wartość

- wersja

- przez

- Zobacz i wysłuchaj

- vishal

- widoczność

- była

- we

- sieć

- usługi internetowe

- jeśli chodzi o komunikację i motywację

- który

- Podczas

- KIM

- będzie

- w

- w ciągu

- Praca

- lat

- You

- Twój

- zefirnet