Ten post powstał we współpracy z Bhajandeepem Singhiem i Ajayem Vishwakarmą z praktyki AWS AI/ML firmy Wipro.

Wiele organizacji korzysta z kombinacji rozwiązań lokalnych i rozwiązań do nauki o danych typu open source do tworzenia modeli uczenia maszynowego (ML) i zarządzania nimi.

Zespoły zajmujące się analizą danych i DevOps mogą stanąć przed wyzwaniami związanymi z zarządzaniem tymi izolowanymi stosami narzędzi i systemami. Integracja wielu stosów narzędzi w celu zbudowania kompaktowego rozwiązania może obejmować tworzenie niestandardowych łączników lub przepływów pracy. Zarządzanie różnymi zależnościami w oparciu o bieżącą wersję każdego stosu i utrzymywanie tych zależności wraz z wydaniem nowych aktualizacji każdego stosu komplikuje rozwiązanie. Zwiększa to koszty utrzymania infrastruktury i zmniejsza produktywność.

Oferta sztucznej inteligencji (AI) i uczenia maszynowego (ML) od Amazon Web Services (AWS)wraz ze zintegrowanymi usługami monitorowania i powiadamiania pomagają organizacjom osiągnąć wymagany poziom automatyzacji, skalowalności i jakości modeli przy optymalnych kosztach. AWS pomaga także zespołom zajmującym się analizą danych i DevOps współpracować oraz usprawnia cały proces cyklu życia modelu.

Portfolio usług ML AWS obejmuje solidny zestaw usług, których można użyć do przyspieszenia rozwoju, szkolenia i wdrażania aplikacji do uczenia maszynowego. Pakietu usług można używać do obsługi pełnego cyklu życia modelu, w tym monitorowania i ponownego uczenia modeli uczenia maszynowego.

W tym poście omawiamy rozwój modelu i wdrożenie frameworku MLOps dla jednego z klientów Wipro, który z niego korzysta Amazon Sage Maker oraz inne usługi AWS.

Wipro jest Partner usługowy AWS Premier Tier i dostawca usług zarządzanych (MSP). Jego Rozwiązania AI/ML zapewnić większą wydajność operacyjną, produktywność i wygodę obsługi wielu klientów korporacyjnych.

Aktualne wyzwania

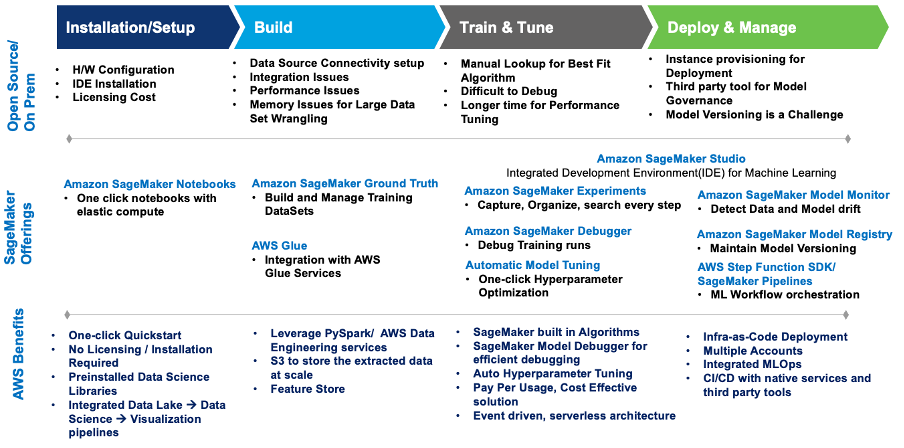

Najpierw przyjrzyjmy się kilku wyzwaniom, jakie stoją przed zespołami zajmującymi się analizą danych i DevOps klienta w związku z ich obecną konfiguracją. Następnie możemy sprawdzić, w jaki sposób zintegrowane oferty AI/ML SageMaker pomogły sprostać tym wyzwaniom.

- Współpraca — każdy z analityków danych pracował nad własnymi lokalnymi notatnikami Jupyter, aby tworzyć i szkolić modele uczenia maszynowego. Brakowało im skutecznej metody udostępniania danych i współpracy z innymi badaczami danych.

- Skalowalność – szkolenie i ponowne szkolenie modeli ML zajmowało coraz więcej czasu, w miarę jak modele stawały się coraz bardziej złożone, a przydzielona przepustowość infrastruktury pozostawała statyczna.

- MLOps – monitorowanie modelu i bieżące zarządzanie nie były ściśle zintegrowane i zautomatyzowane z modelami ML. Istnieją zależności i złożoności związane z integracją narzędzi innych firm z potokiem MLOps.

- Możliwość ponownego użycia – bez ram MLOps wielokrotnego użytku każdy model musi być opracowywany i zarządzany osobno, co zwiększa ogólny wysiłek i opóźnia operacjonalizację modelu.

Ten diagram podsumowuje wyzwania i sposób, w jaki wdrożenie Wipro w SageMaker rozwiązało je za pomocą wbudowanych usług i ofert SageMaker.

Rysunek 1 – Oferta SageMaker do migracji obciążeń ML

Wipro zdefiniowało architekturę, która pozwala sprostać wyzwaniom w sposób zoptymalizowany pod względem kosztów i w pełni zautomatyzowany.

Poniżej przedstawiono przypadek użycia i model zastosowany do zbudowania rozwiązania:

- Przypadek użycia: Prognoza ceny na podstawie zbioru danych używanych samochodów

- Typ problemu: Regresja

- Wykorzystane modele: XGBoost i Linear Learner (wbudowane algorytmy SageMaker)

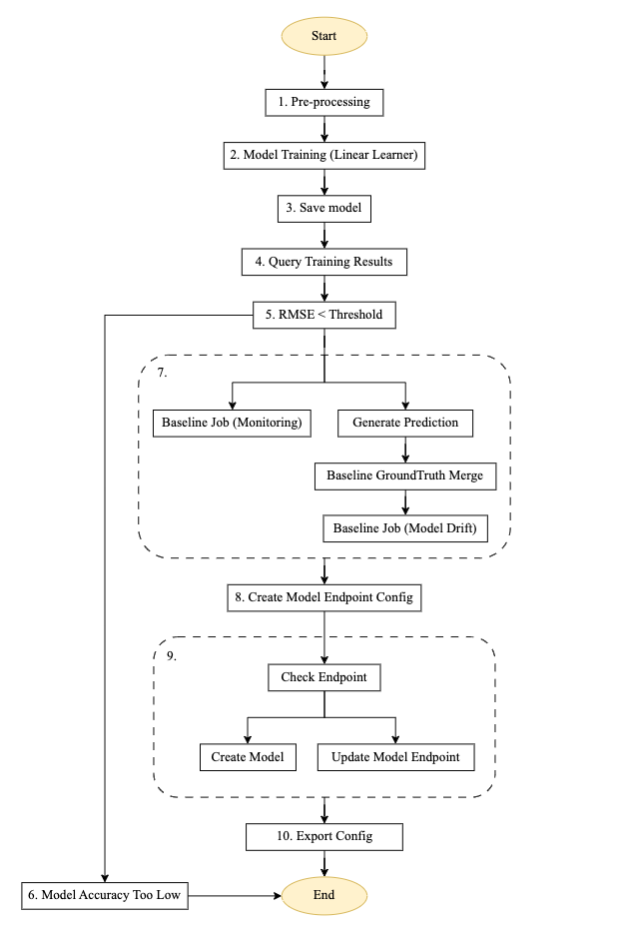

Architektura rozwiązania

Konsultanci Wipro przeprowadzili szczegółowe warsztaty odkrywania z zespołami klienta zajmującymi się analityką danych, DevOps i inżynierią danych, aby zrozumieć obecne środowisko, a także jego wymagania i oczekiwania dotyczące nowoczesnego rozwiązania na platformie AWS. Pod koniec współpracy zespół wdrożył następującą architekturę, która skutecznie spełniała podstawowe wymagania zespołu klienta, w tym:

Udostępnianie kodu – Notatniki SageMaker umożliwiają badaczom danych eksperymentowanie i udostępnianie kodu innym członkom zespołu. Wipro jeszcze bardziej przyspieszyło prace nad modelem ML, wdrażając akceleratory kodu i fragmenty kodu Wipro, aby przyspieszyć inżynierię funkcji, szkolenie modeli, wdrażanie modeli i tworzenie potoków.

Potok ciągłej integracji i ciągłego dostarczania (CI/CD). – Korzystanie z repozytorium GitHub klienta umożliwia wersjonowanie kodu i zautomatyzowane skrypty do uruchamiania wdrażania potoku za każdym razem, gdy zatwierdzona zostanie nowa wersja kodu.

MLOps – Architektura implementuje potok monitorowania modelu SageMaker w celu ciągłego zarządzania jakością modelu poprzez weryfikację danych i dryftu modelu zgodnie z wymaganiami zdefiniowanego harmonogramu. Po wykryciu dryfu uruchamiane jest zdarzenie powiadamiające odpowiednie zespoły o konieczności podjęcia działań lub rozpoczęcia przekwalifikowania modelu.

Architektura sterowana zdarzeniami – Potoki uczenia modeli, wdrażania modeli i monitorowania modeli są dobrze zintegrowane pod względem użytkowania Most zdarzeń Amazona, bezserwerowa magistrala zdarzeń. Gdy wystąpią zdefiniowane zdarzenia, EventBridge może wywołać potok w celu uruchomienia w odpowiedzi. Zapewnia to luźno powiązany zestaw rurociągów, który może działać w razie potrzeby w odpowiedzi na środowisko.

Rysunek 2 – Architektura MLOps sterowana zdarzeniami z SageMakerem

Składniki rozwiązania

W tej sekcji opisano różne komponenty rozwiązania w architekturze.

Eksperymentuj zeszyty

- Cel: Zespół analityki danych klienta chciał poeksperymentować z różnymi zbiorami danych i wieloma modelami, aby opracować optymalne funkcje i wykorzystać je jako dalsze dane wejściowe do zautomatyzowanego potoku.

- Rozwiązanie: Firma Wipro stworzyła notesy eksperymentalne SageMaker zawierające fragmenty kodu dla każdego etapu wielokrotnego użytku, takiego jak odczytywanie i zapisywanie danych, inżynieria funkcji modelu, szkolenie modeli i dostrajanie hiperparametrów. Zadania inżynierii funkcji można również przygotować w Data Wrangler, ale klient specjalnie poprosił o zadania przetwarzania SageMaker i Funkcje kroków AWS ponieważ czuli się bardziej komfortowo korzystając z tych technologii. Wykorzystaliśmy zestaw SDK do nauki danych funkcji krokowej AWS, aby utworzyć funkcję krokową — do testowania przepływu — bezpośrednio z instancji notatnika, aby umożliwić dobrze zdefiniowane dane wejściowe dla potoków. Pomogło to zespołowi analityków danych w tworzeniu i testowaniu potoków w znacznie szybszym tempie.

Zautomatyzowany potok szkoleniowy

- Cel: Aby umożliwić zautomatyzowany potok szkolenia i ponownego szkolenia z konfigurowalnymi parametrami, takimi jak typ instancji, hiperparametry i Usługa Amazon Simple Storage (Amazon S3) lokalizacja wiadra. Potok powinien zostać również uruchomiony poprzez zdarzenie wypychania danych do S3.

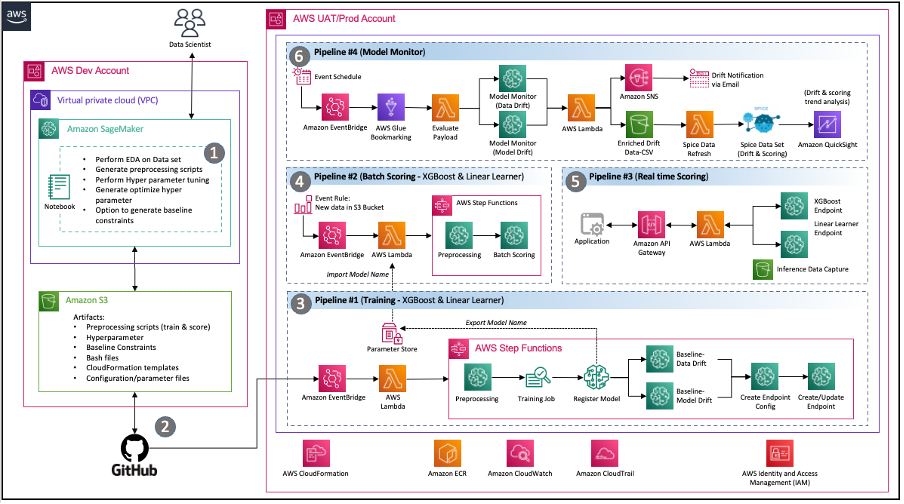

- Rozwiązanie: Wipro wdrożyło potok szkoleniowy wielokrotnego użytku, korzystając z zestawu SDK funkcji Step Functions, przetwarzania SageMaker, zadań szkoleniowych, kontenera monitora modelu SageMaker do generowania linii bazowych, AWS Lambdai usługi EventBridge. Dzięki architekturze opartej na zdarzeniach AWS potok jest skonfigurowany tak, aby uruchamiał się automatycznie na podstawie nowego zdarzenia danych przesyłanego do zmapowanego segmentu S3. Powiadomienia są skonfigurowane tak, aby były wysyłane na zdefiniowane adresy e-mail. Na wysokim poziomie przebieg szkolenia wygląda jak na poniższym diagramie:

Rysunek 3 – Maszyna krokowa potoku szkoleniowego.

Opis przepływu zautomatyzowanego potoku szkoleniowego

Powyższy diagram przedstawia zautomatyzowany potok szkoleniowy zbudowany przy użyciu funkcji Step Functions, Lambda i SageMaker. Jest to potok wielokrotnego użytku umożliwiający konfigurowanie zautomatyzowanego uczenia modeli, generowanie prognoz, tworzenie punktu odniesienia dla monitorowania modelu i monitorowania danych oraz tworzenie i aktualizowanie punktu końcowego na podstawie wartości progowej poprzedniego modelu.

- Przetwarzanie wstępne: Na tym etapie pobierane są dane z lokalizacji Amazon S3 jako dane wejściowe i wykorzystuje się kontener SageMaker SKLearn do wykonywania niezbędnych zadań związanych z inżynierią funkcji i wstępnym przetwarzaniem danych, takich jak uczenie, testowanie i sprawdzanie poprawności podziału.

- Szkolenie modelowe: W przypadku pakietu SageMaker SDK ten krok uruchamia kod szkoleniowy z odpowiednim obrazem modelu i szkoli zestawy danych na podstawie skryptów przetwarzania wstępnego podczas generowania artefaktów wyszkolonego modelu.

- Zapisz model: W tym kroku tworzy się model na podstawie przeszkolonych artefaktów modelu. Nazwa modelu jest przechowywana w celach informacyjnych w innym potoku przy użyciu metody Magazyn parametrów menedżera systemów AWS.

- Zapytanie o wyniki treningu: Ten krok wywołuje funkcję Lambda w celu pobrania metryk ukończonego zadania szkoleniowego z wcześniejszego etapu szkolenia modelu.

- Próg RMSE: W tym kroku sprawdzana jest metryka przeszkolonego modelu (RMSE) względem zdefiniowanego progu, aby zdecydować, czy kontynuować wdrażanie punktu końcowego, czy odrzucić ten model.

- Dokładność modelu jest zbyt niska: Na tym etapie dokładność modelu jest porównywana z poprzednim najlepszym modelem. Jeśli model nie przejdzie walidacji metryki, powiadomienie zostanie wysłane przez funkcję Lambda do tematu docelowego, w którym się zarejestrowano Usługa prostego powiadamiania Amazon (Amazon SNS). Jeśli to sprawdzenie zakończy się niepowodzeniem, przepływ zostanie zakończony, ponieważ nowy przeszkolony model nie osiągnął zdefiniowanego progu.

- Bazowy dryf danych dotyczących stanowiska pracy: Jeśli przeszkolony model przejdzie etapy walidacji, dla tej przeszkolonej wersji modelu zostaną wygenerowane statystyki linii bazowej, aby umożliwić monitorowanie, a następnie zostaną uruchomione kroki rozgałęzienia równoległego w celu wygenerowania linii bazowej dla kontroli jakości modelu.

- Utwórz konfigurację punktu końcowego modelu: Ten krok tworzy konfigurację punktu końcowego dla ocenianego modelu w poprzednim kroku za pomocą pliku włączyć przechwytywanie danych konfiguracja.

- Sprawdź punkt końcowy: Ten krok sprawdza, czy punkt końcowy istnieje lub czy należy go utworzyć. W oparciu o dane wyjściowe następnym krokiem jest utworzenie lub aktualizacja punktu końcowego.

- Eksportuj konfigurację: Ten krok eksportuje nazwę modelu parametru, nazwę punktu końcowego i konfigurację punktu końcowego do pliku Menedżer systemów AWS Magazyn parametrów.

Alerty i powiadomienia są skonfigurowane tak, aby były wysyłane na adres e-mail skonfigurowanego tematu SNS w przypadku niepowodzenia lub powodzenia zmiany stanu automatu stanu. Ta sama konfiguracja potoku jest ponownie wykorzystywana w modelu XGBoost.

Zautomatyzowany potok oceniania wsadowego

- Cel: Uruchom ocenianie wsadowe, gdy tylko dane wejściowe wsadowe dotyczące oceniania będą dostępne w odpowiedniej lokalizacji Amazon S3. Punktacja wsadowa powinna używać najnowszego zarejestrowanego modelu do przeprowadzania punktacji.

- Rozwiązanie: Wipro wdrożyło potok oceniania wielokrotnego użytku, korzystając z pakietu SDK Step Functions, zadań transformacji wsadowej SageMaker, Lambda i EventBridge. Potok jest uruchamiany automatycznie w oparciu o dostępność nowych danych wsadowych oceniania w odpowiedniej lokalizacji S3.

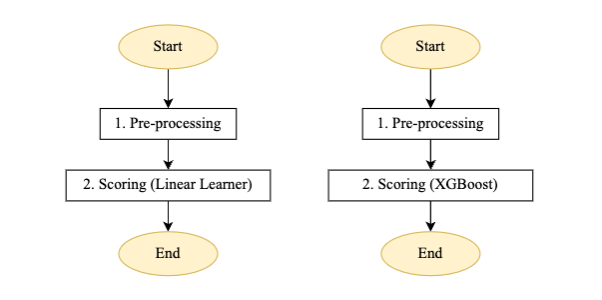

Rysunek 4 – Maszyna krokowa potoku oceniania dla uczenia liniowego i modelu XGBoost

Opis przepływu dla zautomatyzowanego potoku oceniania wsadowego:

- Przetwarzanie wstępne: Dane wejściowe dla tego kroku to plik danych z odpowiedniej lokalizacji S3, który wykonuje wymagane przetwarzanie wstępne przed wywołaniem zadania transformacji wsadowej SageMaker.

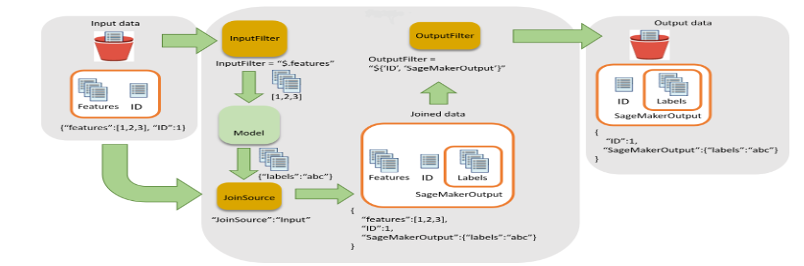

- Punktacja: W tym kroku uruchamiane jest zadanie transformacji wsadowej w celu wygenerowania wniosków, wywołania najnowszej wersji zarejestrowanego modelu i zapisania wyników oceniania w zasobniku S3. Wipro wykorzystało funkcję filtrowania wejściowego i łączenia interfejsu API transformacji wsadowej SageMaker. Pomogło to wzbogacić dane scoringowe i ułatwić podejmowanie lepszych decyzji.

Rysunek 5 – Filtr wejściowy i przepływ łączenia dla transformacji wsadowej

- Na tym etapie potok maszyny stanu jest uruchamiany przez nowy plik danych w zasobniku S3.

Powiadomienie jest skonfigurowane tak, aby było wysyłane na skonfigurowany adres e-mail tematu SNS w przypadku niepowodzenia/powodzenieu zmiany stanu automatu stanu.

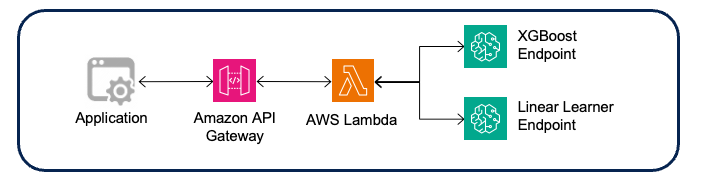

Potok wnioskowania w czasie rzeczywistym

- Cel: Aby umożliwić wnioskowanie w czasie rzeczywistym z punktów końcowych obu modeli (Linear Learner i XGBoost) i uzyskać maksymalną przewidywaną wartość (lub przy użyciu dowolnej innej niestandardowej logiki, którą można zapisać jako funkcję Lambda), która zostanie zwrócona do aplikacji.

- Rozwiązanie: Zespół Wipro wdrożył architekturę wielokrotnego użytku wykorzystując Brama Amazon API, Lambda i punkt końcowy SageMaker, jak pokazano na rysunku 6:

Rysunek 6 – Potok wnioskowania w czasie rzeczywistym

Opis przepływu potoku wnioskowania w czasie rzeczywistym pokazany na rysunku 6:

- Ładunek jest wysyłany z aplikacji do Amazon API Gateway, która kieruje go do odpowiedniej funkcji Lambda.

- Funkcja Lambda (ze zintegrowaną niestandardową warstwą SageMaker) wykonuje wymagane przetwarzanie wstępne, formatowanie ładunku JSON lub CSV i wywołuje odpowiednie punkty końcowe.

- Odpowiedź jest zwracana do Lambdy i wysyłana z powrotem do aplikacji poprzez API Gateway.

Klient wykorzystał ten potok do modeli na małą i średnią skalę, co obejmowało wykorzystanie różnych typów algorytmów open source. Jedną z kluczowych zalet SageMaker jest to, że do SageMaker można wprowadzić różne typy algorytmów i wdrożyć je przy użyciu techniki „przynieś własny kontener” (BYOC). BYOC polega na konteneryzacji algorytmu i zarejestrowaniu obrazu Rejestr elastycznych kontenerów Amazon (Amazon ECR), a następnie używając tego samego obrazu do utworzenia kontenera do trenowania i wnioskowania.

Skalowanie jest jednym z największych problemów w cyklu uczenia maszynowego. SageMaker zawiera niezbędne narzędzia do skalowania modelu podczas wnioskowania. W poprzedniej architekturze użytkownicy muszą włączyć automatyczne skalowanie SageMakera, który ostatecznie poradzi sobie z obciążeniem. Aby włączyć automatyczne skalowanie, użytkownicy muszą udostępnić zasadę automatycznego skalowania, która pyta o przepustowość na instancję oraz maksymalną i minimalną instancję. W ramach obowiązujących zasad SageMaker automatycznie obsługuje obciążenie punktów końcowych w czasie rzeczywistym i w razie potrzeby przełącza się między instancjami.

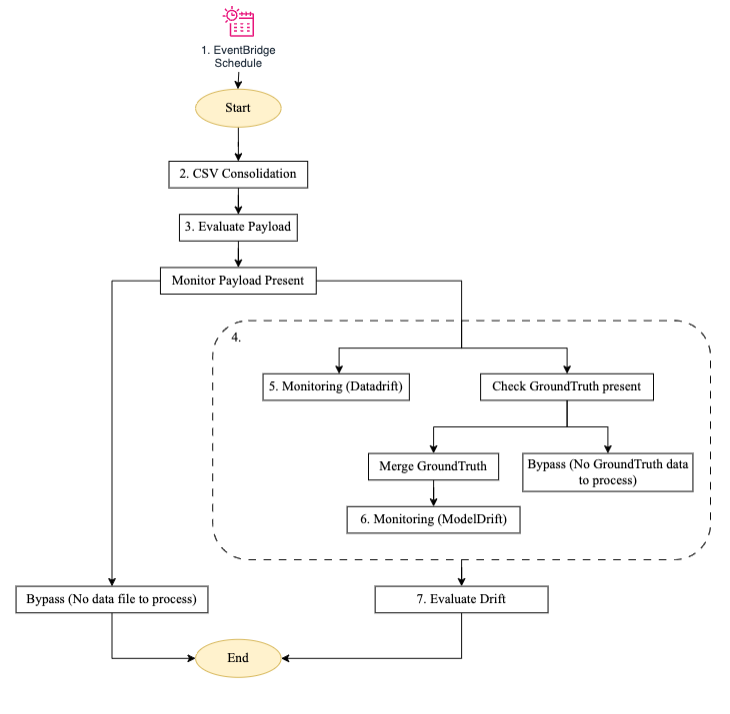

Potok monitorowania modelu niestandardowego

- Cel: Zespół klienta chciał mieć zautomatyzowane monitorowanie modelu w celu wychwytywania zarówno dryftu danych, jak i dryftu modelu. Zespół Wipro wykorzystał monitorowanie modelu SageMaker, aby umożliwić zarówno dryf danych, jak i dryf modelu za pomocą potoku wielokrotnego użytku do wnioskowania w czasie rzeczywistym i transformacji wsadowej. Należy pamiętać, że podczas opracowywania tego rozwiązania monitorowanie modelu SageMaker nie zapewniało możliwości wykrywania danych ani dryf modelu dla transformacji wsadowej. Wdrożyliśmy dostosowania umożliwiające użycie kontenera monitora modelu dla ładunku transformacji wsadowych.

- Rozwiązanie: Zespół Wipro wdrożył potok do monitorowania modeli wielokrotnego użytku dla ładunków wnioskowania w czasie rzeczywistym i wsadowym przy użyciu Klej AWS w celu przechwycenia przyrostowego ładunku i wywołania zadania monitorowania modelu zgodnie ze zdefiniowanym harmonogramem.

Rysunek 7 – Model maszyny krokowej z monitorem

Opis przepływu potoku monitora modelu niestandardowego:

Potok działa zgodnie ze zdefiniowanym harmonogramem skonfigurowanym za pomocą EventBridge.

- Konsolidacja CSV – Wykorzystuje funkcję zakładek AWS Glue do wykrywania obecności przyrostowego ładunku w zdefiniowanym segmencie S3 przechwytywania i reagowania danych w czasie rzeczywistym oraz odpowiedzi na dane wsadowe. Następnie agreguje te dane w celu dalszego przetwarzania.

- Oceń ładunek – Jeśli w bieżącym przebiegu dostępne są dane przyrostowe lub ładunek, wywołuje gałąź monitorowania. W przeciwnym razie pomija bez przetwarzania i kończy zadanie.

- Przetwarzanie końcowe – Gałąź monitorująca ma dwie równoległe gałęzie podrzędne — jedną do dryftu danych, a drugą do dryfu modelu.

- Monitorowanie (dryft danych) – Gałąź dryfu danych działa zawsze, gdy obecny jest ładunek. Wykorzystuje najnowsze wyszkolone ograniczenia linii bazowej modelu i pliki statystyczne wygenerowane w ramach potoku uczenia dla funkcji danych i uruchamia zadanie monitorowania modelu.

- Monitorowanie (dryft modelu) – Gałąź dryfu modelu działa tylko wtedy, gdy dostarczane są dane dotyczące prawdy gruntowej wraz z ładunkiem wnioskowanym. Wykorzystuje przeszkolone ograniczenia linii bazowej modelu i pliki statystyczne wygenerowane w ramach potoku uczenia dla funkcji jakości modelu i uruchamia zadanie monitorowania modelu.

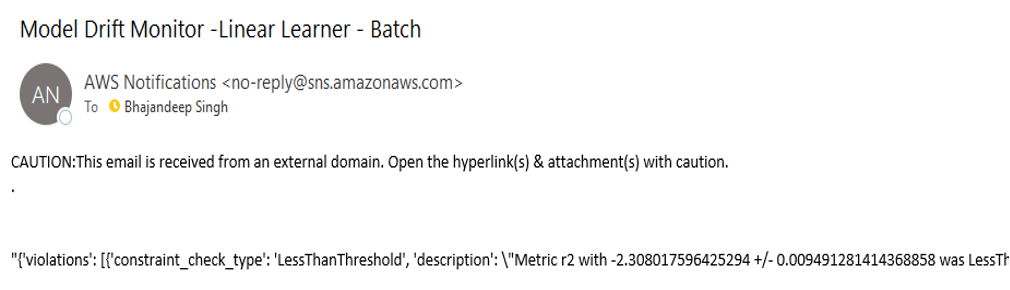

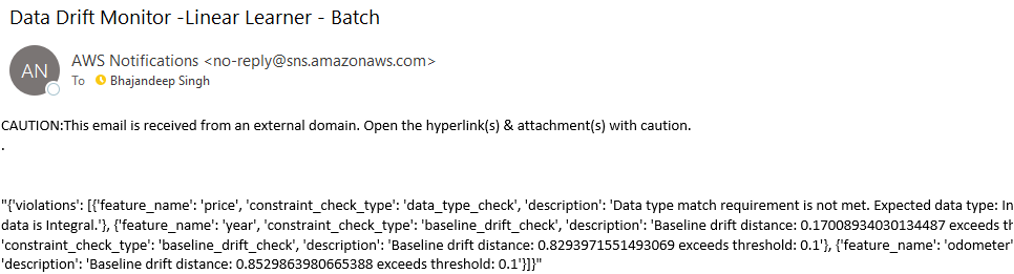

- Oceń dryf – Wynikiem dryfu zarówno danych, jak i modelu jest plik naruszenia ograniczeń, który jest oceniany przez funkcję oceny dryftu Lambda, która wysyła powiadomienie do odpowiednich tematów Amazon SNS ze szczegółami dryftu. Dane dryfu są dodatkowo wzbogacane poprzez dodanie atrybutów do celów raportowania. E-maile z powiadomieniem o dryfowaniu będą wyglądać podobnie do przykładów na rysunku 8.

Rysunek 8 – Komunikat powiadamiający o zmianie danych i modelu

Rysunek 9 – Komunikat powiadamiający o zmianie danych i modelu

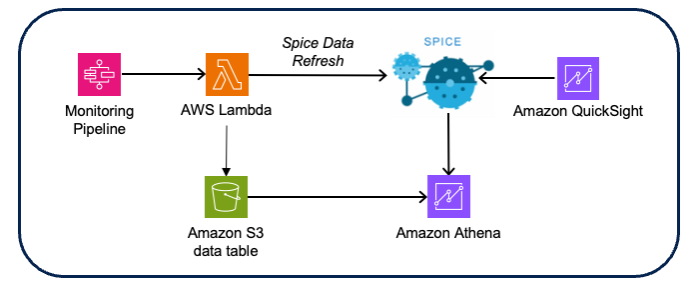

Spostrzeżenia dzięki wizualizacji Amazon QuickSight:

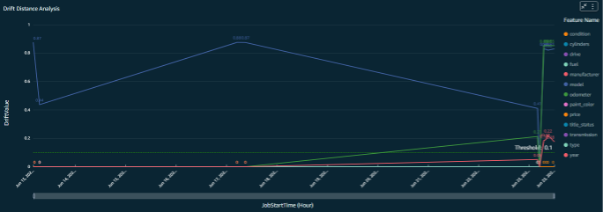

- Cel: Klient chciał uzyskać wgląd w dane i dryft modelu, powiązać dane dryftu z odpowiednimi zadaniami monitorowania modelu oraz poznać trendy danych wnioskowanych, aby zrozumieć naturę trendów danych dotyczących zakłóceń.

- Rozwiązanie: Zespół Wipro wzbogacił dane dotyczące dryftu, łącząc dane wejściowe z wynikami dryfu, co umożliwia selekcję od dryfu do monitorowania i odpowiednich danych punktowych. Wizualizacje i dashboardy zostały stworzone przy użyciu Amazon QuickSight w Amazonka Atena jako źródło danych (przy użyciu punktacji i danych dryfu Amazon S3 CSV).

Rysunek 10 – Architektura wizualizacji monitorowania modelu

Zagadnienia projektowe:

- Użyj zestawu danych przypraw QuickSight, aby uzyskać lepszą wydajność w pamięci.

- Użyj interfejsów API odświeżania zestawu danych QuickSight, aby zautomatyzować odświeżanie danych przypraw.

- Wdrażaj zabezpieczenia oparte na grupach dla kontroli dostępu do pulpitów nawigacyjnych i analiz.

- Automatyzuj wdrażanie na różnych kontach, korzystając z eksportu i importu zestawu danych, źródła danych i wywołań API analizy udostępnianych przez QuickSight.

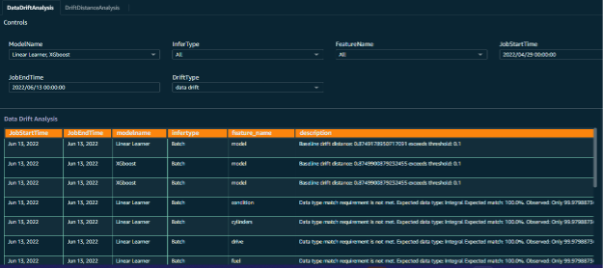

Panel monitorowania modelu:

Aby umożliwić efektywne wyniki i znaczący wgląd w zadania monitorowania modelu, utworzono niestandardowe pulpity nawigacyjne dla danych monitorowania modelu. Punkty danych wejściowych są łączone równolegle z danymi żądań wnioskowania, danymi zadań i wynikami monitorowania w celu stworzenia wizualizacji trendów ujawnionych przez monitorowanie modelu.

To naprawdę pomogło zespołowi klienta w wizualizacji aspektów różnych funkcji danych wraz z przewidywanym wynikiem każdej partii żądań wnioskowania.

Rysunek 11 – Panel monitora modelu z monitami o wybór

Rysunek 12 – Analiza dryfu monitora modelu

Wnioski

Implementacja opisana w tym poście umożliwiła firmie Wipro skuteczną migrację modeli lokalnych do AWS i zbudowanie skalowalnego, zautomatyzowanego środowiska tworzenia modeli.

Korzystanie z komponentów platformy wielokrotnego użytku umożliwia zespołowi zajmującemu się analizą danych skuteczne pakowanie swojej pracy w postaci możliwych do wdrożenia komponentów JSON funkcji krokowych AWS. Jednocześnie zespoły DevOps wykorzystały i udoskonaliły zautomatyzowany potok CI/CD, aby ułatwić bezproblemową promocję i przekwalifikowanie modeli w wyższych środowiskach.

Komponent monitorowania modelu umożliwił ciągłe monitorowanie wydajności modelu, a użytkownicy otrzymują alerty i powiadomienia w przypadku wykrycia dryfu danych lub modelu.

Zespół klienta używa tej platformy MLOps do migracji lub opracowywania większej liczby modeli i zwiększania stopnia wykorzystania SageMaker.

Wykorzystując kompleksowy pakiet usług SageMaker w połączeniu z naszą skrupulatnie zaprojektowaną architekturą, klienci mogą bezproblemowo wdrożyć wiele modeli, znacznie skracając czas wdrażania i łagodząc złożoność związaną ze współdzieleniem kodu. Co więcej, nasza architektura upraszcza obsługę wersjonowania kodu, zapewniając usprawniony proces rozwoju.

Architektura ta obsługuje cały cykl uczenia maszynowego, obejmujący zautomatyzowane szkolenie modeli, wnioskowanie w czasie rzeczywistym i wsadowe, proaktywne monitorowanie modelu i analizę dryftu. To kompleksowe rozwiązanie umożliwia klientom osiągnięcie optymalnej wydajności modelu przy jednoczesnym zachowaniu rygorystycznych możliwości monitorowania i analizy, aby zapewnić ciągłą dokładność i niezawodność.

Aby stworzyć tę architekturę, zacznij od stworzenia niezbędnych zasobów, takich jak Wirtualna prywatna chmura Amazon (Amazon VPC), notesy SageMaker i funkcje Lambda. Pamiętaj o odpowiednim skonfigurowaniu Zarządzanie tożsamością i dostępem AWS (IAM) zasady dotyczące tych zasobów.

Następnie skup się na budowaniu komponentów architektury — takich jak skrypty szkoleniowe i przetwarzania wstępnego — w SageMaker Studio lub Jupyter Notebook. Ten krok polega na opracowaniu niezbędnego kodu i konfiguracji, aby umożliwić pożądane funkcjonalności.

Po zdefiniowaniu komponentów architektury można przystąpić do budowania funkcji Lambda w celu generowania wniosków lub wykonywania etapów przetwarzania końcowego danych.

Na koniec użyj funkcji kroków, aby połączyć komponenty i ustalić płynny przepływ pracy, który koordynuje przebieg każdego kroku.

O autorach

Stephena Randolpha jest starszym architektem rozwiązań partnerskich w Amazon Web Services (AWS). Umożliwia i wspiera partnerów Global Systems Integrator (GSI) w zakresie najnowszej technologii AWS podczas opracowywania rozwiązań branżowych w celu rozwiązywania wyzwań biznesowych. Stephen szczególnie pasjonuje się bezpieczeństwem i generatywną sztuczną inteligencją oraz pomaga klientom i partnerom w projektowaniu bezpiecznych, wydajnych i innowacyjnych rozwiązań w AWS.

Stephena Randolpha jest starszym architektem rozwiązań partnerskich w Amazon Web Services (AWS). Umożliwia i wspiera partnerów Global Systems Integrator (GSI) w zakresie najnowszej technologii AWS podczas opracowywania rozwiązań branżowych w celu rozwiązywania wyzwań biznesowych. Stephen szczególnie pasjonuje się bezpieczeństwem i generatywną sztuczną inteligencją oraz pomaga klientom i partnerom w projektowaniu bezpiecznych, wydajnych i innowacyjnych rozwiązań w AWS.

Bhajandeepa Singha pełnił funkcję szefa centrum doskonałości AWS AI/ML w firmie Wipro Technologies, kierując zaangażowaniem klientów w dostarczanie rozwiązań do analizy danych i sztucznej inteligencji. Posiada certyfikat AWS AI/ML Specialty i jest autorem blogów technicznych na temat usług i rozwiązań AI/ML. Dzięki doświadczeniu w zakresie wiodących rozwiązań AWS AI/ML w różnych branżach, Bhajandeep umożliwił klientom maksymalizację wartości usług AWS AI/ML dzięki swojej wiedzy i przywództwu.

Bhajandeepa Singha pełnił funkcję szefa centrum doskonałości AWS AI/ML w firmie Wipro Technologies, kierując zaangażowaniem klientów w dostarczanie rozwiązań do analizy danych i sztucznej inteligencji. Posiada certyfikat AWS AI/ML Specialty i jest autorem blogów technicznych na temat usług i rozwiązań AI/ML. Dzięki doświadczeniu w zakresie wiodących rozwiązań AWS AI/ML w różnych branżach, Bhajandeep umożliwił klientom maksymalizację wartości usług AWS AI/ML dzięki swojej wiedzy i przywództwu.

Ajay Vishwakarma jest inżynierem ML w skrzydle AWS praktyki rozwiązań AI firmy Wipro. Ma duże doświadczenie w budowaniu rozwiązań BYOM dla niestandardowych algorytmów w SageMaker, kompleksowym wdrażaniu potoków ETL, budowaniu chatbotów przy użyciu Lexa, udostępnianiu zasobów QuickSight między kontami i budowaniu szablonów CloudFormation do wdrożeń. Lubi odkrywać AWS, traktując każdy problem klienta jako wyzwanie, aby zbadać więcej i zapewnić im rozwiązania.

Ajay Vishwakarma jest inżynierem ML w skrzydle AWS praktyki rozwiązań AI firmy Wipro. Ma duże doświadczenie w budowaniu rozwiązań BYOM dla niestandardowych algorytmów w SageMaker, kompleksowym wdrażaniu potoków ETL, budowaniu chatbotów przy użyciu Lexa, udostępnianiu zasobów QuickSight między kontami i budowaniu szablonów CloudFormation do wdrożeń. Lubi odkrywać AWS, traktując każdy problem klienta jako wyzwanie, aby zbadać więcej i zapewnić im rozwiązania.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/modernizing-data-science-lifecycle-management-with-aws-and-wipro/

- :ma

- :Jest

- $W GÓRĘ

- 1

- 10

- 100

- 11

- 12

- 212

- 300

- 32

- 7

- 8

- 804

- 9

- a

- O nas

- powyżej

- przyśpieszyć

- przyśpieszony

- akceleratory

- dostęp

- Stosownie

- Konto

- Konta

- precyzja

- Osiągać

- w poprzek

- Działania

- dodatek

- zaadresowany

- Adresy

- Dodaje

- Przyjęcie

- przed

- agregaty

- AI

- AI / ML

- Alarmy

- algorytm

- Algorytmy

- przydzielony

- wzdłuż

- również

- Amazonka

- Brama Amazon API

- Amazon QuickSight

- Amazon Web Services

- Amazon Web Services (AWS)

- Amazon.com

- an

- analiza

- analityka

- i

- Inne

- każdy

- api

- Pszczoła

- Zastosowanie

- aplikacje

- właściwy

- architektura

- SĄ

- AS

- aspekty

- powiązany

- At

- atrybuty

- Autorzy

- samochód

- zautomatyzować

- zautomatyzowane

- automatycznie

- Automatyzacja

- dostępność

- dostępny

- AWS

- Klej AWS

- Funkcje kroków AWS

- z powrotem

- na podstawie

- Baseline

- BE

- stał

- bo

- być

- zanim

- rozpocząć

- jest

- Korzyści

- BEST

- Ulepsz Swój

- pomiędzy

- Najwyższa

- blogi

- obie

- Oddział

- przynieść

- przyniósł

- budować

- Budowanie

- wybudowany

- wbudowany

- autobus

- biznes

- ale

- by

- powołanie

- Połączenia

- CAN

- możliwości

- Pojemność

- zdobyć

- wózek

- walizka

- Centrum

- Centrum Doskonałości

- Certyfikacja

- wyzwanie

- wyzwania

- zmiana

- nasze chatboty

- ZOBACZ

- w kratę

- Wykrywanie urządzeń szpiegujących

- klient

- klientów

- Chmura

- kod

- Udostępnianie kodu

- współpracować

- współpracę

- współpraca

- COM

- połączenie

- połączony

- jak

- byliśmy spójni, od początku

- wygodny

- zobowiązany

- kompaktowy

- kompletny

- Zakończony

- kompleks

- złożoności

- składnik

- składniki

- wszechstronny

- przeprowadzone

- systemu

- skonfigurowany

- spójnik

- Skontaktuj się

- Podłączanie

- Rozważania

- Ograniczenia

- Konsultanci

- consulting

- Pojemnik

- ciągły

- kontrola

- rdzeń

- Koszty:

- Stwórz

- stworzony

- tworzy

- Tworzenie

- tworzenie

- Krzyż

- Aktualny

- zwyczaj

- klient

- doświadczenie klienta

- Klientów

- cykl

- tablica rozdzielcza

- Deski rozdzielcze

- dane

- Analityka danych

- punkty danych

- nauka danych

- naukowiec danych

- zbiory danych

- zdecydować

- decyzja

- Podejmowanie decyzji

- zdefiniowane

- opóźnienia

- dostarczyć

- dostawa

- Zależności

- wdrażane

- Wdrożenie

- wdrożenia

- opisuje

- opis

- zaprojektowany

- życzenia

- detale

- wykryć

- wykryte

- rozwijać

- rozwinięty

- rozwijanie

- oprogramowania

- różne

- odkrycie

- dyskutować

- do

- robi

- napęd

- napędzany

- podczas

- każdy

- Wcześniej

- Efektywne

- faktycznie

- efektywność

- wydajny

- wysiłek

- e-maile

- upoważnia

- umożliwiać

- włączony

- Umożliwia

- obejmujący

- zakończenia

- koniec końców

- Punkt końcowy

- zaręczynowy

- angaże

- inżynier

- Inżynieria

- wzmocnione

- wzbogacać

- Wzbogacony

- zapewnić

- zapewnienie

- Enterprise

- Cały

- Środowisko

- środowiska

- szczególnie

- niezbędny

- zapewniają

- oceniać

- oceniane

- wydarzenie

- wydarzenia

- ostatecznie

- Każdy

- zbadać

- przykłady

- Doskonałość

- istnieje

- wychodzi

- oczekiwania

- przyśpieszyć coś

- doświadczenie

- eksperyment

- ekspertyza

- wyjaśnione

- odkryj

- Exploring

- eksport

- eksport

- Twarz

- w obliczu

- ułatwiać

- nie

- Brak

- szybciej

- Cecha

- Korzyści

- kilka

- Postać

- filet

- Akta

- filtrować

- Znajdź

- i terminów, a

- pływ

- Skupiać

- następujący

- W razie zamówieenia projektu

- Framework

- Ramy

- od

- w pełni

- funkcjonować

- funkcjonalności

- Funkcjonalność

- Funkcje

- dalej

- Bramka

- Generować

- wygenerowane

- generujący

- generacja

- generatywny

- generatywna sztuczna inteligencja

- otrzymać

- GitHub

- Globalne

- dobry

- zarządzanie

- regulowane

- Ziemia

- miał

- Uchwyty

- Wykorzystywanie

- Have

- he

- głowa

- pomoc

- pomógł

- pomoc

- pomaga

- Wysoki

- wyższy

- jego

- posiada

- W jaki sposób

- HTML

- HTTPS

- Dostrajanie hiperparametrów

- tożsamość

- if

- obraz

- realizacja

- realizowane

- wykonawczych

- narzędzia

- importować

- in

- włączony

- obejmuje

- Włącznie z

- Zwiększać

- Zwiększenia

- przyrostowe

- przemysłowa

- przemysł

- Infrastruktura

- zainicjować

- Innowacyjny

- wkład

- Wejścia

- spostrzeżenia

- przykład

- zintegrowany

- Integracja

- integracja

- Inteligencja

- Interferencja

- najnowszych

- inwokuje

- angażować

- odosobniony

- problemy

- IT

- Praca

- Oferty pracy

- przystąpić

- podróż

- json

- Klawisz

- firmy

- uruchomić

- uruchomiona

- warstwa

- Przywództwo

- prowadzący

- uczeń

- nauka

- poziom

- wifecycwe

- lubić

- lubi

- miejscowy

- lokalizacja

- logika

- Popatrz

- WYGLĄD

- niski

- maszyna

- uczenie maszynowe

- Utrzymywanie

- konserwacja

- robić

- Dokonywanie

- zarządzanie

- zarządzane

- i konserwacjami

- kierownik

- zarządzający

- wiele

- Maksymalizuj

- maksymalny

- Może..

- wymowny

- średni

- Poznaj nasz

- Użytkownicy

- metoda

- skrupulatnie

- metryczny

- Metryka

- może

- migrować

- migracja

- minimum

- łagodzenie

- ML

- MLOps

- model

- modele

- Nowoczesne technologie

- modernizacja

- monitor

- monitorowanie

- jeszcze

- Ponadto

- dużo

- wielokrotność

- musi

- Nazwa

- Natura

- niezbędny

- Potrzebować

- potrzebne

- wymagania

- Nowości

- Następny

- noty

- notatnik

- powiadomienie

- Powiadomienia

- of

- Oferty

- on

- Onboard

- ONE

- trwający

- tylko

- koncepcja

- open source

- operacyjny

- Optymalny

- or

- organizacji

- Inne

- Inaczej

- ludzkiej,

- na zewnątrz

- Wynik

- wydajność

- ogólny

- własny

- Pokój

- pakiet

- Parallel

- parametr

- parametry

- partnerem

- wzmacniacz

- przebiegi

- namiętny

- dla

- wykonać

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- wykonywania

- rurociąg

- Miejsce

- plato

- Analiza danych Platona

- PlatoDane

- zwrotnica

- polityka

- polityka

- teczka

- Post

- praktyka

- poprzedzający

- Przewiduje

- przepowiednia

- Przewidywania

- premier

- przygotowany

- obecność

- teraźniejszość

- poprzedni

- Cena

- Przewidywanie ceny

- prywatny

- Proaktywne

- Problem

- kontynuować

- wygląda tak

- przetwarzanie

- wydajność

- promocja

- monity

- zapewniać

- pod warunkiem,

- dostawca

- zapewnia

- zaopatrzenie

- cele

- Naciskać

- popychany

- jakość

- Czytający

- w czasie rzeczywistym

- dane w czasie rzeczywistym

- naprawdę

- otrzymać

- redukcja

- odniesienie

- zarejestrowany

- rejestracji

- rejestr

- zwolnić

- niezawodność

- pozostał

- Raportowanie

- składnica

- zażądać

- wywołań

- wymagany

- wymagania

- Zasób

- Zasoby

- osób

- odpowiedź

- dalsze

- Efekt

- wielokrotnego użytku

- Ujawnił

- rygorystyczny

- krzepki

- trasy

- run

- bieganie

- działa

- sagemaker

- taki sam

- Skalowalność

- skalowalny

- Skala

- skalowaniem

- rozkład

- nauka

- Naukowiec

- Naukowcy

- punktacji

- skrypty

- Sdk

- bezszwowy

- płynnie

- Sekcja

- bezpieczne

- bezpieczeństwo

- wybór

- wysyła

- senior

- wysłany

- służył

- Bezserwerowe

- usługa

- Usługodawca

- Usługi

- zestaw

- ustawienie

- ustawienie

- Share

- dzielenie

- powinien

- pokazane

- znacznie

- podobny

- Prosty

- upraszcza

- jednocześnie

- mały

- gładki

- rozwiązanie

- Rozwiązania

- ROZWIĄZANIA

- wkrótce

- Źródło

- Specjalność

- swoiście

- przyprawa

- dzielić

- stos

- Półki na książki

- Stan

- statyczny

- statystyka

- statystyki

- Rynek

- Ewolucja krok po kroku

- Stephen

- Cel

- przechowywanie

- sklep

- przechowywany

- przechowywania

- usprawniony

- usprawnień

- studio

- sukces

- taki

- apartament

- w zestawie

- wsparcie

- podpory

- pewnie

- systemy

- Brać

- trwa

- biorąc

- cel

- zadania

- zespół

- Członkowie Zespołu

- Zespoły

- Techniczny

- technika

- Technologies

- Technologia

- Szablony

- test

- że

- Połączenia

- Państwo

- ich

- Im

- następnie

- Tam.

- Te

- one

- innych firm

- to

- tych

- próg

- Przez

- wydajność

- poziom

- ciasno

- czas

- do

- także

- narzędzie

- narzędzia

- aktualny

- tematy

- w kierunku

- Pociąg

- przeszkolony

- Trening

- pociągi

- Transformacja

- przemiany

- Trendy

- rozsierdzony

- Prawda

- strojenie

- drugiej

- rodzaj

- typy

- zrozumieć

- Aktualizacja

- Nowości

- aktualizowanie

- posługiwać się

- przypadek użycia

- używany

- Użytkownicy

- zastosowania

- za pomocą

- UPRAWOMOCNIĆ

- sprawdzanie poprawności

- uprawomocnienie

- wartość

- różnorodny

- wersja

- Wersje

- NARUSZENIE

- Wirtualny

- wyobrażanie sobie

- wyobrażać sobie

- poszukiwany

- była

- Droga..

- we

- sieć

- usługi internetowe

- DOBRZE

- dobrze zdefiniowane

- były

- jeśli chodzi o komunikację i motywację

- ilekroć

- czy

- który

- Podczas

- będzie

- skrzydło

- w

- w ciągu

- bez

- Praca

- pracował

- workflow

- przepływów pracy

- warsztat

- pisanie

- napisany

- XGBoost

- You

- Twój

- zefirnet