In Część 1 z tej serii zaprezentowaliśmy rozwiązanie wykorzystujące technologię Multimodalne osadzania Amazon Titan model umożliwiający konwersję poszczególnych slajdów z zestawu slajdów na elementy osadzone. Zapisaliśmy osady w wektorowej bazie danych, a następnie wykorzystaliśmy plik Duży asystent językowo-wzrokowy (LLaVA 1.5-7b) model do generowania odpowiedzi tekstowych na pytania użytkowników na podstawie najbardziej podobnego slajdu pobranego z bazy wektorów. Korzystaliśmy z usług AWS m.in Amazońska skała macierzysta, Amazon Sage Maker, Amazon OpenSearch bez serwera w tym rozwiązaniu.

W tym poście pokazujemy inne podejście. Używamy Antropiczny Claude 3 Sonet model do generowania opisów tekstowych dla każdego slajdu w zestawie slajdów. Opisy te są następnie konwertowane na osadzony tekst za pomocą narzędzia Osadzanie tekstu Amazon Titan modelu i przechowywany w bazie danych wektorowych. Następnie za pomocą modelu Claude 3 Sonnet generujemy odpowiedzi na pytania użytkowników w oparciu o najbardziej odpowiedni opis tekstowy pobrany z bazy wektorów.

Możesz przetestować oba podejścia dla swojego zbioru danych i ocenić wyniki, aby zobaczyć, które podejście daje najlepsze wyniki. W części 3 tej serii oceniamy wyniki obu metod.

Omówienie rozwiązania

Rozwiązanie zapewnia implementację odpowiadania na pytania z wykorzystaniem informacji zawartych w tekstach i elementach wizualnych slidera. Projekt opiera się na koncepcji generacji rozszerzonej odzyskiwania (RAG). Tradycyjnie RAG kojarzono z danymi tekstowymi, które można przetwarzać za pomocą dużych modeli językowych (LLM). W tej serii rozszerzamy RAG o obrazy. Zapewnia to zaawansowane możliwości wyszukiwania w celu wyodrębnienia treści odpowiednich kontekstowo z elementów wizualnych, takich jak tabele i wykresy, wraz z tekstem.

To rozwiązanie zawiera następujące elementy:

- Amazon Titan Text Embeddings to model osadzania tekstu, który konwertuje tekst w języku naturalnym, w tym pojedyncze słowa, frazy, a nawet duże dokumenty, na reprezentacje numeryczne, które można wykorzystać do wspomagania zastosowań, takich jak wyszukiwanie, personalizacja i grupowanie w oparciu o podobieństwo semantyczne.

- Claude 3 Sonnet to kolejna generacja najnowocześniejszych modeli firmy Anthropic. Sonnet to wszechstronne narzędzie, które może obsłużyć szeroki zakres zadań, od złożonego wnioskowania i analizy po szybkie wyniki, a także wydajne wyszukiwanie i odzyskiwanie ogromnych ilości informacji.

- OpenSearch Serverless to bezserwerowa konfiguracja na żądanie dla usługi Amazon OpenSearch. Używamy OpenSearch Serverless jako wektorowej bazy danych do przechowywania osadzań generowanych przez model Amazon Titan Text Embeddings. Indeks utworzony w kolekcji OpenSearch Serverless służy jako magazyn wektorów dla naszego rozwiązania RAG.

- Przetwarzanie Amazon OpenSearch (OSI) to w pełni zarządzany, bezserwerowy moduł gromadzący dane, który dostarcza dane do domen usługi OpenSearch i kolekcji OpenSearch Serverless. W tym poście używamy interfejsu API potoku OSI do dostarczania danych do magazynu wektorów OpenSearch Serverless.

Projekt rozwiązania składa się z dwóch części: pozyskiwania i interakcji z użytkownikiem. Podczas przetwarzania przetwarzamy wejściowy zestaw slajdów, konwertując każdy slajd na obraz, generując opisy i osadzony tekst dla każdego obrazu. Następnie wypełniamy magazyn danych wektorowych osadzonymi elementami i opisem tekstowym każdego slajdu. Te kroki są wykonywane przed etapami interakcji z użytkownikiem.

W fazie interakcji z użytkownikiem pytanie użytkownika jest konwertowane na osadzony tekst. W bazie wektorów przeprowadzane jest wyszukiwanie podobieństwa w celu znalezienia opisu tekstowego odpowiadającego slajdowi, który potencjalnie mógłby zawierać odpowiedzi na pytanie użytkownika. Następnie przekazujemy opis slajdu i pytanie użytkownika do modelu Claude 3 Sonnet w celu wygenerowania odpowiedzi na zapytanie. Cały kod tego wpisu jest dostępny w pliku GitHub repozytorium.

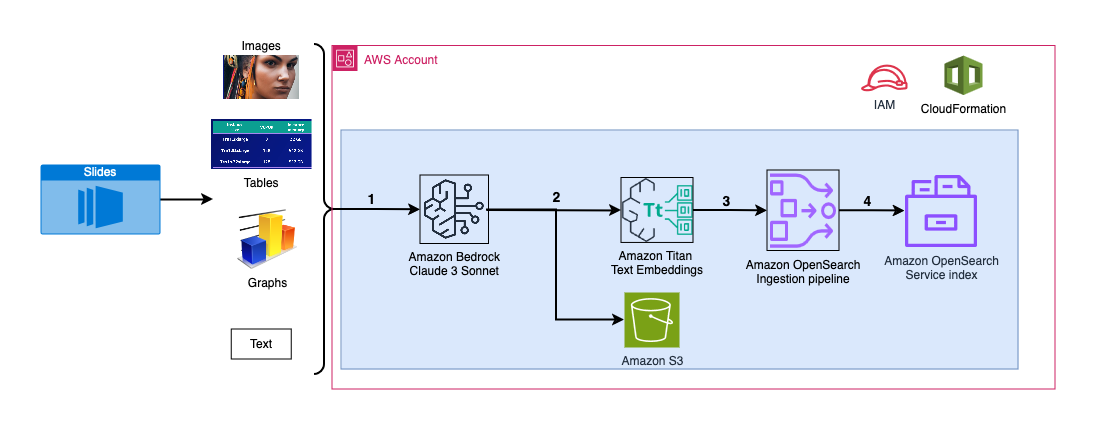

Poniższy diagram ilustruje architekturę pozyskiwania.

Przepływ pracy składa się z następujących kroków:

- Slajdy są konwertowane do plików graficznych (po jednym na slajd) w formacie JPG i przekazywane do modelu Claude 3 Sonnet w celu wygenerowania opisu tekstowego.

- Dane są wysyłane do modelu Amazon Titan Text Embeddings w celu wygenerowania osadzania. W tej serii używamy zjeżdżalni Trenuj i wdrażaj Stable Diffusion przy użyciu AWS Trainium i AWS Inferentia ze szczytu AWS w Toronto w czerwcu 2023 r., aby zademonstrować rozwiązanie. Przykładowa talia zawiera 31 slajdów, dlatego generujemy 31 zestawów osadzania wektorów, każdy o 1536 wymiarach. Dodajemy dodatkowe pola metadanych, aby wykonywać zaawansowane zapytania wyszukiwania, korzystając z potężnych możliwości wyszukiwania OpenSearch.

- Osadzenia są pobierane do potoku OSI przy użyciu wywołania API.

- Potok OSI pobiera dane w postaci dokumentów do indeksu OpenSearch Serverless. Indeks jest skonfigurowany jako ujście dla tego potoku i jest tworzony jako część kolekcji OpenSearch Serverless.

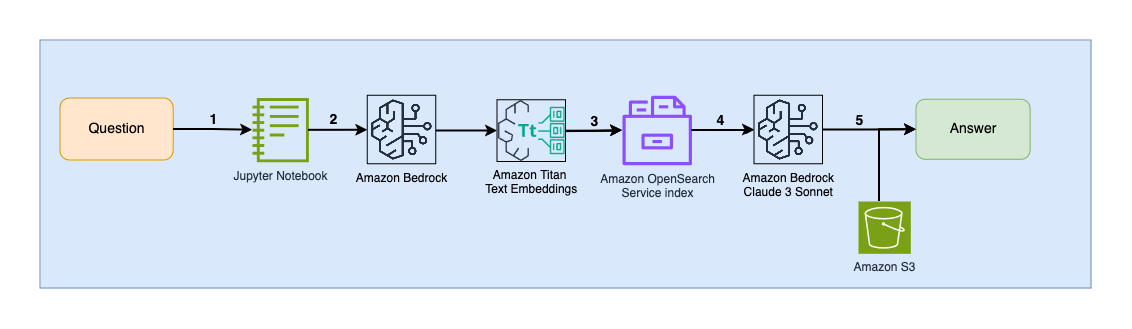

Poniższy diagram ilustruje architekturę interakcji użytkownika.

Przepływ pracy składa się z następujących kroków:

- Użytkownik przesyła pytanie dotyczące przetworzonego zestawu slajdów.

- Dane wprowadzone przez użytkownika są konwertowane na osadzanie przy użyciu modelu Amazon Titan Text Embeddings, do którego dostęp można uzyskać za pomocą Amazon Bedrock. Wyszukiwanie wektorów usługi OpenSearch Service odbywa się przy użyciu tych osadzania. Przeprowadzamy wyszukiwanie k-najbliższego sąsiada (k-NN), aby pobrać najbardziej odpowiednie osadzania pasujące do zapytania użytkownika.

- Metadane odpowiedzi z OpenSearch Serverless zawierają ścieżkę do obrazu i opis odpowiadający najodpowiedniejszemu slajdowi.

- Podpowiedź tworzona jest poprzez połączenie pytania użytkownika i opisu obrazu. Podpowiedź jest dostarczana do Claude 3 Sonnet hostowanego na Amazon Bedrock.

- Wynik tego wnioskowania jest zwracany użytkownikowi.

W poniższych sekcjach omówimy kroki dla obu etapów i podajemy szczegółowe informacje na temat wyników.

Wymagania wstępne

Aby wdrożyć rozwiązanie podane w tym poście, powinieneś mieć plik Konto AWS oraz znajomość FM, Amazon Bedrock, SageMaker i OpenSearch Service.

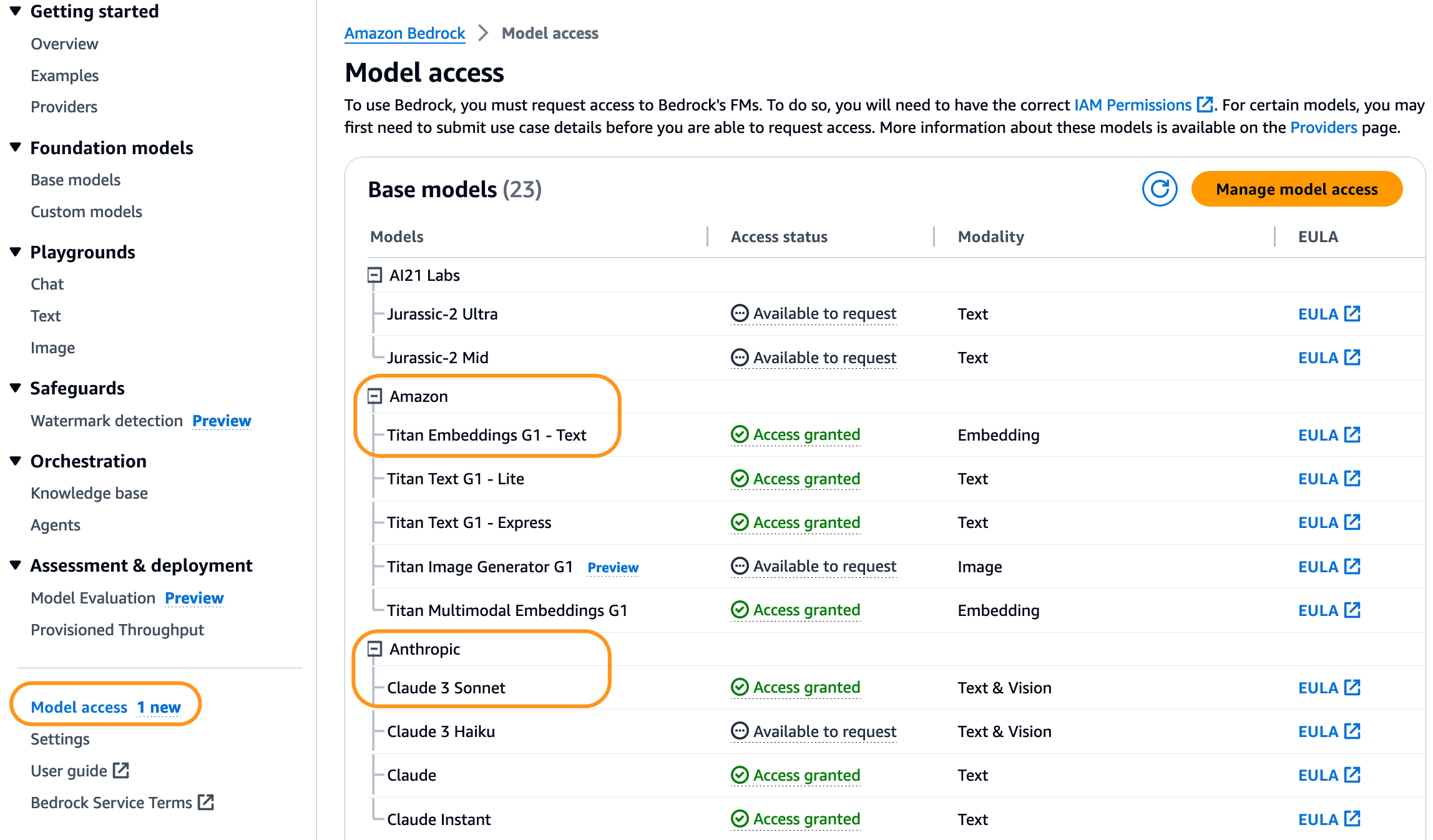

To rozwiązanie wykorzystuje modele Claude 3 Sonnet i Amazon Titan Text Embeddings hostowane na Amazon Bedrock. Upewnij się, że te modele są włączone do użytku, przechodząc do Dostęp do modelu na konsoli Amazon Bedrock.

Jeśli modele są włączone, Stan dostępu stwierdzi Dostęp przyznany.

Jeśli modele nie są dostępne, włącz dostęp, wybierając Zarządzaj dostępem do modelu, wybór modeli i wybór Poproś o dostęp do modelu. Modele są natychmiast udostępniane do użytku.

Użyj AWS CloudFormation, aby utworzyć stos rozwiązań

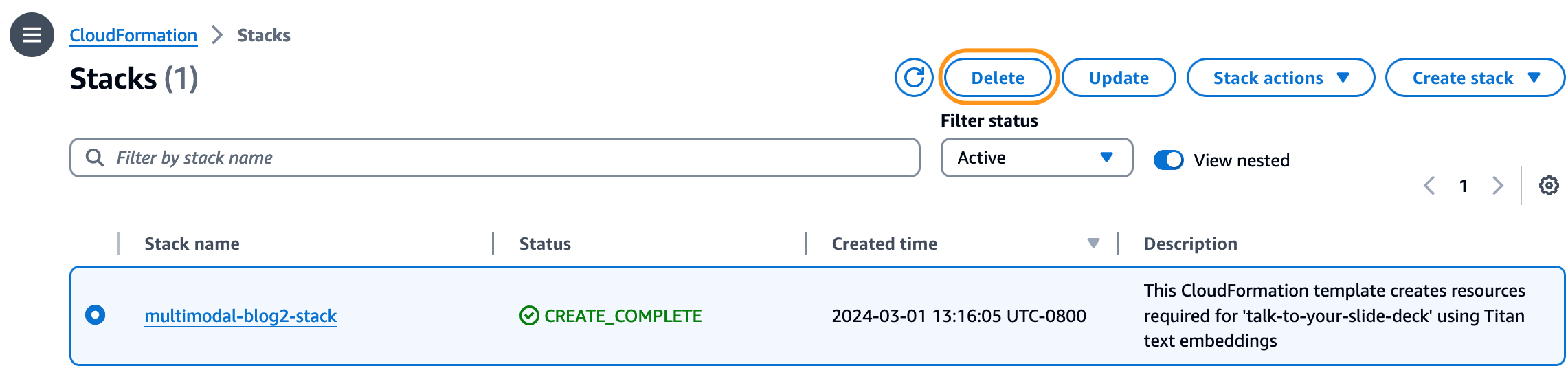

Możesz użyć AWS CloudFormation, aby utworzyć stos rozwiązań. Jeśli utworzyłeś rozwiązanie dla Części 1 na tym samym koncie AWS, pamiętaj o usunięciu go przed utworzeniem tego stosu.

| Region AWS | Połączyć |

|---|---|

us-east-1 |

|

us-west-2 |

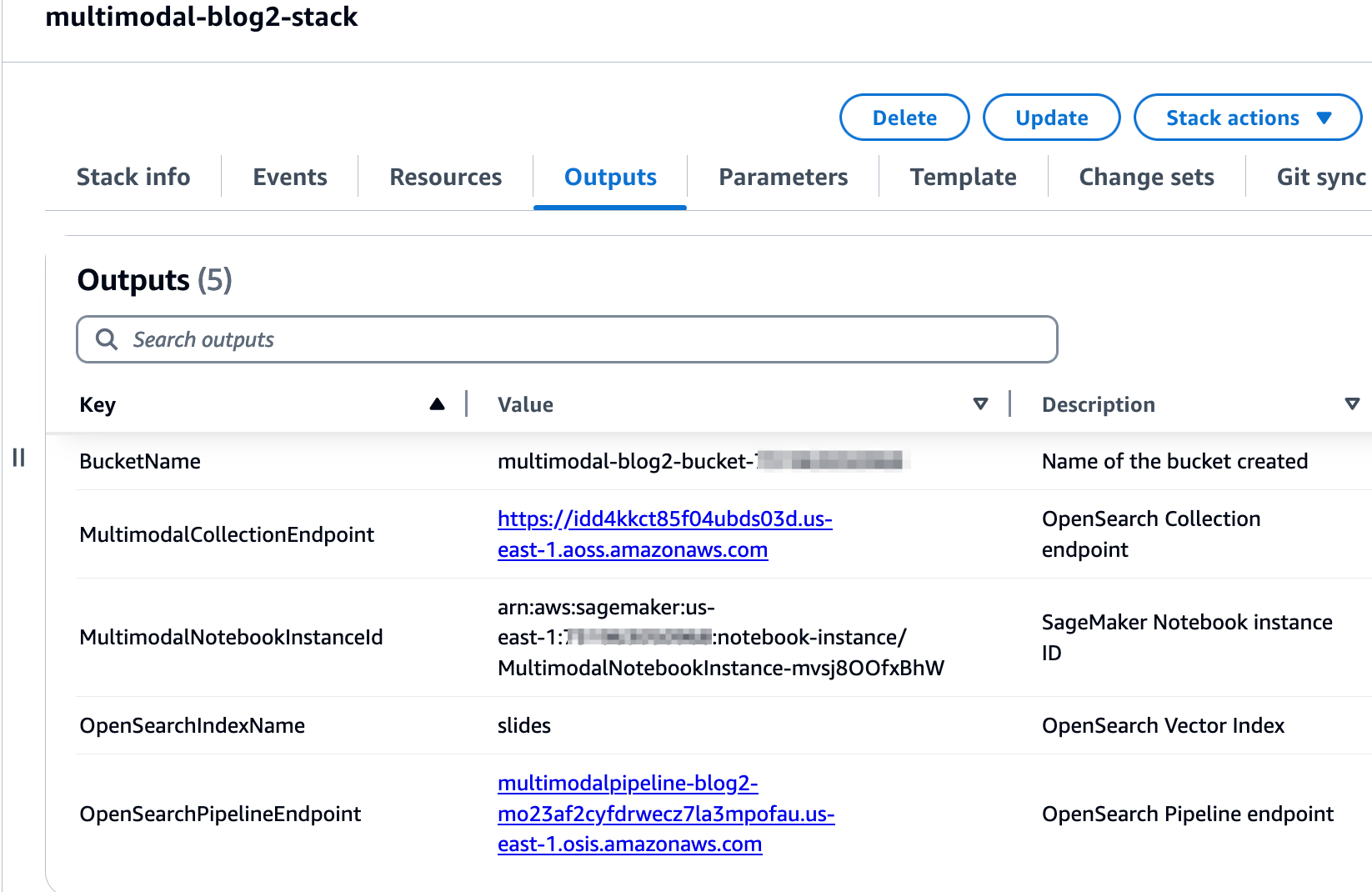

Po pomyślnym utworzeniu stosu przejdź do karty Wyjścia stosu w konsoli AWS CloudFormation i zanotuj wartości dla MultimodalCollectionEndpoint i OpenSearchPipelineEndpoint. Użyjesz ich w kolejnych krokach.

Szablon CloudFormation tworzy następujące zasoby:

- Role IAM - Następujące AWS Zarządzanie tożsamością i dostępem Tworzone są role (IAM). Zaktualizuj te role, aby zastosować uprawnienia o najniższych uprawnieniach, jak omówiono w Najlepsze praktyki w zakresie bezpieczeństwa.

SMExecutionRolew Usługa Amazon Simple Storage (Amazon S3), SageMaker, OpenSearch Service i Amazon Bedrock – pełny dostęp.OSPipelineExecutionRolez dostępem do segmentu S3 i działań OSI.

- Notatnik SageMakera – Cały kod tego posta jest uruchamiany przy użyciu tego notatnika.

- Bezserwerowa kolekcja OpenSearch – Jest to baza danych wektorów służąca do przechowywania i wyszukiwania osadzonych elementów.

- Rurociąg OSI – To jest potok pozyskiwania danych do OpenSearch Serverless.

- Wiadro S3 – Wszystkie dane dla tego wpisu są przechowywane w tym zasobniku.

Szablon CloudFormation konfiguruje konfigurację potoku wymaganą do skonfigurowania potoku OSI z HTTP jako źródłem i indeksem OpenSearch Serverless jako ujściem. Notatnik SageMaker 2_data_ingestion.ipynb wyświetla sposób pozyskiwania danych do potoku przy użyciu metody wnioski Biblioteka HTTP.

Tworzy się również szablon CloudFormation sieć, szyfrowanie i dostęp do danych zasady wymagane dla Twojej kolekcji OpenSearch Serverless. Zaktualizuj te zasady, aby zastosować uprawnienia o najniższych uprawnieniach.

Nazwa szablonu CloudFormation i nazwa indeksu usługi OpenSearch Service znajdują się w notatniku SageMaker 3_rag_inference.ipynb. Jeśli zmienisz nazwy domyślne, pamiętaj o ich zaktualizowaniu w notatniku.

Przetestuj rozwiązanie

Po utworzeniu stosu CloudFormation możesz przetestować rozwiązanie. Wykonaj następujące kroki:

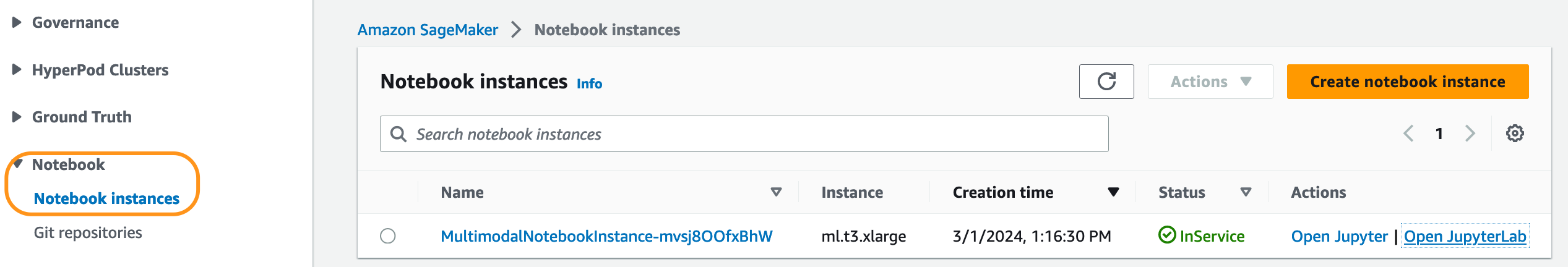

- W konsoli SageMaker wybierz Notebooki w okienku nawigacji.

- Wybierz

MultimodalNotebookInstancei wybierz Otwórz JupyterLab.

- In Przeglądarka plików, przejdź do folderu notesów, aby wyświetlić notesy i pliki pomocnicze.

Zeszyty są ponumerowane w kolejności, w jakiej są prowadzone. Instrukcje i komentarze w każdym notatniku opisują działania wykonywane przez ten notatnik. Prowadzimy te notesy jeden po drugim.

- Dodaj

1_data_prep.ipynbaby otworzyć go w JupyterLab. - Na run menu, wybierz Uruchom wszystkie komórki aby uruchomić kod w tym notatniku.

Ten notatnik pobierze publicznie dostępny plik zjeżdżalnia, przekonwertuj każdy slajd do formatu pliku JPG i prześlij go do zasobnika S3.

- Dodaj

2_data_ingestion.ipynbaby otworzyć go w JupyterLab. - Na run menu, wybierz Uruchom wszystkie komórki aby uruchomić kod w tym notatniku.

W tym notatniku utworzysz indeks w kolekcji OpenSearch Serverless. Ten indeks przechowuje dane osadzenia dla talii slajdów. Zobacz następujący kod:

Modele Claude 3 Sonnet i Amazon Titan Text Embeddings służą do konwertowania obrazów JPG utworzonych w poprzednim notatniku na osadzania wektorowe. Te osadzania i dodatkowe metadane (takie jak ścieżka S3 i opis pliku obrazu) są przechowywane w indeksie wraz z osadzaniami. Poniższy fragment kodu pokazuje, jak Claude 3 Sonnet generuje opisy obrazów:

Opisy obrazów są przekazywane do modelu Amazon Titan Text Embeddings w celu wygenerowania osadzania wektorowego. Te osadzania i dodatkowe metadane (takie jak ścieżka S3 i opis pliku obrazu) są przechowywane w indeksie wraz z osadzaniami. Poniższy fragment kodu przedstawia wywołanie modelu Amazon Titan Text Embeddings:

Dane są pobierane do indeksu OpenSearch Serverless poprzez wywołanie API do potoku OSI. Poniższy fragment kodu przedstawia wywołanie wykonane przy użyciu biblioteki Requests HTTP:

- Dodaj

3_rag_inference.ipynbaby otworzyć go w JupyterLab. - Na run menu, wybierz Uruchom wszystkie komórki aby uruchomić kod w tym notatniku.

W tym notatniku zastosowano rozwiązanie RAG: konwertujesz pytanie użytkownika na osadzanie, znajdujesz podobny opis obrazu w bazie danych wektorowych i przekazujesz pobrany opis Claude 3 Sonnetowi, aby wygenerować odpowiedź na pytanie użytkownika. Używasz następującego szablonu podpowiedzi:

Poniższy fragment kodu przedstawia przepływ pracy RAG:

Efekt

Poniższa tabela zawiera niektóre pytania i odpowiedzi użytkowników wygenerowane przez naszą implementację. The Question kolumna zawiera pytanie użytkownika, a Odpowiedź kolumna to odpowiedź tekstowa wygenerowana przez Claude 3 Sonnet. The Obraz kolumna pokazuje dopasowanie slajdu k-NN zwrócone przez wyszukiwanie wektorowe OpenSearch Serverless.

Wyniki multimodalnych RAG

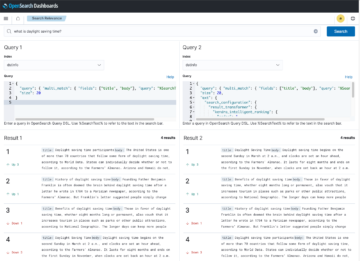

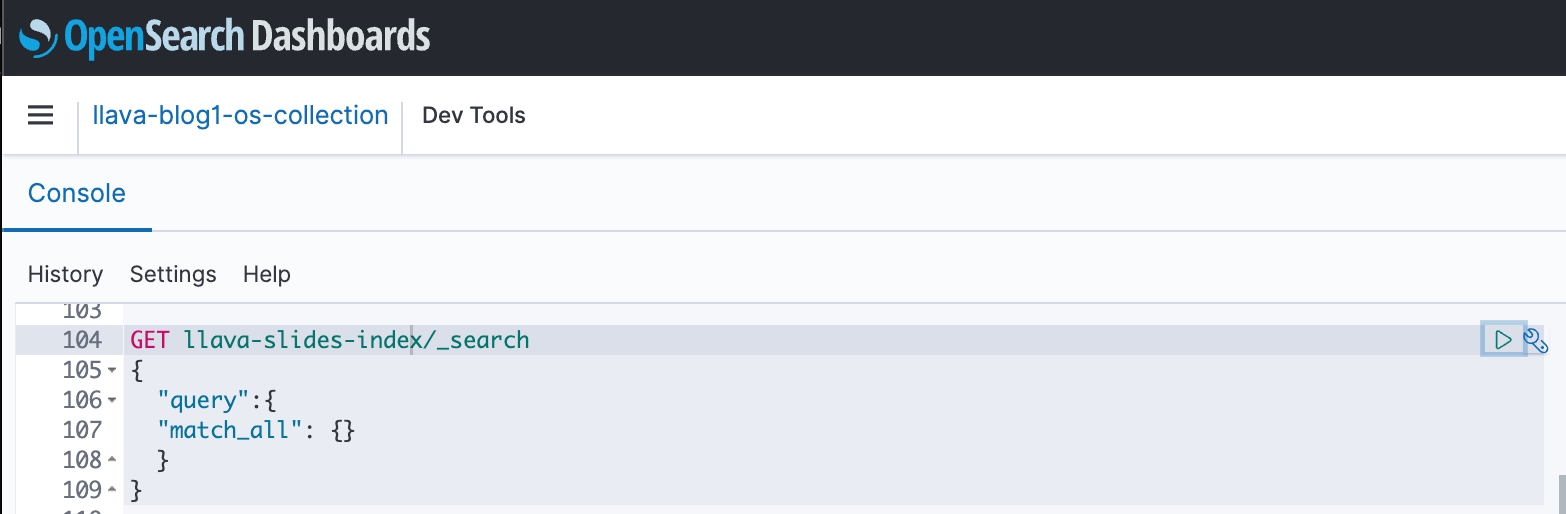

Zapytaj o swój indeks

Pulpitów nawigacyjnych OpenSearch można używać do interakcji z interfejsem API OpenSearch w celu przeprowadzania szybkich testów indeksu i pozyskanych danych.

Oczyszczanie

Aby uniknąć przyszłych opłat, usuń zasoby. Możesz to zrobić, usuwając stos za pomocą konsoli AWS CloudFormation.

Wnioski

Przedsiębiorstwa cały czas generują nowe treści, a slajdy to powszechny sposób udostępniania i rozpowszechniania informacji wewnętrznie w organizacji i na zewnątrz, z klientami lub na konferencjach. Z czasem bogate informacje mogą pozostać ukryte w formach nietekstowych, takich jak wykresy i tabele na tych slajdach.

Możesz wykorzystać to rozwiązanie i moc multimodalnych FM, takich jak Amazon Titan Text Embeddings i Claude 3 Sonnet, aby odkryć nowe informacje lub odkryć nowe perspektywy dotyczące treści na slajdach. Możesz wypróbować różne modele Claude dostępne na Amazon Bedrock, aktualizując plik CLAUDE_MODEL_ID globals.py plik.

Jest to druga część trzyczęściowej serii. W Części 2 wykorzystaliśmy Multimodalne Embeddingi Amazon Titan i model LLaVA. W Części 1 porównamy podejścia z Części 3 i Części 1.

Części tego kodu są udostępniane w ramach Licencja Apache 2.0.

O autorach

Amit Arora jest architektem specjalizującym się w AI i ML w Amazon Web Services, pomagając klientom korporacyjnym w korzystaniu z usług uczenia maszynowego opartych na chmurze w celu szybkiego skalowania ich innowacji. Jest także adiunktem w programie MS Data Science and Analytics na Uniwersytecie Georgetown w Waszyngtonie

Amit Arora jest architektem specjalizującym się w AI i ML w Amazon Web Services, pomagając klientom korporacyjnym w korzystaniu z usług uczenia maszynowego opartych na chmurze w celu szybkiego skalowania ich innowacji. Jest także adiunktem w programie MS Data Science and Analytics na Uniwersytecie Georgetown w Waszyngtonie

Manju Prasad jest starszym architektem rozwiązań w Amazon Web Services. Koncentruje się na zapewnianiu wskazówek technicznych w różnych dziedzinach technicznych, w tym AI/ML. Przed dołączeniem do AWS projektowała i budowała rozwiązania dla firm z sektora usług finansowych, a także dla startupu. Jej pasją jest dzielenie się wiedzą i wzbudzanie zainteresowania wschodzącymi talentami.

Manju Prasad jest starszym architektem rozwiązań w Amazon Web Services. Koncentruje się na zapewnianiu wskazówek technicznych w różnych dziedzinach technicznych, w tym AI/ML. Przed dołączeniem do AWS projektowała i budowała rozwiązania dla firm z sektora usług finansowych, a także dla startupu. Jej pasją jest dzielenie się wiedzą i wzbudzanie zainteresowania wschodzącymi talentami.

Archana Inapudi jest starszym architektem rozwiązań w AWS, wspierającym klienta strategicznego. Posiada ponad dziesięcioletnie doświadczenie międzybranżowe, kierując strategicznymi inicjatywami technicznymi. Archana jest aspirującym członkiem społeczności technicznej AI/ML w AWS. Przed dołączeniem do AWS Archana przeprowadziła migrację z tradycyjnych izolowanych źródeł danych do Hadoop w firmie z branży opieki zdrowotnej. Pasjonuje się wykorzystaniem technologii do przyspieszania wzrostu, zapewniania wartości klientom i osiągania wyników biznesowych.

Archana Inapudi jest starszym architektem rozwiązań w AWS, wspierającym klienta strategicznego. Posiada ponad dziesięcioletnie doświadczenie międzybranżowe, kierując strategicznymi inicjatywami technicznymi. Archana jest aspirującym członkiem społeczności technicznej AI/ML w AWS. Przed dołączeniem do AWS Archana przeprowadziła migrację z tradycyjnych izolowanych źródeł danych do Hadoop w firmie z branży opieki zdrowotnej. Pasjonuje się wykorzystaniem technologii do przyspieszania wzrostu, zapewniania wartości klientom i osiągania wyników biznesowych.

Antara Raisa jest architektem rozwiązań AI i ML w Amazon Web Services, obsługującym klientów strategicznych z siedzibą w Dallas w Teksasie. Ma także wcześniejsze doświadczenie w pracy z dużymi partnerami korporacyjnymi w AWS, gdzie pracowała jako architekt rozwiązań dla partnerów sukcesu dla klientów skupionych na technologii cyfrowej.

Antara Raisa jest architektem rozwiązań AI i ML w Amazon Web Services, obsługującym klientów strategicznych z siedzibą w Dallas w Teksasie. Ma także wcześniejsze doświadczenie w pracy z dużymi partnerami korporacyjnymi w AWS, gdzie pracowała jako architekt rozwiązań dla partnerów sukcesu dla klientów skupionych na technologii cyfrowej.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/talk-to-your-slide-deck-using-multimodal-foundation-models-hosted-on-amazon-bedrock-and-amazon-sagemaker-part-2/

- :ma

- :Jest

- :nie

- :Gdzie

- $W GÓRĘ

- 1

- 10

- 100

- 12

- 15%

- 17

- 173

- 175

- 20

- 2019

- 2020

- 2023

- 23

- 24

- 27

- 30

- 31

- 7

- 8

- 9

- a

- zdolności

- O nas

- przyśpieszyć

- dostęp

- dostęp

- Konto

- Osiągać

- w poprzek

- działania

- Dodaj

- Dodatkowy

- dodatek

- Przyjęcie

- Zalety

- AI

- Modele AI

- AI / ML

- Algorytmy

- Wszystkie kategorie

- wzdłuż

- również

- Amazonka

- Amazon EC2

- Usługa Amazon OpenSearch

- Amazon Web Services

- kwoty

- an

- analiza

- analityka

- i

- i infrastruktura

- odpowiedź

- sekretarka

- odpowiedzi

- Antropiczny

- każdy

- wszystko

- api

- Zastosowanie

- Application Development

- aplikacje

- Aplikuj

- podejście

- awanse

- w przybliżeniu

- architektura

- SĄ

- sztuczny

- sztuczna inteligencja

- Sztuczna inteligencja i uczenie maszynowe

- AS

- zapytać

- ambitny

- Asystent

- powiązany

- At

- zwiększona

- Auth

- dostępny

- uniknąć

- AWS

- Tworzenie chmury AWS

- na podstawie

- BE

- być

- zanim

- BEST

- Ulepsz Swój

- pomiędzy

- Miliard

- ciało

- obie

- wybudowany

- biznes

- ale

- by

- wezwanie

- CAN

- nie może

- możliwości

- zdolność

- przechwytuje

- Etui

- zmiana

- Opłaty

- Dodaj

- Wybierając

- klient

- klastrowanie

- kod

- kolekcja

- kolekcje

- kolektor

- Kolumna

- łączenie

- komentarze

- wspólny

- społeczność

- Firmy

- sukcesy firma

- porównywalny

- porównać

- w porównaniu

- porównanie

- porównanie

- kompletny

- Zakończony

- kompleks

- składniki

- pojęcie

- zwięzły

- konferencje

- systemu

- skonfigurowany

- składa się

- Konsola

- zawierać

- zawarte

- zawiera

- zawartość

- kontekst

- ciągły

- konwertować

- przeliczone

- 轉換

- Odpowiedni

- mógłby

- Stwórz

- stworzony

- tworzy

- Tworzenie

- Listy uwierzytelniające

- klient

- Klientów

- cykl

- Dallas

- Deski rozdzielcze

- dane

- nauka danych

- Baza danych

- dekada

- pokład

- Domyślnie

- dostarczyć

- dostarcza

- Kreowanie

- wykazać

- rozwijać

- opisać

- opisuje

- opis

- Wnętrze

- zaprojektowany

- detale

- rozwijanie

- oprogramowania

- schemat

- DICT

- różnica

- różne

- Transmitowanie

- Wymiary

- Wymiary

- odkryj

- dyskutować

- omówione

- Wyświetlacz

- wyświetlacze

- do

- dokumenty

- robi

- domeny

- pobieranie

- napęd

- jazdy

- podczas

- e

- każdy

- wydajny

- Elementy

- osadzanie

- wschodzących

- umożliwiać

- włączony

- umożliwiając

- silnik

- Enterprise

- błąd

- oceniać

- Parzyste

- Z wyjątkiem

- wyjątek

- doświadczenie

- ekspertyza

- rozciągać się

- zewnętrznie

- wyciąg

- Znajomość

- pole

- Łąka

- filet

- Akta

- budżetowy

- usługi finansowe

- Znajdź

- koncentruje

- następujący

- W razie zamówieenia projektu

- format

- wychowanie

- Fundacja

- od

- Paliwo

- pełny

- w pełni

- dalej

- przyszłość

- Generować

- wygenerowane

- generuje

- generujący

- generacja

- generatywny

- generatywna sztuczna inteligencja

- Georgetown

- GitHub

- dany

- daje

- będzie

- wykresy

- Wzrost

- poradnictwo

- miał

- uchwyt

- Have

- he

- opieki zdrowotnej

- pomoc

- Ukryty

- wyższy

- pasemka

- Odsłon

- gospodarz

- hostowane

- gospodarze

- W jaki sposób

- How To

- Jednak

- HTML

- http

- HTTPS

- człowiek

- i

- tożsamość

- if

- ilustruje

- obraz

- zdjęcia

- natychmiast

- wdrożenia

- realizacja

- narzędzia

- ulepszenia

- in

- zawierać

- obejmuje

- Włącznie z

- wskaźnik

- Indeksy

- indywidualny

- Informacja

- Infrastruktura

- inicjatywy

- Innowacja

- innowacje

- wkład

- przykład

- instrukcje

- Inteligencja

- interakcji

- wzajemne oddziaływanie

- odsetki

- wewnętrznie

- najnowszych

- inwestycja

- IT

- łączący

- jpg

- json

- czerwiec

- Klawisz

- Wiedzieć

- wiedza

- język

- duży

- Utajenie

- prowadzący

- Wyprowadzenia

- nauka

- Doprowadziło

- Biblioteka

- Licencja

- lubić

- miejscowy

- niższy

- maszyna

- uczenie maszynowe

- zrobiony

- Główny

- robić

- Dokonywanie

- zarządzane

- wiele

- Mecz

- dopasowywanie

- max

- członek

- wspominać

- Menu

- wiadomości

- Metadane

- metoda

- metody

- migracja

- ML

- model

- modele

- jeszcze

- większość

- MS

- Nazwa

- Nazwy

- Naturalny

- Przetwarzanie języka naturalnego

- Nawigacja

- żeglujący

- Nawigacja

- Potrzebować

- Nowości

- Następny

- żaden

- noty

- notatnik

- numerowane

- z naszej

- of

- oferta

- on

- Na żądanie

- ONE

- koncepcja

- optymalizacja

- or

- organizacja

- OS

- Inne

- ludzkiej,

- na zewnątrz

- wyniki

- wydajność

- Wyjścia

- koniec

- strona

- chleb

- parametr

- parametry

- część

- partnerem

- wzmacniacz

- strony

- minęło

- namiętny

- ścieżka

- dla

- wykonać

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- wykonywane

- uprawnienia

- personalizacja

- perspektywy

- faza

- Zwroty

- Fizyka

- rurociąg

- plato

- Analiza danych Platona

- PlatoDane

- polityka

- Post

- potencjalnie

- power

- mocny

- przedstawione

- poprzedni

- Wcześniejszy

- wygląda tak

- Obrobiony

- przetwarzanie

- Program

- progresja

- niska zabudowa

- zapewniać

- pod warunkiem,

- zapewnia

- że

- publicznie

- kwarki

- zapytania

- pytanie

- pytanie

- pytania

- Szybki

- R

- szmata

- zasięg

- szybki

- szybko

- Czytaj

- Odebrane

- odwołanie

- związane z

- wydany

- opiera się

- pozostawać

- wywołań

- wymagany

- Badania naukowe

- Zasoby

- odpowiedź

- Odpowiedzi

- dalsze

- Efekt

- wyszukiwanie

- powrót

- Bogaty

- Rola

- role

- run

- bieganie

- sagemaker

- taki sam

- próba

- powiedzieć

- Skala

- nauka

- Szukaj

- działy

- sektor

- widzieć

- wydać się

- wybierając

- semantyczny

- senior

- wysłany

- Sekwencja

- Serie

- Bezserwerowe

- służy

- usługa

- Usługi

- Sesja

- Zestawy

- w panelu ustawień

- Share

- dzielenie

- ona

- powinien

- Targi

- wyciszony

- podobny

- Prosty

- pojedynczy

- Rozmiar

- suwak

- slajdy

- skrawek

- rozwiązanie

- Rozwiązania

- kilka

- Źródło

- Źródła

- specjalista

- specyficzny

- stabilny

- stos

- etapy

- startup

- Stan

- state-of-the-art

- Cel

- przechowywanie

- sklep

- przechowywany

- sklep

- przechowywania

- Strategiczny

- kolejny

- sukces

- Z powodzeniem

- taki

- PODSUMOWANIE

- Szczyt

- wsparcie

- Utrzymany

- Wspierający

- pewnie

- stół

- Talent

- Mówić

- zadania

- Techniczny

- Technologies

- Technologia

- szablon

- test

- Testy

- texas

- XNUMX

- tekstowy

- niż

- że

- Połączenia

- Informacje

- ich

- Im

- następnie

- w związku z tym

- Te

- one

- to

- wydajność

- czas

- czasy

- tytan

- do

- narzędzie

- narzędzia

- Toronto

- tradycyjny

- tradycyjnie

- poligon

- prawdziwy

- próbować

- SKRĘCAĆ

- drugiej

- rodzaj

- typy

- odkryć

- dla

- uniwersytet

- Aktualizacja

- aktualizowanie

- posługiwać się

- przypadków użycia

- używany

- Użytkownik

- zastosowania

- za pomocą

- wartość

- Wartości

- różnorodność

- Naprawiono

- wszechstronny

- wizualny

- Waszyngton

- Droga..

- we

- sieć

- usługi internetowe

- DOBRZE

- Co

- Co to jest

- który

- Podczas

- szeroki

- Szeroki zasięg

- szerszy

- będzie

- w

- w ciągu

- słowa

- pracował

- workflow

- pracujący

- You

- Twój

- zefirnet