Czas czytania: 5 minuty

Badanie skuteczności chatGPT w inteligentnym audycie kontraktów

Było to 30 listopada 2022 r., kiedy uruchomiono ChatGPT. Nie trzeba było długo czekać, by podbić świat. Bez względu na to, z jakich mediów społecznościowych korzystasz, na czacie GPT są posty, memy, artykuły informacyjne i inne. Co więcej, chatGPT był tematem rozmów w mediach głównego nurtu. Nie ma wątpliwości, kiedy mówię, że wszyscy mówili o chatGPT i jego mocy.

Na tym blogu omówimy, w jaki sposób chatGPT jest używany lub może być używany w audycie inteligentnych kontraktów lub bezpieczeństwie cybernetycznym Web3. Zacznijmy od tego, czym dokładnie jest chatGPT.

Co to jest ChatGPT?

ChatGPT to interaktywny chatbot, który przyjmuje monity i zwraca odpowiedzi na podstawie wyszkolonych danych. Ma niezwykłą zdolność komunikowania się w dialogu konwersacyjnym i udzielania odpowiedzi, które mogą wydawać się zaskakująco ludzkie.

Poza tym jedną z rzeczy, które sprawiają, że jest inteligentniejszy, jest jego wyjątkowa zdolność do ciągłego uczenia się na podstawie danych wejściowych użytkownika; jest to zaimplementowane w warstwie uczenia się ze wzmocnieniem z ludzkim sprzężeniem zwrotnym (RLHF), co pomaga w zwracaniu odpowiedzi, które są satysfakcjonujące dla ludzi.

Dane treningowe

Każdy model AI to nic innego jak wyszkolona maszyna, która udziela odpowiedzi na podstawie swojej nauki i wniosków z danych treningowych. Danymi treningowymi może być wszystko, od filmów wideo po tekst, który jest przekazywany do modelu, który uczy się o tych danych, a gdy do tego modelu zostanie zaproponowany problem, w oparciu o jego naukę z danych treningowych, daje odpowiedzi.

ChatGPT został przeszkolony na podstawie danych zebranych z Internetu, w tym źródeł takich jak dyskusje na Reddicie, aby pomóc ChatGPT nauczyć się dialogów i osiągnąć styl odpowiedzi podobny do ludzkiego. chatGPT jest również przeszkolony w zakresie informacji zwrotnych od ludzi. Ta technika nazywa się Uczenie się ze wzmocnieniem z ludzkim sprzężeniem zwrotnym, dzięki czemu sztuczna inteligencja uczy się, czego oczekują ludzie, gdy zadają pytanie.

ChatGPT może znaleźć luki w zabezpieczeniach

Długo po jego wydaniu ludzie zaczęli eksperymentować z możliwościami chatGPT w różnych przypadkach użycia i scenariuszach. Te eksperymenty przeprowadzono również w zakresie bezpieczeństwa inteligentnych kontraktów.

ChatGPT z pewnością nas nie zawiódł. Wciąż jest jednak miejsce na ulepszenia, ale okazało się przydatne i znacząco pomogło audytorom i osobom zajmującym się inteligentnymi kontraktami. Jeśli chodzi o dobrze znane hacki i niektóre hacki, które są w systemie od dłuższego czasu, bardzo przydatne jest ich wyłapywanie.

Niektóre z typowych luk w zabezpieczeniach, które chatGPT znajduje z odrobiną dokładności, to: -

- Atak najemców: Jest to powszechna luka w zabezpieczeniach, w której osoba atakująca może wielokrotnie wywoływać funkcję w ramach inteligentnej umowy przed zakończeniem poprzedniego wykonania, co prowadzi do nieoczekiwanego lub złośliwego zachowania.

- Przepełnienia/niedopełnienia liczb całkowitych: Inteligentne kontrakty często opierają się na obliczeniach liczb całkowitych, a jeśli te obliczenia nie zostaną odpowiednio sprawdzone, mogą spowodować nieoczekiwane lub nieprawidłowe zachowanie.

- Niesprawdzone zwracane wartości: umowa może niewłaściwie obsługiwać nieoczekiwane wartości zwracane z wywołań zewnętrznych, co może prowadzić do potencjalnej luki w zabezpieczeniach i może spowodować szkody.

- Niechronione funkcje: Kontrakt może nie mieć odpowiedniej kontroli dostępu, co prowadzi do nieautoryzowanego dostępu do wrażliwych funkcji. Co może prowadzić do poważnych strat.

Istnieje kilka innych luk w zabezpieczeniach i problemów, które chatGPT może zidentyfikować za pomocą inteligentnych umów, i na pewno będziesz zaskoczony, gdy je zobaczysz. Jednak dzięki naszym testom odkryliśmy, że często otrzymujesz fałszywy alarm i istnieje ogromne prawdopodobieństwo, że niektóre kluczowe błędy zostaną pominięte.

Czy chatGPT może znaleźć wszystkie luki w zabezpieczeniach?

Chociaż chatGPT jest użytecznym narzędziem i przełomem w dziedzinie sztucznej inteligencji dla mas, wciąż jest daleki od doskonałości i nie można go pozostawić do całkowitego zabezpieczenia inteligentnych kontraktów.

Nasz test wykazał, że chatGPT wywołał fałszywy alarm dla a atak ponownego wejścia, który był już strzeżony i przetestowany. Poza tym było więcej fałszywych alarmów, a co najważniejsze, krytyczny błąd wykryty przez nasz zespół został całkowicie zignorowany przez chatGPT. Omówmy niektóre rzeczy, których chatGPT może przegapić.

- Logika specyficzna dla projektu:- Kręgosłupem projektu jest jego logika i sposób, w jaki rzeczy są ze sobą połączone, ale chatGPT wydaje się tego nie zauważać. Podczas testów stwierdzono, że chatGPT często nie był w stanie znaleźć krytycznego błędu, który był specyficzny dla logiki. Ze względu na złożoność podstawowej infrastruktury protokołu, chatGPT pomija krytyczne luki, które powstają w wyniku wzajemnych połączeń umów w celu spełnienia logicznego wymagania projektu.

- Niedokładne obliczenia matematyczne i modele statystyczne:- Jeśli chodzi o projekty, niezależnie od tego, czy jest to gra, projekt DeFi, czy cokolwiek innego, dotyczy to głównie obliczeń matematycznych i relacji. Formuły te są często pozostawiane bez kontroli i monitorowania przez chatGPT, a potencjalne błędy są pomijane.

- Nieprawidłowości w zamierzonym projekcie i wykonaniu:- Wiele razy implementacja przez programistów nie jest tak poprawna, jak powinna, co prowadzi do problemów z bezpieczeństwem. Zostało to wykorzystane w przeszłości i nadal jest jednym z podstawowych sektorów, które można ulepszyć, a chatGPT również jest trochę ignorantem na tym froncie.

Wnioski

Jeśli chodzi o bezpieczeństwo i audyt web3, narzędzia AI są pomocne, nie ma co do tego wątpliwości, ale pytanie brzmi, czy to wystarczy? odpowiedź brzmi: wielkie „NIE”. Jak omówiono, niektóre kluczowe luki w zabezpieczeniach można łatwo pominąć, a ponadto istnieje ogromne prawdopodobieństwo fałszywych alarmów. Te fałszywe alarmy tworzą fałszywe poczucie, że chatGPT może zidentyfikować wszystkie błędy i sprawić, że użytkownik w to uwierzy, ale rzeczywistość jest inna i może być brutalna, jeśli uzależnimy się tylko od narzędzi AI.

Sztuczna inteligencja może stać się bardzo skuteczna, ale przed nami długa droga. Najlepszym sposobem na poprawę bezpieczeństwa jest wykorzystanie zarówno sztucznej inteligencji, jak i ręcznego objęcia aspektów bezpieczeństwa inteligentnych kontraktów.

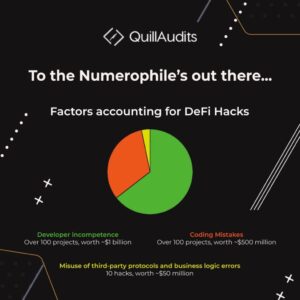

Jeżeli chodzi o inteligentne bezpieczeństwo kontraktów, nic nie zastąpi audytów. Audyt jest bezwzględnie konieczny, a bez audytu nigdy nie będzie zaufania między użytkownikami, ponieważ raporty z audytu wiele znaczą. Wielu użytkowników szuka raportu z audytu, zanim zaufa projektom. Jedną z wiodących firm świadczących usługi audytorskie jest QuillAudits. Mając ponad 700 zabezpieczonych projektów i wiele innych, zapewniamy pełne bezpieczeństwo protokołów. Sprawdź naszą stronę już teraz i zleć audyt swojego projektu.

20 odwiedzajacy

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- Platoblockchain. Web3 Inteligencja Metaverse. Wzmocniona wiedza. Dostęp tutaj.

- Źródło: https://blog.quillhash.com/2023/04/03/beyond-the-hype-chatgpt-and-smart-contract-auditing/

- :Jest

- 2022

- a

- zdolność

- O nas

- dostęp

- precyzja

- Osiągać

- Po

- AI

- alarm

- Wszystkie kategorie

- już

- wśród

- i

- odpowiedź

- odpowiedzi

- osobno

- SĄ

- towary

- AS

- aspekty

- atakować

- Audyt

- zbadane

- audytu

- audytorzy

- kontrole

- Kręgosłup

- na podstawie

- BE

- stają się

- zanim

- uwierzyć

- BEST

- Poza

- Duży

- Bit

- Blog

- przełom

- Bug

- błędy

- by

- Obliczenia

- wezwanie

- nazywa

- Połączenia

- CAN

- nie może

- możliwości

- Etui

- Spowodować

- chatbot

- ChatGPT

- ZOBACZ

- przyjście

- wspólny

- komunikować

- kompletny

- Zakończony

- całkowicie

- kompleksowość

- ciągły

- umowa

- umowy

- kontrola

- konwersacyjny

- pokrycie

- Stwórz

- krytyczny

- istotny

- cyber

- bezpieczeństwo cybernetyczne

- dane

- czynienia

- DeFi

- zależny

- Wnętrze

- deweloperzy

- Dialog

- ZROBIŁ

- różne

- odkryty

- dyskutować

- omówione

- dyskusje

- wątpić

- podczas

- z łatwością

- Efektywne

- skuteczność

- dość

- zapewnić

- niezbędny

- wszyscy

- dokładnie

- egzekucja

- oczekiwać

- eksploatowany

- zewnętrzny

- FAIL

- nakarmiony

- informacja zwrotna

- Znajdź

- znajduje

- firmy

- i terminów, a

- W razie zamówieenia projektu

- znaleziono

- od

- z przodu

- funkcjonować

- Funkcje

- gier

- otrzymać

- daje

- Go

- hacki

- uchwyt

- Have

- ciężki

- pomoc

- pomaga

- W jaki sposób

- Jednak

- HTTPS

- olbrzymi

- człowiek

- Ludzie

- Szum

- i

- zidentyfikować

- realizacja

- realizowane

- podnieść

- ulepszony

- poprawa

- in

- Włącznie z

- informacyjny

- Infrastruktura

- wkład

- interaktywne

- połączone

- Internet

- problemy

- IT

- JEGO

- Trzymać

- uruchomiona

- warstwa

- prowadzić

- prowadzący

- UCZYĆ SIĘ

- nauka

- Prawdopodobnie

- logiczny

- długo

- Popatrz

- od

- Partia

- maszyna

- Mainstream

- media

- robić

- podręcznik

- wiele

- Masy

- matematyka

- matematyczny

- Materia

- Media

- memy

- tęskni

- model

- jeszcze

- większość

- listopad

- of

- on

- ONE

- Inne

- Przeszłość

- Ludzie

- doskonały

- plato

- Analiza danych Platona

- PlatoDane

- możliwość

- Wiadomości

- potencjał

- power

- poprzedni

- Problem

- projekt

- projektowanie

- właściwy

- prawidłowo

- zaproponowane

- protokół

- protokoły

- okazały

- zapewniać

- pytanie

- Quillhash

- Rzeczywistość

- otrzymać

- relacje

- zwolnić

- znakomity

- WIELOKROTNIE

- raport

- Raporty

- wymaganie

- odpowiedź

- dalsze

- powrót

- powraca

- Pokój

- Bezpieczeństwo

- scenariusze

- druga

- Sektory

- bezpieczne

- zabezpieczone

- bezpieczeństwo

- wydaje

- rozsądek

- wrażliwy

- Usługi

- powinien

- znaczący

- mądry

- inteligentna umowa

- Bezpieczeństwo inteligentnych kontraktów

- Inteligentne kontrakty

- mądrzejszy

- So

- Obserwuj Nas

- Media społecznościowe

- kilka

- Źródła

- specyficzny

- początek

- rozpoczęty

- statystyczny

- Nadal

- burza

- styl

- taki

- na pewno

- zdziwiony

- system

- Brać

- trwa

- Mówić

- zespół

- test

- Testy

- że

- Połączenia

- Projekty

- świat

- Im

- Te

- rzeczy

- Przez

- czas

- czasy

- do

- narzędzie

- narzędzia

- przeszkolony

- Trening

- Zaufaj

- zasadniczy

- Nieoczekiwany

- wyjątkowy

- us

- posługiwać się

- Użytkownik

- Użytkownicy

- Wartości

- różnorodny

- Filmy

- Luki w zabezpieczeniach

- wrażliwość

- Droga..

- Web3

- Strona internetowa

- DOBRZE

- znane

- Co

- czy

- który

- będzie

- w

- w ciągu

- bez

- świat

- by

- You

- Twój

- zefirnet