W dzisiejszym krajobrazie indywidualnych interakcji z klientami w celu składania zamówień, dominująca praktyka w dalszym ciągu opiera się na obecności ludzi, nawet w takich miejscach, jak kawiarnie typu drive-thru i lokale typu fast food. To tradycyjne podejście stwarza kilka wyzwań: w dużym stopniu zależy od procesów ręcznych, ma trudności z efektywnym skalowaniem w miarę rosnących wymagań klientów, stwarza ryzyko wystąpienia błędów ludzkich i działa w określonych godzinach dostępności. Ponadto na konkurencyjnych rynkach firmy stosujące wyłącznie procesy ręczne mogą mieć trudności ze świadczeniem wydajnych i konkurencyjnych usług. Pomimo postępu technologicznego model skoncentrowany na człowieku pozostaje głęboko zakorzeniony w przetwarzaniu zamówień, co prowadzi do tych ograniczeń.

Perspektywa wykorzystania technologii do wspomagania realizacji zamówień jeden na jednego istnieje już od jakiegoś czasu. Jednakże istniejące rozwiązania często można podzielić na dwie kategorie: systemy oparte na regułach, które wymagają dużo czasu i wysiłku przy konfiguracji i utrzymaniu, lub systemy sztywne, którym brakuje elastyczności wymaganej do interakcji z klientami na poziomie człowieka. W rezultacie przedsiębiorstwa i organizacje stają przed wyzwaniami związanymi z szybkim i skutecznym wdrażaniem takich rozwiązań. Na szczęście wraz z pojawieniem się generatywna sztuczna inteligencja i duże modele językowe (LLM), możliwe jest teraz tworzenie zautomatyzowanych systemów, które będą w stanie efektywnie obsługiwać język naturalny i działać szybciej.

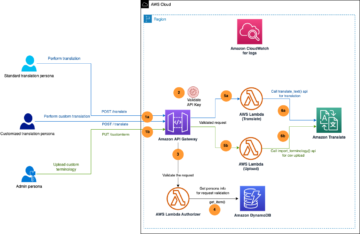

Amazońska skała macierzysta to w pełni zarządzana usługa, która oferuje wybór wysokowydajnych modeli podstawowych (FM) od wiodących firm zajmujących się sztuczną inteligencją, takich jak AI21 Labs, Anthropic, Cohere, Meta, Stability AI i Amazon za pośrednictwem jednego interfejsu API, wraz z szerokim zestawem funkcji, których potrzebujesz muszą tworzyć generatywne aplikacje AI zapewniające bezpieczeństwo, prywatność i odpowiedzialną sztuczną inteligencję. Oprócz Amazon Bedrock możesz korzystać z innych usług AWS, takich jak Amazon SageMaker JumpStart i Amazonka Lex stworzyć w pełni zautomatyzowanych i łatwo adaptowalnych agentów przetwarzania zamówień w oparciu o generatywną sztuczną inteligencję.

W tym poście pokażemy, jak zbudować agenta przetwarzania zamówień obsługującego mowę, korzystając z Amazon Lex, Amazon Bedrock i AWS Lambda.

Omówienie rozwiązania

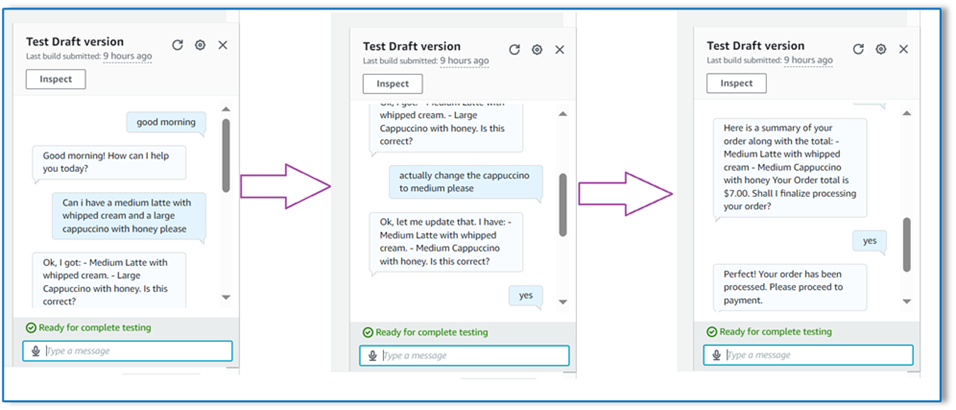

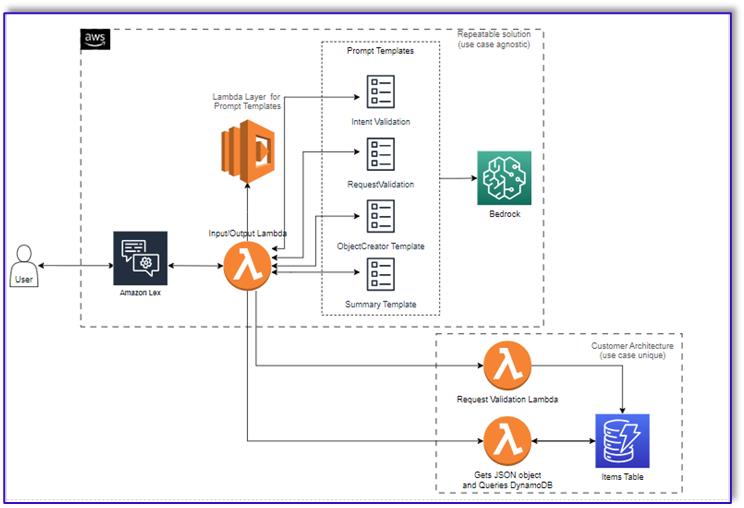

Poniższy diagram ilustruje naszą architekturę rozwiązania.

Przepływ pracy składa się z następujących kroków:

- Klient składa zamówienie za pośrednictwem Amazon Lex.

- Bot Amazon Lex interpretuje intencje klienta i uruchamia:

DialogCodeHook. - Funkcja Lambda pobiera odpowiedni szablon podpowiedzi z warstwy Lambda i formatuje podpowiedzi modelu, dodając dane wejściowe klienta do powiązanego szablonu podpowiedzi.

- Połączenia

RequestValidationPrompt weryfikuje zamówienie z pozycją menu i informuje klienta za pośrednictwem Amazon Lex, czy jest coś, co chce zamówić, a nie jest częścią menu i przedstawia rekomendacje. Monit przeprowadza również wstępną weryfikację kompletności zamówienia. - Połączenia

ObjectCreatorPrompt konwertuje żądania w języku naturalnym na strukturę danych (format JSON). - Funkcja walidatora klienta Lambda weryfikuje wymagane atrybuty zamówienia i potwierdza, czy dostępne są wszystkie informacje niezbędne do realizacji zamówienia.

- Funkcja Lambda klienta przyjmuje strukturę danych jako dane wejściowe do przetwarzania zamówienia i przekazuje kwotę zamówienia z powrotem do orkiestrującej funkcji Lambda.

- Koordynująca funkcja Lambda wywołuje punkt końcowy Amazon Bedrock LLM w celu wygenerowania końcowego podsumowania zamówienia, obejmującego sumę zamówienia z systemu bazy danych klientów (na przykład Amazon DynamoDB).

- Podsumowanie zamówienia jest przesyłane klientowi za pośrednictwem Amazon Lex. Po potwierdzeniu przez Klienta zamówienia, zamówienie zostanie zrealizowane.

Wymagania wstępne

W tym poście założono, że masz aktywne konto AWS i znasz następujące koncepcje i usługi:

Ponadto, aby uzyskać dostęp do Amazon Bedrock z funkcji Lambda, musisz upewnić się, że środowisko wykonawcze Lambda ma następujące biblioteki:

- boto3>=1.28.57

- awscli>=1.29.57

- botocore>=1.31.57

Można to zrobić za pomocą pliku warstwa lambdy lub używając konkretnego AMI z wymaganymi bibliotekami.

Co więcej, biblioteki te są wymagane podczas wywoływania interfejsu API Amazon Bedrock z poziomu Studio Amazon SageMaker. Można to zrobić, uruchamiając komórkę z następującym kodem:

Na koniec tworzysz następującą politykę, a później dołączasz ją do dowolnej roli uzyskującej dostęp do Amazon Bedrock:

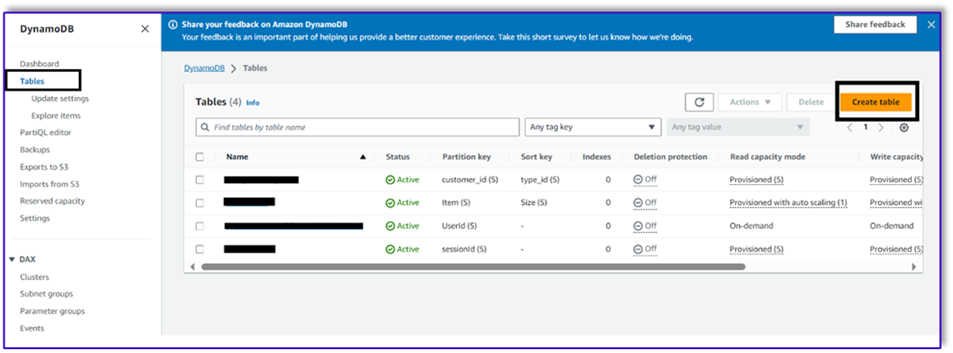

Utwórz tabelę DynamoDB

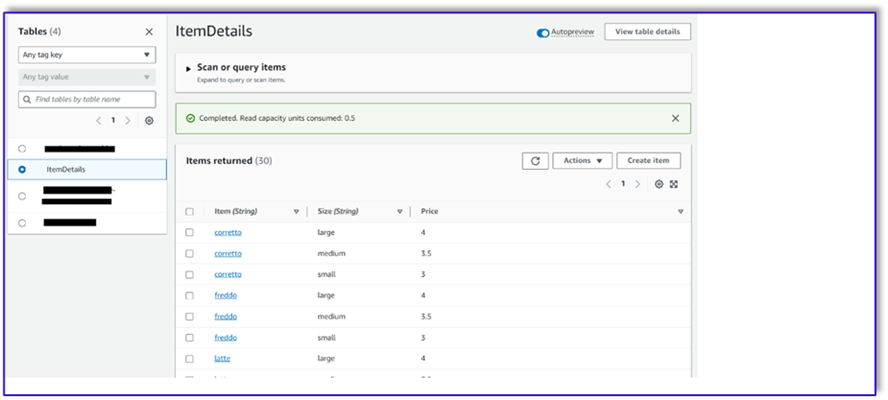

W naszym konkretnym scenariuszu utworzyliśmy tabelę DynamoDB jako nasz system bazy danych klientów, ale możesz również z niej skorzystać Usługa relacyjnych baz danych Amazon (Amazon RDS). Wykonaj następujące kroki, aby udostępnić tabelę DynamoDB (lub dostosuj ustawienia zgodnie z potrzebami):

- W konsoli DynamoDB wybierz Stoły w okienku nawigacji.

- Dodaj Utwórz tabelę.

- W razie zamówieenia projektu Nazwa tabeliwprowadź nazwę (na przykład

ItemDetails). - W razie zamówieenia projektu Klucz partycji, wprowadź klucz (w tym poście używamy

Item). - W razie zamówieenia projektu Sortuj klucz, wprowadź klucz (w tym poście używamy

Size). - Dodaj Utwórz tabelę.

Teraz możesz załadować dane do tabeli DynamoDB. W tym poście używamy pliku CSV. Możesz załadować dane do tabeli DynamoDB, używając kodu Pythona w notatniku SageMaker.

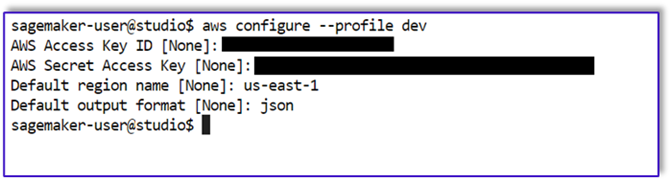

Najpierw musimy skonfigurować profil o nazwie dev.

- Otwórz nowy terminal w SageMaker Studio i uruchom następującą komendę:

To polecenie poprosi Cię o podanie identyfikatora klucza dostępu AWS, tajnego klucza dostępu, domyślnego regionu AWS i formatu wyjściowego.

- Wróć do notatnika SageMaker i napisz kod w Pythonie, aby skonfigurować połączenie z DynamoDB przy użyciu biblioteki Boto3 w Pythonie. Ten fragment kodu tworzy sesję przy użyciu określonego profilu AWS o nazwie dev, a następnie tworzy klienta DynamoDB przy użyciu tej sesji. Poniżej znajduje się przykładowy kod służący do ładowania danych:

Alternatywnie można użyć Środowisko pracy NoSQL lub inne narzędzia do szybkiego ładowania danych do tabeli DynamoDB.

Poniżej znajduje się zrzut ekranu po wstawieniu przykładowych danych do tabeli.

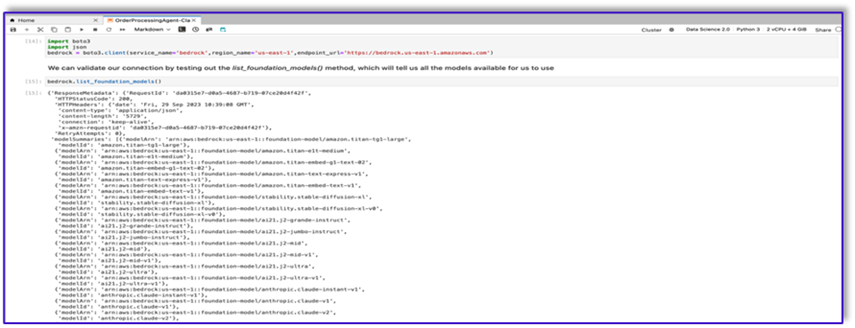

Twórz szablony w notatniku SageMaker, korzystając z interfejsu API wywoływania Amazon Bedrock

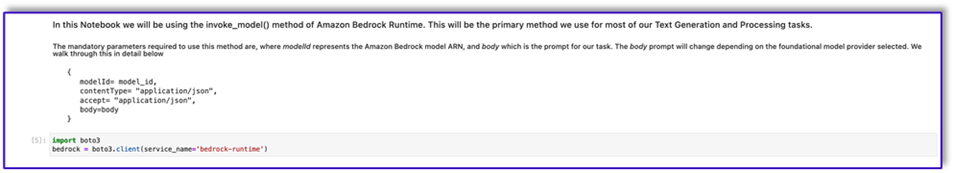

Aby utworzyć nasz szablon podpowiedzi dla tego przypadku użycia, używamy Amazon Bedrock. Dostęp do Amazon Bedrock można uzyskać z Konsola zarządzania AWS oraz poprzez wywołania API. W naszym przypadku uzyskujemy dostęp do Amazon Bedrock poprzez API z wygodnego notatnika SageMaker Studio, aby utworzyć nie tylko nasz szablon podpowiedzi, ale także nasz kompletny kod wywołania API, który możemy później wykorzystać w naszej funkcji Lambda.

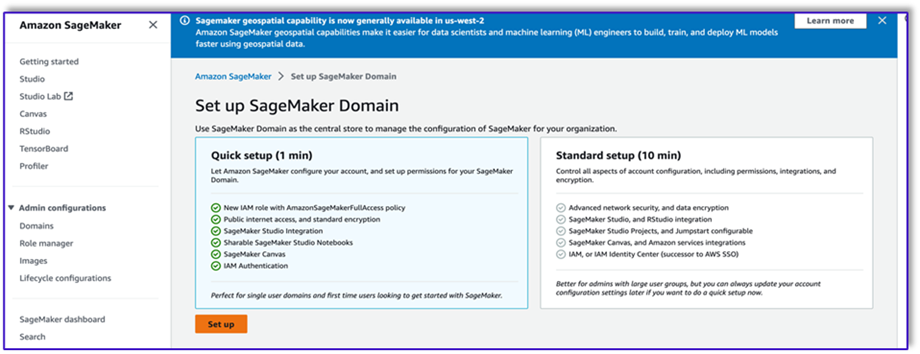

- Na konsoli SageMaker uzyskaj dostęp do istniejącej domeny SageMaker Studio lub utwórz nową, aby uzyskać dostęp do Amazon Bedrock z notatnika SageMaker.

- Po utworzeniu domeny i użytkownika SageMaker wybierz użytkownika i wybierz Premiera i Studio. Spowoduje to otwarcie środowiska JupyterLab.

- Gdy środowisko JupyterLab będzie gotowe, otwórz nowy notatnik i rozpocznij import niezbędnych bibliotek.

Istnieje wiele FM dostępnych za pośrednictwem pakietu SDK Amazon Bedrock Python. W tym przypadku używamy Claude V2, potężnego modelu podstawowego opracowanego przez Anthropic.

Agent przetwarzający zamówienia potrzebuje kilku różnych szablonów. Może się to zmieniać w zależności od przypadku użycia, ale opracowaliśmy ogólny przepływ pracy, który można zastosować do wielu ustawień. W tym przypadku szablon Amazon Bedrock LLM wykona następujące czynności:

- Zweryfikuj intencje klienta

- Zweryfikuj żądanie

- Utwórz strukturę danych zamówienia

- Przekaż podsumowanie zamówienia klientowi

- Aby wywołać model, utwórz obiekt wykonawczy z poziomu Boto3.

Zacznijmy od pracy nad szablonem podpowiedzi modułu sprawdzania intencji. Jest to proces iteracyjny, ale dzięki przewodnikowi inżynieryjnemu firmy Anthropic można szybko utworzyć podpowiedzi, które umożliwią wykonanie zadania.

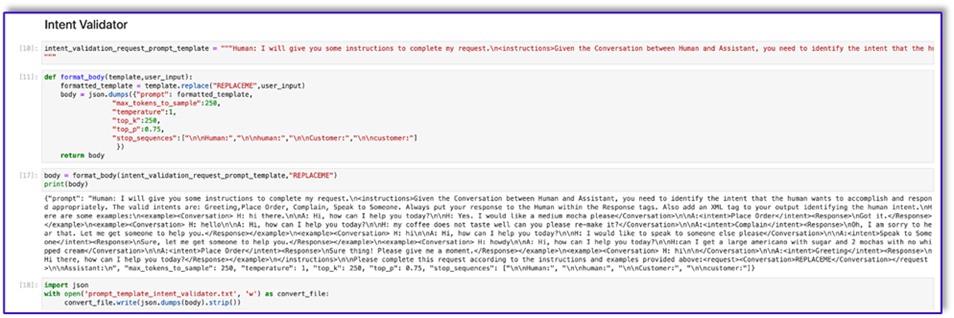

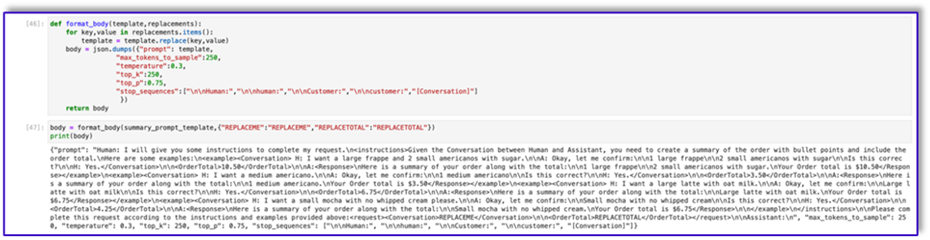

- Utwórz pierwszy szablon podpowiedzi wraz z funkcją narzędziową, która pomoże przygotować treść na wywołania API.

Poniżej znajduje się kod dla pliku Prompt_template_intent_validator.txt:

- Zapisz ten szablon w pliku, aby przesłać go do Amazon S3 i w razie potrzeby wywołać funkcję Lambda. Zapisz szablony jako serializowane ciągi znaków JSON w pliku tekstowym. Poprzedni zrzut ekranu pokazuje przykładowy kod, który również to umożliwia.

- Powtórz te same kroki z innymi szablonami.

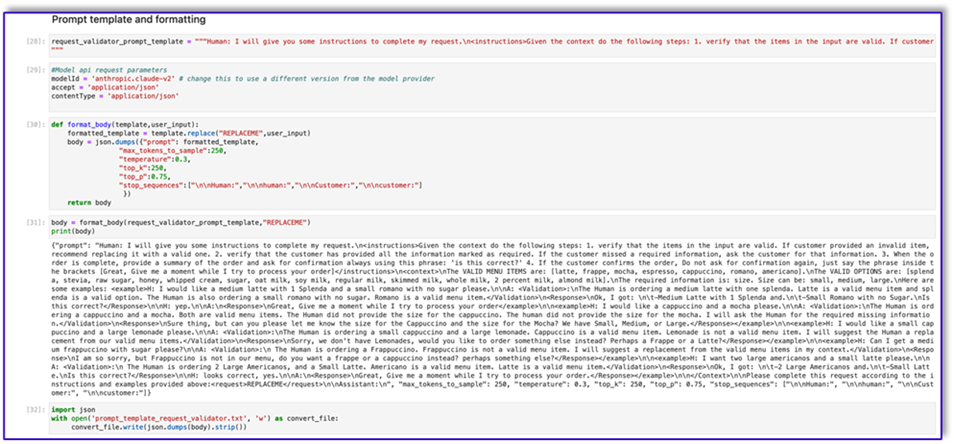

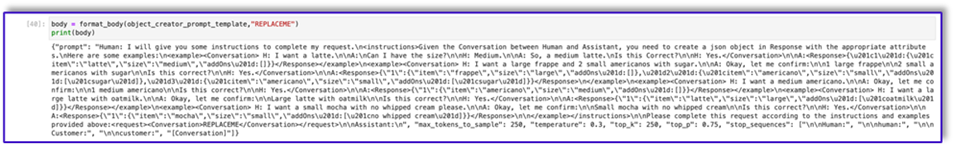

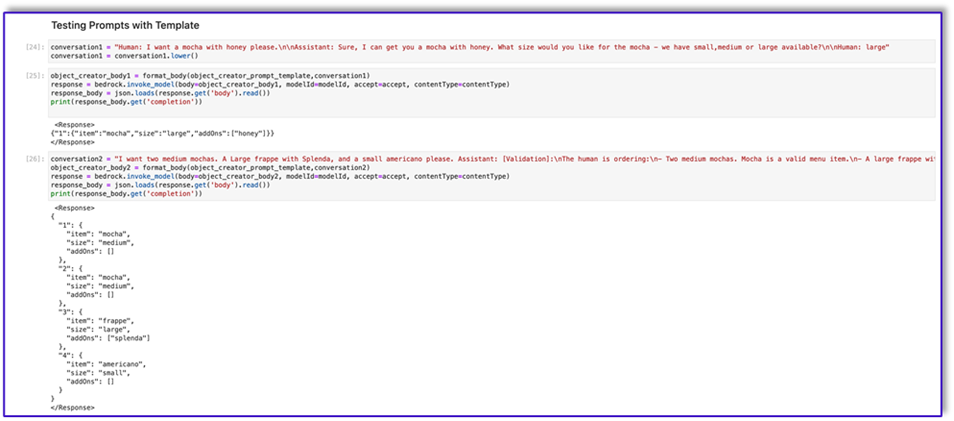

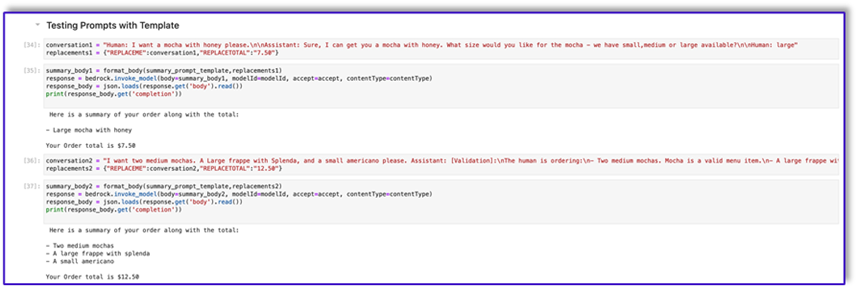

Poniżej znajdują się zrzuty ekranu innych szablonów i wyniki wywołania Amazon Bedrock przy użyciu niektórych z nich.

Poniżej znajduje się kod dla pliku Prompt_template_request_validator.txt:

Poniżej znajduje się nasza odpowiedź od Amazon Bedrock, w której wykorzystano ten szablon.

Poniżej znajduje się kod dla prompt_template_object_creator.txt:

Poniżej znajduje się kod dla Prompt_template_order_summary.txt:

Jak widać, użyliśmy naszych szablonów podpowiedzi do sprawdzenia pozycji menu, zidentyfikowania brakujących wymaganych informacji, stworzenia struktury danych i podsumowania kolejności. Podstawowe modele dostępne w Amazon Bedrock są bardzo wydajne, dzięki czemu możesz wykonać jeszcze więcej zadań za pomocą tych szablonów.

Zakończyłeś projektowanie podpowiedzi i zapisałeś szablony w plikach tekstowych. Możesz teraz rozpocząć tworzenie bota Amazon Lex i powiązanych funkcji Lambda.

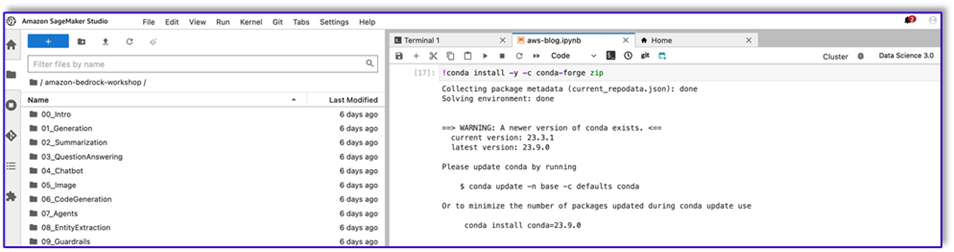

Utwórz warstwę Lambda za pomocą szablonów podpowiedzi

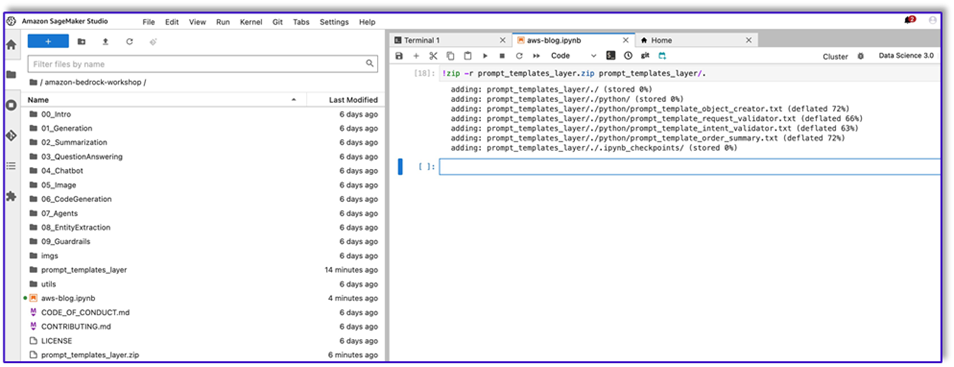

Wykonaj następujące kroki, aby utworzyć warstwę Lambda:

- W SageMaker Studio utwórz nowy folder z podfolderem o nazwie

python. - Skopiuj pliki podpowiedzi do pliku

pythonteczka.

- Możesz dodać bibliotekę ZIP do instancji notatnika, uruchamiając następujące polecenie.

- Teraz uruchom następujące polecenie, aby utworzyć plik ZIP do przesłania do warstwy Lambda.

- Po utworzeniu pliku ZIP możesz go pobrać. Przejdź do Lambda, utwórz nową warstwę, przesyłając plik bezpośrednio lub przesyłając najpierw do Amazon S3.

- Następnie dołącz tę nową warstwę do funkcji Lambda orkiestracji.

Teraz pliki szablonów podpowiedzi są przechowywane lokalnie w środowisku wykonawczym Lambda. Przyspieszy to proces podczas uruchamiania bota.

Utwórz warstwę Lambda z wymaganymi bibliotekami

Wykonaj następujące kroki, aby utworzyć warstwę Lambda z wymaganymi bibliotekami:

- Otwieranie Chmura AWS9 środowisku instancji utwórz folder z podfolderem o nazwie

python. - Otwórz terminal wewnątrz

pythonteczka. - Uruchom następujące polecenia z terminala:

- run

cd ..i umieść się w swoim nowym folderze, w którym również masz plikpythonpodfolder. - Uruchom następujące polecenie:

- Po utworzeniu pliku ZIP możesz go pobrać. Przejdź do Lambda, utwórz nową warstwę, przesyłając plik bezpośrednio lub przesyłając najpierw do Amazon S3.

- Następnie dołącz tę nową warstwę do funkcji Lambda orkiestracji.

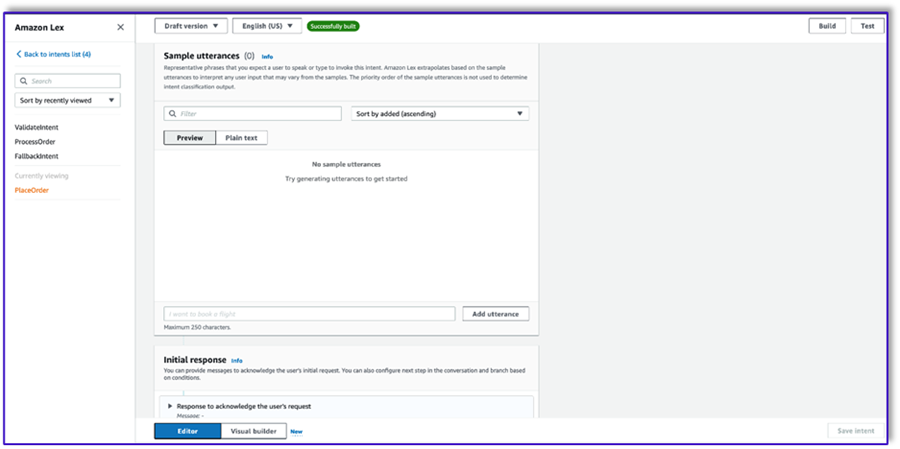

Utwórz bota w Amazon Lex v2

W tym przypadku budujemy bota Amazon Lex, który może zapewnić interfejs wejścia/wyjścia dla architektury w celu wywołania Amazon Bedrock za pomocą głosu lub tekstu z dowolnego interfejsu. Ponieważ LLM zajmie się konwersacją tego agenta przetwarzającego zamówienia, a Lambda będzie koordynować przepływ pracy, możesz utworzyć bota z trzema intencjami i bez miejsc.

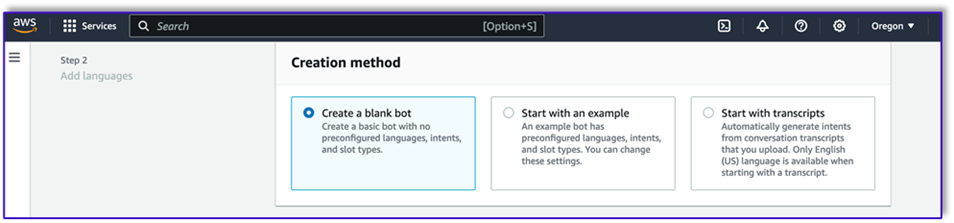

- Na konsoli Amazon Lex utwórz nowego bota za pomocą metody Utwórz pustego bota.

Teraz możesz dodać intencję z dowolną odpowiednią wypowiedzią początkową, aby użytkownicy końcowi mogli rozpocząć rozmowę z botem. Używamy prostych powitań i dodajemy wstępną odpowiedź bota, aby użytkownicy końcowi mogli przekazać swoje żądania. Tworząc bota, pamiętaj o użyciu haka w kodzie Lambda z intencjami; uruchomi to funkcję Lambda, która zorganizuje przepływ pracy między klientem, Amazon Lex i LLM.

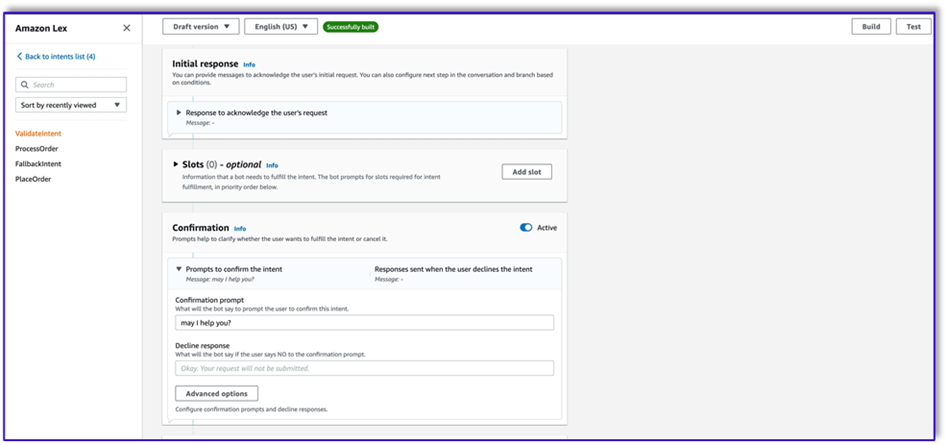

- Dodaj pierwszą intencję, która uruchomi przepływ pracy i użyje szablonu monitu o sprawdzenie intencji, aby wywołać Amazon Bedrock i określić, co klient próbuje osiągnąć. Dodaj kilka prostych wypowiedzi, aby użytkownicy końcowi mogli rozpocząć rozmowę.

Nie musisz używać żadnych slotów ani wstępnego czytania w żadnej z intencji bota. Tak naprawdę nie ma potrzeby dodawania wyrażeń do drugiej lub trzeciej intencji. Dzieje się tak, ponieważ LLM poprowadzi Lambdę przez cały proces.

- Dodaj monit o potwierdzenie. Możesz później dostosować ten komunikat w funkcji Lambda.

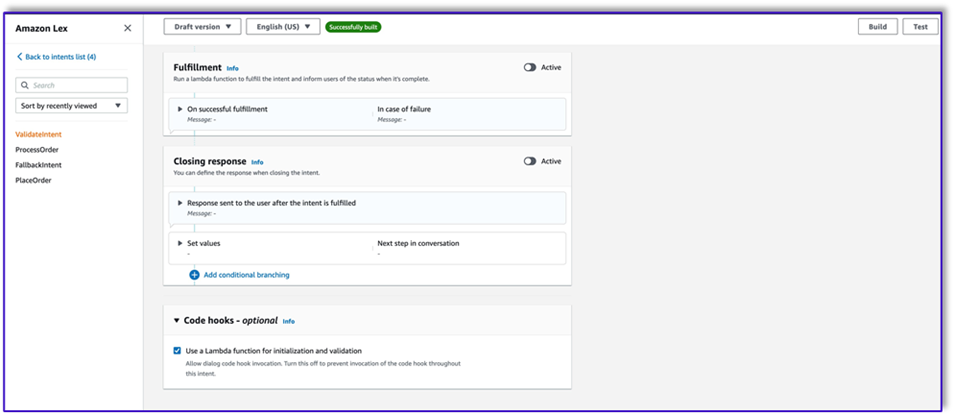

- Pod Kod haczyki, Wybierz Użyj funkcji Lambda do inicjalizacji i sprawdzania poprawności.

- Stwórz drugą intencję bez wypowiedzi i początkowej odpowiedzi. To jest

PlaceOrderzamiar.

Gdy LLM wykryje, że klient próbuje złożyć zamówienie, funkcja Lambda uruchomi ten zamiar i zweryfikuje żądanie klienta w menu oraz upewni się, że nie brakuje żadnych wymaganych informacji. Pamiętaj, że wszystko to znajduje się w szablonach podpowiedzi, więc możesz dostosować ten przepływ pracy do dowolnego przypadku użycia, zmieniając szablony podpowiedzi.

- Nie dodawaj żadnych przedziałów, ale dodaj monit o potwierdzenie i odrzuć odpowiedź.

- Wybierz Użyj funkcji Lambda do inicjalizacji i sprawdzania poprawności.

- Utwórz trzecią intencję o nazwie

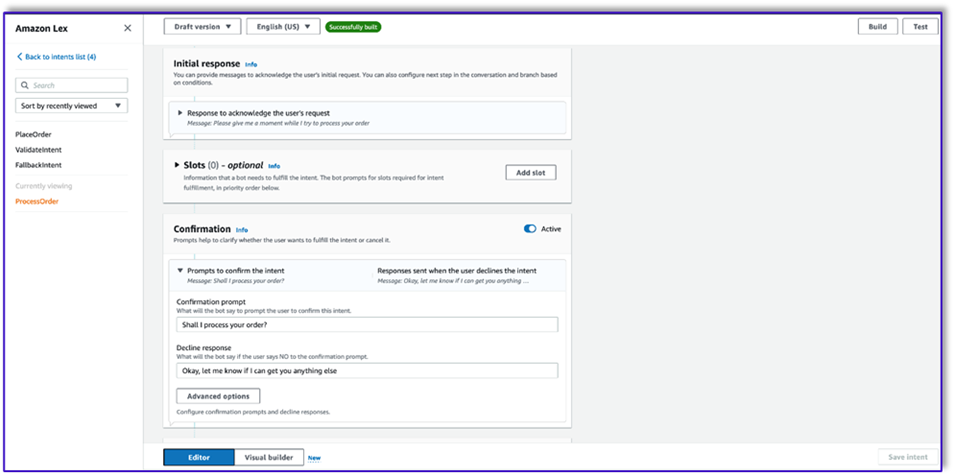

ProcessOrderbez przykładowych wypowiedzi i bez szczelin. - Dodaj odpowiedź wstępną, prośbę o potwierdzenie i odpowiedź o odrzuceniu.

Po zatwierdzeniu żądania klienta przez LLM funkcja Lambda uruchamia trzecią i ostatnią intencję realizacji zamówienia. W tym przypadku Lambda użyje szablonu kreatora obiektów do wygenerowania struktury danych JSON zamówienia w celu wysłania zapytania do tabeli DynamoDB, a następnie użyje szablonu podsumowania zamówienia do podsumowania całego zamówienia wraz z sumą, aby Amazon Lex mógł przekazać je klientowi.

- Wybierz Użyj funkcji Lambda do inicjalizacji i sprawdzania poprawności. Może to wykorzystać dowolną funkcję Lambda do przetworzenia zamówienia po ostatecznym potwierdzeniu przez klienta.

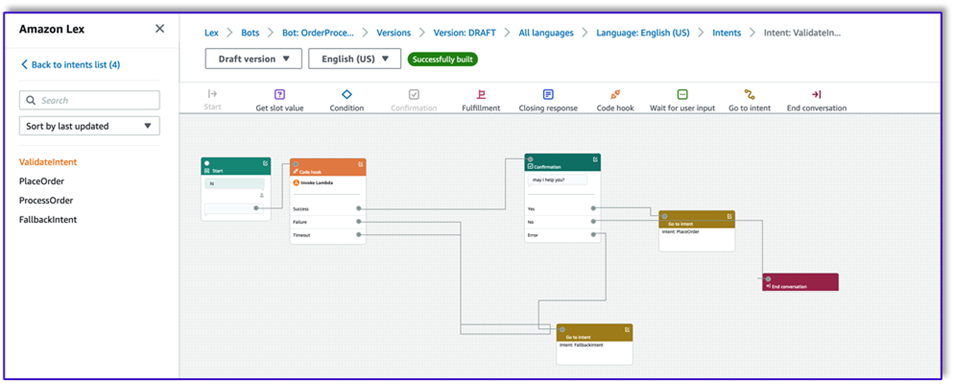

- Po utworzeniu wszystkich trzech intencji przejdź do kreatora wizualizacji dla

ValidateIntent, dodaj krok zamiaru przejścia do celu i podłącz wyjście pozytywnego potwierdzenia do tego kroku. - Po dodaniu intencji „przejdź do” dokonaj jej edycji i jako nazwę intencji wybierz intencję PlaceOrder.

- Podobnie, aby przejść do kreatora wizualizacji dla

PlaceOrderzamiar i podłącz wyjście pozytywnego potwierdzenia doProcessOrderzamiar iść do celu. Nie jest wymagana żadna edycjaProcessOrderzamiar. - Teraz musisz utworzyć funkcję Lambda, która koordynuje działanie Amazon Lex i wywołuje tabelę DynamoDB, jak opisano szczegółowo w następnej sekcji.

Utwórz funkcję Lambda, aby zarządzać botem Amazon Lex

Możesz teraz zbudować funkcję Lambda, która koordynuje bota i przepływ pracy Amazon Lex. Wykonaj następujące kroki:

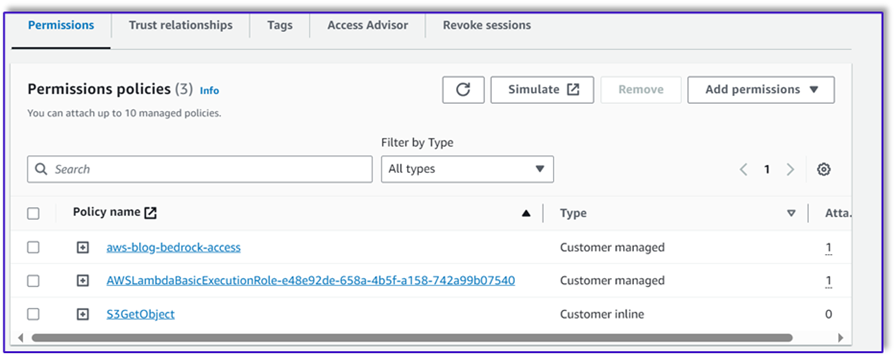

- Utwórz funkcję Lambda ze standardową polityką wykonywania i pozwól Lambdzie utworzyć dla Ciebie rolę.

- W oknie kodu swojej funkcji dodaj kilka funkcji narzędziowych, które pomogą: sformatuj podpowiedzi, dodając kontekst leksykalny do szablonu, wywołaj API Amazon Bedrock LLM, wyodrębnij żądany tekst z odpowiedzi i nie tylko. Zobacz następujący kod:

- Dołącz do tej funkcji utworzoną wcześniej warstwę Lambda.

- Dodatkowo dołącz warstwę do utworzonych szablonów podpowiedzi.

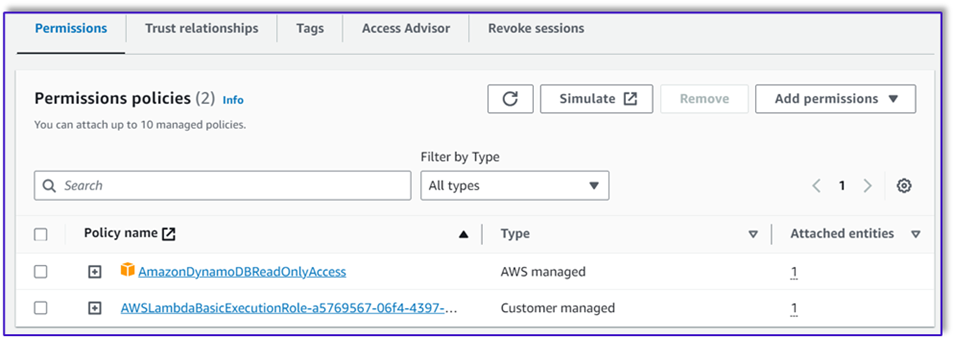

- W roli wykonawczej Lambda dołącz politykę dostępu do Amazon Bedrock, która została utworzona wcześniej.

Rola wykonawcza Lambda powinna mieć następujące uprawnienia.

Dołącz funkcję Orchestration Lambda do bota Amazon Lex

- Po utworzeniu funkcji w poprzedniej sekcji wróć do konsoli Amazon Lex i przejdź do swojego bota.

- Pod Języki w okienku nawigacji wybierz Angielski.

- W razie zamówieenia projektu Źródło, wybierz bota obsługującego zamówienia.

- W razie zamówieenia projektu Wersja lub alias funkcji lambdawybierz $NAJNOWSZE.

- Dodaj Zapisz.

Utwórz pomocnicze funkcje Lambda

Wykonaj następujące kroki, aby utworzyć dodatkowe funkcje Lambda:

- Utwórz funkcję Lambda, aby wysłać zapytanie do utworzonej wcześniej tabeli DynamoDB:

- Nawiguj do systemu tab w funkcji Lambda i wybierz Uprawnienia.

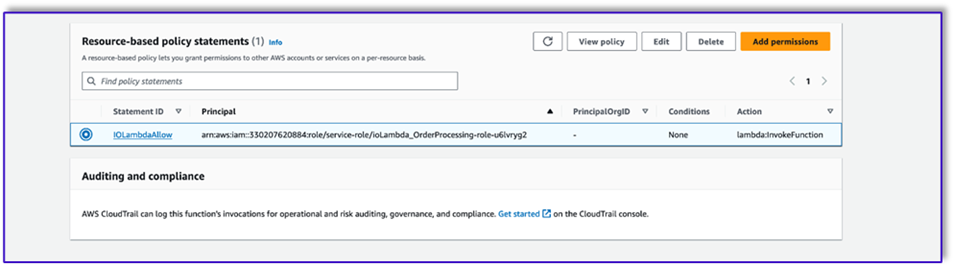

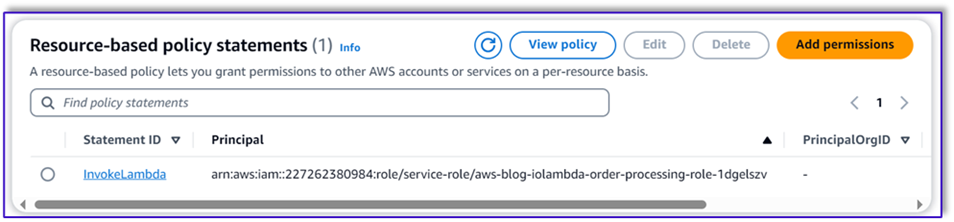

- Dołącz instrukcję zasad opartą na zasobach, umożliwiającą funkcji Lambda przetwarzania zamówień wywoływanie tej funkcji.

- Przejdź do roli wykonawczej IAM dla tej funkcji Lambda i dodaj politykę dostępu do tabeli DynamoDB.

- Utwórz kolejną funkcję Lambda, aby sprawdzić, czy klient przekazał wszystkie wymagane atrybuty. W poniższym przykładzie sprawdzamy, czy dla zamówienia przechwycono atrybut rozmiaru:

- Nawiguj do systemu tab w funkcji Lambda i wybierz Uprawnienia.

- Dołącz instrukcję zasad opartą na zasobach, umożliwiającą funkcji Lambda przetwarzania zamówień wywoływanie tej funkcji.

Przetestuj rozwiązanie

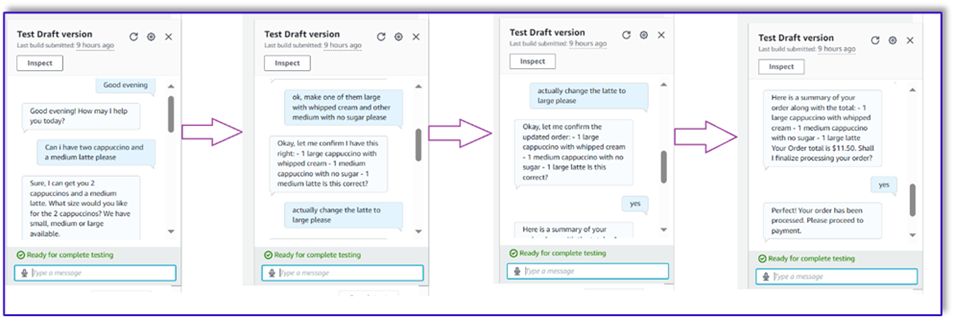

Teraz możemy przetestować rozwiązanie na przykładowych zamówieniach, które klienci składają za pośrednictwem Amazon Lex.

W naszym pierwszym przykładzie klient poprosił o frappuccino, którego nie ma w menu. Model dokonuje walidacji za pomocą szablonu walidatora zamówień i sugeruje pewne rekomendacje na podstawie menu. Po potwierdzeniu zamówienia Klient otrzymuje informację o kwocie zamówienia i podsumowaniu zamówienia. Zamówienie zostanie zrealizowane na podstawie ostatecznego potwierdzenia przez Klienta.

W naszym kolejnym przykładzie klient zamawia duże cappuccino, a następnie zmienia rozmiar z dużego na średni. Model rejestruje wszystkie niezbędne zmiany i prosi klienta o potwierdzenie zamówienia. Model prezentuje sumę zamówienia oraz podsumowanie zamówienia i realizuje zamówienie na podstawie ostatecznego potwierdzenia Klienta.

W naszym ostatnim przykładzie klient złożył zamówienie na wiele artykułów, a w przypadku kilku artykułów brakowało rozmiaru. Model i funkcja Lambda zweryfikują, czy występują wszystkie wymagane atrybuty do realizacji zamówienia, a następnie poproszą klienta o uzupełnienie brakujących informacji. Po uzupełnieniu przez klienta brakujących informacji (w tym przypadku wielkości kawy) wyświetlana jest mu suma zamówienia oraz podsumowanie zamówienia. Zamówienie zostanie zrealizowane na podstawie ostatecznego potwierdzenia przez Klienta.

Ograniczenia LLM

Wyniki LLM są z natury stochastyczne, co oznacza, że wyniki naszego LLM mogą różnić się formatem, a nawet formą nieprawdziwych treści (halucynacji). Dlatego programiści muszą polegać na dobrej logice obsługi błędów w całym kodzie, aby obsłużyć takie scenariusze i uniknąć pogorszenia komfortu użytkownika końcowego.

Sprzątać

Jeśli nie potrzebujesz już tego rozwiązania, możesz usunąć następujące zasoby:

- Funkcje lambda

- Pudełko Amazona Lexa

- Tabela DynamoDB

- Wiadro S3

Dodatkowo zamknij instancję SageMaker Studio, jeśli aplikacja nie jest już potrzebna.

Ocena kosztów

Informacje o cenach głównych usług wykorzystywanych przez to rozwiązanie można znaleźć poniżej:

Pamiętaj, że możesz używać Claude v2 bez konieczności udostępniania, więc ogólne koszty pozostają na minimalnym poziomie. Aby jeszcze bardziej obniżyć koszty, możesz skonfigurować tabelę DynamoDB z ustawieniem na żądanie.

Wnioski

W tym poście pokazano, jak zbudować agenta przetwarzania zamówień AI obsługującego mowę przy użyciu Amazon Lex, Amazon Bedrock i innych usług AWS. Pokazaliśmy, jak szybka inżynieria z potężnym generatywnym modelem sztucznej inteligencji, takim jak Claude, może umożliwić solidne zrozumienie języka naturalnego i przepływ konwersacji na potrzeby przetwarzania zamówień bez konieczności posiadania obszernych danych szkoleniowych.

Architektura rozwiązania wykorzystuje komponenty bezserwerowe, takie jak Lambda, Amazon S3 i DynamoDB, aby umożliwić elastyczną i skalowalną implementację. Przechowywanie szablonów podpowiedzi w Amazon S3 pozwala dostosować rozwiązanie do różnych przypadków użycia.

Kolejne kroki mogą obejmować rozszerzenie możliwości agenta w celu obsługi szerszego zakresu żądań klientów i spraw brzegowych. Szablony podpowiedzi umożliwiają iteracyjne doskonalenie umiejętności agenta. Dodatkowe dostosowania mogą obejmować integrację danych zamówień z systemami zaplecza, takimi jak zapasy, CRM lub POS. Wreszcie agent można udostępnić w różnych punktach kontaktu z klientami, takich jak aplikacje mobilne, punkty typu drive-thru, kioski i inne, korzystając z wielokanałowych możliwości Amazon Lex.

Aby dowiedzieć się więcej, zapoznaj się z następującymi powiązanymi zasobami:

- Wdrażanie i zarządzanie botami wielokanałowymi:

- Szybka inżynieria dla Claude i innych modeli:

- Bezserwerowe wzorce architektoniczne dla skalowalnych asystentów AI:

O autorach

Mumita Dutta jest architektem rozwiązań partnerskich w Amazon Web Services. Na swoim stanowisku ściśle współpracuje z partnerami w celu opracowania skalowalnych zasobów nadających się do ponownego wykorzystania, które usprawniają wdrożenia w chmurze i zwiększają efektywność operacyjną. Jest członkiem społeczności AI/ML i ekspertem Generative AI w AWS. W wolnym czasie lubi pracować w ogrodzie i jeździć na rowerze.

Mumita Dutta jest architektem rozwiązań partnerskich w Amazon Web Services. Na swoim stanowisku ściśle współpracuje z partnerami w celu opracowania skalowalnych zasobów nadających się do ponownego wykorzystania, które usprawniają wdrożenia w chmurze i zwiększają efektywność operacyjną. Jest członkiem społeczności AI/ML i ekspertem Generative AI w AWS. W wolnym czasie lubi pracować w ogrodzie i jeździć na rowerze.

Fernando Lammoglii jest architektem rozwiązań partnerskich w Amazon Web Services, blisko współpracującym z partnerami AWS w kierowaniu rozwojem i wdrażaniem najnowocześniejszych rozwiązań AI we wszystkich jednostkach biznesowych. Lider strategiczny posiadający wiedzę specjalistyczną w zakresie architektury chmury, generatywnej sztucznej inteligencji, uczenia maszynowego i analityki danych. Specjalizuje się w realizacji strategii wejścia na rynek i dostarczaniu skutecznych rozwiązań AI dostosowanych do celów organizacji. W wolnym czasie uwielbia spędzać czas z rodziną i podróżować do innych krajów.

Fernando Lammoglii jest architektem rozwiązań partnerskich w Amazon Web Services, blisko współpracującym z partnerami AWS w kierowaniu rozwojem i wdrażaniem najnowocześniejszych rozwiązań AI we wszystkich jednostkach biznesowych. Lider strategiczny posiadający wiedzę specjalistyczną w zakresie architektury chmury, generatywnej sztucznej inteligencji, uczenia maszynowego i analityki danych. Specjalizuje się w realizacji strategii wejścia na rynek i dostarczaniu skutecznych rozwiązań AI dostosowanych do celów organizacji. W wolnym czasie uwielbia spędzać czas z rodziną i podróżować do innych krajów.

Mitula Patela jest starszym architektem rozwiązań w Amazon Web Services. Pełniąc rolę twórcy technologii chmurowej, współpracuje z klientami, aby zrozumieć ich cele i wyzwania, a także zapewnia wskazówki, jak osiągnąć ich cel dzięki ofercie AWS. Jest członkiem społeczności AI/ML i ambasadorem Generative AI w AWS. W wolnym czasie lubi wędrować i grać w piłkę nożną.

Mitula Patela jest starszym architektem rozwiązań w Amazon Web Services. Pełniąc rolę twórcy technologii chmurowej, współpracuje z klientami, aby zrozumieć ich cele i wyzwania, a także zapewnia wskazówki, jak osiągnąć ich cel dzięki ofercie AWS. Jest członkiem społeczności AI/ML i ambasadorem Generative AI w AWS. W wolnym czasie lubi wędrować i grać w piłkę nożną.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/transform-one-on-one-customer-interactions-build-speech-capable-order-processing-agents-with-aws-and-generative-ai/

- :ma

- :Jest

- :nie

- :Gdzie

- $3

- $W GÓRĘ

- 1

- 10

- 100

- 11

- 12

- 13

- 15%

- 173

- 200

- 24

- 250

- 28

- 29

- 31

- 320

- 385

- 40

- 400

- 500

- 7

- 75

- 8

- 9

- 900

- a

- powyżej

- przyśpieszony

- Akceptuj

- dostęp

- Dostęp

- wykonać

- Stosownie

- Konto

- Osiągać

- w poprzek

- Działania

- aktywny

- przystosować

- Dodaj

- w dodatku

- dodanie

- dodatek

- Dodatkowy

- do tego

- przylegający

- dostosować

- Przyjęcie

- postępy

- nadejście

- Po

- ponownie

- przed

- Agent

- agentów

- AI

- AI / ML

- wyrównany

- Wszystkie kategorie

- dopuszczać

- Pozwalać

- pozwala

- wzdłuż

- również

- zawsze

- am

- Amazonka

- Amazonka Lex

- Amazon RDS

- Amazon Web Services

- Ambasador

- an

- analityka

- i

- Inne

- Antropiczny

- każdy

- api

- Zastosowanie

- aplikacje

- Aplikuj

- podejście

- właściwy

- odpowiednio

- mobilne i webowe

- architektoniczny

- architektura

- SĄ

- AS

- zapytać

- Aktywa

- Wsparcie

- Asystent

- asystenci

- pomoc

- powiązany

- zakłada

- At

- dołączać

- Personel

- atrybuty

- zautomatyzowane

- dostępność

- dostępny

- uniknąć

- AWS

- z powrotem

- Backend

- na podstawie

- BE

- bo

- być

- rozpocząć

- pomiędzy

- ciało

- Bot

- obie

- boty

- szeroki

- budować

- budowniczy

- biznes

- biznes

- ale

- by

- obliczać

- wezwanie

- nazywa

- powołanie

- Połączenia

- CAN

- możliwości

- Zajęte

- przechwytuje

- walizka

- Etui

- kategorie

- komórka

- wyzwania

- wyzwanie

- zmiana

- Zmiany

- wymiana pieniędzy

- znaków

- ZOBACZ

- wybór

- Dodaj

- klient

- Zamknij

- dokładnie

- Chmura

- TECHNOLOGIA W CHMURZE

- kod

- Kawa

- współpracuje

- zbierać

- przekazane

- społeczność

- Firmy

- konkurencyjny

- kompletny

- Zakończony

- wypełniając

- ukończenia

- składniki

- Koncepcje

- Potwierdzać

- potwierdzenie

- ZATWARDZIAŁY

- Skontaktuj się

- połączenie

- składa się

- Konsola

- zawartość

- kontekst

- ciągły

- wygoda

- Rozmowa

- konwertować

- skorygowania

- Koszty:

- mógłby

- kraje

- Para

- Stwórz

- stworzony

- tworzy

- Tworzenie

- tworzenie

- twórca

- CRM

- Aktualny

- zwyczaj

- klient

- Klientów

- dostosować

- pionierski nowatorski

- dane

- Analityka danych

- Struktura danych

- Baza danych

- upadek

- głęboko

- Domyślnie

- określić

- dostarczyć

- dostarczanie

- Kreowanie

- wymagania

- wykazać

- odmówiono

- W zależności

- zależy

- wdrożenia

- zaprojektowany

- życzenia

- Mimo

- szczegółowe

- dev

- rozwijać

- rozwinięty

- deweloperzy

- oprogramowania

- schemat

- ZROBIŁ

- różne

- bezpośrednio

- wysyłka

- do

- robi

- domena

- darowizna

- zrobić

- nie

- na dół

- pobieranie

- podczas

- e

- każdy

- Wcześniej

- z łatwością

- krawędź

- efekt

- efektywność

- wydajny

- skutecznie

- wysiłek

- więcej

- umożliwiać

- aktywator

- Punkt końcowy

- Inżynieria

- wzmacniać

- Wchodzę

- Środowisko

- błąd

- Błędy

- Parzyste

- wydarzenie

- przykład

- przykłady

- Z wyjątkiem

- wyjątek

- wykonywania

- egzekucja

- Przede wszystkim system został opracowany

- Wyjście

- rozszerzenie

- doświadczenie

- ekspert

- ekspertyza

- rozległy

- wyciąg

- Twarz

- fakt

- Spadać

- Znajomość

- członków Twojej rodziny

- kilka

- filet

- Akta

- finał

- sfinalizować

- Znajdź

- i terminów, a

- Elastyczność

- elastyczne

- Przepływy

- następujący

- W razie zamówieenia projektu

- Nasz formularz

- format

- na szczęście

- znaleziono

- Fundacja

- podstawowy

- Darmowy

- od

- w pełni

- funkcjonować

- Funkcje

- dalej

- Ogólne

- Generować

- generatywny

- generatywna sztuczna inteligencja

- otrzymać

- Dać

- dany

- Go

- Idź do sklepu

- Gole

- dobry

- got

- wielki

- wspaniały

- powitanie

- Pozdrowienia

- poradnictwo

- poprowadzi

- uchwyt

- Prowadzenie

- Have

- mający

- he

- słyszeć

- ciężko

- pomoc

- jej

- tutaj

- hi

- wydajny

- jego

- Honey

- GODZINY

- W jaki sposób

- How To

- Jednak

- HTML

- http

- HTTPS

- człowiek

- i

- ID

- identyfikuje

- zidentyfikować

- identyfikacja

- if

- ilustruje

- wpływowy

- realizacja

- wykonawczych

- importować

- importowanie

- podnieść

- in

- zawierać

- Włącznie z

- Przybywający

- wzrastający

- wskaźnik

- Informacja

- zakorzeniony

- początkowy

- wkład

- Wejścia

- wewnątrz

- zainstalować

- przykład

- zamiast

- instrukcje

- Integracja

- zamiar

- Interakcje

- Interfejs

- najnowszych

- Przedstawia

- inwentarz

- angażować

- IT

- szt

- jpg

- json

- właśnie

- Trzymać

- Klawisz

- kioski

- Wiedzieć

- Labs

- Brak

- krajobraz

- język

- duży

- Nazwisko

- w końcu

- później

- warstwa

- lider

- prowadzący

- UCZYĆ SIĘ

- nauka

- lemoniada

- niech

- pozwala

- biblioteki

- Biblioteka

- lubić

- Ograniczenia

- Lista

- LLM

- załadować

- lokalnie

- zalogowaniu

- logika

- dłużej

- WYGLĄD

- kocha

- maszyna

- uczenie maszynowe

- zrobiony

- Główny

- robić

- zarządzane

- i konserwacjami

- zarządzający

- podręcznik

- wiele

- wyraźny

- rynki

- me

- znaczy

- średni

- członek

- Menu

- wiadomość

- wiadomości

- Meta

- metoda

- może

- Mleko

- minimum

- nieodebranych

- brakujący

- Aplikacje mobilne

- aplikacje mobilne

- model

- modele

- zmodyfikowano

- modyfikować

- moment

- jeszcze

- wielokrotność

- my

- Nazwa

- O imieniu

- Naturalny

- Natura

- Nawigacja

- Nawigacja

- niezbędny

- Potrzebować

- potrzebne

- wymagania

- Nowości

- Następny

- Nie

- żaden

- notatnik

- już dziś

- przedmiot

- cel

- miejsce

- of

- Oferty

- Oferty

- często

- W porządku

- on

- Na żądanie

- ONE

- tylko

- koncepcja

- działa

- operacyjny

- Option

- Opcje

- or

- orkiestracja

- orkiestracja

- zamówienie

- Zlecenia

- organizacyjny

- organizacji

- Inne

- ludzkiej,

- wydajność

- Wyjścia

- ogólny

- chleb

- parametry

- część

- partnerem

- wzmacniacz

- przechodzić

- minęło

- przebiegi

- ścieżka

- wzory

- płatność

- procent

- wykonuje

- może

- uprawnienia

- kawałek

- Miejsce

- Miejsca

- wprowadzanie

- plato

- Analiza danych Platona

- PlatoDane

- gra

- Proszę

- zwrotnica

- polityka

- PoS

- stwarza

- position

- pozytywny

- możliwy

- Post

- potencjał

- mocny

- praktyka

- wstępny

- Przygotować

- Przygotowuje

- przygotowanie

- teraźniejszość

- prezenty

- poprzedni

- Cena

- wycena

- prywatność

- kontynuować

- wygląda tak

- Obrobiony

- procesów

- przetwarzanie

- Profil

- monity

- Perspektywa

- zapewniać

- pod warunkiem,

- dostawca

- zapewnia

- zaopatrzenie

- Ściąga

- położyć

- Python

- pytanie

- szybko

- R

- podnieść

- zasięg

- Surowy

- RE

- Czytaj

- Czytający

- gotowy

- polecić

- zalecenia

- zmniejszyć

- odnosić się

- region

- regularny

- związane z

- polegać

- pozostawać

- szczątki

- pamiętać

- usuwanie

- wymiana

- zażądać

- wywołań

- wymagany

- Zasób

- Zasoby

- Odpowiadać

- odpowiedź

- Odpowiedzi

- odpowiedzialny

- dalsze

- Efekt

- powrót

- powraca

- wielokrotnego użytku

- sztywny

- krzepki

- Rola

- Trasa

- RZĄD

- run

- bieganie

- działa

- Czas

- s

- sagemaker

- taki sam

- próba

- Zapisz

- zapisywane

- powiedzieć

- skalowalny

- Skala

- scenariusz

- scenariusze

- screeny

- Sdk

- druga

- Tajemnica

- Sekcja

- bezpieczeństwo

- widzieć

- wybierać

- senior

- Bezserwerowe

- usługa

- Usługi

- Sesja

- zestaw

- ustawienie

- w panelu ustawień

- ustawienie

- kilka

- ona

- Powłoka

- sklepy

- powinien

- pokazać

- pokazał

- pokazane

- Targi

- zamknąć

- zamknąć

- Prosty

- pojedynczy

- Rozmiar

- umiejętności

- otwór

- automatach

- mały

- skrawek

- So

- Piłka nożna

- Wyłącznie

- rozwiązanie

- Rozwiązania

- kilka

- Ktoś

- coś

- mówić

- pionierem

- specjalny

- specjalizuje się

- specyficzny

- prędkość

- wydać

- Stabilność

- standard

- początek

- Startowy

- Stan

- Zestawienie sprzedaży

- Ewolucja krok po kroku

- Cel

- przechowywany

- przechowywania

- Strategiczny

- strategie

- opływowy

- Struktura

- Zmagania

- studio

- znaczny

- Z powodzeniem

- taki

- cukier

- sugerować

- Wskazuje

- streszczać

- PODSUMOWANIE

- Utrzymany

- pewnie

- szybko

- system

- systemy

- stół

- TAG

- trwa

- Zadanie

- zadania

- klucze

- techniczny

- Technologia

- szablon

- Szablony

- terminal

- test

- XNUMX

- Podziękowania

- że

- Połączenia

- Informacje

- ich

- Im

- następnie

- Tam.

- w związku z tym

- Te

- one

- rzecz

- Trzeci

- to

- trzy

- Przez

- poprzez

- czas

- Oś czasu

- do

- już dziś

- dzisiaj

- narzędzia

- Kwota produktów:

- tradycyjny

- Trening

- Przekształcać

- podróżować

- wyzwalać

- kłopot

- próbować

- stara

- drugiej

- rodzaj

- zrozumieć

- zrozumienie

- jednostek

- Uploading

- posługiwać się

- przypadek użycia

- używany

- Użytkownik

- zastosowania

- za pomocą

- użyteczność

- Wykorzystując

- ważny

- UPRAWOMOCNIĆ

- zatwierdzony

- uprawomocnienie

- Validator

- wartość

- Wartości

- zmienna

- różnorodny

- różnią się

- zweryfikować

- wersja

- początku.

- przez

- wizualny

- Głos

- chcieć

- chce

- była

- Droga..

- we

- sieć

- usługi internetowe

- DOBRZE

- były

- Co

- jeśli chodzi o komunikację i motywację

- który

- Podczas

- cały

- szerszy

- będzie

- okno

- w

- w ciągu

- bez

- workflow

- pracujący

- działa

- by

- napisać

- XML

- tak

- You

- Twój

- siebie

- zefirnet

- Zamek błyskawiczny