Ten wpis na blogu został napisany wspólnie z Tuaną Çelik z Deepset.

Wyszukiwanie w przedsiębiorstwie jest kluczowym elementem efektywności organizacyjnej poprzez digitalizację dokumentów i zarządzanie wiedzą. Wyszukiwanie korporacyjne obejmuje przechowywanie dokumentów, takich jak pliki cyfrowe, indeksowanie dokumentów do wyszukiwania i dostarczanie odpowiednich wyników na podstawie zapytań użytkowników. Wraz z pojawieniem się dużych modeli językowych (LLM) możemy wdrożyć doświadczenia konwersacyjne w dostarczaniu wyników użytkownikom. Musimy jednak zadbać o to, aby LLM ograniczały reakcje na dane firmy, łagodząc w ten sposób halucynacje modeli.

W tym poście pokazujemy, jak zbudować kompleksową generatywną aplikację AI do wyszukiwania korporacyjnego z funkcją Retrieval Augmented Generation (RAG), korzystając z potoków Haystack i modelu Falcon-40b-instruct z Amazon SageMaker JumpStart i Usługa Amazon OpenSearch. Kod źródłowy próbki zaprezentowanej w tym poście jest dostępny w pliku Repozytorium GitHub

Omówienie rozwiązania

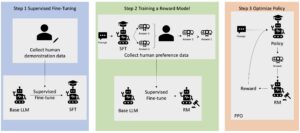

Aby ograniczyć generatywne odpowiedzi aplikacji AI wyłącznie do danych firmowych, musimy zastosować technikę zwaną generacją rozszerzoną wyszukiwania (RAG). Aplikacja korzystająca z podejścia RAG pobiera informacje najbardziej odpowiednie dla żądania użytkownika z bazy wiedzy lub treści przedsiębiorstwa, łączy je w kontekst wraz z żądaniem użytkownika w formie podpowiedzi, a następnie wysyła je do LLM w celu uzyskania odpowiedzi. LLM mają ograniczenia dotyczące maksymalnej liczby słów w podpowiedziach wejściowych, więc wybór właściwych fragmentów spośród tysięcy lub milionów dokumentów w przedsiębiorstwie ma bezpośredni wpływ na dokładność LLM.

Technika RAG staje się coraz ważniejsza w wyszukiwaniu korporacyjnym. W tym poście pokazujemy przepływ pracy, który wykorzystuje SageMaker JumpStart do wdrożenia modelu instrukcji Falcon-40b i wykorzystuje Haystack do projektowania i uruchamiania potoku odpowiedzi na pytania wspomaganego wyszukiwaniem. Przepływ pracy związany z ostatecznym rozszerzeniem pobierania obejmuje następujące etapy wysokiego poziomu:

- Zapytanie użytkownika jest używane w komponencie wyszukiwania, który przeprowadza wyszukiwanie wektorowe w celu pobrania najbardziej odpowiedniego kontekstu z naszej bazy danych.

- Kontekst ten jest osadzony w podpowiedzi, która ma na celu poinstruowanie LLM, aby wygenerował odpowiedź tylko na podstawie podanego kontekstu.

- LLM generuje odpowiedź na pierwotne zapytanie, biorąc pod uwagę jedynie kontekst osadzony w otrzymanym monicie.

SageMaker Szybki start

SageMaker JumpStart pełni funkcję centrum modeli obejmującego szeroką gamę modeli głębokiego uczenia się dla przypadków użycia tekstu, obrazu, dźwięku i osadzania. Centrum modeli obejmuje ponad 500 modeli, zarówno publiczne, jak i zastrzeżone modele partnerów AWS, takich jak AI21, Stability AI, Cohere i LightOn. Zawiera także modele podstawowe opracowane wyłącznie przez firmę Amazon, takie jak AlexaTM. Niektóre modele oferują możliwość dostrojenia ich na podstawie własnych danych. SageMaker JumpStart udostępnia także szablony rozwiązań, które konfigurują infrastrukturę dla typowych przypadków użycia, a także wykonywalne przykładowe notesy do uczenia maszynowego (ML) z SageMaker.

Stóg siana

Stóg siana to platforma typu open source firmy Deepset, która umożliwia programistom orkiestrację aplikacji LLM składających się z różnych komponentów, takich jak modele, wektorowe bazy danych, konwertery plików i niezliczone inne moduły. Stóg siana zapewnia rurociągi i Agenci, dwie potężne struktury do projektowania aplikacji LLM do różnych zastosowań, w tym wyszukiwania, odpowiadania na pytania i konwersacyjnej sztucznej inteligencji. Dzięki dużemu naciskowi na najnowocześniejsze metody wyszukiwania i solidne wskaźniki oceny, zapewnia wszystko, czego potrzebujesz do dostarczenia niezawodnej i godnej zaufania aplikacji. Można serializować potoki do Pliki YAML, ujawnij je poprzez a REST APIi elastycznie skaluj je w zależności od obciążenia, co ułatwia przeniesienie aplikacji z etapu prototypu do produkcji.

Otwarte wyszukiwanie Amazona

Usługa OpenSearch to w pełni zarządzana usługa, która ułatwia wdrażanie, skalowanie i obsługę OpenSearch w chmurze AWS. OpenSearch to skalowalny, elastyczny i rozszerzalny pakiet oprogramowania typu open source do wyszukiwania, analiz, monitorowania bezpieczeństwa i aplikacji monitorujących, objęty licencją Apache 2.0.

W ostatnich latach techniki uczenia maszynowego stają się coraz bardziej popularne w celu usprawnienia wyszukiwania. Wśród nich jest zastosowanie osadzanie modeli, rodzaj modelu, który może zakodować dużą ilość danych w przestrzeni n-wymiarowej, gdzie każda jednostka jest kodowana w wektor, punkt danych w tej przestrzeni i zorganizowane w taki sposób, że podobne elementy znajdują się bliżej siebie. Baza danych wektorów zapewnia wydajne wyszukiwanie podobieństw wektorów poprzez udostępnianie wyspecjalizowanych indeksów, takich jak indeksy k-NN.

Dzięki możliwościom wektorowych baz danych usługi OpenSearch Service można wdrożyć wyszukiwanie semantyczne, RAG z LLM, silniki rekomendacji i wyszukiwanie multimediów. W tym poście używamy RAG, aby umożliwić nam uzupełnienie generatywnych LLM o zewnętrzną bazę wiedzy, która jest zwykle budowana przy użyciu wektorowej bazy danych uzupełnionej artykułami merytorycznymi zakodowanymi wektorowo.

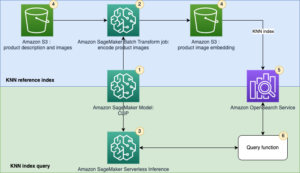

Przegląd aplikacji

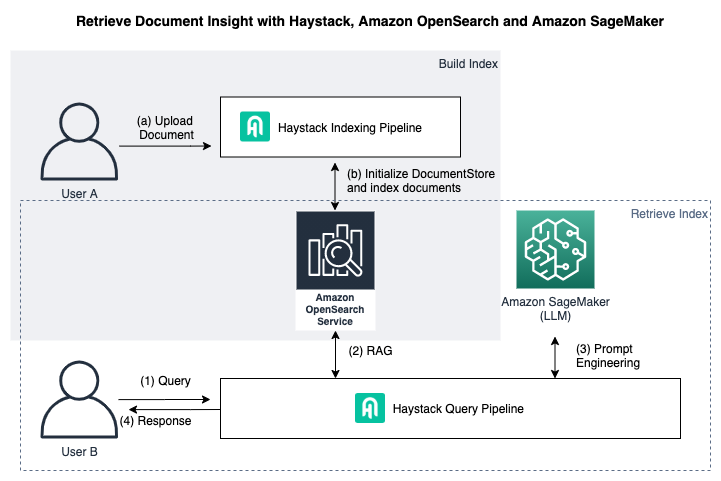

Poniższy diagram przedstawia strukturę ostatecznej aplikacji.

W tej aplikacji używamy Haystack Indexing Pipeline do zarządzania przesłanymi dokumentami i dokumentami indeksującymi oraz Haystack Query Pipeline do wyszukiwania wiedzy z indeksowanych dokumentów.

Rurociąg indeksowania stogu siana obejmuje następujące etapy wysokiego poziomu:

- Prześlij dokument.

- Inicjalizacja

DocumentStorei indeksy dokumentów.

Używamy OpenSearch jako naszego Magazyn dokumentów i stog siana potok indeksowania do wstępnego przetwarzania i indeksowania naszych plików w OpenSearch. Stóg siana Konwertery plików i Preprocesor pozwalają oczyścić i przygotować surowe pliki do kształtu i formatu, z którym może sobie poradzić wybrany potok przetwarzania języka naturalnego (NLP) i wybrany model języka. Potok indeksowania, którego tutaj użyliśmy, również używa sentence-transformers/all-MiniLM-L12-v2 do tworzenia osadzań dla każdego dokumentu, których używamy do wydajnego wyszukiwania.

Potok zapytań dotyczących stogu siana obejmuje następujące kroki wysokiego poziomu:

- Wysyłamy zapytanie do rurociągu RAG.

- An Osadzanie Retrievera komponent działa jak filtr, który pobiera najbardziej odpowiednie

top_kdokumenty z naszych dokumentów indeksowanych w OpenSearch. Aby to osiągnąć, korzystamy z wybranego przez nas modelu osadzania, aby osadzić zarówno zapytanie, jak i dokumenty (podczas indeksowania). - Pobrane dokumenty są osadzone w naszym podpowiedzi do modelu instrukcji Falcon-40b.

- LLM zwraca się z odpowiedzią opartą na pobranych dokumentach.

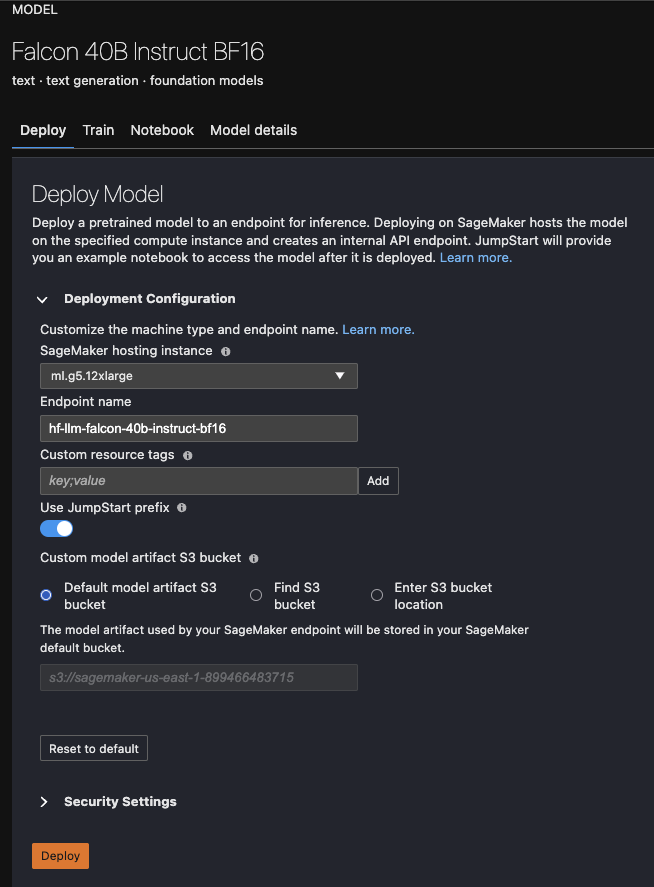

Do wdrażania modeli używamy programu SageMaker JumpStart, który upraszcza wdrażanie modeli poprzez proste naciśnięcie przycisku. Chociaż w tym przykładzie użyliśmy i przetestowaliśmy Falcon-40b-instruct, możesz użyć dowolnego modelu Hugging Face dostępnego w SageMaker.

Ostateczne rozwiązanie jest dostępne na stronie mędrzec stogu siana repozytorium i wykorzystuje witrynę internetową OpenSearch oraz dokumentację (dla OpenSearch 2.7) jako przykładowe dane do wyszukiwania rozszerzonych odpowiedzi na pytania.

Wymagania wstępne

Pierwszą rzeczą, którą należy zrobić, zanim będziemy mogli korzystać z jakichkolwiek usług AWS, jest upewnienie się, że zarejestrowaliśmy się i utworzyliśmy konto AWS. Następnie należy utworzyć użytkownika i grupę administracyjną. Aby uzyskać instrukcje dotyczące obu kroków, zobacz Skonfiguruj wymagania wstępne Amazon SageMaker.

Aby móc korzystać z Stogu siana, musisz zainstalować farm-haystack pakiet z wymaganymi zależnościami. Aby to osiągnąć, użyj requirements.txt Plik w Repozytorium GitHub biegiem pip install requirements.txt.

Indeksuj dokumenty w OpenSearch

Haystack oferuje szereg konektorów do baz danych, tzw DocumentStores. W przypadku tego przepływu pracy RAG używamy pliku OpenSearchDocumentStore. Przykład składnica obejmuje potok indeksowania i Tworzenie chmury AWS szablon założyć OpenSearchDocumentStore z dokumentami pobranymi z witryny OpenSearch i stron dokumentacji.

Często, aby aplikacja NLP działała w zastosowaniach produkcyjnych, musimy pomyśleć o przygotowaniu i oczyszczeniu danych. To jest pokryte Rurociągi indeksujące stogi siana, co pozwala na zaprojektowanie własnych etapów przygotowania danych, które ostatecznie zapisują Twoje dokumenty do wybranej przez Ciebie bazy danych.

Potok indeksowania może również obejmować etap tworzenia osadzania dokumentów. Jest to bardzo ważne na etapie odzyskiwania. W naszym przykładzie używamy transformatory zdań/all-MiniLM-L12-v2 jako nasz model osadzania. Model ten służy do tworzenia osadzania dla wszystkich naszych indeksowanych dokumentów, ale także zapytania użytkownika w czasie zapytania.

Aby indeksować dokumenty w formacie OpenSearchDocumentStore, oferujemy dwie opcje ze szczegółowymi instrukcjami w pliku README przykładowego repozytorium. W tym miejscu omówimy etapy indeksowania w usłudze OpenSearch wdrożonej w AWS.

Uruchom usługę OpenSearch

Skorzystaj z dostarczonego Szablon CloudFormation aby skonfigurować usługę OpenSearch na AWS. Uruchamiając następujące polecenie, będziesz mieć pustą usługę OpenSearch. Możesz następnie zaindeksować dostarczone przez nas przykładowe dane lub skorzystać z własnych danych, które możesz oczyścić i wstępnie przetworzyć za pomocą narzędzia Rurociąg indeksowania stogu siana. Należy pamiętać, że powoduje to utworzenie instancji otwartej dla Internetu, co nie jest zalecane do użytku produkcyjnego.

Poczekaj około 30 minut na zakończenie uruchamiania stosu. Możesz sprawdzić jego postęp w konsoli AWS CloudFormation, przechodząc do Półki na książki page i szukam stosu o nazwie HaystackOpensearch.

Indeksuj dokumenty w OpenSearch

Teraz, gdy mamy działającą usługę OpenSearch, możemy użyć klasy OpenSearchDocumentStore, aby połączyć się z nią i zapisać w niej nasze dokumenty.

Aby uzyskać nazwę hosta dla OpenSearch, uruchom następujące polecenie:

Najpierw wyeksportuj następujące elementy:

Następnie możesz użyć opensearch_indexing_pipeline.py skrypt do wstępnego przetwarzania i indeksowania dostarczonych danych demonstracyjnych.

Jeśli chcesz używać własnych danych, zmodyfikuj potok indeksowania w opensearch_indexing_pipeline.py zawierać Konwerter plików i Preprocesor wymagane kroki konfiguracji.

Zaimplementuj potok odpowiedzi na pytania wspomagane wyszukiwaniem

Teraz, gdy mamy już zaindeksowane dane w OpenSearch, możemy odpowiadać na pytania dotyczące tych dokumentów. W przypadku tego potoku RAG używamy modelu instrukcji Falcon-40b, który wdrożyliśmy w SageMaker JumpStart.

Masz również możliwość programowego wdrożenia modelu z notatnika Jupyter. Instrukcje można znaleźć w GitHub repo.

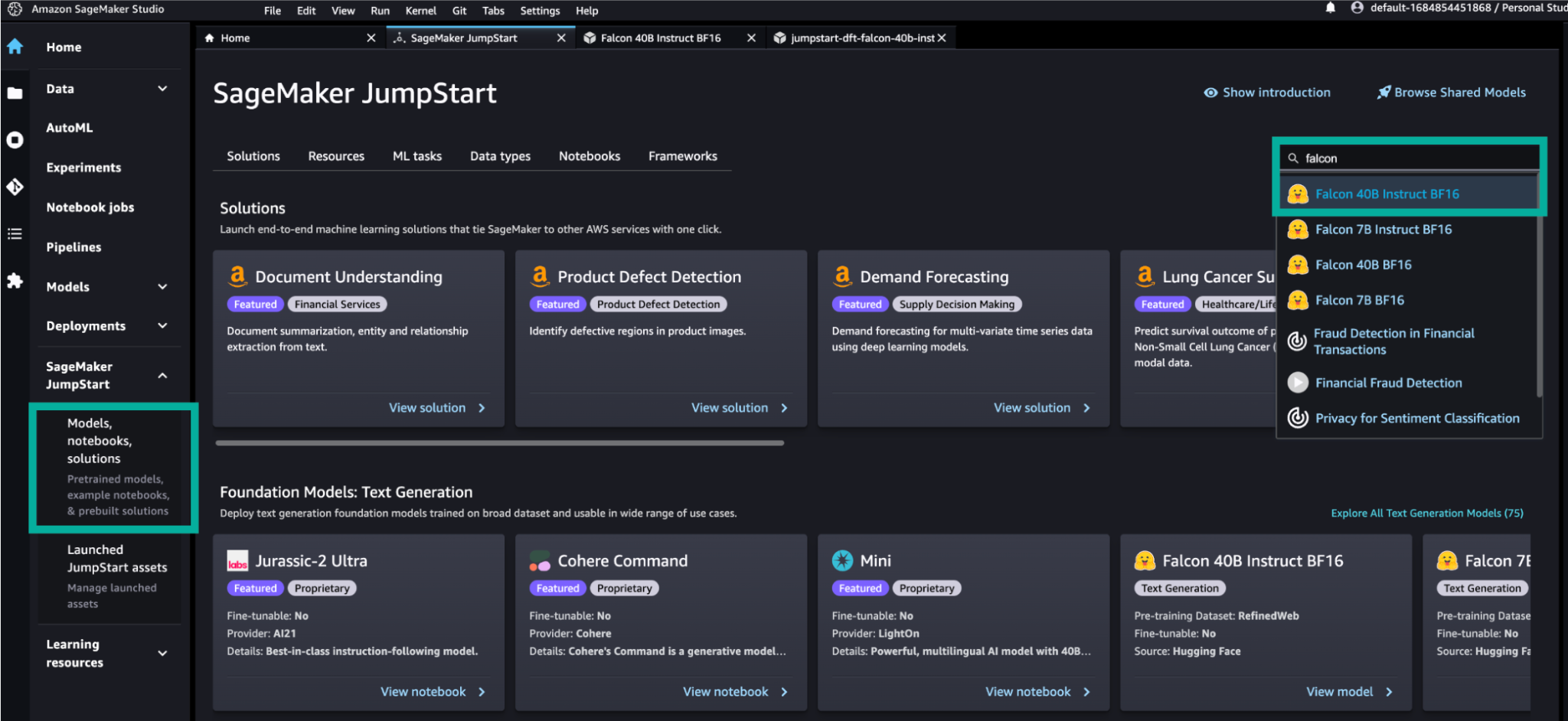

- Wyszukaj model Falcon-40b-instruct w SageMaker JumpStart.

- Wdróż swój model w SageMaker JumpStart i zanotuj nazwę punktu końcowego.

- Wyeksportuj następujące wartości:

- run

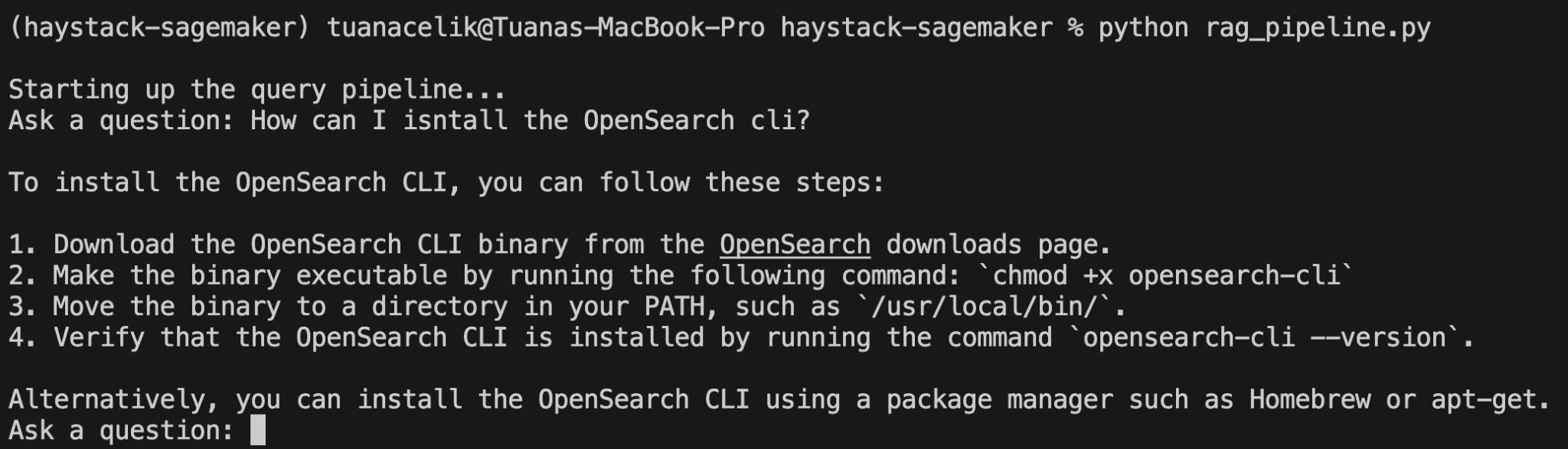

python rag_pipeline.py.

Spowoduje to uruchomienie narzędzia wiersza poleceń, które czeka na pytanie użytkownika. Zapytajmy na przykład: „Jak mogę zainstalować bibliotekę OpenSearch?”

Wynik ten został osiągnięty, ponieważ zdefiniowaliśmy nasz znak zachęty w pliku Szablon podpowiedzi dotyczący stogu siana być następującym:

Dalsze dostosowania

Możesz dokonać dodatkowych dostosowań różnych elementów rozwiązania, na przykład:

- Dane – Udostępniliśmy OpenSearch dokumentacja i dane jako przykładowe dane. Pamiętaj o modyfikacji

opensearch_indexing_pipeline.pyskrypt dostosowany do Twoich potrzeb, jeśli zdecydujesz się na użycie własnych danych. - Model – W tym przykładzie użyliśmy modelu Falcon-40b-instruct. Możesz wdrożyć i używać dowolnego innego modelu Przytulonej Twarzy w SageMaker. Pamiętaj, że zmiana modelu prawdopodobnie będzie oznaczać konieczność dostosowania podpowiedzi do czegoś, do czego jest przeznaczony.

- monit – Na potrzeby tego wpisu stworzyliśmy własny

PromptTemplateinstruuje model, aby odpowiadał na pytania w oparciu o podany kontekst i odpowiadał „nie wiem”, jeśli kontekst nie zawiera istotnych informacji. Możesz zmienić ten monit, aby poeksperymentować z różnymi monitami w Falcon-40b-instruct. Możesz także po prostu pobrać niektóre z naszych podpowiedzi z pliku PromptHub. - Model osadzania – Na etapie pobierania używamy lekkiego modelu osadzania: transformatory zdań/all-MiniLM-L12-v2. Możesz to jednak zmienić także pod swoje potrzeby. Pamiętaj, aby zmodyfikować oczekiwane wymiary osadzenia w pliku

DocumentStoreodpowiednio. - Liczba odzyskanych dokumentów – Możesz także pobawić się liczbą dokumentów, o które prosisz

EmbeddingRetrieverdo pobrania dla każdego zapytania. W naszej konfiguracji jest to ustawione na góra_k=5. Możesz poeksperymentować ze zmianą tej liczby, aby sprawdzić, czy podanie szerszego kontekstu poprawi dokładność wyników.

Gotowość produkcyjna

Rozwiązanie zaproponowane w tym poście może przyspieszyć czas uzyskania wartości procesu rozwoju projektu. Możesz zbudować projekt, który będzie łatwy do skalowania, dzięki środowisku bezpieczeństwa i prywatności w chmurze AWS.

Ze względu na bezpieczeństwo i prywatność usługa OpenSearch zapewnia ochronę danych za pomocą zarządzanie tożsamością i dostępem i zapobieganie mylonemu proxy między usługami. Możesz zastosować precyzyjną kontrolę dostępu użytkownika, tak aby użytkownik miał dostęp tylko do danych, do których jest upoważniony. Dodatkowo SageMaker zapewnia konfigurowalne ustawienia zabezpieczeń dla kontroli dostępu, Ochrona danych, rejestrowanie i monitorowanie. Możesz chronić swoje dane w spoczynku i transporcie za pomocą Usługa zarządzania kluczami AWS (AWS KMS). Możesz także śledzić dziennik wdrożenia modelu SageMaker lub dostępu do punktu końcowego za pomocą Amazon Cloud Watch. Aby uzyskać więcej informacji, zobacz Monitoruj Amazon SageMaker za pomocą Amazon CloudWatch.

Aby zapewnić wysoką skalowalność usługi OpenSearch, możesz ją dostosować poprzez zmiany rozmiaru domen usługi OpenSearch i zatrudniający najlepsze praktyki operacyjne. Możesz także skorzystać z automatycznego skalowania punktu końcowego SageMaker – możesz automatycznie skalować modele SageMaker aby dostosować punkt końcowy zarówno wtedy, gdy ruch jest zwiększony, jak i zasoby nie są używane.

Sprzątać

Aby zaoszczędzić koszty, usuń wszystkie zasoby wdrożone w ramach tego posta. Jeśli uruchomiłeś stos CloudFormation, możesz go usunąć za pomocą konsoli AWS CloudFormation. Podobnie możesz usunąć dowolne punkty końcowe SageMaker, które mogłeś utworzyć za pomocą konsoli SageMaker.

Wnioski

W tym poście zaprezentowaliśmy, jak zbudować kompleksową generatywną aplikację AI do wyszukiwania korporacyjnego za pomocą RAG, korzystając z potoków Haystack i modelu Falcon-40b-instruct z SageMaker JumpStart i OpenSearch Service. Podejście RAG ma kluczowe znaczenie w wyszukiwaniu korporacyjnym, ponieważ gwarantuje, że wygenerowane odpowiedzi pochodzą z domeny, co łagodzi halucynacje. Korzystając z potoków Haystack, jesteśmy w stanie koordynować aplikacje LLM składające się z różnych komponentów, takich jak modele i wektorowe bazy danych. SageMaker JumpStart zapewnia nam rozwiązanie do wdrażania LLM za pomocą jednego kliknięcia, a usługę OpenSearch wykorzystaliśmy jako wektorową bazę danych dla naszych indeksowanych danych. Możesz rozpocząć eksperymentowanie i tworzenie dowodów koncepcji RAG dla generatywnych aplikacji AI w przedsiębiorstwie, korzystając z kroków opisanych w tym poście i kodu źródłowego dostępnego w Repozytorium GitHub.

O autorach

Tuana Celik jest głównym rzecznikiem programistów w deepset, gdzie koncentruje się na społeczności open source dla Haystack. Kieruje funkcją relacji z deweloperami i regularnie przemawia na wydarzeniach poświęconych NLP oraz tworzy materiały edukacyjne dla społeczności.

Tuana Celik jest głównym rzecznikiem programistów w deepset, gdzie koncentruje się na społeczności open source dla Haystack. Kieruje funkcją relacji z deweloperami i regularnie przemawia na wydarzeniach poświęconych NLP oraz tworzy materiały edukacyjne dla społeczności.

Roya Alleli jest starszym architektem rozwiązań specjalistycznych AI/ML w AWS z siedzibą w Monachium w Niemczech. Roy pomaga klientom AWS – od małych start-upów po duże przedsiębiorstwa – efektywnie szkolić i wdrażać duże modele językowe w AWS. Roy jest pasjonatem problemów optymalizacji obliczeniowej i poprawy wydajności obciążeń AI.

Roya Alleli jest starszym architektem rozwiązań specjalistycznych AI/ML w AWS z siedzibą w Monachium w Niemczech. Roy pomaga klientom AWS – od małych start-upów po duże przedsiębiorstwa – efektywnie szkolić i wdrażać duże modele językowe w AWS. Roy jest pasjonatem problemów optymalizacji obliczeniowej i poprawy wydajności obciążeń AI.

Mia Czang jest architektem rozwiązań ML dla Amazon Web Services. Współpracuje z klientami w regionie EMEA i dzieli się najlepszymi praktykami w zakresie uruchamiania obciążeń AI/ML w chmurze dzięki swojemu doświadczeniu w matematyce stosowanej, informatyce i AI/ML. Koncentruje się na zadaniach specyficznych dla NLP i dzieli się swoim doświadczeniem jako mówca na konferencjach i autorka książek. W wolnym czasie lubi wędrować, grać w gry planszowe i parzyć kawę.

Mia Czang jest architektem rozwiązań ML dla Amazon Web Services. Współpracuje z klientami w regionie EMEA i dzieli się najlepszymi praktykami w zakresie uruchamiania obciążeń AI/ML w chmurze dzięki swojemu doświadczeniu w matematyce stosowanej, informatyce i AI/ML. Koncentruje się na zadaniach specyficznych dla NLP i dzieli się swoim doświadczeniem jako mówca na konferencjach i autorka książek. W wolnym czasie lubi wędrować, grać w gry planszowe i parzyć kawę.

Inaam Syed jest architektem rozwiązań dla start-upów w AWS, ze szczególnym naciskiem na wspieranie startupów B2B i SaaS w skalowaniu i osiąganiu wzrostu. Jego pasją są architektury bezserwerowe i sztuczna inteligencja/ML. W wolnym czasie Inaam lubi wartościowe chwile z rodziną i oddaje się swojej miłości do jazdy na rowerze i badmintona.

Inaam Syed jest architektem rozwiązań dla start-upów w AWS, ze szczególnym naciskiem na wspieranie startupów B2B i SaaS w skalowaniu i osiąganiu wzrostu. Jego pasją są architektury bezserwerowe i sztuczna inteligencja/ML. W wolnym czasie Inaam lubi wartościowe chwile z rodziną i oddaje się swojej miłości do jazdy na rowerze i badmintona.

Davida Tippetta jest starszym rzecznikiem programistów pracującym nad open-source OpenSearch w AWS. Jego praca obejmuje wszystkie obszary OpenSearch, od wyszukiwania i trafności po obserwowalność i analitykę bezpieczeństwa.

Davida Tippetta jest starszym rzecznikiem programistów pracującym nad open-source OpenSearch w AWS. Jego praca obejmuje wszystkie obszary OpenSearch, od wyszukiwania i trafności po obserwowalność i analitykę bezpieczeństwa.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Motoryzacja / pojazdy elektryczne, Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- ChartPrime. Podnieś poziom swojej gry handlowej dzięki ChartPrime. Dostęp tutaj.

- Przesunięcia bloków. Modernizacja własności offsetu środowiskowego. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/build-production-ready-generative-ai-applications-for-enterprise-search-using-haystack-pipelines-and-amazon-sagemaker-jumpstart-with-llms/

- :ma

- :Jest

- :nie

- :Gdzie

- $W GÓRĘ

- 100

- 12

- 13

- 30

- 500

- 7

- 8

- a

- Zdolny

- O nas

- przyśpieszyć

- dostęp

- wykonać

- odpowiednio

- Konto

- precyzja

- Osiągać

- osiągnięty

- osiągnięcia

- Dzieje Apostolskie

- przystosować

- Dodatkowy

- do tego

- administracyjny

- Korzyść

- nadejście

- rzecznik

- AI

- AI / ML

- Wszystkie kategorie

- dopuszczać

- pozwala

- wzdłuż

- również

- Chociaż

- Amazonka

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- Amazon Web Services

- wśród

- an

- analityka

- i

- odpowiedź

- każdy

- Apache

- Zastosowanie

- aplikacje

- stosowany

- podejście

- w przybliżeniu

- SĄ

- obszary

- na około

- Szyk

- Sztuka

- towary

- AS

- pomoc

- At

- audio

- zwiększona

- autor

- upoważniony

- samochód

- dostępny

- AWS

- Tworzenie chmury AWS

- B2B

- tło

- baza

- na podstawie

- BE

- bo

- stają się

- zanim

- jest

- poniżej

- BEST

- Najlepsze praktyki

- Duży

- Blog

- deska

- Gry planszowe

- ciało

- książka

- obie

- szeroki

- budować

- Budowanie

- wybudowany

- wiązki

- ale

- przycisk

- by

- nazywa

- CAN

- możliwości

- Etui

- zmiana

- wymiana pieniędzy

- ZOBACZ

- wybór

- Dodaj

- Wybierając

- wybrał

- klasa

- Sprzątanie

- bliższy

- Chmura

- kod

- Kawa

- wspólny

- społeczność

- sukcesy firma

- Komplement

- kompletny

- składnik

- składniki

- zawiera

- komputer

- Computer Science

- pojęcie

- Konferencja

- zmieszany

- Skontaktuj się

- wobec

- Konsola

- zawarte

- zawartość

- kontekst

- kontrola

- konwersacyjny

- konwersacyjna sztuczna inteligencja

- Koszty:

- pokryty

- Okładki

- Stwórz

- stworzony

- tworzy

- krytyczny

- Klientów

- dane

- Przygotowywanie danych

- Ochrona danych

- Baza danych

- Bazy danych

- DBS

- sprawa

- głęboko

- głęboka nauka

- zdefiniowane

- próbny

- Zależności

- rozwijać

- wdrażane

- wdrażanie

- Wdrożenie

- Wnętrze

- zaprojektowany

- projektowanie

- szczegółowe

- rozwinięty

- Deweloper

- deweloperzy

- oprogramowania

- różne

- cyfrowy

- digitalizacja

- Wymiary

- kierować

- do

- dokument

- dokumentacja

- dokumenty

- robi

- Nie

- darowizna

- nie

- każdy

- łatwo

- efektywność

- wydajny

- skutecznie

- bądź

- Elementy

- osadzać

- osadzone

- osadzanie

- EMEA

- umożliwiać

- zakończenia

- koniec końców

- Punkt końcowy

- silniki

- wzmacniać

- zapewnić

- zapewnia

- Enterprise

- podmioty

- jednostka

- Środowisko

- ewaluację

- wydarzenia

- wszystko

- przykład

- spodziewany

- doświadczenie

- Doświadczenia

- eksperyment

- eksport

- zewnętrzny

- Twarz

- członków Twojej rodziny

- Postać

- filet

- Akta

- filtrować

- finał

- i terminów, a

- dopasować

- elastyczne

- elastycznie

- Skupiać

- koncentruje

- następujący

- W razie zamówieenia projektu

- format

- Fundacja

- Framework

- Darmowy

- od

- w pełni

- funkcjonować

- Games

- Generować

- wygenerowane

- generuje

- generacja

- generatywny

- generatywna sztuczna inteligencja

- Niemcy

- otrzymać

- dany

- Zarządzanie

- Wzrost

- uchwyt

- Have

- mający

- he

- pomaga

- jej

- tutaj

- Wysoki

- na wysokim szczeblu

- wysoko

- jego

- gospodarze

- W jaki sposób

- How To

- Jednak

- HTML

- http

- HTTPS

- Piasta

- i

- tożsamość

- if

- Rezultat

- wdrożenia

- ważny

- poprawy

- in

- zawierać

- obejmuje

- Włącznie z

- wzrosła

- coraz bardziej

- wskaźnik

- zindeksowane

- indeksy

- Informacja

- Infrastruktura

- wkład

- zainstalować

- przykład

- instrukcje

- Internet

- najnowszych

- IT

- JEGO

- jpg

- Klawisz

- Klawisze

- Wiedzieć

- wiedza

- Zarządzanie wiedzą

- język

- duży

- uruchomić

- uruchomiona

- prowadzić

- Wyprowadzenia

- nauka

- Licencja

- Upoważniony

- lekki

- lubić

- Prawdopodobnie

- LIMIT

- Ograniczenia

- Linia

- LLM

- log

- zalogowaniu

- poszukuje

- miłość

- maszyna

- uczenie maszynowe

- zrobiony

- robić

- WYKONUJE

- Dokonywanie

- zarządzanie

- zarządzane

- i konserwacjami

- materiały

- matematyka

- maksymalny

- Może..

- oznaczać

- Media

- metody

- Metryka

- miliony

- minut

- łagodzenie

- ML

- model

- modele

- modyfikować

- Moduły

- Chwile

- monitorowanie

- jeszcze

- większość

- ruch

- Nazwa

- O imieniu

- Naturalny

- Przetwarzanie języka naturalnego

- żeglujący

- Potrzebować

- wymagania

- nlp

- notatnik

- numer

- of

- oferta

- Oferty

- on

- tylko

- koncepcja

- open source

- Oprogramowanie typu open source

- działać

- optymalizacja

- Option

- Opcje

- or

- organizacyjny

- Zorganizowany

- oryginalny

- Inne

- ludzkiej,

- opisane

- koniec

- własny

- pakiet

- strona

- stron

- część

- wzmacniacz

- pasja

- namiętny

- wykonać

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- rurociąg

- plato

- Analiza danych Platona

- PlatoDane

- Grać

- Proszę

- punkt

- Popularny

- Post

- mocny

- praktyki

- przygotowanie

- Przygotować

- prywatność

- problemy

- wygląda tak

- przetwarzanie

- Produkcja

- Postęp

- projekt

- dowody

- zaproponowane

- własność

- chronić

- ochrona

- prototyp

- zapewniać

- pod warunkiem,

- zapewnia

- że

- pełnomocnik

- publiczny

- Naciskać

- jakość

- zapytania

- pytanie

- pytania

- Surowy

- Odebrane

- niedawny

- Rekomendacja

- Zalecana

- regularnie

- relacje

- mających znaczenie

- rzetelny

- pamiętać

- składnica

- zażądać

- wymagać

- wymagany

- wymagania

- Zasoby

- odpowiedź

- Odpowiedzi

- REST

- ograniczać

- dalsze

- Efekt

- powraca

- Bogaty

- prawo

- Roy

- run

- bieganie

- SaaS

- sagemaker

- Zapisz

- powiedzieć

- Skalowalność

- skalowalny

- Skala

- skalowaniem

- nauka

- Szukaj

- bezpieczeństwo

- widzieć

- wysłać

- wysyła

- senior

- Bezserwerowe

- służy

- usługa

- Usługi

- zestaw

- w panelu ustawień

- ustawienie

- Shape

- Akcje

- ona

- STATEK

- powinien

- pokazać

- prezentacja

- prezentowany

- podpisana

- podobny

- Podobnie

- Prosty

- po prostu

- mały

- So

- Tworzenie

- Wyłącznie

- solidny

- rozwiązanie

- Rozwiązania

- kilka

- coś

- Źródło

- Kod źródłowy

- Typ przestrzeni

- Głośnik

- Mówi

- specjalista

- wyspecjalizowanym

- Stabilność

- stos

- STAGE

- początek

- startup

- Startups

- Ewolucja krok po kroku

- Cel

- przechowywania

- silny

- Struktura

- taki

- apartament

- pewnie

- Brać

- trwa

- Techniki

- Szablony

- przetestowany

- że

- Połączenia

- Źródło

- Im

- następnie

- a tym samym

- w związku z tym

- Te

- one

- rzecz

- myśleć

- to

- tysiące

- Przez

- czas

- do

- razem

- śledzić

- ruch drogowy

- tranzyt

- godny zaufania

- drugiej

- rodzaj

- zazwyczaj

- Ostatecznie

- dla

- przesłanych

- us

- posługiwać się

- używany

- Użytkownik

- Użytkownicy

- zastosowania

- za pomocą

- użyteczność

- wartość

- Wartości

- różnorodny

- przez

- wizja

- czeka

- we

- sieć

- usługi internetowe

- Strona internetowa

- jeśli chodzi o komunikację i motywację

- który

- będzie

- w

- w ciągu

- słowo

- Praca

- workflow

- pracujący

- działa

- by

- napisać

- jamla

- lat

- You

- Twój

- zefirnet