Skuteczne opcje samoobsługi stają się coraz ważniejsze dla contact center, ale ich dobre wdrożenie wiąże się z wyjątkowymi wyzwaniami.

Amazonka Lex zapewnia Twoje Amazon Połącz contact center z funkcjami chatbota, takimi jak automatyczne rozpoznawanie mowy (ASR) i rozumienie języka naturalnego (NLU) za pośrednictwem kanałów głosowych i tekstowych. Bot odczytuje mowę lub tekst w języku naturalnym, rozpoznaje intencje wprowadzonego tekstu i realizuje intencje użytkownika, wywołując odpowiednią reakcję.

Rozmówcy mogą mieć różne akcenty, wymowę i gramatykę. W połączeniu z hałasem w tle może to utrudniać rozpoznawanie mowy dokładne zrozumienie wypowiedzi. Na przykład „Chcę śledzić moje zamówienie” może zostać błędnie rozpoznane jako „Chcę przewieźć mój uchwyt ciężarówką”. Takie nieudane intencje frustrują klientów, którzy muszą się powtarzać, są kierowani nieprawidłowo lub przekazywani do stałych agentów, co kosztuje firmy więcej.

Amazońska skała macierzysta demokratyzuje dostęp programistów do modelu podstawowego (FM), aby bez wysiłku budować i skalować generatywne aplikacje oparte na sztucznej inteligencji dla nowoczesnego contact center. FM dostarczane przez Amazon Bedrock, takie jak Amazon Tytan i Antropiczny Claude, są wstępnie przeszkoleni w oparciu o zbiory danych dostępne w Internecie, co zapewnia im szerokie możliwości NLU, takie jak klasyfikacja zdań, pytania i odpowiedzi oraz ulepszone zrozumienie semantyki pomimo błędów rozpoznawania mowy.

W tym poście badamy rozwiązanie wykorzystujące FM dostarczane przez Amazon Bedrock w celu usprawnienia rozpoznawania intencji Amazon Lex zintegrowanego z Amazon Connect, ostatecznie zapewniając lepszą samoobsługę Twoim klientom.

Przegląd rozwiązania

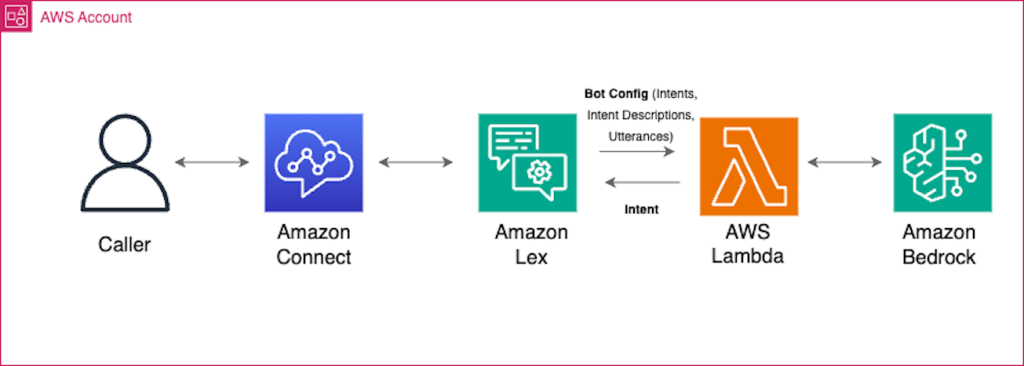

Rozwiązanie wykorzystuje Amazon Połącz, Amazonka Lex , AWS Lambda, Amazońska skała macierzysta w następujących krokach:

- Przepływ kontaktów Amazon Connect integruje się z botem Amazon Lex za pośrednictwem

GetCustomerInputblok. - Gdy bot nie rozpoznaje intencji osoby dzwoniącej i domyślnie wybiera intencję zastępczą, uruchamiana jest funkcja Lambda.

- Funkcja Lambda pobiera transkrypcję wypowiedzi klienta i przekazuje ją do modelu podstawowego w Amazon Bedrock

- Wykorzystując zaawansowane możliwości języka naturalnego, model określa intencje osoby dzwoniącej.

- Funkcja Lambda następnie kieruje bot, aby przekierował połączenie do właściwego celu w celu jego realizacji.

Dzięki wykorzystaniu modeli fundamentów Amazon Bedrock rozwiązanie umożliwia botowi Amazon Lex zrozumienie intencji pomimo błędów rozpoznawania mowy. Zapewnia to płynne przekierowywanie i realizację zamówień, zapobiegając eskalacji do agentów i frustrującym powtarzaniom dla dzwoniących.

Poniższy diagram ilustruje architekturę rozwiązania i przepływ pracy.

W poniższych sekcjach przyjrzymy się bardziej szczegółowo kluczowym komponentom rozwiązania.

Funkcje lambda i framework LangChain

Kiedy bot Amazon Lex wywołuje funkcję Lambda, wysyła komunikat o zdarzeniu zawierający informacje o bocie i transkrypcję wypowiedzi osoby dzwoniącej. Korzystając z tego komunikatu o zdarzeniu, funkcja Lambda dynamicznie pobiera skonfigurowane intencje bota, opis intencji i wyrażenia intencji oraz tworzy podpowiedź za pomocą LangChain, czyli platforma uczenia maszynowego (ML) o otwartym kodzie źródłowym, która umożliwia programistom integrowanie dużych modeli językowych (LLM), źródeł danych i aplikacji.

Następnie przy użyciu podpowiedzi wywoływany jest model fundamentu Amazon Bedrock i otrzymywana jest odpowiedź z przewidywaną intencją i poziomem pewności. Jeśli poziom ufności jest większy niż ustawiony próg, na przykład 80%, funkcja zwraca zidentyfikowany zamiar do Amazon Lex z akcją delegować. Jeżeli poziom ufności jest poniżej progu, następuje powrót do wartości domyślnej FallbackIntent i działanie mające na celu jego zamknięcie.

Uczenie się kontekstowe, szybka inżynieria i wywoływanie modeli

Korzystamy z uczenia kontekstowego, aby móc wykorzystać model podstawowy do wykonania tego zadania. Uczenie się kontekstowe to zdolność LLM do uczenia się zadania przy użyciu wyłącznie treści podpowiedzi, bez konieczności wcześniejszego przeszkolenia lub dostrajania do konkretnego zadania.

W monicie najpierw podajemy instrukcje szczegółowo opisujące, co należy zrobić. Następnie funkcja Lambda dynamicznie pobiera i wstawia do zachęty skonfigurowane intencje, opisy intencji i wyrażenia intencji bota Amazon Lex. Na koniec przekazujemy mu instrukcje dotyczące sposobu myślenia i końcowego wyniku.

Poniższy szablon podpowiedzi został przetestowany na modelach generowania tekstu Anthropic Claude Instant v1.2 i Anthropic Claude v2. Używamy tagów XML, aby lepiej poprawić wydajność modelu. Dodajemy również miejsce, w którym model może pomyśleć przed zidentyfikowaniem ostatecznego zamiaru, aby lepiej ulepszyć uzasadnienie wyboru właściwego zamiaru. The {intent_block} zawiera identyfikatory intencji, opisy intencji i wyrażenia intencji. The {input} blok zawiera transkrybowaną wypowiedź osoby wywołującej. Na końcu dodano trzy kreski („`”), aby pomóc modelowi w bardziej spójnym generowaniu bloku kodu. A <STOP> sekwencja jest dodawana, aby zapobiec dalszemu generowaniu.

Po wywołaniu modelu otrzymujemy następującą odpowiedź od modelu podstawowego:

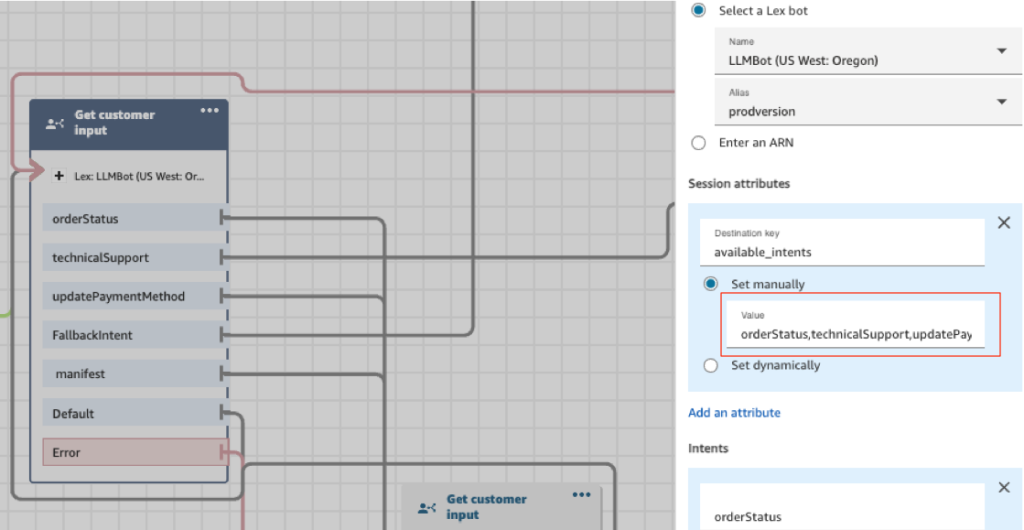

Filtruj dostępne intencje na podstawie atrybutów sesji przepływu kontaktów

Korzystając z rozwiązania w ramach przepływu kontaktów Amazon Connect, możesz jeszcze bardziej zwiększyć zdolność LLM do identyfikowania właściwych zamiarów, określając atrybut sesji available_intents „Uzyskaj opinie klientów” blok z listą intencji rozdzielonych przecinkami, jak pokazano na poniższym zrzucie ekranu. W ten sposób funkcja Lambda uwzględni tylko te określone intencje jako część zachęty do LLM, zmniejszając liczbę intencji, które LLM musi rozważyć. Jeśli available_intents nie określono atrybutu sesji, domyślnie zostaną użyte wszystkie intencje bota Amazon Lex.

Odpowiedź funkcji Lambda na Amazon Lex

Gdy LLM określi zamiar, funkcja Lambda odpowiada w formacie określony format wymagane przez Amazon Lex do przetworzenia odpowiedzi.

Jeśli zostanie znaleziony pasujący zamiar powyżej progu ufności, zwracany jest typ akcji dialogowej Delegate aby poinstruować firmę Amazon Lex, aby skorzystała z wybranej intencji, a następnie zwrócić ukończoną intencję z powrotem do Amazon Connect. Wynik odpowiedzi jest następujący:

Jeśli poziom ufności jest poniżej progu lub zamiar nie został rozpoznany, typ akcji dialogowej Zamknij zostaje zwrócony, aby poinstruować firmę Amazon Lex o zamknięciu FallbackIntenti zwróć kontrolę z powrotem do Amazon Connect. Wynik odpowiedzi jest następujący:

Pełny kod źródłowy tego przykładu jest dostępny w GitHub.

Wymagania wstępne

Zanim zaczniesz, upewnij się, że masz następujące wymagania wstępne:

Zaimplementuj rozwiązanie

Aby wdrożyć rozwiązanie, wykonaj następujące kroki:

- Sklonuj repozytorium

- Uruchom następujące polecenie, aby zainicjować środowisko i utworzyć plik Rejestr elastycznego pojemnika Amazon (Amazon ECR) repozytorium obrazu naszej funkcji Lambda. Podaj region AWS i nazwę repozytorium ECR, które chcesz utworzyć.

- Zaktualizuj

ParameterValuepola wscripts/parameters.jsonfile:ParameterKey ("AmazonECRImageUri")– Wprowadź adres URL repozytorium z poprzedniego kroku.ParameterKey ("AmazonConnectName")– Wprowadź unikalną nazwę.ParameterKey ("AmazonLexBotName")– Wprowadź unikalną nazwę.ParameterKey ("AmazonLexBotAliasName")– Wartość domyślna to „wersja prod”; możesz to zmienić, jeśli zajdzie taka potrzeba.ParameterKey ("LoggingLevel")– Wartość domyślna to „INFO”; możesz to zmienić, jeśli zajdzie taka potrzeba. Prawidłowe wartości to DEBUG, WARN i ERROR.ParameterKey ("ModelID")– Wartość domyślna to „anthropic.claude-instant-v1”; możesz to zmienić, jeśli chcesz użyć innego modelu.ParameterKey ("AmazonConnectName")– Wartość domyślna to „0.75”; możesz to zmienić, jeśli chcesz zaktualizować wynik zaufania.

- Uruchom polecenie, aby wygenerować stos CloudFormation i wdrożyć zasoby:

Jeśli nie chcesz budować przepływu kontaktów od zera w Amazon Connect, możesz zaimportować przykładowy przepływ dostarczony z tym repozytorium filelocation: /contactflowsample/samplecontactflow.json.

- Zaloguj się na swoje Instancja Amazon Connect. Do konta należy przypisać profil zabezpieczeń obejmujący uprawnienia do edycji przepływów.

- W konsoli Amazon Connect, w panelu nawigacji, w obszarze Routingwybierz Przepływy kontaktów.

- Utwórz nowy przepływ tego samego typu, co importowany.

- Dodaj Zapisz i zaimportuj przepływ.

- Wybierz plik do zaimportowania i wybierz import.

Kiedy przepływ jest importowany do istniejącego przepływu, aktualizowana jest również nazwa istniejącego przepływu.

- W razie potrzeby przejrzyj i zaktualizuj wszelkie rozwiązane lub nierozwiązane odniesienia.

- Aby zapisać zaimportowany przepływ, wybierz Zapisz. Aby opublikować, wybierz Zapisz i opublikuj.

- Po przesłaniu przepływu kontaktów zaktualizuj następujące konfiguracje:

- Zaktualizuj

GetCustomerInputbloki z poprawną nazwą i wersją bota Amazon Lex. - W obszarze Zarządzaj numerem telefonu zaktualizuj numer za pomocą zaimportowanego wcześniej przepływu kontaktów lub IVR.

- Zaktualizuj

Sprawdź konfigurację

Sprawdź, czy funkcja Lambda utworzona przy użyciu stosu CloudFormation ma rolę IAM z uprawnieniami do pobierania botów i informacji o zamiarach z Amazon Lex (uprawnienia do list i odczytu) oraz odpowiednie uprawnienia Amazon Bedrock (uprawnienia do list i odczytu).

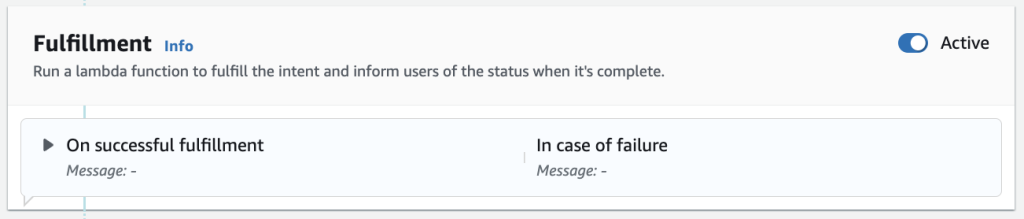

W bocie Amazon Lex dla skonfigurowanego aliasu i języka sprawdź, czy funkcja Lambda została poprawnie skonfigurowana. Dla FallBackIntent, Potwierdź, że Fulfillmentis Ustawić Active aby móc uruchomić tę funkcję za każdym razem, gdy FallBackIntent jest wyzwalany.

W tym momencie Twój bot Amazon Lex automatycznie uruchomi funkcję Lambda i rozwiązanie powinno działać bezproblemowo.

Przetestuj rozwiązanie

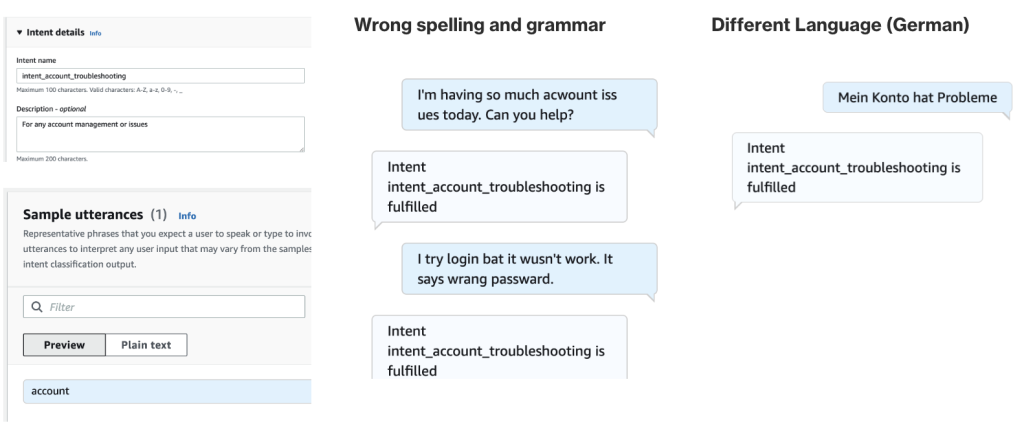

Przyjrzyjmy się przykładowej konfiguracji intencji, opisu i wypowiedzi w Amazon Lex i zobaczmy, jak dobrze LLM radzi sobie z przykładowymi danymi wejściowymi, które zawierają literówki, błędy gramatyczne, a nawet inny język.

Poniższy rysunek przedstawia zrzuty ekranu naszego przykładu. Po lewej stronie wyświetlana jest nazwa intencji, jej opis i przykładowa wypowiedź zawierająca jedno słowo. Bez dużej konfiguracji w Amazon Lex LLM jest w stanie przewidzieć poprawny zamiar (prawa strona). W tym teście mamy prostą wiadomość o spełnieniu od właściwej intencji.

Sprzątać

Aby wyczyścić zasoby, uruchom następujące polecenie, aby usunąć repozytorium ECR i stos CloudFormation:

Wnioski

Korzystając z Amazon Lex wzbogaconego o LLM dostarczane przez Amazon Bedrock, możesz poprawić wydajność rozpoznawania intencji swoich botów. Zapewnia to płynną samoobsługę zróżnicowanej grupie klientów, wypełniając lukę pomiędzy akcentami i unikalnymi cechami mowy, a ostatecznie zwiększając satysfakcję klientów.

Aby zgłębić temat i dowiedzieć się więcej o generatywnej sztucznej inteligencji, zapoznaj się z dodatkowymi zasobami:

Aby uzyskać więcej informacji na temat eksperymentowania z generatywnym rozwiązaniem samoobsługowym opartym na sztucznej inteligencji, zobacz Wdróż samoobsługowe odpowiadanie na pytania za pomocą rozwiązania QnABot na AWS obsługiwanego przez Amazon Lex z Amazon Kendra i dużymi modelami językowymi.

O autorach

Hamzy Nadeema jest architektem rozwiązań specjalistycznych Amazon Connect w AWS z siedzibą w Toronto. Współpracuje z klientami w całej Kanadzie, modernizując ich centra kontaktowe i dostarczając rozwiązania odpowiadające ich unikalnym wyzwaniom związanym z zaangażowaniem klientów i wymaganiom biznesowym. W wolnym czasie Hamza lubi podróżować, grać w piłkę nożną i próbować nowych przepisów z żoną.

Hamzy Nadeema jest architektem rozwiązań specjalistycznych Amazon Connect w AWS z siedzibą w Toronto. Współpracuje z klientami w całej Kanadzie, modernizując ich centra kontaktowe i dostarczając rozwiązania odpowiadające ich unikalnym wyzwaniom związanym z zaangażowaniem klientów i wymaganiom biznesowym. W wolnym czasie Hamza lubi podróżować, grać w piłkę nożną i próbować nowych przepisów z żoną.

Parag Śrivastava jest architektem rozwiązań w Amazon Web Services (AWS), pomagającym klientom korporacyjnym w pomyślnym przyjęciu i migracji do chmury. W swojej karierze zawodowej był intensywnie zaangażowany w złożone projekty transformacji cyfrowej. Pasjonuje go również budowanie innowacyjnych rozwiązań wokół geoprzestrzennych aspektów adresów.

Parag Śrivastava jest architektem rozwiązań w Amazon Web Services (AWS), pomagającym klientom korporacyjnym w pomyślnym przyjęciu i migracji do chmury. W swojej karierze zawodowej był intensywnie zaangażowany w złożone projekty transformacji cyfrowej. Pasjonuje go również budowanie innowacyjnych rozwiązań wokół geoprzestrzennych aspektów adresów.

Ross'ie niestety jest architektem rozwiązań w AWS z siedzibą w Toronto w Kanadzie. Pomaga klientom wprowadzać innowacje dzięki rozwiązaniom AI/ML i generatywnej AI, które prowadzą do rzeczywistych wyników biznesowych. Współpracował z różnymi klientami z branży detalicznej, usług finansowych, technologicznych, farmaceutycznych i innych. W wolnym czasie uwielbia spędzać czas na świeżym powietrzu i cieszyć się przyrodą z rodziną.

Ross'ie niestety jest architektem rozwiązań w AWS z siedzibą w Toronto w Kanadzie. Pomaga klientom wprowadzać innowacje dzięki rozwiązaniom AI/ML i generatywnej AI, które prowadzą do rzeczywistych wyników biznesowych. Współpracował z różnymi klientami z branży detalicznej, usług finansowych, technologicznych, farmaceutycznych i innych. W wolnym czasie uwielbia spędzać czas na świeżym powietrzu i cieszyć się przyrodą z rodziną.

Sangeetha Kamatkar jest architektem rozwiązań w Amazon Web Services (AWS), pomagającym klientom w pomyślnym wdrażaniu i migracji chmury. Współpracuje z klientami nad tworzeniem wysoce skalowalnych, elastycznych i odpornych architektur chmurowych, które rozwiązują problemy biznesowe klientów. W wolnym czasie słucha muzyki, ogląda filmy, a latem zajmuje się ogrodnictwem.

Sangeetha Kamatkar jest architektem rozwiązań w Amazon Web Services (AWS), pomagającym klientom w pomyślnym wdrażaniu i migracji chmury. Współpracuje z klientami nad tworzeniem wysoce skalowalnych, elastycznych i odpornych architektur chmurowych, które rozwiązują problemy biznesowe klientów. W wolnym czasie słucha muzyki, ogląda filmy, a latem zajmuje się ogrodnictwem.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/enhance-amazon-connect-and-lex-with-generative-ai-capabilities/

- :ma

- :Jest

- :nie

- :Gdzie

- $W GÓRĘ

- 1

- 100

- 11

- 14

- 7

- 8

- 9

- a

- zdolność

- Zdolny

- O nas

- powyżej

- dostęp

- wykonać

- Konto

- dokładnie

- Działania

- Dodaj

- w dodatku

- Dodatkowy

- adres

- Adresy

- Przyjęcie

- zaawansowany

- Agent

- agentów

- AI

- Zasilany AI

- AI / ML

- Wszystkie kategorie

- również

- Amazonka

- Amazonka Kendra

- Amazonka Lex

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- i

- odpowiedź

- sekretarka

- Antropiczny

- każdy

- aplikacje

- właściwy

- architektura

- architektur

- SĄ

- na około

- AS

- pytanie

- aspekty

- przydzielony

- Asystent

- At

- automatycznie

- automatycznie

- dostępny

- AWS

- z powrotem

- tło

- na podstawie

- BE

- staje

- być

- zanim

- za

- jest

- poniżej

- Ulepsz Swój

- pomiędzy

- Blokować

- Bloki

- Bot

- boty

- mostkowanie

- budować

- Budowanie

- Buduje

- biznes

- biznes

- ale

- by

- wezwanie

- Call Center

- Gość

- CAN

- Kanada

- możliwości

- Kariera

- kategoryzować

- CD

- Centrum

- Centra

- wyzwania

- wyzwanie

- zmiana

- kanały

- Charakterystyka

- chatbot

- ZOBACZ

- kontrola

- Dodaj

- Wybierając

- klasyfikacja

- kleń

- Zamknij

- Chmura

- adopcja chmury

- kod

- połączony

- kompletny

- Zakończony

- kompleks

- składniki

- pewność siebie

- systemu

- skonfigurowany

- Potwierdzać

- Skontaktuj się

- konsekwentnie

- Konsola

- skontaktuj się

- contact center

- Pojemnik

- zawiera

- kontrola

- skorygowania

- prawidłowo

- rzemiosło

- Stwórz

- stworzony

- krytyczny

- klient

- Zaangażowanie klienta

- Zadowolenie klienta

- Klientów

- dane

- zbiory danych

- Decydowanie

- głębiej

- Domyślnie

- Domyślnie

- dostarczona

- dostarczanie

- demokratyzuje

- rozwijać

- opis

- Mimo

- detal

- Detailing

- ustalona

- określa

- deweloperzy

- schemat

- Dialog

- różne

- cyfrowy

- cyfrowy Transformacja

- bezpośredni

- nurkować

- inny

- robi

- robi

- zrobić

- nie

- podczas

- dynamicznie

- Wcześniej

- bez wysiłku

- Umożliwia

- zakończenia

- zaręczynowy

- Inżynieria

- wzmacniać

- wzmocnione

- wzmocnienie

- cieszyć się

- ciesząc

- Wchodzę

- Enterprise

- Środowisko

- błąd

- Błędy

- eskalacja

- Parzyste

- wydarzenie

- przykład

- Przede wszystkim system został opracowany

- doświadczenie

- eksperyment

- odkryj

- obszernie

- Failed

- nie

- członków Twojej rodziny

- Łąka

- Postać

- filet

- finał

- W końcu

- budżetowy

- usługi finansowe

- i terminów, a

- elastyczne

- pływ

- Przepływy

- następujący

- następujący sposób

- W razie zamówieenia projektu

- format

- znaleziono

- Fundacja

- podstawowy

- Framework

- od

- frustrujące

- funkcjonować

- funkcjonalności

- Funkcje

- dalej

- szczelina

- Generować

- generujący

- generacja

- generatywny

- generatywna sztuczna inteligencja

- otrzymać

- dany

- daje

- gramatyka

- większy

- Have

- he

- pomoc

- pomoc

- pomaga

- jej

- wysoko

- jego

- posiadacz

- W jaki sposób

- How To

- http

- HTTPS

- człowiek

- zidentyfikowane

- zidentyfikować

- identyfikacja

- ids

- if

- ilustruje

- obraz

- wdrożenia

- wykonawczych

- importować

- importowanie

- podnieść

- ulepszony

- in

- zawierać

- obejmuje

- niepoprawnie

- coraz bardziej

- Informacja

- wprowadzać innowacje

- Innowacyjny

- wkład

- Wejścia

- natychmiastowy

- instrukcje

- integrować

- zintegrowany

- Integruje się

- zamiar

- najnowszych

- przywołany

- inwokuje

- zaangażowany

- IT

- JEGO

- jpg

- właśnie

- Klawisz

- język

- duży

- Wyprowadzenia

- UCZYĆ SIĘ

- nauka

- lewo

- poziom

- lubić

- Prawdopodobnie

- Lista

- słucha

- relacja na żywo

- LLM

- Popatrz

- kocha

- maszyna

- uczenie maszynowe

- robić

- zarządzanie

- Mecz

- zapałki

- dopasowywanie

- Może..

- wiadomość

- migracja

- błędy

- ML

- model

- modele

- Nowoczesne technologie

- zmodernizować

- jeszcze

- Kino

- dużo

- Muzyka

- musi

- my

- Nazwa

- Naturalny

- Natura

- Nawigacja

- niezbędny

- Potrzebować

- potrzebne

- wymagania

- Nowości

- nie

- Hałas

- numer

- of

- on

- ONE

- tylko

- koncepcja

- open source

- Opcje

- or

- zamówienie

- Pozostałe

- ludzkiej,

- na zewnątrz

- wyniki

- na zewnątrz

- wydajność

- chleb

- część

- szczególny

- przebiegi

- namiętny

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- wykonuje

- uprawnienia

- Przemysł farmaceutyczny

- telefon

- plato

- Analiza danych Platona

- PlatoDane

- punkt

- Post

- powered

- przewidzieć

- Przewiduje

- warunki wstępne

- prezenty

- zapobieganie

- poprzedni

- problemy

- wygląda tak

- profesjonalny

- Profil

- projektowanie

- zapewniać

- pod warunkiem,

- zapewnia

- publikować

- położyć

- QnABot

- pytanie

- Czytaj

- real

- powód

- otrzymać

- Odebrane

- uznanie

- rozpoznać

- uznane

- rozpoznaje

- redukcja

- referencje

- region

- powtarzać

- składnica

- wymagany

- wymagania

- sprężysty

- zdecydowany

- Zasoby

- Odpowiadać

- odpowiedź

- dalsze

- Efekt

- detaliczny

- powrót

- powraca

- prawo

- Rola

- Pokój

- Trasa

- kierowany

- Routing

- run

- taki sam

- próba

- klientów

- Zapisz

- skalowalny

- Skala

- wynik

- zadraśnięcie

- screeny

- bezszwowy

- płynnie

- działy

- bezpieczeństwo

- widzieć

- wybrany

- Samoobsługa

- semantyczny

- wysyła

- wyrok

- Sekwencja

- Usługi

- Sesja

- zestaw

- ona

- powinien

- pokazane

- Targi

- bok

- Prosty

- gładki

- So

- Piłka nożna

- rozwiązanie

- Rozwiązania

- Źródło

- Kod źródłowy

- Źródła

- specjalista

- określony

- określanie

- przemówienie

- Rozpoznawanie mowy

- stos

- rozpoczęty

- Stan

- oświadczenia

- Rynek

- Ewolucja krok po kroku

- Cel

- Stop

- silny

- Następnie

- udany

- taki

- lato

- pewnie

- trwa

- Zadanie

- Technologia

- szablon

- test

- przetestowany

- XNUMX

- niż

- że

- Połączenia

- ich

- Im

- sami

- następnie

- Te

- myśleć

- Myślący

- to

- trzy

- próg

- Przez

- poprzez

- czas

- do

- także

- Toronto

- śledzić

- Transkrypcja

- Transformacja

- Podróżowanie

- rozsierdzony

- ciężarówka

- próbować

- stara

- rodzaj

- Ostatecznie

- dla

- zrozumieć

- zrozumienie

- wyjątkowy

- Aktualizacja

- zaktualizowane

- URL

- posługiwać się

- używany

- zastosowania

- za pomocą

- v1

- ważny

- Wartości

- różnorodność

- zweryfikować

- wersja

- przez

- Głos

- chcieć

- była

- Oglądaj

- we

- sieć

- usługi internetowe

- DOBRZE

- Co

- ilekroć

- który

- KIM

- żona

- będzie

- w

- bez

- Praca

- pracował

- workflow

- działa

- by

- XML

- You

- Twój

- zefirnet