Wspomagane dostrajanie

Podczas DevDay w listopadzie zeszłego roku my ogłosił program Custom Model przeznaczony do szkolenia i optymalizacji modeli dla określonej domeny, we współpracy z dedykowaną grupą badaczy OpenAI. Od tego czasu spotkaliśmy się z dziesiątkami klientów, aby ocenić ich potrzeby w zakresie modeli niestandardowych i rozwinęliśmy nasz program w celu dalszej maksymalizacji wydajności.

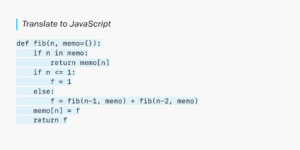

Dzisiaj oficjalnie ogłaszamy naszą ofertę wspomaganego dostrajania w ramach programu Custom Model. Wspomagane dostrajanie to wspólny wysiłek naszych zespołów technicznych w celu wykorzystania technik wykraczających poza interfejs API dostrajania, takich jak dodatkowe hiperparametry i różne metody efektywnego dostrajania parametrów (PEFT) na większą skalę. Jest to szczególnie przydatne dla organizacji, które potrzebują wsparcia w konfigurowaniu wydajnych potoków danych szkoleniowych, systemów oceny oraz niestandardowych parametrów i metod, aby zmaksymalizować wydajność modelu dla ich przypadku użycia lub zadania.

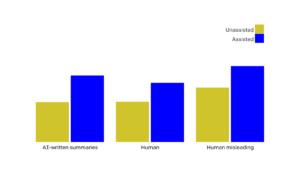

Na przykład, SK Telecom, operator telekomunikacyjny obsługujący ponad 30 milionów abonentów w Korei Południowej, chciał dostosować model tak, aby był ekspertem w dziedzinie telekomunikacji, koncentrując się początkowo na obsłudze klienta. Współpracowali z OpenAI, aby udoskonalić GPT-4, aby poprawić jego wydajność w rozmowach związanych z telekomunikacją w języku koreańskim. W ciągu wielu tygodni SKT i OpenAI osiągnęły znaczącą poprawę wydajności w zadaniach związanych z obsługą klienta telekomunikacyjnego — wzrost jakości podsumowań rozmów o 35%, wzrost dokładności rozpoznawania zamiarów o 33% oraz wzrost wyników satysfakcji z 3.6 do 4.5 (poza z 5) porównując dopracowany model z GPT-4.

Model specjalnie wyszkolony

W niektórych przypadkach organizacje muszą od podstaw wyszkolić specjalnie zbudowany model, który rozumie ich działalność, branżę lub domenę. W pełni wytrenowane modele wprowadzają nową wiedzę z określonej domeny poprzez modyfikację kluczowych etapów procesu uczenia modeli przy użyciu nowatorskich technik w trakcie i po szkoleniu. Organizacje, które osiągnęły sukces dzięki w pełni wytrenowanemu modelowi, często dysponują dużymi ilościami zastrzeżonych danych — milionami przykładów lub miliardami tokenów — których chcą użyć do nauczenia modelu nowej wiedzy lub złożonych, unikalnych zachowań w bardzo specyficznych przypadkach użycia.

Na przykład, Harvey, natywne narzędzie prawne dla prawników oparte na sztucznej inteligencji, współpracujące z OpenAI utwórz specjalnie wyszkolony model dużego języka dla orzecznictwa. Chociaż modele podstawowe były dobre w rozumowaniu, brakowało im rozległej wiedzy na temat historii spraw prawnych i innej wiedzy wymaganej w pracy prawniczej. Po przetestowaniu szybkiej inżynierii, RAG i dostrajaniu Harvey współpracował z naszym zespołem, aby dodać do modelu niezbędną głębię kontekstu — równowartość danych o wartości 10 miliardów tokenów. Nasz zespół modyfikował każdy etap procesu szkolenia modelowego, od szkolenia w trakcie szkolenia specyficznego dla danej domeny po dostosowywanie procesów po szkoleniu i uwzględnianie opinii ekspertów-radców prawnych. W rezultacie uzyskano 83% wzrost liczby odpowiedzi opartych na faktach, a prawnicy w 97% przypadków woleli wyniki niestandardowego modelu niż GPT-4.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://openai.com/blog/introducing-improvements-to-the-fine-tuning-api-and-expanding-our-custom-models-program

- :Jest

- $W GÓRĘ

- 10

- 30

- 35%

- a

- precyzja

- osiągnięty

- Dodaj

- Dodatkowy

- Po

- an

- i

- Ogłaszając

- api

- SĄ

- AS

- oszacować

- wspiera

- At

- adwokat

- BE

- zachowania

- zrobiony na zamówienie

- Poza

- Miliard

- Miliard tokenów

- miliardy

- biznes

- by

- walizka

- Etui

- współpracy

- porównanie

- kompleks

- kontekst

- Rozmowa

- rozmowy

- Kurs

- zwyczaj

- klient

- Obsługa klienta

- Klientów

- dostosować

- dostosowane

- dane

- dedykowane

- głębokość

- zaprojektowany

- domena

- dziesiątki

- wydajny

- wysiłek

- Inżynieria

- Równoważny

- ewaluację

- Każdy

- ewoluowały

- przykład

- przykłady

- rozszerzenie

- ekspert

- rozległy

- informacja zwrotna

- Skupiać

- W razie zamówieenia projektu

- Formalnie

- Fundacja

- od

- w pełni

- dalej

- Zarządzanie

- Have

- pomocny

- wysoko

- historia

- HTML

- HTTPS

- podnieść

- poprawa

- ulepszenia

- in

- włączenie

- Zwiększać

- przemysł

- początkowy

- zamiar

- wprowadzenie

- JEGO

- Klawisz

- wiedza

- Korea

- koreański

- język

- duży

- większe

- Nazwisko

- Regulamin

- Dźwignia

- Maksymalizuj

- wymowny

- spełnione

- metody

- milion

- model

- modele

- zmodyfikowano

- wielokrotność

- Potrzebować

- potrzebne

- wymagania

- Nowości

- powieść

- listopad

- of

- oferuje

- często

- on

- OpenAI

- operator

- Optymalizacja

- or

- organizacji

- Inne

- ludzkiej,

- na zewnątrz

- Wyjścia

- koniec

- parametr

- parametry

- część

- szczególnie

- partner

- Współpraca

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- plato

- Analiza danych Platona

- PlatoDane

- Korzystny

- wygląda tak

- procesów

- Program

- własność

- jakość

- szmata

- uznanie

- wymagany

- Badacze

- Odpowiedzi

- wynikły

- klientów

- Skala

- wyniki

- zadraśnięcie

- widzieć

- usługa

- służąc

- ustawienie

- ponieważ

- SKT

- kilka

- Południe

- Korea Południowa

- specyficzny

- Ewolucja krok po kroku

- Cel

- silny

- abonentów

- sukces

- taki

- wsparcie

- systemy

- Zadanie

- zespół

- Zespoły

- Techniczny

- Techniki

- Telecom

- telekomunikacja

- Testowanie

- że

- Połączenia

- ich

- następnie

- one

- czas

- do

- Żetony

- narzędzie

- Pociąg

- Trening

- rozumie

- wyjątkowy

- posługiwać się

- przypadek użycia

- za pomocą

- różnorodny

- Ve

- chcieć

- poszukiwany

- we

- tygodni

- były

- jeśli chodzi o komunikację i motywację

- Podczas

- w

- Praca

- pracował

- wartość

- zefirnet