Ten post został napisany wspólnie z Jayadeepem Pabbisetty, starszym specjalistą ds. inżynierii danych w firmie Merck i Prabakaranem Mathaiyanem, starszym inżynierem ML w Tiger Analytics.

Cykl życia dużego modelu uczenia maszynowego (ML) wymaga skalowalnego procesu wydawania modelu podobnego do procesu tworzenia oprogramowania. Twórcy modeli często współpracują przy opracowywaniu modeli ML i wymagają solidnej platformy MLOps do pracy. Skalowalna platforma MLOps musi obejmować proces obsługi przepływu pracy związanej z rejestracją, zatwierdzaniem i awansowaniem modelu ML na wyższy poziom środowiska (programowanie, testowanie) , UAT lub produkcja).

Twórca modelu zazwyczaj rozpoczyna pracę w indywidualnym środowisku programistycznym ML Amazon Sage Maker. Kiedy model jest wyszkolony i gotowy do użycia, musi zostać zatwierdzony po zarejestrowaniu w Rejestr modelu Amazon SageMaker. W tym poście omawiamy współpracę zespołu AI/ML AWS z zespołem Merck Human Health IT MLOps przy tworzeniu rozwiązania wykorzystującego zautomatyzowany przepływ pracy do zatwierdzania i promocji modeli ML z interwencją człowieka pośrodku.

Przegląd rozwiązania

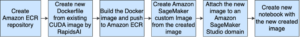

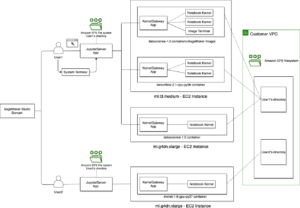

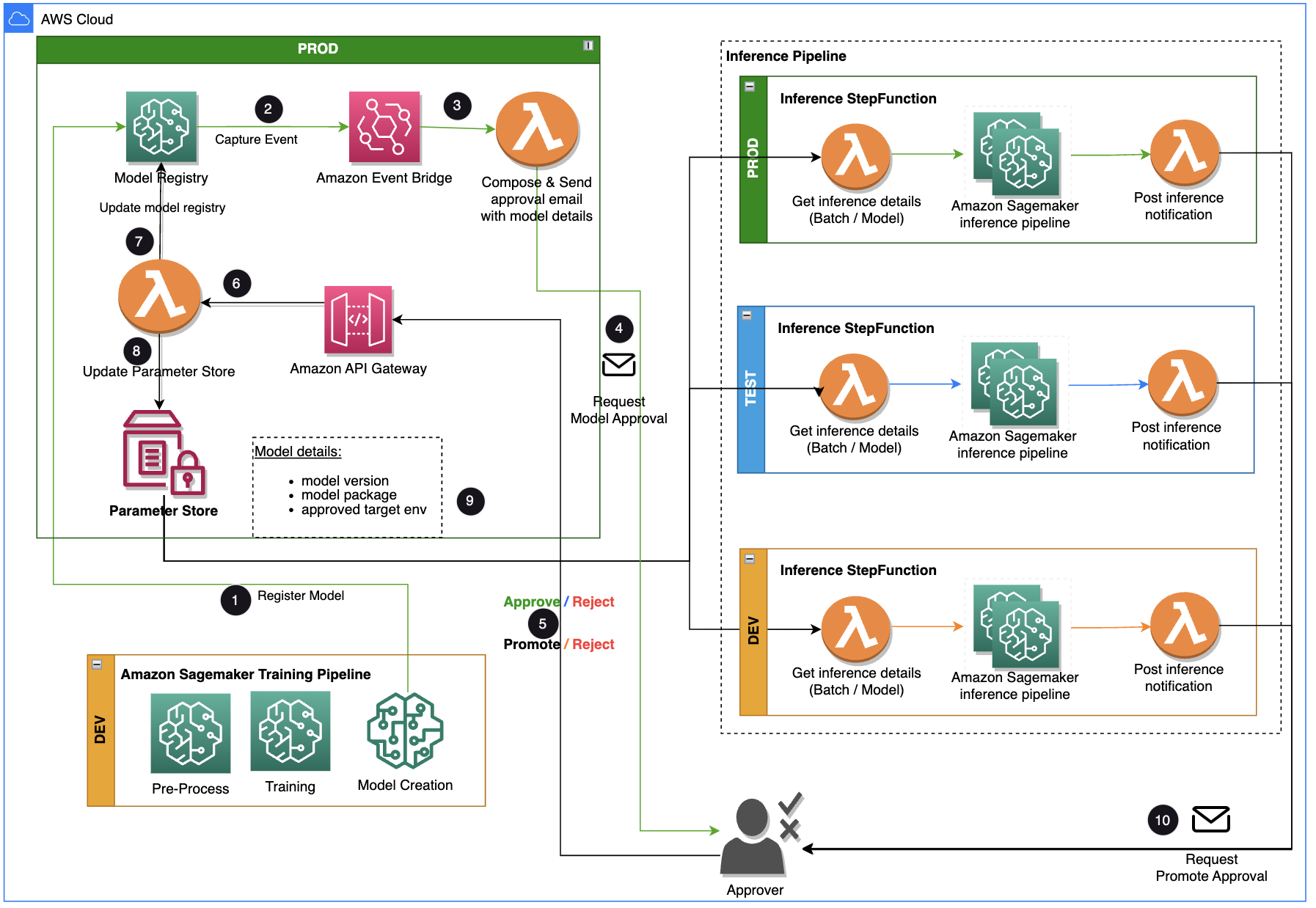

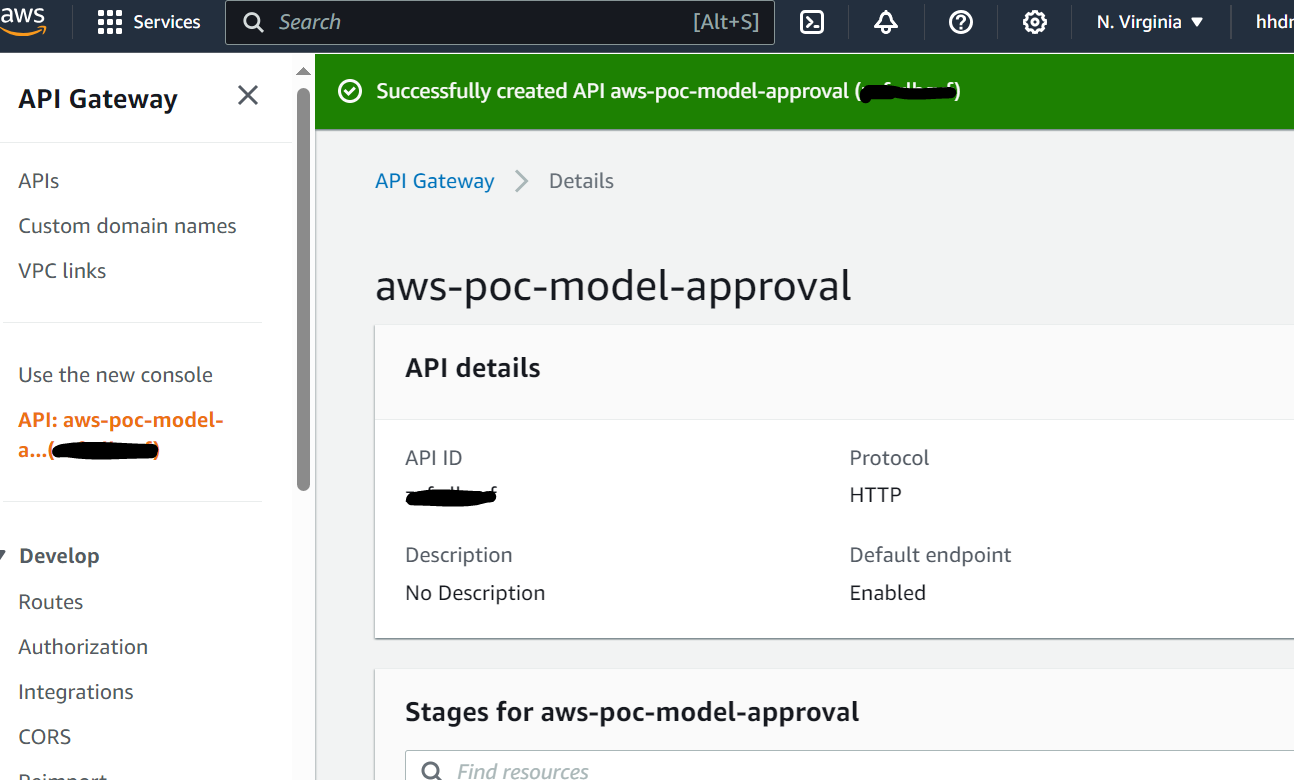

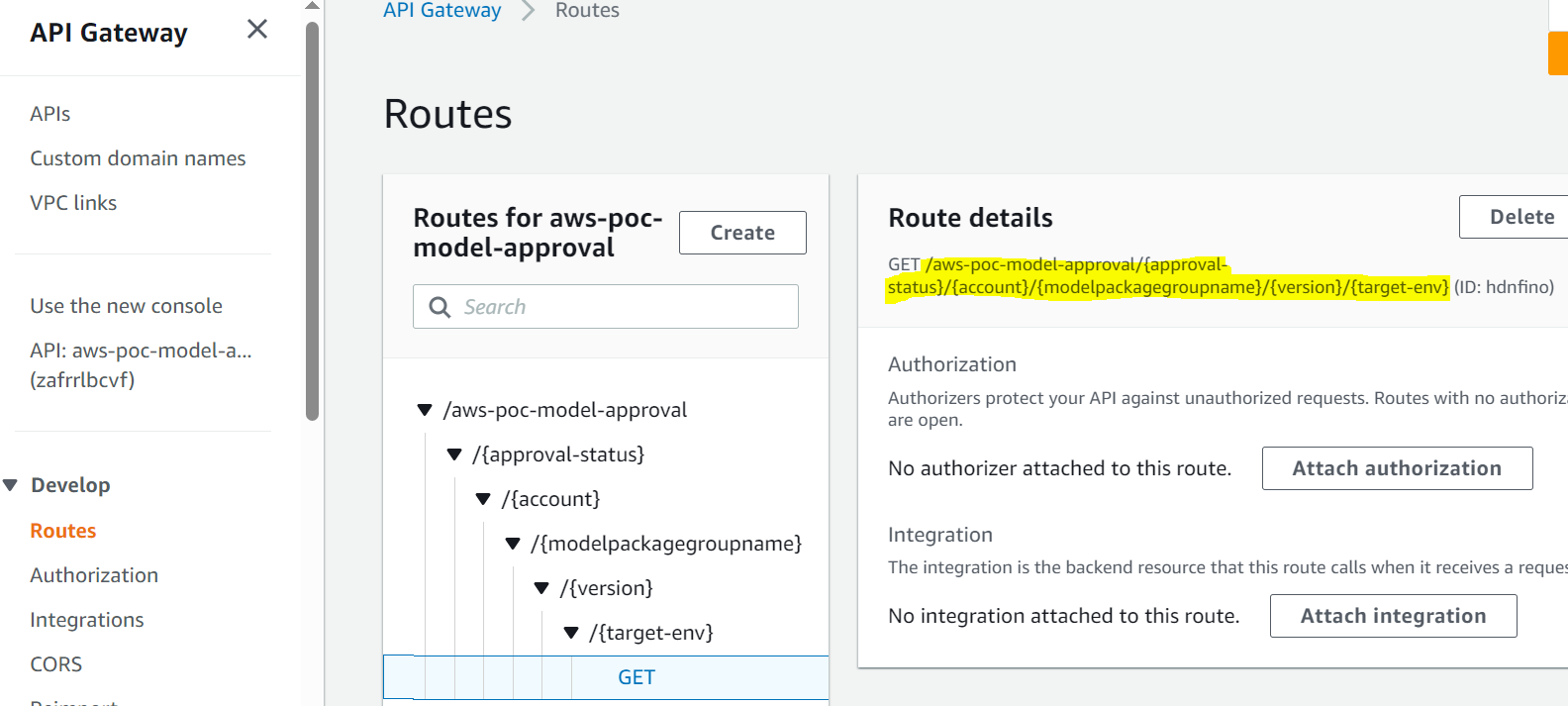

Ten post koncentruje się na rozwiązaniu przepływu pracy, którego może używać cykl życia tworzenia modelu ML między potokiem szkoleniowym a potokiem wnioskowania. Rozwiązanie zapewnia skalowalny przepływ pracy dla MLOps w zakresie wspierania procesu zatwierdzania i promocji modelu ML przy interwencji człowieka. Model uczenia maszynowego zarejestrowany przez analityka danych wymaga sprawdzenia i zatwierdzenia przez osobę zatwierdzającą przed użyciem go w potoku wnioskowania oraz na kolejnym poziomie środowiska (testowym, UAT lub produkcyjnym). Rozwiązanie wykorzystuje AWS Lambda, Brama Amazon API, Most zdarzeń Amazonai SageMaker do automatyzacji przepływu pracy z interwencją człowieka w środku. Poniższy diagram architektury przedstawia ogólny projekt systemu, użyte usługi AWS oraz przepływ pracy związany z zatwierdzaniem i promowaniem modeli ML z udziałem człowieka od rozwoju do produkcji.

Przepływ pracy obejmuje następujące kroki:

- Potok szkoleniowy opracowuje i rejestruje model w rejestrze modeli SageMaker. W tym momencie status modelu to

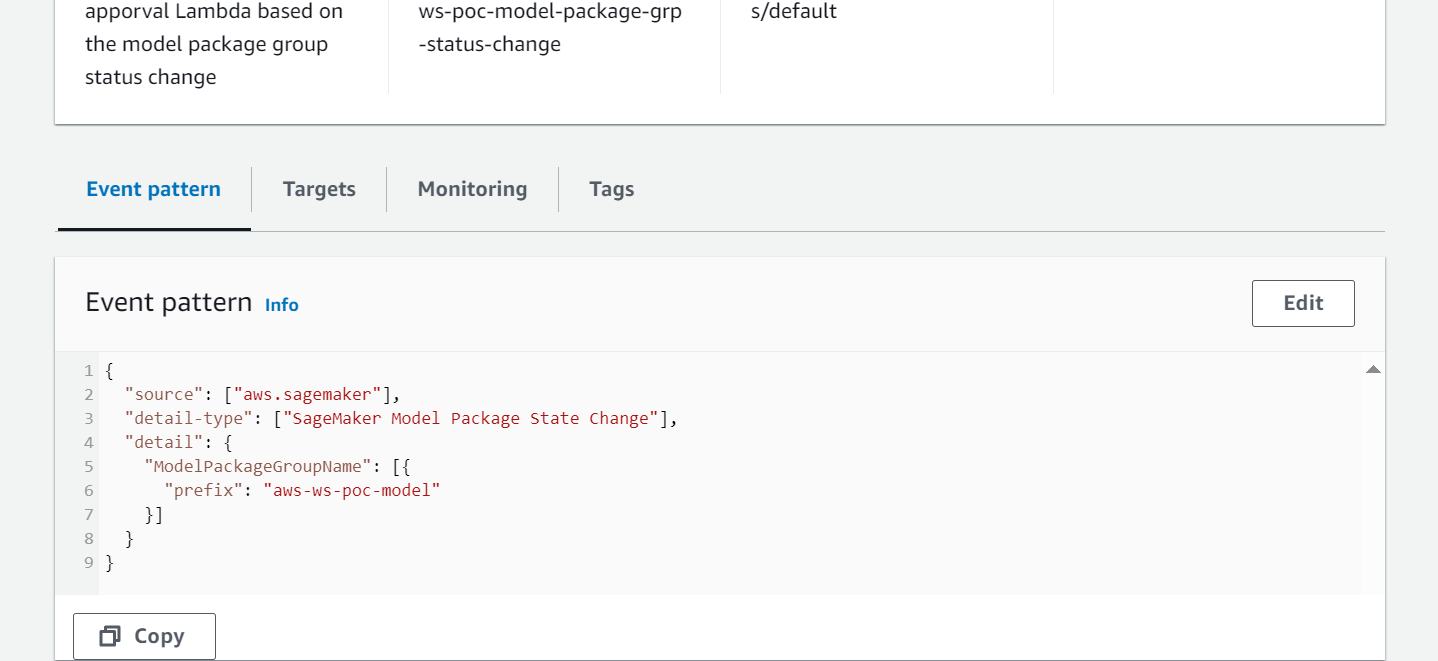

PendingManualApproval. - EventBridge monitoruje zdarzenia zmiany statusu, aby automatycznie podejmować działania za pomocą prostych reguł.

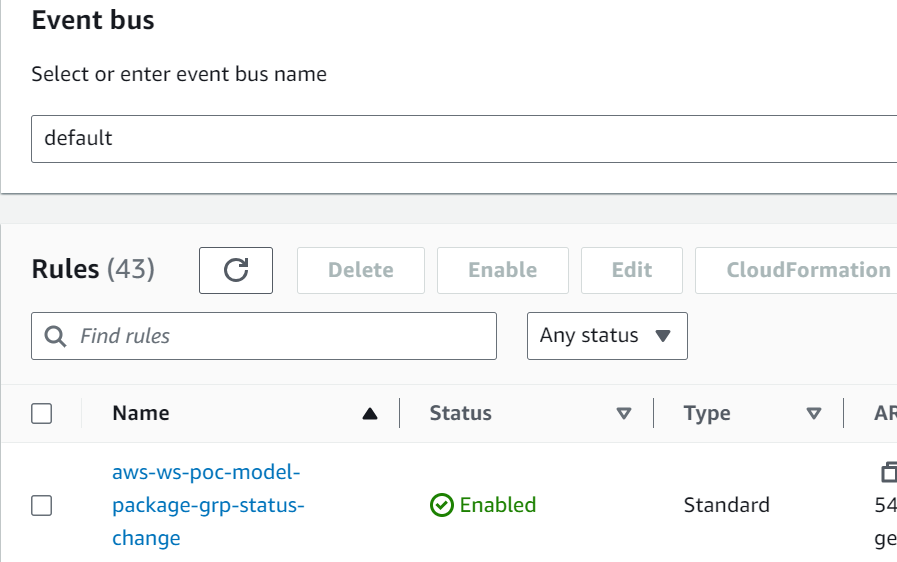

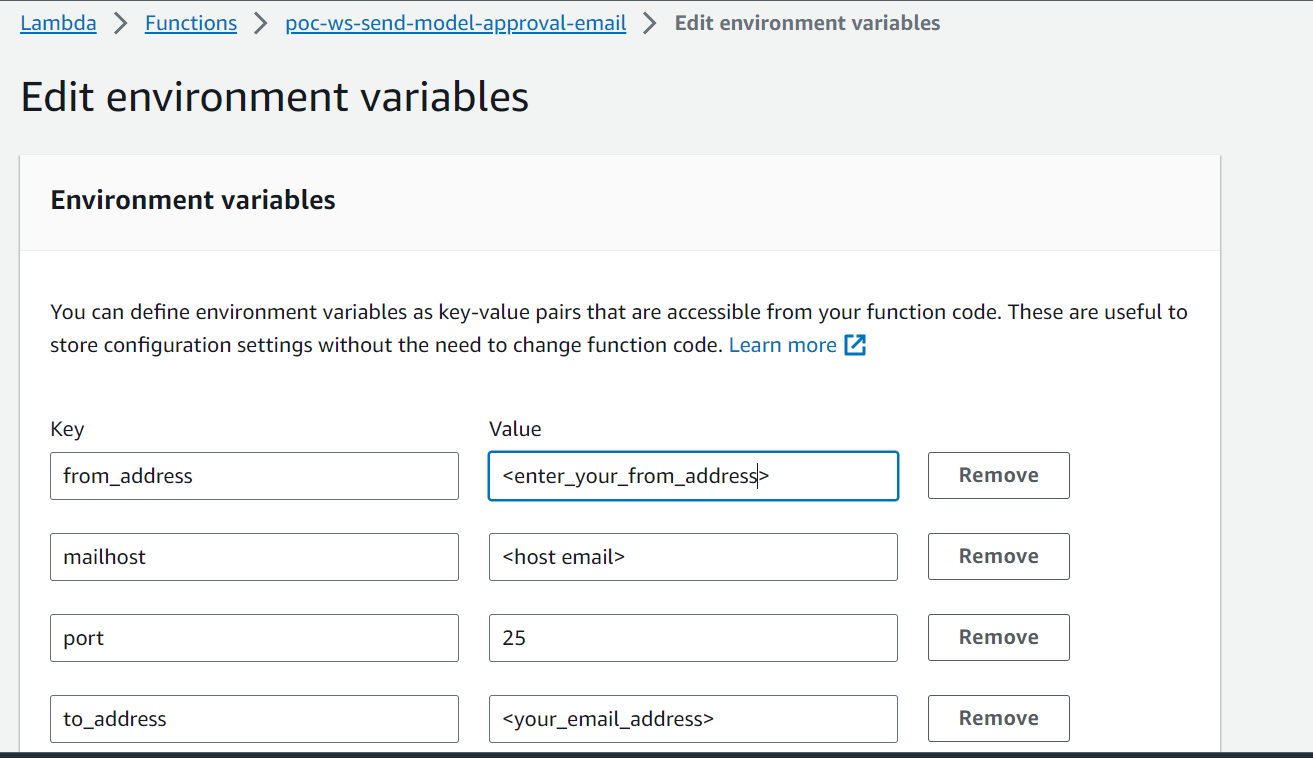

- Reguła zdarzenia rejestracji modelu EventBridge wywołuje funkcję Lambda, która tworzy wiadomość e-mail zawierającą łącze umożliwiające zatwierdzenie lub odrzucenie zarejestrowanego modelu.

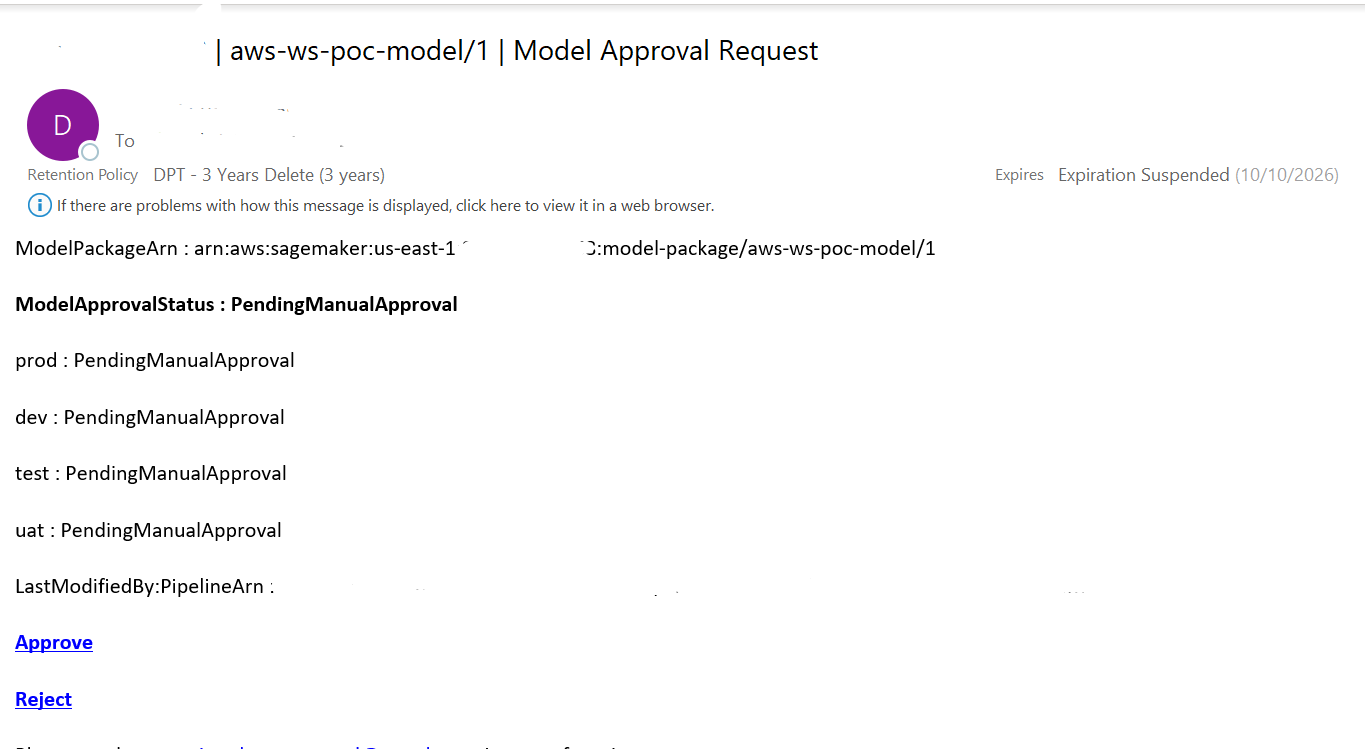

- Osoba zatwierdzająca otrzymuje wiadomość e-mail z łączem umożliwiającym sprawdzenie i zatwierdzenie lub odrzucenie modelu.

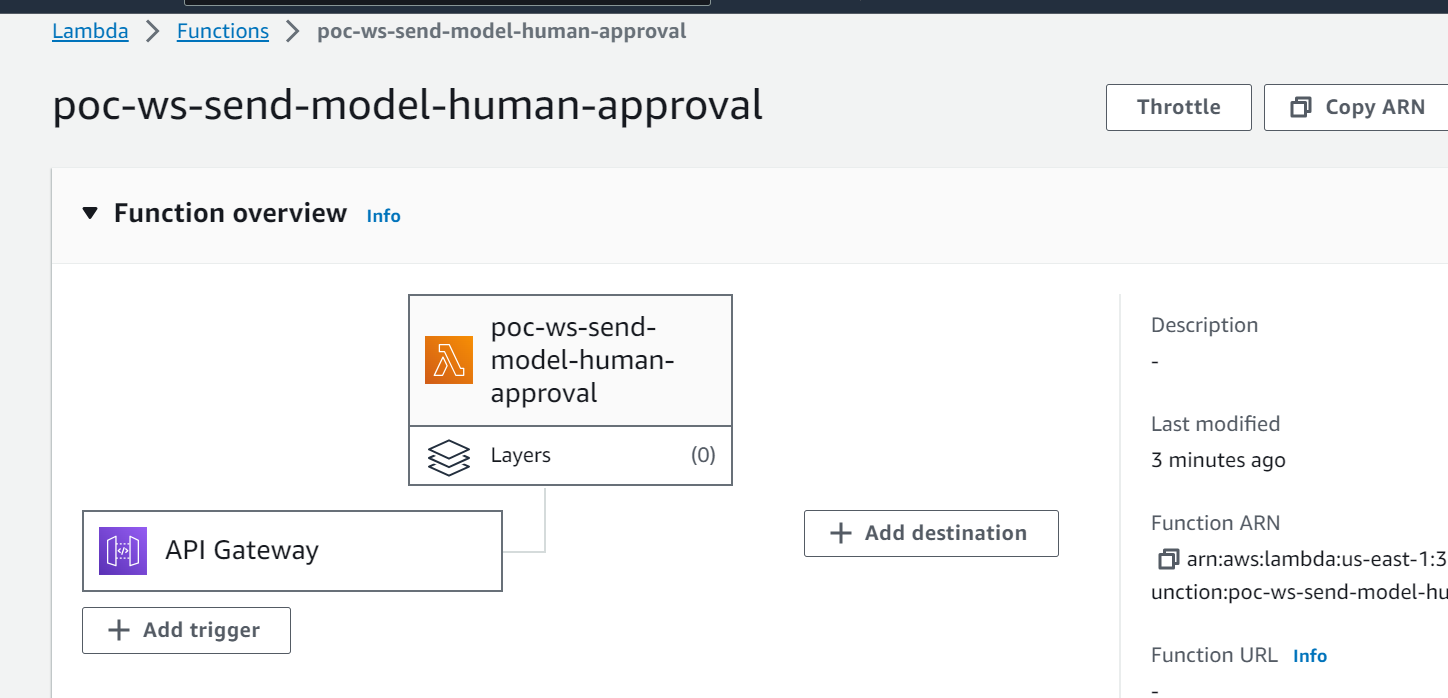

- Osoba zatwierdzająca zatwierdza model, klikając łącze w wiadomości e-mail prowadzące do punktu końcowego bramy API.

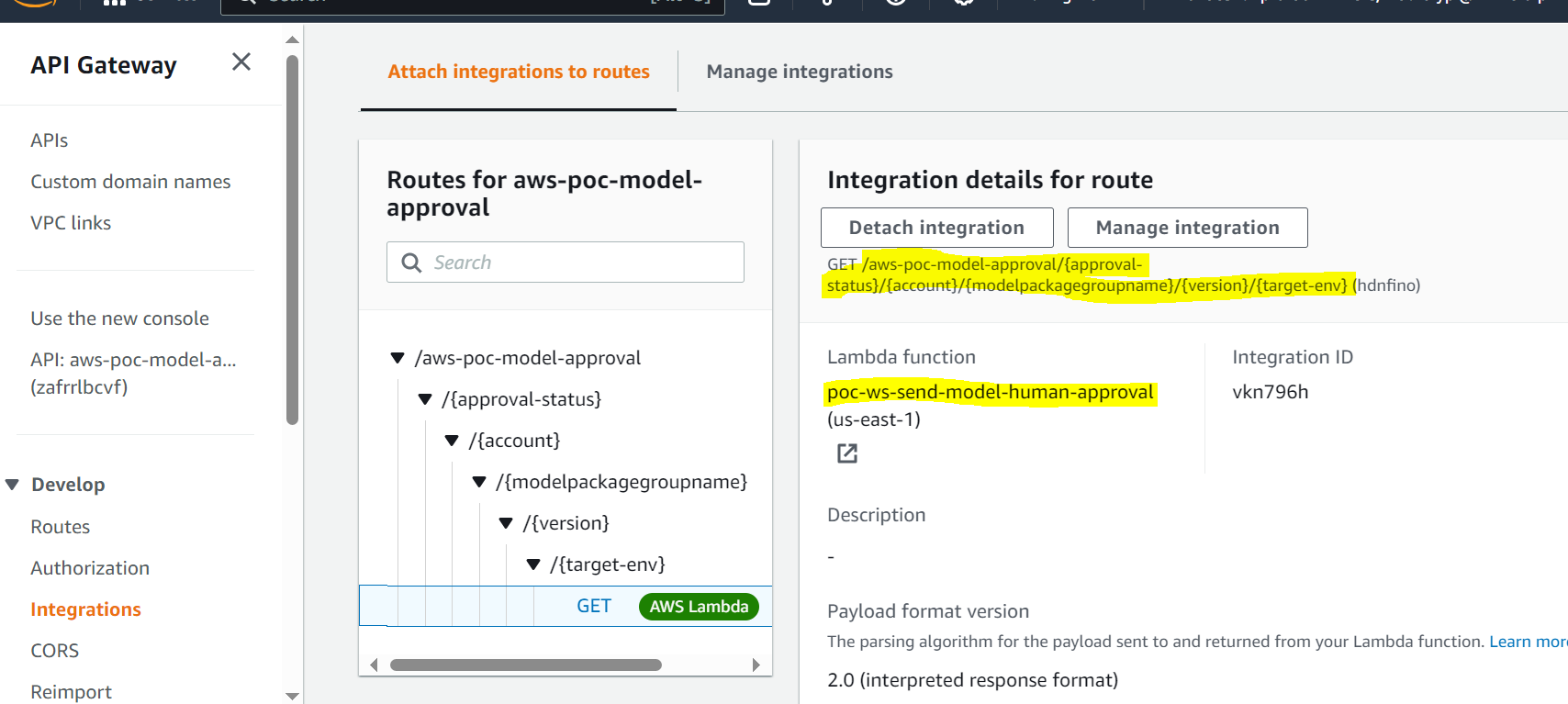

- API Gateway wywołuje funkcję Lambda w celu zainicjowania aktualizacji modelu.

- Rejestr modelu jest aktualizowany pod kątem statusu modelu (

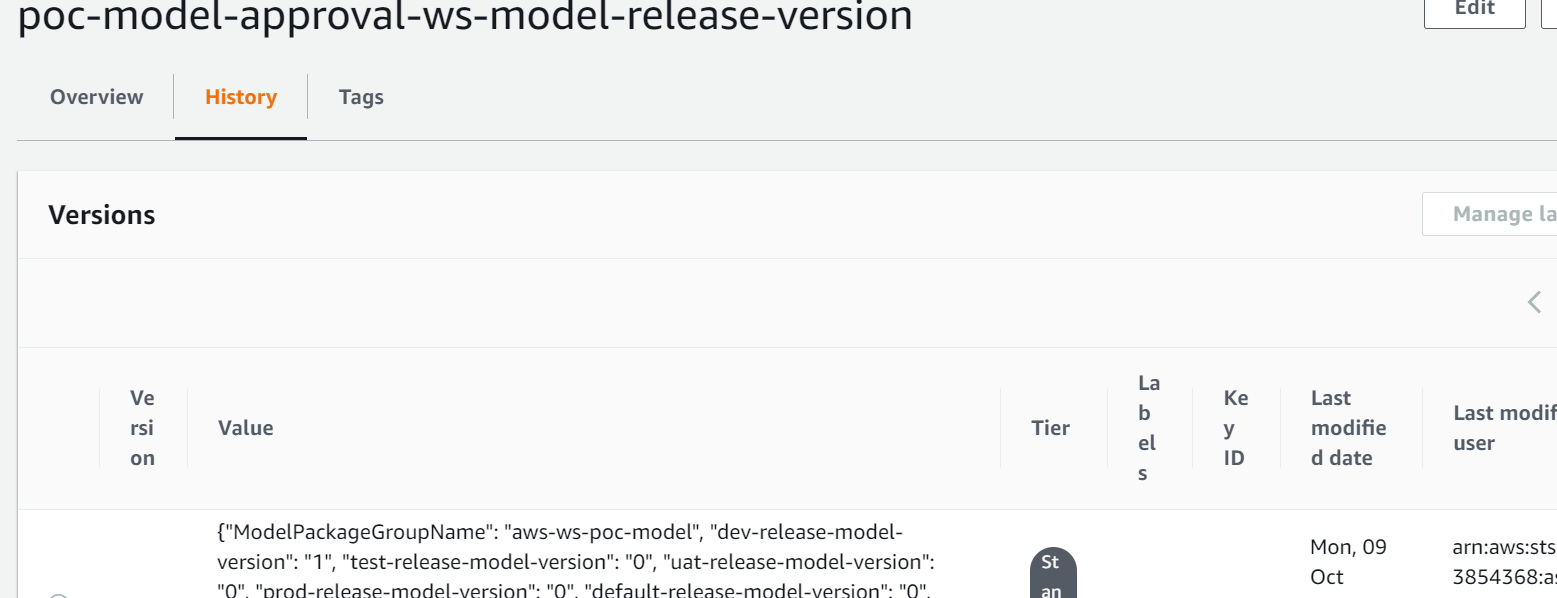

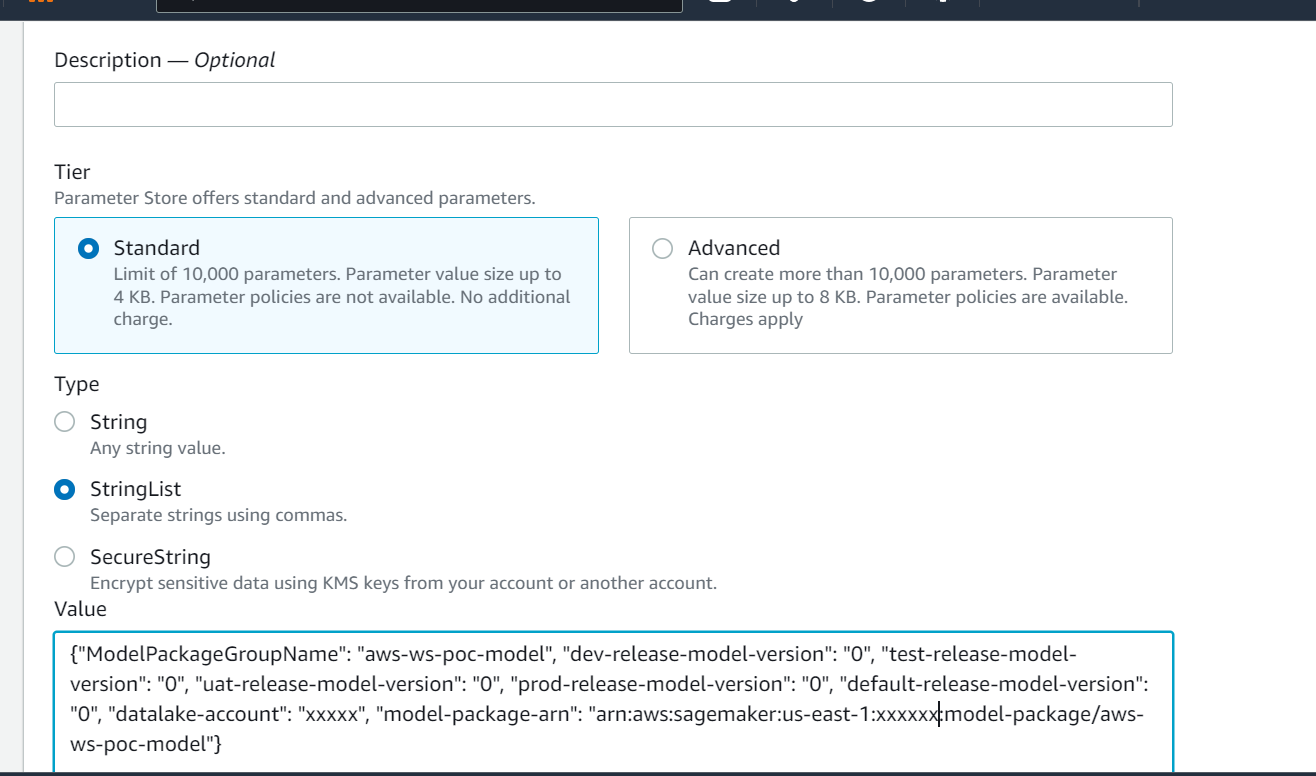

Approveddla środowiska deweloperskiego, alePendingManualApprovaldo testów, UAT i produkcji). - Szczegóły modelu są przechowywane w Magazyn parametrów AWS, zdolność Menedżer systemów AWS, w tym wersję modelu, zatwierdzone środowisko docelowe, pakiet modelu.

- Potok wnioskowania pobiera model zatwierdzony dla środowiska docelowego z magazynu parametrów.

- Funkcja Lambda powiadamiająca po wnioskowaniu zbiera metryki wnioskowania wsadowego i wysyła wiadomość e-mail do osoby zatwierdzającej w celu awansowania modelu do następnego środowiska.

Wymagania wstępne

Przepływ pracy opisany w tym poście zakłada, że środowisko potoku szkoleniowego jest skonfigurowane w SageMaker wraz z innymi zasobami. Dane wejściowe do potoku szkoleniowego to zestaw danych funkcji. Szczegóły generowania funkcji nie są uwzględnione w tym poście, ale skupiają się na rejestrowaniu, zatwierdzaniu i promowaniu modeli uczenia maszynowego po ich przeszkoleniu. Model jest zarejestrowany w rejestrze modeli i podlega ramom monitorowania w Monitor modelu Amazon SageMaker aby wykryć wszelkie odchylenia i przystąpić do ponownego szkolenia w przypadku odchylenia modelu.

Szczegóły przepływu pracy

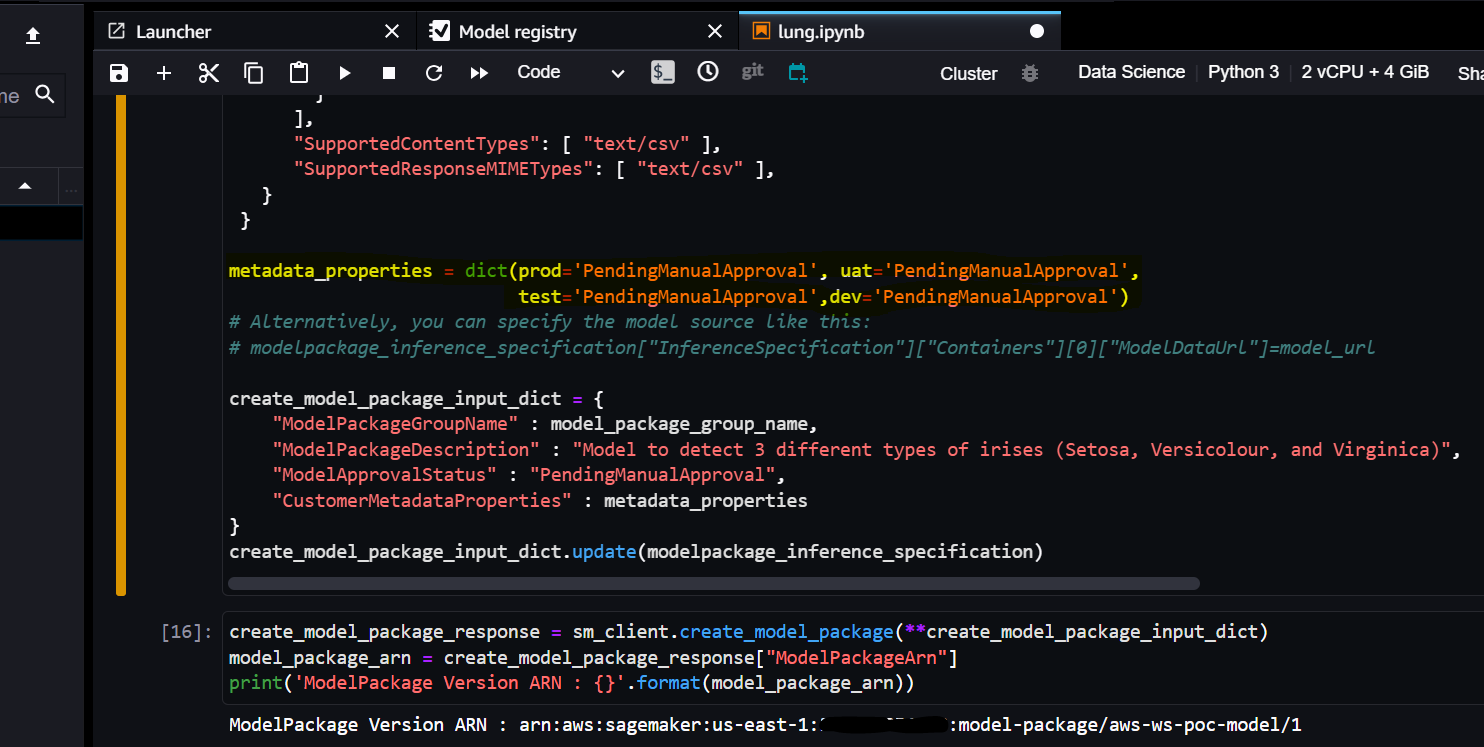

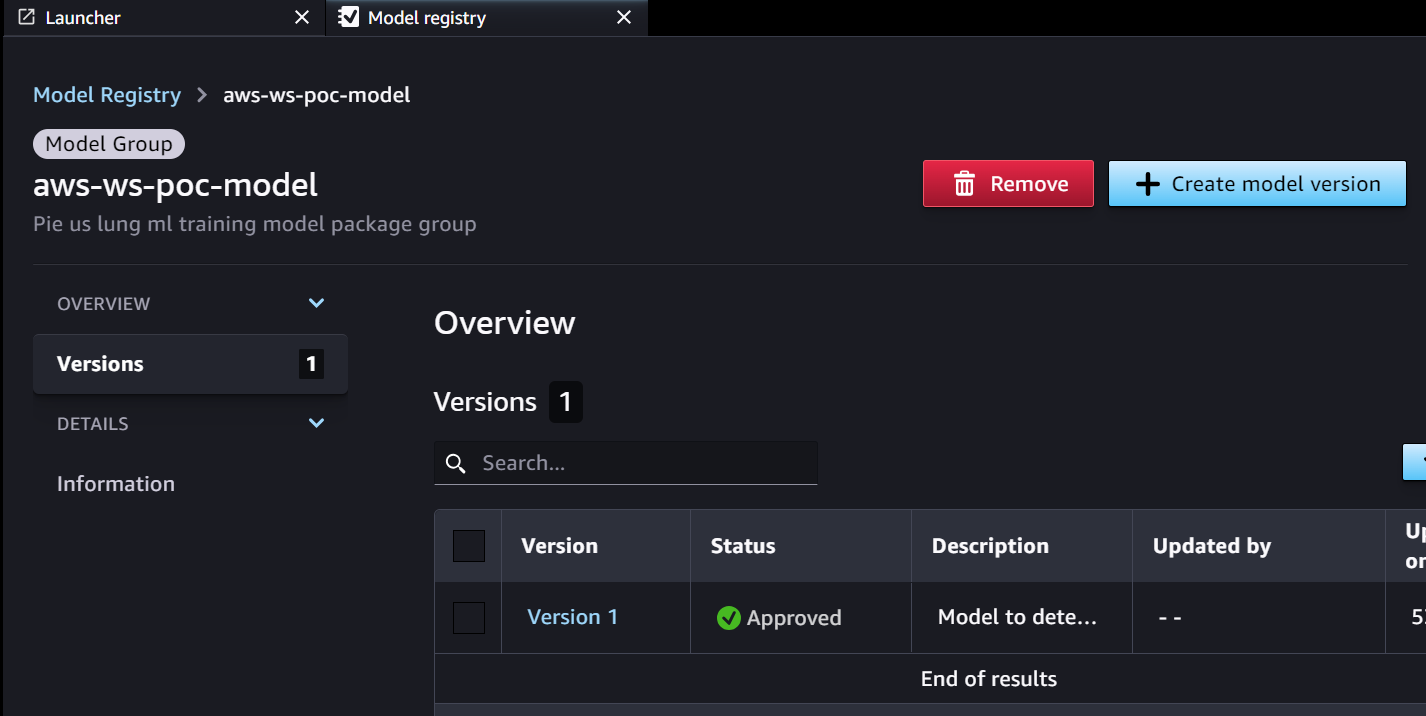

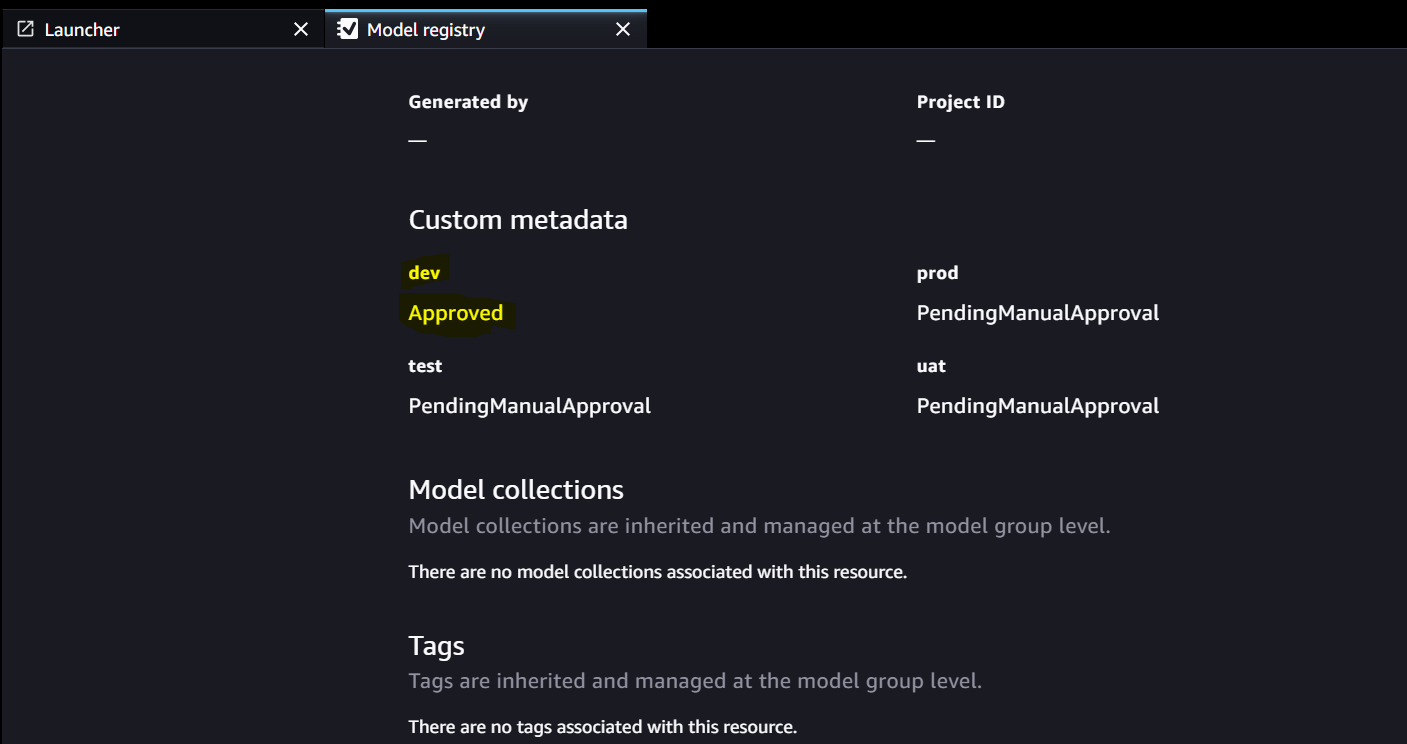

Przepływ pracy zatwierdzania rozpoczyna się od modelu opracowanego na podstawie potoku szkoleniowego. Kiedy badacze danych opracowują model, rejestrują go w rejestrze modeli SageMaker ze statusem modelu PendingManualApproval. EventBridge monitoruje SageMaker pod kątem zdarzenia rejestracji modelu i wyzwala regułę zdarzenia, która wywołuje funkcję Lambda. Funkcja Lambda dynamicznie konstruuje wiadomość e-mail w celu zatwierdzenia modelu z łączem do punktu końcowego API Gateway do innej funkcji Lambda. Gdy osoba zatwierdzająca skorzysta z łącza, aby zatwierdzić model, API Gateway przekazuje akcję zatwierdzania do funkcji Lambda, która aktualizuje rejestr modelu SageMaker i atrybuty modelu w magazynie parametrów. Osoba zatwierdzająca musi być uwierzytelniona i należeć do grupy osób zatwierdzających zarządzanej przez usługę Active Directory. Wstępna akceptacja oznacza model jako Approved dla deweloperów, ale PendingManualApproval do testów, UAT i produkcji. Atrybuty modelu zapisane w magazynie parametrów obejmują wersję modelu, pakiet modelu i zatwierdzone środowisko docelowe.

Gdy potok wnioskowania musi pobrać model, sprawdza magazyn parametrów pod kątem najnowszej wersji modelu zatwierdzonej dla środowiska docelowego i pobiera szczegóły wnioskowania. Po zakończeniu potoku wnioskowania do interesariusza wysyłana jest wiadomość e-mail z powiadomieniem po wnioskowaniu z prośbą o zatwierdzenie promowania modelu na wyższy poziom środowiska. Wiadomość e-mail zawiera szczegółowe informacje na temat modelu i metryk, a także łącze zatwierdzające do punktu końcowego bramy API dla funkcji Lambda, która aktualizuje atrybuty modelu.

Poniżej znajduje się sekwencja zdarzeń i kroków implementacji dla przepływu pracy zatwierdzania/promowania modelu ML od stworzenia modelu do produkcji. Model jest promowany ze środowisk programistycznych do testowych, UAT i produkcyjnych z wyraźną zgodą człowieka na każdym etapie.

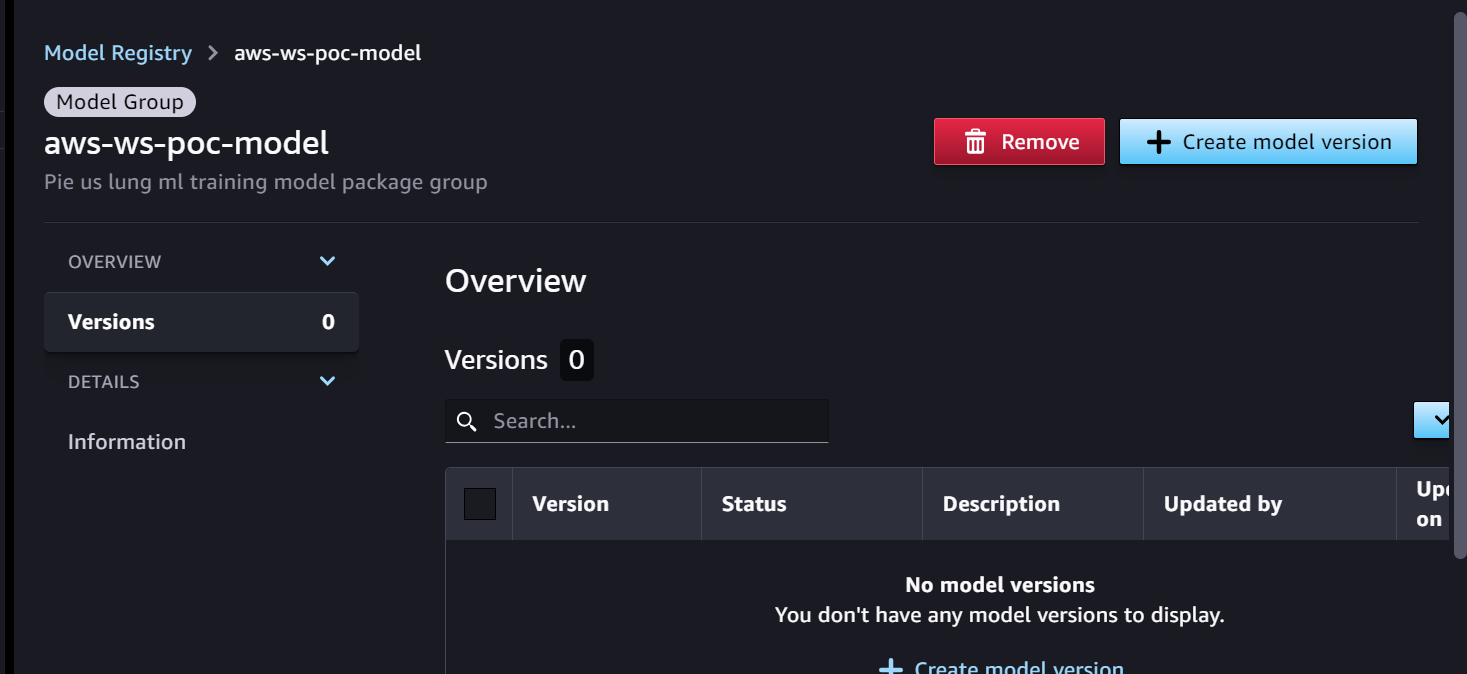

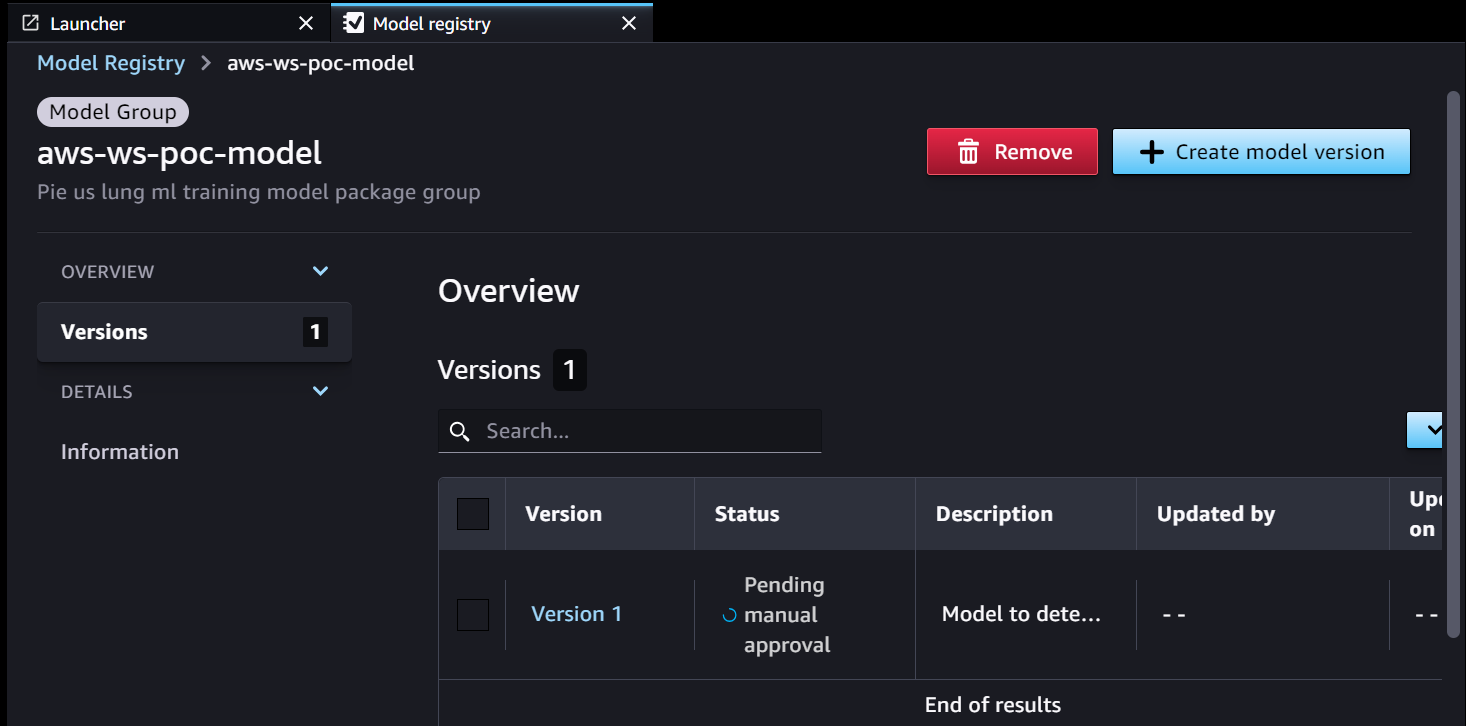

Zaczynamy od potoku szkoleniowego, który jest gotowy do opracowania modelu. Wersja modelu zaczyna się od 0 w rejestrze modeli SageMaker.

- Potok szkoleniowy SageMaker opracowuje i rejestruje model w rejestrze modeli SageMaker. Wersja modelu 1 jest zarejestrowana i zaczyna się od Oczekuje na ręczne zatwierdzenie stan.

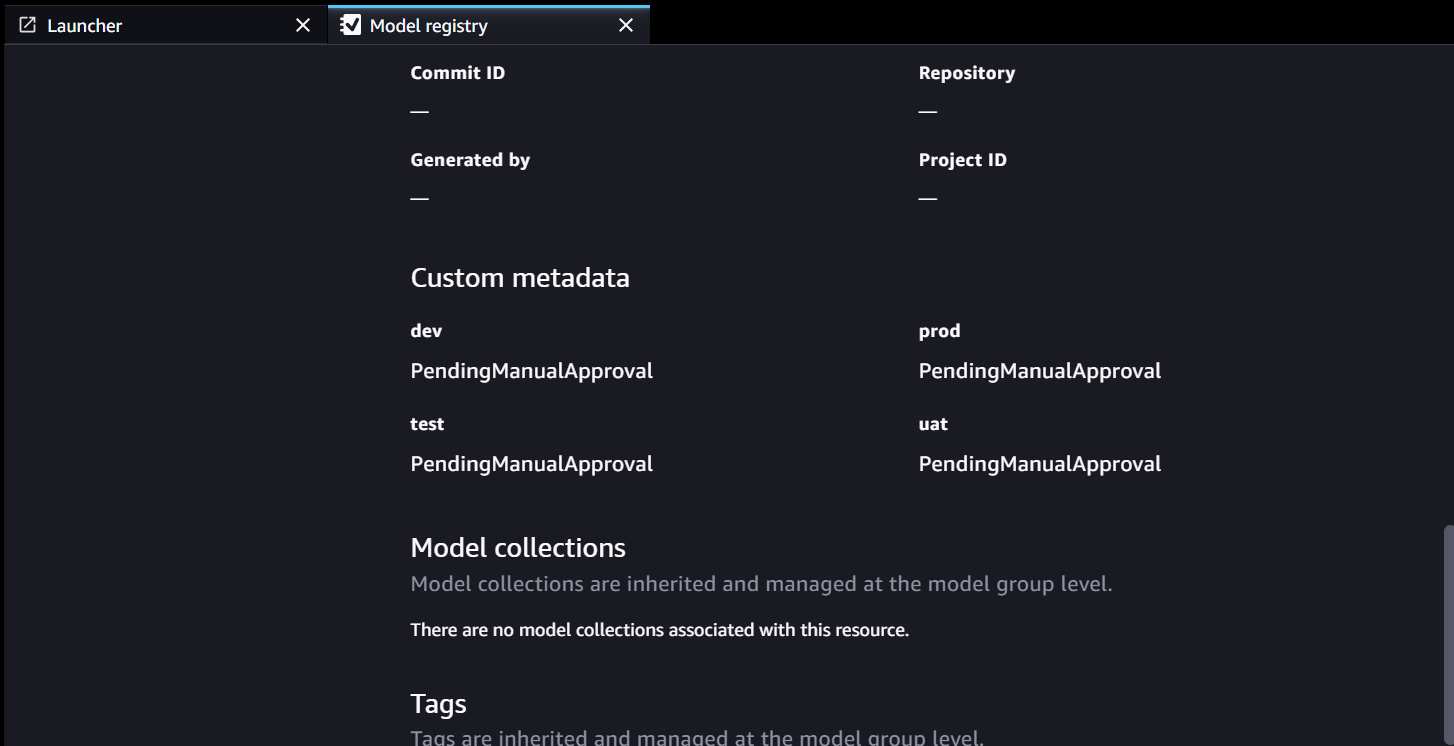

Metadane Rejestru modelu zawierają cztery niestandardowe pola dla środowisk:

Metadane Rejestru modelu zawierają cztery niestandardowe pola dla środowisk: dev, test, uat,prod.

- EventBridge monitoruje rejestr modelu SageMaker pod kątem zmiany statusu, aby automatycznie podejmować działania za pomocą prostych reguł.

- Reguła zdarzenia rejestracji modelu wywołuje funkcję Lambda, która tworzy wiadomość e-mail zawierającą łącze umożliwiające zatwierdzenie lub odrzucenie zarejestrowanego modelu.

- Osoba zatwierdzająca otrzymuje wiadomość e-mail z łączem umożliwiającym sprawdzenie i zatwierdzenie (lub odrzucenie) modelu.

- Osoba zatwierdzająca zatwierdza model, klikając łącze do punktu końcowego API Gateway w wiadomości e-mail.

- API Gateway wywołuje funkcję Lambda w celu zainicjowania aktualizacji modelu.

- Rejestr modelu SageMaker jest aktualizowany o status modelu.

- Informacje szczegółowe o modelu są przechowywane w magazynie parametrów, włączając wersję modelu, zatwierdzone środowisko docelowe i pakiet modelu.

- Potok wnioskowania pobiera model zatwierdzony dla środowiska docelowego z magazynu parametrów.

- Funkcja Lambda powiadamiająca po wnioskowaniu zbiera metryki wnioskowania wsadowego i wysyła wiadomość e-mail do osoby zatwierdzającej w celu awansowania modelu do następnego środowiska.

- Osoba zatwierdzająca zatwierdza awans modelu na wyższy poziom, klikając łącze do punktu końcowego API Gateway, co uruchamia funkcję Lambda w celu aktualizacji rejestru modeli i magazynu parametrów SageMaker.

Pełna historia wersjonowania i zatwierdzania modelu jest zapisywana do przeglądu w magazynie parametrów.

Wnioski

Cykl życia dużego modelu ML wymaga skalowalnego procesu zatwierdzania modelu ML. W tym poście udostępniliśmy implementację przepływu pracy związanego z rejestracją, zatwierdzaniem i promocją modelu ML z interwencją człowieka przy użyciu rejestru modeli SageMaker, EventBridge, API Gateway i Lambda. Jeśli rozważasz skalowalny proces opracowywania modelu ML dla swojej platformy MLOps, możesz wykonać kroki opisane w tym poście, aby wdrożyć podobny przepływ pracy.

O autorach

Tomek Kim jest starszym architektem rozwiązań w AWS, gdzie pomaga swoim klientom osiągać cele biznesowe poprzez tworzenie rozwiązań na platformie AWS. Posiada rozległe doświadczenie w architekturze systemów korporacyjnych i operacjach w kilku branżach – szczególnie w służbie zdrowia i naukach przyrodniczych. Tomek stale uczy się nowych technologii, które prowadzą do pożądanych przez klientów rezultatów biznesowych – m.in. AI/ML, GenAI i analityka danych. Lubi także podróżować do nowych miejsc i grać na nowych polach golfowych, kiedy tylko znajdzie czas.

Tomek Kim jest starszym architektem rozwiązań w AWS, gdzie pomaga swoim klientom osiągać cele biznesowe poprzez tworzenie rozwiązań na platformie AWS. Posiada rozległe doświadczenie w architekturze systemów korporacyjnych i operacjach w kilku branżach – szczególnie w służbie zdrowia i naukach przyrodniczych. Tomek stale uczy się nowych technologii, które prowadzą do pożądanych przez klientów rezultatów biznesowych – m.in. AI/ML, GenAI i analityka danych. Lubi także podróżować do nowych miejsc i grać na nowych polach golfowych, kiedy tylko znajdzie czas.

Shamika Ariyawanę, pełniąca funkcję starszego architekta rozwiązań AI/ML w dziale Healthcare and Life Sciences w Amazon Web Services (AWS), specjalizuje się w generatywnej sztucznej inteligencji, ze szczególnym naciskiem na szkolenia w zakresie modelu dużego języka (LLM), optymalizacje wnioskowania i MLOps (uczenie maszynowe Operacje). Pomaga klientom we wdrażaniu zaawansowanej generatywnej sztucznej inteligencji w swoich projektach, zapewniając solidne procesy szkoleniowe, wydajne mechanizmy wnioskowania i usprawnione praktyki MLOps w celu uzyskania skutecznych i skalowalnych rozwiązań AI. Poza zobowiązaniami zawodowymi Shamika pasjonuje się przygodami związanymi z narciarstwem i off-roadem.

Shamika Ariyawanę, pełniąca funkcję starszego architekta rozwiązań AI/ML w dziale Healthcare and Life Sciences w Amazon Web Services (AWS), specjalizuje się w generatywnej sztucznej inteligencji, ze szczególnym naciskiem na szkolenia w zakresie modelu dużego języka (LLM), optymalizacje wnioskowania i MLOps (uczenie maszynowe Operacje). Pomaga klientom we wdrażaniu zaawansowanej generatywnej sztucznej inteligencji w swoich projektach, zapewniając solidne procesy szkoleniowe, wydajne mechanizmy wnioskowania i usprawnione praktyki MLOps w celu uzyskania skutecznych i skalowalnych rozwiązań AI. Poza zobowiązaniami zawodowymi Shamika pasjonuje się przygodami związanymi z narciarstwem i off-roadem.

Jayadeepa Pabbisetty’ego jest starszym inżynierem ML/Data w firmie Merck, gdzie projektuje i rozwija rozwiązania ETL i MLOps w celu odblokowania nauki i analityki danych dla biznesu. Zawsze jest entuzjastycznie nastawiony do uczenia się nowych technologii, odkrywania nowych ścieżek i zdobywania umiejętności niezbędnych do ewoluowania wraz z ciągle zmieniającą się branżą IT. W wolnym czasie realizuje swoją pasję sportową, lubi podróżować i poznawać nowe miejsca.

Jayadeepa Pabbisetty’ego jest starszym inżynierem ML/Data w firmie Merck, gdzie projektuje i rozwija rozwiązania ETL i MLOps w celu odblokowania nauki i analityki danych dla biznesu. Zawsze jest entuzjastycznie nastawiony do uczenia się nowych technologii, odkrywania nowych ścieżek i zdobywania umiejętności niezbędnych do ewoluowania wraz z ciągle zmieniającą się branżą IT. W wolnym czasie realizuje swoją pasję sportową, lubi podróżować i poznawać nowe miejsca.

Prabakarana Mathaiyana jest starszym inżynierem uczenia maszynowego w Tiger Analytics LLC, gdzie pomaga swoim klientom osiągnąć ich cele biznesowe, dostarczając rozwiązania do budowania modeli, szkoleń, walidacji, monitorowania, CICD i ulepszania rozwiązań uczenia maszynowego w AWS. Prabakaran stale uczy się nowych technologii, które prowadzą do pożądanych rezultatów biznesowych dla klientów – m.in. AI/ML, GenAI, GPT i LLM. Lubi także grać w krykieta, kiedy tylko znajdzie czas.

Prabakarana Mathaiyana jest starszym inżynierem uczenia maszynowego w Tiger Analytics LLC, gdzie pomaga swoim klientom osiągnąć ich cele biznesowe, dostarczając rozwiązania do budowania modeli, szkoleń, walidacji, monitorowania, CICD i ulepszania rozwiązań uczenia maszynowego w AWS. Prabakaran stale uczy się nowych technologii, które prowadzą do pożądanych rezultatów biznesowych dla klientów – m.in. AI/ML, GenAI, GPT i LLM. Lubi także grać w krykieta, kiedy tylko znajdzie czas.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/build-an-amazon-sagemaker-model-registry-approval-and-promotion-workflow-with-human-intervention/

- :ma

- :Jest

- :nie

- :Gdzie

- $W GÓRĘ

- 1

- 100

- 116

- 7

- a

- O nas

- Osiągać

- nabywanie

- w poprzek

- Działania

- działania

- aktywny

- zaawansowany

- Przygody

- Po

- AI

- AI / ML

- wzdłuż

- również

- zawsze

- Amazonka

- Amazon Sage Maker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- analityka

- i

- Inne

- każdy

- api

- zatwierdzenie

- Zatwierdzać

- zatwierdzony

- architektura

- SĄ

- AS

- zakłada

- At

- atrybuty

- uwierzytelniony

- zautomatyzować

- zautomatyzowane

- automatycznie

- aleje

- AWS

- BE

- zanim

- jest

- pomiędzy

- Poza

- Dolny

- budować

- Budowanie

- autobus

- biznes

- ale

- by

- CAN

- zdolność

- który

- walizka

- zmiana

- Wykrywanie urządzeń szpiegujących

- kod

- współpracował

- zobowiązania

- kompletny

- wobec

- konstrukty

- kursy

- tworzenie

- krykiet

- zwyczaj

- Klientów

- dane

- Analityka danych

- nauka danych

- naukowiec danych

- Wnętrze

- projekty

- życzenia

- detal

- detale

- wykryć

- dev

- rozwijać

- rozwinięty

- Deweloper

- deweloperzy

- rozwijanie

- oprogramowania

- rozwija się

- dyskutować

- podział

- dynamicznie

- e

- każdy

- Efektywne

- wydajny

- osadzanie

- Punkt końcowy

- inżynier

- Inżynieria

- zapewnienie

- Enterprise

- entuzjastyczny

- Środowisko

- środowiska

- wydarzenie

- wydarzenia

- ciągle się zmienia

- ewoluuje

- doświadczenie

- odkryj

- Exploring

- rozległy

- Szerokie doświadczenie

- Cecha

- Korzyści

- Łąka

- Znajdź

- Skupiać

- koncentruje

- obserwuj

- następujący

- następujący sposób

- W razie zamówieenia projektu

- cztery

- Framework

- od

- funkcjonować

- Bramka

- generacja

- generatywny

- generatywna sztuczna inteligencja

- golf

- regulowane

- Zarządzanie

- Przewodniki

- Prowadzenie

- he

- Zdrowie

- Opieka zdrowotna

- opieki zdrowotnej

- pomaga

- jego

- historia

- W jaki sposób

- HTML

- HTTPS

- człowiek

- if

- wdrożenia

- realizacja

- poprawa

- in

- zawierać

- włączony

- obejmuje

- Włącznie z

- indywidualny

- przemysłowa

- przemysł

- Informacja

- początkowy

- zainicjować

- wkład

- integracja

- interwencja

- najnowszych

- inwokuje

- IT

- Branża IT

- jpg

- język

- duży

- firmy

- prowadzić

- nauka

- poziom

- życie

- Life Science

- Life Sciences

- wifecycwe

- lubi

- LINK

- LLC

- LLM

- maszyna

- uczenie maszynowe

- zarządzane

- podręcznik

- Mechanizmy

- Metadane

- Metryka

- Środkowy

- ML

- MLOps

- model

- modele

- monitorowanie

- monitory

- musi

- niezbędny

- wymagania

- Nowości

- Nowe technologie

- Następny

- powiadomienie

- Cele

- of

- często

- on

- operacje

- or

- Inne

- Wynik

- ogólny

- pakiet

- parametr

- część

- szczególnie

- pasja

- Wzór

- rurociąg

- Miejsca

- Platforma

- plato

- Analiza danych Platona

- PlatoDane

- gra

- punkt

- portret

- Post

- praktyki

- kontynuować

- wygląda tak

- procesów

- Produkcja

- profesjonalny

- projektowanie

- promować

- Lansowany

- promowanie

- promocja

- zapewnia

- że

- dąży

- gotowy

- zarejestrować

- zarejestrowany

- rejestry

- Rejestracja

- rejestr

- zwolnić

- z prośbą

- wymagać

- Wymaga

- Zasoby

- przeglądu

- krzepki

- Trasa

- Zasada

- reguły

- s

- sagemaker

- zapisywane

- skalowalny

- nauka

- NAUKI

- Naukowiec

- Naukowcy

- wysyła

- senior

- wysłany

- Sekwencja

- Usługi

- służąc

- zestaw

- kilka

- shared

- Targi

- podobny

- Prosty

- umiejętności

- Tworzenie

- rozwoju oprogramowania

- rozwiązanie

- Rozwiązania

- specjalista

- specjalizuje się

- SPORTOWE

- interesariuszy

- początek

- rozpocznie

- Rynek

- Ewolucja krok po kroku

- Cel

- sklep

- przechowywany

- usprawniony

- Wspierający

- system

- systemy

- Brać

- cel

- zespół

- Technologies

- test

- że

- Połączenia

- ich

- one

- to

- Tygrys

- czas

- do

- razem

- tom

- przeszkolony

- Trening

- podróżować

- Podróżowanie

- zazwyczaj

- odblokować

- Aktualizacja

- zaktualizowane

- Nowości

- posługiwać się

- używany

- zastosowania

- za pomocą

- uprawomocnienie

- wersja

- we

- sieć

- usługi internetowe

- DOBRZE

- jeśli chodzi o komunikację i motywację

- ilekroć

- który

- w

- w ciągu

- Praca

- pracować razem

- workflow

- You

- Twój

- zefirnet