Przedsiębiorstwa starają się szybko uwolnić potencjał generatywnej sztucznej inteligencji, zapewniając dostęp do podstawowych modeli (FM) różnym branżom (LOB). Zespoły IT są odpowiedzialne za pomaganie LOB w szybkim i elastycznym wprowadzaniu innowacji, zapewniając jednocześnie scentralizowane zarządzanie i obserwowalność. Na przykład może być konieczne śledzenie wykorzystania FM w zespołach, kosztów obciążeń zwrotnych i zapewnienie wglądu w odpowiednie centrum kosztów w LOB. Ponadto może być konieczne uregulowanie dostępu do różnych modeli w każdym zespole. Na przykład, jeśli do użytku mogą zostać dopuszczone tylko określone FM.

Amazońska skała macierzysta to w pełni zarządzana usługa oferująca wybór wydajnych modeli podstawowych wiodących firm zajmujących się sztuczną inteligencją, takich jak AI21 Labs, Anthropic, Cohere, Meta, Stability AI i Amazon za pośrednictwem jednego interfejsu API, a także szeroki zestaw możliwości tworzenia generatywnej sztucznej inteligencji aplikacje zapewniające bezpieczeństwo, prywatność i odpowiedzialną sztuczną inteligencję. Ponieważ Amazon Bedrock jest rozwiązaniem bezserwerowym, nie musisz zarządzać żadną infrastrukturą i możesz bezpiecznie integrować i wdrażać możliwości generatywnej sztucznej inteligencji w swoich aplikacjach, korzystając z usług AWS, które już znasz.

Warstwa oprogramowania jako usługi (SaaS) dla podstawowych modeli może zapewnić prosty i spójny interfejs dla użytkowników końcowych, zachowując jednocześnie scentralizowane zarządzanie dostępem i zużyciem. Bramy API mogą zapewniać luźne powiązanie między konsumentami modelu a usługą punktu końcowego modelu oraz elastyczność w dostosowywaniu się do zmieniającego się modelu, architektury i metod wywoływania.

W tym poście pokażemy, jak zbudować wewnętrzną warstwę SaaS, aby uzyskać dostęp do modeli podstawowych za pomocą Amazon Bedrock w architekturze wielodostępnej (zespołowej). Koncentrujemy się szczególnie na śledzeniu użycia i kosztów na dzierżawcę, a także na kontroli, takiej jak ograniczanie wykorzystania na dzierżawcę. Opisujemy, w jaki sposób rozwiązanie i plany wykorzystania Amazon Bedrock odpowiadają ogólnym ramom podróży SaaS. Kod rozwiązania i plik Zestaw programistyczny AWS Cloud (AWS CDK) jest dostępny w pliku Repozytorium GitHub.

Wyzwania

Administrator platformy AI musi zapewnić ujednolicony i łatwy dostęp do FM wielu zespołom programistów.

Poniżej przedstawiono niektóre wyzwania związane z zapewnieniem regulowanego dostępu do modeli podstawowych:

- Śledzenie kosztów i wykorzystania – Śledź i audytuj koszty poszczególnych najemców oraz wykorzystanie modeli podstawowych, a także dostarczaj informacje o kosztach obciążeń zwrotnych do określonych miejsc powstawania kosztów

- Kontrola budżetu i wykorzystania – Zarządzaj limitami interfejsu API, budżetem i użytkowaniem w zakresie dozwolonego korzystania z modeli podstawowych z określoną częstotliwością na dzierżawcę

- Kontrola dostępu i zarządzanie modelami – Zdefiniuj kontrolę dostępu dla określonych modeli z listy dozwolonych dla każdego dzierżawcy

- Znormalizowany interfejs API dla wielu dzierżawców – Zapewnij spójny dostęp do modeli fundamentów za pomocą OtwórzAPI standardy

- Scentralizowane zarządzanie API – Zapewnij pojedynczą warstwę do zarządzania kluczami API umożliwiającymi dostęp do modeli

- Wersje modeli i aktualizacje – Obsługa wdrożeń nowych i zaktualizowanych wersji modeli

Omówienie rozwiązania

W tym rozwiązaniu mamy na myśli a wielu najemców podejście. ZA najemca może to dotyczyć pojedynczego użytkownika, konkretnego projektu, zespołu, a nawet całego działu. Kiedy omawiamy to podejście, używamy terminu zespół, bo to jest najczęstsze. Używamy kluczy API, aby ograniczać i monitorować dostęp zespołów do API. Każdemu zespołowi przypisany jest klucz API umożliwiający dostęp do FM. W organizacji mogą być wdrożone różne mechanizmy uwierzytelniania i autoryzacji użytkowników. Dla uproszczenia nie uwzględniamy ich w tym rozwiązaniu. Z tym rozwiązaniem możesz także zintegrować istniejących dostawców tożsamości.

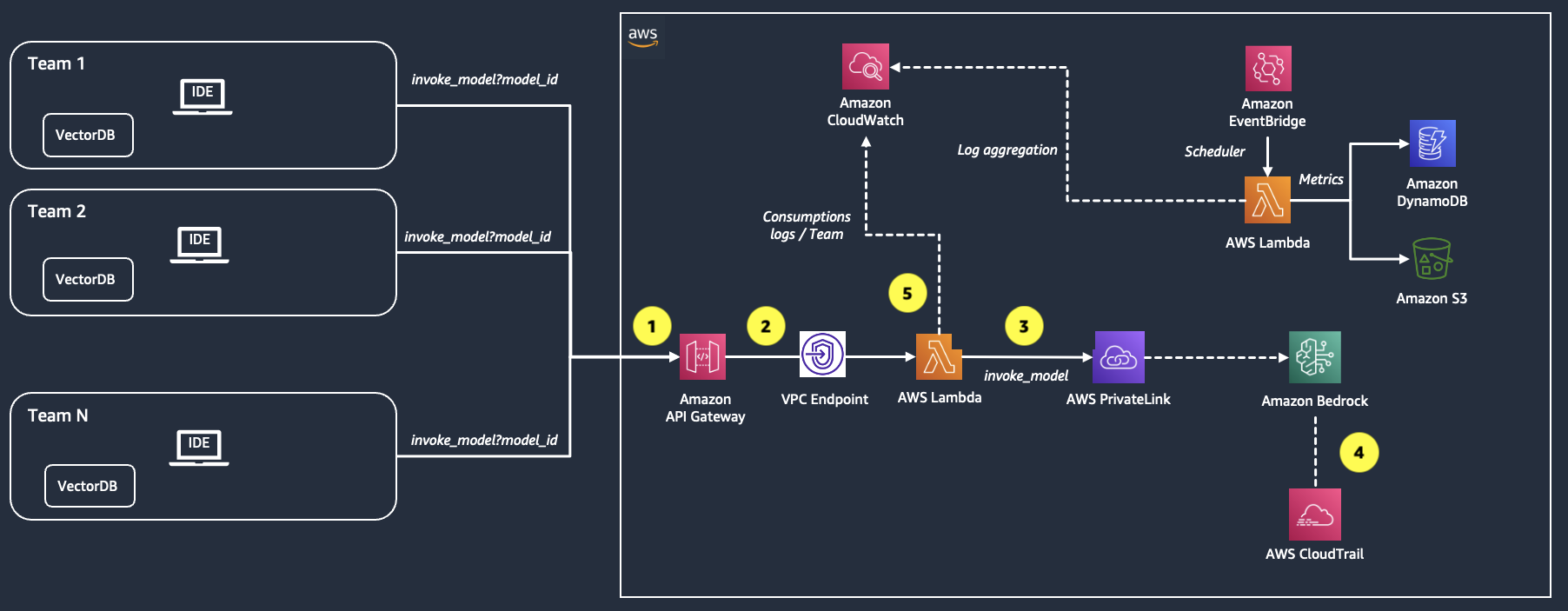

Poniższy diagram podsumowuje architekturę rozwiązania i kluczowe komponenty. Zespoły (najemcy) przypisane do oddzielnych centrów kosztów korzystają z Amazon Bedrock FM za pośrednictwem usługi API. Aby śledzić zużycie i koszt na zespół, rozwiązanie rejestruje dane dla każdego pojedynczego wywołania, w tym wywołany model, liczbę tokenów w przypadku modeli generowania tekstu i wymiary obrazu w przypadku modeli multimodalnych. Ponadto agreguje wywołania według modelu i koszty dla każdego zespołu.

![]()

Możesz wdrożyć rozwiązanie na swoim koncie za pomocą AWS CDK. AWS CDK to platforma programistyczna typu open source służąca do modelowania i udostępniania zasobów aplikacji w chmurze przy użyciu znanych języków programowania. Kod AWS CDK jest dostępny w pliku Repozytorium GitHub.

W kolejnych sekcjach bardziej szczegółowo omawiamy kluczowe elementy rozwiązania.

Przechwytywanie wykorzystania modelu podstawowego na zespół

Procedura rejestrowania wykorzystania FM przez zespół składa się z następujących kroków (ponumerowanych na poprzednim diagramie):

- Aplikacja zespołu wysyła żądanie POST do Brama Amazon API z modelem, który ma zostać wywołany w pliku

model_idparametr zapytania i monit użytkownika w treści żądania. - Brama API kieruje żądanie do AWS Lambda funkcja (

bedrock_invoke_model) odpowiedzialny za rejestrowanie informacji o użytkowaniu zespołu Amazon Cloud Watch i odwoływanie się do modelu Amazon Bedrock. - Amazon Bedrock zapewnia punkt końcowy VPC obsługiwany przez Prywatny link AWS. W tym rozwiązaniu funkcja Lambda wysyła żądanie do Amazon Bedrock za pomocą PrivateLink w celu nawiązania prywatnego połączenia pomiędzy VPC na Twoim koncie a kontem usługi Amazon Bedrock. Aby dowiedzieć się więcej o PrivateLink, zobacz Użyj AWS PrivateLink, aby skonfigurować prywatny dostęp do Amazon Bedrock.

- Po wywołaniu Amazon Bedrock, Amazon CloudTrail generuje Wydarzenie CloudTrail.

- Jeżeli wywołanie Amazon Bedrock zakończy się pomyślnie, funkcja Lambda rejestruje następujące informacje w zależności od typu wywołanego modelu i zwraca wygenerowaną odpowiedź do aplikacji:

- identyfikator_zespołu – Unikalny identyfikator zespołu wysyłającego wniosek.

- żądanie ID – Unikalny identyfikator żądania.

- identyfikator_modelu – Identyfikator modelu, który ma zostać wywołany.

- Tokeny wejściowe – Liczba tokenów wysłanych do modelu w ramach podpowiedzi (dla modeli generujących tekst i osadzających).

- tokeny wyjściowe – Maksymalna liczba tokenów, które ma wygenerować model (dla modeli generujących tekst).

- wysokość – Wysokość żądanego obrazu (dla modeli multimodalnych i modeli osadzania multimodalnego).

- szerokość – Szerokość żądanego obrazu (tylko dla modeli multimodalnych).

- kroki – Wymagane kroki (dla modeli AI związanych ze stabilnością).

Śledzenie kosztów na zespół

Inny przepływ agreguje informacje o użytkowaniu, a następnie codziennie oblicza i zapisuje koszty na żądanie na zespół. Dzięki oddzielnemu przepływowi zapewniamy, że śledzenie kosztów nie ma wpływu na opóźnienia i przepływność przepływu wywoływania modelu. Etapy przepływu pracy są następujące:

- An Most zdarzeń Amazona reguła wyzwala funkcję Lambda (

bedrock_cost_tracking) codzienny. - Funkcja Lambda pobiera informacje o użyciu z CloudWatch z poprzedniego dnia, oblicza powiązane koszty i przechowuje dane zagregowane przez

team_idimodel_idin Usługa Amazon Simple Storage (Amazon S3) w formacie CSV.

Aby wysyłać zapytania i wizualizować dane przechowywane w Amazon S3, masz różne możliwości, m.in S3 Wybierz, Amazon Athena i Amazon QuickSight.

Kontrolowanie użycia na zespół

Plan użytkowania określa, kto może uzyskać dostęp do jednego lub większej liczby wdrożonych interfejsów API i opcjonalnie ustawia docelową liczbę żądań, aby rozpocząć ograniczanie żądań. Plan wykorzystuje klucze API do identyfikowania klientów API, którzy mogą uzyskać dostęp do powiązanego interfejsu API dla każdego klucza. Możesz skorzystać z API Gateway plany użytkowania do ograniczania żądań przekraczających wstępnie zdefiniowane progi. Możesz także użyć Klucze API oraz limity kwot, które umożliwiają ustawienie maksymalnej liczby żądań na klucz API, które każdy zespół może wystawić w określonym przedziale czasu. To dodatkowo Limity usług Amazon Bedrock które są przypisywane wyłącznie na poziomie konta.

Wymagania wstępne

Przed wdrożeniem rozwiązania upewnij się, że masz następujące elementy:

Wdróż stos AWS CDK

Postępuj zgodnie z instrukcjami w README plik repozytorium GitHub, aby skonfigurować i wdrożyć stos AWS CDK.

Stos wdraża następujące zasoby:

- Środowisko sieci prywatnej (VPC, podsieci prywatne, grupa zabezpieczeń)

- Rola uprawnień do kontrolowania dostępu do modelu

- Warstwy Lambda dla niezbędnych modułów Pythona

- Funkcja Lambdy

invoke_model - Funkcja Lambdy

list_foundation_models - Funkcja Lambdy

cost_tracking - Reszta API (bramka API)

- Plan użytkowania bramy API

- Klucz API powiązany z planem użytkowania

Na pokładzie nowego zespołu

Aby zapewnić dostęp nowym zespołom, możesz udostępnić ten sam klucz API różnym zespołom i śledzić zużycie modelu, udostępniając inny team_id do wywołania API lub utwórz dedykowane klucze API używane do uzyskiwania dostępu do zasobów Amazon Bedrock, postępując zgodnie z instrukcjami podanymi w README.

Stos wdraża następujące zasoby:

- Plan użytkowania API Gateway powiązany z wcześniej utworzonym API REST

- Klucz API powiązany z planem użytkowania dla nowego zespołu, z zarezerwowanymi konfiguracjami ograniczania przepustowości i serii dla interfejsu API

Aby uzyskać więcej informacji na temat konfiguracji ograniczania przepustowości i serii API Gateway, zobacz Ogranicz żądania API, aby uzyskać lepszą przepustowość.

Po wdrożeniu stosu widać, że nowy klucz API dla team-2 jest również tworzony.

![]()

Skonfiguruj kontrolę dostępu do modelu

Administrator platformy może zezwolić na dostęp do określonych modeli fundamentów, edytując politykę IAM powiązaną z funkcją Lambda invoke_model,

Uprawnienia IAM są zdefiniowane w pliku setup/stack_constructs/iam.py. Zobacz następujący kod:

Wywołaj usługę

Po wdrożeniu rozwiązania możesz wywołać usługę bezpośrednio ze swojego kodu. Następujące

to przykład w Pythonie wykorzystania invoke_model API do generowania tekstu poprzez żądanie POST:

Wynik: Amazon Bedrock to wewnętrzna platforma technologiczna opracowana przez firmę Amazon w celu uruchamiania i obsługi wielu jej usług i produktów. Kilka kluczowych rzeczy na temat Bedrock…

Poniżej znajduje się kolejny przykład w Pythonie wykorzystania pliku invoke_model API do generowania osadzania poprzez żądanie POST:

model_id = "amazon.titan-embed-text-v1" #the model id for the Amazon Titan Embeddings Text model prompt = "What is Amazon Bedrock?" response = requests.post( f"{api_url}/invoke_model?model_id={model_id}", json={"inputs": prompt, "parameters": model_kwargs}, headers={ "x-api-key": api_key, #key for querying the API "team_id": team_id #unique tenant identifier, "embeddings": "true" #boolean value for the embeddings model }

) text = response.json()[0]["embedding"]

Wyjście: 0.91796875, 0.45117188, 0.52734375, -0.18652344, 0.06982422, 0.65234375, -0.13085938, 0.056884766, 0.092285156, 0.06982422, 1.03125, 0.8515625, 0.16308594, 0.079589844, -0.033935547, 0.796875, -0.15429688, -0.29882812, -0.25585938, 0.45703125, 0.044921875 0.34570312, XNUMX…

Odmowa dostępu do modeli podstawowych

Poniżej znajduje się przykład w Pythonie wykorzystania pliku invoke_model API do generowania tekstu poprzez żądanie POST z odpowiedzią odmowy dostępu:

„Traceback (ostatnie wywołanie): n File ”/var/task/index.py”, linia 213, w odpowiedzi lambda_handlern = _invoke_text(bedrock_client, model_id, body, model_kwargs)n File ”/var/task/index.py ”, linia 146, w _invoke_textn raise en File ”/var/task/index.py”, linia 131, w _invoke_textn odpowiedź = bedrock_client.invoke_model(n File ”/opt/python/botocore/client.py”, linia 535, w _api_calln return self._make_api_call(nazwa_operacji, kwargs)n Plik ”/opt/python/botocore/client.py”, linia 980, w _make_api_calln podnieś error_class(parsed_response, nazwa_operacji)nbotocore.errorfactory.AccessDeniedException: Wystąpił błąd (AccessDeniedException) podczas wywoływania operacji InvokeModel: Twoje konto nie jest autoryzowane do wywoływania tej operacji API.n”

Przykład oszacowania kosztów

W przypadku wywoływania modeli Amazon Bedrock z cenami na żądanie całkowity koszt jest obliczany jako suma kosztów wejściowych i wyjściowych. Koszty wejściowe opierają się na liczbie tokenów wejściowych wysłanych do modelu, a koszty wyjściowe na podstawie wygenerowanych tokenów. Ceny podane są za 1,000 żetonów wejściowych i 1,000 żetonów wyjściowych. Więcej szczegółów i ceny konkretnych modeli można znaleźć w artykule Ceny Amazon Bedrock.

Spójrzmy na przykład, w którym dwa zespoły, zespół 1 i zespół 2, uzyskują dostęp do usługi Amazon Bedrock za pośrednictwem rozwiązania opisanego w tym poście. Dane dotyczące użytkowania i kosztów zapisane w Amazon S3 w ciągu jednego dnia pokazano w poniższej tabeli.

Kolumny input_tokens i output_tokens przechowuj łączną liczbę tokenów wejściowych i wyjściowych dla wywołań modeli odpowiednio dla każdego modelu i zespołu dla danego dnia.

Kolumny input_cost i output_cost przechowuj odpowiednie koszty dla każdego modelu i zespołu. Oblicza się je za pomocą następujących wzorów:

input_cost = input_token_count * model_pricing["input_cost"] / 1000output_cost = output_token_count * model_pricing["output_cost"] / 1000

| identyfikator_zespołu | identyfikator_modelu | tokeny_wejściowe | tokeny_wyjściowe | modły | koszt_wejściowy | koszt_wyjściowy |

| Team1 | amazon.titan-tg1-large | 24000 | 2473 | 1000 | 0.0072 | 0.00099 |

| Team1 | anthropic.claude-v2 | 2448 | 4800 | 24 | 0.02698 | 0.15686 |

| Team2 | amazon.titan-tg1-large | 35000 | 52500 | 350 | 0.0105 | 0.021 |

| Team2 | ai21.j2-grande-instruct | 4590 | 9000 | 45 | 0.05738 | 0.1125 |

| Team2 | anthropic.claude-v2 | 1080 | 4400 | 20 | 0.0119 | 0.14379 |

Kompleksowy widok funkcjonalnego, bezserwerowego środowiska SaaS z wieloma dzierżawcami

Rozumiemy, jak mogłoby wyglądać kompleksowe, funkcjonalne i bezserwerowe środowisko SaaS z wieloma dzierżawcami. Poniżej znajduje się diagram architektury referencyjnej.

![]()

Ten diagram architektury jest pomniejszoną wersją poprzedniego diagramu architektury wyjaśnionego wcześniej w poście, gdzie poprzedni diagram architektury wyjaśnia szczegóły jednego z wymienionych mikrousług (usługa modelu podstawowego). Ten diagram wyjaśnia, że oprócz podstawowej usługi modelu, musisz mieć także inne komponenty na platformie SaaS z wieloma dzierżawcami, aby wdrożyć funkcjonalną i skalowalną platformę.

Przyjrzyjmy się szczegółom architektury.

Wnioski najemców

Aplikacje dzierżawy to aplikacje frontonu, które wchodzą w interakcję ze środowiskiem. Tutaj pokazujemy wielu dzierżawców uzyskujących dostęp z różnych środowisk lokalnych lub AWS. Aplikacje front-end można rozszerzyć o stronę rejestracyjną dla nowych najemców, aby mogli się zarejestrować, oraz konsolę administracyjną dla administratorów warstwy usług SaaS. Jeśli aplikacje dzierżawy wymagają zaimplementowania niestandardowej logiki wymagającej interakcji ze środowiskiem SaaS, mogą zaimplementować specyfikacje mikrousługi adaptera aplikacji. Przykładowymi scenariuszami może być dodanie niestandardowej logiki autoryzacji przy jednoczesnym przestrzeganiu specyfikacji autoryzacji środowiska SaaS.

Usługi wspólne

Następujące usługi są wspólne:

- Usługi zarządzania najemcami i użytkownikami – Służby te odpowiadają za rejestrację i zarządzanie najemcami. Zapewniają przekrojową funkcjonalność, która jest oddzielona od usług aplikacji i współdzielona przez wszystkich dzierżawców.

- Usługa modelowa fundamentów –Schemat architektury rozwiązania wyjaśniony na początku tego postu przedstawia tę mikrousługę, w której w ramach tej mikrousługi odbywa się interakcja między API Gateway a funkcjami Lambda. Wszyscy najemcy korzystają z tej mikrousługi, aby wywoływać podstawowe modele z Anthropic, AI21, Cohere, Stability, Meta i Amazon, a także modele dopracowane. Przechwytuje również informacje potrzebne do śledzenia użytkowania w dziennikach CloudWatch.

- Usługa śledzenia kosztów –Ta usługa śledzi koszty i wykorzystanie dla każdego najemcy. Ta mikrousługa działa zgodnie z harmonogramem, aby odpytywać dzienniki CloudWatch i wysyłać do magazynu danych zagregowane śledzenie użycia i przewidywane koszty. Usługę śledzenia kosztów można rozszerzyć o budowanie kolejnych raportów i wizualizacji.

Usługa adaptera aplikacji

Usługa ta przedstawia zestaw specyfikacji i interfejsów API, które najemca może wdrożyć w celu zintegrowania swojej niestandardowej logiki ze środowiskiem SaaS. W zależności od wymaganego stopnia integracji niestandardowej ten komponent może być opcjonalny dla dzierżawców.

Magazyn danych dla wielu dzierżawców

Usługi udostępnione przechowują swoje dane w magazynie danych, który może być jednym udostępnionym Amazon DynamoDB tabela z kluczem partycjonowania dzierżawy, który kojarzy elementy DynamoDB z indywidualnymi dzierżawcami. Wspólna usługa śledzenia kosztów wysyła zagregowane dane dotyczące użytkowania i śledzenia kosztów do Amazon S3. W zależności od przypadku użycia może istnieć również magazyn danych specyficzny dla aplikacji.

Środowisko SaaS z wieloma dzierżawcami może zawierać znacznie więcej komponentów. Aby uzyskać więcej informacji, zobacz Budowanie rozwiązania SaaS dla wielu najemców przy użyciu usług bezserwerowych AWS.

Obsługa wielu modeli wdrażania

Struktury SaaS zazwyczaj obejmują dwa modele wdrażania: pulę i silos. W przypadku modelu puli wszyscy najemcy uzyskują dostęp do FM ze wspólnego środowiska ze wspólną infrastrukturą pamięci masowej i obliczeniową. W modelu silosowym każdy najemca ma swój własny zestaw dedykowanych zasobów. O modelach izolacji możesz przeczytać w Raport dotyczący strategii izolacji najemców SaaS.

Proponowane rozwiązanie można zastosować w obu modelach wdrożeń SaaS. W podejściu pulowym scentralizowane środowisko AWS obsługuje zasoby API, pamięć masową i zasoby obliczeniowe. W trybie silosowym każdy zespół uzyskuje dostęp do interfejsów API, pamięci masowej i zasobów obliczeniowych w dedykowanym środowisku AWS.

Rozwiązanie jest również zgodne z dostępnymi planami zużycia udostępnianymi przez Amazon Bedrock. AWS umożliwia wybór jednego z dwóch planów zużycia:

- Na żądanie – Ten tryb umożliwia korzystanie z modeli podstawowych na zasadzie płatności zgodnie z rzeczywistym użyciem, bez konieczności podejmowania jakichkolwiek zobowiązań terminowych

- Zapewniona przepustowość – Ten tryb umożliwia zapewnienie przepustowości wystarczającej do spełnienia wymagań aplikacji w zamian za zobowiązanie czasowe

Aby uzyskać więcej informacji na temat tych opcji, zobacz Ceny Amazon Bedrock.

Bezserwerowe rozwiązanie referencyjne SaaS opisane w tym poście może zastosować plany wykorzystania Amazon Bedrock, aby zapewnić użytkownikom końcowym podstawowe i premium opcje warstwowania. Podstawowy może obejmować zużycie przepustowości na żądanie lub zapewnionej przepustowości Amazon Bedrock i może obejmować określone limity użytkowania i budżetu. Limity dzierżawy można włączyć, ograniczając żądania na podstawie żądań, rozmiarów tokenów lub alokacji budżetu. Najemcy warstwy Premium mogą mieć własne, dedykowane zasoby przy zapewnionym wykorzystaniu przepustowości usługi Amazon Bedrock. Ci najemcy są zazwyczaj powiązani z obciążeniami produkcyjnymi, które wymagają dużej przepustowości i dostępu do produktów Amazon Bedrock FM o niskim opóźnieniu.

Wnioski

W tym poście omówiliśmy, jak zbudować wewnętrzną platformę SaaS, aby uzyskać dostęp do podstawowych modeli z Amazon Bedrock w konfiguracji z wieloma dzierżawcami, ze szczególnym uwzględnieniem śledzenia kosztów i użytkowania oraz ograniczania limitów dla każdego dzierżawcy. Dodatkowe tematy do zbadania obejmują integrację istniejących rozwiązań w zakresie uwierzytelniania i autoryzacji w organizacji, ulepszanie warstwy API o gniazda internetowe do dwukierunkowych interakcji klient-serwer, dodawanie filtrowania treści i innych zabezpieczeń zarządzania, projektowanie wielu poziomów wdrożeń, integrowanie innych mikrousług w SaaS architektura i wiele innych.

Cały kod tego rozwiązania jest dostępny w pliku Repozytorium GitHub.

Aby uzyskać więcej informacji na temat frameworków opartych na SaaS, zobacz Struktura SaaS Journey: tworzenie nowego rozwiązania SaaS na platformie AWS.

O autorach

![]() Hasana Poonawala jest starszym architektem rozwiązań specjalistycznych AI/ML w AWS, współpracującym z klientami z branży opieki zdrowotnej i nauk przyrodniczych. Hasan pomaga projektować, wdrażać i skalować aplikacje generatywnej sztucznej inteligencji i uczenia maszynowego w AWS. Ma ponad 15 lat wspólnego doświadczenia zawodowego w uczeniu maszynowym, tworzeniu oprogramowania i analizie danych w chmurze. W wolnym czasie Hasan uwielbia odkrywać przyrodę i spędzać czas z przyjaciółmi i rodziną.

Hasana Poonawala jest starszym architektem rozwiązań specjalistycznych AI/ML w AWS, współpracującym z klientami z branży opieki zdrowotnej i nauk przyrodniczych. Hasan pomaga projektować, wdrażać i skalować aplikacje generatywnej sztucznej inteligencji i uczenia maszynowego w AWS. Ma ponad 15 lat wspólnego doświadczenia zawodowego w uczeniu maszynowym, tworzeniu oprogramowania i analizie danych w chmurze. W wolnym czasie Hasan uwielbia odkrywać przyrodę i spędzać czas z przyjaciółmi i rodziną.

![]() Anastazja Tzeveleka jest starszym architektem rozwiązań specjalistycznych AI/ML w AWS. W ramach swojej pracy pomaga klientom w całym regionie EMEA w budowaniu podstawowych modeli i tworzeniu skalowalnych rozwiązań w zakresie sztucznej inteligencji i uczenia maszynowego przy użyciu usług AWS.

Anastazja Tzeveleka jest starszym architektem rozwiązań specjalistycznych AI/ML w AWS. W ramach swojej pracy pomaga klientom w całym regionie EMEA w budowaniu podstawowych modeli i tworzeniu skalowalnych rozwiązań w zakresie sztucznej inteligencji i uczenia maszynowego przy użyciu usług AWS.

![]() Brużadnego Pistone'a jest architektem rozwiązań generatywnych AI i ML dla AWS z siedzibą w Mediolanie. Współpracuje z dużymi klientami, pomagając im dogłębnie zrozumieć ich potrzeby techniczne oraz projektować rozwiązania AI i Machine Learning, które najlepiej wykorzystują chmurę AWS i stos Amazon Machine Learning. Jego specjalistyczna wiedza obejmuje kompleksowe uczenie maszynowe, industrializację uczenia maszynowego i generatywną sztuczną inteligencję. Lubi spędzać czas z przyjaciółmi i odkrywać nowe miejsca, a także podróżować do nowych miejsc.

Brużadnego Pistone'a jest architektem rozwiązań generatywnych AI i ML dla AWS z siedzibą w Mediolanie. Współpracuje z dużymi klientami, pomagając im dogłębnie zrozumieć ich potrzeby techniczne oraz projektować rozwiązania AI i Machine Learning, które najlepiej wykorzystują chmurę AWS i stos Amazon Machine Learning. Jego specjalistyczna wiedza obejmuje kompleksowe uczenie maszynowe, industrializację uczenia maszynowego i generatywną sztuczną inteligencję. Lubi spędzać czas z przyjaciółmi i odkrywać nowe miejsca, a także podróżować do nowych miejsc.

![]() Vikesha Pandey’a jest architektem rozwiązań generatywnej AI/ML, specjalizującym się w usługach finansowych, gdzie pomaga klientom finansowym budować i skalować platformy i rozwiązania generatywnej AI/ML, które można skalować do setek, a nawet tysięcy użytkowników. W wolnym czasie Vikesh lubi pisać na różnych forach blogowych i budować z dzieckiem klocki Lego.

Vikesha Pandey’a jest architektem rozwiązań generatywnej AI/ML, specjalizującym się w usługach finansowych, gdzie pomaga klientom finansowym budować i skalować platformy i rozwiązania generatywnej AI/ML, które można skalować do setek, a nawet tysięcy użytkowników. W wolnym czasie Vikesh lubi pisać na różnych forach blogowych i budować z dzieckiem klocki Lego.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/build-an-internal-saas-service-with-cost-and-usage-tracking-for-foundation-models-on-amazon-bedrock/

- :ma

- :Jest

- :nie

- :Gdzie

- $W GÓRĘ

- 000

- 1

- 120

- 15 roku

- 15%

- 160

- 26%

- 500

- 7

- a

- O nas

- dostęp

- Dostęp

- Konto

- w poprzek

- przystosować

- dodanie

- dodatek

- Dodatkowy

- do tego

- Admin

- Administratorzy

- przyjęty

- agregaty

- AI

- Modele AI

- Platforma AI

- AI / ML

- Wszystkie kategorie

- przydział

- dopuszczać

- pozwala

- wzdłuż

- już

- również

- Amazonka

- Uczenie maszynowe Amazon

- Amazon QuickSight

- Amazon Web Services

- an

- i

- Inne

- Antropiczny

- każdy

- osobno

- api

- Dostęp do API

- KLUCZE API

- Pszczoła

- Zastosowanie

- aplikacje

- Aplikuj

- podejście

- zatwierdzony

- architektura

- architektur

- SĄ

- AS

- przydzielony

- powiązany

- stowarzyszonych

- At

- Audyt

- Uwierzytelnianie

- autoryzacja

- upoważniony

- dostępny

- AWS

- na podstawie

- podstawowy

- podstawa

- BE

- bo

- Początek

- BEST

- Ulepsz Swój

- pomiędzy

- Blog

- ciało

- obie

- szeroki

- budżet

- budować

- Budowanie

- biznes

- by

- obliczony

- oblicza

- wezwanie

- powołanie

- CAN

- możliwości

- zdobyć

- przechwytuje

- walizka

- Centrum

- Centra

- scentralizowane

- wyzwania

- wymiana pieniędzy

- wybór

- klient

- klientów

- Chmura

- kod

- kolumny

- połączony

- wspólny

- Firmy

- składnik

- składniki

- obliczać

- systemu

- połączenie

- zgodny

- składa się

- Konsola

- konsumować

- Konsumenci

- czasochłonne

- konsumpcja

- zawartość

- kontrola

- kontrolowania

- kontroli

- Koszty:

- Koszty:

- mógłby

- Stwórz

- stworzony

- zwyczaj

- Klientów

- codziennie

- dane

- nauka danych

- przechowywanie danych

- dzień

- dedykowane

- głęboko

- określić

- zdefiniowane

- odmówiono

- Departament

- W zależności

- rozwijać

- wdrażane

- Wdrożenie

- wdraża się

- opisać

- opisane

- Wnętrze

- projektowanie

- Cele podróży

- detal

- detale

- rozwinięty

- oprogramowania

- zespoły deweloperskie

- schemat

- różne

- Wymiary

- bezpośrednio

- dyskutować

- omówione

- do

- Nie

- nie

- każdy

- Wcześniej

- łatwo

- efekt

- bądź

- osadzanie

- EMEA

- umożliwiać

- włączony

- zakończenia

- koniec końców

- Punkt końcowy

- wzmocnienie

- zapewnić

- Cały

- Środowisko

- środowiska

- błąd

- zapewniają

- Parzyste

- wydarzenie

- przykład

- przekraczać

- wymiana

- Przede wszystkim system został opracowany

- doświadczenie

- ekspertyza

- wyjaśnione

- Objaśnia

- odkryj

- Exploring

- ekspresowy

- dużym

- znajomy

- członków Twojej rodziny

- filet

- filtracja

- budżetowy

- usługi finansowe

- pasuje

- Elastyczność

- pływ

- Skupiać

- następujący

- następujący sposób

- W razie zamówieenia projektu

- format

- Forum

- Fundacja

- podstawowy

- Fundamenty

- Framework

- Ramy

- Częstotliwość

- przyjaciele

- od

- z przodu

- Zaczepy

- w pełni

- funkcjonować

- funkcjonalny

- Funkcjonalność

- Funkcje

- dalej

- Bramka

- bramy

- Ogólne

- wygenerowane

- generuje

- generacja

- generatywny

- generatywna sztuczna inteligencja

- dostaje

- GitHub

- dany

- Go

- zarządzanie

- regulowane

- Zarządzanie

- uchwyt

- Wydarzenie

- Have

- mający

- he

- opieki zdrowotnej

- wysokość

- pomoc

- pomaga

- jej

- tutaj

- Wysoki

- wydajny

- jego

- gospodarze

- W jaki sposób

- How To

- HTML

- http

- HTTPS

- Setki

- ID

- identyfikator

- zidentyfikować

- tożsamość

- if

- obraz

- Rezultat

- wdrożenia

- realizowane

- in

- zawierać

- Włącznie z

- indywidualny

- wywnioskowano

- Informacja

- Infrastruktura

- wprowadzać innowacje

- wkład

- Wejścia

- instrukcje

- integrować

- Integracja

- integracja

- interakcji

- wzajemne oddziaływanie

- Interakcje

- Interfejs

- wewnętrzny

- najnowszych

- przywołany

- izolacja

- problem

- wydawanie

- IT

- szt

- JEGO

- podróż

- jpg

- Klawisz

- Klawisze

- Dziecko

- Labs

- Języki

- duży

- Nazwisko

- Utajenie

- warstwa

- nioski

- prowadzący

- UCZYĆ SIĘ

- nauka

- poziom

- życie

- Life Sciences

- lubić

- lubi

- Limity

- Linia

- linie

- Katalogowany

- miejscowy

- zalogowaniu

- logika

- Popatrz

- wygląda jak

- Partia

- kocha

- niski

- maszyna

- uczenie maszynowe

- Utrzymywanie

- robić

- zarządzanie

- zarządzane

- i konserwacjami

- zarządzający

- wiele

- mapa

- maksymalny

- Może..

- Mechanizmy

- Poznaj nasz

- wzmiankowany

- Meta

- metody

- mikrousługa

- mikroserwisy

- może

- MILAN

- ML

- Moda

- model

- modele

- monitor

- jeszcze

- większość

- dużo

- wielokrotność

- Natura

- niezbędny

- Potrzebować

- potrzebne

- wymagania

- sieci

- Nowości

- numer

- numerowane

- miejsce

- of

- Oferty

- on

- Na żądanie

- ONE

- tylko

- koncepcja

- open source

- działać

- działanie

- Opcje

- or

- zamówienie

- organizacja

- Inne

- zarys

- wydajność

- Wyjścia

- koniec

- własny

- strona

- parametr

- parametry

- część

- dla

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- uprawnienia

- Miejsca

- krok po kroku

- plany

- Platforma

- Platformy

- plato

- Analiza danych Platona

- PlatoDane

- polityka

- basen

- Post

- potencjał

- powered

- poprzedzający

- predefiniowane

- Premia

- prezenty

- poprzedni

- poprzednio

- Cennik

- wycena

- prywatność

- prywatny

- Produkcja

- Produkty

- Programowanie

- języki programowania

- projekt

- zaproponowane

- zapewniać

- pod warunkiem,

- dostawców

- zapewnia

- że

- zaopatrzenie

- Python

- pytanie

- szybko

- podnieść

- zasięg

- Kurs

- Czytaj

- niedawny

- odnosić się

- odniesienie

- zarejestrować

- rejestracji

- Rejestracja

- Regulować

- Raporty

- składnica

- reprezentuje

- zażądać

- wywołań

- wymagać

- wymagania

- zarezerwowany

- Zasoby

- co do

- osób

- odpowiednio

- odpowiedź

- odpowiedzialny

- REST

- ograniczać

- powrót

- powraca

- Rola

- trasy

- Zasada

- run

- działa

- SaaS

- taki sam

- zapisywane

- skalowalny

- Skala

- waga

- scenariusze

- rozkład

- nauka

- NAUKI

- zakres

- działy

- bezpiecznie

- bezpieczeństwo

- widzieć

- poszukuje

- SAMEGO SIEBIE

- wysyła

- senior

- wysłany

- oddzielny

- serwer

- Bezserwerowe

- usługa

- Usługi

- zestaw

- Zestawy

- ustawienie

- Share

- shared

- ona

- pokazać

- pokazane

- Prosty

- prostota

- pojedynczy

- rozmiary

- Tworzenie

- Oprogramowanie jako usługa

- rozwoju oprogramowania

- rozwiązanie

- Rozwiązania

- kilka

- Źródło

- specjalizujący się

- specjalista

- specyficzny

- swoiście

- Specyfikacje

- określony

- prędkość

- wydać

- Spędzanie

- Stabilność

- stos

- początek

- Cel

- przechowywanie

- sklep

- przechowywany

- sklep

- strategie

- podsieci

- udany

- taki

- wystarczający

- pewnie

- stół

- cel

- zespół

- Zespoły

- Techniczny

- Technologia

- szablon

- najemca

- semestr

- XNUMX

- że

- Połączenia

- Informacje

- ich

- Im

- sami

- następnie

- Tam.

- Te

- one

- rzeczy

- to

- tysiące

- Przez

- wydajność

- poziom

- czas

- tytan

- do

- żeton

- Żetony

- tematy

- Kwota produktów:

- śledzić

- Śledzenie

- utworów

- prawdziwy

- drugiej

- rodzaj

- zazwyczaj

- zrozumieć

- wyjątkowy

- odblokować

- zaktualizowane

- Stosowanie

- posługiwać się

- przypadek użycia

- używany

- Użytkownik

- Użytkownicy

- zastosowania

- za pomocą

- v1

- wartość

- różnorodny

- wersja

- Wersje

- przez

- Zobacz i wysłuchaj

- widoczność

- wyobrażanie sobie

- wyobrażać sobie

- we

- sieć

- usługi internetowe

- Gniazda internetowe

- DOBRZE

- Co

- Co to jest

- jeśli chodzi o komunikację i motywację

- który

- Podczas

- KIM

- szerokość

- w

- w ciągu

- bez

- Praca

- workflow

- pracujący

- działa

- by

- napisać

- lat

- You

- Twój

- zefirnet