W grudniu 2020, AWS ogłosiło powszechną dostępność of Amazon SageMaker JumpStart, zdolność Amazon Sage Maker który pomaga szybko i łatwo rozpocząć pracę z uczeniem maszynowym (ML). JumpStart zapewnia dostrajanie jednym kliknięciem i wdrażanie szerokiej gamy wstępnie przeszkolonych modeli w popularnych zadaniach ML, a także wybór kompleksowych rozwiązań, które rozwiązują typowe problemy biznesowe. Te funkcje eliminują konieczność podnoszenia ciężarów na każdym etapie procesu ML, ułatwiając opracowywanie modeli wysokiej jakości i skracając czas wdrażania.

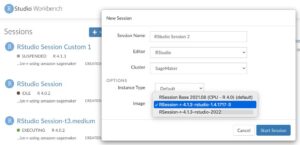

Wcześniej cała zawartość JumpStart była dostępna tylko przez Studio Amazon SageMaker, który zapewnia przyjazny dla użytkownika interfejs graficzny do interakcji z funkcją. Dziś z radością ogłaszamy wprowadzenie łatwego w użyciu Interfejsy API JumpStart jako rozszerzenie SageMaker Python SDK. Te interfejsy API umożliwiają programistyczne wdrażanie i dostrajanie szerokiej gamy wstępnie wytrenowanych modeli obsługiwanych przez JumpStart we własnych zestawach danych. To uruchomienie odblokowuje wykorzystanie funkcji JumpStart w przepływach pracy kodu, potokach MLOps i wszędzie tam, gdzie komunikujesz się z SageMaker za pośrednictwem SDK.

W tym poście przedstawiamy aktualizację bieżącego stanu funkcji JumpStart i poprowadzimy Cię przez proces użytkowania interfejsu API JumpStart z przykładowym przypadkiem użycia.

Przegląd programu JumpStart

JumpStart to wieloaspektowy produkt, który oferuje różne możliwości, które ułatwiają szybkie rozpoczęcie pracy z ML w programie SageMaker. W chwili pisania tego tekstu JumpStart umożliwia wykonanie następujących czynności:

- Wdrażaj wstępnie wytrenowane modele do typowych zadań ML – JumpStart umożliwia rozwiązywanie typowych zadań ML bez wysiłku programistycznego, zapewniając łatwe wdrażanie modeli wstępnie wytrenowanych na publicznie dostępnych dużych zestawach danych. Społeczność badawcza ML włożyła wiele wysiłku w publiczne udostępnienie do użytku większości niedawno opracowanych modeli. JumpStart zawiera kolekcję ponad 300 modeli, obejmującą 15 najpopularniejszych zadań ML, takich jak wykrywanie obiektów, klasyfikacja tekstu i generowanie tekstu, dzięki czemu korzystanie z nich jest łatwe dla początkujących. Modele te pochodzą z popularnych koncentratorów modeli, takich jak TensorFlow, PyTorch, Hugging Face i MXNet Hub.

- Dostosuj wstępnie wytrenowane modele – JumpStart umożliwia precyzyjne dostrojenie wstępnie wytrenowanych modeli bez konieczności pisania własnego algorytmu treningowego. W ML umiejętność transferu wiedzy wyuczonej w jednej domenie do innej nazywa się przenieś naukę. Możesz użyć uczenia transferu do tworzenia dokładnych modeli na mniejszych zestawach danych, przy znacznie niższych kosztach uczenia niż te związane z uczeniem oryginalnego modelu od podstaw. JumpStart zawiera również popularne algorytmy szkoleniowe oparte na LightGBM, CatBoost, XGBoost i Scikit-learn, które można trenować od podstaw pod kątem regresji i klasyfikacji danych tabelarycznych.

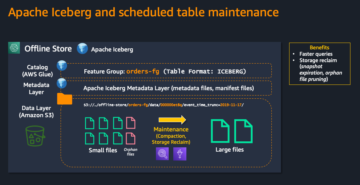

- Korzystaj z gotowych rozwiązań – JumpStart zapewnia zestaw 17 gotowych rozwiązań do typowych przypadków użycia ML, takich jak prognozowanie popytu oraz aplikacje przemysłowe i finansowe, które można wdrożyć za pomocą kilku kliknięć. Rozwiązania to kompleksowe aplikacje ML, które łączą różne usługi AWS w celu rozwiązania określonego biznesowego przypadku użycia. Oni używają Tworzenie chmury AWS szablony i architektury referencyjne do szybkiego wdrażania, co oznacza, że można je w pełni dostosować.

- Użyj przykładów z notatników dla algorytmów SageMaker – SageMaker zapewnia pakiet wbudowane algorytmy aby pomóc naukowcom danych i praktykom ML w szybkim rozpoczęciu szkolenia i wdrażania modeli ML. JumpStart udostępnia przykładowe notesy, których można użyć do szybkiego wykorzystania tych algorytmów.

- Skorzystaj z filmów szkoleniowych i blogów – JumpStart udostępnia również liczne posty na blogu i filmy, które uczą, jak korzystać z różnych funkcji w SageMaker.

JumpStart akceptuje niestandardowe ustawienia VPC i klucze szyfrowania KMS, dzięki czemu można bezpiecznie korzystać z dostępnych modeli i rozwiązań w środowisku przedsiębiorstwa. Możesz przekazać swoje ustawienia bezpieczeństwa do JumpStart w SageMaker Studio lub za pomocą SageMaker Python SDK.

Zadania ML obsługiwane przez JumpStart i przykładowe notatniki w interfejsie API

JumpStart obsługuje obecnie 15 najpopularniejszych zadań ML; 13 z nich to zadania oparte na wizji i NLP, z których 8 obsługuje dostrajanie bez kodu. Obsługuje również cztery popularne algorytmy do modelowania danych tabelarycznych. Zadania i łącza do ich przykładowych notesów podsumowano w poniższej tabeli.

W zależności od zadania przykładowe notesy połączone w powyższej tabeli mogą prowadzić użytkownika po wszystkich lub podzbiorze następujących procesów:

- Wybierz wstępnie przeszkolony model obsługiwany przez JumpStart do konkretnego zadania.

- Hostuj wstępnie wytrenowany model, uzyskuj z niego prognozy w czasie rzeczywistym i odpowiednio wyświetlaj wyniki.

- Dostosuj wstępnie wytrenowany model za pomocą własnego wyboru hiperparametrów i zastosuj go do wnioskowania.

Dostosuj i wdróż model wykrywania obiektów za pomocą interfejsów API JumpStart

W poniższych sekcjach zapewniamy przewodnik krok po kroku, jak używać nowych interfejsów API JumpStart w reprezentatywnym zadaniu wykrywania obiektów. Pokazujemy, jak używać wstępnie wytrenowanego modelu wykrywania obiektów do identyfikowania obiektów z predefiniowanego zestawu klas na obrazie z ramkami ograniczającymi. Na koniec pokazujemy, jak dostroić wstępnie wytrenowany model we własnym zbiorze danych, aby wykrywać obiekty na obrazach, które są specyficzne dla Twoich potrzeb biznesowych, po prostu wprowadzając własne dane. Zapewniamy dołączony notatnik do tego przewodnika.

Przechodzimy przez następujące etapy wysokiego poziomu:

- Uruchom wnioskowanie na wstępnie wytrenowanym modelu.

- Pobierz artefakty JumpStart i wdróż punkt końcowy.

- Przeprowadź zapytanie do punktu końcowego, przeanalizuj odpowiedź i wyświetl prognozy modelu.

- Dostosuj wstępnie wytrenowany model we własnym zestawie danych.

- Odzyskaj artefakty szkoleniowe.

- Uruchom szkolenie.

Uruchom wnioskowanie na wstępnie wytrenowanym modelu

W tej sekcji wybieramy odpowiedni wstępnie wytrenowany model w JumpStart, wdrażamy ten model w punkcie końcowym programu SageMaker i pokazujemy, jak uruchomić wnioskowanie na wdrożonym punkcie końcowym. Wszystkie kroki są dostępne w towarzyszący notatnik Jupyter.

Odzyskaj artefakty JumpStart i wdróż punkt końcowy

SageMaker to platforma oparta na kontenerach Docker. JumpStart korzysta z dostępnej platformy specyficznej Kontenery do głębokiego uczenia SageMaker (DLC). Pobieramy wszelkie dodatkowe pakiety, a także skrypty do obsługi szkolenia i wnioskowania dla wybranego zadania. Na koniec wytrenowane artefakty modelu są pobierane osobno za pomocą model_uris, co zapewnia elastyczność platformy. Możesz użyć dowolnej liczby modeli wstępnie wytrenowanych dla tego samego zadania za pomocą jednego skryptu uczącego lub wnioskowania. Zobacz następujący kod:

Następnie wrzucamy zasoby do Mędrzec Modelka instancję i wdrożyć punkt końcowy:

Wdrażanie punktu końcowego może potrwać kilka minut.

Zapytaj o punkt końcowy, przeanalizuj odpowiedź i wyświetl prognozy

Aby uzyskać wnioski z wdrożonego modelu, obraz wejściowy musi być dostarczony w formacie binarnym wraz z typem akceptacji. W programie JumpStart można zdefiniować liczbę zwracanych ramek ograniczających. W poniższym fragmencie kodu przewidujemy dziesięć ramek ograniczających na obraz poprzez dołączenie ;n_predictions=10 do Accept. Aby przewidzieć xx boxy, możesz to zmienić na ;n_predictions=xx lub uzyskaj wszystkie przewidywane pola, pomijając ;n_predictions=xx całkowicie.

Poniższy fragment kodu daje wgląd w to, jak wygląda wykrywanie obiektów. Wizualizowane jest prawdopodobieństwo przewidywane dla każdej klasy obiektów wraz z jej obwiednią. Używamy parse_response i display_predictions funkcje pomocnicze, które są zdefiniowane w załączonym notatnik.

Poniższy zrzut ekranu przedstawia dane wyjściowe obrazu z etykietami przewidywania i obwiedniami.

Dostosuj wstępnie wytrenowany model we własnym zbiorze danych

Istniejące modele wykrywania obiektów w JumpStart są wstępnie przeszkolone w zestawach danych COCO lub VOC. Jeśli jednak musisz zidentyfikować klasy obiektów, które nie istnieją w oryginalnym zestawie danych przedtreningowych, musisz dostroić model w nowym zestawie danych, który zawiera te nowe typy obiektów. Na przykład, jeśli musisz zidentyfikować przybory kuchenne i przeprowadzić wnioskowanie na wdrożonym wstępnie wytrenowanym modelu SSD, model nie rozpoznaje żadnych cech nowych typów obrazów, a zatem dane wyjściowe są nieprawidłowe.

W tej sekcji pokazujemy, jak łatwo jest dostroić wstępnie wytrenowany model w celu wykrywania nowych klas obiektów za pomocą interfejsów API JumpStart. Pełny przykład kodu z większą ilością szczegółów jest dostępny w towarzyszący notatnik.

Odzyskaj artefakty szkoleniowe

Artefakty uczenia są podobne do artefaktów wnioskowania omówionych w poprzedniej sekcji. Szkolenie wymaga podstawowego kontenera Docker, a mianowicie kontenera MXNet w poniższym przykładowym kodzie. Wszelkie dodatkowe pakiety wymagane do szkolenia są zawarte w skryptach szkoleniowych w train_sourcer_uri. Wstępnie wytrenowany model i jego parametry są pakowane osobno.

Uruchom szkolenie

Aby uruchomić szkolenie, po prostu przekazujemy wymagane artefakty wraz z kilkoma dodatkowymi parametrami do a Estymator SageMakera i zadzwoń do .fit funkcjonować:

Podczas uczenia się algorytmu możesz monitorować jego postęp w notatniku SageMaker, w którym uruchamiasz sam kod, lub w Amazon Cloud Watch. Po zakończeniu szkolenia artefakty dostrojonego modelu są przesyłane do Usługa Amazon Simple Storage (Amazon S3) lokalizacja wyjściowa określona w konfiguracji szkolenia. Możesz teraz wdrożyć model w taki sam sposób, jak model wstępnie przeszkolony. Możesz śledzić resztę procesu w towarzyszący notatnik.

Wnioski

W tym poście opisaliśmy wartość nowo wydanych interfejsów API JumpStart i jak z nich korzystać. Udostępniliśmy linki do 17 przykładowych notatników dla różnych zadań ML obsługiwanych w JumpStart i przeprowadziliśmy Cię przez notatnik wykrywania obiektów.

Czekamy na kontakt z Państwem podczas eksperymentowania z JumpStart.

O autorach

Dr Vivek Madan jest naukowcem w zespole Amazon SageMaker JumpStart. Uzyskał doktorat na Uniwersytecie Illinois w Urbana-Champaign i był badaczem podoktoranckim w Georgia Tech. Jest aktywnym badaczem uczenia maszynowego i projektowania algorytmów, publikował artykuły na konferencjach EMNLP, ICLR, COLT, FOCS i SODA.

Dr Vivek Madan jest naukowcem w zespole Amazon SageMaker JumpStart. Uzyskał doktorat na Uniwersytecie Illinois w Urbana-Champaign i był badaczem podoktoranckim w Georgia Tech. Jest aktywnym badaczem uczenia maszynowego i projektowania algorytmów, publikował artykuły na konferencjach EMNLP, ICLR, COLT, FOCS i SODA.

Joao Moura jest specjalistą ds. rozwiązań AI/ML w Amazon Web Services. Koncentruje się głównie na przypadkach użycia NLP i pomaga klientom zoptymalizować szkolenie i wdrażanie modelu Deep Learning.

Joao Moura jest specjalistą ds. rozwiązań AI/ML w Amazon Web Services. Koncentruje się głównie na przypadkach użycia NLP i pomaga klientom zoptymalizować szkolenie i wdrażanie modelu Deep Learning.

Dr Ashish Khetan jest Starszym Naukowcem Stosowanym z Amazon SageMaker JumpStart i Wbudowane algorytmy Amazon SageMaker i pomaga rozwijać algorytmy uczenia maszynowego. Jest aktywnym badaczem uczenia maszynowego i wnioskowania statystycznego oraz opublikował wiele artykułów na konferencjach NeurIPS, ICML, ICLR, JMLR i ACL.

Dr Ashish Khetan jest Starszym Naukowcem Stosowanym z Amazon SageMaker JumpStart i Wbudowane algorytmy Amazon SageMaker i pomaga rozwijać algorytmy uczenia maszynowego. Jest aktywnym badaczem uczenia maszynowego i wnioskowania statystycznego oraz opublikował wiele artykułów na konferencjach NeurIPS, ICML, ICLR, JMLR i ACL.

- Coinsmart. Najlepsza w Europie giełda bitcoinów i kryptowalut.

- Platoblockchain. Web3 Inteligencja Metaverse. Wzmocniona wiedza. DARMOWY DOSTĘP.

- CryptoJastrząb. Radar Altcoin. Bezpłatna wersja próbna.

- Źródło: https://aws.amazon.com/blogs/machine-learning/amazon-sagemaker-jumpstart-models-and-algorithms-now-available-via-api/

- "

- 100

- 2020

- dokładny

- w poprzek

- aktywny

- Dodatkowy

- Korzyść

- algorytm

- Algorytmy

- Wszystkie kategorie

- Amazonka

- Amazon Web Services

- ilość

- Ogłosić

- ogłosił

- Inne

- nigdzie

- api

- Pszczoła

- aplikacje

- dostępny

- AWS

- jest

- Blog

- Najnowsze wpisy

- Pudełko

- wbudowany

- biznes

- wezwanie

- możliwości

- Etui

- zmiana

- klasyfikacja

- kod

- kolekcja

- wspólny

- społeczność

- konferencje

- systemu

- Pojemnik

- Pojemniki

- zawiera

- zawartość

- Koszty:

- Aktualny

- Stan aktulany

- Klientów

- dane

- analiza danych

- Kreowanie

- rozwijać

- wdrażanie

- Wdrożenie

- Wnętrze

- Wykrywanie

- rozwijać

- rozwinięty

- oprogramowania

- różne

- Wyświetlacz

- Doker

- Nie

- domena

- z łatwością

- szyfrowanie

- Punkt końcowy

- Enterprise

- Środowisko

- przykład

- eksperyment

- Twarz

- Cecha

- Korzyści

- W końcu

- budżetowy

- Elastyczność

- pływ

- koncentruje

- obserwuj

- następujący

- format

- Naprzód

- pełny

- funkcjonować

- Ogólne

- generacja

- poprowadzi

- Prowadzenie

- pomoc

- pomaga

- W jaki sposób

- How To

- HTTPS

- zidentyfikować

- Illinois

- obraz

- włączony

- Włącznie z

- przemysłowy

- zaangażowany

- IT

- samo

- Praca

- Klawisze

- wiedza

- Etykiety

- duży

- uruchomić

- dowiedziałem

- nauka

- linki

- lokalizacja

- maszyna

- uczenie maszynowe

- Większość

- Dokonywanie

- ML

- model

- modele

- większość

- Najbardziej popularne posty

- mianowicie

- notatnik

- numer

- liczny

- Platforma

- Popularny

- Wiadomości

- przepowiednia

- Przewidywania

- teraźniejszość

- problemy

- wygląda tak

- procesów

- produkować

- Produkt

- zapewniać

- zapewnia

- pytanie

- szybko

- w czasie rzeczywistym

- rozpoznać

- redukcja

- wymagany

- Badania naukowe

- Zasoby

- odpowiedź

- REST

- Efekt

- run

- bieganie

- Naukowiec

- Naukowcy

- Sdk

- bezpiecznie

- bezpieczeństwo

- wybrany

- Usługi

- zestaw

- podobny

- Prosty

- So

- Rozwiązania

- ROZWIĄZANIA

- rozpoczęty

- Stan

- statystyczny

- przechowywanie

- studio

- wsparcie

- Utrzymany

- podpory

- zadania

- zespół

- tech

- Przez

- czas

- już dziś

- razem

- Trening

- pociągi

- uniwersytet

- odblokowuje

- Aktualizacja

- posługiwać się

- przypadków użycia

- wartość

- Filmy

- wizja

- sieć

- usługi internetowe

- Co

- w ciągu

- pisanie