Wydawcy cyfrowi nieustannie poszukują sposobów na usprawnienie i zautomatyzowanie przepływów pracy w mediach, aby generować i publikować nowe treści tak szybko, jak to tylko możliwe.

Wielu wydawców ma dużą bibliotekę obrazów stockowych, których używają w swoich artykułach. Te obrazy mogą być wielokrotnie wykorzystywane w różnych historiach, zwłaszcza gdy wydawca ma zdjęcia celebrytów. Dość często dziennikarz może potrzebować wyciąć pożądanego celebrytę ze zdjęcia, aby użyć go w nadchodzącej historii. Jest to ręczne, powtarzalne zadanie, które powinno być zautomatyzowane. Czasami autor może chcieć użyć zdjęcia celebryty, ale zawiera ono dwie osoby, a główny celebryta musi zostać wykadrowany z obrazu. Innym razem może być konieczne ponowne sformatowanie zdjęć celebrytów w celu opublikowania ich na różnych platformach, takich jak urządzenia mobilne, media społecznościowe lub wiadomości cyfrowe. Ponadto autor może potrzebować zmienić proporcje obrazu lub ustawić ostrość na celebrytę.

W tym poście pokazujemy, jak używać Amazon Rekognition przeprowadzić analizę obrazu. Amazon Rekognition ułatwia dodawanie tej funkcji do aplikacji bez wiedzy specjalistycznej w zakresie uczenia maszynowego (ML) i jest dostarczany z różnymi interfejsami API do realizacji takich przypadków użycia, jak wykrywanie obiektów, moderowanie treści, wykrywanie i analiza twarzy oraz rozpoznawanie tekstu i celebrytów, które my użyj w tym przykładzie.

Połączenia funkcja rozpoznawania celebrytów in Amazon Rekognition automatycznie rozpoznaje dziesiątki tysięcy znanych osobistości na obrazach i filmach za pomocą ML. Rozpoznawanie gwiazd może wykryć nie tylko obecność danej gwiazdy, ale także lokalizację na obrazie.

Przegląd rozwiązania

W tym poście pokazujemy, w jaki sposób możemy przekazać zdjęcie, imię i nazwisko celebryty oraz współczynnik proporcji wyjściowego obrazu, aby móc wygenerować przycięty obraz danej gwiazdy, przedstawiający jej twarz na środku.

Podczas pracy z API wykrywania celebrytów Amazon Rekognition, w odpowiedzi zwracanych jest wiele elementów. Oto kilka kluczowych elementów odpowiedzi:

- Dopasuj pewność – Wynik pewności dopasowania, którego można użyć do kontrolowania zachowania interfejsu API. Zalecamy zastosowanie odpowiedniego progu do tego wyniku w aplikacji, aby wybrać preferowany punkt pracy. Na przykład ustawiając próg 99%, możesz wyeliminować fałszywe alarmy, ale możesz przegapić niektóre potencjalne dopasowania.

- Nazwa, identyfikator i adresy URL – Nazwisko celebryty, unikalny identyfikator Amazon Rekognition ID oraz lista adresów URL, takich jak IMDb celebryty lub link do Wikipedii w celu uzyskania dalszych informacji.

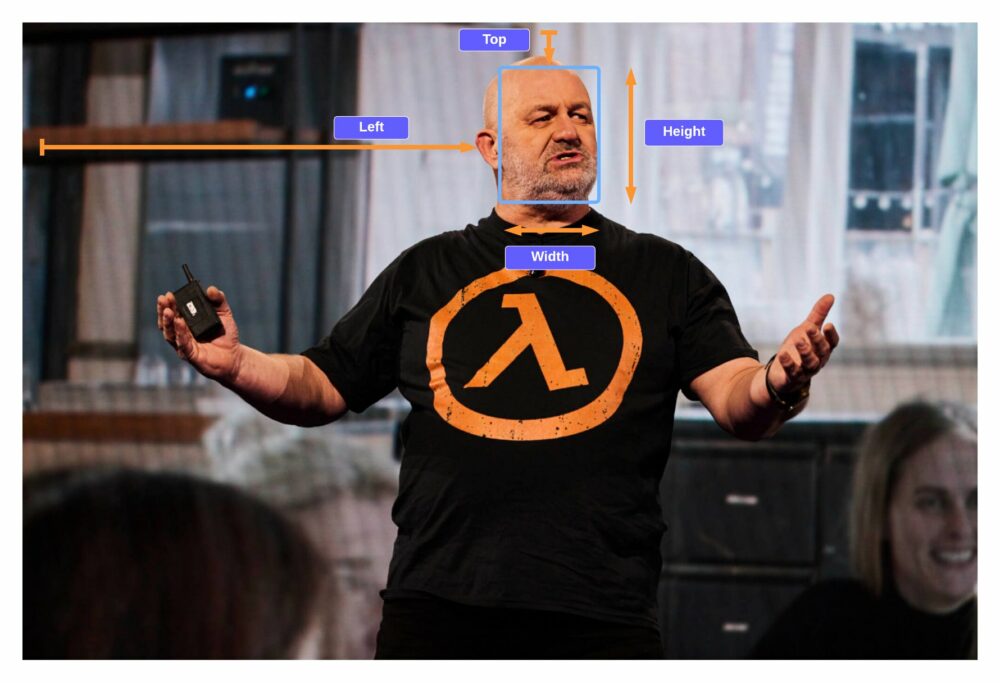

- Obwiednia – Współrzędne lokalizacji prostokątnej ramki ograniczającej dla każdej rozpoznanej twarzy celebryty.

- Znana płeć – Znana tożsamość płciowa dla każdej uznanej gwiazdy.

- Emocje – Emocje wyrażone na twarzy celebryty, na przykład radość, smutek lub złość.

- Poza – Pozycja twarzy celebryty, wykorzystująca trzy osie przechyłu, pochylenia i odchylenia.

- Uśmiech – Czy celebrytka się uśmiecha, czy nie.

Część odpowiedzi API z Amazon Rekognition zawiera następujący kod:

W tym ćwiczeniu zademonstrujemy, jak użyć elementu ramki ograniczającej do określenia położenia powierzchni, jak pokazano na poniższym przykładowym obrazie. Wszystkie wymiary są reprezentowane jako stosunki całkowitego rozmiaru obrazu, więc liczby w odpowiedzi mieszczą się w przedziale od 0 do 1. Na przykład w przykładowej odpowiedzi interfejsu API szerokość obwiedni wynosi 0.1, co oznacza, że szerokość twarzy wynosi 10% całkowitej szerokości obrazu.

Dzięki tej ramce ograniczającej możemy teraz użyć logiki, aby upewnić się, że twarz pozostaje w obrębie krawędzi nowego obrazu, który tworzymy. Możemy zastosować trochę wypełnienia wokół tego obwiedni, aby utrzymać twarz na środku.

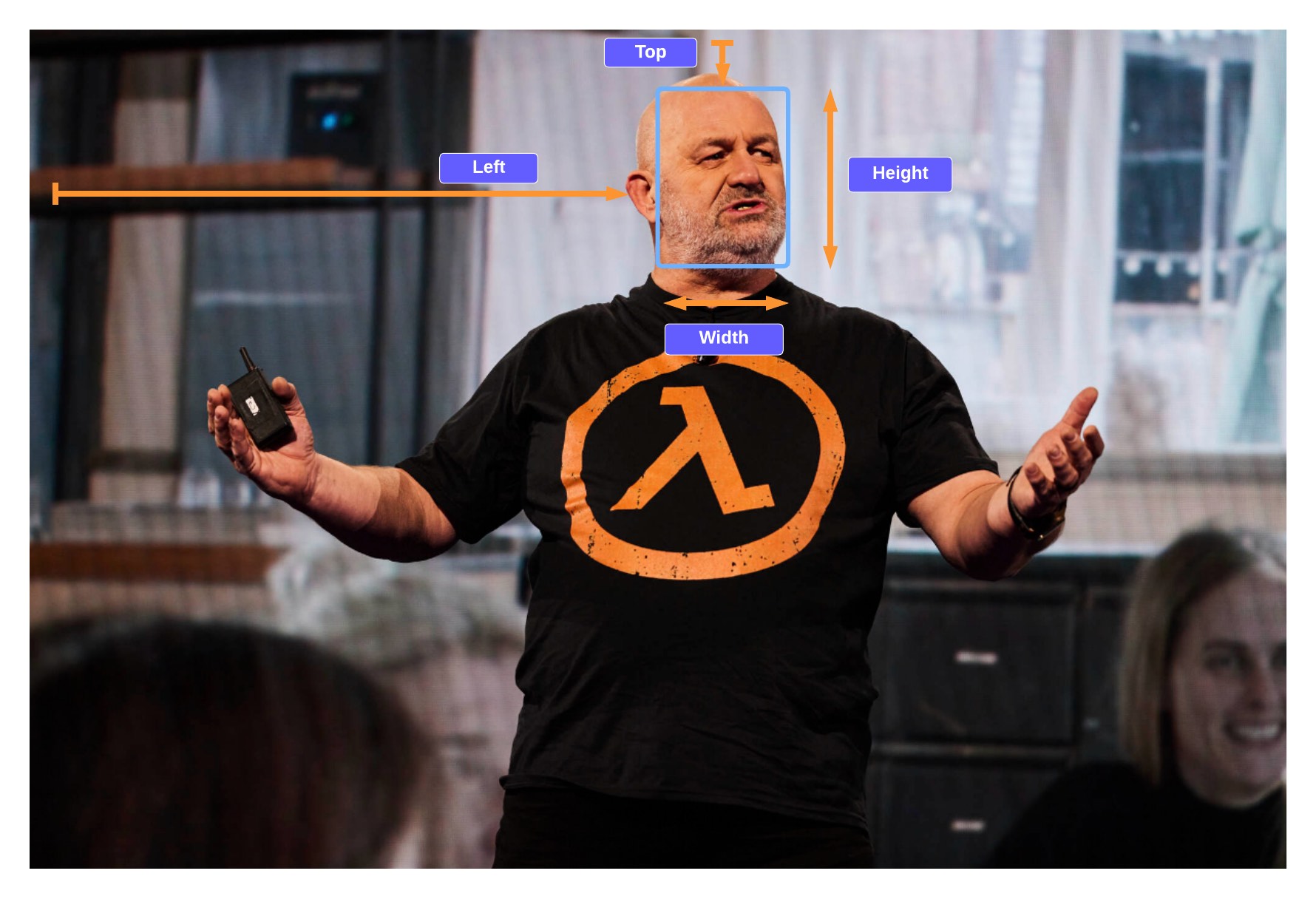

W poniższych sekcjach pokazujemy, jak utworzyć następujący przycięty obraz wyjściowy z Wernerem Vogelsem z wyraźną ostrością.

Uruchamiamy a Amazon Sage Maker notebook, który zapewnia środowisko Pythona, w którym można uruchomić kod, aby przekazać obraz do Amazon Rekognition, a następnie automatycznie zmodyfikować obraz z celebrytą w centrum uwagi.

Kod wykonuje następujące kroki wysokiego poziomu:

- Złóż wniosek do

recognize_celebritiesAPI z podanym obrazem i nazwiskiem celebryty. - Przefiltruj odpowiedź pod kątem informacji o obwiedni.

- Dodaj trochę wypełnienia do obwiedni, tak aby uchwycić część tła.

Wymagania wstępne

W tej instrukcji należy spełnić następujące wymagania wstępne:

Prześlij przykładowy obraz

Prześlij swój przykładowy obraz celebryty do zasobnika S3.

Uruchom kod

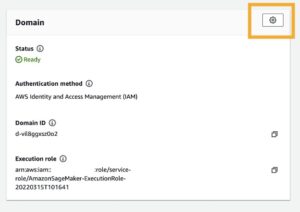

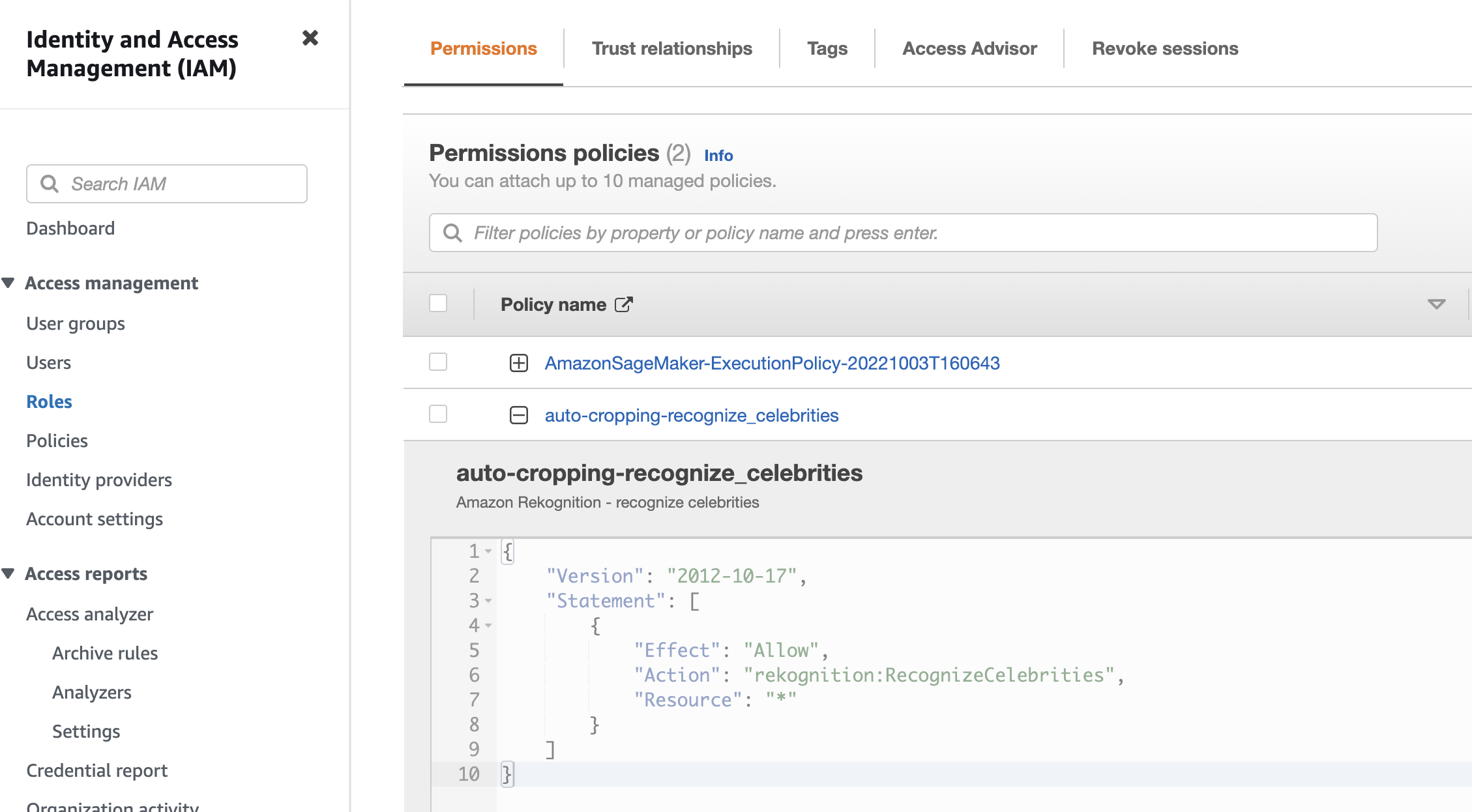

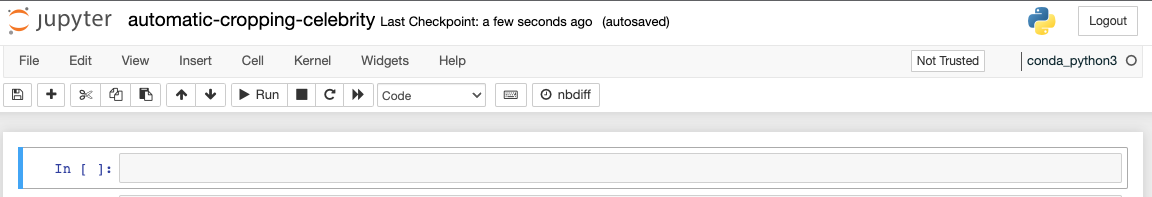

Aby uruchomić kod, używamy notatnika SageMaker, jednak każde IDE działałoby również po zainstalowaniu Pythona, poduszki i Boto3. Tworzymy notatnik SageMaker, a także AWS Zarządzanie tożsamością i dostępem (IAM) z wymaganymi uprawnieniami. Wykonaj następujące kroki:

- Utwórz notatnik i nazwij to

automatic-cropping-celebrity.

Domyślna polityka wykonywania, która została utworzona podczas tworzenia notatnika SageMaker, ma prostą politykę, która nadaje roli uprawnienia do interakcji z Amazon S3.

- Zaktualizuj

Resourceograniczenie z nazwą zasobnika S3:

- Utwórz kolejną politykę, aby dodać ją do roli IAM notatnika SageMaker, aby móc wywoływać Rozpoznaj gwiazdy OGIEŃ:

- W konsoli SageMaker wybierz Instancje notebooków w okienku nawigacji.

- Zlokalizuj

automatic-cropping-celebrityzeszyt i wybierz Otwórz Jupyter. - Dodaj Nowości i conda_python3 jako jądro dla Twojego notebooka.

Aby wykonać poniższe kroki, skopiuj bloki kodu do notesu Jupyter i uruchom je, wybierając run.

- Najpierw importujemy funkcje pomocnicze i biblioteki:

- Ustaw zmienne

- Utwórz klienta usługi

- Funkcja rozpoznawania celebrytów

- Funkcja, która pobiera obwiednię danej gwiazdy:

- Funkcja dodająca trochę wypełnienia do obwiedni, dzięki czemu uchwycimy trochę tła wokół twarzy

- Funkcja zapisywania obrazu w pamięci notebooka i na Amazon S3

- Użyj Pythona

main()funkcja łącząca poprzednie funkcje w celu zakończenia procesu zapisywania nowego przyciętego obrazu naszej gwiazdy:

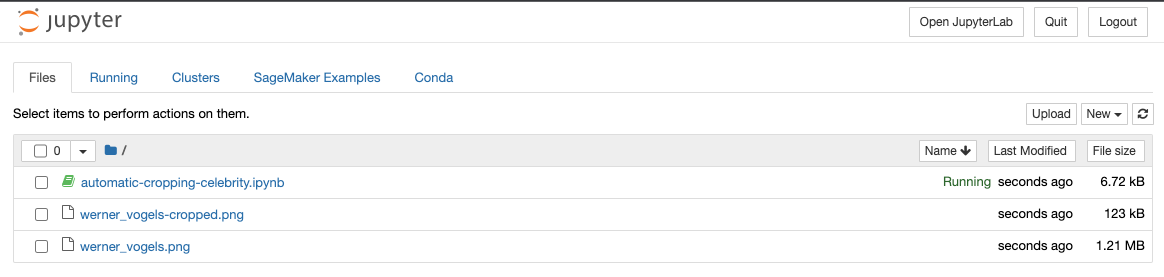

Kiedy uruchomisz ten blok kodu, zobaczysz, że znaleźliśmy Wernera Vogelsa i stworzyliśmy nowy obraz z jego twarzą pośrodku.

Obraz zostanie zapisany w notatniku, a także przesłany do zasobnika S3.

Możesz dołączyć to rozwiązanie do pliku a większy przepływ pracy; na przykład firma wydawnicza może chcieć opublikować tę funkcję jako punkt końcowy do ponownego formatowania i zmiany rozmiaru obrazów w locie podczas publikowania artykułów celebrytów na wielu platformach.

Sprzątanie

Aby uniknąć przyszłych opłat, usuń zasoby:

- W konsoli SageMaker wybierz swój notatnik i na Akcje menu, wybierz Stop.

- Po zatrzymaniu notebooka na Akcje menu, wybierz Usuń.

- W konsoli IAM usuń utworzoną rolę wykonawczą SageMaker.

- Na konsoli Amazon S3 usuń obraz wejściowy i wszelkie pliki wyjściowe z zasobnika S3.

Wnioski

W tym poście pokazaliśmy, jak możemy wykorzystać Amazon Rekognition do zautomatyzowania ręcznego zadania modyfikowania obrazów w celu obsługi przepływów pracy z mediami. Jest to szczególnie ważne w branży wydawniczej, gdzie szybkość ma znaczenie w szybkim udostępnianiu świeżych treści na wiele platform.

Aby uzyskać więcej informacji na temat pracy z zasobami multimedialnymi, zobacz Inteligencja medialna właśnie stała się inteligentniejsza dzięki Media2Cloud 3.0

O autorze

Marka Watkinsa jest Architektem Rozwiązań w zespole Media and Entertainment. Pomaga klientom w tworzeniu rozwiązań AI/ML, które rozwiązują ich wyzwania biznesowe z wykorzystaniem AWS. Pracował nad kilkoma projektami AI/ML związanymi z wizją komputerową, przetwarzaniem języka naturalnego, personalizacją, ML na krawędzi i nie tylko. Z dala od życia zawodowego uwielbia spędzać czas z rodziną i obserwować dorastającą dwójkę swoich maluchów.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- Platoblockchain. Web3 Inteligencja Metaverse. Wzmocniona wiedza. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/automatic-image-cropping-with-amazon-rekognition/

- :Jest

- $W GÓRĘ

- 1

- 10

- 100

- 11

- 7

- 8

- 9

- a

- Zdolny

- O nas

- dostęp

- Działania

- do tego

- Po

- AI / ML

- Wszystkie kategorie

- Amazonka

- Amazon Rekognition

- analiza

- i

- Inne

- api

- Pszczoła

- Zastosowanie

- aplikacje

- Aplikuj

- Stosowanie

- SĄ

- na około

- towary

- AS

- aspekt

- Aktywa

- At

- autor

- zautomatyzować

- zautomatyzowane

- automatycznie

- automatycznie

- AWS

- OSIE

- tło

- BE

- pomiędzy

- Blokować

- Bloki

- Pudełko

- Skrzynki

- biznes

- by

- wezwanie

- CAN

- zdobyć

- Przechwytywanie

- Etui

- Sławy

- Gwiazdy

- Celebrytki

- Centrum

- wyzwania

- zmiana

- Opłaty

- Dodaj

- Wybierając

- kod

- połączyć

- sukcesy firma

- kompletny

- komputer

- Wizja komputerowa

- pewność siebie

- Konsola

- zawiera

- zawartość

- bez przerwy

- kontrola

- mógłby

- Stwórz

- stworzony

- Tworzenie

- wole

- Klientów

- Domyślnie

- wykazać

- życzenia

- wykryte

- Wykrywanie

- różne

- cyfrowy

- Wymiary

- Wyświetlacz

- pobieranie

- e

- każdy

- krawędź

- efekt

- element

- Elementy

- wyeliminować

- Punkt końcowy

- rozrywka

- Środowisko

- szczególnie

- przykład

- egzekucja

- Ćwiczenie

- ekspertyza

- wyrażone

- Twarz

- twarze

- członków Twojej rodziny

- sławny

- filet

- Akta

- Skupiać

- następujący

- W razie zamówieenia projektu

- format

- znaleziono

- świeży

- od

- funkcjonować

- Funkcje

- dalej

- przyszłość

- Płeć

- Generować

- otrzymać

- miejsce

- dany

- daje

- Rozwój

- Zaoszczędzić

- Have

- wysokość

- pomaga

- na wysokim szczeblu

- W jaki sposób

- How To

- Jednak

- HTML

- http

- HTTPS

- ID

- zidentyfikować

- tożsamość

- obraz

- zdjęcia

- importować

- ważny

- in

- zawierać

- obejmuje

- przemysł

- Informacja

- wkład

- Instalacja

- Inteligencja

- interakcji

- IT

- dziennikarz

- jpg

- Trzymać

- Klawisz

- znany

- język

- duży

- uruchomić

- nauka

- biblioteki

- Biblioteka

- życie

- lubić

- LINK

- Lista

- mało

- miejscowy

- lokalizacja

- poszukuje

- maszyna

- uczenie maszynowe

- robić

- WYKONUJE

- podręcznik

- wiele

- Mecz

- Matters

- Media

- Menu

- może

- ML

- Aplikacje mobilne

- umiar

- modyfikować

- jeszcze

- wielokrotność

- Nazwa

- Naturalny

- Przetwarzanie języka naturalnego

- Nawigacja

- Potrzebować

- wymagania

- Nowości

- aktualności

- notatnik

- z naszej

- przedmiot

- Wykrywanie obiektów

- of

- on

- operacyjny

- zamówienie

- Inne

- Inaczej

- wydajność

- ogólny

- chleb

- szczególnie

- ścieżka

- Ludzie

- wykonać

- wykonuje

- uprawnienia

- Osobistości

- personalizacja

- Smoła

- Platformy

- plato

- Analiza danych Platona

- PlatoDane

- punkt

- polityka

- Post

- potencjał

- Korzystny

- warunki wstępne

- obecność

- pierwotny

- przetwarzanie

- profesjonalny

- projektowanie

- zapewnia

- publikować

- wydawca

- wydawcy

- Wydawniczy

- położyć

- Python

- szybko

- podnieść

- szybko

- stosunek

- uznanie

- rozpoznać

- uznane

- rozpoznaje

- polecić

- związane z

- szczątki

- powtarzalne

- reprezentowane

- zażądać

- wymagany

- Zasób

- Zasoby

- odpowiedź

- dalsze

- Efekt

- powrót

- ROI

- Rola

- Rolka

- run

- sagemaker

- Zapisz

- oszczędność

- wynik

- działy

- usługa

- ustawienie

- kilka

- powinien

- pokazać

- pokazane

- Prosty

- Rozmiar

- mądrzejszy

- So

- Obserwuj Nas

- Media społecznościowe

- rozwiązanie

- Rozwiązania

- ROZWIĄZANIA

- kilka

- prędkość

- Spędzanie

- Kwadratowa

- Zestawienie sprzedaży

- Cel

- stany magazynowe

- zatrzymany

- przechowywanie

- historie

- Historia

- opływowy

- taki

- odpowiedni

- wsparcie

- Zadanie

- zespół

- że

- Połączenia

- ich

- Im

- Te

- tysiące

- trzy

- próg

- czas

- czasy

- do

- Top

- Kwota produktów:

- wyjątkowy

- zbliżających

- przesłanych

- posługiwać się

- różnorodność

- różnorodny

- wersja

- Filmy

- wizja

- solucja

- oglądania

- sposoby

- DOBRZE

- znane

- czy

- który

- szerokość

- Wikipedia

- będzie

- w

- w ciągu

- bez

- Praca

- przepływów pracy

- pracujący

- by

- You

- Twój

- zefirnet