Autopilot Amazon SageMaker pomaga ukończyć kompleksowy przepływ pracy uczenia maszynowego (ML) przez automatyzację etapów inżynierii funkcji, szkolenia, dostrajania i wdrażania modelu ML na potrzeby wnioskowania. Dostarczasz SageMaker Autopilot z tabelarycznym zestawem danych i docelowym atrybutem do przewidywania. Następnie SageMaker Autopilot automatycznie eksploruje Twoje dane, trenuje, dostraja, ocenia i znajduje najlepszy model. Wreszcie, jednym kliknięciem możesz wdrożyć ten model do produkcji w celu wnioskowania.

Co nowego?

Nowo uruchomiona funkcja, Raporty jakości modeli autopilota SageMaker, raportuje teraz metryki modelu, aby zapewnić lepszy wgląd w wydajność modelu w przypadku problemów z regresją i klasyfikacją. Możesz wykorzystać te metryki, aby zebrać więcej informacji na temat najlepszego modelu w tabeli liderów modelu.

Te wskaźniki i raporty, które są dostępne w nowej zakładce „Wydajność” w sekcji „Szczegóły modelu” najlepszego modelu, obejmują macierze zamieszania, obszar pod krzywą charakterystyki działania odbiornika (AUC-ROC) oraz obszar pod krzywą precyzji odtwarzania (AUC-PR). Te metryki pomagają zrozumieć fałszywie pozytywne/fałszywie negatywne wyniki (FP/FN), kompromisy między prawdziwymi pozytywami (TP) i fałszywymi alarmami (FP), a także kompromisy między precyzją a przypominaniem w celu oceny najlepszych charakterystyk wydajności modelu.

Przeprowadzanie eksperymentu z autopilotem SageMaker

Zestaw danych

Używamy pliki Zbiór danych marketingowych banku UCI aby zademonstrować raporty jakości modelu autopilota SageMaker. Te dane zawierają atrybuty klienta, takie jak wiek, rodzaj pracy, stan cywilny i inne, których użyjemy do przewidzenia, czy klient otworzy konto w banku. Zbiór danych dotyczy tego rachunku jako lokaty terminowej. To sprawia, że nasz przypadek jest binarnym problemem klasyfikacji – predykcja będzie albo „tak”, albo „nie”. SageMaker Autopilot wygeneruje w naszym imieniu kilka modeli, aby jak najlepiej przewidzieć potencjalnych klientów. Następnie przyjrzymy się raportowi jakości modelu dla autopilota SageMaker najlepszy model.

Wymagania wstępne

Aby zainicjować eksperyment SageMaker Autopilot, musisz najpierw umieścić swoje dane w pliku Usługa Amazon Simple Storage (Amazon S3) wiadro. Określ zasobnik i prefiks, którego chcesz użyć do trenowania. Upewnij się, że zasobnik znajduje się w tym samym regionie co eksperyment SageMaker Autopilot. Musisz także upewnić się, że rola Zarządzanie tożsamościami i dostępem (IAM) Autopilot ma uprawnienia dostępu do danych w Amazon S3.

Tworzenie eksperymentu

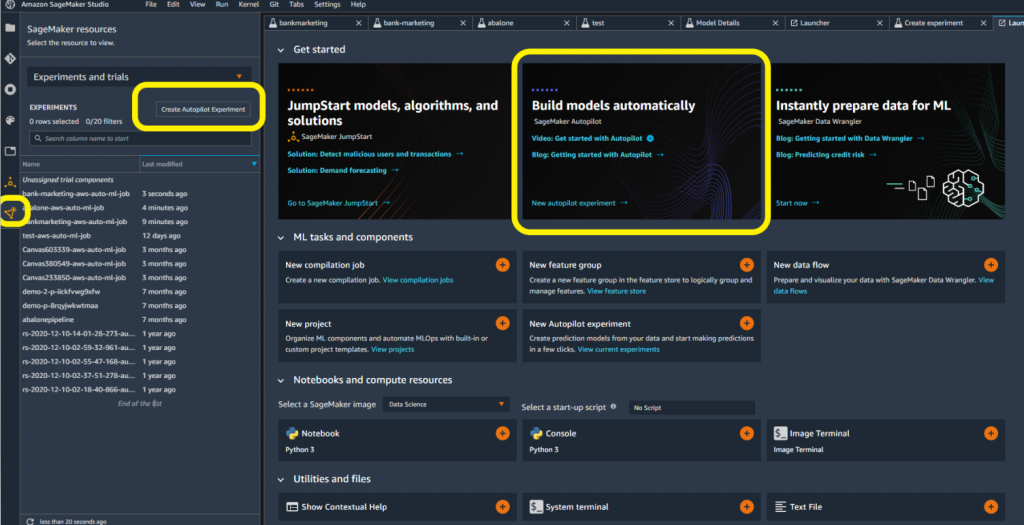

Masz kilka opcji tworzenia eksperymentu SageMaker Autopilot w SageMaker Studio. Otwierając nowy program uruchamiający, możesz uzyskać bezpośredni dostęp do autopilota SageMaker. Jeśli nie, możesz wybrać ikonę zasobów SageMaker po lewej stronie. Następnie możesz wybrać Eksperymenty i próby z rozwijanego menu.

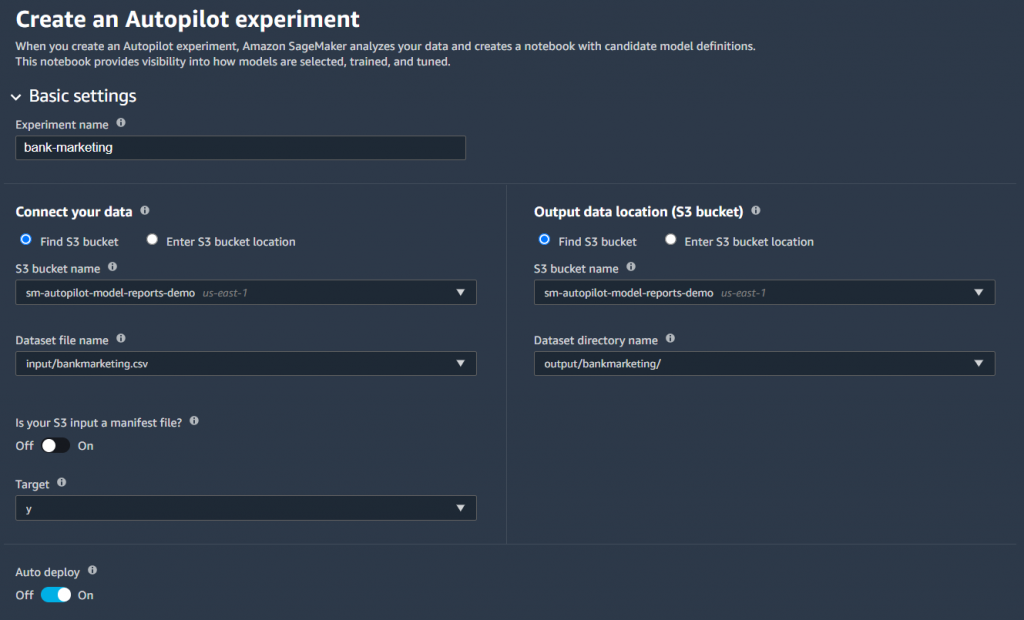

- Nadaj nazwę swojemu eksperymentowi.

- Połącz się ze źródłem danych, wybierając zasobnik Amazon S3 i nazwę pliku.

- Wybierz lokalizację danych wyjściowych w Amazon S3.

- Wybierz kolumnę docelową dla swojego zestawu danych. W tym przypadku kierujemy kolumnę „y”, aby wskazać tak/nie.

- Opcjonalnie podaj nazwę punktu końcowego, jeśli chcesz, aby SageMaker Autopilot automatycznie wdrożył modelowy punkt końcowy.

- Pozostaw wszystkie pozostałe ustawienia zaawansowane jako domyślne i wybierz Utwórz eksperyment.

Po zakończeniu eksperymentu możesz zobaczyć wyniki w SageMaker Studio. SageMaker Autopilot zaprezentuje najlepszy model spośród różnych modeli, które trenuje. Możesz przeglądać szczegóły i wyniki różnych prób, ale użyjemy najlepszego modelu, aby zademonstrować użycie raportów jakości modeli.

- Wybierz model i kliknij prawym przyciskiem myszy, aby Otwórz w szczegółach modelu.

- W szczegółach modelu wybierz Wydajność patka. To pokazuje metryki modelu za pomocą wizualizacji i wykresów.

- Pod Wydajność, Wybierz Pobierz raporty skuteczności jako PDF.

Interpretacja raportu jakości modelu autopilota SageMaker

Raport jakości modelu podsumowuje zadanie i szczegóły modelu SageMaker Autopilot. Skupimy się na formacie PDF raportu, ale możesz również uzyskać dostęp do wyników w formacie JSON. Ponieważ SageMaker Autopilot określił nasz zestaw danych jako binarny problem klasyfikacji, SageMaker Autopilot miał na celu maksymalizację Miernik jakości F1 znaleźć najlepszy model. SageMaker Autopilot wybiera to domyślnie. Istnieje jednak możliwość wyboru innych obiektywnych wskaźników, takich jak dokładność i AUC. Wynik F1 naszego modelu wynosi 0.61. Aby zinterpretować wynik F1, warto najpierw zrozumieć macierz nieporozumień, która jest wyjaśniona w raporcie jakości modelu w wyjściowym pliku PDF.

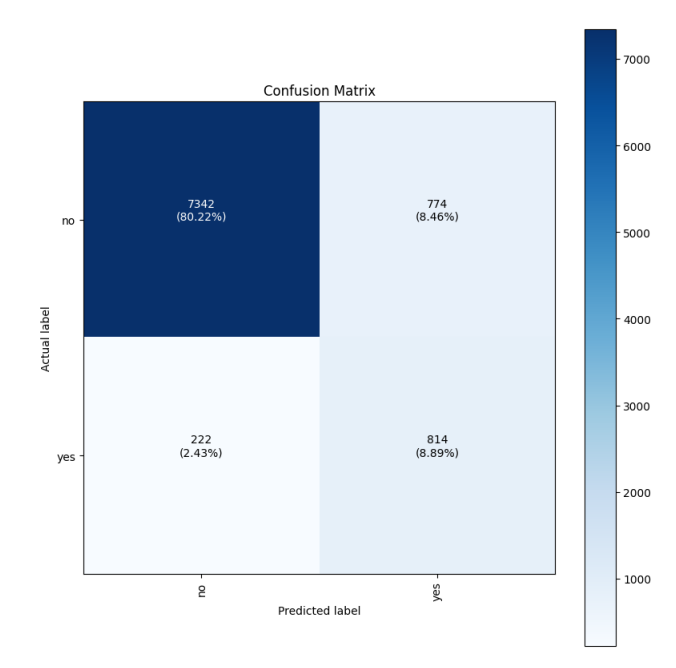

Macierz zamieszania

Macierz pomyłek pomaga zwizualizować wydajność modelu poprzez porównanie różnych klas i etykiet. Eksperyment SageMaker Autopilot stworzył macierz nieporozumień, która pokazuje rzeczywiste etykiety jako wiersze, a predykowane etykiety jako kolumny w raporcie jakości modelu. Pole w lewym górnym rogu pokazuje klientów, którzy nie otworzyli konta w banku, których model prawidłowo przewidział jako „nie”. To są prawdziwe negatywy (TN). Prawe dolne pole pokazuje klientów, którzy otworzyli konto w banku, których model prawidłowo przewidział jako „tak”. To są prawdziwe pozytywy (PT).

Lewy dolny róg pokazuje liczbę fałszywe negatywy (FN). Model przewidywał, że klient nie otworzy konta, ale klient to zrobił. Prawy górny róg pokazuje liczbę fałszywe alarmy (FP). Model przewidywał, że klient otworzy konto, ale klient to zrobił nie faktycznie to zrobić.

Metryki raportu jakości modelu

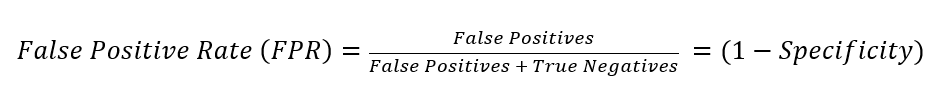

Raport o jakości modelu wyjaśnia, jak obliczyć odsetek wyników fałszywie dodatnich (FPR) oraz współczynnik prawdziwie dodatni (TPR).

Przypomnijmy lub odsetek fałszywie pozytywnych wyników (FPR) mierzy odsetek rzeczywistych negatywnych wyników, które błędnie przewidywano jako otwarcie rachunku (pozytywne). Zakres wynosi od 0 do 1, a mniejsza wartość wskazuje na lepszą dokładność przewidywania.

Zwróć uwagę, że FPR jest również wyrażony jako 1-specyficzność, gdzie specyficzność lub prawdziwie ujemny współczynnik (TNR) to odsetek TN prawidłowo zidentyfikowanych jako nieotwierające konta (ujemne).

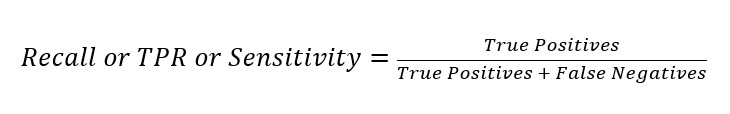

Przywołanie/Czułość/True Positive Rate (TPR) mierzy ułamek rzeczywistych pozytywów, które były przewidywane jako otwarcie konta. Zakres wynosi również od 0 do 1, a większa wartość wskazuje na lepszą dokładność predykcyjną. Jest to również znane jako Przywołanie/Czułość. Ta miara wyraża zdolność do znalezienia wszystkich odpowiednich instancji w zbiorze danych.

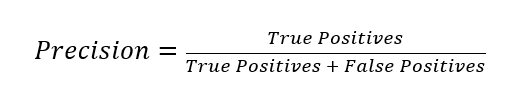

Detaliczność mierzy ułamek rzeczywistych wyników dodatnich, które przewidywano jako dodatnie, spośród wszystkich przewidywanych jako dodatnie. Zakres wynosi od 0 do 1, a większa wartość oznacza lepszą dokładność. Precyzja wyraża odsetek punktów danych, które według naszego modelu były istotne i które były faktycznie istotne. Precyzja to dobry środek do rozważenia, zwłaszcza gdy koszty FP są wysokie – na przykład przy wykrywaniu spamu w wiadomościach e-mail.

Nasz model wykazuje precyzję 0.53 i wycofanie 0.72.

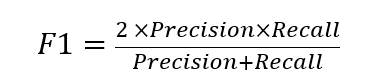

Wynik F1 pokazuje naszą docelową metrykę, która jest średnią harmoniczną precyzji i przypomnienia. Ponieważ nasz zestaw danych jest niezrównoważony na korzyść wielu prognoz „nie”, F1 bierze pod uwagę zarówno FP, jak i FN, aby nadać taką samą wagę precyzji i przypomnieniu.

Raport wyjaśnia, jak interpretować te wskaźniki. Może to pomóc, jeśli nie znasz tych terminów. W naszym przykładzie precyzja i przypominanie są ważnymi metrykami dla problemu klasyfikacji binarnej, ponieważ są używane do obliczania wyniku F1. W raporcie wyjaśniono, że wynik F1 może wahać się od 0 do 1. Najlepsze możliwe wyniki zostaną ocenione jako 1, podczas gdy 0 oznacza najgorsze. Pamiętaj, że wynik F1 naszego modelu to 0.61.

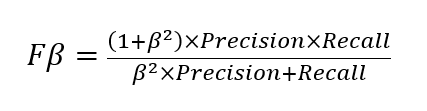

Wynik Fβ jest ważoną średnią harmoniczną precyzji i pamięci. Co więcej, wynik F1 jest taki sam jak Fβ z β=1. Raport zawiera wynik Fβ klasyfikatora, gdzie β przyjmuje wartości 0.5, 1 i 2.

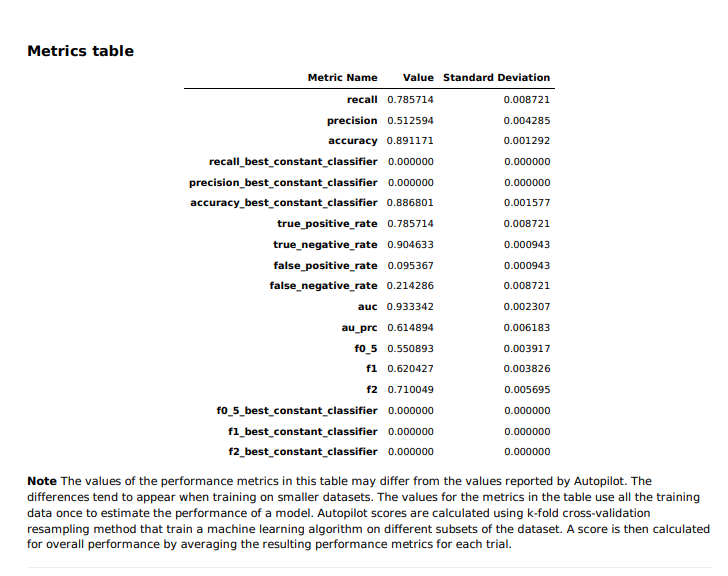

Tabela metryk

W zależności od problemu może się okazać, że SageMaker Autopilot maksymalizuje inną metrykę, taką jak dokładność, dla problemu z klasyfikacją wieloklasową. Niezależnie od rodzaju problemu raporty jakości modelu tworzą tabelę podsumowującą metryki modelu dostępne zarówno w tekście, jak iw raporcie PDF. Możesz dowiedzieć się więcej o tabeli metryk w dokumentacja.

Najlepszy stały klasyfikator — klasyfikator, który służy jako prosta linia bazowa do porównania z innymi, bardziej złożonymi klasyfikatorami — zawsze przewiduje stałą większościową etykietę dostarczoną przez użytkownika. W naszym przypadku model „stały” przewidywałby „nie”, ponieważ jest to najczęstsza klasa i uważana za etykietę negatywną. Metryki dla wytrenowanych modeli klasyfikatorów (takich jak f1, f2 lub przywołanie) można porównać z tymi dla stałego klasyfikatora, tj. linii bazowej. Daje to pewność, że przeszkolony model działa lepiej niż stały klasyfikator. Wyniki Fβ (f0_5, f1 i f2, gdzie β przyjmuje odpowiednio wartości 0.5, 1 i 2) to ważona średnia harmoniczna precyzji i pamięci. Osiąga to swoją optymalną wartość przy 1, a najgorszą wartość przy 0.

W naszym przypadku najlepszy stały klasyfikator zawsze przewiduje „nie”. W związku z tym dokładność jest wysoka i wynosi 0.89, ale wyniki przypomnienia, precyzji i Fβ wynoszą 0. Jeśli zbiór danych jest idealnie zrównoważony, gdy nie ma jednej klasy większościowej lub mniejszościowej, zobaczylibyśmy znacznie bardziej interesujące możliwości dotyczące precyzji, przypomnienia, i wyniki Fβ stałego klasyfikatora.

Ponadto możesz wyświetlić te wyniki w formacie JSON, jak pokazano w poniższym przykładzie. Możesz uzyskać dostęp zarówno do plików PDF, jak i JSON za pośrednictwem interfejsu użytkownika, a także Zestaw SDK Amazon SageMaker dla Pythona używając elementu S3OutputPath w Konfiguracja danych wyjściowych struktura w UtwórzAutoMLJob/OpiszAutoMLJob Odpowiedź API.

{ "version" : 0.0, "dataset" : { "item_count" : 9152, "evaluation_time" : "2022-03-16T20:49:18.661Z" }, "binary_classification_metrics" : { "confusion_matrix" : { "no" : { "no" : 7468, "yes" : 648 }, "yes" : { "no" : 295, "yes" : 741 } }, "recall" : { "value" : 0.7152509652509652, "standard_deviation" : 0.00439996600081394 }, "precision" : { "value" : 0.5334773218142549, "standard_deviation" : 0.007335840278445563 }, "accuracy" : { "value" : 0.8969624125874126, "standard_deviation" : 0.0011703516093899595 }, "recall_best_constant_classifier" : { "value" : 0.0, "standard_deviation" : 0.0 }, "precision_best_constant_classifier" : { "value" : 0.0, "standard_deviation" : 0.0 }, "accuracy_best_constant_classifier" : { "value" : 0.8868006993006993, "standard_deviation" : 0.0016707401772078998 }, "true_positive_rate" : { "value" : 0.7152509652509652, "standard_deviation" : 0.00439996600081394 }, "true_negative_rate" : { "value" : 0.9201577131591917, "standard_deviation" : 0.0010233756436643213 }, "false_positive_rate" : { "value" : 0.07984228684080828, "standard_deviation" : 0.0010233756436643403 }, "false_negative_rate" : { "value" : 0.2847490347490348, "standard_deviation" : 0.004399966000813983 },

………………….

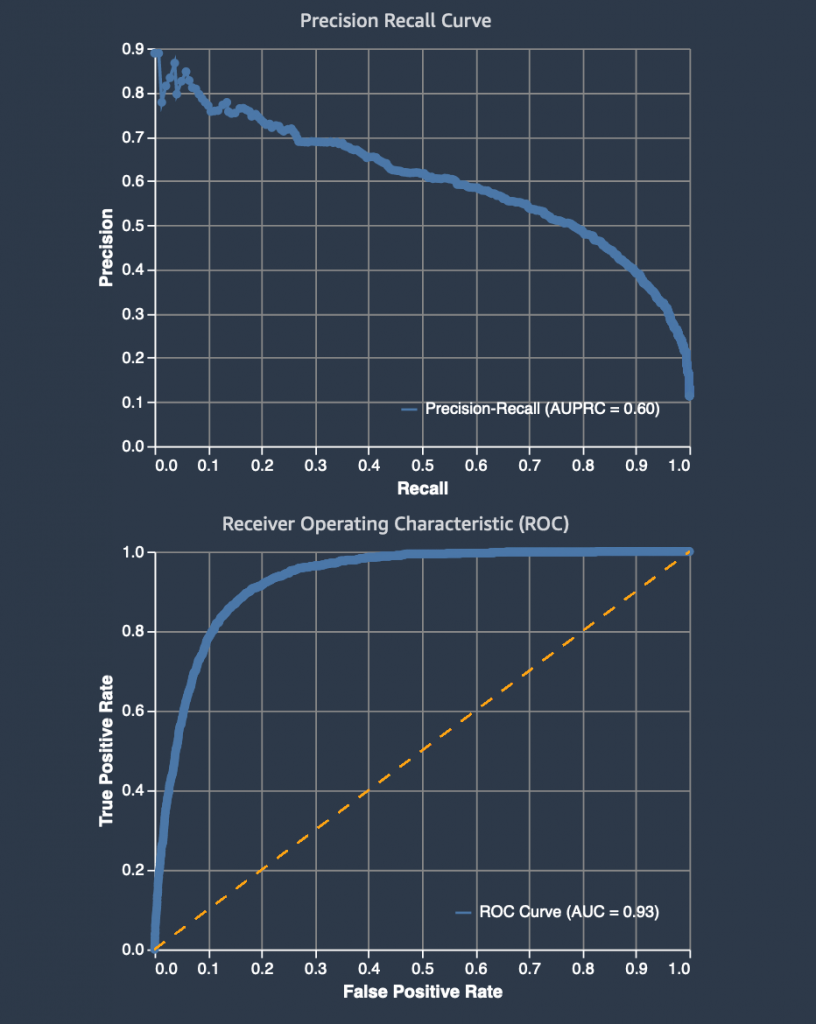

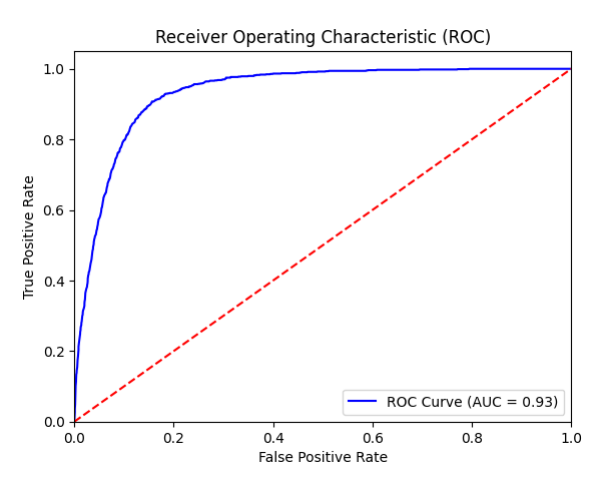

ROC i AUC

W zależności od typu problemu możesz mieć różne progi dla tego, co jest akceptowalne jako FPR. Na przykład, jeśli próbujesz przewidzieć, czy klient otworzy konto, może być bardziej akceptowalne dla firmy, aby mieć wyższą stawkę FP. Pominięcie oferty dla klientów, którym błędnie przewidziano „nie”, może być bardziej ryzykowne niż oferowanie klientom, którym błędnie przewidziano „tak”. Zmiana tych progów w celu uzyskania różnych FPR wymaga utworzenia nowych macierzy zamieszania.

Algorytmy klasyfikacji zwracają ciągłe wartości znane jako prawdopodobieństwa predykcji. Te prawdopodobieństwa muszą zostać przekształcone na wartość binarną (dla klasyfikacji binarnej). W problemach klasyfikacji binarnej próg (lub próg decyzyjny) jest wartością, która dzieli prawdopodobieństwa na prostą decyzję binarną. Dla znormalizowanych przewidywanych prawdopodobieństw w zakresie od 0 do 1 próg jest domyślnie ustawiony na 0.5.

W przypadku binarnych modeli klasyfikacji użyteczną miarą oceny jest obszar pod krzywą ROC (Receiver Operating Characteristic). Raport jakości modelu zawiera wykres ROC ze współczynnikiem TP na osi y i FPR na osi x. Obszar pod charakterystyką działania odbiornika (AUC-ROC) reprezentuje kompromis między TPR i FPR.

Krzywą ROC tworzy się, biorąc binarny predyktor klasyfikacji, który używa wartości progowej, i przypisując etykiety z prawdopodobieństwem predykcji. Zmieniając próg dla modelu, pokrywasz się z dwoma skrajnościami. Kiedy zarówno TPR, jak i FPR są równe 0, oznacza to, że wszystko jest oznaczone jako „nie”, a gdy zarówno TPR, jak i FPR wynoszą 1, oznacza to, że wszystko jest oznaczone jako „tak”.

Losowy predyktor, który oznacza „Tak” w połowie przypadków i „Nie” w drugiej połowie, miałby ROC, który jest prostą ukośną linią (czerwona linia przerywana). Ta linia przecina kwadrat jednostkowy na dwa trójkąty tej samej wielkości. Zatem pole pod krzywą wynosi 0.5. Wartość AUC-ROC równa 0.5 oznaczałaby, że twój predyktor nie byłby lepszy w rozróżnianiu między dwiema klasami niż losowe zgadywanie, czy klient otworzy konto, czy nie. Im wartość AUC-ROC jest bliższa 1.0, tym lepsze są jej prognozy. Wartość poniżej 0.5 wskazuje, że moglibyśmy sprawić, by nasz model generował lepsze prognozy, odwracając odpowiedź, którą nam daje. Dla naszego najlepszego modelu AUC wynosi 0.93.

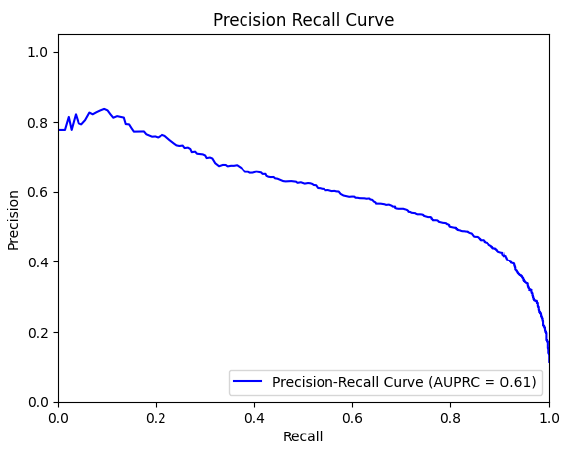

Krzywa przywołania precyzji

W raporcie jakości modelu utworzono również krzywą odtworzenia precyzji (PR), aby wykreślić precyzję (oś y) i odtworzenie (oś x) dla różnych progów – podobnie jak krzywa ROC. Krzywe PR, często używane w wyszukiwaniu informacji, stanowią alternatywę dla krzywych ROC w przypadku problemów klasyfikacyjnych z dużą skośnością rozkładu klas.

W przypadku tych niezrównoważonych klas danych krzywe PR stają się szczególnie przydatne, gdy dodatnia klasa mniejszości jest bardziej interesująca niż ujemna klasa większości. Pamiętaj, że nasz model wykazuje precyzję 0.53 i wycofanie 0.72. Ponadto pamiętaj, że najlepszy stały klasyfikator nie rozróżnia „tak” od „nie”. Za każdym razem przewidywałby losową klasę lub stałą klasę.

Krzywa dla zrównoważonego zbioru danych między „tak” a „nie” byłaby poziomą linią na poziomie 0.5, a zatem miałaby pole pod krzywą PR (AUPRC) równe 0.5. Aby utworzyć PRC, wykreślamy różne modele na krzywej przy różnych progach, w taki sam sposób jak krzywa ROC. Dla naszych danych AUPRC wynosi 0.61.

Wynik raportu jakości modelu

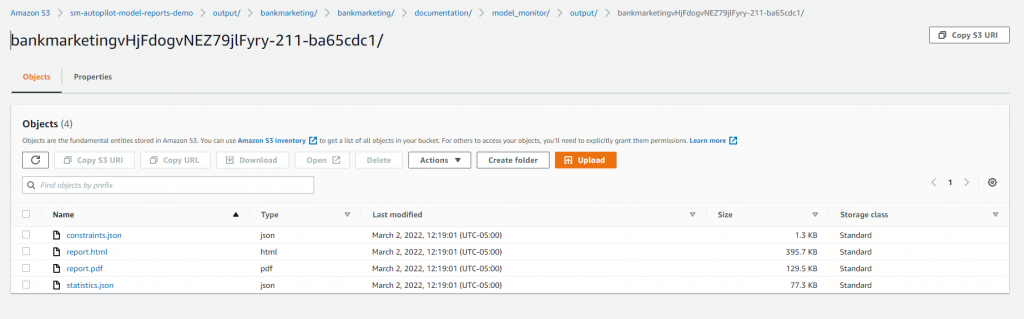

Raport jakości modelu można znaleźć w zasobniku Amazon S3, który określiłeś podczas wyznaczania ścieżki wyjściowej przed uruchomieniem eksperymentu SageMaker AutoPilot. Znajdziesz raporty pod documentation/model_monitor/output/<autopilot model name>/ prefix zapisany jako plik PDF.

Wnioski

Raporty jakości modelu autopilota SageMaker ułatwiają szybkie przeglądanie i udostępnianie wyników eksperymentu autopilota SageMaker. Możesz łatwo ukończyć szkolenie i dostrajanie modelu za pomocą SageMaker Autopilot, a następnie odwoływać się do wygenerowanych raportów w celu interpretacji wyników. Niezależnie od tego, czy ostatecznie użyjesz najlepszego modelu SageMaker Autopilot, czy innego kandydata, wyniki te mogą być pomocnym punktem wyjścia do oceny wstępnego szkolenia i dostrajania modelu. SageMaker Autopilot Model Quality Reports pomaga skrócić czas potrzebny do napisania kodu i tworzenia wizualizacji do oceny i porównania wydajności.

Już dziś możesz z łatwością włączyć autoML do swoich przypadków biznesowych bez konieczności budowania zespołu analityków danych. SageMaker dokumentacja zawiera liczne próbki, które pomogą Ci zacząć.

O autorach

Piotr Chung jest architektem rozwiązań dla AWS i pasjonuje się pomaganiem klientom w odkrywaniu wniosków z ich danych. Tworzył rozwiązania pomagające organizacjom w podejmowaniu decyzji opartych na danych zarówno w sektorze publicznym, jak i prywatnym. Posiada wszystkie certyfikaty AWS oraz dwa certyfikaty GCP. Lubi kawę, gotować, być aktywnym i spędzać czas z rodziną.

Piotr Chung jest architektem rozwiązań dla AWS i pasjonuje się pomaganiem klientom w odkrywaniu wniosków z ich danych. Tworzył rozwiązania pomagające organizacjom w podejmowaniu decyzji opartych na danych zarówno w sektorze publicznym, jak i prywatnym. Posiada wszystkie certyfikaty AWS oraz dwa certyfikaty GCP. Lubi kawę, gotować, być aktywnym i spędzać czas z rodziną.

Arunprasath Shankar jest specjalistą ds. rozwiązań w zakresie sztucznej inteligencji i uczenia maszynowego (AI / ML) w AWS, pomagając globalnym klientom skutecznie i wydajnie skalować rozwiązania AI w chmurze. W wolnym czasie Arun lubi oglądać filmy science fiction i słuchać muzyki klasycznej.

Arunprasath Shankar jest specjalistą ds. rozwiązań w zakresie sztucznej inteligencji i uczenia maszynowego (AI / ML) w AWS, pomagając globalnym klientom skutecznie i wydajnie skalować rozwiązania AI w chmurze. W wolnym czasie Arun lubi oglądać filmy science fiction i słuchać muzyki klasycznej.

Ali Takbiri jest specjalistą ds. rozwiązań AI/ML i pomaga klientom za pomocą uczenia maszynowego rozwiązywać ich wyzwania biznesowe w chmurze AWS.

Ali Takbiri jest specjalistą ds. rozwiązań AI/ML i pomaga klientom za pomocą uczenia maszynowego rozwiązywać ich wyzwania biznesowe w chmurze AWS.

Pradeepa Reddy'ego jest starszym menedżerem produktu w zespole SageMaker Low/No Code ML, który obejmuje SageMaker Autopilot, SageMaker Automatic Model Tuner. Poza pracą Pradeep lubi czytać, biegać i geekować z komputerami wielkości dłoni, takimi jak raspberry pi, i innymi technologiami automatyki domowej.

Pradeepa Reddy'ego jest starszym menedżerem produktu w zespole SageMaker Low/No Code ML, który obejmuje SageMaker Autopilot, SageMaker Automatic Model Tuner. Poza pracą Pradeep lubi czytać, biegać i geekować z komputerami wielkości dłoni, takimi jak raspberry pi, i innymi technologiami automatyki domowej.

- Coinsmart. Najlepsza w Europie giełda bitcoinów i kryptowalut.

- Platoblockchain. Web3 Inteligencja Metaverse. Wzmocniona wiedza. DARMOWY DOSTĘP.

- CryptoJastrząb. Radar Altcoin. Bezpłatna wersja próbna.

- Źródło: https://aws.amazon.com/blogs/machine-learning/automatically-generate-model-evaluation-metrics-using-sagemaker-autopilot-model-quality-reports/

- "

- 100

- 7

- O nas

- dostęp

- Konto

- aktywny

- zaawansowany

- AI

- Algorytmy

- Wszystkie kategorie

- Amazonka

- wśród

- Inne

- api

- POWIERZCHNIA

- sztuczny

- sztuczna inteligencja

- Sztuczna inteligencja i uczenie maszynowe

- atrybuty

- Automatyzacja

- dostępny

- AWS

- Bank

- Baseline

- stają się

- BEST

- granica

- Pudełko

- budować

- Budowanie

- biznes

- Etui

- wyzwania

- Dodaj

- klasa

- Klasy

- klasyfikacja

- bliższy

- Chmura

- kod

- Kawa

- Kolumna

- w porównaniu

- kompleks

- komputery

- zamieszanie

- zawiera

- Koszty:

- mógłby

- stworzony

- Tworzenie

- krzywa

- Klientów

- dane

- nauka danych

- zbiór danych

- wykazać

- rozwijać

- wdrażanie

- Wykrywanie

- ZROBIŁ

- różne

- bezpośrednio

- 分配

- z łatwością

- Punkt końcowy

- Inżynieria

- szczególnie

- wszystko

- przykład

- eksperyment

- członków Twojej rodziny

- Cecha

- W końcu

- znajduje

- i terminów, a

- Elastyczność

- Skupiać

- następujący

- format

- Generować

- Globalne

- dobry

- mający

- pomoc

- pomocny

- pomaga

- Wysoki

- wyższy

- posiada

- Strona główna

- Automatyka domowa

- W jaki sposób

- How To

- HTTPS

- ICON

- tożsamość

- ważny

- zawierać

- Informacja

- spostrzeżenia

- Inteligencja

- IT

- Praca

- znany

- Etykiety

- duży

- większe

- UCZYĆ SIĘ

- nauka

- Dźwignia

- Linia

- Słuchanie

- lokalizacja

- maszyna

- uczenie maszynowe

- Większość

- WYKONUJE

- i konserwacjami

- kierownik

- Marketing

- Matrix

- zmierzyć

- Metryka

- mniejszość

- ML

- model

- modele

- jeszcze

- większość

- Kino

- Muzyka

- numer

- liczny

- oferuje

- Oferty

- koncepcja

- otwarcie

- operacyjny

- Opcje

- organizacji

- Inne

- namiętny

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- punkt

- pozytywny

- możliwości

- możliwy

- potencjał

- przewidzieć

- przepowiednia

- Przewidywania

- teraźniejszość

- prywatny

- Problem

- problemy

- produkować

- Produkt

- Produkcja

- zapewniać

- zapewnia

- publiczny

- jakość

- szybko

- zasięg

- Czytający

- zmniejszyć

- raport

- Raporty

- reprezentuje

- Zasoby

- odpowiedź

- Efekt

- bieganie

- Skala

- nauka

- Sektory

- zestaw

- Share

- Prosty

- So

- Rozwiązania

- ROZWIĄZANIA

- spam

- Spędzanie

- Kwadratowa

- rozpoczęty

- Rynek

- przechowywanie

- studio

- cel

- zespół

- tech

- Przez

- czas

- już dziś

- TPR

- Trening

- pociągi

- ui

- odkryć

- zrozumieć

- us

- posługiwać się

- wartość

- różnorodny

- Zobacz i wysłuchaj

- widoczność

- czy

- KIM

- bez

- Praca

- by