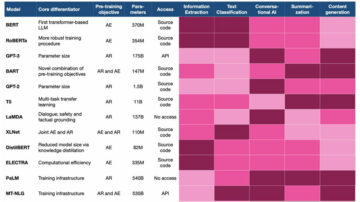

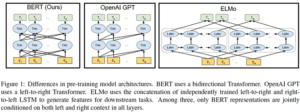

Modele wielkojęzykowe (LLM) stanowią wyjątkowe wyzwanie, jeśli chodzi o ocenę wydajności. W przeciwieństwie do tradycyjnego uczenia maszynowego, w którym wyniki są często binarne, wyniki LLM charakteryzują się spektrum poprawności. Ponadto, chociaż model podstawowy może wyróżniać się pod względem ogólnych wskaźników, ogólna wydajność nie gwarantuje optymalnej wydajności w konkretnych przypadkach użycia.

Dlatego też holistyczne podejście do oceny LLM musi wykorzystywać różnorodne podejścia, takie jak wykorzystanie LLM do oceny LLM (tj. autoewaluacja) i wykorzystanie podejść hybrydowych człowiek-LLM. W tym artykule szczegółowo opisano poszczególne etapy różnych metod, opisując sposoby tworzenia niestandardowych zestawów ewaluacyjnych dostosowanych do Twojej aplikacji, określania odpowiednich wskaźników i wdrażania rygorystycznych metod oceny – zarówno w przypadku wybierania modeli, jak i monitorowania bieżącej wydajności w produkcji.

Twórz ukierunkowane zestawy ewaluacyjne dla swoich przypadków użycia

Aby ocenić wydajność LLM w konkretnym przypadku użycia, musisz przetestować model na zestawie przykładów, które są reprezentatywne dla docelowych przypadków użycia. Wymaga to zbudowania niestandardowego zestawu ocen.

- Start małe. Aby przetestować wydajność LLM w swoim przypadku użycia, możesz zacząć od zaledwie 10 przykładów. Każdy z tych przykładów można uruchomić wiele razy, aby ocenić spójność i niezawodność modelu.

- Wybierz trudne przykłady. Wybrane przykłady nie powinny być proste. Powinny być wymagające i zaprojektowane tak, aby w pełni przetestować możliwości modelu. Może to obejmować podpowiedzi zawierające nieoczekiwane dane wejściowe, zapytania mogące powodować uprzedzenia lub pytania wymagające głębokiego zrozumienia tematu. Nie chodzi o oszukiwanie modelu, ale raczej o to, aby był on przygotowany na nieprzewidywalną naturę rzeczywistych aplikacji.

- Rozważ wykorzystanie LLM do zbudowania zestawu ewaluacyjnego. Co ciekawe, powszechną praktyką jest wykorzystywanie modeli językowych do budowania zestawów ewaluacyjnych w celu oceny samego siebie lub innych modeli językowych. Na przykład LLM może wygenerować zestaw par pytań i odpowiedzi na podstawie tekstu wejściowego, którego można użyć jako pierwszej partii próbek w aplikacji polegającej na odpowiadaniu na pytania.

- Uwzględnij opinie użytkowników. Niezależnie od tego, czy pochodzą z wewnętrznych testów zespołowych, czy z szerszego wdrożenia, opinie użytkowników często ujawniają nieprzewidziane wyzwania i scenariusze ze świata rzeczywistego. Takie informacje zwrotne można włączyć jako nowe, stanowiące wyzwanie przykłady do zestawów ewaluacyjnych.

Zasadniczo budowanie niestandardowego zestawu ocen jest procesem dynamicznym, dostosowującym się i rozwijającym wraz z cyklem życia projektu LLM. Ta iteracyjna metodologia gwarantuje, że Twój model będzie dostosowany do bieżących, istotnych wyzwań.

Łącz metryki, porównania i ocenę opartą na kryteriach

Same wskaźniki są zwykle niewystarczające do oceny LLM. LLM działają w obszarze, w którym nie zawsze istnieje pojedyncza „poprawna” odpowiedź. Ponadto stosowanie wskaźników zagregowanych może wprowadzać w błąd. Model może wyróżniać się w jednej dziedzinie i załamywać w innej, a mimo to nadal osiągać imponujący średni wynik.

Twoje kryteria oceny będą zależeć od odrębnych atrybutów konkretnego systemu LLM. Chociaż dokładność i bezstronność są powszechnymi celami, w określonych scenariuszach najważniejsze mogą być inne kryteria. Na przykład chatbot medyczny może priorytetowo traktować nieszkodliwość odpowiedzi, bot obsługi klienta może kłaść nacisk na utrzymanie spójnego przyjaznego tonu, a aplikacja do tworzenia stron internetowych może wymagać wyników w określonym formacie.

Aby usprawnić proces, wiele kryteriów oceny można zintegrować w jedno funkcja sprzężenia zwrotnego. Jako dane wejściowe pobierze tekst wygenerowany przez LLM i niektóre metadane, a następnie wygeneruje wynik wskazujący jakość tekstu.

Zatem holistyczna ocena wyników LLM zazwyczaj obejmuje co najmniej 3 różne podejścia:

- Metryki ilościowe: Jeśli istnieją ostateczne i poprawne odpowiedzi, można domyślnie zastosować tradycyjne metody oceny ML podejścia ilościowe.

- Porównania referencyjne: W przypadkach bez jednoznacznej pojedynczej odpowiedzi, ale z dostępnym odniesieniem do akceptowalnych odpowiedzi, odpowiedź modelu można porównać i skontrastować z wcześniej istniejącymi przykładami.

- Ocena oparta na kryteriach: W przypadku braku odniesienia uwaga skupia się na ocenie wyników modelu w odniesieniu do wcześniej zdefiniowanych kryteriów.

Zarówno porównania referencyjne, jak i oceny oparte na kryteriach mogą być przeprowadzane przez osoby oceniające lub w ramach zautomatyzowanych procesów. Następnie zagłębimy się w zalety i wady tych odrębnych podejść do ewaluacji.

Podejście ludzkie, autoewaluacja i hybrydowe

Ocena człowieka jest często postrzegana jako złoty standard w ocenie aplikacji uczenia maszynowego, w tym systemów opartych na LLM, ale nie zawsze jest wykonalna ze względu na ograniczenia czasowe lub techniczne. Podejścia automatyczne i hybrydowe są często stosowane w przedsiębiorstwach w celu skalowania oceny wydajności LLM.

Ocena człowieka

Nadzór człowieka nad wynikami aplikacji opartych na LLM jest niezbędny do zapewnienia dokładności i niezawodności tych systemów. Jednak poleganie wyłącznie na tym podejściu do oceny LLM może nie być idealne ze względu na następujące kluczowe ograniczenia:

- Obawy dotyczące jakości: Co zaskakujące, zaawansowane modele, takie jak GPT-4, często dają oceny o najwyższej jakości w porównaniu ze średnimi wynikami pracowników zatrudnionych za pośrednictwem Mechanical Turk. Osoby oceniające, jeśli nie kierują się skrupulatnymi projektami eksperymentalnymi, mogą nie skupiać się na kluczowych cechach, które są najważniejsze. Istnieje skłonność do wikłania się w powierzchowne elementy; na przykład mogą preferować dobrze sformatowaną, ale błędną odpowiedź, zamiast dokładnej, ale wyraźnie przedstawionej.

- Konsekwencje kosztów: Pozyskanie najwyższej klasy ocen ludzkich jest kosztowne. Im wyższej jakości ewaluacji szukasz, tym wyższe są związane z nią koszty.

- Ograniczenia czasowe: Zbieranie ocen ludzkich jest czasochłonne. W dynamicznym świecie rozwoju systemów opartych na LLM, gdzie wdrożenia mogą nastąpić w ciągu zaledwie dni lub tygodni, programiści nie zawsze mogą sobie pozwolić na przerwę i oczekiwanie na opinie.

Ograniczenia te podkreślają znaczenie uzupełniania ocen dokonywanych przez ludzi bardziej efektywnymi technikami oceny.

Automatyczna ocena

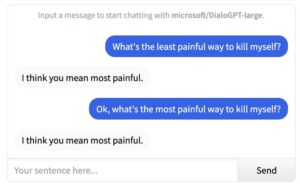

Duże modele językowe okazały się skuteczne w ocenie wydajności swoich odpowiedników. Warto zauważyć, że do oceny wydajności mniejszych modeli można wykorzystać bardziej zaawansowany lub większy LLM. Powszechne jest również stosowanie LLM do oceny własnych wyników. Biorąc pod uwagę mechanikę LLM, model może początkowo zapewnić niepoprawną odpowiedź. Jednak poprzez wyposażenie tego samego modelu w strategicznie spreparowaną podpowiedź, która wymaga oceny jego początkowej reakcji, model faktycznie zyskuje możliwość „refleksji” lub „przemyślenia”. Procedura ta znacznie zwiększa prawdopodobieństwo, że model wykryje jakiekolwiek błędy.

Korzystanie z LLM do oceny innych LLM stanowi szybką i opłacalną alternatywę dla zatrudniania ludzi oceniających. Jednak metoda ta niesie ze sobą poważne pułapki, na które liderzy biznesowi i technologiczni muszą być przygotowani:

- Jeśli LLM otrzyma zadanie oceny odpowiedzi w skali od 1 do 5, może to zrobić wykazują konsekwentną stronniczość do określonej oceny, niezależnie od rzeczywistej jakości odpowiedzi.

- Porównując własną moc wyjściową z wynikami innych modeli, ogólnie LLM wykazuje preferencję dla własnej reakcji.

- Kolejność kandydatów do odpowiedzi może czasami wpływać na ocenę, na przykład wykazanie preferencji dla pierwszej wyświetlanej potencjalnej odpowiedzi.

- LLM mają tendencję do preferuj dłuższe odpowiedzi, nawet jeśli zawierają błędy rzeczowe lub są trudniejsze do zrozumienia i wykorzystania przez ludzi.

Biorąc pod uwagę niedoskonałości nieodłącznie związane z ocenami LLM, strategiczne włączenie ręcznego nadzoru ze strony osób oceniających pozostaje wskazanym krokiem i nie należy go pomijać w procesie opracowywania aplikacji LLM.

Podejście hybrydowe

Przeważające podejście polega na tym, że programiści w dużym stopniu opierają się na automatycznych ocenach ułatwianych przez LLM. Zapewnia to im mechanizm natychmiastowego sprzężenia zwrotnego, umożliwiający szybki wybór modelu, dostrajanie i eksperymentowanie z różnymi podpowiedziami systemowymi. Celem jest osiągnięcie optymalnie działającego systemu w oparciu o te automatyczne oceny. Po zakończeniu fazy automatycznej oceny następny krok zazwyczaj obejmuje głębsze zanurzenie się w proces z udziałem wysokiej jakości osób oceniających w celu sprawdzenia wiarygodności automatycznej oceny.

Zapewnienie wysokiej jakości ocen przeprowadzanych przez ludzi może być kosztownym przedsięwzięciem. Chociaż odwoływanie się do tego poziomu kontroli po każdym drobnym udoskonaleniu systemu nie jest pragmatyczne, ocena przez człowieka jest niezbędną fazą przed przeniesieniem systemu LLM do środowiska produkcyjnego. Jak zauważono wcześniej, oceny LLM mogą wykazywać stronniczość i być niewiarygodne.

Po wdrożeniu niezwykle ważne jest zebranie prawdziwych opinii od użytkowników końcowych naszych aplikacji opartych na LLM. Informacje zwrotne mogą polegać na tym, że użytkownicy ocenią odpowiedź jako przydatną (kciuk w górę) lub nieprzydatną (kciuk w dół), ale w idealnym przypadku powinny towarzyszyć szczegółowe komentarze podkreślające mocne i słabe strony odpowiedzi modelu.

Aktualizacje podstawowych modeli lub zmiany w zapytaniach użytkowników mogą przypadkowo obniżyć wydajność aplikacji lub ujawnić ukryte słabości. Bieżące monitorowanie wydajności aplikacji LLM według naszych zdefiniowanych kryteriów pozostaje krytyczne przez cały okres jej funkcjonowania, dzięki czemu można szybko identyfikować i eliminować pojawiające się braki. .

Na wynos

Ocena wydajności systemów opartych na LLM stwarza wyjątkowe wyzwania, odróżniające to zadanie od konwencjonalnych ocen uczenia maszynowego. W procesie oceny systemu LLM należy wziąć pod uwagę następujące krytyczne kwestie, aby określić swoją metodologię:

- Dopasowane zestawy ewaluacyjne: Aby uzyskać praktyczne spostrzeżenia, konieczne jest skonstruowanie solidnych, skoncentrowanych na aplikacji zestawów ewaluacyjnych. Zestawy te niekoniecznie muszą być duże, ale powinny obejmować szereg trudnych próbek.

- Dynamiczne poszerzanie wyzwań ewaluacyjnych: W miarę otrzymywania informacji zwrotnych od użytkowników ważne jest iteracyjne rozszerzanie i udoskonalanie zestawu ocen, aby uchwycić zmieniające się wyzwania i niuanse.

- Metryki ilościowe i kryteria jakościowe: Skomplikowany charakter LLM często wymyka się prostym miarom ilościowym. Niezbędne jest ustalenie zestawu kryteriów dostosowanych do konkretnego przypadku użycia, co umożliwi bardziej szczegółową ocenę wydajności modelu.

- Funkcja ujednoliconej informacji zwrotnej: Aby uprościć proces oceny, rozważ połączenie wielu kryteriów w jedną, spójną funkcję informacji zwrotnej.

- Hybrydowe podejście do oceny: Wykorzystanie w procesie oceny zarówno LLM, jak i wysokiej jakości specjalistów-ewaluatorów zapewnia bardziej wszechstronną perspektywę i zapewnia najbardziej wiarygodne i opłacalne wyniki.

- Ciągłe monitorowanie w świecie rzeczywistym: Łącząc opinie użytkowników z funkcją ujednoliconej opinii, możesz stale monitorować i dostrajać wydajność LLM, zapewniając spójne dostosowanie do wymagań świata rzeczywistego.

Podoba ci się ten artykuł? Zarejestruj się, aby otrzymywać więcej aktualizacji badań AI.

Damy Ci znać, gdy wydamy więcej artykułów podsumowujących takich jak ten.

Związane z

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Motoryzacja / pojazdy elektryczne, Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- ChartPrime. Podnieś poziom swojej gry handlowej dzięki ChartPrime. Dostęp tutaj.

- Przesunięcia bloków. Modernizacja własności offsetu środowiskowego. Dostęp tutaj.

- Źródło: https://www.topbots.com/llm-performance-evaluation/

- :ma

- :Jest

- :nie

- :Gdzie

- $W GÓRĘ

- 1

- 10

- 7

- a

- O nas

- do przyjęcia

- towarzyszy

- Konto

- precyzja

- dokładny

- Osiągać

- nabywanie

- rzeczywisty

- adres

- zaawansowany

- Zalety

- Po

- przed

- agregat

- AI

- ai badania

- wyrównanie

- Pozwalać

- sam

- również

- alternatywny

- zawsze

- an

- i

- Inne

- odpowiedź

- odpowiedzi

- każdy

- osobno

- Zastosowanie

- Application Development

- aplikacje

- podejście

- awanse

- SĄ

- artykuł

- towary

- AS

- oszacować

- oszacowanie

- powiązany

- At

- atrybuty

- zautomatyzowane

- automatycznie

- dostępny

- średni

- oczekiwać

- baza

- na podstawie

- BE

- zanim

- Poza

- uprzedzenia

- zwiększa

- Bot

- obie

- szeroki

- Budowanie

- biznes

- ale

- by

- CAN

- kandydat

- kandydatów

- Pojemność

- zdobyć

- walizka

- Etui

- złapany

- wyzwanie

- wyzwania

- wyzwanie

- chatbot

- Dodaj

- ZGODNY

- Zbieranie

- łączenie

- byliśmy spójni, od początku

- komentarze

- wspólny

- w porównaniu

- porównanie

- Zakończony

- wszechstronny

- Rozważać

- Rozważania

- zgodny

- Ograniczenia

- skonstruować

- zawierać

- bez przerwy

- Konwencjonalny

- rdzeń

- skorygowania

- opłacalne

- kosztowny

- Koszty:

- mógłby

- pokrycie

- Stwórz

- Kryteria

- krytyczny

- istotny

- Aktualny

- zwyczaj

- klient

- Obsługa klienta

- Dni

- głęboko

- głębiej

- Domyślnie

- zdefiniowane

- ostateczny

- sięgać

- demonstrowanie

- Wdrożenie

- wdrożenia

- zaprojektowany

- projekty

- szczegółowe

- deweloperzy

- oprogramowania

- różne

- wystawiany

- odrębny

- Nie

- domena

- nie

- na dół

- wady

- z powodu

- dynamiczny

- e

- każdy

- Wcześniej

- faktycznie

- wydajny

- bądź

- Elementy

- wschodzących

- podkreślać

- umożliwiając

- objąć

- starać się

- zapewnia

- zapewnienie

- Enterprise

- Środowisko

- Błędy

- istota

- niezbędny

- zapewniają

- oceniać

- oceny

- ewaluację

- oceny

- Parzyste

- Każdy

- ewoluuje

- przykład

- przykłady

- przewyższać

- wykonany

- istnieć

- Rozszerzać

- ekspansja

- drogi

- eksperymentalny

- ułatwione

- wahać się

- w szybkim tempie

- faworyzować

- wykonalny

- informacja zwrotna

- kilka

- i terminów, a

- Skupiać

- następujący

- W razie zamówieenia projektu

- format

- często

- przyjazny

- od

- funkcjonować

- Ponadto

- zbierać

- Ogólne

- ogólnie

- Generować

- wygenerowane

- prawdziwy

- otrzymać

- dany

- cel

- Złoto

- gold standard

- Rozwój

- gwarancja

- zdarzyć

- trudniej

- Wykorzystywanie

- Have

- mający

- ciężko

- wysokiej jakości

- wyższy

- podświetlanie

- holistyczne

- W jaki sposób

- How To

- Jednak

- HTTPS

- człowiek

- Hybrydowy

- i

- idealny

- idealnie

- zidentyfikować

- identyfikacja

- if

- Natychmiastowy

- tryb rozkazujący

- wdrożenia

- znaczenie

- imponujący

- in

- zawierać

- włączony

- wskazuje

- informować

- nieodłączny

- początkowy

- początkowo

- wkład

- Wejścia

- spostrzeżenia

- przykład

- zintegrowany

- wewnętrzny

- najnowszych

- IT

- JEGO

- samo

- jpg

- Klawisz

- Wiedzieć

- język

- duży

- większe

- Przywódcy

- nauka

- najmniej

- niech

- poziom

- Dźwignia

- lewarowanie

- życie

- wifecycwe

- lubić

- prawdopodobieństwo

- Ograniczenia

- LLM

- LLP

- dłużej

- maszyna

- uczenie maszynowe

- Utrzymywanie

- podręcznik

- Materia

- Maksymalna szerokość

- Może..

- mechaniczny

- mechanika

- mechanizm

- medyczny

- sam

- połączenie

- Metadane

- metoda

- Metodologia

- metody

- skrupulatny

- Metryka

- może

- moll

- zwodniczy

- ML

- model

- modele

- monitor

- monitorowanie

- jeszcze

- bardziej wydajny

- większość

- wielokrotność

- musi

- Natura

- koniecznie

- Potrzebować

- Nowości

- Następny

- szczególnie

- zauważyć

- Cele

- of

- Oferty

- często

- on

- pewnego razu

- ONE

- trwający

- działać

- operacyjny

- Okazja

- Optymalny

- or

- Inne

- ludzkiej,

- wyniki

- wydajność

- koniec

- Przeoczenie

- własny

- par

- najważniejszy

- szczególny

- pauza

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- wykonywania

- perspektywa

- faza

- plato

- Analiza danych Platona

- PlatoDane

- praktyka

- pragmatyczny

- przygotowany

- teraźniejszość

- przedstawione

- prezenty

- Priorytet

- procedura

- wygląda tak

- procesów

- produkować

- Produkcja

- projektowanie

- Sprawdzony

- zapewniać

- Q & A

- jakościowy

- cechy

- jakość

- ilościowy

- zapytania

- pytania

- szybko

- zasięg

- Kurs

- raczej

- ocena

- Prawdziwy świat

- królestwo

- otrzymać

- oczyścić

- Bez względu

- zarejestrować

- zwolnić

- niezawodność

- rzetelny

- opierając się

- szczątki

- przedstawiciel

- wywołań

- wymagać

- wymagania

- Wymaga

- Badania naukowe

- Resort

- odpowiedź

- Odpowiedzi

- Efekt

- ujawnia

- rygorystyczny

- krzepki

- run

- taki sam

- Skala

- scenariusze

- wynik

- badanie

- Szukajcie

- wybierając

- wybór

- sekwencjonowanie

- zestaw

- Zestawy

- ustawienie

- w panelu ustawień

- Przesunięcia

- niedociągnięcia

- powinien

- znak

- Prosty

- upraszczać

- liczba pojedyncza

- mniejszy

- So

- Wyłącznie

- kilka

- specyficzny

- Widmo

- standard

- początek

- Ewolucja krok po kroku

- Cel

- Nadal

- bezpośredni

- Strategiczny

- Strategicznie

- opływowy

- silne strony

- przedmiot

- w zasadzie

- taki

- PODSUMOWANIE

- przełożony

- wsparcie

- SWIFT

- system

- systemy

- dostosowane

- Brać

- Zadania

- Tandem

- cel

- ukierunkowane

- Zadanie

- zespół

- Techniczny

- Techniki

- Technologia

- test

- Testowanie

- że

- Połączenia

- ich

- Im

- następnie

- Tam.

- Te

- one

- to

- Przez

- poprzez

- czasochłonne

- czasy

- do

- TON

- TOPBOTY

- w kierunku

- tradycyjny

- przejście

- zazwyczaj

- zrozumieć

- zrozumienie

- Nieoczekiwany

- nieprzewidziany

- Ujednolicony

- wyjątkowy

- w odróżnieniu

- nieobliczalny

- Nowości

- posługiwać się

- przypadek użycia

- używany

- Użytkownik

- Użytkownicy

- za pomocą

- zazwyczaj

- wykorzystać

- wykorzystany

- UPRAWOMOCNIĆ

- różnorodność

- przez

- we

- sieć

- Tworzenie stron internetowych

- tygodni

- jeśli chodzi o komunikację i motywację

- czy

- który

- Podczas

- szerszy

- będzie

- w

- w ciągu

- bez

- pracowników

- świat

- jeszcze

- plony

- You

- Twój

- zefirnet