Rosnąca wielkość modeli językowych jest jednym z największych trendów w przetwarzaniu języka naturalnego (NLP) w ostatnich latach. Od 2018 roku byliśmy świadkami bezprecedensowego rozwoju i wdrażania coraz większych modeli językowych, w tym BERT i jego wariantów, GPT-2, T-NLG i GPT-3 (175 miliardów parametrów).

Modele te przesunęły granice możliwych innowacji architektonicznych. Podczas trenowania modeli uczenia głębokiego na dużą skalę stajemy przed kilkoma wyzwaniami, zwłaszcza z nową falą wstępnie przeszkolonych transformatorów generatywnych. Wyzwania te obejmują ograniczenia sprzętowe i kompromisy z obliczeniami i wydajnością. Aby sprostać tym wyzwaniom związanym z równoległością modeli i danych, AWS oferuje szeroki zakres możliwości.

W tym poście przedstawiamy dwa główne podejścia: zrównoleglanie danych i zrównoleglanie modelu za pomocą Amazon Sage Makeri przedyskutuj ich zalety i wady.

Model

Do modelu językowego wykorzystujemy wprowadzone w artykule Transformatory Uwaga jest wszystkim, czego potrzebujesz. Transformatory to modele uczenia głębokiego zaprojektowane w celu celowego unikania pułapek związanych z RNN poprzez poleganie na mechanizmie samouważności do rysowania globalnych zależności między danymi wejściowymi i wyjściowymi. Architektura modelu Transformer pozwala na znacznie lepszą równoległość i może osiągnąć wysoką wydajność w stosunkowo krótkim czasie uczenia. Zbudowany na sukcesie firmy Transformers, BERT, wprowadzonej w gazecie BERT: Wstępne szkolenie z głębokich transformatorów dwukierunkowych do zrozumienia języka, dodano dwukierunkowe szkolenie wstępne dotyczące reprezentacji języka. Zainspirowany zadaniem Cloze, BERT jest wstępnie przeszkolony w zakresie modelowania języka maskowanego (MLM), w którym model uczy się odzyskiwać oryginalne słowa dla losowo zamaskowanych tokenów. Model BERT jest również wstępnie wytrenowany w zadaniu przewidywania następnego zdania (NSP), aby przewidzieć, czy dwa zdania są w prawidłowej kolejności czytania. Od czasu pojawienia się w 2018 roku BERT i jego odmiany są szeroko stosowane w modelach językowych.

Zaczynamy od utworzenia dwóch warstw osadzania do osadzania tokenów i osadzania pozycyjnego. Osadzenia wejściowe są sumą osadzeń tokenów i osadzeń pozycji.

Następnie definiujemy blok dekodera transformatora z dwiema podwarstwami: wielogłowicową warstwą samouwagi i prostą, w pełni połączoną siecią ze sprzężeniem do przodu, po której następuje normalizacja warstwy i zanik:

Na koniec tworzymy nasz model języka z poprzednią warstwą osadzania i blokami transformatora:

W zależności od hiperparametrów możesz skalować ten model od tysięcy parametrów do miliardów parametrów. Podstawowym wyzwaniem związanym z modelami miliardowymi parametrów jest to, że nie można hostować modelu w jednym wystąpieniu i trzeba rozprowadzić model na kilka węzłów w celu uczenia i wnioskowania.

Zbiór danych

W naszych eksperymentach wykorzystaliśmy Zbiór danych stosu. Pile to zbiór danych tekstowych w języku angielskim o wielkości 800 GiB, przeznaczony do trenowania modeli językowych na dużą skalę. Jest tworzony z 22 różnorodnych i wysokiej jakości zbiorów danych, w tym zarówno ustalonych zbiorów danych NLP, jak i nowo wprowadzonych.

Zbiór danych jest tworzony z różnych źródeł danych, w tym książek; repozytoria GitHub; strony internetowe; dzienniki czatów; oraz artykuły z dziedziny medycyny, fizyki, matematyki, informatyki i filozofii. W szczególności korzysta z następujących źródeł: Pile-CC, PubMed Central, ArXiv, GitHub, FreeLaw Project, Stack Exchange, US Patent and Trademark Office, PubMed, Ubuntu, IRC, HackerNews, YouTube, PhilPapers, Books3, Project Gutenberg ( PG-19), OpenSubtitles, angielska Wikipedia, DM Mathematics, EuroParl, korpus Enron Emails oraz NIH ExPorter. Zawiera również OpenWebText2 i BookCorpus2, które są odpowiednio rozszerzeniami oryginalnych zestawów danych OpenWebText i BookCorpus. Różnorodność źródeł danych może poprawić ogólną wiedzę międzydziedzinową, a w konsekwencji poprawić możliwości uogólniania na dalszych etapach.

Głównym wyzwaniem związanym z tym zestawem danych jest sam rozmiar; zestaw danych ma 825 GiB tekstu, co przekłada się na 4.2 TiB wstępnie przetworzonych i skompresowanych punktów danych. Podobnie jak w przypadku wyzwań, przed którymi stoimy w przypadku trenowania i hostowania modeli, trenowanie modelu za pomocą tego zestawu danych w jednym wystąpieniu zajmie dużo czasu i jest niepraktyczne.

Naszym rozwiązaniem jest rozbicie zbioru danych na porcje danych o wielkości około 1 GiB, załadowanie i wstępne przetworzenie funkcji w Zbiór danych TensorFlow przedmiotów i przechowuj je w Elastyczna usługa plików Amazon (Amazon EFS). Zestawy danych TensorFlow zapewniają łatwy w użyciu i wydajny potok danych, który dobrze integruje się z naszymi modelami. Amazon EFS to łatwa w użyciu usługa, która umożliwia nam zbudowanie współdzielonego systemu plików, który skaluje się automatycznie w miarę dodawania i usuwania plików. Ponadto Amazon EFS jest w stanie w razie potrzeby osiągnąć wyższy poziom przepustowości, co ma kluczowe znaczenie w naszym potoku uczenia danych i modeli.

Następnie przyjrzymy się rozproszonym strategiom szkoleniowym, aby sprostać tym wyzwaniom.

Rozproszone szkolenie

W tym projekcie stanęliśmy przed dwoma wyzwaniami: skalowaniem rozmiaru modelu i objętości danych. Zwiększenie rozmiaru modelu i liczby parametrów, które można trenować, może skutkować lepszą dokładnością, ale istnieje ograniczenie modelu, który można zmieścić w jednej pamięci GPU lub nawet w wielu procesorach GPU w jednym wystąpieniu. Ponadto większe rozmiary modeli wymagają więcej czasu na trenowanie.

Możesz stawić czoła tym wyzwaniom na dwa różne sposoby: równoległość danych i równoległość modelu. Dzięki równoległości danych wykonujemy Stochastic Gradient Descent (SGD) poprzez dystrybucję zapisów mini-partii na różne urządzenia w celu przyspieszenia treningu. Jednak równoległe trenowanie danych wiąże się z dodatkową złożonością obliczania średniej gradientu mini-partii z gradientami ze wszystkich urządzeń, krok zwany AllReduce, co staje się trudniejsze w miarę rozwoju klastra szkoleniowego. Korzystając z równoległości danych, musimy być w stanie zmieścić model i pojedynczy punkt danych w urządzeniu (CPU lub GPU), co jest czynnikiem ograniczającym nasze eksperymenty, ponieważ rozmiar tak dużego modelu jest znacznie większy niż pamięć pojedynczego GPU rozmiar.

Innym rozwiązaniem jest użycie równoległości modelu, która dzieli model na wiele urządzeń. Równoległość modelu to proces dzielenia modelu między wiele urządzeń lub węzłów (takich jak wystąpienia wyposażone w procesory GPU) i tworzenia wydajnego potoku do trenowania modelu na tych urządzeniach w celu maksymalizacji wykorzystania procesora GPU.

Równoległość danych

Równoległość danych jest najczęstszym podejściem do wielu procesorów graficznych lub szkolenia rozproszonego. Możesz grupować swoje dane, wysyłać je do wielu urządzeń (każde hostuje replikowany model), a następnie agregować wyniki. Eksperymentowaliśmy z dwoma pakietami do zrównoleglania danych: Horovod i the SageMaker rozproszona równoległa biblioteka danych.

Horovod to rozproszona platforma szkolenia głębokiego dla TensorFlow, Keras, PyTorch i Apache MXNet. Aby użyć Horovod, przeszliśmy przez następujący proces:

- Zainicjuj przez uruchomienie

hvd.init(). - Powiąż każde urządzenie z jednym procesem. Pierwszy proces lub pracownik jest powiązany z pierwszym urządzeniem, drugi proces jest powiązany z drugim urządzeniem i tak dalej.

- Dostosuj szybkość uczenia się na podstawie liczby urządzeń.

- Owiń optymalizator w

hvd.DistributedOptimizer. - Rozgłaszaj stany zmiennej początkowej z pierwszego procesu roboczego z pozycją 0 do wszystkich pozostałych procesów. Jest to konieczne, aby zapewnić spójną inicjalizację wszystkich pracowników, gdy szkolenie rozpoczyna się z losowymi wagami lub przywracane z punktu kontrolnego.

- Upewnij się, że tylko urządzenie 0 może zapisywać punkty kontrolne, aby zapobiec ich uszkodzeniu przez innych pracowników.

Poniżej znajduje się skrypt szkoleniowy:

Biblioteka równoległa danych SageMaker umożliwia nam skalowanie naszego szkolenia z niemal liniową wydajnością, przyspieszając nasze szkolenie przy minimalnych zmianach kodu. Biblioteka wykonuje niestandardowe AllReduce działanie i optymalizuje komunikację między urządzeniami, w pełni wykorzystując infrastrukturę sieciową AWS i Elastyczna chmura obliczeniowa Amazon (Amazon EC2) topologia instancji. Aby użyć równoległej biblioteki danych SageMaker, przeszliśmy przez następujący proces:

- Importuj i inicjuj

sdp.init(). - Powiąż każde urządzenie z jednym

smdistributed.dataparallelprzetwarzać zlocal_rank.sdp.tensorflow.local_rank()daje nam lokalną rangę urządzeń. Lider ma rangę 0, robotnicy mają rangę 1, 2, 3 i tak dalej. - Dostosuj szybkość uczenia się na podstawie liczby urządzeń.

- Owiń

tf.GradientTapewDistributedGradientTapewystępowaćAllReduce. - Roześlij początkowe zmienne modelu z węzła wiodącego do wszystkich węzłów roboczych.

- Upewnij się, że tylko urządzenie 0 może zapisywać punkty kontrolne.

Równoległość modelu

Możemy dostosować hiperparametry, aby model był wystarczająco mały, aby można go było trenować przy użyciu jednego procesora GPU, lub możemy użyć równoległości modelu, aby podzielić model między wiele procesorów GPU w wielu instancjach. Zwiększenie liczby możliwych do trenowania parametrów modelu może skutkować większą dokładnością, ale istnieje limit maksymalnego rozmiaru modelu, który można zmieścić w pojedynczej pamięci GPU. Użyliśmy biblioteki równoległej modelu rozproszonego SageMaker do trenowania naszych większych modeli. Kroki są następujące:

- Zaimportuj i zainicjuj bibliotekę za pomocą

smp.init(). - Model Keras musi dziedziczyć z smp.DistributedModel zamiast z klasy Keras Model.

- Zestaw

drop_remainder=Truetf.Dataset.batch()metoda zapewniająca, że wielkość partii jest zawsze podzielna przez liczbę mikropartii. - Wszystkie operacje losowe w potoku danych muszą używać tego samego materiału siewnego:

smp.dp_rank()Na przykład,shuffle(ds, seed=smp.dp_rank()). Zapewnia to spójność próbek danych na urządzeniach, które przechowują różne partycje modelu. - Logika do przodu i do tyłu musi być funkcją kroku z

smp.stepdekoracja. - Wykonaj przetwarzanie końcowe na wyjściach w mikropartii przy użyciu metod StepOutput, takich jak

reduce_mean,smp.stepfunkcja musi mieć zwracaną wartość, która zależy od wynikusmp.DistributedModel.

Skrypt szkoleniowy wygląda następująco:

Aby uzyskać szczegółowy przewodnik dotyczący włączania skryptu szkoleniowego TensorFlow dla biblioteki równoległej modelu rozproszonego SageMaker, zobacz Zmodyfikuj skrypt szkoleniowy TensorFlow. W przypadku PyTorch, patrz Zmodyfikuj skrypt szkoleniowy PyTorch.

Debuger SageMakera

W poprzednich sekcjach omówiliśmy, jak zoptymalizować szkolenie przy użyciu technik zrównoleglania modelu i danych. Z Debuger Amazon SageMaker, możemy teraz przechwytywać informacje o profilowaniu wydajności z naszych biegów treningowych, aby określić, jak bardzo poprawił się trening. Domyślnie Debugger przechwytuje metryki systemowe dla każdego zadania szkoleniowego SageMaker, takie jak GPU, wykorzystanie procesora, pamięć, sieć i operacje we/wy z interwałem próbkowania wynoszącym 500 milisekund. Dostęp do danych możemy uzyskać w następujący sposób:

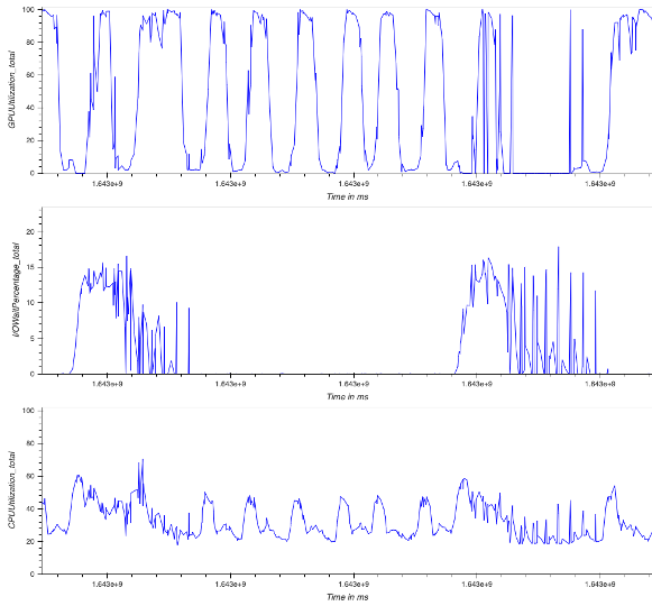

Debuger zapewnia narzędzia do wyobrażać sobie profilowania danych na różne sposoby. W poniższym przykładzie widzimy całkowite wykorzystanie procesora graficznego i procesora, a także czas oczekiwania na operacje we/wy dla zadania uczenia wielu procesorów graficznych przy użyciu Horovod. Aby wygenerować te wykresy, uruchamiamy następujący kod:

Wykorzystanie procesora GPU często waha się od 0 do 100%, a długi czas oczekiwania na operacje we/wy przy niskim wykorzystaniu procesora GPU jest wskaźnikiem wąskiego gardła we/wy. Co więcej, całkowite wykorzystanie procesora nigdy nie przekracza 70%, co oznacza, że możemy poprawić wstępne przetwarzanie danych poprzez zwiększenie liczby procesów roboczych.

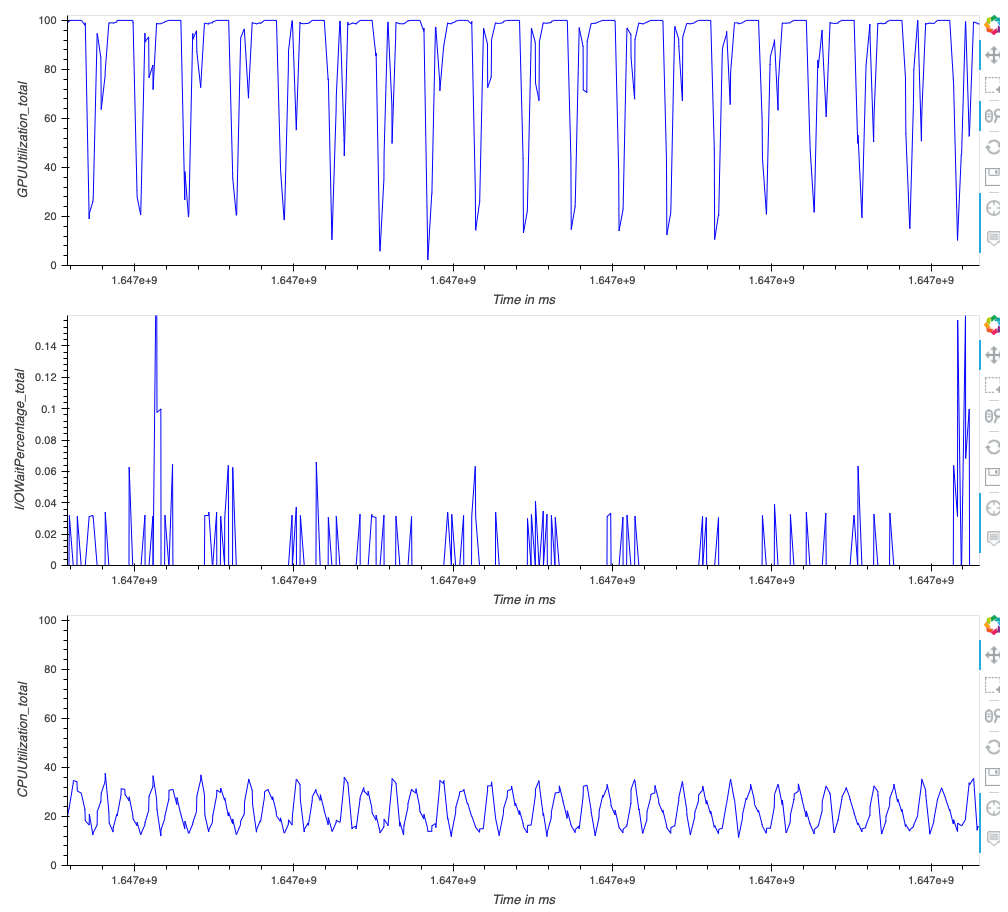

Możemy poprawić wydajność, przełączając się z Horovod na bibliotekę równoległą danych rozproszonych SageMaker. Na poniższych wykresach widzimy, że procesory graficzne są wykorzystywane bardziej efektywnie i spadają do niskiego poziomu wykorzystania tylko na krótkie okresy czasu.

Infrastruktura szkoleniowa

Do szkolenia modeli użyliśmy 10 instancji ml.p3.16xlarge przy użyciu zadania szkoleniowego SageMaker. SageMaker skraca czas i koszty szkolenia i dostrajania modeli uczenia maszynowego (ML) bez konieczności zarządzania infrastrukturą. Dzięki SageMaker możesz łatwo trenować i dostrajać modele ML za pomocą wbudowanych narzędzi do zarządzania i śledzenia eksperymentów szkoleniowych, automatycznego wybierania optymalnych hiperparametrów, debugowania zadań szkoleniowych i monitorowania wykorzystania zasobów systemowych, takich jak procesory graficzne, procesory i przepustowość sieci. Dane były hostowane w Amazon EFS, co pozwoliło nam rosnąć i zmniejszać się w miarę dodawania i usuwania plików bez potrzeby zarządzania lub udostępniania. Naszymi głównymi celami było zwiększenie szybkości treningu i obniżenie kosztów.

Skalowalność modelu

Chociaż ta infrastruktura jest używana głównie do generowania języka, z architekturą GPT i zestawem danych Pile można użyć tych technik do trenowania modeli transformatorów na dużą skalę, co jest przydatne w wielu domenach poza NLP. W samym uczeniu maszynowym wiele zadań związanych z widzeniem komputerowym jest obecnie rozwiązywanych za pomocą architektur z dużymi parametrami (transformatorami), w których wykazano, że przewyższają tradycyjne CNN (Convolutional Neural Network) w zadaniach takich jak uczenie reprezentacji (patrz Postęp w dziedzinie wizji komputerowej dzięki samonadzorowanym Transformatorom i 10-krotnie wydajniejszemu szkoleniu) i wielkoskalowe mapowanie obrazów na tekst (takie jak CLIP). Modele wielkoparametrowe są również przełomowe w naukach przyrodniczych w takich dziedzinach jak analiza struktury białka i analiza medycznych danych obrazowych.

Rozwiązania, które szczegółowo opisaliśmy w tym poście, dotyczące szkolenia rozproszonego i zarządzania dużymi modelami, powinny również dotyczyć modeli w dowolnej z tych domen.

Kompromisy

W środowisku naukowym toczy się dyskusja na temat zagrożeń związanych z trenowaniem modeli językowych na dużą skalę oraz tego, czy dostatecznie przemyślano potencjalne zagrożenia związane z ich opracowywaniem i strategiami ograniczania tych zagrożeń, z których niektóre obejmują kwestie finansowe i koszty środowiskowe. Według papier opublikowany w ACM, oszacowano, że trenowanie pojedynczego modelu podstawowego BERT (bez dostrajania hiperparametrów) na GPU wymagało takiej samej energii, jak lot transamerykański. Wpływ na środowisko skaluje się wraz z rozmiarem modelu, a możliwość skutecznego dostrojenia takich modeli może potencjalnie znacznie ograniczyć emisje. AWS niedawno uruchomił nowy Narzędzie do pomiaru śladu węglowego klienta, dostępne dla wszystkich klientów AWS bez żadnych kosztów, jako część wysiłków Amazona na rzecz zwiększenia zrównoważonego rozwoju i zmniejszenia emisji dwutlenku węgla. Uruchamianie aplikacji w chmurze AWS może potencjalnie zmniejszyć ślad węglowy (w porównaniu z korporacyjnymi centrami danych, które były badane w raport 2019).

Wnioski

Ten post zademonstrował rozwiązanie, które ułatwia dostrajanie modeli językowych z miliardem parametrów w chmurze AWS za pomocą SageMaker.

Aby uzyskać więcej informacji na temat równoległości modeli z programem SageMaker, zobacz Trenuj ponad 175 miliardów parametrów NLP modeli z równoległymi dodawaniem modeli i Hugging Face w Amazon SageMaker i Jak firma Latent Space wykorzystała bibliotekę równoległości modelu Amazon SageMaker, aby przesunąć granice transformatorów wielkoskalowych.

Jeśli potrzebujesz pomocy w przyspieszeniu wykorzystania ML w swoich produktach i procesach, skontaktuj się z Laboratorium rozwiązań Amazon ML.

O autorach

Sia Gholami jest starszym analitykiem danych w Amazon ML Solutions Lab, gdzie buduje rozwiązania AI/ML dla klientów z różnych branż. Pasjonuje się przetwarzaniem języka naturalnego (NLP) i głębokim uczeniem się. Poza pracą Sia lubi spędzać czas na łonie natury i grać w tenisa.

Sia Gholami jest starszym analitykiem danych w Amazon ML Solutions Lab, gdzie buduje rozwiązania AI/ML dla klientów z różnych branż. Pasjonuje się przetwarzaniem języka naturalnego (NLP) i głębokim uczeniem się. Poza pracą Sia lubi spędzać czas na łonie natury i grać w tenisa.

Mehdi Noorijest menedżerem i starszym naukowcem stosowanym w Amazon ML Solutions Lab, gdzie pracuje z klientami z różnych branż i pomaga im przyspieszyć migrację do chmury oraz rozwiązywać problemy ML przy użyciu najnowocześniejszych rozwiązań i technologie.

Mehdi Noorijest menedżerem i starszym naukowcem stosowanym w Amazon ML Solutions Lab, gdzie pracuje z klientami z różnych branż i pomaga im przyspieszyć migrację do chmury oraz rozwiązywać problemy ML przy użyciu najnowocześniejszych rozwiązań i technologie.

Muhyun Kim jest analitykiem danych w Amazon Machine Learning Solutions Lab. Rozwiązuje różne problemy biznesowe klientów, stosując uczenie maszynowe i głębokie uczenie, a także pomaga im zdobyć umiejętności.

Muhyun Kim jest analitykiem danych w Amazon Machine Learning Solutions Lab. Rozwiązuje różne problemy biznesowe klientów, stosując uczenie maszynowe i głębokie uczenie, a także pomaga im zdobyć umiejętności.

Danny'ego Byrda jest naukowcem stosowanym w laboratorium Amazon ML Solutions Lab. W laboratorium pomagał klientom opracowywać zaawansowane rozwiązania ML, w specjalnościach ML, od wizji komputerowej po uczenie ze wzmocnieniem. Pasjonuje go rozwijanie technologii i odblokowywanie nowego potencjału produktów AWS.

Danny'ego Byrda jest naukowcem stosowanym w laboratorium Amazon ML Solutions Lab. W laboratorium pomagał klientom opracowywać zaawansowane rozwiązania ML, w specjalnościach ML, od wizji komputerowej po uczenie ze wzmocnieniem. Pasjonuje go rozwijanie technologii i odblokowywanie nowego potencjału produktów AWS.

Francisco Calderona Rodrigueza jest analitykiem danych w laboratorium Amazon ML Solutions Lab. Jako członek ML Solutions Lab pomaga rozwiązywać krytyczne problemy biznesowe dla klientów AWS z wykorzystaniem głębokiego uczenia się. W wolnym czasie Francisco lubi grać na gitarze, grać w piłkę nożną z córkami i spędzać czas z rodziną.

Francisco Calderona Rodrigueza jest analitykiem danych w laboratorium Amazon ML Solutions Lab. Jako członek ML Solutions Lab pomaga rozwiązywać krytyczne problemy biznesowe dla klientów AWS z wykorzystaniem głębokiego uczenia się. W wolnym czasie Francisco lubi grać na gitarze, grać w piłkę nożną z córkami i spędzać czas z rodziną.

Yoheia Nakayamy jest architektem głębokiego uczenia się w laboratorium Amazon ML Solutions Lab. Współpracuje z klientami z różnych branż, aby przyspieszyć korzystanie przez nich ze sztucznej inteligencji i usług AWS Cloud w celu rozwiązywania ich wyzwań biznesowych. Interesuje się zastosowaniem technologii ML/AI w przemyśle kosmicznym.

Yoheia Nakayamy jest architektem głębokiego uczenia się w laboratorium Amazon ML Solutions Lab. Współpracuje z klientami z różnych branż, aby przyspieszyć korzystanie przez nich ze sztucznej inteligencji i usług AWS Cloud w celu rozwiązywania ich wyzwań biznesowych. Interesuje się zastosowaniem technologii ML/AI w przemyśle kosmicznym.

Nathalie Rauschmayr jest Senior Applied Scientist w AWS, gdzie pomaga klientom rozwijać aplikacje do głębokiego uczenia się.

Nathalie Rauschmayr jest Senior Applied Scientist w AWS, gdzie pomaga klientom rozwijać aplikacje do głębokiego uczenia się.

- Coinsmart. Najlepsza w Europie giełda bitcoinów i kryptowalut.

- Platoblockchain. Web3 Inteligencja Metaverse. Wzmocniona wiedza. DARMOWY DOSTĘP.

- CryptoJastrząb. Radar Altcoin. Bezpłatna wersja próbna.

- Źródło: https://aws.amazon.com/blogs/machine-learning/create-train-and-deploy-a-billion-parameter-language-model-on-terabytes-of-data-with-tensorflow-and- amazonka-sagemaker/

- "

- 10

- 100

- 2019

- a

- O nas

- przyśpieszyć

- przyspieszenie

- dostęp

- Stosownie

- Osiągać

- w poprzek

- w dodatku

- dodatek

- zaawansowany

- Wszystkie kategorie

- pozwala

- zawsze

- Amazonka

- analiza

- api

- aplikacje

- stosowany

- Aplikuj

- Stosowanie

- podejście

- awanse

- w przybliżeniu

- architektoniczny

- architektura

- Sztuka

- sztuczny

- sztuczna inteligencja

- powiązany

- Uwaga

- automatycznie

- dostępny

- średni

- AWS

- bo

- jest

- pomiędzy

- Poza

- większe

- Najwyższa

- Miliard

- miliardy

- Blokować

- Książki

- budować

- Buduje

- wbudowany

- biznes

- możliwości

- zdolny

- zdobyć

- przechwytuje

- węgiel

- emisji dwutlenku węgla

- centralny

- wyzwanie

- wyzwania

- Dodaj

- klasa

- Chmura

- usługi w chmurze

- kod

- wspólny

- Komunikacja

- społeczność

- w porównaniu

- obliczenia

- obliczać

- komputer

- Computer Science

- computing

- połączony

- Wady

- zgodny

- skontaktuj się

- Koszty:

- Stwórz

- stworzony

- tworzy

- Tworzenie

- krytyczny

- zwyczaj

- Klientów

- dane

- centra danych

- naukowiec danych

- głęboko

- wykazać

- zależy

- rozwijać

- Wdrożenie

- zaprojektowany

- detal

- szczegółowe

- Ustalać

- rozwijać

- rozwijanie

- oprogramowania

- urządzenie

- urządzenia

- różne

- dyskutować

- dystrybuowane

- rozdzielczy

- Różnorodność

- DM

- domeny

- na dół

- z łatwością

- łatwy w użyciu

- efektywność

- wydajny

- skutecznie

- starania

- emisje

- umożliwiać

- Umożliwia

- energia

- Angielski

- Enterprise

- środowiskowy

- szczególnie

- ustanowiony

- szacunkowa

- przykład

- przekracza

- wymiana

- rozszerzenia

- Twarz

- w obliczu

- członków Twojej rodziny

- Korzyści

- Łąka

- budżetowy

- i terminów, a

- dopasować

- lot

- następujący

- następujący sposób

- Ślad stopy

- Naprzód

- Framework

- Francisco

- od

- funkcjonować

- Ponadto

- Ogólne

- Generować

- generacja

- generatywny

- miejsce

- GitHub

- Globalne

- GPU

- GPU

- Rosnąć

- poprowadzi

- sprzęt komputerowy

- pomoc

- pomaga

- Wysoki

- wysokiej jakości

- wyższy

- przytrzymaj

- hostowane

- Hosting

- W jaki sposób

- How To

- Jednak

- HTTPS

- obraz

- zdjęcia

- podnieść

- ulepszony

- zawierać

- obejmuje

- Włącznie z

- Zwiększać

- wzrastający

- wskaźnik

- przemysłowa

- przemysł

- Informacja

- Infrastruktura

- innowacje

- wkład

- inspirowane

- przykład

- Inteligencja

- zainteresowany

- IT

- samo

- Praca

- Oferty pracy

- podróż

- Trzymać

- wiedza

- laboratorium

- Etykieta

- Etykiety

- język

- duży

- większe

- uruchomiona

- warstwa

- lider

- nauka

- poziomy

- Biblioteka

- Life Sciences

- załadować

- miejscowy

- Popatrz

- maszyna

- uczenie maszynowe

- zarządzanie

- i konserwacjami

- kierownik

- zarządzający

- mapowanie

- maska

- matematyka

- matematyka

- znaczy

- medyczny

- członek

- Pamięć

- metody

- Metryka

- ML

- model

- modele

- monitor

- jeszcze

- większość

- wielokrotność

- Muzyka

- Naturalny

- Natura

- niezbędny

- wymagania

- sieć

- NIH

- węzły

- numer

- Cele

- Oferty

- Biurowe

- trwający

- działanie

- operacje

- Optymalizacja

- zamówienie

- Inne

- Papier

- część

- namiętny

- patent

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- okresy

- filozofia

- Fizyka

- Grać

- gra

- position

- możliwy

- potencjał

- przewidzieć

- przepowiednia

- Przewidywania

- poprzedni

- pierwotny

- problemy

- wygląda tak

- procesów

- przetwarzanie

- Produkty

- Profilowanie

- projekt

- PROS

- zapewniać

- zapewnia

- popychany

- zasięg

- Czytający

- niedawny

- niedawno

- dokumentacja

- Recover

- zmniejszyć

- w sprawie

- reprezentacja

- reprezentowane

- wymagać

- Badania naukowe

- Zasoby

- Efekt

- powrót

- ryzyko

- run

- bieganie

- taki sam

- Skala

- skalowaniem

- nauka

- NAUKI

- Naukowiec

- nasienie

- usługa

- Usługi

- kilka

- SGD

- Shape

- shared

- Short

- pokazane

- podobny

- Prosty

- ponieważ

- pojedynczy

- Rozmiar

- mały

- So

- Piłka nożna

- rozwiązanie

- Rozwiązania

- ROZWIĄZANIA

- Rozwiązuje

- kilka

- Typ przestrzeni

- swoiście

- prędkość

- Spędzanie

- dzielić

- Dzieli

- stos

- rozpoczęty

- Stan

- state-of-the-art

- Zjednoczone

- sklep

- strategie

- sukces

- Zrównoważony rozwój

- system

- zadania

- Techniki

- Technologies

- Technologia

- Połączenia

- tysiące

- Przez

- wydajność

- czas

- czasy

- żeton

- Żetony

- narzędzia

- śledzić

- towarowym

- tradycyjny

- Trening

- Trendy

- Ubuntu

- bez precedensu

- us

- posługiwać się

- Użytkowe

- Wykorzystując

- wartość

- różnorodność

- różnorodny

- pionowe

- wizja

- Tom

- czekać

- fala

- sposoby

- czy

- Podczas

- Wikipedia

- bez

- słowa

- Praca

- pracownik

- pracowników

- działa

- X

- lat

- Twój

- youtube