DeepMind zrobił to ponownie.

Po rozwiązaniu fundamentalnego wyzwania w biologii —przewidywanie struktury białka-i rozplątywanie matematyki teorii węzłów, ma na celu fundamentalny proces obliczeniowy osadzony w tysiącach codziennych aplikacji. Od analizowania obrazów do modelowanie pogody a nawet badając wewnętrzne działanie sztucznych sieci neuronowych, sztuczna inteligencja mogłaby teoretycznie przyspieszyć obliczenia w różnych dziedzinach, zwiększając wydajność przy jednoczesnym obniżeniu zużycia energii i kosztów.

Ale bardziej imponujące jest w jaki sposób zrobili to. Rekordowy algorytm, nazwany AlphaTensor, jest efektem ubocznym AlfaZero, który słynie z pobicia ludzkich graczy w szachy i go.

„Algorytmy są używane w cywilizacjach na całym świecie do wykonywania podstawowych operacji od tysięcy lat” napisał współautorzy dr hab. Matej Balog i Alhussein Fawzi w DeepMind. „Jednak odkrywanie algorytmów jest bardzo trudne”.

AlphaTensor wytycza szlak do nowego świata, w którym sztuczna inteligencja projektuje programy, które przewyższają wszystko, co ludzie inżynierowie, jednocześnie ulepszając swój własny „mózg”.

„Ta praca wkracza na niezbadane terytorium, wykorzystując sztuczną inteligencję do problemu optymalizacji, nad którym ludzie pracowali od dziesięcioleci… znalezione rozwiązania można natychmiast opracować, aby poprawić czasy wykonywania obliczeń” – powiedział dr Federico Levi, starszy redaktor w Natura, który opublikowany badania.

Wprowadź mnożenie macierzy

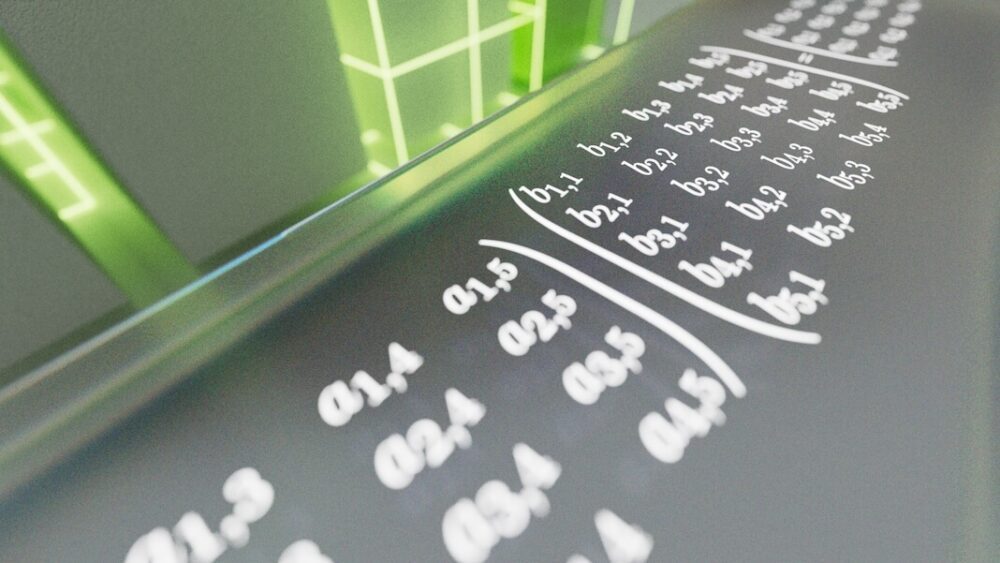

Problemem, przed którym stoi AlphaTensor, jest mnożenie macierzy. Jeśli nagle wyobrażasz sobie rzędy i kolumny zielonych liczb przewijających się w dół ekranu, nie jesteś sam. Z grubsza rzecz biorąc, matryca jest podobna do siatki liczb, która cyfrowo reprezentuje wybrane przez Ciebie dane. Mogą to być piksele na obrazie, częstotliwości klipu dźwiękowego lub wygląd i działania postaci w grach wideo.

Mnożenie macierzy bierze dwie siatki liczb i mnoży jedną przez drugą. Jest to obliczenie często nauczane w szkole średniej, ale ma również kluczowe znaczenie dla systemów komputerowych. Tutaj rzędy liczb w jednej macierzy są mnożone przez kolumny w innej. Wyniki generują wynik — na przykład polecenie przybliżenia lub pochylenia widoku sceny z gry wideo. Chociaż te obliczenia działają pod maską, każdy, kto korzysta z telefonu lub komputera, każdego dnia polega na ich wynikach.

Możesz zobaczyć, jak problem może stać się niezwykle trudny, niezwykle szybki. Mnożenie dużych matryc jest niesamowicie energochłonne i czasochłonne. Każda para liczb musi zostać pomnożona indywidualnie, aby zbudować nową macierz. Gdy matryce rosną, problem szybko staje się nie do utrzymania – nawet bardziej niż przewidywanie najlepszych ruchów szachowych lub Go. Niektórzy eksperci szacują, że są więcej sposobów rozwiązać mnożenie macierzy niż liczba atomów we wszechświecie.

W 1969 r. Volker Strassen, niemiecki matematyk, pokazał, że istnieją sposoby na skrócenie rogów, przecinając jedną rundę mnożenia macierzy dwa na dwa od w sumie osiem do siedmiu. Może nie brzmi to imponująco, ale metoda Strassena pokazała, że możliwe jest pokonanie od dawna utrzymywanych standardów operacji — to znaczy algorytmów — w mnożeniu macierzy. Jego podejście, algorytm Strassena, króluje jako najbardziej efektywne podejście od ponad 50 lat.

Ale co, jeśli istnieją jeszcze skuteczniejsze metody? „Nikt nie zna najlepszego algorytmu do jego rozwiązania”, dr François Le Gall z Uniwersytetu Nagoya w Japonii, który nie był zaangażowany w prace, powiedział Przegląd technologii MIT. „To jeden z największych otwartych problemów w informatyce”.

Algorytmy ścigania AI

Jeśli ludzka intuicja słabnie, dlaczego nie skorzystać z mechanicznego umysłu?

W nowym badaniu zespół DeepMind zamienił mnożenie macierzy w grę. Podobnie jak jego poprzednik AlphaZero, AlphaTensor wykorzystuje głębokie uczenie ze wzmocnieniem, metodę uczenia maszynowego inspirowaną sposobem, w jaki uczą się biologiczne mózgi. Tutaj agent AI (często sztuczna sieć neuronowa) wchodzi w interakcję z otoczeniem, aby rozwiązać wieloetapowy problem. Jeśli mu się powiedzie, otrzymuje „nagrodę” — to znaczy, że parametry sieci AI są aktualizowane, więc jest bardziej prawdopodobne, że odniesie sukces w przyszłości.

To jak nauka przewracania naleśnika. Wiele początkowo spadnie na podłogę, ale w końcu twoje sieci neuronowe nauczą się ruchów ramion i dłoni, aby wykonać perfekcyjny obrót.

Poligon dla AlphaTensor to rodzaj trójwymiarowej gry planszowej. Jest to zasadniczo łamigłówka dla jednego gracza, z grubsza podobna do Sudoku. Sztuczna inteligencja musi mnożyć siatki liczb w jak najmniejszej liczbie kroków, wybierając z niezliczonej liczby dozwolonych ruchów – ponad bilion z nich.

Te dopuszczalne ruchy zostały skrupulatnie zaprojektowane w AlphaTensor. Podczas briefingu prasowego współautor, dr Hussain Fawzi, wyjaśnił: „Formułowanie przestrzeni algorytmicznych odkryć jest bardzo skomplikowane… jeszcze trudniejsze jest to, jak możemy poruszać się w tej przestrzeni”.

Innymi słowy, w obliczu zadziwiającego wachlarza opcji, jak możemy je zawęzić, aby zwiększyć nasze szanse na znalezienie igły w stogu siana? I jak możemy najlepiej zaplanować, aby dostać się do igły bez przekopywania się przez cały stog siana?

Jedną ze sztuczek, którą zespół zastosował w AlphaTensor, jest metoda zwana przeszukiwaniem drzewa. Zamiast, mówiąc metaforycznie, losowo przekopywać się przez stog siana, sztuczna inteligencja bada „drogi”, które mogą prowadzić do lepszego wyniku. Nauka pośrednia następnie pomaga sztucznej inteligencji zaplanować kolejny ruch, aby zwiększyć szanse na sukces. Zespół pokazał również próbki algorytmów udanych partii, takich jak uczenie dziecka pierwszych ruchów w szachy. Wreszcie, gdy sztuczna inteligencja odkryła wartościowe ruchy, zespół pozwolił jej zmienić kolejność tych operacji w celu uzyskania bardziej dopasowanej nauki w poszukiwaniu lepszych wyników.

Breaking New Ground

AlphaTensor grał dobrze. W serii testów zespół rzucił wyzwanie sztucznej inteligencji, aby znaleźć najskuteczniejsze rozwiązania dla macierzy o wielkości do pięć na pięć — czyli z pięcioma liczbami w rzędzie lub kolumnie.

Algorytm szybko odkrył na nowo oryginalny hack Strassena, ale potem przewyższył wszystkie rozwiązania wcześniej wymyślone przez ludzki umysł. Testując sztuczną inteligencję z różnymi rozmiarami macierzy, AlphaTensor znalazł bardziej wydajne rozwiązania dla ponad 70. „W rzeczywistości AlphaTensor zazwyczaj odkrywa tysiące algorytmów dla każdego rozmiaru macierzy” – powiedział zespół. „To zadziwiające”.

W jednym przypadku, mnożąc macierz pięć na pięć przez macierz cztery na pięć, sztuczna inteligencja obcięła poprzedni rekord 80 pojedynczych mnożeń do zaledwie 76. Zabłysnął również na większych macierzach, zmniejszając liczbę obliczeń potrzebnych do dwóch macierze jedenaście na jedenaście od 919 do 896.

Po sprawdzeniu koncepcji zespół zabrał się do praktycznego zastosowania. Chipy komputerowe są często projektowane w celu optymalizacji różnych obliczeń — na przykład GPU do grafiki lub Chipy AI do uczenia maszynowego— a dopasowanie algorytmu do najlepiej dopasowanego sprzętu zwiększa wydajność.

W tym przypadku zespół wykorzystał AlphaTensor do znalezienia algorytmów dla dwóch popularnych układów w uczeniu maszynowym: procesora graficznego NVIDIA V100 i Google TPU. W sumie algorytmy opracowane przez sztuczną inteligencję zwiększyły szybkość obliczeń nawet o 20 procent.

Trudno powiedzieć, czy sztuczna inteligencja może również przyspieszyć smartfony, laptopy, czy inne urządzenia codziennego użytku. Jednak „ten rozwój byłby bardzo ekscytujący, gdyby można go było zastosować w praktyce”, powiedziała dr Virginia Williams z MIT. „Wzrost wydajności poprawiłby wiele aplikacji”.

Umysł AI

Pomimo tego, że AlphaTensor pokonuje najnowsze rekordy dotyczące mnożenia macierzy, zespół DeepMind nie potrafi jeszcze wyjaśnić, dlaczego.

„Ma niesamowitą intuicję, grając w te gry”, powiedział naukowiec DeepMind i współautor, dr Pushmeet Kohli podczas briefingu prasowego.

Ewoluujące algorytmy również nie muszą być oparte na zasadzie „człowiek kontra maszyny”.

Chociaż AlphaTensor jest krokiem w kierunku szybszych algorytmów, nawet szybsze mogą istnieć. „Ponieważ musi ograniczyć swoje wyszukiwanie do algorytmów o określonej formie, może pominąć inne typy algorytmów, które mogą być bardziej wydajne” – napisali Balog i Fawzi.

Być może jeszcze bardziej intrygująca ścieżka łączyłaby intuicję ludzką i maszynową. „Miło byłoby zastanowić się, czy ta nowa metoda faktycznie obejmuje wszystkie poprzednie, czy można je połączyć i uzyskać coś jeszcze lepszego” powiedziany Williamsa. Inni eksperci zgadzają się. Dysponując bogactwem algorytmów, naukowcy mogą rozpocząć ich analizę w poszukiwaniu wskazówek, co sprawiło, że rozwiązania AlphaTensor zadziałały, torując drogę do kolejnego przełomu.

Źródło zdjęcia: DeepMind