Wzrost aktywności społecznościowej online, takiej jak sieci społecznościowe lub gry online, jest często pełen wrogich lub agresywnych zachowań, które mogą prowadzić do niechcianych przejawów mowy nienawiści, cyberprzemocy lub nękania. Na przykład wiele społeczności graczy online oferuje funkcję czatu głosowego, aby ułatwić komunikację między swoimi użytkownikami. Chociaż czat głosowy często wspiera przyjacielskie przekomarzanie się i mówienie śmieciami, może również prowadzić do problemów, takich jak mowa nienawiści, cybernękanie, nękanie i oszustwa. Oznaczanie szkodliwego języka pomaga organizacjom prowadzić konwersacje w sposób cywilizowany i utrzymywać bezpieczne i integracyjne środowisko online, w którym użytkownicy mogą tworzyć, udostępniać i swobodnie w nim uczestniczyć. Obecnie wiele firm polega wyłącznie na ludzkich moderatorach przy przeglądaniu toksycznych treści. Jednak skalowanie ludzkich moderatorów w celu zaspokojenia tych potrzeb z odpowiednią jakością i szybkością jest kosztowne. W rezultacie wiele organizacji ryzykuje wysokie wskaźniki utraty użytkowników, utratę reputacji i kary regulacyjne. Ponadto przeglądanie toksycznych treści często wpływa psychologicznie na moderatorów.

Amazon Transcribe to usługa automatycznego rozpoznawania mowy (ASR), która ułatwia programistom dodawanie funkcji zamiany mowy na tekst w ich aplikacjach. Dziś z radością ogłaszamy Wykrywanie toksyczności w transkrypcji Amazon, funkcja oparta na uczeniu maszynowym (ML), która wykorzystuje sygnały dźwiękowe i tekstowe do identyfikowania i klasyfikowania toksycznych treści głosowych według siedmiu kategorii, w tym molestowania seksualnego, mowy nienawiści, gróźb, nadużyć, wulgaryzmów, obelg i języka graficznego . Oprócz tekstu, wykrywanie toksyczności wykorzystuje sygnały mowy, takie jak ton i ton, aby wyostrzyć toksyczne intencje w mowie.

Jest to ulepszenie w stosunku do standardowych systemów moderacji treści, które mają skupiać się tylko na określonych terminach, bez uwzględniania intencji. Większość przedsiębiorstw ma umowę SLA na 7–15 dni na przejrzenie treści zgłoszonych przez użytkowników, ponieważ moderatorzy muszą wysłuchać długich plików audio, aby ocenić, czy i kiedy rozmowa stała się toksyczna. Dzięki Amazon Transcribe Toxicity Detection moderatorzy przeglądają tylko określoną część pliku audio oznaczonego jako toksyczna zawartość (w porównaniu z całym plikiem audio). Liczba treści, które muszą przeglądać moderatorzy, została zmniejszona o 95%, co pozwala klientom skrócić umowę SLA do zaledwie kilku godzin, a także umożliwić im proaktywne moderowanie większej ilości treści, wykraczających poza to, co zostało oznaczone przez użytkowników. Pozwoli to przedsiębiorstwom automatycznie wykrywać i moderować treści na dużą skalę, zapewniać bezpieczne i integracyjne środowisko online oraz podejmować działania, zanim spowoduje to odejście użytkowników lub utratę reputacji. Modele używane do wykrywania toksycznych treści są utrzymywane przez Amazon Transcribe i okresowo aktualizowane w celu zachowania dokładności i trafności.

W tym poście dowiesz się, jak:

- Zidentyfikuj szkodliwe treści w mowie za pomocą funkcji Amazon Transcribe Toxicity Detection

- Użyj konsoli Amazon Transcribe do wykrywania toksyczności

- Utwórz zadanie transkrypcji z wykrywaniem toksyczności za pomocą Interfejs wiersza poleceń AWS (AWS CLI) i Python SDK

- Skorzystaj z odpowiedzi interfejsu API wykrywania toksyczności Amazon Transcribe

Wykrywaj toksyczność na czacie audio z Amazon Transcribe Toxicity Detection

Amazon Transcribe zapewnia teraz proste rozwiązanie oparte na ML do oznaczania szkodliwego języka w rozmowach mówionych. Ta funkcja jest szczególnie przydatna w przypadku mediów społecznościowych, gier i ogólnych potrzeb, eliminując potrzebę dostarczania przez klientów własnych danych w celu trenowania modelu uczenia maszynowego. Wykrywanie toksyczności klasyfikuje toksyczne treści audio w następujących siedmiu kategoriach i zapewnia ocenę pewności (0–1) dla każdej kategorii:

- Bluźnierstwo – Mowa zawierająca słowa, wyrażenia lub akronimy, które są niegrzeczne, wulgarne lub obraźliwe.

- mowa nienawiści – Wypowiedzi, które krytykują, obrażają, potępiają lub dehumanizują osobę lub grupę na podstawie tożsamości (takiej jak rasa, pochodzenie etniczne, płeć, religia, orientacja seksualna, zdolności i pochodzenie narodowe).

- Seksualny – Wypowiedzi, które wskazują na zainteresowanie seksualne, aktywność lub podniecenie, za pomocą bezpośrednich lub pośrednich odniesień do części ciała, cech fizycznych lub płci.

- Lżenie – Mowa, która zawiera poniżający, upokarzający, kpiący, obrażający lub poniżający język. Ten rodzaj języka jest również określany jako zastraszanie.

- Przemoc lub groźba – Mowa zawierająca groźby mające na celu zadanie bólu, zranienie lub wrogość wobec osoby lub grupy.

- Graficzny – Mowa, która wykorzystuje wizualnie opisowe i nieprzyjemnie żywe obrazy. Ten rodzaj języka jest często celowo rozwlekły, aby wzmocnić dyskomfort odbiorcy.

- Nękanie lub znęcanie się – mowa mająca na celu wpłynięcie na dobrostan psychiczny odbiorcy, w tym określenia poniżające i uprzedmiotawiające.

Możesz uzyskać dostęp do Toxicity Detection za pośrednictwem konsoli Amazon Transcribe lub wywołując interfejsy API bezpośrednio za pomocą AWS CLI lub AWS SDK. W konsoli Amazon Transcribe możesz przesłać pliki audio, które chcesz przetestować pod kątem toksyczności, i uzyskać wyniki za pomocą zaledwie kilku kliknięć. Amazon Transcribe będzie identyfikować i kategoryzować toksyczne treści, takie jak nękanie, mowa nienawiści, treści seksualne, przemoc, obelgi i wulgaryzmy. Amazon Transcribe zapewnia również ocenę zaufania dla każdej kategorii, dostarczając cennych informacji na temat poziomu toksyczności treści. Wykrywanie toksyczności jest obecnie dostępne w standardowym interfejsie API Amazon Transcribe do przetwarzania wsadowego i obsługuje język angielski (USA).

Przewodnik po konsoli Amazon Transcribe

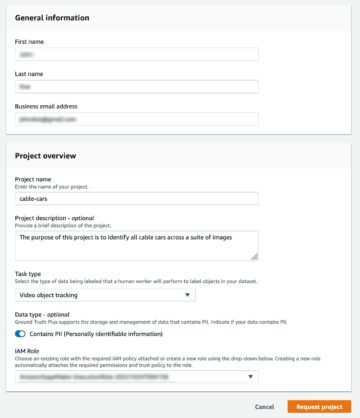

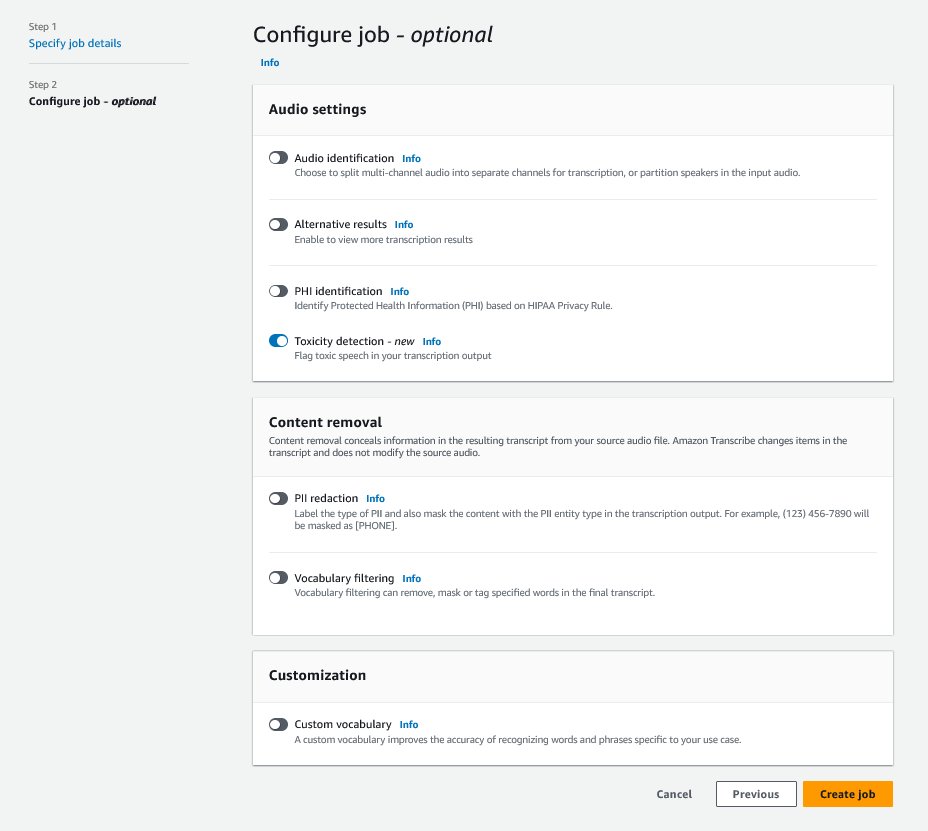

Aby rozpocząć, zaloguj się do Konsola zarządzania AWS i przejdź do Transkrypcji Amazon. Aby utworzyć nowe zadanie transkrypcji, musisz przesłać nagrane pliki do pliku Usługa Amazon Simple Storage (Amazon S3), zanim będą mogły zostać przetworzone. Na stronie ustawień audio, jak pokazano na poniższym zrzucie ekranu, włącz Wykrywanie toksyczności i przejdź do tworzenia nowego zadania. Amazon Transcribe przetworzy zadanie transkrypcji w tle. W miarę postępu zadania możesz spodziewać się zmiany statusu na ZAKOŃCZONY kiedy proces się zakończy.

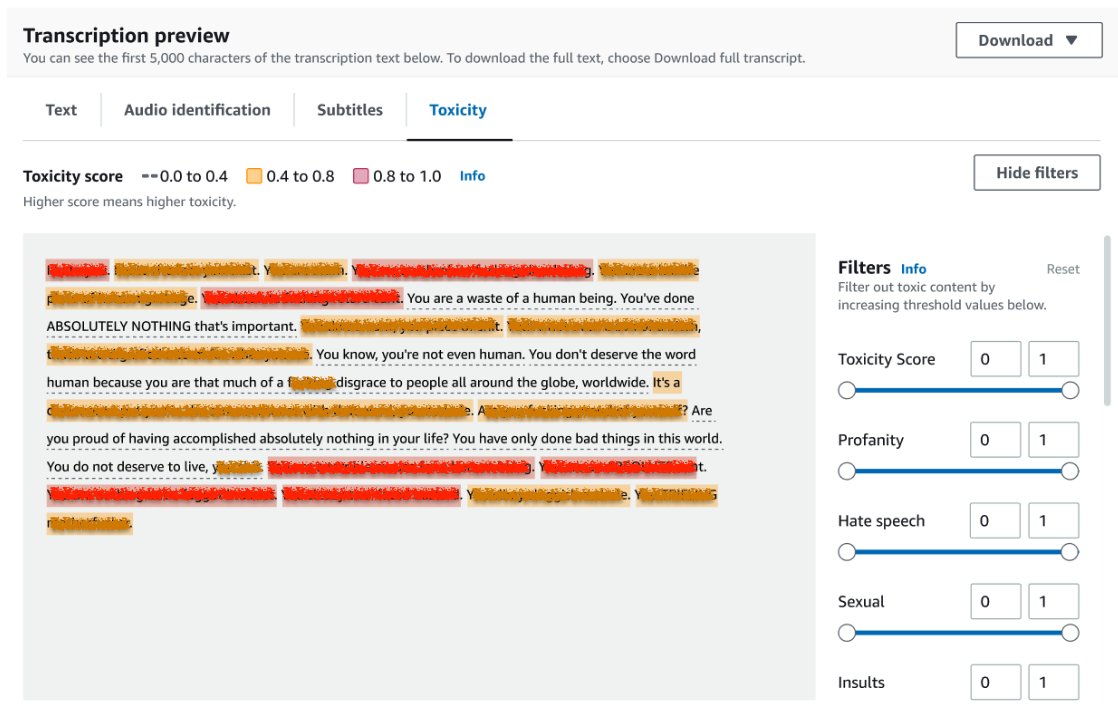

Aby przejrzeć wyniki zadania transkrypcji, wybierz zadanie z listy zadań, aby je otworzyć. Przewiń w dół do Podgląd transkrypcji sekcja, aby sprawdzić wyniki na Toksyczność patka. Interfejs użytkownika pokazuje segmenty transkrypcji oznaczone kolorami, aby wskazać poziom toksyczności określony na podstawie wyniku ufności. Aby dostosować wyświetlanie, możesz użyć pasków przełączania w filtry szkło. Paski te umożliwiają dostosowanie progów i odpowiednie filtrowanie kategorii toksyczności.

Poniższy zrzut ekranu obejmuje fragmenty tekstu transkrypcji ze względu na obecność poufnych lub toksycznych informacji.

Interfejs API transkrypcji z żądaniem wykrycia toksyczności

W tej sekcji przeprowadzimy Cię przez proces tworzenia zadania transkrypcji z wykrywaniem toksyczności za pomocą interfejsów programistycznych. Jeśli plik audio nie znajduje się jeszcze w zasobniku S3, prześlij go, aby zapewnić dostęp Amazon Transcribe. Podobnie jak w przypadku tworzenia zadania transkrypcji na konsoli, podczas wywoływania zadania należy podać następujące parametry:

- TranskrypcjaNazwaZadania – Określ unikalną nazwę zadania.

- MediaFileUri – Wprowadź lokalizację URI pliku audio na Amazon S3. Amazon Transcribe obsługuje następujące formaty audio: MP3, MP4, WAV, FLAC, AMR, OGG lub WebM

- Kod języka - Ustawić

en-US. W chwili pisania tego tekstu funkcja Toxicity Detection obsługuje tylko język angielski (Stany Zjednoczone). - Kategorie toksyczności – Podaj

ALLwartość obejmująca wszystkie obsługiwane kategorie wykrywania toksyczności.

Poniżej przedstawiono przykłady uruchamiania zadania transkrypcji z włączoną funkcją wykrywania toksyczności za pomocą języka Python3:

Możesz wywołać to samo zadanie transkrypcji z wykrywaniem toksyczności za pomocą następującego polecenia AWS CLI:

Interfejs API transkrypcji z odpowiedzią na wykrywanie toksyczności

Dane wyjściowe JSON wykrywania toksyczności Amazon Transcribe będą zawierać wyniki transkrypcji w polu wyników. Włączenie wykrywania toksyczności dodaje dodatkowe pole o nazwie toxicityDetection pod polem wyników. toxicityDetection zawiera listę transkrybowanych pozycji z następującymi parametrami:

- XNUMX – Surowy transkrybowany tekst

- toksyczność – Wynik pewności wykrywania (wartość między 0–1)

- kategorie – Wynik pewności dla każdej kategorii toksycznej mowy

- czas rozpoczęcia – Pozycja początkowa wykrywania w pliku audio (sekundy)

- Koniec czasu – Pozycja końcowa wykrywania w pliku audio (sekundy)

Poniżej znajduje się przykładowa skrócona odpowiedź na wykrycie toksyczności, którą można pobrać z konsoli:

Podsumowanie

W tym poście przedstawiliśmy przegląd nowej funkcji Amazon Transcribe Toxicity Detection. Opisaliśmy również, w jaki sposób można przeanalizować dane wyjściowe JSON wykrywania toksyczności. Aby uzyskać więcej informacji, sprawdź konsolę Amazon Transcribe i wypróbuj interfejs API transkrypcji z wykrywaniem toksyczności.

Usługa Amazon Transcribe Toxicity Detection jest teraz dostępna w następujących regionach AWS: Wschodnie Stany Zjednoczone (Ohio), Wschodnie Stany Zjednoczone (Wirginia Północna), Zachodnie Stany Zjednoczone (Oregon), Azja i Pacyfik (Sydney), Europa (Irlandia) i Europa (Londyn). Aby dowiedzieć się więcej, odwiedź Amazon Transcribe.

Dowiedz się więcej o: moderacja treści na AWS i nasz przypadki użycia ML moderowania treści. Zrób pierwszy krok w kierunku usprawnienie operacji moderowania treści za pomocą AWS.

O autorze

Lana Zhang jest starszym architektem rozwiązań w zespole AWS WWSO AI Services, specjalizującym się w sztucznej inteligencji i uczeniu maszynowym do moderowania treści, widzenia komputerowego i przetwarzania języka naturalnego. Dzięki swojej wiedzy jest zaangażowana w promowanie rozwiązań AWS AI/ML i pomaganie klientom w przekształcaniu ich rozwiązań biznesowych w różnych branżach, w tym w mediach społecznościowych, grach, handlu elektronicznym oraz reklamie i marketingu.

Lana Zhang jest starszym architektem rozwiązań w zespole AWS WWSO AI Services, specjalizującym się w sztucznej inteligencji i uczeniu maszynowym do moderowania treści, widzenia komputerowego i przetwarzania języka naturalnego. Dzięki swojej wiedzy jest zaangażowana w promowanie rozwiązań AWS AI/ML i pomaganie klientom w przekształcaniu ich rozwiązań biznesowych w różnych branżach, w tym w mediach społecznościowych, grach, handlu elektronicznym oraz reklamie i marketingu.

Sumit Kumar jest starszym menedżerem produktu, technicznym w zespole usług językowych AWS AI. Ma 10-letnie doświadczenie w zarządzaniu produktami w różnych dziedzinach i jest pasjonatem AI/ML. Poza pracą Sumit uwielbia podróżować, gra w krykieta i tenisa ziemnego.

Sumit Kumar jest starszym menedżerem produktu, technicznym w zespole usług językowych AWS AI. Ma 10-letnie doświadczenie w zarządzaniu produktami w różnych dziedzinach i jest pasjonatem AI/ML. Poza pracą Sumit uwielbia podróżować, gra w krykieta i tenisa ziemnego.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Motoryzacja / pojazdy elektryczne, Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Przesunięcia bloków. Modernizacja własności offsetu środowiskowego. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/flag-harmful-language-in-spoken-conversations-with-amazon-transcribe-toxicity-detection/

- :ma

- :Jest

- :nie

- 10

- 100

- 16

- 17

- 20

- 24

- 7

- 95%

- a

- zdolność

- O nas

- nadużycie

- dostęp

- odpowiednio

- Księgowość

- precyzja

- w poprzek

- Działania

- zajęcia

- działalność

- Dodaj

- dodatek

- Dodaje

- Reklama

- agresywny

- AI

- Usługi AI

- AI / ML

- Wszystkie kategorie

- dopuszczać

- już

- również

- Chociaż

- Amazonka

- Amazon Transcribe

- Amazon Web Services

- wśród

- an

- i

- Ogłosić

- api

- Pszczoła

- aplikacje

- SĄ

- AS

- Azja

- Azja i Pacyfik

- pomoc

- At

- ścieranie

- audio

- automatycznie

- automatycznie

- dostępny

- AWS

- tło

- paski

- podstawa

- BE

- stał

- bo

- zanim

- zachowanie

- pomiędzy

- Poza

- ciało

- obie

- przerwa

- zastraszanie

- biznes

- by

- nazywa

- powołanie

- CAN

- zdolność

- kategorie

- Kategoria

- Spowodować

- zmiana

- ZOBACZ

- Dodaj

- Klasyfikuj

- Komunikacja

- społeczności

- Firmy

- kompletny

- Zakończony

- komputer

- Wizja komputerowa

- pewność siebie

- Konsola

- zawiera

- zawartość

- Rozmowa

- rozmowy

- pokryty

- Stwórz

- Tworzenie

- krykiet

- Krytyka

- Obecnie

- Klientów

- dostosować

- dane

- Dni

- dedykowane

- opisane

- zaprojektowany

- wykryć

- Wykrywanie

- ustalona

- deweloperzy

- kierować

- bezpośrednio

- Wyświetlacz

- inny

- domeny

- na dół

- pobieranie

- z powodu

- e-commerce

- każdy

- Wschód

- łatwo

- bądź

- eliminując

- umożliwiać

- włączony

- umożliwiając

- zakończenia

- Angielski

- zapewnić

- Wchodzę

- przedsiębiorstwa

- Cały

- Środowisko

- szczególnie

- etniczność

- Europie

- oceniać

- przykład

- przykłady

- podniecony

- oczekiwać

- drogi

- doświadczenie

- ekspertyza

- dodatkowy

- ułatwiać

- okładzina

- Failed

- Cecha

- kilka

- pole

- filet

- Akta

- filtrować

- koniec

- i terminów, a

- taflowy

- Skupiać

- następujący

- W razie zamówieenia projektu

- przyjazny

- od

- Funkcjonalność

- gier

- Płeć

- Ogólne

- otrzymać

- Go

- Goes

- Graficzny

- Zarządzanie

- poprowadzi

- szkodliwy

- Have

- he

- pomaga

- jej

- tutaj

- Wysoki

- GODZINY

- W jaki sposób

- How To

- Jednak

- HTML

- http

- HTTPS

- człowiek

- zidentyfikować

- tożsamość

- if

- wpływ

- importować

- poprawa

- in

- zawierać

- obejmuje

- Włącznie z

- Włącznie

- Zwiększać

- wskazać

- wskazuje

- przemysłowa

- Informacja

- spostrzeżenia

- Zniewaga

- zamierzony

- zamiar

- Zamiar

- celowo

- odsetki

- interfejsy

- najnowszych

- Irlandia

- IT

- szt

- Praca

- jpg

- json

- właśnie

- Trzymać

- język

- prowadzić

- UCZYĆ SIĘ

- nauka

- poziom

- Linia

- Lista

- lokalizacja

- Londyn

- kocha

- maszyna

- uczenie maszynowe

- utrzymać

- WYKONUJE

- i konserwacjami

- kierownik

- wiele

- Marketing

- Media

- Poznaj nasz

- ML

- model

- modele

- umiar

- jeszcze

- większość

- musi

- Nazwa

- narodowy

- Naturalny

- Przetwarzanie języka naturalnego

- Potrzebować

- wymagania

- sieci

- Nowości

- już dziś

- of

- oferta

- często

- Ohio

- on

- Online

- gier online

- tylko

- koncepcja

- operacje

- or

- Oregon

- organizacji

- pochodzenie

- ludzkiej,

- na zewnątrz

- wydajność

- zewnętrzne

- przegląd

- własny

- Pacyfik

- strona

- Ból

- parametry

- uczestniczyć

- strony

- przechodzić

- namiętny

- osoba

- Zwroty

- fizyczny

- Smoła

- plato

- Analiza danych Platona

- PlatoDane

- gra

- część

- position

- Post

- obecność

- problemy

- wygląda tak

- Obrobiony

- przetwarzanie

- Produkt

- zarządzanie produktem

- product manager

- BLUŹNIERSTWO

- Programowanie

- promowanie

- zapewniać

- pod warunkiem,

- zapewnia

- że

- Python

- jakość

- Wyścig

- ceny

- Surowy

- gotowy

- uznanie

- nagrany

- zmniejszyć

- Zredukowany

- referencje

- regiony

- regulacyjne

- mających znaczenie

- religia

- polegać

- Zgłoszone

- odpowiedź

- dalsze

- Efekt

- przeglądu

- recenzowanie

- Ryzyko

- "bezpiecznym"

- taki sam

- Skala

- skalowaniem

- oszustwa

- wynik

- przewijać

- SDKS

- sekund

- Sekcja

- poszukuje

- segment

- Segmenty

- senior

- wrażliwy

- usługa

- Usługi

- zestaw

- w panelu ustawień

- siedem

- Seks

- Seksualny

- Share

- ona

- pokazane

- Targi

- znak

- podobny

- Prosty

- Obserwuj Nas

- Media społecznościowe

- Sieć społecznościowa

- Wyłącznie

- rozwiązanie

- Rozwiązania

- specjalizujący się

- specyficzny

- przemówienie

- Rozpoznawanie mowy

- zamiana mowy na tekst

- prędkość

- mówiony

- standard

- początek

- rozpoczęty

- Startowy

- Rynek

- Ewolucja krok po kroku

- przechowywanie

- taki

- wystarczający

- Utrzymany

- podpory

- sydney

- systemy

- Brać

- rozmawiać

- zespół

- Techniczny

- REGULAMIN

- test

- że

- Połączenia

- ich

- Im

- Te

- one

- to

- zagrożenia

- Przez

- czas

- do

- już dziś

- w kierunku

- w kierunku

- Pociąg

- transformatorowy

- podróżować

- prawdziwy

- próbować

- rodzaj

- ui

- dla

- wyjątkowy

- Dobrowolny

- zaktualizowane

- us

- posługiwać się

- używany

- Użytkownik

- Użytkownicy

- zastosowania

- za pomocą

- Cenny

- wartość

- różnorodność

- przez

- Przemoc

- virginia

- wizja

- Odwiedzić

- Głos

- vs

- wulgarny

- czekać

- chcieć

- we

- sieć

- usługi internetowe

- DOBRZE

- Zachód

- jeśli chodzi o komunikację i motywację

- Podczas

- będzie

- w

- bez

- słowa

- Praca

- pisanie

- lat

- jeszcze

- You

- Twój

- zefirnet