Analitycy danych potrzebują spójnego i odtwarzalnego środowiska dla obciążeń związanych z uczeniem maszynowym (ML) i nauką o danych, które umożliwia zarządzanie zależnościami i jest bezpieczne. Kontenery AWS Deep Learning udostępnia już gotowe obrazy platformy Docker do trenowania i udostępniania modeli w popularnych platformach, takich jak TensorFlow, PyTorch i MXNet. Aby poprawić to doświadczenie, ogłosiliśmy publiczną wersję beta dystrybucji open-source SageMaker na JupyterCon 2023. Zapewnia to ujednolicone, kompleksowe środowisko ML dla programistów ML o różnym poziomie wiedzy. Deweloperzy nie muszą już przełączać się między różnymi kontenerami ramowymi w celu eksperymentowania ani przechodzenia z lokalnych środowisk JupyterLab i notebooków SageMaker do zadań produkcyjnych w SageMaker. Open-source SageMaker Distribution obsługuje najpopularniejsze pakiety i biblioteki do nauki o danych, uczenia maszynowego i wizualizacji, takie jak TensorFlow, PyTorch, Scikit-learn, Pandas i Matplotlib. Możesz zacząć korzystać z kontenera od Publiczna galeria Amazon ECR od dzisiaj.

W tym poście pokazujemy, jak możesz wykorzystać dystrybucję open source SageMaker do szybkiego eksperymentowania w lokalnym środowisku i łatwego promowania ich na stanowiska w SageMaker.

Omówienie rozwiązania

W naszym przykładzie prezentujemy szkolenie modelu klasyfikacji obrazów przy użyciu PyTorch. Używamy KMNIST zbiór danych dostępny publicznie w PyTorch. Uczymy model sieci neuronowej, testujemy wydajność modelu, a na koniec drukujemy trening i test strat. Pełny notes dla tego przykładu jest dostępny w Repozytorium przykładów SageMaker Studio Lab. Rozpoczynamy eksperymenty na lokalnym laptopie przy użyciu dystrybucji open source, przenosimy go do Studio Amazon SageMaker do użycia większej instancji, a następnie zaplanuj notatnik jako zadanie notatnika.

Wymagania wstępne

Potrzebujesz następujących wymagań wstępnych:

Skonfiguruj swoje lokalne środowisko

Możesz bezpośrednio rozpocząć korzystanie z dystrybucji open source na swoim lokalnym laptopie. Aby uruchomić JupyterLab, uruchom następujące polecenia na swoim terminalu:

Możesz zastąpić ECR_IMAGE_ID z dowolnymi znacznikami graficznymi dostępnymi w pliku Publiczna galeria Amazon ECRlub wybierz latest-gpu tag, jeśli używasz komputera obsługującego GPU.

To polecenie uruchomi JupyterLab i poda adres URL na terminalu, na przykład http://127.0.0.1:8888/lab?token=<token>. Skopiuj link i wprowadź go w preferowanej przeglądarce, aby uruchomić JupyterLab.

Skonfiguruj Studio

Studio to kompleksowe zintegrowane środowisko programistyczne (IDE) dla uczenia maszynowego, które umożliwia programistom i analitykom danych tworzenie, trenowanie, wdrażanie i monitorowanie modeli uczenia maszynowego na dużą skalę. Studio udostępnia obszerną listę własnych obrazów z typowymi platformami i pakietami, takimi jak Data Science, TensorFlow, PyTorch i Spark. Te obrazy ułatwiają analitykom danych rozpoczęcie pracy z uczeniem maszynowym przez proste wybranie struktury i typu instancji do obliczeń.

Możesz teraz używać dystrybucji open-source SageMaker w Studio, używając Studio przynieś swój wizerunek funkcja. Aby dodać dystrybucję typu open source do swojej domeny SageMaker, wykonaj następujące kroki:

- Dodaj dystrybucję open source do swojego konta Rejestr elastycznego pojemnika Amazon (Amazon ECR), uruchamiając następujące polecenia na swoim terminalu:

- Utwórz obraz SageMaker i dołącz obraz do domeny Studio:

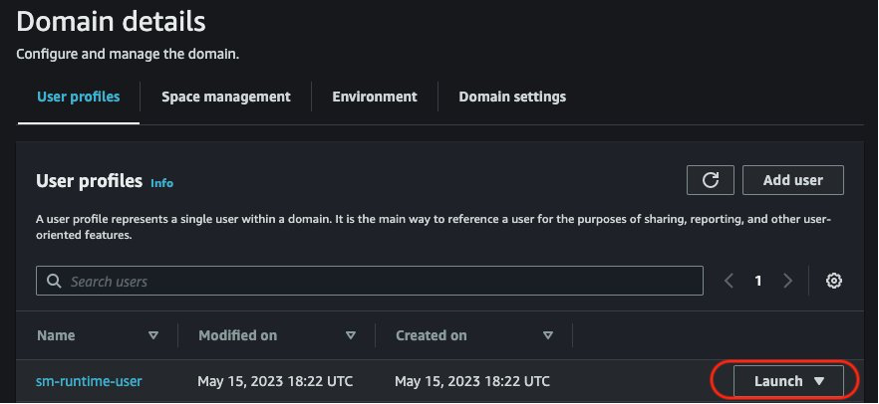

- W konsoli SageMaker uruchom Studio, wybierając swoją domenę i istniejący profil użytkownika.

- Opcjonalnie uruchom ponownie Studio, wykonując czynności opisane w Zamknij i zaktualizuj SageMaker Studio.

Pobierz notatnik

Pobierz przykładowy notatnik lokalnie z GitHub repo.

Otwórz notatnik w wybranym środowisku IDE i dodaj komórkę na początku notatnika do zainstalowania torchsummary, torchsummary pakiet nie jest częścią dystrybucji, a zainstalowanie go na notebooku zapewni, że notebook będzie działał od końca do końca. Zalecamy korzystanie conda or micromamba zarządzać środowiskami i zależnościami. Dodaj następującą komórkę do notatnika i zapisz notatnik:

Eksperymentuj na lokalnym notatniku

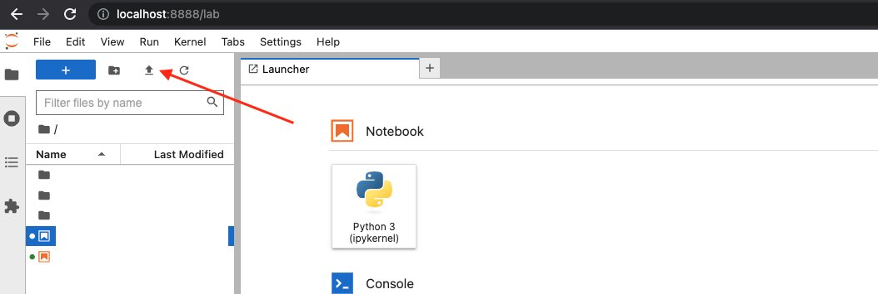

Prześlij notatnik do uruchomionego interfejsu użytkownika JupyterLab, wybierając ikonę przesyłania, jak pokazano na poniższym zrzucie ekranu.

Po przesłaniu uruchom plik cv-kmnist.ipynb zeszyt. Możesz natychmiast rozpocząć uruchamianie komórek, bez konieczności instalowania jakichkolwiek zależności, takich jak torch, matplotlib lub ipywidgets.

Jeśli wykonałeś poprzednie kroki, możesz zobaczyć, że możesz korzystać z dystrybucji lokalnie z laptopa. W następnym kroku użyjemy tej samej dystrybucji w Studio, aby skorzystać z funkcji Studio.

Przenieś eksperymenty do Studio (opcjonalnie)

Opcjonalnie przenieśmy eksperymentowanie do Studio. Jedną z zalet programu Studio jest to, że bazowe zasoby obliczeniowe są w pełni elastyczne, dzięki czemu można łatwo wybierać dostępne zasoby w górę lub w dół, a zmiany odbywają się automatycznie w tle bez przerywania pracy. Jeśli chcesz uruchomić ten sam notes co wcześniej w większym zbiorze danych i wystąpieniu obliczeniowym, możesz przeprowadzić migrację do Studio.

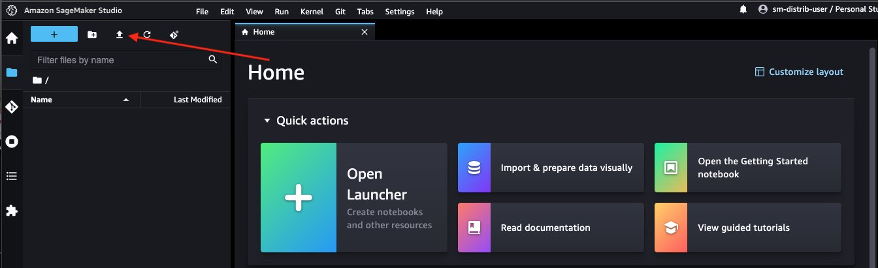

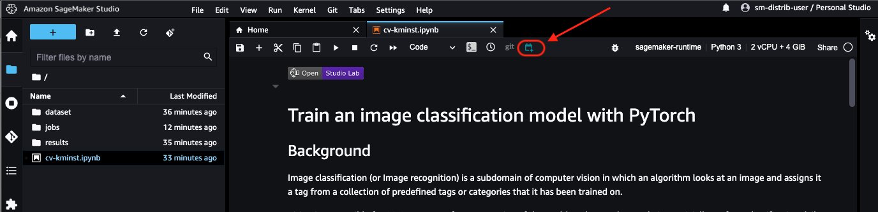

Przejdź do uruchomionego wcześniej interfejsu Studio i wybierz ikonę przesyłania, aby przesłać notatnik.

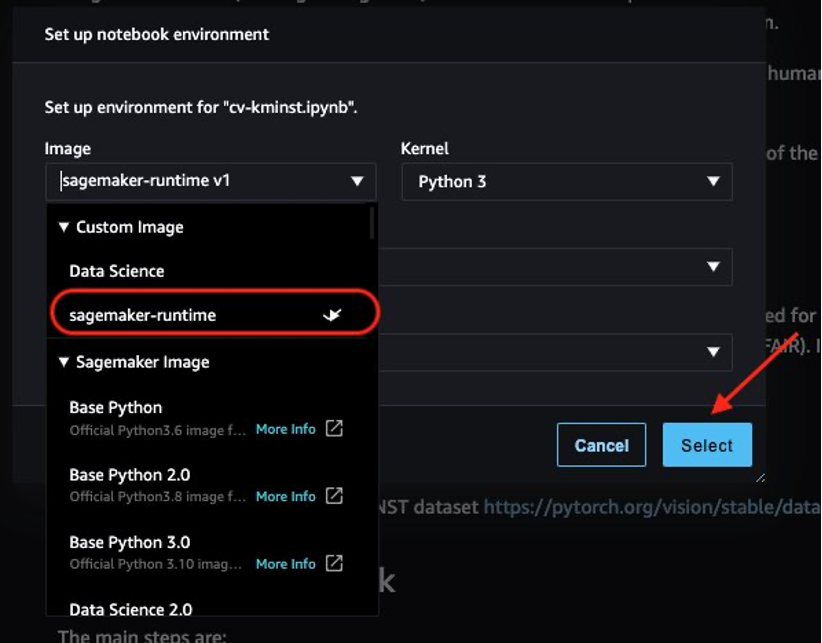

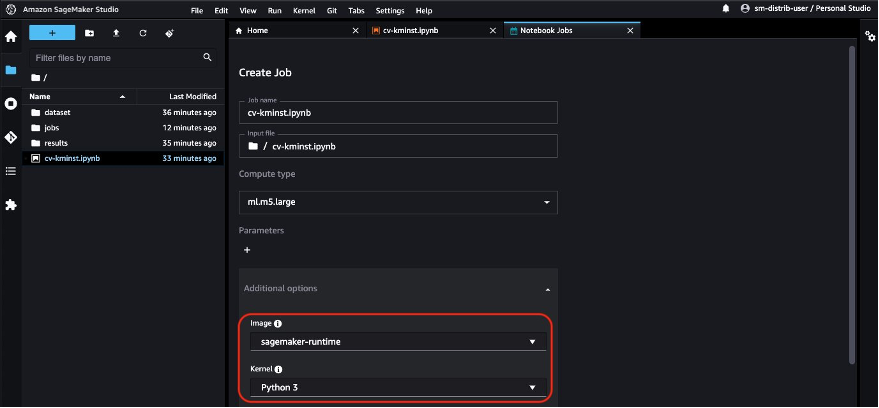

Po uruchomieniu notatnika zostaniesz poproszony o wybranie obrazu i typu instancji. W programie uruchamiającym jądro wybierz sagemaker-runtime jako obraz i ml.t3.medium przykład, a następnie wybierz Wybierz.

Możesz teraz uruchomić notatnik od końca do końca bez konieczności wprowadzania jakichkolwiek zmian w notatniku z lokalnego środowiska programistycznego do notesów Studio!

Zaplanuj notatnik jako zadanie

Kiedy skończysz eksperymentować, SageMaker zapewnia wiele opcji produkcji notebooka, takich jak zadania szkoleniowe i potoki SageMaker. Jedną z takich opcji jest bezpośrednie uruchomienie samego notatnika jako nieinteraktywnego, zaplanowanego zadania notatnika Zadania z notebooka SageMaker. Na przykład możesz chcieć okresowo przeszkolić swój model lub okresowo uzyskiwać wnioski na temat przychodzących danych i generować raporty do wykorzystania przez interesariuszy.

W Studio wybierz ikonę zadania notatnika, aby uruchomić zadanie notatnika. Jeśli zainstalowałeś rozszerzenie zadań notebooka lokalnie na swoim laptopie, możesz również zaplanować notebooka bezpośrednio z laptopa. Widzieć Instrukcja instalacji , aby lokalnie skonfigurować rozszerzenie zadań notebooka.

Zadanie notatnika automatycznie używa identyfikatora URI obrazu ECR dystrybucji typu open source, dzięki czemu można bezpośrednio zaplanować zadanie notatnika.

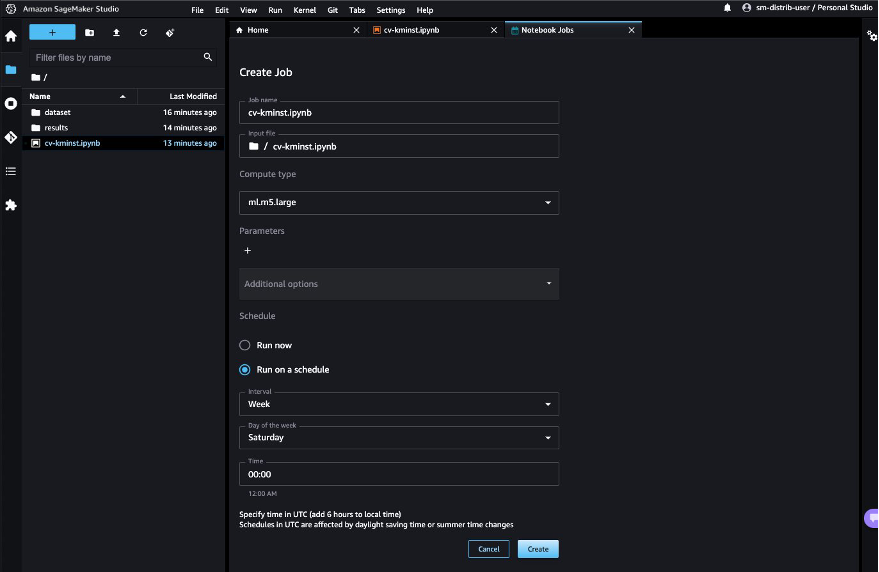

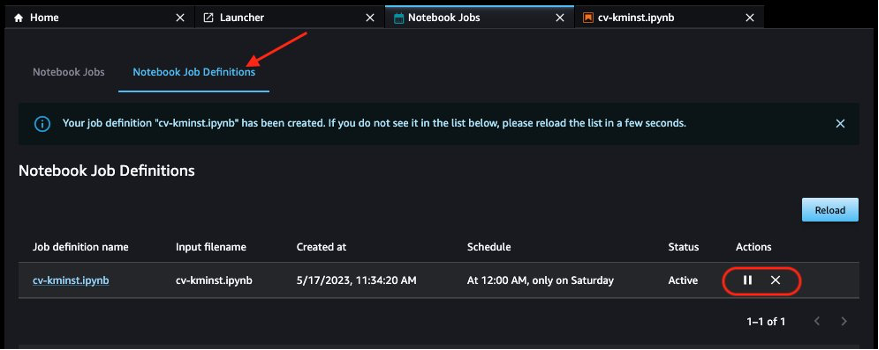

Dodaj Biegaj zgodnie z harmonogramem, wybierz harmonogram, na przykład co tydzień w sobotę, i wybierz Utwórz. Możesz także wybrać Biegnij teraz jeśli chcesz natychmiast zobaczyć wyniki.

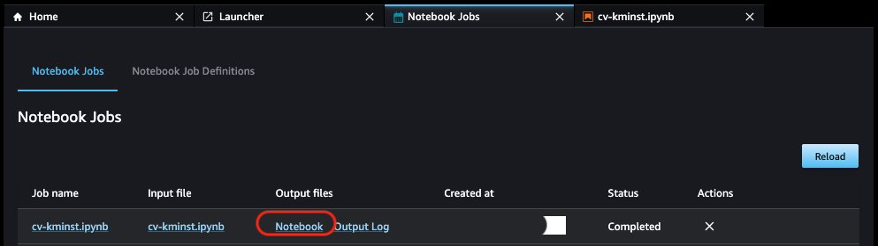

Po zakończeniu pierwszego zadania notatnika możesz przeglądać wyniki notatnika bezpośrednio z interfejsu Studio, wybierając opcję Notatnik dla Pliki wyjściowe.

Dodatkowe uwagi

Oprócz korzystania z publicznie dostępnego obrazu ECR bezpośrednio dla obciążeń ML, dystrybucja typu open source oferuje następujące korzyści:

- Plik Dockerfile użyty do zbudowania obrazu jest publicznie dostępny dla programistów, którzy mogą eksplorować i tworzyć własne obrazy. Możesz także odziedziczyć ten obraz jako obraz podstawowy i zainstalować niestandardowe biblioteki, aby mieć odtwarzalne środowisko.

- Jeśli nie jesteś przyzwyczajony do Dockera i wolisz używać środowisk Conda w swoim środowisku JupyterLab, zapewniamy

env.outplik dla każdej z opublikowanych wersji. Możesz użyć instrukcji zawartych w pliku, aby stworzyć własne środowisko Conda, które będzie naśladować to samo środowisko. Na przykład zobacz plik środowiska procesora cpu.env.out. - Wersji obrazu GPU można używać do uruchamiania obciążeń zgodnych z procesorem GPU, takich jak głębokie uczenie się i przetwarzanie obrazu.

Sprzątać

Wykonaj następujące kroki, aby wyczyścić zasoby:

- Jeśli zaplanowałeś uruchamianie notebooka zgodnie z harmonogramem, wstrzymaj lub usuń harmonogram w Definicje zadań notebooka kartę, aby uniknąć płacenia za przyszłe zlecenia.

- Zamknij wszystkie aplikacje Studio, aby uniknąć płacenia za nieużywane zasoby obliczeniowe. Widzieć Zamknij i zaktualizuj aplikacje Studio po instrukcje.

- Opcjonalnie usuń domenę Studio, jeśli ją utworzyłeś.

Wnioski

Utrzymanie powtarzalnego środowiska na różnych etapach cyklu życia uczenia maszynowego jest jednym z największych wyzwań dla analityków danych i programistów. Dystrybucja open-source SageMaker zapewnia obraz z wzajemnie kompatybilnymi wersjami najpopularniejszych frameworków i pakietów ML. Dystrybucja jest również open source, zapewniając programistom przejrzystość pakietów i procesów kompilacji, ułatwiając dostosowywanie własnej dystrybucji.

W tym poście pokazaliśmy, jak używać dystrybucji w środowisku lokalnym, w Studio i jako kontener dla zadań szkoleniowych. Ta funkcja jest obecnie w publicznej wersji beta. Zachęcamy do wypróbowania tej funkcji i podzielenia się swoimi opiniami i problemami dotyczącymi programu publiczne repozytorium GitHub!

O autorach

Durga Sury jest Architektem Rozwiązań ML w zespole Amazon SageMaker Service SA. Jej pasją jest udostępnianie uczenia maszynowego wszystkim. W ciągu 4 lat pracy w AWS pomogła skonfigurować platformy AI/ML dla klientów korporacyjnych. Kiedy nie pracuje, uwielbia przejażdżki motocyklem, kryminały i długie spacery ze swoim 5-letnim husky.

Durga Sury jest Architektem Rozwiązań ML w zespole Amazon SageMaker Service SA. Jej pasją jest udostępnianie uczenia maszynowego wszystkim. W ciągu 4 lat pracy w AWS pomogła skonfigurować platformy AI/ML dla klientów korporacyjnych. Kiedy nie pracuje, uwielbia przejażdżki motocyklem, kryminały i długie spacery ze swoim 5-letnim husky.

Ketan Vijayvargiya jest starszym inżynierem rozwoju oprogramowania w Amazon Web Services (AWS). Specjalizuje się w uczeniu maszynowym, systemach rozproszonych i open source. Poza pracą lubi spędzać czas u siebie i cieszyć się przyrodą.

Ketan Vijayvargiya jest starszym inżynierem rozwoju oprogramowania w Amazon Web Services (AWS). Specjalizuje się w uczeniu maszynowym, systemach rozproszonych i open source. Poza pracą lubi spędzać czas u siebie i cieszyć się przyrodą.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- EVM Finanse. Ujednolicony interfejs dla zdecentralizowanych finansów. Dostęp tutaj.

- Quantum Media Group. Wzmocnienie IR/PR. Dostęp tutaj.

- PlatoAiStream. Analiza danych Web3. Wiedza wzmocniona. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/get-started-with-the-open-source-amazon-sagemaker-distribution/

- :ma

- :Jest

- :nie

- $W GÓRĘ

- 1

- 10

- 100

- 11

- 2023

- 7

- 9

- a

- O nas

- dostępny

- w poprzek

- Dodaj

- dodatek

- Dodatkowy

- Korzyść

- Zalety

- AI / ML

- Wszystkie kategorie

- już

- również

- Amazonka

- Amazon Sage Maker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- i

- ogłosił

- każdy

- Aplikacja

- mobilne i webowe

- SĄ

- obszary

- AS

- At

- dołączać

- automatycznie

- dostępny

- uniknąć

- AWS

- tło

- baza

- na podstawie

- BE

- Początek

- beta

- pomiędzy

- Najwyższa

- przeglądarka

- budować

- by

- CAN

- CAT

- Komórki

- wyzwania

- Zmiany

- wybór

- Dodaj

- Wybierając

- klasyfikacja

- COM

- wspólny

- zgodny

- kompletny

- obliczać

- systemu

- zgodny

- Konsola

- konsumpcja

- Pojemnik

- Pojemniki

- Stwórz

- stworzony

- Obecnie

- zwyczaj

- Klientów

- dostosować

- dane

- nauka danych

- zbiory danych

- głęboko

- głęboka nauka

- Domyślnie

- rozwijać

- opisać

- deweloperzy

- oprogramowania

- różne

- bezpośrednio

- dystrybuowane

- systemy rozproszone

- 分配

- Doker

- domena

- zrobić

- na dół

- każdy

- Wcześniej

- łatwiej

- z łatwością

- Umożliwia

- zachęcać

- zakończenia

- koniec końców

- inżynier

- zapewnić

- Wchodzę

- Enterprise

- Środowisko

- środowiska

- Każdy

- wszyscy

- przykład

- przykłady

- Przede wszystkim system został opracowany

- doświadczenie

- eksperyment

- ekspertyza

- odkryj

- eksport

- rozbudowa

- rozległy

- Cecha

- Korzyści

- informacja zwrotna

- filet

- W końcu

- i terminów, a

- Skupiać

- następnie

- następujący

- W razie zamówieenia projektu

- Framework

- Ramy

- od

- pełny

- w pełni

- przyszłość

- Generować

- otrzymać

- GitHub

- GPU

- Have

- mający

- he

- pomógł

- jej

- jego

- W jaki sposób

- How To

- HTML

- HTTPS

- ICON

- if

- obraz

- Klasyfikacja obrazu

- zdjęcia

- natychmiast

- podnieść

- in

- Przybywający

- zainstalować

- zainstalowany

- Instalacja

- przykład

- instrukcje

- zintegrowany

- najnowszych

- problemy

- IT

- samo

- Praca

- Oferty pracy

- jpg

- json

- laboratorium

- laptopa

- większe

- uruchomić

- uruchomiona

- nauka

- pozwala

- poziomy

- biblioteki

- wifecycwe

- lubić

- lubi

- LINK

- Lista

- miejscowy

- lokalnie

- Zaloguj Się

- długo

- dłużej

- od

- kocha

- maszyna

- uczenie maszynowe

- robić

- Dokonywanie

- zarządzanie

- zarządzający

- matplotlib

- może

- migrować

- ML

- model

- modele

- monitor

- większość

- motocykl

- ruch

- wielokrotność

- wzajemnie

- Tajemnica

- Nazwa

- Natura

- Potrzebować

- potrzeba

- sieć

- sieci neuronowe

- Nowości

- Następny

- Nie

- notatnik

- już dziś

- of

- Oferty

- on

- ONE

- koncepcja

- open source

- Option

- Opcje

- or

- ludzkiej,

- na zewnątrz

- zewnętrzne

- własny

- pakiet

- Pakiety

- pandy

- część

- namiętny

- pauza

- zwracając

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- Miejsce

- Platformy

- plato

- Analiza danych Platona

- PlatoDane

- Post

- woleć

- Korzystny

- warunki wstępne

- prywatny

- procesów

- przetwarzanie

- Produkcja

- Profil

- promować

- zapewniać

- zapewnia

- że

- publiczny

- publicznie

- opublikowany

- Naciskać

- Python

- płomień

- szybko

- polecić

- obsługi produkcji rolnej, która zastąpiła

- Raporty

- składnica

- wymagania

- Zasoby

- Efekt

- run

- bieganie

- s

- SA

- sagemaker

- Rurociągi SageMaker

- taki sam

- sobota

- Zapisz

- Skala

- rozkład

- zaplanowane

- nauka

- Naukowcy

- nauka-scikit

- bezpieczne

- widzieć

- senior

- usługa

- Usługi

- służąc

- zestaw

- w panelu ustawień

- Share

- ona

- pokazać

- prezentacja

- pokazał

- pokazane

- Prosty

- po prostu

- So

- Tworzenie

- rozwoju oprogramowania

- Rozwiązania

- Źródło

- Iskra

- wydać

- etapy

- interesariusze

- początek

- rozpoczęty

- Startowy

- Ewolucja krok po kroku

- Cel

- studio

- taki

- podpory

- Przełącznik

- systemy

- TAG

- Brać

- zespół

- tensorflow

- terminal

- test

- że

- Połączenia

- ich

- Im

- następnie

- Te

- one

- to

- czas

- do

- już dziś

- pochodnia

- Pociąg

- Trening

- Przezroczystość

- próbować

- rodzaj

- ui

- zasadniczy

- Ujednolicony

- nieużywana

- Aktualizacja

- przesłanych

- URL

- Stosowanie

- posługiwać się

- używany

- Użytkownik

- zastosowania

- za pomocą

- wersja

- Zobacz i wysłuchaj

- wyobrażanie sobie

- chcieć

- poszukiwany

- we

- sieć

- usługi internetowe

- tydzień

- jeśli chodzi o komunikację i motywację

- będzie

- w

- bez

- Praca

- pracujący

- lat

- You

- Twój

- zefirnet