Klienci każdej wielkości i każdej branży wprowadzają innowacje w AWS, wprowadzając uczenie maszynowe (ML) do swoich produktów i usług. Niedawne osiągnięcia w zakresie generatywnych modeli sztucznej inteligencji jeszcze bardziej przyspieszyły potrzebę wdrożenia uczenia maszynowego w różnych branżach. Jednak wdrażanie zabezpieczeń, prywatności danych i kontroli zarządzania to nadal kluczowe wyzwania stojące przed klientami podczas wdrażania obciążeń uczenia maszynowego na dużą skalę. Sprostanie tym wyzwaniom tworzy ramy i podstawy służące ograniczaniu ryzyka i odpowiedzialnemu korzystaniu z produktów opartych na uczeniu maszynowym. Chociaż generatywna sztuczna inteligencja może wymagać dodatkowych kontroli, takich jak usuwanie toksyczności i zapobieganie jailbreakom i halucynacjom, ma te same podstawowe elementy bezpieczeństwa i zarządzania, co tradycyjne ML.

Słyszymy od klientów, że potrzebują specjalistycznej wiedzy i inwestycji trwającej do 12 miesięcy, aby zbudować swój indywidualny projekt Amazon Sage Maker Wdrożenie platformy ML w celu zapewnienia skalowalnych, niezawodnych, bezpiecznych i regulowanych środowisk ML dla swoich linii biznesowych (LOB) lub zespołów ML. Jeśli brakuje Ci ram do zarządzania cyklem życia uczenia maszynowego na dużą skalę, możesz napotkać wyzwania, takie jak izolacja zasobów na poziomie zespołu, skalowanie zasobów eksperymentalnych, operacjonalizacja przepływów pracy ML, zarządzanie modelem skalowania oraz zarządzanie bezpieczeństwem i zgodnością obciążeń ML.

Zarządzanie cyklem życia uczenia maszynowego na dużą skalę to platforma ułatwiająca budowanie platformy uczenia maszynowego z wbudowanymi mechanizmami kontroli bezpieczeństwa i zarządzania w oparciu o najlepsze praktyki branżowe i standardy korporacyjne. Ramy te rozwiązują wyzwania, zapewniając normatywne wytyczne poprzez modułowe podejście ramowe rozszerzające Wieża kontroli AWS wielokontowe środowisko AWS i podejście omówione w poście Konfigurowanie bezpiecznych, dobrze zarządzanych środowisk uczenia maszynowego na platformie AWS.

Zawiera normatywne wytyczne dotyczące następujących funkcji platformy ML:

- Podstawy wielu kont, bezpieczeństwa i sieci – Ta funkcja wykorzystuje AWS Control Tower i dobrze zaprojektowane zasady do konfigurowania i obsługi środowiska z wieloma kontami, bezpieczeństwa i usług sieciowych.

- Podstawy danych i zarządzania – Ta funkcja wykorzystuje a architektura siatki danych do konfigurowania i obsługi jeziora danych, centralnego magazynu funkcji i podstaw zarządzania danymi w celu umożliwienia szczegółowego dostępu do danych.

- Usługi współdzielenia i zarządzania platformą ML – Ta funkcja umożliwia konfigurowanie i obsługę typowych usług, takich jak CI/CD, Katalog usług AWS dla środowisk zaopatrzeniowych oraz centralny rejestr modeli do celów promocji i pochodzenia modeli.

- Środowiska zespołów ML – Ta funkcja umożliwia konfigurowanie i działanie środowisk dla zespołów ML na potrzeby opracowywania modeli, testowania i wdrażania ich przypadków użycia w celu osadzania kontroli bezpieczeństwa i zarządzania.

- Obserwowalność platformy ML – Ta funkcja pomaga w rozwiązywaniu problemów i identyfikowaniu pierwotnej przyczyny problemów w modelach ML poprzez centralizację logów i udostępnianie narzędzi do wizualizacji analizy logów. Zawiera także wskazówki dotyczące generowania raportów o kosztach i użyciu dla przypadków użycia ML.

Chociaż ta struktura może zapewnić korzyści wszystkim klientom, jest najbardziej korzystna dla dużych, dojrzałych, regulowanych lub globalnych przedsiębiorstw, które chcą skalować swoje strategie uczenia maszynowego w sposób kontrolowany, zgodny i skoordynowany w całej organizacji. Pomaga umożliwić przyjęcie uczenia maszynowego, jednocześnie ograniczając ryzyko. Ramy te są przydatne dla następujących klientów:

- Duzi klienci korporacyjni, którzy mają wiele LOBów lub działów zainteresowanych wykorzystaniem ML. Ta struktura umożliwia różnym zespołom niezależne budowanie i wdrażanie modeli uczenia maszynowego, zapewniając jednocześnie centralne zarządzanie.

- Klienci korporacyjni o umiarkowanej do wysokiej dojrzałości w ML. Wdrożyli już kilka początkowych modeli uczenia maszynowego i chcą skalować swoje wysiłki w zakresie uczenia maszynowego. Ta struktura może pomóc przyspieszyć wdrażanie uczenia maszynowego w całej organizacji. Firmy te dostrzegają również potrzebę zarządzania w celu zarządzania takimi kwestiami, jak kontrola dostępu, wykorzystanie danych, wydajność modeli i nieuczciwe uprzedzenia.

- Spółki z branż regulowanych, takich jak usługi finansowe, opieka zdrowotna, chemia i sektor prywatny. Firmy te potrzebują silnego zarządzania i słyszalności wszelkich modeli uczenia maszynowego stosowanych w ich procesach biznesowych. Przyjęcie tych ram może pomóc w ułatwieniu przestrzegania przepisów, jednocześnie umożliwiając rozwój modelu lokalnego.

- Organizacje globalne, które muszą zrównoważyć kontrolę scentralizowaną i lokalną. Stowarzyszone podejście tej struktury umożliwia zespołowi inżynierów platformy centralnej ustalenie pewnych zasad i standardów wysokiego poziomu, ale zapewnia także zespołom LOB elastyczność w dostosowywaniu się do lokalnych potrzeb.

W pierwszej części tej serii omówimy architekturę referencyjną służącą do konfigurowania platformy uczenia maszynowego. W późniejszym poście przedstawimy wytyczne dotyczące sposobu wdrażania różnych modułów architektury referencyjnej w Twojej organizacji.

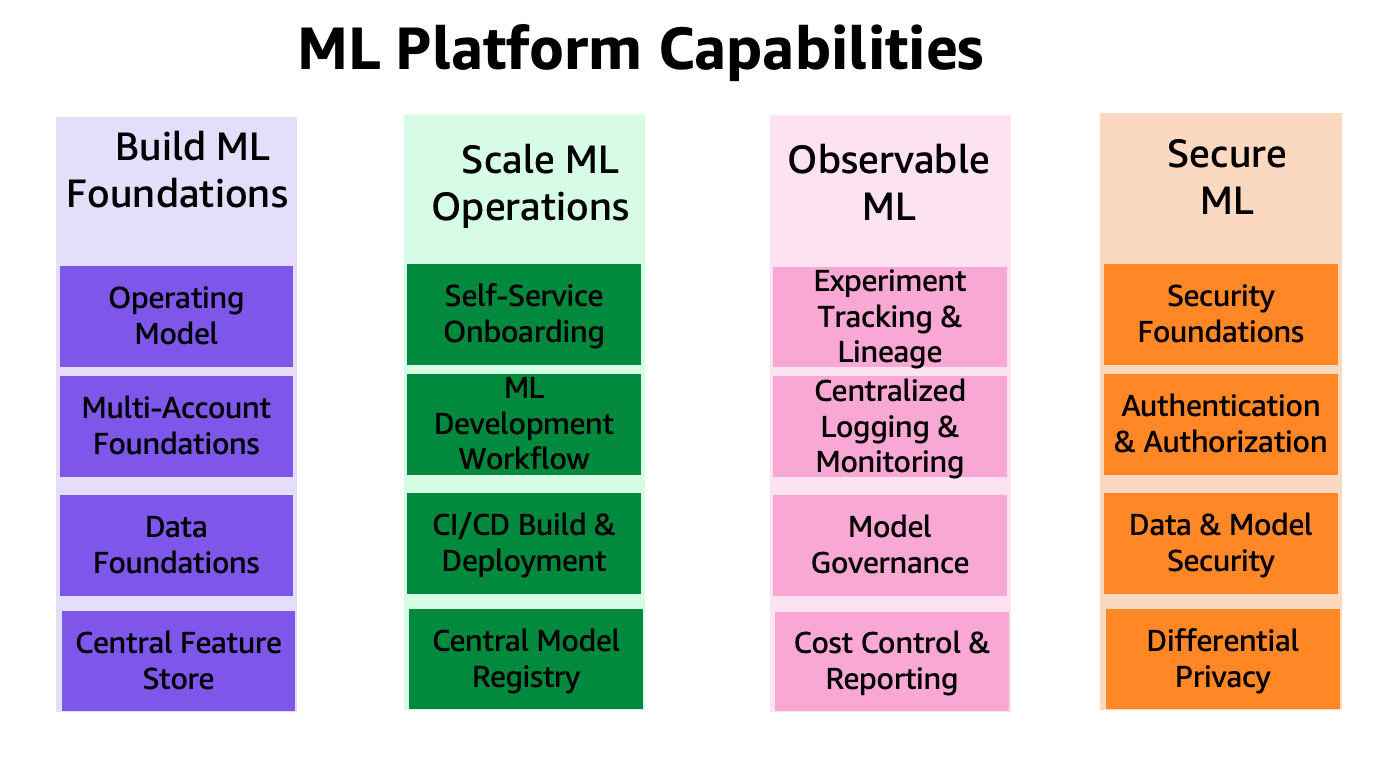

Możliwości platformy ML pogrupowano w cztery kategorie, jak pokazano na poniższym rysunku. Możliwości te stanowią podstawę architektury referencyjnej omówionej w dalszej części tego wpisu:

- Zbuduj fundamenty ML

- Skaluj operacje ML

- Obserwowalny ML

- Bezpieczny ml

Omówienie rozwiązania

Ramy zarządzania cyklem życia uczenia maszynowego na dużą skalę umożliwiają organizacjom osadzanie kontroli bezpieczeństwa i zarządzania w całym cyklu życia uczenia maszynowego, co z kolei pomaga organizacjom zmniejszyć ryzyko i przyspieszyć wdrażanie uczenia maszynowego w swoich produktach i usługach. Struktura pomaga zoptymalizować konfigurację i zarządzanie bezpiecznymi, skalowalnymi i niezawodnymi środowiskami uczenia maszynowego, które można skalować w celu obsługi coraz większej liczby modeli i projektów. Framework udostępnia następujące funkcje:

- Udostępnianie kont i infrastruktury przy użyciu zasobów infrastruktury zgodnych z zasadami organizacji

- Samoobsługowe wdrażanie środowisk analizy danych i szablonów kompleksowych operacji ML (MLops) dla przypadków użycia ML

- Izolacja zasobów na poziomie LOB lub zespołu w celu zapewnienia zgodności z bezpieczeństwem i prywatnością

- Kontrolowany dostęp do danych klasy produkcyjnej na potrzeby eksperymentów i przepływów pracy gotowych do produkcji

- Zarządzanie i nadzór nad repozytoriami kodu, potokami kodu, wdrożonymi modelami i funkcjami danych

- Rejestr modeli i magazyn funkcji (komponenty lokalne i centralne) w celu poprawy zarządzania

- Kontrole bezpieczeństwa i zarządzania na potrzeby kompleksowego procesu opracowywania i wdrażania modelu

W tej sekcji przedstawiamy przegląd normatywnych wskazówek, które pomogą Ci zbudować platformę ML na AWS z wbudowanymi kontrolami bezpieczeństwa i zarządzania.

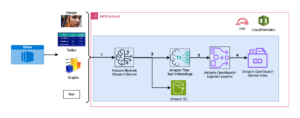

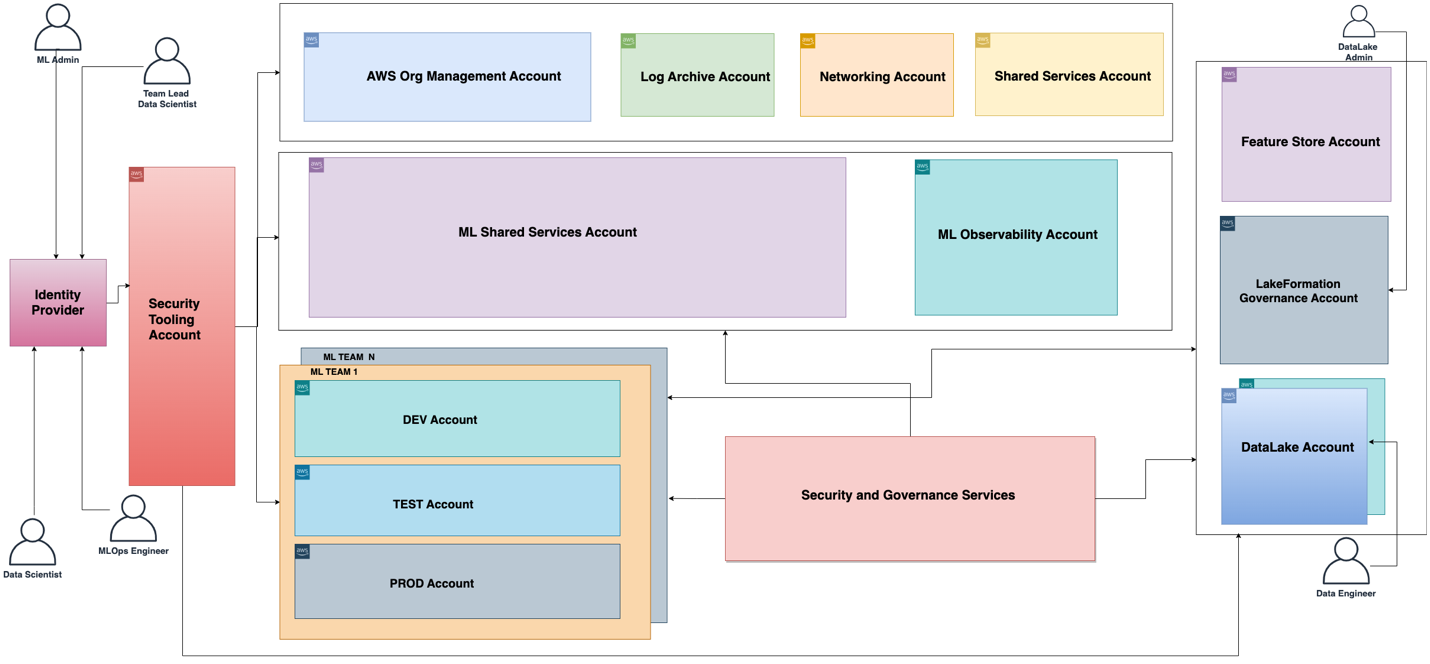

Architekturę funkcjonalną związaną z platformą ML przedstawia poniższy diagram. Architektura odwzorowuje różne możliwości platformy ML na konta AWS.

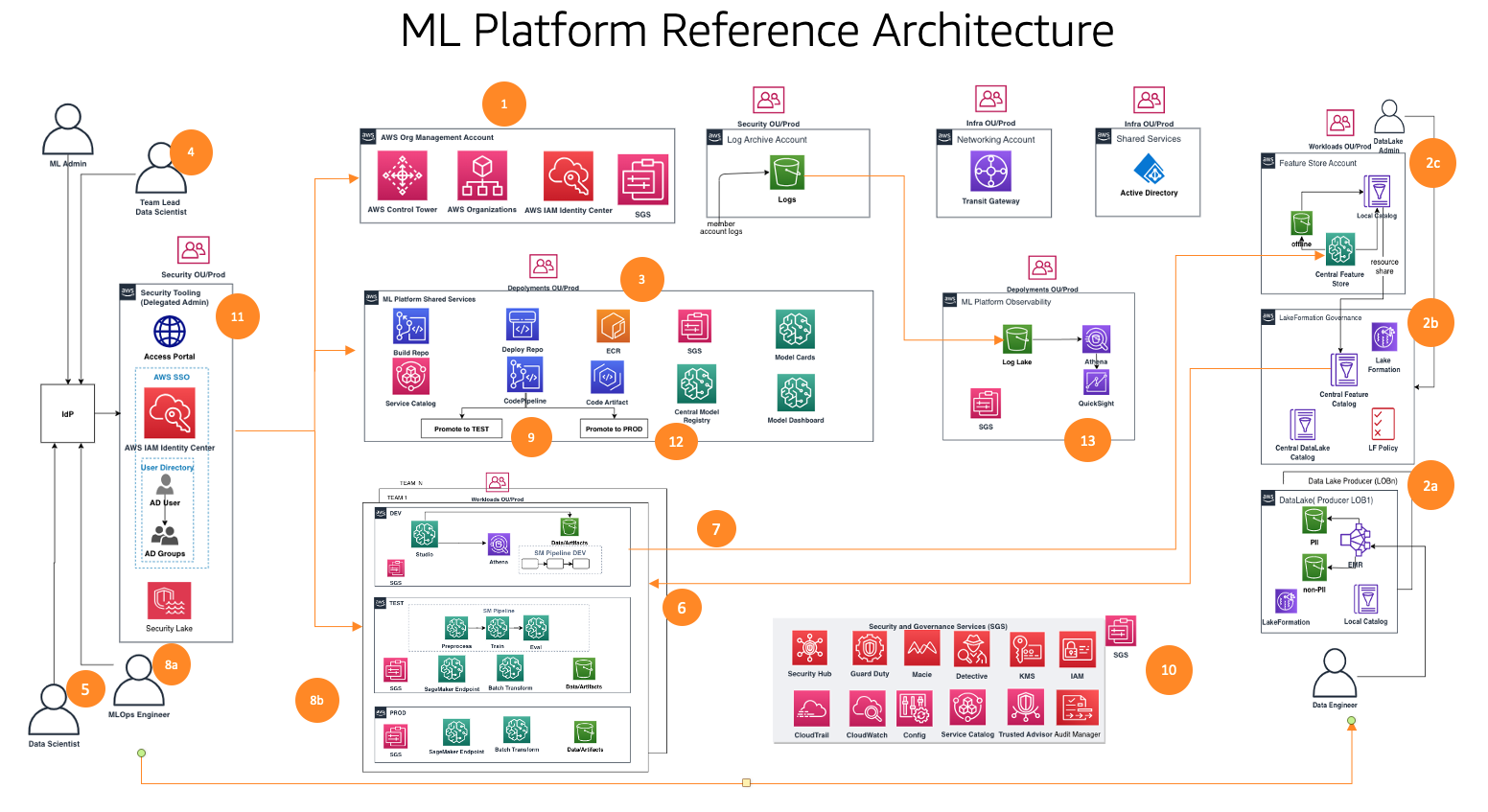

Architektura funkcjonalna o różnych możliwościach jest realizowana z wykorzystaniem szeregu usług AWS, m.in Organizacje AWS, SageMaker, usługi AWS DevOps i jezioro danych. Architekturę referencyjną platformy ML z różnymi usługami AWS przedstawia poniższy diagram.

W ramach tych ram uwzględniono wiele osób i usług w celu zarządzania cyklem życia uczenia maszynowego na dużą skalę. Zalecamy wykonanie następujących kroków w celu zorganizowania zespołów i usług:

- Korzystając z AWS Control Tower i narzędzi do automatyzacji, administrator chmury konfiguruje podstawy wielu kont, takie jak Organizacje i Centrum tożsamości AWS IAM (następca AWS Single Sign-On) oraz usługi bezpieczeństwa i zarządzania, takie jak Usługa zarządzania kluczami AWS (AWS KMS) i Katalog usług. Ponadto administrator konfiguruje różne jednostki organizacyjne (OU) i konta początkowe w celu obsługi przepływów pracy w zakresie uczenia maszynowego i analiz.

- Administratorzy Data Lake skonfigurowali Twoje jezioro danych i katalog danych oraz skonfigurowali centralny magazyn funkcji współpracujący z administratorem platformy ML.

- Administrator platformy ML udostępnia usługi wspólne ML, takie jak Zatwierdzenie kodu AWS, AWS Code Pipeline, Rejestr elastycznego pojemnika Amazon (Amazon ECR), centralny rejestr modeli, Karty modeli SageMaker, Pulpit nawigacyjny modelu SageMakeri produkty z katalogu usług dla zespołów ML.

- Lider zespołu ML łączy się za pośrednictwem IAM Identity Center, korzysta z produktów katalogu usług i udostępnia zasoby w środowisku programistycznym zespołu ML.

- Analitycy danych z zespołów uczenia maszynowego z różnych jednostek biznesowych łączą się ze środowiskiem programistycznym swojego zespołu, aby zbudować potok modelu.

- Analitycy danych wyszukują i pobierają funkcje z centralnego katalogu magazynu funkcji, budują modele w drodze eksperymentów i wybierają najlepszy model do promocji.

- Analitycy danych tworzą i udostępniają nowe funkcje w centralnym katalogu magazynu funkcji w celu ich ponownego wykorzystania.

- Inżynier ML wdraża potok modelu w środowisku testowym zespołu ML przy użyciu procesu CI/CD usług wspólnych.

- Po weryfikacji interesariuszy model ML jest wdrażany w środowisku produkcyjnym zespołu.

- Kontrole bezpieczeństwa i zarządzania są wbudowane w każdą warstwę tej architektury za pomocą usług takich jak Centrum bezpieczeństwa AWS, Amazon Guard Obowiązek, AmazonkaI więcej.

- Kontrole bezpieczeństwa są zarządzane centralnie z poziomu konta narzędzi zabezpieczających za pomocą Security Hub.

- Funkcje zarządzania platformą ML, takie jak karty SageMaker Model Card i SageMaker Model Dashboard, są zarządzane centralnie z poziomu konta usług zarządzania.

- Amazon Cloud Watch i Chmura AWS logi z każdego konta członkowskiego są udostępniane centralnie z konta obserwowalności przy użyciu natywnych usług AWS.

Następnie zagłębiamy się w moduły architektury referencyjnej dla tego frameworka.

Moduły architektury referencyjnej

Architektura referencyjna składa się z ośmiu modułów, z których każdy ma za zadanie rozwiązać określony zestaw problemów. Łącznie moduły te dotyczą zarządzania w różnych wymiarach, takich jak infrastruktura, dane, model i koszty. Każdy moduł oferuje odrębny zestaw funkcji i współpracuje z innymi modułami, tworząc zintegrowaną, kompleksową platformę ML z wbudowanymi mechanizmami kontroli bezpieczeństwa i zarządzania. W tej sekcji przedstawiamy krótkie podsumowanie możliwości każdego modułu.

Fundacje wielokontowe

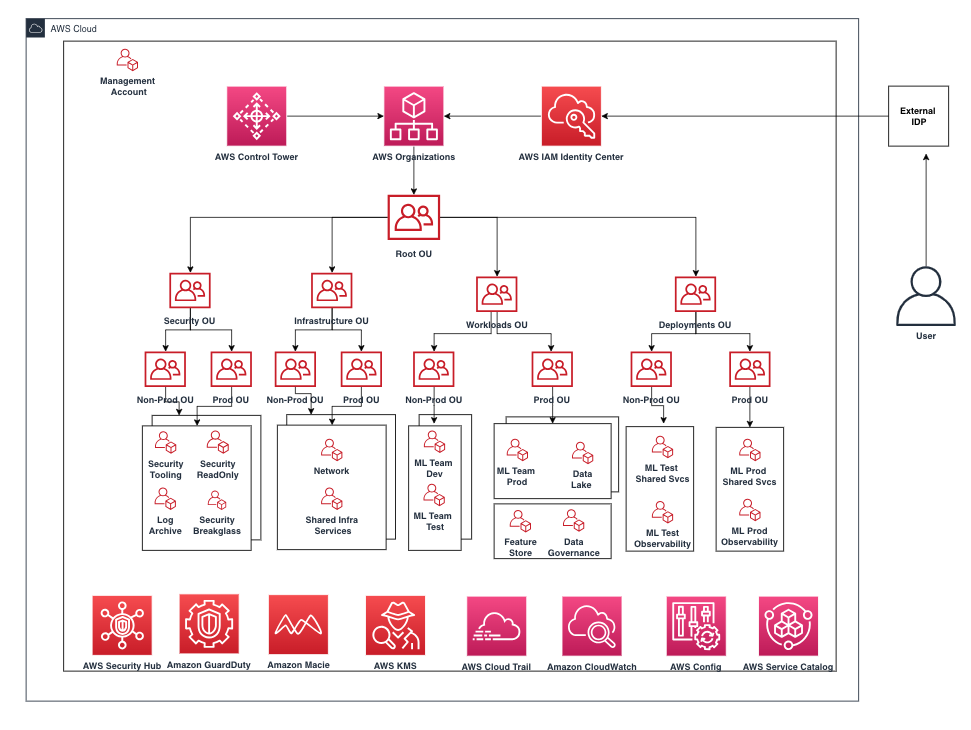

Ten moduł pomaga administratorom chmury w tworzeniu Strefa lądowania wieży kontrolnej AWS jako ramy podstawowe. Obejmuje to budowanie struktury obejmującej wiele kont, uwierzytelnianie i autoryzację za pośrednictwem IAM Identity Center, projekt sieci typu „hub-and-szprychy”, scentralizowane usługi rejestrowania oraz nowe konta członkowskie AWS ze standardowymi podstawami bezpieczeństwa i zarządzania.

Ponadto moduł ten zawiera wskazówki dotyczące najlepszych praktyk w zakresie struktur jednostek organizacyjnych i kont, które są odpowiednie do obsługi procesów uczenia maszynowego i analiz. Administratorzy chmury będą rozumieć cel wymaganych kont i jednostek organizacyjnych, sposób ich wdrażania oraz kluczowe usługi bezpieczeństwa i zgodności, których powinni używać do centralnego zarządzania obciążeniami związanymi z uczeniem się maszyn i analizą.

Omówiono także strukturę sprzedaży nowych kont, która wykorzystuje automatyzację do tworzenia baz danych dla nowych kont po ich udostępnieniu. Dzięki skonfigurowaniu zautomatyzowanego procesu udostępniania kont administratorzy chmury mogą zapewnić zespołom ML i analitykom konta, których potrzebują, aby szybciej wykonywać swoją pracę, nie rezygnując z solidnych podstaw zarządzania.

Fundamenty jeziora danych

Ten moduł pomaga administratorom Data Lake skonfigurować jezioro danych w celu pozyskiwania danych, zarządzania zbiorami danych i korzystania z nich Formacja AWS Lake model zarządzania umożliwiający zarządzanie szczegółowym dostępem do danych między kontami i użytkownikami przy użyciu scentralizowanego katalogu danych, zasad dostępu do danych i kontroli dostępu opartej na tagach. Możesz zacząć od jednego konta stanowiącego podstawę platformy danych w celu sprawdzenia koncepcji lub kilku małych obciążeń. W przypadku implementacji obciążenia produkcyjnego na średnią i dużą skalę zalecamy przyjęcie strategii wielu kont. W takim ustawieniu LOB mogą przyjąć rolę producentów i konsumentów danych korzystających z różnych kont AWS, a zarządzanie jeziorem danych jest obsługiwane z centralnego, współdzielonego konta AWS. Producent danych zbiera, przetwarza i przechowuje dane ze swojej domeny danych, a także monitoruje i zapewnia jakość swoich zasobów danych. Konsumenci danych korzystają z danych od producenta danych po udostępnieniu ich przez scentralizowany katalog przy użyciu usługi Lake Formation. Scentralizowany katalog przechowuje udostępniony katalog danych dla kont producentów danych i zarządza nim.

Usługi platformy ML

Ten moduł pomaga zespołowi inżynierów platformy ML skonfigurować usługi udostępnione, z których korzystają zespoły analityki danych na swoich kontach zespołów. Usługi obejmują katalog usług z produktami dla Domena SageMakera zastosowanie, Profil użytkownika domeny SageMaker wdrażanie, szablony modeli analizy danych do budowania i wdrażania modeli. Moduł ten zawiera funkcje scentralizowanego rejestru modeli, kart modeli, pulpitu nawigacyjnego modeli oraz potoków CI/CD używanych do organizowania i automatyzowania przepływów pracy związanych z opracowywaniem i wdrażaniem modeli.

Ponadto w tym module szczegółowo opisano sposób wdrażania kontroli i zarządzania wymaganych do umożliwienia samoobsługi opartej na osobach, umożliwiając zespołom zajmującym się analizą danych niezależne wdrażanie wymaganej infrastruktury chmurowej i szablonów ML.

Opracowywanie przypadków użycia ML

Moduł ten pomaga specjalistom LOB i badaczom danych uzyskać dostęp do domeny SageMaker ich zespołu w środowisku programistycznym i utworzyć instancję szablonu budowania modelu w celu opracowania ich modeli. W tym module badacze danych pracują nad instancją szablonu na koncie deweloperskim, aby wchodzić w interakcję z danymi dostępnymi w scentralizowanym jeziorze danych, ponownie wykorzystywać i udostępniać funkcje z centralnego magazynu funkcji, tworzyć i uruchamiać eksperymenty ML, budować i testować przepływy pracy ML, i zarejestruj swoje modele w rejestrze modeli kont deweloperów w swoich środowiskach programistycznych.

W szablonach zaimplementowano także takie funkcje, jak śledzenie eksperymentów, raporty wyjaśnialności modeli, monitorowanie danych i odchyleń modelu oraz rejestrowanie modeli, co pozwala na szybkie dostosowanie rozwiązań do modeli opracowanych przez analityków danych.

Operacje ML

Ten moduł pomaga inżynierom LOB i ML pracować nad instancjami deweloperskimi szablonu wdrażania modelu. Po zarejestrowaniu i zatwierdzeniu modelu kandydata konfigurują potoki CI/CD i uruchamiają przepływy pracy ML w środowisku testowym zespołu, które rejestruje model w centralnym rejestrze modeli działającym na koncie usług wspólnych platformy. Zatwierdzenie modelu w centralnym rejestrze modeli uruchamia potok CI/CD w celu wdrożenia modelu w środowisku produkcyjnym zespołu.

Scentralizowany magazyn funkcji

Gdy pierwsze modele zostaną wdrożone w środowisku produkcyjnym i wiele przypadków użycia zacznie współdzielić funkcje utworzone na podstawie tych samych danych, magazyn funkcji staje się niezbędny, aby zapewnić współpracę między przypadkami użycia i ograniczyć powielanie pracy. Moduł ten pomaga zespołowi inżynierów platformy ML skonfigurować scentralizowany magazyn funkcji w celu zapewnienia przechowywania i zarządzania funkcjami ML utworzonymi w przypadkach użycia ML, umożliwiając ponowne wykorzystanie funkcji w różnych projektach.

Rejestrowanie i obserwowalność

Moduł ten pomaga specjalistom LOB i praktykom ML uzyskać wgląd w stan obciążeń ML w środowiskach ML poprzez centralizację aktywności dzienników, takich jak CloudTrail, CloudWatch, dzienniki przepływu VPC i dzienniki obciążeń ML. Zespoły mogą filtrować, wysyłać zapytania i wizualizować dzienniki do analizy, co może również pomóc w zwiększeniu poziomu bezpieczeństwa.

Koszty i raportowanie

Moduł ten pomaga różnym zainteresowanym stronom (administratorowi chmury, administratorowi platformy, biuru biznesowemu w chmurze) generować raporty i pulpity nawigacyjne w celu rozbicia kosztów na poziomie użytkownika ML, zespołu ML i produktu ML oraz śledzić wykorzystanie, takie jak liczba użytkowników, typy instancji i punkty końcowe.

Klienci poprosili nas o wskazówki dotyczące liczby kont, które należy utworzyć i struktury tych kont. W następnej sekcji podajemy wskazówki dotyczące tej struktury konta jako odniesienie, które można modyfikować w celu dostosowania do własnych potrzeb zgodnie z wymaganiami dotyczącymi ładu korporacyjnego.

W tej sekcji omawiamy nasze zalecenia dotyczące organizacji struktury konta. Mamy wspólną bazową strukturę konta referencyjnego; zalecamy jednak, aby administratorzy systemów uczących się i danych ściśle współpracowali z administratorem chmury, aby dostosować tę strukturę konta na podstawie kontroli organizacji.

Zalecamy organizowanie kont według jednostek organizacyjnych ze względu na bezpieczeństwo, infrastrukturę, obciążenia i wdrożenia. Ponadto w obrębie każdej jednostki organizacyjnej organizuj według jednostek nieprodukcyjnych i produkcyjnych, ponieważ konta i obciążenia wdrożone w ich ramach mają inną kontrolę. Następnie krótko omówimy te jednostki organizacyjne.

Jednostka organizacyjna bezpieczeństwa

Kontami w tej jednostce organizacyjnej zarządza administrator chmury lub zespół ds. bezpieczeństwa organizacji w celu monitorowania, identyfikowania, ochrony, wykrywania i reagowania na zdarzenia związane z bezpieczeństwem.

Jednostka organizacyjna infrastruktury

Kontami w tej jednostce organizacyjnej zarządza administrator chmury lub zespół sieciowy organizacji w celu zarządzania udostępnionymi zasobami i sieciami infrastruktury na poziomie przedsiębiorstwa.

Zalecamy posiadanie następujących kont w ramach jednostki organizacyjnej infrastruktury:

- Sieć – Skonfiguruj scentralizowaną infrastrukturę sieciową, taką jak Bramka tranzytowa AWS

- Usługi wspólne – Skonfiguruj scentralizowane usługi AD i punkty końcowe VPC

Jednostka organizacyjna obciążeń

Kontami w tej jednostce organizacyjnej zarządzają administratorzy zespołu platformy organizacji. Jeśli potrzebujesz różnych kontroli zaimplementowanych dla każdego zespołu platformy, możesz w tym celu zagnieżdżać inne poziomy jednostki organizacyjnej, takie jak jednostka organizacyjna obciążeń ML, jednostka organizacyjna obciążeń danych itd.

Zalecamy następujące konta w ramach jednostki organizacyjnej obciążeń:

- Konta deweloperskie, testowe i produkcyjne ML na poziomie zespołu – Skonfiguruj tę opcję w oparciu o wymagania dotyczące izolacji obciążenia

- Konta jeziora danych – Podziel konta według domeny danych

- Centralne konto do zarządzania danymi – Scentralizuj zasady dostępu do danych

- Centralne konto w sklepie z funkcjami – Scentralizuj funkcje udostępniania między zespołami

Jednostka organizacyjna wdrożeń

Kontami w tej jednostce organizacyjnej zarządzają administratorzy zespołu platformy organizacji w celu wdrażania obciążeń i obserwowalności.

Zalecamy korzystanie z następujących kont w ramach jednostki organizacyjnej wdrożeń, ponieważ zespół platformy ML może skonfigurować różne zestawy kontroli na tym poziomie jednostki organizacyjnej w celu zarządzania wdrożeniami i zarządzania nimi:

- Konta usług wspólnych ML dla testów i produktów – Hostuje platformę usług wspólnych CI/CD i rejestr modeli

- Konta obserwowalności ML dla testów i prod – Hostuje dzienniki CloudWatch, dzienniki CloudTrail i inne dzienniki w razie potrzeby

Następnie pokrótce omawiamy mechanizmy kontrolne organizacji, które należy wziąć pod uwagę przy osadzaniu na kontach członkowskich w celu monitorowania zasobów infrastruktury.

Kontrole środowiska AWS

Kontrola to reguła wysokiego poziomu, która zapewnia ciągłe zarządzanie całym środowiskiem AWS. Wyraża się to prostym językiem. W tym kontekście używamy AWS Control Tower do wdrożenia następujących kontroli, które pomagają zarządzać zasobami i monitorować zgodność między grupami kont AWS:

- Kontrole prewencyjne – Kontrola zapobiegawcza zapewnia, że Twoje konta zachowują zgodność, ponieważ uniemożliwia działania prowadzące do naruszenia zasad i są wdrażane przy użyciu Polityki kontroli usług (SCP). Na przykład możesz ustawić kontrolę zapobiegawczą, która gwarantuje, że CloudTrail nie zostanie usunięty ani zatrzymany na kontach lub regionach AWS.

- Kontrole detektywistyczne – Kontrola detektywistyczna wykrywa niezgodność zasobów na Twoich kontach, np. naruszenia zasad, wyświetla alerty za pośrednictwem pulpitu nawigacyjnego i jest realizowana za pomocą Konfiguracja AWS zasady. Można na przykład utworzyć kontrolę detektywistyczną, która będzie wykrywać, czy włączono publiczny dostęp do odczytu Usługa Amazon Simple Storage Wiadra (Amazon S3) na wspólnym koncie archiwum logów.

- Proaktywne kontrole – Proaktywna kontrola skanuje Twoje zasoby przed ich udostępnieniem i upewnia się, że zasoby są zgodne z tą kontrolą i są wdrażane przy użyciu Tworzenie chmury AWS haczyki. Zasoby, które nie są zgodne, nie zostaną udostępnione. Można na przykład ustawić proaktywną kontrolę sprawdzającą, czy dla instancji notatnika SageMaker nie jest dozwolony bezpośredni dostęp do Internetu.

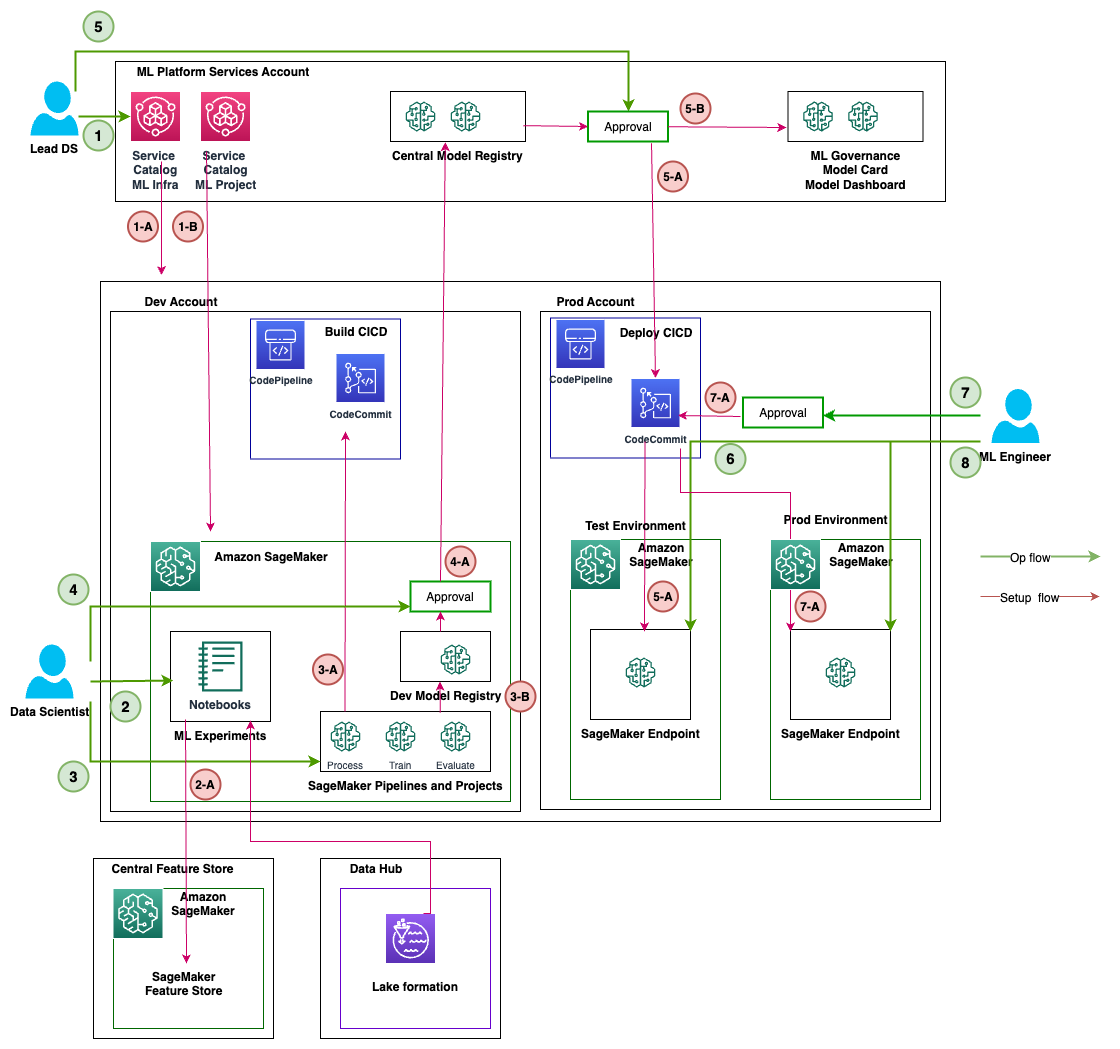

Interakcje między usługami platformy ML, przypadkami użycia ML i operacjami ML

Różne osoby, takie jak kierownik działu analityki danych (główny analityk danych), analityk danych i inżynier ML, obsługują moduły 2–6, jak pokazano na poniższym diagramie, dla różnych etapów usług platformy ML, opracowywania przypadków użycia ML i operacji ML wraz z fundamentami jeziora danych i centralnym magazynem funkcji.

W poniższej tabeli podsumowano czynności związane z przepływem operacji i etapy konfiguracji dla różnych osób. Gdy osoba zainicjuje działanie ML w ramach przepływu operacji, usługi będą działać zgodnie z opisem w etapach konfiguracji.

| Persona | Aktywność przepływu operacji – liczba | Działanie przepływu operacji – opis | Krok przepływu konfiguracji – liczba | Krok konfiguracji – opis |

| Główny specjalista ds. analityki danych lub lider zespołu ML |

1 |

Korzysta z katalogu usług na koncie usług platformy ML i wdraża następujące elementy:

|

1- |

|

|

1-B |

|

|||

| Dane Scientist |

2 |

Prowadzi i śledzi eksperymenty ML w notatnikach SageMaker |

2- |

|

|

3 |

Automatyzuje udane eksperymenty ML z projektami i potokami SageMaker |

3- |

|

|

|

3-B |

Po uruchomieniu potoków SageMaker zapisuje model w lokalnym rejestrze modeli (dev). | |||

| Główny analityk danych lub lider zespołu ML |

4 |

Zatwierdza model w lokalnym rejestrze modeli (programistów). |

4- |

Metadane modelu i pakiet modelu zapisują się z lokalnego (programistycznego) rejestru modeli do centralnego rejestru modeli |

|

5 |

Zatwierdza model w centralnym rejestrze modeli |

5- |

Inicjuje proces wdrażania CI/CD w celu utworzenia punktów końcowych SageMaker w środowisku testowym | |

|

5-B |

Zapisuje informacje o modelu i metadane w module zarządzania ML (karta modelu, pulpit nawigacyjny modelu) na koncie usług platformy ML z konta lokalnego (programisty) | |||

| Inżynier ML |

6 |

Testuje i monitoruje punkt końcowy SageMaker w środowisku testowym po CI/CD | . | |

|

7 |

Zatwierdza wdrożenie punktów końcowych SageMaker w środowisku prod |

7- |

Inicjuje proces wdrażania CI/CD w celu utworzenia punktów końcowych SageMaker w środowisku prod | |

|

8 |

Testuje i monitoruje punkt końcowy SageMaker w środowisku testowym po CI/CD | . | ||

Persony i interakcje z różnymi modułami platformy ML

Każdy moduł jest przeznaczony dla określonych osób docelowych w określonych działach, które najczęściej korzystają z modułu, zapewniając im podstawowy dostęp. Dostęp wtórny jest wówczas dozwolony do innych oddziałów, które wymagają okazjonalnego użycia modułów. Moduły są dostosowywane do potrzeb poszczególnych stanowisk lub osób, aby zoptymalizować funkcjonalność.

Omawiamy następujące zespoły:

- Inżynieria chmury centralnej – Ten zespół działa na poziomie chmury korporacyjnej we wszystkich obciążeniach i konfiguruje typowe usługi infrastruktury chmurowej, takie jak konfigurowanie sieci na poziomie przedsiębiorstwa, tożsamości, uprawnień i zarządzania kontami

- Inżynieria platform danych – Ten zespół zarządza jeziorami danych przedsiębiorstwa, gromadzeniem danych, przechowywaniem danych i zarządzaniem danymi

- Inżynieria platformy ML – Zespół ten działa na poziomie platformy ML we wszystkich LOB, aby świadczyć wspólne usługi w zakresie infrastruktury ML, takie jak udostępnianie infrastruktury ML, śledzenie eksperymentów, zarządzanie modelami, wdrażanie i obserwowalność

Poniższa tabela szczegółowo opisuje, które działy mają podstawowy i dodatkowy dostęp do każdego modułu, zgodnie z docelowymi osobami modułu.

| Numer modułu | Moduły | Dostęp podstawowy | Dostęp wtórny | Docelowe osoby | Liczba kont |

|

1 |

Fundacje wielokontowe | Inżynieria chmury centralnej | Indywidualne LOB |

|

Mało |

|

2 |

Fundamenty jeziora danych | Inżynieria chmury centralnej lub platformy danych | Indywidualne LOB |

|

Wielokrotność |

|

3 |

Usługi platformy ML | Inżynieria chmury centralnej lub platformy ML | Indywidualne LOB |

|

jeden |

|

4 |

Opracowywanie przypadków użycia ML | Indywidualne LOB | Inżynieria chmury centralnej lub platformy ML |

|

Wielokrotność |

|

5 |

Operacje ML | Chmura centralna lub inżynieria ML | Indywidualne LOB |

|

Wielokrotność |

|

6 |

Scentralizowany magazyn funkcji | Chmura centralna lub inżynieria danych | Indywidualne LOB |

|

jeden |

|

7 |

Rejestrowanie i obserwowalność | Inżynieria chmury centralnej | Indywidualne LOB |

|

jeden |

|

8 |

Koszty i raportowanie | Indywidualne LOB | Inżynieria platformy centralnej |

|

jeden |

Wnioski

W tym poście przedstawiliśmy strukturę zarządzania cyklem życia uczenia maszynowego na dużą skalę, która pomaga wdrażać dobrze zaprojektowane obciążenia uczenia maszynowego z osadzeniem zabezpieczeń i kontroli zarządzania. Omówiliśmy, w jaki sposób ta struktura przyjmuje całościowe podejście do tworzenia platformy uczenia maszynowego, biorąc pod uwagę zarządzanie danymi, zarządzanie modelami i kontrole na poziomie przedsiębiorstwa. Zachęcamy do eksperymentowania ze frameworkiem i koncepcjami przedstawionymi w tym poście oraz dzielenia się swoimi opiniami.

O autorach

Rama Vittal jest głównym architektem rozwiązań ML w AWS. Ma ponad 3-letnie doświadczenie w projektowaniu i budowaniu aplikacji rozproszonych, hybrydowych i chmurowych. Pasjonuje się tworzeniem bezpiecznych, skalowalnych, niezawodnych rozwiązań AI/ML i Big Data, aby pomóc klientom korporacyjnym w procesie wdrażania chmury i optymalizacji w celu poprawy wyników biznesowych. W wolnym czasie jeździ na motocyklu i spaceruje ze swoją trzyletnią owcą-doodle!

Rama Vittal jest głównym architektem rozwiązań ML w AWS. Ma ponad 3-letnie doświadczenie w projektowaniu i budowaniu aplikacji rozproszonych, hybrydowych i chmurowych. Pasjonuje się tworzeniem bezpiecznych, skalowalnych, niezawodnych rozwiązań AI/ML i Big Data, aby pomóc klientom korporacyjnym w procesie wdrażania chmury i optymalizacji w celu poprawy wyników biznesowych. W wolnym czasie jeździ na motocyklu i spaceruje ze swoją trzyletnią owcą-doodle!

Sovik Kumar Nath jest architektem rozwiązań AI/ML w AWS. Ma bogate doświadczenie w projektowaniu kompleksowych rozwiązań do uczenia maszynowego i analityki biznesowej w finansach, operacjach, marketingu, opiece zdrowotnej, zarządzaniu łańcuchem dostaw i IoT. Sovik opublikował artykuły i posiada patent na monitorowanie modeli ML. Posiada podwójne stopnie magisterskie z University of South Florida, University of Fribourg w Szwajcarii oraz tytuł licencjata z Indian Institute of Technology w Kharagpur. Poza pracą Sovik lubi podróżować, pływać promem i oglądać filmy.

Sovik Kumar Nath jest architektem rozwiązań AI/ML w AWS. Ma bogate doświadczenie w projektowaniu kompleksowych rozwiązań do uczenia maszynowego i analityki biznesowej w finansach, operacjach, marketingu, opiece zdrowotnej, zarządzaniu łańcuchem dostaw i IoT. Sovik opublikował artykuły i posiada patent na monitorowanie modeli ML. Posiada podwójne stopnie magisterskie z University of South Florida, University of Fribourg w Szwajcarii oraz tytuł licencjata z Indian Institute of Technology w Kharagpur. Poza pracą Sovik lubi podróżować, pływać promem i oglądać filmy.

Maira Ladeira Tanke jest starszym specjalistą ds. danych w AWS. Jako lider techniczny pomaga klientom przyspieszyć osiągnięcie wartości biznesowej dzięki powstającym technologiom i innowacyjnym rozwiązaniom. Maira jest w AWS od stycznia 2020 roku. Wcześniej pracowała jako analityk danych w wielu branżach, koncentrując się na osiąganiu wartości biznesowej z danych. W wolnym czasie Maira lubi podróżować i spędzać czas z rodziną w ciepłych miejscach.

Maira Ladeira Tanke jest starszym specjalistą ds. danych w AWS. Jako lider techniczny pomaga klientom przyspieszyć osiągnięcie wartości biznesowej dzięki powstającym technologiom i innowacyjnym rozwiązaniom. Maira jest w AWS od stycznia 2020 roku. Wcześniej pracowała jako analityk danych w wielu branżach, koncentrując się na osiąganiu wartości biznesowej z danych. W wolnym czasie Maira lubi podróżować i spędzać czas z rodziną w ciepłych miejscach.

Ryana Lempki jest starszym architektem rozwiązań w Amazon Web Services, gdzie pomaga swoim klientom cofnąć się od celów biznesowych do opracowania rozwiązań na platformie AWS. Posiada głębokie doświadczenie w zakresie strategii biznesowej, zarządzania systemami IT i analityki danych. Ryan pragnie uczyć się przez całe życie i każdego dnia lubi rzucać sobie wyzwania, aby nauczyć się czegoś nowego.

Ryana Lempki jest starszym architektem rozwiązań w Amazon Web Services, gdzie pomaga swoim klientom cofnąć się od celów biznesowych do opracowania rozwiązań na platformie AWS. Posiada głębokie doświadczenie w zakresie strategii biznesowej, zarządzania systemami IT i analityki danych. Ryan pragnie uczyć się przez całe życie i każdego dnia lubi rzucać sobie wyzwania, aby nauczyć się czegoś nowego.

Sriharsz Adari jest starszym architektem rozwiązań w Amazon Web Services (AWS), gdzie pomaga klientom pracować wstecz od wyników biznesowych do opracowywania innowacyjnych rozwiązań w AWS. Przez lata pomagał wielu klientom w transformacji platform danych w różnych branżach. Jego główne obszary specjalizacji obejmują strategię technologiczną, analizę danych i naukę o danych. W wolnym czasie lubi uprawiać sport, oglądać programy telewizyjne i grać w Tablę.

Sriharsz Adari jest starszym architektem rozwiązań w Amazon Web Services (AWS), gdzie pomaga klientom pracować wstecz od wyników biznesowych do opracowywania innowacyjnych rozwiązań w AWS. Przez lata pomagał wielu klientom w transformacji platform danych w różnych branżach. Jego główne obszary specjalizacji obejmują strategię technologiczną, analizę danych i naukę o danych. W wolnym czasie lubi uprawiać sport, oglądać programy telewizyjne i grać w Tablę.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/governing-the-ml-lifecycle-at-scale-part-1-a-framework-for-architecting-ml-workloads-using-amazon-sagemaker/

- :ma

- :Jest

- :nie

- :Gdzie

- $W GÓRĘ

- 1

- 10

- 100

- 12

- Miesiąc 12

- 2020

- 28

- 7

- 8

- 971

- a

- O nas

- przyśpieszyć

- dostęp

- dostępny

- Stosownie

- Konto

- Konta

- osiągnięcie

- osiągnięcia

- w poprzek

- działania

- działalność

- Ad

- przystosować

- adaptacja

- dodatek

- Dodatkowy

- adres

- Adresy

- adresowanie

- Admin

- Administratorzy

- Przyjęcie

- Przyjęcie

- Po

- AI

- Modele AI

- AI / ML

- Alarmy

- Wszystkie kategorie

- dozwolony

- Pozwalać

- pozwala

- wzdłuż

- już

- również

- Chociaż

- Amazonka

- Amazon Sage Maker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- analiza

- analityka

- i

- i infrastruktura

- każdy

- aplikacje

- podejście

- właściwy

- zatwierdzony

- architektura

- Archiwum

- SĄ

- POWIERZCHNIA

- towary

- AS

- Aktywa

- powiązany

- założyć

- At

- Uwierzytelnianie

- autoryzacja

- zautomatyzować

- zautomatyzowane

- Automatyzacja

- dostępny

- AWS

- Bilans

- na podstawie

- Baseline

- BE

- bo

- staje się

- być

- zanim

- jest

- korzystny

- Korzyści

- BEST

- Najlepsze praktyki

- pomiędzy

- stronniczość

- Duży

- Big Data

- przerwa

- krótko

- budować

- Budowanie

- Buduje

- biznes

- strategia biznesowa

- ale

- by

- CAN

- kandydat

- możliwości

- karta

- Kartki okolicznosciowe

- walizka

- Etui

- katalog

- kategorie

- caters

- Spowodować

- Centrum

- centralny

- Centralizacja

- scentralizowane

- łańcuch

- wyzwania

- wyzwanie

- Wykrywanie urządzeń szpiegujących

- chemia

- dokładnie

- Chmura

- adopcja chmury

- infrastruktura chmurowa

- kod

- współpraca

- kolekcja

- zbiorowo

- wspólny

- Firmy

- spełnienie

- zgodny

- składniki

- zawiera

- pojęcie

- Koncepcje

- za

- wobec

- rozważa

- konsumować

- Konsumenci

- Pojemnik

- kontrola

- Wieża kontroli

- kontrolowanych

- kontroli

- skoordynowane

- rdzeń

- Koszty:

- Koszty:

- pokryty

- Stwórz

- stworzony

- kuracja

- Klientów

- dostosować

- dostosowane

- tablica rozdzielcza

- Deski rozdzielcze

- dane

- dostęp do danych

- Analityka danych

- Jezioro danych

- Platforma danych

- prywatność danych

- nauka danych

- naukowiec danych

- zbiory danych

- dzień

- lat

- dedykowane

- głęboko

- Stopień

- Działy

- rozwijać

- wdrażane

- wdrażanie

- Wdrożenie

- wdrożenia

- wdraża się

- Wnętrze

- zaprojektowany

- projektowanie

- detale

- dev

- rozwijać

- rozwinięty

- oprogramowania

- wydarzenia

- różne

- Wymiary

- kierować

- dyskutować

- omówione

- odrębny

- dystrybuowane

- nurkować

- domena

- Podwójna

- na dół

- każdy

- starania

- osadzać

- osadzone

- osadzanie

- wschodzących

- Nowa technologia

- umożliwiać

- włączony

- Umożliwia

- umożliwiając

- zachęcać

- koniec końców

- Punkt końcowy

- inżynier

- Inżynieria

- Inżynierowie

- wzmacniać

- zapewnić

- zapewnia

- zapewnienie

- Enterprise

- na poziomie przedsiębiorstwa

- przedsiębiorstwa

- Środowisko

- środowiska

- niezbędny

- oceniać

- wydarzenia

- Każdy

- codziennie

- przykład

- doświadczenie

- eksperyment

- eksperymenty

- ekspertyza

- wyrażone

- rozsuwalny

- rozległy

- Szerokie doświadczenie

- w obliczu

- ułatwiać

- członków Twojej rodziny

- Cecha

- Korzyści

- informacja zwrotna

- kilka

- Postać

- filtrować

- finansować

- budżetowy

- usługi finansowe

- i terminów, a

- Elastyczność

- florida

- pływ

- skupienie

- następujący

- W razie zamówieenia projektu

- Nasz formularz

- formacja

- Fundacja

- Fundamenty

- cztery

- Framework

- Darmowy

- od

- funkcjonować

- funkcjonalny

- funkcjonalności

- Funkcjonalność

- Funkcje

- dalej

- Ponadto

- Wzrost

- Generować

- generujący

- generatywny

- generatywna sztuczna inteligencja

- daje

- Globalne

- zarządzanie

- model zarządzania

- moduł zarządzania

- regulowane

- rządzić

- przyznanie

- Grupy

- poradnictwo

- Have

- mający

- he

- głowa

- opieki zdrowotnej

- słyszeć

- pomoc

- pomógł

- pomaga

- jej

- Wysoki

- na wysokim szczeblu

- jego

- posiada

- holistyczne

- Haczyki

- gospodarze

- W jaki sposób

- How To

- Jednak

- HTML

- http

- HTTPS

- Piasta

- Hybrydowy

- identyfikacja

- tożsamość

- if

- wdrożenia

- realizacja

- realizowane

- wykonawczych

- podnieść

- poprawy

- in

- zawierać

- obejmuje

- Włącznie z

- wzrastający

- niezależnie

- Hindusi

- przemysłowa

- przemysł

- Informacja

- Infrastruktura

- początkowy

- Inicjuje

- innowacyjne

- Innowacyjny

- przykład

- Instytut

- zintegrowany

- interakcji

- Interakcje

- zainteresowany

- Internet

- dostęp do Internetu

- najnowszych

- wprowadzono

- inwestycja

- Internet przedmiotów

- izolacja

- IT

- styczeń

- Praca

- podróż

- jpg

- Klawisz

- wiedza

- Kumar

- Brak

- jezioro

- jezior

- lądowanie

- język

- duży

- później

- warstwa

- prowadzić

- UCZYĆ SIĘ

- nauka

- poziom

- poziomy

- wifecycwe

- lubić

- rodowód

- linie

- miejscowy

- log

- zalogowaniu

- poszukuje

- maszyna

- uczenie maszynowe

- zrobiony

- utrzymać

- WYKONUJE

- zarządzanie

- zarządzane

- i konserwacjami

- zarządza

- zarządzający

- wiele

- Mapy

- Marketing

- dojrzały

- dojrzałość

- Może..

- członek

- wzmiankowany

- siatka

- Metadane

- łagodzenie

- łagodzenie ryzyka

- ML

- MLOps

- model

- modele

- modyfikować

- Modułowa

- Moduł

- Moduły

- monitor

- monitorowanie

- monitory

- miesięcy

- jeszcze

- większość

- motocykl

- Kino

- wielokrotność

- rodzimy

- Potrzebować

- wymagania

- Nest

- sieć

- sieci

- sieci

- Nowości

- Nowe funkcje

- Następny

- notatnik

- numer

- Cele

- okolicznościowy

- of

- Oferty

- Biurowe

- często

- Stary

- on

- pewnego razu

- ONE

- trwający

- działać

- eksploatowane

- działa

- operacyjny

- operacje

- optymalizacja

- Optymalizacja

- or

- organizacja

- organizacji

- organizowanie

- Inne

- ludzkiej,

- na zewnątrz

- wyniki

- zewnętrzne

- koniec

- ogólny

- przegląd

- pakiet

- część

- szczególny

- namiętny

- patent

- wykonać

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- uprawnienia

- rurociąg

- Miejsce

- Równina

- Platforma

- plato

- Analiza danych Platona

- PlatoDane

- gra

- polityka

- polityka

- teczka

- Post

- praktyka

- praktyki

- teraźniejszość

- zapobieganie

- pierwotny

- Główny

- Wcześniejszy

- prywatność

- prywatny

- Sektor prywatny

- Proaktywne

- problemy

- wygląda tak

- procesów

- producent

- Producenci

- Produkt

- Produkcja

- Produkty

- projektowanie

- promocja

- dowód

- dowód koncepcji

- ochrony

- zapewniać

- zapewnia

- że

- publiczny

- opublikowany

- cel

- jakość

- szybko

- szybki

- Czytaj

- niedawny

- rozpoznać

- polecić

- Rekomendacja

- zmniejszyć

- odniesienie

- regiony

- zarejestrować

- zarejestrowany

- rejestry

- rejestr

- regulowane

- branże regulowane

- rzetelny

- usuwanie

- Raporty

- wymagać

- wymagany

- wymagania

- Zasób

- Zasoby

- odpowiadanie

- odpowiedzialny

- ponownie

- przejażdżki

- Ryzyko

- ryzyko

- Rola

- role

- korzeń

- Zasada

- reguły

- run

- bieganie

- Ryan

- poświęcanie

- sagemaker

- Rurociągi SageMaker

- taki sam

- skalowalny

- Skala

- skalowaniem

- nauka

- Naukowiec

- Naukowcy

- Szukaj

- wtórny

- Sekcja

- sektor

- bezpieczne

- bezpieczeństwo

- zdarzenia zabezpieczeń

- Samoobsługa

- senior

- Serie

- usługa

- Usługi

- zestaw

- Zestawy

- ustawienie

- ustawienie

- Share

- shared

- Akcje

- dzielenie

- ona

- Short

- powinien

- pokazane

- Targi

- Prosty

- ponieważ

- pojedynczy

- Rozmiar

- mały

- So

- rozwiązanie

- Rozwiązania

- ROZWIĄZANIA

- kilka

- coś

- Południe

- South Florida

- specjalista

- wyspecjalizowanym

- specyficzny

- Spędzanie

- SPORTOWE

- etapy

- interesariuszy

- interesariusze

- standardy

- początek

- Stan

- Ewolucja krok po kroku

- Cel

- Nadal

- zatrzymany

- przechowywanie

- sklep

- sklep

- strategie

- Strategia

- silny

- Struktura

- Struktury

- studio

- udany

- taki

- Garnitur

- PODSUMOWANIE

- Dostawa

- łańcuch dostaw

- zarządzanie łańcuchem dostaw

- wsparcie

- Wspierający

- pewnie

- Szwajcaria

- systemy

- stół

- dostosowane

- trwa

- biorąc

- cel

- zespół

- Zespoły

- Techniczny

- Technologia

- Strategia technologiczna

- szablon

- Szablony

- test

- Testowanie

- że

- Połączenia

- Państwo

- ich

- Im

- następnie

- Te

- one

- rzeczy

- to

- tych

- Przez

- poprzez

- czas

- do

- narzędzia

- w kierunku

- Wieża

- śledzić

- Śledzenie

- tradycyjny

- Pociąg

- przemiany

- tranzyt

- Podróżowanie

- SKRĘCAĆ

- tv

- typy

- dla

- zrozumieć

- niesprawiedliwy

- jednostek

- uniwersytet

- us

- Stosowanie

- posługiwać się

- przypadek użycia

- używany

- Użytkownik

- Użytkownicy

- zastosowania

- za pomocą

- wykorzystać

- uprawomocnienie

- wartość

- różnorodność

- różnorodny

- pionowe

- przez

- Naruszenia

- widoczność

- wyobrażanie sobie

- wyobrażać sobie

- spacer

- chcieć

- ciepły

- oglądania

- we

- sieć

- usługi internetowe

- DOBRZE

- jeśli chodzi o komunikację i motywację

- czy

- który

- Podczas

- będzie

- w

- w ciągu

- bez

- Praca

- pracował

- przepływów pracy

- pracujący

- lat

- You

- Twój

- zefirnet