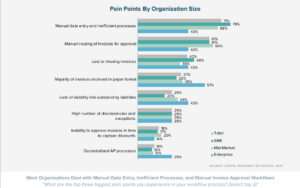

Wyodrębnianie tekstu z obrazu może być uciążliwym procesem. Większość ludzi ręcznie wpisuje tekst/dane z obrazu; ale jest to zarówno czasochłonne, jak i nieefektywne, gdy masz do czynienia z wieloma obrazami.

Konwertery obrazu na tekst oferują zgrabny sposób wyodrębniania tekstu z obrazów.

Chociaż takie narzędzia dobrze sobie radzą, wyodrębniony tekst/dane są często prezentowane w sposób nieustrukturyzowany, co powoduje dużo przetwarzania końcowego.

An OCR oparty na sztucznej inteligencji podobnie jak Nanonets, może pobierać tekst z obrazów i prezentować wyodrębnione dane w schludny, zorganizowany i ustrukturyzowany sposób.

Nanonets wyodrębnia dane z obrazów dokładnie, na dużą skalę i w wielu językach. Nanonets to jedyny OCR z rozpoznawaniem tekstu, który prezentuje wyodrębniony tekst w starannie ustrukturyzowanych formatach, które można w pełni dostosować. Przechwycone dane mogą być prezentowane w postaci tabel, pozycji lub w dowolnym innym formacie.

- Kliknij, aby przesłać swój obraz poniżej

- OCR Nanonets automatycznie rozpoznaje zawartość pliku i konwertuje go na tekst

- Pobierz wyodrębniony tekst jako nieprzetworzony plik tekstowy lub zintegruj przez API

Spis treści

Oto trzy zaawansowane metody, w których możesz użyć Nanonets OCR do wykrywania i wyodrębniania tekstu z obrazów, wyodrębnij tekst z pliku PDFs, wyodrębnij dane z pliku PDFS lub analizuje pliki PDF oraz inne rodzaje dokumentów:

Potrzebujesz darmowego OCR online dla obraz do tekstu, PDF do tabeli, PDF na tekstlub Ekstrakcja danych PDF? Sprawdź Nanonety online API OCR w akcji i zacznij budować własne modele OCR za darmo!

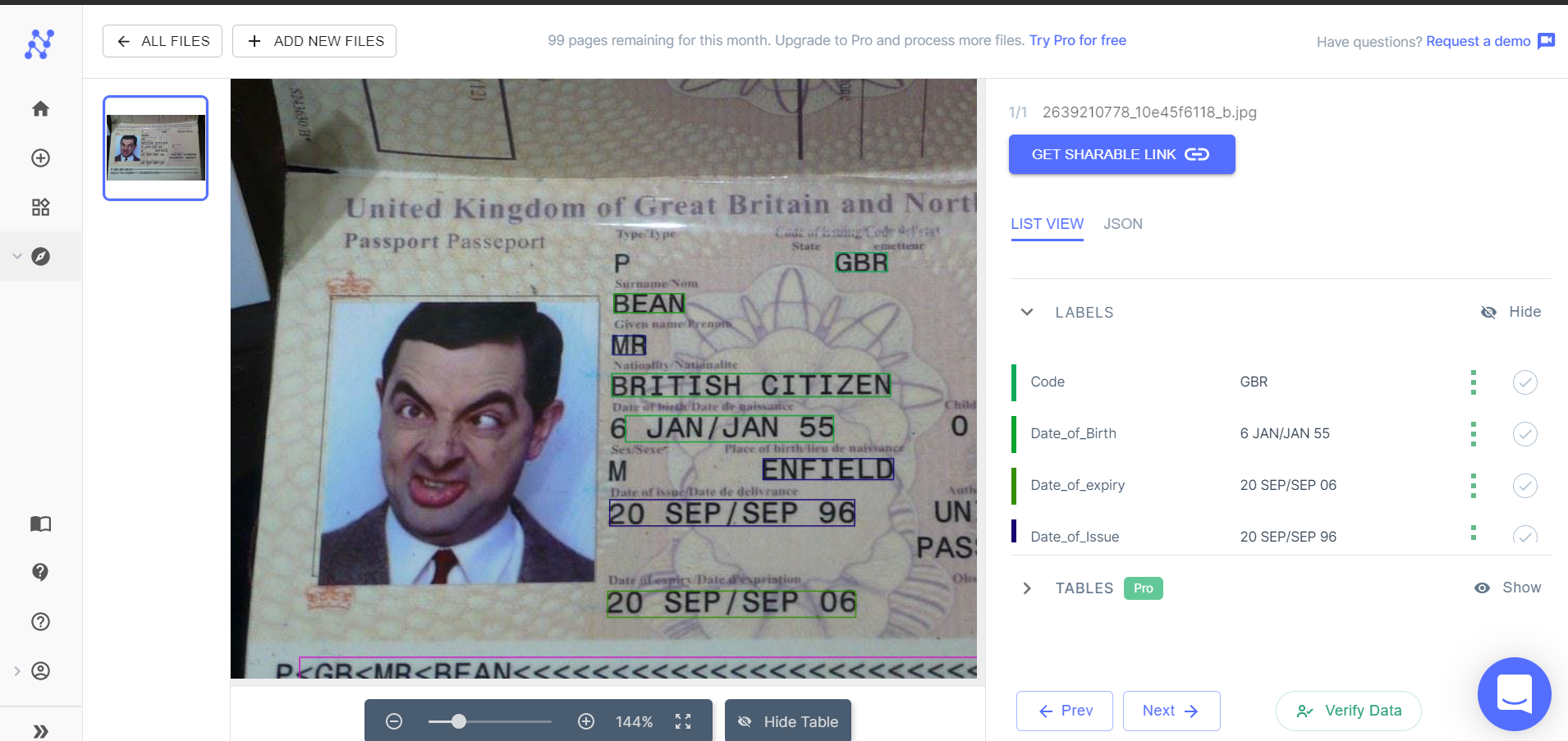

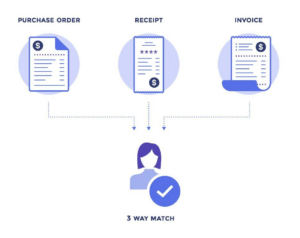

Firma Nanonets ma wstępnie przeszkolone modele OCR dla określonych typów obrazów wymienionych poniżej. Każdy wstępnie wytrenowany model OCR jest szkolony, aby dokładnie powiązać tekst w typie obrazu z odpowiednim polem, takim jak nazwa, adres, data, wygaśnięcie itp. i przedstawić wyodrębniony tekst w schludny i zorganizowany sposób.

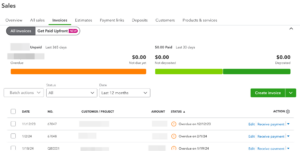

- Faktury

- Wpływy kasowe

- Prawo jazdy (USA)

- Paszporty

Nanonet online OCR & OCR API mają wiele interesujących przypadków użycia.

Krok 1: Wybierz odpowiedni model OCR

Zaloguj do Nanonets i wybierz model OCR odpowiedni dla obrazu, z którego chcesz wyodrębnić tekst i dane. Jeśli żaden ze wstępnie przeszkolonych modeli OCR nie spełnia Twoich wymagań, możesz przejść dalej, aby dowiedzieć się, jak utworzyć niestandardowy model OCR.

Krok 2: Dodaj pliki

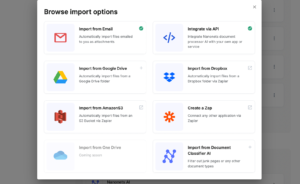

Dodaj pliki/obrazy, z których chcesz wyodrębnić tekst. Możesz dodać dowolną liczbę obrazów.

Krok 3: Testuj

Poczekaj kilka sekund na uruchomienie modelu i wyodrębnienie tekstu z obrazu.

Krok 4: Sprawdź

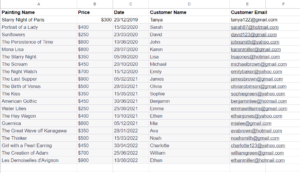

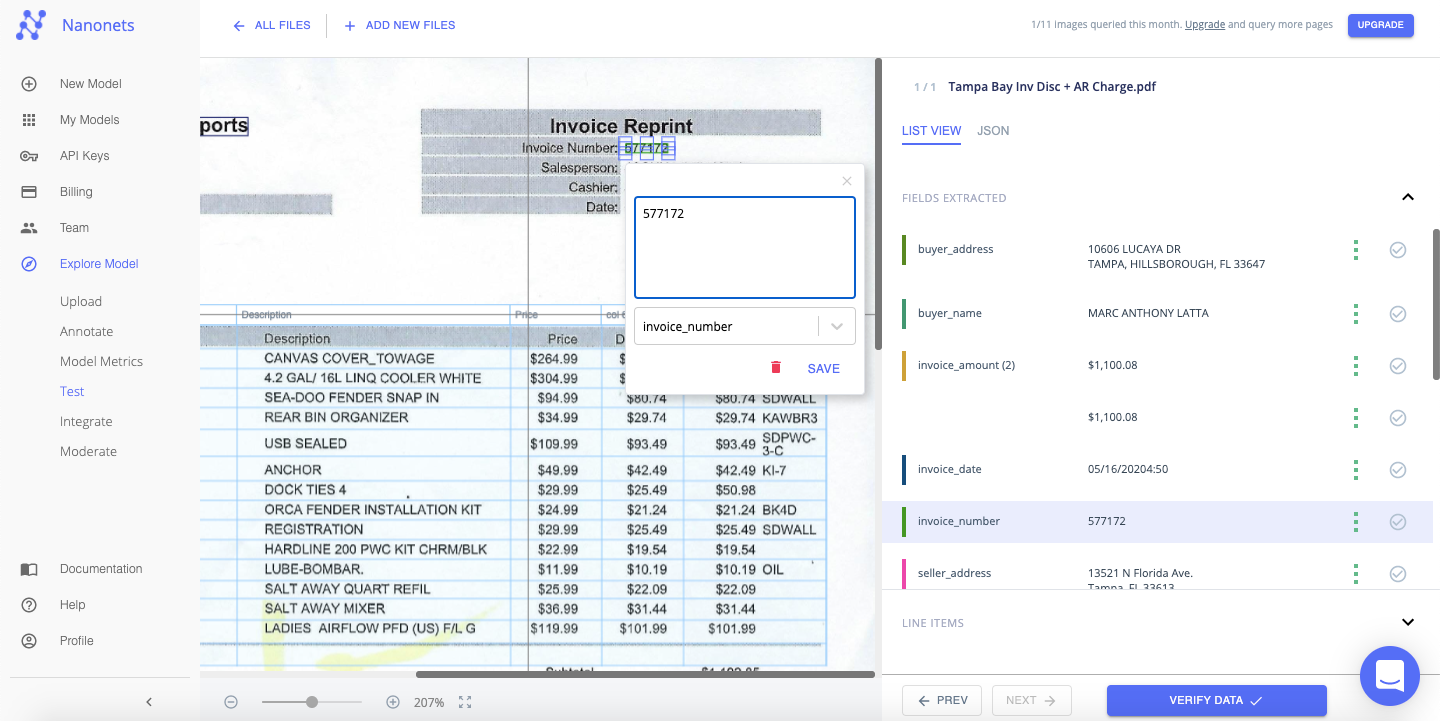

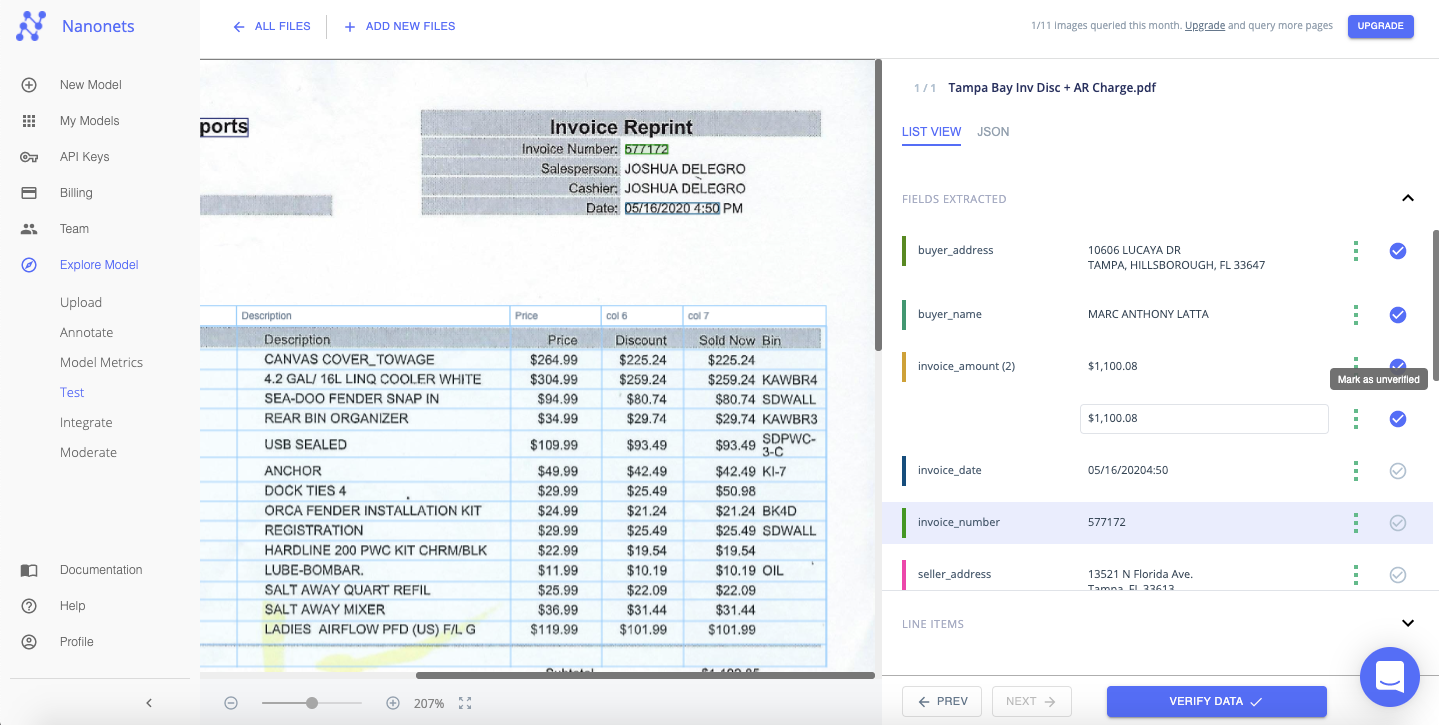

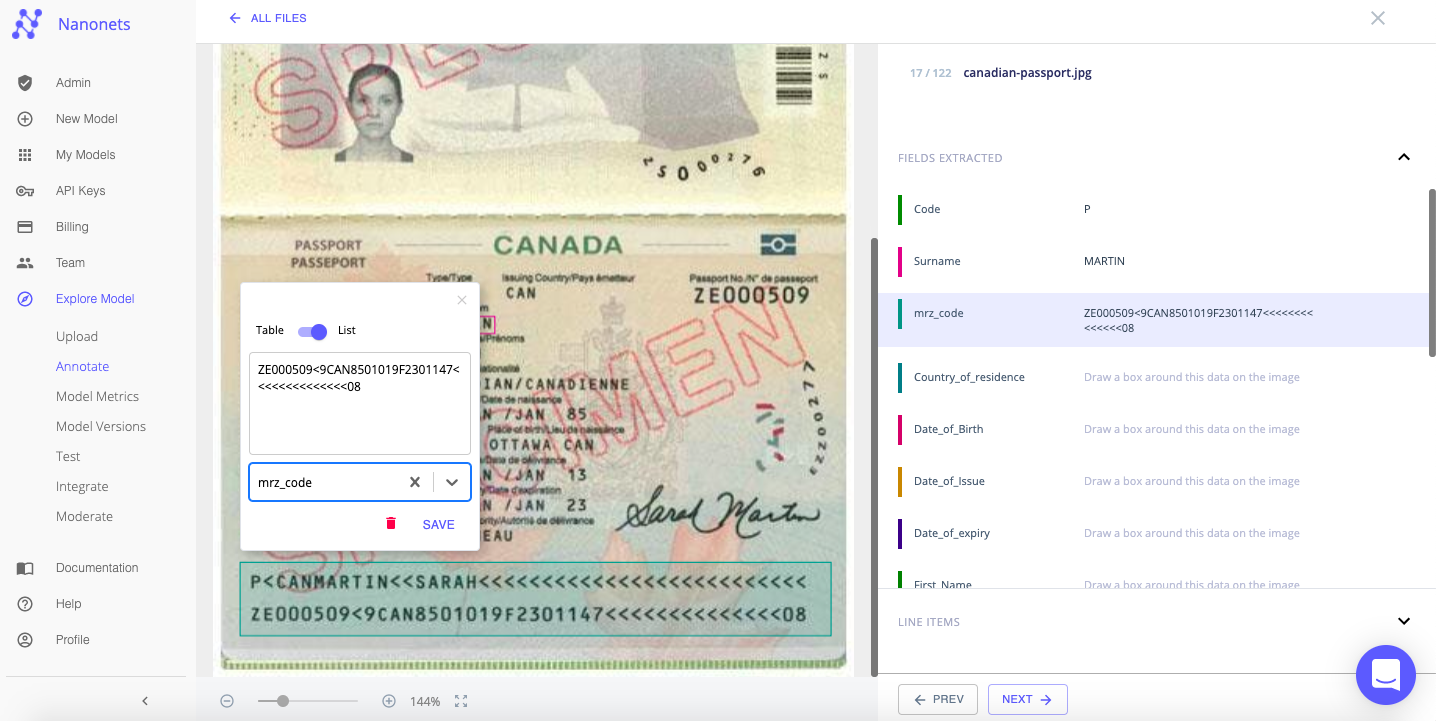

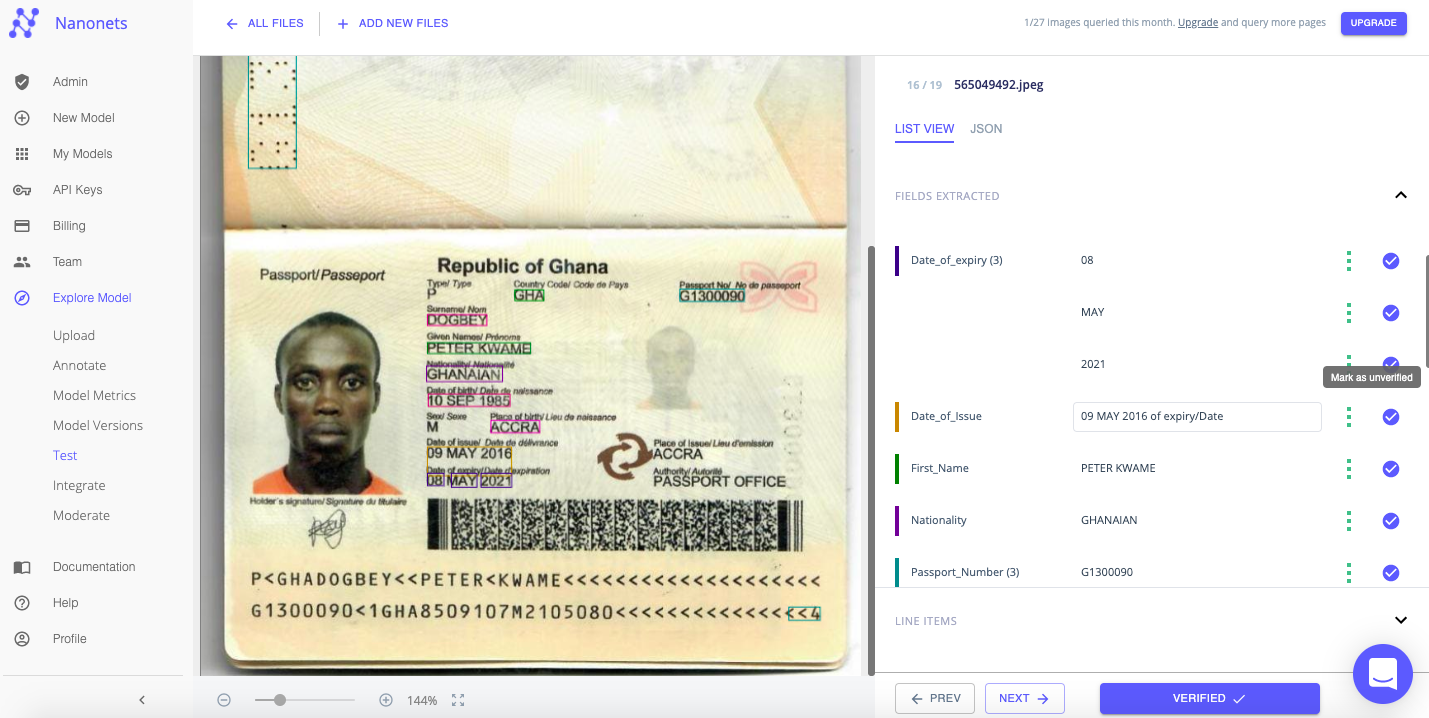

Szybko zweryfikuj tekst wyodrębniony z każdego pliku, sprawdzając widok tabeli po prawej stronie. Możesz łatwo sprawdzić, czy tekst został poprawnie rozpoznany i dopasowany do odpowiedniego pola lub tagu.

Na tym etapie możesz nawet edytować/poprawiać wartości pól i etykiety. Nanonets nie jest związany szablonem obrazu.

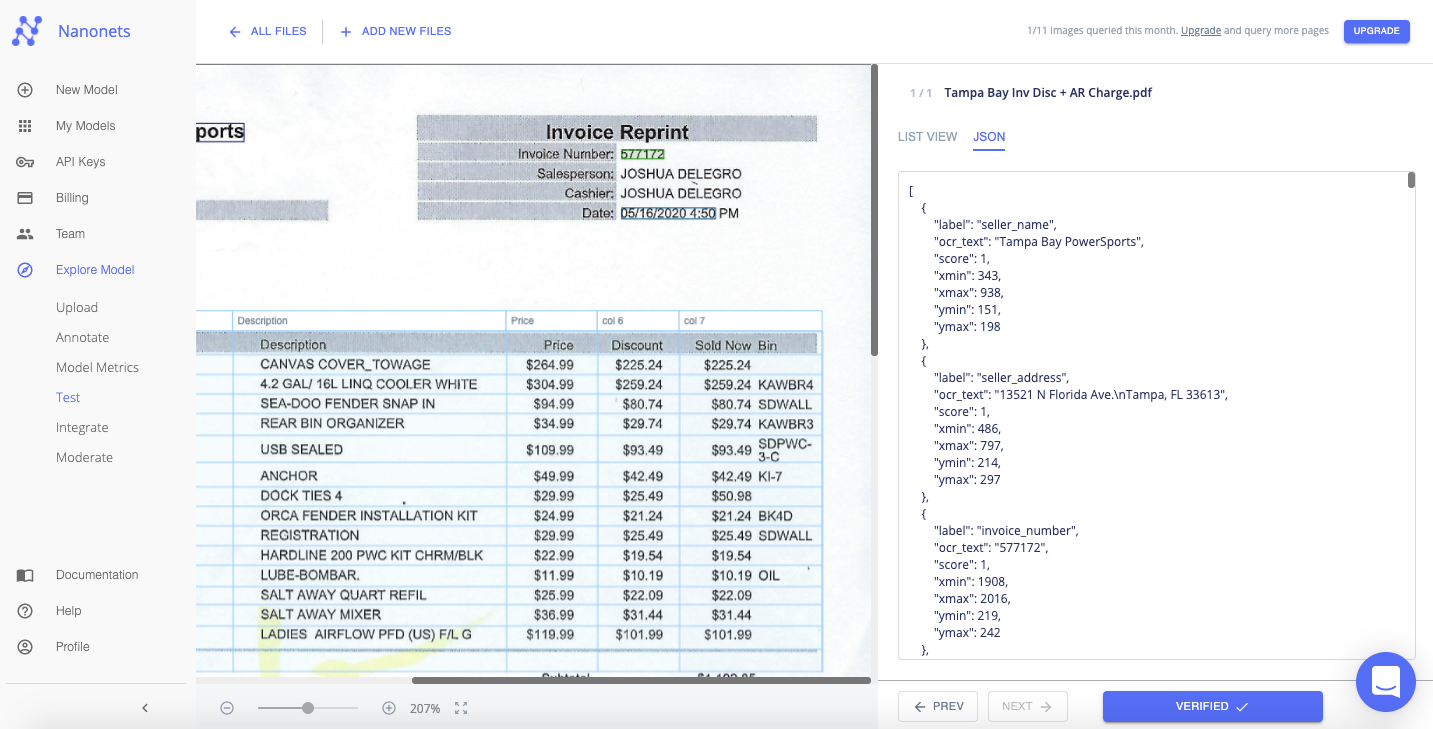

Wyodrębnione dane można wyświetlić w formacie „Widok listy” lub „JSON”.

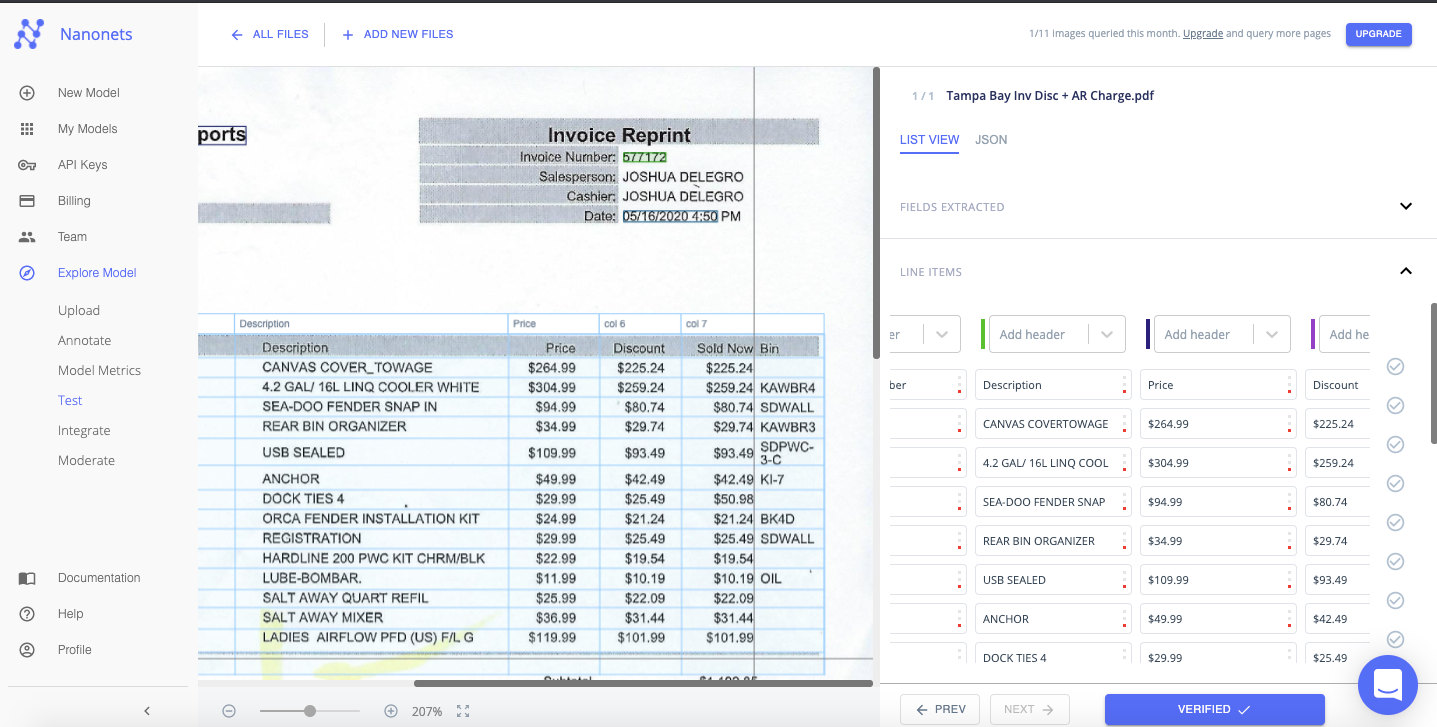

Możesz zaznaczyć pole wyboru obok każdej wartości lub pola, które weryfikujesz lub kliknąć „Weryfikuj dane”, aby przejść natychmiast.

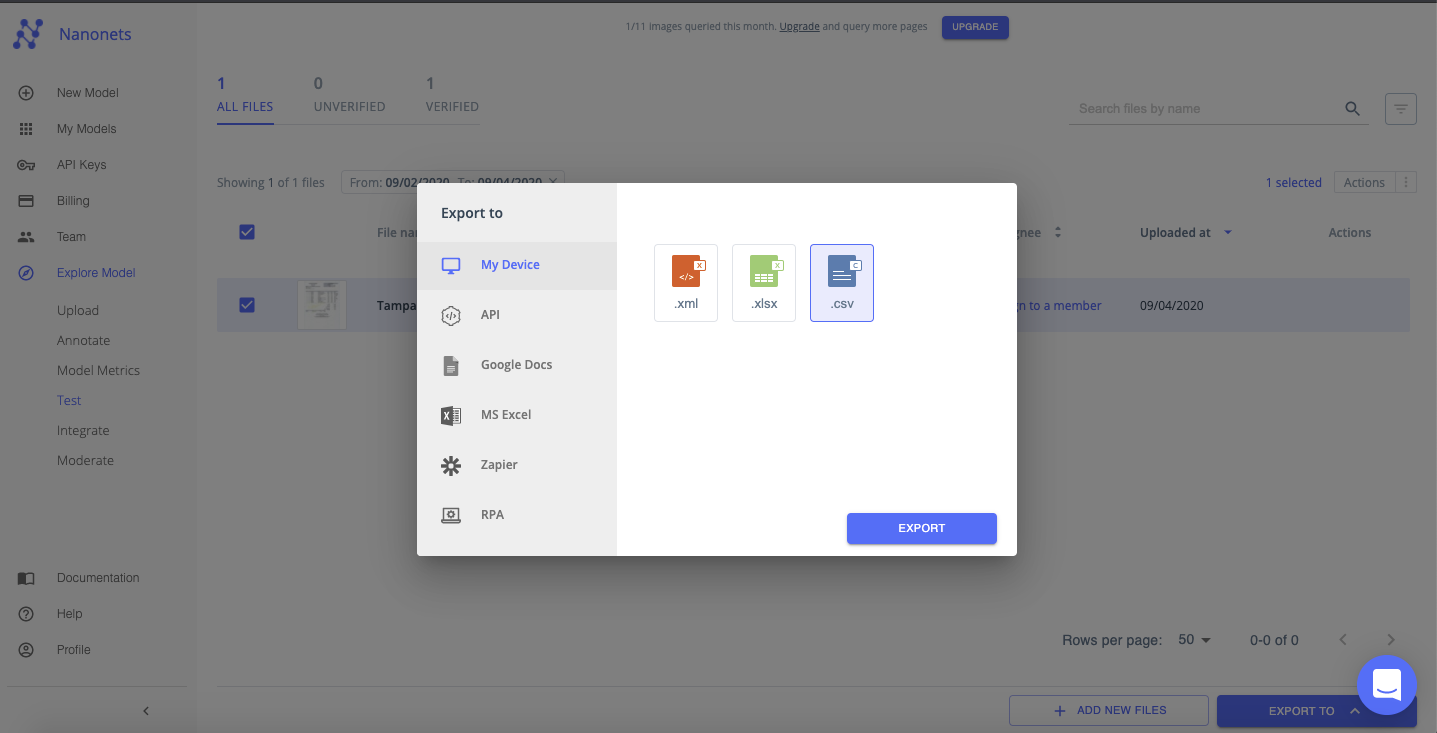

Krok 5: Eksportuj

Po zweryfikowaniu wszystkich plików. Możesz wyeksportować starannie uporządkowane dane jako plik xml, xlsx lub csv.

Nanonets ma interesujące przypadków użycia i wyjątkowy historie sukcesu klientów. Dowiedz się, jak Nanonets może zwiększyć wydajność Twojej firmy.

Budowanie niestandardowego modelu OCR za pomocą Nanonets jest łatwe. Zazwyczaj można zbudować, wytrenować i wdrożyć model dla dowolnego typu obrazu lub dokumentu, w dowolnym języku, w czasie krótszym niż 25 minut (w zależności od liczby plików używanych do trenowania modelu).

Obejrzyj poniższy film, aby wykonać pierwsze 4 kroki tej metody:

Krok 1: Stwórz swój własny model OCR

Zaloguj do Nanonets i kliknij „Stwórz swój własny model OCR”.

Krok 2: Prześlij pliki / obrazy szkoleniowe

Prześlij przykładowe pliki, które posłużą do trenowania modeli OCR. Dokładność zbudowanego modelu OCR będzie w dużej mierze zależała od jakości i ilości plików / obrazów przesłanych na tym etapie

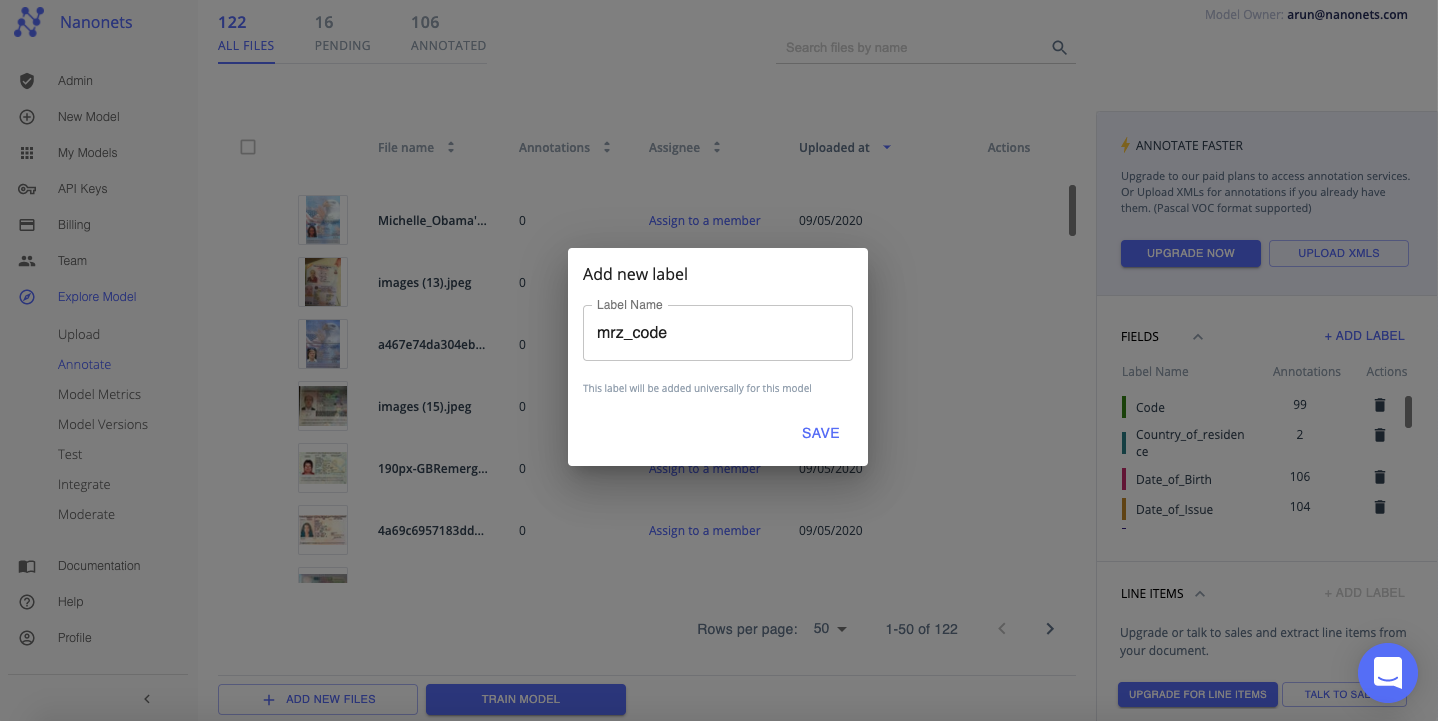

Krok 3: Dodaj adnotacje do plików / obrazów

Teraz opisz każdy fragment tekstu lub danych odpowiednim polem lub etykietą. Ten kluczowy krok nauczy Twój model OCR, jak wyodrębnić odpowiedni tekst z obrazów i powiązać go z niestandardowymi polami, które są odpowiednie dla Twoich potrzeb.

Możesz również dodać nową etykietę, aby opisać tekst lub dane. Pamiętaj, że Nanonets nie jest związany szablonem obrazu!

Krok 4: Wytrenuj niestandardowy model OCR

Po skompletowaniu adnotacji dla wszystkich plików / obrazów szkoleniowych kliknij „Train Model”. Szkolenie trwa zwykle od 20 minut do 2 godzin, w zależności od liczby plików i modeli w kolejce do treningu. Możesz uaktualnienie do płatnego planu, aby uzyskać szybsze wyniki na tym etapie (zwykle poniżej 20 minut).

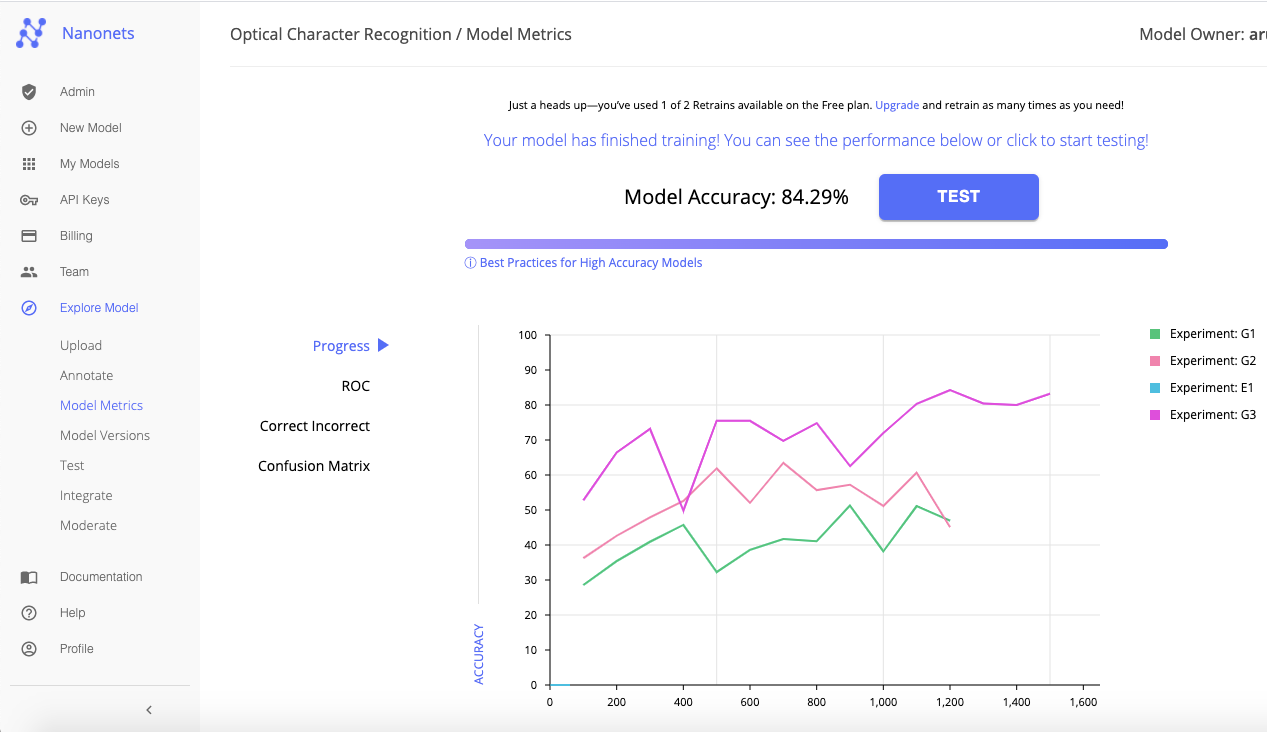

Nanonets wykorzystuje głębokie uczenie, aby budować różne modele OCR i testować je ze sobą pod kątem dokładności. Następnie Nanonets wybiera najlepszy model OCR (na podstawie danych wejściowych i poziomów dokładności).

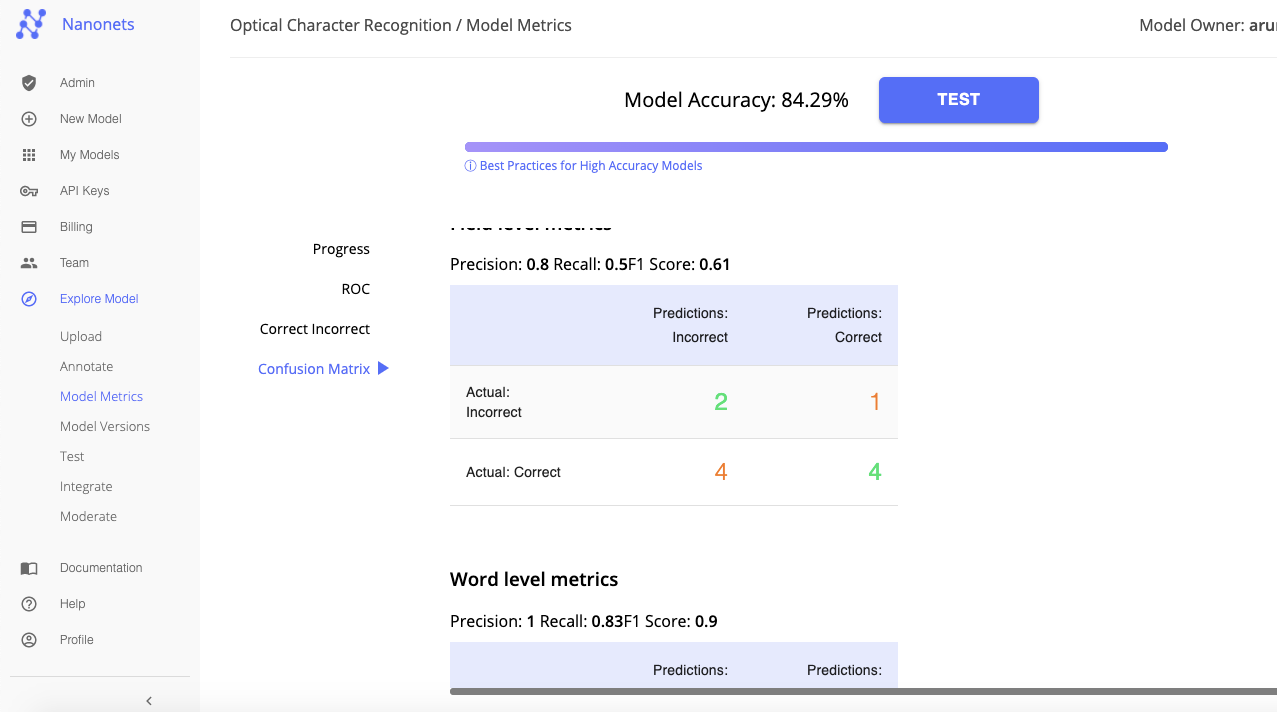

Zakładka „Model Metrics” pokazuje różne pomiary i analizy porównawcze, które pozwoliły firmie Nanonet wybrać najlepszy model OCR spośród wszystkich, które zostały zbudowane. Możesz ponownie trenować model (poprzez zapewnienie szerszego zakresu obrazów szkoleniowych i lepszej adnotacji), aby osiągnąć wyższy poziom dokładności.

Lub, jeśli jesteś zadowolony z dokładności, kliknij „Testuj”, aby przetestować i sprawdzić, czy ten niestandardowy model OCR działa zgodnie z oczekiwaniami na próbce obrazów lub plików, z których należy wyodrębnić tekst / dane.

Krok 5: Przetestuj i zweryfikuj dane

Dodaj kilka przykładowych obrazów, aby przetestować i zweryfikować niestandardowy model OCR.

Jeśli tekst został odpowiednio rozpoznany, wyodrębniony i zaprezentowany, wyeksportuj plik. Jak widać poniżej, wyodrębnione dane zostały uporządkowane i przedstawione w zgrabnym formacie.

Gratulacje, zbudowałeś i wyszkoliłeś niestandardowy model OCR do wyodrębniania tekstu z niektórych typów obrazów!

Czy Twoja firma zajmuje się rozpoznawaniem tekstu w dokumentach cyfrowych, obrazach lub plikach PDF? Zastanawiałeś się, jak dokładnie wyodrębnić tekst z obrazów?

Trenuj własne modele OCR za pomocą NanoNets API

Oto szczegółowy przewodnik po pociągu własne modele OCR za pomocą Nanonet API, w dokumentacja, znajdziesz gotowe do uruchomienia próbki kodu w Python, Shell, Ruby, Golang, Java i C#, a także szczegółowe specyfikacje API dla różnych punktów końcowych.

Oto przewodnik krok po kroku dotyczący trenowania własnego modelu za pomocą interfejsu API Nanonets:

Krok 1: Sklonuj repozytorium

git clone https://github.com/NanoNets/nanonets-ocr-sample-python

cd nanonets-ocr-sample-python

sudo pip install requests

sudo pip install tqdmKrok 2: Uzyskaj darmowy klucz API

Uzyskaj bezpłatny klucz API od https://app.nanonets.com/#/keys

Krok 3: Ustaw klucz API jako zmienną środowiskową

export NANONETS_API_KEY=YOUR_API_KEY_GOES_HERE

Krok 4: Utwórz nowy model

python ./code/create-model.py

Uwaga: wygeneruje to MODEL_ID, którego potrzebujesz do następnego kroku

Krok 5: Dodaj identyfikator modelu jako zmienną środowiskową

export NANONETS_MODEL_ID=YOUR_MODEL_ID

Krok 6: Prześlij dane treningowe

Zbierz obrazy obiektu, który chcesz wykryć. Po przygotowaniu zestawu danych w folderze images (pliki graficzne), rozpocznij przesyłanie zbioru danych.

python ./code/upload-training.py

Krok 7: Wytrenuj model

Po przesłaniu obrazów rozpocznij szkolenie Modela

python ./code/train-model.py

Krok 8: Uzyskaj stan modelu

Trenowanie modelu zajmuje około 30 minut. Otrzymasz wiadomość e-mail, gdy model zostanie przeszkolony. W międzyczasie sprawdzasz stan modelu

watch -n 100 python ./code/model-state.py

Krok 9: Dokonaj prognozy

Po przeszkoleniu modelu. Możesz tworzyć prognozy za pomocą modelu

python ./code/prediction.py PATH_TO_YOUR_IMAGE.jpgKorzyści płynące z używania Nanonets w porównaniu z innymi interfejsami API OCR wykraczają poza tylko lepszą dokładność w odniesieniu do wyodrębniania tekstu z obrazów. Oto 7 powodów, dla których warto rozważyć użycie Nanonets OCR do rozpoznawania tekstu:

1. Praca z danymi niestandardowymi

Większość programów OCR jest dość sztywnych, jeśli chodzi o rodzaj danych, z którymi może pracować. Szkolenie modelu OCR dla przypadku użycia wymaga dużej elastyczności w odniesieniu do jego wymagań i specyfikacji; OCR do przetwarzania faktur znacznie różni się od OCR do paszportów! Nanonety nie podlegają tak sztywnym ograniczeniom. Nanonets wykorzystuje Twoje własne dane do trenowania modeli OCR, które najlepiej odpowiadają konkretnym potrzebom Twojej firmy.

2. Praca z językami innymi niż angielski lub wieloma językami

Ponieważ Nanonets koncentruje się na uczeniu z wykorzystaniem niestandardowych danych, jest wyjątkowo przystosowany do budowania jednego modelu OCR, który może wyodrębniać tekst z obrazów w dowolnym języku lub w wielu językach jednocześnie.

3. Nie wymaga przetwarzania końcowego

Tekst wyodrębniony za pomocą modeli OCR musi być inteligentnie zorganizowany i przedstawiony w zrozumiałym formacie; w przeciwnym razie poświęca się dużo czasu i zasobów na reorganizację danych w sensowne informacje. Podczas gdy większość narzędzi OCR po prostu pobiera i zrzuca dane z obrazów, Nanonets wyodrębnia tylko istotne dane i automatycznie sortuje je w inteligentnie ustrukturyzowane pola, ułatwiając ich przeglądanie i zrozumienie.

4. Ciągle się uczy

Firmy często stają w obliczu dynamicznie zmieniających się wymagań i potrzeb. Aby przezwyciężyć potencjalne przeszkody, Nanonets umożliwia łatwe ponowne trenowanie modeli przy użyciu nowych danych. Dzięki temu Twój model OCR może dostosować się do nieprzewidzianych zmian.

5. Z łatwością radzi sobie z typowymi ograniczeniami danych

Nanonets wykorzystuje techniki sztucznej inteligencji, uczenia maszynowego i głębokiego uczenia się, aby przezwyciężyć typowe ograniczenia danych, które mają duży wpływ na rozpoznawanie i wyodrębnianie tekstu. Nanonets OCR rozpoznaje i obsługuje tekst odręczny, obrazy tekstu w wielu językach jednocześnie, obrazy o niskiej rozdzielczości, obrazy z nowymi lub kursywnymi czcionkami io różnych rozmiarach, obrazy z zacienionym tekstem, tekst pochylony, losowy tekst bez struktury, szum obrazu, rozmyte obrazy i więcej. Tradycyjne interfejsy API OCR po prostu nie są przystosowane do działania w takich warunkach; wymagają danych na bardzo wysokim poziomie wierności, co nie jest normą w rzeczywistych scenariuszach.

6. Nie wymaga wewnętrznego zespołu programistów

Nie musisz martwić się zatrudnianiem programistów i pozyskiwaniem talentów, aby spersonalizować Nanonets API pod kątem Twoich wymagań biznesowych. Nanonety zostały stworzone z myślą o bezproblemowej integracji. Możesz również łatwo zintegrować Nanonet z większością oprogramowania CRM, ERP lub RPA.

7. Dostosuj, dostosuj, dostosuj

Dzięki Nanonets OCR możesz przechwycić dowolną liczbę pól tekstu/danych. Możesz nawet tworzyć niestandardowe reguły sprawdzania poprawności, które działają zgodnie z określonymi wymaganiami dotyczącymi rozpoznawania tekstu i wyodrębniania tekstu. Nanonets nie jest w ogóle związany z szablonem twojego dokumentu. Możesz przechwytywać dane w tabelach lub pozycjach lub w dowolnym innym formacie!

Nanonets ma wiele zastosowań, które mogą zoptymalizować wydajność Twojej firmy, obniżyć koszty i przyspieszyć rozwój. Dowiedzieć się jak przypadki użycia Nanonets mogą odnosić się do Twojego produktu.

Lub sprawdź Nanonet API OCR w akcji i zacznij tworzyć własne OCR modele za darmo!

Aktualizacja lipiec 2022: ten post został pierwotnie opublikowany w paź 2020 i od tego czasu został zaktualizowany regularnie.

Oto slajd podsumowując ustalenia w tym artykule. Oto alternatywna wersja tego postu.

- AI

- AI i uczenie maszynowe

- ai sztuka

- generator sztuki ai

- masz robota

- sztuczna inteligencja

- certyfikacja sztucznej inteligencji

- sztuczna inteligencja w bankowości

- robot sztucznej inteligencji

- roboty sztucznej inteligencji

- oprogramowanie sztucznej inteligencji

- blockchain

- konferencja blockchain ai

- pomysłowość

- sztuczna inteligencja konwersacyjna

- konferencja kryptograficzna

- Dall's

- głęboka nauka

- google to

- uczenie maszynowe

- OCR

- plato

- Platon Ai

- Analiza danych Platona

- Gra Platona

- PlatoDane

- platogaming

- skala ai

- składnia

- Rozpoznawanie tekstu

- zefirnet