Współautorami tego posta są Jyoti Sharma i Sharmo Sarkar z Vericast.

W przypadku każdego problemu związanego z uczeniem maszynowym (ML) analityk danych zaczyna od pracy z danymi. Obejmuje to gromadzenie, eksplorację i zrozumienie biznesowych i technicznych aspektów danych, a także ocenę wszelkich manipulacji, które mogą być potrzebne w procesie budowania modelu. Jednym z aspektów przygotowywania danych jest inżynieria cech.

Inżynieria cech odnosi się do procesu, w którym identyfikuje się, wybiera i manipuluje odpowiednimi zmiennymi w celu przekształcenia surowych danych w bardziej przydatne i użyteczne formy do wykorzystania z algorytmem ML używanym do uczenia modelu i przeprowadzania na jego podstawie wnioskowań. Celem tego procesu jest zwiększenie wydajności algorytmu i wynikającego z niego modelu predykcyjnego. Proces inżynierii cech obejmuje kilka etapów, w tym tworzenie cech, transformację danych, ekstrakcję cech i wybór cech.

Budowa platformy do uogólnionej inżynierii funkcji jest częstym zadaniem klientów, którzy muszą wygenerować wiele modeli uczenia maszynowego z różnymi zbiorami danych. Platforma tego rodzaju obejmuje tworzenie sterowanego programowo procesu w celu wygenerowania sfinalizowanych, opracowanych pod kątem funkcji danych, gotowych do szkolenia modeli przy niewielkiej interwencji człowieka. Jednak uogólnianie inżynierii cech jest trudne. Każdy problem biznesowy jest inny, każdy zestaw danych jest inny, ilości danych różnią się znacznie w zależności od klienta, a jakość danych i często liczność określonej kolumny (w przypadku danych strukturalnych) może odgrywać znaczącą rolę w złożoności inżynierii cech proces. Co więcej, dynamiczny charakter danych klienta może również skutkować dużą zmiennością czasu przetwarzania i zasobów wymaganych do optymalnego ukończenia inżynierii funkcji.

Klient AWS-a Vericast to firma zajmująca się rozwiązaniami marketingowymi, która podejmuje decyzje w oparciu o dane, aby zwiększyć marketingowy zwrot z inwestycji dla swoich klientów. Wewnętrzna platforma uczenia maszynowego Vericast oparta na chmurze, zbudowana wokół procesu CRISP-ML(Q), korzysta z różnych usług AWS, w tym Amazon Sage Maker, Przetwarzanie Amazon SageMaker, AWS Lambda, Funkcje kroków AWS, aby wyprodukować jak najlepsze modele, które są dostosowane do konkretnych danych klienta. Platforma ta ma na celu uchwycenie powtarzalności etapów tworzenia różnych przepływów pracy ML i połączenie ich w standardowe, możliwe do uogólnienia moduły przepływu pracy w ramach platformy.

W tym poście opisujemy, jak Vericast zoptymalizowano inżynierię funkcji przy użyciu SageMaker Processing.

Omówienie rozwiązania

Platforma uczenia maszynowego Vericast pomaga w szybszym wdrażaniu nowych modeli biznesowych w oparciu o istniejące przepływy pracy lub szybszą aktywację istniejących modeli dla nowych klientów. Na przykład model przewidujący skłonność do przesyłek bezpośrednich różni się znacznie od modelu przewidującego wrażliwość klientów klienta Vericast na kupony rabatowe. Rozwiązują różne problemy biznesowe i dlatego mają różne scenariusze wykorzystania w projektowaniu kampanii marketingowej. Jednak z punktu widzenia uczenia maszynowego oba można interpretować jako binarne modele klasyfikacji i dlatego mogą mieć wiele wspólnych kroków z perspektywy przepływu pracy uczenia maszynowego, w tym dostrajanie i szkolenie modelu, ocena, interpretowalność, wdrażanie i wnioskowanie.

Ponieważ modele te są problemami klasyfikacji binarnej (w ujęciu ML), dzielimy klientów firmy na dwie klasy (binarne): tych, którzy pozytywnie zareagowaliby na kampanię, i tych, którzy by tego nie zrobili. Ponadto przykłady te są uważane za klasyfikację niezrównoważoną, ponieważ dane użyte do szkolenia modelu nie obejmowałyby równej liczby klientów, którzy zareagowaliby i nie zareagowaliby pozytywnie.

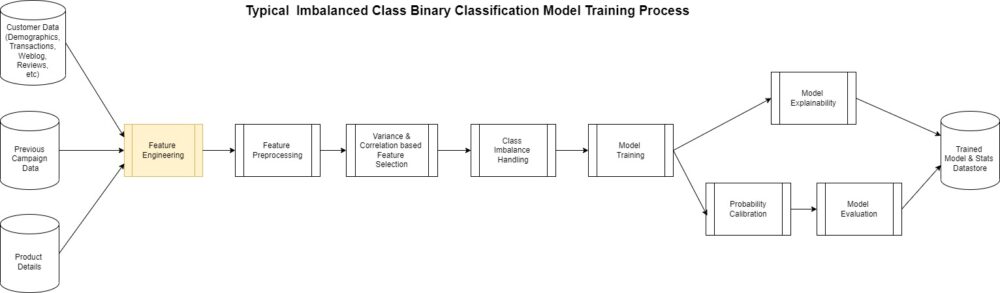

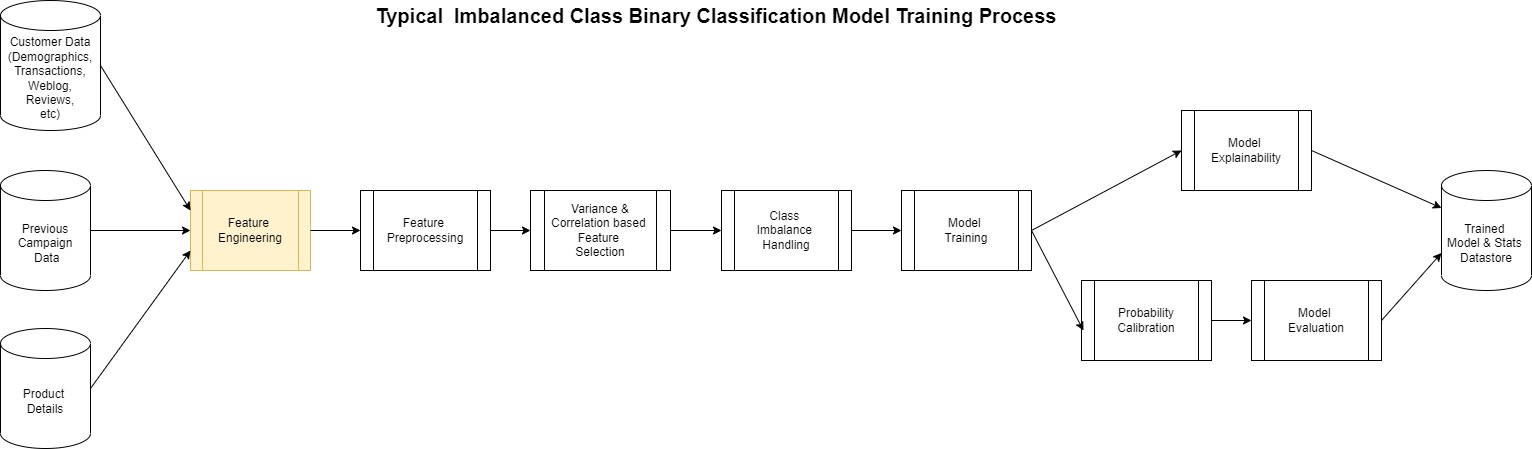

Rzeczywiste utworzenie takiego modelu przebiega według uogólnionego wzorca pokazanego na poniższym diagramie.

Większość tego procesu jest taka sama dla dowolnej klasyfikacji binarnej, z wyjątkiem etapu inżynierii cech. Jest to prawdopodobnie najbardziej skomplikowany, choć czasami pomijany etap procesu. Modele ML w dużej mierze zależą od funkcji użytych do ich stworzenia.

Natywna w chmurze platforma uczenia maszynowego firmy Vericast ma na celu uogólnienie i automatyzację etapów inżynierii funkcji dla różnych przepływów pracy ML i optymalizację ich wydajności na podstawie miernika kosztów w funkcji czasu przy użyciu następujących funkcji:

- Biblioteka inżynieryjna funkcji platformy – Składa się z stale rozwijającego się zestawu transformacji, które zostały przetestowane w celu uzyskania wysokiej jakości uogólnionych funkcji w oparciu o konkretne koncepcje klienta (na przykład dane demograficzne klienta, szczegóły produktu, szczegóły transakcji itd.).

- Inteligentne optymalizatory zasobów – Platforma wykorzystuje możliwości infrastruktury na żądanie AWS w celu uruchomienia najbardziej optymalnego typu zasobów przetwarzania dla konkretnego zadania inżynierii funkcji w oparciu o oczekiwaną złożoność kroku i ilość danych potrzebnych do przetworzenia.

- Dynamiczne skalowanie zadań inżynierii cech – Wykorzystuje się do tego kombinację różnych usług AWS, ale przede wszystkim SageMaker Processing. Dzięki temu platforma zapewnia wysokiej jakości funkcje w sposób opłacalny i terminowy.

Ten post koncentruje się wokół trzeciego punktu na tej liście i pokazuje, jak osiągnąć dynamiczne skalowanie zadań SageMaker Processing, aby uzyskać bardziej zarządzaną, wydajną i opłacalną strukturę przetwarzania danych w przypadku dużych woluminów danych.

SageMaker Processing umożliwia obciążeniom, które wykonują etapy wstępnego lub końcowego przetwarzania danych, inżynierii funkcji, sprawdzania poprawności danych i oceny modelu w SageMaker. Zapewnia także zarządzane środowisko i eliminuje złożoność niezróżnicowanego podnoszenia ciężkich przedmiotów wymaganego do skonfigurowania i utrzymania infrastruktury potrzebnej do obsługi obciążeń. Ponadto SageMaker Processing zapewnia interfejs API do uruchamiania, monitorowania i oceny obciążenia.

Uruchamianie zadań przetwarzania SageMaker odbywa się w całości w zarządzanym klastrze SageMaker, a poszczególne zadania są umieszczane w kontenerach instancji w czasie wykonywania. Zarządzany klaster, instancje i kontenery raportują metryki do Amazon Cloud Watch, w tym wykorzystanie procesora graficznego, procesora, pamięci, pamięci GPU, metryki dysku i rejestrowanie zdarzeń.

Funkcje te zapewniają korzyści inżynierom danych i naukowcom Vericast, pomagając w opracowywaniu uogólnionych przepływów pracy związanych z przetwarzaniem wstępnym i eliminując trudności w utrzymaniu wygenerowanych środowisk, w których można je uruchamiać. Mogą jednak pojawić się problemy techniczne, biorąc pod uwagę dynamiczny charakter danych i ich różnorodne cechy, które można uwzględnić w tak ogólnym rozwiązaniu. System musi wstępnie oszacować rozmiar klastra i instancji, które go tworzą. To przypuszczenie wymaga oceny kryteriów danych i wywnioskowania wymagań dotyczących procesora, pamięci i dysku. To przypuszczenie może być całkowicie właściwe i działać adekwatnie do danego zadania, ale w innych przypadkach może tak nie być. W przypadku danego zestawu danych i zadania przetwarzania wstępnego procesor może być za mały, co skutkuje maksymalną wydajnością przetwarzania i długim czasem jego wykonania. Co gorsza, problemem może stać się pamięć, skutkująca słabą wydajnością lub zdarzeniami związanymi z brakiem pamięci, powodującymi niepowodzenie całego zadania.

Mając na uwadze te przeszkody techniczne, firma Vericast postanowiła stworzyć rozwiązanie. Musiały zachować ogólny charakter i pasować do szerszego obrazu przepływu pracy związanego z przetwarzaniem wstępnym, charakteryzując się elastycznością poszczególnych etapów. Ważne było również rozwiązanie problemu potencjalnej potrzeby skalowania środowiska w przypadku pogorszenia wydajności oraz możliwości płynnego przywrócenia działania po takim zdarzeniu lub gdy z jakiegokolwiek powodu zadanie zakończyło się przedwcześnie.

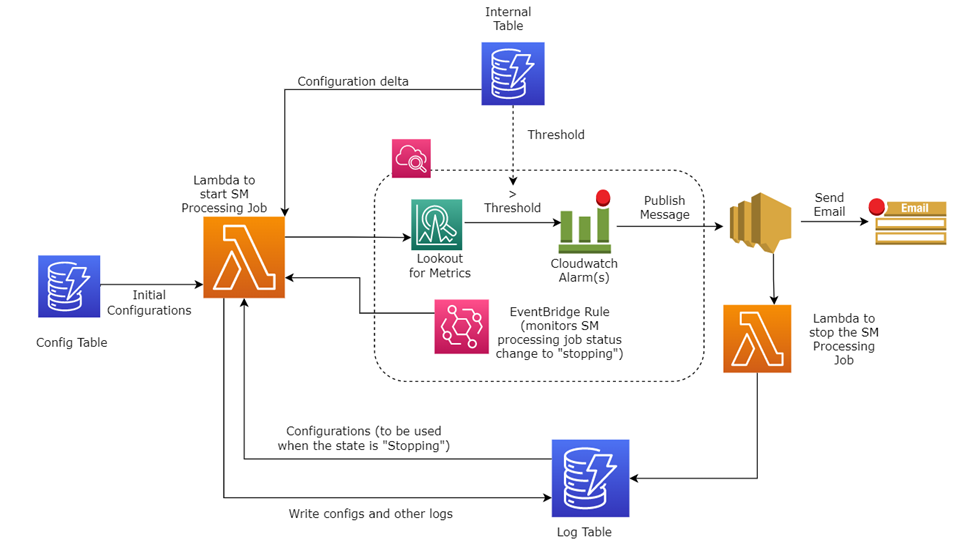

Rozwiązanie stworzone przez Vericast w celu rozwiązania tego problemu wykorzystuje kilka usług AWS współpracujących ze sobą, aby osiągnąć swoje cele biznesowe. Został zaprojektowany do ponownego uruchamiania i skalowania klastra SageMaker Processing w oparciu o metryki wydajności obserwowane za pomocą funkcji Lambda monitorujących zadania. Aby nie stracić pracy w przypadku wystąpienia zdarzenia skalowania lub odzyskać siły po nieoczekiwanym zatrzymaniu zadania, wprowadzono usługę opartą na punktach kontrolnych, która wykorzystuje Amazon DynamoDB i przechowuje częściowo przetworzone dane w Usługa Amazon Simple Storage (Amazon S3) po ukończeniu wszystkich etapów. Ostatecznym rezultatem jest automatyczne skalowanie, solidne i dynamicznie monitorowane rozwiązanie.

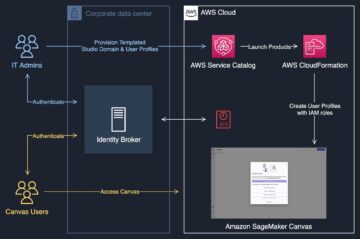

Poniższy diagram przedstawia ogólny przegląd działania systemu.

W poniższych sekcjach bardziej szczegółowo omówimy komponenty rozwiązania.

Inicjalizacja rozwiązania

System zakłada, że rozwiązanie inicjuje odrębny proces. I odwrotnie, ten projekt nie jest przeznaczony do pracy samodzielnej, ponieważ nie będzie generował żadnych artefaktów ani wyników, ale raczej działa jako implementacja poboczna dla jednego z systemów korzystających z zadań SageMaker Processing. W przypadku Vericast rozwiązanie inicjowane jest poprzez wywołanie kroku Step Functions uruchomionego w innym module większego systemu.

Po zainicjowaniu rozwiązania i uruchomieniu pierwszego uruchomienia z tabeli DynamoDB odczytywana jest podstawowa konfiguracja standardowa. Konfiguracja ta służy do ustawienia parametrów zadania SageMaker Processing i posiada wstępne założenia potrzeb infrastrukturalnych. Zadanie przetwarzania SageMaker jest teraz uruchomione.

Monitorowanie metadanych i wyników

Po uruchomieniu zadania funkcja Lambda zapisuje metadane przetwarzania zadania (bieżącą konfigurację zadania i inne informacje dziennika) do tabeli dziennika DynamoDB. Te metadane i informacje dziennika przechowują historię zadania, jego początkową i bieżącą konfigurację oraz inne ważne dane.

W określonych momentach po zakończeniu etapów zadania dane punktu kontrolnego są dodawane do tabeli dziennika DynamoDB. Przetworzone dane wyjściowe są przenoszone do Amazon S3 w celu szybkiego odzyskania, jeśli zajdzie taka potrzeba.

Ta funkcja Lambda konfiguruje również plik Most zdarzeń Amazona reguła monitorująca działające zadanie pod kątem jego stanu. W szczególności ta reguła polega na obserwowaniu zadania w celu sprawdzenia, czy jego status zmieni się na stopping lub jest w stopped państwo. Ta reguła EventBridge odgrywa ważną rolę w ponownym uruchomieniu zadania w przypadku awarii lub wystąpienia planowanego zdarzenia automatycznego skalowania.

Monitorowanie wskaźników CloudWatch

Funkcja Lambda ustawia również alarm CloudWatch na podstawie wyrażenia matematycznego metryki w zadaniu przetwarzania, które monitoruje metryki wszystkich instancji pod kątem wykorzystania procesora, wykorzystania pamięci i wykorzystania dysku. Ten typ alarmu (metryka) wykorzystuje progi alarmów CloudWatch. Alarm generuje zdarzenia na podstawie wartości metryki lub wyrażenia w odniesieniu do progów w określonej liczbie okresów czasu.

W przypadku użycia Vericast wyrażenie progowe zaprojektowano tak, aby traktować instancje sterownika i modułu wykonującego jako oddzielne, przy czym metryki są monitorowane indywidualnie dla każdej z nich. Dzięki rozdzieleniu ich Vericast wie, co powoduje alarm. Ważne jest, aby zdecydować o odpowiednim skalowaniu:

- Jeśli metryki modułu wykonującego przekraczają próg, dobrze jest skalować w poziomie

- Jeśli metryki sterowników przekroczą próg, skalowanie w poziomie prawdopodobnie nie pomoże, dlatego musimy skalować w pionie

Wyrażenie metryk alarmów

Podczas oceny skalowania i awarii firma Vericast może uzyskać dostęp do następujących wskaźników:

- Zużycie procesora – Suma wykorzystania każdego pojedynczego rdzenia procesora

- Wykorzystanie pamięci – Procent pamięci wykorzystywanej przez kontenery w instancji

- Wykorzystanie dysku – Procent miejsca na dysku używany przez kontenery w instancji

- Wykorzystanie GPU – Procent jednostek GPU używanych przez kontenery w instancji

- Wykorzystanie pamięci GPU – Procent pamięci GPU wykorzystywanej przez kontenery w instancji

W chwili pisania tego tekstu Vericast tylko bierze to pod uwagę CPUUtilization, MemoryUtilization, DiskUtilization. W przyszłości zamierzają rozważyć GPUUtilization i GPUMemoryUtilization , jak również.

Poniższy kod jest przykładem alarmu CloudWatch opartego na wyrażeniu matematycznym metryki dla automatycznego skalowania Vericast:

To wyrażenie ilustruje, że alarm CloudWatch jest brany pod uwagę DriverMemoryUtilization (memoryDriver), CPUUtilization (cpuDriver), DiskUtilization (diskDriver), ExecutorMemoryUtilization (memoryExec), CPUUtilization (cpuExec), DiskUtilization (diskExec) jako wskaźniki monitorowania. Liczba 80 w powyższym wyrażeniu oznacza wartość progową.

Tutaj, IF((cpuDriver) > 80, 1, 0 oznacza, że jeśli wykorzystanie procesora sterownika przekracza 80%, jako próg przypisuje się 1, w przeciwnym razie 0. IF(AVG(METRICS("memoryExec")) > 80, 1, 0 oznacza, że wszystkie metryki zawierają ciąg znaków memoryExec w nim są uwzględniane i na tej podstawie obliczana jest średnia. Jeśli średni procent wykorzystania pamięci przekracza 80, jako próg przypisuje się 1, w przeciwnym razie 0.

Operator logiczny OR jest używany w wyrażeniu w celu ujednolicenia wszystkich zastosowań w wyrażeniu — jeśli którekolwiek z zastosowań osiągnie swój próg, wywołaj alarm.

Więcej informacji na temat używania alarmów metryk CloudWatch w oparciu o wyrażenia matematyczne metryki można znaleźć w artykule Tworzenie alarmu CloudWatch na podstawie metrycznego wyrażenia matematycznego.

Ograniczenia alarmów CloudWatch

CloudWatch ogranicza liczbę metryk na alarm do 10. Może to powodować ograniczenia, jeśli trzeba uwzględnić więcej metryk.

Aby pokonać to ograniczenie, Vericast ustawił alarmy na podstawie całkowitego rozmiaru klastra. Na trzy instancje tworzony jest jeden alarm (w przypadku trzech instancji będzie jeden alarm, ponieważ dałoby to w sumie dziewięć metryk). Zakładając, że instancję sterownika należy rozpatrywać osobno, dla instancji kierowcy tworzony jest osobny alarm. Dlatego też całkowita liczba utworzonych alarmów jest w przybliżeniu równa jednej trzeciej liczby węzłów wykonawczych i dodatkowej dla instancji sterownika. W każdym przypadku liczba metryk na alarm jest poniżej limitu 10 metryk.

Co się dzieje w stanie alarmowym

Jeśli zostanie osiągnięty z góry określony próg, alarm przechodzi do alarm stan, który wykorzystuje Usługa prostego powiadomienia Amazon (Amazon SNS), aby wysyłać powiadomienia. W takim przypadku wysyła powiadomienie e-mail do wszystkich abonentów ze szczegółami dotyczącymi alarmu w wiadomości.

Amazon SNS jest również używany jako wyzwalacz funkcji Lambda, która zatrzymuje aktualnie uruchomione zadanie SageMaker Processing, ponieważ wiemy, że zadanie prawdopodobnie zakończy się niepowodzeniem. Funkcja ta zapisuje także logi w tabeli logów powiązane ze zdarzeniem.

Reguła EventBridge skonfigurowana na początku zadania zauważy, że zadanie przeszło do stanu stopping stwierdzić kilka sekund później. Następnie ta reguła ponownie uruchamia pierwszą funkcję Lambda, aby ponownie uruchomić zadanie.

Dynamiczny proces skalowania

Pierwsza funkcja Lambda po uruchomieniu dwa lub więcej razy będzie wiedzieć, że poprzednie zadanie już się rozpoczęło, a teraz zostało zatrzymane. Funkcja przejdzie podobny proces pobierania konfiguracji podstawowej z oryginalnego zadania w tabeli dziennika DynamoDB, a także pobierze zaktualizowaną konfigurację z tabeli wewnętrznej. Ta zaktualizowana konfiguracja to konfiguracja różnicowa zasobów ustawiana na podstawie typu skalowania. Typ skalowania jest określany na podstawie metadanych alarmu, jak opisano wcześniej.

Używana jest oryginalna konfiguracja plus różnica zasobów, ponieważ nowa konfiguracja i nowe zadanie przetwarzania SageMaker są uruchamiane ze zwiększonymi zasobami.

Proces ten trwa do momentu pomyślnego zakończenia zadania i w razie potrzeby może skutkować wielokrotnym ponownym uruchomieniem, za każdym razem dodając więcej zasobów.

Wynik Vericast

To niestandardowe rozwiązanie do automatycznego skalowania odegrało zasadniczą rolę w zwiększeniu niezawodności i odporności platformy uczenia maszynowego firmy Vericast na błędy. Platforma może teraz z łatwością obsługiwać obciążenia związane z różnymi wolumenami danych przy minimalnej interwencji człowieka.

Przed wdrożeniem tego rozwiązania oszacowanie wymagań dotyczących zasobów dla wszystkich przygotowywanych modułów opartych na platformie Spark było jednym z największych wąskich gardeł w procesie wdrażania nowego klienta. Przepływy pracy nie powiodą się, jeśli ilość danych klienta wzrośnie, lub koszty będą nieuzasadnione, jeśli ilość danych spadnie w produkcji.

Dzięki wdrożeniu nowego modułu awarie w przepływie pracy spowodowane ograniczeniami zasobów zostały zredukowane o prawie 80%. Kilka pozostałych błędów wynika głównie z ograniczeń konta AWS i wykracza poza proces automatycznego skalowania. Największą zaletą tego rozwiązania jest łatwość, z jaką firma Vericast może wdrożyć nowych klientów i przepływy pracy. Vericast spodziewa się przyspieszyć ten proces o co najmniej 60–70%, a ostateczna liczba nie zostanie jeszcze zebrana.

Choć Vericast uważa to za sukces, wiąże się to z pewnymi kosztami. Biorąc pod uwagę charakter tego modułu i koncepcję dynamicznego skalowania jako całości, przepływy pracy trwają zazwyczaj około 30% dłużej (przeciętny przypadek) niż przepływ pracy z klastrem dostosowanym niestandardowo dla każdego modułu w przepływie pracy. Vericast kontynuuje optymalizację w tym obszarze, starając się ulepszyć rozwiązanie poprzez włączenie inicjalizacji zasobów opartej na heurystyce dla każdego modułu klienta.

Sharmo Sarkar, starszy menedżer ds. platformy uczenia maszynowego w Vericast, mówi: „W miarę poszerzania naszego wykorzystania AWS i SageMaker, chciałem poświęcić chwilę, aby podkreślić niesamowitą pracę naszego zespołu obsługi klienta AWS, dedykowanych architektów rozwiązań AWS, oraz AWS Professional Services, z którymi współpracujemy. Ich głębokie zrozumienie AWS i SageMaker pozwoliło nam zaprojektować rozwiązanie, które spełniło wszystkie nasze potrzeby i zapewniło nam wymaganą elastyczność i skalowalność. Jesteśmy bardzo wdzięczni, że mamy po swojej stronie tak utalentowany i kompetentny zespół wsparcia”.

Wnioski

W tym poście omówiliśmy, jak SageMaker i SageMaker Processing umożliwiły firmie Vericast zbudowanie zarządzanej, wydajnej i ekonomicznej platformy przetwarzania danych dla dużych ilości danych. Łącząc moc i elastyczność SageMaker Processing z innymi usługami AWS, można łatwo monitorować uogólniony proces inżynierii funkcji. Mogą automatycznie wykrywać potencjalne problemy wynikające z braku mocy obliczeniowej, pamięci i innych czynników, a także w razie potrzeby automatycznie wdrażać skalowanie w pionie i poziomie.

SageMaker i jego narzędzia mogą również pomóc Twojemu zespołowi w osiągnięciu celów uczenia maszynowego. Aby dowiedzieć się więcej o przetwarzaniu SageMaker i o tym, jak może ono pomóc w przetwarzaniu danych, zobacz Przetwarzać dane. Jeśli dopiero zaczynasz przygodę z ML i szukasz przykładów i wskazówek, Amazon SageMaker JumpStart może zacząć. JumpStart to centrum uczenia maszynowego, z którego można uzyskać dostęp do wbudowanych algorytmów ze wstępnie wytrenowanymi modelami podstawowymi, które pomagają w wykonywaniu zadań, takich jak podsumowywanie artykułów i generowanie obrazów, a także do gotowych rozwiązań do rozwiązywania typowych przypadków użycia.

Na koniec, jeśli ten post pomoże Ci lub zainspiruje Cię do rozwiązania problemu, chętnie o tym usłyszymy! Prosimy o podzielenie się swoimi komentarzami i opiniami.

O autorach

Anthony McClure jest starszym architektem rozwiązań partnerskich w zespole AWS SaaS Factory. Anthony bardzo interesuje się także uczeniem maszynowym i sztuczną inteligencją. Współpracuje ze społecznością techniczną AWS ML/AI, aby pomóc klientom we wdrażaniu rozwiązań w zakresie uczenia maszynowego.

Anthony McClure jest starszym architektem rozwiązań partnerskich w zespole AWS SaaS Factory. Anthony bardzo interesuje się także uczeniem maszynowym i sztuczną inteligencją. Współpracuje ze społecznością techniczną AWS ML/AI, aby pomóc klientom we wdrażaniu rozwiązań w zakresie uczenia maszynowego.

Jyoti Sharma jest inżynierem analityki danych w zespole platformy uczenia maszynowego w firmie Vericast. Pasjonuje się wszystkimi aspektami analityki danych i koncentruje się na projektowaniu i wdrażaniu wysoce skalowalnej i rozproszonej platformy uczenia maszynowego.

Jyoti Sharma jest inżynierem analityki danych w zespole platformy uczenia maszynowego w firmie Vericast. Pasjonuje się wszystkimi aspektami analityki danych i koncentruje się na projektowaniu i wdrażaniu wysoce skalowalnej i rozproszonej platformy uczenia maszynowego.

Szarmo Sarkar jest starszym menedżerem w Vericast. Kieruje zespołami badawczo-rozwojowymi ML Cloud Machine Learning Platform i Marketing Platform ML w firmie Vericast. Ma rozległe doświadczenie w analizie Big Data, przetwarzaniu rozproszonym i przetwarzaniu języka naturalnego. Poza pracą lubi jeździć na motocyklu, wędrować i jeździć na rowerze górskimi szlakami.

Szarmo Sarkar jest starszym menedżerem w Vericast. Kieruje zespołami badawczo-rozwojowymi ML Cloud Machine Learning Platform i Marketing Platform ML w firmie Vericast. Ma rozległe doświadczenie w analizie Big Data, przetwarzaniu rozproszonym i przetwarzaniu języka naturalnego. Poza pracą lubi jeździć na motocyklu, wędrować i jeździć na rowerze górskimi szlakami.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoAiStream. Analiza danych Web3. Wiedza wzmocniona. Dostęp tutaj.

- Wybijanie przyszłości w Adryenn Ashley. Dostęp tutaj.

- Kupuj i sprzedawaj akcje spółek PRE-IPO z PREIPO®. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/how-vericast-optimized-feature-engineering-using-amazon-sagemaker-processing/

- :ma

- :Jest

- :nie

- :Gdzie

- $W GÓRĘ

- 1

- 10

- 100

- 15%

- 7

- a

- O nas

- dostęp

- odpowiednio

- Konto

- Osiągać

- Aktywacja

- Dzieje Apostolskie

- Dodaj

- w dodatku

- dodanie

- Dodatkowy

- odpowiednio

- Po

- przed

- AIDS

- Cele

- alarm

- algorytm

- Algorytmy

- Wszystkie kategorie

- sam

- wzdłuż

- już

- również

- Amazonka

- Amazon Sage Maker

- ilość

- an

- analityka

- i

- Inne

- Anthony

- każdy

- api

- właściwy

- architektura

- SĄ

- POWIERZCHNIA

- na około

- artykuł

- sztuczny

- sztuczna inteligencja

- AS

- aspekt

- aspekty

- przydzielony

- pomagać

- At

- samochód

- zautomatyzować

- automatycznie

- średni

- AWS

- Usługi profesjonalne AWS

- baza

- na podstawie

- BE

- bo

- stają się

- być

- jest

- Korzyści

- BEST

- Poza

- Duży

- Big Data

- Najwyższa

- podnieść

- obie

- Bringing

- budować

- Budowanie

- wybudowany

- wbudowany

- biznes

- ale

- by

- obliczony

- wezwanie

- Kampania

- CAN

- Może uzyskać

- Przechwytywanie

- walizka

- Etui

- Spowodować

- spowodowanie

- pewien

- wyzwanie

- Zmiany

- klasa

- Klasy

- klasyfikacja

- klient

- onboarding klienta

- klientów

- Chmura

- Grupa

- kod

- Kolumna

- połączenie

- łączenie

- byliśmy spójni, od początku

- komentarze

- wspólny

- społeczność

- sukcesy firma

- kompletny

- Ukończył

- kompleksowość

- skomplikowane

- składniki

- Zagrożone

- obliczać

- computing

- pojęcie

- Koncepcje

- systemu

- Rozważać

- za

- wobec

- rozważa

- Ograniczenia

- zawierać

- Pojemniki

- kontynuować

- ciągły

- Koszty:

- opłacalne

- mógłby

- kupon

- Stwórz

- stworzony

- tworzenie

- Kryteria

- Krzyż

- Aktualny

- Obecnie

- zwyczaj

- klient

- Klientów

- dane

- Analityka danych

- Przygotowywanie danych

- analiza danych

- nauka danych

- naukowiec danych

- sterowane danymi

- zbiory danych

- zdecydować

- Decyzje

- dedykowane

- głęboko

- Delta

- Demografia

- zależny

- Wdrożenie

- opisane

- Wnętrze

- zaprojektowany

- projektowanie

- detal

- detale

- ustalona

- oprogramowania

- różne

- różni się

- Trudność

- kierować

- Zniżka

- dyskutować

- dystrybuowane

- przetwarzanie rozproszone

- napędzany

- kierowca

- z powodu

- dynamiczny

- dynamicznie

- każdy

- Wcześniej

- łatwość

- z łatwością

- bądź

- włączony

- Umożliwia

- inżynier

- Inżynieria

- Inżynierowie

- zapewnia

- Cały

- Środowisko

- środowiska

- równy

- Równoważny

- oceniać

- oceny

- ewaluację

- wydarzenie

- wydarzenia

- przykład

- przykłady

- Z wyjątkiem

- Przede wszystkim system został opracowany

- Rozszerzać

- spodziewany

- oczekuje

- doświadczenie

- Exploring

- wyrażeń

- rozległy

- Szerokie doświadczenie

- Czynniki

- fabryka

- FAIL

- Brak

- Cecha

- Korzyści

- nakarmiony

- informacja zwrotna

- kilka

- pole

- finał

- sfinalizowane

- i terminów, a

- dopasować

- Elastyczność

- elastyczne

- koncentruje

- następujący

- następujący sposób

- W razie zamówieenia projektu

- formularze

- Fundacja

- Framework

- od

- w pełni

- funkcjonować

- Funkcje

- Ponadto

- przyszłość

- zebranie

- Ogólne

- wygenerowane

- generuje

- generacja

- otrzymać

- miejsce

- dany

- Go

- cel

- Gole

- Goes

- dobry

- GPU

- wdzięczny

- poradnictwo

- miał

- uchwyt

- dzieje

- Have

- mający

- he

- słyszeć

- ciężki

- ciężkie podnoszenie

- pomoc

- pomaga

- na wysokim szczeblu

- wysokiej jakości

- Atrakcja

- wysoko

- historia

- Poziomy

- poziomo

- W jaki sposób

- How To

- Jednak

- HTML

- http

- HTTPS

- Piasta

- człowiek

- Przeszkody

- i

- zidentyfikowane

- if

- ilustruje

- obraz

- wdrożenia

- realizacja

- wykonawczych

- ważny

- podnieść

- in

- W innych

- obejmuje

- Włącznie z

- włączenie

- Zwiększać

- wzrosła

- niewiarygodny

- indywidualny

- Indywidualnie

- Informacja

- Infrastruktura

- początkowy

- Inicjuje

- przykład

- instrumentalny

- Inteligencja

- Zamierzam

- odsetki

- Interfejs

- wewnętrzny

- interwencja

- najnowszych

- zaangażowany

- problem

- problemy

- IT

- JEGO

- Praca

- Oferty pracy

- jpg

- właśnie

- Uprzejmy

- Wiedzieć

- Brak

- język

- duży

- w dużej mierze

- większe

- później

- Wyprowadzenia

- UCZYĆ SIĘ

- nauka

- najmniej

- Biblioteka

- Modernizacja

- ograniczenie

- Ograniczenia

- Limity

- Lista

- mało

- log

- zalogowaniu

- logiczny

- dłużej

- poszukuje

- stracić

- miłość

- maszyna

- uczenie maszynowe

- utrzymać

- Utrzymywanie

- utrzymuje

- robić

- WYKONUJE

- Dokonywanie

- zarządzane

- kierownik

- manipulować

- sposób

- wiele

- Marketing

- matematyka

- Może..

- Poznaj nasz

- Pamięć

- wiadomość

- Metadane

- metryczny

- Metryka

- może

- nic

- minimalny

- ML

- model

- modele

- Moduł

- Moduły

- moment

- monitor

- monitorowane

- monitorowanie

- monitory

- jeszcze

- większość

- przeważnie

- Góra

- wielokrotność

- musi

- Naturalny

- Przetwarzanie języka naturalnego

- Natura

- Potrzebować

- potrzebne

- potrzeba

- wymagania

- Nowości

- węzły

- szczególnie

- Zauważyć..

- powiadomienie

- Powiadomienia

- już dziś

- numer

- Cele

- obserwować

- of

- często

- on

- Na żądanie

- Onboard

- Wprowadzenie

- ONE

- trwający

- tylko

- operator

- Optymalny

- Optymalizacja

- zoptymalizowane

- or

- oryginalny

- Inne

- ludzkiej,

- na zewnątrz

- Wynik

- wydajność

- zewnętrzne

- koniec

- ogólny

- Przezwyciężać

- przegląd

- parametry

- część

- szczególny

- partnerem

- Przechodzący

- namiętny

- Wzór

- procent

- wykonać

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- może

- okresy

- perspektywa

- obraz

- rurociąg

- Miejsce

- planowany

- Platforma

- Platformy

- plato

- Analiza danych Platona

- PlatoDane

- Grać

- odgrywa

- Proszę

- plus

- punkt

- zwrotnica

- biedny

- możliwy

- Post

- potencjał

- power

- przewidywanie

- poprzedni

- prawdopodobnie

- Problem

- problemy

- wygląda tak

- Obrobiony

- przetwarzanie

- produkować

- Produkt

- Produkcja

- profesjonalny

- zapewniać

- pod warunkiem,

- zapewnia

- położyć

- jakość

- Szybki

- szybciej

- R & D

- raczej

- Surowy

- dosięgnąć

- Czytaj

- gotowy

- Rzeczywistość

- powód

- dokumentacja

- Recover

- regeneracja

- Zredukowany

- odnosi

- związane z

- pozostawać

- pozostały

- raport

- wymagany

- wymagania

- Zasób

- Zasoby

- Odpowiadać

- dalsze

- wynikły

- krzepki

- Rola

- w przybliżeniu

- Zasada

- run

- bieganie

- SaaS

- sagemaker

- taki sam

- mówią

- Skalowalność

- skalowalny

- Skala

- skalowaniem

- Rozwiązanie skalujące

- scenariusze

- nauka

- Naukowiec

- Naukowcy

- sekund

- działy

- wybrany

- wybór

- wysłać

- wysyła

- senior

- Wrażliwość

- oddzielny

- rozsadzający

- usługa

- Usługi

- zestaw

- Zestawy

- kilka

- Share

- shared

- Sharma

- ona

- pokazane

- Targi

- bok

- znaczący

- podobny

- Prosty

- Rozmiar

- So

- rozwiązanie

- Rozwiązania

- ROZWIĄZANIA

- Typ przestrzeni

- specyficzny

- swoiście

- prędkość

- Spin

- etapy

- standard

- stojaki

- początek

- rozpoczęty

- rozpocznie

- Stan

- Rynek

- Ewolucja krok po kroku

- Cel

- Nadal

- zatrzymany

- zatrzymanie

- Zatrzymuje

- przechowywanie

- sklep

- sznur

- silny

- zbudowany

- abonentów

- sukces

- Z powodzeniem

- taki

- wsparcie

- system

- systemy

- stół

- dostosowane

- Brać

- trwa

- utalentowany

- Zadanie

- zadania

- zespół

- Zespoły

- Techniczny

- REGULAMIN

- niż

- że

- Połączenia

- Przyszłość

- ich

- Im

- następnie

- Tam.

- w związku z tym

- Te

- one

- Trzeci

- to

- tych

- trzy

- próg

- Przez

- czas

- czasy

- do

- razem

- narzędzia

- Kwota produktów:

- Pociąg

- Trening

- transakcja

- szczegóły transakcji

- Przekształcać

- Transformacja

- przemiany

- wyzwalać

- rozsierdzony

- drugiej

- rodzaj

- typowy

- dla

- zrozumienie

- jednostek

- aż do

- zaktualizowane

- us

- nadający się do użytku

- Stosowanie

- posługiwać się

- przypadek użycia

- używany

- za pomocą

- uprawomocnienie

- wartość

- różnorodny

- pionowy

- Tom

- kłęby

- vs

- poszukiwany

- była

- oglądania

- Droga..

- we

- DOBRZE

- jeśli chodzi o komunikację i motywację

- który

- KIM

- cały

- całkowicie

- będzie

- wygrać

- w

- w ciągu

- Praca

- przepływów pracy

- pracujący

- działa

- gorzej

- by

- pisanie

- jeszcze

- Wydajność

- You

- Twój

- zefirnet