Klienci stają w obliczu rosnących zagrożeń i luk w zabezpieczeniach infrastruktury i zasobów aplikacji w miarę poszerzania się ich śladu cyfrowego i wzrostu wpływu biznesowego tych zasobów cyfrowych. Powszechne wyzwanie dotyczące cyberbezpieczeństwa było dwojakie:

- Korzystanie z dzienników z zasobów cyfrowych dostępnych w różnych formatach i schematach oraz automatyzacja analizy ustaleń dotyczących zagrożeń na podstawie tych dzienników.

- Niezależnie od tego, czy dzienniki pochodzą z Amazon Web Services (AWS), innych dostawców usług w chmurze, lokalnie czy z urządzeń brzegowych, klienci muszą scentralizować i ujednolicić dane dotyczące bezpieczeństwa.

Co więcej, narzędzia analityczne służące identyfikacji zagrożeń bezpieczeństwa muszą umożliwiać skalowanie i ewolucję, aby sprostać zmieniającemu się krajobrazowi podmiotów zagrażających, wektorów bezpieczeństwa i zasobów cyfrowych.

Nowatorskie podejście do rozwiązania tego złożonego scenariusza analizy bezpieczeństwa łączy w sobie pozyskiwanie i przechowywanie danych dotyczących bezpieczeństwa Jezioro bezpieczeństwa Amazonii i analizowanie danych dotyczących bezpieczeństwa za pomocą uczenia maszynowego (ML). Amazon Sage Maker. Amazon Security Lake to specjalnie zaprojektowana usługa, która automatycznie centralizuje dane dotyczące bezpieczeństwa organizacji ze źródeł w chmurze i lokalnych w specjalnie utworzonym jeziorze danych przechowywanym na Twoim koncie AWS. Amazon Security Lake automatyzuje centralne zarządzanie danymi bezpieczeństwa, normalizuje logi ze zintegrowanych usług AWS i usług stron trzecich oraz zarządza cyklem życia danych z dostosowywalnym przechowywaniem, a także automatyzuje warstwowanie pamięci masowej. Usługa Amazon Security Lake pobiera pliki dziennika w formacie Otwórz schemat schematu cyberbezpieczeństwa (OCSF) z obsługą partnerów takich jak Cisco Security, CrowdStrike, Palo Alto Networks i dzienników OCSF z zasobów spoza środowiska AWS. Ten ujednolicony schemat usprawnia dalsze wykorzystanie i analizę, ponieważ dane są zgodne ze standardowym schematem, a nowe źródła można dodawać przy minimalnych zmianach w potoku danych. Po zapisaniu danych dziennika bezpieczeństwa w Amazon Security Lake pojawia się pytanie, jak je przeanalizować. Skutecznym podejściem do analizy danych dziennika bezpieczeństwa jest użycie ML; w szczególności wykrywanie anomalii, które bada dane dotyczące aktywności i ruchu i porównuje je z wartością bazową. Wartość bazowa określa, jaka aktywność jest statystycznie normalna dla tego środowiska. Skala wykrywania anomalii wykracza poza sygnaturę pojedynczego zdarzenia i może ewoluować w wyniku okresowych przekwalifikowań; Następnie można podjąć działania w przypadku ruchu sklasyfikowanego jako nienormalny lub nietypowy, skupiając się na priorytetach i pilności. Amazon SageMaker to w pełni zarządzana usługa, która umożliwia klientom przygotowywanie danych oraz budowanie, trenowanie i wdrażanie modeli uczenia maszynowego dla dowolnego przypadku użycia z w pełni zarządzaną infrastrukturą, narzędziami i przepływami pracy, w tym ofertami bez kodu dla analityków biznesowych. SageMaker obsługuje dwa wbudowane algorytmy wykrywania anomalii: Informacje o IP i Losowo wycięty las. Możesz także użyć SageMaker, aby utworzyć własny, niestandardowy model wykrywania wartości odstających za pomocą Algorytmy pochodzą z wielu platform ML.

W tym poście dowiesz się, jak przygotować dane pochodzące z Amazon Security Lake, a następnie wytrenować i wdrożyć model ML przy użyciu algorytmu IP Insights w SageMaker. Model ten identyfikuje nietypowy ruch sieciowy lub zachowanie, które można następnie uwzględnić w ramach większego, kompleksowego rozwiązania zabezpieczającego. Takie rozwiązanie mogłoby polegać na sprawdzaniu uwierzytelniania wieloskładnikowego (MFA), jeśli użytkownik loguje się z nietypowego serwera lub w nietypowym czasie, powiadamianiu personelu w przypadku podejrzanego skanowania sieci pochodzącego z nowych adresów IP, ostrzeganiu administratorów w przypadku nietypowej sieci używane są protokoły lub porty, lub wzbogacaj wyniki klasyfikacji IP Insights o inne źródła danych, takie jak Amazon Guard Obowiązek oraz wyniki reputacji IP w celu uszeregowania ustaleń dotyczących zagrożeń.

Omówienie rozwiązania

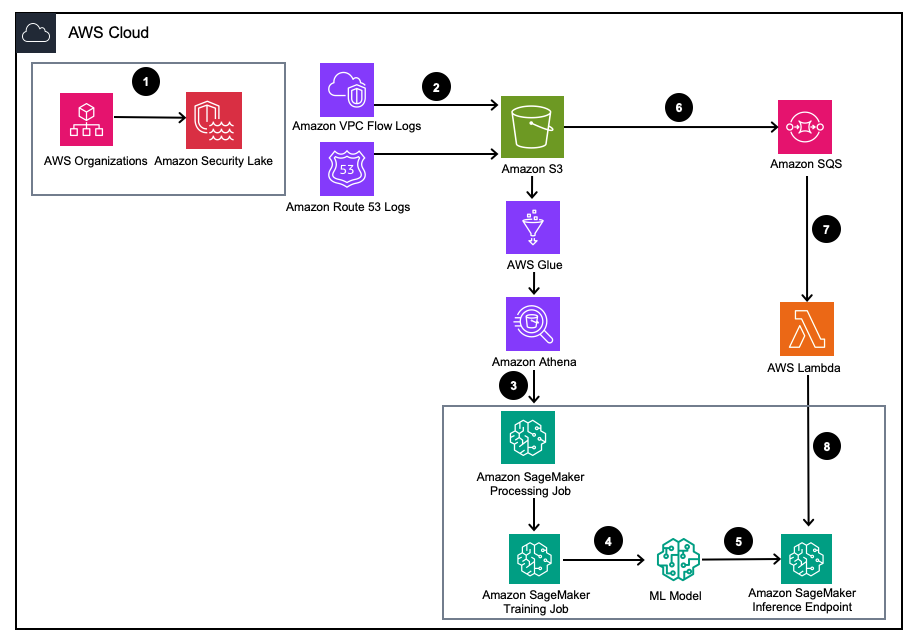

Rysunek 1 – Architektura rozwiązania

- Włącz Amazon Security Lake za pomocą Organizacje AWS dla kont AWS, regionów AWS i zewnętrznych środowisk IT.

- Skonfiguruj źródła Security Lake z Wirtualna prywatna chmura Amazon (Amazon VPC) Dzienniki przepływu i Trasa Amazonki53 Dzienniki DNS w zasobniku Amazon Security Lake S3.

- Przetwarzaj dane dziennika Amazon Security Lake za pomocą zadania SageMaker Processing w celu projektowania funkcji. Używać Amazonka Atena do wysyłania zapytań o ustrukturyzowane dane dziennika OCSF Usługa Amazon Simple Storage (Amazon S3) przez Klej AWS tabele zarządzane przez AWS LakeFormation.

- Trenuj model SageMaker ML przy użyciu zadania SageMaker Training, które wykorzystuje przetworzone dzienniki Amazon Security Lake.

- Wdróż wyszkolony model uczenia maszynowego w punkcie końcowym wnioskowania SageMaker.

- Przechowuj nowe dzienniki zabezpieczeń w zasobniku S3 i kolejkuj zdarzenia Usługa prostej kolejki Amazon (Amazon SQS).

- Subskrybuj AWS Lambda funkcję do kolejki SQS.

- Wywołaj punkt końcowy wnioskowania SageMaker za pomocą funkcji Lambda, aby w czasie rzeczywistym klasyfikować dzienniki bezpieczeństwa jako anomalie.

Wymagania wstępne

Aby wdrożyć rozwiązanie, należy najpierw spełnić następujące wymagania wstępne:

- Włącz Amazon Security Lake w Twojej organizacji lub na pojedynczym koncie z włączonymi dziennikami przepływu VPC i dziennikami rozpoznawania nazw Route 53.

- Upewnij się, że Zarządzanie tożsamością i dostępem AWS (IAM) rola używana przez zadania przetwarzania SageMaker i notatniki ma przydzieloną politykę uprawnień obejmującą Uprawnienie dostępu do zapytania subskrybenta Amazon Security Lake dla zarządzanej bazy danych Amazon Security Lake i tabel zarządzanych przez AWS Lake Formation. Aby zachować zgodność, to zadanie przetwarzania powinno zostać uruchomione z poziomu konta narzędzi analitycznych lub narzędzi zabezpieczających Architektura referencyjna bezpieczeństwa AWS (AWS SRA).

- Upewnij się, że rola IAM używana przez funkcję Lambda ma przypisaną zasadę uprawnień, w tym: Zezwolenie na dostęp do danych subskrybenta Amazon Security Lake.

Wdróż rozwiązanie

Aby skonfigurować środowisko, wykonaj następujące czynności:

- Uruchom a Studio SageMaker lub notatnik SageMaker Jupyter z plikiem

ml.m5.largeinstancja. Uwaga: Rozmiar instancji zależy od używanych zbiorów danych. - Sklonuj GitHuba składnica.

- Otwórz notatnik

01_ipinsights/01-01.amazon-securitylake-sagemaker-ipinsights.ipy. - Zaimplementuj podane zasady uprawnień i odpowiednią politykę zaufania IAM dla instancji SageMaker Studio Notebook, aby uzyskać dostęp do wszystkich niezbędnych danych w S3, Lake Formation i Athena.

W tym blogu omówiono odpowiednią część kodu w notatniku po jego wdrożeniu w Twoim środowisku.

Zainstaluj zależności i zaimportuj wymaganą bibliotekę

Użyj poniższego kodu, aby zainstalować zależności, zaimportować wymagane biblioteki i utworzyć segment SageMaker S3 potrzebny do przetwarzania danych i uczenia modeli. Jedna z wymaganych bibliotek, awswrangler, jest AWS SDK dla ramki danych pand który służy do wysyłania zapytań do odpowiednich tabel w katalogu danych kleju AWS i przechowywania wyników lokalnie w ramce danych.

Zapytaj o tabelę dziennika przepływu VPC Amazon Security Lake

Ta część kodu wykorzystuje pakiet AWS SDK dla pand do wysyłania zapytań do tabeli kleju AWS powiązanej z dziennikami przepływu VPC. Jak wspomniano w wymaganiach wstępnych, tabele Amazon Security Lake są zarządzane przez Formacja AWS Lake, dlatego należy przyznać wszystkie odpowiednie uprawnienia roli używanej przez notatnik SageMaker. To zapytanie pobierze wiele dni ruchu z dziennika przepływu VPC. Zbiór danych wykorzystany podczas tworzenia tego bloga był niewielki. W zależności od skali Twojego przypadku użycia powinieneś zdawać sobie sprawę z ograniczeń pakietu AWS SDK dla pand. Rozważając skalę terabajtową, powinieneś rozważyć AWS SDK do obsługi pand Modyfikuj.

Przeglądając ramkę danych, zobaczysz wynik pojedynczej kolumny ze wspólnymi polami, które można znaleźć w pliku Aktywność sieciowa (4001) klasa OCSF.

Normalizuj dane dziennika przepływu VPC Amazon Security Lake do wymaganego formatu szkoleniowego dla IP Insights.

Algorytm IP Insights wymaga, aby dane szkoleniowe były w formacie CSV i zawierały dwie kolumny. Pierwsza kolumna musi być nieprzezroczystym ciągiem znaków odpowiadającym unikalnemu identyfikatorowi jednostki. Druga kolumna musi zawierać adres IPv4 zdarzenia dostępu jednostki w notacji dziesiętnej. W przykładowym zbiorze danych dla tego bloga unikalnym identyfikatorem są identyfikatory instancji EC2 powiązane z instance_id wartość w dataframe. Adres IPv4 zostanie uzyskany z pliku src_endpoint. Biorąc pod uwagę sposób, w jaki utworzono zapytanie Amazon Athena, zaimportowane dane mają już odpowiedni format do szkolenia modelu IP Insights, więc nie jest wymagana żadna dodatkowa inżynieria funkcji. Jeśli zmodyfikujesz zapytanie w inny sposób, może być konieczne włączenie dodatkowej inżynierii funkcji.

Zapytaj i znormalizuj tabelę dziennika programu rozpoznawania nazw Amazon Security Lake Route 53

Podobnie jak powyżej, w następnym kroku notatnika uruchamiane jest podobne zapytanie względem tabeli mechanizmu rozpoznawania nazw Amazon Security Lake Route 53. Ponieważ w tym notatniku będziesz używać wszystkich danych zgodnych z OCSF, wszelkie zadania związane z inżynierią funkcji pozostają takie same w przypadku dzienników rozpoznawania nazw Route 53, jak w przypadku dzienników przepływu VPC. Następnie łączysz dwie ramki danych w jedną ramkę danych, która jest używana do uczenia. Ponieważ zapytanie Amazon Athena ładuje dane lokalnie we właściwym formacie, nie jest wymagana żadna dalsza inżynieria funkcji.

Uzyskaj obraz szkoleniowy IP Insights i wytrenuj model przy użyciu danych OCSF

W następnej części notatnika będziesz uczyć model uczenia maszynowego w oparciu o algorytm IP Insights i używać skonsolidowanego dataframe OCSF z różnych typów logów. Można znaleźć listę hiperparmetrów IP Insights tutaj. W poniższym przykładzie wybraliśmy hiperparametry, które dały najskuteczniejszy model, na przykład 5 dla epoki i 128 dla wektora_dim. Ponieważ zbiór danych szkoleniowych dla naszej próby był stosunkowo niewielki, wykorzystaliśmy a ml.m5.large instancja. Hiperparametry i konfiguracje szkoleniowe, takie jak liczba instancji i typ instancji, należy wybrać na podstawie obiektywnych metryk i rozmiaru danych szkoleniowych. Jedną z funkcji, którą możesz wykorzystać w Amazon SageMaker, aby znaleźć najlepszą wersję swojego modelu, jest Amazon SageMaker automatyczne dostrajanie modelu który wyszukuje najlepszy model w zakresie wartości hiperparametrów.

Wdróż przeszkolony model i przetestuj przy użyciu prawidłowego i nietypowego ruchu

Po wyszkoleniu modelu wdrażasz go w punkcie końcowym SageMaker i wysyłasz serię kombinacji unikalnych identyfikatorów i adresów IPv4 w celu przetestowania modelu. W tej części kodu założono, że masz dane testowe zapisane w zasobniku S3. Dane testowe to plik .csv, gdzie pierwsza kolumna to identyfikatory instancji, a druga kolumna to adresy IP. Zaleca się przetestowanie ważnych i nieprawidłowych danych, aby zobaczyć wyniki modelu. Poniższy kod wdraża punkt końcowy.

Po wdrożeniu punktu końcowego możesz teraz przesyłać żądania wnioskowania, aby określić, czy ruch jest potencjalnie nietypowy. Poniżej znajduje się przykład tego, jak powinny wyglądać sformatowane dane. W tym przypadku identyfikator pierwszej kolumny to identyfikator instancji, a druga kolumna to powiązany adres IP, jak pokazano poniżej:

Gdy już będziesz mieć dane w formacie CSV, możesz przesłać je do wnioskowania za pomocą kodu, czytając plik .csv z segmentu S3.:

Dane wyjściowe modelu IP Insights stanowią miarę statystycznych oczekiwań dotyczących adresu IP i zasobu online. Zakres tego adresu i zasobu jest jednak nieograniczony, dlatego należy rozważyć, w jaki sposób określić, czy kombinacja identyfikatora instancji i adresu IP powinna być uważana za nienormalną.

W poprzednim przykładzie do modelu przesłano cztery różne kombinacje identyfikatora i adresu IP. Pierwsze dwie kombinacje były prawidłowymi kombinacjami identyfikatora instancji i adresu IP, których oczekuje się na podstawie zestawu szkoleniowego. Trzecia kombinacja ma poprawny unikalny identyfikator, ale inny adres IP w tej samej podsieci. Model powinien określić, że istnieje niewielka anomalia, ponieważ osadzanie różni się nieco od danych szkoleniowych. Czwarta kombinacja ma prawidłowy unikalny identyfikator, ale adres IP nieistniejącej podsieci w dowolnej sieci VPC w środowisku.

Uwaga: Dane o normalnym i nietypowym ruchu będą się zmieniać w zależności od konkretnego przypadku użycia, na przykład: jeśli chcesz monitorować ruch zewnętrzny i wewnętrzny, potrzebujesz unikalnego identyfikatora dopasowanego do każdego adresu IP oraz schematu generowania identyfikatorów zewnętrznych.

Aby określić, jaki powinien być próg w celu ustalenia, czy ruch jest nietypowy, można przeprowadzić, korzystając ze znanego normalnego i nietypowego ruchu. Kroki opisane w ten przykładowy notatnik są następujące:

- Skonstruuj zestaw testowy reprezentujący normalny ruch.

- Dodaj nietypowy ruch do zbioru danych.

- Narysuj rozkład

dot_productwyniki dla modelu dotyczącego ruchu normalnego i ruchu nienormalnego. - Wybierz wartość progową, która odróżnia podzbiór normalny od podzbioru nieprawidłowego. Wartość ta opiera się na tolerancji wyników fałszywie dodatnich

Skonfiguruj ciągłe monitorowanie nowego ruchu w dzienniku przepływu VPC.

Aby zademonstrować, jak można aktywnie wykorzystać ten nowy model uczenia maszynowego z Amazon Security Lake, skonfigurujemy funkcję Lambda, która będzie wywoływana na każdym PutObject zdarzenie w zasobniku zarządzanym przez Amazon Security Lake, w szczególności dane dziennika przepływu VPC. W ramach Amazon Security Lake istnieje koncepcja subskrybenta, który korzysta z logów i zdarzeń z Amazon Security Lake. Funkcja Lambda reagująca na nowe zdarzenia musi posiadać subskrypcję dostępu do danych. Subskrybenci dostępu do danych są powiadamiani o nowych obiektach Amazon S3 dla źródła, gdy obiekty są zapisywane w zasobniku Security Lake. Abonenci mogą uzyskać bezpośredni dostęp do obiektów S3 i otrzymywać powiadomienia o nowych obiektach za pośrednictwem punktu końcowego subskrypcji lub poprzez odpytywanie kolejki Amazon SQS.

- Otwórz Konsola Security Lake.

- W panelu nawigacji wybierz abonenci.

- Na stronie Subskrybenci wybierz Utwórz subskrybenta.

- W polu Dane subskrybenta wpisz

inferencelambdadla Nazwa abonenta i opcjonalny Opis. - Połączenia Region jest automatycznie ustawiany jako aktualnie wybrany region AWS i nie można go modyfikować.

- W razie zamówieenia projektu Źródła dziennika i zdarzeńwybierz Konkretne źródła dziennika i zdarzeń i wybierz Dzienniki przepływu VPC i dzienniki Route 53

- W razie zamówieenia projektu Sposób dostępu do danychwybierz S3.

- W razie zamówieenia projektu Poświadczenia subskrybenta, podaj identyfikator konta AWS, na którym będzie znajdować się funkcja Lambda, oraz identyfikator określony przez użytkownika identyfikator zewnętrzny.

Uwaga: Jeśli robisz to lokalnie w ramach konta, nie musisz mieć zewnętrznego identyfikatora. - Dodaj Stwórz.

Utwórz funkcję Lambda

Aby utworzyć i wdrożyć funkcję Lambda, możesz wykonać następujące kroki lub wdrożyć wstępnie utworzony szablon SAM 01_ipinsights/01.02-ipcheck.yaml w repozytorium GitHub. Szablon SAM wymaga podania SQS ARN i nazwy punktu końcowego SageMaker.

- Na konsoli Lambda wybierz Utwórz funkcję.

- Dodaj Autor od zera.

- W razie zamówieenia projektu Nazwa funkcji, wchodzić

ipcheck. - W razie zamówieenia projektu Czas pracywybierz Python 3.10.

- W razie zamówieenia projektu Architektura, Wybierz x86_64.

- W razie zamówieenia projektu Rola wykonawcza, Wybierz Utwórz nową rolę z uprawnieniami Lambda.

- Po utworzeniu funkcji wprowadź zawartość pliku ipcheck.py plik z repozytorium GitHub.

- W okienku nawigacji wybierz Zmienne środowiskowe.

- Dodaj Edytuj.

- Dodaj Dodaj zmienną środowiskową.

- Wprowadź nową zmienną środowiskową

ENDPOINT_NAMEi jako wartość wprowadź punkt końcowy ARN, który został wyświetlony podczas wdrażania punktu końcowego SageMaker. - Wybierz Zapisz.

- Dodaj Rozmieścić.

- W okienku nawigacji wybierz systemu.

- Wybierz Wyzwalacze.

- Wybierz Dodaj wyzwalacz.

- Pod Wybierz źródłowybierz SQS.

- Pod Kolejka do SQS, wprowadź ARN głównej kolejki SQS utworzonej przez Security Lake.

- Zaznacz pole wyboru dla Aktywuj wyzwalacz.

- Wybierz Dodaj.

Zweryfikuj ustalenia lambda

- Otwórz Konsola Amazon CloudWatch.

- W lewym panelu wybierz Grupy dziennika.

- Na pasku wyszukiwania wpisz ipcheck, a następnie wybierz grupę dzienników o nazwie

/aws/lambda/ipcheck. - Wybierz najnowszy strumień dziennika w obszarze Rejestruj strumienie.

- W dziennikach dla każdego nowego dziennika Amazon Security Lake powinny pojawić się wyniki wyglądające jak poniżej:

{'predictions': [{'dot_product': 0.018832731992006302}, {'dot_product': 0.018832731992006302}]}

Ta funkcja Lambda stale analizuje ruch sieciowy pobierany przez Amazon Security Lake. Dzięki temu możesz zbudować mechanizmy powiadamiające zespoły ds. bezpieczeństwa w przypadku przekroczenia określonego progu, co wskazywałoby na nietypowy ruch w Twoim środowisku.

Oczyszczanie

Po zakończeniu eksperymentowania z tym rozwiązaniem i aby uniknąć opłat na koncie, oczyść swoje zasoby, usuwając segment S3, punkt końcowy SageMaker, wyłączając komputer podłączony do notebooka SageMaker Jupyter, usuwając funkcję Lambda i wyłączając Amazon Security Jezioro na Twoim koncie.

Wnioski

W tym poście dowiedziałeś się, jak przygotować dane o ruchu sieciowym pochodzące z Amazon Security Lake do uczenia maszynowego, a następnie wyszkoliłeś i wdrożyłeś model ML przy użyciu algorytmu IP Insights w Amazon SageMaker. Wszystkie kroki opisane w notesie Jupyter można zreplikować w kompleksowym potoku uczenia maszynowego. Zaimplementowałeś także funkcję AWS Lambda, która zużywała nowe dzienniki Amazon Security Lake i przesyłała wnioski w oparciu o wytrenowany model wykrywania anomalii. Odpowiedzi modelu ML otrzymane przez AWS Lambda mogą proaktywnie powiadamiać zespoły ds. bezpieczeństwa o nietypowym ruchu, gdy zostaną osiągnięte określone progi. Ciągłe doskonalenie modelu można włączyć, włączając zespół ds. bezpieczeństwa do przeglądów pętli w celu sprawdzenia, czy ruch zidentyfikowany jako nietypowy był fałszywie dodatni, czy nie. Można to następnie dodać do swojego zestawu treningowego, a także do swojego normalna zbioru danych o ruchu przy ustalaniu progu empirycznego. Model ten może identyfikować potencjalnie nietypowy ruch sieciowy lub zachowanie, dzięki czemu można go uwzględnić jako część większego rozwiązania zabezpieczającego w celu zainicjowania kontroli MFA, jeśli użytkownik loguje się z nietypowego serwera lub w nietypowym czasie, powiadamiania personelu w przypadku podejrzanego skanowanie sieci pochodzące z nowych adresów IP lub połącz wynik analizy IP z innymi źródłami, takimi jak Amazon Guard Duty, aby uszeregować ustalenia dotyczące zagrożeń. Ten model może obejmować niestandardowe źródła dzienników, takie jak dzienniki przepływu platformy Azure lub dzienniki lokalne, dodając źródła niestandardowe do wdrożenia usługi Amazon Security Lake.

W drugiej części tej serii wpisów na blogu dowiesz się, jak zbudować model wykrywania anomalii za pomocą metody Losowo wycięty las algorytm przeszkolony z dodatkowymi źródłami Amazon Security Lake, które integrują dane dziennika bezpieczeństwa sieci i hosta oraz stosują klasyfikację anomalii bezpieczeństwa w ramach zautomatyzowanego, kompleksowego rozwiązania do monitorowania bezpieczeństwa.

O autorach

Joego Morottiego jest architektem rozwiązań w Amazon Web Services (AWS), pomagającym klientom korporacyjnym w Środkowym Zachodzie Stanów Zjednoczonych. Pełnił szeroki zakres ról technicznych i lubił pokazywać sztukę klienta tego, co możliwe. W wolnym czasie lubi spędzać czas z rodziną, odkrywając nowe miejsca i nadmiernie analizując wyniki swojej drużyny sportowej

Joego Morottiego jest architektem rozwiązań w Amazon Web Services (AWS), pomagającym klientom korporacyjnym w Środkowym Zachodzie Stanów Zjednoczonych. Pełnił szeroki zakres ról technicznych i lubił pokazywać sztukę klienta tego, co możliwe. W wolnym czasie lubi spędzać czas z rodziną, odkrywając nowe miejsca i nadmiernie analizując wyniki swojej drużyny sportowej

Bishr Tabbaa jest architektem rozwiązań w Amazon Web Services. Bishr specjalizuje się w pomaganiu klientom w aplikacjach do uczenia maszynowego, bezpieczeństwa i obserwowalności. Poza pracą lubi grać w tenisa, gotować i spędzać czas z rodziną.

Bishr Tabbaa jest architektem rozwiązań w Amazon Web Services. Bishr specjalizuje się w pomaganiu klientom w aplikacjach do uczenia maszynowego, bezpieczeństwa i obserwowalności. Poza pracą lubi grać w tenisa, gotować i spędzać czas z rodziną.

Sriharsz Adari jest starszym architektem rozwiązań w Amazon Web Services (AWS), gdzie pomaga klientom pracować wstecz od wyników biznesowych do opracowywania innowacyjnych rozwiązań w AWS. Przez lata pomagał wielu klientom w transformacji platform danych w różnych branżach. Jego główne obszary specjalizacji obejmują strategię technologiczną, analizę danych i naukę o danych. W wolnym czasie lubi grać w tenisa, oglądać programy telewizyjne i grać w Tablę.

Sriharsz Adari jest starszym architektem rozwiązań w Amazon Web Services (AWS), gdzie pomaga klientom pracować wstecz od wyników biznesowych do opracowywania innowacyjnych rozwiązań w AWS. Przez lata pomagał wielu klientom w transformacji platform danych w różnych branżach. Jego główne obszary specjalizacji obejmują strategię technologiczną, analizę danych i naukę o danych. W wolnym czasie lubi grać w tenisa, oglądać programy telewizyjne i grać w Tablę.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/identify-cybersecurity-anomalies-in-your-amazon-security-lake-data-using-amazon-sagemaker/

- :ma

- :Jest

- :nie

- :Gdzie

- $W GÓRĘ

- 01

- 1

- 10

- 100

- 12

- 125

- 15%

- 17

- 20000

- 25

- 32

- 7

- 9

- a

- powyżej

- dostęp

- Konto

- Konta

- w poprzek

- działalność

- aktorzy

- w dodatku

- dodanie

- Dodatkowy

- adres

- Adresy

- Administratorzy

- Po

- przed

- Alarm

- algorytm

- Algorytmy

- wyrównany

- Wszystkie kategorie

- pozwala

- już

- również

- Amazonka

- Amazonka Atena

- Amazon Sage Maker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- analiza

- analitycy

- analityka

- w czasie rzeczywistym sprawiają,

- ćwiczenie

- Analizując

- i

- anomalie

- wykrywanie anomalii

- Inne

- każdy

- Zastosowanie

- aplikacje

- Aplikuj

- podejście

- architektura

- SĄ

- POWIERZCHNIA

- Sztuka

- AS

- Aktywa

- powiązany

- zakłada

- At

- Uwierzytelnianie

- zautomatyzowane

- automaty

- automatycznie

- automatyzacja

- uniknąć

- świadomy

- AWS

- Klej AWS

- Formacja AWS Lake

- AWS Lambda

- Lazur

- bar

- na podstawie

- Baseline

- BE

- bo

- staje się

- być

- zachowanie

- jest

- poniżej

- BEST

- Poza

- Blog

- obie

- budować

- wbudowany

- biznes

- ale

- by

- CAN

- zdolność

- zdolny

- walizka

- katalog

- centralny

- scentralizować

- pewien

- wyzwanie

- zmiana

- Zmiany

- wymiana pieniędzy

- Opłaty

- ZOBACZ

- Dodaj

- wybrany

- Cisco

- klasa

- klasyfikacja

- sklasyfikowany

- Klasyfikuj

- kleń

- Chmura

- kod

- Kolumna

- kolumny

- połączenie

- kombinacje

- połączyć

- kombajny

- jak

- przyjście

- wspólny

- kompletny

- kompleks

- zgodny

- w składzie

- wszechstronny

- obliczać

- pojęcie

- Rozważać

- Rozważania

- za

- wobec

- Konsola

- spożywane

- konsumpcja

- zawierać

- treść

- nieustannie

- ciągły

- rdzeń

- skorygowania

- odpowiada

- mógłby

- Stwórz

- stworzony

- Obecnie

- zwyczaj

- Klientów

- konfigurowalny

- Ciąć

- Bezpieczeństwo cybernetyczne

- dane

- dostęp do danych

- Analityka danych

- Jezioro danych

- Platforma danych

- analiza danych

- nauka danych

- Baza danych

- zbiory danych

- Dni

- Definiuje

- wykazać

- Zależności

- zależny

- W zależności

- rozwijać

- wdrażane

- Wdrożenie

- wdraża się

- Pochodny

- detale

- Wykrywanie

- Ustalać

- określaniu

- rozwijać

- oprogramowania

- urządzenia

- ZROBIŁ

- różne

- cyfrowy

- Zasoby cyfrowe

- bezpośrednio

- 分配

- dns

- robi

- robi

- darowizna

- zrobić

- nie

- na dół

- podczas

- e

- każdy

- krawędź

- Efektywne

- bądź

- więcej

- osadzanie

- włączony

- Umożliwia

- koniec końców

- Punkt końcowy

- inżynier

- Inżynieria

- cieszyć się

- wzbogacać

- Wchodzę

- Enterprise

- Środowisko

- środowiska

- epoka

- błąd

- wydarzenie

- wydarzenia

- ewoluuje

- ewoluuje

- Bada

- przykład

- Z wyjątkiem

- istnieje

- rozszerzony

- spodziewany

- ekspertyza

- Exploring

- zewnętrzny

- w obliczu

- fałszywy

- członków Twojej rodziny

- Cecha

- Korzyści

- Łąka

- filet

- Akta

- Znajdź

- Ustalenia

- i terminów, a

- pływ

- Skupiać

- następujący

- następujący sposób

- Ślad stopy

- W razie zamówieenia projektu

- format

- formacja

- znaleziono

- cztery

- Czwarty

- FRAME

- Ramy

- Darmowy

- od

- w pełni

- funkcjonować

- dalej

- Generować

- GitHub

- udzielony

- Zarządzanie

- dorosły

- osłona

- Have

- he

- Trzymany

- pomógł

- pomoc

- pomaga

- jego

- gospodarz

- W jaki sposób

- How To

- Jednak

- HTML

- HTTPS

- ID

- zidentyfikowane

- identyfikator

- identyfikatory

- identyfikuje

- zidentyfikować

- identyfikacja

- tożsamość

- ids

- if

- obraz

- Rezultat

- realizowane

- importować

- poprawa

- in

- zawierać

- włączony

- Włącznie z

- włączać

- wzrastający

- wskazać

- indywidualny

- przemysł

- Infrastruktura

- zainicjować

- Innowacyjny

- spostrzeżenia

- zainstalować

- przykład

- integrować

- zintegrowany

- wewnętrzny

- najnowszych

- przywołany

- IP

- Adres IP

- Adresy IP

- IT

- Praca

- Oferty pracy

- jpg

- json

- znany

- Etykieta

- jezioro

- krajobraz

- duży

- większe

- UCZYĆ SIĘ

- dowiedziałem

- nauka

- lewo

- biblioteki

- wifecycwe

- lubić

- Limity

- Lista

- masa

- lokalnie

- log

- Popatrz

- wygląda jak

- maszyna

- uczenie maszynowe

- Główny

- zarządzane

- i konserwacjami

- zarządza

- sposób

- Może..

- zmierzyć

- Mechanizmy

- Poznaj nasz

- wzmiankowany

- spełnione

- Metryka

- MSZ

- Midwest

- minimalny

- brakujący

- ML

- model

- modele

- skromny

- zmodyfikowano

- modyfikować

- monitor

- monitorowanie

- większość

- wielokrotność

- musi

- Nazwa

- Nawigacja

- niezbędny

- Potrzebować

- potrzebne

- sieć

- ruch sieciowy

- sieci

- Nowości

- Następny

- Nie

- nieistniejący

- normalna

- notatnik

- Powiadomienia

- powieść

- już dziś

- cel

- obiekty

- of

- Oferty

- on

- ONE

- Online

- nieprzezroczysty

- or

- organizacja

- OS

- Inne

- ludzkiej,

- wyniki

- odstające

- opisane

- wydajność

- zewnętrzne

- koniec

- własny

- strona

- Palo Alto

- pandy

- chleb

- część

- wzmacniacz

- wykonywania

- periodycznie

- pozwolenie

- uprawnienia

- rurociąg

- Miejsca

- Platforma

- plato

- Analiza danych Platona

- PlatoDane

- gra

- polityka

- część

- porty

- pozytywny

- możliwy

- Post

- potencjalnie

- poprzedzający

- Przewidywania

- Urządzenie prognozujące

- Przygotować

- warunki wstępne

- priorytetowe

- prywatny

- Proaktywne

- Obrobiony

- przetwarzanie

- właściwy

- protokoły

- zapewniać

- dostawców

- zapewnia

- jakość

- pytanie

- podnieść

- zasięg

- rankingu

- Czytający

- real

- w czasie rzeczywistym

- otrzymać

- Odebrane

- niedawny

- Zalecana

- odniesienie

- region

- regiony

- związane z

- stosunkowo

- pozostawać

- replikowane

- reprezentować

- reputacja

- wywołań

- wymagany

- Wymaga

- Zasób

- Zasoby

- odpowiedź

- Odpowiedzi

- dalsze

- Efekt

- retencja

- Recenzje

- Rola

- role

- Trasa

- run

- działa

- sagemaker

- Wnioskowanie SageMakera

- Sam

- taki sam

- Przykładowy zbiór danych

- zapisywane

- Skala

- waga

- skalowaniem

- skanować

- scenariusz

- schemat

- nauka

- wynik

- Sdk

- Szukaj

- wyszukiwania

- druga

- bezpieczeństwo

- Zagrożenia bezpieczeństwa

- widzieć

- wybierać

- wybrany

- wysłać

- senior

- Serie

- serwer

- usługa

- Usługi

- Sesja

- zestaw

- powinien

- pokazane

- Targi

- wyłączania

- bok

- podpis

- podpisywanie

- podobny

- Prosty

- ponieważ

- pojedynczy

- Rozmiar

- trochę inny

- mały

- So

- rozwiązanie

- Rozwiązania

- ROZWIĄZANIA

- Źródło

- pozyskiwany

- Źródła

- specjalizuje się

- specyficzny

- swoiście

- określony

- Spędzanie

- SPORTOWE

- Personel

- Ewolucja krok po kroku

- Cel

- przechowywanie

- sklep

- przechowywany

- Strategia

- strumień

- usprawnień

- sznur

- zbudowany

- studio

- Zatwierdź

- składane

- podsieci

- abonent

- abonentów

- subskrypcja

- taki

- wsparcie

- podpory

- podejrzliwy

- stół

- zadania

- zespół

- Zespoły

- Techniczny

- Technologia

- Strategia technologiczna

- szablon

- tenis

- test

- że

- Połączenia

- ich

- następnie

- Tam.

- one

- Trzeci

- innych firm

- to

- tych

- groźba

- podmioty grożące

- zagrożenia

- próg

- Przez

- czas

- do

- narzędzia

- ruch drogowy

- Pociąg

- przeszkolony

- Trening

- przemiany

- Zaufaj

- próbować

- tv

- drugiej

- dwojaki

- rodzaj

- typy

- dla

- Ujednolicony

- wyjątkowy

- na

- pilna sprawa

- us

- posługiwać się

- przypadek użycia

- używany

- Użytkownik

- zastosowania

- za pomocą

- wykorzystać

- wykorzystany

- ważny

- wartość

- Wartości

- zmienna

- wersja

- pionowe

- Zobacz i wysłuchaj

- łamane

- Wirtualny

- Luki w zabezpieczeniach

- spacery

- chcieć

- była

- Droga..

- we

- sieć

- usługi internetowe

- były

- Co

- jeśli chodzi o komunikację i motywację

- czy

- który

- szeroki

- Szeroki zasięg

- będzie

- w

- w ciągu

- Praca

- przepływów pracy

- by

- napisany

- lat

- You

- Twój

- zefirnet