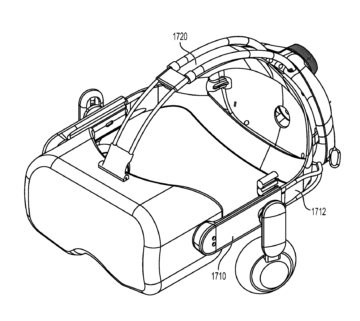

Meta badacze zademonstrowali śledzenie ciała Quest 2 bez dodatkowych urządzeń śledzących.

Obecne systemy VR są dostarczane z goglami i trzymanymi kontrolerami, więc śledź tylko pozycję głowy i rąk. Pozycję łokci, tułowia i nóg można oszacować za pomocą klasy algorytmów zwanych kinematykami odwrotnymi (IK), ale jest to tylko czasami dokładne dla łokci i rzadko dla nóg. Istnieje zbyt wiele potencjalnych rozwiązań dla każdego zestawu pozycji głowy i rąk.

Biorąc pod uwagę ograniczenia IK, niektórzy W dzisiejszych aplikacjach VR widać tylko dłonie, a wiele z nich daje tylko górną część ciała. Zestawy słuchawkowe do komputerów PC korzystające ze śledzenia SteamVR obsługują noszone dodatkowe trackery, takie jak HTC Vive Tracker, ale trzy potrzebne do śledzenia ciała kosztują na północ od 350 USD, a zatem nie jest to obsługiwane w większości gier.

Ale w nowy artykuł zatytułowany QuestSim, badacze Meta zademonstrowali system sterowany przez sieć neuronową, który może oszacować prawdopodobną pozę całego ciała za pomocą tylko danych śledzenia z Quest 2 i jego kontrolerów. Nie są potrzebne żadne dodatkowe trackery ani zewnętrzne czujniki.

Wynikowy ruch awatara dość ściśle odpowiada rzeczywistemu ruchowi użytkownika. Naukowcy twierdzą nawet, że uzyskana dokładność i jitter są lepsze od zużytych trackerów IMU – urządzeń z tylko akcelerometrem i żyroskopem, takich jak zapowiedziany Pico 4 Zespół Pico Fitness (Pico twierdzi, że pracuje nad własnym algorytmem uczenia maszynowego).

Jednakże, jest tu haczyk. Jak widać na filmie, ten system ma na celu nadanie priorytetu tworzeniu wiarygodnego całe ciało Połóż się nad upewnieniem się, że ręce awatara pasują dokładnie do położenia rąk użytkownika. Opóźnienie systemu również wynosi 160ms – ponad 11 klatek przy 72Hz. Biorąc pod uwagę te problemy, QuestSim byłby odpowiedni tylko do oglądania ciał awatarów innych osób, a nie do oglądania własnego ciała, gdy patrzysz w dół.

Mimo to oglądanie ruchu całego ciała awatarów innych ludzi byłoby o wiele lepsze niż często krytykowane, pozbawione nóg górne części ciała obecnych awatarów Meta. Czy ten system lub coś w tym stylu pojawi się w Quest 2?

Meta CTO Andrew Bosworth z pewnością zdawał się sugerować to w zeszłym tygodniu. Kiedy zapytany o śledzenie nóg na Instagramie „zapytaj mnie o cokolwiek” Bosworth odpowiedział:

„Tak, naśmiewano się z wielu beznogich awatarów i myślę, że to bardzo sprawiedliwe i myślę, że to całkiem zabawne.

Posiadanie nóg na własnym awatarach, które nie pasują do twoich prawdziwych nóg, jest bardzo niepokojące dla ludzi. Ale oczywiście możemy stawiać nogi na innych ludziach, co widać i to ci w ogóle nie przeszkadza.

Więc pracujemy nad nogami, które wyglądają naturalnie dla kogoś, kto jest postronnym obserwatorem – ponieważ nie wie on, jak naprawdę są ustawione twoje prawdziwe nogi – ale prawdopodobnie ty, gdy patrzysz na własne nogi, nadal nic nie zobaczysz. To nasza obecna strategia.”

Rozwiązanie krótkoterminowe może jednak nie być tej samej jakości tego algorytmu. Artykuły badawcze dotyczące uczenia maszynowego zwykle działają na potężnych procesorach graficznych do komputerów PC przy stosunkowo niskiej liczbie klatek na sekundę. Artykuł nie wspomina o wydajności opisanego systemu, ale RTX 3080 jest wymieniony jako używany do treningu.

Odbywa się coroczna impreza AR/VR Meta Connect w nieco ponad 2 tygodnie, więc najprawdopodobniej podczas tego będzie miało miejsce jakiekolwiek ogłoszenie o śledzeniu ciała.

- AR / VR

- blockchain

- konferencja blockchain ar

- konferencja blockchain vr

- pomysłowość

- konferencja kryptograficzna

- konferencja kryptograficzna

- rozszerzona rzeczywistość

- Przyszłość VR

- Meta

- metabadania

- Metaverse

- mieszana rzeczywistość

- Oculus

- gry oculus

- OPPO

- plato

- Platon Ai

- Analiza danych Platona

- PlatoDane

- platogaming

- zadanie 2

- laboratoria rzeczywistości

- nauka robota

- telemedycyna

- firmy telemedyczne

- Ulubione historie

- UploadVR

- Wirtualna rzeczywistość

- gra w wirtualnej rzeczywistości

- gry w wirtualnej rzeczywistości

- vr

- zefirnet