To drugi post z czteroczęściowej serii szczegółowo opisującej, jak to zrobić Grupa NatWest, poważna instytucja świadcząca usługi finansowe, współpracująca z Usługi profesjonalne AWS w celu zbudowania nowej platformy operacji uczenia maszynowego (MLops). W tym poście opisujemy, w jaki sposób Grupa NatWest wykorzystała AWS, aby umożliwić samoobsługowe wdrożenie swojej standardowej, bezpiecznej i zgodnej platformy MLOps przy użyciu Katalog usług AWS i Amazon Sage Maker. Doprowadziło to do skrócenia czasu potrzebnego na udostępnienie nowych środowisk z dni do zaledwie kilku godzin.

Wierzymy, że decydenci mogą skorzystać z tych treści. CTO, CDAO, starsi badacze danych i starsi inżynierowie zajmujący się chmurą mogą podążać za tym wzorcem, aby dostarczać innowacyjne rozwiązania swoim zespołom zajmującym się analizą danych i inżynierią.

Przeczytaj całą serię:

|

Technologia w Grupie NatWest

NatWest Group to bank relacyjny dla cyfrowego świata, który świadczy usługi finansowe dla ponad 19 milionów klientów w całej Wielkiej Brytanii. Grupa posiada zróżnicowane portfolio technologii, w ramach którego rozwiązania wyzwań biznesowych są często dostarczane w oparciu o projekty „na zamówienie” i w długich terminach.

Niedawno Grupa NatWest przyjęła strategię stawiającą na chmurę, która umożliwiła jej korzystanie z usług zarządzanych w celu udostępniania zasobów obliczeniowych i pamięci masowej na żądanie. Posunięcie to doprowadziło do poprawy ogólnej stabilności, skalowalności i wydajności rozwiązań biznesowych, przy jednoczesnym obniżeniu kosztów i przyspieszeniu tempa dostaw. Ponadto przejście do chmury umożliwia Grupie NatWest uproszczenie stosu technologii poprzez egzekwowanie zestawu spójnych, powtarzalnych i wstępnie zatwierdzonych projektów rozwiązań, które spełniają wymogi regulacyjne i działają w kontrolowany sposób.

Wyzwania

Pilotażowe etapy przyjęcia podejścia opartego na chmurze obejmowały kilka faz eksperymentów i oceny, w których wykorzystano szeroką gamę rozwiązań usługi analityczne na AWS-ie. Pierwsze wersje platformy chmurowej Grupy NatWest do obsługi obciążeń związanych z analizą danych stawiały czoła wyzwaniom związanym z zapewnieniem spójnych, bezpiecznych i zgodnych środowisk chmurowych. Proces tworzenia nowych środowisk trwał od kilku dni do tygodni, a nawet miesięcy. Poleganie na zespołach platform centralnych w zakresie tworzenia, udostępniania, zabezpieczania, wdrażania i zarządzania infrastrukturą i źródłami danych utrudniało wdrażanie nowych zespołów do pracy w chmurze.

Ze względu na rozbieżności w konfiguracji infrastruktury na kontach AWS zespoły, które zdecydowały się na migrację swoich obciążeń do chmury, musiały przejść skomplikowany proces zapewniania zgodności. Każdy element infrastruktury musiał być analizowany osobno, co wydłużało czas audytów bezpieczeństwa.

Rozpoczęcie programowania w AWS wymagało przeczytania zestawu przewodników po dokumentacji napisanych przez zespoły zajmujące się platformą. Początkowe kroki konfiguracji środowiska obejmowały zarządzanie kluczami publicznymi i prywatnymi na potrzeby uwierzytelniania, konfigurowanie połączeń z usługami zdalnymi za pomocą Interfejs wiersza poleceń AWS (AWS CLI) lub SDK z lokalnych środowisk programistycznych oraz uruchamianie niestandardowych skryptów do łączenia lokalnych IDE z usługami w chmurze. Wyzwania techniczne często utrudniały wdrażanie nowych członków zespołu. Po skonfigurowaniu środowisk programistycznych droga do wydania oprogramowania w wersji produkcyjnej była podobnie złożona i długa.

Jak opisano w części 1 tej serii, wspólny zespół projektowy zebrał dużą ilość opinii na temat doświadczeń użytkowników i wymagań od zespołów w całej Grupie NatWest przed zbudowaniem nowej platformy do nauki o danych i MLOps. Częstym tematem tych opinii była potrzeba automatyzacji i standaryzacji jako prekursora szybkiej i wydajnej realizacji projektów w AWS. Nowa platforma korzysta z usług zarządzanych AWS w celu optymalizacji kosztów, ograniczenia wysiłków związanych z konfiguracją platformy i zmniejszenia śladu węglowego wynikającego z wykonywania niepotrzebnie dużych zadań obliczeniowych. Standaryzacja jest osadzona w sercu platformy i obejmuje wstępnie zatwierdzone, w pełni skonfigurowane, bezpieczne, zgodne i nadające się do ponownego wykorzystania komponenty infrastruktury, które można udostępniać zespołom zajmującym się danymi i analizami.

Dlaczego SageMaker Studio?

Zespół wybrał Studio Amazon SageMaker jako główne narzędzie do budowania i wdrażania potoków uczenia maszynowego. Studio zapewnia pojedynczy interfejs internetowy, który zapewnia użytkownikom pełny dostęp, kontrolę i wgląd w każdy etap wymagany do budowania, uczenia i wdrażania modeli. Dojrzałość Studio IDE (zintegrowanego środowiska programistycznego) do tworzenia modeli, śledzenia metadanych, zarządzania artefaktami i wdrażania należała do funkcji, które bardzo podobały się zespołowi Grupy NatWest.

Analitycy danych w NatWest Group współpracują z notatnikami SageMaker w Studio na początkowych etapach opracowywania modelu, aby przeprowadzić analizę danych, przetwarzanie danych i inżynierię funkcji. Gdy użytkownicy będą zadowoleni z wyników tej wstępnej pracy, kod można łatwo przekształcić w funkcje, które można komponować, na potrzeby transformacji danych, uczenia modeli, wnioskowania, rejestrowania i testów jednostkowych, dzięki czemu jest w stanie gotowym do produkcji.

Późniejsze etapy cyklu życia modelu obejmują wykorzystanie Rurociągi Amazon SageMaker, które można wizualnie sprawdzić i monitorować w Studio. Rurociągi są wizualizowane w formie DAG (kierunkowego wykresu acyklicznego), który koduje etapy kolorami na podstawie ich stanu podczas działania potoku. Ponadto podsumowanie Dzienniki Amazon CloudWatch jest wyświetlany obok DAG, aby ułatwić debugowanie nieudanych kroków. Analitycy danych otrzymują szablon kodu składający się ze wszystkich podstawowych kroków w potoku SageMaker. Zapewnia to ujednoliconą strukturę (spójną dla wszystkich użytkowników platformy, co ułatwia współpracę i dzielenie się wiedzą), do której programiści mogą dodawać zindywidualizowaną logikę i kod aplikacji dostosowany do wyzwania biznesowego, które rozwiązują.

Deweloperzy uruchamiają potoki w środowisku IDE Studio, aby mieć pewność, że zmiany w kodzie prawidłowo integrują się z innymi etapami potoku. Po przejrzeniu i zatwierdzeniu zmian w kodzie te potoki są budowane i uruchamiane automatycznie w oparciu o wyzwalacz głównej gałęzi repozytorium Git. Podczas uczenia modelu metryki oceny modelu są przechowywane i śledzone w eksperymentach SageMaker, których można używać do dostrajania hiperparametrów. Po przeszkoleniu modelu artefakt modelu jest przechowywany w pliku Rejestr modeli SageMaker, wraz z metadanymi związanymi z kontenerami modeli, danymi używanymi podczas uczenia, funkcjami modelu i kodem modelu. Rejestr modeli odgrywa kluczową rolę w procesie wdrażania modelu, ponieważ pakuje wszystkie informacje o modelu i umożliwia automatyzację promocji modelu w środowiskach produkcyjnych.

Inżynierowie MLOps wdrażają rozwiązania zarządzane Zadania transformacji wsadowej SageMaker, które można skalować w celu spełnienia wymagań dotyczących obciążenia. Zarówno zadania wsadowe wnioskowania w trybie offline, jak i modele online udostępniane za pośrednictwem punktu końcowego korzystają z funkcji wnioskowania zarządzanego SageMaker. Jest to korzystne zarówno dla zespołów zajmujących się platformą, jak i aplikacjami biznesowymi, ponieważ inżynierowie platform nie spędzają już czasu na konfigurowaniu komponentów infrastruktury na potrzeby wnioskowania o modelu, a zespoły ds. aplikacji biznesowych nie piszą dodatkowego standardowego kodu w celu konfigurowania instancji obliczeniowych i interakcji z nimi.

Dlaczego katalog usług AWS?

Zespół wybrał katalog usług AWS, aby zbudować katalog bezpiecznych, zgodnych i wstępnie zatwierdzonych szablonów infrastruktury. Komponenty infrastruktury w produkcie AWS Service Catalog są wstępnie skonfigurowane tak, aby spełniały wymagania bezpieczeństwa Grupy NatWest. Zarządzanie dostępem do ról, zasady zasobów, konfiguracja sieci i zasady centralnej kontroli są konfigurowane dla każdego zasobu spakowanego w produkcie AWS Service Catalog. Produkty są wersjonowane i udostępniane zespołom ds. aplikacji zgodnie ze standardowym procesem, który umożliwia zespołom zajmującym się analizą danych i inżynierią samoobsługę i wdrażanie infrastruktury natychmiast po uzyskaniu dostępu do swoich kont AWS.

Zespoły programistów platform mogą z czasem łatwo ewoluować produkty AWS Service Catalog, aby umożliwić wdrażanie nowych funkcji w oparciu o wymagania biznesowe. Iteracyjne zmiany w produktach są wprowadzane za pomocą wersjonowania produktów AWS Service Catalog. Po wydaniu nowej wersji produktu zespół ds. platformy scala zmiany w kodzie z główną gałęzią Git i zwiększa wersję produktu AWS Service Catalog. Aktualizowanie infrastruktury zapewnia pewną autonomię i elastyczność, ponieważ konta aplikacji biznesowych mogą korzystać z wcześniejszych wersji produktów przed migracją do najnowszej wersji.

Omówienie rozwiązania

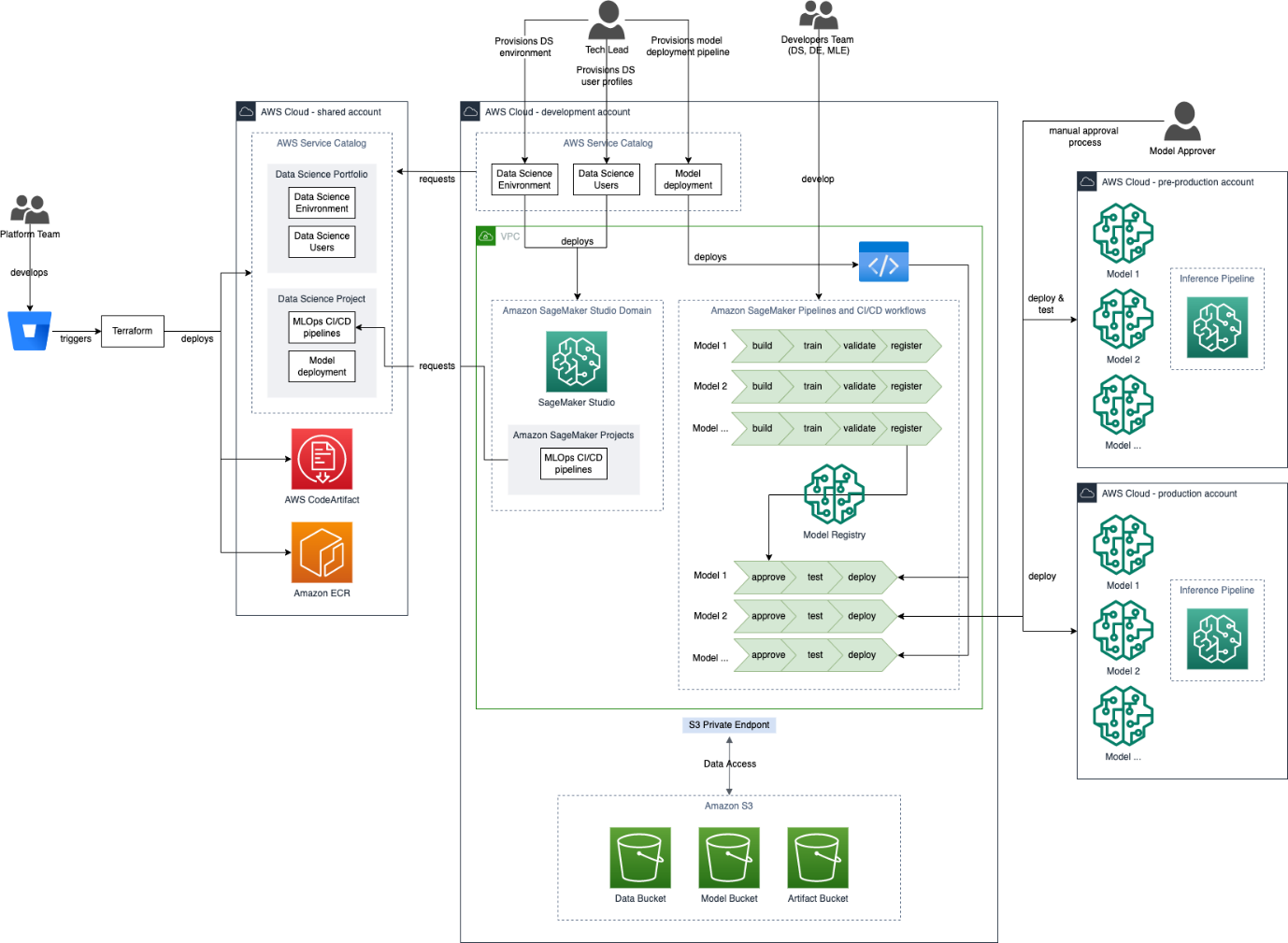

Poniższy diagram architektury wysokiego poziomu pokazuje, jak typowy przypadek użycia aplikacji biznesowej jest wdrażany w AWS. W poniższych sekcjach opisano bardziej szczegółowo architekturę konta, sposób wdrażania infrastruktury, zarządzanie dostępem użytkowników i sposób wykorzystania różnych usług AWS do tworzenia rozwiązań ML.

Jak pokazano na diagramie architektury, konta opierają się na modelu piasty i szprychy. Konto platformy współdzielonej służy jako konto centrum, w którym zasoby wymagane przez konta zespołów aplikacji biznesowych (szprychy) są hostowane przez zespół platformy. Zasoby te obejmują:

- Biblioteka bezpiecznych, standardowych produktów infrastrukturalnych używanych do samoobsługowych wdrożeń infrastruktury, hostowana przez katalog usług AWS

- Obrazy Dockera przechowywane w Rejestr elastycznego pojemnika Amazon (Amazon ECR), które są używane podczas wykonywania etapów potoku SageMaker i wnioskowania o modelu

- Artefakt Kodeksu AWS repozytoria, w których znajdują się wstępnie zatwierdzone pakiety Pythona

Zasoby te są automatycznie udostępniane kontom szprych za pośrednictwem funkcji udostępniania i importowania portfolio usług AWS AWS Zarządzanie tożsamością i dostępem (IAM) zasady zaufania zarówno w przypadku Amazon ECR, jak i CodeArtifact.

Każdy zespół zajmujący się aplikacjami biznesowymi ma zapewnione trzy konta AWS w środowisku infrastruktury Grupy NatWest: programistyczne, przedprodukcyjne i produkcyjne. Nazwy środowisk odnoszą się do zamierzonej roli konta w cyklu życia rozwoju analizy danych. Konto programistyczne służy do przeprowadzania analizy i przetwarzania danych, pisania kodu modelu i potoku modelu, trenowania modeli i wyzwalania wdrożeń modeli w środowiskach przedprodukcyjnych i produkcyjnych za pośrednictwem SageMaker Studio. Konto przedprodukcyjne odzwierciedla konfigurację konta produkcyjnego i służy do testowania wdrożeń modeli i zadań transformacji wsadowej przed ich zwolnieniem do środowiska produkcyjnego. Konto produkcyjne obsługuje modele i uruchamia obciążenia wnioskowania produkcyjnego.

Zarządzanie użytkownikami

Grupa NatWest posiada rygorystyczne procesy zarządzania mające na celu wymuszenie rozdzielenia ról użytkowników. Dla każdej osoby użytkownika utworzono pięć oddzielnych ról IAM.

Zespół platformy pełni następujące role:

- Inżynier wsparcia platformy – Ta rola zawiera uprawnienia do wykonywania zwykłych zadań oraz widok tylko do odczytu pozostałej części środowiska w celu monitorowania i debugowania platformy.

- Inżynier naprawy platformy – Ta rola została utworzona z podwyższonymi uprawnieniami. Jest używany, jeśli występują problemy z platformą wymagające ręcznej interwencji. Rolę tę można pełnić wyłącznie w zatwierdzony i ograniczony w czasie sposób.

Zespoły zajmujące się tworzeniem aplikacji biznesowych pełnią trzy różne role:

- Kierownik techniczny – Tę rolę przypisuje się kierownikowi zespołu aplikacyjnego, często starszemu analitykowi danych. Ten użytkownik ma uprawnienia do wdrażania i zarządzania produktami AWS Service Catalog, uruchamiania wydań do produkcji i sprawdzania stanu środowiska, np. AWS Code Pipeline statusy i logi. Ta rola nie ma uprawnień do zatwierdzania modelu w rejestrze modeli SageMaker.

- Deweloper – Ta rola jest przypisana wszystkim członkom zespołu współpracującego z SageMaker Studio, do którego zaliczają się inżynierowie, badacze danych, a często także lider zespołu. Ta rola ma uprawnienia do otwierania Studio, pisania kodu oraz uruchamiania i wdrażania potoków SageMaker. Podobnie jak kierownik techniczny, ta rola nie ma uprawnień do zatwierdzania modelu w rejestrze modeli.

- Osoba zatwierdzająca model – Ta rola ma ograniczone uprawnienia dotyczące przeglądania, zatwierdzania i odrzucania modeli w rejestrze modeli. Powodem tego rozdzielenia jest uniemożliwienie użytkownikom, którzy mogą budować i trenować modele, zatwierdzania i publikowania własnych modeli w środowiskach eskalowanych.

Dla programistów i osób zatwierdzających modele tworzone są osobne profile użytkowników Studio. Rozwiązanie wykorzystuje kombinację instrukcji zasad IAM i tagów profilu użytkownika SageMaker, dzięki czemu użytkownicy mogą otwierać tylko profile użytkownika odpowiadające ich typowi użytkownika. Dzięki temu użytkownik ma przypisaną właściwą rolę IAM wykonywania SageMaker (a tym samym uprawnienia) po otwarciu środowiska IDE Studio.

Wdrożenia samoobsługowe z katalogiem usług AWS

Użytkownicy końcowi wykorzystują katalog usług AWS do wdrażania produktów infrastruktury analizy danych, takich jak:

- Środowisko studyjne

- Profile użytkowników Studio

- Potoki wdrażania modelu

- Rurociągi szkoleniowe

- Potoki wnioskowania

- System monitorowania i ostrzegania

Użytkownicy końcowi wdrażają te produkty bezpośrednio za pośrednictwem interfejsu użytkownika katalogu usług AWS, co oznacza, że przy udostępnianiu środowisk mniej polega się na zespołach ds. platform centralnych. Znacząco skróciło to czas potrzebny użytkownikom na uzyskanie dostępu do nowych środowisk chmurowych, z kilku dni do zaledwie kilku godzin, co ostatecznie doprowadziło do znacznego skrócenia czasu uzyskania korzyści. Zastosowanie wspólnego zestawu produktów AWS Service Catalog wspiera spójność projektów w całym przedsiębiorstwie i obniża barierę dla współpracy i ponownego wykorzystania.

Ponieważ cała infrastruktura analizy danych jest obecnie wdrażana za pośrednictwem centralnie opracowanego katalogu produktów infrastrukturalnych, przy tworzeniu każdego z tych produktów zadbano o bezpieczeństwo. Usługi zostały skonfigurowane do komunikacji wewnątrz Wirtualna prywatna chmura Amazon (Amazon VPC), aby ruch nie przechodził przez publiczny Internet. Dane są szyfrowane podczas przesyłania i przechowywania Usługa zarządzania kluczami AWS (AWS KMS). Role IAM zostały również skonfigurowane zgodnie z zasadą najmniejszych uprawnień.

Wreszcie, dzięki Katalogowi usług AWS, zespół ds. platformy może łatwo udostępniać nowe produkty i usługi, gdy tylko staną się dostępne lub będą potrzebne zespołom zajmującym się aplikacjami biznesowymi. Mogą one przybrać formę nowych produktów infrastrukturalnych, na przykład zapewniających użytkownikom końcowym możliwość wdrażania własnych Amazon EMR klastry lub aktualizacje istniejących produktów infrastrukturalnych. Ponieważ katalog usług AWS obsługuje wersjonowanie produktów i wykorzystuje je Tworzenie chmury AWS Za kulisami można zastosować aktualizacje lokalne, gdy zostaną wydane nowe wersje istniejących produktów. Dzięki temu zespoły zajmujące się platformami mogą skoncentrować się na budowaniu i ulepszaniu produktów, zamiast opracowywać złożone procesy aktualizacji.

Integracja z istniejącym oprogramowaniem IaC firmy NatWest

Katalog usług AWS służy do samoobsługowych wdrożeń infrastruktury analizy danych. Dodatkowo do budowy infrastruktury na kontach AWS wykorzystywane jest standardowe narzędzie NatWest w postaci infrastruktury jako kodu (IaC), Terraform. Terraform jest używany przez zespoły ds. platform podczas procesu początkowej konfiguracji konta w celu wdrożenia wymaganych zasobów infrastruktury, takich jak VPC, grupy zabezpieczeń, Menedżer systemów AWS parametrów, kluczy KMS i standardowych kontroli bezpieczeństwa. Infrastruktura na koncie centrum, taka jak portfele katalogu usług AWS i zasoby używane do tworzenia obrazów Dockera, są również definiowane za pomocą Terraform. Jednak same produkty katalogu usług AWS są budowane przy użyciu standardowych szablonów CloudFormation.

Poprawa produktywności programistów i jakości kodu dzięki projektom SageMaker

Projekty SageMaker Zapewnij programistom i analitykom danych dostęp do projektów szybkiego startu bez opuszczania SageMaker Studio. Te projekty szybkiego startu umożliwiają jednoczesne wdrożenie wielu zasobów infrastruktury za pomocą zaledwie kilku kliknięć. Należą do nich repozytorium Git zawierające ustandaryzowany szablon projektu dla wybranego typu modelu, Usługa Amazon Simple Storage Zasobniki (Amazon S3) do przechowywania danych, serializowanych modeli i artefaktów oraz uczenia modeli i potoków wnioskowania CodePipeline.

Wprowadzenie standardowych architektur i narzędzi bazowych kodu ułatwia obecnie badaczom i inżynierom danych przemieszczanie się między projektami i zapewnia utrzymanie wysokiej jakości kodu. Na przykład najlepsze praktyki inżynierii oprogramowania, takie jak sprawdzanie lintingu i formatowania (uruchamiane zarówno jako kontrole automatyczne, jak i przechwytywanie przed zatwierdzeniem), testy jednostkowe i raporty pokrycia są teraz zautomatyzowane w ramach potoków szkoleniowych, zapewniając standaryzację we wszystkich projektach. Poprawiło to łatwość konserwacji projektów ML i ułatwi przeniesienie tych projektów do środowiska produkcyjnego.

Automatyzacja wdrażania modeli

Proces uczenia modelu jest koordynowany przy użyciu SageMaker Pipelines. Po przeszkoleniu modele są przechowywane w rejestrze modeli SageMaker. Użytkownicy, którym przypisano rolę osoby zatwierdzającej model, mogą otworzyć rejestr modelu i znaleźć informacje dotyczące procesu uczenia, takie jak data wytrenowania modelu, wartości hiperparametrów i metryki oceny. Informacje te pomagają użytkownikowi podjąć decyzję o zatwierdzeniu lub odrzuceniu modelu. Odrzucenie modelu uniemożliwia wdrożenie modelu w eskalowanym środowisku, natomiast zatwierdzenie modelu uruchamia potok promocji modelu za pośrednictwem CodePipeline, który automatycznie kopiuje model na przedprodukcyjne konto AWS, gotowe do testowania obciążenia wnioskowaniem. Po potwierdzeniu przez zespół, że model działa poprawnie w fazie przedprodukcyjnej, zatwierdzany jest ręczny krok w tym samym potoku, a model jest automatycznie kopiowany na konto produkcyjne, gotowy do obciążeń związanych z wnioskowaniem produkcyjnym.

Wyniki

Jednym z głównych celów tego wspólnego projektu pomiędzy NatWest i AWS było skrócenie czasu potrzebnego na zapewnienie i wdrożenie środowisk chmurowych do nauki danych i modeli uczenia maszynowego w środowisku produkcyjnym. Udało się to osiągnąć — NatWest może teraz udostępnić nowe, skalowalne i bezpieczne środowiska AWS w ciągu kilku godzin, w porównaniu do dni lub nawet tygodni. Analitycy i inżynierowie zajmujący się danymi mają teraz możliwość samodzielnego wdrażania infrastruktury analityki danych i zarządzania nią za pomocą katalogu usług AWS, co zmniejsza zależność od scentralizowanych zespołów zajmujących się platformami. Dodatkowo wykorzystanie projektów SageMaker umożliwia użytkownikom rozpoczęcie kodowania i uczenia modeli w ciągu kilku minut, zapewniając jednocześnie ustandaryzowane struktury projektów i narzędzia.

Ponieważ katalog usług AWS służy jako centralna metoda wdrażania infrastruktury analityki danych, platformę można łatwo rozszerzać i modernizować w przyszłości. Nowe usługi AWS można szybko zaoferować użytkownikom końcowym, gdy zajdzie taka potrzeba, a istniejące produkty AWS Service Catalog można zaktualizować w celu wykorzystania nowych funkcji.

Wreszcie przejście w stronę usług zarządzanych w AWS oznacza, że zasoby obliczeniowe są udostępniane i zamykane na żądanie. Zapewniło to oszczędności i elastyczność, a jednocześnie dostosowało się do wymagań Ambicją NatWest jest osiągnięcie zerowej emisji netto do 2050 r ze względu na szacunkową redukcję emisji CO o 75%.2 emisji.

Wnioski

Przyjęcie strategii opartej na chmurze w Grupie NatWest doprowadziło do stworzenia solidnego rozwiązania AWS, które może obsługiwać dużą liczbę zespołów zajmujących się aplikacjami biznesowymi w całej organizacji. Zarządzanie infrastrukturą za pomocą katalogu usług AWS znacznie usprawniło proces wdrażania w chmurze dzięki zastosowaniu bezpiecznych, zgodnych i wstępnie zatwierdzonych elementów infrastruktury, które można łatwo rozszerzać. Zarządzane komponenty infrastruktury SageMaker usprawniły proces opracowywania modeli i przyspieszyły realizację projektów ML.

Aby dowiedzieć się więcej o procesie budowania gotowych do produkcji modeli ML w NatWest Group, zapoznaj się z dalszą częścią tej czteroczęściowej serii poświęconej strategicznej współpracy pomiędzy NatWest Group i AWS Professional Services:

- Część 1 wyjaśnia, w jaki sposób NatWest Group nawiązała współpracę z AWS Professional Services, aby zbudować skalowalną, bezpieczną i zrównoważoną platformę MLOps

- Część 3 zawiera przegląd tego, w jaki sposób NatWest Group wykorzystuje usługi SageMaker do tworzenia podlegających audytowi, odtwarzalnych i wyjaśnialnych modeli ML

- Część 4 szczegółowo opisuje, w jaki sposób zespoły zajmujące się analizą danych NatWest migrują swoje istniejące modele do architektur SageMaker

O autorach

Junaid Baba jest konsultantem DevOps w firmie Usługi profesjonalne AWS Wykorzystuje swoje doświadczenie w Kubernetes, przetwarzaniu rozproszonym i sztucznej inteligencji/MLOps, aby przyspieszyć wdrażanie chmury wśród klientów z branży usług finansowych w Wielkiej Brytanii. Junaid jest w AWS od czerwca 2018 r. Wcześniej Junaid współpracował z wieloma finansowymi start-upami, wdrażając praktyki DevOps. Poza pracą interesuje się trekkingiem, sztuką współczesną i fotografią.

Junaid Baba jest konsultantem DevOps w firmie Usługi profesjonalne AWS Wykorzystuje swoje doświadczenie w Kubernetes, przetwarzaniu rozproszonym i sztucznej inteligencji/MLOps, aby przyspieszyć wdrażanie chmury wśród klientów z branży usług finansowych w Wielkiej Brytanii. Junaid jest w AWS od czerwca 2018 r. Wcześniej Junaid współpracował z wieloma finansowymi start-upami, wdrażając praktyki DevOps. Poza pracą interesuje się trekkingiem, sztuką współczesną i fotografią.

Jordananka Iwanowa jest inżynierem danych w Grupie NatWest. Posiada doświadczenie w budowaniu i dostarczaniu rozwiązań danych dla firm z branży usług finansowych. Przed dołączeniem do NatWest Yordanka pracowała jako konsultant techniczny, gdzie zdobyła doświadczenie w wykorzystywaniu szerokiej gamy usług w chmurze i technologii open source w celu zapewniania wyników biznesowych na wielu platformach chmurowych. W wolnym czasie Yordanka lubi ćwiczyć, podróżować i grać na gitarze.

Jordananka Iwanowa jest inżynierem danych w Grupie NatWest. Posiada doświadczenie w budowaniu i dostarczaniu rozwiązań danych dla firm z branży usług finansowych. Przed dołączeniem do NatWest Yordanka pracowała jako konsultant techniczny, gdzie zdobyła doświadczenie w wykorzystywaniu szerokiej gamy usług w chmurze i technologii open source w celu zapewniania wyników biznesowych na wielu platformach chmurowych. W wolnym czasie Yordanka lubi ćwiczyć, podróżować i grać na gitarze.

Michał Anglia jest inżynierem oprogramowania w zespole Data Science and Innovation w Grupie NatWest. Jego pasją jest opracowywanie rozwiązań do uruchamiania wielkoskalowych obciążeń Machine Learning w chmurze. Przed dołączeniem do NatWest Group Michael pracował i kierował zespołami inżynierów oprogramowania opracowującymi krytyczne aplikacje w branży usług finansowych i branży turystycznej. W wolnym czasie lubi grać na gitarze, podróżować i zwiedzać okolicę na rowerze.

Michał Anglia jest inżynierem oprogramowania w zespole Data Science and Innovation w Grupie NatWest. Jego pasją jest opracowywanie rozwiązań do uruchamiania wielkoskalowych obciążeń Machine Learning w chmurze. Przed dołączeniem do NatWest Group Michael pracował i kierował zespołami inżynierów oprogramowania opracowującymi krytyczne aplikacje w branży usług finansowych i branży turystycznej. W wolnym czasie lubi grać na gitarze, podróżować i zwiedzać okolicę na rowerze.

- Coinsmart. Najlepsza w Europie giełda bitcoinów i kryptowalut.

- Platoblockchain. Web3 Inteligencja Metaverse. Wzmocniona wiedza. DARMOWY DOSTĘP.

- CryptoJastrząb. Radar Altcoin. Bezpłatna wersja próbna.

- Źródło: https://aws.amazon.com/blogs/machine-learning/part-2-how-natwest-group-built-a-secure-Compliance-self-service-mlops-platform-using-aws-service- katalog-i-amazon-sagemaker/

- "

- 100

- O nas

- przyśpieszony

- przyspieszenie

- dostęp

- Konto

- w poprzek

- dodatek

- Dodatkowy

- Przyjęcie

- Korzyść

- Wszystkie kategorie

- Amazonka

- wśród

- ilość

- kwoty

- analiza

- analityka

- Zastosowanie

- aplikacje

- podejście

- Zatwierdzać

- architektura

- Sztuka

- przydzielony

- Audyt

- Uwierzytelnianie

- zautomatyzowane

- Automatyzacja

- Automatyzacja i standaryzacja

- dostępny

- AWS

- Bank

- stają się

- za kulisami

- jest

- korzyści

- Korzyści

- BEST

- Najlepsze praktyki

- budować

- Budowanie

- biznes

- węgiel

- który

- scentralizowane

- wyzwanie

- wyzwania

- Wykrywanie urządzeń szpiegujących

- Chmura

- Platforma chmurowa

- usługi w chmurze

- kod

- Kodowanie

- współpraca

- połączenie

- wspólny

- Firmy

- sukcesy firma

- w porównaniu

- kompleks

- spełnienie

- zgodny

- składnik

- obliczać

- computing

- systemu

- połączenia

- konsultant

- Pojemnik

- Pojemniki

- zawiera

- zawartość

- nieustannie

- kontrola

- stworzony

- Tworzenie

- tworzenie

- krytyczny

- zwyczaj

- Klientów

- dane

- analiza danych

- nauka danych

- naukowiec danych

- dostarczona

- dostarczanie

- dostawa

- Kreowanie

- wymagania

- rozwijać

- wdrażane

- wdrażanie

- Wdrożenie

- wdrożenia

- opisane

- projekty

- detal

- detale

- rozwinięty

- Deweloper

- deweloperzy

- rozwijanie

- oprogramowania

- różne

- trudny

- cyfrowy

- bezpośrednio

- dystrybuowane

- przetwarzanie rozproszone

- Doker

- Nie

- na dół

- jazdy

- z łatwością

- wydajny

- starania

- Opracować

- umożliwiać

- Punkt końcowy

- inżynier

- Inżynieria

- Inżynierowie

- Enterprise

- Środowisko

- szacunkowa

- ewaluację

- ewoluuje

- przykład

- egzekucja

- Przede wszystkim system został opracowany

- doświadczenie

- Cecha

- Korzyści

- informacja zwrotna

- budżetowy

- usługi finansowe

- i terminów, a

- Fix

- Elastyczność

- Skupiać

- obserwuj

- następujący

- Ślad stopy

- Nasz formularz

- Framework

- Funkcjonalność

- przyszłość

- git

- zarządzanie

- Zarządzanie

- Grupy

- Przewodniki

- Zaoszczędzić

- pomoc

- pomaga

- Wysoki

- W jaki sposób

- HTTPS

- tożsamość

- realizacja

- ulepszony

- zawierać

- włączony

- obejmuje

- wzrosła

- przemysłowa

- przemysł

- Informacja

- Infrastruktura

- Innowacja

- Innowacyjny

- Instytucja

- integrować

- zintegrowany

- zainteresowania

- Interfejs

- Internet

- zaangażowany

- problemy

- IT

- Oferty pracy

- Klawisz

- Klawisze

- wiedza

- duży

- firmy

- prowadzić

- UCZYĆ SIĘ

- nauka

- Doprowadziło

- wykorzystuje

- lewarowanie

- Biblioteka

- Ograniczony

- Linia

- Powiązanie

- miejscowy

- maszyna

- uczenie maszynowe

- zrobiony

- poważny

- WYKONUJE

- zarządzanie

- zarządzane

- i konserwacjami

- zarządzający

- sposób

- podręcznik

- Materia

- dojrzałość

- znaczenie

- Użytkownicy

- Metryka

- milion

- nic

- ML

- model

- modele

- monitorowanie

- miesięcy

- jeszcze

- ruch

- przeniesienie

- wielokrotność

- Nazwy

- sieci

- Nowe funkcje

- Nowa platforma

- nowy produkt

- Nowe produkty

- numer

- oferowany

- nieaktywny

- Wprowadzenie

- Online

- koncepcja

- operacje

- Optymalizacja

- organizacja

- Inne

- ogólny

- własny

- szczególny

- partner

- namiętny

- Wzór

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- fotografia

- pilot

- Platforma

- Platformy

- gra

- polityka

- polityka

- teczka

- portfele

- zasada

- prywatny

- Klucze prywatne

- wygląda tak

- procesów

- Produkt

- Produkcja

- wydajność

- Produkty

- profesjonalny

- Profil

- profile

- projekt

- projektowanie

- promocja

- zapewniać

- zapewnia

- że

- publiczny

- jakość

- Szybki

- szybko

- Czytający

- zmniejszyć

- redukcja

- regulacyjne

- związek

- zwolnić

- wydany

- prasowe

- poleganie

- Raporty

- składnica

- wymagać

- wymagany

- wymagania

- Zasób

- Zasoby

- REST

- Efekt

- przeglądu

- Trasa

- run

- bieganie

- Skalowalność

- skalowalny

- Skala

- Sceny

- nauka

- Naukowiec

- Naukowcy

- Sdk

- bezpieczne

- bezpieczeństwo

- wybrany

- Serie

- usługa

- Usługi

- zestaw

- ustawienie

- Share

- shared

- znaczący

- Podobnie

- Prosty

- So

- Tworzenie

- Software Engineer

- Inżynieria oprogramowania

- rozwiązanie

- Rozwiązania

- wydać

- Stabilność

- stos

- standard

- start-up

- rozpoczęty

- Stan

- oświadczenia

- Rynek

- przechowywanie

- Strategiczny

- Strategia

- studio

- wsparcie

- podpory

- zrównoważone

- system

- systemy

- zadania

- zespół

- Techniczny

- Technologies

- Technologia

- Szablony

- test

- Testowanie

- Testy

- staw

- motyw

- w związku z tym

- Przez

- czas

- narzędzie

- w kierunku

- Śledzenie

- ruch drogowy

- Trening

- Przekształcać

- Transformacja

- tranzyt

- podróżować

- Podróżowanie

- Zaufaj

- ui

- Uk

- Nowości

- posługiwać się

- Użytkownicy

- wykorzystać

- Wykorzystując

- różnorodność

- Zobacz i wysłuchaj

- Wirtualny

- widoczność

- Web-based

- czy

- Podczas

- KIM

- w ciągu

- bez

- Praca

- pracował

- pracujący

- wypracowanie

- działa

- świat