W tej dwuczęściowej serii pokazujemy, jak oznaczać i szkolić modele do zadań związanych z wykrywaniem obiektów 3D. W części 1 omawiamy zestaw danych, którego używamy, a także wszelkie etapy wstępnego przetwarzania, aby zrozumieć i oznaczyć dane. W części 2 omówimy, jak wyszkolić model w zestawie danych i wdrożyć go w środowisku produkcyjnym.

LiDAR (wykrywanie i określanie zasięgu światła) to metoda określania odległości poprzez skierowanie lasera na obiekt lub powierzchnię i pomiar czasu powrotu odbitego światła do odbiornika. Firmy zajmujące się pojazdami autonomicznymi zazwyczaj używają czujników LiDAR do generowania trójwymiarowego obrazu otoczenia wokół swoich pojazdów.

W miarę jak czujniki LiDAR stają się coraz bardziej dostępne i opłacalne, klienci coraz częściej wykorzystują dane z chmury punktów w nowych obszarach, takich jak robotyka, mapowanie sygnałów i rzeczywistość rozszerzona. Niektóre nowe urządzenia mobilne zawierają nawet czujniki LiDAR. Rosnąca dostępność czujników LiDAR zwiększyła zainteresowanie danymi chmury punktów do zadań uczenia maszynowego (ML), takich jak wykrywanie i śledzenie obiektów 3D, segmentacja 3D, synteza i rekonstrukcja obiektów 3D oraz wykorzystanie danych 3D do walidacji oszacowania głębokości 2D.

W tej serii pokazujemy, jak trenować model wykrywania obiektów, który działa na danych chmury punktów, aby przewidywać położenie pojazdów w scenie 3D. W tym poście skupiamy się w szczególności na etykietowaniu danych LiDAR. Standardowe wyjście czujnika LiDAR to sekwencja klatek chmury punktów 3D, z typową szybkością przechwytywania 10 klatek na sekundę. Aby oznaczyć to wyjście czujnika, potrzebujesz narzędzia do etykietowania, które może obsługiwać dane 3D. Amazon SageMaker Ground Prawda ułatwia etykietowanie obiektów w pojedynczej ramce 3D lub w sekwencji klatek chmury punktów 3D w celu tworzenia zestawów danych szkoleniowych ML. Ground Truth obsługuje również fuzję danych z kamery i LiDAR z maksymalnie ośmioma wejściami kamery wideo.

Dane są niezbędne w każdym projekcie ML. W szczególności dane 3D mogą być trudne do pozyskania, wizualizacji i etykietowania. Używamy Zestaw danych A2D2 w tym poście i przeprowadzę Cię przez kolejne etapy wizualizacji i oznakowania.

A2D2 zawiera 40,000 12,499 ramek z segmentacją semantyczną i etykietami chmury punktów, w tym 3 12,499 ramek z etykietami obwiedni 3D. Ponieważ koncentrujemy się na wykrywaniu obiektów, interesuje nas 14 XNUMX klatek z etykietami obwiedni XNUMXD. Te adnotacje obejmują XNUMX klas związanych z prowadzeniem samochodu, takich jak samochód, pieszy, ciężarówka, autobus itp.

Poniższa tabela przedstawia pełną listę klas:

| wskaźnik | Lista klas |

| 1 | zwierzę |

| 2 | rower |

| 3 | autobus |

| 4 | wózek |

| 5 | transporter karawan |

| 6 | rowerzysta |

| 7 | pojazd ratunkowy |

| 8 | motocyklista |

| 9 | motocykl |

| 10 | pieszy |

| 11 | przyczepa |

| 12 | ciężarówka |

| 13 | pojazd użytkowy |

| 14 | samochód dostawczy/SUV |

Wyszkolimy nasz detektor, aby wykrywał samochody, ponieważ jest to najczęstsza klasa w naszym zbiorze danych (32616 z 42816 wszystkich obiektów w zbiorze danych jest oznaczonych jako samochody).

Omówienie rozwiązania

W tej serii omawiamy, jak wizualizować i oznaczać dane za pomocą Amazon SageMaker Ground Truth i demonstrujemy, jak używać tych danych w zadaniu szkoleniowym Amazon SageMaker do tworzenia modelu wykrywania obiektów, wdrożonego w punkcie końcowym Amazon SageMaker. W szczególności będziemy używać notebooka Amazon SageMaker do obsługi rozwiązania i uruchamiania wszelkich zadań związanych z etykietowaniem lub szkoleniami.

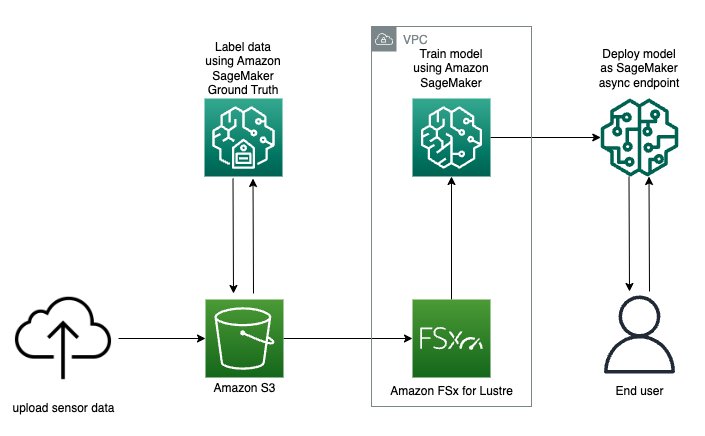

Poniższy diagram przedstawia ogólny przepływ danych z czujnika od etykietowania, przez szkolenie, aż po wdrożenie:

Dowiesz się, jak trenować i wdrażać model wykrywania obiektów 3D w czasie rzeczywistym za pomocą Amazon Sage Maker Ugruntuj prawdę, wykonując następujące kroki:

- Pobierz i wizualizuj zestaw danych chmury punktów

- Przygotuj dane do oznaczenia za pomocą Narzędzie chmury punktów Amazon SageMaker Ground Truth

- Uruchom rozproszoną pracę szkoleniową Amazon SageMaker Ground Truth z MMDetekcja3D

- Oceniaj wyniki pracy szkoleniowej i profiluj wykorzystanie zasobów Debuger Amazon SageMaker

- Wdróż asynchroniczny Punkt końcowy SageMaker

- Zadzwoń do punktu końcowego i wizualizuj prognozy obiektów 3D

Usługi AWS użyte do wdrożenia tego rozwiązania

Wymagania wstępne

Na poniższym diagramie pokazano, jak utworzyć prywatną siłę roboczą. Aby uzyskać pisemne instrukcje krok po kroku, zobacz Utwórz siłę roboczą Amazon Cognito za pomocą strony pracowników do etykietowania.

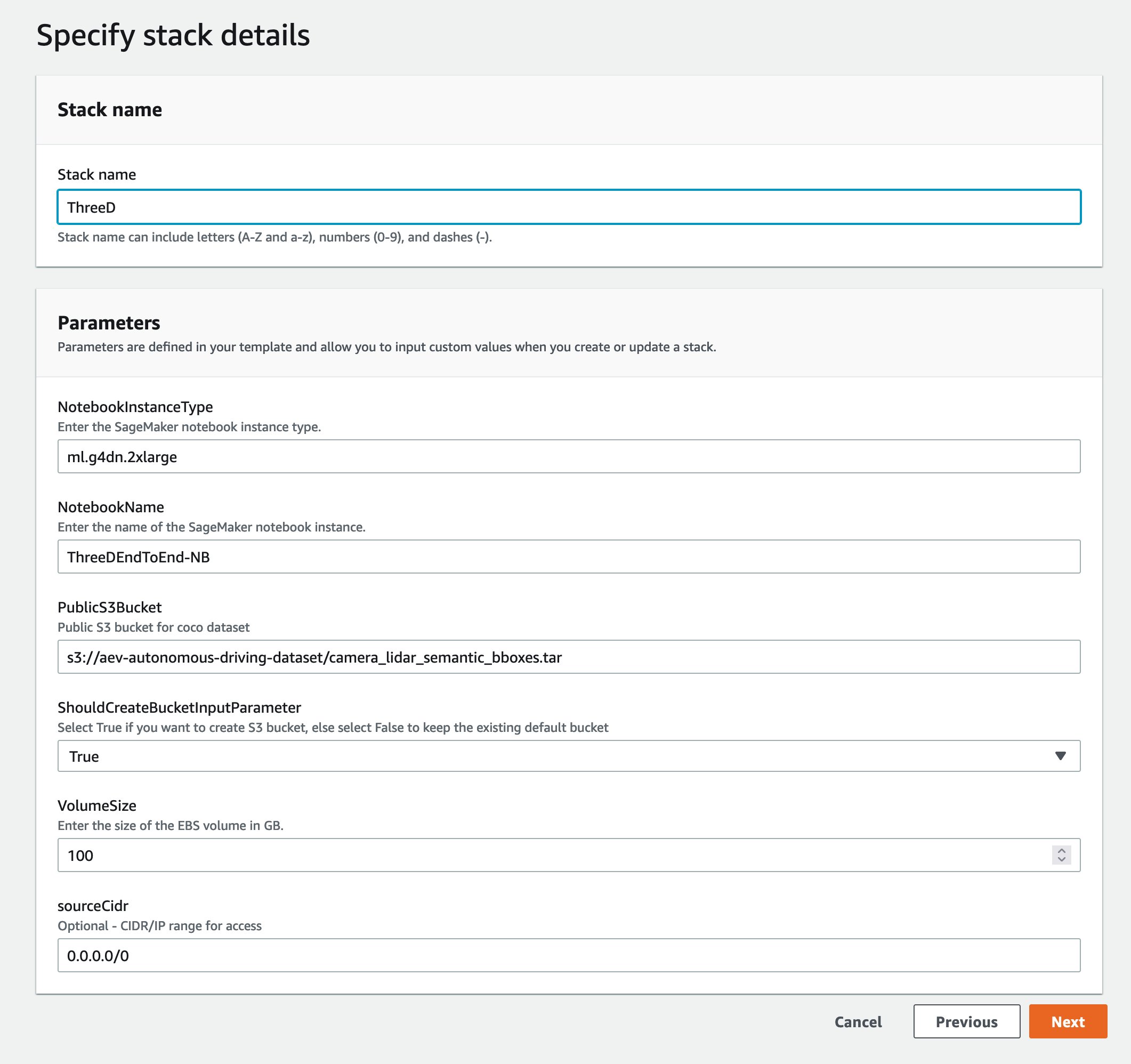

Uruchomienie stosu AWS CloudFormation

Teraz, gdy znasz już strukturę rozwiązania, możesz wdrożyć je na swoim koncie, aby móc uruchomić przykładowy przepływ pracy. Wszystkimi etapami wdrażania związanymi z potokiem etykietowania zarządza AWS CloudFormation. Oznacza to, że AWS Cloudformation tworzy Twoją instancję notebooka, a także wszelkie role lub zasobniki Amazon S3 do obsługi uruchamiania rozwiązania.

Możesz uruchomić stos w regionie AWS us-east-1 w konsoli AWS CloudFormation przy użyciu Uruchom stos

przycisk. Aby uruchomić stos w innym regionie, użyj instrukcji znajdujących się w README Repozytorium GitHub.

Utworzenie wszystkich zasobów zajmuje około 20 minut. Możesz monitorować postęp z interfejsu użytkownika (UI) AWS CloudFormation.

Po uruchomieniu szablonu CloudFormation wróć do konsoli AWS.

Otwieranie Notatnika

Instancje notebooka Amazon SageMaker to instancje obliczeniowe ML działające w aplikacji Jupyter Notebook. Amazon SageMaker zarządza tworzeniem instancji i powiązanych zasobów. Korzystaj z notatników Jupyter w swojej instancji notatnika, aby przygotowywać i przetwarzać dane, pisać kod do uczenia modeli, wdrażać modele w hostingu Amazon SageMaker oraz testować lub weryfikować swoje modele.

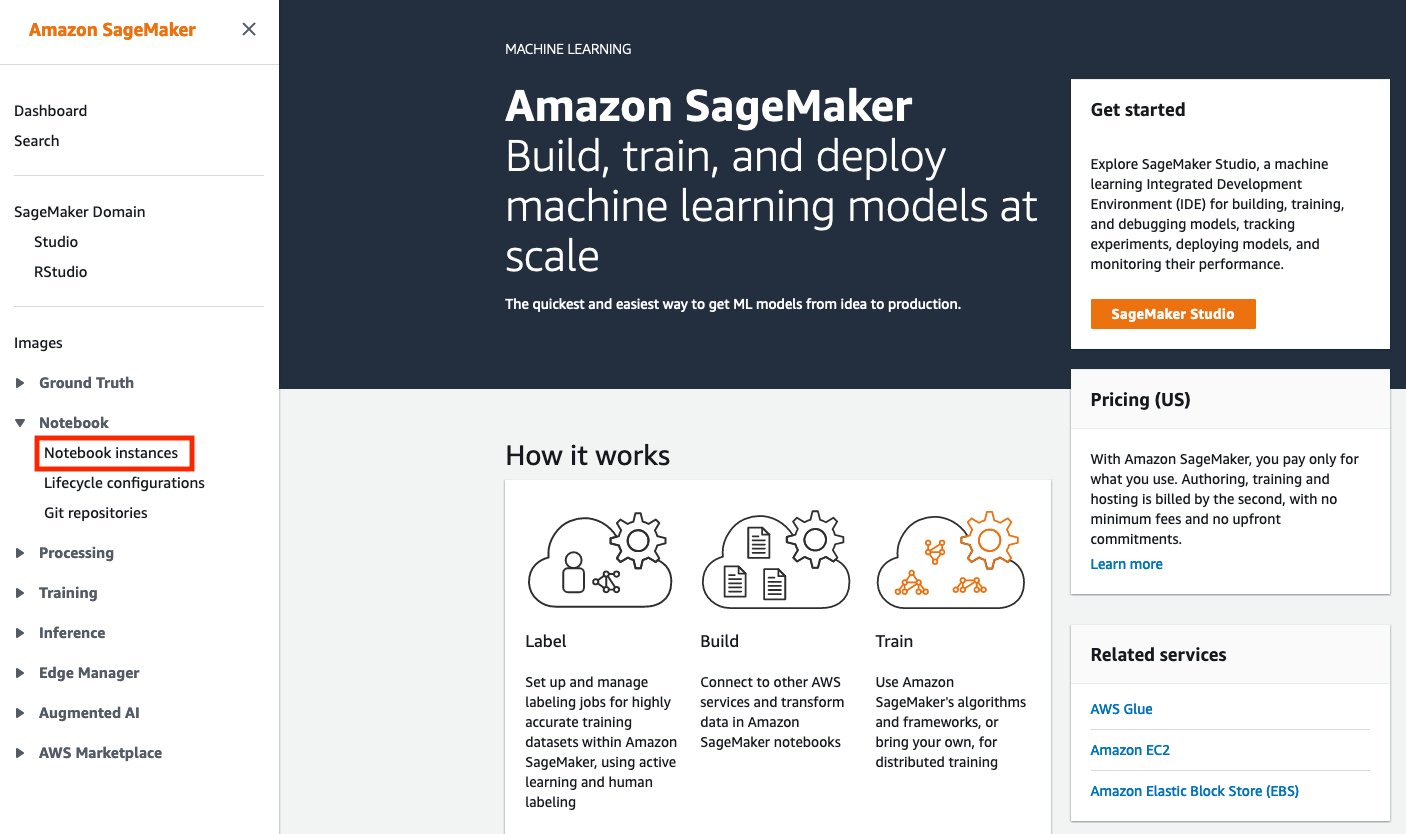

Wykonaj kolejne kroki, aby uzyskać dostęp do środowiska Amazon SageMaker Notebook:

- W obszarze usługi wyszukaj Amazon Sage Maker.

- Pod Notatnik, Wybierz Instancje notebooków.

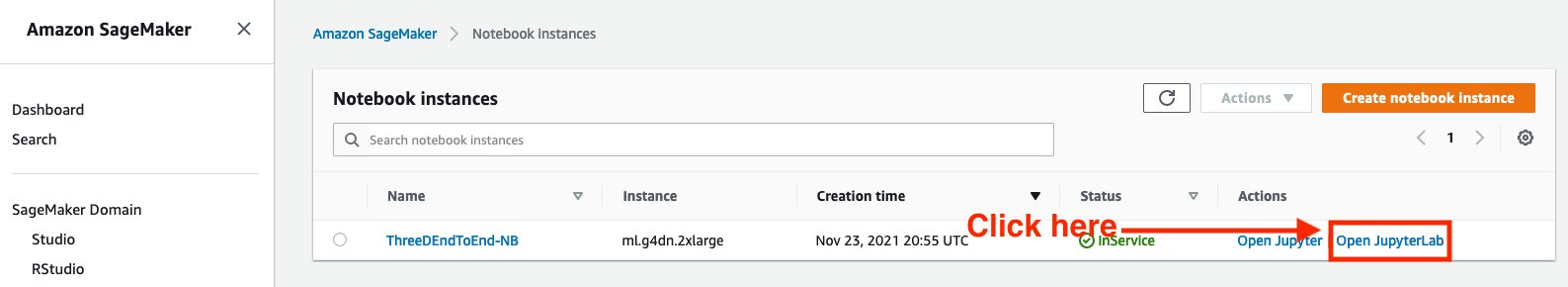

- Instancja notesu powinna zostać zainicjowana. Wybierz Otwórz laboratorium jupytera, która znajduje się po prawej stronie wstępnie przygotowanej instancji notesu w obszarze Akcje.

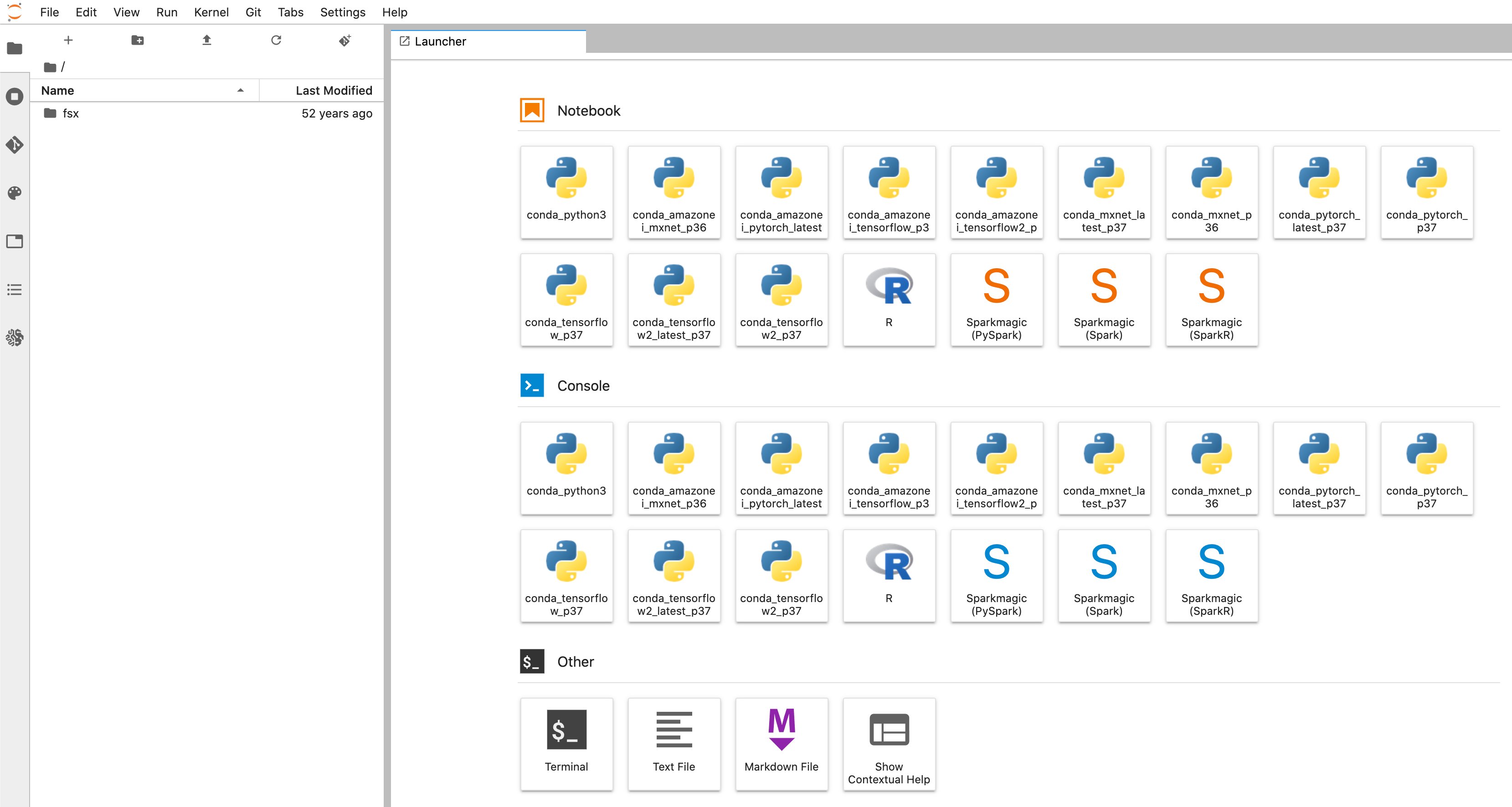

- Podczas ładowania strony zobaczysz taką ikonę:

- Nastąpi przekierowanie do nowej karty przeglądarki, która wygląda jak na poniższym diagramie:

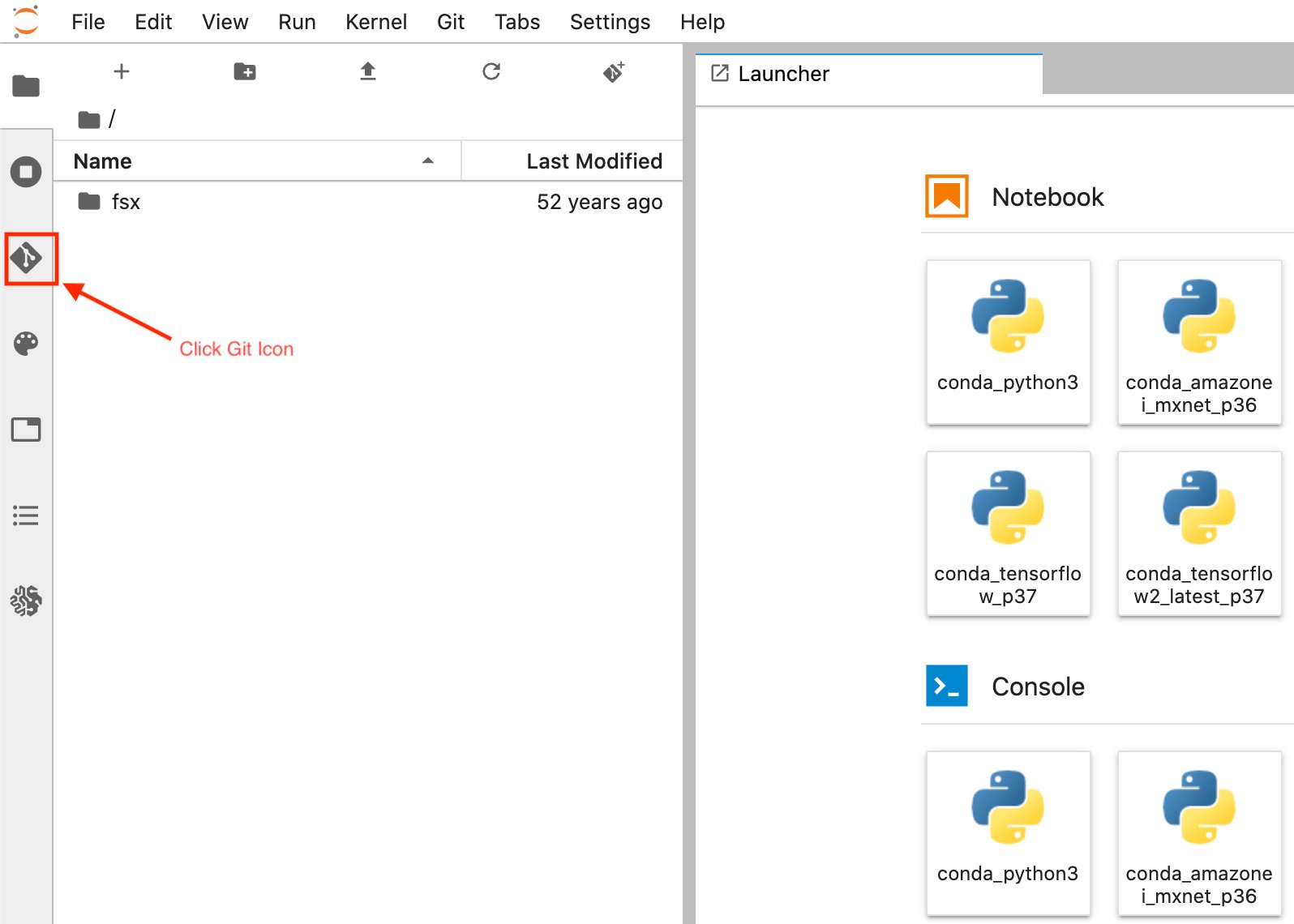

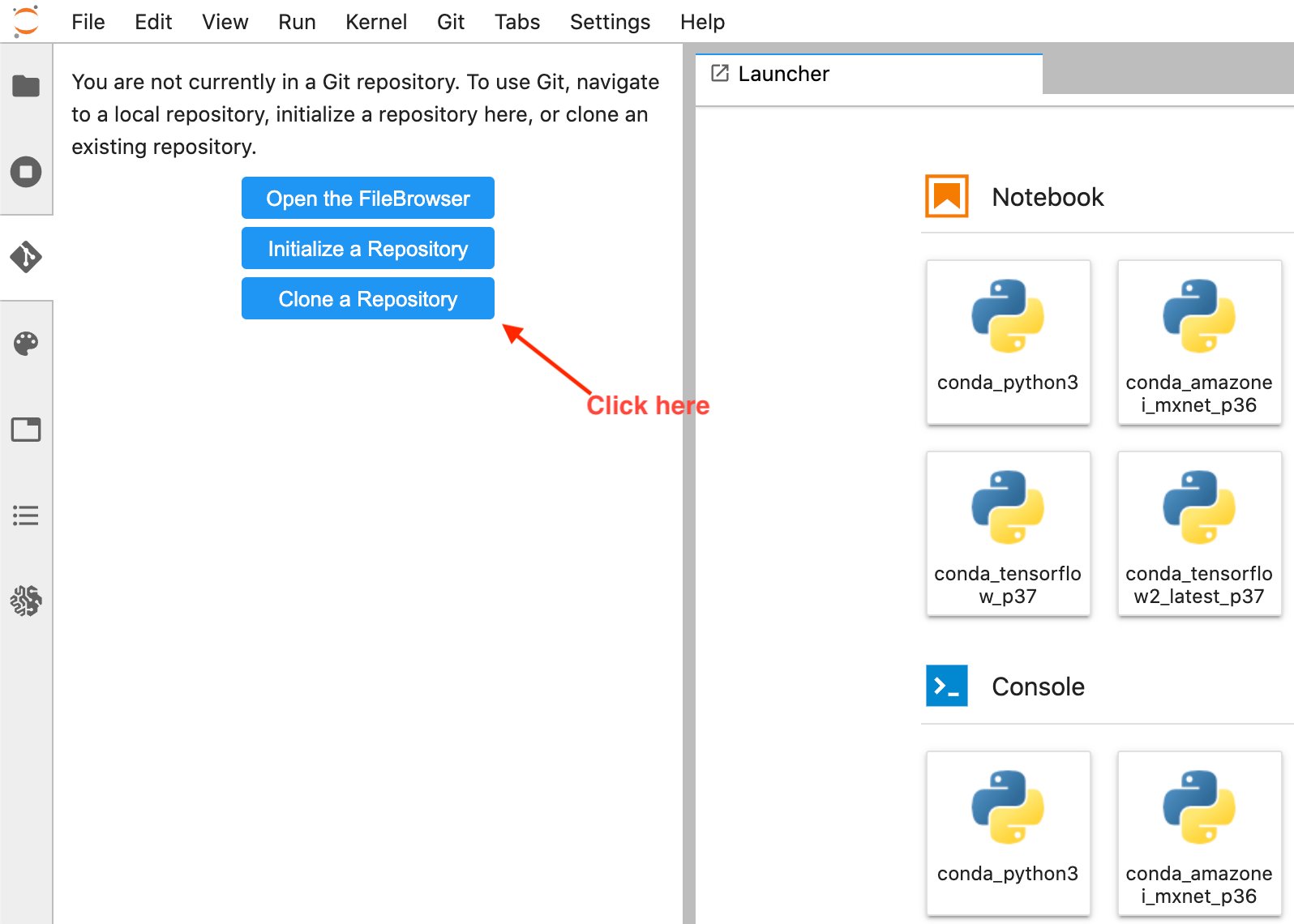

- Gdy znajdziesz się w interfejsie użytkownika Amazon SageMaker Notebook Instance Launcher. Z lewego paska bocznego wybierz git ikonę, jak pokazano na poniższym schemacie.

- Wybierz Sklonuj repozytorium opcja.

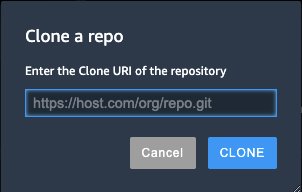

- Wprowadź adres URL GitHuba (https://github.com/aws-samples/end-2-end-3d-ml) w wyskakującym oknie i wybierz klonować.

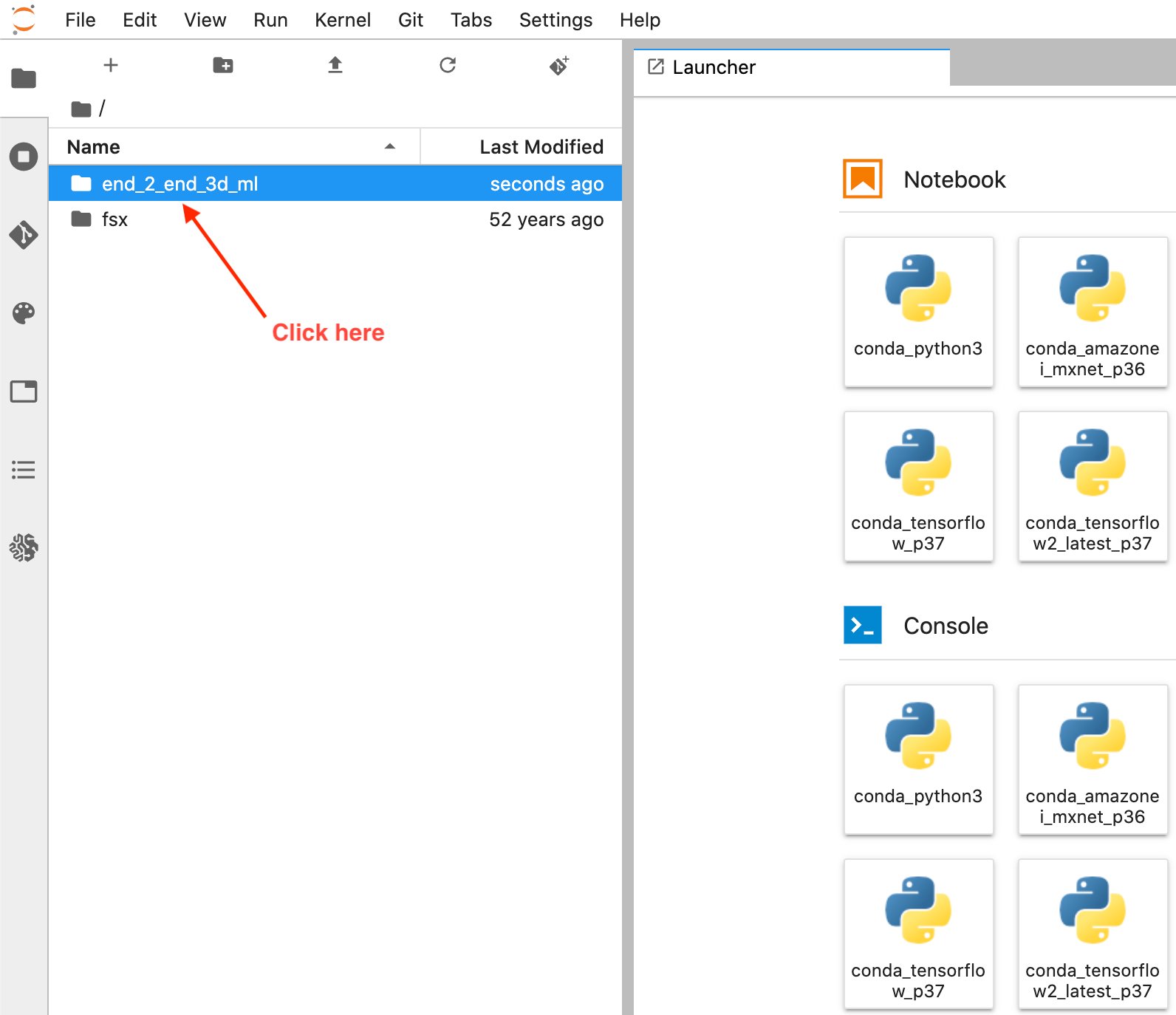

- Wybierz Przeglądarka plików aby zobaczyć folder GitHub.

- Otwórz notatnik pt

1_visualization.ipynb.

Obsługa notebooka

Przegląd

Kilka pierwszych komórek zeszytu w dziale pt Pobrane pliki przeprowadzi Cię przez proces pobierania zestawu danych i sprawdzania zawartych w nim plików. Po wykonaniu komórek ukończenie pobierania danych zajmuje kilka minut.

Po pobraniu możesz przejrzeć strukturę plików A2D2, która jest listą scen lub napędów. Scena to krótkie nagranie danych z czujników naszego pojazdu. A2D2 zapewnia nam 18 takich scen do trenowania, z których wszystkie są identyfikowane przez unikalne daty. Każda scena zawiera dane z kamery 2D, etykiety 2D, adnotacje prostopadłościanu 3D i chmury punktów 3D.

Strukturę plików zestawu danych A2D2 można wyświetlić w następujący sposób:

Konfiguracja czujnika A2D2

Następna sekcja przeprowadzi Cię przez odczyt niektórych danych z tej chmury punktów, aby upewnić się, że interpretujemy je poprawnie i możemy je zwizualizować w notatniku przed próbą przekonwertowania ich na format gotowy do etykietowania danych.

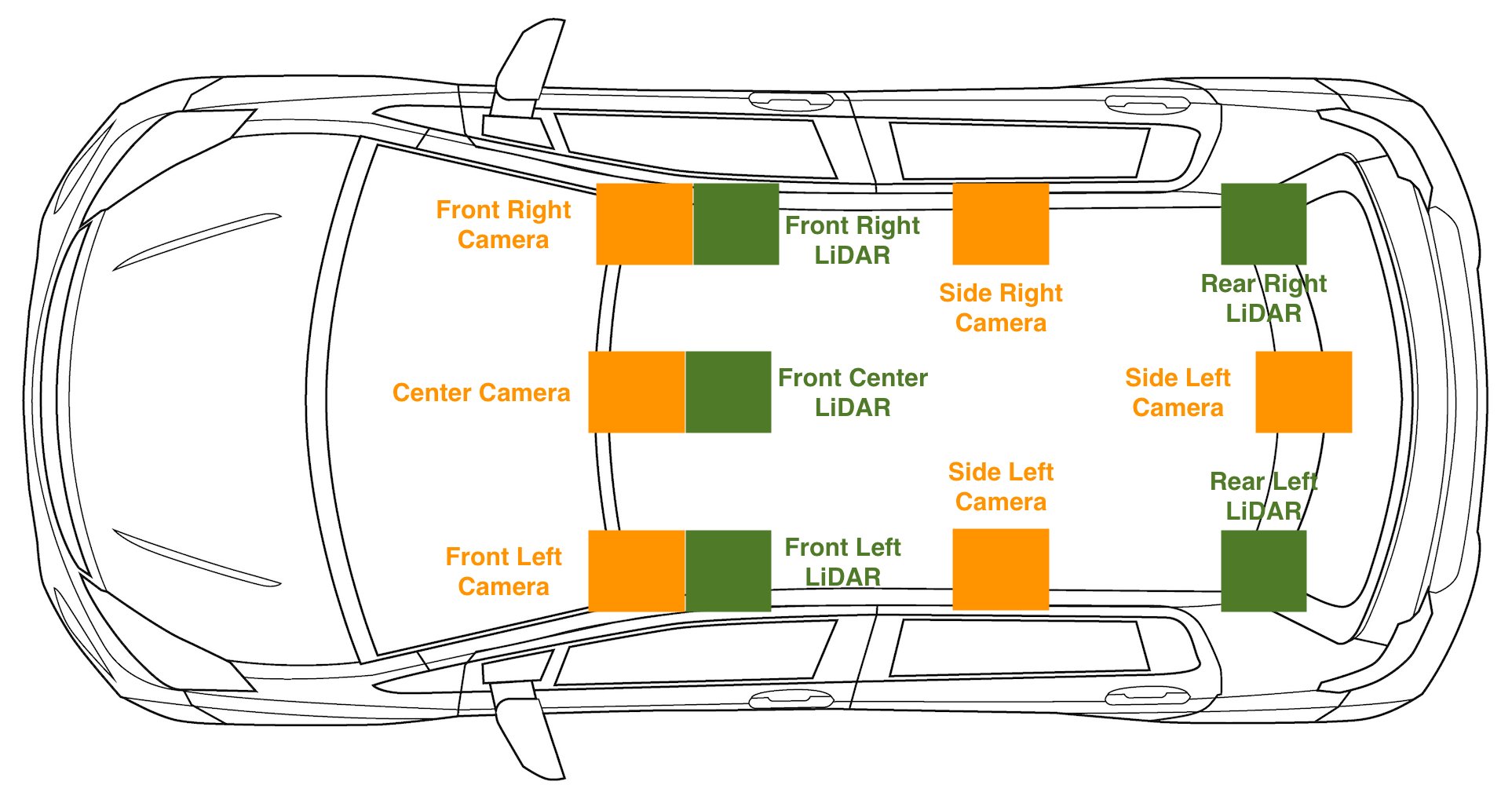

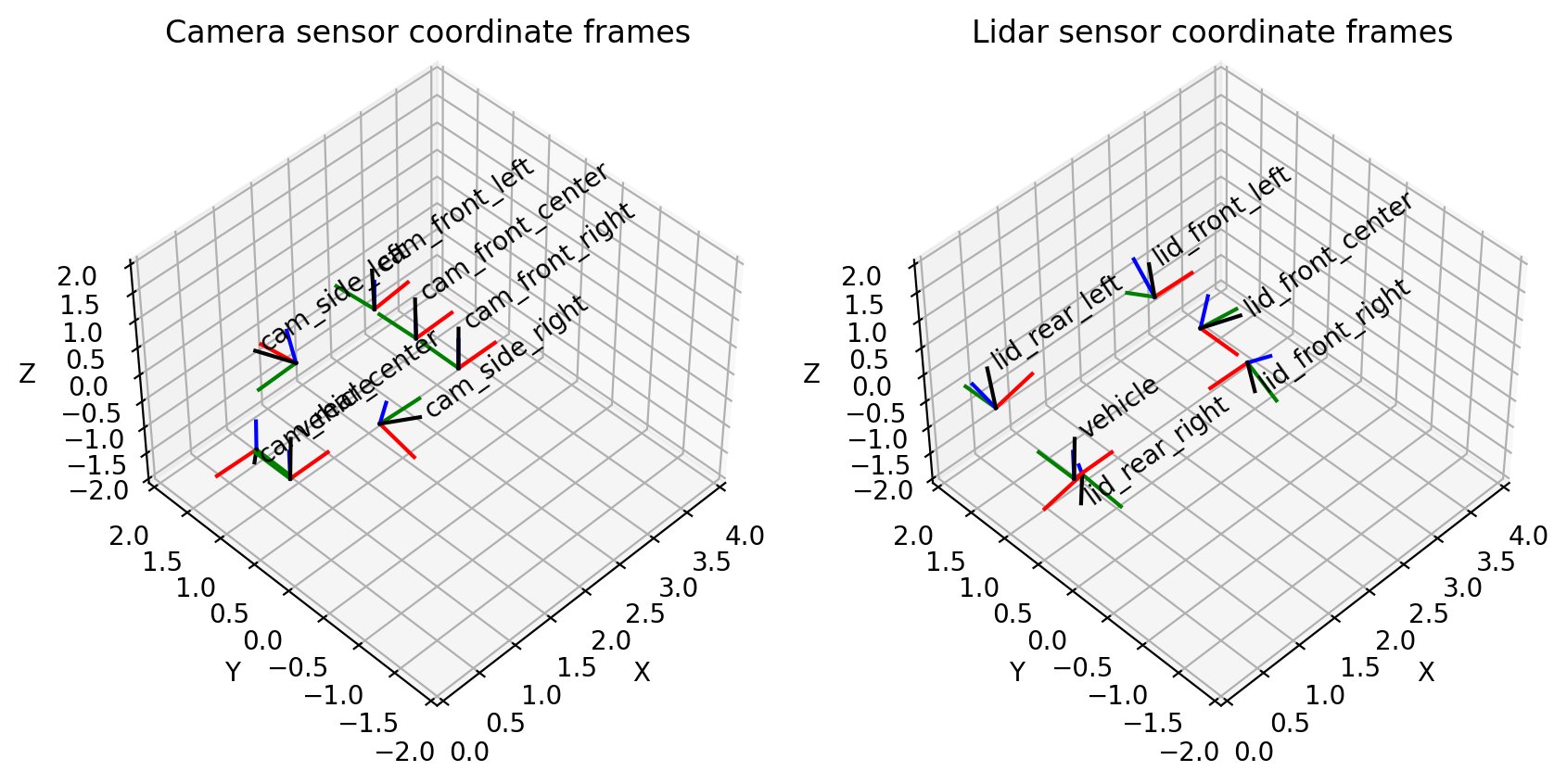

W przypadku każdego rodzaju konfiguracji autonomicznej jazdy, w której mamy dane z czujników 2D i 3D, niezbędne jest przechwytywanie danych kalibracyjnych czujników. Oprócz surowych danych pobraliśmy również cams_lidar.json. Ten plik zawiera translację i orientację każdego czujnika względem układu współrzędnych pojazdu, co można również nazwać pozycją czujnika lub położeniem w przestrzeni. Jest to ważne przy konwersji punktów z układu współrzędnych czujnika na układ współrzędnych pojazdu. Innymi słowy, jest to ważne dla wizualizacji czujników 2D i 3D podczas jazdy pojazdu. Układ współrzędnych pojazdu definiuje się jako statyczny punkt w środku pojazdu, przy czym oś x jest zgodna z kierunkiem ruchu pojazdu do przodu, oś y oznacza lewą i prawą stronę, przy czym lewa jest dodatnia, a oś z- oś skierowana przez dach pojazdu. Punkt (X,Y,Z) z (5,2,1) oznacza, że ten punkt znajduje się 5 metrów przed naszym pojazdem, 2 metry w lewo i 1 metr nad naszym pojazdem. Posiadanie tych kalibracji pozwala nam również rzutować punkty 3D na nasz obraz 2D, co jest szczególnie przydatne w zadaniach związanych z etykietowaniem chmury punktów.

Aby zobaczyć konfigurację czujnika w pojeździe, sprawdź poniższy schemat.

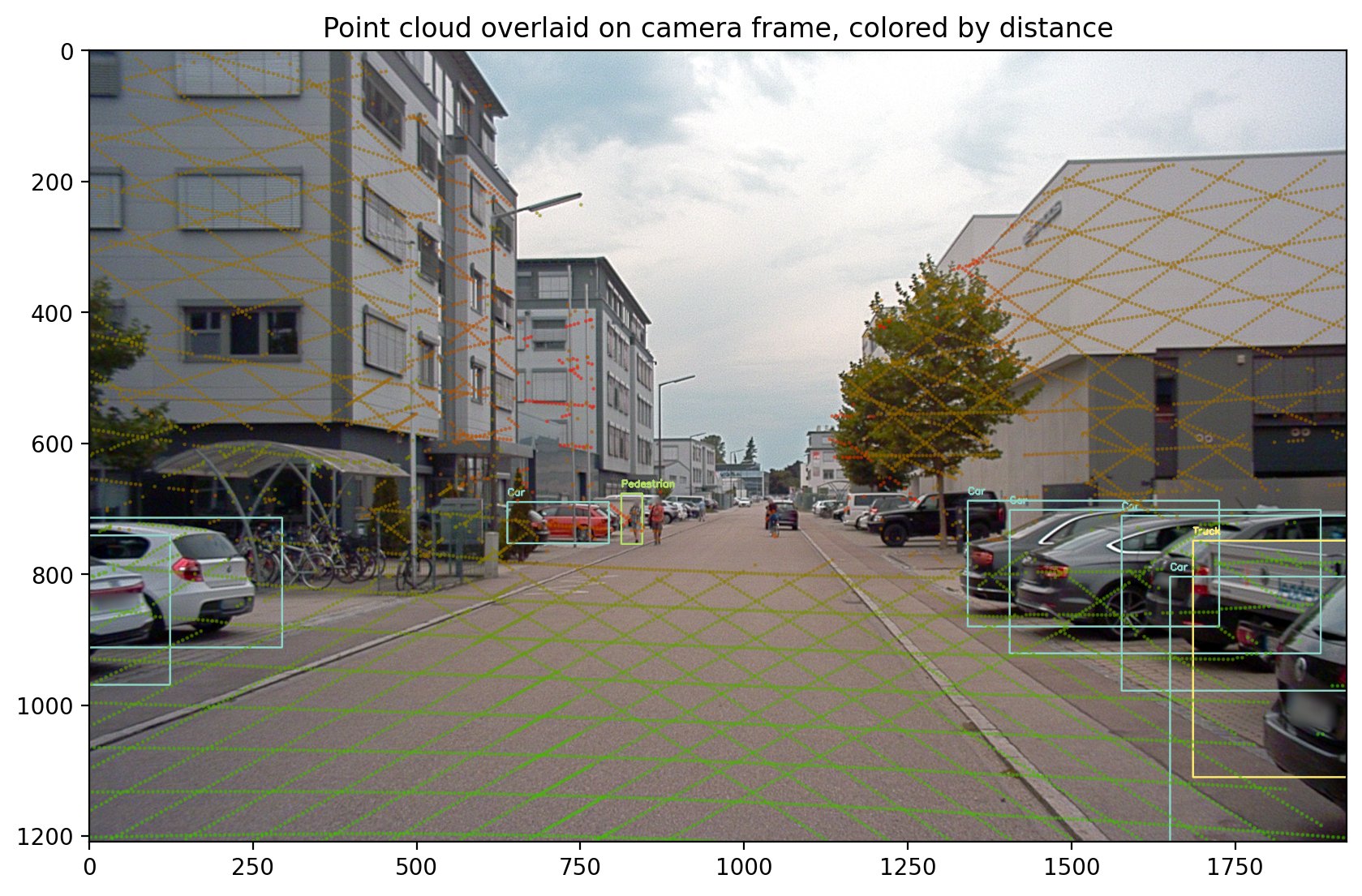

Dane chmury punktów, na których się uczymy, są specjalnie dopasowane do przedniego aparatu lub centralnej kamery:

To pasuje do naszej wizualizacji czujników kamery w 3D:

W tej części notatnika sprawdzamy, czy zestaw danych A2D2 odpowiada naszym oczekiwaniom dotyczącym pozycji czujników i czy jesteśmy w stanie dopasować dane z czujników chmury punktów do ramki kamery. Nie krępuj się przepuścić wszystkie komórki przez tę zatytułowaną Projekcja z 3D na 2D aby zobaczyć nakładkę danych chmury punktów na następujący obraz z kamery.

Konwersja do Amazon SageMaker Ground Truth

Po wizualizacji naszych danych w naszym notatniku możemy śmiało konwertować nasze chmury punktów na Amazon Format 3D SageMaker Ground Truth weryfikować i dostosowywać nasze etykiety. Ta sekcja przeprowadzi Cię przez konwersję z formatu danych A2D2 na Amazon Plik sekwencji SageMaker Ground Truth, z formatem wejściowym używanym przez tryb śledzenia obiektów.

Format pliku sekwencji obejmuje formaty chmur punktów, obrazy powiązane z każdą chmurą punktów oraz wszystkie dane dotyczące położenia i orientacji czujnika wymagane do wyrównania obrazów z chmurami punktów. Te konwersje są wykonywane przy użyciu informacji z czujnika odczytanych z poprzedniej sekcji. Poniższy przykład to format pliku sekwencji z Amazon SageMaker Ground Truth, który opisuje sekwencję z tylko jednym krokiem czasowym.

Chmura punktów dla tego kroku czasowego znajduje się pod adresem s3://sagemaker-us-east-1-322552456788/a2d2_smgt/20180807_145028_out/20180807145028_lidar_frontcenter_000000091.txt i ma format <x coordinate> <y coordinate> <z coordinate>.

Z chmurą punktów powiązany jest obraz z pojedynczej kamery znajdującej się pod adresem s3://sagemaker-us-east-1-322552456788/a2d2_smgt/20180807_145028_out/undistort_20180807145028_camera_frontcenter_000000091.png. Zauważ, że bierzemy plik sekwencji, który definiuje wszystkie parametry kamery, aby umożliwić projekcję z chmury punktów do kamery iz powrotem.

Konwersja do tego formatu wejściowego wymaga od nas napisania konwersji z formatu danych A2D2 na formaty danych obsługiwane przez Amazon SageMaker Ground Truth. Jest to ten sam proces, który musi przejść każdy, kto przynosi własne dane do etykietowania. Omówimy krok po kroku, jak działa ta konwersja. Jeśli postępujesz zgodnie z notatnikiem, spójrz na funkcję o nazwie a2d2_scene_to_smgt_sequence_and_seq_label.

Konwersja chmury punktów

Pierwszym krokiem jest konwersja danych ze skompresowanego pliku w formacie Numpy (NPZ), który został wygenerowany za pomocą narzędzia numpy.wiedzieć metoda, do zaakceptowany surowy format 3D dla Amazon SageMaker Ground Truth. W szczególności generujemy plik z jednym wierszem na punkt. Każdy punkt 3D jest zdefiniowany przez trzy zmiennoprzecinkowe współrzędne X, Y i Z. Kiedy określamy nasz format w pliku sekwencji, używamy łańcucha text/xyz reprezentować ten format. Amazon SageMaker Ground Truth obsługuje również dodawanie wartości intensywności lub punktów Red Green Blue (RGB).

Pliki NPZ A2D2 zawierają wiele tablic Numpy, z których każda ma własną nazwę. Aby przeprowadzić konwersję, ładujemy plik NPZ za pomocą Numpy załadować metoda, uzyskaj dostęp do tablicy o nazwie zwrotnica (tj. tablica Nx3, gdzie N to liczba punktów w chmurze punktów) i zapisz jako tekst do nowego pliku za pomocą Numpy zapiszxt Metoda.

Wstępne przetwarzanie obrazu

Następnie przygotowujemy nasze pliki graficzne. A2D2 zapewnia obrazy PNG, a Amazon SageMaker Ground Truth obsługuje obrazy PNG; jednak te obrazy są zniekształcone. Zniekształcenie często występuje, ponieważ soczewka wykonująca zdjęcie nie jest ustawiona równolegle do płaszczyzny obrazowania, przez co niektóre obszary obrazu wydają się bliższe niż oczekiwano. To zniekształcenie opisuje różnicę między fizycznym aparatem a aparatem wyidealizowany model kamery otworkowej. Jeśli zniekształcenia nie zostaną wzięte pod uwagę, Amazon SageMaker Ground Truth nie będzie w stanie renderować naszych punktów 3D na widokach z kamery, co utrudnia wykonywanie etykiet. Aby zapoznać się z samouczkiem dotyczącym kalibracji aparatu, zapoznaj się z tą dokumentacją z OpenCV.

Podczas gdy Amazon SageMaker Ground Truth obsługuje współczynniki zniekształceń w swoim pliku wejściowym, możesz również wykonać przetwarzanie wstępne przed zadaniem etykietowania. Ponieważ A2D2 zapewnia kod pomocniczy do usuwania zniekształceń, stosujemy go do obrazu i pozostawiamy pola związane z zniekształceniami z naszego pliku sekwencji. Należy zauważyć, że pola związane z zniekształceniami obejmują k1, k2, k3, k4, p1, p2 i pochylenie.

Pozycja kamery, orientacja i konwersja projekcji

Oprócz surowych plików danych wymaganych do etykietowania, plik sekwencji wymaga również informacji o pozycji i orientacji kamery, aby wykonać rzutowanie punktów 3D na widoki z kamery 2D. Musimy wiedzieć, gdzie kamera patrzy w przestrzeni 3D, aby dowiedzieć się, jak trójwymiarowe prostopadłościenne etykiety i punkty 3D powinny być renderowane na naszych obrazach.

Ponieważ załadowaliśmy nasze pozycje czujników do wspólnego menedżera transformacji w sekcji konfiguracji czujnika A2D2, możemy łatwo zapytać menedżera transformacji o potrzebne informacje. W naszym przypadku traktujemy położenie pojazdu jako (0, 0, 0) w każdej klatce, ponieważ nie mamy informacji o położeniu czujnika dostarczonych przez zestaw danych wykrywania obiektów A2D2. Tak więc w stosunku do naszego pojazdu orientacja i pozycja kamery jest opisana następującym kodem:

Teraz, gdy pozycja i orientacja zostały przekonwertowane, musimy również podać wartości fx, fy, cx i cy, czyli wszystkie parametry dla każdej kamery w formacie pliku sekwencyjnego.

Parametry te odnoszą się do wartości w matrycy kamery. Podczas gdy pozycja i orientacja opisują, w którą stronę skierowana jest kamera, matryca kamery opisuje pole widzenia kamery i dokładnie, w jaki sposób punkt 3D względem kamery jest konwertowany na położenie piksela 2D na obrazie.

A2D2 zapewnia matrycę kamery. W poniższym kodzie przedstawiono macierz kamery referencyjnej wraz ze sposobem, w jaki nasz notatnik indeksuje tę macierz, aby uzyskać odpowiednie pola.

Po przeanalizowaniu wszystkich pól z formatu A2D2 możemy zapisać plik sekwencji i użyć go w Amazon Plik manifestu wejściowego SageMaker Ground Truth aby rozpocząć zadanie etykietowania. To zadanie etykietowania pozwala nam tworzyć etykiety obwiedni 3D do wykorzystania w dalszej części szkolenia modeli 3D.

Uruchom wszystkie komórki do końca notatnika i upewnij się, że zastąpiłeś plik workteam ARN z Amazon SageMaker Ground Truth workteam ARN utworzyłeś warunek wstępny. Po około 10 minutach oznaczania czasu tworzenia zadania etykietą powinno być możliwe zalogowanie się do portalu pracowników i korzystanie z etykietowanie interfejsu użytkownika wizualizować swoją scenę.

Sprzątać

Usuń stos AWS CloudFormation wdrożony przy użyciu Uruchom stos przycisk o nazwie ThreeD w konsoli AWS CloudFormation, aby usunąć wszystkie zasoby użyte w tym poście, w tym wszelkie uruchomione instancje.

Szacowany koszt

Orientacyjny koszt to 5 dolarów za 2 godziny.

Wnioski

W tym poście pokazaliśmy, jak pobrać dane 3D i przekształcić je w formę gotową do etykietowania w Amazon SageMaker Ground Truth. Wykonując te czynności, możesz etykietować własne dane 3D na potrzeby uczenia modeli wykrywania obiektów. W następnym poście z tej serii pokażemy, jak wziąć A2D2 i wytrenować model detektora obiektów na etykietach znajdujących się już w zbiorze danych.

Szczęśliwego budowania!

O autorach

Izaak Privitera jest starszym analitykiem danych w firmie Laboratorium rozwiązań do uczenia maszynowego Amazon Amazon, gdzie opracowuje zindywidualizowane rozwiązania do uczenia maszynowego i uczenia głębokiego, aby rozwiązywać problemy biznesowe klientów. Pracuje głównie w przestrzeni wizji komputerowej, koncentrując się na umożliwieniu klientom AWS rozproszonych szkoleń i aktywnego uczenia się.

Izaak Privitera jest starszym analitykiem danych w firmie Laboratorium rozwiązań do uczenia maszynowego Amazon Amazon, gdzie opracowuje zindywidualizowane rozwiązania do uczenia maszynowego i uczenia głębokiego, aby rozwiązywać problemy biznesowe klientów. Pracuje głównie w przestrzeni wizji komputerowej, koncentrując się na umożliwieniu klientom AWS rozproszonych szkoleń i aktywnego uczenia się.

Widja Sagar Rawipati jest kierownikiem ds Laboratorium rozwiązań do uczenia maszynowego Amazon Amazon, gdzie wykorzystuje swoje bogate doświadczenie w wielkoskalowych systemach rozproszonych i swoją pasję do uczenia maszynowego, aby pomóc klientom AWS z różnych branż w przyspieszeniu wdrażania sztucznej inteligencji i chmury. Wcześniej był inżynierem uczenia maszynowego w Connectivity Services w Amazon, który pomagał budować platformy do personalizacji i konserwacji predykcyjnej.

Widja Sagar Rawipati jest kierownikiem ds Laboratorium rozwiązań do uczenia maszynowego Amazon Amazon, gdzie wykorzystuje swoje bogate doświadczenie w wielkoskalowych systemach rozproszonych i swoją pasję do uczenia maszynowego, aby pomóc klientom AWS z różnych branż w przyspieszeniu wdrażania sztucznej inteligencji i chmury. Wcześniej był inżynierem uczenia maszynowego w Connectivity Services w Amazon, który pomagał budować platformy do personalizacji i konserwacji predykcyjnej.

Jeremiego Feltracco jest inżynierem ds. rozwoju oprogramowania z th Laboratorium rozwiązań do uczenia maszynowego Amazon Amazon w Amazon Web Services. Wykorzystuje swoje doświadczenie w dziedzinie wizji komputerowej, robotyki i uczenia maszynowego, aby pomóc klientom AWS przyspieszyć wdrażanie sztucznej inteligencji.

Jeremiego Feltracco jest inżynierem ds. rozwoju oprogramowania z th Laboratorium rozwiązań do uczenia maszynowego Amazon Amazon w Amazon Web Services. Wykorzystuje swoje doświadczenie w dziedzinie wizji komputerowej, robotyki i uczenia maszynowego, aby pomóc klientom AWS przyspieszyć wdrażanie sztucznej inteligencji.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- Platoblockchain. Web3 Inteligencja Metaverse. Wzmocniona wiedza. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/using-amazon-sagemaker-with-point-clouds-part-1-ground-truth-for-3d-labeling/

- :Jest

- $W GÓRĘ

- 000

- 1

- 10

- 100

- 1996

- 2D

- 3d

- 7

- 9

- a

- Zdolny

- O nas

- powyżej

- przyśpieszyć

- dostęp

- dostępny

- Konto

- w poprzek

- aktywny

- dodatek

- adres

- Przyjęcie

- Po

- przed

- AI

- wyrównany

- Wszystkie kategorie

- pozwala

- już

- Amazonka

- Amazon Cognito

- Amazon Sage Maker

- Amazon SageMaker Ground Prawda

- Amazon Web Services

- i

- ktoś

- Aplikacja

- Aplikuj

- właściwy

- w przybliżeniu

- architektura

- SĄ

- obszary

- na około

- Szyk

- AS

- powiązany

- At

- zwiększona

- Augmented Reality

- autonomiczny

- dostępność

- AWS

- Tworzenie chmury AWS

- z powrotem

- tło

- BE

- bo

- stają się

- zanim

- jest

- poniżej

- pomiędzy

- Niebieski

- Pudełko

- Bringing

- przeglądarka

- budować

- Budowanie

- autobus

- biznes

- przycisk

- by

- nazywa

- aparat fotograficzny

- CAN

- zdobyć

- Przechwytywanie

- wózek

- samochody

- walizka

- Komórki

- Centrum

- wyzwanie

- ZOBACZ

- Dodaj

- klasa

- Klasy

- bliższy

- Chmura

- adopcja chmury

- kod

- wspólny

- Firmy

- kompletny

- obliczać

- komputer

- Wizja komputerowa

- ufnie

- Łączność

- Konsola

- zawierać

- zawiera

- Konwersja

- konwersje

- konwertować

- przeliczone

- koordynować

- Koszty:

- opłacalne

- pokrywa

- Stwórz

- stworzony

- tworzy

- tworzenie

- Klientów

- CX

- dane

- naukowiec danych

- zbiory danych

- Daty

- głęboko

- głęboka nauka

- zdefiniowane

- Definiuje

- wykazać

- wykazać

- demonstruje

- rozwijać

- wdrażane

- Wdrożenie

- głębokość

- opisać

- opisane

- Wykrywanie

- określaniu

- oprogramowania

- rozwija się

- urządzenia

- różnica

- różne

- trudny

- kierunek

- dyskutować

- dystrybuowane

- systemy rozproszone

- szkolenia rozproszone

- dokumentacja

- nie

- pobieranie

- jazdy

- e

- każdy

- z łatwością

- umożliwiając

- Punkt końcowy

- inżynier

- zapewnić

- Środowisko

- szczególnie

- niezbędny

- itp

- Parzyste

- dokładnie

- przykład

- oczekiwania

- spodziewany

- doświadczenie

- okładzina

- kilka

- pole

- Łąka

- Postać

- filet

- Akta

- koniec

- i terminów, a

- unoszący się

- pływ

- Skupiać

- skupienie

- następujący

- W razie zamówieenia projektu

- Nasz formularz

- format

- Naprzód

- znaleziono

- FRAME

- Darmowy

- od

- z przodu

- funkcjonować

- fuzja

- FX

- Generować

- wygenerowane

- otrzymać

- gif

- git

- GitHub

- Go

- Goes

- Zielony

- Ziemia

- Rozwój

- uchwyt

- Have

- mający

- Nagłówek

- pomoc

- pomógł

- pomocny

- Hosting

- GODZINY

- W jaki sposób

- How To

- Jednak

- HTML

- HTTPS

- i

- ICON

- zidentyfikowane

- obraz

- zdjęcia

- Obrazowanie

- wdrożenia

- ważny

- in

- W innych

- zawierać

- obejmuje

- Włącznie z

- wzrosła

- coraz bardziej

- indeksy

- przemysł

- Informacja

- wkład

- przykład

- instrukcje

- odsetki

- zainteresowany

- Interfejs

- IT

- JEGO

- Praca

- Oferty pracy

- jpg

- json

- Uprzejmy

- Wiedzieć

- Etykieta

- etykietowanie

- Etykiety

- na dużą skalę

- laser

- uruchomić

- UCZYĆ SIĘ

- nauka

- Pozostawiać

- wykorzystuje

- lekki

- lubić

- Lista

- załadować

- masa

- usytuowany

- lokalizacja

- Popatrz

- poszukuje

- WYGLĄD

- maszyna

- uczenie maszynowe

- konserwacja

- robić

- WYKONUJE

- zarządzane

- kierownik

- zarządza

- mapowanie

- Matrix

- znaczy

- zmierzenie

- metoda

- minut

- ML

- Aplikacje mobilne

- urządzenia mobilne

- model

- modele

- monitor

- jeszcze

- większość

- ruch

- wielokrotność

- Nazwa

- O imieniu

- Potrzebować

- Nowości

- Następny

- notatnik

- numer

- tępy

- przedmiot

- Wykrywanie obiektów

- obiekty

- of

- on

- ONE

- koncepcja

- OpenCV

- działać

- Option

- Inne

- wydajność

- ogólny

- własny

- strona

- Parallel

- parametry

- część

- szczególny

- pasja

- ścieżka

- wykonać

- personalizacja

- fizyczny

- rurociąg

- piksel

- Platformy

- plato

- Analiza danych Platona

- PlatoDane

- punkt

- zwrotnica

- Portal

- position

- Pozycje

- pozytywny

- Post

- przewidzieć

- Przygotować

- poprzedni

- poprzednio

- głównie

- prywatny

- problemy

- wygląda tak

- Produkcja

- Profilowanie

- Postęp

- projekt

- Projekcja

- pod warunkiem,

- zapewnia

- nośny

- Kurs

- Surowy

- Czytaj

- Czytający

- gotowy

- w czasie rzeczywistym

- Rzeczywistość

- nagranie

- Czerwony

- , o którym mowa

- odzwierciedlenie

- region

- związane z

- pozostały

- usunąć

- obsługi produkcji rolnej, która zastąpiła

- reprezentować

- wymagany

- Wymaga

- Zasób

- Zasoby

- Efekt

- powrót

- przeglądu

- RGB

- robotyka

- role

- dach

- RZĄD

- run

- bieganie

- s

- sagemaker

- taki sam

- Zapisz

- scena

- Sceny

- Naukowiec

- Szukaj

- druga

- Sekcja

- segmentacja

- senior

- czujniki

- Sekwencja

- Serie

- Usługi

- ustawienie

- Short

- powinien

- pokazać

- pokazane

- Targi

- bok

- Signal

- ponieważ

- pojedynczy

- So

- Tworzenie

- rozwoju oprogramowania

- rozwiązanie

- Rozwiązania

- kilka

- Źródło

- Typ przestrzeni

- obowiązuje

- swoiście

- stos

- standard

- początek

- Ewolucja krok po kroku

- Cel

- Struktura

- Dostawa

- wsparcie

- Utrzymany

- podpory

- Powierzchnia

- systemy

- stół

- Brać

- trwa

- kierowania

- zadania

- szablon

- test

- że

- Połączenia

- Informacje

- ich

- Te

- trzy

- Przez

- czas

- pod tytulem

- do

- narzędzie

- Top

- Kwota produktów:

- Śledzenie

- Pociąg

- Trening

- Przekształcać

- Tłumaczenie

- leczyć

- ciężarówka

- Tutorial

- typowy

- zazwyczaj

- ui

- dla

- zrozumieć

- zrozumienie

- wyjątkowy

- us

- posługiwać się

- Użytkownik

- Interfejs użytkownika

- UPRAWOMOCNIĆ

- Wartości

- Naprawiono

- pojazd

- Pojazdy

- zweryfikować

- pionowe

- Wideo

- Zobacz i wysłuchaj

- widoki

- wizja

- wyobrażanie sobie

- Droga..

- sieć

- usługi internetowe

- DOBRZE

- który

- Podczas

- KIM

- Wikipedia

- będzie

- w

- w ciągu

- słowa

- pracownik

- Siła robocza

- działa

- napisać

- pisać kod

- napisany

- X

- jamla

- You

- Twój

- zefirnet