Esta é uma postagem de convidado de Capital escalável, uma FinTech líder na Europa que oferece gestão de patrimônio digital e uma plataforma de corretagem com taxa fixa de negociação.

Como uma empresa em rápido crescimento, os objetivos da Scalable Capital não são apenas construir uma infraestrutura inovadora, robusta e confiável, mas também fornecer as melhores experiências aos nossos clientes, especialmente quando se trata de serviços ao cliente.

Scalable recebe centenas de consultas por e-mail de nossos clientes diariamente. Ao implementar um modelo moderno de processamento de linguagem natural (PNL), o processo de resposta foi moldado de forma muito mais eficiente e o tempo de espera dos clientes foi reduzido tremendamente. O modelo de aprendizado de máquina (ML) classifica as novas solicitações recebidas dos clientes assim que chegam e as redireciona para filas predefinidas, o que permite que nossos agentes dedicados de sucesso do cliente se concentrem no conteúdo dos e-mails de acordo com suas habilidades e forneçam respostas adequadas.

Nesta postagem, demonstramos os benefícios técnicos do uso de transformadores Hugging Face implantados com Amazon Sage Maker, como treinamento e experimentação em escala, e aumento da produtividade e eficiência de custos.

Declaração do problema

Scalable Capital é uma das FinTechs de crescimento mais rápido na Europa. Com o objetivo de democratizar o investimento, a empresa proporciona aos seus clientes fácil acesso aos mercados financeiros. Os clientes da Scalable podem participar ativamente do mercado por meio da plataforma de corretagem da empresa ou usar o Scalable Wealth Management para investir de forma inteligente e automatizada. Em 2021, a Scalable Capital experimentou um aumento de dez vezes em sua base de clientes, de dezenas de milhares para centenas de milhares.

Para fornecer aos nossos clientes uma experiência de usuário de primeira classe (e consistente) em todos os produtos e atendimento ao cliente, a empresa estava procurando soluções automatizadas para gerar eficiência para uma solução escalável, mantendo a excelência operacional. As equipes de ciência de dados e atendimento ao cliente da Scalable Capital identificaram que um dos maiores gargalos no atendimento aos nossos clientes era a resposta a consultas por e-mail. Especificamente, o gargalo era a etapa de classificação, na qual os funcionários tinham que ler e rotular os textos das solicitações diariamente. Após os e-mails serem encaminhados para suas devidas filas, os respectivos especialistas rapidamente se engajaram e resolveram os casos.

Para agilizar esse processo de classificação, a equipe de ciência de dados da Scalable construiu e implantou um modelo de PNL multitarefa usando arquitetura de transformador de última geração, com base no pré-treinado distilbert-base-alemão modelo publicado pela Hugging Face. distilbert-base-alemão utiliza o destilação de conhecimento método para pré-treinar um modelo de representação de linguagem de uso geral menor do que o modelo base BERT original. A versão destilada atinge desempenho comparável à versão original, sendo menor e mais rápida. Para facilitar nosso processo de ciclo de vida de ML, decidimos adotar o SageMaker para construir, implantar, servir e monitorar nossos modelos. Na seção seguinte, apresentamos nosso design de arquitetura de projeto.

Visão geral da solução

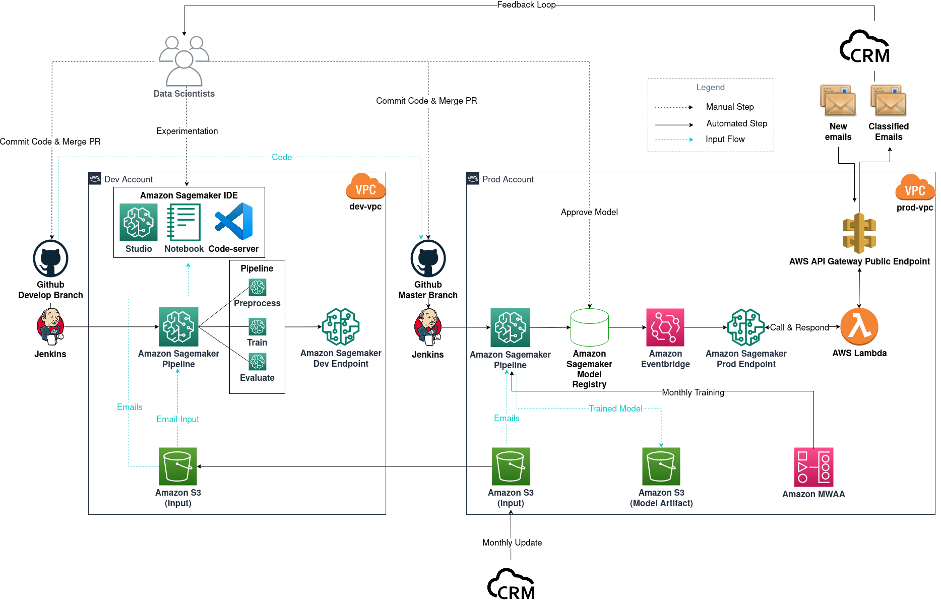

A infraestrutura de ML da Scalable Capital consiste em duas contas AWS: uma como ambiente para a fase de desenvolvimento e outra para a fase de produção.

O diagrama a seguir mostra o fluxo de trabalho do nosso projeto de classificador de e-mail, mas também pode ser generalizado para outros projetos de ciência de dados.

Diagrama do projeto de classificação de e-mail

O fluxo de trabalho consiste nos seguintes componentes:

- Experimentação de modelo – Cientistas de dados usam Estúdio Amazon SageMaker realizar as primeiras etapas do ciclo de vida da ciência de dados: análise exploratória de dados (EDA), limpeza e preparação de dados e construção de modelos de protótipos. Quando a fase exploratória for concluída, recorremos ao VSCode hospedado por um notebook SageMaker como nossa ferramenta de desenvolvimento remoto para modularizar e produzir nossa base de código. Para explorar diferentes tipos de modelos e configurações de modelos e, ao mesmo tempo, acompanhar nossas experimentações, usamos o SageMaker Training e o SageMaker Experiments.

- Construção de modelo – Depois de decidirmos sobre um modelo para nosso caso de uso de produção, neste caso um modelo multitarefa distilbert-base-alemão modelo, ajustado a partir do modelo pré-treinado do Hugging Face, comprometemos e enviamos nosso código para o branch de desenvolvimento do Github. O evento de mesclagem do Github aciona nosso pipeline Jenkins CI, que por sua vez inicia um trabalho do SageMaker Pipelines com dados de teste. Isso funciona como um teste para garantir que os códigos estejam funcionando conforme o esperado. Um endpoint de teste é implantado para fins de teste.

- Implantação de modelo – Depois de se certificar de que tudo está funcionando conforme o esperado, os cientistas de dados mesclam o branch de desenvolvimento com o branch primário. Este evento de mesclagem agora aciona um trabalho do SageMaker Pipelines usando dados de produção para fins de treinamento. Depois, os artefatos do modelo são produzidos e armazenados em uma saída Serviço de armazenamento simples da Amazon (Amazon S3) e uma nova versão do modelo é registrada no registro do modelo SageMaker. Os cientistas de dados examinam o desempenho do novo modelo e aprovam se ele está alinhado com as expectativas. O evento de aprovação do modelo é capturado por Amazon Event Bridge, que então implanta o modelo em um endpoint do SageMaker no ambiente de produção.

- MLOps – Como o endpoint do SageMaker é privado e não pode ser acessado por serviços fora da VPC, um AWS Lambda função e Gateway de API da Amazon endpoint público são necessários para se comunicar com o CRM. Sempre que novos e-mails chegam na caixa de entrada do CRM, o CRM invoca o endpoint público do API Gateway, que por sua vez aciona a função Lambda para invocar o endpoint privado do SageMaker. A função então retransmite a classificação de volta ao CRM por meio do endpoint público do API Gateway. Para monitorar o desempenho do nosso modelo implantado, implementamos um ciclo de feedback entre o CRM e os cientistas de dados para acompanhar as métricas de previsão do modelo. Mensalmente, o CRM atualiza os dados históricos utilizados para experimentação e treinamento de modelos. Nós usamos Fluxos de trabalho gerenciados da Amazon para Apache Airflow (Amazon MWAA) como agendador de nosso retreinamento mensal.

Nas seções a seguir, detalhamos as etapas de preparação de dados, experimentação de modelo e implantação de modelo com mais detalhes.

Preparação de dados

Scalable Capital usa uma ferramenta de CRM para gerenciar e armazenar dados de e-mail. O conteúdo relevante do e-mail consiste em assunto, corpo e bancos custodiantes. Existem três rótulos a serem atribuídos a cada e-mail: de qual linha de negócios o e-mail pertence, qual fila é apropriada e o tópico específico do e-mail.

Antes de começarmos a treinar qualquer modelo de PNL, garantimos que os dados de entrada estejam limpos e os rótulos sejam atribuídos de acordo com as expectativas.

Para recuperar conteúdos de consultas limpas de clientes escaláveis, removemos dos dados brutos de e-mail e textos e símbolos extras, como assinaturas de e-mail, impressões, citações de mensagens anteriores em cadeias de e-mail, símbolos CSS e assim por diante. Caso contrário, nossos futuros modelos treinados poderão apresentar desempenho degradado.

Os rótulos dos e-mails evoluem com o tempo, à medida que as equipes escalonáveis de atendimento ao cliente adicionam novos e refinam ou removem os existentes para acomodar as necessidades de negócios. Para garantir que os rótulos dos dados de treinamento, bem como as classificações esperadas para previsão, estejam atualizados, a equipe de ciência de dados trabalha em estreita colaboração com a equipe de atendimento ao cliente para garantir a exatidão dos rótulos.

Experimentação de modelo

Começamos nosso experimento com o pré-treinado prontamente disponível distilbert-base-alemão modelo publicado pela Hugging Face. Como o modelo pré-treinado é um modelo de representação de linguagem de uso geral, podemos adaptar a arquitetura para executar tarefas específicas de downstream – como classificação e resposta a perguntas – anexando cabeças apropriadas à rede neural. Em nosso caso de uso, a tarefa downstream na qual estamos interessados é a classificação de sequência. Sem modificar o arquitetura existente, decidimos ajustar três modelos pré-treinados separados para cada uma das categorias exigidas. Com o SageMaker Abraçando Rosto Recipientes de Aprendizado Profundo (DLCs), iniciar e gerenciar experimentos de PNL são simplificados com os contêineres Hugging Face e a API SageMaker Experiments.

A seguir está um trecho de código de train.py:

O código a seguir é o estimador Hugging Face:

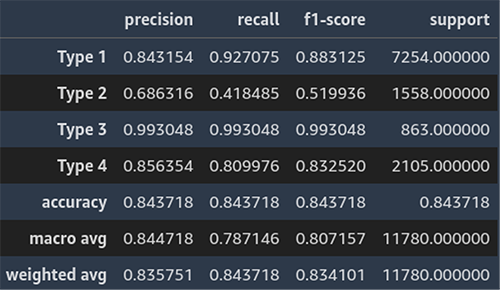

Para validar os modelos ajustados, usamos o Pontuação F1 devido à natureza desequilibrada do nosso conjunto de dados de e-mail, mas também para calcular outras métricas, como exatidão, precisão e recall. Para que a API SageMaker Experiments registre as métricas do trabalho de treinamento, precisamos primeiro registrar as métricas no console local do trabalho de treinamento, que são coletadas por Amazon CloudWatch. Em seguida, definimos o formato regex correto para capturar os logs do CloudWatch. As definições de métricas incluem o nome das métricas e a validação de regex para extrair as métricas do trabalho de treinamento:

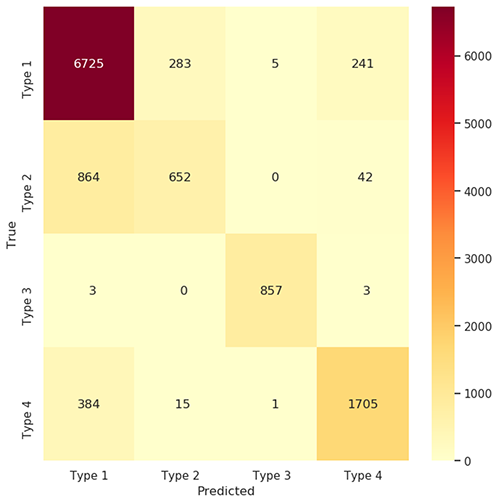

Como parte da iteração de treinamento do modelo classificador, usamos uma matriz de confusão e um relatório de classificação para avaliar o resultado. A figura a seguir mostra a matriz de confusão para previsão de linha de negócios.

Matriz de Confusão

A captura de tela a seguir mostra um exemplo de relatório de classificação para previsão de linha de negócios.

Relatório de Classificação

Como próxima iteração do nosso experimento, aproveitaremos aprendizagem multitarefa para melhorar nosso modelo. A aprendizagem multitarefa é uma forma de treinamento em que um modelo aprende a resolver múltiplas tarefas simultaneamente, porque as informações compartilhadas entre as tarefas podem melhorar a eficiência do aprendizado. Ao anexar mais duas cabeças de classificação à arquitetura original do distilbert, podemos realizar o ajuste fino multitarefa, que atinge métricas razoáveis para nossa equipe de atendimento ao cliente.

Implantação de modelo

Em nosso caso de uso, o classificador de email deve ser implantado em um endpoint, para o qual nosso pipeline de CRM pode enviar um lote de emails não classificados e receber previsões. Como temos outras lógicas – como limpeza de dados de entrada e previsões multitarefas – além da inferência do modelo Hugging Face, precisamos escrever um script de inferência personalizado que siga o Padrão SageMaker.

A seguir está um trecho de código de inference.py:

Quando tudo estiver instalado e pronto, usamos SageMaker Pipelines para gerenciar nosso pipeline de treinamento e anexá-lo à nossa infraestrutura para concluir nossa configuração de MLOps.

Para monitorar o desempenho do modelo implantado, construímos um ciclo de feedback para permitir que o CRM nos forneça o status dos e-mails classificados quando os casos são encerrados. Com base nessas informações, fazemos ajustes para melhorar o modelo implantado.

Conclusão

Nesta postagem, compartilhamos como o SageMaker facilita a equipe de ciência de dados da Scalable a gerenciar com eficiência o ciclo de vida de um projeto de ciência de dados, ou seja, o projeto de classificador de e-mail. O ciclo de vida começa com a fase inicial de análise e exploração de dados com SageMaker Studio; passa para a experimentação e implantação de modelos com treinamento, inferência e DLCs Hugging Face do SageMaker; e completa com um pipeline de treinamento com SageMaker Pipelines integrado a outros serviços da AWS. Graças a esta infraestrutura, somos capazes de iterar e implantar novos modelos com mais eficiência e, portanto, melhorar os processos existentes no Scalable, bem como as experiências dos nossos clientes.

Para saber mais sobre Hugging Face e SageMaker, consulte os seguintes recursos:

Sobre os autores

Dra.Sandra Schmid é chefe de análise de dados na Scalable GmbH. Ela é responsável por abordagens baseadas em dados e casos de uso na empresa junto com suas equipes. Seu foco principal é encontrar a melhor combinação de modelos de aprendizado de máquina e ciência de dados e metas de negócios, a fim de obter o máximo possível de valor comercial e eficiência a partir dos dados.

Dra.Sandra Schmid é chefe de análise de dados na Scalable GmbH. Ela é responsável por abordagens baseadas em dados e casos de uso na empresa junto com suas equipes. Seu foco principal é encontrar a melhor combinação de modelos de aprendizado de máquina e ciência de dados e metas de negócios, a fim de obter o máximo possível de valor comercial e eficiência a partir dos dados.

Huy Dang Cientista de dados na Scalable GmbH. Suas responsabilidades incluem análise de dados, construção e implantação de modelos de aprendizado de máquina, bem como desenvolvimento e manutenção de infraestrutura para a equipe de ciência de dados. Em seu tempo livre, ele gosta de ler, fazer caminhadas, escalar rochas e manter-se atualizado com os mais recentes desenvolvimentos em aprendizado de máquina.

Huy Dang Cientista de dados na Scalable GmbH. Suas responsabilidades incluem análise de dados, construção e implantação de modelos de aprendizado de máquina, bem como desenvolvimento e manutenção de infraestrutura para a equipe de ciência de dados. Em seu tempo livre, ele gosta de ler, fazer caminhadas, escalar rochas e manter-se atualizado com os mais recentes desenvolvimentos em aprendizado de máquina.

Mia Chang é arquiteto de soluções especialista em ML da Amazon Web Services. Ela trabalha com clientes na EMEA e compartilha práticas recomendadas para executar cargas de trabalho de IA/ML na nuvem com sua experiência em matemática aplicada, ciência da computação e IA/ML. Ela se concentra em cargas de trabalho específicas de PNL e compartilha sua experiência como palestrante em conferências e autora de livros. Em seu tempo livre, ela gosta de ioga, jogos de tabuleiro e preparar café.

Mia Chang é arquiteto de soluções especialista em ML da Amazon Web Services. Ela trabalha com clientes na EMEA e compartilha práticas recomendadas para executar cargas de trabalho de IA/ML na nuvem com sua experiência em matemática aplicada, ciência da computação e IA/ML. Ela se concentra em cargas de trabalho específicas de PNL e compartilha sua experiência como palestrante em conferências e autora de livros. Em seu tempo livre, ela gosta de ioga, jogos de tabuleiro e preparar café.

Moritz Guertler é executivo de contas no segmento de negócios nativos digitais da AWS. Ele se concentra nos clientes do espaço FinTech e os apoia na aceleração da inovação por meio de infraestrutura em nuvem segura e escalável.

Moritz Guertler é executivo de contas no segmento de negócios nativos digitais da AWS. Ele se concentra nos clientes do espaço FinTech e os apoia na aceleração da inovação por meio de infraestrutura em nuvem segura e escalável.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Automotivo / EVs, Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- ChartPrime. Eleve seu jogo de negociação com ChartPrime. Acesse aqui.

- BlockOffsets. Modernizando a Propriedade de Compensação Ambiental. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/accelerate-client-success-management-through-email-classification-with-hugging-face-on-amazon-sagemaker/

- :tem

- :é

- :não

- :onde

- $UP

- 1

- 100

- 13

- 15%

- 17

- 2021

- 26%

- 32

- 500

- 7

- a

- Capaz

- Sobre

- acima

- acelerar

- acelerando

- ACEITAR

- Acesso

- acomodar

- Segundo

- Conta

- Contas

- precisão

- Alcança

- em

- ativamente

- atos

- adaptar

- adicionar

- Adição

- ajustes

- adotar

- Vantagem

- Depois de

- depois

- agentes

- AI / ML

- visar

- permite

- tb

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- entre

- an

- análise

- analítica

- e

- qualquer

- apache

- api

- aplicado

- se aproxima

- apropriado

- aprovação

- aprovar

- arquitetura

- SOMOS

- argumentos

- AS

- atribuído

- At

- anexar

- autor

- Automatizado

- disponível

- AWS

- em caminho duplo

- fundo

- bancos

- base

- baseado

- base

- BE

- Porque

- sido

- ser

- Benefícios

- MELHOR

- melhores práticas

- entre

- borda

- Board Games

- corpo

- livro

- Ramo

- Break

- corretagem

- construir

- Prédio

- construído

- negócio

- negócios

- mas a

- by

- CAN

- capital

- Capital

- capturar

- capturados

- transportar

- casas

- casos

- Categorias

- correntes

- classificação

- classificado

- Limpeza

- cliente

- clientes

- Escalada

- Fechar

- fechado

- Na nuvem

- infraestrutura de nuvem

- código

- base de código

- códigos

- Café

- colaboração

- combinação

- vem

- commit

- comunicar

- Empresa

- Empresa

- comparável

- completar

- Completa

- componentes

- Computar

- computador

- Ciência da Computação

- Conferência

- confusão

- consistente

- consiste

- cônsul

- Containers

- conteúdo

- conteúdo

- correta

- CRM

- APF

- custodiante

- personalizadas

- cliente

- Clientes

- diariamente

- dados,

- análise de dados

- Análise de Dados

- Preparação de dados

- ciência de dados

- cientista de dados

- orientado por dados

- Data

- decidir

- decidido

- dedicado

- profundo

- deep learning

- Padrão

- definir

- definido

- definições

- democratizar

- demonstrar

- implantar

- implantado

- Implantação

- desenvolvimento

- implanta

- Design

- detalhe

- desenvolver

- em desenvolvimento

- Desenvolvimento

- desenvolvimentos

- diferente

- digital

- gestão de patrimônio digital

- down

- dois

- cada

- fácil

- eficiências

- eficientemente

- outro

- e-mails

- EMEA

- colaboradores

- permitir

- Ponto final

- contratado

- garantir

- Meio Ambiente

- época

- especialmente

- Europa

- avaliar

- avaliação

- Evento

- tudo

- evolui

- examinar

- exemplo

- Excelência

- executivo

- existente

- expectativa

- expectativas

- esperado

- vasta experiência

- experiente

- Experiências

- experimentar

- experimentos

- exploração

- Análise exploratória de dados

- explorar

- extra

- f1

- Rosto

- facilitar

- facilita

- Moda

- mais rápido

- mais rápido

- crescimento mais rápido

- retornos

- Figura

- financeiro

- descoberta

- FinTech

- fintechs

- Primeiro nome

- primeiros passos

- plano

- Foco

- concentra-se

- seguinte

- Escolha

- formulário

- formato

- Gratuito

- da

- função

- futuro

- Ganho

- Games

- porta de entrada

- propósito geral

- gerar

- ter

- GitHub

- GmBH

- Objetivos

- Crescente

- Locatário

- Visitante Mensagem

- tinha

- Ter

- he

- cabeça

- cabeças

- sua experiência

- sua

- histórico

- hospedado

- Como funciona o dobrador de carta de canal

- HTML

- http

- HTTPS

- Centenas

- identificado

- if

- executar

- implementação

- melhorar

- in

- incluir

- Entrada

- Crescimento

- aumentou

- INFORMAÇÕES

- Infraestrutura

- do estado inicial,

- Inovação

- inovadores

- entrada

- Inquéritos

- inquérito

- integrado

- Inteligente

- interessado

- para dentro

- introduzir

- Investir

- investimento

- invoca

- IT

- iteração

- ESTÁ

- Trabalho

- json

- Guarda

- Chave

- O rótulo

- Rótulos

- língua

- maior

- mais recente

- principal

- APRENDER

- aprendizagem

- wifecycwe

- Line

- carregar

- local

- log

- registrado

- procurando

- fora

- máquina

- aprendizado de máquina

- moldadas

- Manter

- fazer

- Fazendo

- gerencia

- gerenciados

- de grupos

- gestão

- mercado

- Mercados

- matemática

- Matriz

- ir

- evento de mesclagem

- mensagens

- método

- métrico

- Métrica

- poder

- ML

- MLOps

- modelo

- modelos

- EQUIPAMENTOS

- Monitore

- mensal

- mais

- movimentos

- muito

- múltiplo

- nome

- nomeadamente

- nativo

- natural

- Processamento de linguagem natural

- Natureza

- você merece...

- Cria

- rede

- neural

- rede neural

- Novo

- Próximo

- PNL

- caderno

- agora

- número

- of

- Oferece

- on

- ONE

- queridos

- só

- operacional

- or

- ordem

- original

- Outros

- de outra forma

- A Nossa

- Fora

- saída

- lado de fora

- Acima de

- parte

- participar

- Realizar

- atuação

- fase

- escolhido

- oleoduto

- plataforma

- platão

- Inteligência de Dados Platão

- PlatãoData

- possível

- Publique

- práticas

- Precisão

- predição

- Previsões

- preparação

- anterior

- primário

- privado

- processo

- processos

- em processamento

- Produzido

- Produção

- produtividade

- Produtos

- projeto

- projetos

- adequado

- protótipo

- fornecer

- fornece

- público

- publicado

- fins

- Empurrar

- questão

- rapidamente

- citações

- aumentar

- Taxa

- Cru

- alcançado

- Leia

- Leitura

- pronto

- razoável

- recebe

- registros

- Reduzido

- referir

- refinar

- regex

- cadastre-se

- registro

- relevante

- confiável

- remoto

- remover

- Denunciar

- representação

- solicitar

- pedidos

- requeridos

- resolvidas

- Recursos

- aqueles

- responder

- resposta

- respostas

- responsabilidades

- responsável

- resultar

- retorno

- uma conta de despesas robusta

- Rocha

- corrida

- sábio

- Pipelines SageMaker

- mesmo

- escalável

- Escala

- Ciência

- Cientista

- cientistas

- escrita

- Seção

- seções

- seguro

- segmento

- enviar

- separado

- Seqüência

- servir

- serviço

- Serviços

- instalação

- em forma de

- compartilhado

- ações

- ela

- Shows

- Assinaturas

- simples

- simultaneamente

- Habilidades

- menor

- fragmento

- So

- solução

- Soluções

- RESOLVER

- em breve

- Espaço

- Palestrantes

- especialista

- especialistas

- específico

- especificamente

- Etapa

- começo

- Comece

- começa

- estado-da-arte

- Status

- permanecendo

- Passo

- Passos

- armazenamento

- armazenadas

- armazenar

- simplificar

- estudo

- sujeito

- sucesso

- tal

- suportes

- certo

- Tire

- Tarefa

- tarefas

- Profissionais

- equipes

- Dados Técnicos:

- dezenas

- teste

- ensaio

- texto

- do que

- obrigado

- que

- A

- deles

- Eles

- então

- Lá.

- assim sendo

- deles

- isto

- milhares

- três

- Através da

- tempo

- para

- juntos

- ferramenta

- tópico

- tocha

- pista

- Trading

- Plataforma de negociação

- Trem

- treinado

- Training

- transformador

- transformadores

- tremendamente

- VIRAR

- dois

- tipo

- tipos

- Atualizações

- us

- usar

- caso de uso

- usava

- Utilizador

- Experiência do Usuário

- usos

- utilização

- VALIDAR

- validação

- valor

- versão

- Esperando

- foi

- we

- Riqueza

- gestão de riqueza

- web

- serviços web

- BEM

- foram

- quando

- sempre que

- qual

- enquanto

- de

- dentro

- sem

- de gestão de documentos

- fluxos de trabalho

- trabalho

- escrever

- Ioga

- zefirnet