Esta postagem foi escrita em co-autoria com Kostia Kofman e Jenny Tokar da Booking.com.

Como líder global na indústria de viagens online, Booking.com está sempre buscando maneiras inovadoras de aprimorar seus serviços e oferecer aos clientes experiências personalizadas e integradas. A equipe de Ranking da Booking.com desempenha um papel fundamental para garantir que os algoritmos de pesquisa e recomendação sejam otimizados para entregar os melhores resultados aos seus usuários.

Compartilhando recursos internos com outras equipes internas, os cientistas de aprendizado de máquina (ML) da equipe do Ranking frequentemente encontravam longos tempos de espera para acessar recursos para treinamento e experimentação de modelos – desafiando sua capacidade de experimentar e inovar rapidamente. Reconhecendo a necessidade de uma infraestrutura de ML modernizada, a equipe do Ranking embarcou em uma jornada para usar o poder do Amazon Sage Maker para construir, treinar e implantar modelos de ML em escala.

Booking.com colaborou com Serviços Profissionais AWS construir uma solução para acelerar o tempo de lançamento no mercado de modelos de ML aprimorados por meio das seguintes melhorias:

- Tempos de espera reduzidos por recursos para treinamento e experimentação

- Integração de recursos essenciais de ML, como ajuste de hiperparâmetros

- Um ciclo de desenvolvimento reduzido para modelos de ML

Tempos de espera reduzidos significariam que a equipe poderia iterar e experimentar modelos rapidamente, obtendo insights em um ritmo muito mais rápido. O uso de instâncias disponíveis sob demanda do SageMaker permitiu uma redução de dez vezes no tempo de espera. Faltavam recursos essenciais de ML, como ajuste de hiperparâmetros e capacidade de explicação do modelo, no local. A jornada de modernização da equipe introduziu esses recursos por meio de Ajuste automático de modelo do Amazon SageMaker e Esclarecimento do Amazon SageMaker. Por fim, a aspiração da equipe era receber feedback imediato sobre cada alteração feita no código, reduzindo o ciclo de feedback de minutos para um instante e, assim, reduzindo o ciclo de desenvolvimento de modelos de ML.

Neste post, nos aprofundamos na jornada realizada pela equipe de Ranking da Booking.com à medida que aproveitavam os recursos do SageMaker para modernizar sua estrutura de experimentação de ML. Ao fazê-lo, não só superaram os desafios existentes, mas também melhoraram a sua experiência de pesquisa, beneficiando, em última análise, milhões de viajantes em todo o mundo.

Abordagem para modernização

A equipe do Ranking consiste em vários cientistas de ML, cada um precisando desenvolver e testar seu próprio modelo offline. Quando um modelo é considerado bem-sucedido de acordo com a avaliação off-line, ele pode ser movido para testes A/B de produção. Se apresentar melhoria online, pode ser implantado para todos os usuários.

O objetivo deste projeto era criar um ambiente amigável para os cientistas de ML executarem facilmente Pipelines de criação de modelos do Amazon SageMaker para testar suas hipóteses sem a necessidade de codificar módulos longos e complicados.

Um dos vários desafios enfrentados foi a adaptação da solução de pipeline local existente para uso na AWS. A solução envolveu dois componentes principais:

- Modificando e estendendo o código existente – A primeira parte da nossa solução envolveu a modificação e extensão do nosso código existente para torná-lo compatível com a infraestrutura AWS. Isto foi crucial para garantir uma transição tranquila do processamento local para o processamento baseado na nuvem.

- Desenvolvimento de pacote de cliente – Foi desenvolvido um pacote cliente que atua como um wrapper em torno das APIs do SageMaker e do código previamente existente. Este pacote combina os dois, permitindo que os cientistas de ML configurem e implantem facilmente pipelines de ML sem codificação.

Configuração do pipeline do SageMaker

A personalização é fundamental para o pipeline de construção do modelo e foi alcançada por meio de config.ini, um extenso arquivo de configuração. Este arquivo serve como centro de controle para todas as entradas e comportamentos do pipeline.

Configurações disponíveis dentro config.ini incluem:

- Detalhes do pipeline – O profissional pode definir o nome do pipeline, especificar quais etapas devem ser executadas, determinar onde as saídas devem ser armazenadas Serviço de armazenamento simples da Amazon (Amazon S3) e selecione quais conjuntos de dados usar

- Detalhes da conta AWS – Você pode decidir em qual região o pipeline deve ser executado e qual função deve ser usada

- Configuração específica da etapa – Para cada etapa do pipeline, você pode especificar detalhes como o número e o tipo de instâncias a serem usadas, juntamente com parâmetros relevantes

O código a seguir mostra um exemplo de arquivo de configuração:

config.ini é um arquivo controlado por versão gerenciado pelo Git, representando a configuração mínima necessária para uma execução bem-sucedida do pipeline de treinamento. Durante o desenvolvimento, arquivos de configuração local que não são controlados por versão podem ser utilizados. Esses arquivos de configuração local só precisam conter configurações relevantes para uma execução específica, introduzindo flexibilidade sem complexidade. O cliente de criação de pipeline foi projetado para lidar com vários arquivos de configuração, com o mais recente tendo precedência sobre as configurações anteriores.

Etapas do pipeline do SageMaker

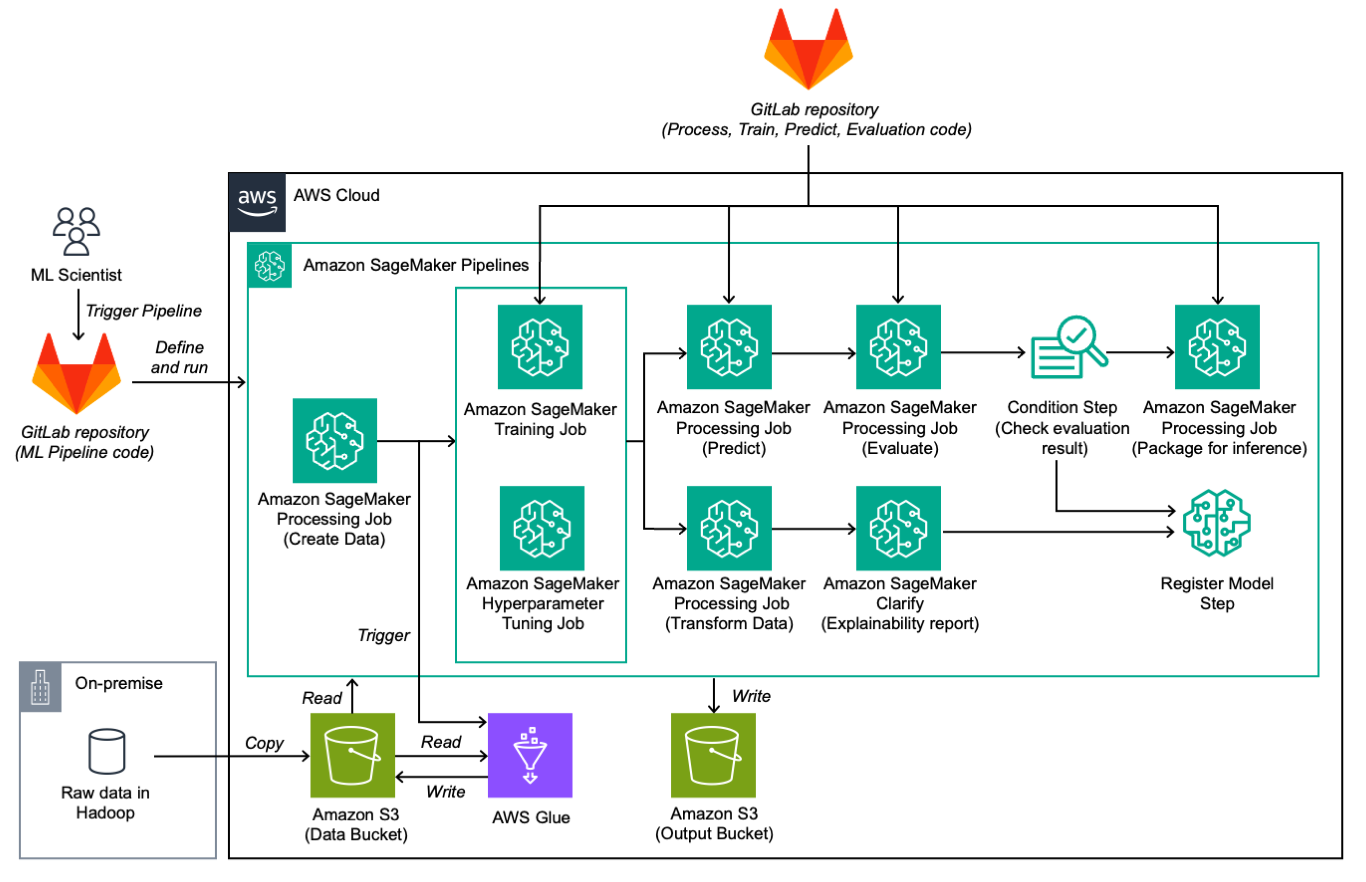

O pipeline é dividido nas seguintes etapas:

- Treine e teste a preparação de dados – Terabytes de dados brutos são copiados para um bucket S3, processados usando Cola AWS jobs para processamento do Spark, resultando em dados estruturados e formatados para compatibilidade.

- Trem – A etapa de treinamento usa o estimador TensorFlow para trabalhos de treinamento do SageMaker. O treinamento ocorre de maneira distribuída usando o Horovod, e o artefato do modelo resultante é armazenado no Amazon S3. Para ajuste de hiperparâmetros, um trabalho de otimização de hiperparâmetros (HPO) pode ser iniciado, selecionando o melhor modelo com base na métrica objetiva.

- Prever – Nesta etapa, um trabalho de processamento do SageMaker usa o artefato do modelo armazenado para fazer previsões. Esse processo é executado em paralelo nas máquinas disponíveis e os resultados da previsão são armazenados no Amazon S3.

- Avaliação – Um trabalho de processamento do PySpark avalia o modelo usando um script Spark personalizado. O relatório de avaliação é então armazenado no Amazon S3.

- Condição – Após a avaliação, é tomada uma decisão quanto à qualidade do modelo. Esta decisão é baseada em uma métrica de condição definida no arquivo de configuração. Se a avaliação for positiva, o modelo é registrado como aprovado; caso contrário, será registrado como rejeitado. Em ambos os casos, o relatório de avaliação e explicabilidade, se gerado, fica registrado no cadastro do modelo.

- Modelo de pacote para inferência – Usando um trabalho de processamento, se os resultados da avaliação forem positivos, o modelo é empacotado, armazenado no Amazon S3 e preparado para upload no portal interno de ML.

- Explicação – O SageMaker Clarify gera um relatório de explicabilidade.

Dois repositórios distintos são usados. O primeiro repositório contém a definição e o código de construção do pipeline de ML, e o segundo repositório contém o código executado em cada etapa, como processamento, treinamento, previsão e avaliação. Essa abordagem de repositório duplo permite maior modularidade e permite que as equipes de ciência e engenharia iterem de forma independente no código de ML e nos componentes do pipeline de ML.

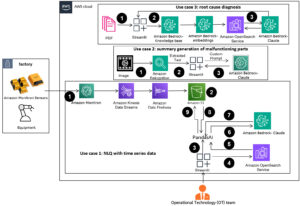

O diagrama a seguir ilustra o fluxo de trabalho da solução.

Ajuste automático do modelo

O treinamento de modelos de ML requer uma abordagem iterativa de vários experimentos de treinamento para construir um modelo final robusto e de alto desempenho para uso comercial. Os cientistas de ML precisam selecionar o tipo de modelo apropriado, construir os conjuntos de dados de entrada corretos e ajustar o conjunto de hiperparâmetros que controlam o processo de aprendizagem do modelo durante o treinamento.

A seleção de valores apropriados para hiperparâmetros para o processo de treinamento do modelo pode influenciar significativamente o desempenho final do modelo. No entanto, não existe uma maneira única ou definida de determinar quais valores são apropriados para um caso de uso específico. Na maioria das vezes, os cientistas de ML precisarão executar vários trabalhos de treinamento com conjuntos de hiperparâmetros ligeiramente diferentes, observar as métricas de treinamento do modelo e, em seguida, tentar selecionar valores mais promissores para a próxima iteração. Esse processo de ajuste do desempenho do modelo também é conhecido como otimização de hiperparâmetros (HPO) e às vezes pode exigir centenas de experimentos.

A equipe do Ranking costumava realizar o HPO manualmente em seu ambiente local porque só conseguia lançar um número muito limitado de trabalhos de treinamento em paralelo. Portanto, eles tiveram que executar o HPO sequencialmente, testar e selecionar manualmente diferentes combinações de valores de hiperparâmetros e monitorar regularmente o progresso. Isso prolongou o processo de desenvolvimento e ajuste do modelo e limitou o número total de experimentos de HPO que poderiam ser executados em um período de tempo viável.

Com a mudança para a AWS, a equipe de Ranking pôde usar o recurso de ajuste automático de modelo (AMT) do SageMaker. O AMT permite que os cientistas do Ranking ML iniciem automaticamente centenas de trabalhos de treinamento dentro de faixas de hiperparâmetros de interesse para encontrar a versão com melhor desempenho do modelo final de acordo com a métrica escolhida. A equipe de classificação agora pode escolher entre quatro estratégias diferentes de ajuste automático para a seleção de hiperparâmetros:

- Pesquisa de grade – A AMT espera que todos os hiperparâmetros sejam valores categóricos e lançará trabalhos de treinamento para cada combinação categórica distinta, explorando todo o espaço dos hiperparâmetros.

- Pesquisa aleatória – AMT selecionará aleatoriamente combinações de valores de hiperparâmetros dentro dos intervalos fornecidos. Como não há dependência entre diferentes trabalhos de treinamento e seleção de valores de parâmetros, vários trabalhos de treinamento paralelos podem ser iniciados com esse método, acelerando o processo ideal de seleção de parâmetros.

- Otimização Bayesiana – AMT usa implementação de otimização Bayesiana para adivinhar o melhor conjunto de valores de hiperparâmetros, tratando-o como um problema de regressão. Ele considerará combinações de hiperparâmetros testadas anteriormente e seu impacto nos trabalhos de treinamento de modelo com a nova seleção de parâmetros, otimizando para uma seleção de parâmetros mais inteligente com menos experimentos, mas também lançará trabalhos de treinamento apenas sequencialmente para sempre poder aprender com treinamentos anteriores.

- Hiperbanda – A AMT usará os resultados intermediários e finais dos trabalhos de treinamento que está executando para realocar dinamicamente recursos para trabalhos de treinamento com configurações de hiperparâmetros que mostram resultados mais promissores, interrompendo automaticamente aqueles com desempenho inferior.

O AMT no SageMaker permitiu que a equipe de classificação reduzisse o tempo gasto no processo de ajuste de hiperparâmetros para o desenvolvimento de seu modelo, permitindo-lhes, pela primeira vez, executar vários experimentos paralelos, usar estratégias de ajuste automático e realizar execuções de trabalho de treinamento de dois dígitos em poucos dias, algo que não era viável no local.

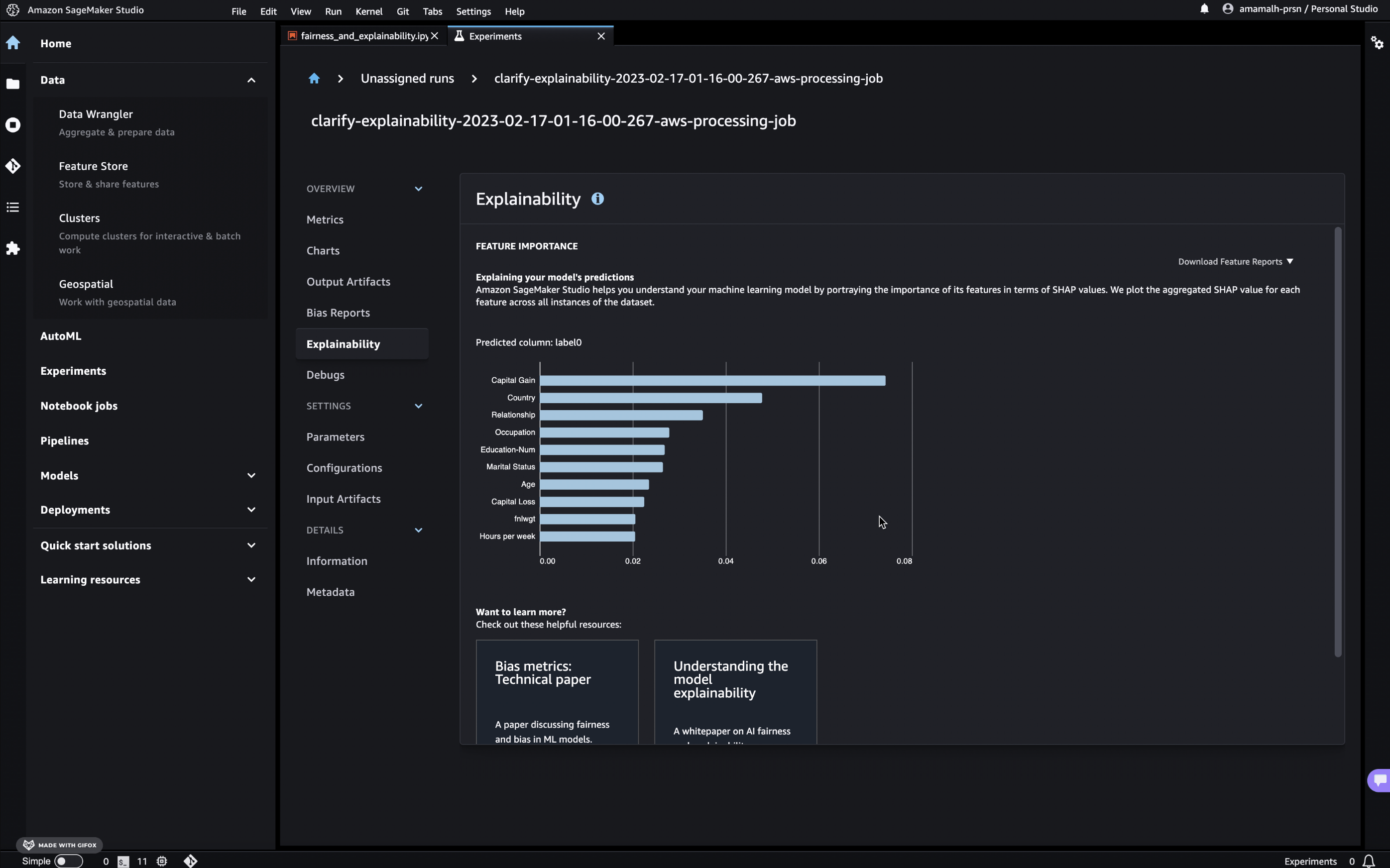

Explicabilidade do modelo com SageMaker Clarify

A explicabilidade do modelo permite que os profissionais de ML entendam a natureza e o comportamento de seus modelos de ML, fornecendo insights valiosos para engenharia de recursos e decisões de seleção, o que, por sua vez, melhora a qualidade das previsões do modelo. A equipe do Ranking queria avaliar seus insights de explicabilidade de duas maneiras: entender como as entradas de recursos afetam os resultados do modelo em todo o conjunto de dados (interpretabilidade global) e também ser capaz de descobrir a influência dos recursos de entrada para uma previsão de modelo específico em um ponto de dados de interesse ( interpretabilidade local). Com esses dados, os cientistas do Ranking ML podem tomar decisões informadas sobre como melhorar ainda mais o desempenho do modelo e levar em conta os resultados de previsão desafiadores que o modelo ocasionalmente forneceria.

O SageMaker Clarify permite gerar relatórios de explicabilidade do modelo usando Explicações do aditivo Shapley (SHAP) ao treinar seus modelos no SageMaker, oferecendo suporte à interpretabilidade do modelo global e local. Além dos relatórios de explicabilidade do modelo, o SageMaker Clarify oferece suporte à execução de análises para métricas de polarização pré-treinamento, métricas de polarização pós-treinamento e gráficos de dependência parcial. O trabalho será executado como um trabalho de processamento do SageMaker na conta AWS e se integra diretamente aos pipelines do SageMaker.

O relatório de interpretabilidade global será gerado automaticamente na saída do trabalho e exibido no Estúdio Amazon SageMaker ambiente como parte da execução do experimento de treinamento. Se este modelo for registrado no registro de modelos do SageMaker, o relatório será adicionalmente vinculado ao artefato do modelo. Usando essas duas opções, a equipe de classificação conseguiu rastrear facilmente diferentes versões de modelos e suas mudanças comportamentais.

Para explorar o impacto do recurso de entrada em uma única previsão (valores de interpretabilidade local), a equipe de classificação habilitou o parâmetro save_local_shap_values nos trabalhos do SageMaker Clarify e foi capaz de carregá-los do bucket S3 para análises adicionais nos notebooks Jupyter no SageMaker Studio.

As imagens anteriores mostram um exemplo de como seria a explicabilidade de um modelo para um modelo de ML arbitrário.

Otimização de treinamento

A ascensão do aprendizado profundo (DL) fez com que o ML se tornasse cada vez mais dependente do poder computacional e de grandes quantidades de dados. Os profissionais de ML geralmente enfrentam o obstáculo de usar recursos de maneira eficiente ao treinar esses modelos complexos. Quando você executa treinamento em grandes clusters de computação, surgem vários desafios na otimização da utilização de recursos, incluindo problemas como gargalos de E/S, atrasos na inicialização do kernel, restrições de memória e recursos subutilizados. Se a configuração do trabalho de treinamento não for ajustada para eficiência, esses obstáculos poderão resultar em uso de hardware abaixo do ideal, durações de treinamento prolongadas ou até mesmo execuções de treinamento incompletas. Esses fatores aumentam os custos do projeto e atrasam os prazos.

A criação de perfil de uso de CPU e GPU ajuda a entender essas ineficiências, determinar o consumo de recursos de hardware (tempo e memória) das diversas operações do TensorFlow em seu modelo, resolver gargalos de desempenho e, em última análise, fazer com que o modelo seja executado mais rapidamente.

A equipe de classificação usou o recurso de criação de perfil de estrutura de Depurador do Amazon SageMaker (agora obsoleto em favor de Perfilador do Amazon SageMaker) para otimizar esses trabalhos de treinamento. Isso permite que você rastreie todas as atividades em CPUs e GPUs, como utilizações de CPU e GPU, execuções de kernel em GPUs, inicializações de kernel em CPUs, operações de sincronização, operações de memória em GPUs, latências entre inicializações de kernel e execuções correspondentes e transferência de dados entre CPUs e GPUs.

A equipe de classificação também usou o Perfilador do TensorFlow característica de TensorBoard, o que ajudou ainda mais a traçar o perfil do treinamento do modelo TensorFlow. SageMaker agora é ainda mais integrado ao TensorBoard e traz as ferramentas de visualização do TensorBoard para o SageMaker, integradas aos treinamentos e domínios do SageMaker. O TensorBoard permite executar tarefas de depuração de modelo usando os plug-ins de visualização do TensorBoard.

Com a ajuda dessas duas ferramentas, a equipe de Ranking otimizou seu modelo TensorFlow e conseguiu identificar gargalos e reduzir o tempo médio da etapa de treinamento de 350 milissegundos para 140 milissegundos na CPU e de 170 milissegundos para 70 milissegundos na GPU, acelerações de 60%. e 59%, respectivamente.

Resultados de negócios

Os esforços de migração centraram-se no aumento da disponibilidade, escalabilidade e elasticidade, o que coletivamente levou o ambiente de ML a um novo nível de excelência operacional, exemplificado pelo aumento da frequência de treinamento de modelos e diminuição de falhas, tempos de treinamento otimizados e recursos avançados de ML.

Frequência e falhas de treinamento de modelo

O número de trabalhos mensais de treinamento de modelo aumentou cinco vezes, levando a otimizações de modelo significativamente mais frequentes. Além disso, o novo ambiente de ML levou a uma redução na taxa de falhas nas execuções de pipeline, caindo de aproximadamente 50% para 20%. O tempo de processamento do trabalho com falha diminuiu drasticamente, de mais de uma hora em média para insignificantes 5 segundos. Isto aumentou fortemente a eficiência operacional e diminuiu o desperdício de recursos.

Tempo de treinamento otimizado

A migração trouxe consigo aumentos de eficiência por meio do treinamento de GPU baseado em SageMaker. Essa mudança diminuiu o tempo de treinamento do modelo para um quinto da duração anterior. Anteriormente, os processos de treinamento para modelos de aprendizagem profunda consumiam cerca de 60 horas de CPU; isso foi simplificado para aproximadamente 12 horas na GPU. Essa melhoria não apenas economiza tempo, mas também acelera o ciclo de desenvolvimento, permitindo iterações mais rápidas e melhorias no modelo.

Recursos avançados de ML

Central para o sucesso da migração é o uso do conjunto de recursos SageMaker, abrangendo ajuste de hiperparâmetros e explicabilidade do modelo. Além disso, a migração permitiu um acompanhamento contínuo de experimentos usando Experimentos Amazon SageMaker, permitindo experimentações mais criteriosas e produtivas.

Mais importante ainda, o novo ambiente de experimentação de ML apoiou o desenvolvimento bem-sucedido de um novo modelo que está agora em produção. Este modelo é de aprendizado profundo em vez de baseado em árvore e introduziu melhorias visíveis no desempenho do modelo online.

Conclusão

Esta postagem forneceu uma visão geral da colaboração entre AWS Professional Services e Booking.com que resultou na implementação de uma estrutura de ML escalonável e reduziu com sucesso o tempo de lançamento no mercado de modelos de ML de sua equipe de classificação.

A equipe de classificação da Booking.com aprendeu que a migração para a nuvem e o SageMaker se mostrou benéfica e que a adaptação das práticas de operações de aprendizado de máquina (MLOps) permite que seus engenheiros e cientistas de ML se concentrem em seu trabalho e aumentem a velocidade de desenvolvimento. A equipe está compartilhando os aprendizados e o trabalho realizado com toda a comunidade de ML na Booking.com, por meio de palestras e sessões dedicadas com profissionais de ML, onde eles compartilham o código e os recursos. Esperamos que este post possa servir como mais uma forma de compartilhar o conhecimento.

Os serviços profissionais da AWS estão prontos para ajudar sua equipe a desenvolver ML escalonável e pronto para produção na AWS. Para mais informações, veja Serviços Profissionais AWS ou entre em contato com seu gerente de conta.

Sobre os autores

Laurens van der Maas é engenheiro de aprendizado de máquina na AWS Professional Services. Ele trabalha em estreita colaboração com clientes que criam soluções de machine learning na AWS, é especialista em treinamento distribuído, experimentação e IA responsável e é apaixonado por como o machine learning está mudando o mundo como o conhecemos.

Laurens van der Maas é engenheiro de aprendizado de máquina na AWS Professional Services. Ele trabalha em estreita colaboração com clientes que criam soluções de machine learning na AWS, é especialista em treinamento distribuído, experimentação e IA responsável e é apaixonado por como o machine learning está mudando o mundo como o conhecemos.

Daniel Zagyva é cientista de dados na AWS Professional Services. Ele é especialista no desenvolvimento de soluções de machine learning escalonáveis e de nível de produção para clientes da AWS. Sua experiência se estende por diferentes áreas, incluindo processamento de linguagem natural, IA generativa e operações de aprendizado de máquina.

Daniel Zagyva é cientista de dados na AWS Professional Services. Ele é especialista no desenvolvimento de soluções de machine learning escalonáveis e de nível de produção para clientes da AWS. Sua experiência se estende por diferentes áreas, incluindo processamento de linguagem natural, IA generativa e operações de aprendizado de máquina.

Kostia Kofman é gerente sênior de aprendizado de máquina na Booking.com, liderando a equipe de Search Ranking ML e supervisionando o sistema de ML mais extenso da Booking.com. Com experiência em Personalização e Classificação, ele busca aproveitar tecnologia de ponta para aprimorar a experiência do cliente.

Kostia Kofman é gerente sênior de aprendizado de máquina na Booking.com, liderando a equipe de Search Ranking ML e supervisionando o sistema de ML mais extenso da Booking.com. Com experiência em Personalização e Classificação, ele busca aproveitar tecnologia de ponta para aprimorar a experiência do cliente.

Jenny Tokar é engenheiro sênior de aprendizado de máquina na equipe de classificação de pesquisa da Booking.com. Ela é especializada no desenvolvimento de pipelines de ML completos caracterizados por eficiência, confiabilidade, escalabilidade e inovação. A experiência de Jenny capacita sua equipe a criar modelos de classificação de ponta que atendem milhões de usuários todos os dias.

Jenny Tokar é engenheiro sênior de aprendizado de máquina na equipe de classificação de pesquisa da Booking.com. Ela é especializada no desenvolvimento de pipelines de ML completos caracterizados por eficiência, confiabilidade, escalabilidade e inovação. A experiência de Jenny capacita sua equipe a criar modelos de classificação de ponta que atendem milhões de usuários todos os dias.

Aleksandra Dokic é cientista de dados sênior na AWS Professional Services. Ela gosta de apoiar os clientes na criação de soluções inovadoras de IA/ML na AWS e está entusiasmada com as transformações dos negócios por meio do poder dos dados.

Aleksandra Dokic é cientista de dados sênior na AWS Professional Services. Ela gosta de apoiar os clientes na criação de soluções inovadoras de IA/ML na AWS e está entusiasmada com as transformações dos negócios por meio do poder dos dados.

Luba Protsiva é gerente de engajamento na AWS Professional Services. Ela é especializada no fornecimento de soluções de dados e GenAI/ML que permitem aos clientes da AWS maximizar o valor de seus negócios e acelerar a velocidade da inovação.

Luba Protsiva é gerente de engajamento na AWS Professional Services. Ela é especializada no fornecimento de soluções de dados e GenAI/ML que permitem aos clientes da AWS maximizar o valor de seus negócios e acelerar a velocidade da inovação.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/how-booking-com-modernized-its-ml-experimentation-framework-with-amazon-sagemaker/

- :tem

- :é

- :não

- :onde

- $UP

- 1

- 100

- 12

- 130

- 140

- 16

- 350

- 60

- 7

- 70

- a

- habilidade

- Capaz

- Sobre

- acelerar

- Acesso

- Segundo

- Conta

- alcançado

- em

- atividades

- atos

- adaptação

- Adição

- Adicionalmente

- avançado

- afetar

- Depois de

- AI

- AI / ML

- algoritmos

- Todos os Produtos

- permitidas

- permite

- juntamente

- tb

- sempre

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- quantidade

- quantidades

- an

- Analisa

- e

- Outro

- APIs

- abordagem

- apropriado

- aprovou

- aproximadamente

- arbitrário

- SOMOS

- áreas

- surgir

- por aí

- AS

- aspiração

- At

- Automático

- automaticamente

- disponibilidade

- disponível

- média

- AWS

- Serviços Profissionais AWS

- em caminho duplo

- baseado

- Bayesiano

- BE

- Porque

- tornando-se

- comportamento

- comportamental

- comportamentos

- benéfico

- beneficiando

- MELHOR

- entre

- viés

- reserva

- Booking.com

- ambos

- gargalos

- Traz

- Trazido

- construir

- Prédio

- negócio

- mas a

- by

- CAN

- capacidades

- casas

- casos

- Centralização de

- centralizado

- desafios

- desafiante

- alterar

- Alterações

- mudança

- caracterizado

- Escolha

- escolhido

- cliente

- de perto

- Na nuvem

- código

- Codificação

- colaborou

- colaboração

- coletivamente

- COM

- combinação

- combinações

- combina

- geralmente

- comunidade

- compatibilidade

- compatível

- integrações

- complexidade

- complicado

- componentes

- computacional

- poder computacional

- Computar

- condição

- Configuração

- Considerar

- consiste

- restrições

- consumida

- consumo

- não contenho

- contém

- ao controle

- correta

- Correspondente

- custos

- poderia

- artesanato

- crio

- criação

- crucial

- personalizadas

- cliente

- Clientes

- personalizável

- ponta

- tecnologia de ponta

- ciclo

- dados,

- Preparação de dados

- cientista de dados

- conjuntos de dados

- dia

- dias

- decidir

- decisão

- decisões

- diminuiu

- dedicado

- considerado

- profundo

- deep learning

- definir

- definido

- definição

- atraso

- atrasos

- entregar

- entregando

- mergulhar

- dependência

- Dependência

- implantar

- implantado

- obsoleta

- projetado

- detalhes

- Determinar

- desenvolver

- desenvolvido

- em desenvolvimento

- Desenvolvimento

- diagrama

- diferente

- diretamente

- descobrir

- exibido

- distinto

- distribuído

- treinamento distribuído

- dividido

- fazer

- domínios

- feito

- drasticamente

- Caindo

- duração

- durante

- dinamicamente

- cada

- facilmente

- eficiência

- eficientemente

- esforços

- embarcou

- empodera

- permitir

- habilitado

- permite

- permitindo

- abrangente

- end-to-end

- COMPROMETIMENTO

- engenheiro

- Engenharia

- Engenheiros

- aumentar

- aprimorando

- assegurando

- Todo

- Meio Ambiente

- épocas

- essencial

- avaliar

- avaliação

- Mesmo

- Cada

- todo dia

- exemplo

- Excelência

- animado

- exemplificado

- existente

- esperar

- expedições

- vasta experiência

- Experiências

- experimentar

- experimentos

- experiência

- Explicação

- explorar

- Explorando

- estendendo

- se estende

- extensão

- extenso

- Rosto

- enfrentou

- fatores

- fracassado

- Falha

- falhas

- falso

- mais rápido

- favorecer

- factível

- Característica

- Funcionalidades

- retornos

- menos

- Envie o

- Arquivos

- final

- Finalmente

- Encontre

- Primeiro nome

- primeira vez

- Flexibilidade

- Foco

- seguinte

- Escolha

- quatro

- Quadro

- Frequência

- freqüente

- da

- mais distante

- Além disso

- ganhando

- gerar

- gerado

- gera

- generativo

- IA generativa

- ter

- Git

- Global

- meta

- GPU

- GPUs

- maior

- adivinhar

- tinha

- manipular

- Hardware

- arreado

- Ter

- he

- ajudar

- ajudou

- ajuda

- sua experiência

- sua

- esperança

- hora

- HORÁRIO

- Como funciona o dobrador de carta de canal

- Como Negociar

- Contudo

- HTML

- http

- HTTPS

- Centenas

- Obstáculo

- Otimização de hiperparâmetros

- Ajuste de hiperparâmetros

- identificar

- if

- ilustra

- imagens

- Imediato

- Impacto

- implementação

- importante

- melhorar

- melhorado

- melhoria

- melhorias

- melhora

- in

- incluir

- Incluindo

- Crescimento

- aumentou

- Aumenta

- cada vez mais

- independentemente

- indústria

- ineficiências

- influência

- INFORMAÇÕES

- informado

- Infraestrutura

- iniciado

- inovar

- Inovação

- inovadores

- entrada

- inputs

- dentro

- perspicaz

- insights

- instantâneos

- integrado

- Integra-se

- interesse

- interno

- para dentro

- introduzido

- introduzindo

- envolvido

- questões

- IT

- iteração

- iterações

- ESTÁ

- Trabalho

- Empregos

- viagem

- jpg

- Chave

- Saber

- Conhecimento

- conhecido

- sem

- língua

- grande

- mais recente

- lançamento

- lançado

- lança

- líder

- principal

- APRENDER

- aprendido

- aprendizagem

- levou

- Nível

- aproveitando

- como

- Limitado

- ligado

- carregar

- local

- longo

- olhar

- parece

- máquina

- aprendizado de máquina

- máquinas

- moldadas

- fazer

- gerenciados

- Gerente

- maneira

- manualmente

- Maximizar

- significar

- Memória

- método

- métrico

- Métrica

- migrando

- migração

- milhões

- milissegundos

- mínimo

- Minutos

- ML

- MLOps

- modelo

- modelos

- modernizar

- Módulos

- Monitore

- mensal

- mais

- a maioria

- mover

- movido

- muito

- múltiplo

- nome

- natural

- Processamento de linguagem natural

- Natureza

- você merece...

- Novo

- Próximo

- não

- agora

- número

- objetivo

- observar

- obstáculos

- of

- modo offline

- frequentemente

- on

- Sob demanda

- ONE

- online

- só

- operacional

- Operações

- ideal

- otimização

- otimizações

- Otimize

- otimizado

- otimizando

- Opções

- or

- Outros

- de outra forma

- A Nossa

- Fora

- saída

- outputs

- Acima de

- global

- supervisionando

- Visão geral

- próprio

- Paz

- pacote

- empacotado

- Paralelo

- parâmetro

- parte

- apaixonado

- Realizar

- atuação

- realização

- Personalização

- oleoduto

- essencial

- platão

- Inteligência de Dados Platão

- PlatãoData

- desempenha

- plugins

- ponto

- Portal

- positivo

- Publique

- poder

- práticas

- precedente

- predizer

- predição

- Previsões

- preparação

- anterior

- anteriormente

- Problema

- processo

- Processado

- processos

- em processamento

- Produção

- produtivo

- profissional

- Perfil

- profiling

- Progresso

- projeto

- promissor

- provou

- fornecer

- fornecido

- fornecendo

- qualidade

- rapidamente

- gamas

- Posição

- rapidamente

- Taxa

- em vez

- Cru

- alcançar

- pronto

- receber

- reconhecendo

- Recomendação

- gravado

- reduzir

- Reduzido

- redução

- redução

- em relação a

- região

- cadastre-se

- registrado

- registro

- regularmente

- Rejeitado..

- relevante

- confiabilidade

- Denunciar

- Relatórios

- repositório

- representando

- requerer

- requeridos

- exige

- resolver

- recurso

- Recursos

- respectivamente

- responsável

- resultar

- resultando

- Resultados

- Subir

- uma conta de despesas robusta

- Tipo

- Execute

- corrida

- é executado

- sábio

- Pipelines SageMaker

- AMPLIAR

- escalável

- Escala

- Ciência

- Cientista

- cientistas

- escrita

- desatado

- Pesquisar

- Segundo

- segundo

- Vejo

- busca

- selecionar

- selecionando

- doadores,

- senior

- servir

- serve

- Serviços

- sessões

- conjunto

- Conjuntos

- Configurações

- vários

- Partilhar

- compartilhando

- ela

- mudança

- rede de apoio social

- mostrar

- Shows

- de forma considerável

- simples

- solteiro

- ligeiramente diferente

- mais inteligente

- Liso

- So

- solução

- Soluções

- algo

- Espaço

- Faísca

- especializada

- específico

- velocidade

- gasto

- Passo

- Passos

- paragem

- armazenamento

- armazenadas

- estratégias

- simplificada

- discordaram

- estruturada

- estudo

- subótimo

- sucesso

- bem sucedido

- entraram com sucesso

- tal

- Suportado

- Apoiar

- suportes

- sincronizar.

- .

- adaptados

- tomar

- negociações

- tarefas

- Profissionais

- equipes

- Tecnologia

- fluxo tensor

- teste

- testado

- ensaio

- do que

- que

- A

- o mundo

- deles

- Eles

- então

- Lá.

- assim

- assim sendo

- Este

- deles

- isto

- aqueles

- prospera

- Através da

- tempo

- timelines

- vezes

- para

- ferramentas

- tocar

- para

- pista

- Rastreamento

- Trem

- Training

- treinamentos

- transferência

- transformações

- transição

- viagens

- indústria de viagens

- Viajantes

- tratamento

- verdadeiro

- tentar

- sintonização

- VIRAR

- dois

- tipo

- Em última análise

- compreender

- único

- Uso

- usar

- caso de uso

- usava

- user-friendly

- usuários

- usos

- utilização

- utilizado

- Valioso

- valor

- Valores

- vário

- Grande

- Velocidade

- versão

- versões

- muito

- visualização

- esperar

- querido

- foi

- Caminho..

- maneiras

- we

- web

- serviços web

- foram

- quando

- qual

- enquanto

- QUEM

- precisarão

- de

- dentro

- sem

- Atividades:

- de gestão de documentos

- trabalho

- mundo

- no mundo todo

- seria

- Vocês

- investimentos

- zefirnet