À medida que nos aprofundamos na era digital, o desenvolvimento de modelos multimodais tem sido fundamental para melhorar a compreensão das máquinas. Esses modelos processam e geram conteúdo em vários formatos de dados, como texto e imagens. Uma característica fundamental desses modelos são seus recursos de conversão de imagem em texto, que demonstraram notável proficiência em tarefas como legendagem de imagens e resposta visual a perguntas.

Ao traduzir imagens em texto, desbloqueamos e aproveitamos a riqueza de informações contidas nos dados visuais. Por exemplo, no comércio eletrônico, a conversão de imagem em texto pode automatizar a categorização de produtos com base em imagens, aumentando a eficiência e a precisão da pesquisa. Da mesma forma, pode auxiliar na geração de descrições automáticas de fotos, fornecendo informações que podem não estar incluídas nos títulos ou descrições dos produtos, melhorando assim a experiência do usuário.

Nesta postagem, fornecemos uma visão geral dos modelos multimodais populares. Também demonstramos como implantar esses modelos pré-treinados em Amazon Sage Maker. Além disso, discutimos as diversas aplicações desses modelos, focando particularmente em vários cenários do mundo real, como geração de tags e atribuição zero-shot para comércio eletrônico e geração automática de prompts a partir de imagens.

Antecedentes dos modelos multimodalidade

Os modelos de aprendizado de máquina (ML) alcançaram avanços significativos em campos como processamento de linguagem natural (PNL) e visão computacional, onde os modelos podem exibir desempenho semelhante ao humano na análise e geração de conteúdo a partir de uma única fonte de dados. Mais recentemente, tem havido uma atenção crescente no desenvolvimento de modelos multimodais, que são capazes de processar e gerar conteúdos em diferentes modalidades. Estes modelos, como a fusão de redes de visão e de linguagem, ganharam destaque devido à sua capacidade de integrar informações de diversas fontes e modalidades, melhorando assim a sua capacidade de compreensão e expressão.

Nesta seção, fornecemos uma visão geral de dois modelos multimodais populares: CLIP (Pré-treinamento de linguagem-imagem contrastiva) e BLIP (Inicializando o pré-treinamento de linguagem-imagem).

Modelo CLIPE

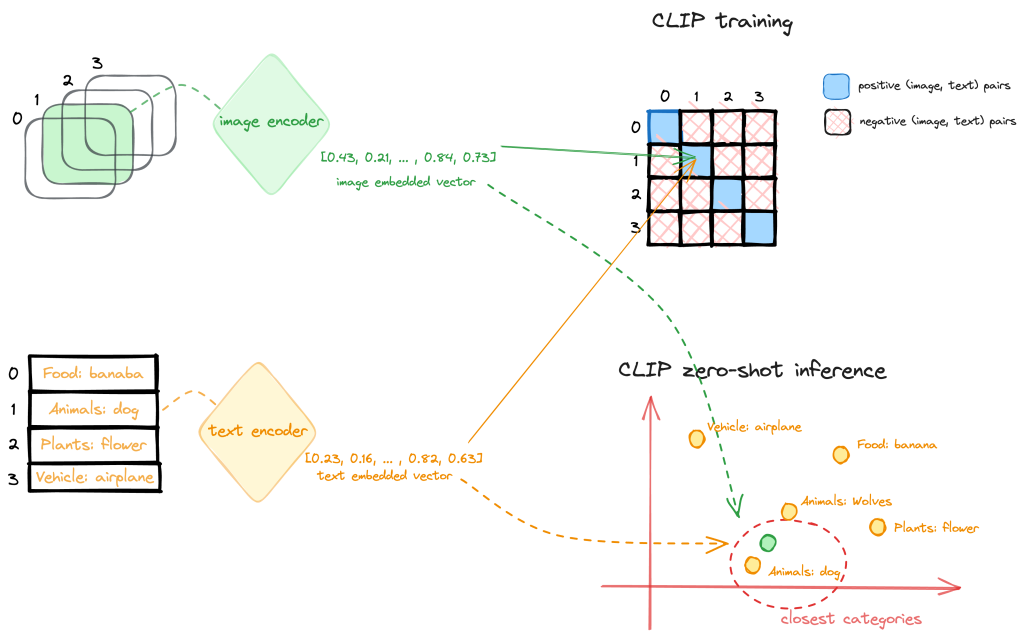

CLIP é um modelo multimodal de visão e linguagem, que pode ser usado para similaridade imagem-texto e para classificação de imagem zero-shot. O CLIP é treinado em um conjunto de dados de 400 milhões de pares imagem-texto coletados de diversas fontes disponíveis publicamente na Internet. A arquitetura do modelo consiste em um codificador de imagem e um codificador de texto, conforme mostrado no diagrama a seguir.

Durante o treinamento, uma imagem e um trecho de texto correspondente são alimentados através dos codificadores para obter um vetor de recursos de imagem e um vetor de recursos de texto. O objetivo é fazer com que os recursos de imagem e texto de um par correspondente tenham uma alta similaridade de cosseno, enquanto os recursos de pares incompatíveis tenham baixa similaridade. Isto é feito através de uma perda contrastiva. Esse pré-treinamento contrastante resulta em codificadores que mapeiam imagens e texto para um espaço de incorporação comum onde a semântica está alinhada.

Os codificadores podem então ser usados para aprendizagem de transferência zero-shot para tarefas posteriores. No momento da inferência, o codificador pré-treinado de imagem e texto processa sua respectiva entrada e a transforma em uma representação vetorial de alta dimensão, ou um embutindo. As incorporações da imagem e do texto são então comparadas para determinar sua similaridade, como a similaridade de cosseno. O prompt de texto (classes de imagem, categorias ou tags) cuja incorporação é mais semelhante (por exemplo, tem a menor distância) à incorporação da imagem é considerada a mais relevante e a imagem é classificada de acordo.

Modelo BLIP

Outro modelo multimodal popular é o BLIP. Ele apresenta uma nova arquitetura de modelo capaz de se adaptar a diversas tarefas de linguagem de visão e emprega uma técnica exclusiva de inicialização de conjunto de dados para aprender com dados barulhentos da web. A arquitetura BLIP inclui um codificador de imagem e um codificador de texto: o codificador de texto baseado em imagem injeta informações visuais no bloco transformador do codificador de texto, e o decodificador de texto baseado em imagem incorpora informações visuais no bloco decodificador transformador. Com esta arquitetura, o BLIP demonstra excelente desempenho em um espectro de tarefas de linguagem de visão que envolvem a fusão de informações visuais e linguísticas, desde pesquisa baseada em imagens e geração de conteúdo até sistemas de diálogo visual interativos. Em um post anterior, propusemos um solução de moderação de conteúdo baseada no modelo BLIP que abordou vários desafios usando abordagens de ML unimodais de visão computacional.

Caso de uso 1: geração de tags ou atributos zero-shot para uma plataforma de comércio eletrônico

As plataformas de comércio eletrônico funcionam como mercados dinâmicos repletos de ideias, produtos e serviços. Com milhões de produtos listados, a classificação e categorização eficazes representam um desafio significativo. É aqui que o poder da marcação automática e da geração de atributos entra em ação. Ao aproveitar tecnologias avançadas como ML e PNL, esses processos automatizados podem revolucionar as operações das plataformas de comércio eletrônico.

Um dos principais benefícios da etiquetagem automática ou geração de atributos reside na sua capacidade de melhorar a capacidade de pesquisa. Os produtos etiquetados com precisão podem ser encontrados pelos clientes de forma rápida e eficiente. Por exemplo, se um cliente estiver pesquisando uma “camiseta de algodão com gola redonda e um logotipo na frente”, a etiquetagem automática e a geração de atributos permitem que o mecanismo de pesquisa identifique produtos que correspondam não apenas à categoria mais ampla de “camisetas”, mas também à categoria mais ampla de “camisetas”. mas também os atributos específicos de “algodão” e “gola redonda”. Essa correspondência precisa pode facilitar uma experiência de compra mais personalizada e aumentar a satisfação do cliente. Além disso, tags ou atributos gerados automaticamente podem melhorar substancialmente os algoritmos de recomendação de produtos. Com um conhecimento profundo dos atributos do produto, o sistema pode sugerir produtos mais relevantes aos clientes, aumentando assim a probabilidade de compras e aumentando a satisfação do cliente.

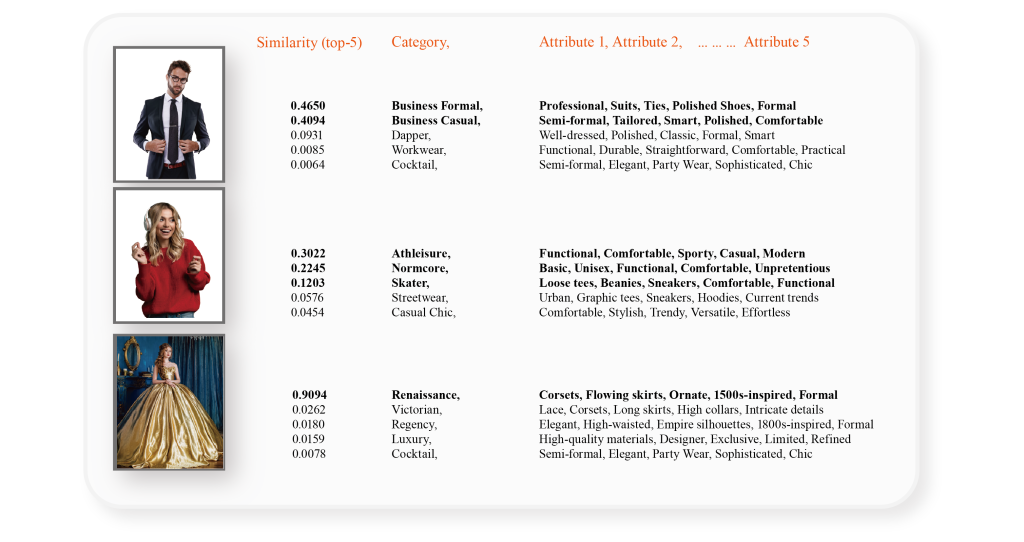

CLIP oferece uma solução promissora para automatizar o processo de geração de tags ou atributos. Ele recebe uma imagem do produto e uma lista de descrições ou tags como entrada, gerando uma representação vetorial, ou incorporação, para cada tag. Esses embeddings existem em um espaço de alta dimensão, com suas distâncias e direções relativas refletindo as relações semânticas entre as entradas. O CLIP é pré-treinado em uma grande escala de pares imagem-texto para encapsular essas incorporações significativas. Se uma tag ou atributo descreve uma imagem com precisão, suas incorporações devem estar relativamente próximas neste espaço. Para gerar tags ou atributos correspondentes, uma lista de tags potenciais pode ser inserida na parte de texto do modelo CLIP e os embeddings resultantes armazenados. Idealmente, esta lista deve ser exaustiva, abrangendo todas as categorias e atributos potenciais relevantes para os produtos na plataforma de comércio eletrônico. A figura a seguir mostra alguns exemplos.

Para implantar o modelo CLIP no SageMaker, você pode seguir o notebook a seguir GitHub repo. Usamos o SageMaker pré-construído contêineres de inferência de modelo grande (LMI) para implantar o modelo. Os contêineres LMI usam Serviço DJL para servir seu modelo para inferência. Para saber mais sobre como hospedar modelos grandes no SageMaker, consulte Implante modelos grandes no Amazon SageMaker usando DJLServing e inferência paralela de modelo DeepSpeed e Implante modelos grandes com alto desempenho usando FasterTransformer no Amazon SageMaker.

Neste exemplo, fornecemos os arquivos serving.properties, model.py e requirements.txt para preparar os artefatos do modelo e armazená-los em um arquivo tarball.

serving.propertiesé o arquivo de configuração que pode ser usado para indicar ao DJL Serving quais bibliotecas de paralelização de modelos e otimização de inferência você gostaria de usar. Dependendo da sua necessidade, você pode definir a configuração apropriada. Para obter mais detalhes sobre as opções de configuração e uma lista completa, consulte Configurações e configurações.model.pyé o script que trata de quaisquer solicitações de veiculação.requirements.txté o arquivo de texto que contém quaisquer rodas pip adicionais para instalar.

Se você quiser baixar o modelo de Abraçando o rosto diretamente, você pode definir o option.model_id parâmetro no serving.properties arquivo como o ID do modelo de um modelo pré-treinado hospedado dentro de um repositório de modelo em abraçandoface.co. O contêiner usa esse ID de modelo para baixar o modelo correspondente durante o tempo de implantação. Se você definir o model_id para uma Serviço de armazenamento simples da Amazon (Amazon S3), o DJL baixará os artefatos do modelo do Amazon S3 e trocará o model_id para a localização real dos artefatos do modelo. No seu script, você pode apontar para esse valor para carregar o modelo pré-treinado. No nosso exemplo, usamos a última opção, porque o contêiner LMI usa s5cmd para baixar dados do Amazon S3, o que reduz significativamente a velocidade ao carregar modelos durante a implantação. Veja o seguinte código:

No modelo.py script, carregamos o caminho do modelo usando o ID do modelo fornecido no arquivo de propriedades:

Depois que os artefatos do modelo forem preparados e carregados no Amazon S3, você poderá implantar o modelo CLIP na hospedagem do SageMaker com algumas linhas de código:

Quando o terminal está em serviço, você pode invocá-lo com uma imagem de entrada e uma lista de rótulos como prompt de entrada para gerar as probabilidades do rótulo:

Caso de uso 2: geração automática de prompts a partir de imagens

Uma aplicação inovadora que utiliza modelos multimodalidade é gerar prompts informativos a partir de uma imagem. Na IA generativa, um pronto refere-se à entrada fornecida a um modelo de linguagem ou outro modelo generativo para instruí-lo sobre que tipo de conteúdo ou resposta é desejado. O prompt é essencialmente um ponto de partida ou um conjunto de instruções que orienta o processo de geração do modelo. Pode assumir a forma de uma frase, pergunta, texto parcial ou qualquer entrada que transmita o contexto ou a saída desejada para o modelo. A escolha de um prompt bem elaborado é fundamental para gerar imagens de alta qualidade, precisão e relevância. Engenharia imediata é o processo de otimizar ou elaborar uma entrada textual para obter as respostas desejadas de um modelo de linguagem, muitas vezes envolvendo ajustes de redação, formato ou contexto.

A engenharia imediata para geração de imagens apresenta vários desafios, incluindo os seguintes:

- Definir conceitos visuais com precisão – Descrever conceitos visuais em palavras às vezes pode ser impreciso ou ambíguo, dificultando a transmissão da imagem exata desejada. Capturar detalhes intrincados ou cenas complexas por meio de instruções textuais pode não ser simples.

- Especificando estilos desejados de forma eficaz – Comunicar preferências estilísticas específicas, como humor, paleta de cores ou estilo artístico, pode ser um desafio apenas por meio de texto. Traduzir conceitos estéticos abstratos em instruções concretas para o modelo pode ser complicado.

- Equilibrar a complexidade para evitar sobrecarregar o modelo – Prompts elaborados podem confundir o modelo ou levá-lo a sobrecarregá-lo com informações, afetando o resultado gerado. É essencial encontrar o equilíbrio certo entre fornecer orientação suficiente e evitar uma complexidade esmagadora.

Portanto, a elaboração de prompts eficazes para geração de imagens é demorada, o que requer experimentação iterativa e refinamento para atingir o equilíbrio certo entre precisão e criatividade, tornando-se uma tarefa que exige muitos recursos e depende fortemente da experiência humana.

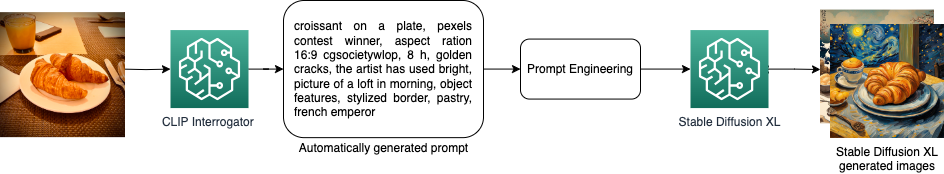

A Interrogador CLIP é uma ferramenta de engenharia de prompt automático para imagens que combina CLIP e BLIP para otimizar prompts de texto para corresponder a uma determinada imagem. Você pode usar os prompts resultantes com modelos de texto para imagem como Difusão Estável para criar arte legal. Os prompts criados pelo CLIP Interrogator oferecem uma descrição abrangente da imagem, abrangendo não apenas seus elementos fundamentais, mas também o estilo artístico, a inspiração potencial por trás da imagem, o meio onde a imagem poderia ter sido ou poderia ser usada e muito mais. Você pode implantar facilmente a solução CLIP Interrogator no SageMaker para agilizar o processo de implantação e aproveitar as vantagens da escalabilidade, economia e segurança robusta fornecidas pelo serviço totalmente gerenciado. O diagrama a seguir mostra a lógica de fluxo desta solução.

Você pode usar o seguinte caderno para implantar a solução CLIP Interrogator no SageMaker. Da mesma forma, para hospedagem do modelo CLIP, usamos o contêiner SageMaker LMI para hospedar a solução no SageMaker usando DJL Serving. Neste exemplo, fornecemos um arquivo de entrada adicional com os artefatos do modelo que especifica os modelos implantados no endpoint SageMaker. Você pode escolher diferentes modelos CLIP ou BLIP passando o nome do modelo de legenda e o nome do modelo de clipe através do model_name.json arquivo criado com o seguinte código:

O script de inferência model.py contém uma função de identificador que o DJL Serving executará sua solicitação invocando esta função. Para preparar este script de ponto de entrada, adotamos o código do original clip_interrogator.py arquivo e modificou-o para funcionar com DJL Serving na hospedagem SageMaker. Uma atualização é o carregamento do modelo BLIP. Os modelos BLIP e CLIP são carregados através do load_caption_model() e load_clip_model() função durante a inicialização do objeto Interrogador. Para carregar o modelo BLIP, primeiro baixamos os artefatos do modelo do Hugging Face e os carregamos no Amazon S3 como o valor alvo do model_id no arquivo de propriedades. Isso ocorre porque o modelo BLIP pode ser um arquivo grande, como o blip2-opt-2.7b modelo, que tem mais de 15 GB de tamanho. Baixar o modelo do Hugging Face durante a implantação do modelo exigirá mais tempo para a criação do endpoint. Portanto, apontamos o model_id para o local do Amazon S3 do modelo BLIP2 e carregue o modelo do caminho do modelo especificado no arquivo de propriedades. Observe que, durante a implantação, o caminho do modelo será trocado pelo caminho do contêiner local onde os artefatos do modelo foram baixados pelo DJL Serving a partir do local do Amazon S3. Veja o seguinte código:

Como o modelo CLIP não é muito grande, usamos open_clip para carregar o modelo diretamente do Hugging Face, que é igual ao original clip_interrogator implementação:

Usamos código semelhante para implantar a solução CLIP Interrogator em um endpoint SageMaker e invocar o endpoint com uma imagem de entrada para obter os prompts que podem ser usados para gerar imagens semelhantes.

Tomemos a imagem a seguir como exemplo. Usando o endpoint CLIP Interrogator implantado no SageMaker, ele gera a seguinte descrição de texto: croissant on a plate, pexels contest winner, aspect ratio 16:9, cgsocietywlop, 8 h, golden cracks, the artist has used bright, picture of a loft in morning, object features, stylized border, pastry, french emperor.

Podemos combinar ainda mais a solução CLIP Interrogator com difusão estável e técnicas de engenharia imediata – surge uma dimensão totalmente nova de possibilidades criativas. Esta integração permite-nos não só descrever imagens com texto, mas também manipular e gerar diversas variações das imagens originais. A difusão estável garante a síntese controlada da imagem, refinando iterativamente a saída gerada, e a engenharia estratégica orienta o processo de geração em direção aos resultados desejados.

No segunda parte do caderno, detalhamos as etapas para usar a engenharia imediata para remodelar imagens com o modelo de difusão estável (Difusão estável XL 1.0) Nós usamos o SDK de IA de estabilidade para implantar este modelo do SageMaker JumpStart após assinar este modelo na AWS marketplace. Porque esta é uma versão mais nova e melhor para geração de imagens fornecida por IA de estabilidade, podemos obter imagens de alta qualidade com base na imagem de entrada original. Além disso, se prefixarmos a descrição anterior e adicionarmos uma mensagem adicional mencionando um artista conhecido e uma de suas obras, obteremos resultados surpreendentes com o restyling. A imagem a seguir usa o prompt: This scene is a Van Gogh painting with The Starry Night style, croissant on a plate, pexels contest winner, aspect ratio 16:9, cgsocietywlop, 8 h, golden cracks, the artist has used bright, picture of a loft in morning, object features, stylized border, pastry, french emperor.

A imagem a seguir usa o prompt: This scene is a Hokusai painting with The Great Wave off Kanagawa style, croissant on a plate, pexels contest winner, aspect ratio 16:9, cgsocietywlop, 8 h, golden cracks, the artist has used bright, picture of a loft in morning, object features, stylized border, pastry, french emperor.

Conclusão

O surgimento de modelos multimodalidade, como CLIP e BLIP, e suas aplicações estão transformando rapidamente o cenário da conversão de imagem em texto. Fazendo a ponte entre a informação visual e a semântica, estão a fornecer-nos as ferramentas para desbloquear o vasto potencial dos dados visuais e aproveitá-lo de formas que antes eram inimagináveis.

Neste post, ilustramos diferentes aplicações dos modelos multimodalidade. Isso vai desde o aumento da eficiência e precisão da pesquisa em plataformas de comércio eletrônico, por meio de marcação e categorização automáticas, até a geração de prompts para modelos de texto para imagem, como Stable Diffusion. Esses aplicativos abrem novos horizontes para a criação de conteúdo exclusivo e envolvente. Incentivamos você a aprender mais explorando os diversos modelos de multimodalidade no SageMaker e construir uma solução inovadora para o seu negócio.

Sobre os autores

Yanwei Cui, PhD, é arquiteto de soluções especialista em aprendizado de máquina sênior na AWS. Ele iniciou pesquisas em aprendizado de máquina no IRISA (Instituto de Pesquisa de Ciência da Computação e Sistemas Aleatórios) e tem vários anos de experiência na construção de aplicações industriais baseadas em IA em visão computacional, processamento de linguagem natural e previsão on-line do comportamento do usuário. Na AWS, ele compartilha sua experiência no domínio e ajuda os clientes a desbloquear potenciais de negócios e gerar resultados acionáveis com aprendizado de máquina em escala. Fora do trabalho, ele gosta de ler e viajar.

Yanwei Cui, PhD, é arquiteto de soluções especialista em aprendizado de máquina sênior na AWS. Ele iniciou pesquisas em aprendizado de máquina no IRISA (Instituto de Pesquisa de Ciência da Computação e Sistemas Aleatórios) e tem vários anos de experiência na construção de aplicações industriais baseadas em IA em visão computacional, processamento de linguagem natural e previsão on-line do comportamento do usuário. Na AWS, ele compartilha sua experiência no domínio e ajuda os clientes a desbloquear potenciais de negócios e gerar resultados acionáveis com aprendizado de máquina em escala. Fora do trabalho, ele gosta de ler e viajar.

Raghu Ramesha é arquiteto sênior de soluções de ML da equipe do Amazon SageMaker Service. Ele se concentra em ajudar os clientes a criar, implantar e migrar cargas de trabalho de produção de ML para o SageMaker em escala. Ele é especialista em domínios de aprendizado de máquina, IA e visão computacional, e possui mestrado em Ciência da Computação pela UT Dallas. Nas horas vagas gosta de viajar e fotografar.

Raghu Ramesha é arquiteto sênior de soluções de ML da equipe do Amazon SageMaker Service. Ele se concentra em ajudar os clientes a criar, implantar e migrar cargas de trabalho de produção de ML para o SageMaker em escala. Ele é especialista em domínios de aprendizado de máquina, IA e visão computacional, e possui mestrado em Ciência da Computação pela UT Dallas. Nas horas vagas gosta de viajar e fotografar.

Sam Edwards, é engenheiro de nuvem (AI/ML) na AWS Sydney, especializado em aprendizado de máquina e Amazon SageMaker. Ele é apaixonado por ajudar os clientes a resolver problemas relacionados a fluxos de trabalho de aprendizado de máquina e a criar novas soluções para eles. Fora do trabalho, ele gosta de praticar esportes com raquete e viajar.

Sam Edwards, é engenheiro de nuvem (AI/ML) na AWS Sydney, especializado em aprendizado de máquina e Amazon SageMaker. Ele é apaixonado por ajudar os clientes a resolver problemas relacionados a fluxos de trabalho de aprendizado de máquina e a criar novas soluções para eles. Fora do trabalho, ele gosta de praticar esportes com raquete e viajar.

Melanie Li, PhD, é especialista sênior em IA/ML TAM na AWS com sede em Sydney, Austrália. Ela ajuda clientes corporativos a criar soluções usando ferramentas de IA/ML de última geração na AWS e fornece orientação sobre como arquitetar e implementar soluções de ML com as melhores práticas. Nas horas vagas adora explorar a natureza e estar com a família e amigos.

Melanie Li, PhD, é especialista sênior em IA/ML TAM na AWS com sede em Sydney, Austrália. Ela ajuda clientes corporativos a criar soluções usando ferramentas de IA/ML de última geração na AWS e fornece orientação sobre como arquitetar e implementar soluções de ML com as melhores práticas. Nas horas vagas adora explorar a natureza e estar com a família e amigos.

Gordon Wang é especialista sênior em IA/ML TAM na AWS. Ele oferece suporte a clientes estratégicos com as melhores práticas de IA/ML em vários setores. Ele é apaixonado por visão computacional, PNL, IA generativa e MLOps. Nas horas vagas, adora correr e fazer caminhadas.

Gordon Wang é especialista sênior em IA/ML TAM na AWS. Ele oferece suporte a clientes estratégicos com as melhores práticas de IA/ML em vários setores. Ele é apaixonado por visão computacional, PNL, IA generativa e MLOps. Nas horas vagas, adora correr e fazer caminhadas.

Dhawal Patel é Arquiteto Principal de Machine Learning na AWS. Ele trabalhou com organizações que vão desde grandes empresas até startups de médio porte em problemas relacionados à computação distribuída e Inteligência Artificial. Ele se concentra em aprendizado profundo, incluindo domínios de PNL e Visão Computacional. Ele ajuda os clientes a obter inferência de modelo de alto desempenho no SageMaker.

Dhawal Patel é Arquiteto Principal de Machine Learning na AWS. Ele trabalhou com organizações que vão desde grandes empresas até startups de médio porte em problemas relacionados à computação distribuída e Inteligência Artificial. Ele se concentra em aprendizado profundo, incluindo domínios de PNL e Visão Computacional. Ele ajuda os clientes a obter inferência de modelo de alto desempenho no SageMaker.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/build-an-image-to-text-generative-ai-application-using-multimodality-models-on-amazon-sagemaker/

- :tem

- :é

- :não

- :onde

- 1

- 10

- 100

- 12

- 15%

- 16

- 400

- 7

- 8

- 9

- 97

- a

- habilidade

- Sobre

- RESUMO

- conformemente

- precisão

- exatamente

- Alcançar

- alcançado

- em

- real

- adicionar

- Adicional

- Adicionalmente

- endereçado

- ajustes

- adotado

- avançado

- avanços

- Vantagem

- afetando

- Depois de

- AI

- Alimentado por AI

- AI / ML

- algoritmos

- alinhado

- Todos os Produtos

- permite

- sozinho

- tb

- surpreendente

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- an

- análise

- e

- qualquer

- Aplicação

- aplicações

- se aproxima

- apropriado

- arquitetura

- SOMOS

- Arte

- artificial

- inteligência artificial

- artista

- artístico

- AS

- aspecto

- auxiliar

- At

- por WhatsApp.

- atributos

- Australia

- automatizar

- Automatizado

- Automático

- automatizando

- disponível

- evitando

- AWS

- Equilíbrio

- baseado

- BE

- Porque

- sido

- comportamento

- atrás

- Benefícios

- MELHOR

- melhores práticas

- Melhor

- entre

- Pós

- Grande

- Bloquear

- corpo

- impulsionar

- fronteira

- ponte

- Brilhante

- mais amplo

- construir

- Prédio

- negócio

- mas a

- by

- CAN

- Pode obter

- capacidades

- capaz

- Capturar

- casas

- CAT

- Categorias

- Categoria

- Gatos

- desafiar

- desafios

- desafiante

- escolha

- Escolha

- aulas

- classificação

- classificado

- Fechar

- Na nuvem

- código

- cor

- combinar

- combina

- vem

- comum

- comunicação

- comparado

- integrações

- complexidade

- compreensivo

- computador

- Ciência da Computação

- Visão de Computador

- computação

- conceitos

- Configuração

- considerado

- consiste

- contida

- Recipiente

- Containers

- contém

- conteúdo

- Geração de Conteúdo

- contexto

- controlado

- Conversão

- Legal

- Correspondente

- poderia

- cobertura

- crio

- criado

- Criar

- criação

- Criatividade

- criatividade

- crítico

- Atravessar

- cliente

- A satisfação do cliente

- Clientes

- Dallas

- dados,

- profundo

- deep learning

- mais profunda

- Grau

- mergulhar

- demonstrar

- demonstra

- Dependendo

- implantar

- implantado

- desenvolvimento

- descreve

- descrição

- desejado

- detalhe

- detalhes

- Determinar

- Desenvolvimento

- dispositivo

- diálogo

- diferente

- difícil

- Distribuição

- digital

- Dimensão

- diretamente

- discutir

- distância

- distribuído

- computação distribuída

- diferente

- domínio

- domínios

- feito

- download

- distância

- dois

- durante

- dinâmico

- cada

- facilmente

- Loja virtual

- Eficaz

- eficiência

- eficientemente

- Elaborar

- elementos

- outro

- embutindo

- emergência

- emerge

- emprega

- permitir

- encorajar

- Ponto final

- noivando

- Motor

- engenheiro

- Engenharia

- aumentar

- aprimorando

- garante

- Empreendimento

- empresas

- entrada

- Era

- essencial

- essencialmente

- exemplo

- exemplos

- apresentar

- existir

- vasta experiência

- experiência

- explorar

- Explorando

- expressão

- Rosto

- facilitar

- família

- Característica

- Funcionalidades

- Alimentado

- poucos

- Campos

- Figura

- Envie o

- Arquivos

- Primeiro nome

- fluxo

- concentra-se

- focando

- seguir

- seguinte

- Escolha

- formulário

- formato

- formas

- encontrado

- Gratuito

- Francês

- amigos

- da

- frente

- totalmente

- função

- fundamental

- mais distante

- Além disso

- fusão

- ganhou

- lacuna

- gerar

- gerado

- gera

- gerando

- geração

- generativo

- IA generativa

- ter

- dado

- meta

- Dourado

- ótimo

- orientações

- Guias

- manipular

- Alças

- arreios

- Aproveitamento

- Ter

- he

- fortemente

- ajuda

- ajuda

- sua experiência

- Alta

- alta qualidade

- sua

- detém

- Horizontes

- hospedeiro

- hospedado

- hospedagem

- Como funciona o dobrador de carta de canal

- Como Negociar

- HTML

- http

- HTTPS

- humano

- ID

- idealmente

- idéias

- if

- imagem

- Classificação de imagem

- imagens

- implementação

- implementação

- importar

- melhorar

- melhorar

- in

- incluído

- inclui

- Incluindo

- aumentando

- indicam

- industrial

- indústrias

- INFORMAÇÕES

- informativo

- inovadores

- entrada

- inputs

- dentro

- Inspiração

- instalar

- instância

- Instituto

- instruções

- integrar

- integração

- Inteligência

- interativo

- Internet

- para dentro

- Introduz

- envolver

- envolvendo

- questões

- IT

- ESTÁ

- jpg

- json

- Chave

- conhecido

- O rótulo

- Rótulos

- paisagem

- língua

- grande

- Grandes empresas

- conduzir

- APRENDER

- aprendizagem

- Li

- bibliotecas

- encontra-se

- como

- probabilidade

- linhas

- Lista

- Listado

- carregar

- carregamento

- local

- localização

- lógica

- logotipo

- fora

- ama

- Baixo

- máquina

- aprendizado de máquina

- fazer

- Fazendo

- gerenciados

- muitos

- mapa,

- marketplaces

- mestre

- Match

- correspondido

- correspondente

- significativo

- média

- apenas

- poder

- migrado

- milhão

- milhões

- ML

- MLOps

- modelo

- modelos

- moderação

- modificada

- mais

- Além disso

- Manhã

- a maioria

- múltiplo

- nome

- natural

- Processamento de linguagem natural

- Natureza

- você merece...

- redes

- Novo

- Novos horizontes

- noite

- PNL

- nenhum

- caderno

- romance

- objeto

- of

- WOW!

- oferecer

- Oferece

- frequentemente

- on

- ONE

- online

- só

- aberto

- Operações

- otimização

- Otimize

- otimizando

- Opção

- Opções

- or

- organizações

- original

- OS

- Outros

- A Nossa

- resultados

- saída

- lado de fora

- marcante

- Visão geral

- esmagador

- próprio

- pintura

- par

- pares

- palete

- Paralelo

- parâmetro

- parte

- particularmente

- Passagem

- apaixonado

- caminho

- atuação

- Personalizado

- phd

- foto

- fotografia

- fotografia

- essencial

- plataforma

- Plataformas

- platão

- Inteligência de Dados Platão

- PlatãoData

- jogar

- plugue

- ponto

- Popular

- coloca

- possibilidades

- Publique

- potencial

- potenciais

- poder

- práticas

- preciso

- Precisão

- predição

- preferências

- Preparar

- preparado

- evitar

- anterior

- anteriormente

- Diretor

- problemas

- processo

- processos

- em processamento

- Produto

- Produção

- Produtos

- proeminência

- promissor

- Propriedades

- propriedade

- proposto

- fornecer

- fornecido

- fornece

- fornecendo

- publicamente

- compras

- questão

- acaso

- alcance

- variando

- rapidamente

- relação

- Leitura

- mundo real

- recentemente

- Recomendação

- reduz

- referir

- refere-se

- refinação

- refletindo

- região

- relacionado

- Relacionamentos

- relativo

- relativamente

- relevância

- relevante

- notável

- repositório

- representação

- solicitar

- pedidos

- requerer

- exige

- pesquisa

- uso intensivo de recursos

- aqueles

- resposta

- respostas

- resultando

- Resultados

- retorno

- revolucionar

- certo

- uma conta de despesas robusta

- Execute

- corrida

- sábio

- mesmo

- satisfação

- AMPLIAR

- Escala

- cenários

- cena

- Cenas

- Ciência

- escrita

- Pesquisar

- motor de busca

- pesquisar

- Seção

- segurança

- Vejo

- AUTO

- semântica

- senior

- sentença

- servir

- serviço

- Serviços

- de servir

- conjunto

- vários

- ações

- ela

- minha

- rede de apoio social

- mostrando

- Shows

- periodo

- de forma considerável

- semelhante

- Similarmente

- simples

- solteiro

- Tamanho

- fragmento

- solução

- Soluções

- RESOLVER

- alguns

- às vezes

- fonte

- Fontes

- Espaço

- especialista

- especializado

- especializada

- específico

- especificada

- Espectro

- velocidade

- gastar

- Esportes

- estável

- estrelado

- começado

- Comece

- Startups

- estado-da-arte

- Passos

- armazenamento

- loja

- armazenadas

- franco

- Estratégico

- simplificar

- greve

- estilo

- substancialmente

- tal

- suficiente

- sugerir

- suportes

- trocar

- rapidamente

- sydney

- .

- sistemas

- TAG

- Tire

- toma

- Target

- Tarefa

- tarefas

- Profissionais

- técnica

- Tecnologias

- modelo

- texto

- textual

- do que

- que

- A

- A paisagem

- deles

- Eles

- então

- Lá.

- assim

- assim sendo

- Este

- deles

- isto

- Através da

- tempo

- títulos

- para

- ferramenta

- ferramentas

- para

- treinado

- Training

- transferência

- transformador

- transformando

- transformações

- Viagens

- dois

- tipo

- compreensão

- inimaginável

- único

- destravar

- Atualizar

- carregado

- URL

- us

- usar

- usava

- Utilizador

- Experiência do Usuário

- usos

- utilização

- valor

- variedade

- vário

- Grande

- versão

- muito

- via

- visão

- W

- queremos

- Onda

- maneiras

- we

- Riqueza

- web

- serviços web

- foram

- O Quê

- quando

- qual

- enquanto

- inteiro

- de quem

- precisarão

- vencedor

- de

- redação

- palavras

- Atividades:

- trabalhou

- fluxos de trabalho

- trabalho

- seria

- anos

- Vocês

- investimentos

- zefirnet