Este é um post convidado co-escrito com a equipe PyTorch da Meta e é uma continuação de Parte 1 desta série, onde demonstramos o desempenho e a facilidade de execução do PyTorch 2.0 na AWS.

A pesquisa de aprendizado de máquina (ML) provou que grandes modelos de linguagem (LLMs) treinados com conjuntos de dados significativamente grandes resultam em melhor qualidade do modelo. Nos últimos anos, o tamanho dos modelos da geração atual aumentou significativamente e requerem ferramentas e infraestruturas modernas para serem treinados de forma eficiente e em escala. O Paralelismo de Dados Distribuídos (DDP) PyTorch ajuda a processar dados em escala de maneira simples e robusta, mas requer que o modelo caiba em uma GPU. A biblioteca PyTorch Fully Sharded Data Parallel (FSDP) quebra essa barreira ao permitir a fragmentação de modelos para treinar grandes modelos em trabalhadores paralelos de dados.

O treinamento de modelo distribuído requer um cluster de nós de trabalho que possam ser dimensionados. Serviço Amazon Elastic Kubernetes (Amazon EKS) é um serviço popular em conformidade com o Kubernetes que simplifica muito o processo de execução de cargas de trabalho de IA/ML, tornando-o mais gerenciável e menos demorado.

Nesta postagem do blog, a AWS colabora com a equipe PyTorch da Meta para discutir como usar a biblioteca PyTorch FSDP para obter escalonamento linear de modelos de aprendizagem profunda na AWS de maneira integrada usando Amazon EKS e Contêineres de aprendizado profundo da AWS (DLC). Demonstramos isso por meio de uma implementação passo a passo do treinamento dos modelos Llama7 13B, 70B e 2B usando o Amazon EKS com 16 Amazon Elastic Compute Nuvem (Amazon EC2) p4de.24xgrande instâncias (cada uma com 8 GPUs NVIDIA A100 Tensor Core e cada GPU com 80 GB de memória HBM2e) ou 16 EC2 p5.48xgrande instâncias (cada uma com 8 GPUs NVIDIA H100 Tensor Core e cada GPU com 80 GB de memória HBM3), alcançando escala quase linear na taxa de transferência e, por fim, permitindo um tempo de treinamento mais rápido.

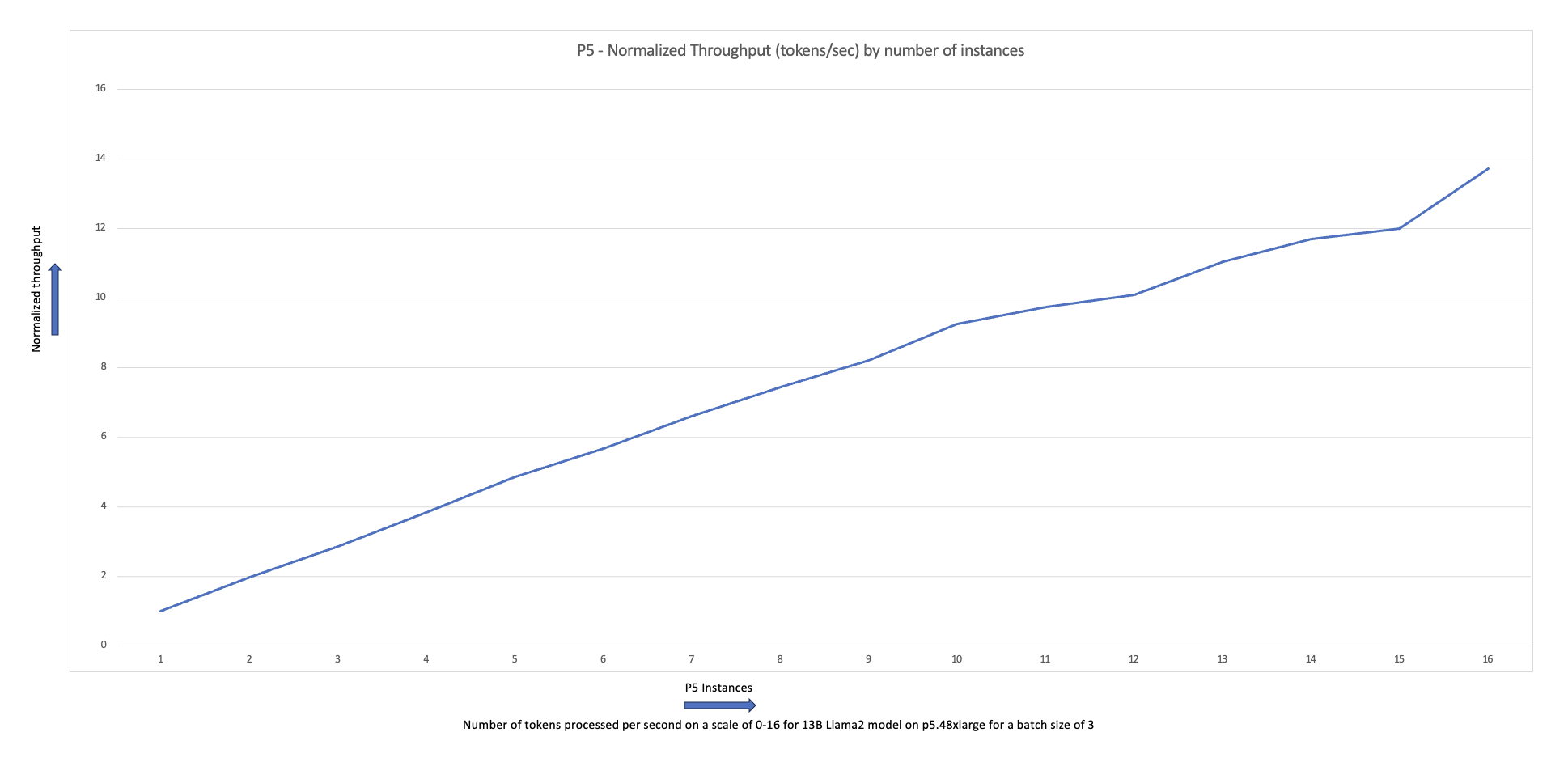

O gráfico de escalabilidade a seguir mostra que as instâncias p5.48xlarge oferecem 87% de eficiência de escalabilidade com ajuste fino do FSDP Llama2 em uma configuração de cluster de 16 nós.

Desafios de treinar LLMs

As empresas estão adotando cada vez mais LLMs para uma série de tarefas, incluindo assistentes virtuais, tradução, criação de conteúdo e visão computacional, para aumentar a eficiência e a precisão em uma variedade de aplicações.

No entanto, treinar ou ajustar esses modelos grandes para um caso de uso personalizado requer uma grande quantidade de dados e poder de computação, o que aumenta a complexidade geral de engenharia da pilha de ML. Isso também se deve à memória limitada disponível em uma única GPU, que restringe o tamanho do modelo que pode ser treinado e também limita o tamanho do lote por GPU usado durante o treinamento.

Para enfrentar esse desafio, várias técnicas de paralelismo de modelos, como DeepSpeed ZeRO e PyTorchFSDP foram criados para permitir que você supere essa barreira de memória GPU limitada. Isso é feito adotando uma técnica paralela de dados fragmentados, onde cada acelerador contém apenas uma fatia (um estilhaço) de uma réplica do modelo em vez de toda a réplica do modelo, o que reduz drasticamente o consumo de memória do trabalho de treinamento.

Esta postagem demonstra como você pode usar o PyTorch FSDP para ajustar o modelo Llama2 usando o Amazon EKS. Conseguimos isso ampliando a capacidade de computação e GPU para atender aos requisitos do modelo.

Visão geral do FSDP

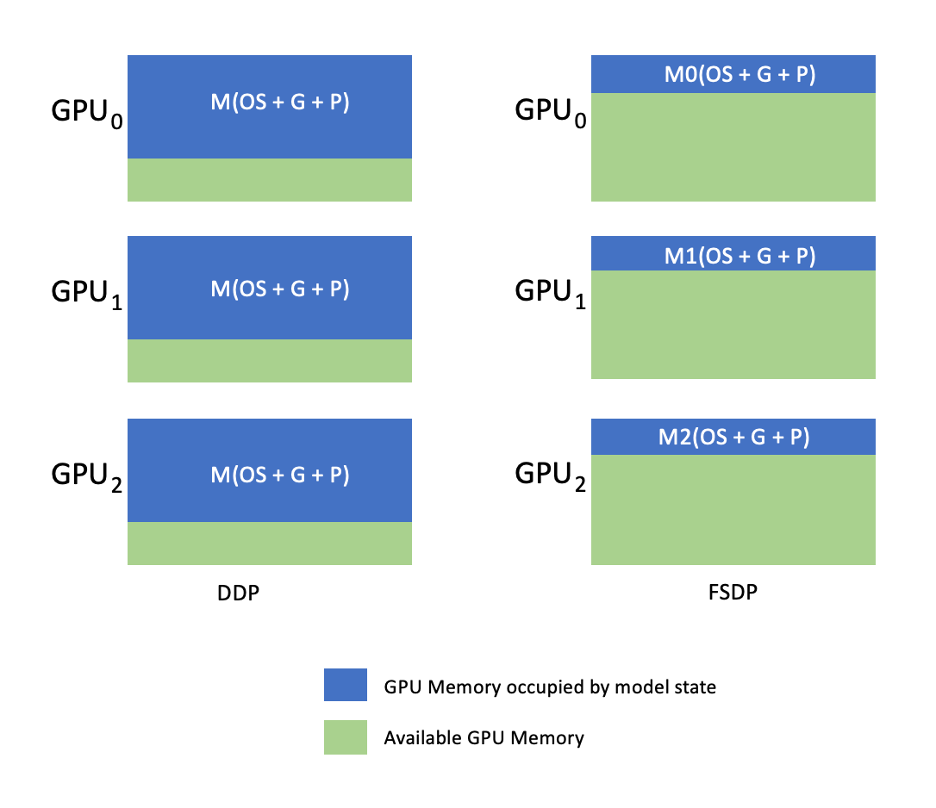

No treinamento PyTorch DDP, cada GPU (referida como trabalhador no contexto do PyTorch) contém uma cópia completa do modelo, incluindo os pesos do modelo, gradientes e estados do otimizador. Cada trabalhador processa um lote de dados e, no final da passagem para trás, usa um redução total operação para sincronizar gradientes entre diferentes trabalhadores.

Ter uma réplica do modelo em cada GPU restringe o tamanho do modelo que pode ser acomodado em um fluxo de trabalho DDP. O FSDP ajuda a superar essa limitação ao fragmentar parâmetros do modelo, estados do otimizador e gradientes entre trabalhadores paralelos de dados, preservando ao mesmo tempo a simplicidade do paralelismo de dados.

Isso é demonstrado no diagrama a seguir, onde no caso do DDP, cada GPU mantém uma cópia completa do estado do modelo, incluindo o estado do otimizador (OS), gradientes (G) e parâmetros (P): M(OS + G +P). No FSDP, cada GPU contém apenas uma fatia do estado do modelo, incluindo o estado do otimizador (OS), gradientes (G) e parâmetros (P): M (SO + G + P). O uso do FSDP resulta em um consumo de memória de GPU significativamente menor em comparação com o DDP em todos os trabalhadores, permitindo o treinamento de modelos muito grandes ou o uso de lotes maiores para trabalhos de treinamento.

Isso, no entanto, tem o custo do aumento da sobrecarga de comunicação, que é mitigado por meio de otimizações de FSDP, como sobreposição de processos de comunicação e computação com recursos como pré-busca. Para informações mais detalhadas, consulte Primeiros passos com dados paralelos totalmente fragmentados (FSDP).

O FSDP oferece vários parâmetros que permitem ajustar o desempenho e a eficiência dos seus trabalhos de treinamento. Alguns dos principais recursos e capacidades do FSDP incluem:

- Política de encapsulamento de transformadores

- Precisão mista flexível

- Ponto de verificação de ativação

- Várias estratégias de fragmentação para atender diferentes velocidades de rede e topologias de cluster:

- FULL_SHARD – Parâmetros do modelo de fragmento, gradientes e estados do otimizador

- HYBRID_SHARD – Fragmento completo dentro de um nó DDP entre nós; suporta um grupo de fragmentação flexível para uma réplica completa do modelo (HSDP)

- SHARD_GRAD_OP – Fragmentar apenas gradientes e estados do otimizador

- NO_SHARD – Semelhante ao DDP

Para obter mais informações sobre o FSDP, consulte Treinamento eficiente em larga escala com Pytorch FSDP e AWS.

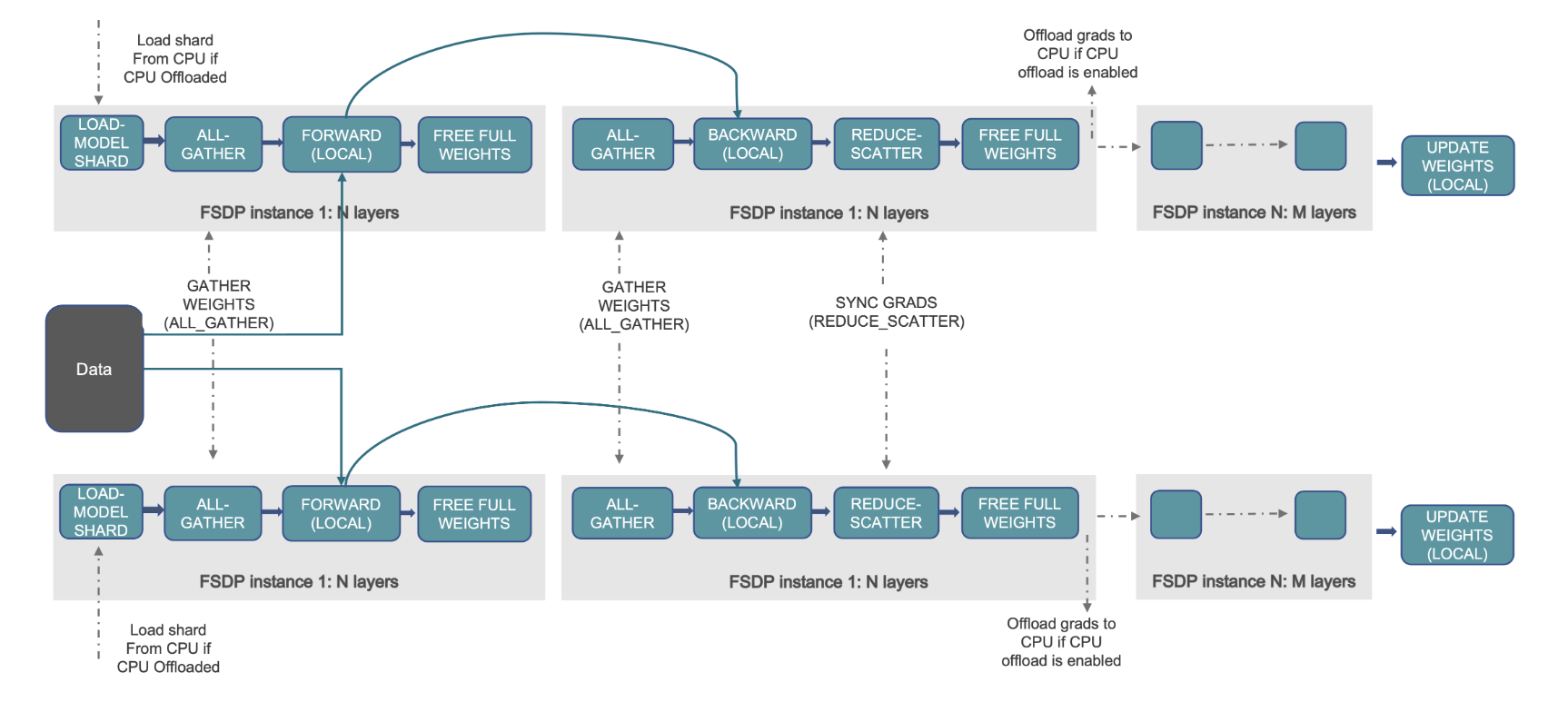

A figura a seguir mostra como o FSDP funciona para dois processos paralelos de dados.

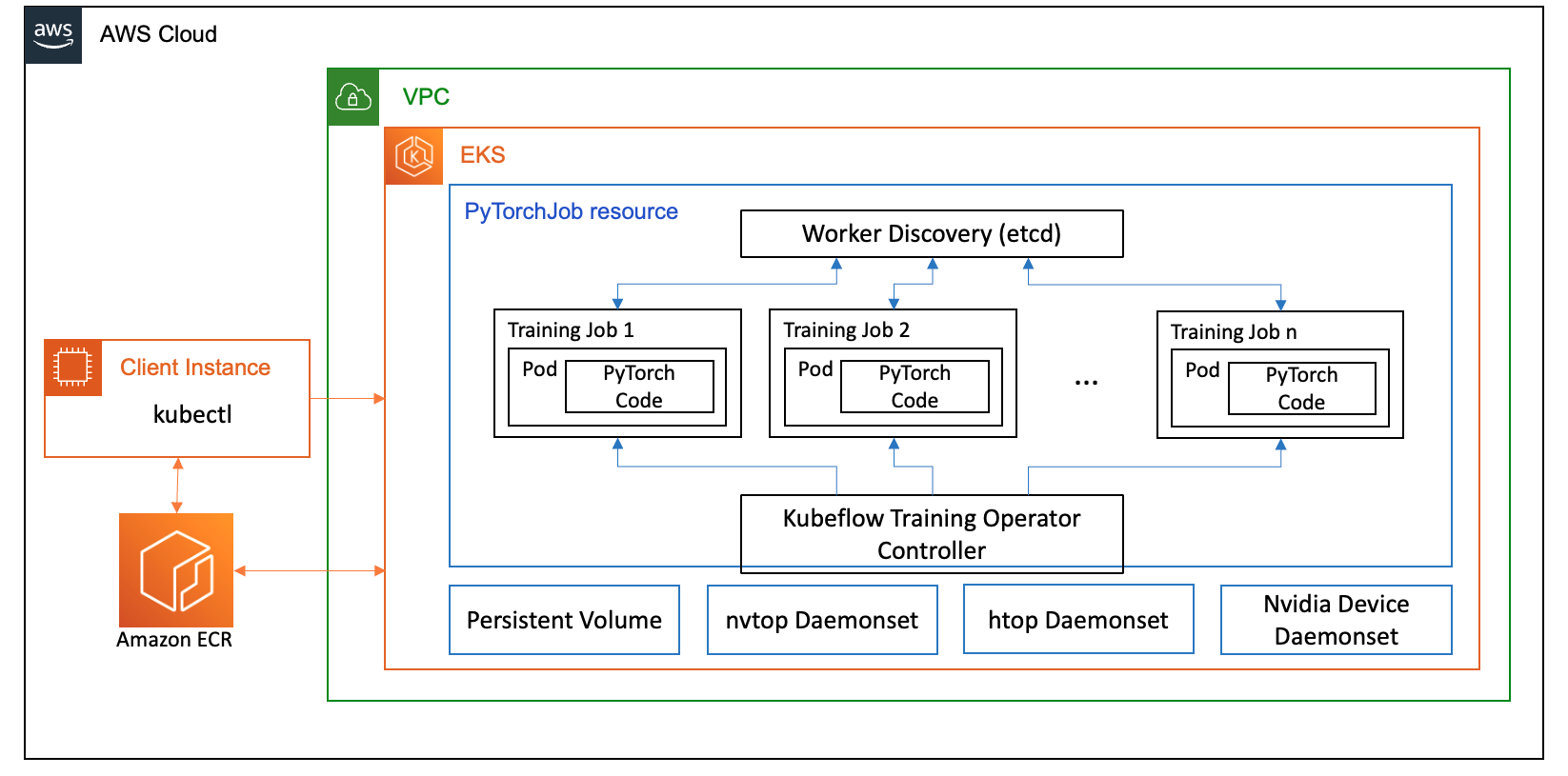

Visão geral da solução

Nesta postagem, configuramos um cluster de computação usando Amazon EKS, que é um serviço gerenciado para executar Kubernetes na nuvem AWS e em data centers locais. Muitos clientes estão adotando o Amazon EKS para executar cargas de trabalho de IA/ML baseadas em Kubernetes, aproveitando seu desempenho, escalabilidade, confiabilidade e disponibilidade, bem como suas integrações com redes, segurança e outros serviços da AWS.

Para nosso caso de uso FSDP, usamos o Operador de treinamento Kubeflow no Amazon EKS, que é um projeto nativo do Kubernetes que facilita o ajuste fino e o treinamento distribuído escalável para modelos de ML. Ele oferece suporte a várias estruturas de ML, incluindo PyTorch, que você pode usar para implantar e gerenciar trabalhos de treinamento PyTorch em escala.

Utilizando o recurso personalizado PyTorchJob do Kubeflow Training Operator, executamos jobs de treinamento no Kubernetes com um número configurável de réplicas de trabalho que nos permite otimizar a utilização de recursos.

A seguir estão alguns componentes do operador de treinamento que desempenham uma função em nosso caso de uso de ajuste fino do Llama2:

- Um controlador Kubernetes centralizado que orquestra trabalhos de treinamento distribuídos para PyTorch.

- PyTorchJob, um recurso personalizado do Kubernetes para PyTorch, fornecido pelo Kubeflow Training Operator, para definir e implantar trabalhos de treinamento Llama2 no Kubernetes.

- etcd, que está relacionado à implementação do mecanismo de encontro para coordenação do treinamento distribuído de modelos PyTorch. Esse

etcdO servidor, como parte do processo de encontro, facilita a coordenação e sincronização dos trabalhadores participantes durante o treinamento distribuído.

O diagrama a seguir ilustra a arquitetura da solução.

A maioria dos detalhes será abstraída pelos scripts de automação que usamos para executar o exemplo Llama2.

Usamos as seguintes referências de código neste caso de uso:

O que é Llama2?

Llama2 é um LLM pré-treinado em 2 trilhões de tokens de texto e código. É um dos maiores e mais poderosos LLMs disponíveis atualmente. Você pode usar o Llama2 para uma variedade de tarefas, incluindo processamento de linguagem natural (PNL), geração de texto e tradução. Para obter mais informações, consulte Primeiros passos com Lhama.

Llama2 está disponível em três tamanhos de modelo diferentes:

- Lhama2-70b – Este é o maior modelo Llama2, com 70 bilhões de parâmetros. É o modelo Llama2 mais potente e pode ser utilizado para as tarefas mais exigentes.

- Lhama2-13b – Este é um modelo Llama2 de tamanho médio, com 13 bilhões de parâmetros. É um bom equilíbrio entre desempenho e eficiência e pode ser usado para uma variedade de tarefas.

- Lhama2-7b – Este é o menor modelo Llama2, com 7 bilhões de parâmetros. É o modelo Llama2 mais eficiente e pode ser utilizado para tarefas que não exigem o mais alto nível de desempenho.

Esta postagem permite ajustar todos esses modelos no Amazon EKS. Para fornecer uma experiência simples e reproduzível de criação de um cluster EKS e execução de jobs FSDP nele, usamos o aws-do-eks projeto. O exemplo também funcionará com um cluster EKS pré-existente.

Um passo a passo com script está disponível em GitHub para uma experiência fora da caixa. Nas seções a seguir, explicamos o processo de ponta a ponta com mais detalhes.

Provisione a infraestrutura da solução

Para os experimentos descritos neste post, usamos clusters com nós p4de (GPU A100) e p5 (GPU H100).

Cluster com nós p4de.24xlarge

Para nosso cluster com nós p4de, usamos o seguinte eks-gpu-p4de-odcr.yaml script:

utilização extl e o manifesto do cluster anterior, criamos um cluster com nós p4de:

Cluster com nós p5.48xlarge

Um modelo terraform para um cluster EKS com nós P5 está localizado a seguir GitHub repo.

Você pode personalizar o cluster por meio do variáveis.tf arquivo e, em seguida, crie-o por meio da CLI do Terraform:

Você pode verificar a disponibilidade do cluster executando um comando kubectl simples:

O cluster estará íntegro se a saída deste comando mostrar o número esperado de nós no status Pronto.

Implantar pré-requisitos

Para executar o FSDP no Amazon EKS, usamos o PyTorchJob recurso personalizado. Isso requer etc. e Operador de treinamento Kubeflow como pré-requisitos.

Implante o etcd com o seguinte código:

Implante o Kubeflow Training Operator com o seguinte código:

Crie e envie uma imagem de contêiner FSDP para o Amazon ECR

Use o código a seguir para criar uma imagem de contêiner FSDP e enviá-la para Registro do Amazon Elastic Container (Amazon ECR):

Crie o manifesto FSDP PyTorchJob

Insira seu Símbolo de rosto abraçado no seguinte trecho antes de executá-lo:

Configure seu PyTorchJob com .env arquivo ou diretamente em suas variáveis de ambiente conforme abaixo:

Gere o manifesto PyTorchJob usando o modelo fsdp e gerar.sh script ou crie-o diretamente usando o script abaixo:

Execute o PyTorchJob

Execute o PyTorchJob com o seguinte código:

Você verá o número especificado de pods de trabalho FDSP criados e, após extrair a imagem, eles entrarão no estado Em execução.

Para ver o status do PyTorchJob, use o seguinte código:

Para interromper o PyTorchJob, use o seguinte código:

Após a conclusão de um trabalho, ele precisa ser excluído antes de iniciar uma nova execução. Também observamos que a exclusão doetcdpod e deixá-lo reiniciar antes de iniciar um novo trabalho ajuda a evitar um RendezvousClosedError.

Dimensionar o cluster

É possível repetir as etapas anteriores de criação e execução de tarefas enquanto varia o número e o tipo de instância de nós do trabalhador no cluster. Isso permite produzir gráficos de escala como o mostrado anteriormente. Em geral, você verá uma redução no consumo de memória da GPU, uma redução no tempo de época e um aumento na taxa de transferência quando mais nós forem adicionados ao cluster. O gráfico anterior foi produzido através da realização de vários experimentos usando um grupo de nós p5 variando de 1 a 16 nós em tamanho.

Observe a carga de trabalho de treinamento do FSDP

A observabilidade das cargas de trabalho generativas de inteligência artificial é importante para permitir a visibilidade dos seus trabalhos em execução, bem como ajudar a maximizar a utilização dos seus recursos computacionais. Nesta postagem, usamos algumas ferramentas de observabilidade nativas e de código aberto do Kubernetes para essa finalidade. Essas ferramentas permitem rastrear erros, estatísticas e comportamento do modelo, tornando a observabilidade da IA uma parte crucial de qualquer caso de uso de negócios. Nesta secção, mostramos várias abordagens para observar os trabalhos de formação do FSDP.

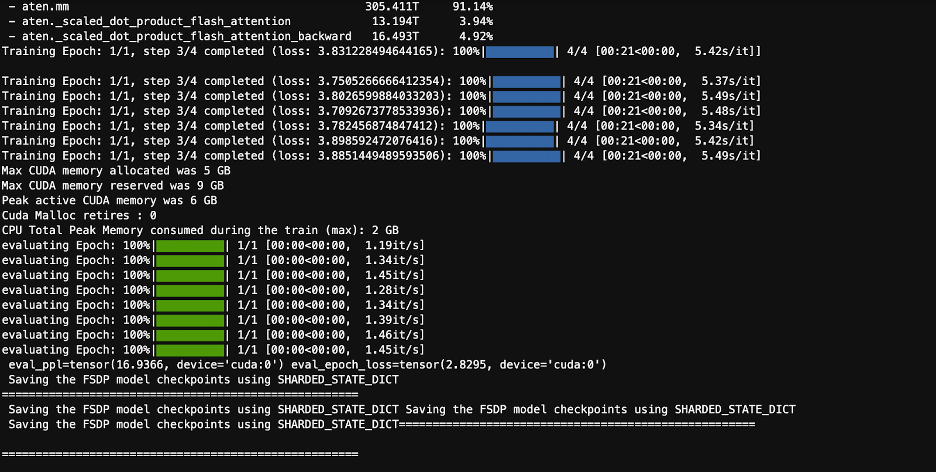

Registros de pod de trabalho

No nível mais básico, você precisa ver os registros dos seus pods de treinamento. Isso pode ser feito facilmente usando comandos nativos do Kubernetes.

Primeiro, recupere uma lista de pods e localize o nome daquele cujos registros você deseja ver:

Em seguida, visualize os registros do pod selecionado:

Apenas um log de pod de trabalhador (líder eleito) listará as estatísticas gerais do trabalho. O nome do pod líder eleito está disponível no início de cada log do pod de trabalho, identificado pela chave master_addr=.

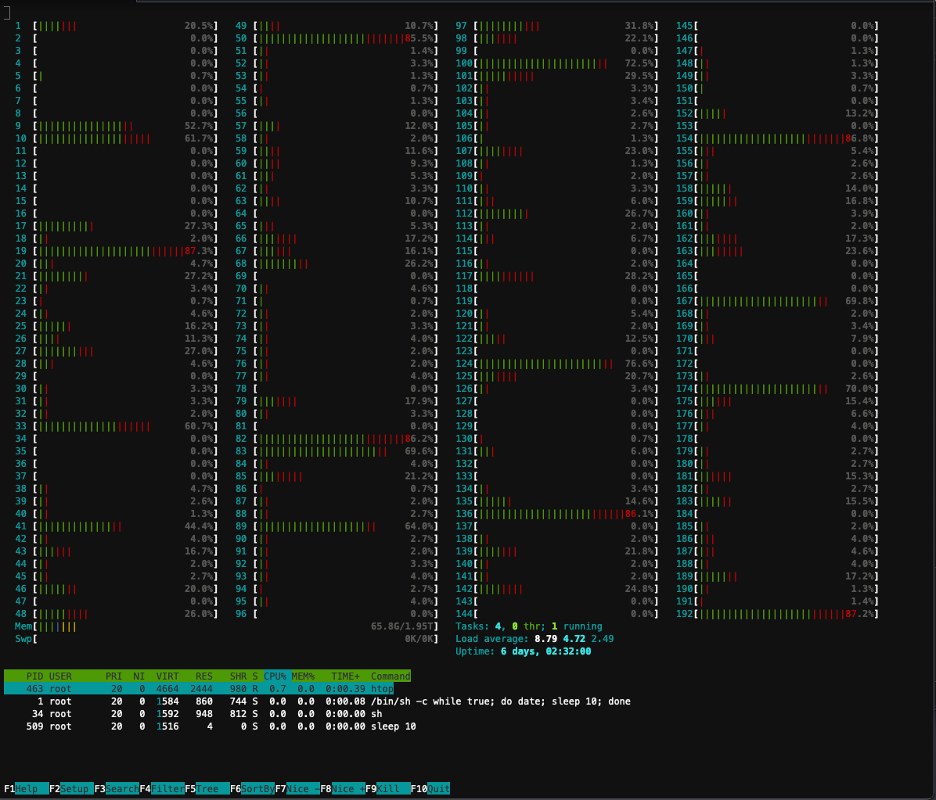

Utilização da CPU

Cargas de trabalho de treinamento distribuídas exigem recursos de CPU e GPU. Para otimizar estas cargas de trabalho, é importante compreender como estes recursos são utilizados. Felizmente, estão disponíveis alguns excelentes utilitários de código aberto que ajudam a visualizar a utilização da CPU e GPU. Para visualizar a utilização da CPU, você pode usarhtop. Se seus pods de trabalho contiverem esse utilitário, você poderá usar o comando abaixo para abrir um shell em um pod e, em seguida, executarhtop.

Alternativamente, você pode implantar um htopdaemonsetcomo o fornecido a seguir GitHub repo.

Adaemonsetexecutará um pod htop leve em cada nó. Você pode executar qualquer um desses pods e executar ohtopcomando:

A captura de tela a seguir mostra a utilização da CPU em um dos nós do cluster. Nesse caso, estamos analisando uma instância P5.48xlarge, que possui 192 vCPUs. Os núcleos do processador ficam ociosos enquanto os pesos do modelo são baixados e vemos uma utilização crescente enquanto os pesos do modelo são carregados na memória da GPU.

Utilização de GPU

Se onvtoputilitário está disponível em seu pod, você pode executá-lo usando abaixo e depois executarnvtop.

Alternativamente, você pode implantar um nvtopdaemonsetcomo o fornecido a seguir GitHub repo.

Isso executará umnvtoppod em cada nó. Você pode executar em qualquer um desses pods e executarnvtop:

A captura de tela a seguir mostra a utilização da GPU em um dos nós do cluster de treinamento. Neste caso, estamos diante de uma instância P5.48xlarge, que possui 8 GPUs NVIDIA H100. As GPUs ficam ociosas enquanto os pesos do modelo são baixados, então a utilização da memória da GPU aumenta à medida que os pesos do modelo são carregados na GPU e a utilização da GPU aumenta para 100% enquanto as iterações de treinamento estão em andamento.

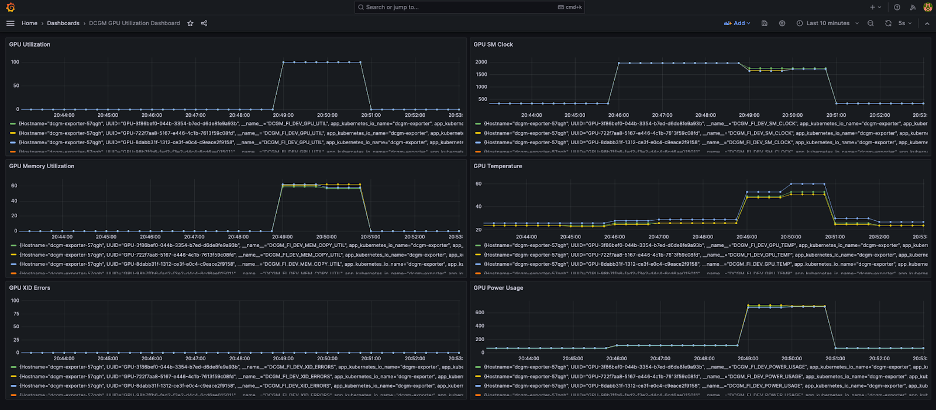

Painel Grafana

Agora que você entende como seu sistema funciona no nível do pod e do nó, também é importante observar as métricas no nível do cluster. Métricas de utilização agregadas podem ser coletadas pelo NVIDIA DCGM Exporter e Prometheus e visualizadas no Grafana.

Um exemplo de implantação do Prometheus-Grafana está disponível a seguir GitHub repo.

Um exemplo de implantação do exportador DCGM está disponível a seguir GitHub repo.

Um painel simples do Grafana é mostrado na captura de tela a seguir. Ele foi construído selecionando as seguintes métricas DCGM: DCGM_FI_DEV_GPU_UTIL, DCGM_FI_MEM_COPY_UTIL, DCGM_FI_DEV_XID_ERRORS, DCGM_FI_DEV_SM_CLOCK, DCGM_FI_DEV_GPU_TEMP e DCGM_FI_DEV_POWER_USAGE. O painel pode ser importado para o Prometheus de GitHub.

O painel a seguir mostra uma execução de um trabalho de treinamento de época única Llama2 7b. Os gráficos mostram que à medida que o clock do multiprocessador de streaming (SM) aumenta, o consumo de energia e a temperatura das GPUs também aumentam, juntamente com a utilização da GPU e da memória. Você também pode ver que não houve erros de XID e que as GPUs estavam íntegras durante esta execução.

Desde março de 2024, a observabilidade da GPU para EKS é suportada nativamente em Insights de contêiner do CloudWatch. Para habilitar essa funcionalidade, basta implantar o complemento CloudWatch Observability em seu cluster EKS. Em seguida, você poderá navegar pelas métricas em nível de pod, nó e cluster por meio de painéis pré-configurados e personalizáveis no Container Insights.

limpar

Se você criou seu cluster usando os exemplos fornecidos neste blog, poderá executar o código a seguir para excluir o cluster e todos os recursos associados a ele, incluindo a VPC:

Para exctl:

Para terraforma:

Próximos recursos

Espera-se que o FSDP inclua um recurso de fragmentação por parâmetro, com o objetivo de melhorar ainda mais o consumo de memória por GPU. Além disso, o desenvolvimento contínuo do suporte FP8 visa melhorar o desempenho do FSDP nas GPUs H100. Finalmente, quando o FSDP é integrado comtorch.compile, esperamos ver melhorias adicionais de desempenho e ativação de recursos como checkpoint de ativação seletiva.

Conclusão

Nesta postagem, discutimos como o FSDP reduz o consumo de memória em cada GPU, permitindo o treinamento de modelos maiores com mais eficiência e alcançando escala quase linear no rendimento. Demonstramos isso por meio de uma implementação passo a passo do treinamento de um modelo Llama2 usando Amazon EKS em instâncias P4de e P5 e usamos ferramentas de observabilidade como kubectl, htop, nvtop e dcgm para monitorar logs, bem como a utilização de CPU e GPU.

Incentivamos você a aproveitar as vantagens do PyTorch FSDP para seus próprios trabalhos de treinamento LLM. Comece em aws-do-fsdp.

Sobre os autores

Kanwaljit Khurmi é arquiteto principal de soluções de IA/ML na Amazon Web Services. Ele trabalha com clientes da AWS para fornecer orientação e assistência técnica, ajudando-os a melhorar o valor de suas soluções de machine learning na AWS. A Kanwaljit é especializada em ajudar clientes com computação distribuída e em contêineres e aplicativos de aprendizado profundo.

Kanwaljit Khurmi é arquiteto principal de soluções de IA/ML na Amazon Web Services. Ele trabalha com clientes da AWS para fornecer orientação e assistência técnica, ajudando-os a melhorar o valor de suas soluções de machine learning na AWS. A Kanwaljit é especializada em ajudar clientes com computação distribuída e em contêineres e aplicativos de aprendizado profundo.

Alex Iankoulski é arquiteto de soluções principal, aprendizado de máquina autogerenciado na AWS. Ele é um engenheiro full-stack de software e infraestrutura que gosta de fazer um trabalho profundo e prático. Em sua função, ele se concentra em ajudar os clientes com conteinerização e orquestração de cargas de trabalho de ML e IA em serviços AWS alimentados por contêiner. Ele também é o autor do código aberto fazer estrutura e um capitão do Docker que adora aplicar tecnologias de contêineres para acelerar o ritmo da inovação e, ao mesmo tempo, solucionar os maiores desafios do mundo.

Alex Iankoulski é arquiteto de soluções principal, aprendizado de máquina autogerenciado na AWS. Ele é um engenheiro full-stack de software e infraestrutura que gosta de fazer um trabalho profundo e prático. Em sua função, ele se concentra em ajudar os clientes com conteinerização e orquestração de cargas de trabalho de ML e IA em serviços AWS alimentados por contêiner. Ele também é o autor do código aberto fazer estrutura e um capitão do Docker que adora aplicar tecnologias de contêineres para acelerar o ritmo da inovação e, ao mesmo tempo, solucionar os maiores desafios do mundo.

Ana Simões é especialista principal em aprendizado de máquina, ML Frameworks na AWS. Ela oferece suporte aos clientes que implantam IA, ML e IA generativa em larga escala na infraestrutura de HPC na nuvem. Ana se concentra em apoiar os clientes para obter desempenho de preço para novas cargas de trabalho e casos de uso para IA generativa e aprendizado de máquina.

Ana Simões é especialista principal em aprendizado de máquina, ML Frameworks na AWS. Ela oferece suporte aos clientes que implantam IA, ML e IA generativa em larga escala na infraestrutura de HPC na nuvem. Ana se concentra em apoiar os clientes para obter desempenho de preço para novas cargas de trabalho e casos de uso para IA generativa e aprendizado de máquina.

Hamid Shojanazeri é engenheiro parceiro da PyTorch trabalhando em código aberto, otimização de modelos de alto desempenho e treinamento distribuído (PSDB) e inferência. Ele é o co-criador de receita de lhama e contribuidor para TorchServe. O seu principal interesse é melhorar a relação custo-benefício, tornando a IA mais acessível à comunidade em geral.

Hamid Shojanazeri é engenheiro parceiro da PyTorch trabalhando em código aberto, otimização de modelos de alto desempenho e treinamento distribuído (PSDB) e inferência. Ele é o co-criador de receita de lhama e contribuidor para TorchServe. O seu principal interesse é melhorar a relação custo-benefício, tornando a IA mais acessível à comunidade em geral.

Menos Wright é um AI/Engenheiro Parceiro em PyTorch. Ele trabalha em kernels Triton/CUDA (Acelerando Dequant com decomposição de trabalho SplitK); otimizadores paginados, de streaming e quantizados; e PyTorch distribuído (PyTorchFSDP).

Menos Wright é um AI/Engenheiro Parceiro em PyTorch. Ele trabalha em kernels Triton/CUDA (Acelerando Dequant com decomposição de trabalho SplitK); otimizadores paginados, de streaming e quantizados; e PyTorch distribuído (PyTorchFSDP).

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/scale-llms-with-pytorch-2-0-fsdp-on-amazon-eks-part-2/

- :tem

- :é

- :onde

- ][p

- $UP

- 1

- 10

- 100

- 12

- 13

- 16

- 2024

- 28

- 500

- 7

- 70

- 8

- 80

- 800

- a

- Capaz

- Sobre

- abstraído

- acelerar

- acelerador

- acessível

- Conta

- precisão

- Alcançar

- alcançar

- em

- ativação

- Adicionar

- adicionado

- Adicional

- Adicionalmente

- endereço

- Adiciona

- Adotando

- Vantagem

- Depois de

- agregado

- AI

- AI / ML

- Ajuda

- Visando

- visa

- Todos os Produtos

- permitir

- permite

- tb

- sempre

- Amazon

- Amazon EC2

- Amazon Web Services

- quantidade

- an

- Ana

- e

- e infra-estrutura

- qualquer

- app

- aplicações

- Aplicar

- Aplicando

- se aproxima

- arquitetura

- SOMOS

- artificial

- inteligência artificial

- AS

- Assistência

- assistentes

- associado

- At

- autor

- Automação

- disponibilidade

- disponível

- evitar

- AWS

- Equilíbrio

- barreira

- bater

- basic

- BE

- antes

- Começo

- comportamento

- ser

- abaixo

- Melhor

- entre

- O maior

- bilhão

- Blog

- ambos

- quebra

- mais amplo

- construir

- construído

- negócio

- mas a

- by

- CAN

- capacidades

- Capacidade

- casas

- casos

- CAT

- Centros

- centralizada

- desafiar

- desafios

- de cores

- charts

- cli

- Relógio

- Na nuvem

- Agrupar

- código

- colabora

- vem

- Comunicação

- comunidade

- comparado

- completar

- complexidade

- componentes

- computação

- Computar

- computador

- Visão de Computador

- computação

- condutor

- Configuração

- não contenho

- Recipiente

- Containers

- conteúdo

- Criação de conteúdo

- contexto

- continuação

- contribuinte

- controlador

- coordenando

- coordenação

- cópia

- núcleo

- Custo

- crio

- criado

- Criar

- criação

- crucial

- Atual

- personalizadas

- Clientes

- personalizável

- personalizar

- painel de instrumentos

- painéis

- dados,

- centros de dados

- conjuntos de dados

- DDP

- profundo

- deep learning

- definir

- exigente

- demonstrar

- demonstraram

- demonstra

- implantar

- Implantação

- desenvolvimento

- descreve

- descrito

- detalhe

- detalhado

- detalhes

- Desenvolvimento

- diagrama

- diferente

- diretamente

- discutir

- discutido

- distribuído

- computação distribuída

- treinamento distribuído

- do

- Estivador

- feito

- não

- download

- baixados

- dramaticamente

- desenhar

- dois

- durante

- cada

- Mais cedo

- facilidade

- facilmente

- eficiência

- eficiente

- eficientemente

- eleito

- abraçando

- permitir

- habilitação

- permite

- permitindo

- encorajar

- final

- end-to-end

- engenheiro

- Engenharia

- aumentar

- Entrar

- Todo

- Meio Ambiente

- época

- erros

- exemplo

- exemplos

- executar

- esperado

- vasta experiência

- experimentos

- Explicação

- Rosto

- facilita

- mais rápido

- Característica

- Funcionalidades

- poucos

- Figura

- Envie o

- Finalmente

- caber

- flexível

- concentra-se

- seguinte

- Pegada

- Escolha

- Felizmente

- enquadramentos

- da

- cheio

- totalmente

- funcionalidade

- mais distante

- Geral

- geração

- generativo

- IA generativa

- ter

- GitHub

- Bom estado, com sinais de uso

- GPU

- GPUs

- gradientes

- gráficos

- ótimo

- grandemente

- Grupo

- Locatário

- Visitante Mensagem

- orientações

- mãos em

- he

- saudável

- ajudar

- ajuda

- ajuda

- alta performance

- mais

- sua

- detém

- esperança

- Como funciona o dobrador de carta de canal

- Como Negociar

- Contudo

- hpc

- HTML

- http

- HTTPS

- identificado

- inativo

- if

- ilustra

- imagem

- implementação

- importante

- melhorar

- melhorias

- in

- incluir

- Incluindo

- Crescimento

- aumentou

- Aumenta

- cada vez mais

- info

- INFORMAÇÕES

- Infraestrutura

- Inovação

- insights

- instância

- em vez disso

- integrado

- integrações

- Inteligência

- interesse

- para dentro

- IT

- iterações

- ESTÁ

- Trabalho

- Empregos

- jpeg

- jpg

- json

- apenas por

- Chave

- Tipo

- Kubeflow

- Rótulos

- língua

- grande

- em grande escala

- Maior

- maior

- Sobrenome

- de lançamento

- líder

- aprendizagem

- menos

- de locação

- Nível

- Biblioteca

- leve

- como

- gostos

- limitação

- Limitado

- limites

- linear

- Lista

- LLM

- localizado

- log

- entrar

- olhar

- procurando

- ama

- máquina

- aprendizado de máquina

- a Principal

- Fazendo

- gerencia

- manejável

- gerenciados

- maneira

- muitos

- Março

- Março de 2024

- maximizando

- Posso..

- mecanismo

- Memória

- Meta

- metadados

- Métrica

- misto

- ML

- modelo

- modelos

- EQUIPAMENTOS

- Monitore

- mais

- a maioria

- nome

- nativamente

- natural

- Processamento de linguagem natural

- Perto

- você merece...

- Cria

- rede

- networking

- Novo

- PNL

- não

- nó

- nós

- número

- Nvidia

- of

- oferecer

- Oferece

- on

- ONE

- contínuo

- só

- para

- aberto

- open source

- operação

- operador

- otimização

- otimizações

- Otimize

- or

- orquestração

- OS

- Outros

- A Nossa

- Fora

- saída

- global

- Superar

- em cima

- próprio

- Paz

- Paralelo

- parâmetros

- parte

- participando

- parceiro

- passar

- caminho

- para

- atuação

- plano

- platão

- Inteligência de Dados Platão

- PlatãoData

- Jogar

- Popular

- Publique

- poder

- poderoso

- precedente

- pré-requisitos

- preservando

- anterior

- Diretor

- Prévio

- processo

- processos

- em processamento

- Subcontratante

- produzir

- Produzido

- projeto

- comprovado

- fornecer

- fornecido

- puxando

- propósito

- Empurrar

- pytorch

- qualidade

- alcance

- pronto

- reduz

- redução

- referir

- referências

- a que se refere

- região

- registro

- relacionado

- confiabilidade

- repetir

- responder

- pedidos

- requerer

- Requisitos

- exige

- pesquisa

- recurso

- Recursos

- resultar

- Resultados

- ascensão

- uma conta de despesas robusta

- Tipo

- Execute

- corrida

- AMPLIAR

- escalável

- Escala

- dimensionamento

- escrita

- Scripts

- sem problemas

- Seção

- seções

- segurança

- Vejo

- selecionado

- selecionando

- seletivo

- Série

- serviço

- Serviços

- conjunto

- vários

- fragmentado

- raspando

- ela

- concha

- rede de apoio social

- mostrar

- mostrando

- Shows

- de forma considerável

- semelhante

- simples

- simplicidade

- simplifica

- solteiro

- Tamanho

- tamanhos

- Fatia

- menor

- fragmento

- Software

- solução

- Soluções

- Resolvendo

- alguns

- fonte

- especialista

- especializada

- especificada

- velocidades

- picos

- pilha

- começado

- Estado

- Unidos

- estatística

- Status

- Passos

- Ainda

- Dê um basta

- estratégias

- de streaming

- tal

- terno

- ajuda

- Suportado

- Apoiar

- suportes

- Sincronização

- SYS

- .

- Tire

- tomar

- Target

- tarefas

- Profissionais

- Dados Técnicos:

- técnica

- técnicas

- Tecnologias

- modelo

- Terraform

- texto

- que

- A

- deles

- Eles

- então

- Lá.

- Este

- deles

- isto

- aqueles

- três

- Através da

- Taxa de transferência

- tempo

- demorado

- para

- hoje

- juntos

- Tokens

- ferramentas

- pista

- Trem

- treinado

- Training

- Tradução

- Trilhão

- verdadeiro

- afinação

- dois

- tipo

- Em última análise

- compreender

- a caminho

- us

- usar

- caso de uso

- usava

- usos

- utilização

- utilitários

- utilidade

- utilizado

- valor

- variedade

- vário

- variando

- verificar

- versão

- muito

- via

- Ver

- vendo

- Virtual

- visibilidade

- visão

- visualizar

- volumes

- Passo a passo

- queremos

- foi

- we

- web

- serviços web

- BEM

- foram

- quando

- qual

- enquanto

- QUEM

- precisarão

- de

- dentro

- Atividades:

- trabalhador

- trabalhadores

- de gestão de documentos

- trabalhar

- trabalho

- do mundo

- embrulho

- yaml

- anos

- Vocês

- investimentos

- zefirnet