Hoje a Apple finalmente revelou o Vision Pro, seu headset AR/VR de US$ 3500 que será lançado em 2024. Aqui está um resumo de todas as suas especificações e recursos.

Visão Profissional é um fone de ouvido de última geração com a mais alta resolução e a maioria dos sensores já encontrados em um produto AR/VR. Ele apresenta novos recursos nunca antes lançados e seu visionOS repensa a linha entre 2D, AR e VR.

Design leve com bateria conectada

O Vision Pro possui uma estrutura de liga de alumínio leve e personalizada que suporta uma placa frontal curva de vidro laminado “formado tridimensionalmente” para obter um design fino.

O que também mantém o Vision Pro leve é a separação da bateria do fone de ouvido. Alguns outros fones de ouvido como Meta Quest Profissional e Pico 4 têm a bateria na parte traseira da alça, mas o design da Apple tira tudo da sua cabeça com uma bateria externa conectada a um conector magnético à esquerda da faixa para a cabeça.

A Apple afirma que a bateria externa durou 2 horas nas seguintes condições de teste:

Reprodução de vídeo, navegação na Internet, captura de vídeo espacial e FaceTime. Reprodução de vídeo testada em conjunto com um ambiente, usando conteúdo de filme 2D adquirido no app Apple TV. Navegação na Internet testada em 20 sites populares. FaceTime testado entre duas unidades Apple Vision Pro com Personas habilitado. Testado com Wi-Fi associado a uma rede.

Como alternativa, o Vision Pro pode ser usado perpetuamente sem bateria, conectando-o a uma fonte de alimentação. A Apple ainda não entrou em detalhes sobre quais fontes são suportadas ou se o adaptador para isso está incluído.

Uma infinidade de câmeras e sensores

O Vision Pro possui um total de doze câmeras, quatro sensores de profundidade, um sensor LiDAR e seis microfones.

AR de passagem

Seis das doze câmeras estão sob o vidro frontal.

Dois desses seis capturam cores de alta resolução para fornecer a visão do mundo real do fone de ouvido, transmitindo “mais de um bilhão de pixels coloridos por segundo”.

As outras quatro câmeras frontais realizam rastreamento posicional do headset e outras tarefas gerais de visão computacional.

Rastreamento manual

Uma das finalidades dos quatro sensores de profundidade é o rastreamento manual. A Apple descreve a qualidade do rastreamento manual como “tão precisa que libera completamente suas mãos da necessidade de controladores de hardware desajeitados”.

O Vision Pro não possui nenhum tipo de controlador rastreado, embora suporte jogos 2D em uma tela virtual com um gamepad.

Malha de ambiente

O sensor LiDAR é usado para realizar “mapeamento 3D em tempo real” do seu ambiente em conjunto com as outras câmeras frontais.

A Apple afirma que o Vision Pro tem uma “compreensão detalhada” de pisos, paredes, superfícies e móveis, que os aplicativos podem aproveitar. Um exemplo dado pela Apple foram objetos virtuais lançando sombras em mesas reais, mas isso apenas arranha a superfície do que deveria ser possível.

Rastreamento facial e ocular para FaceTime e muito mais

Duas câmeras voltadas para baixo rastreiam seu rosto, enquanto quatro câmeras infravermelhas internas ao lado delas rastreiam seus olhos, auxiliadas por um anel de iluminadores LED ao redor das lentes.

O rastreamento ocular do Vision Pro serve a três propósitos: autenticação, renderização desejada e direcionamento de seu avatar FaceTime.

A Apple está chamando sua nova autenticação de digitalização de íris de OpticID, seguindo o esquema de nomenclatura de TouchID e FaceID de seus outros dispositivos. OpticID é como você desbloqueia o Vision Pro e também funciona com compras do Apple Pay e preenchimento automático de senha. Tal como acontece com TouchID e FaceID, os dados biométricos que alimentam o OpticID são processados no dispositivo por um processador Secure Enclave.

A renderização foveada é uma técnica em que apenas a pequena região da tela que seus olhos estão vendo no momento é renderizada em resolução total, liberando assim o desempenho, já que o restante tem resolução mais baixa. Os recursos liberados da GPU podem ser usados para melhorar o desempenho, aumentar a resolução de renderização ou aumentar as configurações gráficas. Ele aproveita o fato de que nossos olhos só veem em alta resolução bem no centro da fóvea.

Por fim, o rastreamento ocular combina-se com as câmeras voltadas para baixo para rastrear suas expressões faciais em tempo real para conduzir seu FaceTime Persona, a versão da Apple de avatares fotorrealistas. Meta foi exibindo pesquisas nesse sentido há mais de quatro anos, mas parece que a Apple será a primeira a lançar – embora não com a mesma qualidade da pesquisa da Meta.

Chip R1 para latência ultrabaixa

Para fundir a entrada de todas essas câmeras, sensores e microfones, a Apple desenvolveu um chip personalizado chamado R1.

A Apple afirma que o R1 “praticamente elimina o atraso, transmitindo novas imagens para os monitores em 12 milissegundos”.

Para efeito de comparação, o fundador da startup francesa de fones de ouvido Lynx reivindicações A latência de passagem do Meta Quest Pro é de 35 a 60 milissegundos. Não está claro se esta é uma comparação igual.

Coroa Digital AR-VR

O Vision Pro possui apenas dois controles físicos, ambos na parte superior. Um botão para capturar “vídeos espaciais” e “fotos espaciais” a qualquer momento e uma Coroa Digital.

Pressionar a Digital Crown abre a visualização inicial do sistema. Mas girá-lo controla seu nível de imersão, desde AR total até VR total. Se você for até a metade, por exemplo, verá VR na sua frente e AR atrás de você.

Em headsets existentes como Meta Quest e Pico 4, o passthrough é uma opção de alternância, o que significa que você deve escolher entre imersão total ou nenhuma imersão. Em vez disso, a Apple deseja permitir que você escolha exatamente o quão envolvido estará com o ambiente real.

Visão e Conscientização Pessoal

Um recurso totalmente exclusivo do Vision Pro é um display externo que mostra seus olhos para outras pessoas na sala e indica o quanto você está ciente delas. A Apple chama essa tecnologia de EyeSight.

Quando você está em um aplicativo de AR, o EyeSight mostra um padrão colorido na frente de seus olhos, e quando você está em um aplicativo de VR, ele mostra apenas o padrão com seus olhos invisíveis.

Quando alguém se aproxima de você, o Vision Pro mostra um recorte da pessoa e o EyeSight revela seus olhos para ela.

A Apple descreveu garantir que você “nunca fique isolado das pessoas ao seu redor” como um de seus “objetivos básicos de design” para o Vision Pro, e a empresa vê isso como um diferenciador claro para fones de ouvido totalmente opacos como Meta Quests.

Telas micro OLED com 23 milhões de pixels no total

O Vision Pro apresenta painéis micro-OLED duplos com densidade de pixels sem precedentes. A Apple diz que cada um é “do tamanho de um selo postal”, mas juntos têm 23 milhões de pixels, menos de havia rumores.

A Apple não revelou a resolução exata, mas um total de 23 milhões de pixels sugeriria uma resolução por olho de cerca de 3400×3400 para uma proporção de aspecto quadrada, ou cerca de 3200×3600 para a proporção de 9:10 normalmente usada em fones de ouvido. No entanto, não sabemos a proporção exata no Vision Pro.

A Apple confirmou que os monitores do Vision Pro suportam ampla gama de cores e alta faixa dinâmica, mas não revelou especificações detalhadas como brilho máximo.

Chip M2 para desempenho ‘inigualável’

O Vision Pro é alimentado pelo mesmo chip Apple Silicon M2 usado em Macs recentes.

A Apple afirma que isso oferece “desempenho autônomo incomparável” e permite que o Vision Pro “mantenha uma temperatura confortável e funcione virtualmente silencioso”.

Comparado com o rumores especificações da próxima geração do chipset Qualcomm Snapdragon Meta-Quest 3 usará, o M2 da Apple deve oferecer desempenho de CPU single-threaded cerca de 25% mais rápido, multi-threaded 75% mais rápido e cerca de 15% mais potência de GPU.

No entanto, sem saber as velocidades de clock exatas dos processadores em cada fone de ouvido, esta é apenas uma comparação muito aproximada.

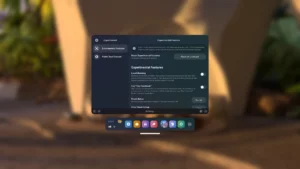

visionOS com controle manual e ocular

visionOS é o “sistema operacional espacial” personalizado da Apple para Vision Pro e, presumivelmente, também para futuros headsets da linha Vision.

A Apple descreve o visionOS como “familiar, mas inovador”. Ele apresenta aplicativos 2D flutuantes que você percorre com um movimento dos dedos. Você seleciona itens de menu apenas olhando para eles e usa os dedos para clicar.

Muitos dos aplicativos e serviços originais da Apple estão disponíveis no visionOS, incluindo Notas, Mensagens, Safari, Keynote, Fotos, FaceTime e Apple Music.

Em vez de apenas existirem em seu quadro 2D, muitos dos aplicativos da Apple “tornam-se espaciais”, ocupando espaço ao seu redor. Nas chamadas em grupo do FaceTime, por exemplo, a visualização da webcam de cada pessoa torna-se seu próprio retângulo flutuante, com áudio espacial vindo de cada pessoa. A Apple também deu o exemplo de ser capaz de extrair modelos 3D de mensagens para o espaço real.

O Vision Pro também permite expandir a tela do seu Mac para uma enorme tela virtual sem fio, apenas olhando para ele.

Um dos principais focos do visionOS é assistir filmes e programas de TV em uma enorme tela virtual, incluindo suporte para visualização de filmes 3D da biblioteca da Apple com profundidade.

Áudio espacial Ray Tracing personalizado

O Vision Pro possui “pods de áudio” na lateral, cada um com dois drivers. A Apple o descreve como o “sistema de áudio espacial mais avançado de todos os tempos”.

Se você tiver um iPhone com sensor TrueDepth FaceID, poderá escanear seu rosto para ativar o áudio espacial personalizado, onde o sistema adaptará o som à geometria de sua cabeça e ouvido para obter o áudio espacial mais preciso possível.

O Vision Pro também usa uma técnica chamada Audio Ray Tracing, onde verifica os recursos e materiais do seu espaço para “combinar com precisão o som com o seu ambiente”. Essa técnica também é usada nos alto-falantes HomePod da Apple.

A Apple afirma que os compradores do Vision Pro estarão “totalmente convencidos de que os sons vêm do ambiente ao seu redor”.

Preço e disponibilidade

O Apple Vision Pro estará à venda nos EUA no início de 2024 a partir de US$ 3500. Estará disponível online e nas Apple Stores.

A Apple diz que mais países receberão o Vision Pro “no final do próximo ano”, mas não revelou exatamente quais países.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoAiStream. Inteligência de Dados Web3. Conhecimento Amplificado. Acesse aqui.

- Cunhando o Futuro com Adryenn Ashley. Acesse aqui.

- Compre e venda ações em empresas PRE-IPO com PREIPO®. Acesse aqui.

- Fonte: https://www.uploadvr.com/apple-vision-pro-specs-features-details/

- :tem

- :é

- :não

- :onde

- $UP

- 10

- 12

- 15%

- 20

- 200

- 2024

- 23

- 2D

- 3d

- 7

- 9

- a

- Capaz

- Sobre

- Alcançar

- avançado

- Todos os Produtos

- permite

- Liga

- tb

- an

- e

- qualquer

- app

- Apple

- música maçã

- Apple Pay

- Aplicativos

- AR

- um aplicativo

- AR / VR

- SOMOS

- por aí

- AS

- aspecto

- associado

- At

- auditivo

- Autenticação

- disponível

- avatar

- Avatares

- consciente

- bateria

- BE

- tornam-se

- torna-se

- antes

- atrás

- ser

- Melhor

- entre

- bilhão

- biométrico

- ambos

- Traz

- Navegando

- mas a

- botão

- compradores

- by

- chamado

- chamada

- chamadas

- câmeras

- CAN

- capturar

- Centralização de

- lasca

- Escolha

- reivindicações

- remover filtragem

- clique

- Relógio

- Fechar

- cor

- COM

- combina

- vem

- confortável

- vinda

- Empresa

- comparação

- completamente

- computador

- Visão de Computador

- condições

- CONFIRMADO

- conjunção

- conteúdo

- controles

- países

- Coroa

- Atualmente

- personalizadas

- dados,

- entregar

- entrega

- profundidade

- descrito

- Design

- detalhado

- detalhes

- desenvolvido

- Dispositivos/Instrumentos

- diferenciador

- digital

- Divulgar

- Ecrã

- monitores

- don

- distância

- Drivers

- condução

- dinâmico

- cada

- Cedo

- elimina

- incorporado

- permitir

- habilitado

- contratado

- inteiramente

- Meio Ambiente

- SEMPRE

- exatamente

- exemplo

- existente

- Expandir

- expressões

- externo

- olho

- rastreamento ocular

- Olhos

- Rosto

- FaceTime

- Facial

- enfrentando

- fato

- familiar

- mais rápido

- Característica

- Funcionalidades

- menos

- Finalmente

- Primeiro nome

- ESTALIDO

- flutuante

- Foco

- seguinte

- Escolha

- formado

- fundador

- quatro

- renderização foveated

- QUADRO

- Francês

- da

- frente

- cheio

- totalmente

- futuro

- Games

- Geral

- geração

- ter

- vidro

- Go

- Objetivos

- ido

- GPU

- gráficos

- inovador

- Grupo

- a meio caminho

- mão

- rastreamento de mão

- mãos

- Hardware

- Ter

- cabeça

- fone

- headsets

- ajudou

- SUA PARTICIPAÇÃO FAZ A DIFERENÇA

- Alta

- dinâmica de alto alcance

- High-End

- mais

- Início

- HORÁRIO

- Como funciona o dobrador de carta de canal

- Contudo

- HTTPS

- enorme

- if

- imagens

- in

- incluído

- Incluindo

- Crescimento

- indicam

- entrada

- em vez disso

- interno

- Internet

- para dentro

- Introduz

- introduzindo

- iPhone

- varredura da íris

- isolado

- IT

- Unid

- ESTÁ

- jpg

- apenas por

- Principal

- Tipo

- Saber

- Conhecimento

- Latência

- mais tarde

- de lançamento

- levou

- esquerda

- lentes

- deixar

- Permite

- Nível

- Alavancagem

- aproveita as

- Biblioteca

- leve

- leve

- como

- Line

- ll

- procurando

- OLHARES

- Baixo

- diminuir

- lince

- M2

- mac

- a manter

- principal

- Fazendo

- muitos

- mapeamento

- Match

- materiais

- significado

- Menu

- mensagens

- Meta

- Meta quest

- meta quest profissional

- milhão

- modelos

- momento

- mais

- a maioria

- filme

- Filmes

- Música

- nomeando

- necessitando

- rede

- nunca

- Novo

- Novos Recursos

- Próximo

- não

- Notas

- agora

- objetos

- of

- WOW!

- on

- ONE

- online

- só

- opaco

- operando

- sistema operativo

- Opção

- or

- Outros

- A Nossa

- Fora

- Acima de

- próprio

- painéis

- festa

- atravessar

- Senha

- padrão

- Pagar

- Pico

- Pessoas

- Realizar

- atuação

- pessoa

- Personalizado

- Fotorrealista

- Fotos

- físico

- Pico

- foto 4

- pixels

- platão

- Inteligência de Dados Platão

- PlatãoData

- jogar

- abundância

- Popular

- possível

- poder

- alimentado

- Powering

- preciso

- justamente

- presentes

- Pro

- Processado

- Subcontratante

- processadores

- Produto

- fornecer

- comprado

- compras

- propósito

- fins

- Qualcomm

- qualcomm snapdragon

- qualidade

- busca

- busca profissional

- missões

- alcance

- relação

- RAY

- RE

- reais

- mundo real

- em tempo real

- recentemente

- região

- representação

- pesquisa

- Resolução

- Recursos

- DESCANSO

- revelar

- Revelado

- Anel

- Quarto

- grosseiramente

- Execute

- s

- Safári

- Promoção

- mesmo

- diz

- digitalização

- exploração

- esquema

- Peneira

- scroll

- Segundo

- seguro

- Vejo

- vê

- sensor

- serve

- Serviços

- Configurações

- NAVIO

- enviado

- rede de apoio social

- mostrar

- Shows

- lado

- Silício

- desde

- SIX

- Tamanho

- pequeno

- snapdragon

- So

- alguns

- Alguém

- Parecer

- fonte

- Fontes

- Espaço

- Espacial

- caixas de som

- óculos

- velocidades

- quadrado

- autônoma

- Comece

- inicialização

- lojas

- de streaming

- sugerir

- ajuda

- Suportado

- Apoiar

- suportes

- superfície

- .

- Tire

- toma

- tomar

- tarefas

- Tecnologia

- teste

- do que

- que

- A

- A linha

- deles

- Eles

- Este

- deles

- isto

- Apesar?

- três

- Através da

- tempo

- para

- juntos

- também

- topo

- Total

- TOTALMENTE

- para

- Traçado

- pista

- Rastreamento

- Passando

- tv

- dois

- tipicamente

- Ultra

- para

- compreensão

- único

- unidades

- destravar

- inigualável

- sem precedente

- UploadVR

- us

- usar

- usava

- usos

- utilização

- muito

- Vídeo

- VÍDEOS

- Ver

- vendo

- Virtual

- praticamente

- visão

- vr

- App VR

- quer

- foi

- assistindo

- Caminho..

- we

- webcam

- sites

- O Quê

- quando

- se

- qual

- enquanto

- Wi-fi

- Largo

- precisarão

- de

- dentro

- sem

- trabalho

- mundo

- seria

- ano

- anos

- ainda

- Vocês

- investimentos

- Youtube

- zefirnet