Recentemente, introduzimos um novo recurso no SDK do Amazon SageMaker Python que permite que os cientistas de dados executem seu código de aprendizado de máquina (ML) criado em seu ambiente de desenvolvedor integrado (IDE) e notebooks preferidos, juntamente com as dependências de tempo de execução associadas como Amazon Sage Maker trabalhos de treinamento com alterações mínimas de código para a experimentação feita localmente. Os cientistas de dados normalmente realizam várias iterações de experimentação em modelos de treinamento e processamento de dados enquanto trabalham em qualquer problema de ML. Eles querem executar esse código ML e realizar a experimentação com facilidade de uso e alteração mínima de código. Treinamento do modelo Amazon SageMaker ajuda os cientistas de dados a executar trabalhos de treinamento em larga escala totalmente gerenciados na infraestrutura de computação da AWS. O SageMaker Training também ajuda os cientistas de dados com ferramentas avançadas, como Depurador do Amazon SageMaker e Profiler para depurar e analisar seus trabalhos de treinamento em larga escala.

Para clientes com orçamentos pequenos, equipes pequenas e prazos apertados, cada novo conceito e linha de código reescrito para execução no SageMaker os torna menos produtivos em suas tarefas principais, ou seja, processamento de dados e modelos de ML de treinamento. Eles querem escrever código uma vez na estrutura de sua escolha e ser capazes de passar facilmente da execução do código em seus notebooks ou laptops para a execução do código em escala usando os recursos do SageMaker.

Com esse novo recurso do SageMaker Python SDK, os cientistas de dados podem integrar seu código ML à plataforma de treinamento SageMaker em alguns minutos. Você só precisa adicionar uma única linha de código ao seu código de ML, e o SageMaker compreende seu código de forma inteligente junto com os conjuntos de dados e a configuração do ambiente de trabalho e o executa como um trabalho de treinamento do SageMaker. Você pode aproveitar os principais recursos da plataforma de treinamento SageMaker, como a capacidade de dimensionar trabalhos facilmente e outras ferramentas associadas, como Debugger e Profiler. Nesta versão, você pode executar seu código Python de aprendizado de máquina (ML) local como um trabalho de treinamento Amazon SageMaker de nó único ou vários trabalhos paralelos. Trabalhos de treinamento distribuídos (em vários nós) não são suportados por funções remotas.

Nesta postagem, mostramos como usar esse novo recurso para executar o código ML local como um trabalho de treinamento do SageMaker.

Visão geral da solução

Agora você pode executar seu código ML escrito em seu IDE ou notebook como um trabalho de treinamento do SageMaker anotando a função, que atua como um ponto de entrada para a base de código do usuário, com um simples decorador. Após a chamada, esse recurso tira automaticamente um instantâneo de todas as variáveis, funções, pacotes, variáveis de ambiente e outros requisitos de tempo de execução associados de seu código ML, os serializa e os envia como um trabalho de treinamento do SageMaker. Integra-se com o recentemente anunciado Recurso SageMaker Python SDK para definir valores padrão para parâmetros. Esse recurso simplifica as construções do SageMaker que você precisa aprender para poder executar o código usando o Treinamento do SageMaker. Os cientistas de dados podem escrever, depurar e iterar seu código em qualquer IDE preferido (como Estúdio Amazon SageMaker, notebooks, VS Code ou PyCharm). Quando estiver pronto, você pode anotar sua função Python com o @remote decorador e execute-o como um trabalho do SageMaker em escala.

Esse recurso usa objetos Python de código aberto conhecidos como argumentos e saídas. Além disso, você não precisa entender o gerenciamento do ciclo de vida do contêiner e pode simplesmente executar suas cargas de trabalho em diferentes contextos de computação (como um IDE local, Studio ou trabalhos de treinamento) com sobrecarga mínima de configuração. Para executar qualquer código local como um trabalho de treinamento do SageMaker, esse recurso infere as configurações necessárias para executar trabalhos, como o Gerenciamento de acesso e identidade da AWS função (IAM), chave de criptografia e configuração de rede, nas configurações do Studio ou IDE (que podem ser as configurações padrão) e os passa para a plataforma por padrão. Você tem a flexibilidade de personalizar seu tempo de execução na infraestrutura gerenciada do SageMaker usando a configuração inferida ou substituí-los no nível do SDK passando-os como argumentos para o decorador.

Esse novo recurso do SageMaker Python SDK transforma seu código de ML em um ambiente de espaço de trabalho existente e qualquer código de processamento de dados e conjuntos de dados associados em um trabalho de treinamento do SageMaker. Esse recurso procura código ML agrupado dentro de um @remote decorador e o traduz automaticamente em um trabalho executado no Studio ou em um IDE local, como o PyCharm.

Nas seções a seguir, percorremos os recursos desse novo recurso e como iniciar funções python como trabalhos de treinamento do SageMaker.

Pré-requisitos

Para usar esse novo recurso SageMaker Python SDK e executar o código associado a esta postagem, você precisa dos seguintes pré-requisitos:

- Uma conta da AWS que conterá todos os seus recursos da AWS

- Uma função IAM para acessar o SageMaker

- Acesso ao Studio ou a uma instância de bloco de anotações do SageMaker ou a um IDE como o PyCharm

Use o SDK dos notebooks Studio e SageMaker

Você pode usar esse recurso do Studio iniciando um notebook e agrupando seu código com um @remote decorador dentro do notebook. Você primeiro precisa importar a função remota usando o seguinte código:

from sagemaker.remote_function import remoteQuando você usa a função de decorador, esse recurso interpreta automaticamente a função do seu código e a executa como um trabalho de treinamento do SageMaker.

Você também pode usar esse recurso de uma instância de bloco de anotações do SageMaker. Primeiro, você precisa iniciar uma instância de notebook, abrir o Jupyter ou o Jupyter Lab nela e iniciar um notebook. Em seguida, importe a função remota conforme mostrado no código anterior e envolva seu código com o @remote decorador. Incluímos um exemplo de como usar a função decorador e as configurações associadas posteriormente neste post.

Use o SDK do seu ambiente local

Você também pode usar esse recurso de seu IDE local. Como pré-requisito, você deve ter o Interface de linha de comando da AWS (AWS CLI), SageMaker Python SDK e SDK da AWS para Python (Boto3) instalado em seu ambiente local. Você precisa importar essas bibliotecas em seu código, definir a sessão do SageMaker, especificar configurações e decorar sua função com o @remote decorador. No código de exemplo a seguir, executamos uma função de divisão simples como um trabalho de treinamento do SageMaker:

import boto3

import sagemaker

from sagemaker.remote_function import remote sm_session = sagemaker.Session(boto_session=boto3.session.Session(region_name="us-west-2"))

settings = dict(

sagemaker_session=sm_session,

role=<IAM_ROLE_NAME>

instance_type="ml.m5.xlarge",

)

@remote(**settings)

def divide(x, y):

return x / y

if __name__ == "__main__":

print(divide(2, 3.0))Podemos usar uma metodologia semelhante para executar funções avançadas como trabalhos de treinamento, conforme mostrado na próxima seção.

Iniciar funções do Python como trabalhos do SageMaker

O novo recurso SageMaker Python SDK permite que você execute funções Python como Vagas de treinamento do SageMaker. Qualquer código Python, código de treinamento de ML desenvolvido por cientistas de dados usando seus IDEs locais preferidos (PyCharm, VS Code), notebooks SageMaker ou notebooks Studio podem ser iniciados como um trabalho gerenciado do SageMaker.

Em cargas de trabalho de ML que usam esse recurso, conjuntos de dados associados, dependências e configurações de ambiente de espaço de trabalho são serializados usando o código de ML e executados como um trabalho do SageMaker de forma síncrona e assíncrona.

Você pode adicionar um @remote decorator para qualquer código Python, incluindo um processamento de ML local ou função de treinamento para iniciá-lo como um trabalho de treinamento gerenciado do SageMaker, aproveitando assim a escala, o desempenho e os benefícios de custo do SageMaker. Isso pode ser obtido com alterações mínimas no código, adicionando um decorador ao código da função Python. A chamada para a função decorada é executada de forma síncrona e a execução da função aguarda até que o trabalho do SageMaker seja concluído.

No exemplo a seguir, usamos o @remote decorador para iniciar tarefas do SageMaker no modo decorador usando uma instância ml.m5.large. O SageMaker usa trabalhos de treinamento para iniciar essa função como um trabalho gerenciado.

from sagemaker.remote_function import remote

from numpy as np @remote(instance_type="ml.m5.large")

def matrix_multiply(a, b): return np.matmul(a, b) a = np.array([[1, 0], [0, 1]])

b = np.array([1, 2]) assert matrix_multiply(a, b) == np.array([1,2])Você também pode usar o modo decorador para iniciar trabalhos do SageMaker, pacotes Python e dependências. Você pode incluir variáveis de ambiente como VPC, sub-redes e grupos de segurança para iniciar trabalhos de treinamento do SageMaker no environment.yml arquivo. Isso permite que engenheiros e administradores de ML configurem essas variáveis de ambiente para que os cientistas de dados possam se concentrar na criação de modelos de ML e iterar mais rapidamente. Veja o seguinte código:

from sagemaker.remote_function import remote @remote(instance_type="ml.g4dn.xlarge",dependencies = "./environment.yml")

def train_hf_model(

train_input_path,test_input_path,s3_output_path = None,

*,epochs = 1, train_batch_size = 32, eval_batch_size = 64,

warmup_steps = 500,learning_rate = 5e-5

):

model_name = "distilbert-base-uncased"

model = AutoModelForSequenceClassification.from_pretrained(model_name)

... <TRUCNATED>

return os.path.join(s3_output_path, model_dir), eval_resultVocê pode usar RemoteExecutor para iniciar as funções do Python como trabalhos do SageMaker de forma assíncrona. O executor pesquisa de forma assíncrona os trabalhos de treinamento do SageMaker para atualizar o status do trabalho. O RemoteExecutor classe é uma implementação do concorrente.futures.Executor, que é usado para enviar trabalhos de treinamento do SageMaker de forma assíncrona. Veja o seguinte código:

from sagemaker.remote_function import RemoteExecutor def train_hf_model(

train_input_path,test_input_path,s3_output_path = None,

*,epochs = 1, train_batch_size = 32, eval_batch_size = 64,

warmup_steps = 500,learning_rate = 5e-5

):

model_name = "distilbert-base-uncased"

model = AutoModelForSequenceClassification.from_pretrained(model_name)

...<TRUNCATED>

return os.path.join(s3_output_path, model_dir), eval_result with RemoteExecutor(instance_type="ml.g4dn.xlarge", dependencies = './requirements.txt') as e:

future = e.submit(train_hf_model, train_input_path,test_input_path,s3_output_path,

epochs, train_batch_size, eval_batch_size,warmup_steps,learning_rate)Personalizar o ambiente de tempo de execução

Modo decorador e RemoteExecutor permitem definir e personalizar os ambientes de tempo de execução para a tarefa do SageMaker. As dependências de tempo de execução, incluindo pacotes Python e variáveis de ambiente para trabalhos do SageMaker, podem ser especificadas para personalizar o tempo de execução. Para executar o código Python local como trabalhos gerenciados pelo SageMaker, o pacote Python e as dependências precisam ser disponibilizados para o SageMaker. Engenheiros de ML ou administradores de ciência de dados podem definir configurações de rede e segurança, como VPC, sub-redes e grupos de segurança para trabalhos do SageMaker, para que os cientistas de dados possam usar essas configurações gerenciadas centralmente ao iniciar trabalhos do SageMaker. Você pode usar um requirements.txt arquivo ou um Conda environment.yaml arquivo.

Quando as dependências são definidas com requirements.txt, os pacotes serão instalados usando pip no tempo de execução do trabalho. Se a imagem usada para executar o trabalho vier com ambientes Conda, os pacotes serão instalados no ambiente Conda declarado para usar para trabalhos. O código a seguir mostra um exemplo requirements.txt arquivo:

datasets

transformers

torch

scikit-learn

s3fs==0.4.2

sagemaker>=2.148.0Você pode passar o seu Conda environment.yaml para criar o ambiente Conda no qual você gostaria que seu código fosse executado durante o trabalho de treinamento. Se a imagem usada para executar o trabalho declarar um ambiente Conda para executar o código, atualizaremos o ambiente Conda declarado com a especificação fornecida. O código a seguir é um exemplo de um Conda environment.yaml arquivo:

name: sagemaker_example

channels: - conda-forge

dependencies: - python=3.10 - pandas - pip: - sagemakerAlternativamente, você pode definir dependencies=”auto_capture” para permitir que o SageMaker Python SDK capture as dependências instaladas no ambiente Conda ativo. Você deve ter um ambiente Conda ativo para auto_capture trabalhar. Note que existem pré-requisitos para auto_capture trabalhar; recomendamos que você passe em suas dependências como requirement.txt or Conda environment.yml conforme descrito na seção anterior.

Para mais detalhes, consulte Execute seu código local como um trabalho de treinamento do SageMaker.

Configurações para trabalhos do SageMaker

As configurações relacionadas à infraestrutura podem ser transferidas para um arquivo de configuração que os usuários administrativos podem ajudar a configurar. Você só precisa configurá-lo uma vez. As configurações de infraestrutura cobrem a configuração de rede, funções IAM, Serviço de armazenamento simples da Amazon (Amazon S3) para entrada, dados de saída e tags. Referir-se Configurando e usando padrões com o SageMaker Python SDK para mais detalhes.

SchemaVersion: '1.0'

SageMaker:

PythonSDK:

Modules:

RemoteFunction:

Dependencies: path/to/requirements.txt

EnvironmentVariables: {"EnvVarKey": "EnvVarValue"}

ImageUri: 366666666666.dkr.ecr.us-west-2.amazonaws.com/my-image:latest

InstanceType: ml.m5.large

RoleArn: arn:aws:iam::366666666666:role/MyRole

S3KmsKeyId: somekmskeyid

S3RootUri: s3://my-bucket/my-project

SecurityGroupIds:

- sg123

Subnets:

- subnet-1234

Tags:

- {"Key": "someTagKey", "Value": "someTagValue"}

VolumeKmsKeyId: somekmskeyidImplementação

Modelos de aprendizado profundo como PyTorch ou TensorFlow também podem ser executados no Studio executando o código como um trabalho de treinamento no notebook. Para mostrar esse recurso no Studio, você pode clonar esse repositório em seu Studio e executar o notebook localizado no GitHub repositório.

Este exemplo demonstra um caso de uso de classificação de texto binário de ponta a ponta. Estamos usando os transformadores Hugging Face e a biblioteca de conjuntos de dados para ajustar um transformador pré-treinado na classificação de texto binário. Em particular, o modelo pré-treinado será ajustado usando o conjunto de dados IMDb.

Ao clonar o repositório, você deve localizar os seguintes arquivos:

- config.yaml – A maioria dos argumentos do decorador pode ser transferida para o arquivo de configuração para separar as configurações relacionadas à infraestrutura da base de código

- abraçandoface.ipynb – Contém o código para treinar um modelo HuggingFace pré-treinado, que será ajustado usando o conjunto de dados do IMDB

- requisitos.txt – Este arquivo contém todas as dependências para executar a função que será utilizada neste notebook para executar o código e executar o treinamento remotamente em uma instância de GPU como um trabalho de treinamento

Ao abrir o notebook, você será solicitado a configurar o ambiente do notebook. Você pode selecionar a imagem Data Science 3.0 com o kernel Python 3 e ml.m5.large como o tipo de instância de inicialização rápida para executar o código do notebook. Esse tipo de instância é significativamente mais rápido na criação de um ambiente.

O trabalho de treinamento será executado em uma instância ml.g4dn.xlarge conforme definido no config.yaml arquivo:

SchemaVersion: '1.0'

SageMaker:

PythonSDK:

Modules:

RemoteFunction:

# role arn is not required if in SageMaker Notebook instance or SageMaker Studio

# Uncomment the following line and replace with the right execution role if in a local IDE

# RoleArn: <IAM_ROLE_ARN>

InstanceType: ml.g4dn.xlarge

Dependencies: ./requirements.txtA requirements.txt dependências de arquivo para executar a função para treinar o modelo Hugging Face incluem o seguinte:

datasets

transformers

torch

scikit-learn

# lock s3fs to this specific version as more recent ones introduce dependency on aiobotocore, which is not compatible with botocore

s3fs==0.4.2

sagemaker>=2.148.0,<3O notebook Hugging Face mostra como executar o treinamento remotamente por meio do @remote função, que é executada de forma síncrona. Portanto, a função executada para treinar o modelo aguardará até que o trabalho de treinamento do SageMaker seja concluído. O treinamento será executado remotamente com uma instância de GPU em que o tipo de instância é definido no arquivo de configuração anterior.

Depois de executar o trabalho de treinamento, você pode executar o restante das células no notebook para inspecionar as métricas de avaliação e classificar o texto em nosso modelo treinado.

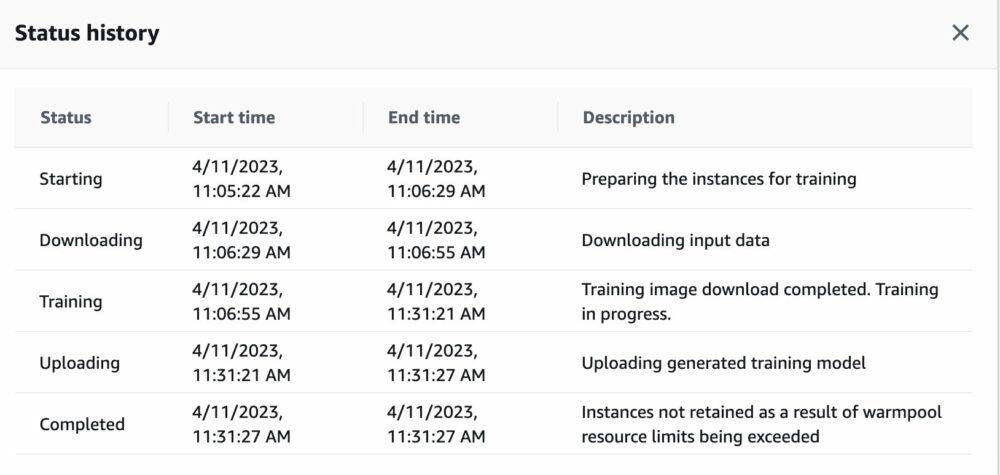

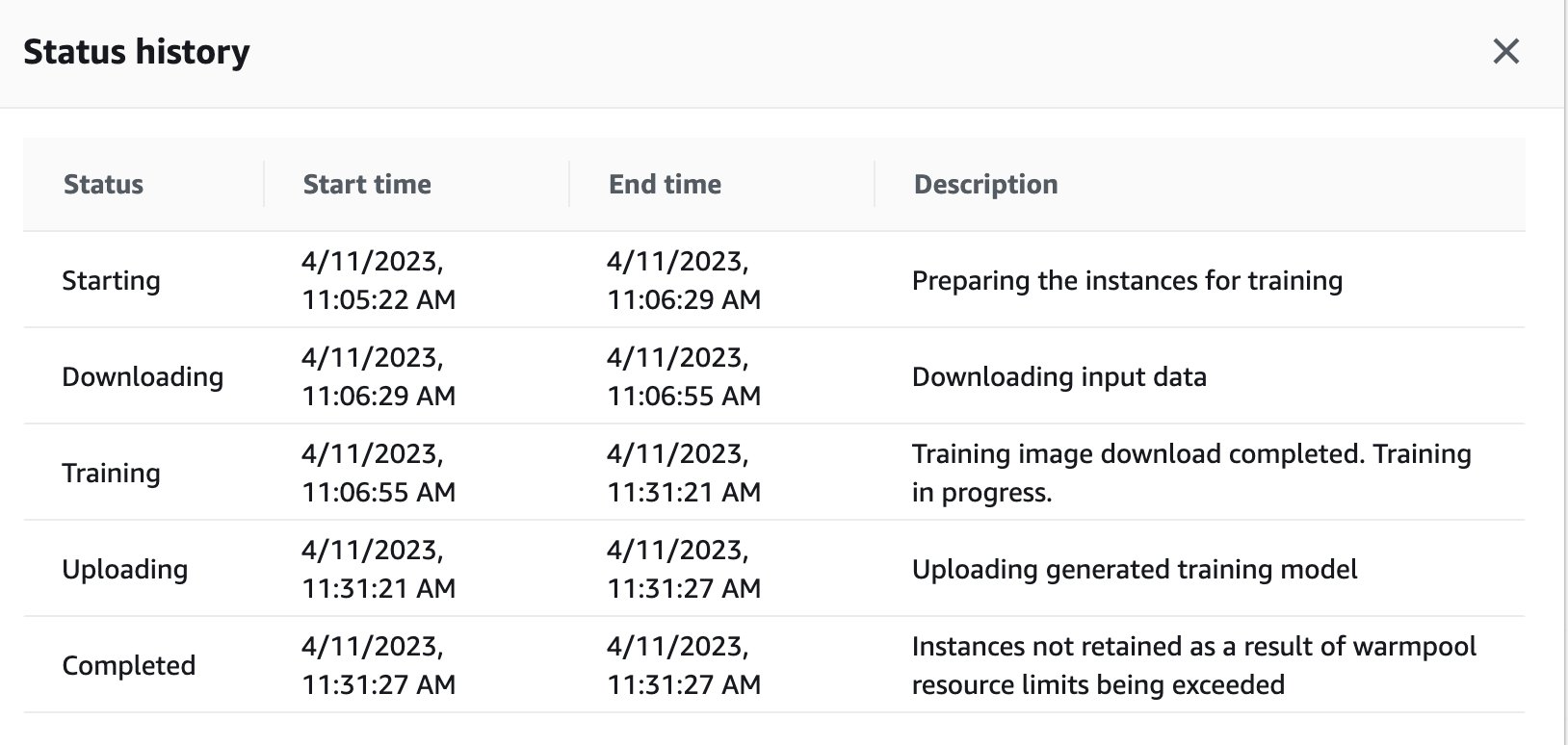

Você também pode visualizar o status do trabalho de treinamento que foi acionado remotamente na instância de GPU no painel do SageMaker navegando de volta ao console do SageMaker.

Assim que o trabalho de treinamento é concluído, ele continua executando as instruções no notebook para avaliação e classificação. Tarefas semelhantes podem ser treinadas e executadas por meio da função de executor remoto incorporada aos notebooks Studio para executar as execuções de forma assíncrona.

Integração com experimentos do SageMaker dentro de uma função @remote

Você pode passar o nome do experimento, o nome da execução e outros parâmetros para a função remota para criar uma execução de experimentos do SageMaker. O exemplo de código a seguir importa o nome do experimento, o nome da execução e os parâmetros a serem registrados para cada execução:

from sagemaker.remote_function import remote

from sagemaker.experiments.run import Run

# Define your remote function

@remote

def train(value_1, value_2, exp_name, run_name):

...

...

#Creates the experiment

with Run( experiment_name=exp_name, run_name=run_name, sagemaker_session=sagemaker_session

) as run:

...

...

#Define values for the parameters to log

run.log_parameter("param_1", value_1)

run.log_parameter("param_2", value_2)

...

...

#Define metrics to log

run.log_metric("metric_a", 0.5)

run.log_metric("metric_b", 0.1) # Invoke your remote function

train(1.0, 2.0, "my-exp-name", "my-run-name") No exemplo anterior, os parâmetros p1 e p2 são registrados ao longo do tempo dentro de um loop de treinamento. Parâmetros comuns podem incluir tamanho de lote ou épocas. No exemplo, as métricas A e B são registrados para um tempo de execução dentro de um loop de treinamento. Métricas comuns podem incluir precisão ou perda. Para mais informações, veja Criar um experimento do Amazon SageMaker.

Conclusão

Nesta postagem, apresentamos um novo recurso SageMaker Python SDK que permite que os cientistas de dados executem seu código ML em seu IDE preferido como trabalhos de treinamento do SageMaker. Discutimos os pré-requisitos necessários para usar esse recurso junto com seus recursos. Também mostramos como usar esse recurso no Studio, instâncias de notebook do SageMaker e seu IDE local. Além disso, fornecemos exemplos de código de amostra para demonstrar como usar esse recurso. Como próxima etapa, recomendamos testar esse recurso em seu IDE ou SageMaker seguindo as instruções exemplos de código referenciado neste post.

Sobre os autores

Dipankar Patro é um engenheiro de desenvolvimento de software na AWS SageMaker, inovando e desenvolvendo soluções MLOps para ajudar os clientes a adotar soluções de IA/ML em escala. Ele tem um MS em Ciência da Computação e suas áreas de interesse são Segurança de Computadores, Sistemas Distribuídos e AI/ML.

Dipankar Patro é um engenheiro de desenvolvimento de software na AWS SageMaker, inovando e desenvolvendo soluções MLOps para ajudar os clientes a adotar soluções de IA/ML em escala. Ele tem um MS em Ciência da Computação e suas áreas de interesse são Segurança de Computadores, Sistemas Distribuídos e AI/ML.

Farooq Sabir é arquiteto sênior de soluções de inteligência artificial e aprendizado de máquina da AWS. Ele possui doutorado e mestrado em Engenharia Elétrica pela Universidade do Texas em Austin e mestrado em Ciência da Computação pelo Georgia Institute of Technology. Ele tem mais de 15 anos de experiência profissional e também gosta de ensinar e orientar estudantes universitários. Na AWS, ele ajuda os clientes a formular e resolver seus problemas de negócios em ciência de dados, aprendizado de máquina, visão computacional, inteligência artificial, otimização numérica e domínios relacionados. Com sede em Dallas, Texas, ele e sua família adoram viajar e fazer longas viagens.

Farooq Sabir é arquiteto sênior de soluções de inteligência artificial e aprendizado de máquina da AWS. Ele possui doutorado e mestrado em Engenharia Elétrica pela Universidade do Texas em Austin e mestrado em Ciência da Computação pelo Georgia Institute of Technology. Ele tem mais de 15 anos de experiência profissional e também gosta de ensinar e orientar estudantes universitários. Na AWS, ele ajuda os clientes a formular e resolver seus problemas de negócios em ciência de dados, aprendizado de máquina, visão computacional, inteligência artificial, otimização numérica e domínios relacionados. Com sede em Dallas, Texas, ele e sua família adoram viajar e fazer longas viagens.

Manoj Ravi é gerente de produto sênior do Amazon SageMaker. Ele é apaixonado por criar produtos de IA de última geração e trabalha com software e ferramentas para facilitar o aprendizado de máquina em grande escala para os clientes. Possui MBA pela Haas School of Business e mestrado em Gestão de Sistemas de Informação pela Carnegie Mellon University. Em seu tempo livre, Manoj gosta de jogar tênis e fazer fotografia de paisagem.

Manoj Ravi é gerente de produto sênior do Amazon SageMaker. Ele é apaixonado por criar produtos de IA de última geração e trabalha com software e ferramentas para facilitar o aprendizado de máquina em grande escala para os clientes. Possui MBA pela Haas School of Business e mestrado em Gestão de Sistemas de Informação pela Carnegie Mellon University. Em seu tempo livre, Manoj gosta de jogar tênis e fazer fotografia de paisagem.

Shikhar Kwatra é um arquiteto de soluções especialista em IA/ML na Amazon Web Services, trabalhando com um integrador de sistemas global líder. Ele ganhou o título de um dos mais jovens mestres inventores indianos com mais de 500 patentes nos domínios AI/ML e IoT. Shikhar auxilia na arquitetura, construção e manutenção de ambientes de nuvem escaláveis e econômicos para a organização e oferece suporte ao parceiro GSI na criação de soluções estratégicas do setor na AWS. Shikhar gosta de tocar violão, compor música e praticar mindfulness em seu tempo livre.

Shikhar Kwatra é um arquiteto de soluções especialista em IA/ML na Amazon Web Services, trabalhando com um integrador de sistemas global líder. Ele ganhou o título de um dos mais jovens mestres inventores indianos com mais de 500 patentes nos domínios AI/ML e IoT. Shikhar auxilia na arquitetura, construção e manutenção de ambientes de nuvem escaláveis e econômicos para a organização e oferece suporte ao parceiro GSI na criação de soluções estratégicas do setor na AWS. Shikhar gosta de tocar violão, compor música e praticar mindfulness em seu tempo livre.

Vikram Elango é Arquiteto de Soluções Especialista em IA/ML sênior na AWS, com sede na Virgínia, EUA. Atualmente, ele está focado em IA generativa, LLMs, engenharia imediata, otimização de inferência de modelo grande e dimensionamento de ML em empresas. A Vikram ajuda os clientes do setor financeiro e de seguros com design e liderança de pensamento para criar e implantar aplicativos de aprendizado de máquina em escala. Em seu tempo livre, ele gosta de viajar, fazer caminhadas, cozinhar e acampar.

Vikram Elango é Arquiteto de Soluções Especialista em IA/ML sênior na AWS, com sede na Virgínia, EUA. Atualmente, ele está focado em IA generativa, LLMs, engenharia imediata, otimização de inferência de modelo grande e dimensionamento de ML em empresas. A Vikram ajuda os clientes do setor financeiro e de seguros com design e liderança de pensamento para criar e implantar aplicativos de aprendizado de máquina em escala. Em seu tempo livre, ele gosta de viajar, fazer caminhadas, cozinhar e acampar.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoAiStream. Inteligência de Dados Web3. Conhecimento Amplificado. Acesse aqui.

- Cunhando o Futuro com Adryenn Ashley. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/run-your-local-machine-learning-code-as-amazon-sagemaker-training-jobs-with-minimal-code-changes/

- :tem

- :é

- :não

- $UP

- 1

- 10

- 100

- 15 anos

- 500

- 7

- a

- habilidade

- Capaz

- Sobre

- Acesso

- Conta

- precisão

- alcançado

- em

- ativo

- atos

- adicionar

- acrescentando

- Adição

- admin

- administradores

- adotar

- avançado

- Vantagem

- AI

- AI / ML

- SIDA

- Todos os Produtos

- permite

- juntamente

- tb

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- an

- analisar

- e

- anunciou

- qualquer

- aplicações

- SOMOS

- áreas

- argumentos

- artificial

- inteligência artificial

- Inteligência Artificial e Aprendizado de Máquinas

- AS

- associado

- At

- austin

- automaticamente

- disponível

- AWS

- em caminho duplo

- base

- baseado

- BE

- Benefícios

- Orçamentos

- construir

- Prédio

- negócio

- by

- CAN

- capacidades

- capturar

- Carnegie Mellon

- transportar

- casas

- Células

- alterar

- Alterações

- canais

- escolha

- classe

- classificação

- classificar

- Na nuvem

- código

- base de código

- Faculdade

- vem

- comum

- compatível

- completar

- Computar

- computador

- Ciência da Computação

- Segurança Informática

- Visão de Computador

- conceito

- Configuração

- cônsul

- não contenho

- Recipiente

- contém

- Contextos

- continua

- núcleo

- Custo

- poderia

- cobrir

- crio

- Atualmente

- Clientes

- personalizar

- Dallas

- painel de instrumentos

- dados,

- informática

- ciência de dados

- conjuntos de dados

- declara

- Padrão

- defaults

- definido

- demonstrar

- demonstra

- Dependência

- implantar

- descrito

- Design

- detalhes

- desenvolvido

- Developer

- Desenvolvimento

- diferente

- discutido

- distribuído

- Sistemas distribuídos

- treinamento distribuído

- domínios

- feito

- não

- durante

- e

- cada

- ganhou

- facilidade de utilização

- mais fácil

- facilmente

- ou

- incorporado

- permite

- criptografia

- end-to-end

- engenheiro

- Engenharia

- Engenheiros

- empresas

- entrada

- Meio Ambiente

- ambientes

- época

- épocas

- avaliação

- Cada

- exemplo

- exemplos

- execução

- existente

- vasta experiência

- experimentar

- Rosto

- familiar

- família

- RÁPIDO

- mais rápido

- Característica

- Funcionalidades

- poucos

- Envie o

- Arquivos

- financeiro

- Primeiro nome

- Flexibilidade

- Foco

- focado

- seguinte

- Escolha

- Quadro

- da

- totalmente

- função

- funções

- Além disso

- futuro

- futuros

- generativo

- IA generativa

- dado

- Global

- Go

- GPU

- Do grupo

- Ter

- he

- ajudar

- ajuda

- sua

- detém

- Como funciona o dobrador de carta de canal

- Como Negociar

- HTML

- http

- HTTPS

- Abraçando o Rosto

- Identidade

- if

- imagem

- implementação

- importar

- importações

- in

- incluir

- Incluindo

- indiano

- indústria

- INFORMAÇÕES

- Sistemas de Informação

- Infraestrutura

- inovando

- entrada

- instalado

- instância

- Instituto

- instruções

- com seguro

- integrado

- Integra-se

- Inteligência

- interesse

- para dentro

- introduzir

- introduzido

- Inventores

- iot

- IT

- iterações

- ESTÁ

- Trabalho

- Empregos

- jpg

- apenas por

- Chave

- laboratório

- paisagem

- laptops

- grande

- em grande escala

- mais recente

- lançamento

- lançado

- de lançamento

- Liderança

- principal

- APRENDER

- aprendizagem

- deixar

- Permite

- bibliotecas

- Biblioteca

- wifecycwe

- como

- gostos

- Line

- local

- localmente

- localizado

- log

- registrado

- longo

- OLHARES

- fora

- gosta,

- máquina

- aprendizado de máquina

- moldadas

- Manter

- fazer

- FAZ

- gerenciados

- de grupos

- Gerente

- dominar

- Posso..

- Mellon

- Metodologia

- Métrica

- Mindfulness

- mínimo

- Minutos

- ML

- MLOps

- Moda

- modelo

- modelos

- Módulos

- mais

- a maioria

- mover

- MS

- múltiplo

- Música

- nome

- nomeadamente

- navegação

- você merece...

- necessário

- rede

- networking

- Novo

- Próximo

- nós

- caderno

- agora

- numpy

- objetos

- of

- on

- A bordo

- uma vez

- ONE

- só

- aberto

- open source

- otimização

- or

- ordem

- organização

- OS

- Outros

- A Nossa

- Fora

- saída

- Acima de

- override

- pacote

- pacotes

- pandas

- Paralelo

- parâmetros

- particular

- parceiro

- passar

- passes

- Passagem

- apaixonado

- Patentes

- caminho

- atuação

- fotografia

- plataforma

- platão

- Inteligência de Dados Platão

- PlatãoData

- jogar

- ponto

- Publique

- preferido

- pré-requisitos

- anterior

- Problema

- problemas

- em processamento

- Produto

- gerente de produto

- produtivo

- Produtos

- fornecido

- Python

- pytorch

- pronto

- recentemente

- recentemente

- recomendar

- relacionado

- liberar

- remoto

- substituir

- repositório

- requeridos

- Requisitos

- DESCANSO

- retorno

- estrada

- Tipo

- papéis

- Execute

- corrida

- sábio

- escalável

- Escala

- dimensionamento

- Escola

- Ciência

- cientistas

- scikit-learn

- Sdk

- sem problemas

- Seção

- seções

- segurança

- Vejo

- senior

- separado

- Serviços

- Sessão

- conjunto

- contexto

- Configurações

- instalação

- vários

- rede de apoio social

- mostrar

- mostrar

- mostrando

- Shows

- de forma considerável

- semelhante

- simples

- simplesmente

- solteiro

- Tamanho

- pequeno

- Instantâneo

- So

- Software

- desenvolvimento de software

- Soluções

- RESOLVER

- especialista

- específico

- especificação

- especificada

- começo

- Comece

- Status

- Passo

- armazenamento

- Estratégico

- Estudantes

- estudo

- enviar

- sub-redes

- tal

- Suportado

- suportes

- .

- sistemas

- Tire

- toma

- tomar

- tarefas

- equipes

- Tecnologia

- fluxo tensor

- texas

- Classificação de Texto

- que

- A

- deles

- Eles

- então

- Lá.

- assim

- assim sendo

- Este

- deles

- isto

- pensamento

- liderança de pensamento

- Através da

- tempo

- Título

- para

- ferramentas

- tocha

- para

- Trem

- treinado

- Training

- transformadores

- viagens

- Viagens

- desencadeado

- tipo

- tipicamente

- para

- compreender

- universidade

- Atualizar

- us

- usar

- caso de uso

- usava

- usuários

- utilização

- valor

- Valores

- versão

- via

- Ver

- Virgínia

- visão

- vs

- vs código

- esperar

- queremos

- we

- web

- serviços web

- quando

- qual

- enquanto

- precisarão

- de

- dentro

- Atividades:

- trabalhar

- trabalho

- seria

- embrulho

- Envolvido

- escrever

- escrever código

- escrito

- X

- anos

- Vocês

- Mais jovem

- investimentos

- zefirnet