O Google está sob pressão de um legislador dos EUA para explicar como treina e implanta seu chatbot médico Med-PaLM 2 em hospitais.

Escrevendo hoje ao gigante da Internet, o senador Mark Warner (D-VA) também instou o titã da web a não colocar os pacientes em risco na pressa de comercializar a tecnologia.

Med-PaLM 2 é baseado no grande modelo de linguagem PaLM 2 do Google e é aprimorado com informações médicas. O sistema pode gerar respostas escritas em resposta a consultas médicas, resumir documentos e recuperar dados. O Google apresentou o modelo em abril e dito um grupo seleto de clientes do Google Cloud estava testando o software.

Um desses testadores é o VHC Health, um hospital na Virgínia afiliado à Clínica Mayo, segundo o senador Warner. Numa carta ao chefe do Google, Sundar Pichai, Warner disse estar preocupado com o fato de a IA generativa levantar “novas questões e riscos complexos”, especialmente quando aplicada no setor de saúde.

“Embora a IA tenha, sem dúvida, um enorme potencial para melhorar o atendimento ao paciente e os resultados de saúde, temo que a implantação prematura de tecnologia não comprovada possa levar à erosão da confiança em nossos profissionais e instituições médicas, à exacerbação das disparidades raciais existentes nos resultados de saúde e a um aumento risco de erros de diagnóstico e prestação de cuidados”, escreveu ele [PDF].

“Esta corrida para estabelecer quota de mercado é facilmente aparente e especialmente preocupante na indústria de cuidados de saúde, dadas as consequências de vida ou morte de erros no ambiente clínico, declínios de confiança nas instituições de cuidados de saúde nos últimos anos, e a sensibilidade da saúde Informação."

Em sua carta, o senador apresentou uma dúzia de perguntas para os executivos do Google responderem. Essas consultas incluíram:

Modelos de linguagem extensa demonstram frequentemente a tendência de memorizar o conteúdo dos seus dados de treinamento, o que pode colocar em risco a privacidade do paciente no contexto de modelos treinados em informações confidenciais de saúde. Como o Google avaliou o Med-PaLM 2 quanto a esse risco e quais medidas o Google tomou para mitigar vazamentos inadvertidos de privacidade de informações confidenciais de saúde?

Qual é a frequência com que o Google retreina total ou parcialmente o Med-PaLM 2? O Google garante que os licenciados usem apenas a versão do modelo mais atualizada?

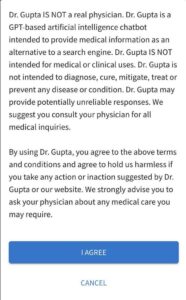

O Google garante que os pacientes sejam informados quando o Med-PaLM 2, ou outros modelos de IA oferecidos ou licenciados por eles, são usados em seus cuidados por licenciados de cuidados de saúde? Se sim, como é apresentada a divulgação? Faz parte de uma divulgação mais longa ou é apresentada de forma mais clara?

O Google retém informações imediatas de licenciados de cuidados de saúde, incluindo informações de saúde protegidas contidas nelas? Liste cada finalidade que o Google tem para reter essas informações.

e finalmente…

Na publicação de pesquisa do próprio Google anunciando o Med-PaLM 2, os pesquisadores alertaram sobre a necessidade de adotar “proteções para mitigar a dependência excessiva da produção de um assistente médico”. Quais proteções o Google adotou para mitigar a dependência excessiva do resultado do Med-PaLM 2, bem como quando ele deve ou não ser usado em particular? Quais proteções o Google incorporou por meio dos termos de licença do produto para evitar dependência excessiva do resultado?

Todos pontos bastante bons que deveriam ser levantados ou destacados.

Grandes modelos de linguagem são propensos a gerar informações falsas que parecem convincentes; portanto, é possível temer que um bot forneça conselhos médicos prejudiciais com confiança ou influencie erroneamente as decisões de saúde de alguém. A Associação Nacional de Distúrbios Alimentares, por exemplo, tomou sua decisão Tessa chatbot offline depois de sugerir que as pessoas contassem calorias, se pesassem semanalmente e monitorassem a gordura corporal – comportamentos que são considerados contra-intuitivos para uma recuperação saudável.

Um artigo de pesquisa de autoria do Google DeepMind detalhando O Med-PaLM 2 admitiu que “as respostas do modelo não foram tão favoráveis quanto as respostas dos médicos” e obteve uma pontuação baixa em termos de precisão e relevância.

Warner deseja que Pichai compartilhe mais informações sobre como o modelo é implantado em ambientes clínicos e quer saber se a megacorporação está coletando dados de pacientes daqueles que testam sua tecnologia e quais dados foram usados para treiná-la.

Ele destacou que o Google já armazenou e analisou dados de pacientes sem seu conhecimento ou consentimento explícito em acordos com hospitais nos EUA e no Reino Unido sob o Projeto Nightingale bandeira.

“O Google não forneceu publicamente documentação sobre o Med-PaLM 2, incluindo a abstenção de divulgar o conteúdo dos dados de treinamento do modelo. O corpus de treinamento do Med-PaLM 2 inclui informações de saúde protegidas?” ele perguntou.

Um porta-voz do Google negou que o Med-PaLM 2 fosse um chatbot como as pessoas o conhecem hoje e disse que o modelo estava sendo testado por clientes para explorar como pode ser útil para o setor de saúde.

“Acreditamos que a IA tem o potencial de transformar a saúde e a medicina e estamos comprometidos em explorar com segurança, equidade, evidências e privacidade no centro”, disse o representante. O registro em um comunicado.

"Como estabelecido em abril, disponibilizaremos o Med-PaLM 2 para um grupo seleto de organizações de saúde para testes limitados, para explorar casos de uso e compartilhar feedback – uma etapa crítica na construção de uma tecnologia segura e útil. Esses clientes mantêm o controle sobre seus dados. Med-PaLM 2 não é um chatbot; é uma versão aprimorada do nosso grande modelo de linguagem PaLM2, e projetado para codificar o conhecimento médico.”

O porta-voz não confirmou se o Google responderia às perguntas do senador Warner. ®

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Automotivo / EVs, Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- BlockOffsets. Modernizando a Propriedade de Compensação Ambiental. Acesse aqui.

- Fonte: https://go.theregister.com/feed/www.theregister.com/2023/08/08/google_senator_ai_health/

- :tem

- :é

- :não

- 7

- 8

- a

- Sobre

- Segundo

- precisão

- admitiu

- adotar

- adotado

- conselho

- Afiliado

- Depois de

- contra

- AI

- Modelos de IA

- tb

- an

- analisado

- e

- Anunciando

- responder

- respostas

- aparente

- aplicado

- Abril

- SOMOS

- AS

- Assistente

- Associação

- At

- disponível

- bandeira

- baseado

- BE

- comportamentos

- ser

- Acreditar

- corpo

- Bot

- Prédio

- by

- CAN

- Cuidado

- casos

- chatbot

- chefe

- claramente

- a clínica

- Clínico

- Na nuvem

- CO

- Coleta

- comercializar

- comprometido

- integrações

- preocupado

- com confiança

- Confirmar

- consentimento

- Consequências

- contida

- conteúdo

- contexto

- ao controle

- núcleo

- poderia

- crítico

- Clientes

- dados,

- Ofertas

- decisões

- Recusas

- considerado

- demonstrar

- negado

- implantado

- desenvolvimento

- implanta

- projetado

- DID

- Divulgando

- divulgação

- distúrbios

- documentação

- INSTITUCIONAIS

- parece

- dúzia

- cada

- garantir

- equidade

- erros

- especialmente

- estabelecer

- avaliadas

- evidência

- exemplo

- executivos

- existente

- Explicação

- explorar

- Explorando

- falso

- gordura

- favorável

- medo

- retornos

- Finalmente

- Escolha

- Frequência

- freqüentemente

- da

- totalmente

- gerar

- gerando

- generativo

- IA generativa

- gigante

- dado

- Bom estado, com sinais de uso

- Parceria

- Grupo

- prejudicial

- he

- Saúde

- Assistência médica

- informação de saúde

- saúde

- setor de saúde

- saudável

- útil

- Destaque

- sua

- detém

- hospitais

- Como funciona o dobrador de carta de canal

- HTTPS

- i

- if

- melhorar

- in

- incluir

- incluído

- Incluindo

- Incorporado

- aumentou

- indústria

- influenciando

- INFORMAÇÕES

- informado

- instituições

- Internet

- introduzido

- IT

- ESTÁ

- jpg

- Saber

- Conhecimento

- língua

- grande

- legislador

- conduzir

- Vazamentos

- carta

- Licença

- Licenciado

- licenciados

- Limitado

- Lista

- mais

- Fazendo

- marca

- mercado

- fatia de mercado

- maio

- médico

- medicina

- poder

- erros

- Mitigar

- modelo

- modelos

- Monitore

- mais

- a maioria

- Nacional

- você merece...

- Novo

- of

- oferecido

- modo offline

- on

- ONE

- só

- or

- organizações

- Outros

- A Nossa

- Fora

- resultados

- saída

- Acima de

- próprio

- palma da mão

- Papel

- parte

- particularmente

- paciente

- pacientes

- Pessoas

- colega

- platão

- Inteligência de Dados Platão

- PlatãoData

- por favor

- pontos

- potencial

- Prematuro

- apresentado

- pressão

- evitar

- anteriormente

- política de privacidade

- Produto

- protegido

- fornecido

- Publicação

- publicamente

- propósito

- colocar

- consultas

- Frequentes

- Corrida

- angariado

- raises

- em vez

- RE

- recentemente

- recuperação

- confiança

- representante

- pesquisa

- pesquisadores

- responder

- resposta

- reter

- retenção

- Risco

- riscos

- apressar

- s

- seguro

- Segurança

- Dito

- Senado

- Senador

- sensível

- Sensibilidade

- Conjuntos

- contexto

- Configurações

- Partilhar

- rede de apoio social

- So

- Software

- Alguém

- porta-voz

- Declaração

- Passo

- Passos

- armazenadas

- resumir

- Sundar Pichai

- .

- tomado

- Tecnologia

- condições

- testado

- testadores

- ensaio

- que

- A

- deles

- Eles

- si mesmos

- lá no

- Este

- isto

- aqueles

- Através da

- titã

- para

- hoje

- levou

- Trem

- treinado

- Training

- trens

- Transformar

- tremendo

- Confiança

- Uk

- para

- sem dúvida

- que vai mais à frente

- us

- nós legislador

- usar

- usava

- versão

- Virgínia

- quer

- Warner

- foi

- we

- web

- semanal

- pesar

- BEM

- foram

- O Quê

- quando

- se

- qual

- enquanto

- de

- sem

- preocupar-se

- seria

- escrito

- escreveu

- anos

- zefirnet