Esta postagem foi escrita em colaboração com Ankur Goyal e Karthikeyan Chokappa do negócio Cloud & Digital da PwC Australia.

A inteligência artificial (IA) e a aprendizagem automática (ML) estão a tornar-se parte integrante dos sistemas e processos, permitindo decisões em tempo real, impulsionando assim melhorias de resultados em todas as organizações. No entanto, colocar um modelo de ML em produção em escala é um desafio e requer um conjunto de práticas recomendadas. Muitas empresas já possuem cientistas de dados e engenheiros de ML que podem construir modelos de última geração, mas levar modelos para produção e mantê-los em escala continua sendo um desafio. Os fluxos de trabalho manuais limitam as operações do ciclo de vida do ML para retardar o processo de desenvolvimento, aumentar os custos e comprometer a qualidade do produto final.

As operações de aprendizado de máquina (MLOps) aplicam princípios de DevOps a sistemas de ML. Assim como o DevOps combina desenvolvimento e operações para engenharia de software, o MLOps combina engenharia de ML e operações de TI. Com o rápido crescimento dos sistemas de ML e no contexto da engenharia de ML, o MLOps fornece recursos necessários para lidar com as complexidades exclusivas da aplicação prática dos sistemas de ML. No geral, os casos de uso de ML exigem uma solução integrada prontamente disponível para industrializar e agilizar o processo que leva um modelo de ML do desenvolvimento à implantação de produção em escala usando MLOps.

Para enfrentar esses desafios dos clientes, a PwC Austrália desenvolveu o Machine Learning Ops Accelerator como um conjunto de processos padronizados e recursos tecnológicos para melhorar a operacionalização de modelos de IA/ML que permitem a colaboração multifuncional entre equipes ao longo das operações do ciclo de vida de ML. O PwC Machine Learning Ops Accelerator, desenvolvido com base nos serviços nativos da AWS, oferece uma solução adequada à finalidade que se integra facilmente aos casos de uso de ML para clientes de todos os setores. Nesta postagem, nos concentramos na construção e implantação de um caso de uso de ML que integra vários componentes do ciclo de vida de um modelo de ML, permitindo integração contínua (CI), entrega contínua (CD), treinamento contínuo (CT) e monitoramento contínuo (CM).

Visão geral da solução

No MLOps, uma jornada bem-sucedida dos dados aos modelos de ML até recomendações e previsões em sistemas e processos de negócios envolve várias etapas cruciais. Envolve pegar o resultado de um experimento ou protótipo e transformá-lo em um sistema de produção com controles padrão, qualidade e ciclos de feedback. É muito mais do que apenas automação. Trata-se de melhorar as práticas organizacionais e entregar resultados que sejam repetíveis e reproduzíveis em escala.

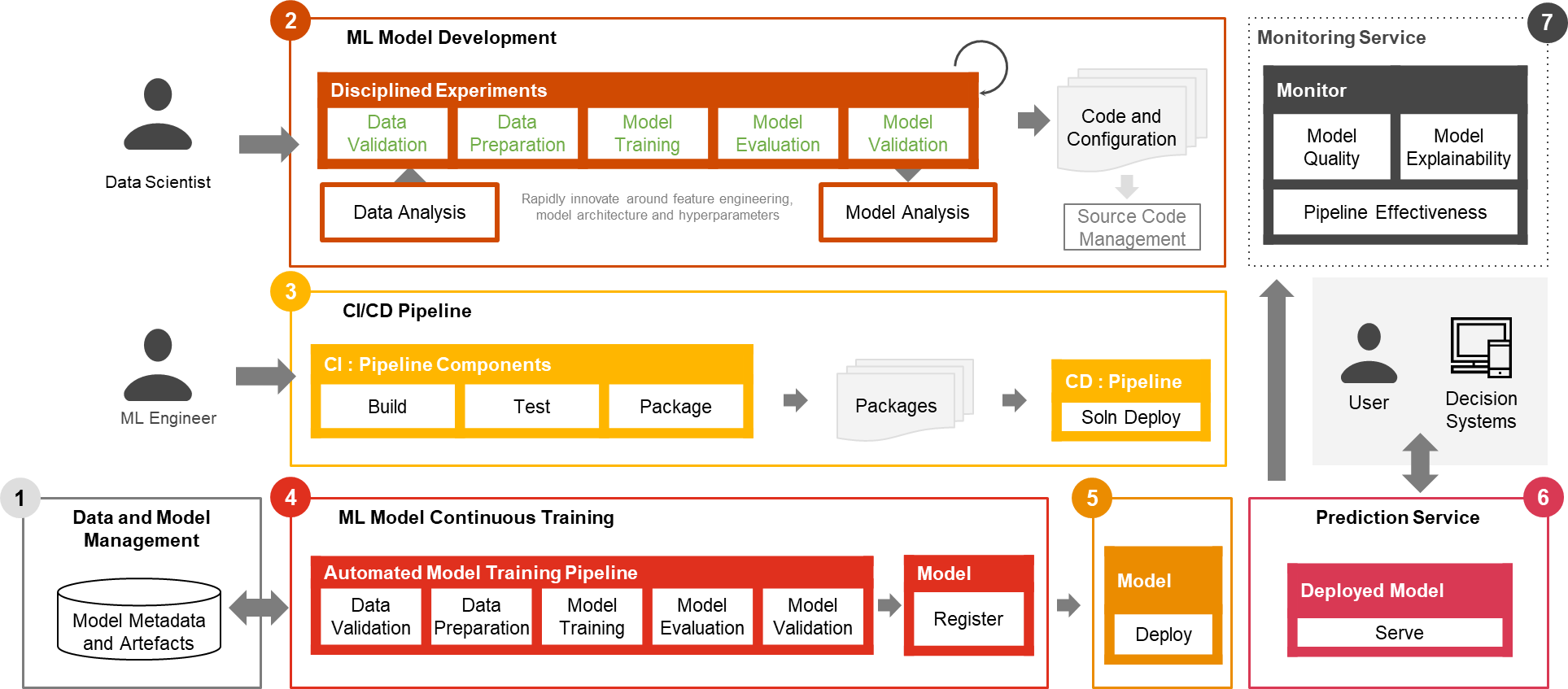

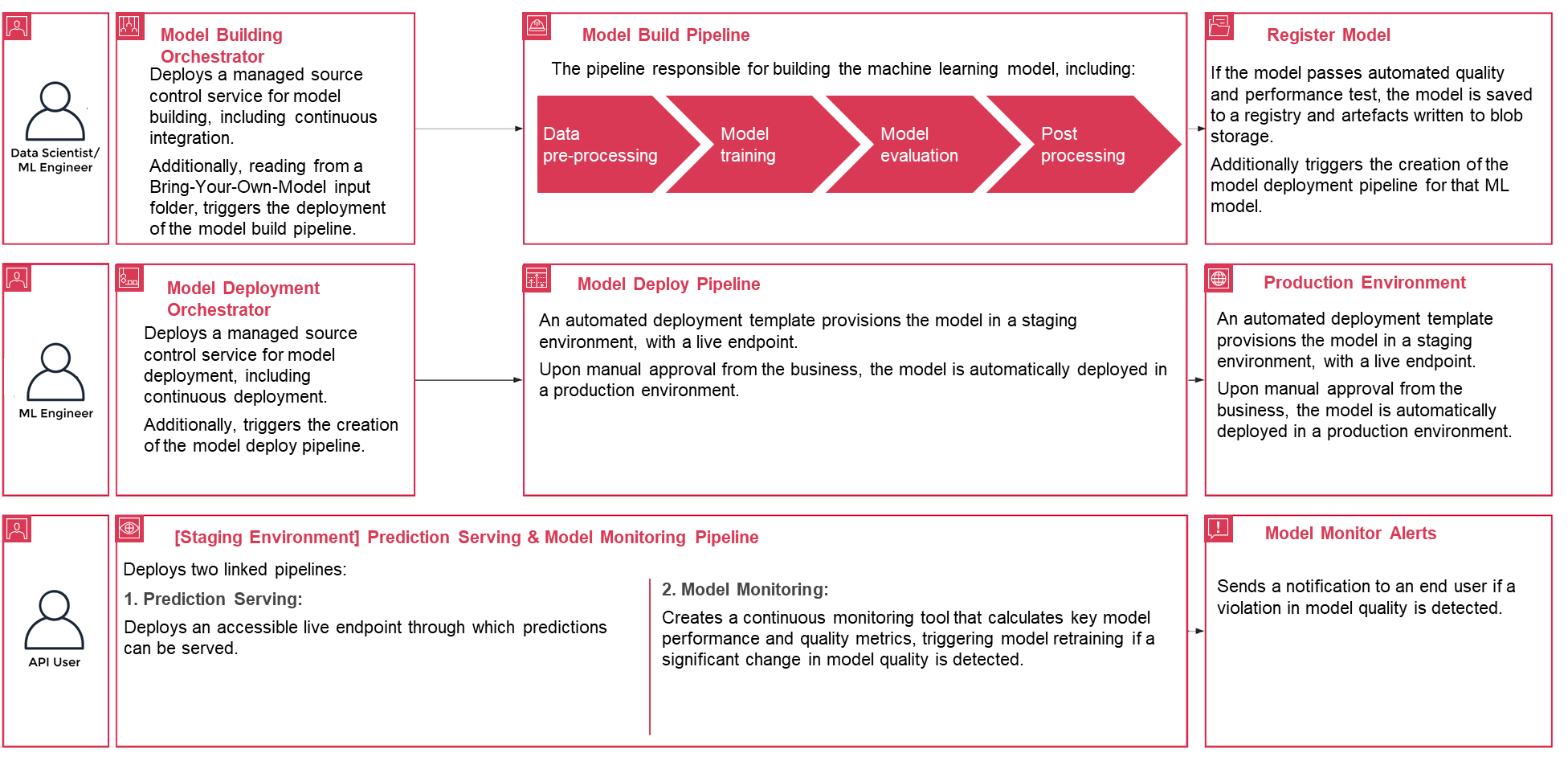

Apenas uma pequena fração de um caso de uso de ML do mundo real compreende o próprio modelo. Os vários componentes necessários para construir um recurso de ML avançado integrado e operá-lo continuamente em escala são mostrados na Figura 1. Conforme ilustrado no diagrama a seguir, o PwC MLOps Accelerator compreende sete recursos integrados principais e etapas iterativas que permitem CI, CD, CT e CM de um caso de uso de ML. A solução aproveita os recursos nativos da AWS de Amazon Sage Maker, construindo uma estrutura flexível e extensível em torno disso.

Figura 1 – Capacidades do PwC Machine Learning Ops Accelerator

Em um cenário empresarial real, podem existir etapas e estágios adicionais de testes para garantir validação e implantação rigorosas de modelos em diferentes ambientes.

- Gerenciamento de dados e modelos fornecem um recurso central que controla os artefatos de ML durante todo o seu ciclo de vida. Ele permite auditabilidade, rastreabilidade e conformidade. Também promove a capacidade de compartilhamento, reutilização e descoberta de ativos de ML.

- Desenvolvimento de modelo de ML permite que várias personas desenvolvam um pipeline de treinamento de modelo robusto e reproduzível, que compreende uma sequência de etapas, desde validação e transformação de dados até treinamento e avaliação de modelo.

- Integração/entrega contínua facilita a construção, o teste e o empacotamento automatizados do pipeline de treinamento do modelo e sua implantação no ambiente de execução de destino. As integrações com fluxos de trabalho de CI/CD e controle de versão de dados promovem as melhores práticas de MLOps, como governança e monitoramento para desenvolvimento iterativo e controle de versão de dados.

- Treinamento contínuo do modelo ML capacidade executa o pipeline de treinamento com base em gatilhos de retreinamento; isto é, à medida que novos dados se tornam disponíveis ou o desempenho do modelo cai abaixo de um limite predefinido. Ele registra o modelo treinado se ele se qualificar como um candidato a modelo bem-sucedido e armazena os artefatos de treinamento e os metadados associados.

- Implantação de modelo permite acesso ao modelo treinado registrado para revisão e aprovação para liberação de produção e permite empacotamento, teste e implantação de modelo no ambiente de serviço de previsão para atendimento de produção.

- Serviço de previsão capacidade inicia o modelo implantado para fornecer previsão por meio de padrões on-line, em lote ou de streaming. O tempo de execução de serviço também captura logs de serviço de modelo para monitoramento e melhorias contínuas.

- Monitoramento contínuo monitora o modelo quanto à eficácia preditiva para detectar a deterioração do modelo e a eficácia do serviço (latência, pipeline completo e erros de execução)

Arquitetura do acelerador de operações de aprendizado de máquina PwC

A solução é desenvolvida com base em serviços nativos da AWS usando Amazon SageMaker e tecnologia sem servidor para manter o desempenho e a escalabilidade elevados e os custos de operação baixos.

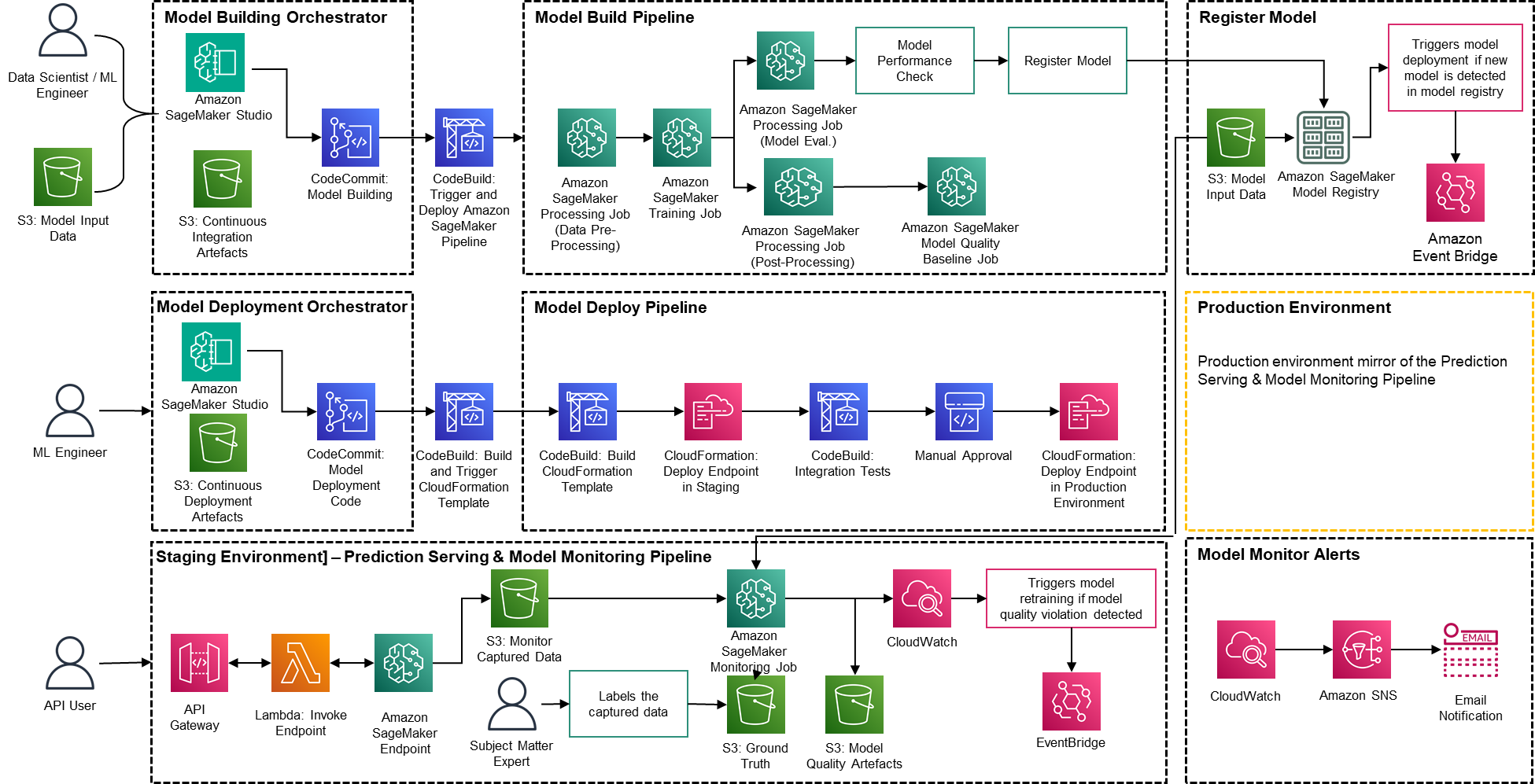

Figura 2 – Arquitetura do PwC Machine Learning Ops Accelerator

- O PwC Machine Learning Ops Accelerator fornece um direito de acesso personalizado para desenvolvimento, uso e operações que permite que engenheiros de ML e cientistas de dados automatizem a implantação de pipelines (treinamento e atendimento) e respondam rapidamente às mudanças na qualidade do modelo. Gerenciador de funções do Amazon SageMaker é usado para implementar atividades de ML baseadas em funções e Amazon S3 é usado para armazenar dados de entrada e artefatos.

- A solução usa ativos de criação de modelo existentes do cliente e cria uma estrutura flexível e extensível em torno disso usando serviços nativos da AWS. Foram criadas integrações entre Amazon S3, Git e AWS CodeCommit que permitem o controle de versão de conjuntos de dados com gerenciamento futuro mínimo.

- O modelo AWS CloudFormation é gerado usando Kit de desenvolvimento da Nuvem AWS (AWS CDK). O AWS CDK oferece a capacidade de gerenciar alterações para a solução completa. O pipeline automatizado inclui etapas para armazenamento de modelo pronto para uso e rastreamento de métricas.

- O PwC MLOps Accelerator foi projetado para ser modular e entregue como infraestrutura como código (IaC) para permitir implantações automáticas. O processo de implantação usa AWS CodeCommit, AWS CodeBuild, AWS Code Pipelinee modelo do AWS CloudFormation. Uma solução completa de ponta a ponta para operacionalizar um modelo de ML está disponível como código implantável.

- Por meio de uma série de modelos IaC, três componentes distintos são implantados: construção de modelo, implantação de modelo e monitoramento de modelo e serviço de previsão, usando Pipelines Amazon SageMaker

- O pipeline de construção de modelo automatiza o processo de treinamento e avaliação do modelo e permite a aprovação e o registro do modelo treinado.

- O pipeline de implantação de modelo fornece a infraestrutura necessária para implantar o modelo de ML para inferência em lote e em tempo real.

- O pipeline de monitoramento e previsão de modelos implanta a infraestrutura necessária para fornecer previsões e monitorar o desempenho do modelo.

- O PwC MLOps Accelerator foi projetado para ser independente de modelos de ML, estruturas de ML e ambientes de tempo de execução. A solução permite o uso familiar de linguagens de programação como Python e R, ferramentas de desenvolvimento como Jupyter Notebook e estruturas de ML por meio de um arquivo de configuração. Essa flexibilidade torna mais fácil para os cientistas de dados refinar continuamente os modelos e implantá-los usando sua linguagem e ambiente preferidos.

- A solução possui integrações integradas para usar ferramentas pré-construídas ou personalizadas para atribuir tarefas de etiquetagem usando Verdade no solo do Amazon SageMaker para conjuntos de dados de treinamento para fornecer treinamento e monitoramento contínuos.

- O pipeline de ML ponta a ponta é arquitetado usando recursos nativos do SageMaker (Estúdio Amazon SageMaker , Pipelines de criação de modelos do Amazon SageMaker, Experimentos Amazon SageMaker e Endpoints do Amazon SageMaker).

- A solução usa recursos integrados do Amazon SageMaker para controle de versão de modelo, rastreamento de linhagem de modelo, compartilhamento de modelo e inferência sem servidor com Registro de modelos do Amazon SageMaker.

- Assim que o modelo estiver em produção, a solução monitora continuamente a qualidade dos modelos de ML em tempo real. Monitor de modelo do Amazon SageMaker é usado para monitorar continuamente modelos em produção. O Amazon CloudWatch Logs é usado para coletar arquivos de log que monitoram o status do modelo, e notificações são enviadas usando o Amazon SNS quando a qualidade do modelo atinge determinados limites. Registradores nativos como (boto3) são usados para capturar o status da execução para agilizar a solução de problemas.

Passo a passo da solução

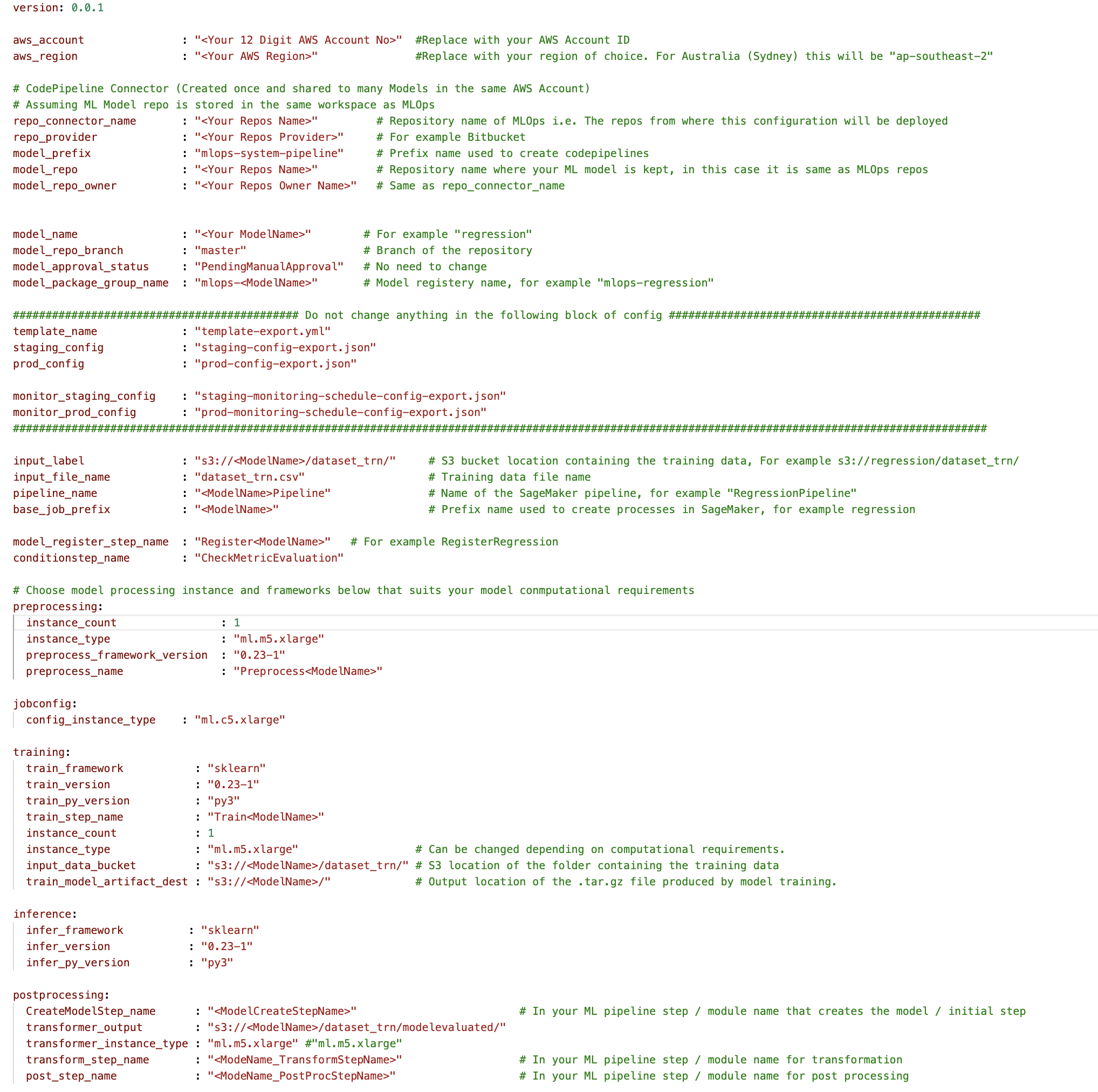

O passo a passo a seguir se aprofunda nas etapas padrão para criar o processo MLOps para um modelo usando o PwC MLOps Accelerator. Este passo a passo descreve um caso de uso de um engenheiro de MLOps que deseja implantar o pipeline para um modelo de ML desenvolvido recentemente usando um arquivo de definição/configuração simples e intuitivo.

Figura 3 – Ciclo de vida do processo PwC Machine Learning Ops Accelerator

- Para começar, inscreva-se Acelerador PwC MLOps para obter acesso aos artefatos da solução. Toda a solução é baseada em um arquivo YAML de configuração (

config.yaml) por modelo. Todos os detalhes necessários para executar a solução estão contidos nesse arquivo de configuração e armazenados junto com o modelo em um repositório Git. O arquivo de configuração servirá como entrada para automatizar as etapas do fluxo de trabalho, externalizando parâmetros e configurações importantes fora do código. - O engenheiro de ML é obrigado a preencher

config.yamlarquivo e acionar o pipeline MLOps. Os clientes podem configurar uma conta AWS, o repositório, o modelo, os dados usados, o nome do pipeline, a estrutura de treinamento, o número de instâncias a serem usadas para treinamento, a estrutura de inferência e quaisquer etapas de pré e pós-processamento e vários outros configurações para verificar a qualidade, viés e explicabilidade do modelo.

Figura 4 – Configuração do Machine Learning Ops Accelerator YAML

- Um arquivo YAML simples é usado para configurar os requisitos de treinamento, implantação, monitoramento e tempo de execução de cada modelo. Uma vez o

config.yamlé configurado adequadamente e salvo junto com o modelo em seu próprio repositório Git, o orquestrador de construção de modelo é invocado. Ele também pode ler um modelo Bring-Your-Own que pode ser configurado por meio de YAML para acionar a implantação do pipeline de construção de modelo. - Tudo após esse ponto é automatizado pela solução e não precisa do envolvimento do engenheiro de ML ou do cientista de dados. O pipeline responsável pela construção do modelo de ML inclui pré-processamento de dados, treinamento de modelo, avaliação de modelo e processamento ost. Se o modelo passar nos testes automatizados de qualidade e desempenho, o modelo será salvo em um registro e os artefatos serão gravados no armazenamento do Amazon S3 de acordo com as definições nos arquivos YAML. Isso aciona a criação do pipeline de implantação do modelo para esse modelo de ML.

Figura 5 – Exemplo de fluxo de trabalho de implantação de modelo

- Em seguida, um modelo de implantação automatizado provisiona o modelo em um ambiente de preparo com um endpoint ativo. Após a aprovação, o modelo é automaticamente implantado no ambiente de produção.

- A solução implanta dois pipelines vinculados. O serviço de previsão implanta um endpoint ativo acessível por meio do qual as previsões podem ser servidas. O monitoramento do modelo cria uma ferramenta de monitoramento contínuo que calcula as principais métricas de desempenho e qualidade do modelo, acionando o novo treinamento do modelo se uma mudança significativa na qualidade do modelo for detectada.

- Agora que você passou pela criação e implantação inicial, o engenheiro de MLOps pode configurar alertas de falha para ser alertado sobre problemas, por exemplo, quando um pipeline não executa o trabalho pretendido.

- MLOps não se trata mais de empacotar, testar e implantar componentes de serviço em nuvem semelhantes a uma implantação tradicional de CI/CD; é um sistema que deve implantar automaticamente outro serviço. Por exemplo, o pipeline de treinamento de modelo implanta automaticamente o pipeline de implantação de modelo para habilitar o serviço de previsão, que por sua vez habilita o serviço de monitoramento de modelo.

Conclusão

Em resumo, o MLOps é fundamental para qualquer organização que pretenda implantar modelos de ML em sistemas de produção em escala. A PwC desenvolveu um acelerador para automatizar a construção, implantação e manutenção de modelos de ML por meio da integração de ferramentas DevOps no processo de desenvolvimento de modelos.

Nesta postagem, exploramos como a solução PwC é alimentada por serviços de ML nativos da AWS e ajuda a adotar práticas de MLOps para que as empresas possam acelerar sua jornada de IA e obter mais valor com seus modelos de ML. Seguimos as etapas que um usuário seguiria para acessar o PwC Machine Learning Ops Accelerator, executar os pipelines e implantar um caso de uso de ML que integra vários componentes do ciclo de vida de um modelo de ML.

Para começar sua jornada de MLOps na Nuvem AWS em escala e executar cargas de trabalho de produção de ML, inscreva-se em Operações de aprendizado de máquina da PwC.

Sobre os autores

Kiran Kumar Ballari é arquiteto de soluções principal na Amazon Web Services (AWS). Ele é um evangelista que adora ajudar os clientes a aproveitar novas tecnologias e construir soluções industriais repetíveis para resolver seus problemas. Ele é especialmente apaixonado por engenharia de software, IA generativa e por ajudar empresas no desenvolvimento de produtos de IA/ML.

Kiran Kumar Ballari é arquiteto de soluções principal na Amazon Web Services (AWS). Ele é um evangelista que adora ajudar os clientes a aproveitar novas tecnologias e construir soluções industriais repetíveis para resolver seus problemas. Ele é especialmente apaixonado por engenharia de software, IA generativa e por ajudar empresas no desenvolvimento de produtos de IA/ML.

Ankur Goyal é diretor da prática de Nuvem e Digital da PwC Austrália, com foco em Dados, Análise e IA. Ankur tem ampla experiência no apoio a organizações dos setores público e privado na condução de transformações tecnológicas e no design de soluções inovadoras, aproveitando ativos de dados e tecnologias.

Ankur Goyal é diretor da prática de Nuvem e Digital da PwC Austrália, com foco em Dados, Análise e IA. Ankur tem ampla experiência no apoio a organizações dos setores público e privado na condução de transformações tecnológicas e no design de soluções inovadoras, aproveitando ativos de dados e tecnologias.

Karthikeyan Chokappa (KC) é gerente na prática de nuvem e digital da PwC Australia, com foco em dados, análises e IA. A KC é apaixonada por projetar, desenvolver e implantar soluções analíticas completas que transformam dados em ativos de decisão valiosos para melhorar o desempenho e a utilização e reduzir o custo total de propriedade de coisas conectadas e inteligentes.

Karthikeyan Chokappa (KC) é gerente na prática de nuvem e digital da PwC Australia, com foco em dados, análises e IA. A KC é apaixonada por projetar, desenvolver e implantar soluções analíticas completas que transformam dados em ativos de decisão valiosos para melhorar o desempenho e a utilização e reduzir o custo total de propriedade de coisas conectadas e inteligentes.

Rama Lankalapalli é arquiteto de soluções parceiro sênior na AWS, trabalhando com a PwC para acelerar as migrações e modernizações de seus clientes para a AWS. Ele trabalha em diversos setores para acelerar a adoção da Nuvem AWS. Sua experiência reside na arquitetura de soluções de nuvem eficientes e escaláveis, impulsionando a inovação e a modernização de aplicações de clientes, aproveitando os serviços da AWS e estabelecendo bases de nuvem resilientes.

Rama Lankalapalli é arquiteto de soluções parceiro sênior na AWS, trabalhando com a PwC para acelerar as migrações e modernizações de seus clientes para a AWS. Ele trabalha em diversos setores para acelerar a adoção da Nuvem AWS. Sua experiência reside na arquitetura de soluções de nuvem eficientes e escaláveis, impulsionando a inovação e a modernização de aplicações de clientes, aproveitando os serviços da AWS e estabelecendo bases de nuvem resilientes.

Jeejee Unwalla é arquiteto de soluções sênior na AWS e gosta de orientar os clientes na solução de desafios e no pensamento estratégico. Ele é apaixonado por tecnologia e dados e por permitir a inovação.

Jeejee Unwalla é arquiteto de soluções sênior na AWS e gosta de orientar os clientes na solução de desafios e no pensamento estratégico. Ele é apaixonado por tecnologia e dados e por permitir a inovação.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/driving-advanced-analytics-outcomes-at-scale-using-amazon-sagemaker-powered-pwcs-machine-learning-ops-accelerator/

- :tem

- :é

- :não

- $UP

- 1

- 100

- 1951

- 2024

- 32

- 33

- 7

- a

- habilidade

- Sobre

- acelerar

- acelerador

- Acesso

- acessível

- Conta

- em

- atividade

- Adicional

- endereço

- adotar

- Adoção

- avançado

- Vantagem

- Depois de

- AI

- AI / ML

- visa

- Alertas

- Todos os Produtos

- permitir

- permite

- juntamente

- ao lado de

- já

- tb

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- analítica

- e

- Outro

- qualquer

- Aplicação

- aplicações

- aplica

- adequadamente

- aprovação

- aprovar

- arquitetura

- SOMOS

- por aí

- AS

- Ativos

- associado

- At

- auditabilidade

- Australia

- automatizar

- Automatizado

- automatiza

- Automático

- automaticamente

- Automação

- disponível

- AWS

- Formação da Nuvem AWS

- baseado

- BE

- torna-se

- tornando-se

- sido

- abaixo

- MELHOR

- melhores práticas

- entre

- viés

- construir

- construir

- Prédio

- Constrói

- construído

- construídas em

- negócio

- negócios

- mas a

- by

- calcula

- CAN

- candidato

- capacidades

- capacidade

- capturar

- capturas

- casas

- casos

- CD

- central

- certo

- desafiar

- desafios

- desafiante

- alterar

- Alterações

- verificar

- Na nuvem

- código

- colaboração

- coletar

- combina

- Empresas

- completar

- complexidades

- compliance

- componentes

- compreende

- compromisso

- Configuração

- configurado

- conectado

- contida

- contexto

- contínuo

- continuamente

- controles

- Custo

- custos

- crio

- cria

- criação

- crítico

- crucial

- personalizadas

- cliente

- Clientes

- dados,

- cientista de dados

- conjuntos de dados

- decisão

- decisões

- definições

- entregue

- entregando

- entrega

- Entrega

- implantar

- implantado

- Implantação

- desenvolvimento

- Implantações

- implanta

- projetado

- concepção

- detalhes

- descobrir

- detectou

- desenvolver

- desenvolvido

- em desenvolvimento

- Desenvolvimento

- ferramentas de desenvolvimento

- diferente

- digital

- Diretor

- distinto

- diferente

- do

- parece

- down

- dirigido

- condução

- cada

- facilidade

- facilmente

- eficácia

- eficiente

- ou

- permitir

- permite

- permitindo

- end-to-end

- Ponto final

- engenheiro

- Engenharia

- Engenheiros

- garantir

- Empreendimento

- Todo

- Direito

- Meio Ambiente

- ambientes

- erros

- especialmente

- estabelecendo

- avaliação

- Evangelista

- exemplo

- Executa

- execução

- existir

- existente

- a acelerar

- vasta experiência

- experimentar

- experiência

- Explorado

- extenso

- Experiência Extensiva

- falha

- Falha

- familiar

- Funcionalidades

- retornos

- Figura

- Envie o

- Arquivos

- final

- Flexibilidade

- flexível

- Foco

- focado

- seguinte

- Escolha

- Fundações

- fração

- Quadro

- enquadramentos

- da

- futuro

- Ganho

- gerado

- generativo

- IA generativa

- ter

- Git

- ido

- governo

- governa

- Solo

- Growth

- manipular

- Ter

- he

- ajudar

- ajuda

- ajuda

- Alta

- sua

- acessos

- Como funciona o dobrador de carta de canal

- Contudo

- HTML

- HTTPS

- if

- executar

- importante

- melhorar

- melhorias

- melhorar

- in

- inclui

- Crescimento

- indústrias

- indústria

- Infraestrutura

- do estado inicial,

- Inovação

- inovadores

- entrada

- integral

- integrado

- Integra-se

- Integração

- integração

- integrações

- Inteligência

- Inteligente

- Pretendido

- para dentro

- intuitivo

- invocado

- envolvimento

- questões

- IT

- ESTÁ

- se

- Trabalho

- viagem

- jpg

- apenas por

- Guarda

- Chave

- Kumar

- marcação

- língua

- Idiomas

- Latência

- aprendizagem

- Alavancagem

- aproveitando

- encontra-se

- wifecycwe

- como

- LIMITE

- linhagem

- ligado

- viver

- log

- mais

- ama

- Baixo

- máquina

- aprendizado de máquina

- Manter

- FAZ

- gerencia

- de grupos

- Gerente

- manual

- muitos

- Posso..

- metadados

- métrico

- Métrica

- mínimo

- ML

- MLOps

- modelo

- modelos

- modulares

- Monitore

- monitoração

- monitores

- mais

- muito

- nome

- nativo

- necessário

- você merece...

- necessário

- Novo

- Novas tecnologias

- não

- caderno

- notificações

- número

- of

- on

- uma vez

- ONE

- online

- operar

- Operações

- or

- organização

- organizações

- Outros

- resultados

- lado de fora

- global

- próprio

- propriedade

- acondicionamento

- parâmetros

- parte

- parceiro

- passes

- apaixonado

- padrões

- para

- atuação

- oleoduto

- platão

- Inteligência de Dados Platão

- PlatãoData

- ponto

- Publique

- alimentado

- Prática

- prática

- práticas

- predição

- Previsões

- preferido

- Diretor

- princípios

- privado

- setor privado

- problemas

- processo

- processos

- Produto

- desenvolvimento de produtos

- Produção

- Programação

- linguagens de programação

- a promover

- promove

- protótipo

- fornecer

- fornece

- público

- Colocar

- PWC

- Python

- qualidade

- R

- rápido

- rapidamente

- Leia

- prontamente

- reais

- mundo real

- em tempo real

- recentemente

- recomendações

- reduzir

- refinar

- registrado

- registradores

- Registo

- registro

- liberar

- permanece

- Repetivel

- repositório

- requerer

- requeridos

- Requisitos

- exige

- resiliente

- Responder

- responsável

- resultar

- rever

- rigoroso

- uma conta de despesas robusta

- Tipo

- Execute

- corrida

- tempo de execução

- sábio

- salvo

- AMPLIAR

- escalável

- Escala

- cenário

- Cientista

- cientistas

- setor

- senior

- enviei

- Seqüência

- Série

- servir

- servido

- Serverless

- serviço

- Serviços

- de servir

- conjunto

- Configurações

- Sete

- vários

- compartilhando

- rede de apoio social

- mostrando

- periodo

- semelhante

- simples

- lento

- pequeno

- So

- Software

- Engenharia de software

- solução

- Soluções

- RESOLVER

- Resolvendo

- velocidade

- Estágio

- encenação

- padrão

- começado

- começa

- estado-da-arte

- Status

- Passos

- armazenamento

- loja

- armazenadas

- lojas

- franco

- Estrategicamente

- de streaming

- simplificar

- bem sucedido

- tal

- RESUMO

- Apoiar

- .

- sistemas

- Tire

- toma

- tomar

- Target

- tarefas

- equipes

- tecnologia

- Tecnologias

- Tecnologia

- modelo

- modelos

- ensaio

- testes

- do que

- que

- A

- deles

- Eles

- assim

- Este

- coisas

- Pensando

- isto

- três

- limiar

- Através da

- todo

- tempo

- para

- ferramenta

- ferramentas

- topo

- Total

- Rastreabilidade

- Rastreamento

- tradicional

- treinado

- Training

- Transformar

- Transformação

- transformações

- desencadear

- desencadeando

- VIRAR

- Passando

- dois

- único

- sobre

- Uso

- usar

- caso de uso

- usava

- Utilizador

- usos

- utilização

- validação

- Valioso

- valor

- vário

- via

- caminhou

- Passo a passo

- quer

- foi

- we

- web

- serviços web

- quando

- qual

- QUEM

- precisarão

- de

- dentro

- de gestão de documentos

- fluxos de trabalho

- trabalhar

- trabalho

- seria

- escrito

- yaml

- investimentos

- zefirnet