Manter fluxos de trabalho de aprendizado de máquina (ML) na produção é uma tarefa desafiadora porque requer a criação de pipelines de integração contínua e entrega contínua (CI/CD) para códigos e modelos de ML, controle de versão de modelo, monitoramento de dados e desvios de conceito, retreinamento de modelo e um manual processo de aprovação para garantir que novas versões do modelo atendam aos requisitos de desempenho e conformidade.

Nesta postagem, descrevemos como criar um fluxo de trabalho MLOps para inferência em lote que automatiza o agendamento de trabalhos, o monitoramento de modelos, o retreinamento e o registro, bem como o tratamento e notificação de erros usando Amazon Sage Maker, Amazon Event Bridge, AWS Lambda, Serviço de notificação simples da Amazon (Amazon SNS), HashiCorp Terraform e GitLab CI/CD. O fluxo de trabalho MLOps apresentado fornece um modelo reutilizável para gerenciar o ciclo de vida de ML por meio de automação, monitoramento, auditabilidade e escalabilidade, reduzindo assim as complexidades e os custos de manutenção de cargas de trabalho de inferência em lote na produção.

Visão geral da solução

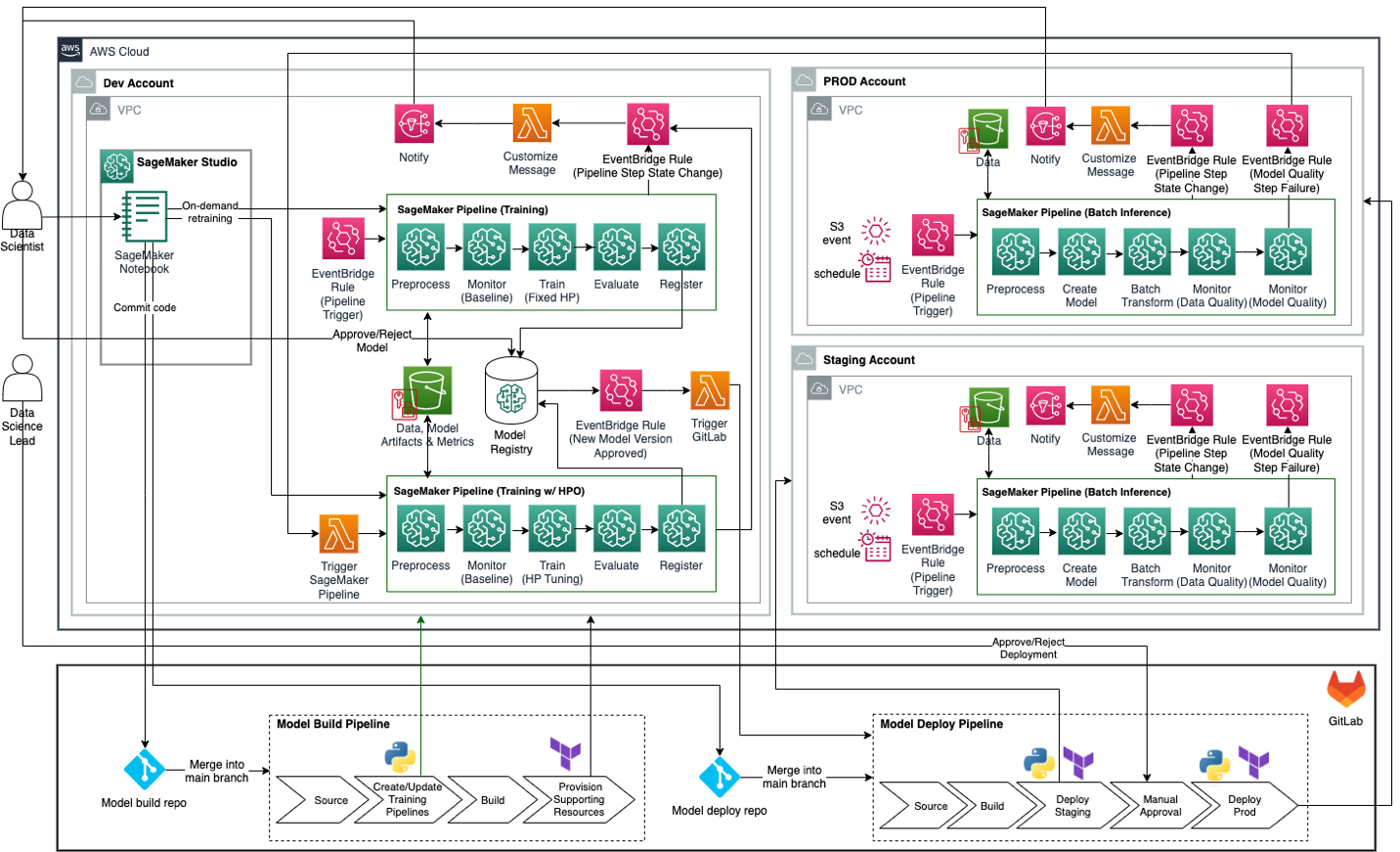

A figura a seguir ilustra a arquitetura MLOps de destino proposta para inferência de lote empresarial para organizações que usam GitLab CI/CD e infraestrutura Terraform como código (IaC) em conjunto com ferramentas e serviços AWS. GitLab CI/CD atua como macroorquestrador, orquestrando model build e model deploy pipelines, que incluem fornecimento, construção e provisionamento Pipelines Amazon SageMaker e recursos de suporte usando o SageMaker Python SDK e Terraform. SageMaker Python SDK é usado para criar ou atualizar pipelines SageMaker para treinamento, treinamento com otimização de hiperparâmetros (HPO) e inferência em lote. O Terraform é usado para criar recursos adicionais, como regras do EventBridge, funções Lambda e tópicos SNS para monitorar pipelines do SageMaker e enviar notificações (por exemplo, quando uma etapa do pipeline falha ou é bem-sucedida). O SageMaker Pipelines atua como orquestrador para treinamento de modelo de ML e fluxos de trabalho de inferência.

Esse projeto de arquitetura representa uma estratégia de múltiplas contas em que modelos de ML são criados, treinados e registrados em um registro de modelo central dentro de uma conta de desenvolvimento de ciência de dados (que tem mais controles do que uma conta típica de desenvolvimento de aplicativos). Em seguida, os pipelines de inferência são implantados em contas de preparação e produção usando automação de ferramentas DevOps, como GitLab CI/CD. O registro do modelo central também poderia ser opcionalmente colocado em uma conta de serviços compartilhados. Referir-se Modelo operacional para obter as melhores práticas em relação a uma estratégia de múltiplas contas para ML.

Nas subseções a seguir, discutiremos detalhadamente diferentes aspectos do projeto de arquitetura.

Infraestrutura como código

IaC oferece uma maneira de gerenciar a infraestrutura de TI por meio de arquivos legíveis por máquina, garantindo um controle de versão eficiente. Nesta postagem e no exemplo de código que a acompanha, demonstramos como usar HashiCorp Terraforma com GitLab CI/CD para gerenciar recursos da AWS de maneira eficaz. Esta abordagem sublinha o principal benefício da IaC, oferecendo um processo transparente e repetível na gestão da infraestrutura de TI.

Treinamento e reciclagem de modelo

Neste design, o pipeline de treinamento do SageMaker é executado de acordo com um cronograma (via EventBridge) ou com base em um Serviço de armazenamento simples da Amazon (Amazon S3) gatilho de evento (por exemplo, quando um arquivo de gatilho ou novos dados de treinamento, no caso de um único objeto de dados de treinamento, é colocado no Amazon S3) para recalibrar regularmente o modelo com novos dados. Este pipeline não introduz alterações estruturais ou materiais no modelo porque utiliza hiperparâmetros fixos que foram aprovados durante o processo de revisão do modelo empresarial.

O pipeline de treinamento registra a versão do modelo recém-treinado no Registro de modelos do Amazon SageMaker se o modelo exceder um limite de desempenho de modelo predefinido (por exemplo, RMSE para regressão e pontuação F1 para classificação). Quando uma nova versão do modelo é registrada no registro de modelos, ela aciona uma notificação ao cientista de dados responsável por meio do Amazon SNS. O cientista de dados precisa então revisar e aprovar manualmente a versão mais recente do modelo no Estúdio Amazon SageMaker UI ou por meio de uma chamada de API usando o Interface de linha de comando da AWS (AWS CLI) ou AWS SDK para Python (Boto3) antes que a nova versão do modelo possa ser utilizada para inferência.

O pipeline de treinamento do SageMaker e seus recursos de suporte são criados pelo GitLab model build pipeline, por meio de uma execução manual do pipeline do GitLab ou automaticamente quando o código é mesclado no main ramo da model build Repositório Git.

Inferência em lote

O pipeline de inferência em lote do SageMaker é executado de acordo com uma programação (via EventBridge) ou também com base em um gatilho de evento S3. O pipeline de inferência em lote extrai automaticamente a versão aprovada mais recente do modelo do registro do modelo e a utiliza para inferência. O pipeline de inferência em lote inclui etapas para verificar a qualidade dos dados em relação a uma linha de base criada pelo pipeline de treinamento, bem como a qualidade do modelo (desempenho do modelo) se rótulos de verdade estiverem disponíveis.

Se o pipeline de inferência em lote descobrir problemas de qualidade dos dados, ele notificará o cientista de dados responsável por meio do Amazon SNS. Se descobrir problemas de qualidade do modelo (por exemplo, o RMSE é maior que um limite pré-especificado), a etapa do pipeline para a verificação da qualidade do modelo falhará, o que, por sua vez, acionará um evento EventBridge para iniciar o treinamento com o pipeline HPO.

O pipeline de inferência em lote do SageMaker e seus recursos de suporte são criados pelo GitLab model deploy pipeline, por meio de uma execução manual do pipeline do GitLab ou automaticamente quando o código é mesclado no main ramo da model deploy Repositório Git.

Ajuste e reajuste do modelo

O treinamento do SageMaker com pipeline HPO é acionado quando a etapa de verificação de qualidade do modelo do pipeline de inferência em lote falha. A verificação da qualidade do modelo é realizada comparando as previsões do modelo com os rótulos reais da verdade. Se a métrica de qualidade do modelo (por exemplo, RMSE para regressão e pontuação F1 para classificação) não atender a um critério pré-especificado, a etapa de verificação de qualidade do modelo será marcada como falhada. O treinamento do SageMaker com pipeline HPO também pode ser acionado manualmente (na IU do SageMaker Studio ou por meio de uma chamada de API usando a AWS CLI ou o SageMaker Python SDK) pelo cientista de dados responsável, se necessário. Como os hiperparâmetros do modelo estão mudando, o cientista de dados responsável precisa obter a aprovação do conselho de revisão do modelo empresarial antes que a nova versão do modelo possa ser aprovada no registro do modelo.

O treinamento SageMaker com pipeline HPO e seus recursos de suporte são criados pelo GitLab model build pipeline, por meio de uma execução manual do pipeline do GitLab ou automaticamente quando o código é mesclado no main ramo da model build Repositório Git.

Monitoramento de modelo

Estatísticas de dados e linhas de base de restrições são geradas como parte do treinamento e treinamento com pipelines HPO. Eles serão salvos no Amazon S3 e também registrados com o modelo treinado no registro de modelos se o modelo for aprovado na avaliação. A arquitetura proposta para o pipeline de inferência em lote usa Monitor de modelo do Amazon SageMaker para verificações de qualidade de dados, ao usar Processamento do Amazon SageMaker etapas para verificação da qualidade do modelo. Esse design separa dados e verificações de qualidade do modelo, o que, por sua vez, permite que você envie apenas uma notificação de aviso quando um desvio de dados for detectado; e acionar o treinamento com pipeline HPO quando uma violação de qualidade do modelo for detectada.

Aprovação do modelo

Depois que um modelo recém-treinado é registrado no registro de modelos, o cientista de dados responsável recebe uma notificação. Se o modelo tiver sido treinado pelo pipeline de treinamento (recalibração com novos dados de treinamento enquanto os hiperparâmetros são corrigidos), não há necessidade de aprovação do conselho de revisão do modelo empresarial. O cientista de dados pode revisar e aprovar a nova versão do modelo de forma independente. Por outro lado, se o modelo tiver sido treinado pelo treinamento com pipeline HPO (reajuste alterando hiperparâmetros), a nova versão do modelo precisará passar pelo processo de revisão empresarial antes de poder ser usada para inferência na produção. Quando o processo de revisão for concluído, o cientista de dados poderá prosseguir e aprovar a nova versão do modelo no registro do modelo. Alterando o status do pacote de modelo para Approved irá acionar uma função Lambda via EventBridge, que por sua vez acionará o GitLab model deploy pipeline por meio de uma chamada de API. Isso atualizará automaticamente o pipeline de inferência em lote do SageMaker para utilizar a versão aprovada mais recente do modelo para inferência.

Existem duas maneiras principais de aprovar ou rejeitar uma nova versão de modelo no registro de modelo: usando o AWS SDK para Python (Boto3) ou pela interface do usuário do SageMaker Studio. Por padrão, tanto o pipeline de treinamento quanto o conjunto de pipeline de treinamento com HPO ModelApprovalStatus para PendingManualApproval. O cientista de dados responsável pode atualizar o status de aprovação do modelo ligando para o update_model_package API do Boto3. Referir-se Atualizar o status de aprovação de um modelo para obter detalhes sobre como atualizar o status de aprovação de um modelo por meio da IU do SageMaker Studio.

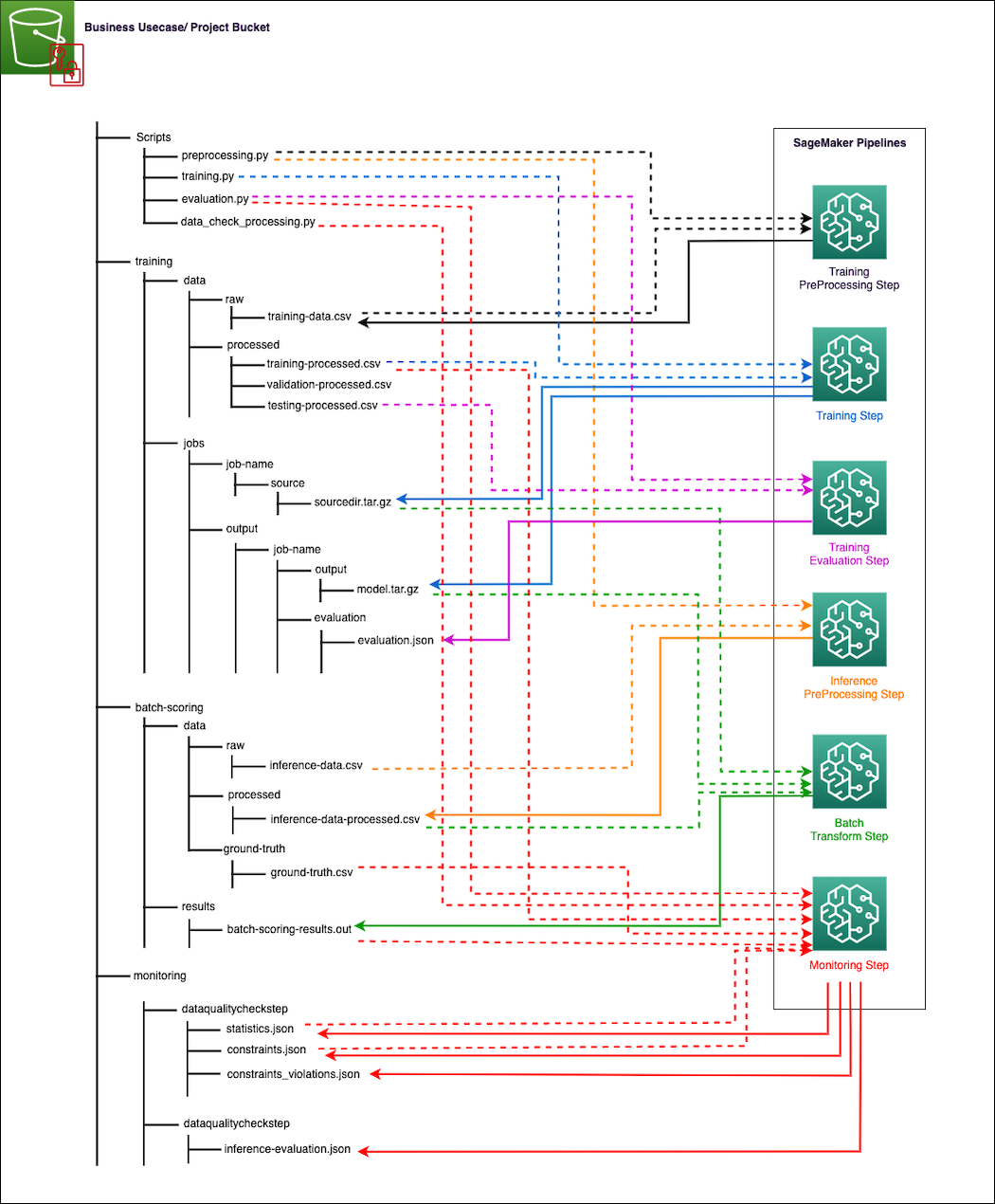

Projeto de E/S de dados

O SageMaker interage diretamente com o Amazon S3 para ler entradas e armazenar saídas de etapas individuais nos pipelines de treinamento e inferência. O diagrama a seguir ilustra como diferentes scripts Python, dados de treinamento brutos e processados, dados de inferência brutos e processados, resultados de inferência e rótulos de verdade (se disponíveis para monitoramento de qualidade do modelo), artefatos de modelo, métricas de avaliação de treinamento e inferência (monitoramento de qualidade do modelo), bem como linhas de base de qualidade de dados e relatórios de violação (para monitoramento de qualidade de dados) podem ser organizados em um intervalo S3. A direção das setas no diagrama indica quais arquivos são entradas ou saídas de suas respectivas etapas nos pipelines do SageMaker. As setas foram codificadas por cores com base no tipo de etapa do pipeline para facilitar a leitura. O pipeline fará upload automaticamente de scripts Python do repositório GitLab e armazenará arquivos de saída ou artefatos de modelo de cada etapa no caminho S3 apropriado.

O engenheiro de dados é responsável pelo seguinte:

- Carregar dados de treinamento rotulados para o caminho apropriado no Amazon S3. Isso inclui adicionar novos dados de treinamento regularmente para garantir que o pipeline de treinamento e o treinamento com pipeline HPO tenham acesso aos dados de treinamento recentes para novo treinamento e reajuste do modelo, respectivamente.

- Carregar dados de entrada para inferência no caminho apropriado no bucket S3 antes de uma execução planejada do pipeline de inferência.

- Carregar rótulos verdadeiros para o caminho S3 apropriado para monitoramento da qualidade do modelo.

O cientista de dados é responsável pelo seguinte:

- Preparar rótulos verdadeiros e fornecê-los à equipe de engenharia de dados para upload no Amazon S3.

- Levar as versões do modelo treinadas pelo treinamento com pipeline HPO através do processo de revisão empresarial e obter as aprovações necessárias.

- Aprovar ou rejeitar manualmente versões de modelo recém-treinadas no registro de modelo.

- Aprovar a porta de produção para o pipeline de inferência e apoiar recursos a serem promovidos para produção.

Código de amostra

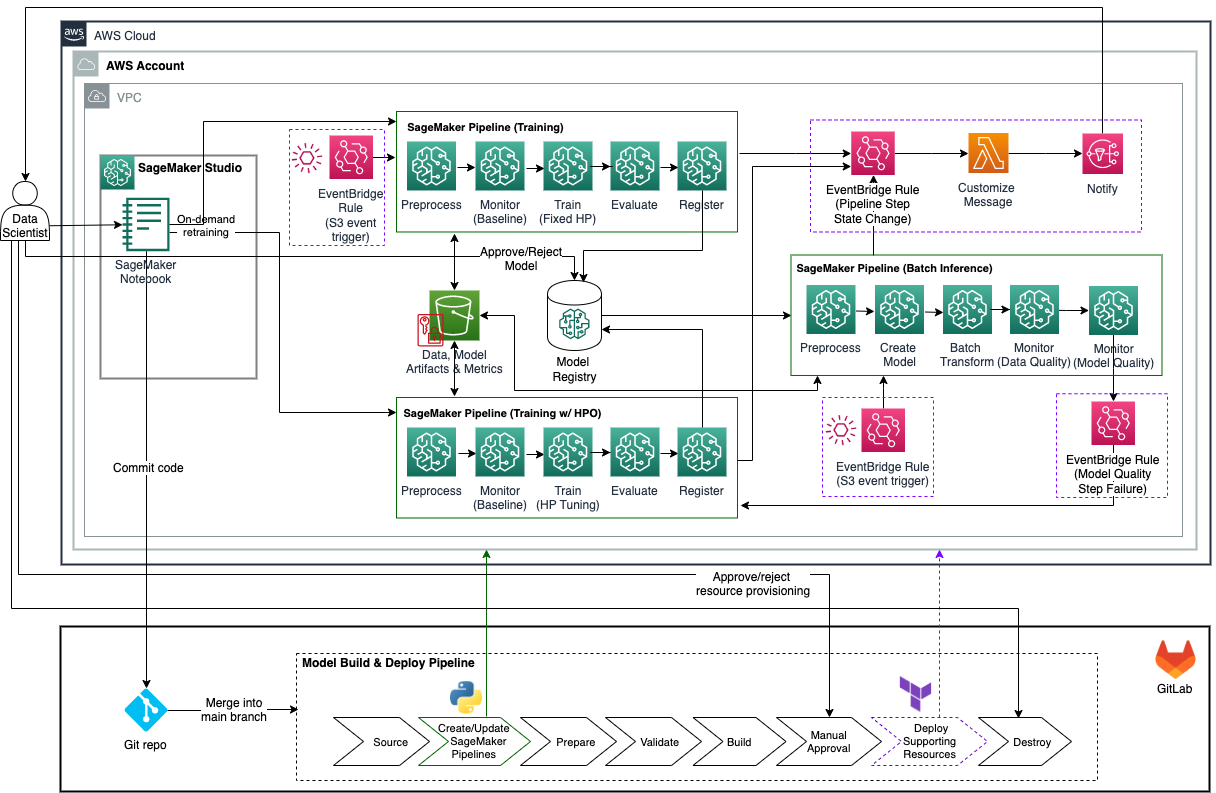

Nesta seção, apresentamos um exemplo de código para operações de inferência em lote com uma configuração de conta única, conforme mostrado no diagrama de arquitetura a seguir. O código de exemplo pode ser encontrado no Repositório GitHube pode servir como ponto de partida para inferência em lote com monitoramento de modelo e retreinamento automático usando portas de qualidade frequentemente exigidas pelas empresas. O código de amostra difere da arquitetura de destino das seguintes maneiras:

- Ele usa uma única conta AWS para construir e implantar o modelo de ML e recursos de suporte. Referir-se Organizando seu ambiente da AWS usando várias contas para obter orientação sobre configuração de várias contas na AWS.

- Ele usa um único pipeline de CI/CD do GitLab para construir e implantar o modelo de ML e recursos de suporte.

- Quando uma nova versão do modelo é treinada e aprovada, o pipeline de CI/CD do GitLab não é acionado automaticamente e precisa ser executado manualmente pelo cientista de dados responsável para atualizar o pipeline de inferência em lote do SageMaker com a versão aprovada mais recente do modelo.

- Ele oferece suporte apenas a gatilhos baseados em eventos S3 para executar os pipelines de treinamento e inferência do SageMaker.

Pré-requisitos

Você deve ter os seguintes pré-requisitos antes de implantar esta solução:

- Uma conta da AWS

- Estúdio SageMaker

- Uma função de execução do SageMaker com leitura/gravação do Amazon S3 e Serviço de gerenciamento de chaves AWS (AWS KMS) permissões de criptografia/descriptografia

- Um bucket S3 para armazenar dados, scripts e artefatos de modelo

- Terraform versão 0.13.5 ou superior

- GitLab com um executor Docker funcional para executar os pipelines

- A CLI da AWS

- jq

- descompactar

- Python3 (Python 3.7 ou superior) e os seguintes pacotes Python:

- boto3

- sábio

- pandas

- pyyaml

Estrutura do repositório

A Repositório GitHub contém os seguintes diretórios e arquivos:

/code/lambda_function/– Este diretório contém o arquivo Python para uma função Lambda que prepara e envia mensagens de notificação (via Amazon SNS) sobre alterações de estado de etapa dos pipelines do SageMaker/data/– Este diretório inclui os arquivos de dados brutos (dados de treinamento, inferência e dados reais)/env_files/– Este diretório contém o arquivo de variáveis de entrada do Terraform/pipeline_scripts/– Este diretório contém três scripts Python para criar e atualizar treinamento, inferência e treinamento com pipelines HPO SageMaker, bem como arquivos de configuração para especificar os parâmetros de cada pipeline/scripts/– Este diretório contém scripts Python adicionais (como pré-processamento e avaliação) que são referenciados pelo treinamento, inferência e treinamento com pipelines HPO.gitlab-ci.yml– Este arquivo especifica a configuração do pipeline CI/CD do GitLab/events.tf– Este arquivo define os recursos do EventBridge/lambda.tf– Este arquivo define a função de notificação Lambda e o associado Gerenciamento de acesso e identidade da AWS recursos (IAM)/main.tf– Este arquivo define fontes de dados Terraform e variáveis locais/sns.tf– Este arquivo define os recursos do Amazon SNS/tags.json– Este arquivo JSON permite declarar pares de valores-chave de tags personalizados e anexá-los aos recursos do Terraform usando uma variável local/variables.tf– Este arquivo declara todas as variáveis do Terraform

Variáveis e configuração

A tabela a seguir mostra as variáveis usadas para parametrizar esta solução. Consulte o ./env_files/dev_env.tfvars arquivo para obter mais detalhes.

| Nome | Descrição |

bucket_name |

Bucket S3 usado para armazenar dados, scripts e artefatos de modelo |

bucket_prefix |

Prefixo S3 para o projeto de ML |

bucket_train_prefix |

Prefixo S3 para dados de treinamento |

bucket_inf_prefix |

Prefixo S3 para dados de inferência |

notification_function_name |

Nome da função Lambda que prepara e envia mensagens de notificação sobre alterações de estado de etapa dos pipelines do SageMaker |

custom_notification_config |

A configuração para personalizar a mensagem de notificação para etapas específicas do pipeline do SageMaker quando um status específico de execução do pipeline é detectado |

email_recipient |

A lista de endereços de e-mail para receber notificações de mudança de estado de etapa dos pipelines do SageMaker |

pipeline_inf |

Nome do pipeline de inferência do SageMaker |

pipeline_train |

Nome do pipeline de treinamento do SageMaker |

pipeline_trainwhpo |

Nome do treinamento SageMaker com pipeline HPO |

recreate_pipelines |

Se definido para true, os três pipelines SageMaker existentes (treinamento, inferência, treinamento com HPO) serão excluídos e novos serão criados quando o GitLab CI/CD for executado |

model_package_group_name |

Nome do grupo de pacotes de modelo |

accuracy_mse_threshold |

Valor máximo do MSE antes de exigir uma atualização do modelo |

role_arn |

ARN da função IAM da função de execução do pipeline do SageMaker |

kms_key |

ARN da chave KMS para criptografia do Amazon S3 e SageMaker |

subnet_id |

ID de sub-rede para configuração de rede do SageMaker |

sg_id |

ID do grupo de segurança para configuração de rede do SageMaker |

upload_training_data |

Se definido para true, os dados de treinamento serão carregados no Amazon S3 e essa operação de upload acionará a execução do pipeline de treinamento |

upload_inference_data |

Se definido para true, os dados de inferência serão carregados no Amazon S3 e essa operação de upload acionará a execução do pipeline de inferência |

user_id |

O ID do funcionário do usuário do SageMaker que é adicionado como uma tag aos recursos do SageMaker |

Implante a solução

Conclua as etapas a seguir para implantar a solução em sua conta da AWS:

- Clone o repositório GitHub em seu diretório de trabalho.

- Revise e modifique a configuração do pipeline de CI/CD do GitLab para se adequar ao seu ambiente. A configuração é especificada no

./gitlab-ci.ymlarquivo. - Consulte o arquivo README para atualizar as variáveis gerais da solução no

./env_files/dev_env.tfvarsarquivo. Este arquivo contém variáveis para scripts Python e automação Terraform.- Verifique os parâmetros adicionais do SageMaker Pipelines definidos nos arquivos YAML em

./batch_scoring_pipeline/pipeline_scripts/. Revise e atualize os parâmetros, se necessário.

- Verifique os parâmetros adicionais do SageMaker Pipelines definidos nos arquivos YAML em

- Revise os scripts de criação de pipeline do SageMaker em

./pipeline_scripts/bem como os scripts que são referenciados por eles no./scripts/pasta. Os scripts de exemplo fornecidos no repositório GitHub são baseados no Conjunto de dados de abalone. Se você for usar um conjunto de dados diferente, certifique-se de atualizar os scripts para atender ao seu problema específico. - Coloque seus arquivos de dados no

./data/pasta usando a seguinte convenção de nomenclatura. Se você estiver usando o conjunto de dados Abalone junto com os scripts de exemplo fornecidos, certifique-se de que os arquivos de dados não tenham cabeçalho, que os dados de treinamento incluam variáveis independentes e de destino com a ordem original das colunas preservada, que os dados de inferência incluam apenas variáveis independentes e a verdade básica arquivo inclui apenas a variável de destino.training-data.csvinference-data.csvground-truth.csv

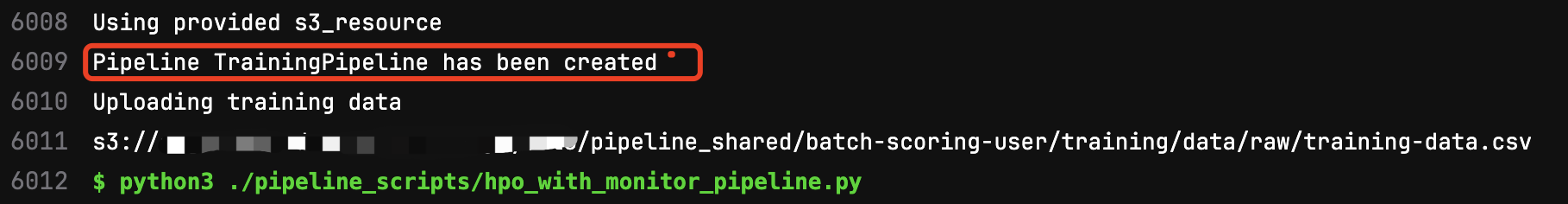

- Confirme e envie o código para o repositório para acionar a execução do pipeline de CI/CD do GitLab (primeira execução). Observe que a primeira execução do pipeline falhará no

pipelineestágio porque ainda não há uma versão de modelo aprovada para uso pelo script do pipeline de inferência. Revise o log de etapas e verifique um novo pipeline do SageMaker chamadoTrainingPipelinefoi criado com sucesso.

-

- Abra a IU do SageMaker Studio, revise e execute o pipeline de treinamento.

- Após a execução bem-sucedida do pipeline de treinamento, aprove a versão do modelo registrada no registro do modelo e execute novamente todo o pipeline de CI/CD do GitLab.

- Revise a saída do plano do Terraform na seção

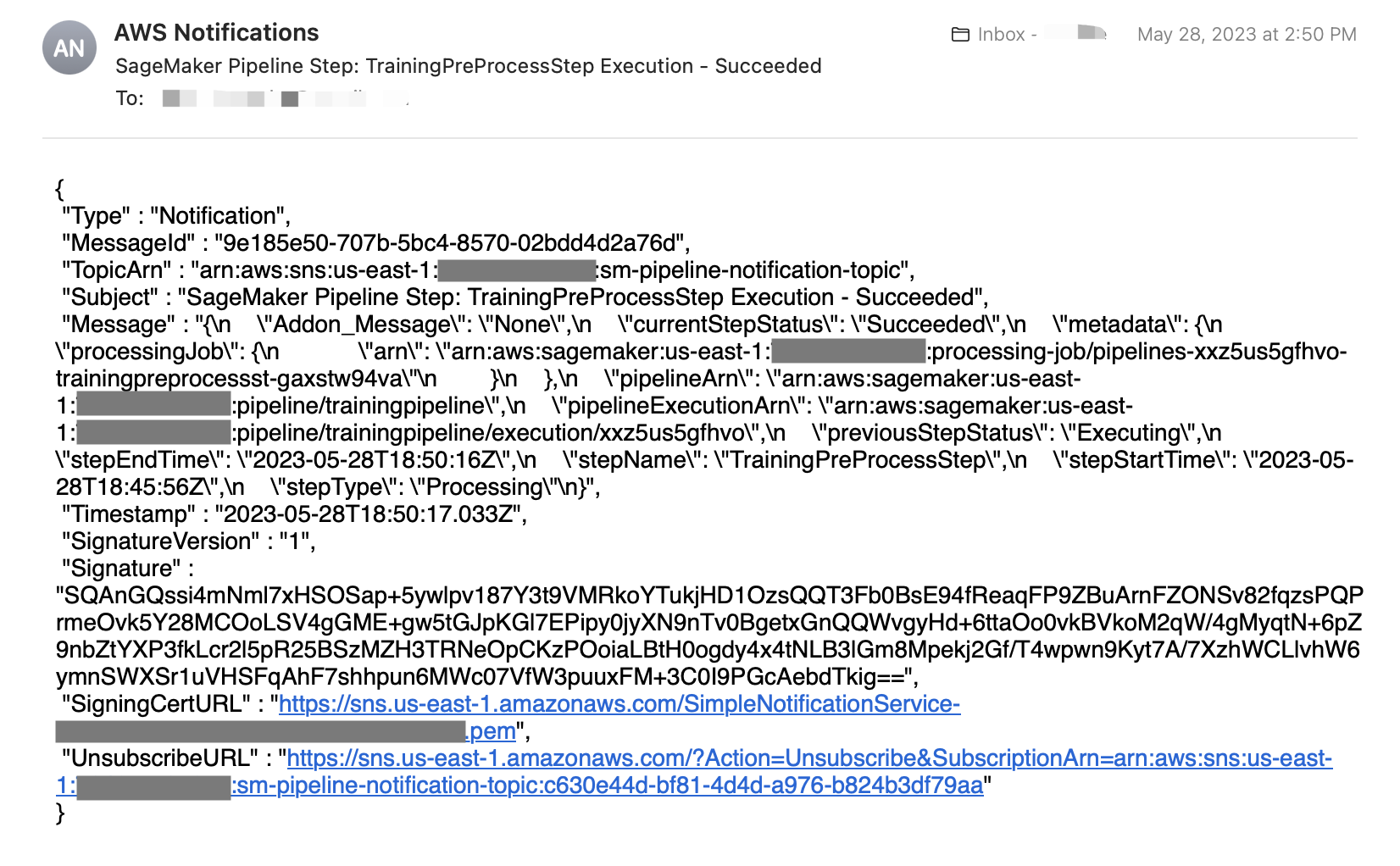

buildestágio. Aprove o manualapplyestágio no pipeline de CI/CD do GitLab para retomar a execução do pipeline e autorizar o Terraform a criar os recursos de monitoramento e notificação em sua conta da AWS. - Por fim, revise o status de execução e a saída dos pipelines do SageMaker na IU do SageMaker Studio e verifique se há mensagens de notificação em seu e-mail, conforme mostrado na captura de tela a seguir. O corpo da mensagem padrão está no formato JSON.

Pipelines do SageMaker

Nesta seção, descrevemos os três pipelines do SageMaker no fluxo de trabalho MLOps.

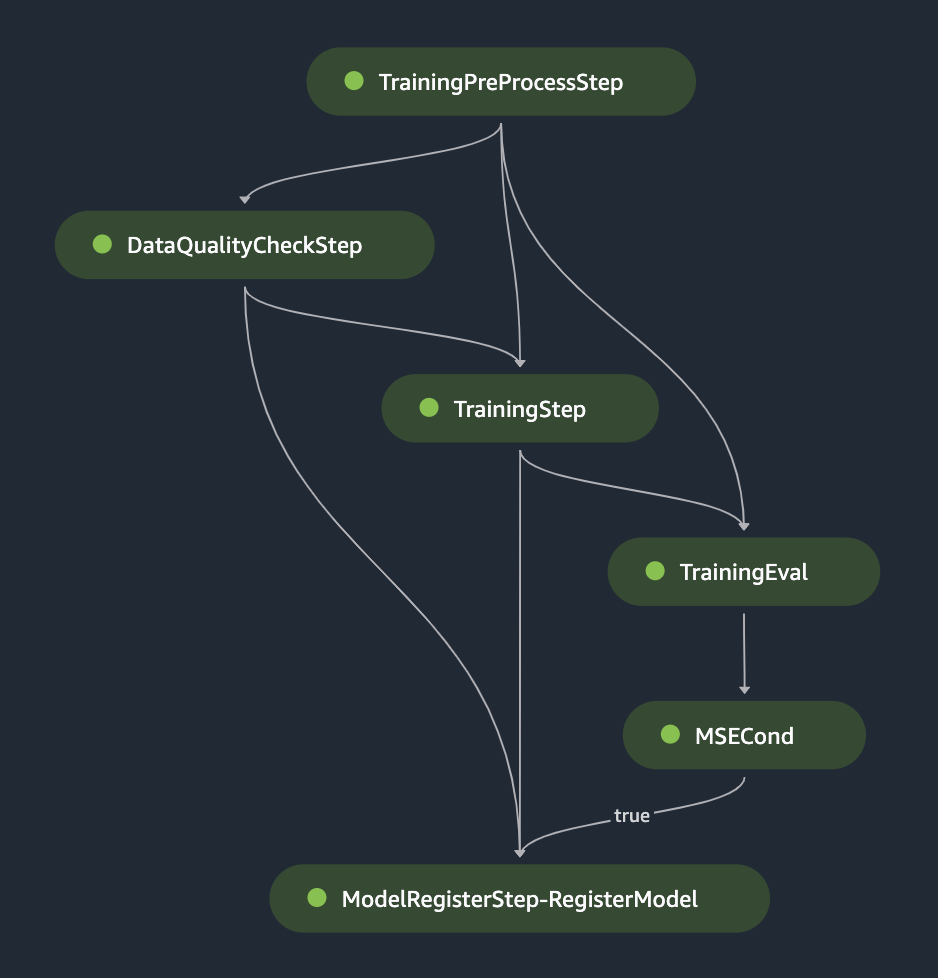

Canal de treinamento

O pipeline de treinamento é composto pelas seguintes etapas:

- Etapa de pré-processamento, incluindo transformação e codificação de recursos

- Etapa de verificação da qualidade dos dados para gerar estatísticas de dados e linha de base de restrições usando os dados de treinamento

- Etapa de treinamento

- Etapa de avaliação do treinamento

- Etapa de condição para verificar se o modelo treinado atende a um limite de desempenho pré-especificado

- Etapa de registro do modelo para registrar o modelo recém-treinado no registro de modelo se o modelo treinado atender ao limite de desempenho necessário

Tanto o skip_check_data_quality e register_new_baseline_data_quality os parâmetros estão configurados para True no pipeline de treinamento. Esses parâmetros instruem o pipeline a ignorar a verificação de qualidade dos dados e apenas criar e registrar novas estatísticas de dados ou linhas de base de restrições usando os dados de treinamento. A figura a seguir mostra uma execução bem-sucedida do pipeline de treinamento.

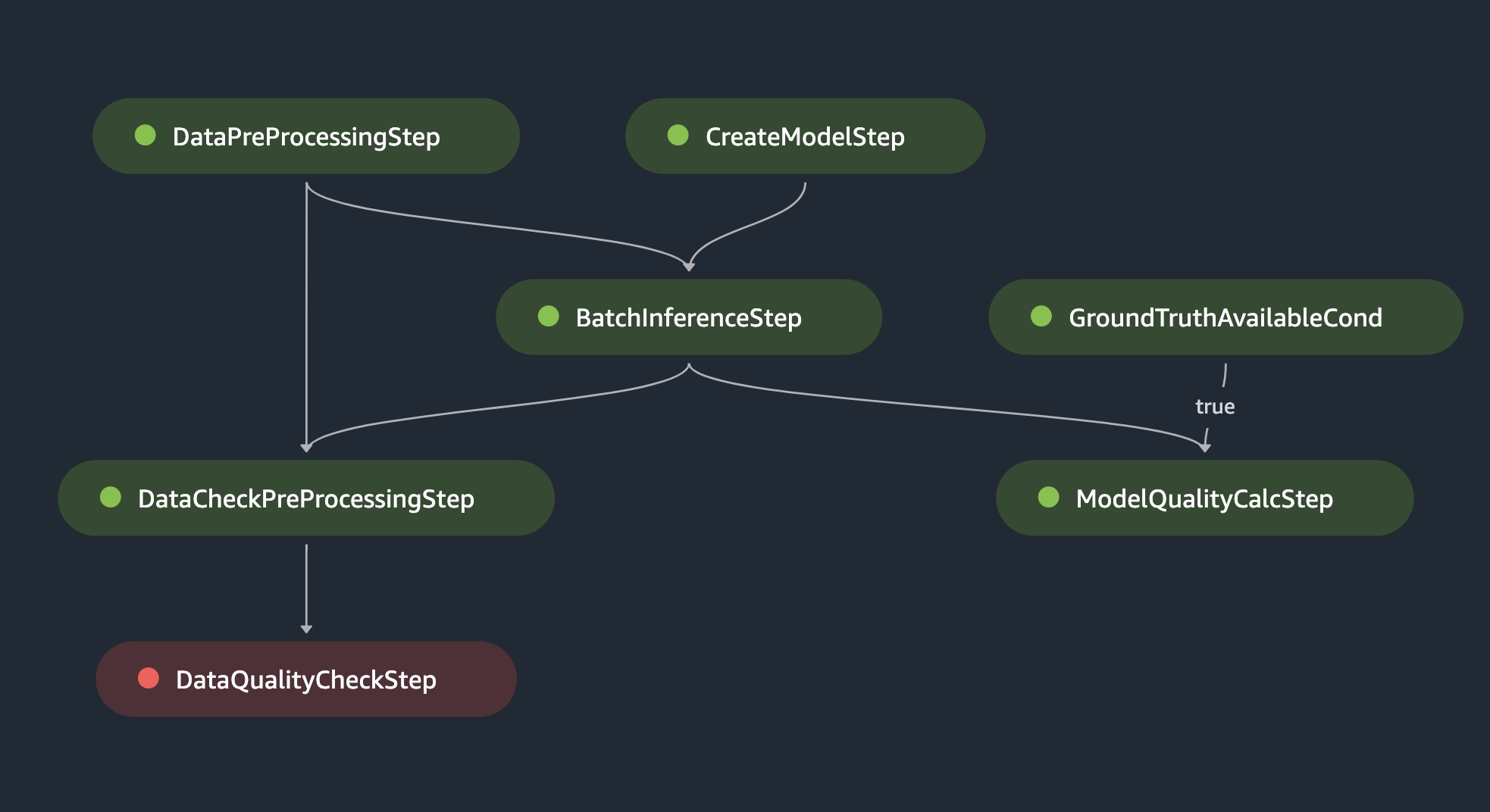

Pipeline de inferência em lote

O pipeline de inferência em lote é composto pelas seguintes etapas:

- Criando um modelo a partir da versão de modelo aprovada mais recente no registro de modelo

- Etapa de pré-processamento, incluindo transformação e codificação de recursos

- Etapa de inferência em lote

- Etapa de pré-processamento da verificação da qualidade dos dados, que cria um novo arquivo CSV contendo dados de entrada e previsões do modelo a serem usados para a verificação da qualidade dos dados

- Etapa de verificação da qualidade dos dados, que verifica os dados de entrada em relação às estatísticas de linha de base e às restrições associadas ao modelo registrado

- Etapa de condição para verificar se os dados reais estão disponíveis. Se dados reais estiverem disponíveis, a etapa de verificação de qualidade do modelo será realizada

- Etapa de cálculo da qualidade do modelo, que calcula o desempenho do modelo com base em rótulos verdadeiros

Tanto o skip_check_data_quality e register_new_baseline_data_quality os parâmetros estão configurados para False no pipeline de inferência. Esses parâmetros instruem o pipeline a realizar uma verificação de qualidade de dados usando as estatísticas de dados ou a linha de base de restrições associada ao modelo registrado (supplied_baseline_statistics_data_quality e supplied_baseline_constraints_data_quality) e pule a criação ou registro de novas estatísticas de dados e linhas de base de restrições durante a inferência. A figura a seguir ilustra uma execução do pipeline de inferência em lote onde a etapa de verificação da qualidade dos dados falhou devido ao baixo desempenho do modelo nos dados de inferência. Neste caso específico, o treinamento com pipeline HPO será acionado automaticamente para ajustar o modelo.

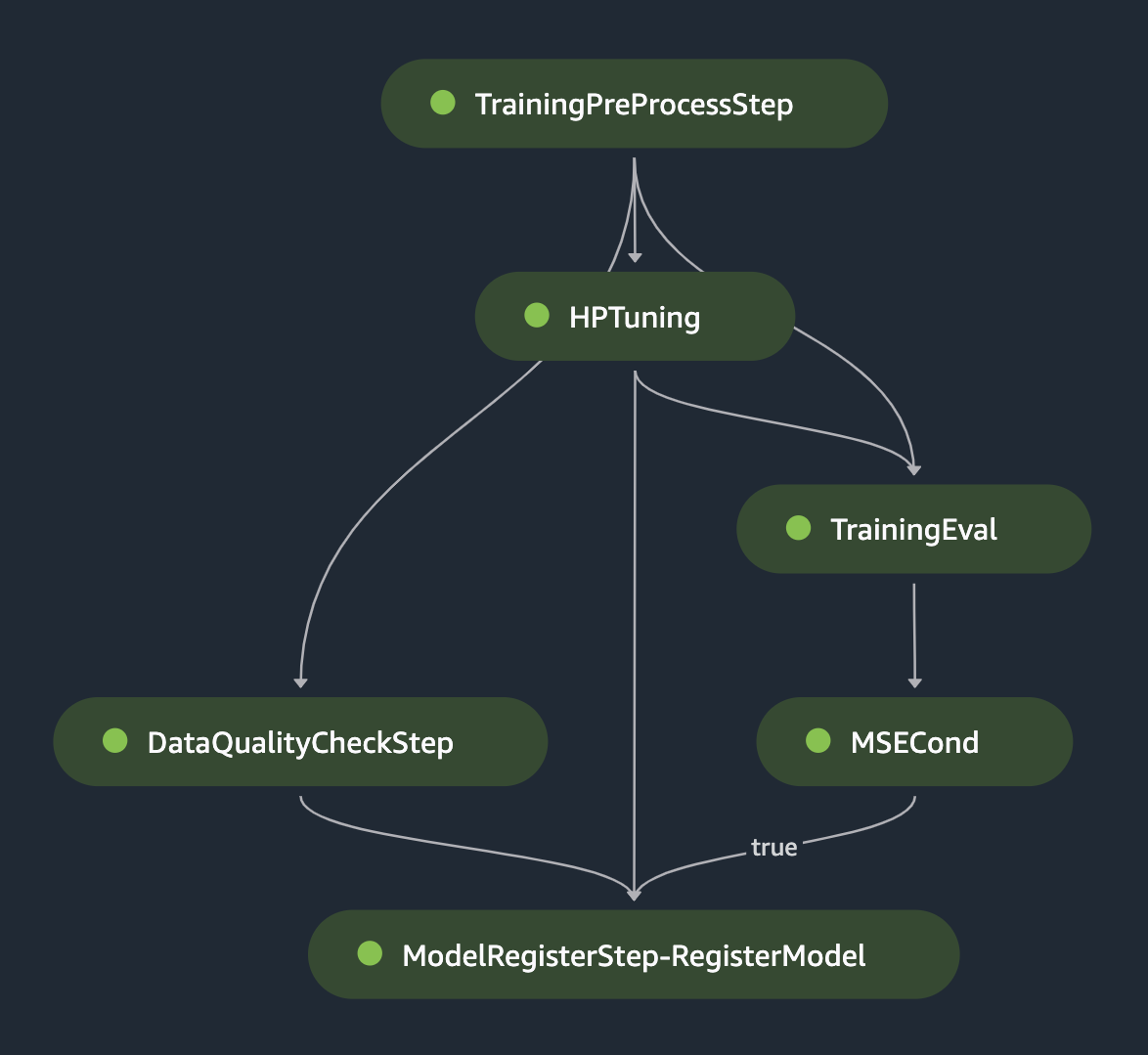

Treinamento com pipeline HPO

O treinamento com pipeline HPO é composto pelas seguintes etapas:

- Etapa de pré-processamento (transformação e codificação de recursos)

- Etapa de verificação da qualidade dos dados para gerar estatísticas de dados e linha de base de restrições usando os dados de treinamento

- Etapa de ajuste de hiperparâmetros

- Etapa de avaliação do treinamento

- Etapa de condição para verificar se o modelo treinado atende a um limite de precisão pré-especificado

- Etapa de registro do modelo se o modelo mais bem treinado atender ao limite de precisão exigido

Tanto o skip_check_data_quality e register_new_baseline_data_quality os parâmetros estão configurados para True no treinamento com pipeline HPO. A figura a seguir mostra uma execução bem-sucedida do treinamento com pipeline HPO.

limpar

Conclua as etapas a seguir para limpar seus recursos:

- Empregar o

destroyestágio no pipeline de CI/CD do GitLab para eliminar todos os recursos provisionados pelo Terraform. - Use a AWS CLI para Lista e remover quaisquer pipelines restantes criados pelos scripts Python.

- Opcionalmente, exclua outros recursos da AWS, como o bucket S3 ou a função IAM criada fora do pipeline de CI/CD.

Conclusão

Nesta postagem, demonstramos como as empresas podem criar fluxos de trabalho MLOps para seus trabalhos de inferência em lote usando Amazon SageMaker, Amazon EventBridge, AWS Lambda, Amazon SNS, HashiCorp Terraform e GitLab CI/CD. O fluxo de trabalho apresentado automatiza o monitoramento de dados e modelos, o retreinamento de modelos, bem como execuções de trabalhos em lote, controle de versão de código e provisionamento de infraestrutura. Isso pode levar a reduções significativas nas complexidades e nos custos de manutenção de trabalhos de inferência em lote na produção. Para obter mais informações sobre detalhes de implementação, revise o GitHub repo.

Sobre os autores

Hasan Shojaei é cientista de dados sênior da AWS Professional Services, onde ajuda clientes de diferentes setores, como esportes, seguros e serviços financeiros, a resolver seus desafios de negócios por meio do uso de big data, aprendizado de máquina e tecnologias de nuvem. Antes desta função, Hasan liderou diversas iniciativas para desenvolver novas técnicas de modelagem baseadas na física e orientadas por dados para as principais empresas de energia. Fora do trabalho, Hasan é apaixonado por livros, caminhadas, fotografia e história.

Hasan Shojaei é cientista de dados sênior da AWS Professional Services, onde ajuda clientes de diferentes setores, como esportes, seguros e serviços financeiros, a resolver seus desafios de negócios por meio do uso de big data, aprendizado de máquina e tecnologias de nuvem. Antes desta função, Hasan liderou diversas iniciativas para desenvolver novas técnicas de modelagem baseadas na física e orientadas por dados para as principais empresas de energia. Fora do trabalho, Hasan é apaixonado por livros, caminhadas, fotografia e história.

Wenxin Liu é arquiteto sênior de infraestrutura em nuvem. Wenxin aconselha empresas empresariais sobre como acelerar a adoção da nuvem e apoia suas inovações na nuvem. Ele adora animais de estimação e é apaixonado por snowboard e viagens.

Wenxin Liu é arquiteto sênior de infraestrutura em nuvem. Wenxin aconselha empresas empresariais sobre como acelerar a adoção da nuvem e apoia suas inovações na nuvem. Ele adora animais de estimação e é apaixonado por snowboard e viagens.

Vivek Lakshmanan é engenheiro de aprendizado de máquina na Amazon. Possui mestrado em Engenharia de Software com especialização em Ciência de Dados e vários anos de experiência como MLE. Vivek está entusiasmado em aplicar tecnologias de ponta e construir soluções de IA/ML para clientes na nuvem. Ele é apaixonado por Estatística, PNL e Explicabilidade de Modelos em IA/ML. Nas horas vagas, ele gosta de jogar críquete e fazer viagens.

Vivek Lakshmanan é engenheiro de aprendizado de máquina na Amazon. Possui mestrado em Engenharia de Software com especialização em Ciência de Dados e vários anos de experiência como MLE. Vivek está entusiasmado em aplicar tecnologias de ponta e construir soluções de IA/ML para clientes na nuvem. Ele é apaixonado por Estatística, PNL e Explicabilidade de Modelos em IA/ML. Nas horas vagas, ele gosta de jogar críquete e fazer viagens.

Andy Cracchiolo é um arquiteto de infraestrutura em nuvem. Com mais de 15 anos em infraestrutura de TI, Andy é um profissional de TI talentoso e voltado para resultados. Além de otimizar a infraestrutura, as operações e a automação de TI, Andy tem um histórico comprovado de análise de operações de TI, identificação de inconsistências e implementação de melhorias de processos que aumentam a eficiência, reduzem custos e aumentam os lucros.

Andy Cracchiolo é um arquiteto de infraestrutura em nuvem. Com mais de 15 anos em infraestrutura de TI, Andy é um profissional de TI talentoso e voltado para resultados. Além de otimizar a infraestrutura, as operações e a automação de TI, Andy tem um histórico comprovado de análise de operações de TI, identificação de inconsistências e implementação de melhorias de processos que aumentam a eficiência, reduzem custos e aumentam os lucros.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Automotivo / EVs, Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- ChartPrime. Eleve seu jogo de negociação com ChartPrime. Acesse aqui.

- BlockOffsets. Modernizando a Propriedade de Compensação Ambiental. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/mlops-for-batch-inference-with-model-monitoring-and-retraining-using-amazon-sagemaker-hashicorp-terraform-and-gitlab-ci-cd/

- :tem

- :é

- :não

- :onde

- $UP

- 100

- 125

- 13

- 15 anos

- 15%

- 26%

- 29

- 500

- 7

- a

- Sobre

- acelerar

- Acesso

- realizado

- Conta

- Contas

- precisão

- em

- real

- adicionado

- acrescentando

- Adição

- Adicional

- endereço

- Adoção

- contra

- AI / ML

- Todos os Produtos

- permite

- juntamente

- tb

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- an

- análise

- e

- e infra-estrutura

- qualquer

- api

- Aplicação

- Desenvolvimento de Aplicações

- Aplicando

- abordagem

- apropriado

- aprovação

- aprovações

- aprovar

- aprovou

- arquitetura

- SOMOS

- AS

- aspectos

- associado

- At

- auditabilidade

- autorizar

- auto

- automatiza

- Automático

- automaticamente

- Automação

- disponível

- AWS

- AWS Lambda

- Serviços Profissionais AWS

- baseado

- Linha de Base

- BE

- Porque

- sido

- antes

- beneficiar

- MELHOR

- melhores práticas

- Grande

- Big Data

- borda

- corpo

- Livros

- ambos

- Ramo

- Prédio

- construído

- negócio

- by

- calcula

- Cálculo

- chamada

- chamada

- CAN

- casas

- central

- desafios

- desafiante

- alterar

- Alterações

- mudança

- verificar

- a verificação

- Cheques

- classificação

- Na nuvem

- adoção de nuvem

- infraestrutura de nuvem

- código

- colunas

- Empresas

- comparando

- completar

- complexidades

- compliance

- composta

- conceito

- Configuração

- conjunção

- restrições

- contém

- contínuo

- ao controle

- controles

- Convenção

- custos

- poderia

- crio

- criado

- cria

- Criar

- criação

- Grilo

- personalizadas

- Clientes

- ponta

- dados,

- ciência de dados

- cientista de dados

- orientado por dados

- declara

- Padrão

- definido

- Define

- Grau

- Entrega

- demonstrar

- demonstraram

- implantar

- implantado

- Implantação

- descreve

- Design

- detalhe

- detalhes

- detectou

- desenvolver

- Desenvolvimento

- diferente

- direção

- diretamente

- diretórios

- Descobre

- discutir

- Estivador

- parece

- Não faz

- dois

- durante

- cada

- mais fácil

- efetivamente

- eficiência

- eficiente

- ou

- eliminado

- Empregado

- energia

- engenheiro

- Engenharia

- Melhorias

- garantir

- assegurando

- Empreendimento

- empresas

- Todo

- Meio Ambiente

- erro

- avaliação

- Evento

- exemplo

- excede

- animado

- execução

- existente

- vasta experiência

- f1

- FALHA

- fracassado

- falha

- Característica

- Figura

- Envie o

- Arquivos

- financeiro

- serviços financeiros

- Primeiro nome

- fixado

- seguinte

- Escolha

- formato

- encontrado

- da

- função

- funções

- Portões

- Geral

- gerado

- gerando

- Git

- GitHub

- Go

- vai

- maior

- Solo

- Grupo

- orientações

- mão

- Manipulação

- Ter

- he

- ajuda

- sua

- história

- Como funciona o dobrador de carta de canal

- Como Negociar

- HTML

- http

- HTTPS

- Otimização de hiperparâmetros

- ID

- identificar

- Identidade

- if

- ilustra

- implementação

- implementação

- in

- incluir

- inclui

- Incluindo

- Crescimento

- de treinadores em Entrevista Motivacional

- independentemente

- indicam

- Individual

- indústrias

- INFORMAÇÕES

- Infraestrutura

- iniciativas

- e inovações

- entrada

- inputs

- com seguro

- integração

- interage

- para dentro

- introduzir

- questões

- IT

- ESTÁ

- Trabalho

- Empregos

- jpg

- json

- apenas por

- Chave

- Rótulos

- mais recente

- conduzir

- aprendizagem

- levou

- wifecycwe

- Line

- Lista

- local

- log

- máquina

- aprendizado de máquina

- a Principal

- Manter

- fazer

- gerencia

- de grupos

- gestão

- manual

- manualmente

- marcado

- mestre

- material

- Conheça

- atende

- mensagem

- mensagens

- métrico

- Métrica

- ML

- MLOps

- modelo

- modelagem

- modelos

- modificar

- monitoração

- mais

- múltiplo

- Nomeado

- nomeando

- necessário

- você merece...

- necessário

- Cria

- networking

- Novo

- recentemente

- PNL

- não

- notificação

- notificações

- romance

- objeto

- obter

- obtendo

- of

- oferecendo treinamento para distância

- Oferece

- frequentemente

- on

- queridos

- só

- operação

- Operações

- otimização

- otimizando

- or

- ordem

- organizações

- Organizado

- original

- Outros

- saída

- lado de fora

- pacote

- pacotes

- pares

- parâmetros

- parte

- particular

- passes

- apaixonado

- caminho

- Realizar

- atuação

- realizada

- fotografia

- oleoduto

- plano

- planejado

- platão

- Inteligência de Dados Platão

- PlatãoData

- jogar

- ponto

- pobre

- Publique

- práticas

- Previsões

- Prepara

- pré-requisitos

- presente

- apresentado

- Prévio

- Problema

- prosseguir

- processo

- Processado

- Produção

- profissional

- lucros

- Promovido

- proposto

- comprovado

- fornecido

- fornece

- fornecendo

- Pullover

- Empurrar

- Python

- qualidade

- Cru

- Leia

- Leitura

- recebe

- receber

- recentemente

- registro

- reduzir

- redução

- em relação a

- cadastre-se

- registrado

- registro

- registradores

- Registo

- registro

- regularmente

- remanescente

- Repetivel

- Relatórios

- repositório

- representa

- requeridos

- Requisitos

- exige

- Recursos

- aqueles

- respectivamente

- responsável

- Resultados

- currículo

- reutilizável

- rever

- estrada

- Tipo

- regras

- Execute

- corredor

- corrida

- é executado

- sábio

- Inferência do SageMaker

- Pipelines SageMaker

- AMPLIAR

- cronograma

- agendamento

- Ciência

- Cientista

- Ponto

- Scripts

- Sdk

- Seção

- enviar

- envio

- envia

- servir

- serve

- Serviços

- conjunto

- instalação

- vários

- compartilhado

- rede de apoio social

- mostrando

- Shows

- periodo

- simples

- solteiro

- Software

- Engenharia de software

- solução

- Soluções

- RESOLVER

- Fontes

- Origem

- específico

- especificada

- Esportes

- Etapa

- encenação

- começo

- Comece

- Estado

- estatística

- Status

- Passo

- Passos

- armazenamento

- loja

- armazenar

- Estratégia

- estrutural

- estudo

- bem sucedido

- entraram com sucesso

- tal

- terno

- Apoiar

- suportes

- mesa

- TAG

- tomar

- Target

- Tarefa

- Profissionais

- técnicas

- Tecnologias

- modelo

- Terraform

- do que

- que

- A

- deles

- Eles

- então

- Lá.

- assim

- Este

- deles

- isto

- três

- limiar

- Através da

- tempo

- para

- ferramentas

- topo

- Temas

- pista

- historial

- treinado

- Training

- Transformação

- transparente

- Viagens

- desencadear

- desencadeado

- Verdade

- VIRAR

- dois

- tipo

- típico

- ui

- para

- sublinhados

- Atualizar

- atualização

- carregado

- Upload

- usar

- usava

- Utilizador

- usos

- utilização

- utilizar

- utilizado

- valor

- variável

- verificar

- versão

- versões

- via

- VIOLAÇÃO

- aviso

- Caminho..

- maneiras

- we

- web

- serviços web

- BEM

- quando

- se

- qual

- enquanto

- QUEM

- precisarão

- de

- dentro

- Atividades:

- de gestão de documentos

- fluxos de trabalho

- trabalhar

- yaml

- anos

- ainda

- Vocês

- investimentos

- zefirnet