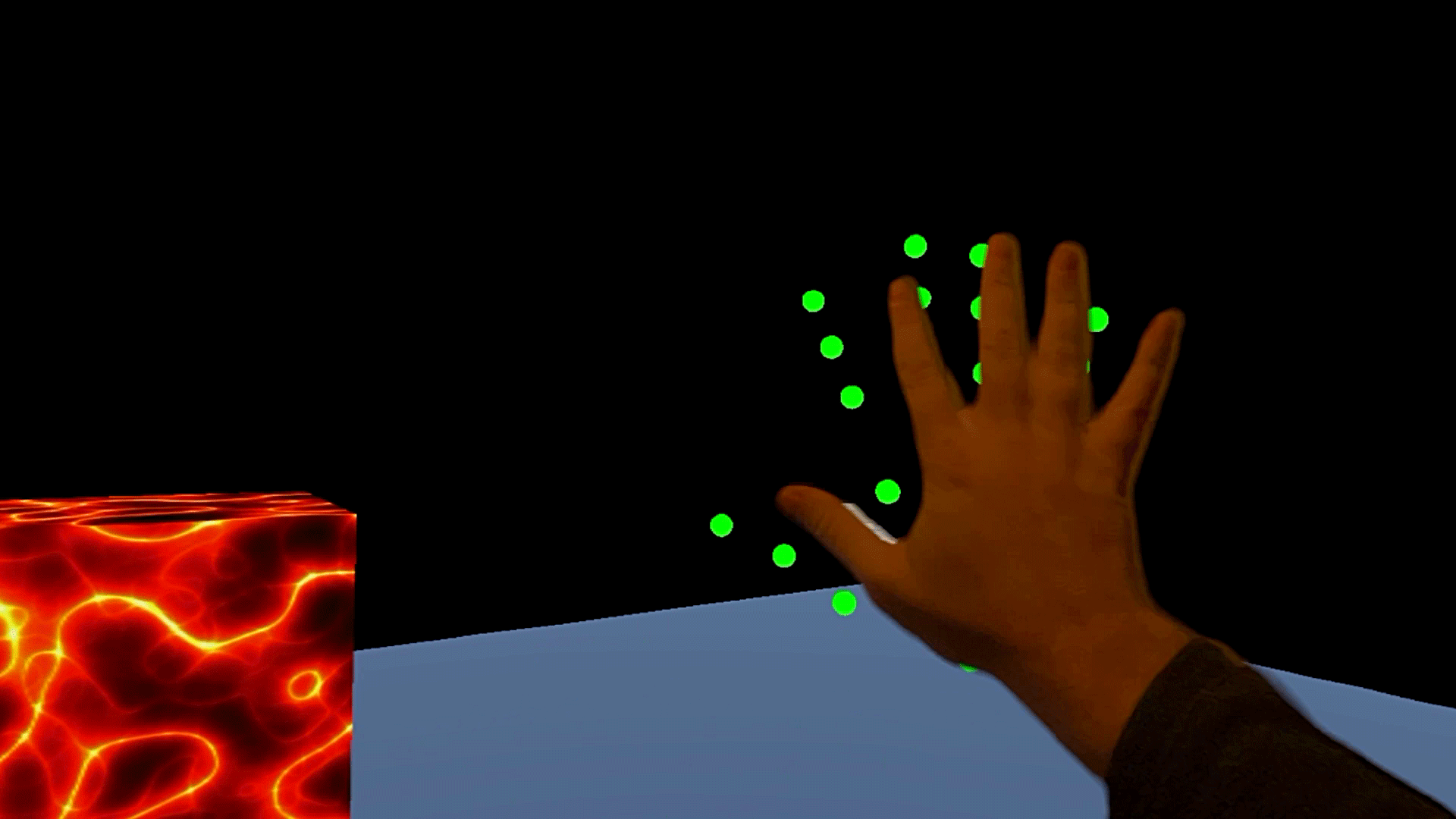

Um vídeo postado por um desenvolvedor do Vision Pro parece mostrar os níveis atuais de rastreamento manual e desempenho de oclusão que o novo fone de ouvido da Apple é capaz.

Apple Visão Profissional, com lançamento previsto para os próximos meses, usará o rastreamento manual como método de entrada principal. Embora as interações no nível do sistema combinem o rastreamento manual com o rastreamento ocular para uma modalidade de “olhar e tocar”, os desenvolvedores também podem criar aplicativos que permitem aos usuários interagir diretamente com os aplicativos usando as mãos.

O rastreamento manual no Vision Pro pode ser dividido em dois recursos distintos: ‘rastreamento manual’ e ‘oclusão manual’.

O rastreamento manual é o modelo 3D estimado da mão, suas articulações e a posição das pontas dos dedos. Este modelo é usado para determinar quando os objetos são tocados, agarrados e interagidos.

A oclusão manual trata de como o sistema sobrepõe sua mão real ao conteúdo virtual. Em vez de desenhar um modelo 3D de uma mão virtual na cena, o Vision Pro corta a imagem de suas mãos reais para mostrá-las na cena. Fazer isso adiciona outra camada de realismo ao conteúdo virtual, porque você pode ver suas próprias mãos únicas.

Um desenvolvedor que está construindo o Vision Pro usando Unity postou um vídeo que dá uma visão clara do rastreamento manual e da oclusão.

No vídeo acima, os ponteiros reais mostram o sistema de oclusão em ação, enquanto os pontos verdes mostram a posição 3D estimada da mão.

Podemos ver que a oclusão das mãos é muito boa, mas não perfeita; quando cercado inteiramente por conteúdo virtual e se movendo rapidamente, você pode ver alguns recortes nas bordas da mão.

Enquanto isso, a posição real de rastreamento da mão está ainda mais atrasada em relação à oclusão da mão, algo em torno de 100–200ms atrás. No entanto, não podemos determinar a verdadeira latência do rastreamento de mão do Vision Pro, porque só temos uma visão das mãos de rastreamento de oclusão para compará-la (que terão alguma latência em relação às mãos reais).

Nesse contexto, o vídeo vem de uma conversa com desenvolvedores do Unity dizendo que seus primeiros experimentos com o Vision Pro mostraram uma latência de rastreamento manual muito alta, aparentemente em comparação com os recursos de rastreamento manual mais recentes do Quest. Outros desenvolvedores do Unity concordaram que estavam vendo latência semelhante em seus próprios dispositivos Vision Pro.

No entanto, o vídeo em questão é uma integração de rastreamento manual dentro de um aplicativo Unity, o que significa que o desempenho e a latência do rastreamento manual podem ter fatores adicionais relacionados ao Unity que não estão presentes ao usar as ferramentas de desenvolvimento Vision Pro originais da Apple. E considerando que o fone de ouvido ainda não foi lançado e essas ferramentas ainda estão em desenvolvimento, poderemos ver melhorias adicionais quando o fone de ouvido chegar às lojas.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://www.roadtovr.com/apple-vision-pro-unity-hand-tracking-occlusion/

- :é

- :não

- 3d

- a

- acima

- Açao Social

- real

- Adicional

- Adiciona

- concordaram

- permitir

- tb

- e

- Outro

- app

- aparece

- Apple

- aplicações

- SOMOS

- por aí

- AS

- At

- BE

- Porque

- atrás

- ambos

- Quebrado

- construir

- Prédio

- mas a

- by

- CAN

- capacidades

- capaz

- remover filtragem

- combinar

- vem

- comparar

- comparação

- considerando

- conteúdo

- contexto

- Conversa

- Atual

- cortes

- Ofertas

- Determinar

- Developer

- desenvolvedores

- Desenvolvimento

- ferramentas de desenvolvimento

- Dispositivos/Instrumentos

- diretamente

- distinto

- fazer

- desenho

- Cedo

- inteiramente

- estimado

- experimentos

- fatores

- poucos

- ponta dos dedos

- Escolha

- da

- mais distante

- dá

- Vislumbre

- Bom estado, com sinais de uso

- Verde

- mão

- mãos

- Ter

- fone

- Alta

- Como funciona o dobrador de carta de canal

- Contudo

- HTTPS

- imagem

- melhorias

- in

- entrada

- dentro

- em vez disso

- integração

- interagir

- interações

- para dentro

- IT

- ESTÁ

- Latência

- mais recente

- lançamento

- lançado

- camada

- níveis

- olhar

- Posso..

- significa

- método

- modelo

- em movimento

- Novo

- novo fone de ouvido

- Próximo

- objetos

- of

- Oferece

- on

- só

- para

- Outros

- Fora

- próprio

- perfeita

- atuação

- platão

- Inteligência de Dados Platão

- PlatãoData

- posição

- publicado

- presente

- primário

- Pro

- busca

- busca de rastreamento de mãos

- questão

- rapidamente

- bastante

- em vez

- Chega

- reais

- realismo

- Considerar

- dizendo

- cena

- Vejo

- visto

- mostrar

- mostrou

- semelhante

- So

- alguns

- algum lugar

- Ainda

- lojas

- cercado

- .

- do que

- que

- A

- deles

- Eles

- si mesmos

- Este

- deles

- isto

- tempo

- para

- ferramentas

- tocou

- verdadeiro

- dois

- único

- unidade

- usar

- usava

- usuários

- utilização

- muito

- Vídeo

- Ver

- Virtual

- visão

- we

- foram

- quando

- qual

- enquanto

- precisarão

- de

- ainda

- Vocês

- investimentos

- zefirnet