Depois de criar, treinar e avaliar seu modelo de aprendizado de máquina (ML) para garantir que ele está resolvendo o problema de negócios pretendido proposto, você deseja implantar esse modelo para permitir a tomada de decisões nas operações de negócios. Modelos que suportam funções críticas de negócios são implantados em um ambiente de produção onde uma estratégia de liberação de modelo é implementada. Dada a natureza dos modelos de ML, em que os dados mudam continuamente, você também deseja garantir que um modelo implantado ainda seja relevante para novos dados e que o modelo seja atualizado quando esse não for o caso. Isso inclui a escolha de uma estratégia de implantação que minimize os riscos e o tempo de inatividade. Essa estratégia de implantação ideal deve manter a alta disponibilidade do modelo, considerar o custo comercial de implantar um modelo inferior ao que já está em produção e conter funcionalidade para reverter facilmente para uma versão de modelo anterior. Muitas dessas considerações recomendadas e padrões de implantação também são abordados no Estrutura bem arquitetada da AWS – lentes de aprendizado de máquina.

Além de escolher a estratégia de implantação correta, essa estratégia deve ser implementada usando um mecanismo confiável que inclua práticas de MLOps. O MLOps inclui práticas que integram cargas de trabalho de ML em gerenciamento de liberação, CI/CD e operações, considerando os aspectos exclusivos de projetos de ML, incluindo considerações para implantação e monitoramento de modelos. Amazon SageMaker para MLOps fornece ferramentas específicas para automatizar e padronizar etapas em todo o ciclo de vida de ML, incluindo recursos para implantar e gerenciar novos modelos usando padrões de implantação avançados.

Nesta postagem, discutimos como implantar modelos de ML com Amazon Sage Maker de forma repetível e automatizada, integrando o variantes de produção e guarda-corpos de implantação recursos do SageMaker com soluções MLOps. Fornecemos uma introdução sobre como integrar as ferramentas MLOps do SageMaker com os padrões de implantação de modelo do SageMaker, com foco em endpoints de modelo único em tempo real.

Visão geral da solução

Exploramos os seguintes padrões de teste de modelo e proteção e sua integração com as ferramentas SageMaker MLOps:

- Teste de modelo – Comparamos diferentes versões do modelo na produção antes de substituir a versão do modelo atual. Esta postagem compara os seguintes recursos de teste de modelo:

- Teste A / B Exemplo: crie XNUMX textos de email > XNUMX pessoas na sua lista, XNUMX receberao XNUMX email e XNUMX receberão outro e veja qual email converteu mais – Com o teste A/B, você compara diferentes versões de seu modelo em produção, distribuindo o tráfego de endpoint entre suas variantes de modelo. O teste A/B é usado em cenários em que o feedback de loop fechado pode vincular diretamente as saídas do modelo às métricas de negócios downstream. Esse feedback é usado para determinar a significância estatística da mudança de um modelo para outro, ajudando você a selecionar o melhor modelo por meio de testes de produção ao vivo.

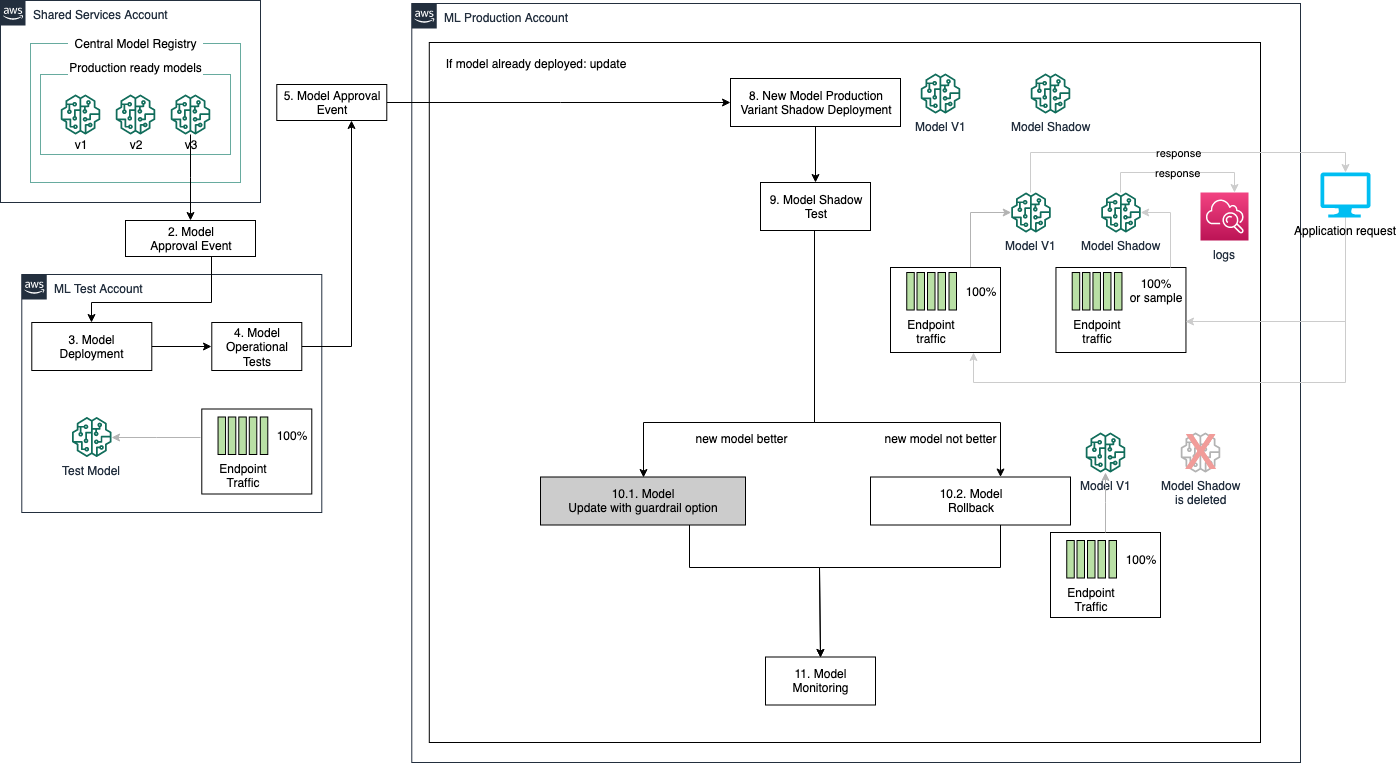

- testes de sombra – Com testes de sombra, você testa uma nova versão de seu modelo em produção enviando solicitações para o modelo de produção e o novo modelo em paralelo. Os dados de resposta de previsão do modelo de produção são fornecidos ao aplicativo, enquanto as novas previsões de versão do modelo são armazenadas para teste, mas não fornecidas ao aplicativo de produção. O teste de sombra é usado em situações em que não há feedback de loop fechado mapeando uma métrica de negócios de volta para as previsões de um modelo. Neste cenário, você usa qualidade de modelo e métricas operacionais para comparar vários modelos em vez de qualquer impacto nas métricas de negócios downstream.

- Mudança de tráfego – Depois de testar a nova versão do modelo e ficar satisfeito com seu desempenho, o próximo passo é transferir o tráfego do modelo atual para o novo. O grades de proteção de implantação azul/verde no SageMaker permitem que você mude facilmente do modelo atual em produção (frota azul) para um novo (frota verde) de forma controlada. As implantações azul/verde evitam o tempo de inatividade durante as atualizações de seu modelo, como o que você teria em um cenário de implantação local. Para maximizar a disponibilidade do modelo, até o momento, as implantações azul/verde são a opção padrão para atualizações de modelo no SageMaker. Discutimos os seguintes métodos de mudança de tráfego neste post:

- De repente, mudança de tráfego – 100% do tráfego do endpoint é transferido da frota azul para a frota verde depois que a frota verde fica disponível. Nós usamos alarmes in Amazon CloudWatch que monitoram sua frota verde por um determinado período de tempo (o período de cozimento) e se nenhum alarme for acionado, a frota azul será excluída pelo SageMaker após o período de cozimento.

- Mudança de tráfego canário – Sua frota verde é primeiro exposta a uma proporção menor de seu tráfego (uma canário) e validado para quaisquer problemas usando alarmes do CloudWatch por um período de cozimento, enquanto a frota azul continua recebendo a maior parte do tráfego de endpoint. Depois que a frota verde é validada, todo o tráfego é transferido para a nova frota e a frota azul é excluída pelo SageMaker.

- Mudança de tráfego linear azul/verde guardrail – Você muda gradualmente o tráfego de sua frota azul para sua frota verde em uma abordagem por etapas. Seu modelo é então monitorado com alarmes do CloudWatch por um período de cozimento em cada etapa antes que a frota Blue seja completamente substituída.

Esta postagem se concentra na descrição de arquiteturas que utilizam os recursos SageMaker MLOps para executar implantações controladas de modelos por meio das proteções de implantação e estratégias de teste de modelagem que listamos. Para obter informações gerais sobre esses padrões, consulte Aproveite as estratégias de implantação avançadas usando proteções de implantação do Amazon SageMaker e Proteção de implantação.

Implantar um modelo com o SageMaker

O SageMaker oferece uma ampla gama de opções de implantação que variam de baixa latência e alta taxa de transferência a trabalhos de inferência de longa duração. Essas opções incluem considerações para processamento em lote, em tempo real ou inferência quase em tempo real. Cada opção oferece diferentes recursos avançados, como a capacidade de executar vários modelos em um único terminal. No entanto, conforme mencionado anteriormente, para esta postagem, abordamos apenas os padrões de implantação de MLOps usando endpoints de modelo único. Para se aprofundar nos recursos de implantação mais avançados do SageMaker para inferência em tempo real, consulte Padrões de hospedagem de modelo no Amazon SageMaker, Parte 2: Introdução à implantação de modelos em tempo real no SageMaker.

Para entender a implementação de padrões avançados de implantação usando pipelines de entrega contínua (CD), vamos primeiro discutir um conceito-chave no SageMaker chamado variantes do modelo.

Variantes do modelo SageMaker

As variantes de modelo permitem implantar várias versões de seu modelo no mesmo endpoint para testar seu modelo. As variantes do modelo são implantadas em instâncias separadas, portanto, não há impacto em outras variantes quando uma é atualizada. No SageMaker, as variantes do modelo são implementadas como variantes de produção e sombra.

Variantes de produção permitem que você teste A/B várias versões de seu modelo para comparar seu desempenho. Nesse cenário, todas as versões do seu modelo retornam respostas às solicitações do modelo. O tráfego do seu endpoint é distribuído entre as variantes existentes por distribuição de tráfego, onde você atribui um peso para cada variante, ou por variante de destino, onde um determinado parâmetro (por exemplo, Região ou mercado) decide qual modelo deve ser invocado.

variantes de sombra permitem que você faça o teste de sombra de uma nova versão do seu modelo. Neste cenário, seu modelo tem uma variante de produção e uma variante de sombra implantadas em paralelo no mesmo endpoint. A variante shadow recebe o tráfego de dados completo (ou amostrado) do seu endpoint. No entanto, apenas as previsões das variantes de produção são enviadas de volta aos usuários de seu aplicativo e as previsões das variantes de sombra são registradas para análise. Como as variantes de sombra são executadas em instâncias separadas da variante de produção, não há impacto no desempenho da sua variante de produção neste teste. Com esta opção, você está testando o novo modelo e minimizando os riscos de um modelo de baixo desempenho, podendo comparar o desempenho de ambos os modelos com os mesmos dados.

Proteções de implantação do SageMaker

Guardrails são uma parte essencial do desenvolvimento de software. Eles protegem seu aplicativo e minimizam o risco de implantação de uma nova versão de seu aplicativo. Da mesma forma, as proteções de implantação do SageMaker permitem alternar de uma versão de modelo para outra de maneira controlada. A partir de dezembro de 2022, as proteções do SageMaker fornecem implementação para opções de implantação de mudança de tráfego azul/verde, canário e linear. Quando combinados com variantes de modelo, os guardrails de implantação podem ser aplicados tanto nas variantes de produção quanto nas variantes de sombra do seu modelo, garantindo nenhum tempo de inatividade durante a atualização de uma nova variante, com o deslocamento do tráfego sendo controlado de acordo com a opção selecionada.

Fundamentos de MLOps para implantação de modelo

No contexto mais amplo de um fluxo de trabalho de construção e implantação de modelo de ML, queremos empregar práticas de CI/CD criadas especificamente para o fluxo de trabalho de ML. Semelhante aos sistemas tradicionais de CI/CD, queremos automatizar testes de software, testes de integração e implantações de produção. No entanto, também precisamos incluir operações específicas no ciclo de vida de ML que não estão presentes no ciclo de vida de desenvolvimento de software tradicional, como treinamento de modelo, experimentação de modelo, teste de modelo e monitoramento de modelo.

Para alcançar esses recursos específicos de ML, os fundamentos de MLOps, como teste de modelo automatizado, proteções de implantação, implantações de várias contas e reversão automatizada de modelo, são adicionados ao processo de implantação de modelo. Isso garante que os recursos já descritos permitam o teste do modelo e evitem o tempo de inatividade durante o processo de atualização do modelo. Ele também fornece a confiabilidade e a rastreabilidade necessárias para a melhoria contínua de um modelo pronto para produção. Além disso, recursos como a capacidade de empacotar soluções existentes em modelos reutilizáveis e implantar modelos em uma configuração de várias contas garantem a escalabilidade dos padrões de implantação de modelo discutidos na postagem para vários modelos em uma organização.

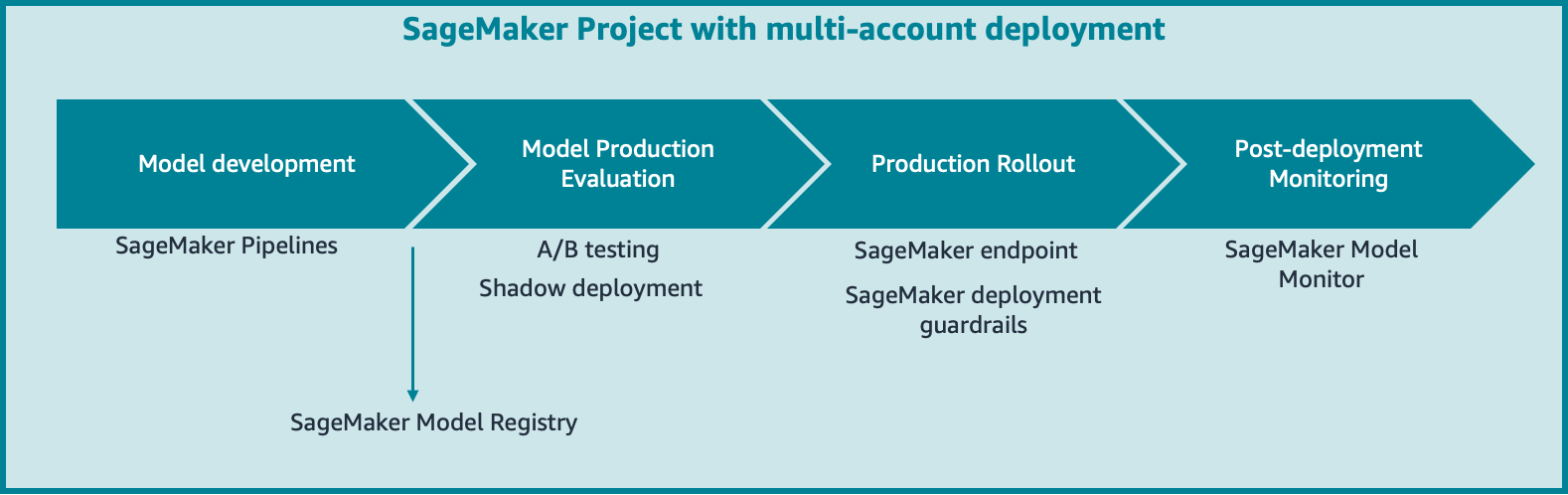

A figura a seguir demonstra um padrão comum para a conexão dos recursos do SageMaker para criar um pipeline de implantação e construção de modelo de ponta a ponta. Neste exemplo, um modelo é desenvolvido no SageMaker usando Trabalhos de processamento do SageMaker para executar o código de processamento de dados usado para preparar dados para um algoritmo de ML. Vagas de treinamento do SageMaker são usados para treinar um modelo de ML nos dados produzidos pelo trabalho de processamento. Os artefatos do modelo e os metadados associados são armazenados no Registro de modelo do SageMaker como a última etapa do processo de treinamento. Isso é orquestrado por Pipelines SageMaker, que é um serviço de CI/CD desenvolvido especificamente para ML que ajuda a automatizar e gerenciar fluxos de trabalho de ML em escala.

Depois que o modelo é aprovado, ele é testado na produção com um teste A/B ou uma implantação de sombra. Depois que o modelo é validado na produção, usamos o registro do modelo para aprovar o modelo para distribuição de produção em um endpoint SageMaker usando uma das opções de proteção de implantação.

Quando o processo de atualização do modelo estiver concluído, Monitor de modelo SageMaker monitora continuamente o desempenho do modelo para desvios no modelo e na qualidade dos dados. Este processo é automatizado para vários casos de uso usando Projeto SageMaker modelos que mapeiam a implantação da infraestrutura para uma configuração de várias contas, a fim de garantir isolamento completo de recursos e controle de custos mais fácil.

Padrões de implantação de endpoint de modelo único

Ao implantar modelos em um ambiente de produção pela primeira vez, você não tem um modelo em execução para comparar e o modelo implantado será aquele usado por seu aplicativo de negócios. Depois que o modelo for implantado e monitorado em um ambiente de produção, talvez você queira atualizar o modelo regularmente ou sob demanda, quando novos dados estiverem disponíveis ou quando seu modelo tiver uma lacuna de desempenho detectada. Ao atualizar um modelo existente, você deseja garantir que o novo modelo tenha um desempenho melhor do que o atual e possa lidar com o tráfego de solicitação de previsão de seus aplicativos de negócios. Durante esse período de validação, você deseja que o modelo atual ainda esteja disponível para uma possível reversão para minimizar o risco de inatividade de seus aplicativos.

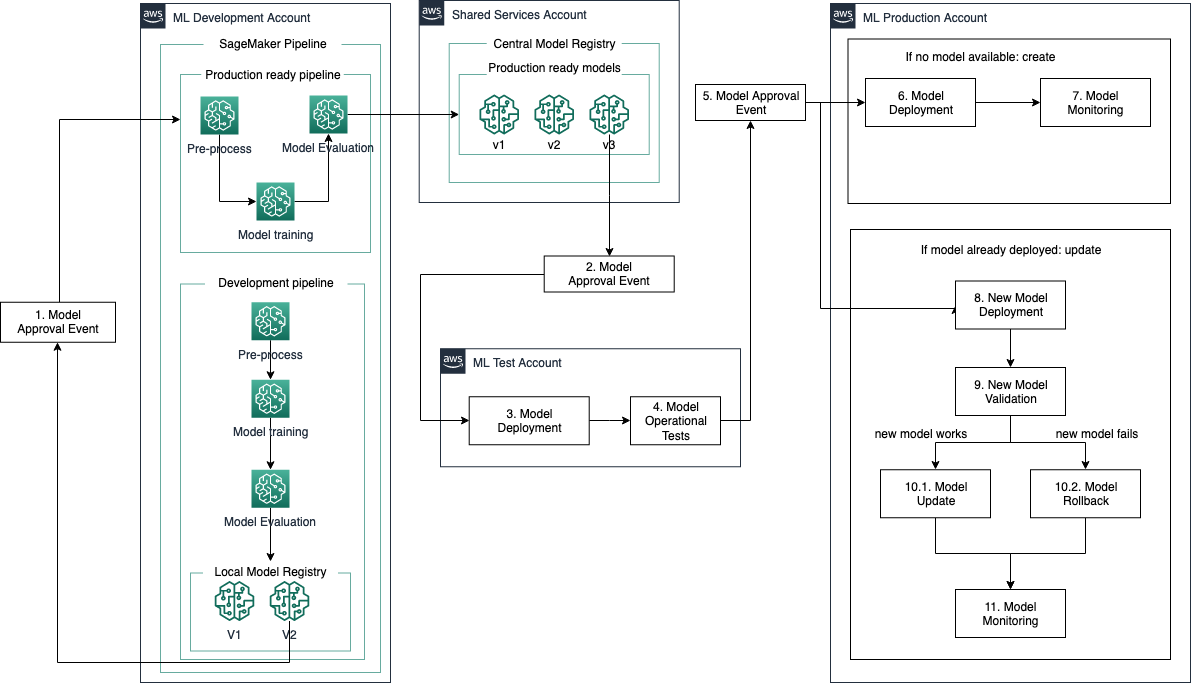

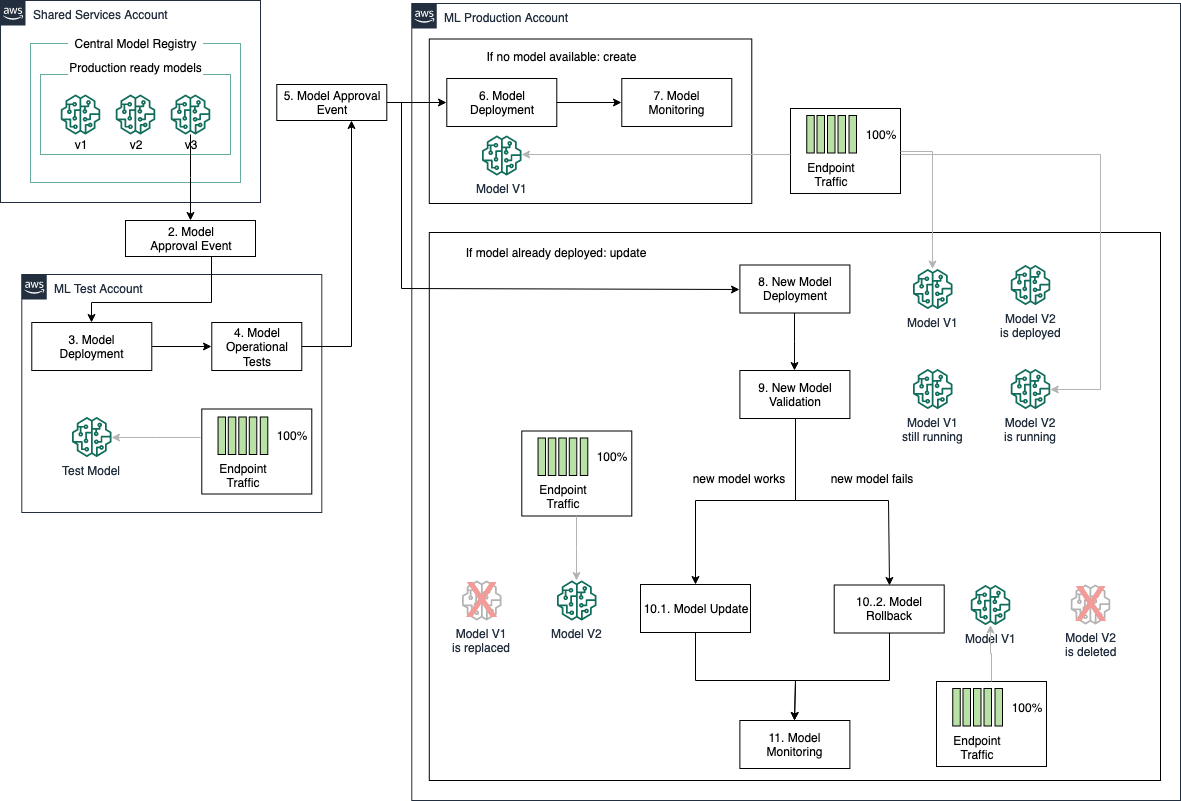

Em uma imagem de desenvolvimento de modelo mais ampla, os modelos são normalmente treinados em uma conta de desenvolvimento de ciência de dados. Isso inclui fluxos de trabalho de experimentação frequentemente usados no desenvolvimento de modelos, bem como fluxos de trabalho de retreinamento usados em pipelines prontos para produção. Todos os metadados para esses experimentos podem ser rastreados usando Experimentos Amazon SageMaker durante o desenvolvimento. Depois que o fluxo de trabalho é incorporado a um pipeline para uso em produção, os metadados são rastreados automaticamente por meio dos pipelines do SageMaker. Para acompanhar os modelos de produção viáveis em um só lugar, depois que a experimentação trouxe as métricas de desempenho de um modelo (precisão, recall e assim por diante) a um nível aceitável para produção, um passo de condição no pipeline do SageMaker permite que o modelo seja registrado no registro do modelo.

O registro do modelo permite acionar a implantação desse modelo com um processo de aprovação manual ou automatizado. Essa implantação ocorre em uma conta de teste de ML em que testes operacionais, como testes de integração, testes de unidade, latência de modelo e qualquer validação de modelo adicional, podem ser executados na nova versão do modelo. Observe que o teste A/B e o teste de sombra não são executados na conta de teste de ML, mas sim na conta de produção de ML.

Depois que o modelo passar por todas as validações na conta de teste, ele estará pronto para ser implantado em um ambiente de produção. Um novo processo de aprovação aciona essa implantação, e as proteções de implantação do SageMaker permitem uma liberação controlada e um processo transparente de atualização do modelo de acordo com o modo de deslocamento de tráfego selecionado.

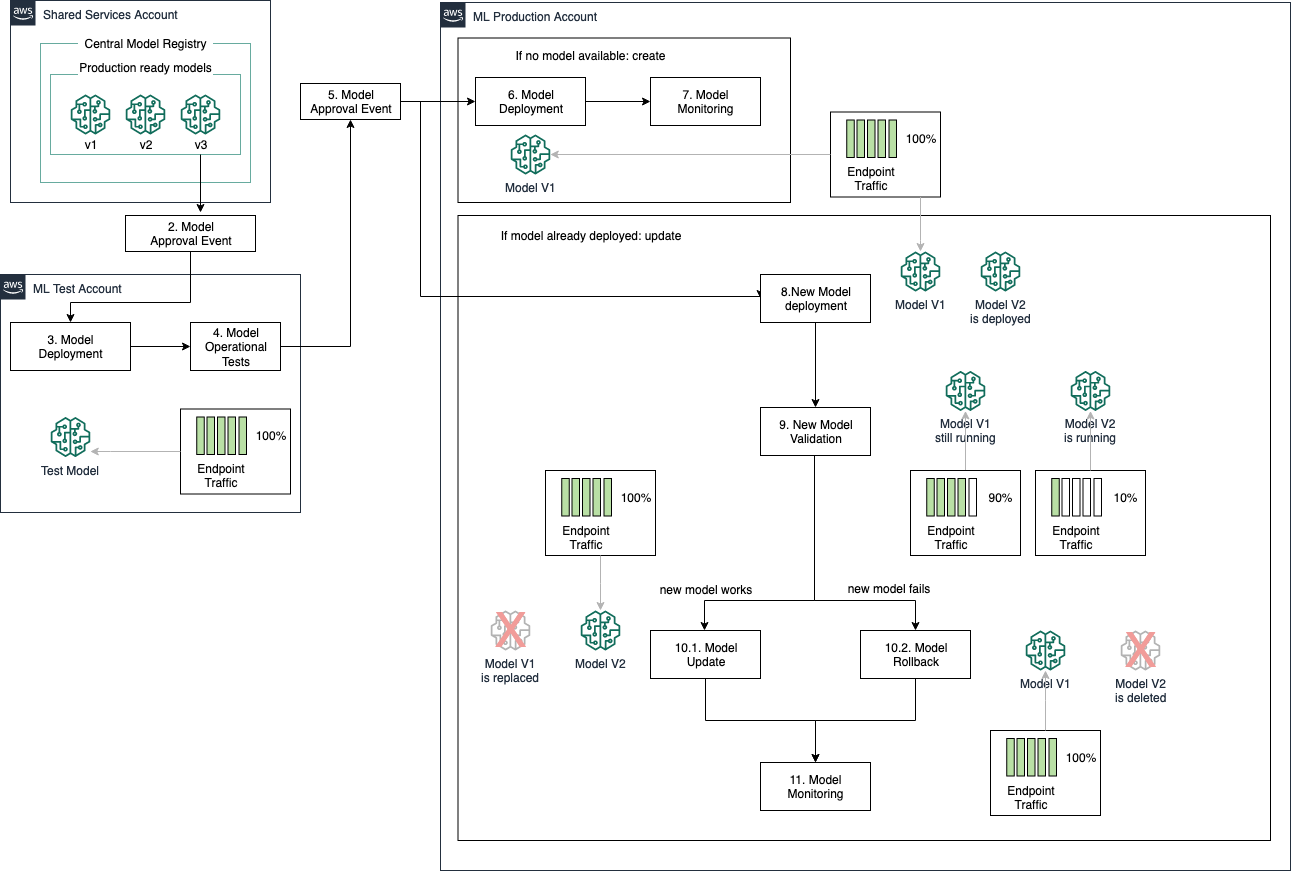

O diagrama a seguir ilustra essa arquitetura de solução.

De repente, mudança de tráfego

A modo de mudança de tráfego de uma só vez permite que você atualize uma nova versão do modelo (frota verde) mudando completamente 100% do tráfego do seu modelo atual (frota azul) para o seu novo modelo. Com esta opção, você pode configurar um período de cozimento durante o qual ambas as versões do seu modelo ainda estão em execução e pode reverter rápida e automaticamente para a versão atual se o seu novo modelo não funcionar conforme o esperado. A desvantagem dessa opção é que todo o tráfego de dados é afetado de uma só vez, portanto, se houver um problema com a implantação do modelo, todos os usuários que usarem o aplicativo durante o processo de implantação serão afetados. A arquitetura a seguir mostra como a opção de mudança de tráfego de uma só vez lida com as atualizações do modelo.

A mudança de tráfego de uma só vez pode ser incorporada em suas ferramentas MLOps definindo uma configuração de implantação de endpoint com Política BlueGreenUpdate definido para ALL_AT_ONCE. Em seu pipeline de MLOps, depois que um novo modelo é aprovado para implantação na conta de produção de ML, o SageMaker verifica se o endpoint do modelo já existe. Em caso afirmativo, o ALL_AT_ONCE a configuração aciona uma atualização de terminal que segue a arquitetura. A reversão do endpoint é controlada com base em Alarmes do CloudWatch definido pelo seu endpoint AutoRollbackConfiguration, que quando acionado inicia automaticamente a reversão do modelo para a versão atual do modelo.

Mudança de tráfego canário

A mudança de tráfego canário O modo permite que você teste seu novo modelo (frota verde) com uma pequena parte do tráfego de dados antes de atualizar o modelo em execução (frota azul) para a nova versão ou reverter a nova versão, dependendo do resultado do teste canário. A parte do tráfego usada para testar o novo modelo é chamada de canário e, nessa opção, seu risco de um novo modelo problemático é minimizado para o tráfego canário enquanto o tempo de atualização ainda é minimizado.

As implantações Canary permitem minimizar o risco de implementar uma nova versão do modelo, expondo a nova versão do modelo a um grupo menor de usuários para monitorar a eficácia durante um período de tempo. A desvantagem é o gerenciamento de várias versões por um período de tempo que permite a coleta de métricas de desempenho significativas o suficiente para determinar o impacto no desempenho. O benefício é a capacidade de isolar o risco para um grupo menor de usuários.

A mudança de tráfego canary pode ser incorporada em suas ferramentas MLOps definindo uma configuração de implantação de endpoint com um Política BlueGreenUpdate definido para CANARY e definindo o CanarySize para determinar quanto do tráfego do endpoint deve ser redirecionado para uma nova versão do modelo. Da mesma forma que a opção de uma só vez, em seu pipeline de MLOps, depois que um novo modelo é aprovado para implantação na conta de produção de ML, o SageMaker verifica se o endpoint do modelo já existe. Em caso afirmativo, o CANARY a configuração aciona uma atualização de terminal que segue a arquitetura descrita no diagrama a seguir. A reversão do seu endpoint é controlada com base nos alarmes do CloudWatch definidos pelo seu endpoint AutoRollbackConfiguration que, quando acionado, inicia automaticamente a reversão do modelo para a versão atual do modelo. Tipos de alarme úteis para implantar aqui são 500 códigos de status e latência de modelo; no entanto, essas configurações de alarme devem ser personalizadas para seu caso de uso de negócios específico e tecnologia de ML.

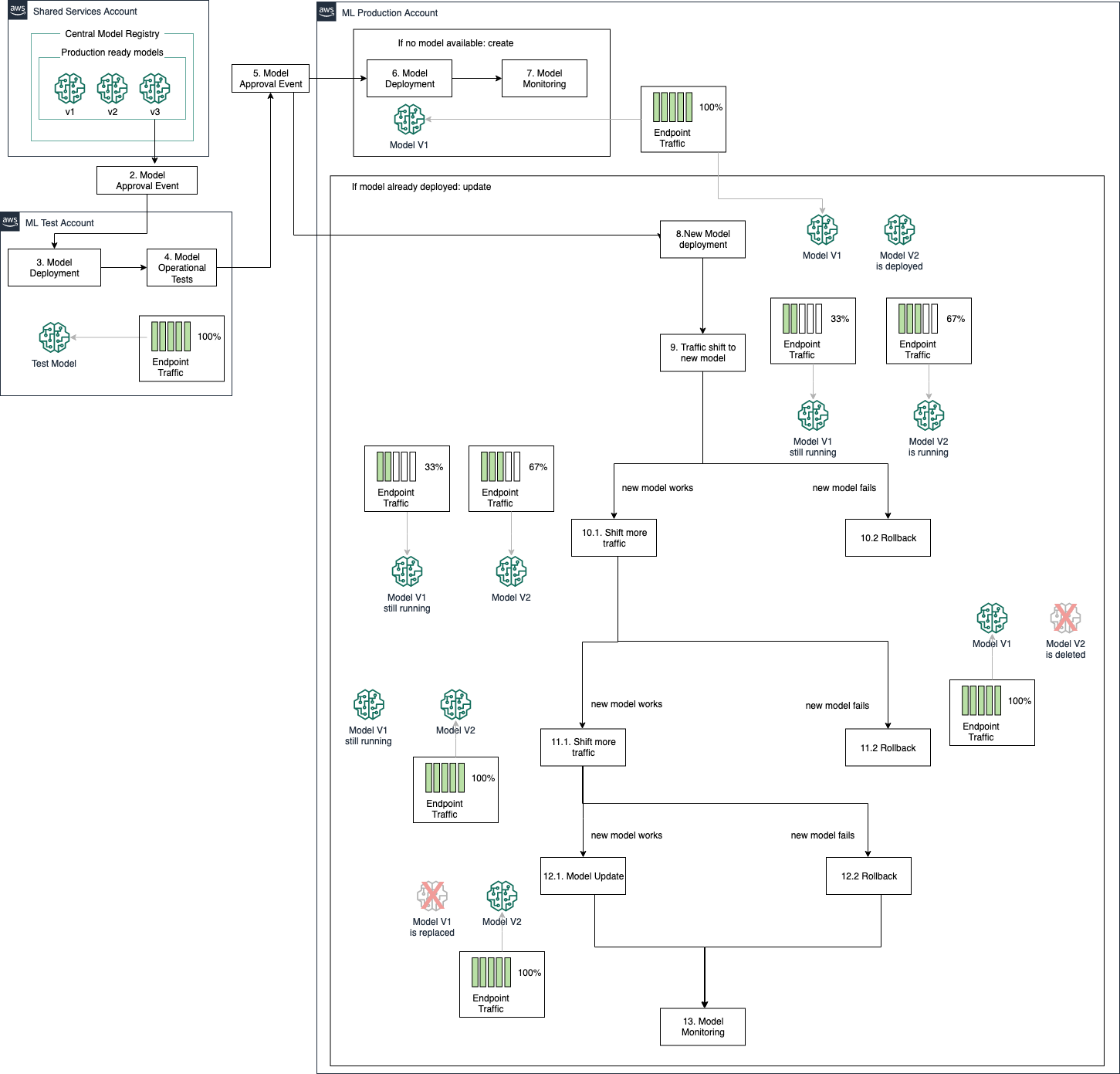

Mudança de tráfego linear

No mudança de tráfego linear modelo, você muda gradualmente o tráfego de seu modelo atual (frota azul) para sua nova versão de modelo (frota verde) aumentando o tráfego de dados enviado para o novo modelo em etapas. Dessa forma, a proporção de tráfego usada para testar sua nova versão de modelo aumenta gradualmente a cada etapa, e um tempo de cozimento para cada etapa garante que seu modelo ainda esteja operacional com o novo tráfego. Com essa opção, você minimiza o risco de implantar um modelo de baixo desempenho e expõe gradualmente o novo modelo a mais tráfego de dados. A desvantagem dessa abordagem é que o tempo de atualização é maior e os custos de execução de ambos os modelos em paralelo aumentam.

A mudança de tráfego linear pode ser incorporada em suas ferramentas MLOps definindo uma configuração de implantação de endpoint com BlueGreenUpdatePolicy definido como LINEAR e definindo o LinearStepSize para determinar quanto do seu tráfego deve ser redirecionado para um novo modelo em cada etapa. Da mesma forma que a opção de uma só vez, em seu pipeline de MLOps, depois que um novo modelo é aprovado para implantação na conta de produção de ML, o SageMaker verifica se o endpoint do modelo já existe. Em caso afirmativo, o LINEAR a configuração aciona uma atualização de terminal que segue a arquitetura indicada no diagrama a seguir. A reversão do seu endpoint é controlada com base nos alarmes do CloudWatch definidos pelo seu endpoint AutoRollbackConfiguration que, quando acionado, inicia automaticamente a reversão do modelo para a versão atual do modelo.

Padrões de implantação com variantes de produção de modelo

Independentemente do padrão de implantação escolhido para seu aplicativo, você também pode utilizar variantes de produção para validar o desempenho do modelo antes de atualizar seu endpoint ou implementar padrões de implantação adicionais, como implantações de sombra. Nesse caso, você deseja adicionar um processo manual ou automatizado para selecionar o melhor modelo a ser implantado antes de atualizar seu endpoint. A arquitetura a seguir mostra como o tráfego e a resposta do endpoint se comportam em um cenário de implantação de sombra. Nesse cenário, cada solicitação de previsão é enviada para os modelos novos e implantados; no entanto, apenas o modelo implantado atualmente atende à resposta de previsão para o aplicativo de negócios, enquanto a previsão fornecida pelo novo modelo é mantida apenas para análise de desempenho em relação ao modelo implantado atualmente. Depois que o desempenho do modelo é avaliado, a nova versão do modelo pode ser implantada para atender o tráfego de resposta de previsão para aplicativos de negócios.

Rollback

Independentemente da estratégia de implantação escolhida para a implantação do modelo, você deseja reverter para a versão anterior do modelo se o desempenho do novo modelo for inferior ao desempenho do modelo atual. Para fazer isso enquanto minimiza o tempo de inatividade do seu aplicativo, você precisa manter o modelo atual em execução em paralelo ao novo até ter certeza de que o desempenho do novo modelo é melhor do que o atual.

As proteções de implantação do SageMaker permitem definir alarmes e reverter automaticamente para versões anteriores do modelo durante o período de validação do modelo. Após o término do período de validação, talvez ainda seja necessário reverter para uma versão anterior do modelo para resolver um novo problema descoberto após a conclusão da atualização do modelo. Para fazer isso, você pode aproveitar o registro do modelo SageMaker para modelos rejeitados e aprovados e acionar um processo de reversão.

Conclusão

Nesta postagem, você aprendeu como combinar variantes de modelo de endpoint do SageMaker e proteções de implantação com recursos de MLOps para criar padrões de ponta a ponta para desenvolvimento de modelo. Fornecemos um exemplo de implementação para guardrails de implantação de deslocamento canário e linear conectados com pipelines do SageMaker e o registro do modelo por meio de um projeto personalizado do SageMaker. Como próximo passo, tente adaptar o seguinte modelo para implementar a estratégia de implantação de sua organização.

Referências

Sobre os autores

Tanque Maira Ladeira é arquiteto de soluções especialista em ML na AWS. Com experiência em ciência de dados, ela tem 9 anos de experiência em arquitetura e construção de aplicativos de ML com clientes em todos os setores. Como líder técnica, ela ajuda os clientes a acelerar a conquista de valor comercial por meio de tecnologias emergentes e soluções inovadoras. Em seu tempo livre, Maira gosta de viajar e passar o tempo com sua família em algum lugar quente.

Tanque Maira Ladeira é arquiteto de soluções especialista em ML na AWS. Com experiência em ciência de dados, ela tem 9 anos de experiência em arquitetura e construção de aplicativos de ML com clientes em todos os setores. Como líder técnica, ela ajuda os clientes a acelerar a conquista de valor comercial por meio de tecnologias emergentes e soluções inovadoras. Em seu tempo livre, Maira gosta de viajar e passar o tempo com sua família em algum lugar quente.

Clay Elmore é arquiteto de soluções especialista em IA/ML da AWS. Depois de passar muitas horas em um laboratório de pesquisa de materiais, sua formação em engenharia química foi rapidamente deixada de lado para se dedicar ao aprendizado de máquina. Ele trabalhou em aplicativos de ML em muitos setores diferentes, desde comércio de energia até marketing de hospitalidade. Clay tem um interesse especial em trazer práticas de desenvolvimento de software para ML e orientar os clientes para soluções repetíveis e escalonáveis usando esses princípios. Em seu tempo livre, Clay gosta de esquiar, resolver cubos de Rubik, ler e cozinhar.

Clay Elmore é arquiteto de soluções especialista em IA/ML da AWS. Depois de passar muitas horas em um laboratório de pesquisa de materiais, sua formação em engenharia química foi rapidamente deixada de lado para se dedicar ao aprendizado de máquina. Ele trabalhou em aplicativos de ML em muitos setores diferentes, desde comércio de energia até marketing de hospitalidade. Clay tem um interesse especial em trazer práticas de desenvolvimento de software para ML e orientar os clientes para soluções repetíveis e escalonáveis usando esses princípios. Em seu tempo livre, Clay gosta de esquiar, resolver cubos de Rubik, ler e cozinhar.

Shelbee Eigenbrode é arquiteto principal de soluções de inteligência artificial e aprendizado de máquina da AWS. Ela está em tecnologia há 24 anos, abrangendo vários setores, tecnologias e funções. Atualmente, ela está se concentrando em combinar sua experiência em DevOps e ML no domínio de MLOps para ajudar os clientes a fornecer e gerenciar cargas de trabalho de ML em escala. Com mais de 35 patentes concedidas em vários domínios de tecnologia, ela tem paixão pela inovação contínua e pelo uso de dados para gerar resultados de negócios. Shelbee é cocriadora e instrutora da especialização Practical Data Science no Coursera. Ela também é codiretora da Women In Big Data (WiBD), divisão de Denver. Em seu tempo livre, ela gosta de passar tempo com sua família, amigos e cães hiperativos.

Shelbee Eigenbrode é arquiteto principal de soluções de inteligência artificial e aprendizado de máquina da AWS. Ela está em tecnologia há 24 anos, abrangendo vários setores, tecnologias e funções. Atualmente, ela está se concentrando em combinar sua experiência em DevOps e ML no domínio de MLOps para ajudar os clientes a fornecer e gerenciar cargas de trabalho de ML em escala. Com mais de 35 patentes concedidas em vários domínios de tecnologia, ela tem paixão pela inovação contínua e pelo uso de dados para gerar resultados de negócios. Shelbee é cocriadora e instrutora da especialização Practical Data Science no Coursera. Ela também é codiretora da Women In Big Data (WiBD), divisão de Denver. Em seu tempo livre, ela gosta de passar tempo com sua família, amigos e cães hiperativos.

Qiyun Zhao é engenheiro de desenvolvimento de software sênior da equipe da plataforma de inferência do Amazon SageMaker. Ele é o principal desenvolvedor de proteções de implantação e implantações de sombra e se concentra em ajudar os clientes a gerenciar cargas de trabalho e implantações de ML em escala com alta disponibilidade. Ele também trabalha em evoluções de arquitetura de plataforma para implantação rápida e segura de trabalhos de ML e execução de experimentos on-line de ML com facilidade. Em seu tempo livre, ele gosta de ler, jogar e viajar.

Qiyun Zhao é engenheiro de desenvolvimento de software sênior da equipe da plataforma de inferência do Amazon SageMaker. Ele é o principal desenvolvedor de proteções de implantação e implantações de sombra e se concentra em ajudar os clientes a gerenciar cargas de trabalho e implantações de ML em escala com alta disponibilidade. Ele também trabalha em evoluções de arquitetura de plataforma para implantação rápida e segura de trabalhos de ML e execução de experimentos on-line de ML com facilidade. Em seu tempo livre, ele gosta de ler, jogar e viajar.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- Platoblockchain. Inteligência Metaverso Web3. Conhecimento Ampliado. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/mlops-deployment-best-practices-for-real-time-inference-model-serving-endpoints-with-amazon-sagemaker/

- 100

- 2022

- 7

- 9

- a

- habilidade

- Capaz

- acelerar

- aceitável

- Segundo

- Conta

- Contabilidade

- Alcançar

- realização

- em

- adicionado

- Adição

- Adicional

- Adicionalmente

- avançado

- Vantagem

- Depois de

- contra

- AI

- AI / ML

- alarme

- algoritmo

- Todos os Produtos

- permite

- já

- Amazon

- Amazon Sage Maker

- quantidade

- análise

- e

- Outro

- Aplicação

- aplicações

- aplicado

- abordagem

- aprovação

- aprovar

- aprovou

- arquitetura

- por aí

- aspectos

- associado

- automatizar

- Automatizado

- automaticamente

- disponibilidade

- disponível

- AWS

- em caminho duplo

- fundo

- baseado

- base

- Porque

- torna-se

- antes

- atrás

- ser

- beneficiar

- MELHOR

- melhores práticas

- Melhor

- entre

- Grande

- Big Data

- Azul

- Trazendo

- amplo

- mais amplo

- Trazido

- construir

- Prédio

- construído

- negócio

- Aplicações de Negócio

- chamado

- capacidades

- casas

- casos

- CD

- certo

- alterar

- mudança

- Capítulo

- Cheques

- químico

- escolha

- escolheu

- fechado

- código

- combinar

- combinado

- combinando

- comum

- comparar

- completar

- completamente

- conceito

- confiante

- Configuração

- conectado

- da conexão

- Considerar

- Considerações

- não contenho

- contexto

- continuamente

- contínuo

- continuamente

- ao controle

- controlado

- Custo

- custos

- cobrir

- coberto

- crio

- Atual

- Atualmente

- personalizadas

- Clientes

- personalizado

- dados,

- informática

- ciência de dados

- Dezembro

- Tomada de Decisão

- Padrão

- definido

- definição

- entregar

- Entrega

- Demanda

- demonstra

- Denver

- Dependendo

- implantar

- implantado

- Implantação

- desenvolvimento

- Implantações

- descrito

- detectou

- Determinar

- desenvolvido

- Developer

- Desenvolvimento

- diferente

- diretamente

- descoberto

- discutir

- discutido

- distribuído

- distribuindo

- distribuição

- Não faz

- domínio

- domínios

- não

- desvantagem

- tempo de inatividade

- distância

- durante

- cada

- mais fácil

- facilmente

- eficácia

- ou

- emergente

- permitir

- end-to-end

- Ponto final

- energia

- engenheiro

- Engenharia

- suficiente

- garantir

- garante

- assegurando

- Meio Ambiente

- essencial

- avaliar

- avaliadas

- evoluções

- exemplo

- existente

- existe

- esperado

- vasta experiência

- explorar

- exposto

- família

- RÁPIDO

- Funcionalidades

- retornos

- Figura

- Primeiro nome

- primeira vez

- ANIMARIS

- concentra-se

- focando

- seguinte

- segue

- Fundações

- Quadro

- Gratuito

- amigos

- da

- cheio

- funcionalidade

- funções

- mais distante

- jogos

- lacuna

- coleta

- Geral

- obtendo

- OFERTE

- dado

- gradualmente

- concedido

- Verde

- Grupo

- manipular

- Alças

- ajudar

- ajuda

- ajuda

- SUA PARTICIPAÇÃO FAZ A DIFERENÇA

- Alta

- hospitalidade

- hospedagem

- HORÁRIO

- Como funciona o dobrador de carta de canal

- Como Negociar

- Contudo

- HTML

- HTTPS

- Impacto

- executar

- implementação

- implementado

- implementação

- melhoria

- in

- incluir

- inclui

- Incluindo

- Incorporado

- aumentou

- Aumenta

- aumentando

- indústrias

- INFORMAÇÕES

- Infraestrutura

- Inovação

- inovadores

- instância

- em vez disso

- integrar

- Integração

- integração

- interesse

- Introdução

- isolamento

- emitem

- questões

- IT

- Trabalho

- Empregos

- Guarda

- Chave

- laboratório

- Sobrenome

- Latência

- lançado

- conduzir

- aprendido

- aprendizagem

- Nível

- wifecycwe

- Listado

- viver

- mais

- Baixo

- máquina

- aprendizado de máquina

- a manter

- gerencia

- de grupos

- gestão

- manual

- muitos

- mapeamento

- mercado

- Marketing

- materiais

- Maximizar

- significativo

- mecanismo

- mencionado

- metadados

- métodos

- métrico

- Métrica

- poder

- minimizando

- ML

- MLOps

- Moda

- modelo

- Teste de modelo

- modelos

- Monitore

- monitorados

- monitoração

- monitores

- mais

- a maioria

- múltiplo

- Natureza

- necessário

- você merece...

- Novo

- Próximo

- Oferece

- ONE

- online

- operacional

- Operações

- ideal

- Opção

- Opções

- ordem

- organização

- Outros

- Resultado

- delineado

- pacote

- Paralelo

- parâmetro

- parte

- passes

- paixão

- Patentes

- padrão

- padrões

- Realizar

- atuação

- executa

- significativo

- fotografia

- oleoduto

- Lugar

- plataforma

- platão

- Inteligência de Dados Platão

- PlatãoData

- possível

- Publique

- Prática

- práticas

- Precisão

- predição

- Previsões

- Preparar

- presente

- anterior

- anteriormente

- Diretor

- princípios

- Problema

- processo

- em processamento

- Produzido

- Produção

- projeto

- projetos

- proposto

- proteger

- fornecer

- fornecido

- fornece

- propósito

- colocar

- qualidade

- rapidamente

- alcance

- variando

- Leitura

- pronto

- reais

- em tempo real

- recebe

- receber

- Recomenda

- região

- registrado

- registro

- regular

- liberar

- relevante

- confiabilidade

- confiável

- Repetivel

- substituído

- solicitar

- pedidos

- pesquisa

- recurso

- resposta

- retorno

- reutilizável

- Risco

- riscos

- papéis

- Rolo

- rolando

- Execute

- corrida

- sábio

- Inferência do SageMaker

- Pipelines SageMaker

- mesmo

- satisfeito

- satisfeito com

- AMPLIAR

- escalável

- Escala

- cenário

- cenários

- Ciência

- seguro

- selecionado

- envio

- senior

- separado

- serve

- serviço

- de servir

- conjunto

- Configurações

- instalação

- vários

- Shadow

- Teste de sombra

- mudança

- MUDANÇA

- rede de apoio social

- Shows

- significado

- semelhante

- Similarmente

- solteiro

- situações

- pequeno

- menor

- So

- Software

- desenvolvimento de software

- solução

- Soluções

- RESOLVER

- Resolvendo

- especial

- especialista

- específico

- gastar

- Passar

- começado

- começa

- estatístico

- Status

- Passo

- Passos

- Ainda

- armazenadas

- estratégias

- Estratégia

- apresentado

- tal

- ajuda

- Interruptor

- sistemas

- Tire

- toma

- Target

- Profissionais

- Dados Técnicos:

- Tecnologias

- Tecnologia

- modelos

- teste

- ensaio

- testes

- A

- deles

- Através da

- Taxa de transferência

- GRAVATA

- tempo

- para

- ferramentas

- para

- Rastreabilidade

- pista

- Trading

- tradicional

- tráfego

- Trem

- treinado

- Training

- transparente

- Viagens

- desencadear

- desencadeado

- tipos

- tipicamente

- compreender

- único

- unidade

- Atualizar

- Atualizada

- Atualizações

- atualização

- usar

- caso de uso

- usuários

- utilizar

- VALIDAR

- validado

- validação

- valor

- Variante

- vário

- versão

- via

- viável

- quente

- peso

- O Quê

- O que é a

- qual

- enquanto

- precisarão

- dentro

- Mulher

- trabalhou

- fluxos de trabalho

- trabalho

- seria

- escrita

- anos

- Vocês

- investimentos

- zefirnet