JumpStart do Amazon SageMaker é um hub de aprendizado de máquina (ML) que pode ajudá-lo a acelerar sua jornada de ML. Com o SageMaker JumpStart, você pode descobrir e implantar modelos de fundação proprietários e disponíveis publicamente para Amazon Sage Maker instâncias para seus aplicativos de IA generativos. O SageMaker JumpStart permite implantar modelos de base a partir de um ambiente de rede isolado e não compartilha dados de treinamento e inferência do cliente com provedores de modelos.

Nesta postagem, mostramos como começar a usar modelos proprietários de fornecedores de modelos, como AI21, Cohere e LightOn, da Estúdio Amazon SageMaker. O SageMaker Studio é um ambiente de notebook onde os clientes de cientistas de dados corporativos do SageMaker avaliam e criam modelos para seus próximos aplicativos de IA generativos.

Modelos de fundação no SageMaker

Os modelos de fundação são modelos de ML em grande escala que contêm bilhões de parâmetros e são pré-treinados em terabytes de dados de texto e imagem para que você possa realizar uma ampla variedade de tarefas, como resumo de artigo e geração de texto, imagem ou vídeo. Como os modelos básicos são pré-treinados, eles podem ajudar a reduzir os custos de treinamento e infraestrutura e permitir a personalização para seu caso de uso.

O SageMaker JumpStart fornece dois tipos de modelos de fundação:

- Modelos proprietários – Esses modelos são de fornecedores como AI21 com modelos Jurassic-2, Cohere com Cohere Command e LightOn com Mini treinados em algoritmos e dados proprietários. Você não pode visualizar artefatos de modelo, como peso e scripts, mas ainda pode implantar em instâncias do SageMaker para inferência.

- Modelos disponíveis publicamente – São hubs de modelos populares, como Hugging Face com difusão estável, Falcon e FLAN, treinados em algoritmos e dados disponíveis publicamente. Para esses modelos, os usuários têm acesso a artefatos de modelo e podem ajustar com seus próprios dados antes da implantação para inferência.

Descubra modelos

Você pode acessar os modelos de base por meio do SageMaker JumpStart na interface do usuário do SageMaker Studio e do SageMaker Python SDK. Nesta seção, veremos como descobrir os modelos na IU do SageMaker Studio.

O SageMaker Studio é um ambiente de desenvolvimento integrado (IDE) baseado na Web para ML que permite criar, treinar, depurar, implantar e monitorar seus modelos de ML. Para obter mais detalhes sobre como começar e configurar o SageMaker Studio, consulte Estúdio Amazon SageMaker.

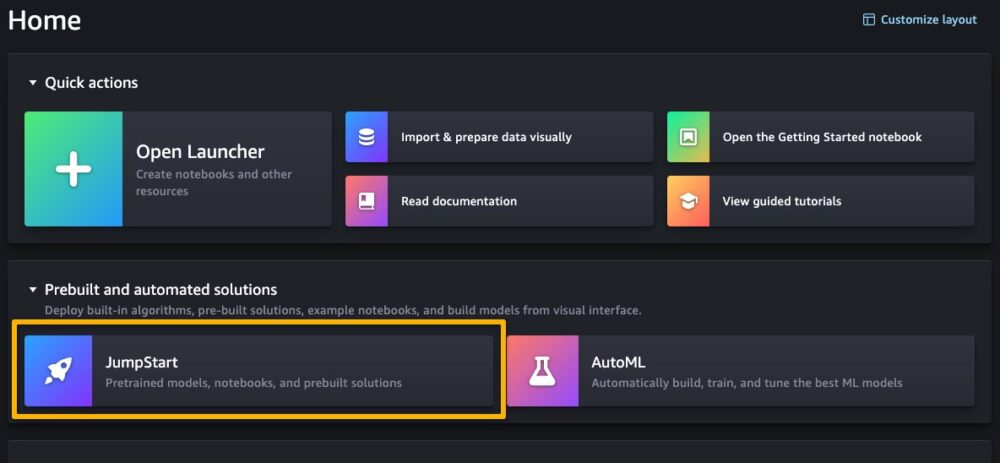

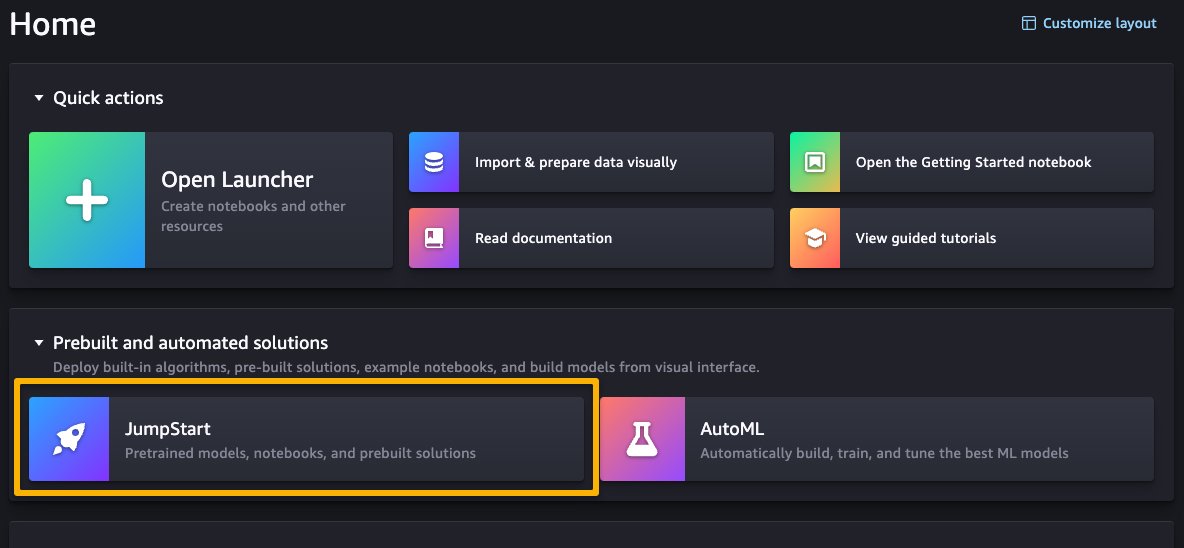

Quando estiver na IU do SageMaker Studio, você poderá acessar o SageMaker JumpStart, que contém modelos pré-treinados, notebooks e soluções pré-criadas, em Soluções pré-construídas e automatizadas.

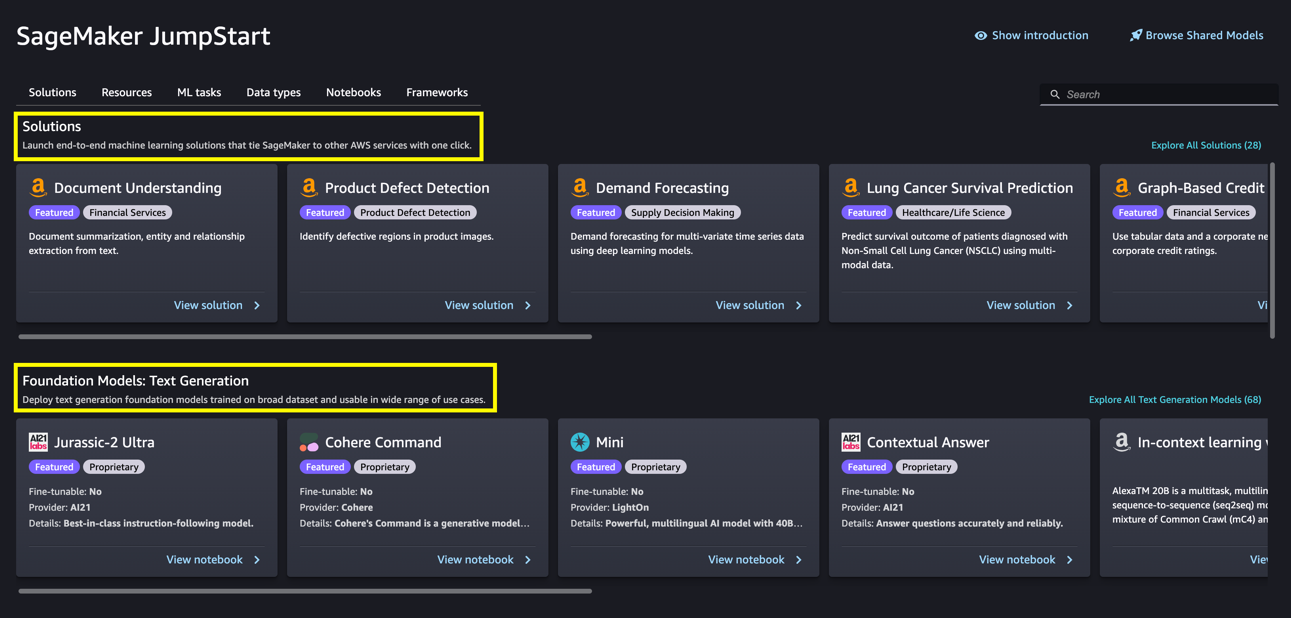

Na página inicial do SageMaker JumpStart, você pode procurar soluções, modelos, blocos de anotações e outros recursos. A captura de tela a seguir mostra um exemplo da página inicial com soluções e modelos de fundação listados.

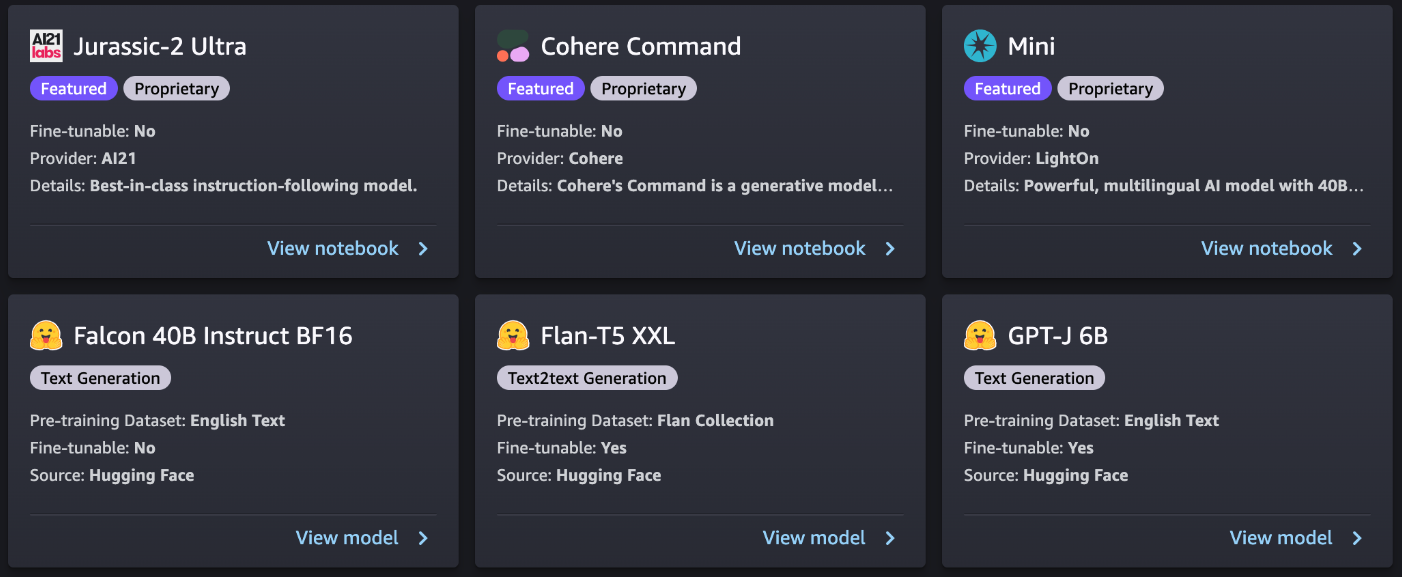

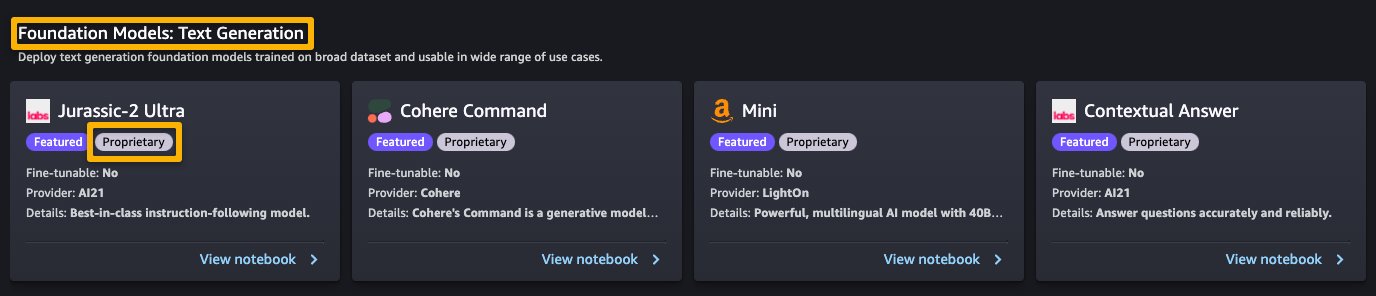

Cada modelo possui um cartão de modelo, conforme mostrado na captura de tela a seguir, que contém o nome do modelo, se é ajustável ou não, o nome do provedor e uma breve descrição sobre o modelo. Você também pode abrir o cartão do modelo para saber mais sobre o modelo e começar a treinar ou implantar.

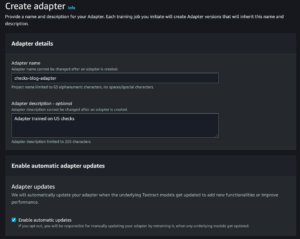

Inscrever-se no AWS Marketplace

Modelos proprietários no SageMaker JumpStart são publicados por fornecedores de modelos, como AI21, Cohere e LightOn. Você pode identificar modelos proprietários pela etiqueta “Proprietary” nos cartões de modelo, conforme mostrado na captura de tela a seguir.

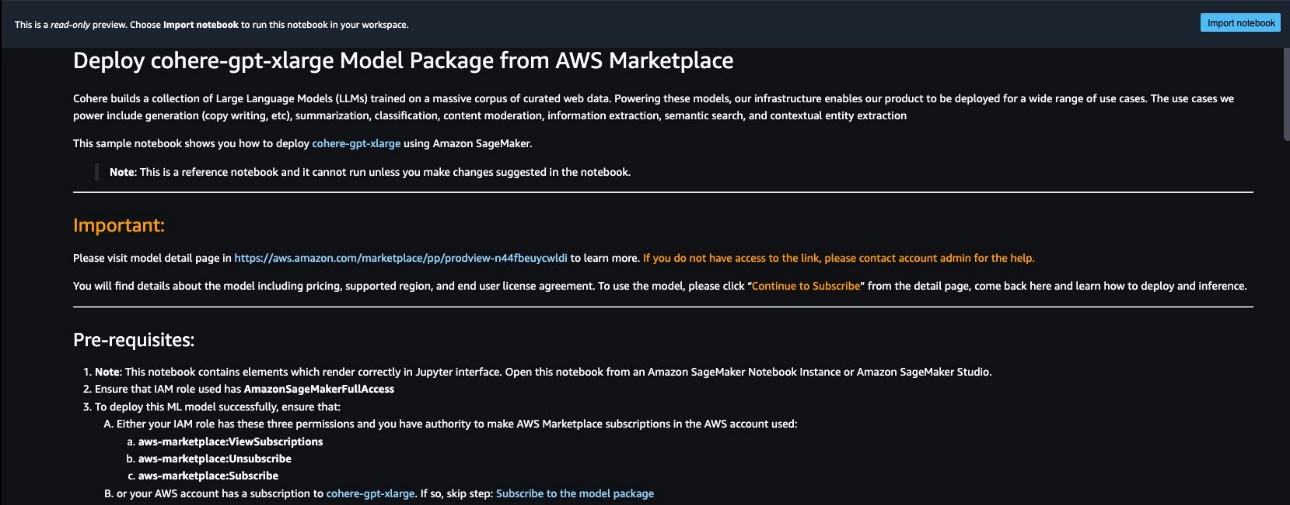

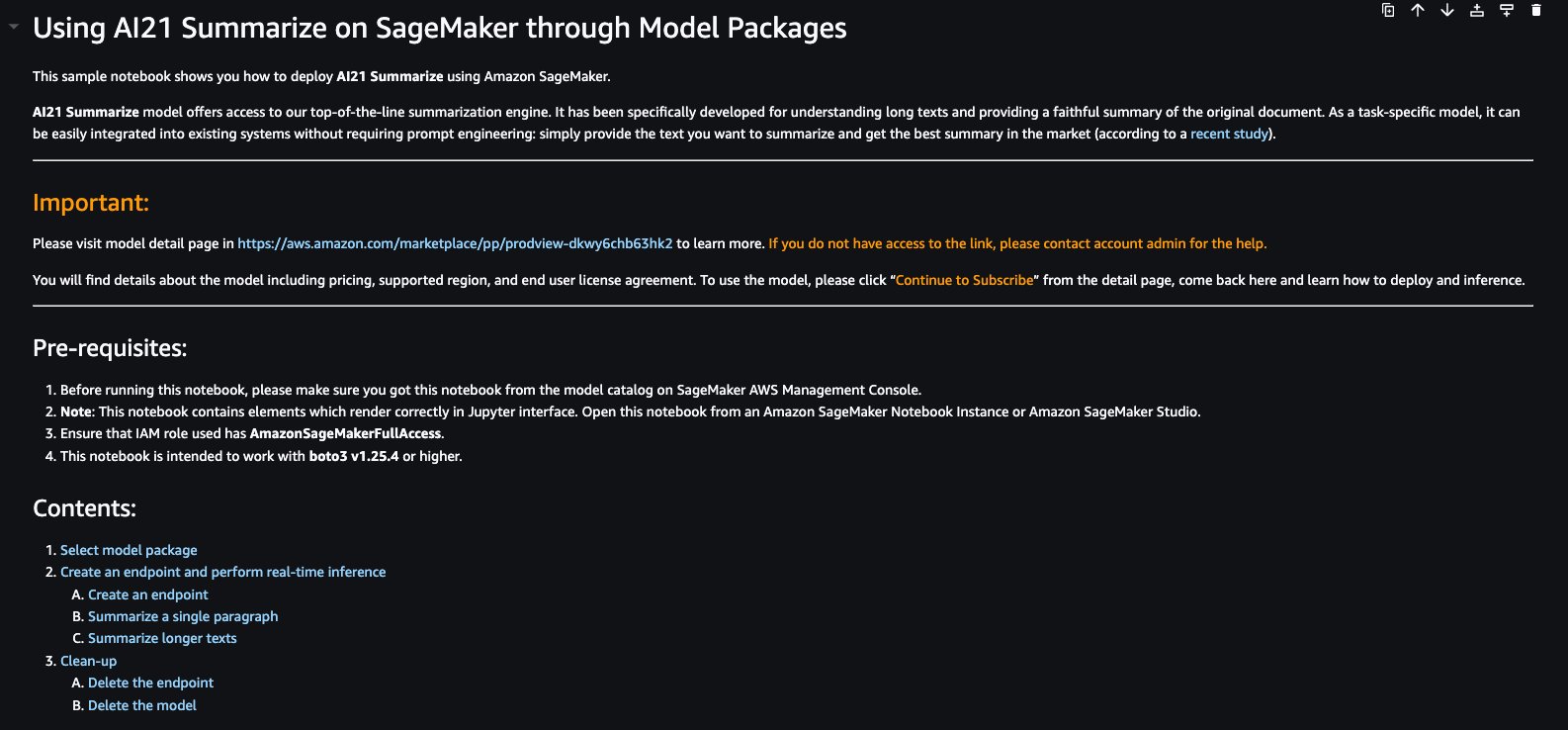

Você pode escolher Ver caderno no cartão do modelo para abrir o notebook no modo somente leitura, conforme mostrado na captura de tela a seguir. Você pode ler o notebook para obter informações importantes sobre pré-requisitos e outras instruções de uso.

Depois de importar o notebook, você precisa selecionar o ambiente de notebook apropriado (imagem, kernel, tipo de instância e assim por diante) antes de executar os códigos. Você também deve seguir as instruções de assinatura e uso do notebook selecionado.

Antes de usar um modelo proprietário, você precisa primeiro se inscrever no modelo de Mercado da AWS:

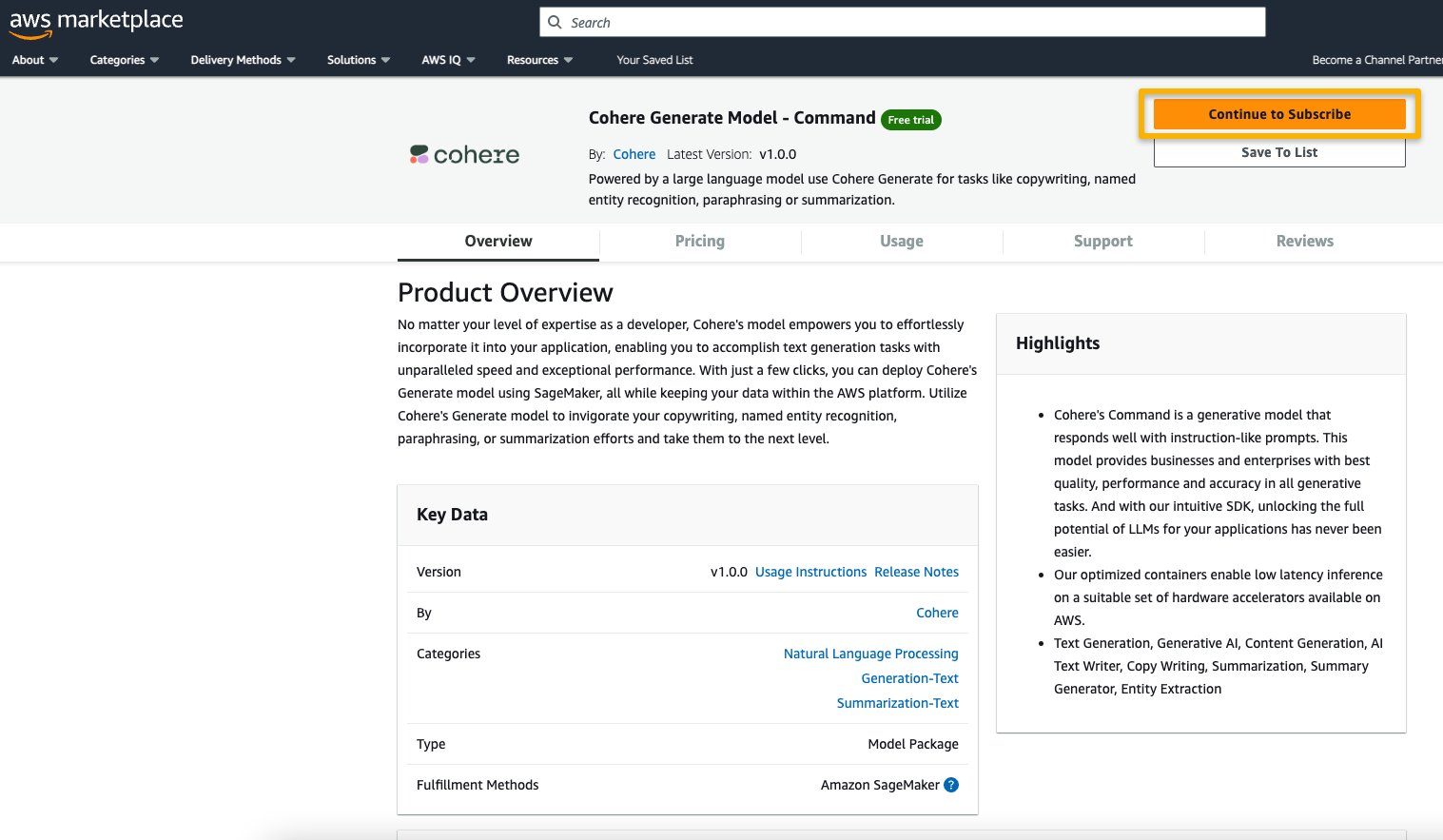

- Abra a página de listagem de modelos no AWS Marketplace.

A URL é fornecida no importante seção do notebook, ou você pode acessá-lo a partir do Página do serviço SageMaker JumpStart. A página de listagem mostra a visão geral, preços, uso e informações de suporte sobre o modelo.

- Na listagem do AWS Marketplace, escolha Continuar a se inscrever.

Se você não tiver as permissões necessárias para visualizar ou assinar o modelo, entre em contato com seu administrador de TI ou ponto de contato de aquisição para assinar o modelo para você. Muitas empresas podem limitar as permissões do AWS Marketplace para controlar as ações que alguém com essas permissões pode realizar no AWS Marketplace Management Portal.

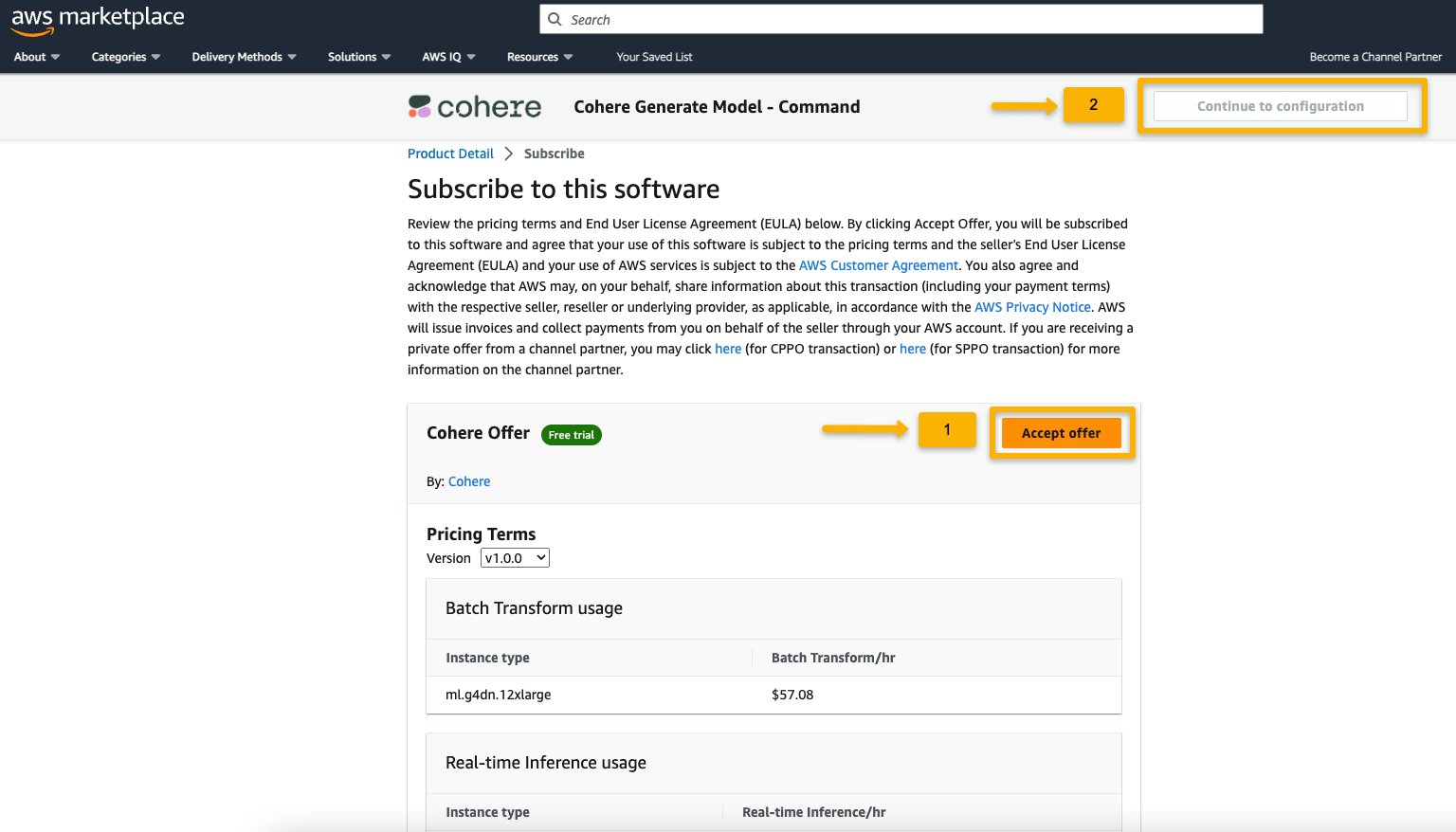

- No Assine esta página de software, revise os detalhes e escolha Aceitar oferta se você e sua organização concordarem com o EULA, preços e termos de suporte.

Se você tiver alguma dúvida ou solicitar um desconto por volume, entre em contato com o fornecedor do modelo diretamente pelo e-mail de suporte fornecido na página de detalhes ou entre em contato com sua equipe de contas da AWS.

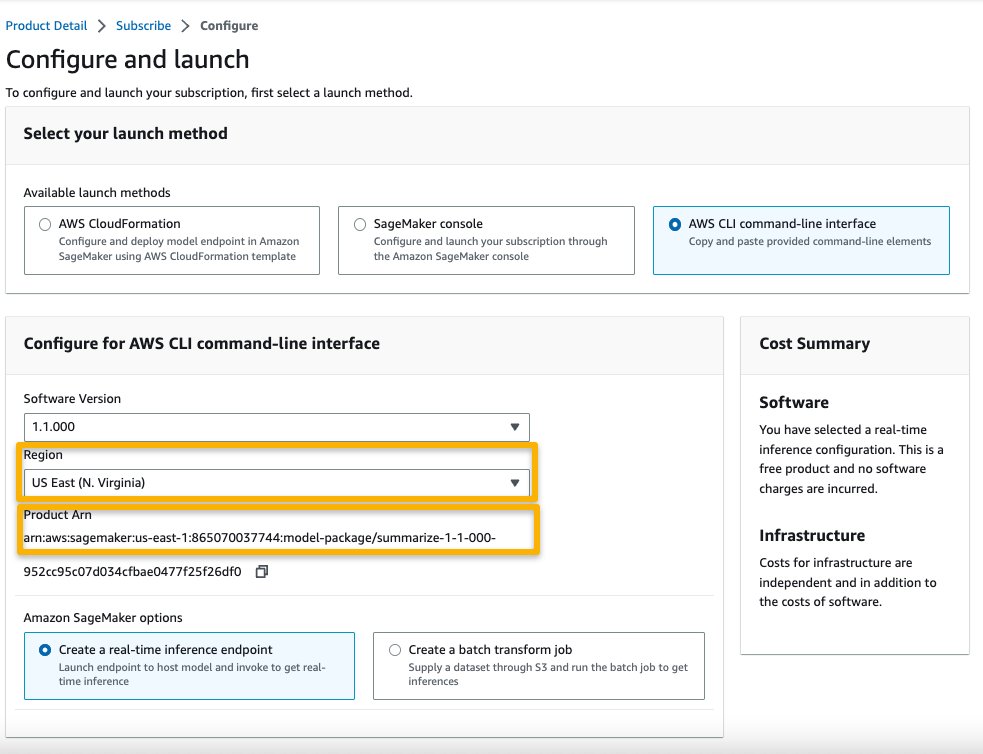

- Escolha Continuar para a configuração e escolha uma região.

Você verá um ARN do produto exibido. Este é o ARN do pacote de modelo que você precisa especificar ao criar um modelo implementável usando o Boto3.

- Copie o ARN correspondente à sua região e especifique o mesmo na instrução de célula do notebook.

Inferência de amostra com prompts de amostra

Vejamos alguns dos exemplos de modelos de fundação da A21 Labs, Cohere e LightOn que podem ser descobertos no SageMaker JumpStart no SageMaker Studio. Todos eles têm as mesmas instruções para se inscrever no AWS Marketplace e importar e configurar o notebook.

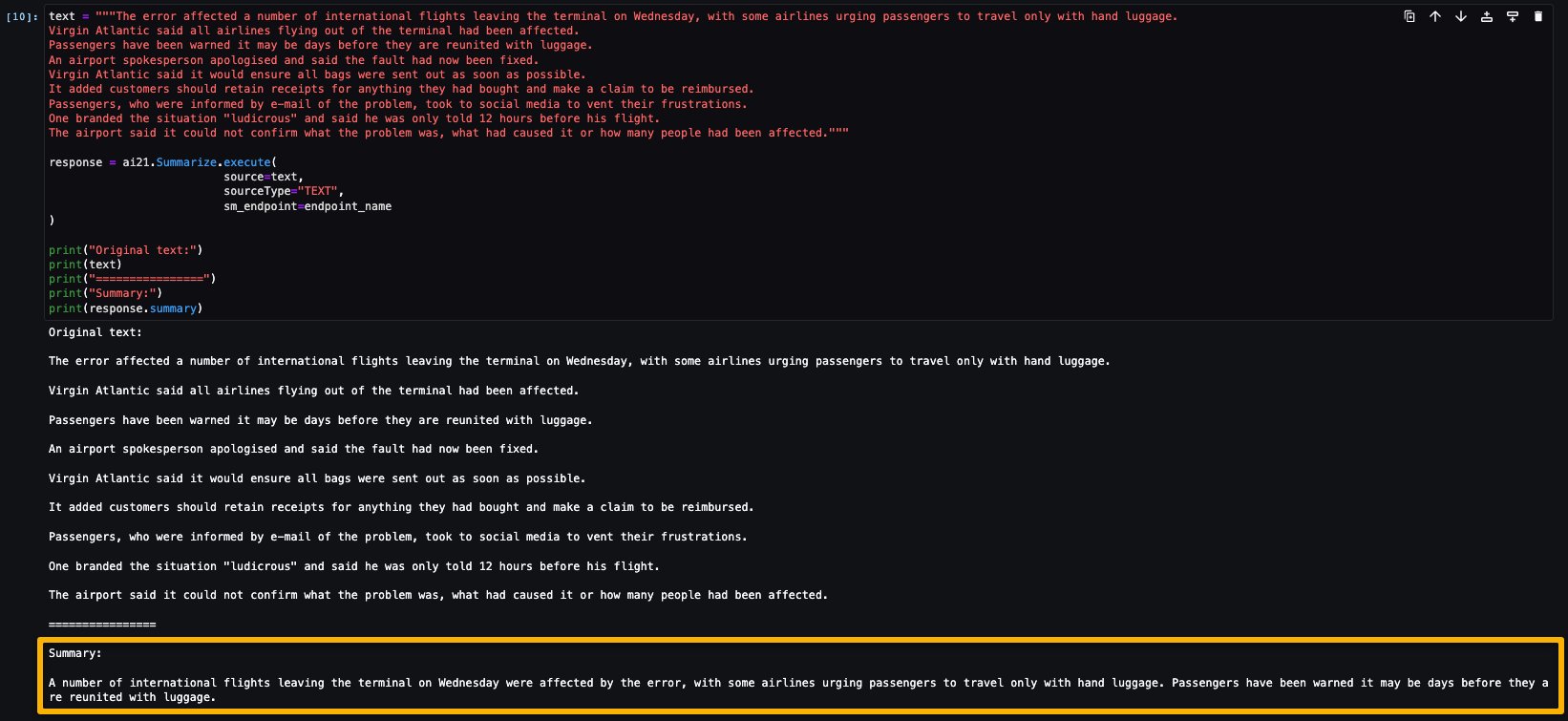

AI21 Resumir

O modelo Summarize da A121 Labs condensa textos longos em pedaços curtos e fáceis de ler que permanecem factualmente consistentes com a fonte. O modelo é treinado para gerar resumos que capturam ideias-chave com base em um corpo de texto. Não requer nenhuma solicitação. Você simplesmente insere o texto que precisa ser resumido. Seu texto de origem pode conter até 50,000 caracteres, traduzindo-se em cerca de 10,000 palavras ou impressionantes 40 páginas.

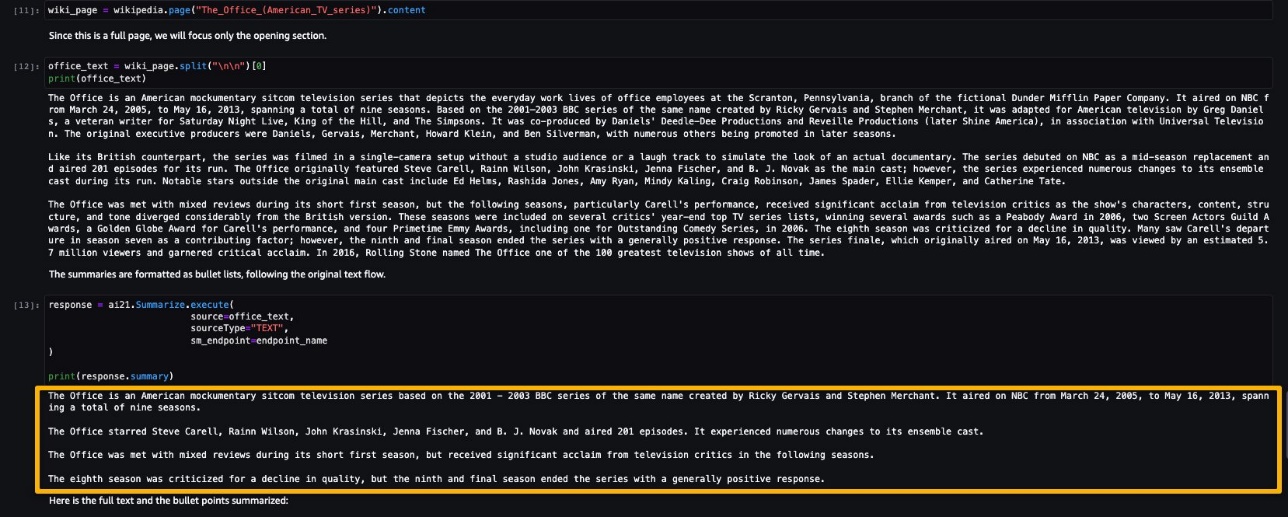

O notebook de amostra para o modelo AI21 Summarize fornece pré-requisitos importantes que precisam ser seguidos. Por exemplo, o modelo está inscrito no AWS Marketplace , tem permissões apropriadas de funções do IAM e versão necessária do boto3 etc. Ele orienta você sobre como selecionar o pacote do modelo, criar endpoints para inferência em tempo real e, em seguida, limpar.

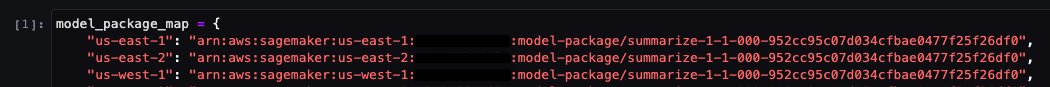

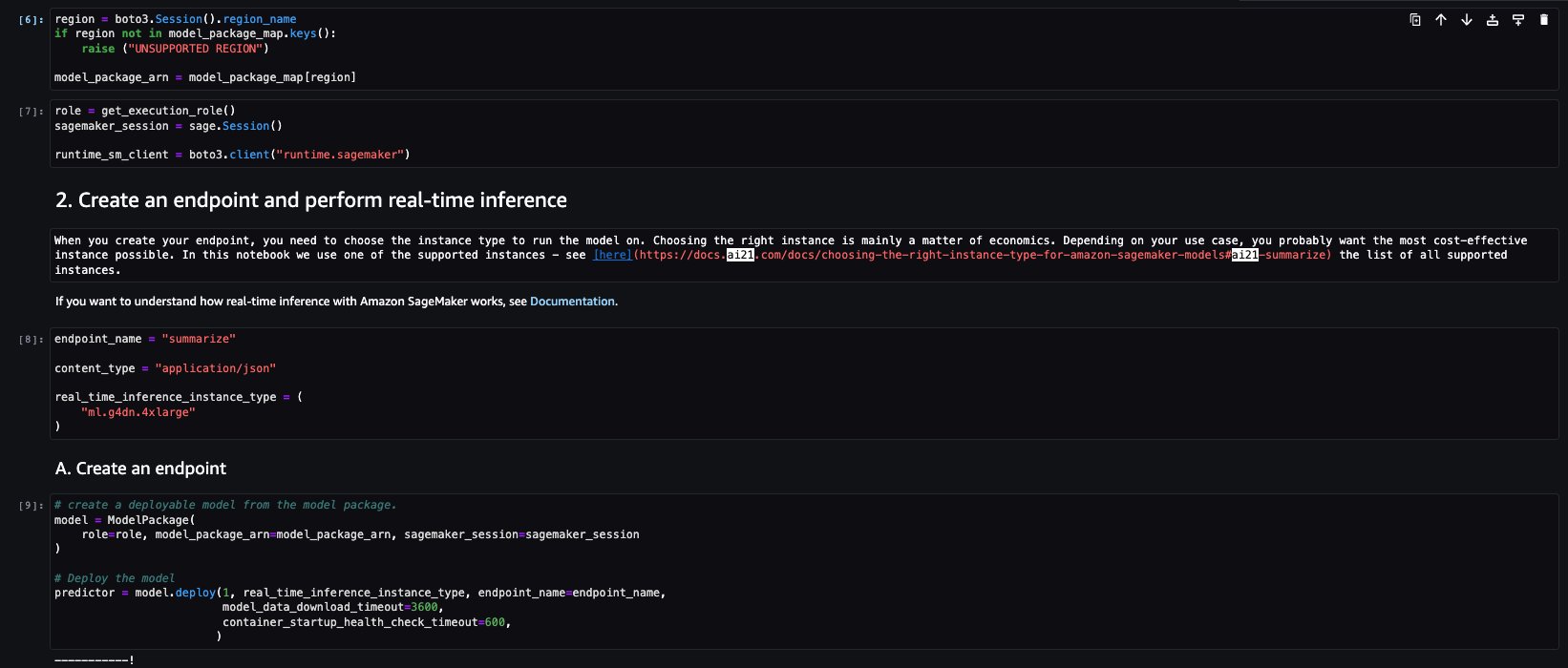

O pacote de modelo selecionado contém o mapeamento de ARNs para regiões. Esta é a informação que você capturou depois de escolher Continuar para a configuração na página de assinatura do AWS Marketplace (na seção Avalie e assine no Marketplace) e, em seguida, selecionando uma região para a qual você verá o ARN do produto correspondente.

O notebook pode já ter o ARN pré-preenchido.

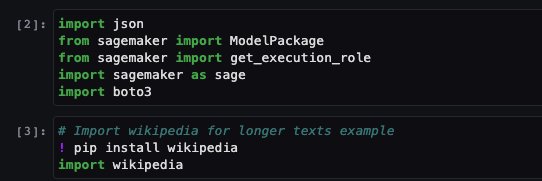

Em seguida, importe algumas bibliotecas necessárias para executar este notebook e instale a wikipedia, que é uma biblioteca Python que facilita o acesso e a análise de dados da Wikipedia. O notebook usa isso mais tarde para mostrar como resumir um longo texto da Wikipedia.

O notebook também passa a instalar o ai21 Python SDK, que é um wrapper em torno das APIs do SageMaker, como deploy e invoke endpoint.

As próximas células do notebook percorrem as seguintes etapas:

- Selecione a região e busque o ARN do pacote modelo no mapa do pacote modelo

- Crie seu endpoint de inferência selecionando um tipo de instância (dependendo do seu caso de uso e da instância suportada para o modelo; consulte Modelos específicos de tarefas para mais detalhes) para executar o modelo em

- Crie um modelo implantável a partir do pacote de modelos

Vamos executar a inferência para gerar um resumo de um único parágrafo retirado de uma notícia. Como você pode ver na saída, o texto resumido é apresentado como uma saída pelo modelo.

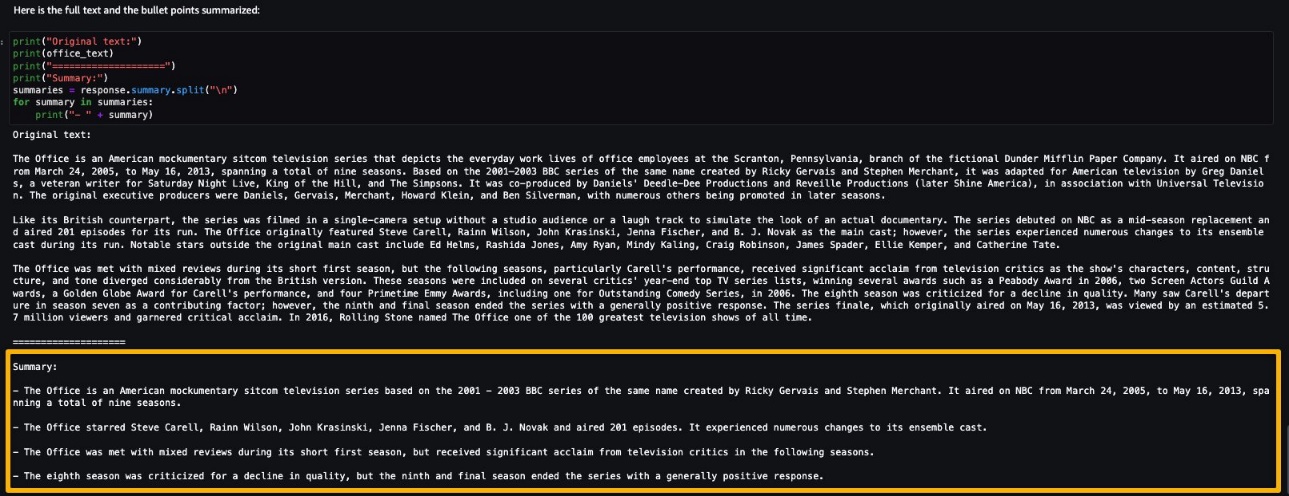

O AI21 Summarize pode lidar com entradas de até 50,000 caracteres. Isso se traduz em cerca de 10,000 palavras ou 40 páginas. Como demonstração do comportamento do modelo, carregamos uma página da Wikipédia.

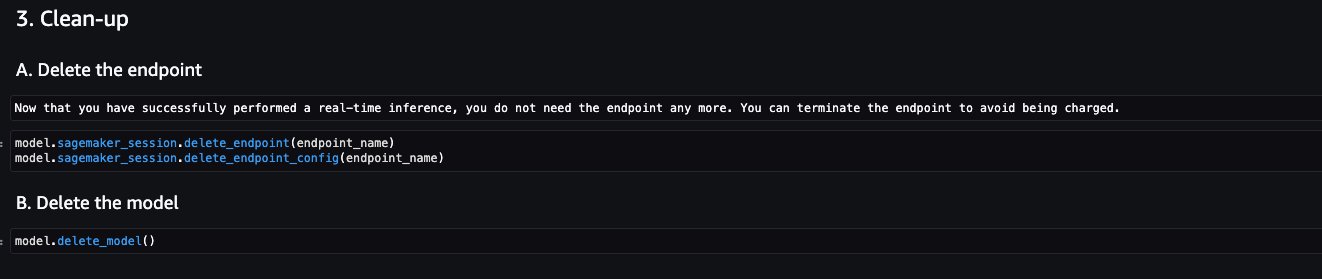

Agora que você executou uma inferência em tempo real para teste, talvez não precise mais do terminal. Você pode excluir o endpoint para evitar cobranças.

Comando Cohere

Cohere Command é um modelo generativo que responde bem com prompts semelhantes a instruções. Este modelo oferece aos negócios e empresas a melhor qualidade, desempenho e precisão em todas as tarefas generativas. Você pode usar o modelo de comando do Cohere para revigorar seus esforços de redação, reconhecimento de entidade nomeada, paráfrase ou resumo e levá-los ao próximo nível.

O notebook de exemplo para o modelo Cohere Command fornece pré-requisitos importantes que precisam ser seguidos. Por exemplo, o modelo está inscrito no AWS Marketplace, tem permissões apropriadas de funções do IAM e versão necessária do boto3, etc.

Algumas das tarefas são semelhantes às abordadas no exemplo de notebook anterior, como instalar o Boto3, instalar cohere-sagemaker (o pacote fornece funcionalidade desenvolvida para simplificar a interface com o modelo Cohere) e obter a sessão e a região.

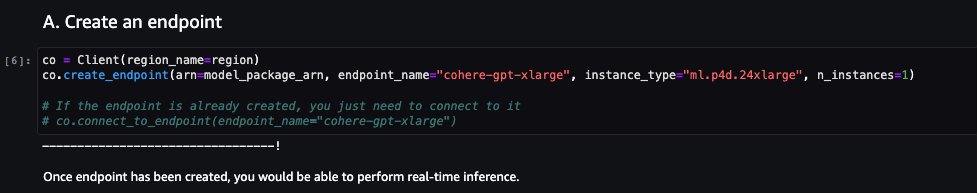

Vamos explorar a criação do endpoint. Você fornece o ARN do pacote modelo, o nome do terminal, o tipo de instância a ser usado e o número de instâncias. Uma vez criado, o endpoint aparece em seu Ponto final seção do SageMaker.

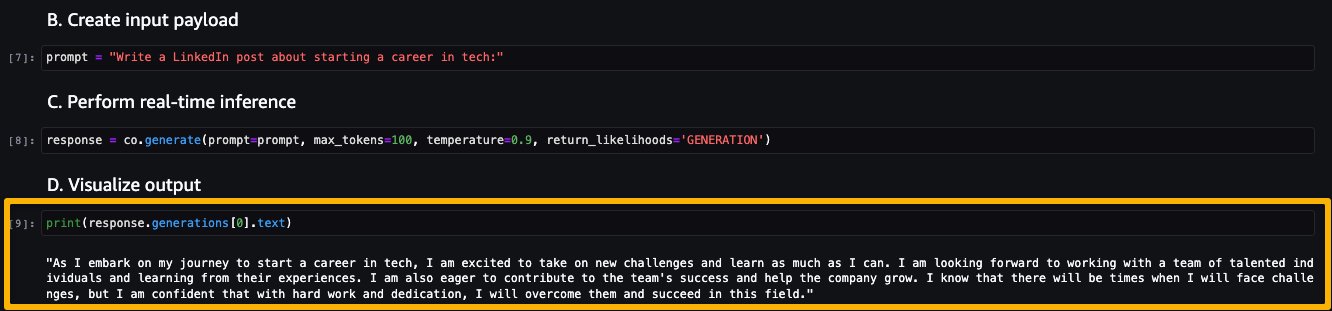

Agora vamos executar a inferência para ver algumas das saídas do modelo Command.

A captura de tela a seguir mostra um exemplo de geração de uma postagem de trabalho e sua saída. Como você pode ver, o modelo gerou uma postagem a partir do prompt fornecido.

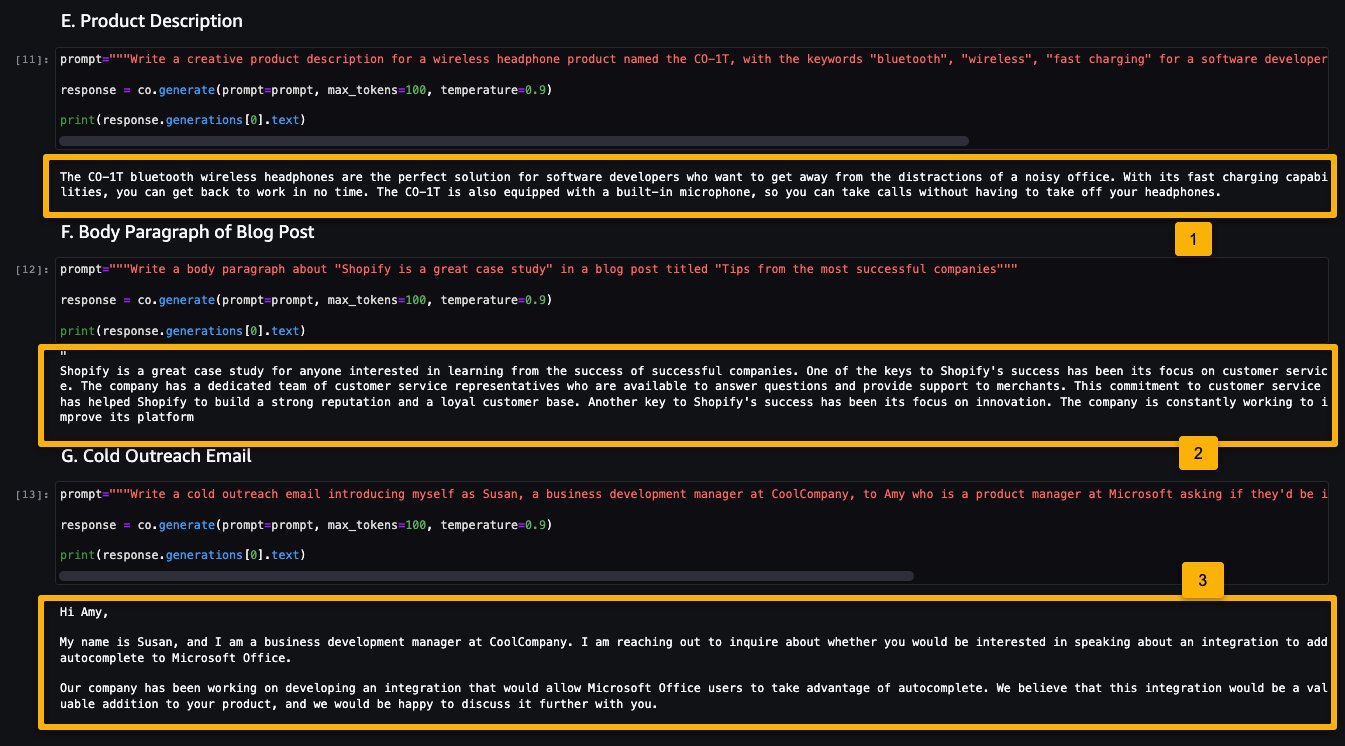

Vejamos agora os seguintes exemplos:

- Gerar uma descrição do produto

- Gerar um parágrafo do corpo de uma postagem de blog

- Gere um e-mail de divulgação

Como você pode ver, o modelo Cohere Command gerou texto para várias tarefas generativas.

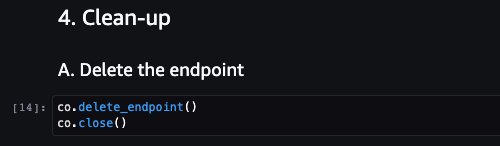

Agora que você executou inferência em tempo real para teste, talvez não precise mais do ponto de extremidade. Você pode excluir o endpoint para evitar cobranças.

Mini-instrução LightOn

O Mini-instruct, um modelo de IA com 40 bilhões de bilhões de parâmetros criado pela LightOn, é um poderoso sistema de IA multilíngue que foi treinado usando dados de alta qualidade de várias fontes. Ele foi desenvolvido para entender a linguagem natural e reagir a comandos específicos às suas necessidades. Ele tem um desempenho admirável em produtos de consumo, como assistentes de voz, chatbots e aparelhos inteligentes. Ele também possui uma ampla gama de aplicativos de negócios, incluindo assistência ao agente e produção de linguagem natural para atendimento automatizado ao cliente.

O notebook de exemplo para o modelo LightOn Mini-instruct fornece pré-requisitos importantes que precisam ser seguidos. Por exemplo, o modelo está inscrito no AWS Marketplace, tem permissões apropriadas de funções do IAM e versão necessária do boto3, etc.

Algumas das tarefas são semelhantes às abordadas no exemplo de notebook anterior, como instalar o Boto3 e obter a região da sessão.

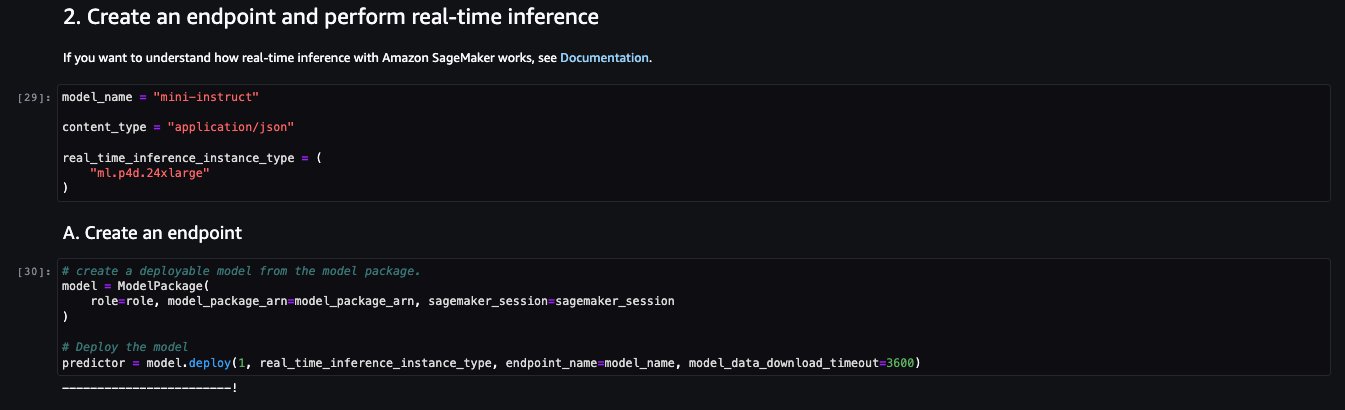

Vamos ver como criar o endpoint. Primeiro, forneça o ARN do pacote modelo, o nome do endpoint, o tipo de instância a ser usado e o número de instâncias. Depois de criado, o endpoint aparece na seção endpoint do SageMaker.

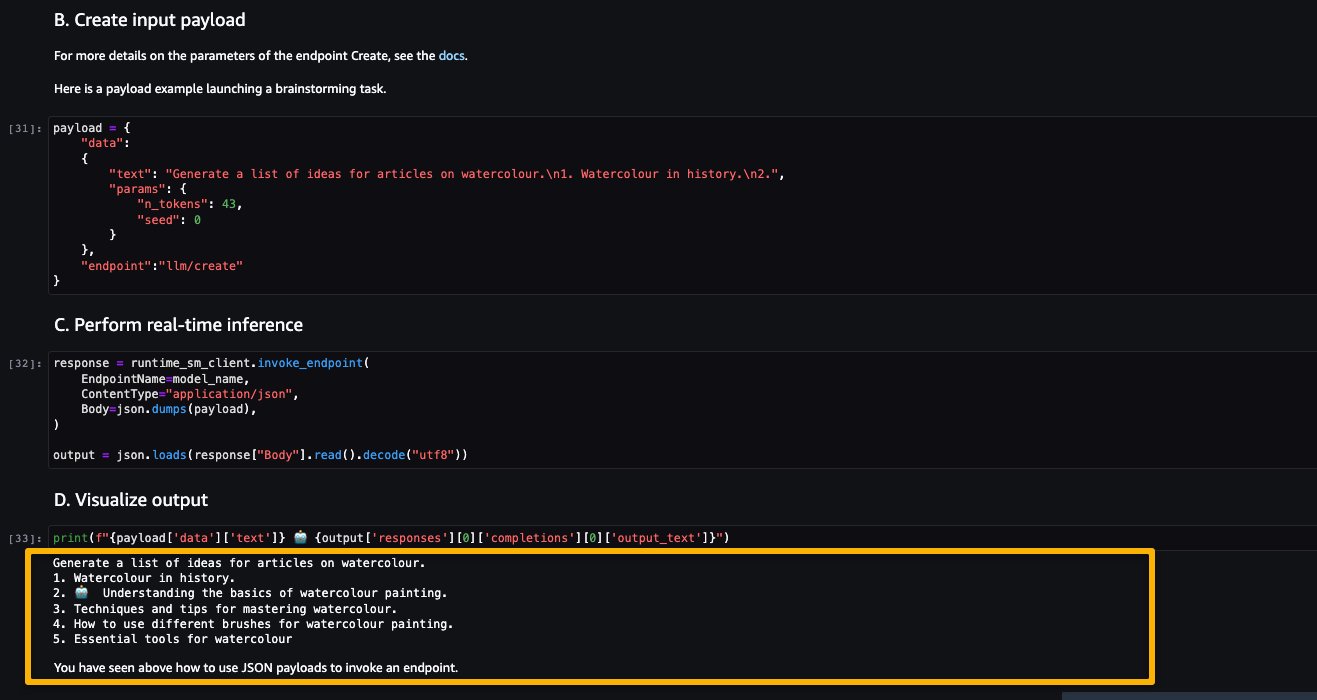

Agora vamos tentar inferir o modelo pedindo a ele para gerar uma lista de ideias para artigos para um tópico, neste caso aquarela.

Como você pode ver, o modelo LightOn Mini-instruct foi capaz de fornecer o texto gerado com base no prompt fornecido.

limpar

Depois de testar os modelos e criar pontos de extremidade acima para os exemplos de Modelos de fundação proprietários, exclua os pontos de extremidade de inferência do SageMaker e exclua os modelos para evitar cobranças.

Conclusão

Nesta postagem, mostramos como começar a usar modelos proprietários de fornecedores de modelos, como AI21, Cohere e LightOn no SageMaker Studio. Os clientes podem descobrir e usar modelos de fundação proprietários no SageMaker JumpStart do Studio, do SageMaker SDK e do SageMaker Console. Com isso, eles têm acesso a modelos de ML de grande escala que contêm bilhões de parâmetros e são pré-treinados em terabytes de dados de texto e imagem para que os clientes possam executar uma ampla gama de tarefas, como resumo de artigos e geração de texto, imagem ou vídeo. Como os modelos básicos são pré-treinados, eles também podem ajudar a reduzir os custos de treinamento e infraestrutura e permitir a personalização para seu caso de uso.

Recursos

Sobre os autores

junho ganhou é gerente de produto do SageMaker JumpStart. Ele se concentra em tornar os modelos de base facilmente detectáveis e utilizáveis para ajudar os clientes a criar aplicativos generativos de IA.

junho ganhou é gerente de produto do SageMaker JumpStart. Ele se concentra em tornar os modelos de base facilmente detectáveis e utilizáveis para ajudar os clientes a criar aplicativos generativos de IA.

Mani Khanuja é Especialista em Inteligência Artificial e Aprendizado de Máquina SA na Amazon Web Services (AWS). Ela ajuda os clientes que usam aprendizado de máquina a resolver seus desafios de negócios usando a AWS. Ela passa a maior parte do tempo se aprofundando e ensinando os clientes em projetos de IA/ML relacionados à visão computacional, processamento de linguagem natural, previsão, ML na borda e muito mais. Ela é apaixonada por ML no limite, por isso criou seu próprio laboratório com kit autônomo e linha de produção de protótipos, onde passa grande parte de seu tempo livre.

Mani Khanuja é Especialista em Inteligência Artificial e Aprendizado de Máquina SA na Amazon Web Services (AWS). Ela ajuda os clientes que usam aprendizado de máquina a resolver seus desafios de negócios usando a AWS. Ela passa a maior parte do tempo se aprofundando e ensinando os clientes em projetos de IA/ML relacionados à visão computacional, processamento de linguagem natural, previsão, ML na borda e muito mais. Ela é apaixonada por ML no limite, por isso criou seu próprio laboratório com kit autônomo e linha de produção de protótipos, onde passa grande parte de seu tempo livre.

Nitin Eusébio See More é arquiteto sênior de soluções corporativas na AWS com experiência em engenharia de software, arquitetura corporativa e IA/ML. Ele trabalha com os clientes para ajudá-los a criar aplicativos bem arquitetados na plataforma AWS. Ele é apaixonado por resolver desafios tecnológicos e ajudar os clientes em sua jornada para a nuvem.

Nitin Eusébio See More é arquiteto sênior de soluções corporativas na AWS com experiência em engenharia de software, arquitetura corporativa e IA/ML. Ele trabalha com os clientes para ajudá-los a criar aplicativos bem arquitetados na plataforma AWS. Ele é apaixonado por resolver desafios tecnológicos e ajudar os clientes em sua jornada para a nuvem.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Automotivo / EVs, Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- BlockOffsets. Modernizando a Propriedade de Compensação Ambiental. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/use-proprietary-foundation-models-from-amazon-sagemaker-jumpstart-in-amazon-sagemaker-studio/

- :tem

- :é

- :não

- :onde

- $UP

- 000

- 10

- 100

- 40

- 50

- 500

- 7

- 87

- a

- Capaz

- Sobre

- acima

- acelerar

- Acesso

- Conta

- precisão

- ações

- admin

- Depois de

- Agente

- AI

- AI / ML

- algoritmos

- Todos os Produtos

- permite

- já

- tb

- Amazon

- Amazon Sage Maker

- JumpStart do Amazon SageMaker

- Estúdio Amazon SageMaker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- e

- e infra-estrutura

- qualquer

- mais

- APIs

- aparece

- aparelhos

- aplicações

- apropriado

- arquitetura

- SOMOS

- por aí

- artigo

- artigos

- artificial

- inteligência artificial

- Inteligência Artificial e Aprendizado de Máquinas

- AS

- Assistência

- assistentes

- At

- Automatizado

- disponível

- evitar

- AWS

- Mercado da AWS

- baseado

- BE

- Porque

- sido

- antes

- ser

- MELHOR

- bilhão

- bilhões

- Blog

- corpo

- construir

- construído

- negócio

- Aplicações de Negócio

- negócios

- mas a

- by

- CAN

- capturar

- capturados

- cartão

- Cartões

- Cuidado

- casas

- Células

- desafios

- caracteres

- carregada

- acusações

- chatbots

- Escolha

- escolha

- Na nuvem

- códigos

- computador

- Visão de Computador

- consistente

- cônsul

- consumidor

- Produtos de consumo

- Contacto

- não contenho

- contém

- ao controle

- copywriting

- Correspondente

- custos

- coberto

- crio

- criado

- Criar

- cliente

- Clientes

- personalização

- dados,

- cientista de dados

- dedicado

- profundo

- Dependendo

- implantar

- Implantação

- desenvolvimento

- descrição

- detalhe

- detalhes

- desenvolvido

- Desenvolvimento

- Distribuição

- diretamente

- Desconto

- descobrir

- exibido

- Não faz

- não

- facilmente

- fácil

- borda

- esforços

- permitir

- Ponto final

- Engenharia

- Empreendimento

- empresas

- entidade

- Meio Ambiente

- etc.

- avaliar

- exemplo

- exemplos

- vasta experiência

- explorar

- Rosto

- poucos

- Primeiro nome

- concentra-se

- seguir

- seguido

- seguinte

- Escolha

- Foundation

- Gratuito

- da

- funcionalidade

- gerar

- gerado

- gerando

- geração

- generativo

- IA generativa

- ter

- obtendo

- dado

- Go

- manipular

- Ter

- he

- ajudar

- ajuda

- ajuda

- sua experiência

- alta qualidade

- Como funciona o dobrador de carta de canal

- Como Negociar

- HTML

- HTTPS

- Hub

- idéias

- identificar

- if

- imagem

- importar

- importante

- importador

- impressionante

- in

- Incluindo

- INFORMAÇÕES

- Infraestrutura

- entrada

- inputs

- instalar

- instalando

- instância

- instruções

- integrado

- Inteligência

- para dentro

- isolado

- IT

- ESTÁ

- Trabalho

- viagem

- jpg

- Chave

- laboratório

- Laboratório

- aterrissagem

- língua

- em grande escala

- mais tarde

- APRENDER

- aprendizagem

- Permite

- Nível

- bibliotecas

- Biblioteca

- como

- LIMITE

- Line

- Lista

- Listado

- listagem

- carregar

- longo

- olhar

- lote

- diminuir

- máquina

- aprendizado de máquina

- fazer

- FAZ

- Fazendo

- de grupos

- Gerente

- fabrica

- muitos

- mapeamento

- marketplace

- Posso..

- ML

- Moda

- modelo

- modelos

- Monitore

- mais

- a maioria

- nome

- Nomeado

- natural

- Processamento de linguagem natural

- necessário

- você merece...

- Cria

- rede

- notícias

- Próximo

- caderno

- número

- numeroso

- of

- on

- uma vez

- aberto

- or

- organização

- Outros

- Fora

- saída

- alcance

- Acima de

- Visão geral

- próprio

- pacote

- página

- parâmetros

- apaixonado

- Realizar

- atuação

- realizada

- executa

- permissões

- plataforma

- platão

- Inteligência de Dados Platão

- PlatãoData

- ponto

- Popular

- Portal

- Publique

- poderoso

- pré-requisitos

- apresentado

- anterior

- preços

- Prévio

- prossegue

- em processamento

- aquisição

- Produto

- gerente de produto

- Produção

- Produtos

- projetos

- proprietário

- protótipo

- fornecer

- fornecido

- provedor

- fornecedores

- fornece

- publicamente

- publicado

- Python

- qualidade

- Frequentes

- alcance

- alcançar

- Reagir

- Leia

- Modo somente leitura

- em tempo real

- reconhecimento

- em relação a

- região

- regiões

- relacionado

- permanecem

- solicitar

- requerer

- requeridos

- Recursos

- rever

- papéis

- grosseiramente

- Execute

- corrida

- SA

- sábio

- Inferência do SageMaker

- mesmo

- Cientista

- Scripts

- Sdk

- Seção

- Vejo

- selecionado

- selecionando

- autodirrigação

- serviço

- Serviços

- Sessão

- conjunto

- Partilhar

- ela

- Baixo

- rede de apoio social

- mostrar

- mostrou

- mostrando

- Shows

- semelhante

- simplificar

- simplesmente

- solteiro

- smart

- So

- Software

- Engenharia de software

- Soluções

- RESOLVER

- Resolvendo

- alguns

- Alguém

- fonte

- Fontes

- especialista

- específico

- estável

- começo

- começado

- Passos

- Ainda

- estudo

- Inscreva-se

- tudo incluso

- tal

- resumir

- RESUMO

- ajuda

- Suportado

- .

- TAG

- Tire

- tomado

- tarefas

- Ensino

- Profissionais

- Tecnologia

- condições

- testado

- ensaio

- que

- A

- as informações

- A fonte

- deles

- Eles

- então

- assim sendo

- Este

- deles

- isto

- aqueles

- Através da

- tempo

- para

- tópico

- Trem

- treinado

- Training

- tentar

- dois

- tipo

- tipos

- ui

- para

- compreender

- URL

- utilizável

- Uso

- usar

- caso de uso

- usava

- usuários

- usos

- utilização

- vário

- versão

- via

- Vídeo

- Ver

- visão

- voz

- volume

- foi

- we

- web

- serviços web

- Web-Based

- peso

- BEM

- qual

- enquanto

- Largo

- Ampla variedade

- Wikipedia

- precisarão

- de

- palavras

- trabalho

- Vocês

- investimentos

- zefirnet