Os editores digitais estão continuamente procurando maneiras de simplificar e automatizar seus fluxos de trabalho de mídia para gerar e publicar novos conteúdos o mais rápido possível.

Muitos editores têm uma grande biblioteca de imagens que usam para seus artigos. Essas imagens podem ser reutilizadas muitas vezes para diferentes histórias, especialmente quando o editor tem imagens de celebridades. Muitas vezes, um jornalista pode precisar cortar uma celebridade desejada de uma imagem para usar em sua próxima história. Esta é uma tarefa manual e repetitiva que deve ser automatizada. Às vezes, um autor pode querer usar a imagem de uma celebridade, mas contém duas pessoas e a celebridade principal precisa ser cortada da imagem. Outras vezes, as imagens de celebridades podem precisar ser reformatadas para publicação em uma variedade de plataformas, como celular, mídia social ou notícias digitais. Além disso, um autor pode precisar alterar a proporção da imagem ou colocar a celebridade em foco nítido.

Neste post, mostramos como usar Reconhecimento da Amazônia para realizar a análise de imagem. O Amazon Rekognition facilita a adição desse recurso aos seus aplicativos sem qualquer experiência em aprendizado de máquina (ML) e vem com várias APIs para atender a casos de uso, como detecção de objetos, moderação de conteúdo, detecção e análise de face e reconhecimento de texto e celebridade, que nós usar neste exemplo.

A recurso de reconhecimento de celebridades in Reconhecimento da Amazônia reconhece automaticamente dezenas de milhares de personalidades conhecidas em imagens e vídeos usando ML. O reconhecimento de celebridade pode detectar não apenas a presença da celebridade em questão, mas também a localização dentro da imagem.

Visão geral da solução

Neste post, demonstramos como podemos passar uma foto, um nome de celebridade e uma proporção da imagem de saída para poder gerar uma imagem recortada da celebridade em questão capturando seu rosto no centro.

Ao trabalhar com o API de detecção de celebridades do Amazon Rekognition, muitos elementos são retornados na resposta. A seguir estão alguns elementos-chave de resposta:

- Match Confidence – Uma pontuação de confiança de correspondência que pode ser usada para controlar o comportamento da API. Recomendamos aplicar um limite adequado a essa pontuação em sua aplicação para escolher seu ponto de operação preferido. Por exemplo, ao definir um limite de 99%, você pode eliminar falsos positivos, mas pode perder algumas possíveis correspondências.

- Nome, ID e URLs – O nome da celebridade, um ID exclusivo do Amazon Rekognition e uma lista de URLs, como o IMDb da celebridade ou o link da Wikipedia para obter mais informações.

- Caixa Delimitadora – Coordenadas da localização da caixa delimitadora retangular para cada rosto de celebridade reconhecido.

- Sexo Conhecido – Identidade de gênero conhecida para cada celebridade reconhecida.

- Emoções – Emoção expressa no rosto da celebridade, por exemplo, feliz, triste ou com raiva.

- pose – Pose do rosto da celebridade, usando três eixos de rolagem, inclinação e guinada.

- Sorrir – Se a celebridade está sorrindo ou não.

Parte da resposta da API do Amazon Rekognition inclui o seguinte código:

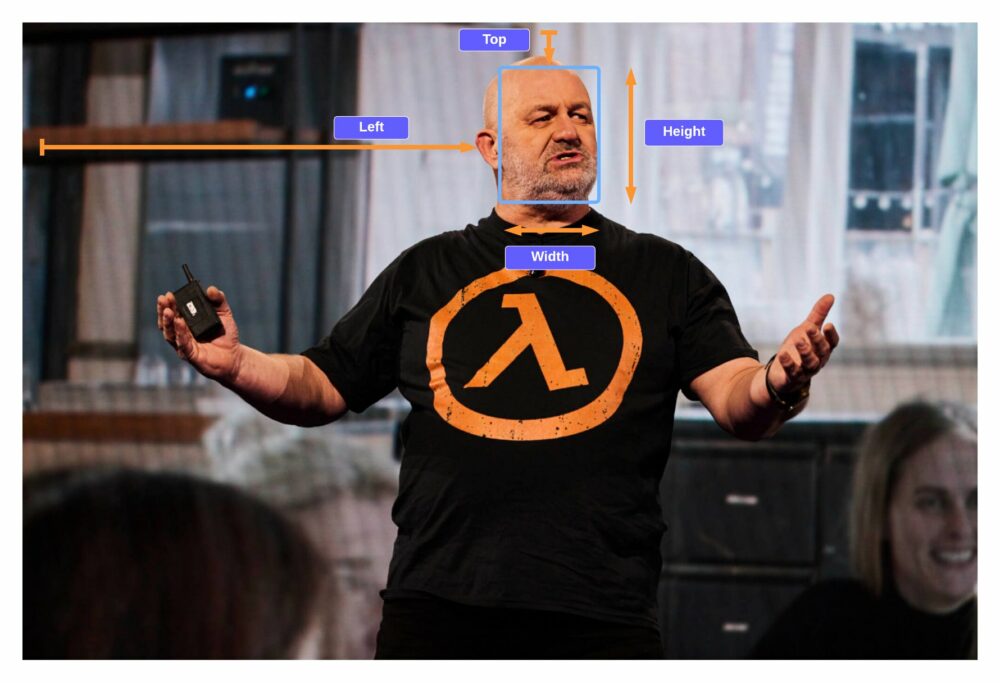

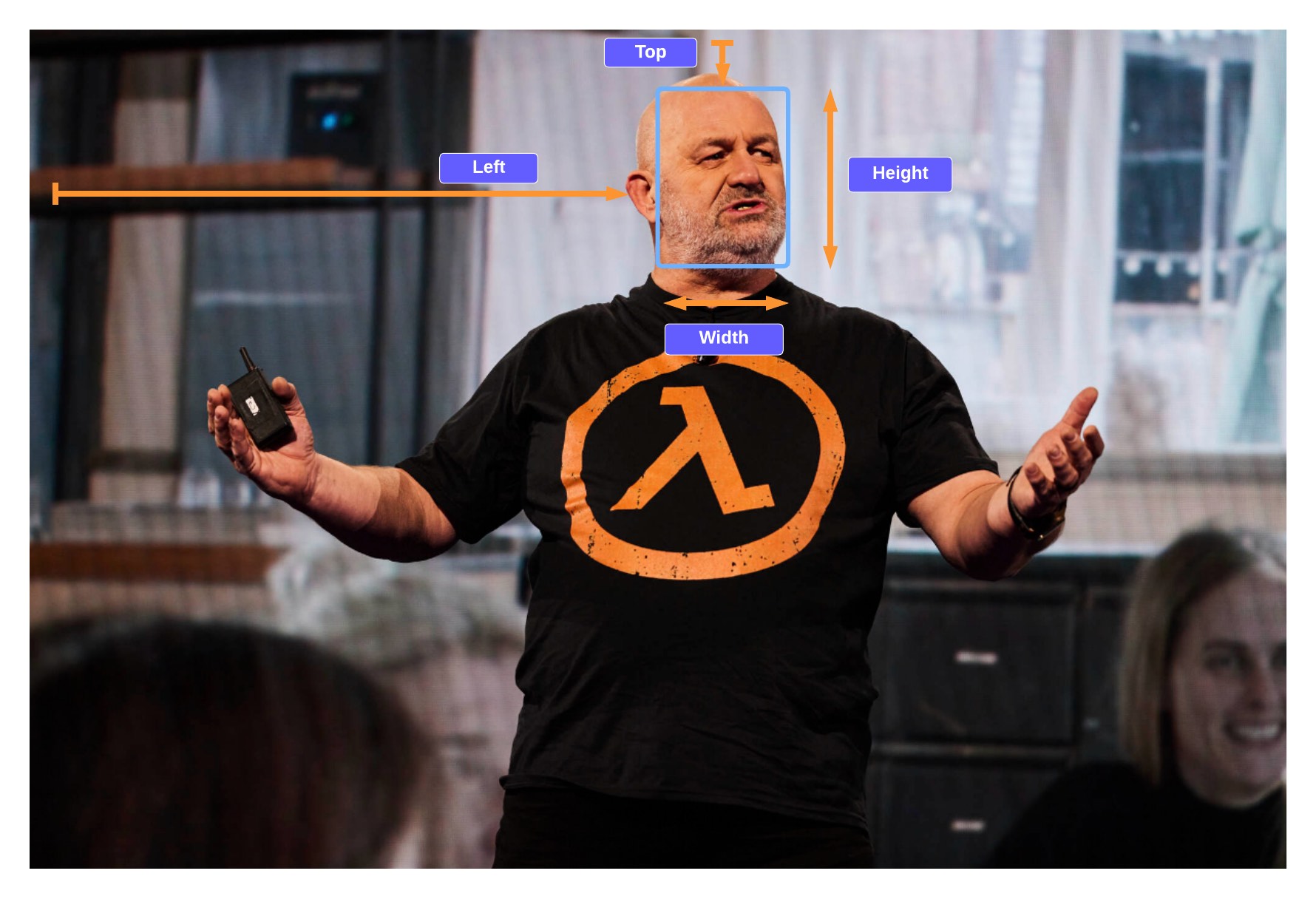

Neste exercício, demonstramos como usar o elemento de caixa delimitadora para identificar a localização da face, conforme mostrado na imagem de exemplo a seguir. Todas as dimensões são representadas como proporções do tamanho geral da imagem, portanto, os números na resposta estão entre 0–1. Por exemplo, no exemplo de resposta da API, a largura da caixa delimitadora é 0.1, o que implica que a largura da face é 10% da largura total da imagem.

Com essa caixa delimitadora, agora podemos usar a lógica para garantir que o rosto permaneça dentro das bordas da nova imagem que criamos. Podemos aplicar algum preenchimento ao redor dessa caixa delimitadora para manter a face no centro.

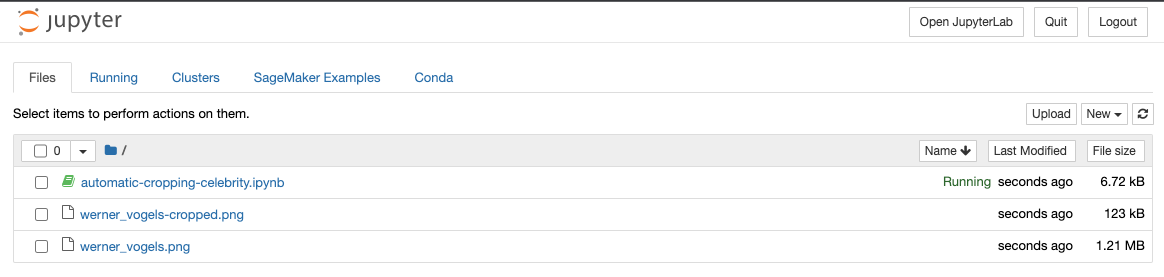

Nas seções a seguir, mostramos como criar a seguinte saída de imagem cortada com Werner Vogels em foco nítido.

Lançamos um Amazon Sage Maker notebook, que fornece um ambiente Python onde você pode executar o código para passar uma imagem para o Amazon Rekognition e modificar automaticamente a imagem com a celebridade em foco.

O código executa as seguintes etapas de alto nível:

- Faça um pedido ao

recognize_celebritiesAPI com a imagem fornecida e o nome da celebridade. - Filtre a resposta para as informações da caixa delimitadora.

- Adicione um pouco de preenchimento à caixa delimitadora de forma que capturemos parte do plano de fundo.

Pré-requisitos

Para este passo a passo, você deve ter os seguintes pré-requisitos:

Carregue a imagem de amostra

Carregue sua amostra de imagem de celebridade em seu balde S3.

Execute o código

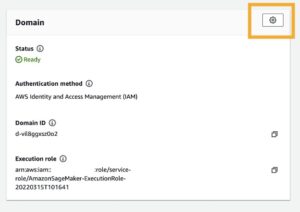

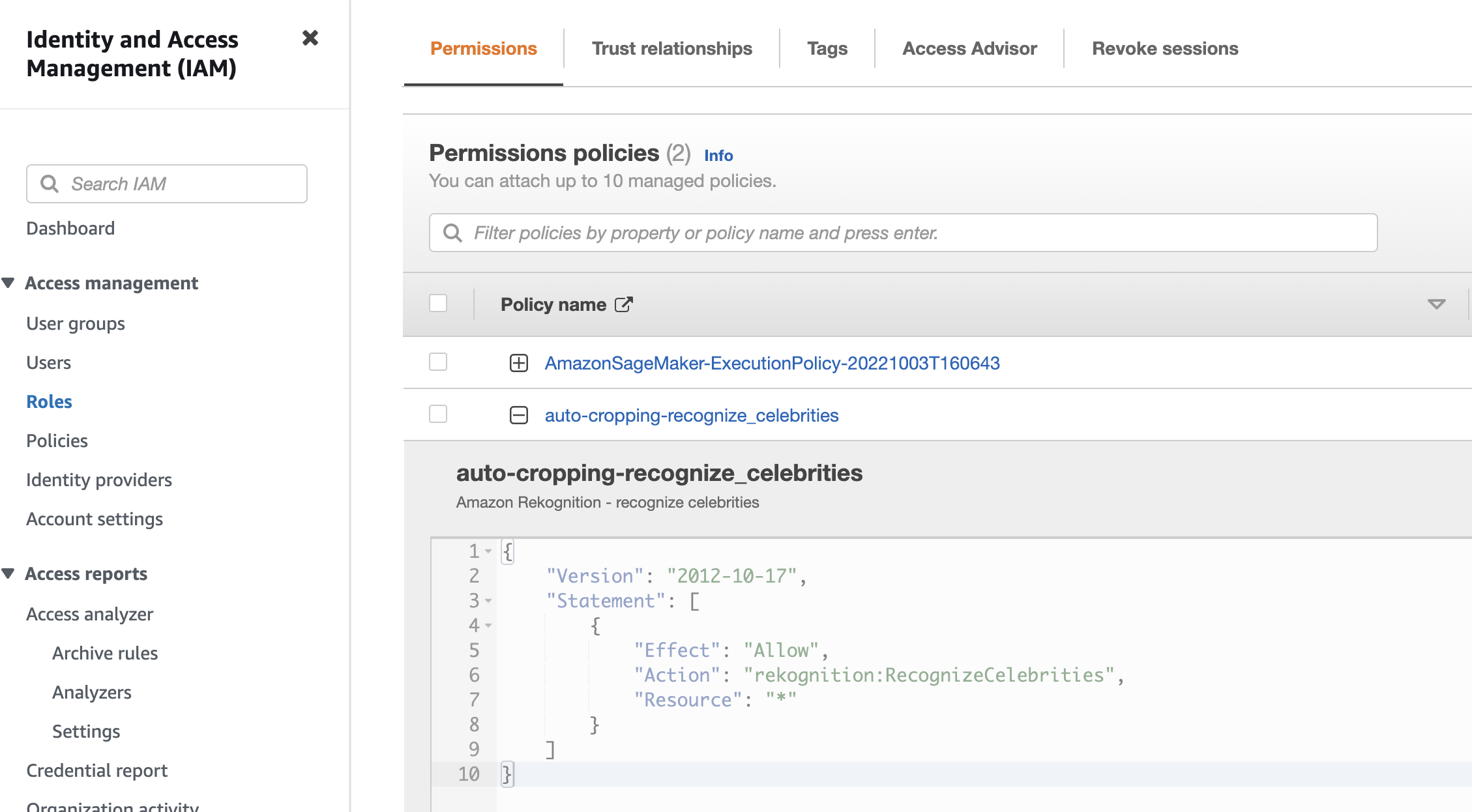

Para executar o código, usamos um notebook SageMaker, porém qualquer IDE também funcionaria após a instalação do Python, pillow e Boto3. Criamos um notebook SageMaker, bem como o Gerenciamento de acesso e identidade da AWS (IAM) com as permissões necessárias. Conclua as seguintes etapas:

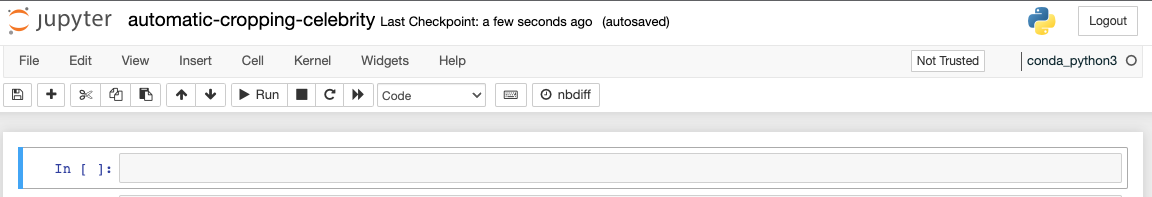

- Criar o bloco de notas e nomeie

automatic-cropping-celebrity.

A política de execução padrão, que foi criada durante a criação do notebook SageMaker, tem uma política simples que concede à função permissões para interagir com o Amazon S3.

- Atualize o

Resourcerestrição com o nome do bucket S3:

- Crie outra política para adicionar à função IAM do notebook SageMaker para poder chamar o Reconhecer Celebridades API:

- No console SageMaker, escolha Instâncias de notebook no painel de navegação.

- Localize o

automatic-cropping-celebritycaderno e escolha Abra o Jupyter. - Escolha Novo e conda_python3 como o kernel do seu notebook.

Para as etapas a seguir, copie os blocos de código em seu notebook Jupyter e execute-os escolhendo Execute.

- Primeiro, importamos funções auxiliares e bibliotecas:

- Definir variáveis

- Criar um cliente de serviço

- Função para reconhecer as celebridades

- Função para obter a caixa delimitadora da celebridade fornecida:

- Função para adicionar algum preenchimento à caixa delimitadora, para que possamos capturar algum plano de fundo ao redor do rosto

- Função para salvar a imagem no armazenamento do notebook e no Amazon S3

- Use o Python

main()função para combinar as funções anteriores para concluir o fluxo de trabalho de salvar uma nova imagem recortada de nossa celebridade:

Ao executar esse bloco de código, você pode ver que encontramos Werner Vogels e criamos uma nova imagem com o rosto dele no centro.

A imagem será salva no notebook e também carregada no bucket S3.

Você pode incluir esta solução em um fluxo de trabalho maior; por exemplo, uma editora pode querer publicar esse recurso como um terminal para reformatar e redimensionar imagens em tempo real ao publicar artigos de celebridades em várias plataformas.

Limpando

Para evitar incorrer em cobranças futuras, exclua os recursos:

- No console do SageMaker, selecione seu notebook e no Opções menu, escolha Dê um basta.

- Depois que o notebook é parado, no Opções menu, escolha Apagar.

- No console do IAM, exclua a função de execução do SageMaker que você criou.

- No console do Amazon S3, exclua a imagem de entrada e todos os arquivos de saída do seu bucket do S3.

Conclusão

Nesta postagem, mostramos como podemos usar o Amazon Rekognition para automatizar uma tarefa manual de modificação de imagens para dar suporte a fluxos de trabalho de mídia. Isso é particularmente importante na indústria editorial, onde a velocidade é importante para obter novos conteúdos rapidamente e para várias plataformas.

Para obter mais informações sobre como trabalhar com ativos de mídia, consulte A inteligência de mídia ficou mais inteligente com o Media2Cloud 3.0

Sobre o autor

Marcos Watkins é arquiteto de soluções da equipe de mídia e entretenimento. Ele ajuda os clientes a criar soluções de IA/ML que resolvem seus desafios de negócios usando a AWS. Ele tem trabalhado em vários projetos de IA/ML relacionados à visão computacional, processamento de linguagem natural, personalização, ML na borda e muito mais. Longe da vida profissional, adora estar com a família e acompanhar o crescimento dos seus dois filhos.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- Platoblockchain. Inteligência Metaverso Web3. Conhecimento Ampliado. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/automatic-image-cropping-with-amazon-rekognition/

- :é

- $UP

- 1

- 10

- 100

- 11

- 7

- 8

- 9

- a

- Capaz

- Sobre

- Acesso

- Açao Social

- Adicionalmente

- Depois de

- AI / ML

- Todos os Produtos

- Amazon

- Reconhecimento da Amazônia

- análise

- e

- Outro

- api

- APIs

- Aplicação

- aplicações

- Aplicar

- Aplicando

- SOMOS

- por aí

- artigos

- AS

- aspecto

- Ativos

- At

- autor

- automatizar

- Automatizado

- Automático

- automaticamente

- AWS

- MACHADOS

- fundo

- BE

- entre

- Bloquear

- Blocos

- Caixa

- caixas

- negócio

- by

- chamada

- CAN

- capturar

- Capturar

- casos

- Celeb

- celebridades

- Celebridade

- Centralização de

- desafios

- alterar

- acusações

- Escolha

- escolha

- código

- combinar

- Empresa

- completar

- computador

- Visão de Computador

- confiança

- cônsul

- contém

- conteúdo

- continuamente

- ao controle

- poderia

- crio

- criado

- Criar

- colheita

- Clientes

- Padrão

- demonstrar

- desejado

- detectou

- Detecção

- diferente

- digital

- dimensões

- Ecrã

- download

- e

- cada

- borda

- efeito

- elemento

- elementos

- eliminado

- Ponto final

- Entretenimento

- Meio Ambiente

- especialmente

- exemplo

- execução

- Exercício

- experiência

- expressa

- Rosto

- rostos

- família

- famoso

- Envie o

- Arquivos

- Foco

- seguinte

- Escolha

- formato

- encontrado

- recentes

- da

- função

- funções

- mais distante

- futuro

- Gênero

- gerar

- ter

- obtendo

- dado

- dá

- Crescente

- feliz

- Ter

- altura

- ajuda

- de alto nível

- Como funciona o dobrador de carta de canal

- Como Negociar

- Contudo

- HTML

- http

- HTTPS

- ID

- identificar

- Identidade

- imagem

- imagens

- importar

- importante

- in

- incluir

- inclui

- indústria

- INFORMAÇÕES

- entrada

- instalando

- Inteligência

- interagir

- IT

- jornalista

- jpg

- Guarda

- Chave

- conhecido

- língua

- grande

- lançamento

- aprendizagem

- bibliotecas

- Biblioteca

- vida

- como

- LINK

- Lista

- pequeno

- local

- localização

- procurando

- máquina

- aprendizado de máquina

- fazer

- FAZ

- manual

- muitos

- Match

- Matéria

- Mídia

- Menu

- poder

- ML

- Móvel Esteira

- moderação

- modificar

- mais

- múltiplo

- nome

- natural

- Processamento de linguagem natural

- Navegação

- você merece...

- Cria

- Novo

- notícias

- caderno

- números

- objeto

- Detecção de Objetos

- of

- on

- operando

- ordem

- Outros

- de outra forma

- saída

- global

- pão

- particularmente

- caminho

- Pessoas

- Realizar

- executa

- permissões

- Personalidades

- Personalização

- Passo

- Plataformas

- platão

- Inteligência de Dados Platão

- PlatãoData

- ponto

- Privacidade

- Publique

- potencial

- preferido

- pré-requisitos

- presença

- primário

- em processamento

- profissional

- projetos

- fornece

- publicar

- editor

- editores

- Publishing

- colocar

- Python

- rapidamente

- aumentar

- rapidamente

- relação

- reconhecimento

- reconhecer

- reconhecido

- reconhece

- recomendar

- relacionado

- permanece

- repetitivo

- representado

- solicitar

- requeridos

- recurso

- Recursos

- resposta

- resultar

- Resultados

- retorno

- ROI

- Tipo

- Rolo

- Execute

- sábio

- Salvar

- poupança

- Ponto

- seções

- serviço

- contexto

- vários

- rede de apoio social

- mostrar

- mostrando

- simples

- Tamanho

- mais inteligente

- So

- Redes Sociais

- meios de comunicação social

- solução

- Soluções

- RESOLVER

- alguns

- velocidade

- Passar

- quadrado

- Declaração

- Passos

- estoque

- parou

- armazenamento

- Histórias

- História

- simplificar

- tal

- adequado

- ajuda

- Tarefa

- Profissionais

- que

- A

- deles

- Eles

- Este

- milhares

- três

- limiar

- tempo

- vezes

- para

- topo

- Total

- único

- os próximos

- carregado

- usar

- variedade

- vário

- versão

- VÍDEOS

- visão

- Passo a passo

- assistindo

- maneiras

- BEM

- bem conhecido

- se

- qual

- largura

- Wikipedia

- precisarão

- de

- dentro

- sem

- Atividades:

- fluxos de trabalho

- trabalhar

- seria

- Vocês

- investimentos

- zefirnet