Os chatbots modernos podem servir como agentes digitais, fornecendo um novo caminho para fornecer atendimento e suporte ao cliente 24 horas por dia, 7 dias por semana, em muitos setores. Sua popularidade decorre da capacidade de responder às consultas dos clientes em tempo real e lidar com diversas consultas simultaneamente em diferentes idiomas. Os chatbots também oferecem informações valiosas baseadas em dados sobre o comportamento do cliente, ao mesmo tempo em que se expandem sem esforço à medida que a base de usuários cresce; portanto, eles apresentam uma solução econômica para envolver os clientes. Os chatbots usam os recursos avançados de linguagem natural de grandes modelos de linguagem (LLMs) para responder às perguntas dos clientes. Eles podem compreender a linguagem coloquial e responder naturalmente. No entanto, os chatbots que apenas respondem a perguntas básicas têm utilidade limitada. Para se tornarem consultores confiáveis, os chatbots precisam fornecer respostas ponderadas e personalizadas.

Uma forma de permitir conversas mais contextuais é vincular o chatbot a bases de conhecimento internas e sistemas de informação. A integração de dados corporativos proprietários de bases de conhecimento internas permite que os chatbots contextualizem suas respostas às necessidades e interesses individuais de cada usuário. Por exemplo, um chatbot poderia sugerir produtos que correspondam às preferências e compras anteriores de um comprador, explicar detalhes em linguagem adaptada ao nível de conhecimento do usuário ou fornecer suporte à conta acessando registros específicos do cliente. A capacidade de incorporar informações de forma inteligente, compreender a linguagem natural e fornecer respostas personalizadas em um fluxo de conversação permite que os chatbots forneçam valor comercial real em diversos casos de uso.

O popular padrão de arquitetura de Geração Aumentada de Recuperação (RAG) é frequentemente usado para aumentar o contexto e as respostas da consulta do usuário. O RAG combina as capacidades dos LLMs com a base em fatos e conhecimento do mundo real que vem da recuperação de textos e passagens relevantes do corpus de dados. Esses textos recuperados são então usados para informar e fundamentar o resultado, reduzindo a alucinação e melhorando a relevância.

Nesta postagem, ilustramos o aprimoramento contextual de um chatbot usando Bases de conhecimento para Amazon Bedrock, um serviço sem servidor totalmente gerenciado. A integração das bases de conhecimento para Amazon Bedrock permite que nosso chatbot forneça respostas mais relevantes e personalizadas, vinculando as consultas dos usuários a pontos de dados de informações relacionados. Internamente, Rocha Amazônica usa embeddings armazenados em um banco de dados vetorial para aumentar o contexto de consulta do usuário em tempo de execução e permitir uma solução de arquitetura RAG gerenciada. Nós usamos o Cartas da Amazon aos acionistas conjunto de dados para desenvolver esta solução.

Geração Aumentada de Recuperação

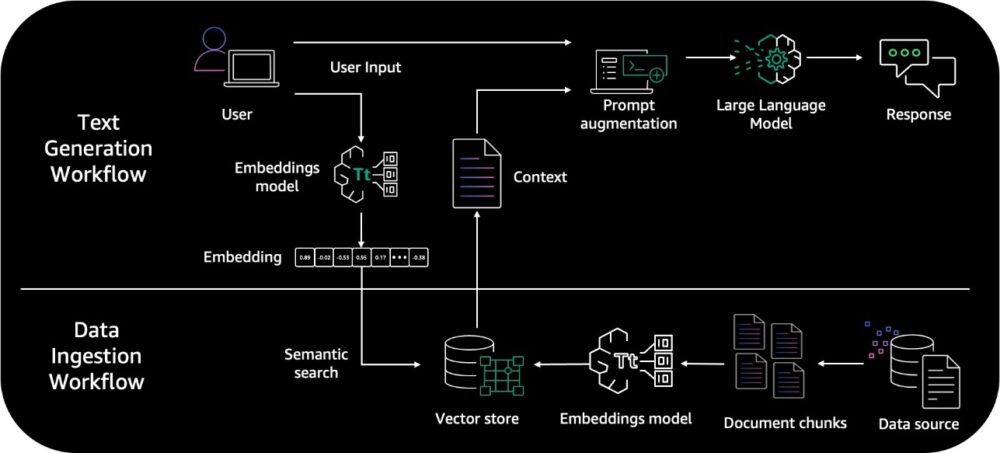

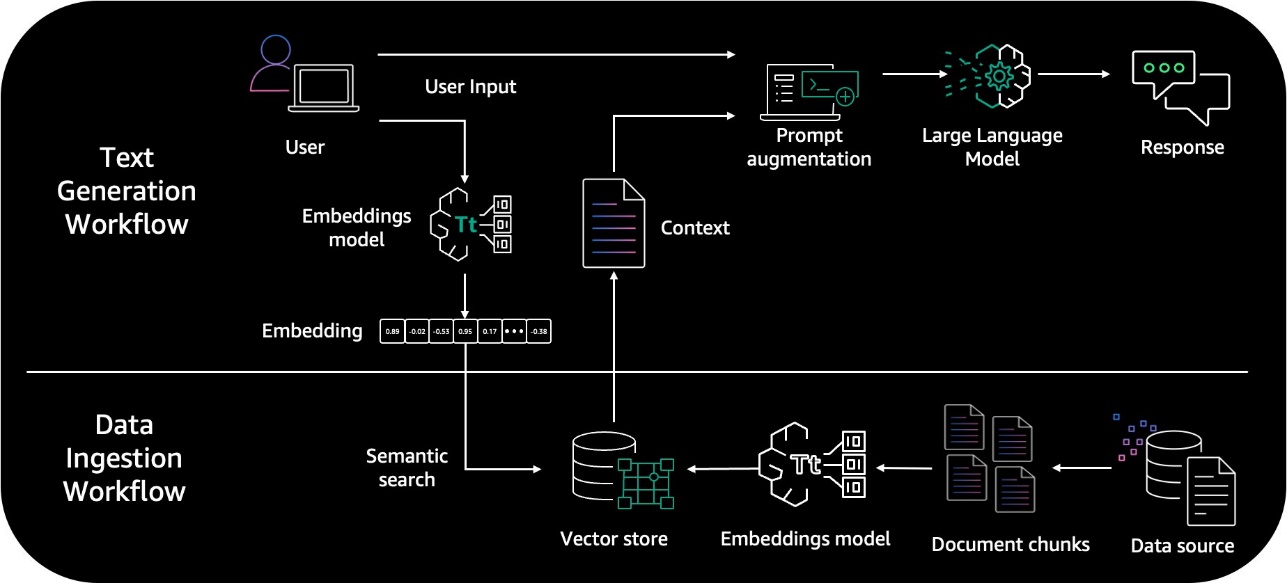

RAG é uma abordagem para geração de linguagem natural que incorpora a recuperação de informações no processo de geração. A arquitetura RAG envolve dois fluxos de trabalho principais: pré-processamento de dados por meio de ingestão e geração de texto usando contexto aprimorado.

O fluxo de trabalho de ingestão de dados usa LLMs para criar vetores de incorporação que representam o significado semântico dos textos. Os embeddings são criados para documentos e perguntas do usuário. Os embeddings de documentos são divididos em partes e armazenados como índices em um banco de dados vetorial. O fluxo de trabalho de geração de texto pega o vetor de incorporação de uma pergunta e o utiliza para recuperar os pedaços de documento mais semelhantes com base na similaridade do vetor. Ele aumenta os prompts com esses pedaços relevantes para gerar uma resposta usando o LLM. Para mais detalhes, consulte o Cartilha sobre geração aumentada de recuperação, incorporações e bancos de dados de vetores seção em Pré-visualização – Conecte modelos básicos às fontes de dados da sua empresa com agentes do Amazon Bedrock.

O diagrama a seguir ilustra a arquitetura RAG de alto nível.

Embora a arquitetura RAG tenha muitas vantagens, ela envolve vários componentes, incluindo banco de dados, mecanismo de recuperação, prompt e modelo generativo. O gerenciamento dessas partes interdependentes pode introduzir complexidades no desenvolvimento e na implantação do sistema. A integração de recuperação e geração também requer esforço adicional de engenharia e recursos computacionais. Algumas bibliotecas de código aberto fornecem wrappers para reduzir essa sobrecarga; entretanto, alterações nas bibliotecas podem introduzir erros e adicionar sobrecarga adicional de controle de versão. Mesmo com bibliotecas de código aberto, é necessário um esforço significativo para escrever código, determinar o tamanho ideal do bloco, gerar incorporações e muito mais. Somente esse trabalho de configuração pode levar semanas, dependendo do volume de dados.

Portanto, uma solução gerenciada que lide com essas tarefas indiferenciadas poderia agilizar e acelerar o processo de implementação e gerenciamento de aplicações RAG.

Bases de conhecimento para Amazon Bedrock

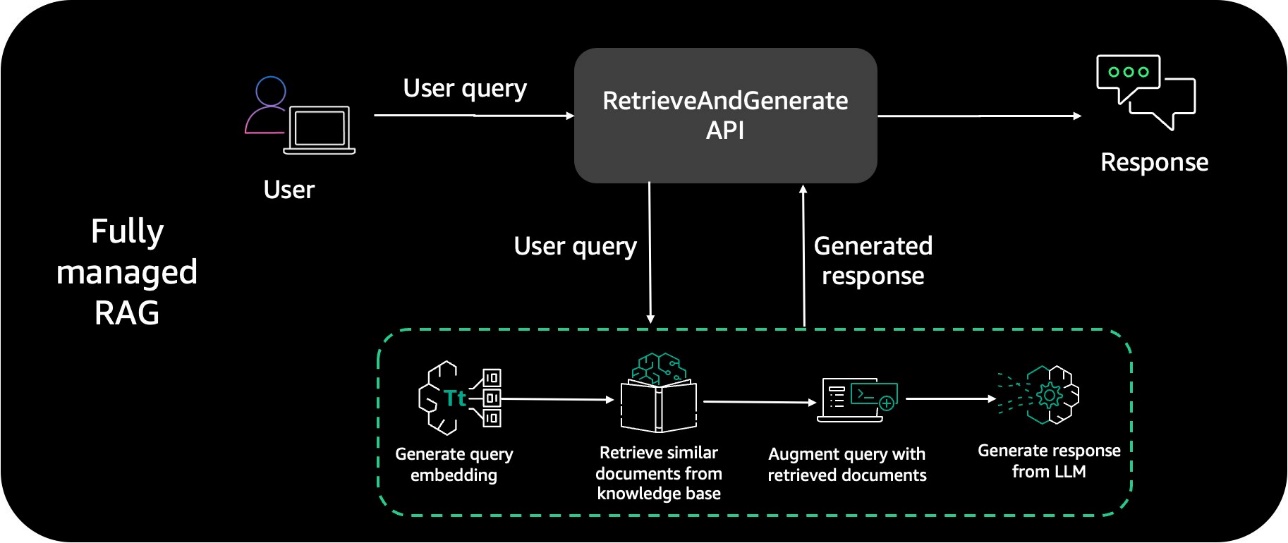

As bases de conhecimento do Amazon Bedrock são uma opção sem servidor para criar sistemas avançados de IA conversacional usando RAG. Ele oferece ingestão de dados totalmente gerenciada e fluxos de trabalho de geração de texto.

Para ingestão de dados, ele cria, armazena, gerencia e atualiza automaticamente incorporações de texto de dados de documentos no banco de dados vetorial. Ele divide os documentos em partes gerenciáveis para uma recuperação eficiente. Os pedaços são então convertidos em embeddings e gravados em um índice vetorial, permitindo que você veja os documentos de origem ao responder a uma pergunta.

Para geração de texto, o Amazon Bedrock fornece o Recuperar e gerar API para criar incorporações de consultas de usuários e recuperar partes relevantes do banco de dados vetorial para gerar respostas precisas. Ele também oferece suporte à atribuição de fonte e à memória de curto prazo necessária para aplicativos RAG.

Isso permite que você se concentre em seus principais aplicativos de negócios e elimina o trabalho pesado indiferenciado.

Visão geral da solução

A solução apresentada neste post utiliza um chatbot criado usando um Iluminado aplicativo e inclui os seguintes serviços da AWS:

O diagrama a seguir é um padrão de arquitetura de solução comum que você pode usar para integrar qualquer aplicativo chatbot às bases de conhecimento do Amazon Bedrock.

Essa arquitetura inclui as seguintes etapas:

- Um usuário interage com a interface do chatbot Streamlit e envia uma consulta em linguagem natural

- Isso aciona uma função Lambda, que invoca as Bases de Conhecimento

RetrieveAndGenerateAPI. Internamente, as Bases de Conhecimento usam um Titã Amazona modelo de incorporação e converte a consulta do usuário em um vetor e encontra pedaços que são semanticamente semelhantes à consulta do usuário. O prompt do usuário é então aumentado com os pedaços recuperados da base de conhecimento. O prompt junto com o contexto adicional é então enviado a um LLM para geração de resposta. Nesta solução usamos Antrópico Claude Instantâneo como nosso LLM para gerar respostas do usuário usando contexto adicional. Observe que esta solução é suportada em regiões onde o Anthropic Claude no Amazon Bedrock está disponível. - Uma resposta contextualmente relevante é enviada de volta ao aplicativo chatbot e ao usuário.

Pré-requisitos

Os usuários do Amazon Bedrock precisam solicitar acesso aos modelos básicos antes que eles estejam disponíveis para uso. Esta é uma ação única e leva menos de um minuto. Para esta solução, você precisará habilitar o acesso ao modelo Titan Embeddings G1 – Text e Claude Instant – v1.2 no Amazon Bedrock. Para obter mais informações, consulte Acesso ao modelo.

Clone o repositório GitHub

A solução apresentada neste post está disponível no seguinte GitHub repo. Você precisa clonar o repositório GitHub em sua máquina local. Abra uma janela de terminal e execute o seguinte comando. Observe que este é um único comando git clone.

Carregue seu conjunto de dados de conhecimento no Amazon S3

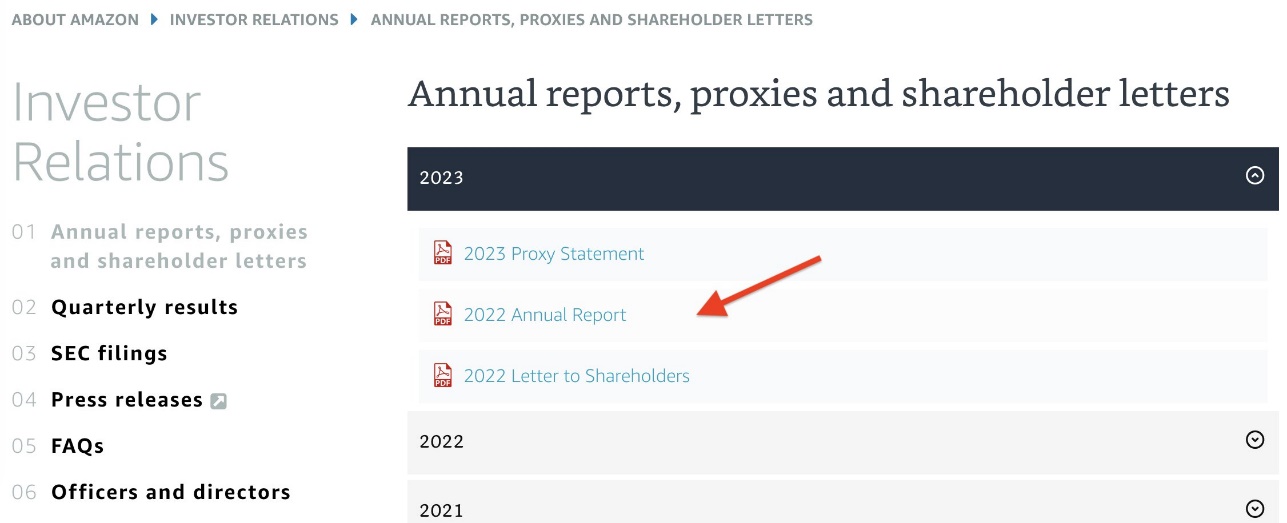

Baixamos o conjunto de dados para nossa base de conhecimento e o carregamos em um bucket S3. Este conjunto de dados alimentará e fortalecerá a base de conhecimento. Conclua as seguintes etapas:

- Navegue até a Relatórios anuais, procurações e cartas aos acionistas repositório de dados e baixe as cartas dos acionistas da Amazon dos últimos anos.

- No console do Amazon S3, escolha Baldes no painel de navegação.

- Escolha Criar balde.

- Dê um nome ao balde

knowledgebase-<your-awsaccount-number>. - Deixe todas as outras configurações de bucket como padrão e escolha Crie.

- Navegue até a

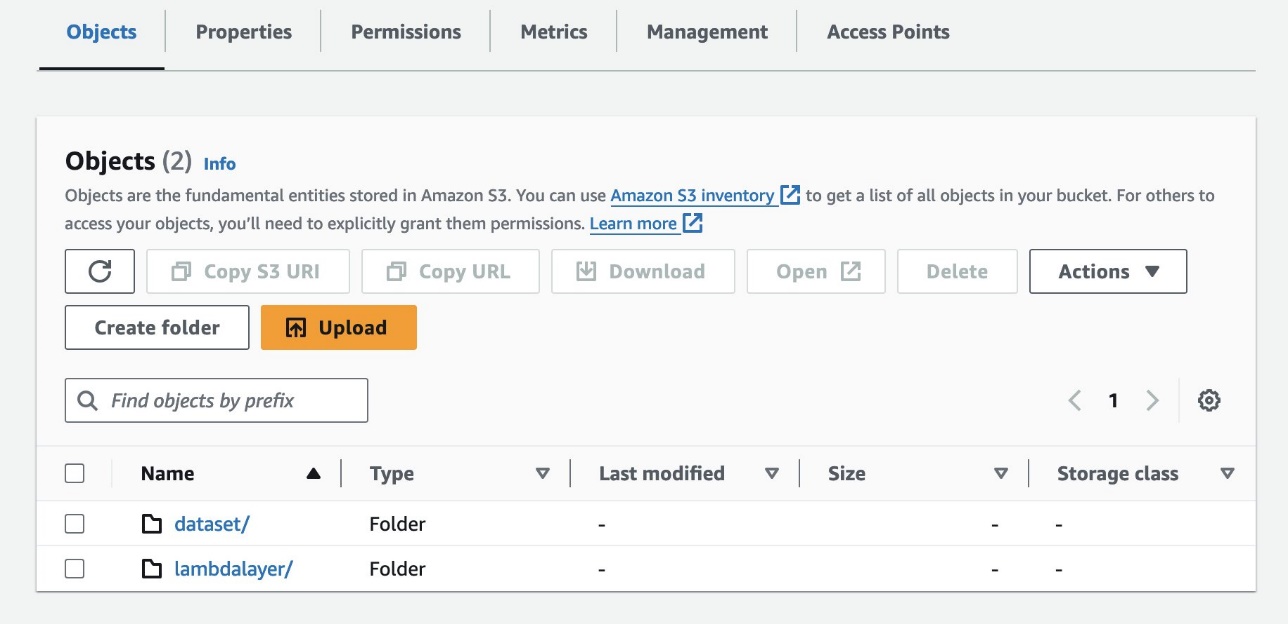

knowledgebase-<your-awsaccount-number>balde. - Escolha Criar pasta e nomeie-o como conjunto de dados.

- Deixe todas as outras configurações de pasta como padrão e escolha Crie.

- Navegue de volta para a página inicial do bucket e escolha Criar pasta para criar uma nova pasta e nomeá-la

lambdalayer. - Deixe todas as outras configurações como padrão e escolha Crie.

- Navegue até a

datasetpasta. - Faça upload dos arquivos do conjunto de dados de relatórios anuais, procurações e cartas aos acionistas que você baixou anteriormente para este intervalo e escolha Escolher arquivo.

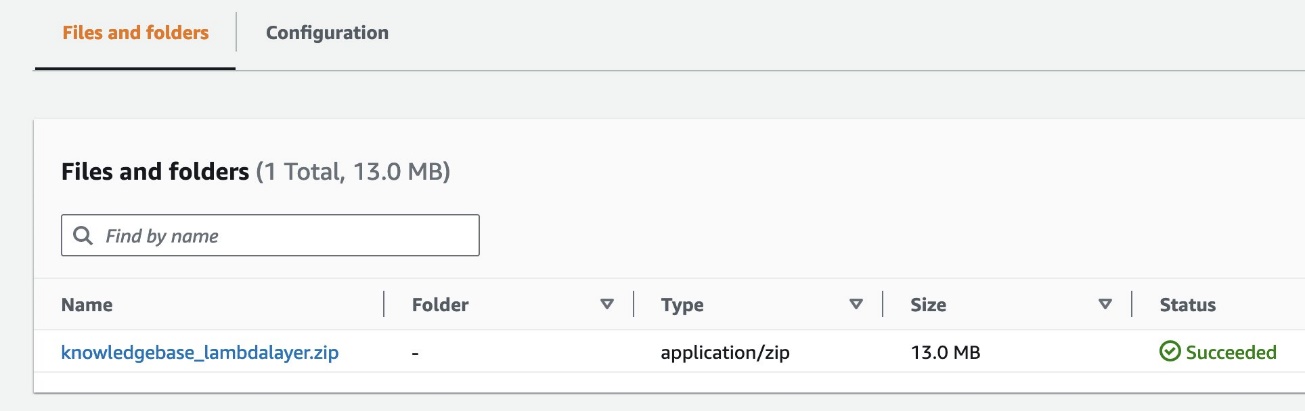

- Navegue até a

lambdalayerpasta. - Nos envie os

knowledgebase-lambdalayer.ziparquivo disponível no/lambda/layerpasta no repositório GitHub que você clonou anteriormente e escolha Escolher arquivo. Você usará esse código da camada Lambda posteriormente para criar a função Lambda.

Crie uma base de conhecimento

Nesta etapa, criamos uma base de conhecimento usando o conjunto de dados de cartas aos acionistas da Amazon que carregamos em nosso bucket S3 na etapa anterior.

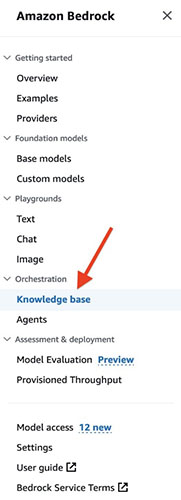

- No console Amazon Bedrock, em Orquestração no painel de navegação, escolha Base de conhecimento.

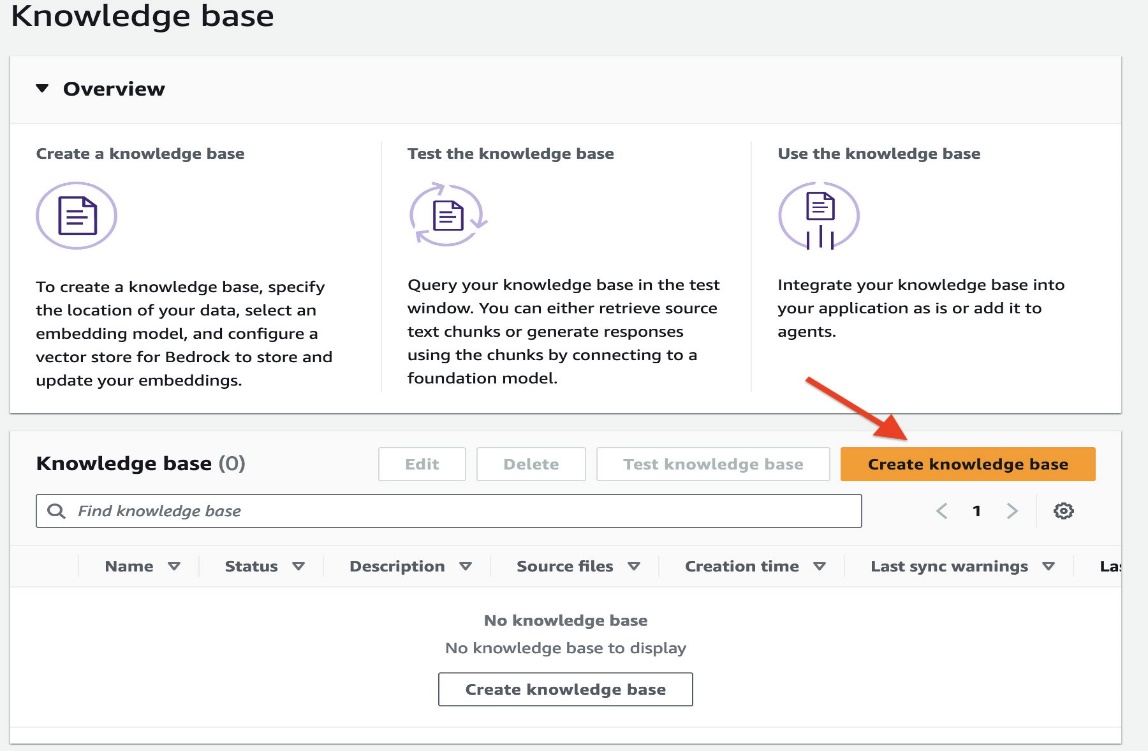

- Escolha Criar base de conhecimento.

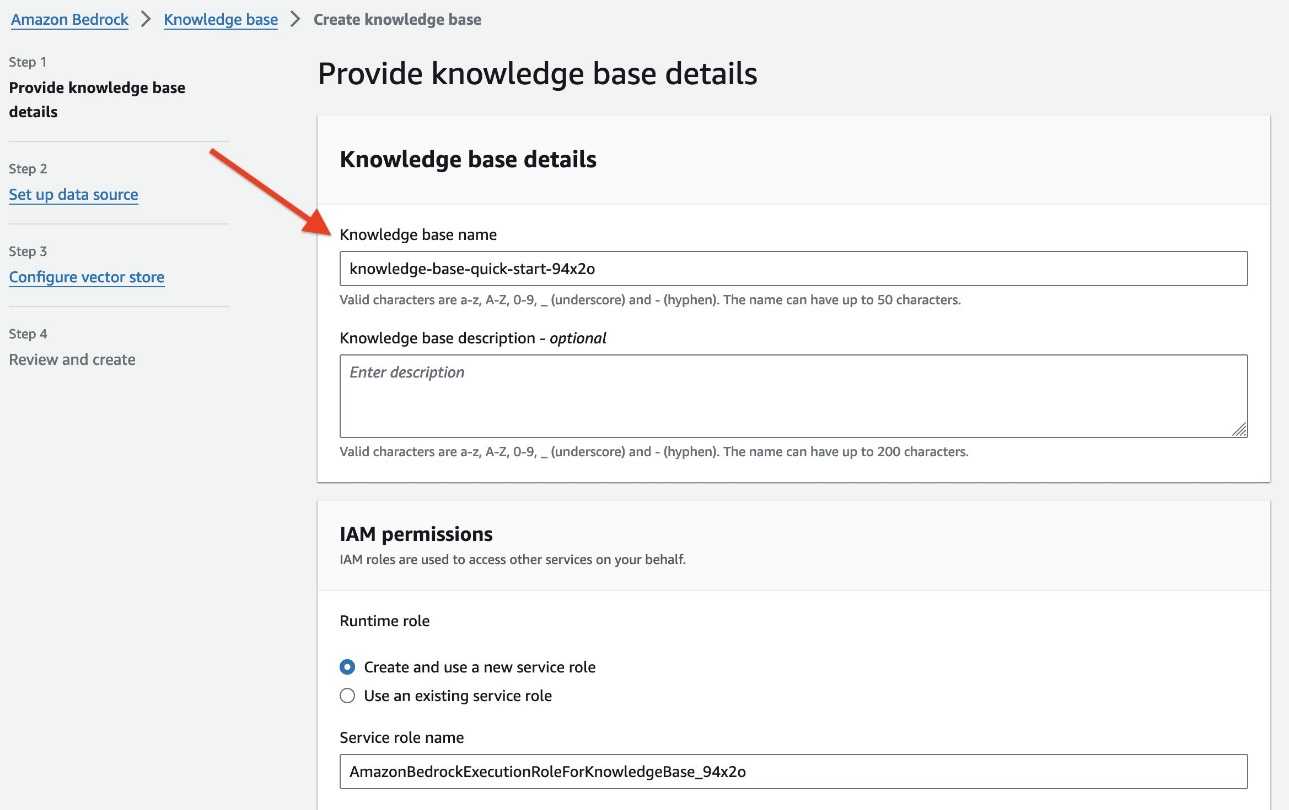

- No Detalhes da base de conhecimento seção, insira um nome e uma descrição opcional.

- No Permissões do IAM seção, selecione Criar e usar uma nova função de serviço e digite um nome para a função.

- Adicione tags conforme necessário.

- Escolha Próximo.

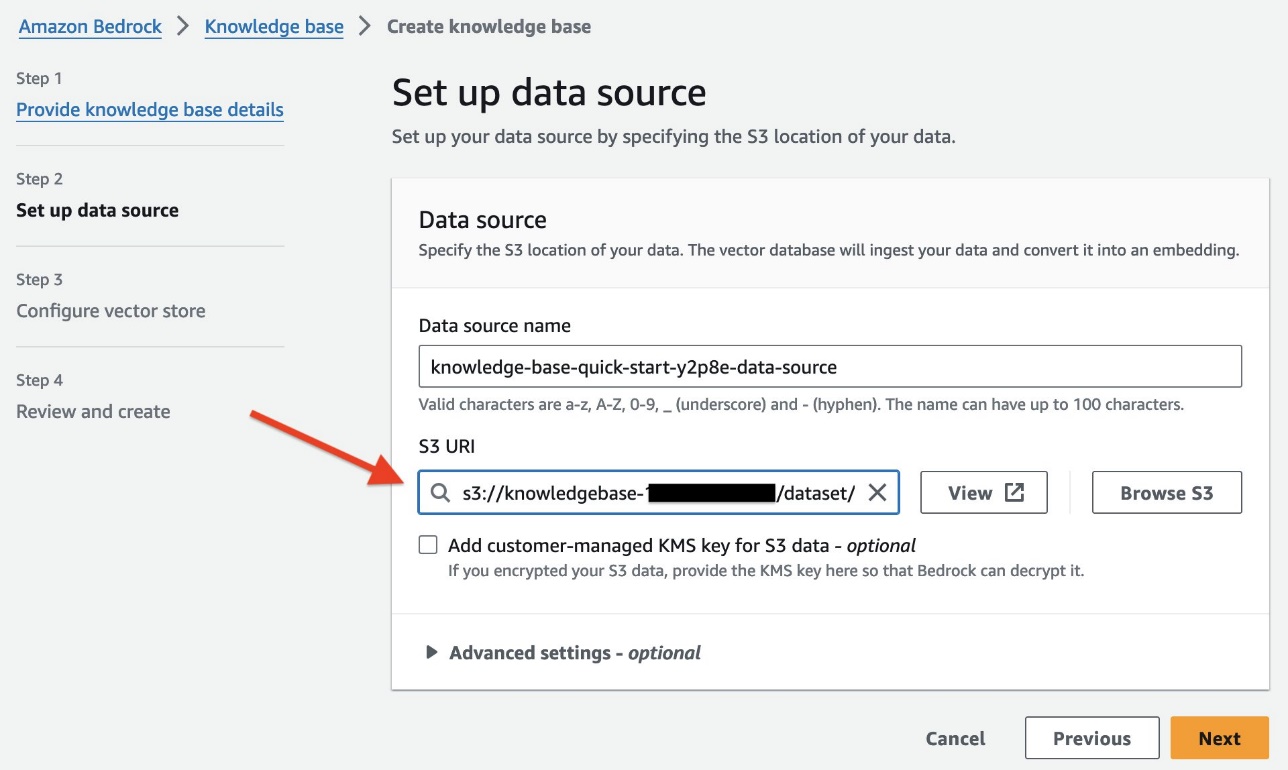

- Deixar Nome da fonte de dados como o nome padrão.

- Escolha URI S3, escolha Navegar S3 para escolher o balde S3

knowledgebase-<your-account-number>/dataset/.Você precisa apontar para o bucket e a pasta do conjunto de dados que criou nas etapas anteriores. - No Configurações avançadas seção, deixe os valores padrão (se desejar, você pode alterar a estratégia de agrupamento padrão e especificar o tamanho do bloco e a sobreposição em porcentagem).

- Escolha Próximo.

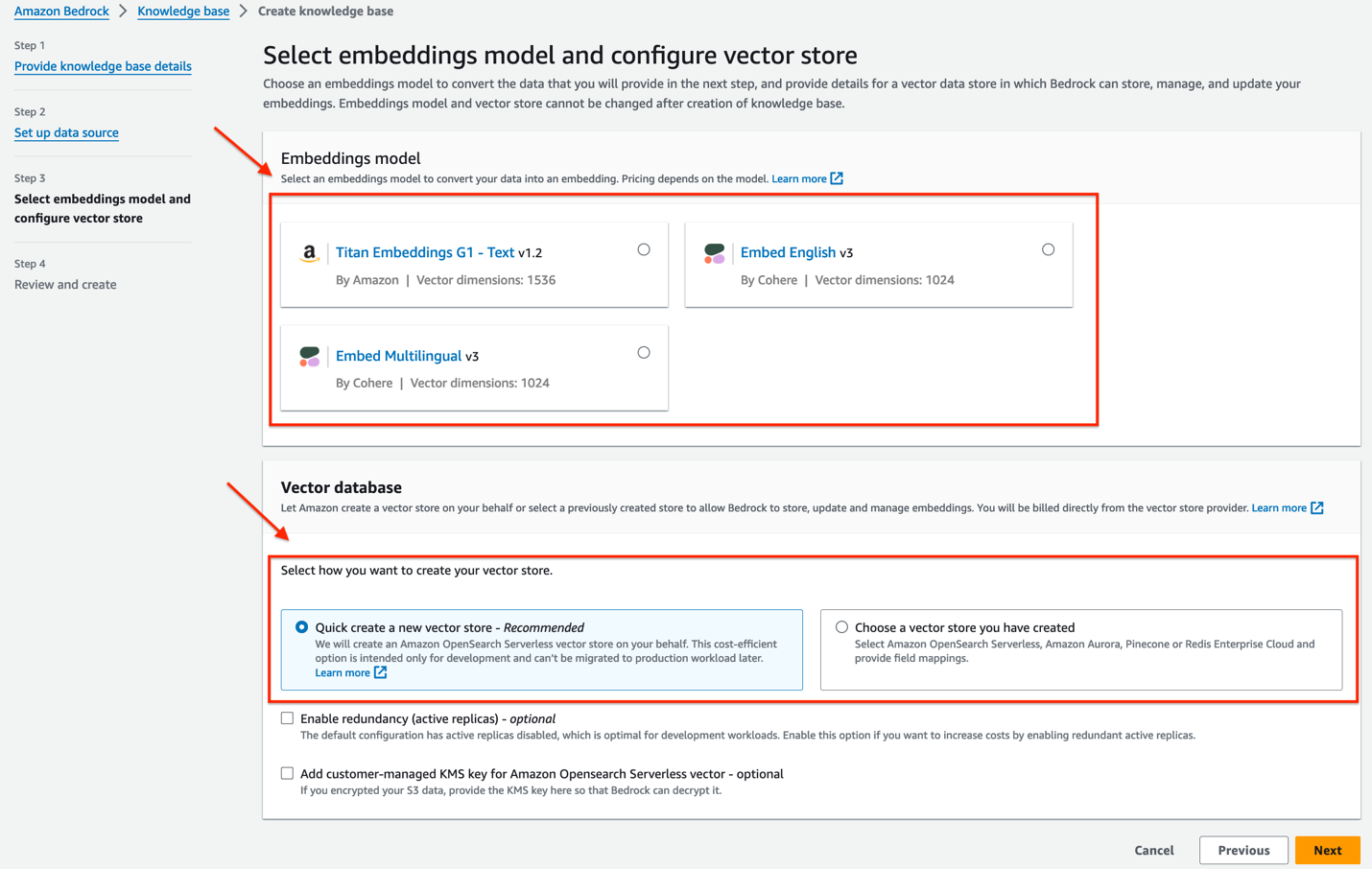

- Escolha Modelo de incorporações, selecione Titan Embedding G1 – Texto.

- Escolha Banco de dados de vetores, você pode selecionar Crie rapidamente um novo armazenamento de vetores or Escolha uma loja de vetores que você criou. Observe que, para usar o armazenamento de vetores de sua escolha, você precisa ter um armazenamento de vetores pré-configurado para uso. Atualmente, oferecemos suporte a quatro tipos de mecanismo vetorial: o mecanismo vetorial para Amazon OpenSearch Serverless, Amazon Aurora, Pinecone e Redis Enterprise Cloud. Para esta postagem, selecionamos Criação rápida de um novo armazenamento de vetores, que por padrão cria um novo armazenamento de vetores OpenSearch Serverless em sua conta.

- Escolha Próximo.

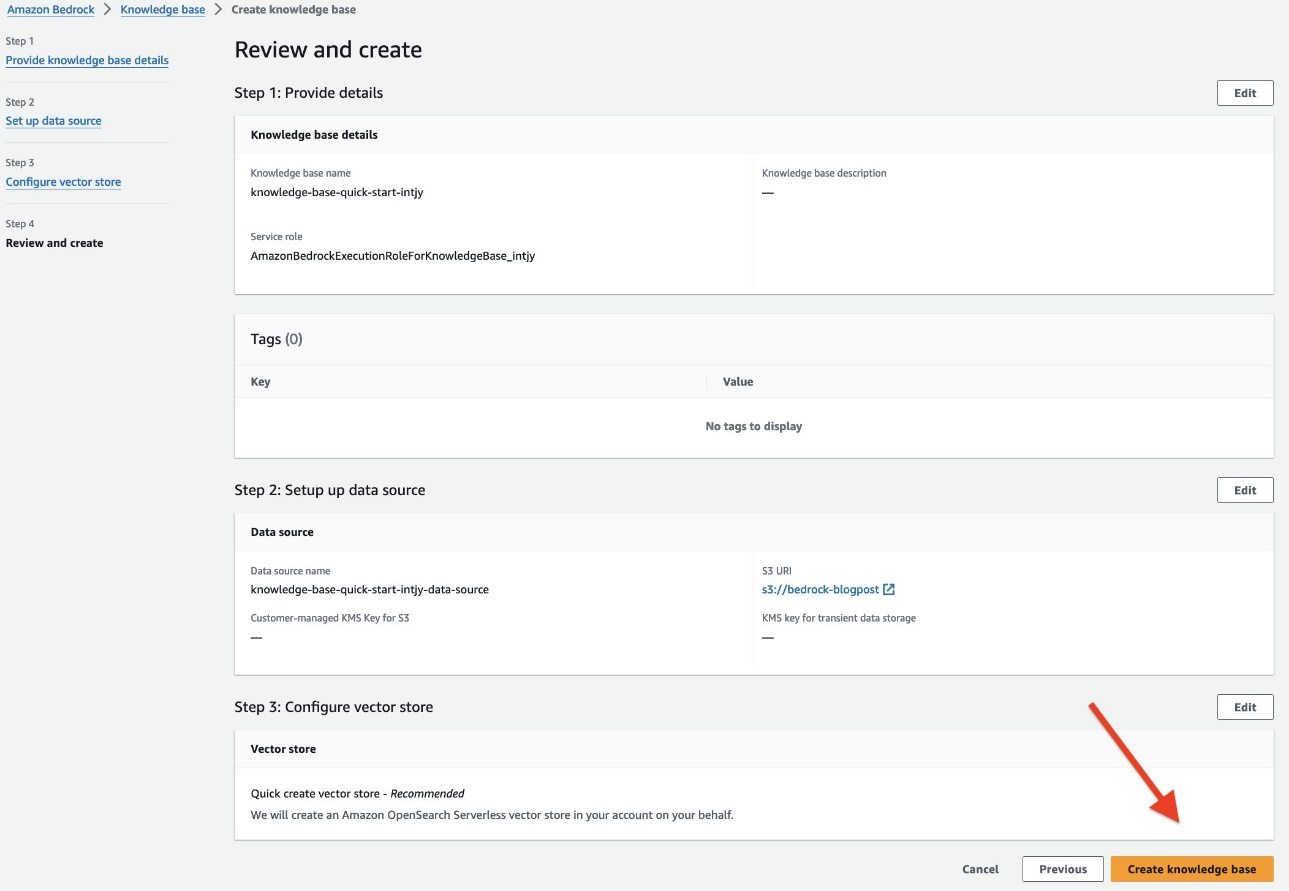

- No Revise e crie página, revise todas as informações ou escolha Anterior para modificar quaisquer opções.

- Escolha Criar base de conhecimento.

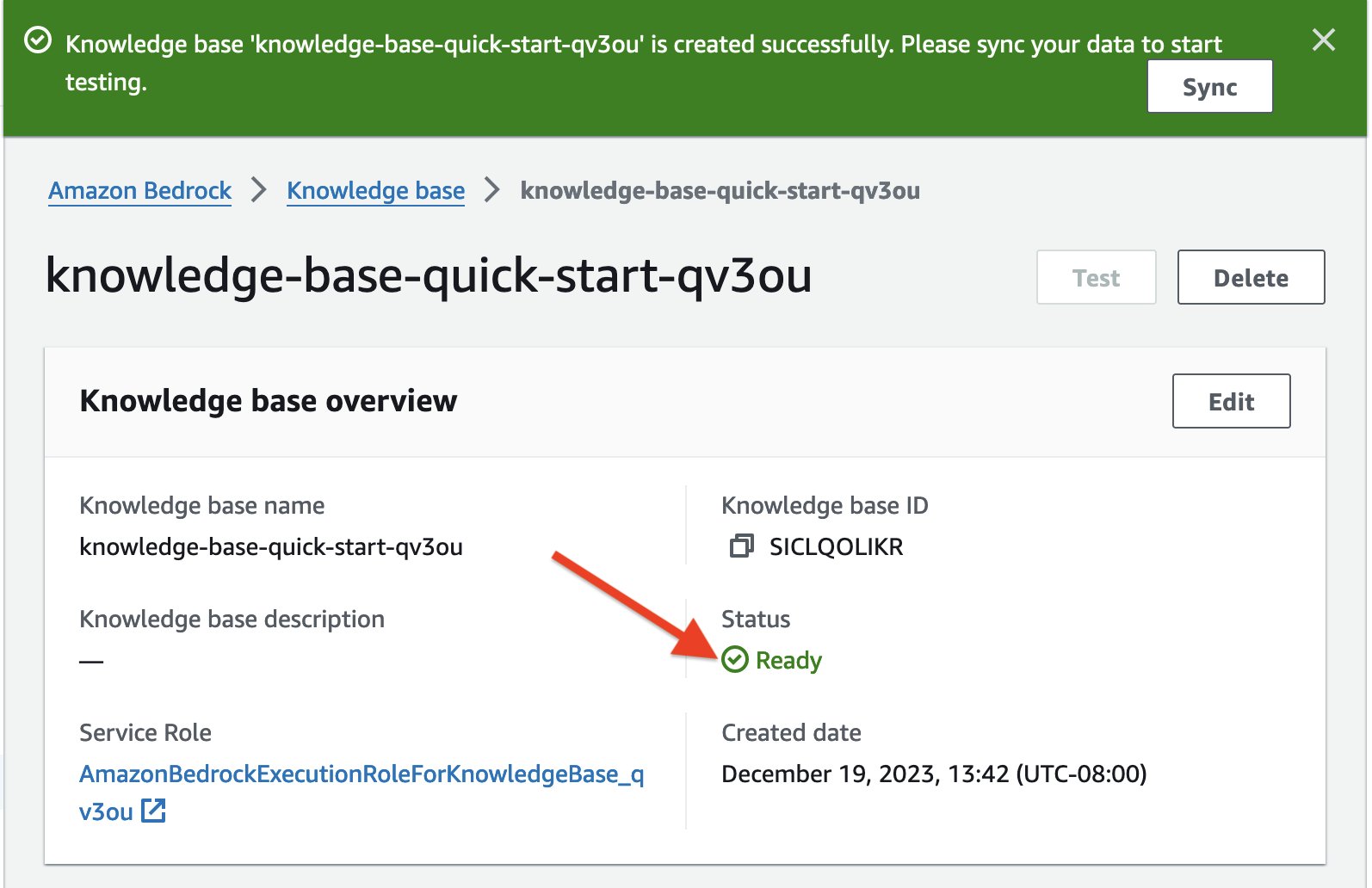

Observe que o processo de criação da base de conhecimento começa e o status é Em andamento. Levará alguns minutos para criar o armazenamento de vetores e a base de conhecimento. Não saia da página, caso contrário a criação falhará.

Observe que o processo de criação da base de conhecimento começa e o status é Em andamento. Levará alguns minutos para criar o armazenamento de vetores e a base de conhecimento. Não saia da página, caso contrário a criação falhará. - Quando o status da base de conhecimento estiver no

Readyestado, anote o ID da base de conhecimento. Você o usará nas próximas etapas para configurar a função Lambda.

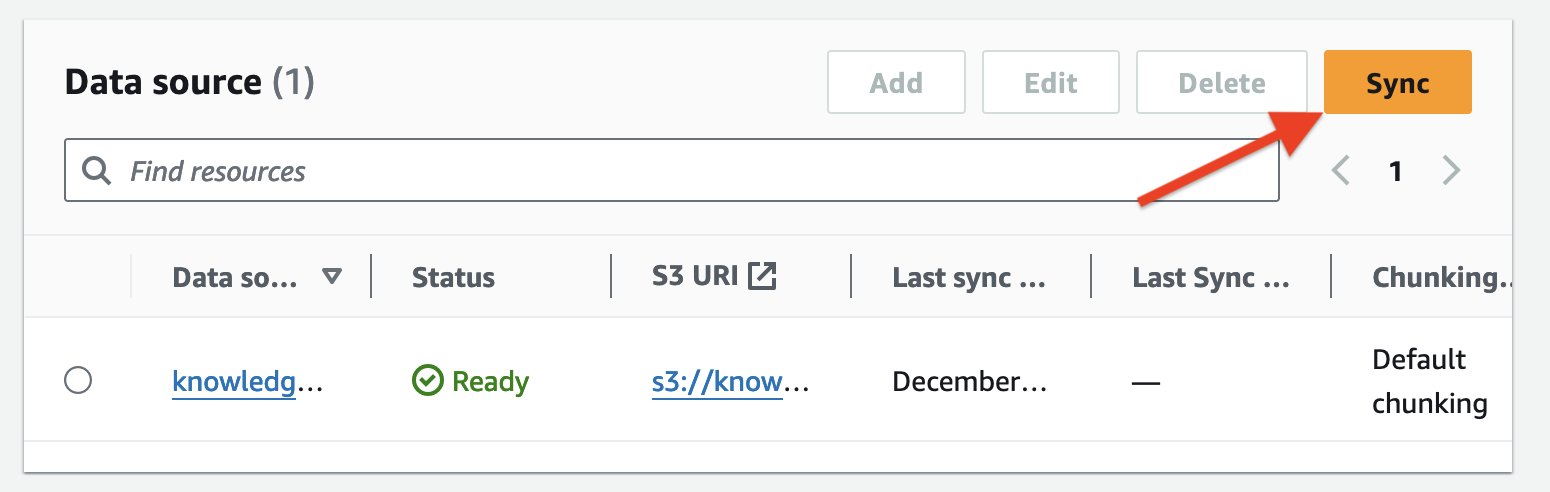

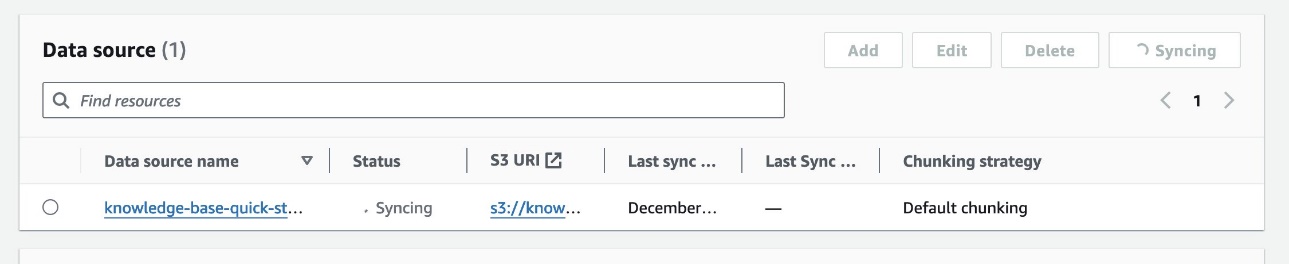

- Agora que a base de conhecimento está pronta, precisamos sincronizar os dados das cartas aos acionistas da Amazon com ela. No Fonte de dados seção da página de detalhes da base de conhecimento, escolha sincronização para acionar o processo de ingestão de dados do bucket S3 para a base de conhecimento.

Esse processo de sincronização divide os arquivos de documentos em partes menores do tamanho especificado anteriormente, gera embeddings de vetores usando o modelo de incorporação de texto selecionado e os armazena no armazenamento de vetores gerenciado pelas bases de conhecimento do Amazon Bedrock.

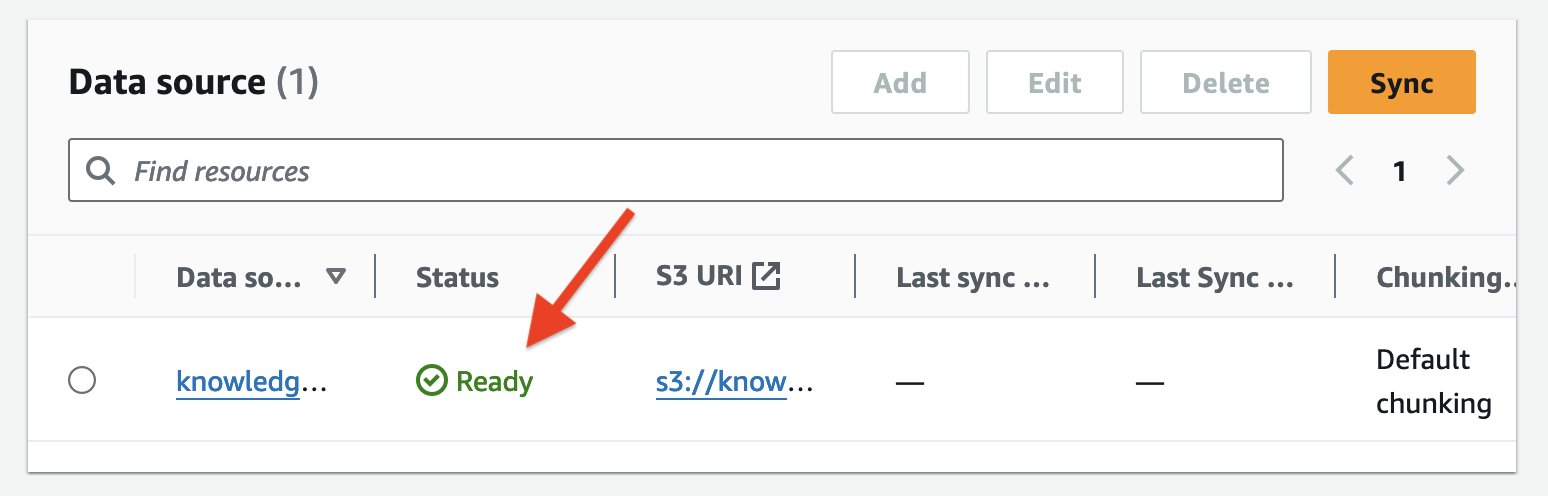

Quando a sincronização do conjunto de dados for concluída, o status da fonte de dados mudará para Ready estado. Observe que, se você adicionar documentos adicionais à pasta de dados do S3, será necessário sincronizar novamente a base de conhecimento.

Parabéns, sua base de conhecimento está pronta.

Observe que você também pode usar bases de conhecimento para APIs de serviço Amazon Bedrock e o Interface de linha de comando da AWS (AWS CLI) para criar programaticamente uma base de conhecimento. Você precisará executar várias seções do notebook Jupyter fornecido no /notebook pasta no repositório GitHub.

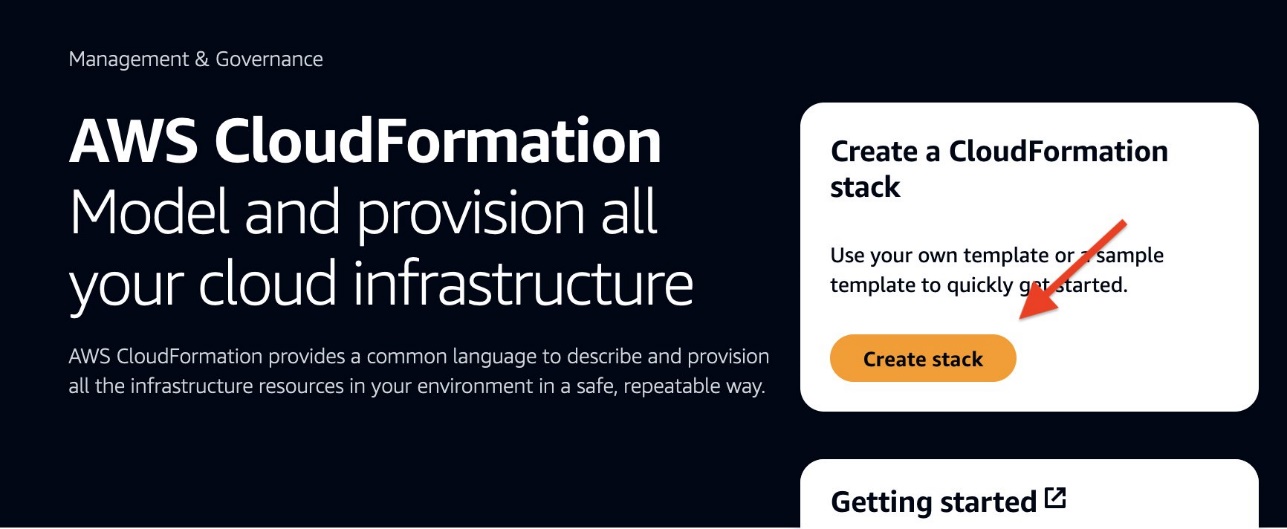

Crie uma função Lambda

Esta função Lambda é implantada usando um Formação da Nuvem AWS modelo disponível no repositório GitHub sob o /cfn pasta. O modelo requer dois parâmetros: o nome do bucket S3 e o ID da base de conhecimento.

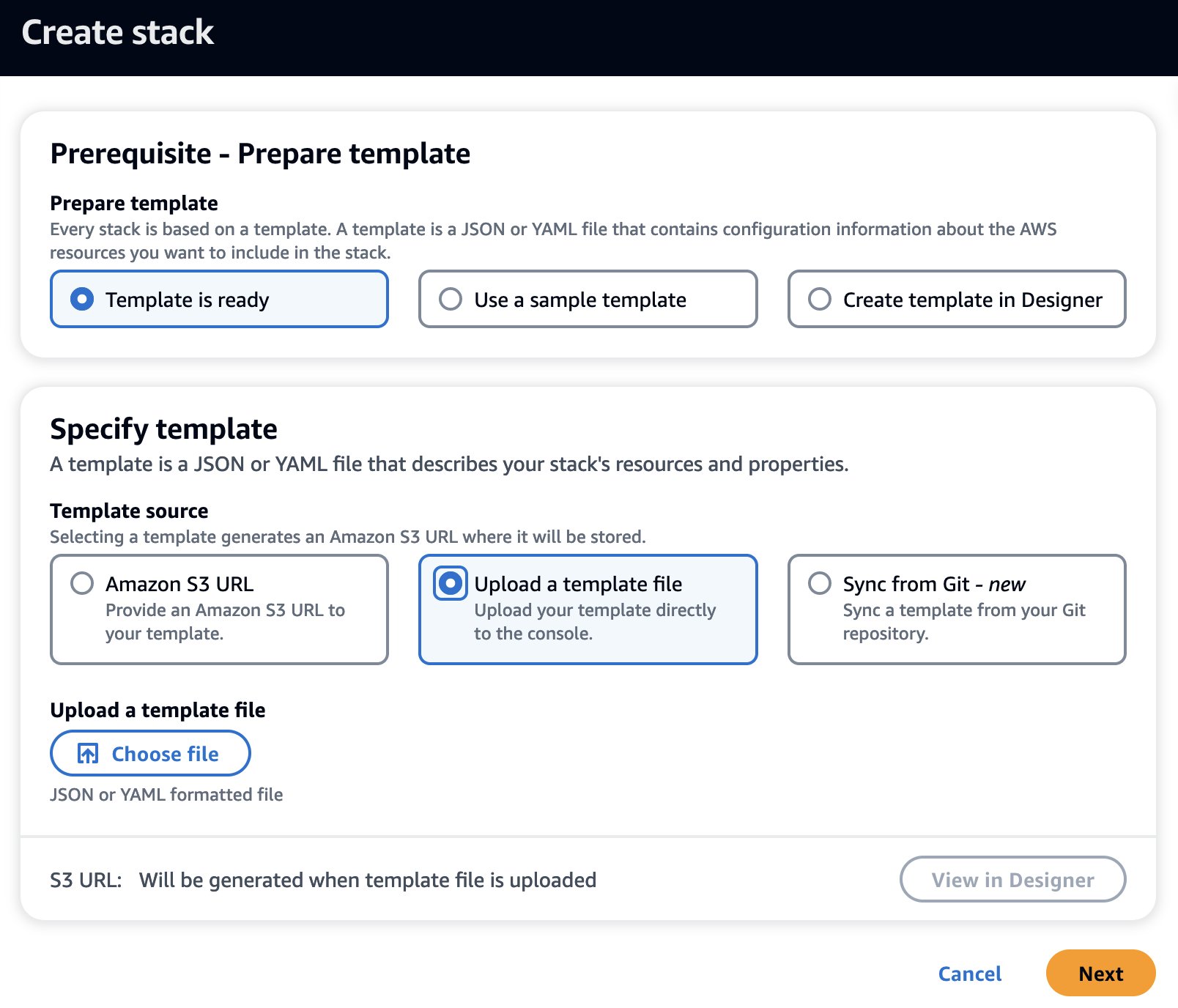

- Na página inicial do serviço AWS CloudFormation, escolha Criar pilha para criar uma nova pilha.

- Selecionar O modelo está pronto para Preparar modelo.

- Selecionar Carregue o arquivo de modelo para Fonte do modelo.

- Escolha Escolha o arquivo, navegue até o repositório GitHub que você clonou anteriormente e escolha o arquivo .yaml no

/cfnpasta. - Escolha Próximo.

- Escolha Nome da pilha, Insira o nome.

- No parâmetros seção, insira o ID da base de conhecimento e o nome do bucket S3 que você anotou anteriormente.

- Escolha Próximo.

- Deixe todas as opções padrão como estão, escolha Próximoe escolha Submeter.

- Verifique se o modelo CloudFormation foi executado com sucesso e se não há erros.

Parabéns, você criou uma função Lambda, funções e políticas relacionadas com sucesso.

Teste o aplicativo chatbot contextual

Para testar seu aplicativo chatbot, execute as seguintes etapas:

- Abra um novo terminal ou uma janela de linha de comando em sua máquina.

- Execute o seguinte comando para instalar o SDK da AWS para Python (Boto3). O Boto3 simplifica a integração de um aplicativo, biblioteca ou script Python com serviços AWS.

- Execute o seguinte comando para instalar e configurar um ambiente de desenvolvimento Python local para executar o aplicativo Streamlit:

- Navegue até a

/streamlitpasta na pasta do repositório GitHub que você clonou anteriormente. - Execute o seguinte comando para instanciar o aplicativo chatbot:

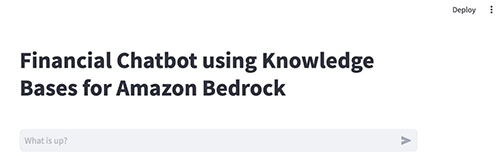

Isso deve abrir um aplicativo de bate-papo baseado na web desenvolvido pela Streamlit em seu navegador padrão.

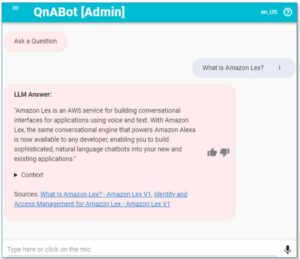

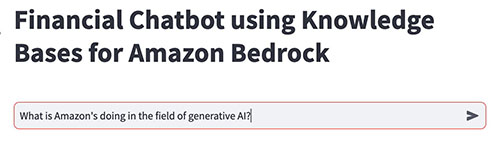

- Use este aplicativo de chatbot Streamlit para postar perguntas em linguagem natural para iniciar conversas com base em bases de conhecimento do Amazon Bedrock.

Quando você envia um prompt, o aplicativo Streamlit aciona a função Lambda, que invoca as Bases de Conhecimento RetrieveAndGenerate API para pesquisar e gerar respostas.

A tabela a seguir inclui alguns exemplos de perguntas e respostas da base de conhecimento relacionadas. Experimente algumas dessas perguntas usando prompts.

| Frequentes | respostas |

| O que a Amazon está fazendo no campo da IA generativa? | A Amazon tem trabalhado em seus próprios grandes modelos de linguagem (LLMs) para IA generativa e acredita que isso transformará e melhorará a experiência de cada cliente. Eles planejam continuar investindo substancialmente nesses modelos em todas as experiências de consumidores, vendedores, marcas e criadores. |

| Qual é a receita anual da AWS em 2022? | A receita da AWS cresceu 29% ano a ano em 2022, com base em receitas de US$ 62 bilhões. |

| Há quantos dias a Amazon pede aos funcionários que venham trabalhar no escritório? | A Amazon pediu aos funcionários corporativos que voltassem ao escritório pelo menos três dias por semana a partir de maio de 2022. |

| Em que porcentagem a receita da AWS cresceu ano após ano em 2022? | A AWS teve uma receita anual de 29% ('YoY') em 2022. |

| Comparado aos processadores Graviton2, que melhoria de desempenho os chips Graviton3 entregaram de acordo com a passagem? | Em 2022, a AWS entregou seus chips Graviton3, proporcionando desempenho 25% melhor do que os processadores Graviton2. |

| Qual foi o primeiro chip de inferência lançado pela AWS de acordo com o trecho? | A AWS lançou seus primeiros chips de inferência (“Inferentia”) em 2019 e economizou para empresas como a Amazon mais de cem milhões de dólares em despesas de capital. |

| De acordo com o contexto, em que ano a receita anual da Amazon aumentou de US$ 245 bilhões para US$ 434 bilhões? | A receita anual da Amazon aumentou de US$ 245 bilhões em 2019 para US$ 434 bilhões em 2022. |

| Diga-me novamente qual foi a receita em 2019? | A receita da Amazon em 2019 foi de US$ 245 bilhões. |

| e, 2021? | A receita da Amazon em 2021 foi de US$ 469.8 bilhões, um aumento de 22% em relação a 2020. |

| E lembre-me novamente quando o primeiro chip de inferência foi lançado? | O primeiro chip de inferência da Amazon foi o Inferentia, lançado em 2019. |

Durante a primeira chamada para a função Lambda, o RetrieveAndGenerate API retorna um sessionId, que é então passado pelo aplicativo Streamlit junto com o prompt do usuário subsequente como uma entrada para a API RetrieveAndGenerate para continuar a conversa na mesma sessão. O RetrieveAndGenerate A API gerencia a memória de curto prazo e usa o histórico do chat desde que o mesmo sessionId seja passado como entrada nas chamadas sucessivas.

Parabéns, você criou e testou com êxito um aplicativo chatbot usando bases de conhecimento do Amazon Bedrock.

limpar

A falha na exclusão de recursos como o bucket S3, a coleção OpenSearch Serverless e a base de conhecimento incorrerá em cobranças. Para limpar esses recursos, exclua a pilha do CloudFormation, exclua o bucket S3 (incluindo quaisquer pastas de documentos e arquivos armazenados nesse bucket), exclua a coleção OpenSearch Serverless, exclua a base de conhecimento e exclua quaisquer funções, políticas e permissões que você criado anteriormente.

Conclusão

Nesta postagem, fornecemos uma visão geral dos chatbots contextuais e explicamos por que eles são importantes. Descrevemos as complexidades envolvidas na ingestão de dados e fluxos de trabalho de geração de texto para uma arquitetura RAG. Em seguida, apresentamos como as bases de conhecimento do Amazon Bedrock criam um sistema RAG sem servidor totalmente gerenciado, incluindo um armazenamento de vetores. Por fim, fornecemos uma arquitetura de solução e um código de amostra em um GitHub repo recuperar e gerar respostas contextuais para um aplicativo chatbot usando uma base de conhecimento.

Ao explicar o valor dos chatbots contextuais, os desafios dos sistemas RAG e como as bases de conhecimento do Amazon Bedrock abordam esses desafios, esta postagem teve como objetivo mostrar como o Amazon Bedrock permite criar aplicativos sofisticados de IA conversacional com o mínimo de esforço.

Para mais informações, consulte o Guia do desenvolvedor Amazon Bedrock e APIs da base de conhecimento.

Sobre os autores

Manish Chugh é arquiteto de soluções principal da AWS e mora em São Francisco, CA. Ele é especialista em aprendizado de máquina e IA generativa. Ele trabalha com organizações que vão desde grandes empresas até startups em estágio inicial em problemas relacionados ao aprendizado de máquina. Sua função envolve ajudar essas organizações a arquitetar cargas de trabalho escalonáveis, seguras e econômicas na AWS. Ele se apresenta regularmente em conferências da AWS e em outros eventos de parceiros. Fora do trabalho, ele gosta de fazer caminhadas nas trilhas de East Bay, andar de bicicleta e assistir (e jogar) críquete.

Manish Chugh é arquiteto de soluções principal da AWS e mora em São Francisco, CA. Ele é especialista em aprendizado de máquina e IA generativa. Ele trabalha com organizações que vão desde grandes empresas até startups em estágio inicial em problemas relacionados ao aprendizado de máquina. Sua função envolve ajudar essas organizações a arquitetar cargas de trabalho escalonáveis, seguras e econômicas na AWS. Ele se apresenta regularmente em conferências da AWS e em outros eventos de parceiros. Fora do trabalho, ele gosta de fazer caminhadas nas trilhas de East Bay, andar de bicicleta e assistir (e jogar) críquete.

Mani Khanuja é líder de tecnologia - especialistas em IA generativa, autora do livro Applied Machine Learning and High Performance Computing on AWS e membro do Conselho de Administração da Women in Manufacturing Education Foundation Board. Ela lidera projetos de aprendizado de máquina em vários domínios, como visão computacional, processamento de linguagem natural e IA generativa. Ela fala em conferências internas e externas, como AWS re:Invent, Women in Manufacturing West, webinars no YouTube e GHC 23. Em seu tempo livre, ela gosta de fazer longas corridas na praia.

Mani Khanuja é líder de tecnologia - especialistas em IA generativa, autora do livro Applied Machine Learning and High Performance Computing on AWS e membro do Conselho de Administração da Women in Manufacturing Education Foundation Board. Ela lidera projetos de aprendizado de máquina em vários domínios, como visão computacional, processamento de linguagem natural e IA generativa. Ela fala em conferências internas e externas, como AWS re:Invent, Women in Manufacturing West, webinars no YouTube e GHC 23. Em seu tempo livre, ela gosta de fazer longas corridas na praia.

Pallavi Nargund é arquiteto de soluções principal na AWS. Em sua função como facilitadora de tecnologia em nuvem, ela trabalha com os clientes para entender seus objetivos e desafios e fornecer orientação prescritiva para atingir seus objetivos com as ofertas da AWS. Ela é apaixonada por mulheres na tecnologia e é membro principal do Women in AI/ML na Amazon. Ela palestra em conferências internas e externas, como AWS re:Invent, AWS Summits e webinars. Fora do trabalho, ela gosta de voluntariado, jardinagem, ciclismo e caminhadas.

Pallavi Nargund é arquiteto de soluções principal na AWS. Em sua função como facilitadora de tecnologia em nuvem, ela trabalha com os clientes para entender seus objetivos e desafios e fornecer orientação prescritiva para atingir seus objetivos com as ofertas da AWS. Ela é apaixonada por mulheres na tecnologia e é membro principal do Women in AI/ML na Amazon. Ela palestra em conferências internas e externas, como AWS re:Invent, AWS Summits e webinars. Fora do trabalho, ela gosta de voluntariado, jardinagem, ciclismo e caminhadas.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/build-a-contextual-chatbot-application-using-knowledge-bases-for-amazon-bedrock/

- :tem

- :é

- :onde

- $UP

- 100

- 125

- 2019

- 2020

- 2021

- 2022

- 23

- 27

- 500

- 7

- 8

- 9

- a

- habilidade

- Sobre

- acelerar

- Acesso

- acessando

- Segundo

- Conta

- preciso

- Alcançar

- em

- Açao Social

- adicionar

- Adicional

- endereços

- avançado

- vantagens

- conselheiros

- novamente

- agentes

- AI

- Sistemas de IA

- AI / ML

- Destinado

- Todos os Produtos

- Permitindo

- permite

- sozinho

- juntamente

- ao lado de

- tb

- Amazon

- Amazon Web Services

- an

- e

- anual

- RECEITA ANUAL

- responder

- responder

- Antrópico

- qualquer

- api

- APIs

- app

- Aplicação

- aplicações

- aplicado

- abordagem

- arquitetura

- SOMOS

- AS

- At

- aumentar

- aumentado

- aumentos

- aurora

- autor

- automaticamente

- disponível

- Avenida

- longe

- AWS

- Formação da Nuvem AWS

- AWS re: Invent

- em caminho duplo

- base

- baseado

- basic

- Bay

- Beach

- tornam-se

- sido

- antes

- Começo

- começa

- comportamento

- acredita

- Melhor

- bilhão

- borda

- conselho de administração

- livro

- interesse?

- navegador

- construir

- negócio

- Aplicações de Negócio

- by

- CA

- chamada

- chamadas

- CAN

- capacidades

- capital

- casos

- CD

- desafios

- alterar

- Alterações

- acusações

- bate-papo

- chatbot

- chatbots

- Finalizar compra

- lasca

- Chips

- escolha

- Escolha

- limpar

- cli

- Na nuvem

- TECNOLOGIA DE NUVEM

- código

- coleção

- combina

- como

- vem

- comum

- Empresas

- Empresa

- completar

- complexidades

- componentes

- computacional

- computador

- Visão de Computador

- computação

- conferências

- Contato

- cônsul

- consumidor

- contexto

- contextual

- contextualizar

- continuar

- Conversa

- conversação

- IA conversacional

- conversas

- convertido

- núcleo

- Responsabilidade

- relação custo-benefício

- poderia

- crio

- criado

- cria

- Criar

- criação

- criador

- Grilo

- Atualmente

- cliente

- comportamento do consumidor

- experiência do cliente

- Atendimento ao Cliente

- Clientes

- personalizado

- dados,

- Os pontos de dados

- orientado por dados

- banco de dados

- dias

- Padrão

- entregar

- entregue

- entregando

- Dependendo

- implantado

- desenvolvimento

- descrito

- descrição

- detalhes

- Determinar

- desenvolver

- Developer

- Desenvolvimento

- diagrama

- DID

- diferente

- digital

- Administração

- diferente

- documento

- INSTITUCIONAIS

- fazer

- dólares

- domínios

- não

- down

- download

- cada

- Mais cedo

- estágio inicial

- Leste

- Educação

- eficiente

- esforço

- sem esforço

- ou

- embutindo

- colaboradores

- permitir

- enabler

- permite

- noivando

- Motor

- Engenharia

- aprimorada

- aprimorando

- Entrar

- Empreendimento

- empresas

- Meio Ambiente

- erros

- Mesmo

- eventos

- Cada

- exemplo

- vasta experiência

- Experiências

- experiência

- Explicação

- explicado

- explicando

- externo

- fatos

- FALHA

- poucos

- campo

- Envie o

- Arquivos

- Finalmente

- encontra

- Primeiro nome

- fluxo

- Foco

- seguinte

- Escolha

- Foundation

- quatro

- Francisco

- Gratuito

- da

- totalmente

- função

- g1

- gerar

- gera

- geração

- generativo

- IA generativa

- Git

- GitHub

- OFERTE

- Go

- Objetivos

- cresceu

- Solo

- Cresça:

- Cresce

- orientações

- tinha

- manipular

- Alças

- Ter

- he

- pesado

- levantamento pesado

- ajuda

- sua experiência

- Alta

- de alto nível

- sua

- história

- Início

- Como funciona o dobrador de carta de canal

- Contudo

- HTML

- http

- HTTPS

- cem

- ID

- if

- ilustrar

- ilustra

- implementação

- importante

- melhorar

- melhoria

- melhorar

- in

- inclui

- Incluindo

- incorporar

- incorpora

- Crescimento

- aumentou

- índice

- índices

- Individual

- indústrias

- informar

- INFORMAÇÕES

- Sistemas de Informação

- entrada

- Inquéritos

- insights

- instalar

- instantâneos

- integrar

- Integração

- integração

- interage

- interesses

- Interface

- interno

- internamente

- para dentro

- introduzir

- introduzido

- investir

- invoca

- envolvido

- envolve

- IT

- jpg

- Chave

- Conhecimento

- língua

- Idiomas

- grande

- Grandes empresas

- Sobrenome

- mais tarde

- lançado

- camada

- conduzir

- Leads

- aprendizagem

- mínimo

- Deixar

- menos

- carta

- Nível

- bibliotecas

- Biblioteca

- facelift

- como

- gostos

- Limitado

- Line

- vinculação

- LLM

- local

- longo

- máquina

- aprendizado de máquina

- a Principal

- FAZ

- manejável

- gerenciados

- gestão

- gestão

- fabrica

- muitos

- Match

- Posso..

- me

- significado

- mecanismo

- membro

- Memória

- apenas

- milhão

- Milhão de dolares

- mínimo

- minuto

- Minutos

- modelo

- modelos

- modificar

- mais

- a maioria

- múltiplo

- nome

- natural

- Processamento de linguagem natural

- Navegar

- Navegação

- você merece...

- necessário

- Cria

- Novo

- Próximo

- não

- nenhum

- nota

- caderno

- notado

- objetivo

- of

- oferecer

- Ofertas

- Oferece

- Office

- frequentemente

- on

- ONE

- aberto

- open source

- ideal

- Opção

- Opções

- or

- organizações

- Outros

- de outra forma

- A Nossa

- Fora

- saída

- lado de fora

- Acima de

- em cima

- Visão geral

- próprio

- página

- pão

- parâmetros

- parceiro

- peças

- passagem

- passagens

- passou

- apaixonado

- passado

- padrão

- percentagem

- atuação

- permissões

- Personalizado

- plano

- platão

- Inteligência de Dados Platão

- PlatãoData

- jogar

- ponto

- pontos

- políticas

- Popular

- popularidade

- Publique

- poder

- alimentado

- poderoso

- preferências

- presente

- apresentado

- presentes

- anterior

- Diretor

- problemas

- processo

- em processamento

- processadores

- Produtos

- Progresso

- projetos

- solicita

- proprietário

- fornecer

- fornecido

- fornece

- fornecendo

- compras

- Python

- consultas

- pergunta

- questão

- Frequentes

- Links

- trapo

- variando

- RE

- pronto

- reais

- mundo real

- em tempo real

- registros

- reduzir

- redução

- referir

- regiões

- regularmente

- relacionado

- relevância

- relevante

- remove

- Relatórios

- repositório

- representar

- solicitar

- requeridos

- exige

- Recursos

- Responder

- resposta

- respostas

- recuperação

- Retorna

- receita

- rever

- estrada

- Tipo

- papéis

- Execute

- é executado

- tempo de execução

- mesmo

- amostra

- San

- San Francisco

- salvo

- escalável

- dimensionamento

- escrita

- Sdk

- Pesquisar

- Seção

- seções

- seguro

- Vejo

- selecionar

- selecionado

- semântico

- enviei

- servir

- Serverless

- serviço

- Serviços

- Sessão

- conjunto

- Configurações

- instalação

- acionista

- Acionistas

- ela

- assistência técnica de curto e longo prazo

- rede de apoio social

- mostrar

- periodo

- semelhante

- simultaneamente

- solteiro

- Tamanho

- menor

- solução

- Soluções

- alguns

- sofisticado

- fonte

- Fontes

- fala

- especialistas

- especializada

- específico

- especificada

- divisão

- splits

- pilha

- começo

- Startups

- Estado

- Status

- deriva

- Passo

- Passos

- loja

- armazenadas

- lojas

- armazenar

- franco

- Estratégia

- simplificar

- enviar

- subseqüente

- substancialmente

- entraram com sucesso

- tal

- sugerir

- Cúpulas

- ajuda

- Suportado

- suportes

- sincronizar.

- .

- sistemas

- mesa

- adaptados

- Tire

- toma

- tarefas

- tecnologia

- Tecnologia

- modelo

- terminal

- teste

- testado

- texto

- do que

- que

- A

- as informações

- A fonte

- deles

- Eles

- então

- Lá.

- assim sendo

- Este

- deles

- isto

- aqueles

- três

- Através da

- tempo

- titã

- para

- Transformar

- desencadear

- confiável

- tentar

- dois

- tipos

- para

- compreender

- atualização

- carregado

- usar

- usava

- Utilizador

- usuários

- usos

- utilização

- utilidade

- v1

- Valioso

- valor

- Valores

- vário

- visão

- volume

- queremos

- foi

- assistindo

- Caminho..

- we

- web

- navegador web

- serviços web

- Web-Based

- Webinars

- semana

- semanas

- Ocidente

- O Quê

- quando

- qual

- enquanto

- porque

- precisarão

- janela

- de

- Mulher

- mulheres na tecnologia

- Atividades:

- de gestão de documentos

- fluxos de trabalho

- trabalhar

- trabalho

- escrever

- escrever código

- escrito

- yaml

- ano

- anos

- Vocês

- investimentos

- Youtube

- zefirnet