A moderação de conteúdo desempenha um papel fundamental na manutenção da segurança online e na defesa dos valores e padrões de sites e plataformas de mídia social. A sua importância é sublinhada pela proteção que proporciona aos utilizadores contra a exposição a conteúdos inadequados, salvaguardando o seu bem-estar nos espaços digitais. Por exemplo, na indústria da publicidade, a moderação de conteúdos serve para proteger as marcas de associações desfavoráveis, contribuindo assim para a elevação da marca e o crescimento das receitas. Os anunciantes priorizam o alinhamento da sua marca com conteúdo apropriado para manter a sua reputação e evitar publicidade negativa. A moderação de conteúdo também assume importância crítica nos setores financeiro e de saúde, onde desempenha múltiplas funções. Ele desempenha um papel importante na identificação e proteção de informações confidenciais de identificação pessoal e de saúde (PII, PHI). Ao aderir aos padrões e práticas internas e ao cumprir regulamentações externas, a moderação de conteúdo aumenta a segurança digital dos usuários. Dessa forma, evita o compartilhamento inadvertido de dados confidenciais em plataformas públicas, garantindo a preservação da privacidade dos usuários e a segurança dos dados.

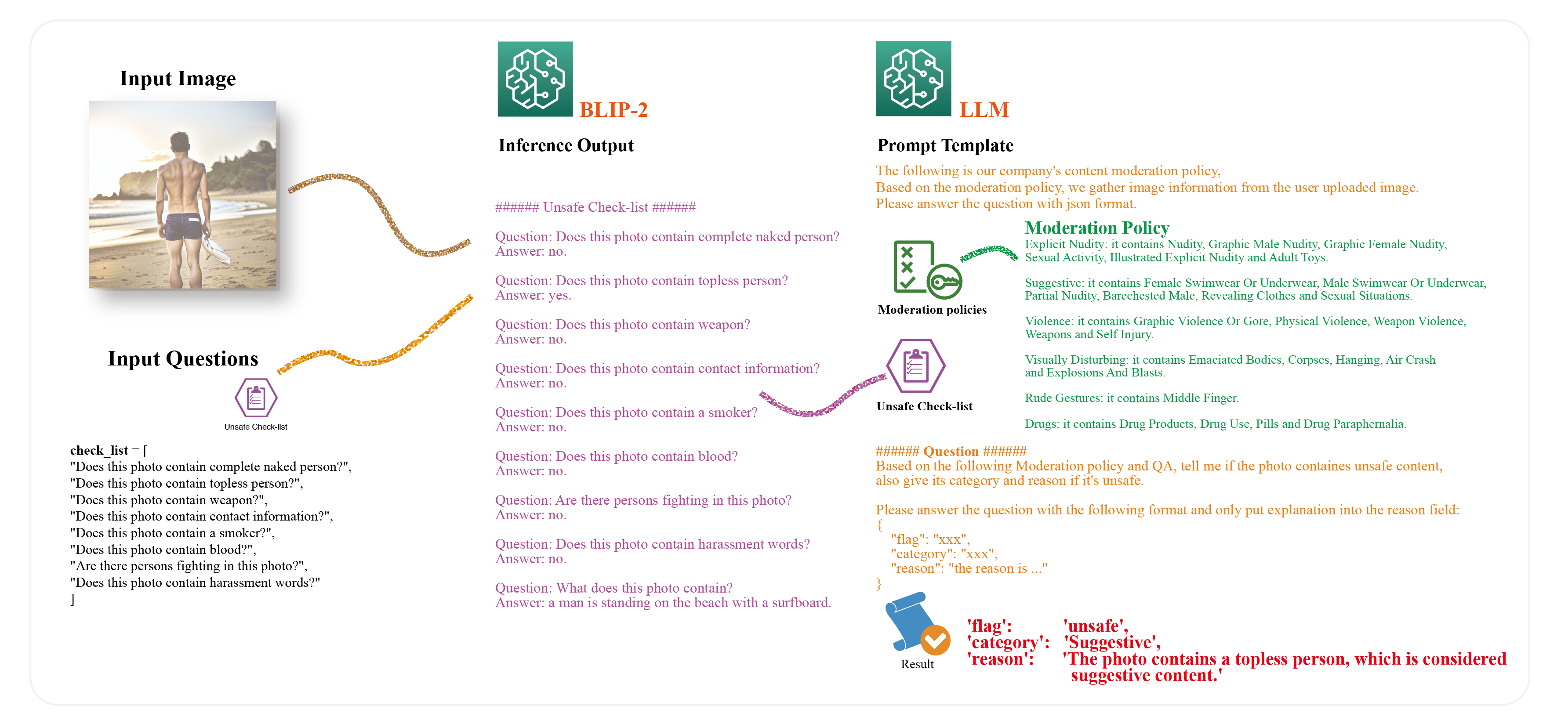

Nesta postagem, apresentamos um novo método para realizar moderação de conteúdo em dados de imagem com pré-treinamento multimodal e um modelo de linguagem grande (LLM). Com o pré-treinamento multimodal, podemos consultar diretamente o conteúdo da imagem com base em um conjunto de questões de interesse e o modelo será capaz de responder a essas questões. Isso permite que os usuários conversem com a imagem para confirmar se ela contém algum conteúdo impróprio que viole as políticas da organização. Usamos a poderosa capacidade de geração de LLMs para gerar a decisão final, incluindo rótulos seguros/inseguros e tipo de categoria. Além disso, ao projetar um prompt, podemos fazer um LLM gerar o formato de saída definido, como o formato JSON. O modelo de prompt projetado permite que o LLM determine se a imagem viola a política de moderação, identifique a categoria da violação, explique o porquê e forneça a saída em um formato JSON estruturado.

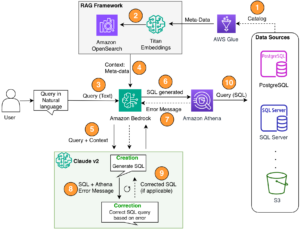

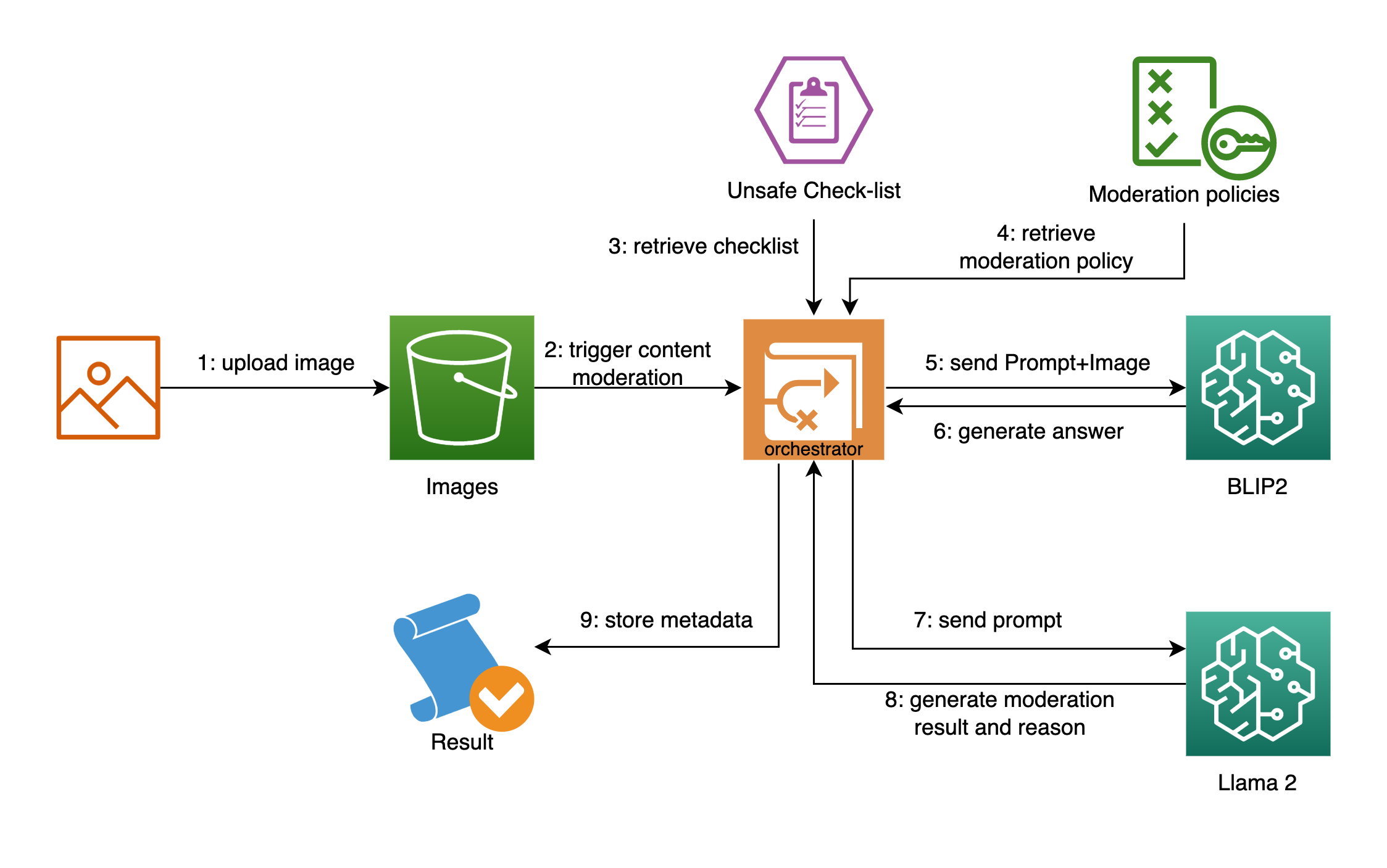

Usamos BLIP-2 como o método multimodal de pré-treinamento. BLIP-2 é um dos modelos de última geração em pré-treinamento multimodal e supera a maioria dos métodos existentes em resposta visual a perguntas, legenda de imagens e recuperação de texto de imagem. Para nosso LLM, usamos lhama 2, o LLM de código aberto da próxima geração, que supera os modelos de linguagem de código aberto existentes em muitos benchmarks, incluindo testes de raciocínio, codificação, proficiência e conhecimento. O diagrama a seguir ilustra os componentes da solução.

Desafios na moderação de conteúdo

Os métodos tradicionais de moderação de conteúdo, como a moderação baseada em humanos, não conseguem acompanhar o volume crescente de conteúdo gerado pelo usuário (UGC). À medida que o volume de UGC aumenta, os moderadores humanos podem ficar sobrecarregados e ter dificuldade para moderar o conteúdo de forma eficaz. Isso resulta em uma experiência do usuário ruim, altos custos de moderação e risco de marca. A moderação baseada em humanos também está sujeita a erros, o que pode resultar em moderação inconsistente e decisões tendenciosas. Para enfrentar esses desafios, a moderação de conteúdo alimentada por aprendizado de máquina (ML) surgiu como uma solução. Os algoritmos de ML podem analisar grandes volumes de UGC e identificar conteúdo que viola as políticas da organização. Os modelos de ML podem ser treinados para reconhecer padrões e identificar conteúdos problemáticos, como discurso de ódio, spam e material impróprio. De acordo com o estudo Proteja seus usuários, sua marca e seu orçamento com moderação de conteúdo baseada em IA, a moderação de conteúdo baseada em ML pode ajudar as organizações a recuperar até 95% do tempo que suas equipes gastam moderando conteúdo manualmente. Isto permite que as organizações concentrem os seus recursos em tarefas mais estratégicas, como a construção de comunidades e a criação de conteúdos. A moderação de conteúdo baseada em ML também pode reduzir os custos de moderação porque é mais eficiente do que a moderação baseada em humanos.

Apesar das vantagens da moderação de conteúdo baseada em ML, ela ainda tem espaço para melhorias. A eficácia dos algoritmos de ML depende muito da qualidade dos dados nos quais são treinados. Quando os modelos são treinados usando dados tendenciosos ou incompletos, eles podem tomar decisões errôneas de moderação, expondo as organizações a riscos de marca e possíveis responsabilidades legais. A adoção de abordagens baseadas em ML para moderação de conteúdo traz vários desafios que requerem consideração cuidadosa. Esses desafios incluem:

- Adquirindo dados rotulados – Este pode ser um processo caro, especialmente para tarefas complexas de moderação de conteúdo que exigem treinamento de rotuladores. Esse custo pode dificultar a coleta de conjuntos de dados grandes o suficiente para treinar um modelo de ML supervisionado com facilidade. Além disso, a precisão do modelo depende fortemente da qualidade dos dados de treinamento, e dados tendenciosos ou incompletos podem resultar em decisões de moderação imprecisas, levando a riscos de marca e responsabilidades legais.

- Generalização do modelo – Isso é fundamental para a adoção de abordagens baseadas em ML. Um modelo treinado em um conjunto de dados pode não generalizar bem para outro conjunto de dados, principalmente se os conjuntos de dados tiverem distribuições diferentes. Portanto, é essencial garantir que o modelo seja treinado em um conjunto de dados diversificado e representativo para garantir que ele generalize bem para novos dados.

- Eficiência operacional – Este é outro desafio ao usar abordagens convencionais baseadas em ML para moderação de conteúdo. Adicionar constantemente novos rótulos e treinar novamente o modelo quando novas classes são adicionadas pode ser demorado e caro. Além disso, é fundamental garantir que o modelo seja atualizado regularmente para acompanhar as mudanças no conteúdo moderado.

- Explicação – Os utilizadores finais podem considerar a plataforma tendenciosa ou injusta se o conteúdo for sinalizado ou removido sem justificação, resultando numa má experiência do utilizador. Da mesma forma, a ausência de explicações claras pode tornar o processo de moderação de conteúdo ineficiente, demorado e caro para os moderadores.

- Natureza adversária – A natureza adversária da moderação de conteúdo baseada em imagens apresenta um desafio único para as abordagens convencionais baseadas em ML. Os malfeitores podem tentar escapar aos mecanismos de moderação de conteúdo, alterando o conteúdo de várias maneiras, como usando sinônimos de imagens ou incorporando seu conteúdo real em um corpo maior de conteúdo não ofensivo. Isto requer monitoramento e atualização constantes do modelo para detectar e responder a tais táticas adversárias.

Raciocínio multimodal com BLIP-2

Modelos de ML multimodal referem-se a modelos que podem manipular e integrar dados de múltiplas fontes ou modalidades, como imagens, texto, áudio, vídeo e outras formas de dados estruturados ou não estruturados. Um dos modelos multimodais populares são os modelos de linguagem visual, como o BLIP-2, que combina visão computacional e processamento de linguagem natural (PNL) para compreender e gerar informações visuais e textuais. Esses modelos permitem que os computadores interpretem o significado das imagens e do texto de uma forma que imite a compreensão humana. Os modelos de linguagem visual podem realizar uma variedade de tarefas, incluindo legenda de imagens, recuperação de texto de imagem, resposta visual a perguntas e muito mais. Por exemplo, um modelo de legenda de imagens pode gerar uma descrição de uma imagem em linguagem natural, e um modelo de recuperação de texto de imagem pode pesquisar imagens com base em uma consulta de texto. Os modelos de resposta visual a perguntas podem responder a perguntas em linguagem natural sobre imagens, e os chatbots multimodais podem usar entradas visuais e textuais para gerar respostas. Em termos de moderação de conteúdo, você pode usar esse recurso para consultar uma lista de perguntas.

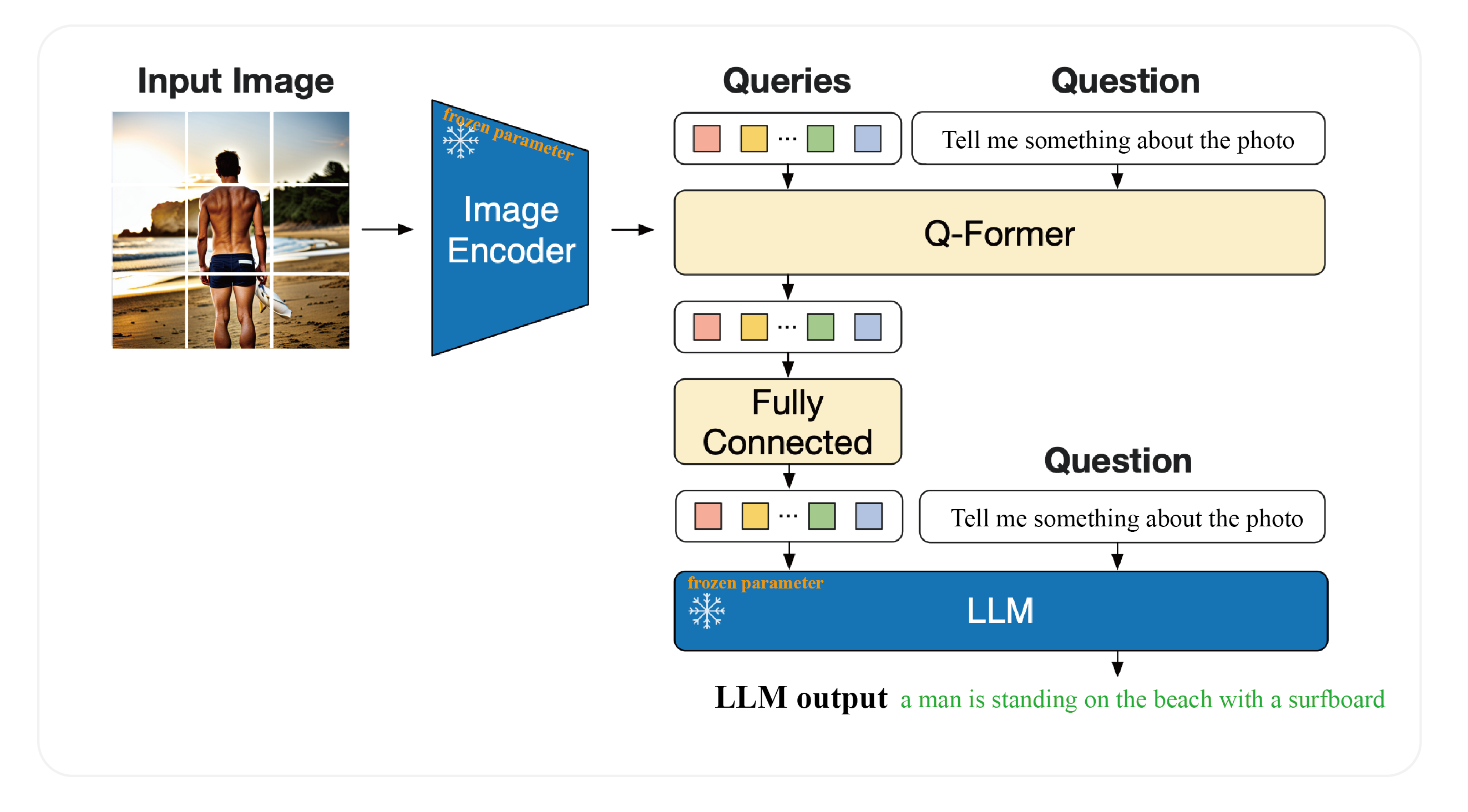

BLIP-2 contém três partes. O primeiro componente é um codificador de imagem congelada, ViT-L/14 do CLIP, que recebe dados de imagem como entrada. O segundo componente é um LLM congelado, FlanT5, que gera texto. O terceiro componente é um módulo treinável chamado Q-Former, um transformador leve que conecta o codificador de imagem congelada ao LLM congelado. Q-Former emprega vetores de consulta que podem ser aprendidos para extrair recursos visuais do codificador de imagem congelada e alimenta o recurso visual mais útil para o LLM para gerar o texto desejado.

O processo de pré-treinamento envolve duas etapas. Na primeira etapa, o aprendizado da representação visual-linguagem é realizado para ensinar o Q-Former a aprender a representação visual mais relevante para o texto. No segundo estágio, a aprendizagem generativa da visão para a linguagem é realizada conectando a saída do Q-Former a um LLM congelado e treinando o Q-Former para produzir representações visuais que podem ser interpretadas pelo LLM.

O BLIP-2 alcança desempenho de última geração em várias tarefas de linguagem visual, apesar de ter significativamente menos parâmetros treináveis do que os métodos existentes. O modelo também demonstra capacidades emergentes de geração de imagem para texto de disparo zero que podem seguir instruções de linguagem natural. A ilustração a seguir foi modificada a partir do artigo de pesquisa original.

Visão geral da solução

O diagrama a seguir ilustra a arquitetura da solução.

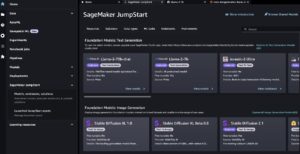

Nas seções a seguir, demonstramos como implantar o BLIP-2 em um Amazon Sage Maker endpoint e use BLIP-2 e um LLM para moderação de conteúdo.

Pré-requisitos

Você precisa de uma conta da AWS com um Gerenciamento de acesso e identidade da AWS (IAM) com permissões para gerenciar recursos criados como parte da solução. Para obter detalhes, consulte Crie uma conta AWS independente.

Se esta é sua primeira vez trabalhando com Estúdio Amazon SageMaker, primeiro você precisa criar um Domínio do SageMaker. Além disso, pode ser necessário solicitar um aumento de cota de serviço para as instâncias de hospedagem do SageMaker correspondentes. Para o modelo BLIP-2, usamos um ml.g5.2xlarge Instância de hospedagem do SageMaker. Para o modelo Llama 2 13B, usamos um ml.g5.12xlarge Instância de hospedagem do SageMaker.

Implante o BLIP-2 em um endpoint do SageMaker

Você pode hospedar um LLM no SageMaker usando o Inferência de modelo grande (LMI) otimizado para hospedar modelos grandes usando DJLServing. DJLServing é uma solução de serviço de modelo universal de alto desempenho desenvolvida pela Deep Java Library (DJL) que é independente de linguagem de programação. Para saber mais sobre DJL e DJLServing, consulte Implante modelos grandes no Amazon SageMaker usando DJLServing e inferência paralela de modelo DeepSpeed. Com a ajuda do contêiner SageMaker LMI, o modelo BLIP-2 pode ser facilmente implementado com a biblioteca Hugging Face e hospedado no SageMaker. Você pode correr blip2-sagemaker.ipynb para esta etapa.

Para preparar a imagem do Docker e o arquivo de modelo, você precisa recuperar a imagem do Docker do DJLServing, empacotar o script de inferência e os arquivos de configuração como um arquivo model.tar.gz arquivo e carregue-o em um Serviço de armazenamento simples da Amazon (Amazon S3) balde. Você pode consultar o script de inferência e arquivo de configuração para mais detalhes.

inference_image_uri = image_uris.retrieve( framework="djl-deepspeed", region=sess.boto_session.region_name, version="0.22.1"

)

! tar czvf model.tar.gz blip2/

s3_code_artifact = sess.upload_data("model.tar.gz", bucket, s3_code_prefix)Quando a imagem do Docker e os arquivos relacionados à inferência estiverem prontos, você cria o modelo, a configuração para o endpoint e o endpoint:

from sagemaker.utils import name_from_base

blip_model_version = "blip2-flan-t5-xl"

model_name = name_from_base(blip_model_version)

model = Model( image_uri=inference_image_uri, model_data=s3_code_artifact, role=role, name=model_name,

)

model.deploy( initial_instance_count=1, instance_type="ml.g5.2xlarge", endpoint_name=model_name

)Quando o status do terminal se torna em serviço, você pode invocar o terminal para legenda de imagem e a tarefa instruída de geração de visão para linguagem de disparo zero. Para a tarefa de legendagem de imagens, você só precisa passar uma imagem para o endpoint:

import base64

import json

from PIL import Image smr_client = boto3.client("sagemaker-runtime") def encode_image(img_file): with open(img_file, "rb") as image_file: img_str = base64.b64encode(image_file.read()) base64_string = img_str.decode("latin1") return base64_string def run_inference(endpoint_name, inputs): response = smr_client.invoke_endpoint( EndpointName=endpoint_name, Body=json.dumps(inputs) ) print(response["Body"].read()) test_image = "carcrash-ai.jpeg"

base64_string = encode_image(test_image)

inputs = {"image": base64_string}

run_inference(endpoint_name, inputs)Para a tarefa instruída de geração de visão para linguagem, além da imagem de entrada, você precisa definir a pergunta como um prompt:

base64_string = encode_image(test_image)

inputs = {"prompt": "Question: what happened in this photo? Answer:", "image": base64_string}

run_inference(endpoint_name, inputs)Use BLIP-2 e LLM para moderação de conteúdo

Nesta etapa, você pode fazer consultas sobre uma determinada imagem e recuperar informações ocultas. Com o LLM, você organiza as consultas e recupera informações para gerar o resultado no formato JSON. Você pode dividir aproximadamente esta tarefa nas duas subtarefas a seguir:

- Extraia informações da imagem com o modelo BLIP-2.

- Gere o resultado final e explicação com o LLM.

Extraia informações da imagem com o modelo BLIP-2

Para recuperar informações ocultas úteis suficientes de uma determinada imagem, você precisa definir consultas. Como cada consulta invocará o endpoint uma vez, muitas consultas levarão a um tempo de processamento mais longo. Portanto, sugerimos fazer consultas de alta qualidade e abranger todas as apólices, mas também sem duplicidades. Em nosso código de exemplo, definimos as consultas da seguinte forma:

check_list = [ "Does this photo contain complete naked person?", "Does this photo contain topless person?", "Does this photo contain weapon?", "Does this photo contain contact information?", "Does this photo contain a smoker?", "Does this photo contain blood?", "Are there persons fighting in this photo?", "Does this photo contain harassment words?"

]Com as consultas anteriores, invoque o endpoint do BLIP-2 para recuperar as informações com o seguinte código:

test_image = "./surf_swimwear.png"

raw_image = Image.open(test_image).convert('RGB') base64_string = encode_image(test_image)

conversations = """"""

for question in check_list: inputs = {"prompt": f"Question: {question}? Answer:", "image": base64_string} response = run_inference(endpoint_name, inputs) conversations += f"""

Question: {question}

Answer: {response}. """Além das informações recuperadas pelas consultas, você pode obter informações com a tarefa de legendagem de imagens invocando o endpoint sem o prompt campo na carga útil:

inputs = {"image": base64_string}

response = smr_client.invoke_endpoint(

EndpointName=endpoint_name, Body=json.dumps(inputs)

)

image_caption = response["Body"].read().decode('utf-8')Você pode combinar o conteúdo das consultas e respostas com a legenda da imagem e usar essas informações recuperadas para a tarefa posterior, descrita na próxima seção abaixo.

Gere o resultado final e explicação com o LLM

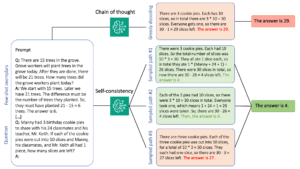

Modelos de linguagem grande (LLMs), como o Llama 2, podem gerar resultados de alta qualidade com o modelo de prompt correto. Usando JumpStart do Amazon SageMaker, os profissionais de ML podem escolher entre uma ampla seleção de modelos de base disponíveis publicamente. Com apenas alguns cliques no SageMaker Studio, agora você pode descubra e implante o Llama 2.

Os resultados finais contam com um LLM com um modelo de prompt específico. Tal alerta consiste em: a política de moderação baseada em categorias de inapropriados ou ofensivos categorias de moderação; informações de imagem extraídas do BLIP-2; o modelo de pergunta para o LLM perguntando se a foto contém conteúdo inseguro e solicitando sua categoria e motivo se for inseguro; e instruções para gerar os resultados no formato JSON. O modelo de prompt projetado permite que o LLM determine se a imagem viola a política de moderação, identifique a categoria da violação, explique o porquê e forneça a saída em um formato JSON estruturado.

O código-fonte principal é o seguinte:

prompt_template = f"""

The following is our company's content moderation policy, based on the moderation policy, we gather image information from the user uploaded image. Please answer the question with json format. ###### moderation policy ######

{moderation_policy} ###### Image information ######

{conversations} ###### Question ######

Based on the following Moderation policy and QA, tell me if the photo containes unsafe content, also give its category and reason if it's unsafe. Please anwser the question with the following format and only put explanation into the reason field: """ prompt_template += """

{ "flag": "xxx", "category": "xxx", "reason": "the reason is ..."

} """ dialog = [ {"role": "user", "content": prompt_template}

]Você pode personalizar o prompt com base em seu próprio caso de uso. Consulte o caderno para mais detalhes. Quando o prompt estiver pronto, você poderá invocar o endpoint LLM para gerar resultados:

endpoint_name = "jumpstart-dft-meta-textgeneration-llama-2-70b-f" def query_endpoint(payload): client = boto3.client("sagemaker-runtime") response = client.invoke_endpoint( EndpointName=endpoint_name, ContentType="application/json", Body=json.dumps(payload), CustomAttributes="accept_eula=true", ) response = response["Body"].read().decode("utf8") response = json.loads(response) return response payload = { "inputs": [dialog], "parameters": {"max_new_tokens": 256, "top_p": 0.9, "temperature": 0.5}

}

result = query_endpoint(payload)[0]Parte da saída gerada é a seguinte:

Ocasionalmente, o Llama 2 anexa explicações adicionais além da resposta do assistente. Você poderia usar o código de análise para extrair dados JSON dos resultados originais gerados:

answer = result['generation']['content'].split('}')[0]+'}'

json.loads(answer)

Vantagens das abordagens generativas

As seções anteriores mostraram como implementar a parte central da inferência de modelo. Nesta seção, cobrimos vários aspectos das abordagens generativas, incluindo comparações com abordagens e perspectivas convencionais.

A tabela a seguir compara cada abordagem.

| . | Abordagem Generativa | Abordagem de Classificação |

| Adquirindo dados rotulados | Modelo pré-treinado em um grande número de imagens, inferência zero-shot | Requer dados de todos os tipos de categorias |

| Generalização do modelo | Modelo pré-treinado com vários tipos de imagens | Requer um grande volume de dados relacionados à moderação de conteúdo para melhorar a generalização do modelo |

| Eficiência operacional | Capacidades de tiro zero | Requer treinamento do modelo para reconhecer diferentes padrões e retreinamento quando rótulos são adicionados |

| Explicação | Raciocínio como saída de texto, ótima experiência do usuário | Difícil de conseguir raciocínio, difícil de explicar e interpretar |

| Natureza adversária | Robusto | Retreinamento de alta frequência |

Possíveis casos de uso de raciocínio multimodal além da moderação de conteúdo

Os modelos BLIP-2 podem ser aplicados para atender a diversas finalidades, com ou sem ajuste fino, que inclui o seguinte:

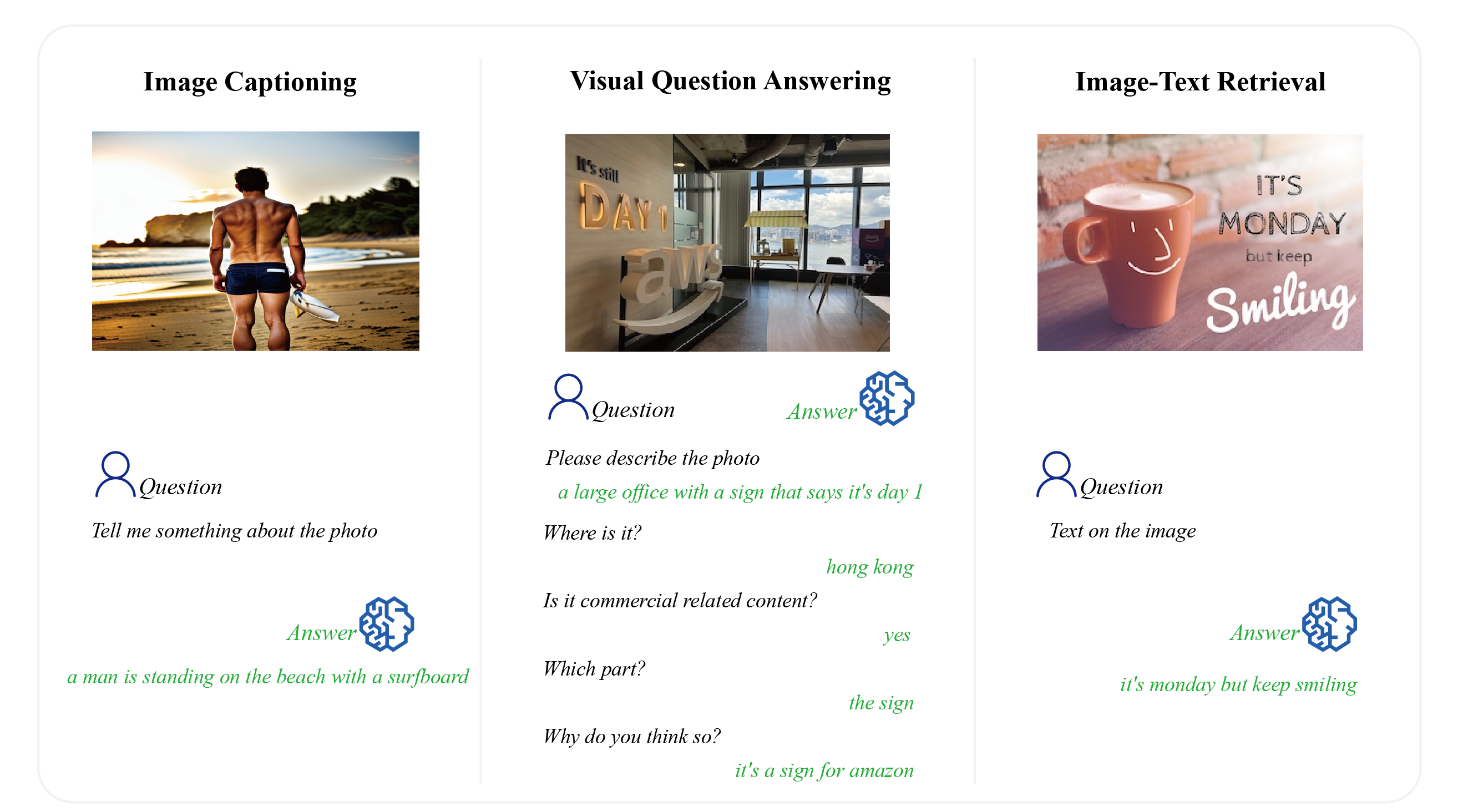

- Legendagem de imagens – Solicita ao modelo que gere uma descrição de texto para o conteúdo visual da imagem. Conforme ilustrado na imagem de exemplo a seguir (à esquerda), podemos ter “um homem está parado na praia com uma prancha de surf” como a descrição da imagem.

- Resposta a perguntas visuais – Como mostra o exemplo da imagem do meio, podemos perguntar “É conteúdo comercial” e nós temos "sim" como a resposta. Além disso, o BLIP-2 oferece suporte à conversa em várias rodadas e gera a seguinte pergunta: "Porque você acha isso?" Com base na sugestão visual e nos recursos LLM, o BLIP-2 produz “é um sinal para a Amazon.”

- Recuperação de texto de imagem – Dada a questão como “Texto na imagem”, podemos extrair o texto da imagem “é segunda-feira, mas continue sorrindo” conforme demonstrado na imagem à direita.

As imagens a seguir mostram exemplos para demonstrar a capacidade de imagem para texto de disparo zero do raciocínio de conhecimento visual.

Como podemos ver nos vários exemplos acima, os modelos multimodalidade abrem novas oportunidades para resolver problemas complexos que os modelos tradicionais de modalidade única teriam dificuldade em resolver.

limpar

Para evitar cobranças futuras, exclua os recursos criados como parte desta postagem. Você pode fazer isso seguindo as instruções na seção de limpeza do notebook ou excluir os endpoints criados por meio do console SageMaker e dos recursos armazenados no bucket S3.

Conclusão

Neste post discutimos a importância da moderação de conteúdo no mundo digital e destacamos seus desafios. Propusemos um novo método para ajudar a melhorar a moderação de conteúdo com dados de imagem e realizar respostas a perguntas sobre as imagens para extrair automaticamente informações úteis. Também fornecemos uma discussão mais aprofundada sobre as vantagens de usar uma abordagem generativa baseada em IA em comparação com a abordagem tradicional baseada em classificação. Por último, ilustramos os possíveis casos de uso de modelos de linguagem visual além da moderação de conteúdo.

Incentivamos você a aprender mais explorando o SageMaker e construindo uma solução usando a solução multimodal fornecida nesta postagem e um conjunto de dados relevante para o seu negócio.

Sobre os autores

Gordon Wang é especialista sênior em IA/ML TAM na AWS. Ele oferece suporte a clientes estratégicos com as melhores práticas de IA/ML em vários setores. Ele é apaixonado por visão computacional, PNL, IA generativa e MLOps. Nas horas vagas, adora correr e fazer caminhadas.

Gordon Wang é especialista sênior em IA/ML TAM na AWS. Ele oferece suporte a clientes estratégicos com as melhores práticas de IA/ML em vários setores. Ele é apaixonado por visão computacional, PNL, IA generativa e MLOps. Nas horas vagas, adora correr e fazer caminhadas.

Yanwei Cui, PhD, é arquiteto de soluções especialista em aprendizado de máquina sênior na AWS. Ele iniciou pesquisas em aprendizado de máquina no IRISA (Instituto de Pesquisa de Ciência da Computação e Sistemas Aleatórios) e tem vários anos de experiência na construção de aplicações industriais baseadas em IA em visão computacional, processamento de linguagem natural e previsão on-line do comportamento do usuário. Na AWS, ele compartilha sua experiência no domínio e ajuda os clientes a desbloquear potenciais de negócios e gerar resultados acionáveis com aprendizado de máquina em escala. Fora do trabalho, ele gosta de ler e viajar.

Yanwei Cui, PhD, é arquiteto de soluções especialista em aprendizado de máquina sênior na AWS. Ele iniciou pesquisas em aprendizado de máquina no IRISA (Instituto de Pesquisa de Ciência da Computação e Sistemas Aleatórios) e tem vários anos de experiência na construção de aplicações industriais baseadas em IA em visão computacional, processamento de linguagem natural e previsão on-line do comportamento do usuário. Na AWS, ele compartilha sua experiência no domínio e ajuda os clientes a desbloquear potenciais de negócios e gerar resultados acionáveis com aprendizado de máquina em escala. Fora do trabalho, ele gosta de ler e viajar.

Melanie Li, PhD, é especialista sênior em AI/ML TAM na AWS com sede em Sydney, Austrália. Ela ajuda clientes corporativos a criar soluções usando ferramentas de IA/ML de última geração na AWS e fornece orientação sobre como arquitetar e implementar soluções de ML com as melhores práticas. Em seu tempo livre, ela adora explorar a natureza e passar tempo com a família e amigos.

Melanie Li, PhD, é especialista sênior em AI/ML TAM na AWS com sede em Sydney, Austrália. Ela ajuda clientes corporativos a criar soluções usando ferramentas de IA/ML de última geração na AWS e fornece orientação sobre como arquitetar e implementar soluções de ML com as melhores práticas. Em seu tempo livre, ela adora explorar a natureza e passar tempo com a família e amigos.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Automotivo / EVs, Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- ChartPrime. Eleve seu jogo de negociação com ChartPrime. Acesse aqui.

- BlockOffsets. Modernizando a Propriedade de Compensação Ambiental. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/build-a-generative-ai-based-content-moderation-solution-on-amazon-sagemaker-jumpstart/

- :tem

- :é

- :não

- :onde

- $UP

- 1

- 10

- 100

- 20

- 22

- 7

- 9

- 95%

- a

- Capaz

- Sobre

- acima

- Acesso

- Segundo

- Conta

- precisão

- Alcançar

- Alcança

- atores

- real

- adicionado

- acrescentando

- Adição

- Adicional

- Adicionalmente

- endereço

- aderente

- Adotando

- Adoção

- vantagens

- adversarial

- anunciantes

- Publicidade

- contra

- AI

- Alimentado por AI

- AI / ML

- algoritmos

- alinhamento

- Todos os Produtos

- permite

- tb

- Amazon

- Amazon Sage Maker

- JumpStart do Amazon SageMaker

- Amazon Web Services

- an

- analisar

- e

- Outro

- responder

- respostas

- qualquer

- aplicações

- aplicado

- abordagem

- se aproxima

- apropriado

- arquitetura

- SOMOS

- AS

- perguntar

- aspectos

- Assistente

- associações

- assume

- At

- auditivo

- Australia

- automaticamente

- disponível

- evitar

- AWS

- Mau

- baseado

- BE

- Beach

- Porque

- tornam-se

- torna-se

- comportamento

- ser

- abaixo

- benchmarks

- além de

- MELHOR

- melhores práticas

- Pós

- tendencioso

- sangue

- corpo

- ambos

- interesse?

- marcas

- Traz

- amplo

- orçamento

- construir

- Prédio

- negócio

- mas a

- by

- chamado

- CAN

- Pode obter

- capacidades

- capacidade

- cuidadoso

- casas

- casos

- Categorias

- Categoria

- desafiar

- desafios

- desafiante

- Alterações

- acusações

- chatbots

- Escolha

- aulas

- remover filtragem

- cliente

- roupas

- código

- Codificação

- combinar

- combina

- comercial

- comunidade

- edifício comunitário

- Empresa

- comparado

- completar

- integrações

- componente

- componentes

- computador

- Ciência da Computação

- Visão de Computador

- computadores

- Configuração

- Confirmar

- Conexão de

- conecta

- consideração

- considerado

- consiste

- cônsul

- constante

- constantemente

- Contacto

- não contenho

- Recipiente

- contém

- conteúdo

- Criação de conteúdo

- conteúdo

- contribuindo

- convencional

- Conversa

- conversas

- núcleo

- Correspondente

- Custo

- dispendioso

- custos

- poderia

- cobrir

- crio

- criado

- criação

- crítico

- Atravessar

- Clientes

- personalizar

- dados,

- segurança dos dados

- conjuntos de dados

- decisão

- decisões

- profundo

- definir

- definido

- demonstrar

- demonstraram

- demonstra

- implantar

- descrito

- descrição

- projetado

- concepção

- desejado

- Apesar de

- detalhes

- descobrir

- Determinar

- diálogo

- diferente

- digital

- mundo digital

- diretamente

- discutido

- discussão

- distribuições

- diferente

- do

- Estivador

- parece

- domínio

- distância

- cada

- facilidade

- facilmente

- efetivamente

- eficácia

- eficiente

- embutindo

- emergiu

- emergente

- emprega

- permitir

- permite

- encorajar

- final

- Ponto final

- Melhora

- suficiente

- garantir

- assegurando

- Empreendimento

- erros

- especialmente

- essencial

- exemplo

- exemplos

- existente

- vasta experiência

- experiência

- Explicação

- explicação

- explorar

- Explorando

- Exposição

- externo

- extrato

- Rosto

- Quedas

- família

- Característica

- Funcionalidades

- feminina

- poucos

- menos

- campo

- combate

- Envie o

- Arquivos

- final

- financiar

- Primeiro nome

- primeira vez

- caber

- marcado

- Foco

- seguir

- seguinte

- segue

- Escolha

- formato

- formas

- Foundation

- Frequência

- amigos

- da

- congelado

- funções

- mais distante

- futuro

- reunir

- gerar

- gerado

- gerando

- geração

- generativo

- IA generativa

- ter

- OFERTE

- dado

- ótimo

- Crescente

- Growth

- orientações

- manipular

- aconteceu

- Queijos duros

- Ter

- ter

- he

- Saúde

- informação de saúde

- saúde

- fortemente

- ajudar

- ajuda

- sua experiência

- oculto

- Alta

- alta performance

- alta qualidade

- Destaque

- sua

- hospedeiro

- hospedado

- hospedagem

- Como funciona o dobrador de carta de canal

- Como Negociar

- HTML

- http

- HTTPS

- humano

- identificar

- identificar

- Identidade

- if

- ilustra

- imagem

- imagens

- executar

- implementado

- implementação

- importar

- importância

- importante

- melhorar

- melhoria

- in

- impreciso

- incluir

- inclui

- Incluindo

- Crescimento

- Aumenta

- industrial

- indústrias

- indústria

- ineficiente

- INFORMAÇÕES

- entrada

- inputs

- instância

- Instituto

- instruções

- integrar

- interesse

- interno

- para dentro

- introduzir

- IT

- ESTÁ

- Java

- jpg

- json

- apenas por

- Guarda

- Conhecimento

- Rótulos

- língua

- grande

- Maior

- conduzir

- principal

- APRENDER

- aprendizagem

- esquerda

- Legal

- passivo

- Biblioteca

- leve

- Lista

- lhama

- LLM

- mais

- ama

- máquina

- aprendizado de máquina

- Manter

- fazer

- Fazendo

- homem

- gerencia

- manualmente

- muitos

- material

- Posso..

- me

- significado

- mecanismos

- Mídia

- Meta

- método

- métodos

- Coração

- ML

- MLOps

- modelo

- modelos

- moderação

- modificada

- Módulo

- Segunda-feira

- monitoração

- mais

- mais eficiente

- a maioria

- múltiplo

- natural

- Processamento de linguagem natural

- Natureza

- você merece...

- negativo

- Novo

- Próximo

- PNL

- caderno

- romance

- agora

- número

- of

- ofensivo

- on

- uma vez

- ONE

- online

- só

- aberto

- open source

- oportunidades

- otimizado

- or

- organizações

- original

- Outros

- A Nossa

- Sobre a empresa

- resultados

- Supera o desempenho

- saída

- lado de fora

- sobrecarregado

- próprio

- pacote

- Paralelo

- parâmetros

- parte

- particularmente

- peças

- passar

- apaixonado

- padrões

- Realizar

- atuação

- realizada

- permissões

- pessoa

- pessoal

- pessoas

- perspectivas

- phd

- foto

- essencial

- plataforma

- Plataformas

- platão

- Inteligência de Dados Platão

- PlatãoData

- desempenha

- por favor

- políticas

- Privacidade

- pobre

- Popular

- Publique

- potencial

- potenciais

- alimentado

- poderoso

- práticas

- predição

- Preparar

- presentes

- preservação

- impede

- Priorizar

- política de privacidade

- problemas

- processo

- em processamento

- Programação

- proposto

- proteção

- fornecer

- fornecido

- fornece

- público

- publicidade

- publicamente

- fins

- colocar

- Dúvidas

- qualidade

- consultas

- questão

- Frequentes

- acaso

- Leitura

- pronto

- razão

- reconhecer

- reconhecendo

- reduzir

- regularmente

- regulamentos

- relacionado

- relevante

- depender

- Removido

- representação

- representante

- reputação

- solicitar

- requerer

- exige

- pesquisa

- Recursos

- Responder

- resposta

- respostas

- resultar

- resultando

- Resultados

- retorno

- revelando

- receita

- Crescimento da receita

- RGB

- certo

- Risco

- riscos

- Tipo

- grosseiramente

- Regra

- Execute

- corrida

- s

- salvaguardando

- Segurança

- sábio

- Escala

- Ciência

- Pesquisar

- Segundo

- Seção

- seções

- Setores

- segurança

- Vejo

- doadores,

- senior

- sensível

- serve

- serviço

- Serviços

- de servir

- conjunto

- vários

- Sexual

- ações

- compartilhando

- ela

- Proteger

- mostrar

- mostrou

- Shows

- assinar

- significado

- de forma considerável

- Similarmente

- simples

- situações

- So

- Redes Sociais

- meios de comunicação social

- sociais plataformas de mídia

- solução

- Soluções

- Resolvendo

- fonte

- código fonte

- Fontes

- Espaço

- espaços

- Spam

- especialista

- específico

- discurso

- gastar

- divisão

- Etapa

- Estágio

- autônoma

- padrões

- começado

- estado-da-arte

- Unidos

- Status

- Passo

- Ainda

- armazenamento

- armazenadas

- Estratégico

- estruturada

- Lutar

- estudo

- Estudo

- tal

- sugerir

- suportes

- sydney

- sistemas

- mesa

- equipamento

- tática

- toma

- Tarefa

- tarefas

- equipes

- dizer

- modelo

- condições

- texto

- textual

- do que

- que

- A

- as informações

- deles

- Lá.

- assim

- assim sendo

- Este

- deles

- think

- Terceiro

- isto

- três

- tempo

- demorado

- para

- ferramentas

- tradicional

- Trem

- treinado

- Training

- transformador

- Viagens

- dois

- tipo

- tipos

- para

- compreender

- compreensão

- único

- Universal

- destravar

- Atualizada

- atualização

- Defender

- carregado

- usar

- caso de uso

- Utilizador

- Experiência do Usuário

- privacidade do usuário

- usuários

- utilização

- Valores

- variedade

- vário

- via

- Vídeo

- VIOLAÇÃO

- visão

- volume

- volumes

- Caminho..

- maneiras

- we

- web

- serviços web

- sites

- BEM

- O Quê

- quando

- qual

- porque

- precisarão

- de

- dentro

- sem

- palavras

- Atividades:

- trabalhar

- mundo

- seria

- anos

- Vocês

- investimentos

- zefirnet