Os clientes de saúde e ciências biológicas (HCLS) estão adotando a IA generativa como uma ferramenta para aproveitar melhor seus dados. Os casos de uso incluem o resumo de documentos para ajudar os leitores a se concentrarem nos pontos-chave de um documento e a transformação de texto não estruturado em formatos padronizados para destacar atributos importantes. Com formatos de dados exclusivos e requisitos regulatórios rigorosos, os clientes procuram opções para selecionar o modelo com melhor desempenho e custo-benefício, bem como a capacidade de realizar a personalização necessária (ajuste fino) para se adequar ao seu caso de uso comercial. Nesta postagem, orientamos você na implantação de um modelo de linguagem grande (LLM) Falcon usando JumpStart do Amazon SageMaker e usar o modelo para resumir documentos longos com LangChain e Python.

Visão geral da solução

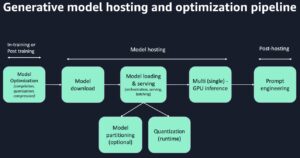

Amazon Sage Maker baseia-se nas duas décadas de experiência da Amazon no desenvolvimento de aplicativos de ML do mundo real, incluindo recomendações de produtos, personalização, compras inteligentes, robótica e dispositivos assistidos por voz. SageMaker é um serviço gerenciado qualificado para HIPAA que fornece ferramentas que permitem que cientistas de dados, engenheiros de ML e analistas de negócios inovem com ML. Dentro do SageMaker está Estúdio Amazon SageMaker, um ambiente de desenvolvimento integrado (IDE) desenvolvido especificamente para fluxos de trabalho colaborativos de ML, que, por sua vez, contém uma ampla variedade de soluções de início rápido e modelos de ML pré-treinados em um hub integrado chamado SageMaker JumpStart. Com o SageMaker JumpStart, você pode usar modelos pré-treinados, como o Falcon LLM, com notebooks de amostra pré-construídos e suporte SDK para experimentar e implantar esses poderosos modelos de transformadores. Você pode usar o SageMaker Studio e o SageMaker JumpStart para implantar e consultar seu próprio modelo generativo em sua conta da AWS.

Você também pode garantir que os dados da carga útil de inferência não saiam da VPC. Você pode provisionar modelos como endpoints de locatário único e implantá-los com isolamento de rede. Além disso, você pode selecionar e gerenciar o conjunto selecionado de modelos que atendem aos seus próprios requisitos de segurança usando o recurso de hub de modelo privado no SageMaker JumpStart e armazenando os modelos aprovados nele. SageMaker está no escopo para HIPAA BAA, SOC123 e HITRUST LCR.

A Falcão LLM é um grande modelo de linguagem, treinado por pesquisadores do Technology Innovation Institute (TII) em mais de 1 trilhão de tokens usando AWS. O Falcon tem muitas variações diferentes, com seus dois constituintes principais, Falcon 40B e Falcon 7B, compostos por 40 bilhões e 7 bilhões de parâmetros, respectivamente, com versões ajustadas e treinadas para tarefas específicas, como seguir instruções. O Falcon tem um bom desempenho em uma variedade de tarefas, incluindo resumo de texto, análise de sentimentos, resposta a perguntas e conversas. Esta postagem fornece um passo a passo que você pode seguir para implantar o Falcon LLM em sua conta AWS, usando uma instância de notebook gerenciado por meio do SageMaker JumpStart para experimentar o resumo de texto.

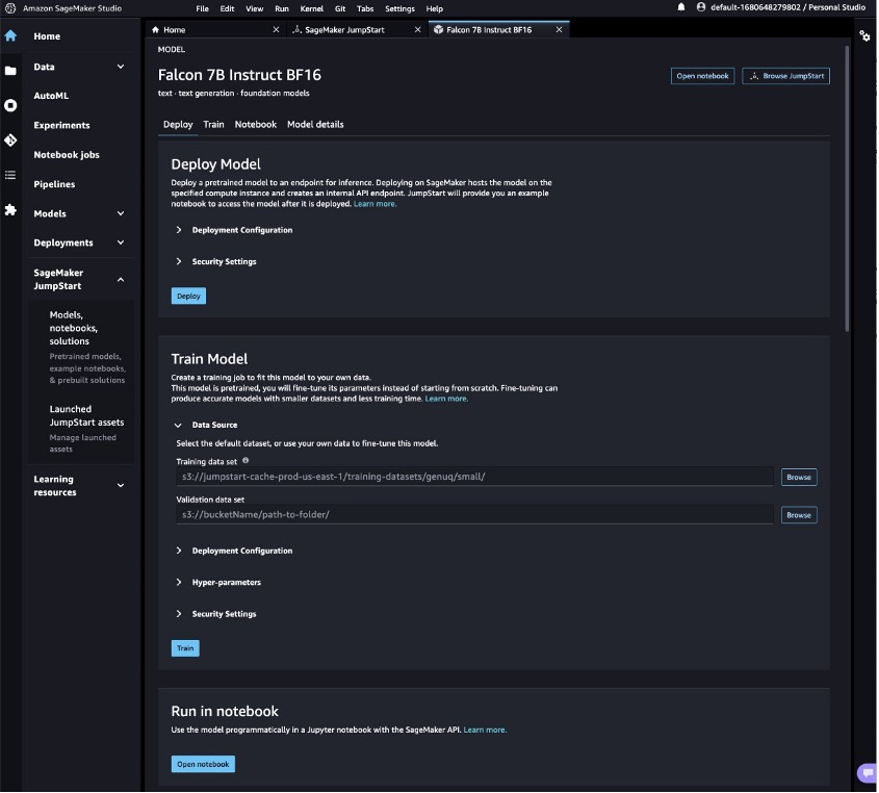

O hub do modelo SageMaker JumpStart inclui notebooks completos para implantar e consultar cada modelo. No momento em que este artigo foi escrito, havia seis versões do Falcon disponíveis no hub do modelo SageMaker JumpStart: Falcon 40B Instruct BF16, Falcon 40B BF16, Falcon 180B BF16, Falcon 180B Chat BF16, Falcon 7B Instruct BF16 e Falcon 7B BF16. Esta postagem usa o modelo Falcon 7B Instruct.

Nas seções a seguir, mostramos como começar a resumir documentos implantando o Falcon 7B no SageMaker Jumpstart.

Pré-requisitos

Para este tutorial, você precisará de uma conta AWS com um domínio SageMaker. Se você ainda não possui um domínio SageMaker, consulte Integrado ao domínio do Amazon SageMaker para criar um.

Implante o Falcon 7B usando o SageMaker JumpStart

Para implantar seu modelo, conclua as etapas a seguir:

- Navegue até o ambiente do SageMaker Studio no console do SageMaker.

- Dentro do IDE, em SageMaker JumpStart no painel de navegação, escolha Modelos, notebooks, soluções.

- Implante o modelo Falcon 7B Instruct em um endpoint para inferência.

Isso abrirá o cartão de modelo do modelo Falcon 7B Instruct BF16. Nesta página você encontra o Implantação or Trem opções, bem como links para abrir os blocos de notas de amostra no SageMaker Studio. Esta postagem usará o notebook de exemplo do SageMaker JumpStart para implantar o modelo.

- Escolha Caderno aberto.

- Execute as primeiras quatro células do notebook para implantar o endpoint Falcon 7B Instruct.

Você pode ver seus modelos JumpStart implantados na página Ativos JumpStart lançados Disputas de Comerciais.

- No painel de navegação, em Início rápido do SageMaker, escolha Ativos JumpStart lançados.

- Escolha o Pontos de extremidade do modelo para visualizar o status do seu endpoint.

Com o endpoint Falcon LLM implantado, você está pronto para consultar o modelo.

Execute sua primeira consulta

Para executar uma consulta, conclua as seguintes etapas:

- No Envie o menu, escolha Novo e Portátil para abrir um novo bloco de notas.

Você também pode baixar o caderno completo SUA PARTICIPAÇÃO FAZ A DIFERENÇA.

- Selecione a imagem, o kernel e o tipo de instância quando solicitado. Para esta postagem, escolhemos a imagem Data Science 3.0, o kernel Python 3 e a instância ml.t3.medium.

- Importe os módulos Boto3 e JSON inserindo as duas linhas a seguir na primeira célula:

- Press Shift+Enter para executar a célula.

- A seguir, você pode definir uma função que chamará seu endpoint. Esta função pega uma carga de dicionário e a usa para invocar o cliente de tempo de execução SageMaker. Em seguida, desserializa a resposta e imprime a entrada e o texto gerado.

A carga inclui o prompt como entradas, juntamente com os parâmetros de inferência que serão passados para o modelo.

- Você pode usar estes parâmetros com o prompt para ajustar a saída do modelo para seu caso de uso:

Consulta com um prompt de resumo

Esta postagem usa um exemplo de artigo de pesquisa para demonstrar o resumo. O arquivo de texto de exemplo refere-se ao resumo automático de texto na literatura biomédica. Conclua as seguintes etapas:

- Baixar o PDF e copie o texto em um arquivo chamado

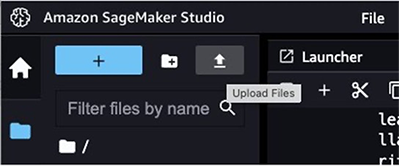

document.txt. - No SageMaker Studio, escolha o ícone de upload e carregue o arquivo para sua instância do SageMaker Studio.

Pronto para uso, o Falcon LLM fornece suporte para resumo de texto.

- Vamos criar uma função que use técnicas de engenharia imediata para resumir

document.txt:

Você notará que, para documentos mais longos, aparece um erro – o Falcon, junto com todos os outros LLMs, tem um limite no número de tokens passados como entrada. Podemos contornar esse limite usando os recursos aprimorados de resumo do LangChain, que permitem que uma entrada muito maior seja passada para o LLM.

Importe e execute uma cadeia de resumo

LangChain é uma biblioteca de software de código aberto que permite que desenvolvedores e cientistas de dados criem, ajustem e implantem rapidamente aplicativos generativos personalizados sem gerenciar interações complexas de ML, comumente usado para abstrair muitos dos casos de uso comuns para modelos de linguagem de IA generativos em apenas alguns linhas de código. O suporte do LangChain para serviços AWS inclui suporte para endpoints SageMaker.

LangChain fornece uma interface acessível para LLMs. Seus recursos incluem ferramentas para modelagem e encadeamento de prompts. Essas cadeias podem ser usadas para resumir documentos de texto que são mais longos do que o modelo de linguagem suporta em uma única chamada. Você pode usar uma estratégia de redução de mapa para resumir documentos longos, dividindo-os em partes gerenciáveis, resumindo-os e combinando-os (e resumindo-os novamente, se necessário).

- Vamos instalar o LangChain para começar:

- Importe os módulos relevantes e divida o documento longo em partes:

- Para fazer o LangChain funcionar de maneira eficaz com o Falcon, você precisa definir as classes de manipulador de conteúdo padrão para entrada e saída válidas:

- Você pode definir prompts personalizados como

PromptTemplateobjetos, o principal veículo de prompt com LangChain, para a abordagem de resumo de redução de mapa. Esta é uma etapa opcional porque os prompts de mapeamento e combinação são fornecidos por padrão se os parâmetros na chamada para carregar a cadeia de resumo (load_summarize_chain) são indefinidos.

- LangChain oferece suporte a LLMs hospedados em endpoints de inferência do SageMaker, portanto, em vez de usar o AWS Python SDK, você pode inicializar a conexão por meio do LangChain para maior acessibilidade:

- Finalmente, você pode carregar uma cadeia de resumo e executar um resumo nos documentos de entrada usando o seguinte código:

Porque o verbose parâmetro está definido como True, você verá todos os resultados intermediários da abordagem de redução de mapa. Isto é útil para seguir a sequência de eventos para chegar a um resumo final. Com essa abordagem de redução de mapa, você pode resumir documentos de maneira eficaz por muito mais tempo do que normalmente é permitido pelo limite máximo de tokens de entrada do modelo.

limpar

Depois de terminar de usar o endpoint de inferência, é importante excluí-lo para evitar incorrer em custos desnecessários por meio das seguintes linhas de código:

Usando outros modelos de base no SageMaker JumpStart

A utilização de outros modelos básicos disponíveis no SageMaker JumpStart para resumo de documentos requer sobrecarga mínima para configuração e implantação. Ocasionalmente, os LLMs variam de acordo com a estrutura dos formatos de entrada e saída e, à medida que novos modelos e soluções pré-fabricadas são adicionados ao SageMaker JumpStart, dependendo da implementação da tarefa, pode ser necessário fazer as seguintes alterações no código:

- Se você estiver executando a compactação por meio do

summarize()método (o método sem usar LangChain), pode ser necessário alterar a estrutura JSON dopayloadparâmetro, bem como o tratamento da variável de resposta noquery_endpoint()função - Se você estiver realizando um resumo via LangChain's

load_summarize_chain()método, talvez seja necessário modificar oContentHandlerTextSummarizationclasse, especificamente otransform_input()etransform_output()funções, para lidar corretamente com a carga útil que o LLM espera e a saída que o LLM retorna

Os modelos básicos variam não apenas em fatores como velocidade e qualidade de inferência, mas também em formatos de entrada e saída. Consulte a página de informações relevantes do LLM sobre entradas e saídas esperadas.

Conclusão

O modelo Falcon 7B Instruct está disponível no hub do modelo SageMaker JumpStart e funciona em vários casos de uso. Esta postagem demonstrou como você pode implantar seu próprio endpoint Falcon LLM em seu ambiente usando o SageMaker JumpStart e fazer seus primeiros experimentos no SageMaker Studio, permitindo que você crie protótipos rapidamente de seus modelos e faça uma transição perfeita para um ambiente de produção. Com Falcon e LangChain, você pode resumir com eficácia documentos extensos de saúde e ciências biológicas em grande escala.

Para obter mais informações sobre como trabalhar com IA generativa na AWS, consulte Anunciando novas ferramentas para criar com IA generativa na AWS. Você pode começar a experimentar e criar provas de conceito de resumo de documentos para seus aplicativos GenAI orientados para saúde e ciências biológicas usando o método descrito nesta postagem. Quando Rocha Amazônica estiver disponível para o público geral, publicaremos uma postagem de acompanhamento mostrando como você pode implementar o resumo de documentos usando Amazon Bedrock e LangChain.

Sobre os autores

John Kitaoka é arquiteto de soluções na Amazon Web Services. John ajuda os clientes a projetar e otimizar cargas de trabalho de IA/ML na AWS para ajudá-los a atingir suas metas de negócios.

John Kitaoka é arquiteto de soluções na Amazon Web Services. John ajuda os clientes a projetar e otimizar cargas de trabalho de IA/ML na AWS para ajudá-los a atingir suas metas de negócios.

Josh Famestad é arquiteto de soluções na Amazon Web Services. Josh trabalha com clientes do setor público para criar e executar abordagens baseadas em nuvem para atender às prioridades de negócios.

Josh Famestad é arquiteto de soluções na Amazon Web Services. Josh trabalha com clientes do setor público para criar e executar abordagens baseadas em nuvem para atender às prioridades de negócios.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/create-an-hcls-document-summarization-application-with-falcon-using-amazon-sagemaker-jumpstart/

- :tem

- :é

- :não

- $UP

- 1

- 10

- 100

- 11

- 12

- 14

- 150

- 16

- 1M

- 20

- 40

- 400

- 50

- 500

- 7

- a

- habilidade

- RESUMO

- Aceita

- acessibilidade

- acessível

- Conta

- Alcançar

- adicionado

- Adotando

- novamente

- AI

- AI / ML

- Todos os Produtos

- permitidas

- Permitindo

- permite

- ao lado de

- já

- tb

- Amazon

- Amazon Sage Maker

- JumpStart do Amazon SageMaker

- Amazon Web Services

- an

- análise

- Analistas

- e

- animal

- animais

- Aplicação

- aplicações

- abordagem

- se aproxima

- aprovou

- SOMOS

- por aí

- AS

- At

- atributos

- Automático

- disponível

- evitar

- AWS

- baseado

- BE

- Porque

- começar

- acredita

- bilhão

- biomédica

- corpo

- pino

- Caixa

- Break

- Quebra

- construir

- Prédio

- construído

- negócio

- mas a

- by

- chamada

- chamado

- CAN

- Pode obter

- capacidades

- capacidade

- cartão

- casas

- casos

- Células

- cadeia

- correntes

- alterar

- Alterações

- escolhas

- Escolha

- escolha

- classe

- aulas

- cliente

- Na nuvem

- código

- colaborativo

- combinar

- combinando

- comum

- geralmente

- comparado

- completar

- Efetuado

- integrações

- Composto

- conceito

- conciso

- da conexão

- cônsul

- não contenho

- conteúdo

- relação custo-benefício

- custos

- crio

- personalizadas

- Clientes

- personalização

- dados,

- ciência de dados

- décadas

- Padrão

- definir

- entregar

- demonstrar

- demonstraram

- Dependendo

- implantar

- implantado

- Implantação

- desenvolvimento

- Design

- desenvolvedores

- em desenvolvimento

- Desenvolvimento

- Dispositivos/Instrumentos

- diferente

- do

- documento

- INSTITUCIONAIS

- Não faz

- domínio

- não

- down

- download

- cada

- terra

- efetivamente

- permitir

- Ponto final

- Engenharia

- Engenheiros

- aprimorada

- garantir

- entrar

- Meio Ambiente

- erro

- eventos

- exemplo

- executar

- esperado

- espera

- vasta experiência

- experimentar

- experimentos

- Rosto

- fatores

- falso

- Funcionalidades

- poucos

- Envie o

- final

- Encontre

- Primeiro nome

- caber

- Foco

- seguir

- seguinte

- Escolha

- Foundation

- quatro

- da

- função

- funções

- Além disso

- geralmente

- gerar

- gerado

- generativo

- IA generativa

- ter

- Objetivos

- maior

- manipular

- Manipulação

- Ter

- saúde

- ajudar

- ajuda

- Destaques

- hospedado

- Como funciona o dobrador de carta de canal

- Como Negociar

- HTML

- HTTPS

- Hub

- ÍCONE

- if

- imagem

- executar

- implementação

- importar

- importante

- in

- incluir

- inclui

- Incluindo

- INFORMAÇÕES

- inovar

- Inovação

- entrada

- inputs

- instalar

- instância

- em vez disso

- Instituto

- instruções

- integrado

- Inteligente

- interações

- Interface

- para dentro

- isolamento

- IT

- ESTÁ

- banheiro

- json

- apenas por

- Chave

- língua

- grande

- Maior

- lançado

- Deixar

- Biblioteca

- vida

- Ciências da Vida

- LIMITE

- linhas

- Links

- literatura

- LLM

- carregar

- longo

- mais

- procurando

- a Principal

- fazer

- gerencia

- manejável

- gerenciados

- gestão

- muitos

- mapeamento

- máximo

- Posso..

- média

- Menu

- método

- mínimo

- ML

- modelo

- modelos

- modificar

- Módulos

- mais

- a maioria

- muito

- Navegação

- necessário

- você merece...

- necessário

- rede

- Novo

- NIH

- normalmente

- caderno

- Perceber..

- número

- objetos

- of

- on

- ONE

- só

- aberto

- open source

- Software livre

- Otimize

- Opções

- Outros

- delineado

- saída

- Acima de

- próprio

- página

- pão

- Papel

- parâmetro

- parâmetros

- passou

- Realizar

- realização

- executa

- Personalização

- platão

- Inteligência de Dados Platão

- PlatãoData

- pontos

- Publique

- poderoso

- Impressão

- impressões

- privado

- processo

- Produto

- Produção

- provas

- protótipo

- fornecer

- fornecido

- fornece

- provisão

- público

- publicar

- Python

- qualidade

- questão

- rapidamente

- rapidamente

- leitores

- pronto

- mundo real

- recomendações

- referir

- reguladores

- relevante

- Requisitos

- exige

- pesquisa

- pesquisadores

- respectivamente

- resposta

- retorno

- robótica

- Execute

- sábio

- Inferência do SageMaker

- Escala

- Ciência

- CIÊNCIAS

- cientistas

- escopo

- Sdk

- sem problemas

- seções

- setor

- segurança

- Vejo

- selecionado

- AUTO

- sentimento

- Seqüência

- serviço

- Serviços

- conjunto

- contexto

- minha

- Baixo

- mostrar

- solteiro

- SIX

- So

- Software

- Soluções

- específico

- especificamente

- velocidade

- começo

- começado

- Status

- Passo

- Passos

- armazenar

- Estratégia

- Estrito

- estrutura

- estudo

- tal

- resumir

- RESUMO

- ajuda

- suportes

- toma

- Tarefa

- tarefas

- técnicas

- Tecnologia

- Inovação Tecnológica

- texto

- do que

- que

- A

- deles

- Eles

- então

- Lá.

- Este

- isto

- Através da

- para

- juntos

- token

- Tokens

- ferramenta

- ferramentas

- treinado

- transformador

- transformando

- transição

- Trilhão

- verdadeiro

- VIRAR

- tutorial

- dois

- tipo

- indefinido

- único

- desnecessário

- Upload

- usar

- caso de uso

- usava

- usos

- utilização

- variável

- variedade

- veículo

- versões

- via

- Ver

- andar

- Passo a passo

- we

- web

- serviços web

- BEM

- O Quê

- quando

- qual

- Largo

- precisarão

- de

- dentro

- sem

- Atividades:

- fluxos de trabalho

- trabalhar

- trabalho

- escrever

- escrita

- Vocês

- investimentos

- zefirnet