Clientes de todos os tamanhos e setores estão inovando na AWS ao incorporar machine learning (ML) em seus produtos e serviços. Desenvolvimentos recentes em modelos generativos de IA aceleraram ainda mais a necessidade de adoção de ML em todos os setores. No entanto, a implementação de controles de segurança, privacidade de dados e governança ainda são os principais desafios enfrentados pelos clientes ao implementar cargas de trabalho de ML em escala. Enfrentar esses desafios cria a estrutura e as bases para a mitigação de riscos e o uso responsável de produtos baseados em ML. Embora a IA generativa possa necessitar de controlos adicionais, como a remoção de toxicidade e a prevenção de jailbreak e alucinações, partilha os mesmos componentes fundamentais de segurança e governação que o BC tradicional.

Ouvimos dos clientes que eles necessitam de conhecimento especializado e investimento de até 12 meses para construir seus projetos customizados Amazon Sage Maker Implementação de plataforma de ML para garantir ambientes de ML escalonáveis, confiáveis, seguros e governados para suas linhas de negócios (LOBs) ou equipes de ML. Se você não tiver uma estrutura para governar o ciclo de vida de ML em escala, poderá enfrentar desafios como isolamento de recursos em nível de equipe, dimensionamento de recursos de experimentação, operacionalização de fluxos de trabalho de ML, dimensionamento de governança de modelo e gerenciamento de segurança e conformidade de cargas de trabalho de ML.

Governar o ciclo de vida de ML em escala é uma estrutura para ajudá-lo a construir uma plataforma de ML com segurança incorporada e controles de governança com base nas práticas recomendadas do setor e nos padrões empresariais. Esta estrutura aborda desafios, fornecendo orientação prescritiva através de uma abordagem de estrutura modular que estende um Torre de controle AWS ambiente AWS multicontas e a abordagem discutida na postagem Configurar ambientes de machine learning seguros e bem controlados na AWS.

Ele fornece orientação prescritiva para as seguintes funções da plataforma de ML:

- Fundamentos de múltiplas contas, segurança e rede – Esta função usa AWS Control Tower e princípios bem arquitetados para configurar e operar ambiente de múltiplas contas, segurança e serviços de rede.

- Fundamentos de dados e governança – Esta função usa um arquitetura de malha de dados para configurar e operar o data lake, o armazenamento central de recursos e as bases de governança de dados para permitir acesso detalhado aos dados.

- Serviços compartilhados e de governança da plataforma de ML – Esta função permite configurar e operar serviços comuns como CI/CD, Catálogo de serviços da AWS para ambientes de provisionamento e um registro central de modelos para promoção e linhagem de modelos.

- Ambientes de equipe de ML – Esta função permite configurar e operar ambientes para equipes de ML para desenvolvimento de modelos, testes e implantação de seus casos de uso para incorporar controles de segurança e governança.

- Observabilidade da plataforma de ML – Esta função ajuda na solução de problemas e na identificação da causa raiz dos problemas em modelos de ML por meio da centralização de logs e do fornecimento de ferramentas para visualização de análise de logs. Ele também fornece orientação para gerar relatórios de custo e uso para casos de uso de ML.

Embora esta estrutura possa proporcionar benefícios a todos os clientes, é mais benéfica para clientes de empresas grandes, maduras, regulamentadas ou globais que pretendam escalar as suas estratégias de ML numa abordagem controlada, compatível e coordenada em toda a organização. Ajuda a permitir a adoção de ML e, ao mesmo tempo, a mitigar riscos. Esta estrutura é útil para os seguintes clientes:

- Clientes de grandes empresas que possuem muitos LOBs ou departamentos interessados em usar ML. Essa estrutura permite que diferentes equipes criem e implantem modelos de ML de forma independente, ao mesmo tempo que fornece governança central.

- Clientes corporativos com maturidade moderada a alta em ML. Eles já implantaram alguns modelos iniciais de ML e estão buscando dimensionar seus esforços de ML. Essa estrutura pode ajudar a acelerar a adoção do ML em toda a organização. Estas empresas também reconhecem a necessidade de governação para gerir questões como controlo de acesso, utilização de dados, desempenho de modelos e preconceitos injustos.

- Empresas em setores regulamentados, como serviços financeiros, saúde, química e setor privado. Estas empresas precisam de uma governação forte e de audibilidade para quaisquer modelos de ML utilizados nos seus processos de negócio. A adopção deste quadro pode ajudar a facilitar a conformidade, ao mesmo tempo que permite o desenvolvimento de um modelo local.

- Organizações globais que precisam equilibrar o controle centralizado e local. A abordagem federada desta estrutura permite que a equipe central de engenharia da plataforma defina algumas políticas e padrões de alto nível, mas também dá às equipes LOB flexibilidade para se adaptarem com base nas necessidades locais.

Na primeira parte desta série, percorremos a arquitetura de referência para configurar a plataforma de ML. Em uma postagem posterior, forneceremos orientações prescritivas sobre como implementar os diversos módulos da arquitetura de referência em sua organização.

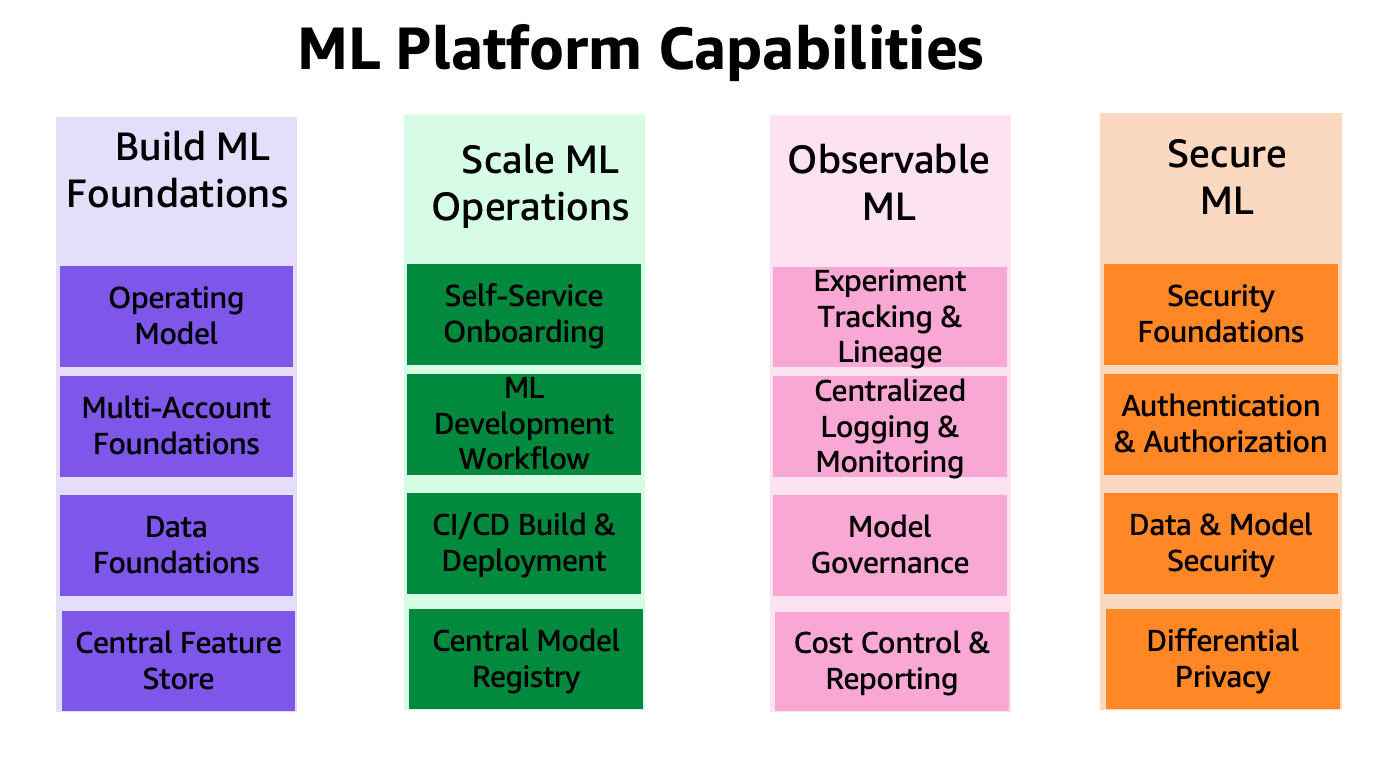

Os recursos da plataforma de ML são agrupados em quatro categorias, conforme mostrado na figura a seguir. Esses recursos formam a base da arquitetura de referência discutida posteriormente nesta postagem:

- Crie bases de ML

- Escale as operações de ML

- ML observável

- ML seguro

Visão geral da solução

A estrutura para governar o ciclo de vida do ML em escala permite que as organizações incorporem controles de segurança e governança em todo o ciclo de vida do ML, o que, por sua vez, ajuda as organizações a reduzir riscos e a acelerar a introdução do ML em seus produtos e serviços. A estrutura ajuda a otimizar a configuração e a governança de ambientes de ML seguros, escalonáveis e confiáveis que podem ser dimensionados para dar suporte a um número crescente de modelos e projetos. A estrutura permite os seguintes recursos:

- Provisionamento de conta e infraestrutura com recursos de infraestrutura compatíveis com a política da organização

- Implantação de autoatendimento de ambientes de ciência de dados e modelos completos de operações de ML (MLOps) para casos de uso de ML

- Isolamento de recursos em nível LOB ou em nível de equipe para conformidade com segurança e privacidade

- Acesso controlado a dados de nível de produção para experimentação e fluxos de trabalho prontos para produção

- Gerenciamento e governança para repositórios de código, pipelines de código, modelos implantados e recursos de dados

- Um modelo de registro e armazenamento de recursos (componentes locais e centrais) para melhorar a governança

- Controles de segurança e governança para o processo de desenvolvimento e implantação de modelo de ponta a ponta

Nesta seção, fornecemos uma visão geral das orientações prescritivas para ajudá-lo a construir esta plataforma de ML na AWS com segurança incorporada e controles de governança.

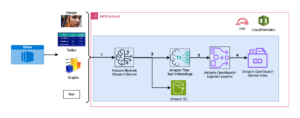

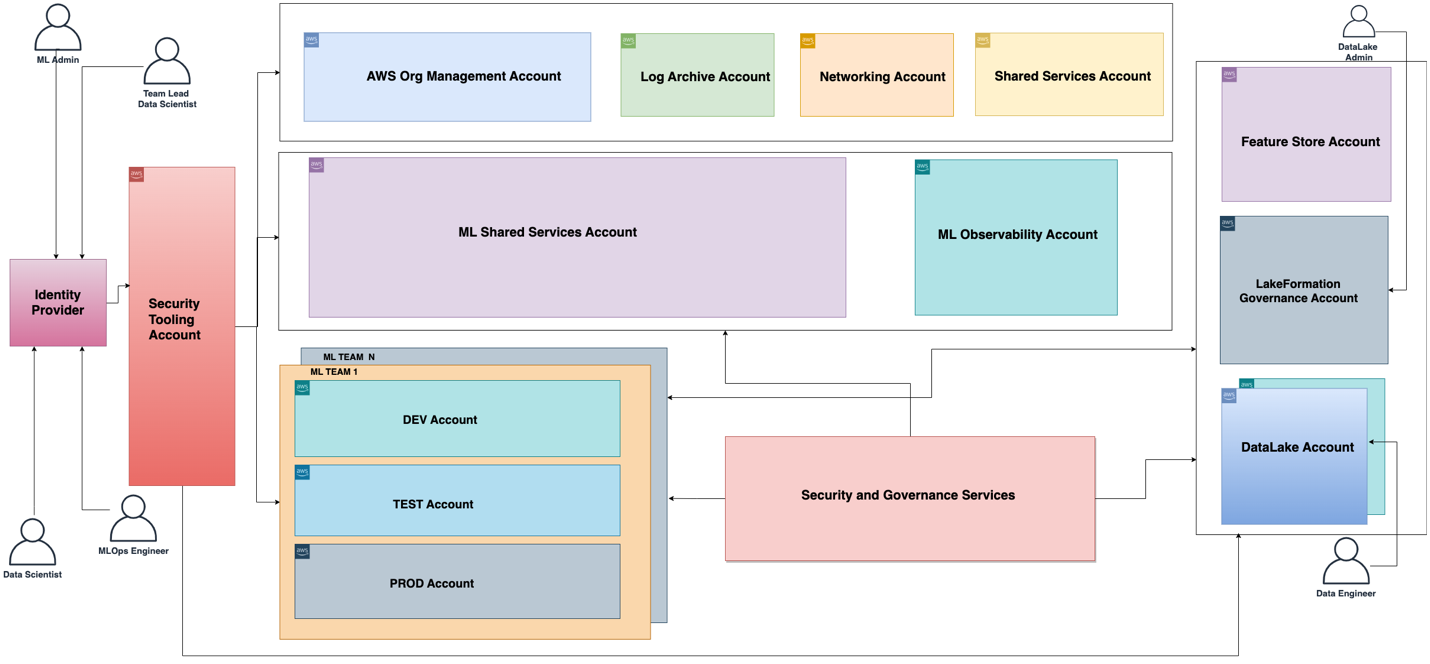

A arquitetura funcional associada à plataforma de ML é mostrada no diagrama a seguir. A arquitetura mapeia os diferentes recursos da plataforma de ML para contas AWS.

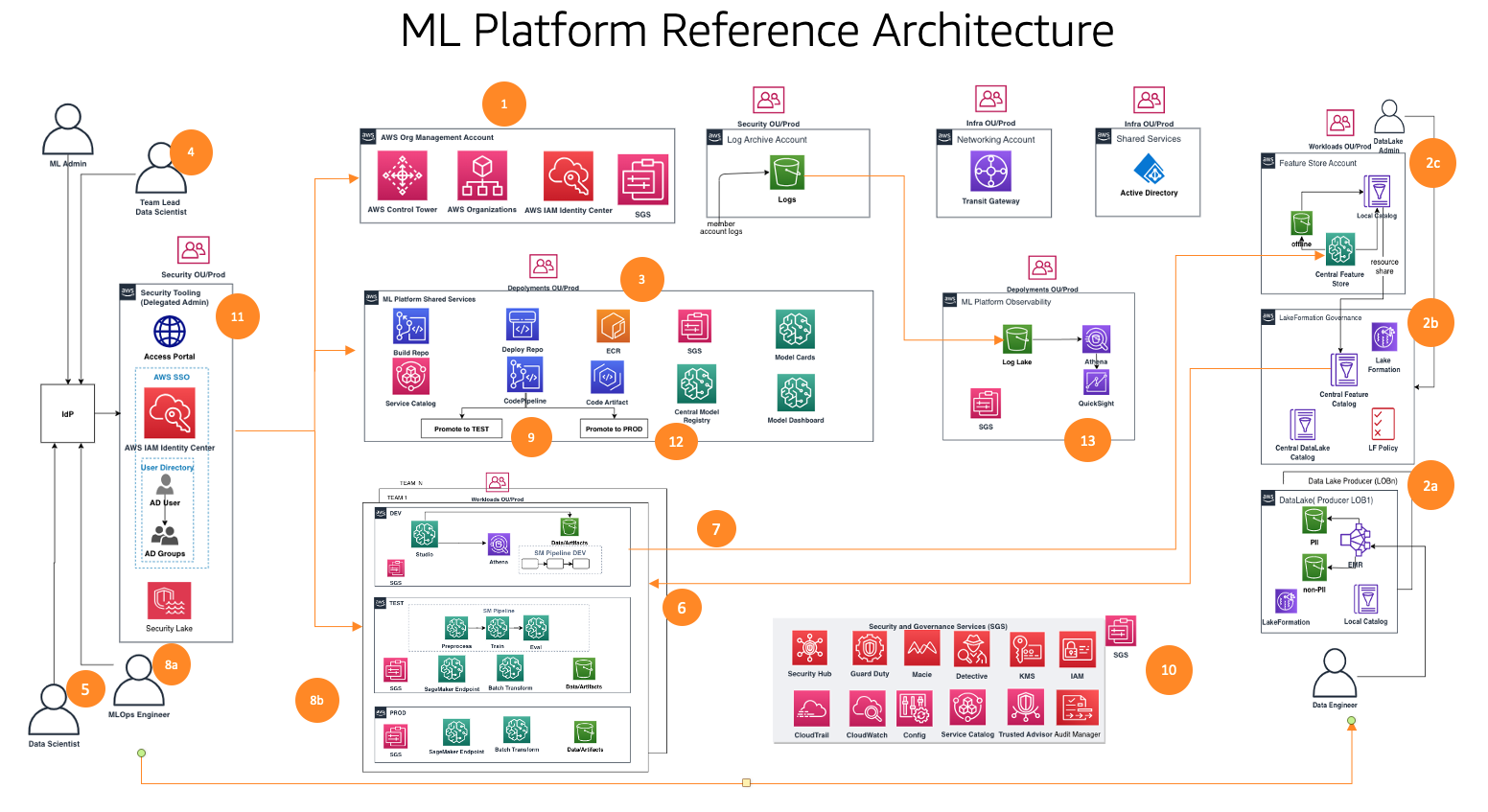

A arquitetura funcional com diferentes capacidades é implementada usando vários serviços AWS, incluindo Organizações da AWS, SageMaker, serviços AWS DevOps e um data lake. A arquitetura de referência para a plataforma de ML com vários serviços da AWS é mostrada no diagrama a seguir.

Esta estrutura considera múltiplas personas e serviços para governar o ciclo de vida do ML em escala. Recomendamos os seguintes passos para organizar suas equipes e serviços:

- Usando o AWS Control Tower e ferramentas de automação, seu administrador de nuvem configura as bases de múltiplas contas, como Organizações e Centro de identidade do AWS IAM (sucessor do AWS Single Sign-On) e serviços de segurança e governança, como Serviço de gerenciamento de chaves AWS (AWS KMS) e Catálogo de Serviços. Além disso, o administrador configura uma variedade de unidades organizacionais (OUs) e contas iniciais para dar suporte aos seus fluxos de trabalho de ML e análise.

- Os administradores de data lake configuram seu data lake e catálogo de dados e configuram o feature store central trabalhando com o administrador da plataforma de ML.

- O administrador da plataforma de ML fornece serviços compartilhados de ML, como AWS CodeCommit, AWS Code Pipeline, Registro do Amazon Elastic Container (Amazon ECR), um registro central de modelos, Cartões modelo SageMaker, Painel de modelos do SageMakere produtos do Catálogo de Serviços para equipes de ML.

- O líder da equipe de ML é federado por meio do IAM Identity Center, usa produtos do Catálogo de Serviços e provisiona recursos no ambiente de desenvolvimento da equipe de ML.

- Cientistas de dados de equipes de ML de diferentes unidades de negócios federam-se ao ambiente de desenvolvimento de suas equipes para construir o pipeline do modelo.

- Os cientistas de dados pesquisam e extraem recursos do catálogo central da feature store, constroem modelos por meio de experimentos e selecionam o melhor modelo para promoção.

- Os cientistas de dados criam e compartilham novos recursos no catálogo central do armazenamento de recursos para reutilização.

- Um engenheiro de ML implanta o pipeline do modelo no ambiente de teste da equipe de ML usando um processo de CI/CD de serviços compartilhados.

- Após a validação das partes interessadas, o modelo de ML é implantado no ambiente de produção da equipe.

- Os controles de segurança e governança estão incorporados em todas as camadas desta arquitetura usando serviços como Centro de segurança da AWS, Dever de guarda da Amazônia, Amazon MacieE muito mais.

- Os controles de segurança são gerenciados centralmente a partir da conta de ferramentas de segurança usando o Security Hub.

- Os recursos de governança da plataforma de ML, como SageMaker Model Cards e SageMaker Model Dashboard, são gerenciados centralmente a partir da conta de serviços de governança.

- Amazon CloudWatch e AWS CloudTrail os logs de cada conta-membro são disponibilizados centralmente a partir de uma conta de observabilidade usando serviços nativos da AWS.

A seguir, nos aprofundamos nos módulos da arquitetura de referência deste framework.

Módulos de arquitetura de referência

A arquitetura de referência compreende oito módulos, cada um projetado para resolver um conjunto específico de problemas. Coletivamente, esses módulos abordam a governança em diversas dimensões, como infraestrutura, dados, modelo e custo. Cada módulo oferece um conjunto distinto de funções e interopera com outros módulos para fornecer uma plataforma de ML integrada de ponta a ponta com segurança incorporada e controles de governança. Nesta seção, apresentamos um breve resumo dos recursos de cada módulo.

Fundações multicontas

Este módulo ajuda os administradores de nuvem a criar um Zona de destino da Torre de Controle AWS como uma estrutura fundamental. Isso inclui a construção de uma estrutura de múltiplas contas, autenticação e autorização por meio do IAM Identity Center, um design hub-and-spoke de rede, serviços de registro centralizados e novas contas de membros da AWS com linhas de base padronizadas de segurança e governança.

Além disso, este módulo fornece orientações de práticas recomendadas sobre estruturas de conta e UO apropriadas para dar suporte a seus fluxos de trabalho de ML e análise. Os administradores de nuvem compreenderão a finalidade das contas e UOs necessárias, como implantá-las e os principais serviços de segurança e conformidade que devem usar para governar centralmente suas cargas de trabalho de ML e análise.

Também é abordada uma estrutura para venda de novas contas, que utiliza automação para definir a linha de base de novas contas quando elas são provisionadas. Ao configurar um processo automatizado de provisionamento de contas, os administradores de nuvem podem fornecer às equipes de ML e análise as contas necessárias para realizar seu trabalho mais rapidamente, sem sacrificar uma base sólida de governança.

Fundações de data lake

Este módulo ajuda os administradores de data lake a configurar um data lake para ingerir dados, selecionar conjuntos de dados e usar o Formação AWS Lake modelo de governança para gerenciar o acesso detalhado a dados entre contas e usuários usando um catálogo de dados centralizado, políticas de acesso a dados e controles de acesso baseados em tags. Você pode começar aos poucos com uma conta para as bases da sua plataforma de dados para uma prova de conceito ou algumas pequenas cargas de trabalho. Para implementação de carga de trabalho de produção em média e grande escala, recomendamos a adoção de uma estratégia multicontas. Nesse cenário, os LOBs podem assumir a função de produtores e consumidores de dados usando diferentes contas da AWS, e a governança do data lake é operada a partir de uma conta central compartilhada da AWS. O produtor de dados coleta, processa e armazena dados de seu domínio de dados, além de monitorar e garantir a qualidade de seus ativos de dados. Os consumidores de dados consomem os dados do produtor de dados depois que o catálogo centralizado os compartilha usando o Lake Formation. O catálogo centralizado armazena e gerencia o catálogo de dados compartilhado para as contas do produtor de dados.

Serviços de plataforma de ML

Este módulo ajuda a equipe de engenharia da plataforma de ML a configurar serviços compartilhados que são usados pelas equipes de ciência de dados em suas contas de equipe. Os serviços incluem um portfólio de Catálogo de Serviços com produtos para Domínio do SageMaker implantação, Perfil de usuário do domínio SageMaker implantação, modelos de modelo de ciência de dados para construção e implantação de modelo. Este módulo possui funcionalidades para um registro de modelo centralizado, cartões de modelo, painel de modelo e pipelines de CI/CD usados para orquestrar e automatizar o desenvolvimento de modelos e fluxos de trabalho de implantação.

Além disso, este módulo detalha como implementar os controles e a governança necessários para habilitar recursos de autoatendimento baseados em pessoas, permitindo que as equipes de ciência de dados implantem de forma independente a infraestrutura de nuvem e os modelos de ML necessários.

Desenvolvimento de caso de uso de ML

Este módulo ajuda LOBs e cientistas de dados a acessar o domínio SageMaker de sua equipe em um ambiente de desenvolvimento e instanciar um modelo de construção de modelo para desenvolver seus modelos. Neste módulo, os cientistas de dados trabalham em uma instância de conta de desenvolvimento do modelo para interagir com os dados disponíveis no data lake centralizado, reutilizar e compartilhar recursos de um armazenamento central de recursos, criar e executar experimentos de ML, construir e testar seus fluxos de trabalho de ML, e registrar seus modelos em um registro de modelo de conta de desenvolvimento em seus ambientes de desenvolvimento.

Recursos como rastreamento de experimentos, relatórios de explicabilidade de modelos, monitoramento de dados e tendências de modelos e registro de modelos também são implementados nos modelos, permitindo a rápida adaptação das soluções aos modelos desenvolvidos pelos cientistas de dados.

Operações de ML

Este módulo ajuda os engenheiros de LOBs e ML a trabalhar em suas instâncias de desenvolvimento do modelo de implantação do modelo. Depois que o modelo candidato é registrado e aprovado, eles configuram pipelines de CI/CD e executam fluxos de trabalho de ML no ambiente de teste da equipe, que registra o modelo no registro central de modelos em execução em uma conta de serviços compartilhados da plataforma. Quando um modelo é aprovado no registro central de modelos, isso aciona um pipeline de CI/CD para implantar o modelo no ambiente de produção da equipe.

Armazenamento de recursos centralizado

Depois que os primeiros modelos são implantados na produção e vários casos de uso começam a compartilhar recursos criados a partir dos mesmos dados, um armazenamento de recursos se torna essencial para garantir a colaboração entre os casos de uso e reduzir o trabalho duplicado. Este módulo ajuda a equipe de engenharia da plataforma de ML a configurar um armazenamento de recursos centralizado para fornecer armazenamento e governança para recursos de ML criados pelos casos de uso de ML, permitindo a reutilização de recursos em projetos.

Registro e observabilidade

Este módulo ajuda LOBs e profissionais de ML a obter visibilidade do estado das cargas de trabalho de ML em ambientes de ML por meio da centralização de atividades de log, como CloudTrail, CloudWatch, logs de fluxo de VPC e logs de carga de trabalho de ML. As equipes podem filtrar, consultar e visualizar logs para análise, o que também pode ajudar a melhorar a postura de segurança.

Custo e relatórios

Este módulo ajuda várias partes interessadas (administrador de nuvem, administrador de plataforma, escritório de negócios em nuvem) a gerar relatórios e painéis para detalhar os custos nos níveis de usuário de ML, equipe de ML e produto de ML e rastrear o uso, como número de usuários, tipos de instância e pontos finais.

Os clientes nos pediram orientação sobre quantas contas criar e como estruturá-las. Na próxima seção, fornecemos orientação sobre essa estrutura de conta como referência que você pode modificar para atender às suas necessidades de acordo com os requisitos de governança corporativa.

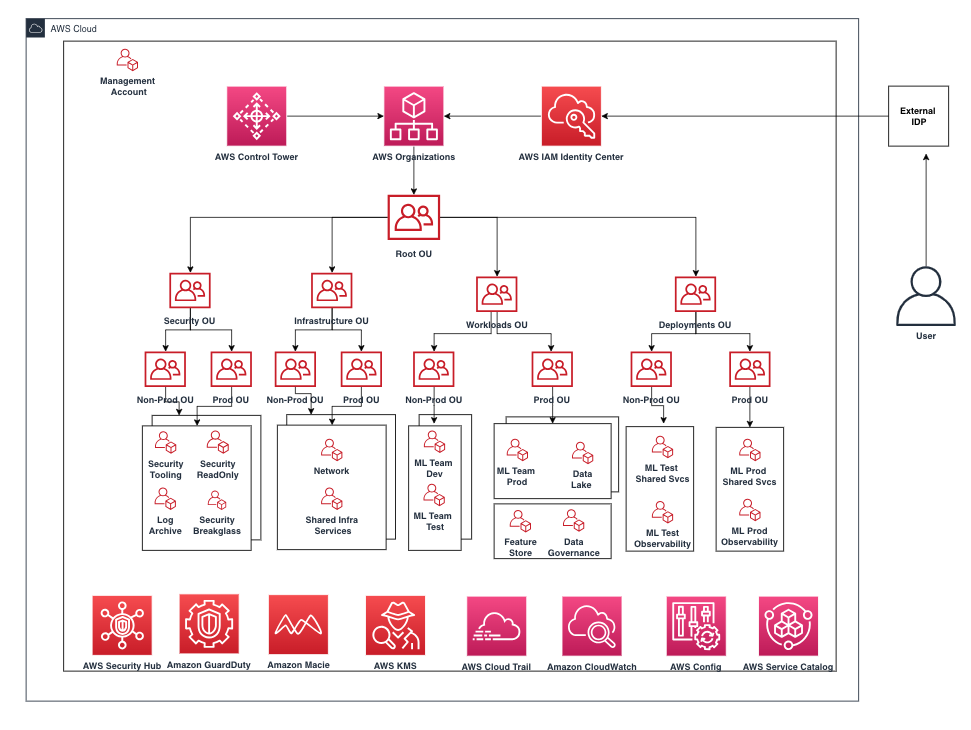

Nesta seção, discutimos nossa recomendação para organizar a estrutura de sua conta. Compartilhamos uma estrutura básica de contas de referência; no entanto, recomendamos que os administradores de ML e de dados trabalhem em estreita colaboração com o administrador da nuvem para personalizar essa estrutura de conta com base nos controles da organização.

Recomendamos organizar contas por UO para segurança, infraestrutura, cargas de trabalho e implantações. Além disso, dentro de cada UO, organize por UO de produção e de não produção, pois as contas e as cargas de trabalho implantadas sob elas têm controles diferentes. A seguir, discutiremos brevemente essas UOs.

UO de segurança

As contas nesta UO são gerenciadas pelo administrador de nuvem ou pela equipe de segurança da organização para monitorar, identificar, proteger, detectar e responder a eventos de segurança.

UO de infraestrutura

As contas nesta UO são gerenciadas pelo administrador de nuvem ou pela equipe de rede da organização para gerenciar redes e recursos compartilhados de infraestrutura de nível empresarial.

Recomendamos ter as seguintes contas na UO de infraestrutura:

- Network – Configure uma infraestrutura de rede centralizada, como AWS Transit Gateway

- Serviços compartilhados – Configurar serviços AD centralizados e endpoints VPC

Unidade organizacional de cargas de trabalho

As contas nesta UO são gerenciadas pelos administradores da equipe da plataforma da organização. Se precisar de controles diferentes implementados para cada equipe de plataforma, você poderá aninhar outros níveis de UO para essa finalidade, como uma UO de cargas de trabalho de ML, uma UO de cargas de trabalho de dados e assim por diante.

Recomendamos as seguintes contas na unidade organizacional de cargas de trabalho:

- Contas de desenvolvimento, teste e produção de ML em nível de equipe – Configure isso com base nos requisitos de isolamento da carga de trabalho

- Contas de data lake – Particionar contas pelo seu domínio de dados

- Conta central de governança de dados – Centralize suas políticas de acesso a dados

- Conta central da loja de recursos – Centralize recursos para compartilhamento entre equipes

UO de implantações

As contas nesta UO são gerenciadas pelos administradores da equipe de plataforma da organização para implantação de cargas de trabalho e observabilidade.

Recomendamos as seguintes contas na unidade organizacional de implantações porque a equipe da plataforma de ML pode configurar diferentes conjuntos de controles nesse nível da unidade organizacional para gerenciar e controlar as implantações:

- Contas de serviços compartilhados de ML para teste e produção – Hospeda serviços compartilhados de plataforma CI/CD e registro de modelo

- Contas de observabilidade de ML para teste e produção – Hospeda logs do CloudWatch, logs do CloudTrail e outros logs conforme necessário

A seguir, discutiremos brevemente os controles da organização que precisam ser considerados para incorporação nas contas dos membros para monitorar os recursos da infraestrutura.

Controles de ambiente AWS

Um controle é uma regra de alto nível que fornece governança contínua para seu ambiente geral da AWS. É expresso em linguagem simples. Nesta estrutura, usamos o AWS Control Tower para implementar os seguintes controles que ajudam você a controlar seus recursos e monitorar a conformidade em grupos de contas da AWS:

- Controles preventivos – Um controle preventivo garante que suas contas mantenham a conformidade, pois proíbe ações que levam a violações de políticas e são implementadas por meio de uma Política de Controle de Serviços (SCP). Por exemplo, você pode definir um controle preventivo que garanta que o CloudTrail não seja excluído ou interrompido em contas ou regiões da AWS.

- Controles de detetive – Um controle detetive detecta a não conformidade de recursos em suas contas, como violações de políticas, fornece alertas por meio do painel e é implementado usando Configuração da AWS regras. Por exemplo, você pode criar um controle de detetive para detectar se o acesso de leitura pública está habilitado para o Serviço de armazenamento simples da Amazon (Amazon S3) na conta compartilhada do arquivo de log.

- Controles proativos – Um controle proativo verifica seus recursos antes de serem provisionados e garante que os recursos estejam em conformidade com esse controle e sejam implementados usando Formação da Nuvem AWS ganchos. Os recursos que não estiverem em conformidade não serão provisionados. Por exemplo, você pode definir um controle proativo que verifica se o acesso direto à Internet não é permitido para uma instância de notebook SageMaker.

Interações entre serviços de plataforma de ML, casos de uso de ML e operações de ML

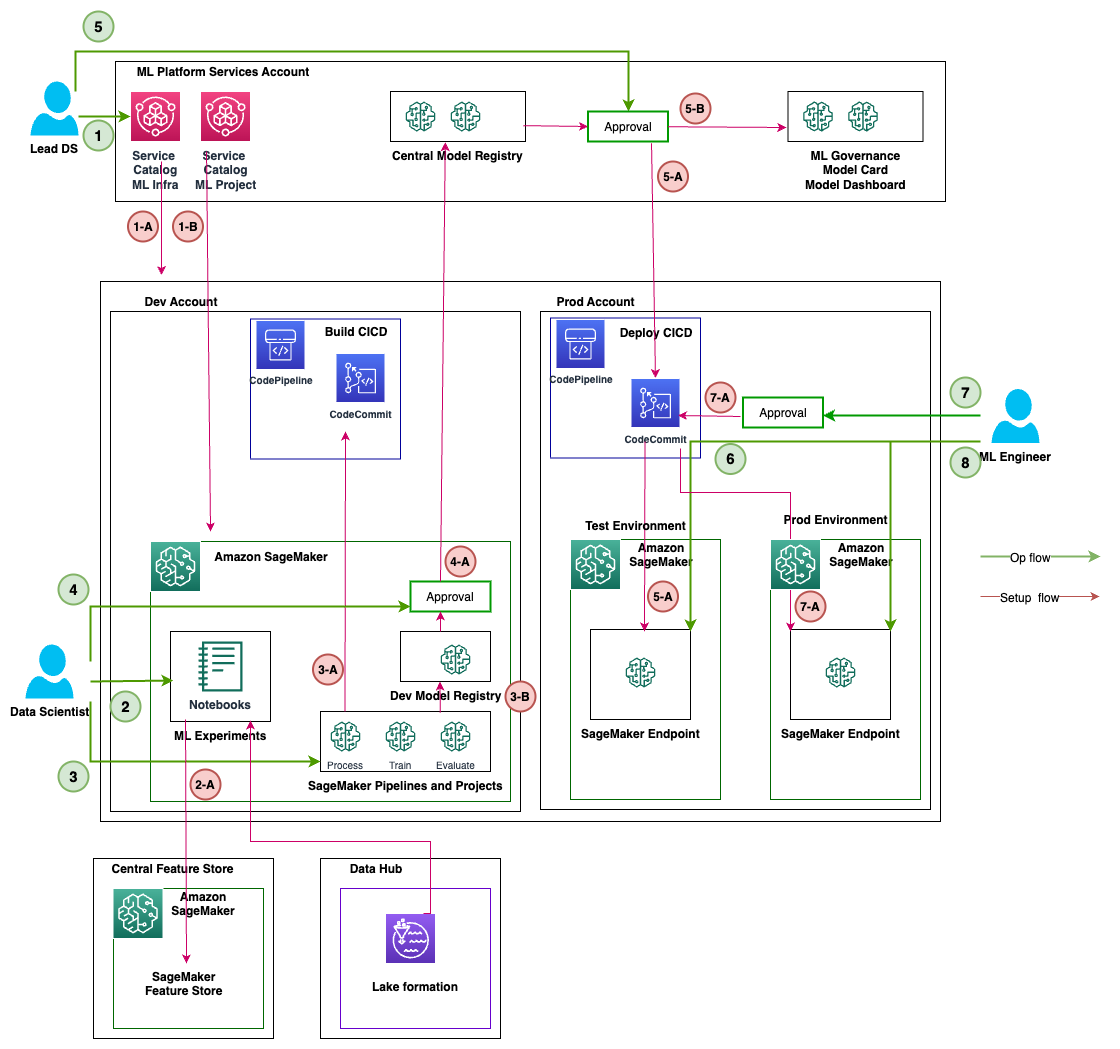

Diferentes personas, como o chefe de ciência de dados (cientista líder de dados), o cientista de dados e o engenheiro de ML, operam os módulos 2 a 6, conforme mostrado no diagrama a seguir, para diferentes estágios de serviços de plataforma de ML, desenvolvimento de casos de uso de ML e operações de ML junto com as fundações do data lake e o armazenamento central de recursos.

A tabela a seguir resume a atividade do fluxo de operações e as etapas do fluxo de configuração para diferentes personas. Depois que uma persona inicia uma atividade de ML como parte do fluxo de operações, os serviços são executados conforme mencionado nas etapas do fluxo de configuração.

| Persona | Atividade de fluxo de operações – Número | Atividade de fluxo de operações – Descrição | Etapa do fluxo de configuração – Número | Etapa de fluxo de configuração – Descrição |

| Líder de ciência de dados ou líder de equipe de ML |

1 |

Usa o Catálogo de Serviços na conta de serviços da plataforma ML e implanta o seguinte:

|

1-A |

|

|

1-B |

|

|||

| Cientista de dados |

2 |

Conduz e rastreia experimentos de ML em notebooks SageMaker |

2-A |

|

|

3 |

Automatiza experimentos de ML bem-sucedidos com projetos e pipelines do SageMaker |

3-A |

|

|

|

3-B |

Após a execução dos pipelines do SageMaker, salva o modelo no registro de modelo local (dev) | |||

| Cientista de dados líder ou líder de equipe de ML |

4 |

Aprova o modelo no registro de modelo local (dev) |

4-A |

Gravações de metadados de modelo e pacote de modelo do registro de modelo local (dev) para o registro de modelo central |

|

5 |

Aprova o modelo no registro central de modelos |

5-A |

Inicia o processo de implantação CI/CD para criar endpoints SageMaker no ambiente de teste | |

|

5-B |

Grava as informações e os metadados do modelo no módulo de governança de ML (cartão de modelo, painel de modelo) na conta de serviços da plataforma de ML da conta local (desenvolvedor) | |||

| Engenheiro de ML |

6 |

Testa e monitora o endpoint SageMaker no ambiente de teste após CI/CD | . | |

|

7 |

Aprova a implantação de endpoints do SageMaker no ambiente de produção |

7-A |

Inicia o processo de implantação de CI/CD para criar endpoints do SageMaker no ambiente de produção | |

|

8 |

Testa e monitora o endpoint SageMaker no ambiente de teste após CI/CD | . | ||

Personas e interações com diferentes módulos da plataforma ML

Cada módulo atende a personas-alvo específicas em divisões específicas que utilizam o módulo com mais frequência, concedendo-lhes acesso primário. É então permitido o acesso secundário a outras divisões que necessitem de utilização ocasional dos módulos. Os módulos são adaptados às necessidades de funções ou personas específicas para otimizar a funcionalidade.

Discutimos as seguintes equipes:

- Engenharia de nuvem central – Essa equipe opera no nível da nuvem corporativa em todas as cargas de trabalho para configurar serviços comuns de infraestrutura em nuvem, como configuração de rede, identidade, permissões e gerenciamento de contas em nível empresarial.

- Engenharia de plataforma de dados – Esta equipe gerencia data lakes corporativos, coleta de dados, curadoria de dados e governança de dados

- Engenharia de plataforma de ML – Esta equipe opera no nível da plataforma de ML em LOBs para fornecer serviços de infraestrutura de ML compartilhados, como provisionamento de infraestrutura de ML, rastreamento de experimentos, governança de modelo, implantação e observabilidade

A tabela a seguir detalha quais divisões têm acesso primário e secundário para cada módulo de acordo com as personas alvo do módulo.

| Número do módulo | Módulos | Acesso Primário | Acesso Secundário | Personagens-alvo | Número de contas |

|

1 |

Fundações multicontas | Engenharia de nuvem central | LOBs individuais |

|

Poucos |

|

2 |

Fundações de data lake | Engenharia central de nuvem ou plataforma de dados | LOBs individuais |

|

Múltiplo |

|

3 |

Serviços de plataforma de ML | Engenharia central de nuvem ou plataforma de ML | LOBs individuais |

|

completa |

|

4 |

Desenvolvimento de caso de uso de ML | LOBs individuais | Engenharia central de nuvem ou plataforma de ML |

|

Múltiplo |

|

5 |

Operações de ML | Nuvem central ou engenharia de ML | LOBs individuais |

|

Múltiplo |

|

6 |

Armazenamento de recursos centralizado | Nuvem central ou engenharia de dados | LOBs individuais |

|

completa |

|

7 |

Registro e observabilidade | Engenharia de nuvem central | LOBs individuais |

|

completa |

|

8 |

Custo e relatórios | LOBs individuais | Engenharia de plataforma central |

|

completa |

Conclusão

Nesta postagem, apresentamos uma estrutura para governar o ciclo de vida de ML em escala que ajuda você a implementar cargas de trabalho de ML bem arquitetadas, incorporando controles de segurança e governança. Discutimos como esta estrutura adota uma abordagem holística para construir uma plataforma de ML considerando governança de dados, governança de modelo e controles de nível empresarial. Incentivamos você a experimentar a estrutura e os conceitos apresentados nesta postagem e compartilhar seus comentários.

Sobre os autores

Carneiro Vital é arquiteto principal de soluções de ML na AWS. Ele tem mais de 3 décadas de experiência arquitetando e construindo aplicativos distribuídos, híbridos e em nuvem. Ele é apaixonado por criar soluções de IA/ML e big data seguras, escaláveis e confiáveis para ajudar clientes corporativos em sua jornada de adoção e otimização da nuvem para melhorar seus resultados de negócios. Nas horas vagas, ele anda de moto e caminha com seu carneiro de três anos!

Carneiro Vital é arquiteto principal de soluções de ML na AWS. Ele tem mais de 3 décadas de experiência arquitetando e construindo aplicativos distribuídos, híbridos e em nuvem. Ele é apaixonado por criar soluções de IA/ML e big data seguras, escaláveis e confiáveis para ajudar clientes corporativos em sua jornada de adoção e otimização da nuvem para melhorar seus resultados de negócios. Nas horas vagas, ele anda de moto e caminha com seu carneiro de três anos!

Sovik Kumar Nath é um arquiteto de soluções AI/ML da AWS. Ele tem uma vasta experiência no desenvolvimento de soluções completas de aprendizado de máquina e análise de negócios em finanças, operações, marketing, saúde, gerenciamento da cadeia de suprimentos e IoT. Sovik publicou artigos e detém uma patente em monitoramento de modelo ML. Ele tem mestrado duplo pela University of South Florida, University of Fribourg, Suíça, e bacharelado pelo Indian Institute of Technology, Kharagpur. Fora do trabalho, Sovik gosta de viajar, fazer passeios de balsa e assistir a filmes.

Sovik Kumar Nath é um arquiteto de soluções AI/ML da AWS. Ele tem uma vasta experiência no desenvolvimento de soluções completas de aprendizado de máquina e análise de negócios em finanças, operações, marketing, saúde, gerenciamento da cadeia de suprimentos e IoT. Sovik publicou artigos e detém uma patente em monitoramento de modelo ML. Ele tem mestrado duplo pela University of South Florida, University of Fribourg, Suíça, e bacharelado pelo Indian Institute of Technology, Kharagpur. Fora do trabalho, Sovik gosta de viajar, fazer passeios de balsa e assistir a filmes.

Tanque Maira Ladeira é especialista sênior em dados na AWS. Como líder técnica, ela ajuda os clientes a acelerar a obtenção de valor comercial por meio de tecnologia emergente e soluções inovadoras. Maira está na AWS desde janeiro de 2020. Antes disso, ela trabalhou como cientista de dados em vários setores, com foco na obtenção de valor comercial a partir dos dados. Nas horas vagas, Maira gosta de viajar e passar o tempo com a família em algum lugar aconchegante.

Tanque Maira Ladeira é especialista sênior em dados na AWS. Como líder técnica, ela ajuda os clientes a acelerar a obtenção de valor comercial por meio de tecnologia emergente e soluções inovadoras. Maira está na AWS desde janeiro de 2020. Antes disso, ela trabalhou como cientista de dados em vários setores, com foco na obtenção de valor comercial a partir dos dados. Nas horas vagas, Maira gosta de viajar e passar o tempo com a família em algum lugar aconchegante.

Ryan Lempka é arquiteto de soluções sênior na Amazon Web Services, onde ajuda seus clientes a trabalhar retroativamente a partir dos objetivos de negócios para desenvolver soluções na AWS. Ele tem profunda experiência em estratégia de negócios, gerenciamento de sistemas de TI e ciência de dados. Ryan se dedica a aprender ao longo da vida e gosta de se desafiar todos os dias para aprender algo novo.

Ryan Lempka é arquiteto de soluções sênior na Amazon Web Services, onde ajuda seus clientes a trabalhar retroativamente a partir dos objetivos de negócios para desenvolver soluções na AWS. Ele tem profunda experiência em estratégia de negócios, gerenciamento de sistemas de TI e ciência de dados. Ryan se dedica a aprender ao longo da vida e gosta de se desafiar todos os dias para aprender algo novo.

Sriharsh Adari é arquiteto de soluções sênior na Amazon Web Services (AWS), onde ajuda os clientes a trabalhar de trás para frente a partir dos resultados de negócios para desenvolver soluções inovadoras na AWS. Ao longo dos anos, ele ajudou vários clientes em transformações de plataformas de dados em verticais do setor. Sua principal área de especialização inclui Estratégia de Tecnologia, Análise de Dados e Ciência de Dados. Em seu tempo livre, ele gosta de praticar esportes, assistir a programas de TV e jogar Tabla.

Sriharsh Adari é arquiteto de soluções sênior na Amazon Web Services (AWS), onde ajuda os clientes a trabalhar de trás para frente a partir dos resultados de negócios para desenvolver soluções inovadoras na AWS. Ao longo dos anos, ele ajudou vários clientes em transformações de plataformas de dados em verticais do setor. Sua principal área de especialização inclui Estratégia de Tecnologia, Análise de Dados e Ciência de Dados. Em seu tempo livre, ele gosta de praticar esportes, assistir a programas de TV e jogar Tabla.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/governing-the-ml-lifecycle-at-scale-part-1-a-framework-for-architecting-ml-workloads-using-amazon-sagemaker/

- :tem

- :é

- :não

- :onde

- $UP

- 1

- 10

- 100

- 12

- de 12 meses

- 2020

- 28

- 7

- 8

- 971

- a

- Sobre

- acelerar

- Acesso

- acessível

- Segundo

- Conta

- Contas

- realização

- alcançar

- em

- ações

- atividade

- Ad

- adaptar

- adaptação

- Adição

- Adicional

- endereço

- endereços

- endereçando

- admin

- administradores

- Adotando

- Adoção

- Depois de

- AI

- Modelos de IA

- AI / ML

- Alertas

- Todos os Produtos

- permitidas

- Permitindo

- permite

- juntamente

- já

- tb

- Apesar

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- análise

- analítica

- e

- e infra-estrutura

- qualquer

- aplicações

- abordagem

- apropriado

- aprovou

- arquitetura

- arquivo

- SOMOS

- ÁREA

- artigos

- AS

- Ativos

- associado

- assumir

- At

- Autenticação

- autorização

- automatizar

- Automatizado

- Automação

- disponível

- AWS

- Equilíbrio

- baseado

- Linha de Base

- BE

- Porque

- torna-se

- sido

- antes

- ser

- benéfico

- Benefícios

- MELHOR

- melhores práticas

- entre

- viés

- Grande

- Big Data

- Break

- brevemente

- construir

- Prédio

- Constrói

- negócio

- estratégia de negócios

- mas a

- by

- CAN

- candidato

- capacidades

- cartão

- Cartões

- casas

- casos

- catálogo

- Categorias

- atende

- Causar

- Centralização de

- central

- Centralização

- centralizada

- cadeia

- desafios

- desafiante

- Cheques

- química

- de perto

- Na nuvem

- adoção de nuvem

- infraestrutura de nuvem

- código

- colaboração

- coleção

- coletivamente

- comum

- Empresas

- compliance

- compatível

- componentes

- compreende

- conceito

- conceitos

- considerado

- considerando

- considera

- consumir

- Consumidores

- Recipiente

- ao controle

- Torre de controle

- controlado

- controles

- coordenado

- núcleo

- Custo

- custos

- coberto

- crio

- criado

- curadoria

- Clientes

- personalizar

- personalizado

- painel de instrumentos

- painéis

- dados,

- acesso a dados

- Análise de Dados

- lago data

- Plataforma de dados

- privacidade de dados

- ciência de dados

- cientista de dados

- conjuntos de dados

- dia

- décadas

- dedicado

- profundo

- Grau

- departamentos

- implantar

- implantado

- Implantação

- desenvolvimento

- Implantações

- implanta

- Design

- projetado

- concepção

- detalhes

- Dev

- desenvolver

- desenvolvido

- Desenvolvimento

- desenvolvimentos

- diferente

- dimensões

- diretamente

- discutir

- discutido

- distinto

- distribuído

- mergulho

- domínio

- duplo

- down

- cada

- esforços

- embutir

- incorporado

- embutindo

- emergente

- Tecnologia emergente

- permitir

- habilitado

- permite

- permitindo

- encorajar

- end-to-end

- Ponto final

- engenheiro

- Engenharia

- Engenheiros

- aumentar

- garantir

- garante

- assegurando

- Empreendimento

- no âmbito da empresa

- empresas

- Meio Ambiente

- ambientes

- essencial

- avaliar

- eventos

- Cada

- todo dia

- exemplo

- vasta experiência

- experimentar

- experimentos

- experiência

- expressa

- estendendo

- extenso

- Experiência Extensiva

- enfrentou

- facilitar

- família

- Característica

- Funcionalidades

- retornos

- poucos

- Figura

- filtro

- financiar

- financeiro

- serviços financeiros

- Primeiro nome

- Flexibilidade

- florida

- fluxo

- focando

- seguinte

- Escolha

- formulário

- treinamento

- Foundation

- Fundações

- quatro

- Quadro

- Gratuito

- da

- função

- funcional

- funcionalidades

- funcionalidade

- funções

- mais distante

- Além disso

- Ganho

- gerar

- gerando

- generativo

- IA generativa

- dá

- Global

- governo

- modelo de governança

- módulo de governança

- governado

- governando

- concessão

- Do grupo

- orientações

- Ter

- ter

- he

- cabeça

- saúde

- ouvir

- ajudar

- ajudou

- ajuda

- sua experiência

- Alta

- de alto nível

- sua

- detém

- holística

- Hooks

- anfitriões

- Como funciona o dobrador de carta de canal

- Como Negociar

- Contudo

- HTML

- http

- HTTPS

- Hub

- HÍBRIDO

- identificar

- Identidade

- if

- executar

- implementação

- implementado

- implementação

- melhorar

- melhorar

- in

- incluir

- inclui

- Incluindo

- aumentando

- independentemente

- indiano

- indústrias

- indústria

- INFORMAÇÕES

- Infraestrutura

- do estado inicial,

- Inicia

- inovando

- inovadores

- instância

- Instituto

- integrado

- interagir

- interações

- interessado

- Internet

- Acesso à internet

- para dentro

- introduzido

- investimento

- iot

- isolamento

- IT

- janeiro

- Trabalho

- viagem

- jpg

- Chave

- Conhecimento

- Kumar

- Falta

- lago

- lagos

- aterrissagem

- língua

- grande

- mais tarde

- camada

- conduzir

- APRENDER

- aprendizagem

- Nível

- níveis

- wifecycwe

- como

- linhagem

- linhas

- local

- log

- logging

- procurando

- máquina

- aprendizado de máquina

- moldadas

- a manter

- FAZ

- gerencia

- gerenciados

- de grupos

- gestão

- gestão

- muitos

- mapas

- Marketing

- maduro

- maturidade

- Posso..

- membro

- mencionado

- malha

- metadados

- mitigando

- mitigando riscos

- ML

- MLOps

- modelo

- modelos

- modificar

- modulares

- Módulo

- Módulos

- Monitore

- monitoração

- monitores

- mês

- mais

- a maioria

- motocicleta

- Filmes

- múltiplo

- nativo

- você merece...

- Cria

- Nest

- rede

- networking

- redes

- Novo

- Novos Recursos

- Próximo

- caderno

- número

- objetivos

- ocasional

- of

- Oferece

- Office

- frequentemente

- Velho

- on

- uma vez

- ONE

- contínuo

- operar

- operado

- opera

- operando

- Operações

- otimização

- Otimize

- or

- organização

- organizações

- organização

- Outros

- A Nossa

- Fora

- resultados

- lado de fora

- Acima de

- global

- Visão geral

- pacote

- parte

- particular

- apaixonado

- patente

- Realizar

- atuação

- permissões

- oleoduto

- Lugar

- Avião

- plataforma

- platão

- Inteligência de Dados Platão

- PlatãoData

- jogar

- políticas

- Privacidade

- pasta

- Publique

- prática

- práticas

- presente

- impedindo

- primário

- Diretor

- Prévio

- política de privacidade

- privado

- setor privado

- Proactive

- problemas

- processo

- processos

- produtor

- Produtores

- Produto

- Produção

- Produtos

- projetos

- promoção

- prova

- prova de conceito

- proteger

- fornecer

- fornece

- fornecendo

- público

- publicado

- propósito

- qualidade

- rapidamente

- rápido

- Leia

- recentemente

- reconhecer

- recomendar

- Recomendação

- reduzir

- referência

- regiões

- cadastre-se

- registrado

- registradores

- registro

- regulamentadas

- indústrias reguladas

- confiável

- removendo

- Relatórios

- requerer

- requeridos

- Requisitos

- recurso

- Recursos

- responder

- responsável

- reutilizar

- passeios

- Risco

- riscos

- Tipo

- papéis

- raiz

- Regra

- regras

- Execute

- corrida

- Ryan

- sacrificando

- sábio

- Pipelines SageMaker

- mesmo

- escalável

- Escala

- dimensionamento

- Ciência

- Cientista

- cientistas

- Pesquisar

- secundário

- Seção

- setor

- seguro

- segurança

- eventos de segurança

- Autoatendimento

- senior

- Série

- serviço

- Serviços

- conjunto

- Conjuntos

- contexto

- instalação

- Partilhar

- compartilhado

- ações

- compartilhando

- ela

- Baixo

- rede de apoio social

- mostrando

- Shows

- simples

- desde

- solteiro

- Tamanho

- pequeno

- So

- solução

- Soluções

- RESOLVER

- alguns

- algo

- Sul

- Sul da Flórida

- especialista

- especializado

- específico

- Passar

- Esportes

- Estágio

- partes interessadas

- partes interessadas

- padrões

- começo

- Estado

- Passo

- Passos

- Ainda

- parou

- armazenamento

- loja

- lojas

- estratégias

- Estratégia

- mais forte,

- estrutura

- estruturas

- estudo

- bem sucedido

- tal

- terno

- RESUMO

- supply

- cadeia de suprimentos

- gestão da cadeia de abastecimento

- ajuda

- Apoiar

- certo

- Suíça

- sistemas

- mesa

- adaptados

- toma

- tomar

- Target

- Profissionais

- equipes

- Dados Técnicos:

- Tecnologia

- Estratégia Tecnológica

- modelo

- modelos

- teste

- ensaio

- que

- A

- O Estado

- deles

- Eles

- então

- Este

- deles

- coisas

- isto

- aqueles

- Através da

- todo

- tempo

- para

- ferramentas

- para

- Torre

- pista

- Rastreamento

- tradicional

- Trem

- transformações

- trânsito

- Viagens

- VIRAR

- tv

- tipos

- para

- compreender

- Injusto

- unidades

- universidade

- us

- Uso

- usar

- caso de uso

- usava

- Utilizador

- usuários

- usos

- utilização

- utilizar

- validação

- valor

- variedade

- vário

- Verticais

- via

- Violações

- visibilidade

- visualização

- visualizar

- andar

- queremos

- quente

- assistindo

- we

- web

- serviços web

- BEM

- quando

- se

- qual

- enquanto

- precisarão

- de

- dentro

- sem

- Atividades:

- trabalhou

- fluxos de trabalho

- trabalhar

- anos

- Vocês

- investimentos

- zefirnet