Nesta postagem, mostramos como configurar um novo recurso de autenticação baseado em OAuth para uso Floco de neve in Gerenciador de dados do Amazon SageMaker. Snowflake é uma plataforma de dados em nuvem que fornece soluções de dados para armazenamento de dados para ciência de dados. Floco de neve é um Parceiro AWS com vários credenciamentos da AWS, incluindo competências da AWS em aprendizado de máquina (ML), varejo e dados e análises.

O Data Wrangler simplifica a preparação de dados e o processo de engenharia de recursos, reduzindo o tempo que leva de semanas para minutos, fornecendo uma interface visual única para cientistas de dados selecionarem e limparem dados, criarem recursos e automatizarem a preparação de dados em fluxos de trabalho de ML sem escrever nenhum código. Você pode importar dados de várias fontes de dados, como Serviço de armazenamento simples da Amazon (Amazon S3), Amazona atena, Amazon RedShift, Amazon EMRe floco de neve. Com esse novo recurso, você pode usar seu próprio provedor de identidade (IdP), como Octa, azureadou Ping Federado para se conectar ao Snowflake via Data Wrangler.

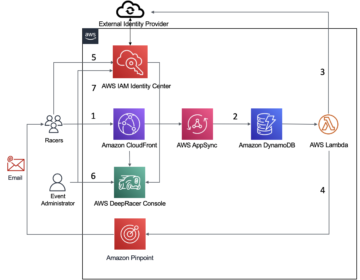

Visão geral da solução

Nas seções a seguir, fornecemos etapas para um administrador configurar o IdP, o Snowflake e o Studio. Também detalhamos as etapas que os cientistas de dados podem seguir para configurar o fluxo de dados, analisar a qualidade dos dados e adicionar transformações de dados. Por fim, mostramos como exportar o fluxo de dados e treinar um modelo usando Piloto automático do SageMaker.

Pré-requisitos

Para este passo a passo, você deve ter os seguintes pré-requisitos:

- Para administrador:

- Um usuário do Snowflake com permissões para criar integrações de armazenamento e integrações de segurança no Snowflake.

- Uma conta da AWS com permissões para criar Gerenciamento de acesso e identidade da AWS (IAM) políticas e funções.

- Acesso e permissões para configurar o IDP para registrar o aplicativo Data Wrangler e configurar o servidor de autorização ou API.

- Para cientista de dados:

Configuração do administrador

Em vez de fazer com que seus usuários insiram diretamente suas credenciais do Snowflake no Data Wrangler, você pode fazer com que eles usem um IdP para acessar o Snowflake.

As etapas a seguir estão envolvidas para habilitar o acesso OAuth do Data Wrangler ao Snowflake:

- Configure o IdP.

- Configurar floco de neve.

- Configure o SageMaker Studio.

Configurar o IdP

Para configurar seu IdP, você deve registrar o aplicativo Data Wrangler e configurar seu servidor de autorização ou API.

Registre o aplicativo Data Wrangler no IdP

Consulte a seguinte documentação para os IdPs compatíveis com o Data Wrangler:

Use a documentação fornecida pelo seu IdP para registrar seu aplicativo Data Wrangler. As informações e os procedimentos nesta seção ajudam você a entender como usar corretamente a documentação fornecida pelo seu IdP.

Personalizações específicas, além das etapas nos respectivos guias, são destacadas nas subseções.

- Selecione a configuração que inicia o processo de registro do Data Wrangler como um aplicativo.

- Forneça aos usuários dentro do IdP acesso ao Data Wrangler.

- Habilite a autenticação do cliente OAuth armazenando as credenciais do cliente como um segredo do Secrets Manager.

- Especifique um URL de redirecionamento usando o seguinte formato:

https://domain-ID.studio.AWS Region.sagemaker.aws/jupyter/default/lab.

Você está especificando o ID de domínio do SageMaker e a região da AWS que está usando para executar o Data Wrangler. Você deve registrar uma URL para cada domínio e região em que está executando o Data Wrangler. Os usuários de um domínio e região que não tenham URLs de redirecionamento configurados para eles não poderão se autenticar com o IdP para acessar a conexão do Snowflake.

- Certifique-se de que os tipos de concessão de código de autorização e token de atualização sejam permitidos para seu aplicativo Data Wrangler.

Configure o servidor de autorização ou API dentro do IdP

Dentro do seu IdP, você deve configurar um servidor de autorização ou uma interface de programação de aplicativo (API). Para cada usuário, o servidor de autorização ou a API envia tokens para o Data Wrangler com o Snowflake como público.

Snowflake usa o conceito de papéis que são diferentes das funções do IAM usadas na AWS. Você deve configurar o IdP para usar QUALQUER função para usar a função padrão associada à conta Snowflake. Por exemplo, se um usuário tiver systems administrator como a função padrão em seu perfil do Snowflake, a conexão do Data Wrangler para o Snowflake usa systems administrator como o papel.

Use o procedimento a seguir para configurar o servidor de autorização ou API em seu IdP:

- A partir do seu IdP, comece o processo de configuração do servidor ou API.

- Configure o servidor de autorização para usar o código de autorização e atualizar os tipos de concessão de token.

- Especifique o tempo de vida do token de acesso.

- Defina o tempo limite de inatividade do token de atualização.

O tempo limite de inatividade é o tempo que o token de atualização expira se não for usado. Se você estiver agendando trabalhos no Data Wrangler, recomendamos que o tempo limite ocioso seja maior que a frequência do trabalho de processamento. Caso contrário, algumas tarefas de processamento podem falhar porque o token de atualização expirou antes que elas pudessem ser executadas. Quando o token de atualização expirar, o usuário deverá se autenticar novamente acessando a conexão que fez com o Snowflake por meio do Data Wrangler.

Observe que o Data Wrangler não oferece suporte a tokens de atualização rotativos. O uso de tokens de atualização rotativos pode resultar em falhas de acesso ou usuários que precisam fazer login com frequência.

Se o token de atualização expirar, seus usuários deverão se autenticar novamente acessando a conexão que fizeram com o Snowflake por meio do Data Wrangler.

- Especificar

session:role-anycomo o novo escopo.

Para o Azure AD, você também deve especificar um identificador exclusivo para o escopo.

Depois de configurar o provedor OAuth, você fornece ao Data Wrangler as informações necessárias para se conectar ao provedor. Você pode usar a documentação do seu IdP para obter valores para os seguintes campos:

- URL do token – A URL do token que o IdP envia para o Data Wrangler

- URL de autorização – A URL do servidor de autorização do IdP

- ID do cliente – O ID do IdP

- Segredo do cliente – O segredo que apenas o servidor de autorização ou API reconhece

- Escopo OAuth – Isso é apenas para o Azure AD

Configurar floco de neve

Para configurar o Snowflake, siga as instruções em Importar dados do Snowflake.

Use a documentação do Snowflake para seu IdP para configurar uma integração OAuth externa no Snowflake. Veja a seção anterior Registre o aplicativo Data Wrangler no IdP para obter mais informações sobre como configurar uma integração OAuth externa.

Ao configurar a integração de segurança no Snowflake, certifique-se de ativar external_oauth_any_role_mode.

Configurar o SageMaker Studio

Você armazena os campos e valores em um segredo do Secrets Manager e o adiciona à configuração do ciclo de vida do Studio que está usando para o Data Wrangler. Uma configuração de ciclo de vida é um script de shell que carrega automaticamente as credenciais armazenadas no segredo quando o usuário faz login no Studio. Para obter informações sobre como criar segredos, consulte Mova segredos codificados para o AWS Secrets Manager. Para obter informações sobre como usar configurações de ciclo de vida no Studio, consulte Use configurações de ciclo de vida com o Amazon SageMaker Studio.

Crie um segredo para as credenciais do Snowflake

Para criar seu segredo para as credenciais do Snowflake, conclua as seguintes etapas:

- No console do Secrets Manager, escolha Guarde um novo segredo.

- Escolha Tipo de segredo, selecione Outro tipo de segredo.

- Especifique os detalhes do seu segredo como pares de valor-chave.

Os nomes das chaves requerem letras minúsculas devido à distinção entre maiúsculas e minúsculas. O Data Wrangler emite um aviso se você inserir qualquer um deles incorretamente. Insira os valores secretos como pares chave-valor Chave/valor, se desejar, ou use o Texto simples opção.

A seguir está o formato do segredo usado para Okta. Se você estiver usando o Azure AD, precisará adicionar o datasource_oauth_scope campo.

- Atualize os valores anteriores com sua escolha de IdP e as informações coletadas após o registro do aplicativo.

- Escolha Próximo.

- Escolha Nome secreto, adicione o prefixo

AmazonSageMaker(por exemplo, nosso segredo éAmazonSageMaker-DataWranglerSnowflakeCreds). - No Tags seção, adicione uma tag com a chave

SageMakere valortrue. - Escolha Próximo.

- O restante dos campos são opcionais; escolher Próximo até que você tenha a opção de escolher Loja para armazenar o segredo.

Depois de armazenar o segredo, você retornará ao console do Secrets Manager.

- Escolha o segredo que acabou de criar e, em seguida, recupere o ARN secreto.

- Armazene-o em seu editor de texto preferido para uso posterior ao criar a origem de dados do Data Wrangler.

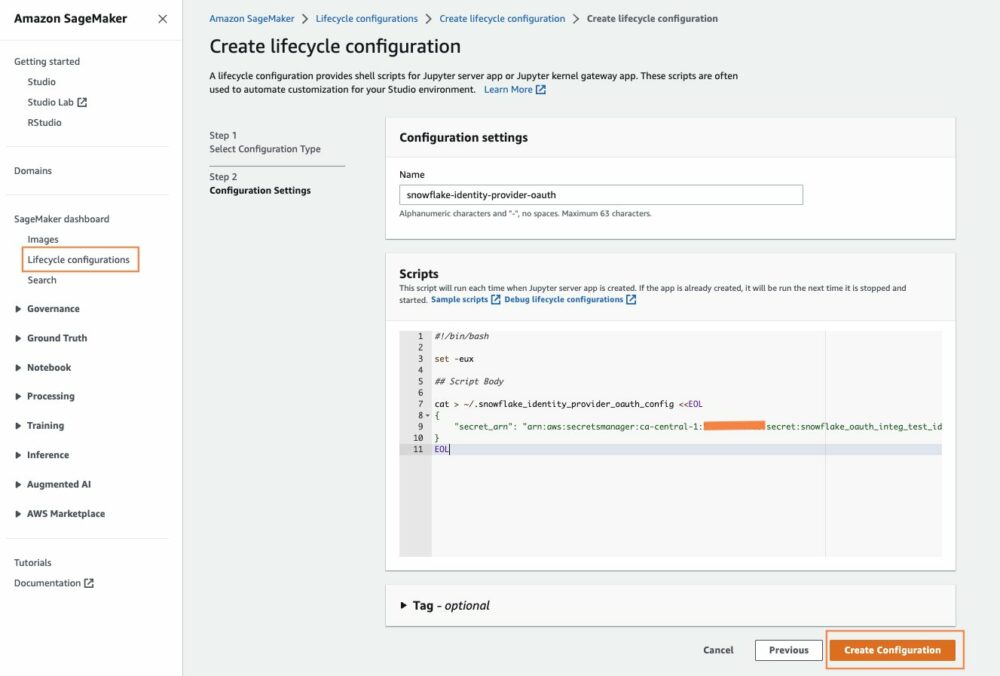

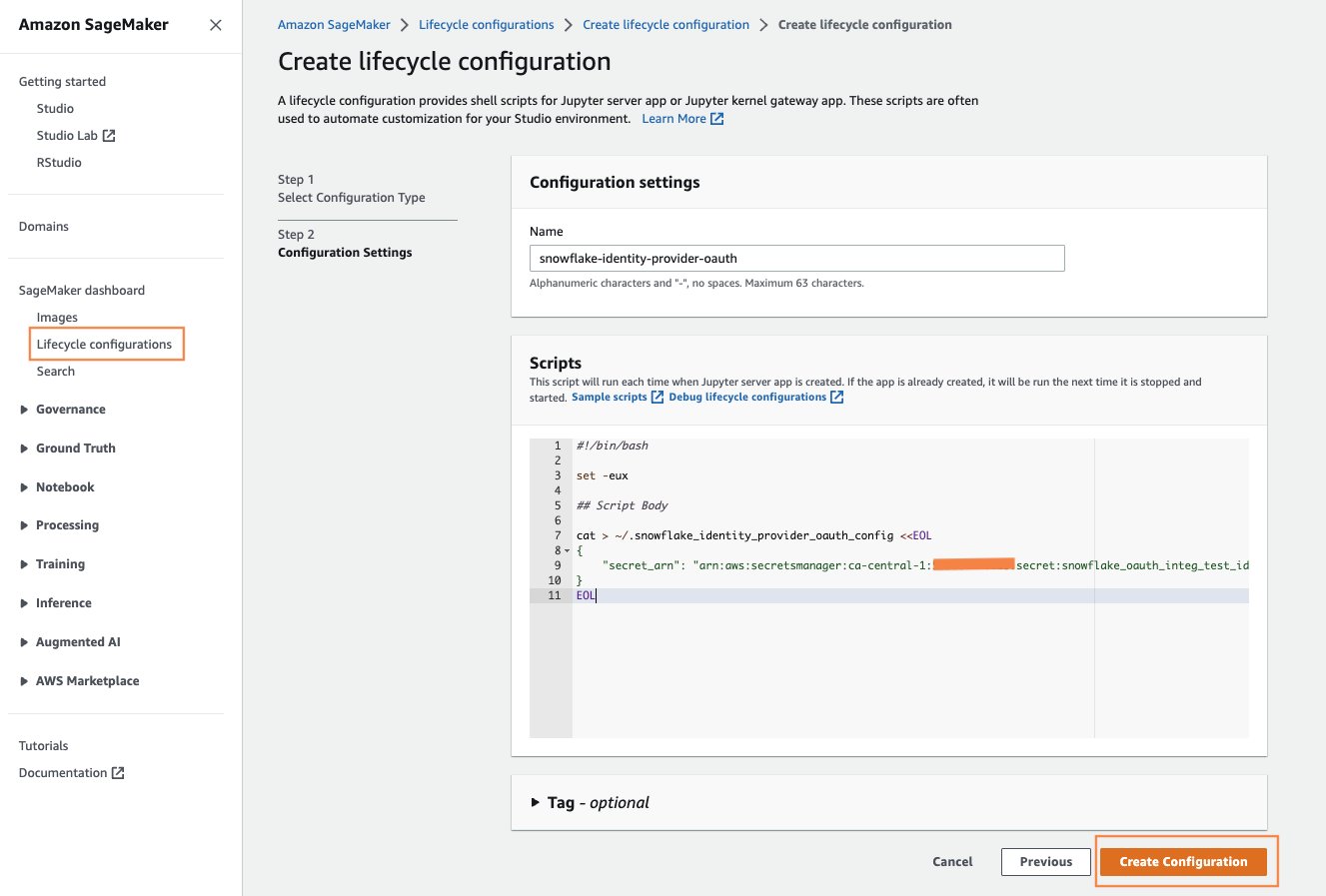

Criar uma configuração de ciclo de vida do Studio

Para criar uma configuração de ciclo de vida no Studio, conclua as seguintes etapas:

- No console SageMaker, escolha Configurações de ciclo de vida no painel de navegação.

- Escolha Criar configuração.

- Escolha Aplicativo do servidor Jupyter.

- Crie uma nova configuração de ciclo de vida ou anexe uma existente com o seguinte conteúdo:

A configuração cria um arquivo com o nome ".snowflake_identity_provider_oauth_config", contendo o segredo na pasta inicial do usuário.

- Escolha Criar configuração.

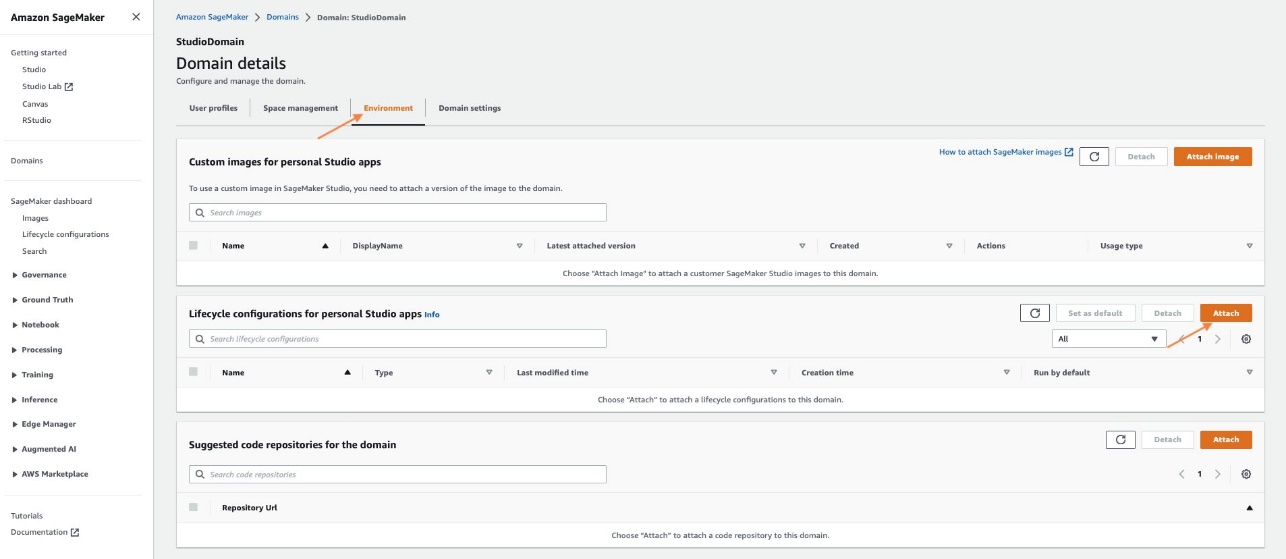

Definir a configuração padrão do ciclo de vida

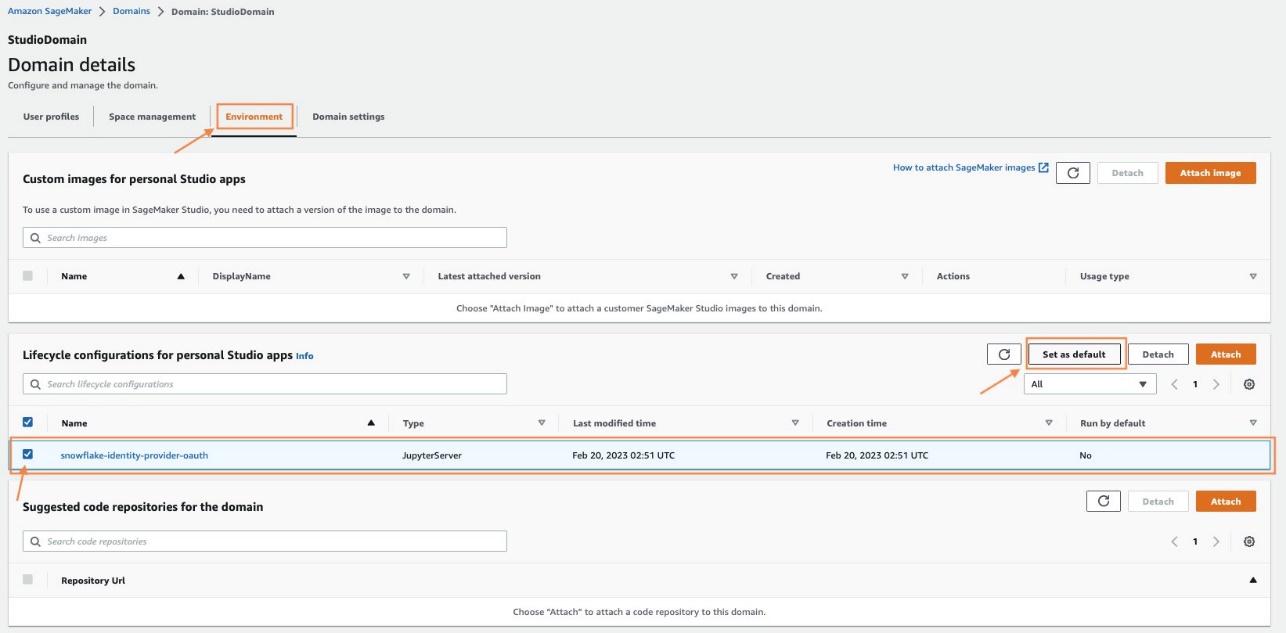

Conclua as etapas a seguir para definir a configuração do ciclo de vida que você acabou de criar como padrão:

- No console SageMaker, escolha domínios no painel de navegação.

- Escolha o domínio do Studio que você usará para este exemplo.

- No Meio Ambiente guia, no Configurações de ciclo de vida para aplicativos pessoais do Studio seção, escolha Anexar.

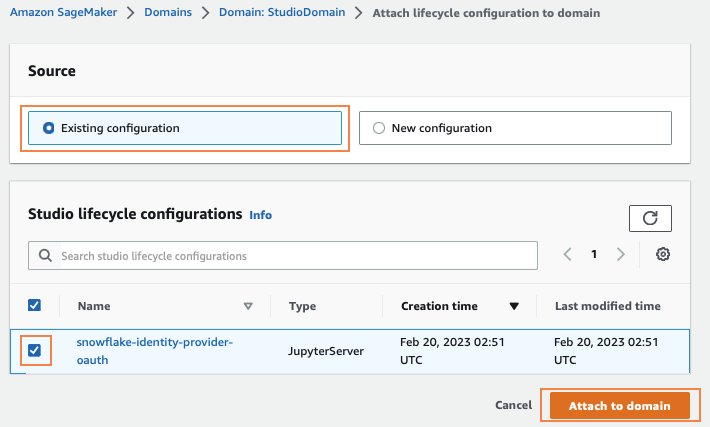

- Escolha fonte, selecione Configuração existente.

- Selecione a configuração que você acabou de fazer e escolha Anexar ao domínio.

- Selecione a nova configuração e escolha Definir como padrão, Em seguida, escolha Definir como padrão novamente na mensagem pop-up.

Suas novas configurações agora devem estar visíveis em Configurações de ciclo de vida para aplicativos pessoais do Studio como padrão.

- Encerre o aplicativo Studio e reinicie-o para que as alterações entrem em vigor.

Experiência do cientista de dados

Nesta seção, abordamos como os cientistas de dados podem se conectar ao Snowflake como uma fonte de dados no Data Wrangler e preparar dados para ML.

Crie um novo fluxo de dados

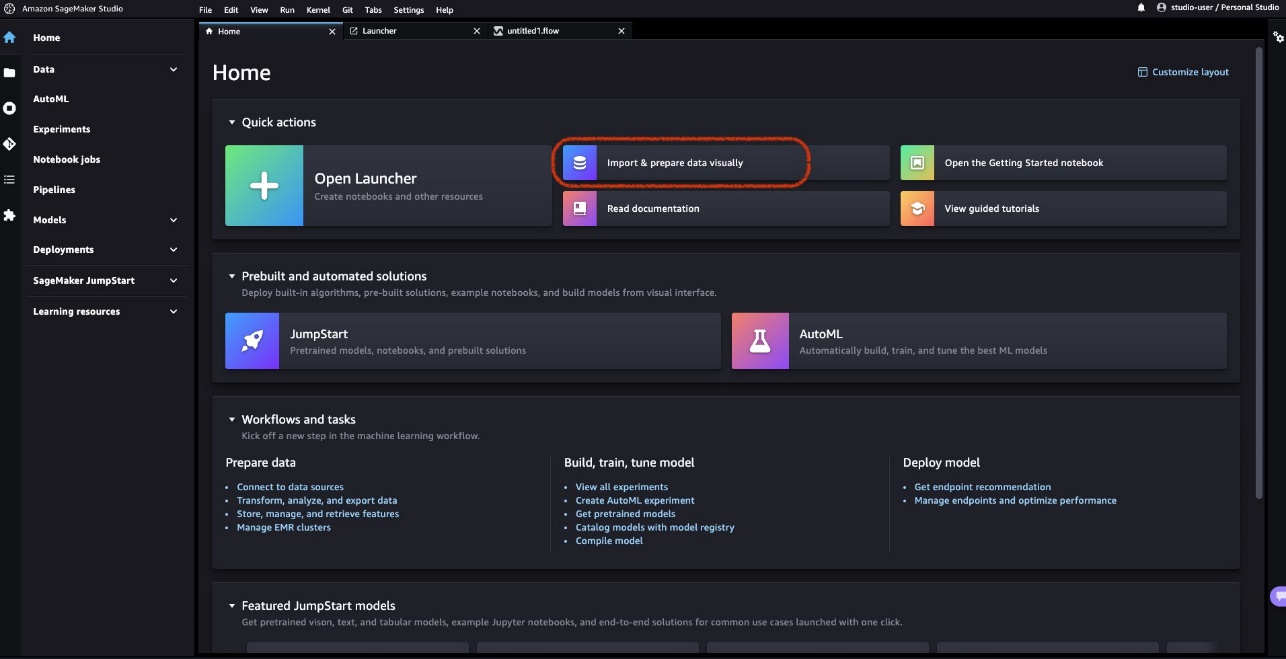

Para criar seu fluxo de dados, conclua as seguintes etapas:

- No console SageMaker, escolha Estúdio Amazon SageMaker no painel de navegação.

- Escolha Estúdio Aberto.

- no estúdio Início página, escolha Importar e preparar dados visualmente. Alternativamente, no Envie o drop-down, escolha Novo, Em seguida, escolha Fluxo do SageMaker Data Wrangler.

A criação de um novo fluxo pode levar alguns minutos.

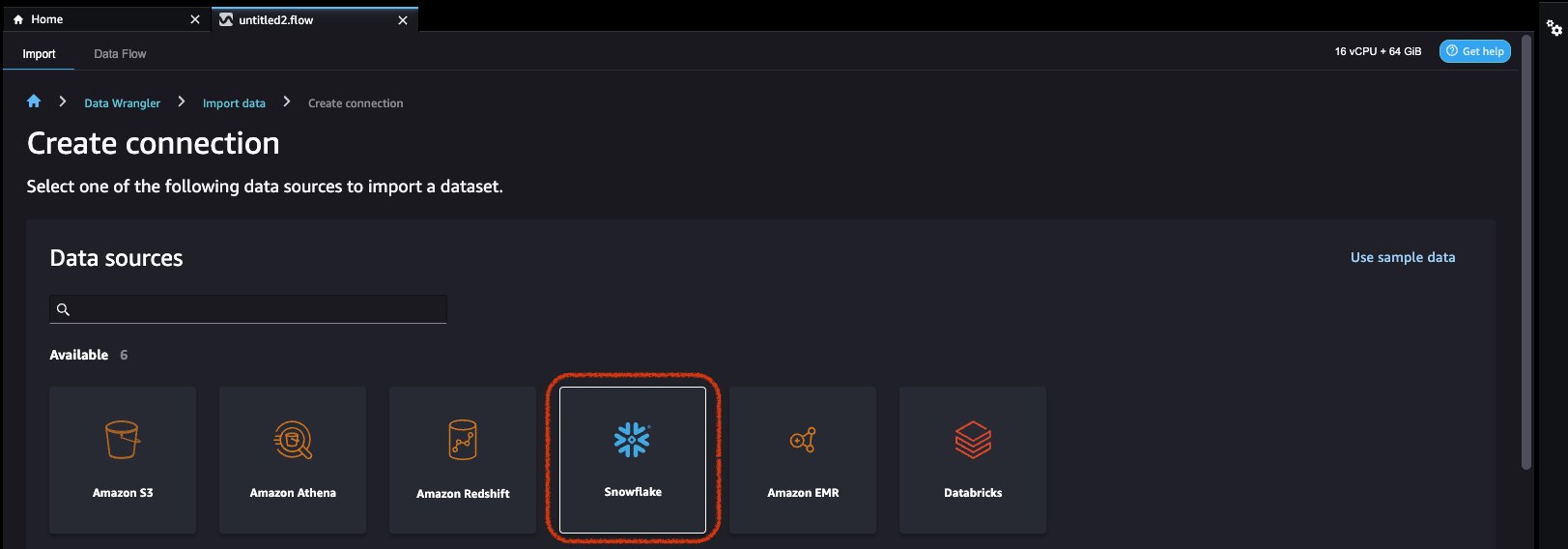

- No Datas de importação página, escolha Criar conexão.

- Escolha Floco de neve da lista de fontes de dados.

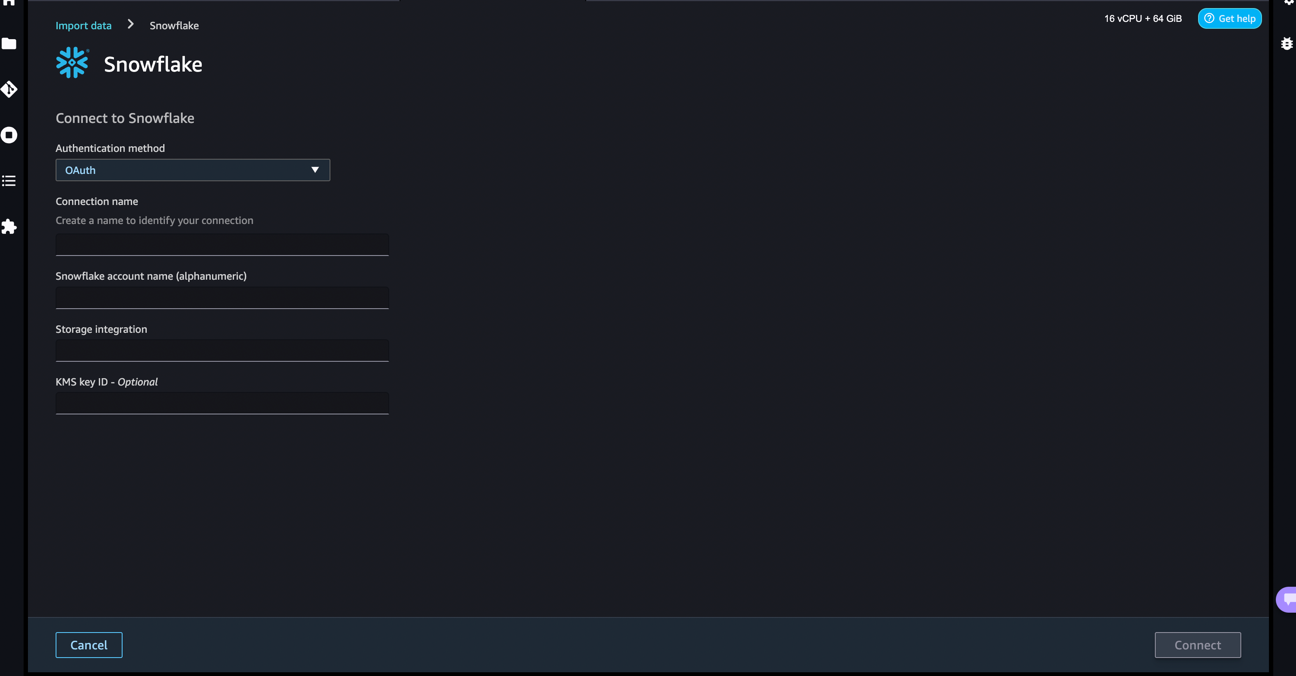

- Escolha Método de autenticação, escolha OAuth.

Se você não vir OAuth, verifique as etapas de configuração do ciclo de vida anteriores.

- Insira detalhes para Nome da conta do floco de neve e Integração de armazenamento.

- Digite um nome de conexão e escolha Contato.

Você é redirecionado para uma página de autenticação IdP. Para este exemplo, estamos usando o Okta.

- Digite seu nome de usuário e senha e escolha Iniciar Sessão.

Depois que a autenticação for bem-sucedida, você será redirecionado para a página de fluxo de dados do Studio.

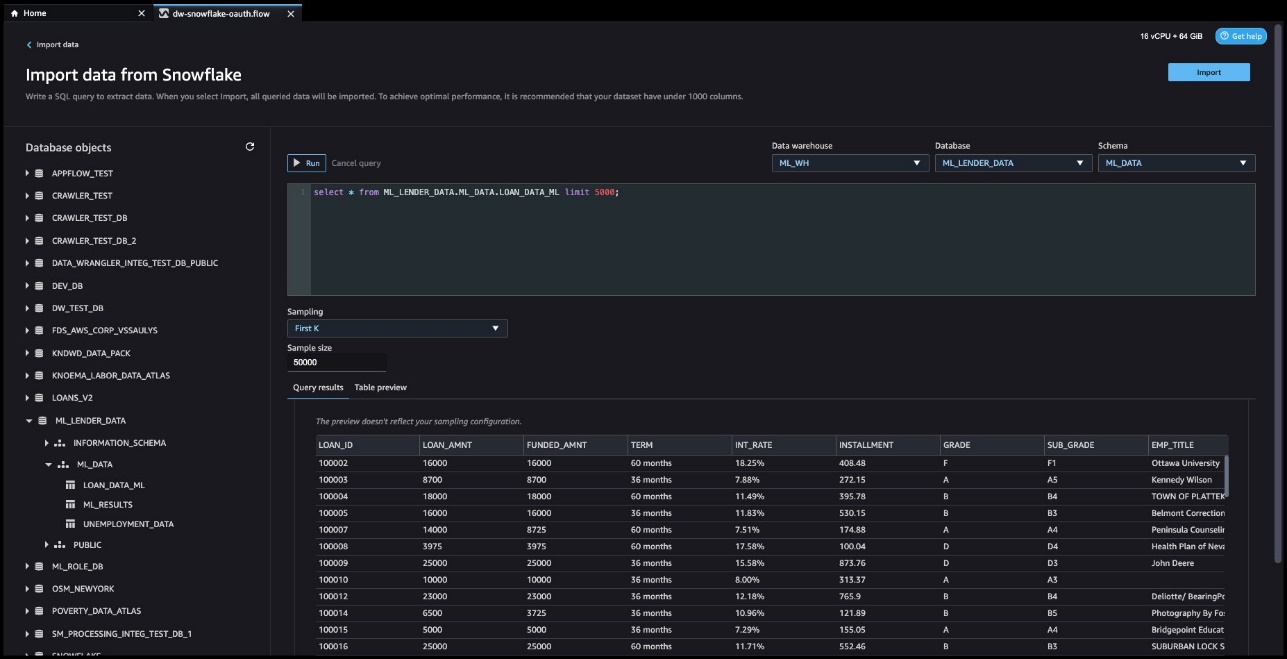

- No Importar dados do Snowflake página, navegue pelos objetos do banco de dados ou execute uma consulta para os dados de destino.

- No editor de consulta, insira uma consulta e visualize os resultados.

No exemplo a seguir, carregamos Dados do Empréstimo e recupere todas as colunas de 5,000 linhas.

- Escolha importação.

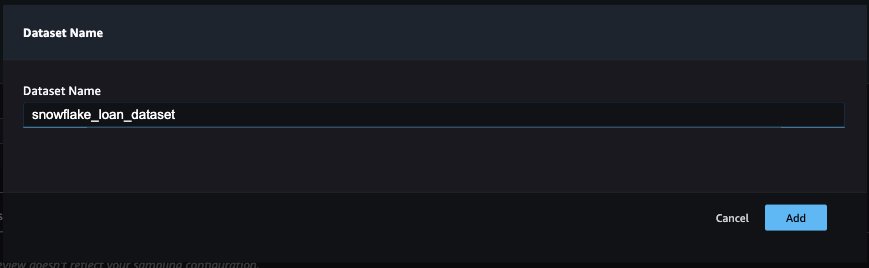

- Digite um nome de conjunto de dados (para esta postagem, usamos

snowflake_loan_dataset) e escolha Adicionar.

Você é redirecionado para o Preparar página, onde você pode adicionar transformações e análises aos dados.

O Data Wrangler facilita a ingestão de dados e a execução de tarefas de preparação de dados, como análise exploratória de dados, seleção de recursos e engenharia de recursos. Cobrimos apenas alguns dos recursos do Data Wrangler nesta postagem sobre preparação de dados; você pode usar o Data Wrangler para análises de dados mais avançadas, como importância de recursos, vazamento de alvo e explicabilidade de modelo usando uma interface de usuário fácil e intuitiva.

Analisar a qualidade dos dados

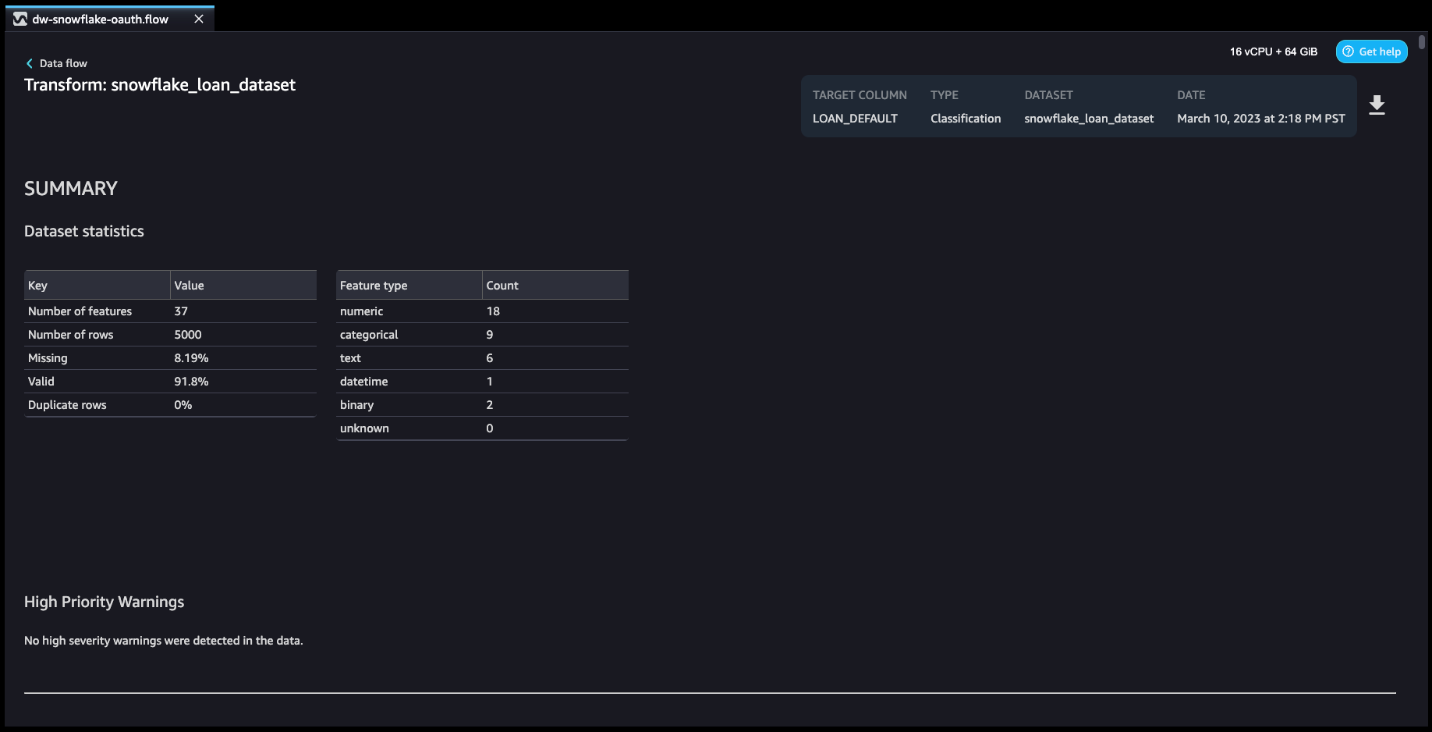

Use o Relatório de insights e qualidade de dados para realizar uma análise dos dados importados para o Data Wrangler. O Data Wrangler cria o relatório a partir dos dados amostrados.

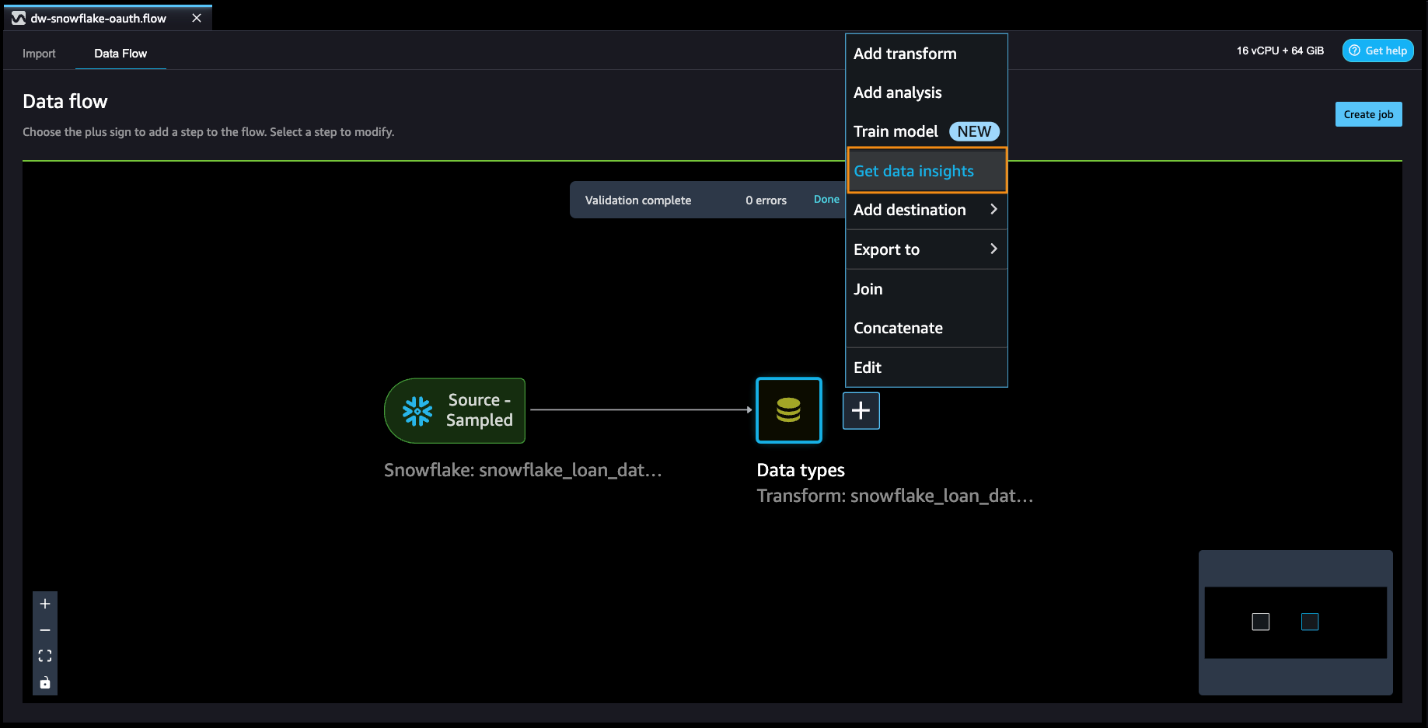

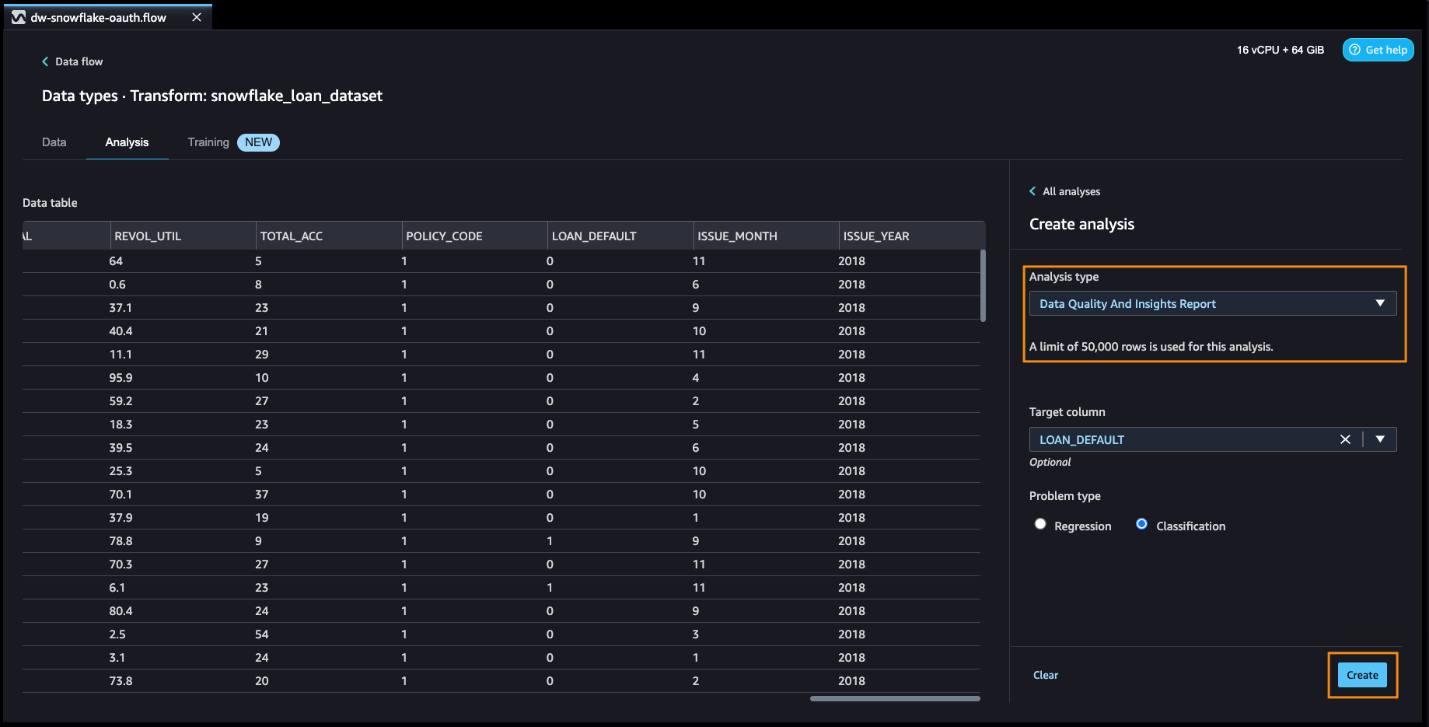

- Na página de fluxo do Data Wrangler, escolha o sinal de adição ao lado de Tipos de dados, Em seguida, escolha Obtenha insights de dados.

- Escolha Relatório de insights e qualidade de dados para Tipo de análise.

- Escolha Coluna de destino, escolha sua coluna de destino.

- Escolha Tipo de problema, selecione Classificação.

- Escolha Crie.

O relatório de insights tem um breve resumo dos dados, que inclui informações gerais, como valores ausentes, valores inválidos, tipos de recursos, contagens atípicas e muito mais. Você pode baixar o relatório ou visualizá-lo online.

Adicione transformações aos dados

Data Wrangler tem mais de 300 transformações integradas. Nesta seção, usamos algumas dessas transformações para preparar o conjunto de dados para um modelo de ML.

- Na página de fluxo do Data Wrangler, escolha o sinal de adição e escolha Adicionar transformação.

Se estiver seguindo as etapas da postagem, você será direcionado para cá automaticamente após adicionar seu conjunto de dados.

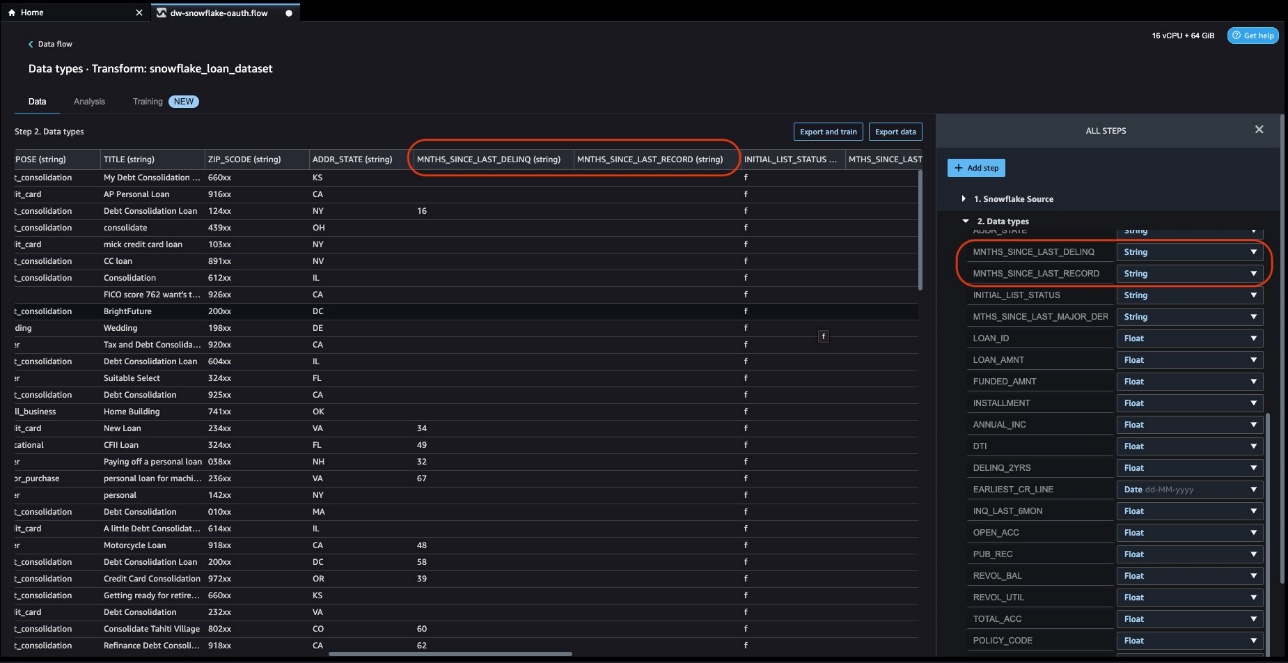

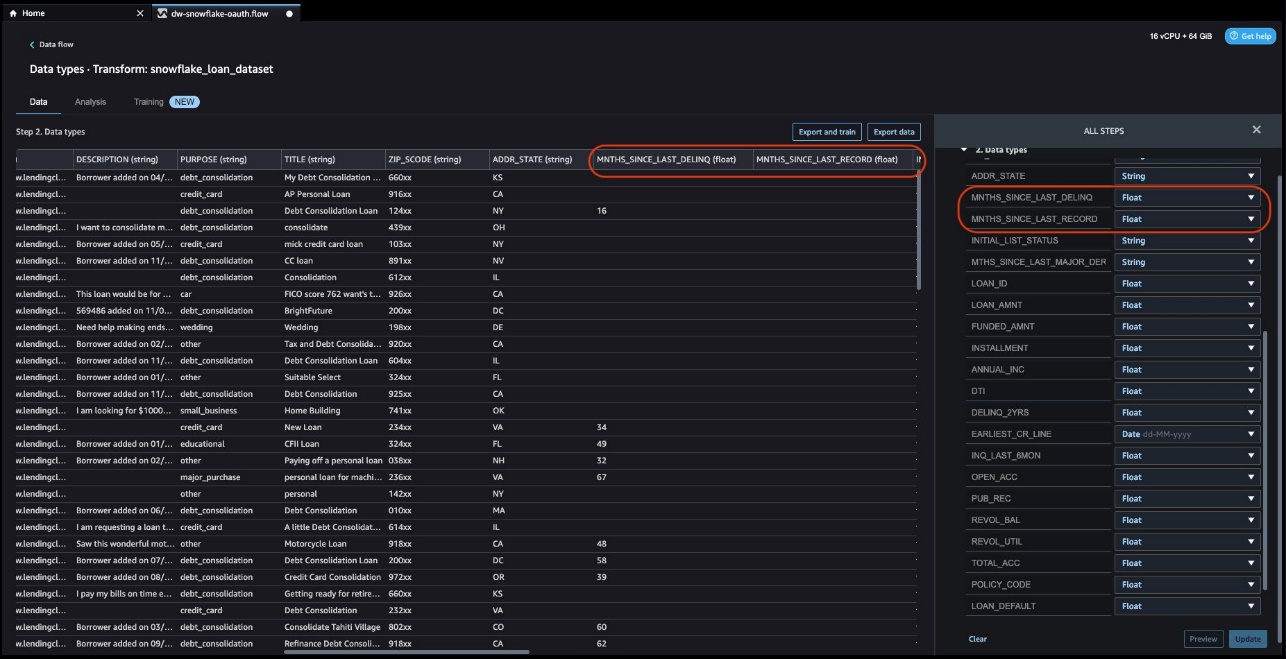

- Verifique e modifique o tipo de dados das colunas.

Olhando pelas colunas, identificamos que MNTHS_SINCE_LAST_DELINQ e MNTHS_SINCE_LAST_RECORD provavelmente deve ser representado como um tipo de número em vez de string.

- Depois de aplicar as alterações e adicionar a etapa, você pode verificar se o tipo de dados da coluna foi alterado para float.

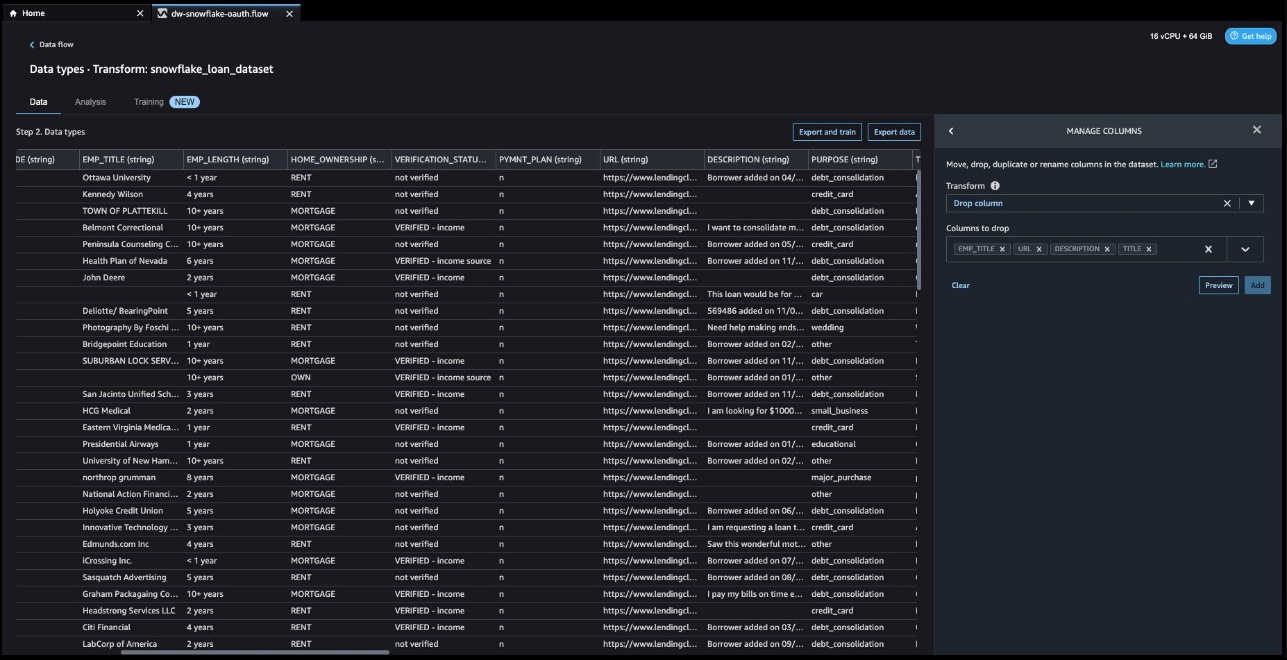

Olhando através dos dados, podemos ver que os campos EMP_TITLE, URL, DESCRIPTION e TITLE provavelmente não fornecerão valor ao nosso modelo em nosso caso de uso, portanto, podemos eliminá-los.

- Escolha Adicionar Etapa, Em seguida, escolha Gerenciar colunas.

- Escolha Transformar, escolha Coluna de queda.

- Escolha Coluna para soltar, especificamos

EMP_TITLE,URL,DESCRIPTIONeTITLE. - Escolha visualização e Adicionar.

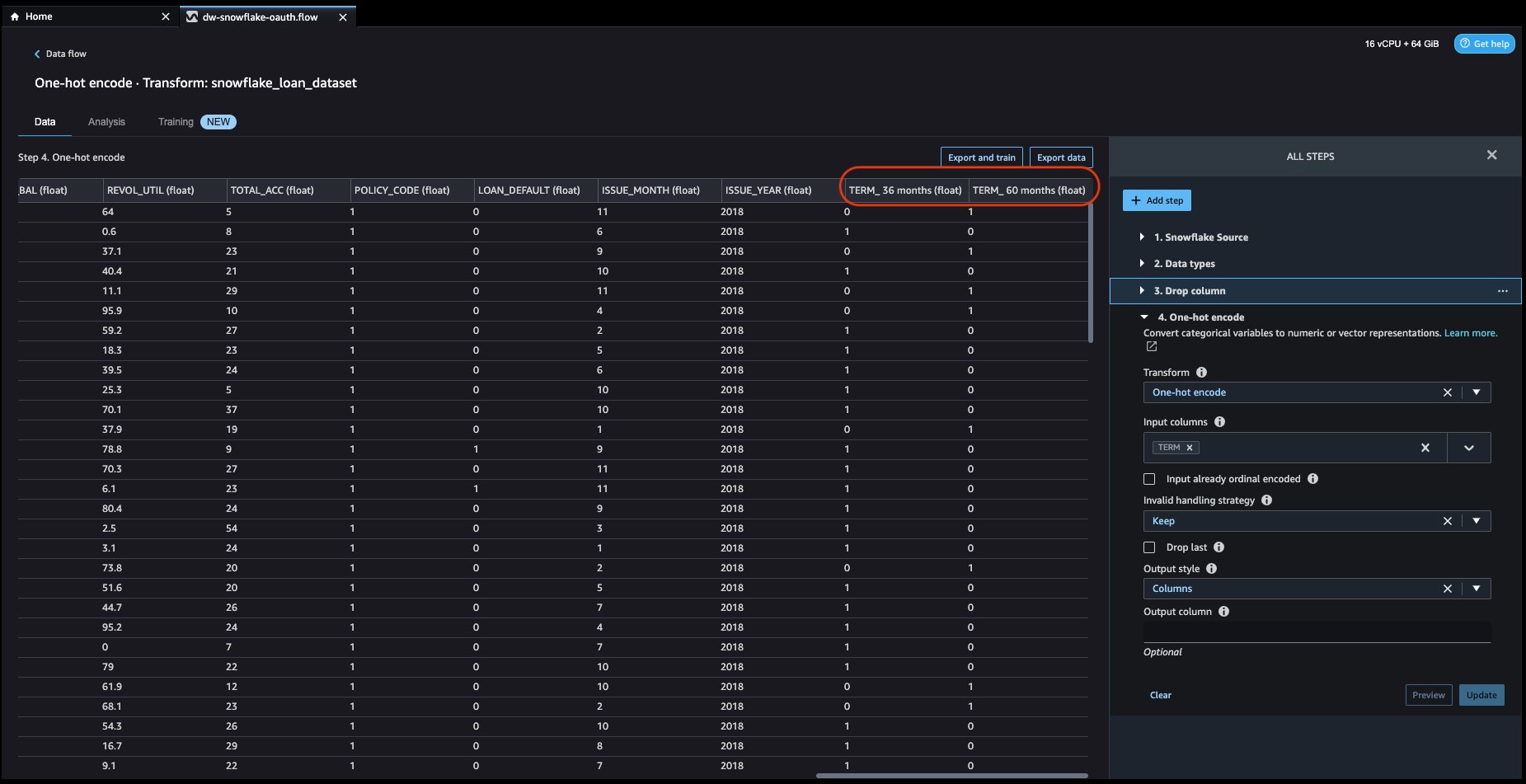

Em seguida, queremos procurar dados categóricos em nosso conjunto de dados. O Data Wrangler possui uma funcionalidade integrada para codificar dados categóricos usando codificações ordinais e one-hot. Olhando nosso conjunto de dados, podemos ver que o TERM, HOME_OWNERSHIP e PURPOSE todas as colunas parecem ser de natureza categórica.

- Adicione outra etapa e escolha Codificar categórico.

- Escolha Transformar, escolha Codificação one-hot.

- Escolha Coluna de entrada, escolha

TERM. - Escolha Estilo de saída, escolha colunas.

- Deixe todas as outras configurações como padrão e escolha visualização e Adicionar.

A HOME_OWNERSHIP coluna tem quatro valores possíveis: RENT, MORTGAGE, OWN, e outro.

- Repita as etapas anteriores para aplicar uma abordagem de codificação one-hot a esses valores.

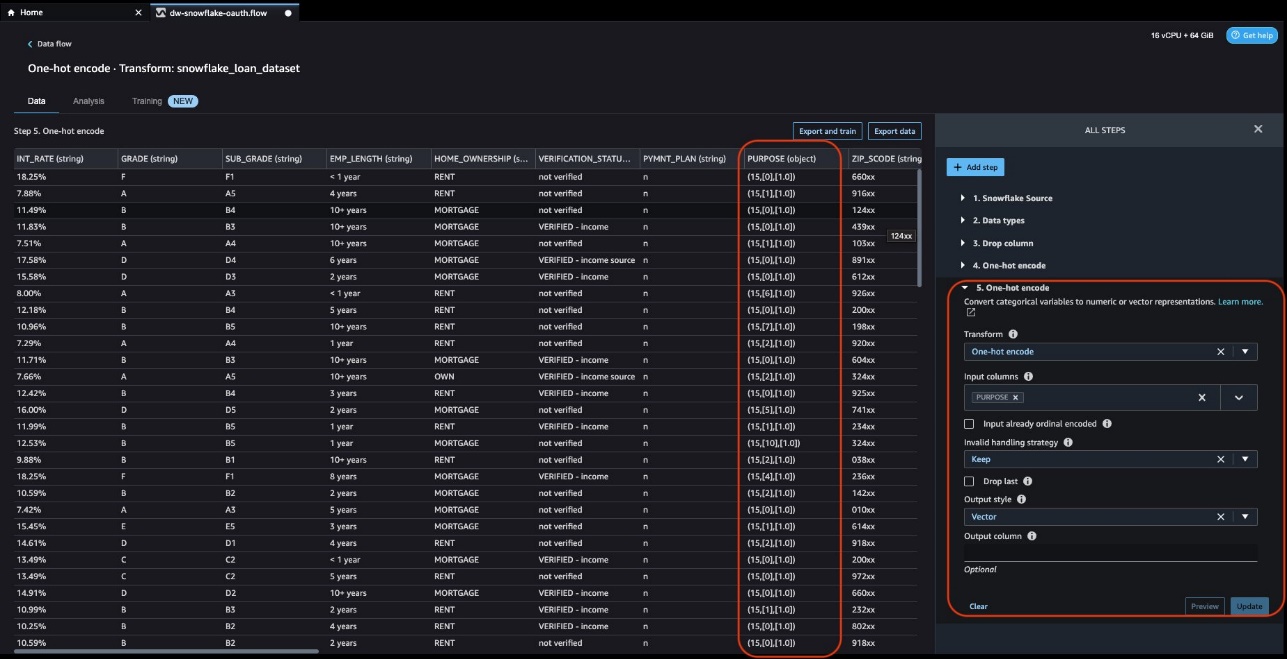

Por último, o PURPOSE coluna tem vários valores possíveis. Para esses dados, também usamos uma abordagem de codificação one-hot, mas definimos a saída como um vetor em vez de colunas.

- Escolha Transformar, escolha Codificação one-hot.

- Escolha Coluna de entrada, escolha

PURPOSE. - Escolha Estilo de saída, escolha vetor.

- Escolha Coluna de saída, chamamos esta coluna

PURPOSE_VCTR.

Isso mantém o original PURPOSE coluna, se decidirmos usá-lo mais tarde.

- Deixe todas as outras configurações como padrão e escolha visualização e Adicionar.

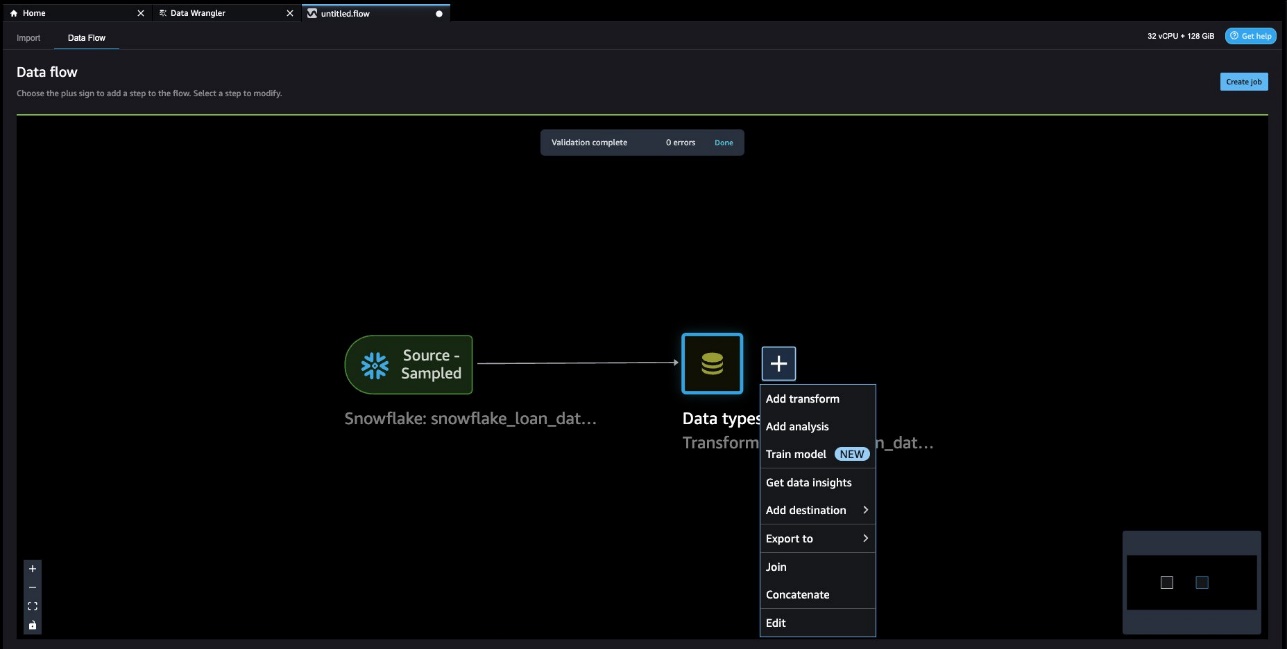

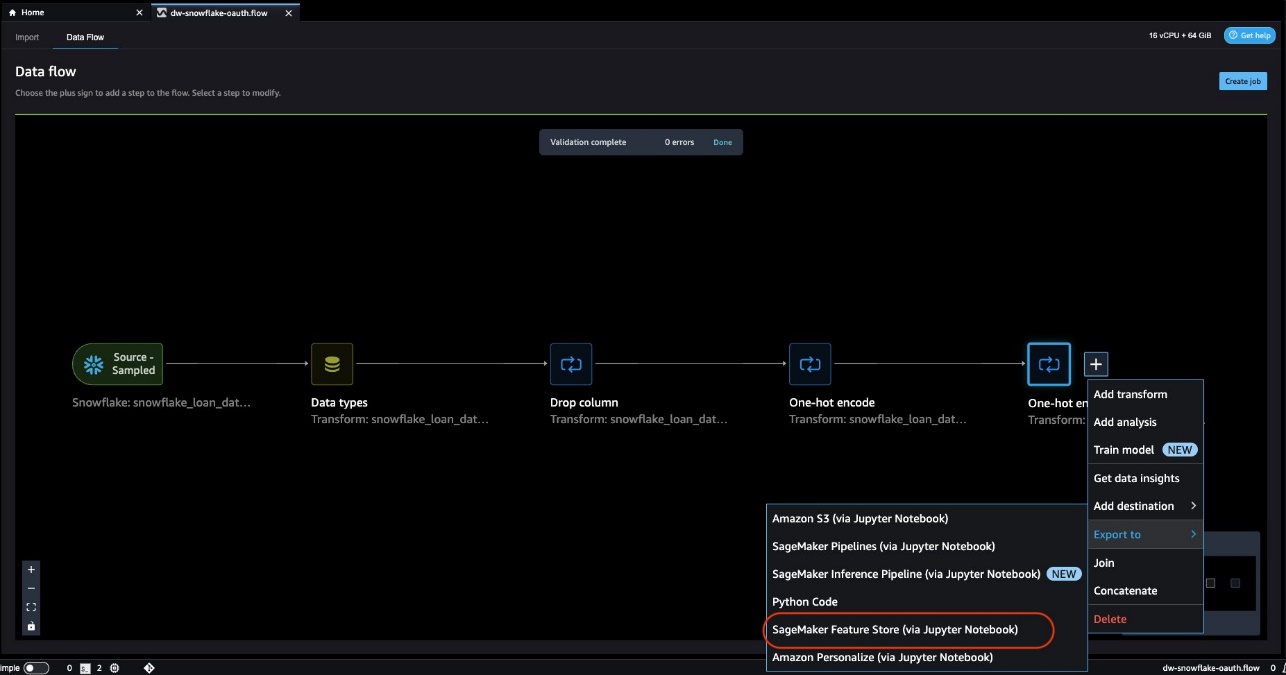

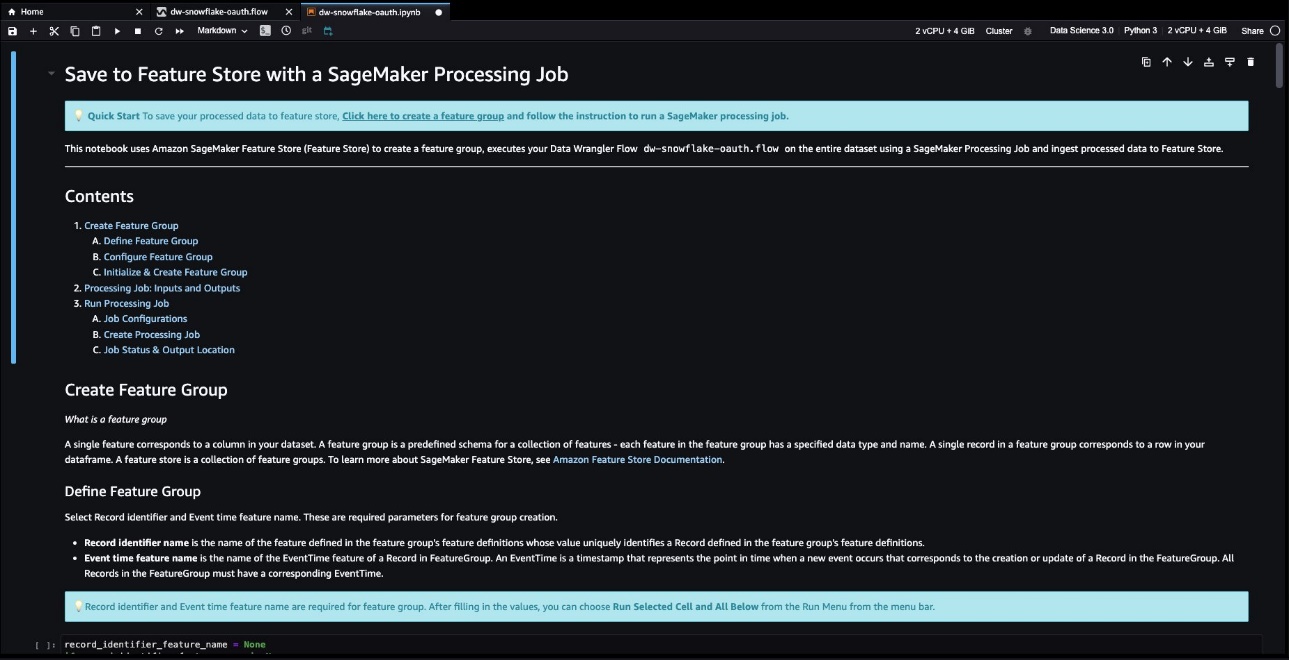

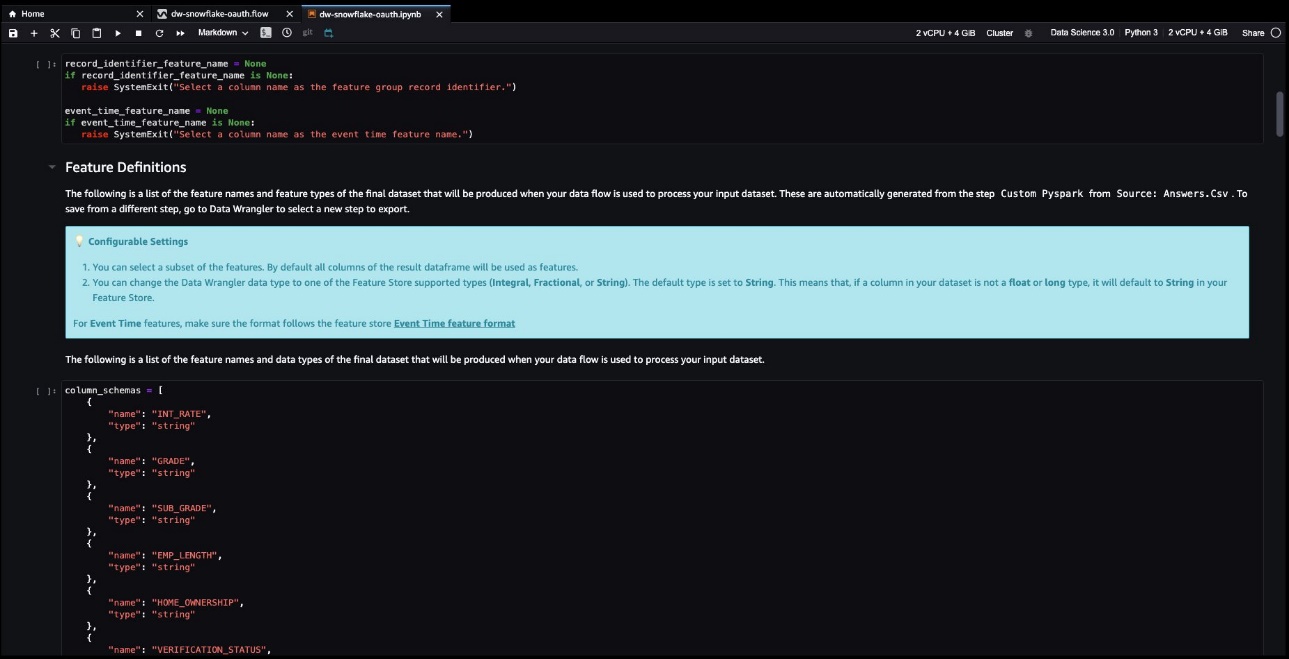

Exportar o fluxo de dados

Por fim, exportamos todo esse fluxo de dados para um armazenamento de recursos com um trabalho de processamento do SageMaker, que cria um notebook Jupyter com o código pré-preenchido.

- Na página de fluxo de dados, escolha o sinal de mais e Exportar para.

- Escolha para onde exportar. Para nosso caso de uso, escolhemos Loja de artigos SageMaker.

O notebook exportado agora está pronto para ser executado.

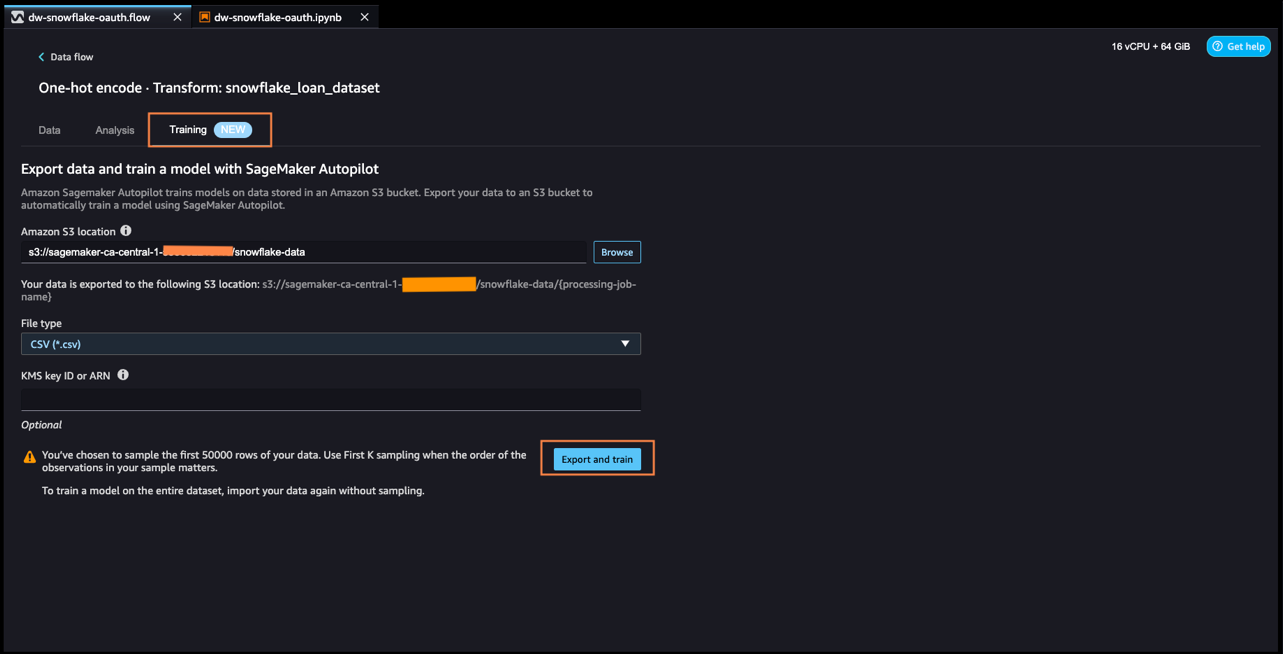

Exportar dados e treinar um modelo com piloto automático

Agora podemos treinar o modelo usando Piloto automático do Amazon SageMaker.

- Na página de fluxo de dados, escolha o Training aba.

- Escolha Localização do Amazon S3, insira um local para os dados a serem salvos.

- Escolha Exportar e treinar.

- Especifique as configurações no Alvo e características, Método de treinamento, Implantação e configurações avançadas e Revise e crie .

- Escolha Criar experimento para encontrar o melhor modelo para o seu problema.

limpar

Se o seu trabalho com o Data Wrangler estiver completo, desligue sua instância do Data Wrangler para evitar incorrer em taxas adicionais.

Conclusão

Nesta postagem, demonstramos como conectar Data Wrangler para Snowflake usando OAuth, transformando e analisando um conjunto de dados e, finalmente, exportando-o para o fluxo de dados para que possa ser usado em um notebook Jupyter. Mais notavelmente, criamos um pipeline para preparação de dados sem precisar escrever nenhum código.

Para começar a usar o Data Wrangler, consulte Prepare dados de ML com o Amazon SageMaker Data Wrangler.

Sobre os autores

Ajjay Govindaram é Arquiteto de Soluções Sênior na AWS. Ele trabalha com clientes estratégicos que usam AI/ML para resolver problemas complexos de negócios. Sua experiência está em fornecer orientação técnica e assistência de design para implantações de aplicativos de IA/ML de modesta a grande escala. Seu conhecimento varia de arquitetura de aplicativos a big data, análise e aprendizado de máquina. Ele gosta de ouvir música enquanto descansa, experimenta o ar livre e passa tempo com seus entes queridos.

Ajjay Govindaram é Arquiteto de Soluções Sênior na AWS. Ele trabalha com clientes estratégicos que usam AI/ML para resolver problemas complexos de negócios. Sua experiência está em fornecer orientação técnica e assistência de design para implantações de aplicativos de IA/ML de modesta a grande escala. Seu conhecimento varia de arquitetura de aplicativos a big data, análise e aprendizado de máquina. Ele gosta de ouvir música enquanto descansa, experimenta o ar livre e passa tempo com seus entes queridos.

bosco albuquerque é arquiteto sênior de soluções de parceiros na AWS e tem mais de 20 anos de experiência trabalhando com produtos de análise e banco de dados de fornecedores de bancos de dados corporativos e provedores de nuvem. Ele ajudou grandes empresas de tecnologia a projetar soluções de análise de dados e liderou equipes de engenharia na concepção e implementação de plataformas de análise de dados e produtos de dados.

bosco albuquerque é arquiteto sênior de soluções de parceiros na AWS e tem mais de 20 anos de experiência trabalhando com produtos de análise e banco de dados de fornecedores de bancos de dados corporativos e provedores de nuvem. Ele ajudou grandes empresas de tecnologia a projetar soluções de análise de dados e liderou equipes de engenharia na concepção e implementação de plataformas de análise de dados e produtos de dados.

Matt Marzillo é engenheiro de vendas sênior da Snowflake. Ele tem 10 anos de experiência em funções de ciência de dados e aprendizado de máquina, tanto em consultoria quanto em organizações do setor. Matt tem experiência no desenvolvimento e implantação de modelos de IA e ML em várias organizações diferentes em áreas como marketing, vendas, operações, clínicas e finanças, além de assessoria em funções consultivas.

Matt Marzillo é engenheiro de vendas sênior da Snowflake. Ele tem 10 anos de experiência em funções de ciência de dados e aprendizado de máquina, tanto em consultoria quanto em organizações do setor. Matt tem experiência no desenvolvimento e implantação de modelos de IA e ML em várias organizações diferentes em áreas como marketing, vendas, operações, clínicas e finanças, além de assessoria em funções consultivas.

Huong Nguyen é líder de produto do Amazon SageMaker Data Wrangler na AWS. Ela tem 15 anos de experiência na criação de produtos obcecados pelo cliente e orientados por dados para espaços corporativos e de consumo. Em seu tempo livre, ela gosta de livros de áudio, jardinagem, caminhadas e passar o tempo com sua família e amigos.

Huong Nguyen é líder de produto do Amazon SageMaker Data Wrangler na AWS. Ela tem 15 anos de experiência na criação de produtos obcecados pelo cliente e orientados por dados para espaços corporativos e de consumo. Em seu tempo livre, ela gosta de livros de áudio, jardinagem, caminhadas e passar o tempo com sua família e amigos.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- Platoblockchain. Inteligência Metaverso Web3. Conhecimento Ampliado. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/access-snowflake-data-using-oauth-based-authentication-in-amazon-sagemaker-data-wrangler/

- :é

- $UP

- 000

- 10

- 100

- 15 anos

- 20 anos

- 7

- 8

- 9

- a

- Capaz

- Sobre

- Acesso

- Acesso a dados

- acessando

- Conta

- em

- Ad

- Adição

- Adicional

- admin

- avançar

- avançado

- aconselhando

- Depois de

- AI

- AI / ML

- Todos os Produtos

- Amazon

- Amazon Sage Maker

- Gerenciador de dados do Amazon SageMaker

- Analisa

- análise

- analítica

- analisar

- análise

- e

- Outro

- api

- app

- aparecer

- Aplicação

- Aplicar

- Aplicando

- abordagem

- Aplicativos

- arquitetura

- SOMOS

- áreas

- AS

- Assistência

- associado

- At

- anexar

- público

- auditivo

- autenticar

- Autenticação

- autorização

- automatizar

- automaticamente

- AWS

- Azul

- BE

- Porque

- antes

- começar

- MELHOR

- Grande

- Big Data

- corpo

- Livros

- construídas em

- negócio

- by

- chamada

- chamado

- CAN

- capacidades

- casas

- CAT

- Alterações

- escolha

- Escolha

- cliente

- Clínico

- Na nuvem

- código

- Coluna

- colunas

- Empresas

- completar

- integrações

- conceito

- Configuração

- Contato

- Conexão de

- da conexão

- cônsul

- consultor

- consumidor

- conteúdo

- poderia

- cobrir

- coberto

- crio

- criado

- cria

- Criar

- Credenciais

- Clientes

- dados,

- análise de dados

- Análise de Dados

- Plataforma de dados

- Preparação de dados

- ciência de dados

- cientista de dados

- orientado por dados

- banco de dados

- decidir

- Padrão

- demonstraram

- Implantação

- Implantações

- Design

- concepção

- detalhe

- detalhes

- em desenvolvimento

- diferente

- direção

- diretamente

- distinto

- documentação

- Não faz

- domínio

- não

- down

- download

- Cair

- cada

- editor

- efeito

- ou

- permitir

- engenheiro

- Engenharia

- Entrar

- Empreendimento

- Meio Ambiente

- exemplo

- existente

- vasta experiência

- experimentando

- Análise exploratória de dados

- exportar

- externo

- FALHA

- família

- Característica

- Funcionalidades

- Taxas

- poucos

- campo

- Campos

- Envie o

- Finalmente

- financiar

- Encontre

- Flutuador

- fluxo

- seguinte

- Escolha

- formato

- Frequência

- freqüentemente

- amigos

- da

- funcionalidade

- Geral

- ter

- dá

- conceder

- maior

- Guias

- Ter

- ter

- ajudar

- ajudou

- SUA PARTICIPAÇÃO FAZ A DIFERENÇA

- Início

- Como funciona o dobrador de carta de canal

- Como Negociar

- HTML

- http

- HTTPS

- ID

- identificador

- identificar

- Identidade

- inativo

- implementação

- importar

- importância

- in

- inclui

- Incluindo

- incorretamente

- indústria

- INFORMAÇÕES

- entrada

- introspecção

- insights

- instruções

- integração

- integrações

- Interface

- intuitivo

- envolvido

- IT

- Trabalho

- Empregos

- jpg

- Chave

- Conhecimento

- grande

- em grande escala

- líder

- aprendizagem

- levou

- encontra-se

- wifecycwe

- garantia vitalícia

- como

- Provável

- Lista

- Escuta

- carregar

- cargas

- localização

- olhar

- procurando

- amado

- máquina

- aprendizado de máquina

- moldadas

- fazer

- FAZ

- Fazendo

- Gerente

- muitos

- Marketing

- mensagem

- poder

- Minutos

- desaparecido

- ML

- modelo

- modelos

- modificar

- mais

- a maioria

- múltiplo

- Música

- nome

- nomes

- Natureza

- Navegação

- você merece...

- necessitando

- Cria

- Novo

- Próximo

- notavelmente

- caderno

- número

- juramento

- objetos

- of

- OKTA

- on

- ONE

- online

- Operações

- Opção

- organizações

- original

- Outros

- de outra forma

- ao ar livre

- saída

- próprio

- página

- pares

- pão

- parceiro

- Senha

- Realizar

- permissões

- pessoal

- oleoduto

- plataforma

- Plataformas

- platão

- Inteligência de Dados Platão

- PlatãoData

- mais

- políticas

- pop-up

- possível

- Publique

- preferido

- Preparar

- pré-requisitos

- visualização

- anterior

- Problema

- problemas

- procedimentos

- processo

- em processamento

- Produto

- Produtos

- Perfil

- Programação

- devidamente

- fornecer

- fornecido

- provedor

- fornecedores

- fornece

- fornecendo

- qualidade

- em vez

- pronto

- recomendar

- redirecionar

- redução

- região

- cadastre-se

- registro

- Registo

- relançar

- Denunciar

- representado

- requerer

- aqueles

- DESCANSO

- resultar

- Resultados

- varejo

- Tipo

- papéis

- Execute

- corrida

- sábio

- vendas

- agendamento

- Ciência

- Cientista

- cientistas

- escopo

- Segredo

- Seção

- seções

- segurança

- doadores,

- senior

- Sensibilidade

- conjunto

- contexto

- Configurações

- vários

- concha

- rede de apoio social

- mostrar

- assinar

- simples

- solteiro

- So

- Soluções

- RESOLVER

- alguns

- fonte

- Fontes

- espaços

- Passar

- começado

- começa

- Passo

- Passos

- armazenamento

- loja

- armazenadas

- armazenar

- Estratégico

- Tanga

- estudo

- bem sucedido

- tal

- RESUMO

- ajuda

- suportes

- TAG

- Tire

- toma

- Target

- visadas

- tarefas

- equipes

- Dados Técnicos:

- Tecnologia

- empresas de tecnologia

- que

- A

- as informações

- deles

- Eles

- Este

- Através da

- tempo

- para

- token

- Tokens

- Trem

- Transformar

- transformações

- transformando

- tipos

- para

- compreender

- único

- Atualizar

- URL

- usar

- caso de uso

- Utilizador

- Interface de Usuário

- usuários

- valor

- Valores

- fornecedores

- verificar

- via

- Ver

- visível

- Passo a passo

- aviso

- semanas

- BEM

- qual

- enquanto

- QUEM

- inteiro

- precisarão

- de

- dentro

- sem

- Atividades:

- fluxos de trabalho

- trabalhar

- trabalho

- escrever

- escrita

- anos

- Vocês

- investimentos

- zefirnet