Este post é de co-autoria com Jan Paul Assendorp, Thomas Lietzow, Christopher Masch, Alexander Meinert, Dr. Lars Palzer, Jan Schillemans da SIGNAL IDUNA.

Na SIGNAL IDUNA, uma grande seguradora alemã, estamos nos reinventando com nosso programa de transformação VISION2023 para nos tornarmos ainda mais orientados para o cliente. Dois aspectos são centrais para essa transformação: a reorganização de grande parte da força de trabalho em equipes multifuncionais e ágeis e se tornar uma empresa verdadeiramente orientada por dados. Aqui, o lema “Você constrói, você executa” é um requisito importante para uma equipe multifuncional que cria um produto de dados ou aprendizado de máquina (ML). Isso impõe restrições rígidas sobre quanto a equipe de trabalho pode gastar para produzir e executar um produto.

Este post mostra como a SIGNAL IDUNA enfrenta esse desafio e utiliza o AWS Cloud para permitir que equipes multifuncionais criem e operacionalizem seus próprios produtos de ML. Para isso, primeiro apresentamos a estrutura organizacional de equipes ágeis, que define os requisitos centrais da infraestrutura de nuvem usada para desenvolver e executar um produto. Em seguida, mostramos como três equipes centrais da SIGNAL IDUNA permitem que equipes multifuncionais criem produtos de dados na Nuvem AWS com o mínimo de assistência, fornecendo um fluxo de trabalho adequado e soluções de infraestrutura que podem ser facilmente usadas e adaptadas. Por fim, revisamos nossa abordagem e a comparamos com uma abordagem mais clássica, onde desenvolvimento e operação são separados de forma mais estrita.

Agile@SI – a base da mudança organizacional

Desde o início de 2021, a SIGNAL IDUNA começou a colocar em ação sua estratégia Agile@SI e a estabelecer métodos ágeis para desenvolver soluções orientadas para o cliente em toda a empresa [1]. Tarefas e metas anteriores agora são realizadas por equipes multifuncionais, chamadas de esquadrões. Esses esquadrões empregam métodos ágeis (como o framework Scrum), tomam suas próprias decisões e constroem produtos orientados para o cliente. Normalmente, os esquadrões estão localizados em divisões de negócios, como marketing, e muitos têm uma forte ênfase na criação de produtos baseados em dados e baseados em ML. Como exemplo, os casos de uso típicos em seguros são a previsão de perda de clientes e a recomendação de produtos.

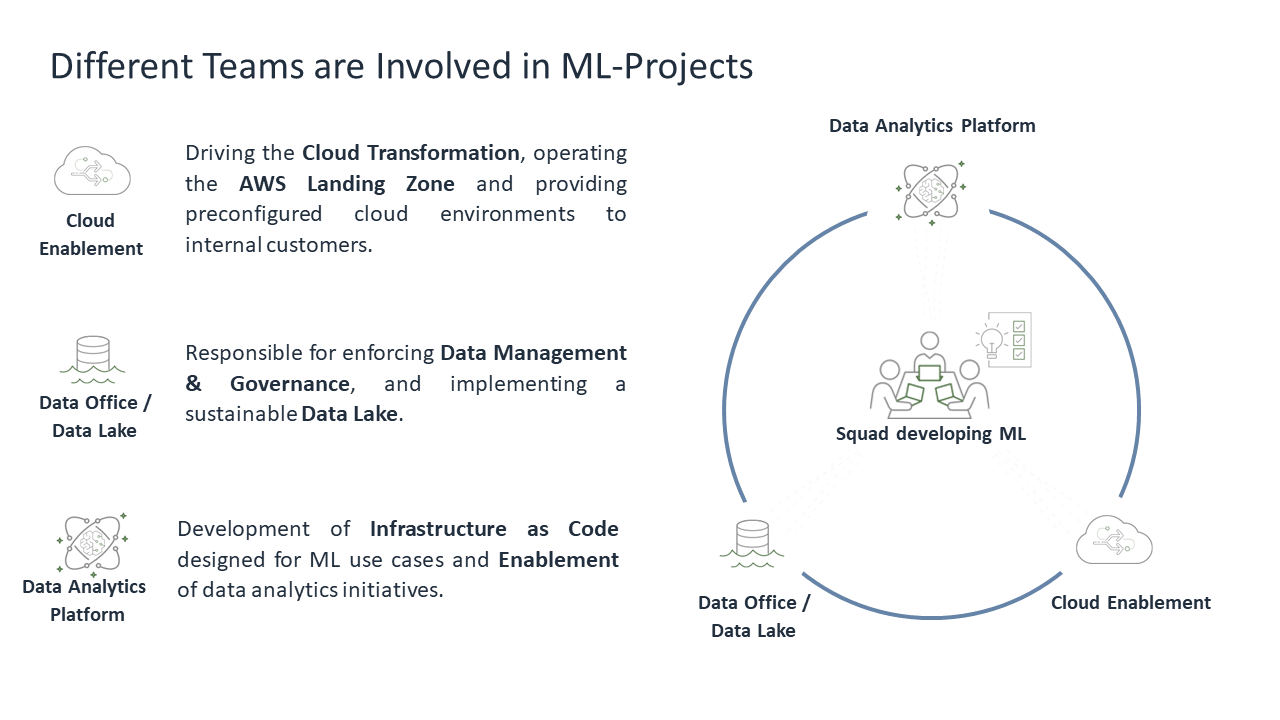

Devido à complexidade do ML, criar uma solução de ML por um único esquadrão é desafiador e, portanto, requer a colaboração de diferentes esquadrões.

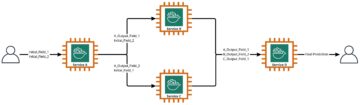

A SIGNAL IDUNA tem três equipas essenciais que apoiam a criação de soluções de ML. Rodeada por estes três esquadrões está a equipa responsável pelo desenvolvimento e operação a longo prazo e da solução de ML. Essa abordagem segue o modelo de responsabilidade compartilhada da AWS [2].

Na imagem acima, todos os esquadrões estão representados em uma visão geral.

Ativação da nuvem

A infraestrutura de nuvem subjacente para toda a organização é fornecida pelo esquadrão Cloud Enablement. É sua tarefa permitir que as equipes construam produtos em tecnologias de nuvem por conta própria. Isso melhora o tempo de lançamento de novos produtos no mercado, como o ML, e segue o princípio de “você constrói, você executa”.

Escritório de dados/Data Lake

A movimentação de dados para a nuvem, bem como a localização do conjunto de dados correto, é suportada pelo esquadrão Data Office/Data Lake. Eles configuram um catálogo de dados que pode ser usado para pesquisar e selecionar os conjuntos de dados necessários. Seu objetivo é estabelecer transparência e governança de dados. Além disso, eles são responsáveis por estabelecer e operar um Data Lake que ajuda as equipes a acessar e processar dados relevantes.

Plataforma de análise de dados

Nosso esquadrão Data Analytics Platform (DAP) é uma equipe focada em nuvem e ML na SIGNAL IDUNA que é proficiente em engenharia de ML, engenharia de dados e ciência de dados. Habilitamos equipes internas usando a nuvem pública para ML fornecendo componentes e conhecimento de infraestrutura. Nossos produtos e serviços são apresentados em detalhes na seção a seguir.

Habilitando equipes multifuncionais para criar soluções de ML

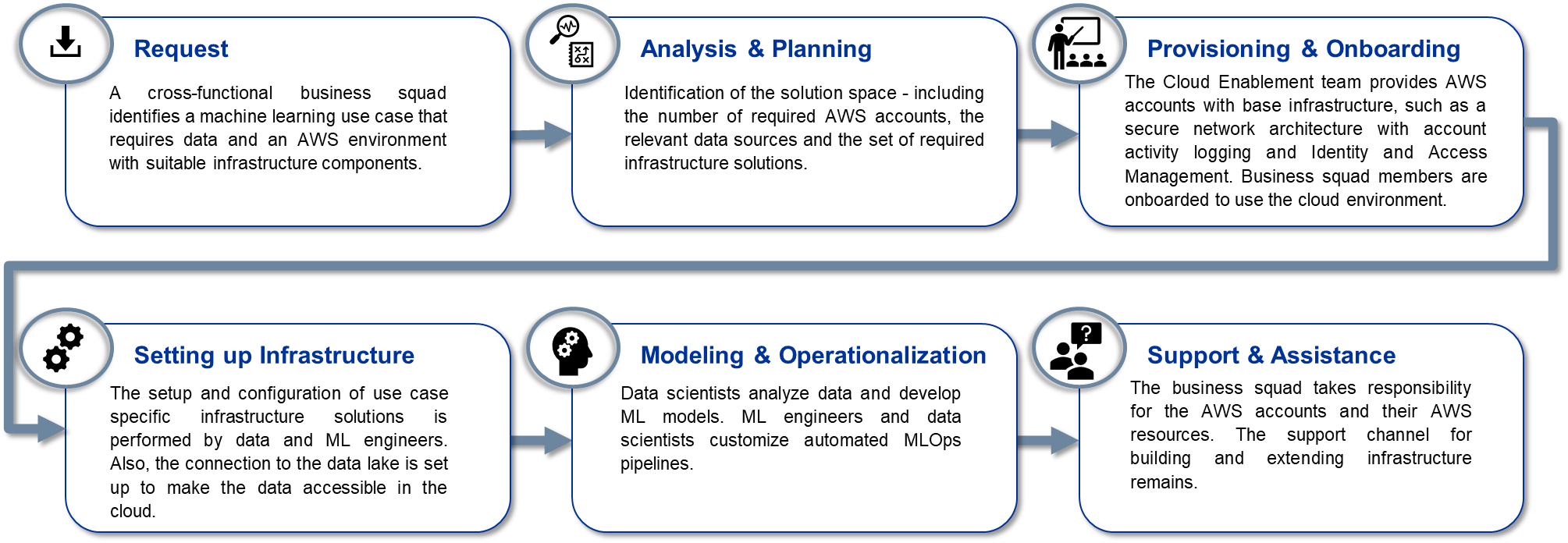

Para permitir que as equipes multifuncionais da SIGNAL IDUNA criem soluções de ML, precisamos de uma maneira rápida e versátil de provisionar infraestrutura em nuvem reutilizável, bem como um fluxo de trabalho eficiente para que as equipes de integração utilizem os recursos da nuvem.

Para isso, criamos um processo de integração e suporte padronizado e fornecemos modelos de infraestrutura modulares como Infraestrutura como Código (IaC). Esses modelos contêm componentes de infraestrutura projetados para casos de uso comuns de ML que podem ser facilmente adaptados aos requisitos de um caso de uso específico.

O fluxo de trabalho da criação de soluções de ML

Existem três funções técnicas principais envolvidas na criação e operação de soluções de ML: Cientista de dados, engenheiro de ML e engenheiro de dados. Cada função faz parte do esquadrão multifuncional e tem responsabilidades diferentes. O cientista de dados tem o conhecimento de domínio necessário dos requisitos funcionais e técnicos do caso de uso. O engenheiro de ML é especializado na criação de soluções de ML automatizadas e na implantação de modelos. E o engenheiro de dados garante que os dados fluam no local e na nuvem.

O processo de disponibilização da plataforma é o seguinte:

A infraestrutura do caso de uso específico é definida em IaC e versionada em um repositório central do projeto. Isso também inclui pipelines para treinamento e implantação de modelos, bem como outros artefatos de código relacionados à ciência de dados. Cientistas de dados, engenheiros de ML e engenheiros de dados têm acesso ao repositório do projeto e podem configurar e atualizar todo o código de infraestrutura de forma autônoma. Isso permite que a equipe altere rapidamente a infraestrutura, se necessário. No entanto, o engenheiro de ML sempre pode apoiar no desenvolvimento e atualização de infraestrutura ou modelos de ML.

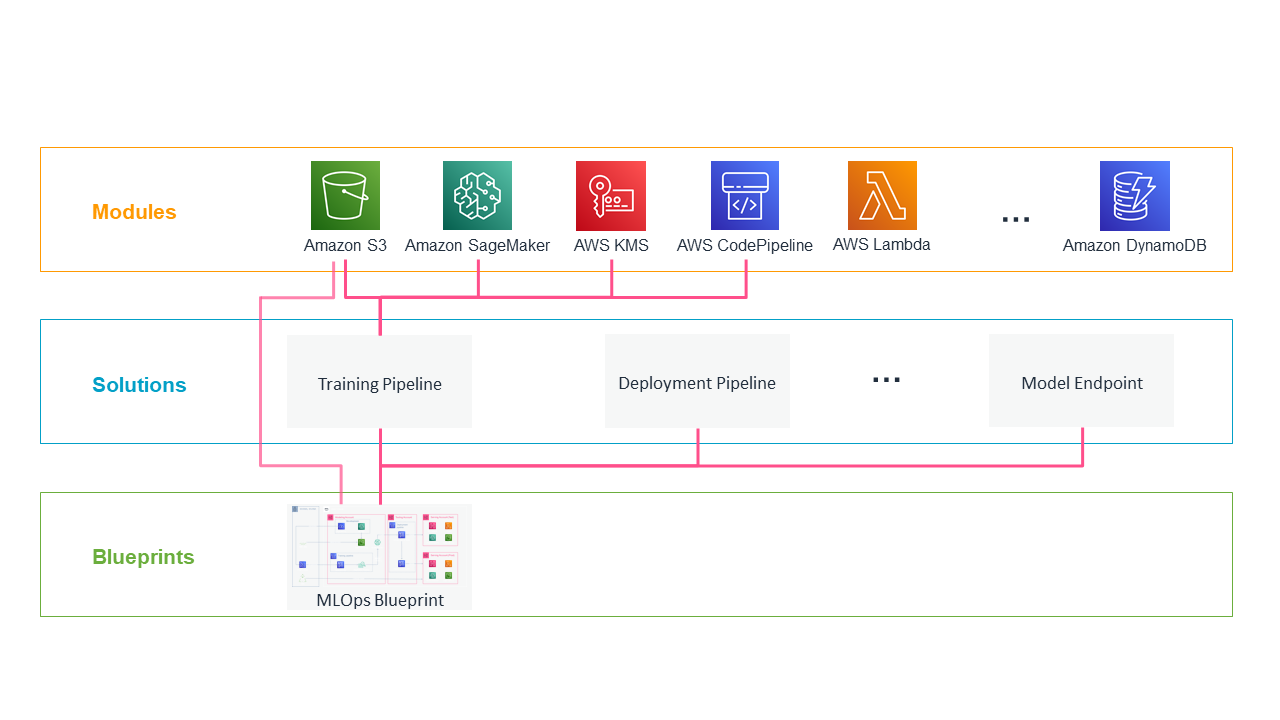

Componentes de infraestrutura reutilizáveis e modulares

Os recursos IaC hierárquicos e modulares são implementados em Terraform e incluem infraestrutura para casos de uso comuns de ciência de dados e ETL. Isso nos permite reutilizar o código de infraestrutura e aplicar as políticas de segurança e conformidade necessárias, como o uso de Serviço de Gerenciamento de Chaves da AWS (KMS) criptografia de dados, bem como encapsulamento de infraestrutura em Nuvem privada virtual da Amazon (VPC) ambientes sem acesso direto à Internet.

A estrutura hierárquica do IaC é a seguinte:

- Módulos encapsule serviços básicos da AWS com a configuração necessária para gerenciamento de segurança e acesso. Isso inclui configurações de melhores práticas, como a prevenção do acesso público a Serviço de armazenamento simples da Amazon (S3) buckets ou aplicando criptografia para todos os arquivos armazenados.

- Em alguns casos, você precisa de uma variedade de serviços para automatizar processos, como implantar modelos de ML em diferentes estágios. Por isso, definimos Soluções como um pacote de diferentes módulos em uma configuração conjunta para diferentes tipos de tarefas.

- Além disso, oferecemos completa Plantas que combinam soluções em diferentes ambientes para atender as diversas necessidades potenciais de um projeto. Em nosso plano de MLOps, definimos uma infraestrutura implantável para treinamento, provisionamento e monitoramento de modelos de ML integrados e distribuídos em contas da AWS. Discutimos mais detalhes na próxima seção.

Esses produtos são versionados em um repositório central pelo esquadrão DAP. Isso nos permite melhorar continuamente nosso IaC e considerar novos recursos da AWS, como Amazon Sage Maker Cadastro de Modelo. Cada esquadrão pode fazer referência a esses recursos, parametrizá-los conforme necessário e, finalmente, implantá-los em suas próprias contas da AWS.

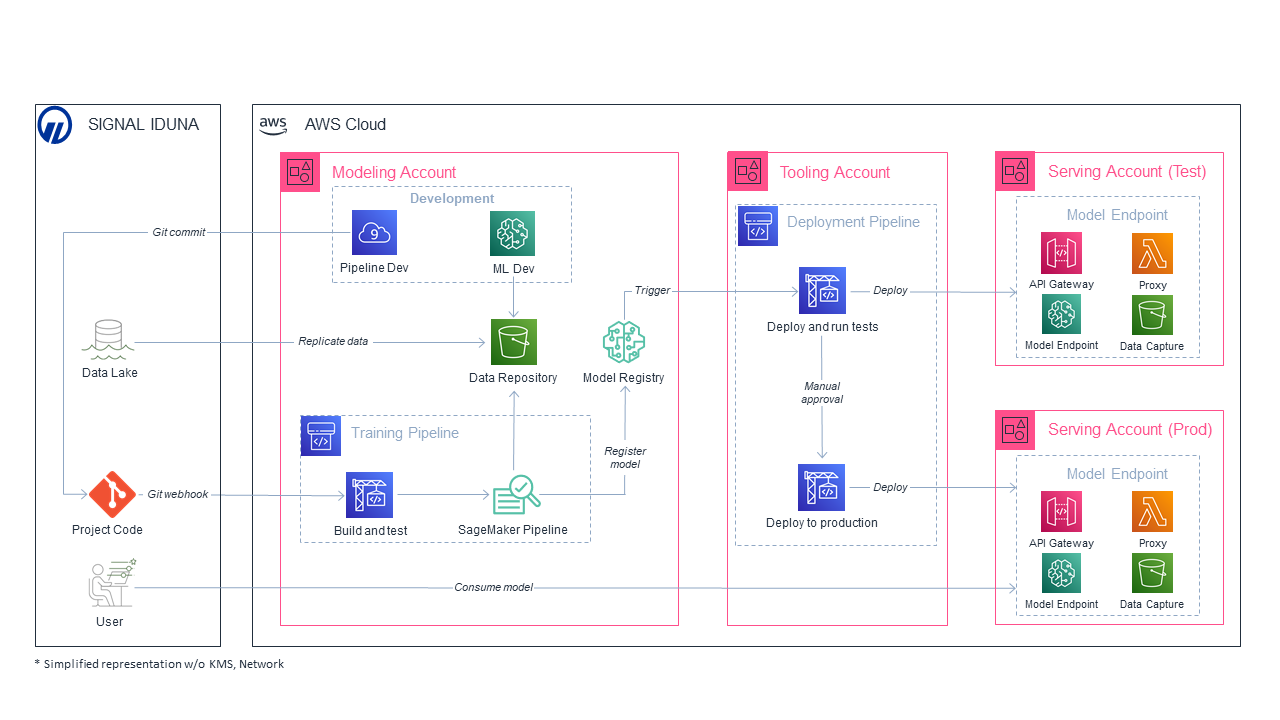

Arquitetura MLOps

Fornecemos um blueprint pronto para uso com soluções específicas para cobrir todo o processo de MLOps. O blueprint contém infraestrutura distribuída em quatro contas da AWS para criar e implantar modelos de ML. Isso nos permite isolar recursos e fluxos de trabalho para as diferentes etapas do processo de MLOps. A figura a seguir mostra a arquitetura de várias contas e descrevemos como a responsabilidade sobre etapas específicas do processo é dividida entre as diferentes funções técnicas.

A modelagem conta inclui serviços para o desenvolvimento de modelos de ML. Primeiro, o engenheiro de dados emprega um processo ETL para fornecer dados relevantes do data lake SIGNAL IDUNA, o gateway centralizado para fluxos de trabalho orientados por dados na Nuvem AWS. Posteriormente, o conjunto de dados pode ser utilizado pelo cientista de dados para treinar e avaliar candidatos a modelo. Uma vez pronto para experimentos extensivos, um candidato a modelo é integrado a um pipeline de treinamento automatizado pelo engenheiro de ML. Usamos o Amazon SageMaker Pipelines para automatizar o treinamento, o ajuste de hiperparâmetros e a avaliação de modelos em escala. Isso também inclui linhagem de modelo e um mecanismo de aprovação padronizado para modelos a serem testados para implantação em produção. Testes de unidade automatizados e análise de código garantem a qualidade e a confiabilidade do código para cada etapa do pipeline, como pré-processamento de dados, treinamento de modelo e avaliação. Depois que um modelo é avaliado e aprovado, usamos o Amazon SageMaker ModelPackages como uma interface para o modelo treinado e metadados relevantes.

A ferramental conta contém pipelines de CI/CD automatizados com diferentes estágios para teste e implantação de modelos treinados. Na fase de teste, os modelos são implantados no servindo-não-produção conta. Embora a qualidade do modelo seja avaliada no pipeline de treinamento antes do modelo ser testado para produção, aqui executamos testes de desempenho e integração em um ambiente de teste isolado. Depois de passar na fase de teste, os modelos são implantados no produto de serviço conta a ser integrada nos fluxos de trabalho de produção.

Separar os estágios do fluxo de trabalho de MLOps em diferentes contas da AWS nos permite isolar o desenvolvimento e o teste da produção. Portanto, podemos impor uma política rígida de acesso e segurança. Além disso, funções personalizadas do IAM garantem que serviços específicos possam acessar apenas dados e outros serviços necessários para seu escopo, seguindo as princípio do menor privilégio. Os serviços dentro dos ambientes de serviço também podem ser disponibilizados para processos de negócios externos. Por exemplo, um processo de negócios pode consultar um terminal no ambiente de produção de serviço para previsões de modelo.

Benefícios da nossa abordagem

Este processo tem muitas vantagens em relação a uma separação estrita de desenvolvimento e operação para ambos os modelos de ML, bem como a infraestrutura necessária:

- Isolamento: cada equipe recebe seu próprio conjunto de contas da AWS completamente isoladas dos ambientes de outras equipes. Isso facilita o gerenciamento dos direitos de acesso e mantém os dados privados para aqueles que têm o direito de trabalhar com eles.

- Ativação da nuvem: Os membros da equipe com pouca experiência anterior em DevOps na nuvem (como muitos cientistas de dados) podem assistir facilmente a todo o processo de projeto e gerenciamento de infraestrutura, pois (quase) nada está oculto por trás de um serviço central. Isso cria uma melhor compreensão da infraestrutura, o que pode ajudá-los a criar produtos de ciência de dados com mais eficiência.

- Propriedade do produto: O uso de soluções de infraestrutura pré-configuradas e serviços gerenciados mantém a barreira para gerenciar um produto de ML em produção muito baixa. Portanto, um cientista de dados pode facilmente se apropriar de um modelo que é colocado em produção. Isso minimiza o conhecido risco de não colocar um modelo em produção após o desenvolvimento.

- Inovação: como os engenheiros de ML estão envolvidos muito antes de um modelo estar pronto para ser colocado em produção, eles podem criar soluções de infraestrutura adequadas para novos casos de uso enquanto os cientistas de dados desenvolvem um modelo de ML.

- Adaptabilidade: Como a solução de IaC desenvolvida pela DAP está disponível gratuitamente, qualquer equipe pode adaptá-la facilmente para atender a uma necessidade específica de seu caso de uso.

- Código aberto: Todas as novas soluções de infraestrutura podem ser facilmente disponibilizadas por meio do repositório de código DAP central para serem usadas por outras equipes. Com o tempo, isso criará uma base de código rica com componentes de infraestrutura adaptados a diferentes casos de uso.

Resumo

Neste post, ilustramos como as equipes multifuncionais da SIGNAL IDUNA estão sendo habilitadas para criar e executar produtos de ML na AWS. Central para nossa abordagem é o uso de um conjunto dedicado de contas da AWS para cada equipe em combinação com projetos e soluções de IaC sob medida. Esses dois componentes permitem que uma equipe multifuncional crie e opere a infraestrutura de qualidade de produção. Por sua vez, eles podem assumir a propriedade total de ponta a ponta de seus produtos de ML.

Consulte Pipelines de criação de modelos do Amazon SageMaker – Amazon SageMaker para saber mais.

Encontre mais informações sobre ML na AWS em nossa página oficial.

Referências

[1] https://www.handelsblatt.com/finanzen/versicherungsbranche-vorbild-spotify-signal-iduna-wird-von-einer-handwerker-versicherung-zum-agilen-konzern/27381902.html

[2] https://blog.crisp.se/wp-content/uploads/2012/11/SpotifyScaling.pdf

[3] https://aws.amazon.com/compliance/shared-responsibility-model/

Sobre os autores

Jan Paul Assendorp é um engenheiro de ML com um forte foco em ciência de dados. Ele cria modelos de ML e automatiza o treinamento de modelos e a implantação em ambientes de produção.

Jan Paul Assendorp é um engenheiro de ML com um forte foco em ciência de dados. Ele cria modelos de ML e automatiza o treinamento de modelos e a implantação em ambientes de produção.

Thomas Lietzow é o Scrum Master do esquadrão Data Analytics Platform.

Thomas Lietzow é o Scrum Master do esquadrão Data Analytics Platform.

Christopher Masch é o Product Owner do squad Data Analytics Platform com conhecimento em engenharia de dados, ciência de dados e engenharia de ML.

Christopher Masch é o Product Owner do squad Data Analytics Platform com conhecimento em engenharia de dados, ciência de dados e engenharia de ML.

Alexandre Meinert faz parte da equipe da Data Analytics Platform e trabalha como engenheiro de ML. Começou com estatísticas, cresceu em projetos de ciência de dados, encontrou paixão por métodos e arquitetura de ML.

Alexandre Meinert faz parte da equipe da Data Analytics Platform e trabalha como engenheiro de ML. Começou com estatísticas, cresceu em projetos de ciência de dados, encontrou paixão por métodos e arquitetura de ML.

Dr. Lars Palzer é cientista de dados e faz parte da equipe da Data Analytics Platform. Depois de ajudar a construir os componentes da arquitetura MLOps, ele agora os está usando para construir produtos de ML.

Dr. Lars Palzer é cientista de dados e faz parte da equipe da Data Analytics Platform. Depois de ajudar a construir os componentes da arquitetura MLOps, ele agora os está usando para construir produtos de ML.

Jan Schillemans é um engenheiro de ML com formação em engenharia de software. Ele se concentra na aplicação das melhores práticas de engenharia de software em ambientes de ML (MLOps).

Jan Schillemans é um engenheiro de ML com formação em engenharia de software. Ele se concentra na aplicação das melhores práticas de engenharia de software em ambientes de ML (MLOps).

- Coinsmart. A melhor troca de Bitcoin e criptografia da Europa.

- Platoblockchain. Inteligência Metaverso Web3. Conhecimento Ampliado. ACESSO LIVRE.

- CryptoHawk. Radar Altcoin. Teste grátis.

- Fonte: https://aws.amazon.com/blogs/machine-learning/how-signal-iduna-operationalizes-machine-learning-projects-on-aws/

- "

- 100

- 2021

- Acesso

- Conta

- em

- Açao Social

- vantagens

- ágil

- Todos os Produtos

- Apesar

- Amazon

- análise

- analítica

- Aplicando

- abordagem

- arquitetura

- Automatizado

- disponível

- AWS

- ser

- MELHOR

- melhores práticas

- construir

- Prédio

- Pacote

- negócio

- capacidades

- casos

- desafiar

- Na nuvem

- infraestrutura de nuvem

- código

- colaboração

- combinação

- comum

- Empresa

- comparado

- compliance

- Configuração

- contém

- Criar

- dados,

- Análise de Dados

- ciência de dados

- cientista de dados

- dedicado

- implantar

- Implantação

- desenvolvimento

- concepção

- detalhe

- desenvolver

- desenvolvido

- em desenvolvimento

- Desenvolvimento

- diferente

- discutir

- distribuído

- domínio

- facilmente

- criptografia

- Ponto final

- engenheiro

- Engenharia

- Engenheiros

- Meio Ambiente

- essencial

- estabelecer

- exemplo

- vasta experiência

- RÁPIDO

- Funcionalidades

- Figura

- Finalmente

- Primeiro nome

- Foco

- focado

- seguinte

- encontrado

- Foundation

- Quadro

- cheio

- Objetivos

- governo

- ajudar

- ajuda

- SUA PARTICIPAÇÃO FAZ A DIFERENÇA

- Como funciona o dobrador de carta de canal

- HTTPS

- imagem

- implementado

- importante

- melhorar

- incluir

- INFORMAÇÕES

- Infraestrutura

- com seguro

- integrado

- integração

- Interface

- Internet

- envolvido

- IT

- Chave

- Conhecimento

- grande

- APRENDER

- aprendizagem

- pequeno

- longo

- máquina

- aprendizado de máquina

- de grupos

- gestão

- mercado

- Marketing

- Match

- Membros

- Meta

- ML

- modelo

- modelos

- modulares

- monitoração

- Novos Recursos

- novos produtos

- oferecer

- oficial

- Onboarding

- operando

- organização

- Outros

- proprietário

- atuação

- plataforma

- políticas

- Privacidade

- predição

- Previsões

- Prevenção

- privado

- processo

- processos

- Produto

- Produção

- Produtos

- Agenda

- projeto

- projetos

- fornecer

- público

- nuvem pública

- qualidade

- repositório

- requeridos

- Requisitos

- Recursos

- responsável

- rever

- Risco

- Execute

- Escala

- Ciência

- Cientista

- cientistas

- Pesquisar

- segurança

- serviço

- Serviços

- de servir

- conjunto

- compartilhado

- simples

- Software

- Engenharia de software

- Soluções

- especializada

- gastar

- Etapa

- começo

- começado

- estatística

- armazenamento

- Estratégia

- mais forte,

- Subseqüentemente

- ajuda

- Suportado

- cercado

- tarefas

- Profissionais

- Dados Técnicos:

- Tecnologias

- teste

- ensaio

- testes

- tempo

- Training

- Transformação

- Transparência

- Atualizar

- us

- usar

- utilizar

- Virtual

- Assistir

- QUEM

- dentro

- sem

- Atividades:

- Força de trabalho

- trabalho