Jogos online e comunidades sociais oferecem funcionalidade de bate-papo por voz e texto para seus usuários se comunicarem. Embora o bate-papo por voz e texto muitas vezes suporte brincadeiras amigáveis, ele também pode levar a problemas como discurso de ódio, cyberbullying, assédio e fraudes. Hoje, muitas empresas dependem exclusivamente de moderadores humanos para revisar conteúdo tóxico. No entanto, verificar violações no chat é demorado, sujeito a erros e difícil de escalar.

Nesta postagem, apresentamos soluções que permitem moderação de chat de áudio e texto usando vários serviços da AWS, incluindo Amazon Transcribe, Amazon Comprehend, Rocha Amazônica e Serviço Amazon OpenSearch.

As plataformas sociais procuram uma solução de moderação pronta a utilizar que seja simples de iniciar, mas também requerem personalização para gerir diversas políticas. Latência e custo também são fatores críticos que devem ser levados em consideração. Ao orquestrar a classificação de toxicidade com grandes modelos de linguagem (LLMs) usando IA generativa, oferecemos uma solução que equilibra simplicidade, latência, custo e flexibilidade para satisfazer vários requisitos.

O código de exemplo para esta postagem está disponível no Repositório GitHub.

Fluxo de trabalho de moderação de chat de áudio

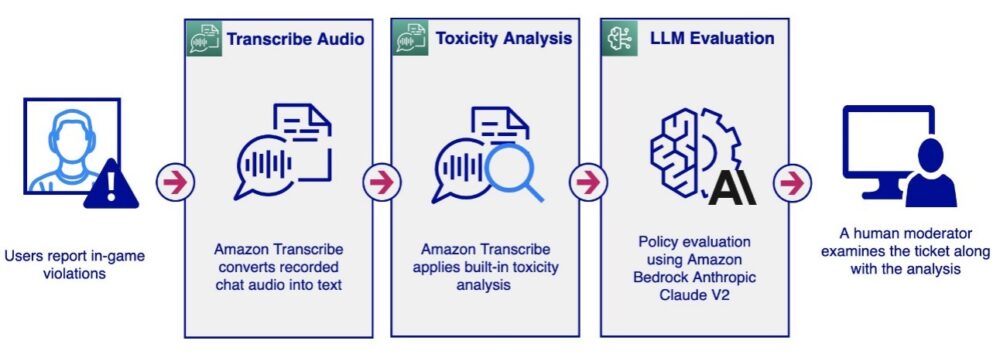

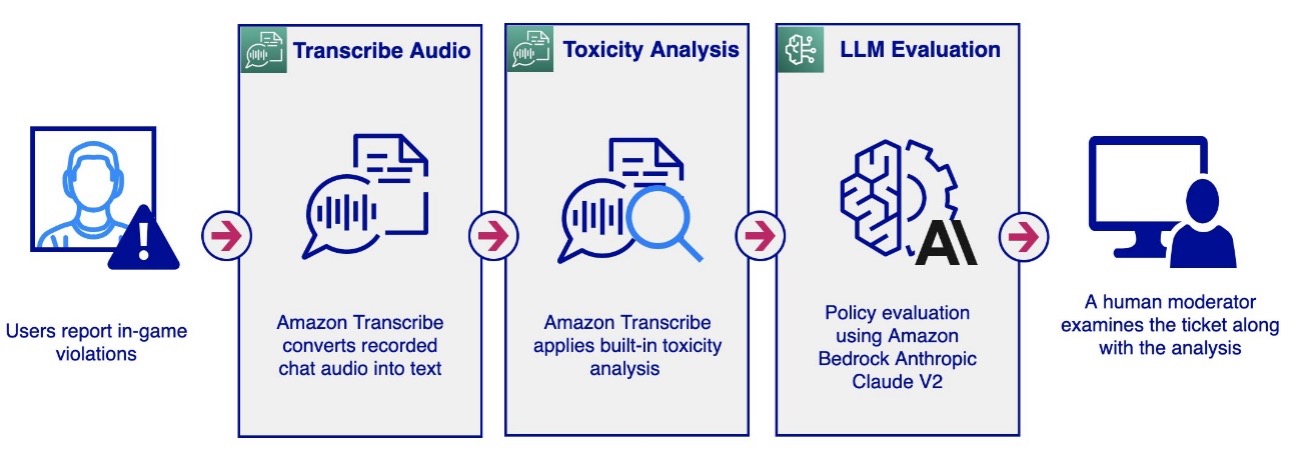

Um fluxo de trabalho de moderação de chat de áudio pode ser iniciado por um usuário denunciando outros usuários em uma plataforma de jogos por violações de políticas, como palavrões, discurso de ódio ou assédio. Isso representa uma abordagem passiva à moderação de áudio. O sistema grava todas as conversas de áudio sem análise imediata. Quando um relatório é recebido, o fluxo de trabalho recupera os arquivos de áudio relacionados e inicia o processo de análise. Um moderador humano analisa a conversa denunciada, investigando seu conteúdo para determinar se ela viola a política da plataforma.

Alternativamente, o fluxo de trabalho pode ser acionado proativamente. Por exemplo, em uma sala de chat de áudio social, o sistema poderia gravar todas as conversas e aplicar análises.

Ambas as abordagens passiva e proativa podem acionar o seguinte pipeline para análise de áudio.

O fluxo de trabalho de moderação de áudio envolve as seguintes etapas:

- O fluxo de trabalho começa com o recebimento do arquivo de áudio e o armazenamento em um Serviço de armazenamento simples da Amazon Bucket (Amazon S3) para acesso do Amazon Transcribe.

- A transcrição da Amazon

StartTranscriptionJobAPI é invocada com Detecção de toxicidade habilitado. O Amazon Transcribe converte o áudio em texto, fornecendo informações adicionais sobre análise de toxicidade. Para obter mais informações sobre análise de toxicidade, consulte Sinalize linguagem prejudicial em conversas faladas com o Amazon Transcribe Toxicity Detection. - Se a análise de toxicidade retornar uma pontuação de toxicidade superior a um determinado limite (por exemplo, 50%), podemos usar Bases de conhecimento para Amazon Bedrock para avaliar a mensagem em relação a políticas personalizadas usando LLMs.

- O moderador humano recebe um relatório detalhado de moderação de áudio destacando os segmentos de conversa considerados tóxicos e que violam a política, permitindo-lhes tomar uma decisão informada.

A captura de tela a seguir mostra um exemplo de aplicativo exibindo análise de toxicidade para um segmento de áudio. Inclui a transcrição original, os resultados da análise de toxicidade do Amazon Transcribe e a análise conduzida usando uma base de conhecimento do Amazon Bedrock por meio do modelo Amazon Bedrock Anthropic Claude V2.

A análise LLM fornece um resultado de violação (S ou N) e explica a lógica por trás da decisão do modelo em relação à violação da política. Além disso, a base de conhecimento inclui os documentos políticos referenciados utilizados pela avaliação, proporcionando aos moderadores um contexto adicional.

Detecção de Toxicidade do Amazon Transcribe

O Amazon Transcribe é um serviço de reconhecimento automático de fala (ASR) que facilita para os desenvolvedores adicionar recursos de fala para texto aos seus aplicativos. O fluxo de trabalho de moderação de áudio usa o Amazon Transcribe Toxicity Detection, que é um recurso alimentado por aprendizado de máquina (ML) que usa dicas baseadas em áudio e texto para identificar e classificar conteúdo tóxico baseado em voz em sete categorias, incluindo assédio sexual, discurso de ódio, ameaças , abuso, palavrões, insultos e linguagem gráfica. Além de analisar texto, a Detecção de Toxicidade usa dicas de fala, como tons e tom, para identificar intenções tóxicas na fala.

O fluxo de trabalho de moderação de áudio ativa a avaliação de políticas do LLM somente quando a análise de toxicidade excede um limite definido. Essa abordagem reduz a latência e otimiza custos ao aplicar LLMs seletivamente, filtrando uma parcela significativa do tráfego.

Use a engenharia imediata do LLM para acomodar políticas personalizadas

Os modelos pré-treinados de detecção de toxicidade do Amazon Transcribe e do Amazon Comprehend fornecem uma ampla taxonomia de toxicidade, comumente usada por plataformas sociais para moderar conteúdo gerado pelo usuário em formatos de áudio e texto. Embora estes modelos pré-treinados detetem eficientemente problemas com baixa latência, poderá precisar de uma solução para detetar violações contra as políticas específicas da sua empresa ou domínio de negócio, o que os modelos pré-treinados por si só não conseguem alcançar.

Além disso, detectar violações em conversas contextuais, como identificar aliciamento sexual infantil conversas, requer uma solução personalizável que envolve considerar as mensagens de bate-papo e o contexto externo a ele, como idade, sexo e histórico de conversa do usuário. É aqui que os LLMs podem oferecer a flexibilidade necessária para ampliar esses requisitos.

O Amazon Bedrock é um serviço totalmente gerenciado que oferece uma variedade de modelos básicos (FMs) de alto desempenho das principais empresas de IA. Essas soluções usam o Anthropic Claude v2 do Amazon Bedrock para moderar transcrições de áudio e mensagens de chat de texto usando um modelo de prompt flexível, conforme descrito no código a seguir:

O modelo contém espaços reservados para a descrição da política, a mensagem do chat e regras adicionais que requerem moderação. O modelo Antrópico Claude V2 fornece respostas no formato instruído (Y ou N), juntamente com uma análise que explica por que considera que a mensagem viola a política. Essa abordagem permite definir categorias de moderação flexíveis e articular suas políticas em linguagem humana.

O método tradicional de treinamento de um modelo de classificação interno envolve processos complicados, como anotação de dados, treinamento, teste e implantação de modelo, exigindo a experiência de cientistas de dados e engenheiros de ML. Os LLMs, por outro lado, oferecem um alto grau de flexibilidade. Os usuários corporativos podem modificar prompts em linguagem humana, aumentando a eficiência e reduzindo os ciclos de iteração no treinamento do modelo de ML.

Bases de conhecimento Amazon Bedrock

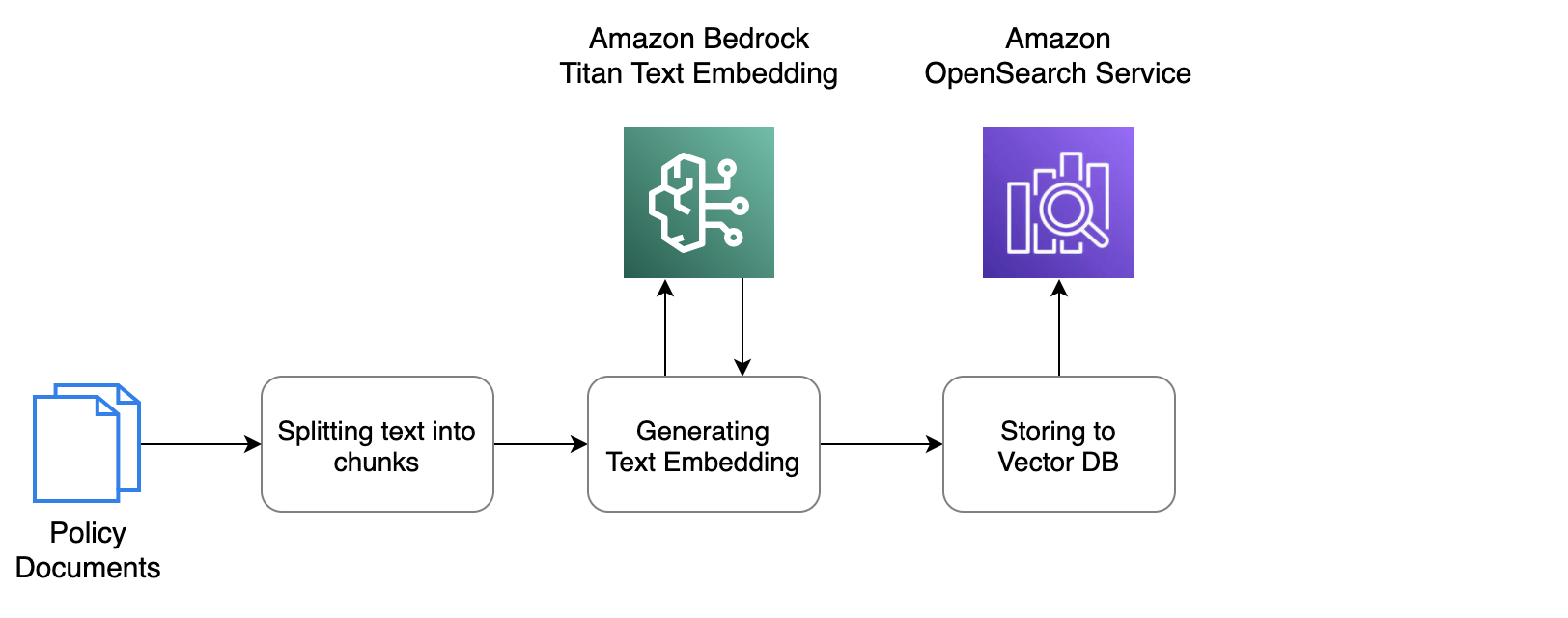

Embora a engenharia de prompts seja eficiente para personalizar políticas, injetar políticas e regras extensas diretamente nos prompts do LLM para cada mensagem pode introduzir latência e aumentar o custo. Para resolver isso, usamos as bases de conhecimento Amazon Bedrock como um sistema gerenciado de Retrieval Augmented Generation (RAG). Isso permite gerenciar o documento de política de maneira flexível, permitindo que o fluxo de trabalho recupere apenas os segmentos de política relevantes para cada mensagem de entrada. Isto minimiza o número de tokens enviados aos LLMs para análise.

Você pode usar o Console de gerenciamento da AWS para fazer upload dos documentos de política para um bucket S3 e, em seguida, indexar os documentos em um banco de dados vetorial para recuperação eficiente. Veja a seguir um fluxo de trabalho conceitual gerenciado por uma base de conhecimento do Amazon Bedrock que recupera documentos do Amazon S3, divide o texto em partes e invoca o Modelo de incorporação de texto Amazon Bedrock Titan para converter os pedaços de texto em vetores, que são então armazenados no banco de dados de vetores.

Nesta solução usamos Serviço Amazon OpenSearch como o armazenamento de vetores. Opensearch é um conjunto de software de código aberto escalável, flexível e extensível para aplicativos de pesquisa, análise, monitoramento de segurança e observabilidade, licenciado sob a licença Apache 2.0. O OpenSearch Service é um serviço totalmente gerenciado que facilita a implantação, o dimensionamento e a operação do OpenSearch na Nuvem AWS.

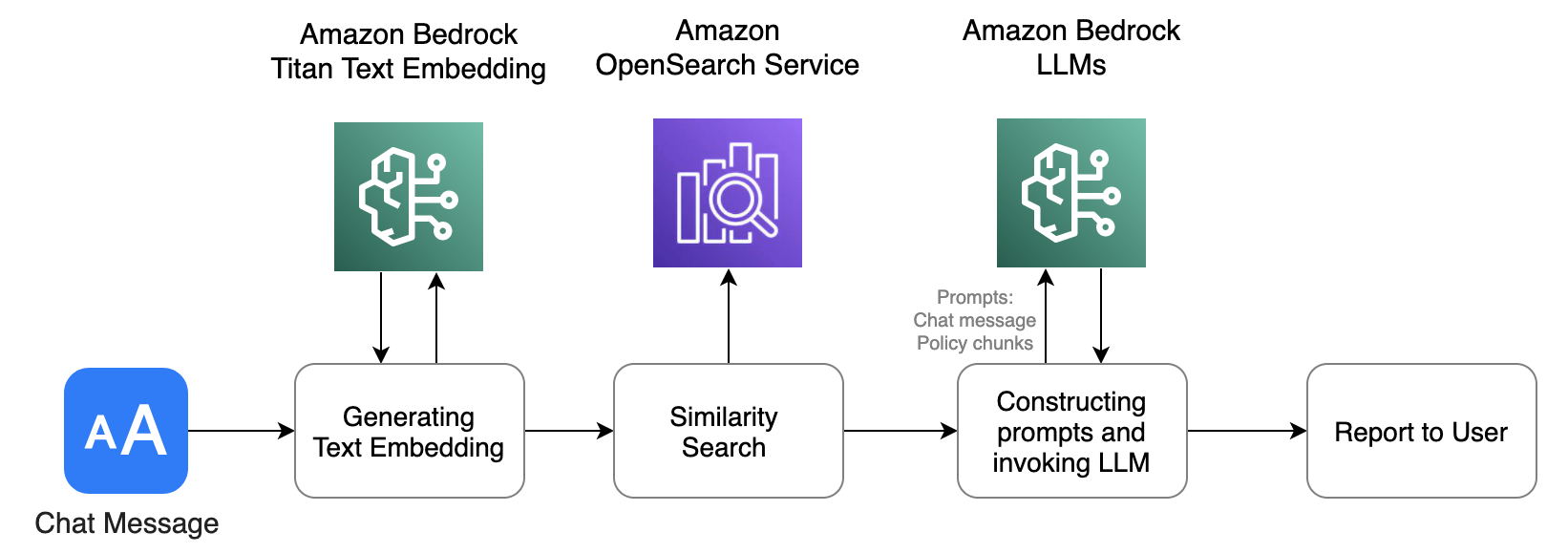

Depois que o documento é indexado no OpenSearch Service, o fluxo de trabalho de moderação de áudio e texto envia mensagens de chat, acionando o seguinte fluxo de consulta para avaliação de política personalizada.

O processo é semelhante ao fluxo de trabalho de iniciação. Primeiro, a mensagem de texto é convertida em incorporações de texto usando a API Amazon Bedrock Titan Text Embedding. Esses embeddings são então usados para realizar um pesquisa de vetores no banco de dados do OpenSearch Service, que já foi preenchido com incorporações de documentos. O banco de dados retorna pedaços de política com a pontuação correspondente mais alta, relevante para a mensagem de texto de entrada. Em seguida, redigimos prompts contendo a mensagem de chat de entrada e o segmento de política, que são enviados ao Anthropic Claude V2 para avaliação. O modelo LLM retorna um resultado de análise com base nas instruções imediatas.

Para obter instruções detalhadas sobre como criar uma nova instância com seu documento de política em uma base de conhecimento do Amazon Bedrock, consulte Bases de conhecimento agora oferecem experiência RAG totalmente gerenciada no Amazon Bedrock.

Fluxo de trabalho de moderação de chat de texto

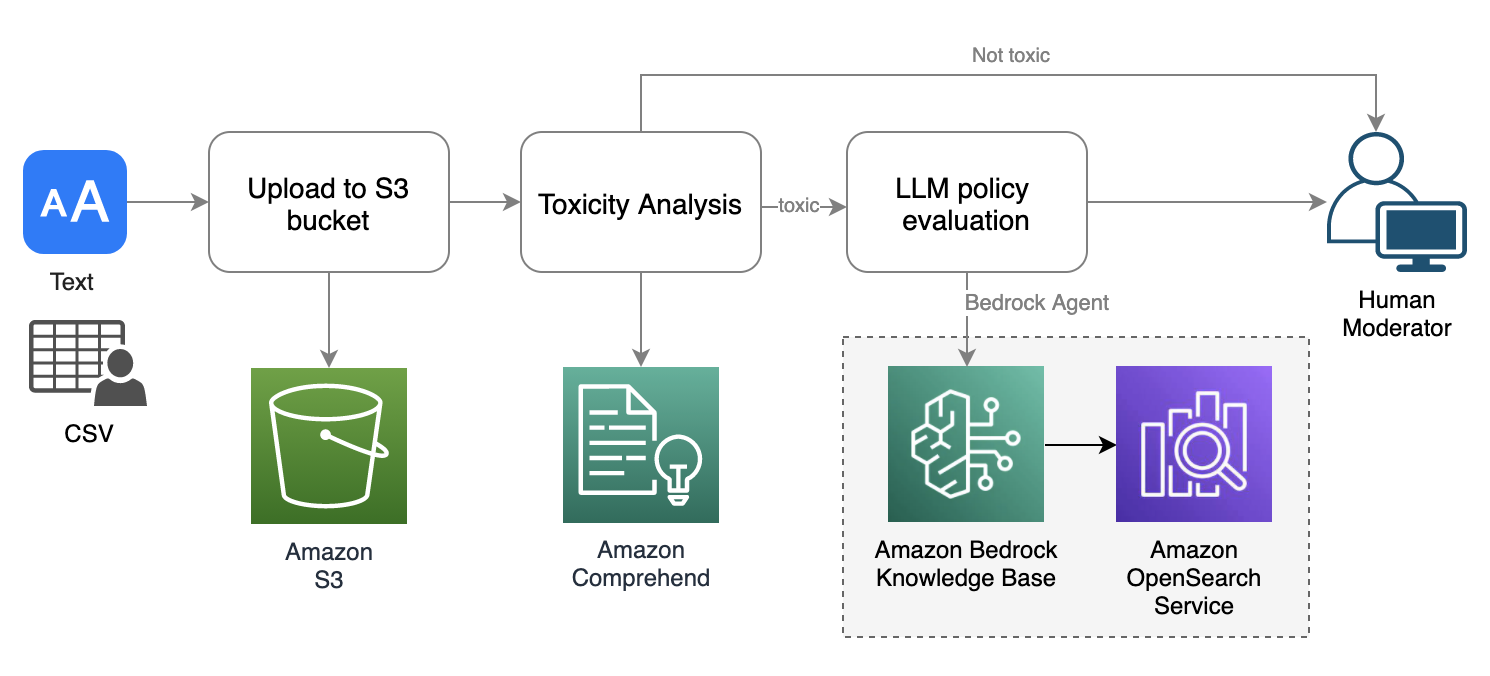

O fluxo de trabalho de moderação de chat de texto segue um padrão semelhante à moderação de áudio, mas usa a análise de toxicidade do Amazon Comprehend, que é personalizada para moderação de texto. O aplicativo de amostra oferece suporte a uma interface para upload de arquivos de texto em massa no formato CSV ou TXT e fornece uma interface de mensagem única para testes rápidos. O diagrama a seguir ilustra o fluxo de trabalho.

O fluxo de trabalho de moderação de texto envolve as seguintes etapas:

- O usuário carrega um arquivo de texto em um bucket S3.

- A análise de toxicidade do Amazon Comprehend é aplicada à mensagem de texto.

- Se a análise de toxicidade retornar uma pontuação de toxicidade que excede um determinado limite (por exemplo, 50%), usamos uma base de conhecimento Amazon Bedrock para avaliar a mensagem em relação a políticas personalizadas usando o LLM Anthropic Claude V2.

- Um relatório de avaliação da política é enviado ao moderador humano.

Análise de toxicidade do Amazon Comprehend

No fluxo de trabalho de moderação de texto, usamos a análise de toxicidade do Amazon Comprehend para avaliar o nível de toxicidade das mensagens de texto. O Amazon Comprehend é um serviço de processamento de linguagem natural (PNL) que usa ML para descobrir insights e conexões valiosas em texto. A API de detecção de toxicidade do Amazon Comprehend atribui uma pontuação geral de toxicidade ao conteúdo do texto, variando de 0 a 1, indicando a probabilidade de ele ser tóxico. Ele também categoriza o texto nas seguintes categorias e fornece uma pontuação de confiança para cada uma: hate_speech, gráfico, harrassement_or_abuse, sexuais, violence_or_threat, insulto e palavrões.

Neste fluxo de trabalho de moderação de texto, a análise de toxicidade do Amazon Comprehend desempenha um papel crucial na identificação se a mensagem de texto recebida contém conteúdo tóxico. Semelhante ao fluxo de trabalho de moderação de áudio, inclui uma condição para ativar a avaliação da política LLM downstream somente quando a análise de toxicidade retornar uma pontuação que exceda um limite predefinido. Essa otimização ajuda a reduzir a latência geral e os custos associados à análise LLM.

Resumo

Nesta postagem, apresentamos soluções para moderação de chat de áudio e texto usando serviços da AWS, incluindo Amazon Transcribe, Amazon Comprehend, Amazon Bedrock e OpenSearch Service. Essas soluções usam modelos pré-treinados para análise de toxicidade e são orquestradas com LLMs de IA generativos para alcançar o equilíbrio ideal em precisão, latência e custo. Eles também permitem que você defina com flexibilidade suas próprias políticas.

Você pode experimentar o aplicativo de exemplo seguindo as instruções no GitHub repo.

Sobre o autor

Lana Zhang é arquiteto de soluções sênior na equipe de serviços de IA do AWS WWSO, especializado em IA e ML para moderação de conteúdo, visão computacional, processamento de linguagem natural e IA generativa. Com sua experiência, ela se dedica a promover soluções de IA/ML da AWS e ajudar os clientes a transformar suas soluções de negócios em diversos setores, incluindo mídia social, jogos, comércio eletrônico, mídia, publicidade e marketing.

Lana Zhang é arquiteto de soluções sênior na equipe de serviços de IA do AWS WWSO, especializado em IA e ML para moderação de conteúdo, visão computacional, processamento de linguagem natural e IA generativa. Com sua experiência, ela se dedica a promover soluções de IA/ML da AWS e ajudar os clientes a transformar suas soluções de negócios em diversos setores, incluindo mídia social, jogos, comércio eletrônico, mídia, publicidade e marketing.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/moderate-audio-and-text-chats-using-aws-ai-services-and-llms/

- :tem

- :é

- :não

- :onde

- 100

- 118

- 14

- 7

- a

- Sobre

- abuso

- Acesso

- acomodar

- Conta

- precisão

- Alcançar

- em

- ativado

- adicionar

- Adição

- Adicional

- Informação adicional

- endereço

- Publicidade

- contra

- idade

- AI

- Serviços de IA

- AI / ML

- Todos os Produtos

- Permitindo

- permite

- sozinho

- juntamente

- já

- tb

- Apesar

- Amazon

- Amazon Comprehend

- Amazon Transcribe

- Amazon Web Services

- an

- análise

- analítica

- análise

- e

- Antrópico

- apache

- api

- app

- Aplicação

- aplicações

- aplicado

- Aplicar

- Aplicando

- abordagem

- se aproxima

- SOMOS

- AS

- avaliar

- auxiliar

- Assistente

- ajudando

- associado

- At

- auditivo

- aumentado

- autor

- Automático

- disponível

- AWS

- Equilíbrio

- saldos

- base

- baseado

- BE

- sido

- começa

- atrás

- ser

- ambos

- Quebra

- amplo

- negócio

- mas a

- by

- CAN

- capacidade

- Categorias

- certo

- desafiante

- bate-papo

- chats

- escolha

- classificação

- classificar

- Na nuvem

- código

- geralmente

- comunicar

- Comunidades

- Empresas

- Empresa

- compreender

- computador

- Visão de Computador

- conceptual

- condição

- conduzido

- confiança

- Coneções

- Considerar

- considerado

- considerando

- contém

- conteúdo

- contexto

- contextual

- contraste

- Conversa

- conversas

- converter

- convertido

- Custo

- custos

- poderia

- crio

- crítico

- crucial

- pesado

- Clientes

- personalizável

- personalização

- personalizado

- ciclos

- dados,

- banco de dados

- decidir

- decisão

- dedicado

- definir

- Grau

- entrega

- implantar

- desenvolvimento

- descrição

- detalhado

- descobrir

- Detecção

- Determinar

- desenvolvedores

- diagrama

- diretamente

- exibindo

- diferente

- documento

- INSTITUCIONAIS

- parece

- domínio

- down

- e-commerce,

- cada

- eficiência

- eficiente

- eficientemente

- ou

- embutindo

- autorizar

- permitir

- habilitado

- permite

- Engenharia

- Engenheiros

- aprimorada

- avaliar

- avaliação

- exemplo

- superior

- excede

- vasta experiência

- especialista

- experiência

- explicando

- Explica

- estender

- fatores

- Envie o

- Arquivos

- filtragem

- Encontre

- Primeiro nome

- Flexibilidade

- flexível

- flexivelmente

- fluxo

- seguinte

- segue

- Escolha

- formato

- Foundation

- amigável

- da

- totalmente

- funcionalidade

- Além disso

- jogos

- plataforma de jogos

- Gênero

- geração

- generativo

- IA generativa

- Designer

- prejudicial

- odiar

- ajuda

- sua experiência

- Alta

- Alta performance

- mais

- Destacando

- história

- Como funciona o dobrador de carta de canal

- Como Negociar

- Contudo

- HTML

- http

- HTTPS

- humano

- identificar

- identificar

- if

- ilustra

- Imediato

- in

- inclui

- Incluindo

- Entrada

- Crescimento

- índice

- indexado

- indicam

- indicador

- indústrias

- INFORMAÇÕES

- informado

- iniciar

- iniciado

- Inicia

- iniciação

- entrada

- insights

- instância

- instruções

- Insulto

- intenção

- Interface

- para dentro

- introduzir

- introduzido

- investigar

- invocado

- invoca

- envolve

- questões

- IT

- iteração

- ESTÁ

- Trabalho

- jpg

- Guarda

- Conhecimento

- língua

- grande

- Latência

- conduzir

- principal

- aprendizagem

- Nível

- Licença

- Licenciado

- probabilidade

- LLM

- Baixo

- máquina

- aprendizado de máquina

- fazer

- FAZ

- gerencia

- gerenciados

- de grupos

- gestão

- muitos

- Marketing

- correspondente

- Posso..

- significa

- Mídia

- mensagem

- mensagens

- método

- minimiza

- ML

- modelo

- modelos

- moderada

- moderador

- moderação

- modificar

- monitoração

- mais

- devo

- natural

- Processamento de linguagem natural

- você merece...

- necessário

- Novo

- PNL

- agora

- número

- of

- oferecer

- Oferece

- frequentemente

- on

- só

- aberto

- open source

- operar

- ideal

- otimização

- Otimiza

- or

- orquestrada

- orquestrando

- original

- Outros

- Fora

- delineado

- lado de fora

- global

- próprio

- passiva

- padrão

- Realizar

- oleoduto

- Passo

- plataforma

- Plataformas

- platão

- Inteligência de Dados Platão

- PlatãoData

- desempenha

- por favor

- políticas

- Privacidade

- populosa

- parte

- Publique

- predefinido

- Proactive

- problemas

- processo

- processos

- em processamento

- PROFANIDADE

- Promoção

- solicita

- fornecer

- fornece

- fornecendo

- pergunta

- Links

- trapo

- variando

- raciocínio

- recebido

- recebe

- receber

- reconhecimento

- registro

- registros

- reduzir

- Reduzido

- reduz

- referir

- referenciada

- em relação a

- relacionado

- relevante

- depender

- Denunciar

- Informou

- Relatórios

- representa

- requerer

- Requisitos

- exige

- Responder

- respostas

- resultar

- Resultados

- recuperação

- Retorna

- rever

- Opinões

- Tipo

- Quarto

- Regra

- regras

- seguro

- Segurança

- amostra

- satisfazer

- escalável

- Escala

- scams

- cientistas

- Ponto

- Pesquisar

- Seção

- segurança

- Buscar

- segmento

- segmentos

- envia

- senior

- enviei

- serviço

- Serviços

- conjunto

- Sete

- Sexual

- ela

- Shows

- periodo

- semelhante

- simples

- simplicidade

- Redes Sociais

- meios de comunicação social

- plataformas sociais

- Software

- unicamente

- solução

- Soluções

- fonte

- especializando

- específico

- discurso

- Reconhecimento de Voz

- fala para texto

- splits

- falado

- Passos

- armazenamento

- loja

- armazenadas

- armazenar

- franco

- tal

- suíte

- ajuda

- suportes

- .

- TAG

- adaptados

- tomado

- taxonomia

- Profissionais

- modelo

- ensaio

- texto

- que

- A

- deles

- Eles

- então

- Este

- deles

- Acha

- isto

- ameaças

- limiar

- Através da

- demorado

- titã

- para

- hoje

- Tokens

- tradicional

- tráfego

- Training

- transformando

- desencadear

- desencadeado

- desencadeando

- Confiança

- descobrir

- para

- Upload

- usar

- usava

- Utilizador

- usuários

- usos

- utilização

- Valioso

- vário

- verificação

- VIOLAÇÃO

- Violações

- visão

- voz

- we

- web

- serviços web

- quando

- se

- qual

- enquanto

- porque

- Wikipedia

- precisarão

- de

- dentro

- sem

- palavras

- de gestão de documentos

- Vocês

- investimentos

- zefirnet