Os clientes enfrentam ameaças e vulnerabilidades crescentes à segurança em toda a infraestrutura e recursos de aplicativos, à medida que sua pegada digital se expande e o impacto comercial desses ativos digitais aumenta. Um desafio comum de segurança cibernética tem duas vertentes:

- Consumir logs de recursos digitais que vêm em diferentes formatos e esquemas e automatizar a análise de descobertas de ameaças com base nesses logs.

- Quer os logs venham da Amazon Web Services (AWS), de outros provedores de nuvem, de dispositivos locais ou de borda, os clientes precisam centralizar e padronizar os dados de segurança.

Além disso, a análise para identificar ameaças à segurança deve ser capaz de escalar e evoluir para atender a um cenário em mudança de atores de ameaças, vetores de segurança e ativos digitais.

Uma nova abordagem para resolver esse cenário complexo de análise de segurança combina a ingestão e o armazenamento de dados de segurança usando Lago de segurança amazônico e analisando os dados de segurança com aprendizado de máquina (ML) usando Amazon Sage Maker. O Amazon Security Lake é um serviço desenvolvido especificamente para centralizar automaticamente os dados de segurança de uma organização da nuvem e de fontes locais em um data lake criado especificamente e armazenado em sua conta da AWS. O Amazon Security Lake automatiza o gerenciamento central de dados de segurança, normaliza logs de serviços integrados da AWS e de serviços de terceiros e gerencia o ciclo de vida dos dados com retenção personalizável e também automatiza a classificação em níveis de armazenamento. O Amazon Security Lake ingere arquivos de log no Estrutura aberta do esquema de segurança cibernética (OCSF), com suporte para parceiros como Cisco Security, CrowdStrike, Palo Alto Networks e logs OCSF de recursos fora do seu ambiente AWS. Esse esquema unificado simplifica o consumo e a análise downstream porque os dados seguem um esquema padronizado e novas fontes podem ser adicionadas com alterações mínimas no pipeline de dados. Depois que os dados do log de segurança são armazenados no Amazon Security Lake, a questão é como analisá-los. Uma abordagem eficaz para analisar os dados do log de segurança é usar ML; especificamente, detecção de anomalias, que examina dados de atividade e tráfego e os compara com uma linha de base. A linha de base define qual atividade é estatisticamente normal para aquele ambiente. A detecção de anomalias vai além de uma assinatura de evento individual e pode evoluir com retreinamento periódico; o tráfego classificado como anormal ou anômalo pode então ser tratado com foco priorizado e urgência. O Amazon SageMaker é um serviço totalmente gerenciado que permite aos clientes preparar dados e criar, treinar e implantar modelos de ML para qualquer caso de uso com infraestrutura, ferramentas e fluxos de trabalho totalmente gerenciados, incluindo ofertas sem código para analistas de negócios. SageMaker oferece suporte a dois algoritmos integrados de detecção de anomalias: Informações sobre IP e Floresta de Corte Aleatório. Você também pode usar o SageMaker para criar seu próprio modelo personalizado de detecção de valores discrepantes usando algoritmos proveniente de várias estruturas de ML.

Nesta postagem, você aprenderá como preparar dados provenientes do Amazon Security Lake e, em seguida, treinar e implantar um modelo de ML usando um algoritmo IP Insights no SageMaker. Este modelo identifica tráfego ou comportamento de rede anômalo que pode então ser composto como parte de uma solução de segurança ponta a ponta maior. Tal solução poderia invocar uma verificação de autenticação multifator (MFA) se um usuário estiver fazendo login a partir de um servidor incomum ou em um horário incomum, notificar a equipe se houver uma varredura de rede suspeita proveniente de novos endereços IP, alertar os administradores se a rede for incomum. protocolos ou portas são usados, ou enriquecer o resultado da classificação de insights de IP com outras fontes de dados, como Dever de guarda da Amazônia e pontuações de reputação de IP para classificar as descobertas de ameaças.

Visão geral da solução

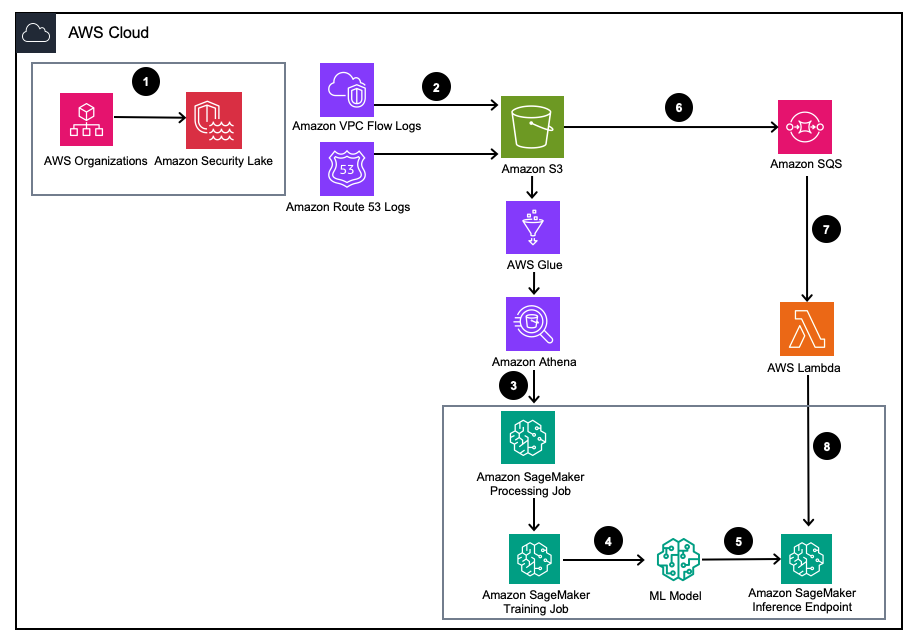

Figura 1 – Arquitetura da Solução

- Habilite o Amazon Security Lake com Organizações da AWS para contas da AWS, regiões da AWS e ambientes de TI externos.

- Configurar fontes do Security Lake de Nuvem privada virtual da Amazon (Amazon VPC) Registros de fluxo e Rota Amazon53 Logs de DNS no bucket Amazon Security Lake S3.

- Processe dados de log do Amazon Security Lake usando um trabalho de processamento do SageMaker para projetar recursos. Usar Amazona atena para consultar dados de log estruturados do OCSF de Serviço de armazenamento simples da Amazon (Amazon S3) NFT`s Cola AWS tabelas gerenciadas pelo AWS LakeFormation.

- Treine um modelo SageMaker ML usando um trabalho de treinamento do SageMaker que consome os logs processados do Amazon Security Lake.

- Implante o modelo de ML treinado em um endpoint de inferência do SageMaker.

- Armazene novos logs de segurança em um bucket S3 e enfileire eventos em Serviço de fila simples da Amazon (Amazon SQS).

- Assine um AWS Lambda função para a fila SQS.

- Invoque o endpoint de inferência do SageMaker usando uma função Lambda para classificar logs de segurança como anomalias em tempo real.

Pré-requisitos

Para implementar a solução, primeiro você deve atender aos seguintes pré-requisitos:

- Habilitar Amazon Security Lake dentro da sua organização ou em uma única conta com logs de fluxo de VPC e logs do resolvedor do Route 53 habilitados.

- Certifique-se de que o AWS Identity and Access Management (IAM) A função usada pelos trabalhos de processamento e notebooks do SageMaker recebeu uma política IAM incluindo o Permissão de acesso à consulta de assinante do Amazon Security Lake para o banco de dados gerenciado do Amazon Security Lake e tabelas gerenciadas pelo AWS Lake Formation. Esse trabalho de processamento deve ser executado em uma conta de ferramentas de análise ou de segurança para permanecer em conformidade com Arquitetura de referência de segurança da AWS (AWS SRA).

- Certifique-se de que a função IAM usada pela função Lambda tenha recebido uma política IAM incluindo o Permissão de acesso aos dados do assinante do Amazon Security Lake.

Implante a solução

Para configurar o ambiente, execute as seguintes etapas:

- Lança um Estúdio SageMaker ou notebook SageMaker Jupyter com um

ml.m5.largeinstância. Observação: O tamanho da instância depende dos conjuntos de dados que você usa. - Clonar o GitHub repositório.

- Abra o caderno

01_ipinsights/01-01.amazon-securitylake-sagemaker-ipinsights.ipy. - Implemente o política IAM fornecida e política de confiança do IAM correspondente para que sua instância do SageMaker Studio Notebook acesse todos os dados necessários no S3, Lake Formation e Athena.

Este blog percorre a parte relevante do código no notebook após sua implantação em seu ambiente.

Instale as dependências e importe a biblioteca necessária

Use o código a seguir para instalar dependências, importar as bibliotecas necessárias e criar o bucket SageMaker S3 necessário para processamento de dados e treinamento de modelo. Uma das bibliotecas necessárias, awswrangler, é um AWS SDK para dataframe do pandas que é usado para consultar as tabelas relevantes no catálogo de dados do AWS Glue e armazenar os resultados localmente em um dataframe.

Consultar a tabela de log de fluxo do Amazon Security Lake VPC

Esta parte do código usa o AWS SDK para pandas para consultar a tabela do AWS Glue relacionada aos logs de fluxo de VPC. Conforme mencionado nos pré-requisitos, as tabelas do Amazon Security Lake são gerenciadas por Formação AWS Lake, portanto, todas as permissões adequadas devem ser concedidas à função usada pelo notebook SageMaker. Esta consulta extrairá vários dias de tráfego de log de fluxo de VPC. O conjunto de dados usado durante o desenvolvimento deste blog foi pequeno. Dependendo da escala do seu caso de uso, você deve estar ciente dos limites do AWS SDK para pandas. Ao considerar a escala de terabytes, você deve considerar o suporte do AWS SDK para pandas para modin.

Ao visualizar o quadro de dados, você verá uma saída de uma única coluna com campos comuns que podem ser encontrados no Atividade de rede (4001) turma do OCSF.

Normalize os dados de log de fluxo do Amazon Security Lake VPC no formato de treinamento necessário para IP Insights.

O algoritmo IP Insights exige que os dados de treinamento estejam no formato CSV e contenham duas colunas. A primeira coluna deve ser uma string opaca que corresponda ao identificador exclusivo de uma entidade. A segunda coluna deve ser o endereço IPv4 do evento de acesso da entidade em notação de ponto decimal. No conjunto de dados de amostra deste blog, o identificador exclusivo são os IDs de instâncias do EC2 associados ao instance_id valor dentro do dataframe. O endereço IPv4 será derivado do src_endpoint. Com base na forma como a consulta do Amazon Athena foi criada, os dados importados já estão no formato correto para treinar um modelo do IP Insights, portanto, nenhuma engenharia de recursos adicional é necessária. Se você modificar a consulta de outra maneira, talvez seja necessário incorporar engenharia de recursos adicionais.

Consultar e normalizar a tabela de log do resolvedor Amazon Security Lake Route 53

Assim como você fez acima, a próxima etapa do notebook executa uma consulta semelhante na tabela do resolvedor Amazon Security Lake Route 53. Como você usará todos os dados compatíveis com OCSF neste notebook, todas as tarefas de engenharia de recursos permanecerão as mesmas para os logs do resolvedor do Route 53 e para os logs de fluxo de VPC. Em seguida, você combina os dois quadros de dados em um único quadro de dados usado para treinamento. Como a consulta do Amazon Athena carrega os dados localmente no formato correto, nenhuma engenharia adicional de recursos é necessária.

Obtenha a imagem de treinamento do IP Insights e treine o modelo com os dados OCSF

Na próxima parte do notebook, você treinará um modelo de ML baseado no algoritmo IP Insights e usará o consolidado dataframe de OCSF de diferentes tipos de logs. Uma lista dos hiperparâmetros do IP Insights pode ser encontrada SUA PARTICIPAÇÃO FAZ A DIFERENÇA. No exemplo abaixo, selecionamos hiperparâmetros que geraram o modelo de melhor desempenho, por exemplo, 5 para época e 128 para vector_dim. Como o conjunto de dados de treinamento para nossa amostra era relativamente pequeno, utilizamos um ml.m5.large instância. Os hiperparâmetros e suas configurações de treinamento, como contagem e tipo de instância, devem ser escolhidos com base nas métricas objetivas e no tamanho dos dados de treinamento. Um recurso que você pode utilizar no Amazon SageMaker para encontrar a melhor versão do seu modelo é o Amazon SageMaker ajuste automático do modelo que procura o melhor modelo em um intervalo de valores de hiperparâmetros.

Implante o modelo treinado e teste com tráfego válido e anômalo

Depois que o modelo for treinado, você implanta o modelo em um endpoint do SageMaker e envia uma série de identificadores exclusivos e combinações de endereços IPv4 para testar seu modelo. Esta parte do código pressupõe que você tenha dados de teste salvos em seu bucket S3. Os dados de teste são um arquivo .csv, onde a primeira coluna são IDs de instância e a segunda coluna são IPs. Recomenda-se testar dados válidos e inválidos para ver os resultados do modelo. O código a seguir implanta seu endpoint.

Agora que seu endpoint foi implantado, você pode enviar solicitações de inferência para identificar se o tráfego é potencialmente anômalo. Abaixo está um exemplo de como devem ser os dados formatados. Neste caso, o identificador da primeira coluna é um ID de instância e a segunda coluna é um endereço IP associado, conforme mostrado a seguir:

Depois de ter seus dados no formato CSV, você poderá enviá-los para inferência usando o código lendo seu arquivo .csv de um bucket S3.:

A saída de um modelo IP Insights fornece uma medida de quão estatisticamente esperados são um endereço IP e um recurso online. No entanto, o intervalo para esse endereço e recurso é ilimitado; portanto, há considerações sobre como você determinaria se uma combinação de ID de instância e endereço IP deve ser considerada anômala.

No exemplo anterior, quatro combinações diferentes de identificadores e IP foram submetidas ao modelo. As duas primeiras combinações eram combinações válidas de ID de instância e endereço IP esperadas com base no conjunto de treinamento. A terceira combinação possui o identificador exclusivo correto, mas um endereço IP diferente na mesma sub-rede. O modelo deve determinar que há uma anomalia modesta, pois a incorporação é ligeiramente diferente dos dados de treinamento. A quarta combinação possui um identificador exclusivo válido, mas um endereço IP de uma sub-rede inexistente em qualquer VPC do ambiente.

Observação: Os dados de tráfego normal e anormal mudarão com base no seu caso de uso específico, por exemplo: se você quiser monitorar o tráfego externo e interno, precisará de um identificador exclusivo alinhado a cada endereço IP e de um esquema para gerar os identificadores externos.

Determinar qual deve ser o seu limite para determinar se o tráfego é anômalo pode ser feito usando tráfego normal e anormal conhecido. As etapas descritas em este caderno de exemplo são como segue:

- Construa um conjunto de testes para representar o tráfego normal.

- Adicione tráfego anormal ao conjunto de dados.

- Trace a distribuição de

dot_productpontuações para o modelo de tráfego normal e tráfego anormal. - Selecione um valor limite que distinga o subconjunto normal do subconjunto anormal. Este valor é baseado na sua tolerância a falsos positivos

Configure o monitoramento contínuo do novo tráfego de log de fluxo de VPC.

Para demonstrar como esse novo modelo de ML pode ser usado com o Amazon Security Lake de maneira proativa, configuraremos uma função Lambda a ser invocada em cada PutObject evento dentro do bucket gerenciado do Amazon Security Lake, especificamente os dados de log de fluxo da VPC. Dentro do Amazon Security Lake existe o conceito de assinante, que consome logs e eventos do Amazon Security Lake. A função Lambda que responde a novos eventos deve receber uma assinatura de acesso a dados. Os assinantes de acesso a dados são notificados sobre novos objetos do Amazon S3 para uma origem à medida que os objetos são gravados no bucket do Security Lake. Os assinantes podem acessar diretamente os objetos do S3 e receber notificações de novos objetos por meio de um endpoint de assinatura ou pesquisando uma fila do Amazon SQS.

- Abra o Console do Security Lake.

- No painel de navegação, selecione Assinantes.

- Na página Assinantes, escolha Criar assinante.

- Para detalhes do assinante, digite

inferencelambdapara Nome do assinante e um opcional Descrição. - A Região é automaticamente definido como sua região da AWS atualmente selecionada e não pode ser modificado.

- Escolha Fontes de log e eventos, escolha Fontes específicas de log e eventos e escolha Registros de fluxo de VPC e registros do Route 53

- Escolha Método de acesso a dados, escolha S3.

- Escolha Credenciais de assinante, forneça o ID da conta da AWS onde a função Lambda residirá e um código especificado pelo usuário ID externo.

Observação: Se estiver fazendo isso localmente em uma conta, você não precisa ter um ID externo. - Escolha Crie.

Criar a função Lambda

Para criar e implantar a função Lambda, você pode concluir as etapas a seguir ou implantar o modelo SAM pré-construído 01_ipinsights/01.02-ipcheck.yaml no repositório GitHub. O modelo SAM exige que você forneça o ARN do SQS e o nome do endpoint do SageMaker.

- No console do Lambda, escolha Criar função.

- Escolha Autor do zero.

- Escolha Nome da Função, entrar

ipcheck. - Escolha Runtime, escolha Python 3.10.

- Escolha Arquitetura, selecione x86_64.

- Escolha Função de execução, selecione Criar uma nova função com permissões do Lambda.

- Depois de criar a função, insira o conteúdo do arquivo ipcheck.py arquivo do repositório GitHub.

- No painel de navegação, escolha variáveis ambientais.

- Escolha Editar.

- Escolha Adicionar variável de ambiente.

- Para a nova variável de ambiente, insira

ENDPOINT_NAMEe para valor insira o ARN do endpoint que foi gerado durante a implantação do endpoint SageMaker. - Selecionar Salvar.

- Escolha Implantação.

- No painel de navegação, escolha Configuração.

- Selecionar gatilhos.

- Selecionar Adicionar gatilho.

- Debaixo Selecione uma fonte, escolha SQS.

- Debaixo Fila SQS, insira o ARN da fila SQS principal criada pelo Security Lake.

- Marque a caixa de seleção para Ativar gatilho.

- Selecionar Adicionar.

Validar descobertas do Lambda

- Abra o Console do Amazon CloudWatch.

- No painel esquerdo, selecione Grupos de registro.

- Na barra de pesquisa, digite ipcheck e selecione o grupo de logs com o nome

/aws/lambda/ipcheck. - Selecione o fluxo de log mais recente em Fluxos de log.

- Nos logs, você deverá ver resultados semelhantes aos seguintes para cada novo log do Amazon Security Lake:

{'predictions': [{'dot_product': 0.018832731992006302}, {'dot_product': 0.018832731992006302}]}

Essa função Lambda analisa continuamente o tráfego de rede ingerido pelo Amazon Security Lake. Isso permite que você crie mecanismos para notificar suas equipes de segurança quando um limite especificado for violado, o que indicaria um tráfego anômalo em seu ambiente.

Limpar

Quando terminar de experimentar esta solução e para evitar cobranças em sua conta, limpe seus recursos excluindo o bucket S3, o endpoint SageMaker, desligando a computação anexada ao notebook SageMaker Jupyter, excluindo a função Lambda e desabilitando o Amazon Security Lago em sua conta.

Conclusão

Nesta postagem, você aprendeu como preparar dados de tráfego de rede provenientes do Amazon Security Lake para machine learning e, em seguida, treinou e implantou um modelo de ML usando o algoritmo IP Insights no Amazon SageMaker. Todas as etapas descritas no notebook Jupyter podem ser replicadas em um pipeline de ML de ponta a ponta. Você também implementou uma função AWS Lambda que consumiu novos logs do Amazon Security Lake e enviou inferências com base no modelo de detecção de anomalias treinado. As respostas do modelo de ML recebidas pelo AWS Lambda podem notificar proativamente as equipes de segurança sobre tráfego anômalo quando determinados limites são atingidos. A melhoria contínua do modelo pode ser possibilitada incluindo sua equipe de segurança nas revisões do circuito para identificar se o tráfego identificado como anômalo era um falso positivo ou não. Isso pode então ser adicionado ao seu conjunto de treinamento e também ao seu normal conjunto de dados de tráfego ao determinar um limite empírico. Este modelo pode identificar tráfego ou comportamento de rede potencialmente anômalo, por meio do qual pode ser incluído como parte de uma solução de segurança maior para iniciar uma verificação de MFA se um usuário estiver fazendo login a partir de um servidor incomum ou em um horário incomum, alertar a equipe se houver um suspeito verificação de rede proveniente de novos endereços IP ou combine a pontuação de insights de IP com outras fontes, como Amazon Guard Duty, para classificar descobertas de ameaças. Esse modelo pode incluir fontes de log personalizadas, como Azure Flow Logs ou logs locais, adicionando fontes personalizadas à implantação do Amazon Security Lake.

Na parte 2 desta série de postagens do blog, você aprenderá como construir um modelo de detecção de anomalias usando o Floresta de Corte Aleatório algoritmo treinado com fontes adicionais do Amazon Security Lake que integram dados de log de segurança de rede e host e aplicam a classificação de anomalia de segurança como parte de uma solução de monitoramento de segurança abrangente e automatizada.

Sobre os autores

Joe Morotti é Arquiteto de Soluções da Amazon Web Services (AWS), ajudando clientes corporativos no Centro-Oeste dos EUA. Ele ocupou uma ampla gama de funções técnicas e gosta de mostrar a arte do possível para o cliente. Em seu tempo livre, ele gosta de passar um tempo de qualidade com sua família explorando novos lugares e analisando o desempenho de sua equipe esportiva

Joe Morotti é Arquiteto de Soluções da Amazon Web Services (AWS), ajudando clientes corporativos no Centro-Oeste dos EUA. Ele ocupou uma ampla gama de funções técnicas e gosta de mostrar a arte do possível para o cliente. Em seu tempo livre, ele gosta de passar um tempo de qualidade com sua família explorando novos lugares e analisando o desempenho de sua equipe esportiva

Bishr Tabba é arquiteto de soluções da Amazon Web Services. A Bishr é especializada em ajudar os clientes com aplicativos de aprendizado de máquina, segurança e observabilidade. Fora do trabalho, ele gosta de jogar tênis, cozinhar e passar o tempo com a família.

Bishr Tabba é arquiteto de soluções da Amazon Web Services. A Bishr é especializada em ajudar os clientes com aplicativos de aprendizado de máquina, segurança e observabilidade. Fora do trabalho, ele gosta de jogar tênis, cozinhar e passar o tempo com a família.

Sriharsh Adari é Arquiteto de Soluções Sênior na Amazon Web Services (AWS), onde ajuda os clientes a trabalhar de trás para frente a partir dos resultados de negócios para desenvolver soluções inovadoras na AWS. Ao longo dos anos, ele ajudou vários clientes em transformações de plataformas de dados em verticais do setor. Sua principal área de especialização inclui Estratégia de Tecnologia, Análise de Dados e Ciência de Dados. Em seu tempo livre, ele gosta de jogar tênis, assistir a programas de TV e jogar Tabla.

Sriharsh Adari é Arquiteto de Soluções Sênior na Amazon Web Services (AWS), onde ajuda os clientes a trabalhar de trás para frente a partir dos resultados de negócios para desenvolver soluções inovadoras na AWS. Ao longo dos anos, ele ajudou vários clientes em transformações de plataformas de dados em verticais do setor. Sua principal área de especialização inclui Estratégia de Tecnologia, Análise de Dados e Ciência de Dados. Em seu tempo livre, ele gosta de jogar tênis, assistir a programas de TV e jogar Tabla.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/identify-cybersecurity-anomalies-in-your-amazon-security-lake-data-using-amazon-sagemaker/

- :tem

- :é

- :não

- :onde

- $UP

- 01

- 1

- 10

- 100

- 12

- 125

- 15%

- 17

- 20000

- 25

- 32

- 7

- 9

- a

- acima

- Acesso

- Conta

- Contas

- em

- atividade

- atores

- adicionado

- acrescentando

- Adicional

- endereço

- endereços

- administradores

- Depois de

- contra

- Alertar

- algoritmo

- algoritmos

- alinhado

- Todos os Produtos

- permite

- já

- tb

- Amazon

- Amazona atena

- Amazon Sage Maker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- análise

- Analistas

- analítica

- analisar

- análises

- análise

- e

- anomalias

- detecção de anomalia

- Outro

- qualquer

- Aplicação

- aplicações

- Aplicar

- abordagem

- arquitetura

- SOMOS

- ÁREA

- Arte

- AS

- Ativos

- associado

- assume

- At

- Autenticação

- Automatizado

- automatiza

- automaticamente

- automatizando

- evitar

- consciente

- AWS

- Cola AWS

- Formação AWS Lake

- AWS Lambda

- Azul

- Barra

- baseado

- Linha de Base

- BE

- Porque

- torna-se

- sido

- comportamento

- ser

- abaixo

- MELHOR

- Pós

- Blog

- ambos

- construir

- construídas em

- negócio

- mas a

- by

- CAN

- capacidade

- capaz

- casas

- catálogo

- central

- centralizar

- certo

- desafiar

- alterar

- Alterações

- mudança

- acusações

- verificar

- Escolha

- escolhido

- Cisco

- classe

- classificação

- classificado

- classificar

- limpar

- Na nuvem

- código

- Coluna

- colunas

- combinação

- combinações

- combinar

- combina

- como

- vinda

- comum

- completar

- integrações

- compatível

- composta

- compreensivo

- Computar

- conceito

- Considerar

- Considerações

- considerado

- considerando

- cônsul

- consumida

- consumo

- não contenho

- conteúdo

- continuamente

- contínuo

- núcleo

- correta

- corresponde

- poderia

- crio

- criado

- Atualmente

- personalizadas

- Clientes

- personalizável

- Cortar

- Cíber segurança

- dados,

- acesso a dados

- Análise de Dados

- lago data

- Plataforma de dados

- informática

- ciência de dados

- banco de dados

- conjuntos de dados

- dias

- Define

- demonstrar

- dependências

- dependente

- Dependendo

- implantar

- implantado

- desenvolvimento

- implanta

- Derivado

- detalhes

- Detecção

- Determinar

- determinando

- desenvolver

- Desenvolvimento

- Dispositivos/Instrumentos

- DID

- diferente

- digital

- Ativos Digitais

- diretamente

- distribuição

- dns

- não

- fazer

- don

- feito

- não

- down

- durante

- e

- cada

- borda

- Eficaz

- ou

- outro

- embutindo

- habilitado

- permite

- end-to-end

- Ponto final

- engenheiro

- Engenharia

- desfrutar

- enriquecer

- Entrar

- Empreendimento

- Meio Ambiente

- ambientes

- época

- erro

- Evento

- eventos

- evolui

- evolução

- Examina

- exemplo

- Exceto

- existe

- expandido

- esperado

- experiência

- Explorando

- externo

- enfrentou

- falso

- família

- Característica

- Funcionalidades

- Campos

- Envie o

- Arquivos

- Encontre

- descobertas

- Primeiro nome

- fluxo

- Foco

- seguinte

- segue

- Pegada

- Escolha

- formato

- treinamento

- encontrado

- quatro

- Quarto

- QUADRO

- enquadramentos

- Gratuito

- da

- totalmente

- função

- mais distante

- gerar

- GitHub

- concedido

- Grupo

- crescido

- Guarda

- Ter

- he

- Herói

- ajudou

- ajuda

- ajuda

- sua

- hospedeiro

- Como funciona o dobrador de carta de canal

- Como Negociar

- Contudo

- HTML

- HTTPS

- ID

- identificado

- identificador

- Identificadores

- identifica

- identificar

- identificar

- Identidade

- ids

- if

- imagem

- Impacto

- implementado

- importar

- melhoria

- in

- incluir

- incluído

- Incluindo

- incorporar

- aumentando

- indicam

- Individual

- indústria

- Infraestrutura

- iniciar

- inovadores

- insights

- instalar

- instância

- integrar

- integrado

- interno

- para dentro

- invocado

- IP

- Endereço IP

- Endereços IP

- IT

- Trabalho

- Empregos

- jpg

- json

- conhecido

- O rótulo

- lago

- paisagem

- grande

- Maior

- APRENDER

- aprendido

- aprendizagem

- esquerda

- bibliotecas

- wifecycwe

- como

- limites

- Lista

- cargas

- localmente

- log

- olhar

- parece

- máquina

- aprendizado de máquina

- a Principal

- gerenciados

- de grupos

- gestão

- maneira

- Posso..

- a medida

- mecanismos

- Conheça

- mencionado

- conheceu

- Métrica

- MFA

- midwest

- mínimo

- desaparecido

- ML

- modelo

- modelos

- modesto

- modificada

- modificar

- Monitore

- monitoração

- a maioria

- múltiplo

- devo

- nome

- Navegação

- necessário

- você merece...

- necessário

- rede

- tráfego de rede

- redes

- Novo

- Próximo

- não

- inexistente

- normal

- caderno

- notificações

- romance

- agora

- objetivo

- objetos

- of

- Ofertas

- on

- ONE

- online

- opaco

- or

- organização

- OS

- Outros

- A Nossa

- resultados

- ponto fora da curva

- delineado

- saída

- lado de fora

- Acima de

- próprio

- página

- Palo Alto

- pandas

- pão

- parte

- Parceiros

- realização

- periodicamente

- permissão

- permissões

- oleoduto

- Locais

- plataforma

- platão

- Inteligência de Dados Platão

- PlatãoData

- jogar

- Privacidade

- parte

- portas

- positivo

- possível

- Publique

- potencialmente

- precedente

- Previsões

- Predictor

- Preparar

- pré-requisitos

- priorizado

- privado

- Proactive

- Processado

- em processamento

- adequado

- protocolos

- fornecer

- fornecedores

- fornece

- qualidade

- questão

- aumentar

- alcance

- classificar

- Leitura

- reais

- em tempo real

- receber

- recebido

- recentemente

- Recomenda

- referência

- região

- regiões

- relacionado

- relativamente

- relevante

- permanecem

- replicado

- representar

- reputação

- pedidos

- requeridos

- exige

- recurso

- Recursos

- resposta

- respostas

- resultar

- Resultados

- retenção

- Opinões

- Tipo

- papéis

- Rota

- Execute

- é executado

- sábio

- Inferência do SageMaker

- Sam

- mesmo

- Conjunto de dados de amostra

- salvo

- Escala

- Escalas

- dimensionamento

- digitalização

- cenário

- esquema

- Ciência

- Ponto

- Sdk

- Pesquisar

- pesquisas

- Segundo

- segurança

- As ameaças de segurança

- Vejo

- selecionar

- selecionado

- enviar

- senior

- Série

- servidor

- serviço

- Serviços

- Sessão

- conjunto

- rede de apoio social

- mostrando

- Shows

- desligando

- lado

- assinatura

- assinatura

- semelhante

- simples

- desde

- solteiro

- Tamanho

- ligeiramente diferente

- pequeno

- So

- solução

- Soluções

- RESOLVER

- fonte

- de origem

- Fontes

- especializada

- específico

- especificamente

- especificada

- Passar

- Esportes

- Staff

- Passo

- Passos

- armazenamento

- loja

- armazenadas

- Estratégia

- transmitir canais

- Simplifica

- Tanga

- estruturada

- estudo

- enviar

- apresentado

- sub-rede

- assinante

- assinantes

- tudo incluso

- tal

- ajuda

- suportes

- suspeito

- mesa

- tarefas

- Profissionais

- equipes

- Dados Técnicos:

- Tecnologia

- Estratégia Tecnológica

- modelo

- tênis

- teste

- que

- A

- deles

- então

- Lá.

- deles

- Terceiro

- De terceiros

- isto

- aqueles

- ameaça

- atores de ameaças

- ameaças

- limiar

- Através da

- tempo

- para

- ferramentas

- tráfego

- Trem

- treinado

- Training

- transformações

- Confiança

- tentar

- tv

- dois

- duplo

- tipo

- tipos

- para

- unificado

- único

- sobre

- urgência

- us

- usar

- caso de uso

- usava

- Utilizador

- usos

- utilização

- utilizar

- utilizado

- válido

- valor

- Valores

- variável

- versão

- Verticais

- Ver

- violados

- Virtual

- vulnerabilidades

- anda

- queremos

- foi

- Caminho..

- we

- web

- serviços web

- foram

- O Quê

- quando

- se

- qual

- Largo

- Ampla variedade

- precisarão

- de

- dentro

- Atividades:

- fluxos de trabalho

- seria

- escrito

- anos

- Vocês

- investimentos

- zefirnet