A preparação de dados é uma etapa crítica em qualquer projeto orientado a dados, e ter as ferramentas certas pode aumentar muito a eficiência operacional. Gerenciador de dados do Amazon SageMaker reduz o tempo necessário para agregar e preparar dados tabulares e de imagem para aprendizado de máquina (ML) de semanas para minutos. Com o SageMaker Data Wrangler, você pode simplificar o processo de preparação de dados e engenharia de recursos e concluir cada etapa do fluxo de trabalho de preparação de dados, incluindo seleção, limpeza, exploração e visualização de dados a partir de uma única interface visual.

Nesta postagem, exploramos os recursos mais recentes do SageMaker Data Wrangler, projetados especificamente para melhorar a experiência operacional. Nós nos aprofundamos no suporte de Serviço de armazenamento simples (Amazon S3) manifestar arquivos, artefatos de inferência em um fluxo de dados interativo e a integração perfeita com JSON (Notação de Objeto JavaScript) formato para inferência, destacando como esses aprimoramentos tornam a preparação de dados mais fácil e eficiente.

Apresentando novos recursos

Nesta seção, discutimos os novos recursos do SageMaker Data Wrangler para uma preparação de dados ideal.

Suporte a arquivo de manifesto S3 com SageMaker Autopilot para inferência de ML

O SageMaker Data Wrangler permite um preparação de dados unificados e treinamento de modelo com experiência Piloto automático do Amazon SageMaker em apenas alguns cliques. Você pode usar o SageMaker Autopilot para treinar, ajustar e implantar automaticamente modelos nos dados que você transformou em seu fluxo de dados.

Essa experiência agora é ainda mais simplificada com o suporte a arquivo de manifesto S3. Um arquivo de manifesto do S3 é um arquivo de texto que lista os objetos (arquivos) armazenados em um bucket do S3. Se o seu conjunto de dados exportado no SageMaker Data Wrangler for muito grande e dividido em arquivos de dados de várias partes no Amazon S3, agora o SageMaker Data Wrangler criará automaticamente um arquivo de manifesto no S3 representando todos esses arquivos de dados. Esse arquivo de manifesto gerado agora pode ser usado com a IU do SageMaker Autopilot no SageMaker Data Wrangler para coletar todos os dados particionados para treinamento.

Antes do lançamento desse recurso, ao usar modelos do SageMaker Autopilot treinados em dados preparados do SageMaker Data Wrangler, você só podia escolher um arquivo de dados, que pode não representar todo o conjunto de dados, especialmente se o conjunto de dados for muito grande. Com essa nova experiência de arquivo de manifesto, você não fica limitado a um subconjunto de seu conjunto de dados. Você pode criar um modelo de ML com o SageMaker Autopilot representando todos os seus dados usando o arquivo de manifesto e usá-lo para sua inferência de ML e implantação de produção. Esse recurso aumenta a eficiência operacional simplificando os modelos de ML de treinamento com o SageMaker Autopilot e simplificando os fluxos de trabalho de processamento de dados.

Adicionado suporte para fluxo de inferência em artefatos gerados

Os clientes querem pegar as transformações de dados que aplicaram aos dados de treinamento do modelo, como codificação one-hot, PCA e imputar valores ausentes, e aplicar essas transformações de dados à inferência em tempo real ou inferência em lote na produção. Para fazer isso, você deve ter um artefato de inferência SageMaker Data Wrangler, que é consumido por um modelo SageMaker.

Anteriormente, os artefatos de inferência só podiam ser gerados a partir da interface do usuário ao exportar para o treinamento do SageMaker Autopilot ou exportar um notebook de pipeline de inferência. Isso não fornecia flexibilidade se você quisesse levar seus fluxos do SageMaker Data Wrangler para fora do Estúdio Amazon SageMaker ambiente. Agora, você pode gerar um artefato de inferência para qualquer arquivo de fluxo compatível por meio de uma tarefa de processamento do SageMaker Data Wrangler. Isso permite MLOps programáticos de ponta a ponta com fluxos do SageMaker Data Wrangler para personas MLOps de código inicial, bem como um caminho intuitivo e sem código para obter um artefato de inferência criando um trabalho a partir da interface do usuário.

Simplificando a preparação de dados

JSON tornou-se um formato amplamente adotado para troca de dados em ecossistemas de dados modernos. A integração do SageMaker Data Wrangler com o formato JSON permite lidar perfeitamente com dados JSON para transformação e limpeza. Ao fornecer suporte nativo para JSON, o SageMaker Data Wrangler simplifica o processo de trabalho com dados estruturados e semiestruturados, permitindo que você extraia informações valiosas e prepare os dados com eficiência. O SageMaker Data Wrangler agora oferece suporte ao formato JSON para implantação de endpoint de inferência em tempo real e em lote.

Visão geral da solução

Para nosso caso de uso, usamos o exemplo Conjunto de dados de avaliações de clientes da Amazon para mostrar como o SageMaker Data Wrangler pode simplificar o esforço operacional para criar um novo modelo de ML usando o SageMaker Autopilot. O conjunto de dados de avaliações de clientes da Amazon contém análises de produtos e metadados da Amazon, incluindo 142.8 milhões de avaliações de maio de 1996 a julho de 2014.

Em um nível superior, usamos o SageMaker Data Wrangler para gerenciar esse grande conjunto de dados e executar as seguintes ações:

- Desenvolva um modelo de ML no SageMaker Autopilot usando todo o conjunto de dados, não apenas uma amostra.

- Crie um pipeline de inferência em tempo real com o artefato de inferência gerado pelo SageMaker Data Wrangler e use a formatação JSON para entrada e saída.

Suporte ao arquivo de manifesto S3 com o SageMaker Autopilot

Ao criar um experimento do SageMaker Autopilot usando o SageMaker Data Wrangler, você só podia especificar um único arquivo CSV ou Parquet. Agora você também pode usar um arquivo de manifesto S3, permitindo que você use grandes quantidades de dados para experimentos do SageMaker Autopilot. O SageMaker Data Wrangler particionará automaticamente os arquivos de dados de entrada em vários arquivos menores e gerará um manifesto que pode ser usado em um experimento do SageMaker Autopilot para extrair todos os dados da sessão interativa, não apenas uma pequena amostra.

Conclua as seguintes etapas:

- Importe os dados de avaliação de clientes da Amazon de um arquivo CSV para o SageMaker Data Wrangler. Certifique-se de desativar a amostragem ao importar os dados.

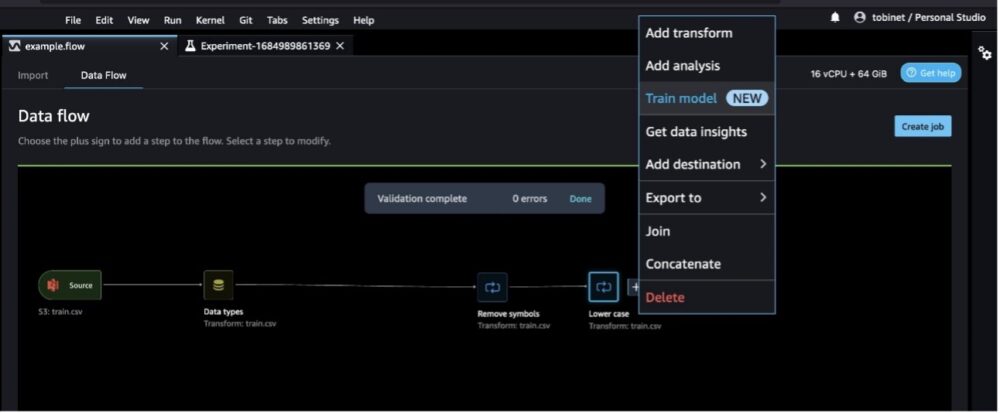

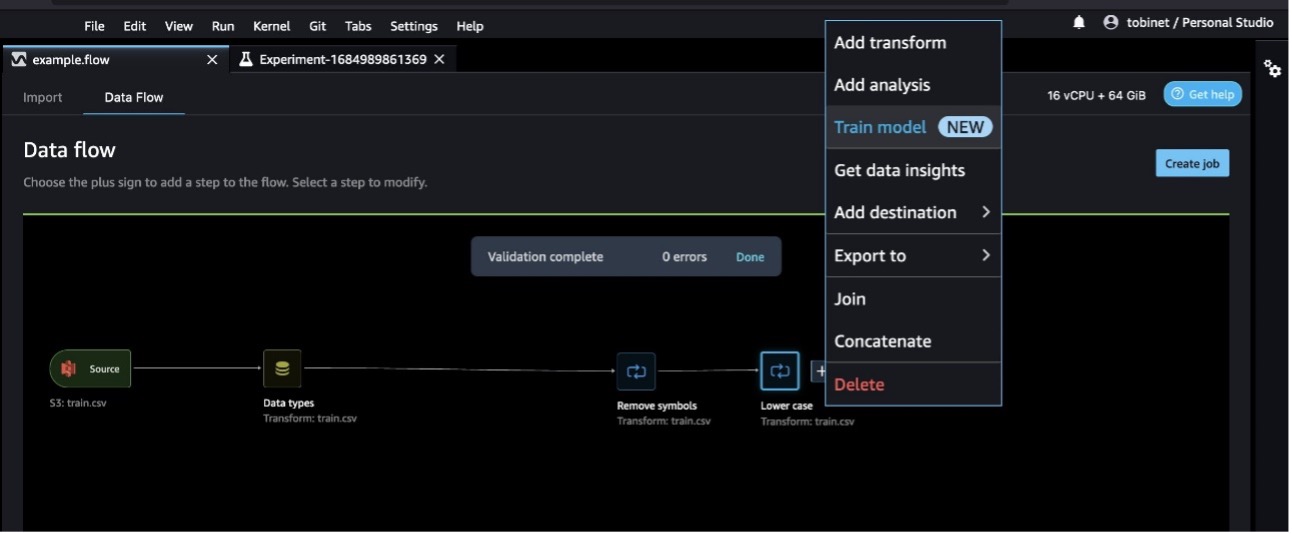

- Especifique as transformações que normalizam os dados. Para este exemplo, remova os símbolos e transforme tudo em letras minúsculas usando as transformações integradas do SageMaker Data Wrangler.

- Escolha Modelo de trem para começar a treinar.

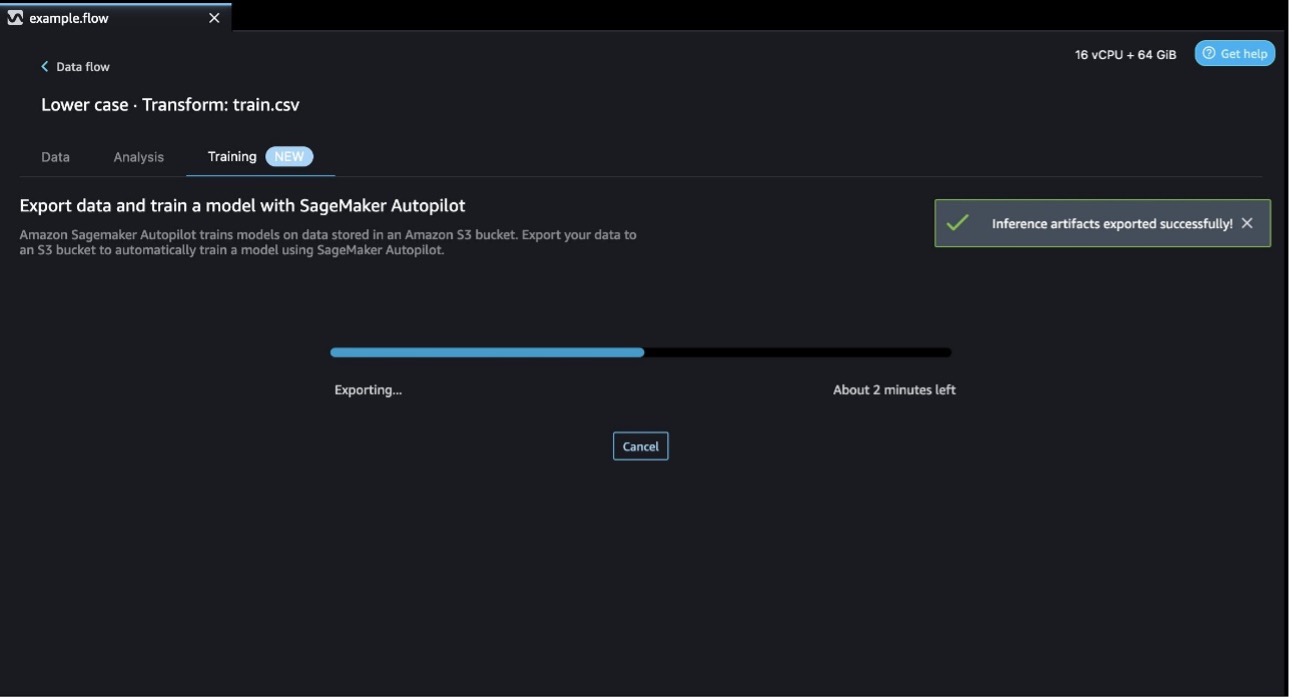

Para treinar um modelo com o SageMaker Autopilot, o SageMaker exporta dados automaticamente para um bucket do S3. Para conjuntos de dados grandes como este, ele dividirá automaticamente o arquivo em arquivos menores e gerará um manifesto que inclui a localização dos arquivos menores.

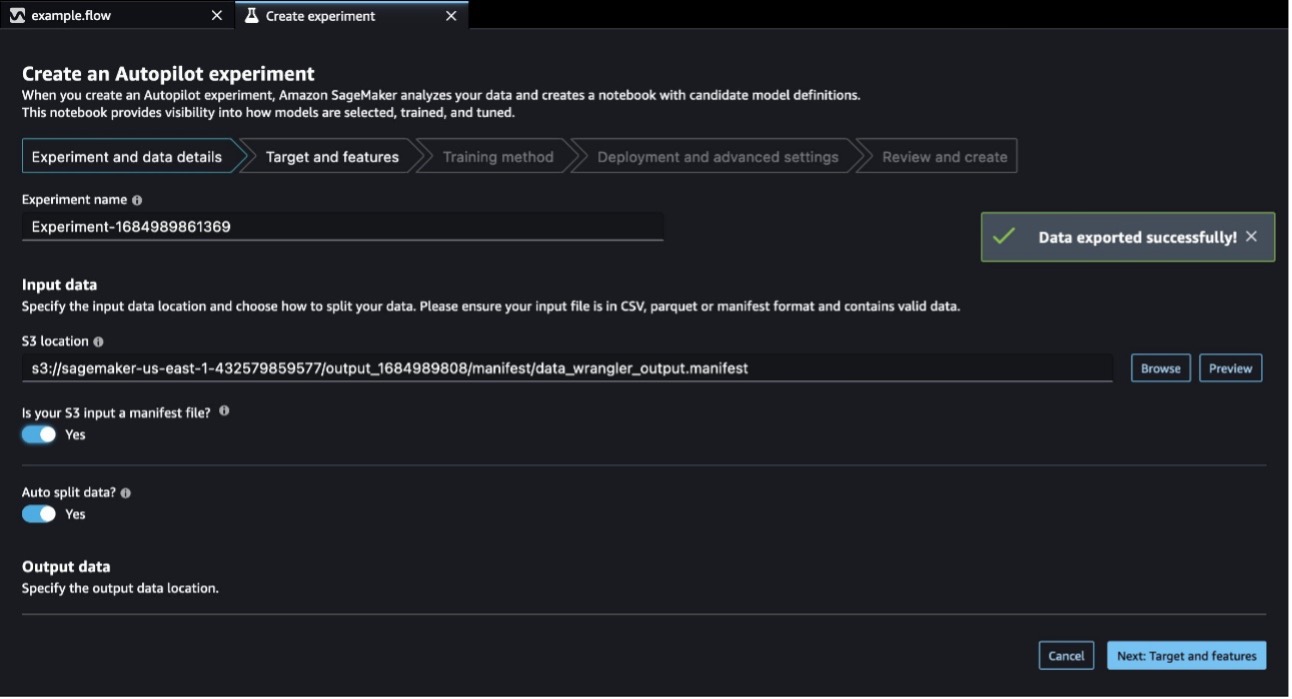

- Primeiro, selecione seus dados de entrada.

Anteriormente, o SageMaker Data Wrangler não tinha a opção de gerar um arquivo de manifesto para usar com o SageMaker Autopilot. Hoje, com o lançamento do suporte ao arquivo de manifesto, o SageMaker Data Wrangler exportará automaticamente um arquivo de manifesto para o Amazon S3, preencherá previamente o local S3 do treinamento do SageMaker Autopilot com o local do arquivo de manifesto S3 e alternará a opção de arquivo de manifesto para Sim. Nenhum trabalho é necessário para gerar ou usar o arquivo de manifesto.

- Configure seu experimento selecionando o alvo para o modelo prever.

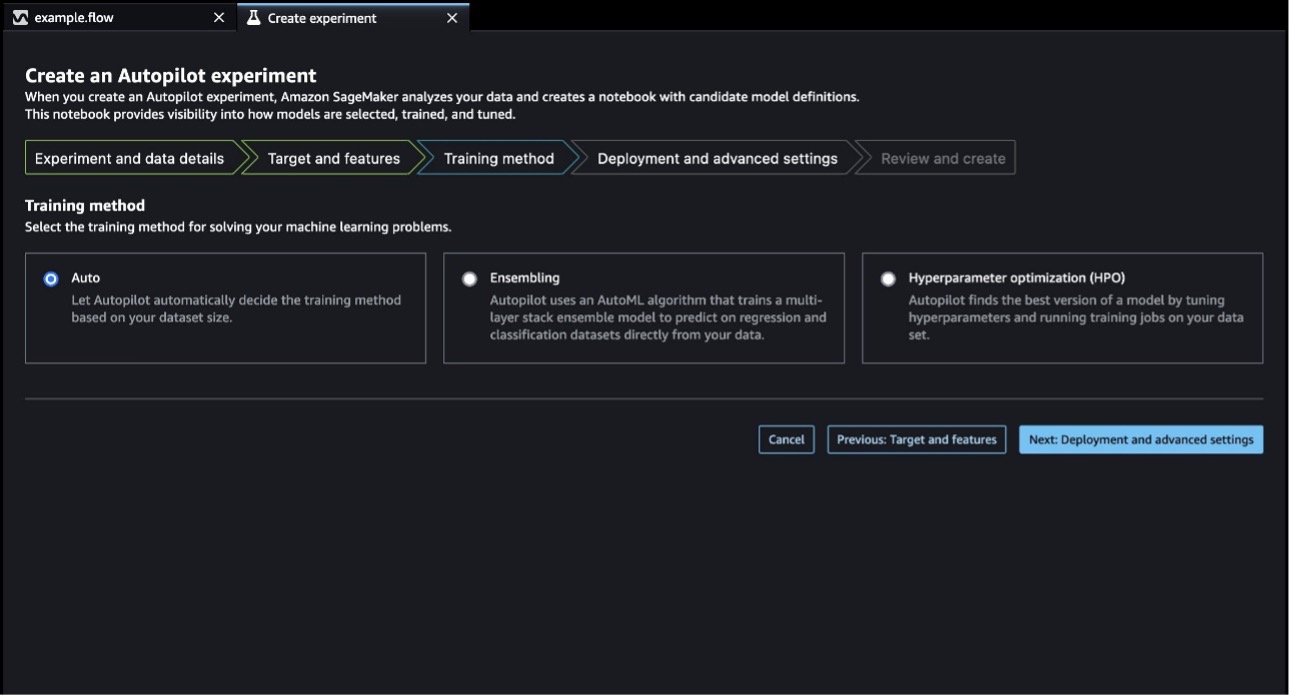

- Em seguida, selecione um método de treinamento. Neste caso, selecionamos Auto e deixe o SageMaker Autopilot decidir o melhor método de treinamento com base no tamanho do conjunto de dados.

- Especifique as configurações de implantação.

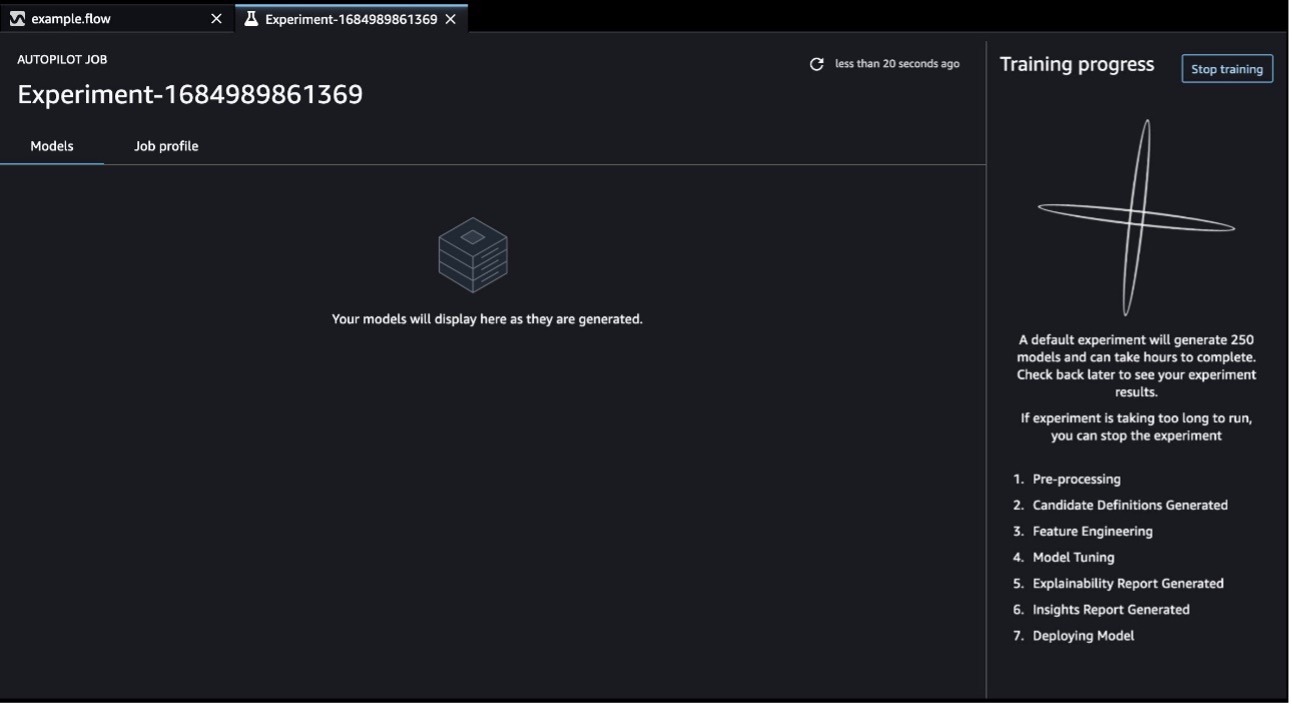

- Por fim, revise a configuração do trabalho e envie o experimento do piloto automático do SageMaker para treinamento. Quando o piloto automático do SageMaker concluir o experimento, você poderá visualizar os resultados do treinamento e explorar o melhor modelo.

Graças ao suporte para arquivos de manifesto, você pode usar todo o seu conjunto de dados para o experimento SageMaker Autopilot, não apenas um subconjunto de seus dados.

Para obter mais informações sobre como usar o SageMaker Autopilot com o SageMaker Data Wrangler, consulte Preparação unificada de dados e treinamento de modelos com Amazon SageMaker Data Wrangler e Amazon SageMaker Autopilot.

Gere artefatos de inferência a partir de trabalhos de processamento do SageMaker

Agora, vamos ver como podemos gerar artefatos de inferência por meio da IU do SageMaker Data Wrangler e dos notebooks do SageMaker Data Wrangler.

IU do SageMaker Data Wrangler

Para nosso caso de uso, queremos processar nossos dados por meio da interface do usuário e, em seguida, usar os dados resultantes para treinar e implantar um modelo por meio do console do SageMaker. Conclua as seguintes etapas:

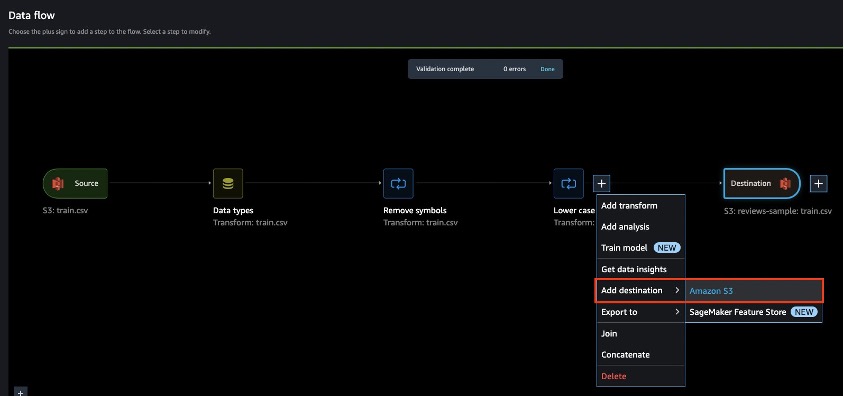

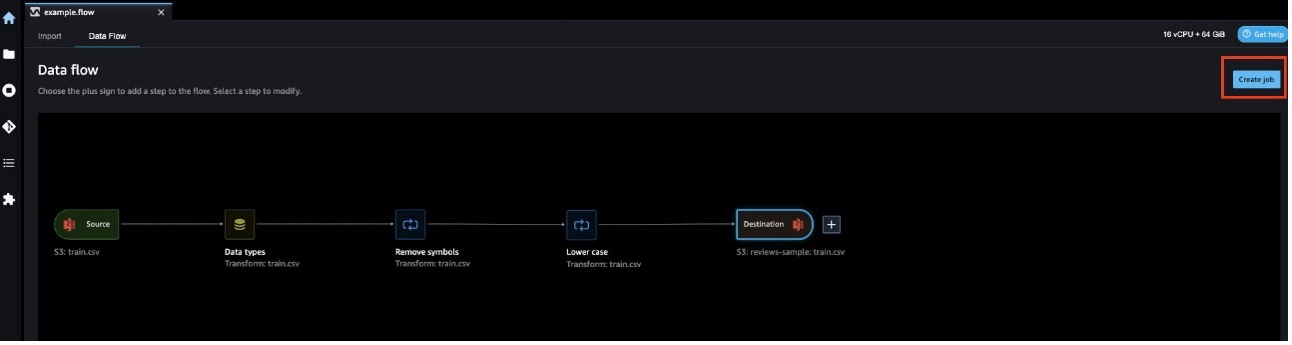

- Abra o fluxo de dados que você criou na seção anterior.

- Escolha o sinal de mais ao lado da última transformação, escolha Adicionar destinoe escolha Amazon S3. Este será o local onde os dados processados serão armazenados.

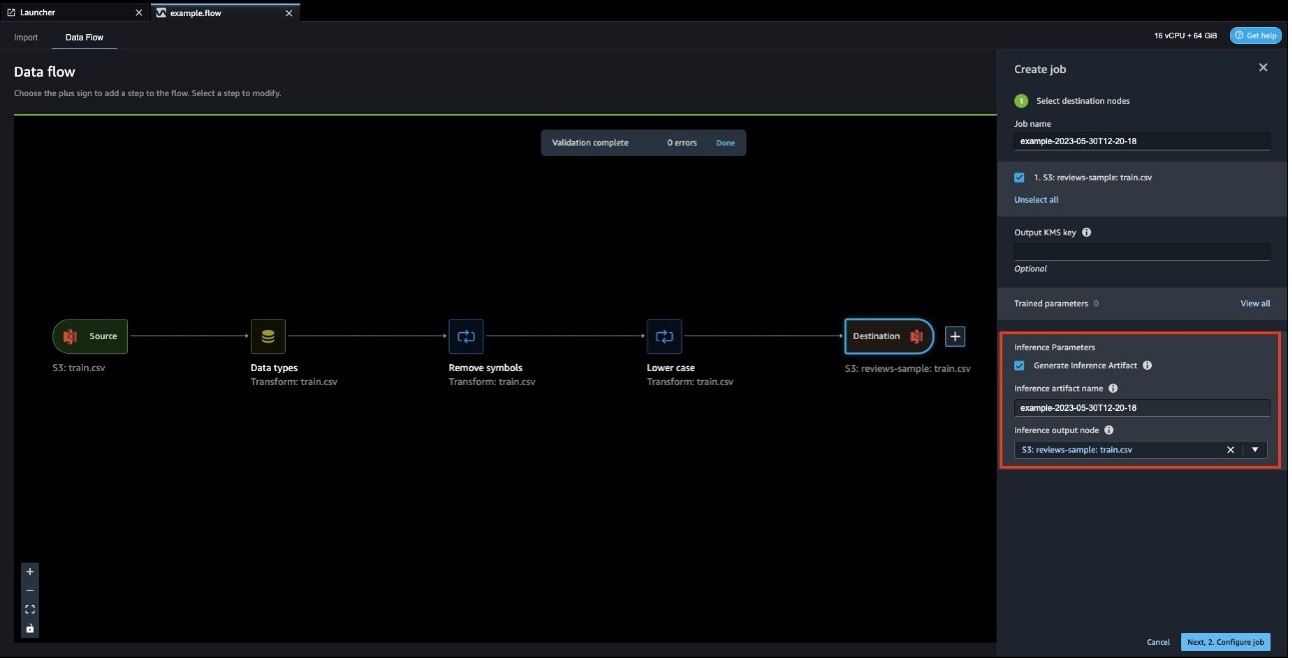

- Escolha Criar emprego.

- Selecionar Gerar artefatos de inferência na seção Parâmetros de inferência para gerar um artefato de inferência.

- Para Nome do artefato de inferência, insira o nome do seu artefato de inferência (com .tar.gz como a extensão do arquivo).

- Para Nó de saída de inferência, insira o nó de destino correspondente às transformações aplicadas aos seus dados de treinamento.

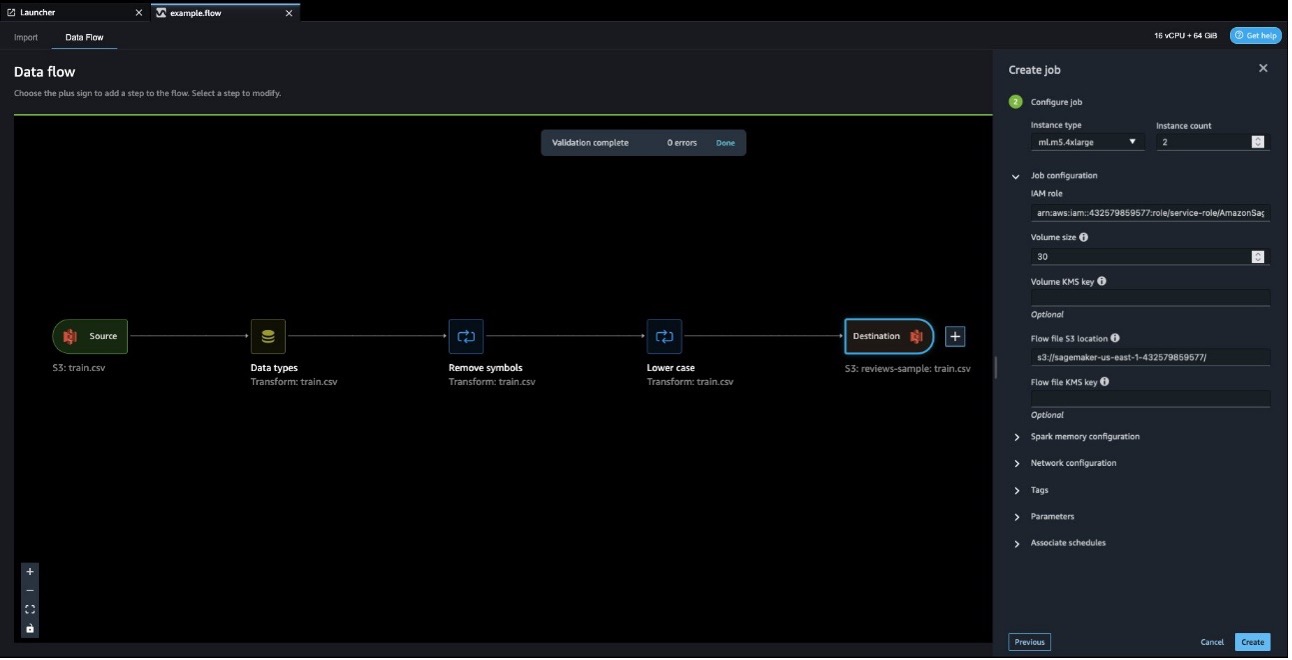

- Escolha Configurar trabalho.

- Debaixo Configuração do trabalho, insira um caminho para Local do S3 do arquivo de fluxo. Uma pasta chamada

data_wrangler_flowsserá criado neste local e o artefato de inferência será carregado nesta pasta. Para alterar o local de upload, defina um local S3 diferente. - Deixe os padrões para todas as outras opções e escolha Crie para criar o trabalho de processamento.

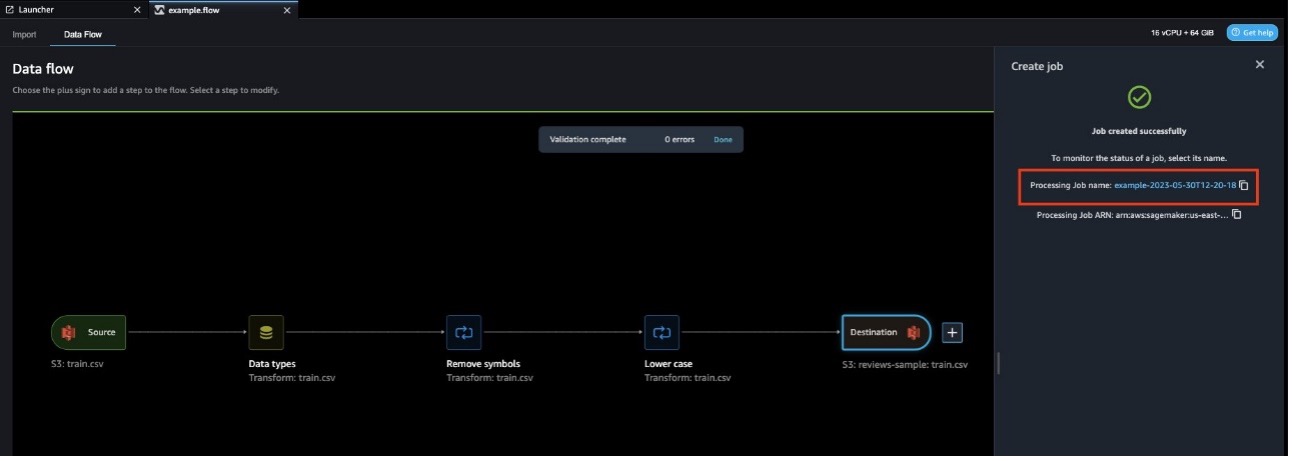

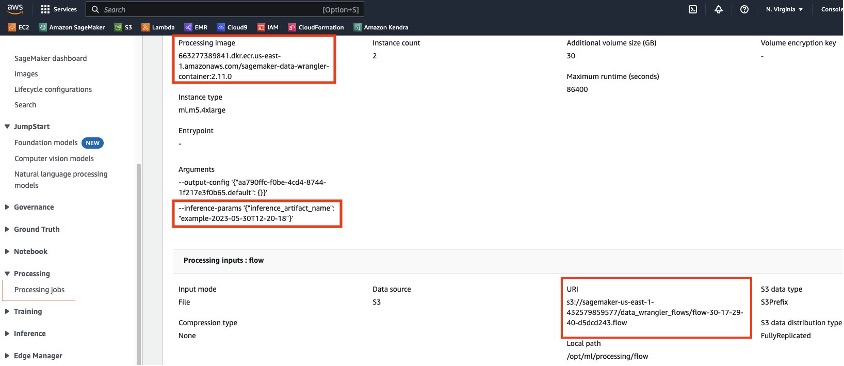

O trabalho de processamento criará umtarball (.tar.gz)contendo um arquivo de fluxo de dados modificado com uma seção de inferência recém-adicionada que permite usá-lo para inferência. Você precisa do identificador de recurso uniforme (URI) S3 do artefato de inferência para fornecer o artefato a um modelo SageMaker ao implantar sua solução de inferência. O URI estará no formato{Flow file S3 location}/data_wrangler_flows/{inference artifact name}.tar.gz. - Se você não anotou esses valores anteriormente, pode escolher o link para o trabalho de processamento para encontrar os detalhes relevantes. Em nosso exemplo, o URI é

s3://sagemaker-us-east-1-43257985977/data_wrangler_flows/example-2023-05-30T12-20-18.tar.gz.

- Copie o valor de Processando imagem; também precisamos desse URI ao criar nosso modelo.

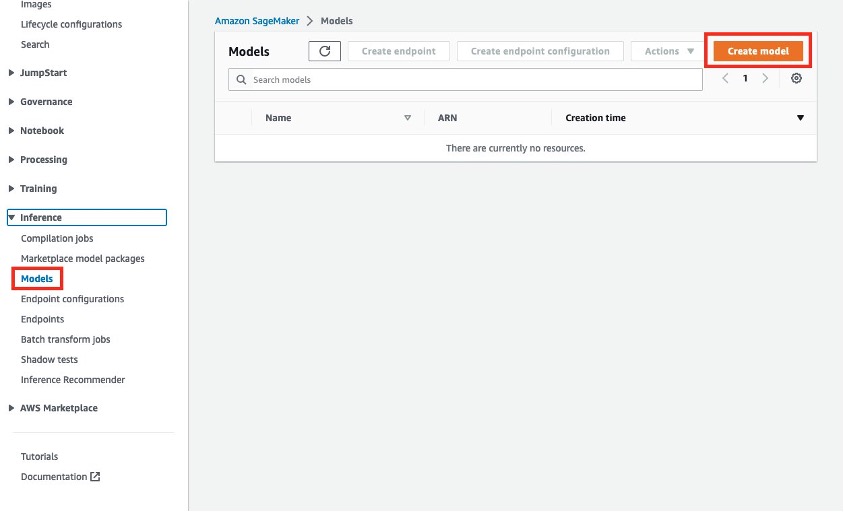

- Agora podemos usar esse URI para criar um modelo do SageMaker no console do SageMaker, que podemos implantar posteriormente em um endpoint ou trabalho de transformação em lote.

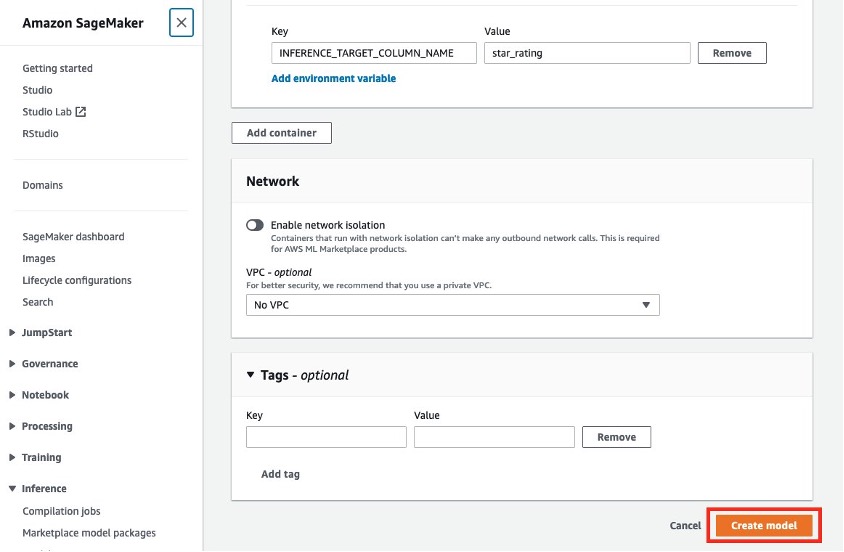

- Debaixo Configurações do modelo¸ digite um nome de modelo e especifique sua função IAM.

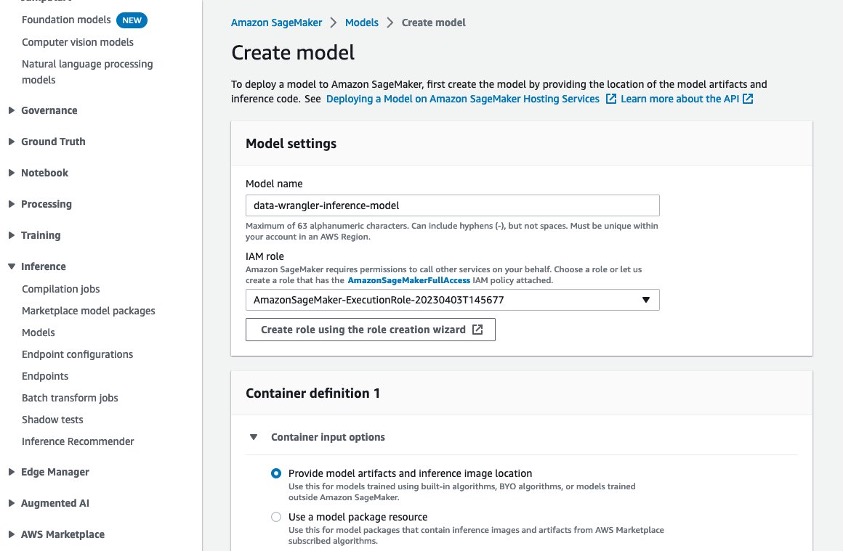

- Escolha Opções de entrada de contêiner, selecione Forneça artefatos de modelo e localização da imagem de inferência.

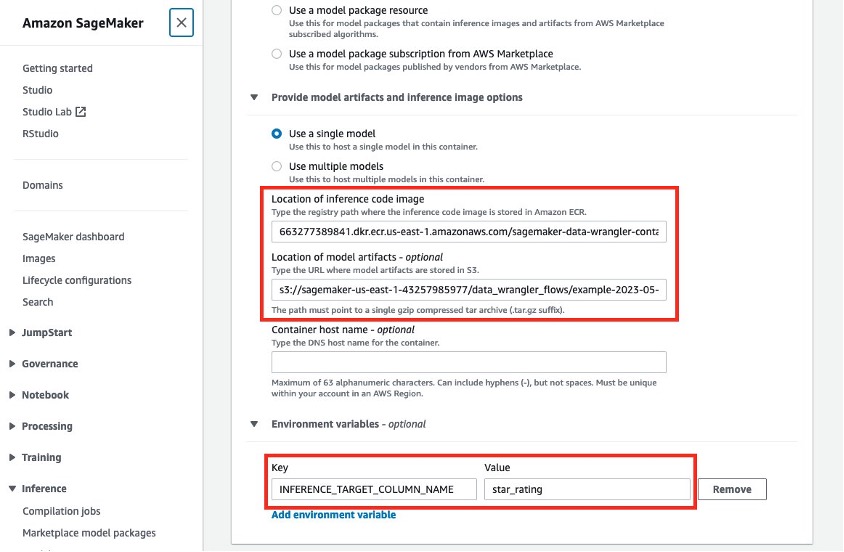

- Escolha Localização da imagem do código de inferência, insira o URI da imagem de processamento.

- Escolha Localização dos artefatos do modelo, insira o URI do artefato de inferência.

- Além disso, se seus dados tiverem uma coluna de destino que será prevista por um modelo de ML treinado, especifique o nome dessa coluna em Variáveis ambientais, com

INFERENCE_TARGET_COLUMN_NAMEas Chave e o nome da coluna como Valor.

- Termine de criar seu modelo escolhendo Criar modelo.

Agora temos um modelo que podemos implantar em um endpoint ou trabalho de transformação em lote.

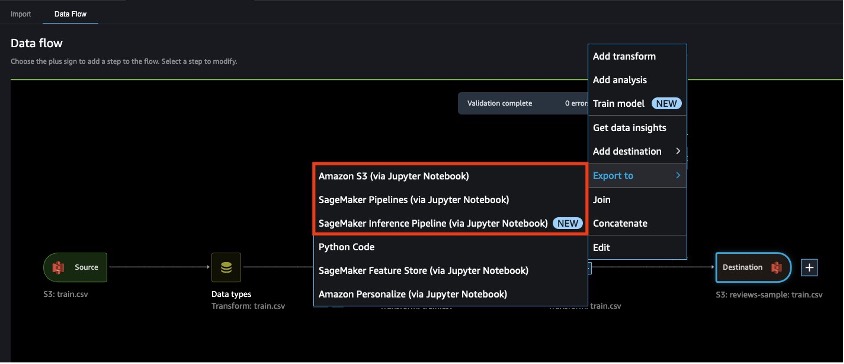

Blocos de anotações SageMaker Data Wrangler

Para uma abordagem de código inicial para gerar o artefato de inferência de um trabalho de processamento, podemos encontrar o código de exemplo escolhendo Exportar para no menu do nó e escolhendo Amazon S3, Pipelines SageMakerou Pipeline de inferência do SageMaker. Nós escolhemos Pipeline de inferência do SageMaker neste exemplo.

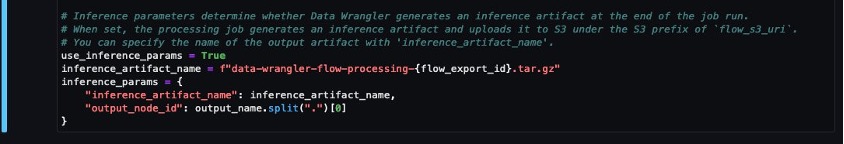

Neste caderno, há uma seção intitulada Criar processador (isso é idêntico no notebook SageMaker Pipelines, mas no notebook Amazon S3, o código equivalente estará sob o Configurações de trabalho seção). No final desta seção está uma configuração para nosso artefato de inferência chamado inference_params. Ele contém as mesmas informações que vimos na IU, ou seja, o nome do artefato de inferência e o nó de saída de inferência. Esses valores serão pré-preenchidos, mas podem ser modificados. Existe adicionalmente um parâmetro chamado use_inference_params, que deve ser definido como True para usar esta configuração no trabalho de processamento.

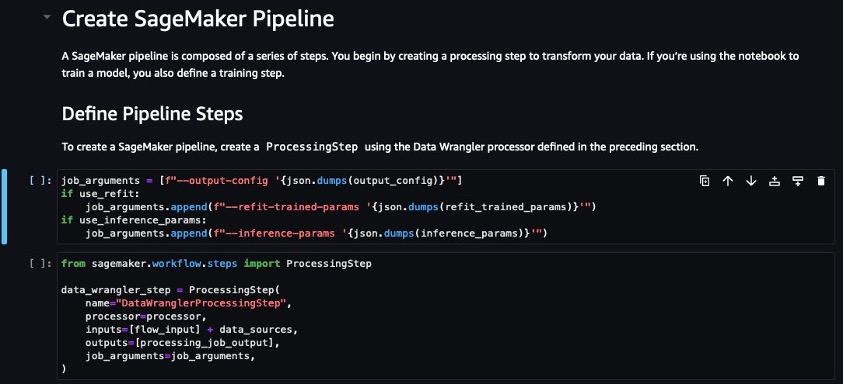

Mais abaixo está uma seção intitulada Definir etapas do pipeline, Onde o inference_params A configuração é anexada a uma lista de argumentos de trabalho e passada para a definição de uma etapa de processamento do SageMaker Data Wrangler. No notebook Amazon S3, job_arguments é definido imediatamente após o Configurações de trabalho seção.

Com essas configurações simples, o trabalho de processamento criado por este notebook gerará um artefato de inferência no mesmo local do S3 que nosso arquivo de fluxo (definido anteriormente em nosso notebook). Podemos determinar programaticamente esse local S3 e usar esse artefato para criar um modelo SageMaker usando o SDK Python do SageMaker, que é demonstrado no notebook SageMaker Inference Pipeline.

A mesma abordagem pode ser aplicada a qualquer código Python que crie um trabalho de processamento do SageMaker Data Wrangler.

Suporte ao formato de arquivo JSON para entrada e saída durante a inferência

É bastante comum que sites e aplicativos usem JSON como solicitação/resposta para APIs, de modo que as informações sejam fáceis de analisar por diferentes linguagens de programação.

Anteriormente, depois de ter um modelo treinado, você só podia interagir com ele via CSV como um formato de entrada em um pipeline de inferência do SageMaker Data Wrangler. Hoje, você pode usar JSON como um formato de entrada e saída, proporcionando mais flexibilidade ao interagir com os contêineres de inferência do SageMaker Data Wrangler.

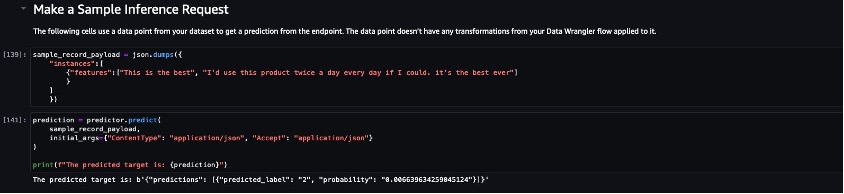

Para começar a usar JSON para entrada e saída no notebook do pipeline de inferência, conclua as etapas a seguir:

- Defina uma carga útil.

Para cada carga útil, o modelo espera uma chave chamada instances. O valor é uma lista de objetos, cada um sendo seu próprio ponto de dados. Os objetos requerem uma chave chamada recursos e os valores devem ser os recursos de um único ponto de dados que devem ser enviados ao modelo. Vários pontos de dados podem ser enviados em uma única solicitação, até um tamanho total de 6 MB por solicitação.

Veja o seguinte código:

- Especifique o

ContentTypeasapplication/json. - Forneça dados ao modelo e receba inferência no formato JSON.

See Formatos de dados comuns para inferência para exemplos de JSON de entrada e saída de amostra.

limpar

Quando terminar de usar o SageMaker Data Wrangler, recomendamos que você desligue a instância em que ele é executado para evitar cobranças adicionais. Para obter instruções sobre como desligar o aplicativo SageMaker Data Wrangler e a instância associada, consulte Desligar o Data Wrangler.

Conclusão

Os novos recursos do SageMaker Data Wrangler, incluindo suporte para arquivos de manifesto S3, recursos de inferência e integração de formato JSON, transformam a experiência operacional de preparação de dados. Esses aprimoramentos agilizam a importação de dados, automatizam as transformações de dados e simplificam o trabalho com dados JSON. Com esses recursos, você pode aprimorar sua eficiência operacional, reduzir o esforço manual e extrair insights valiosos de seus dados com facilidade. Aproveite o poder dos novos recursos do SageMaker Data Wrangler e libere todo o potencial de seus fluxos de trabalho de preparação de dados.

Para começar a usar o SageMaker Data Wrangler, confira as informações mais recentes sobre o Página do produto SageMaker Data Wrangler.

Sobre os autores

Munish Dabra é Arquiteto Principal de Soluções da Amazon Web Services (AWS). Suas áreas de foco atuais são AI/ML e observabilidade. Ele tem uma sólida experiência em projetar e construir sistemas distribuídos escaláveis. Ele gosta de ajudar os clientes a inovar e transformar seus negócios na AWS. Linkedin: /mdabra

Munish Dabra é Arquiteto Principal de Soluções da Amazon Web Services (AWS). Suas áreas de foco atuais são AI/ML e observabilidade. Ele tem uma sólida experiência em projetar e construir sistemas distribuídos escaláveis. Ele gosta de ajudar os clientes a inovar e transformar seus negócios na AWS. Linkedin: /mdabra

Patrick Lin é engenheiro de desenvolvimento de software do Amazon SageMaker Data Wrangler. Ele está comprometido em tornar o Amazon SageMaker Data Wrangler a ferramenta de preparação de dados número um para fluxos de trabalho de ML produzidos. Fora do trabalho, você pode encontrá-lo lendo, ouvindo música, conversando com amigos e servindo em sua igreja.

Patrick Lin é engenheiro de desenvolvimento de software do Amazon SageMaker Data Wrangler. Ele está comprometido em tornar o Amazon SageMaker Data Wrangler a ferramenta de preparação de dados número um para fluxos de trabalho de ML produzidos. Fora do trabalho, você pode encontrá-lo lendo, ouvindo música, conversando com amigos e servindo em sua igreja.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Automotivo / EVs, Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- BlockOffsets. Modernizando a Propriedade de Compensação Ambiental. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/optimize-data-preparation-with-new-features-in-aws-sagemaker-data-wrangler/

- :tem

- :é

- :não

- :onde

- $UP

- 100

- 1996

- 2014

- 7

- 8

- 9

- a

- ações

- adicionado

- Adicional

- Adicionalmente

- adotado

- Depois de

- AI / ML

- Todos os Produtos

- Permitindo

- permite

- tb

- Amazon

- Amazon Sage Maker

- Piloto automático do Amazon SageMaker

- Gerenciador de dados do Amazon SageMaker

- Amazon Web Services

- Amazon Web Services (AWS)

- quantidades

- an

- e

- qualquer

- APIs

- app

- aplicações

- aplicado

- Aplicar

- abordagem

- SOMOS

- áreas

- argumentos

- AS

- associado

- At

- automatizar

- automaticamente

- evitar

- AWS

- fundo

- baseado

- BE

- tornam-se

- ser

- MELHOR

- Grande

- ambos

- Inferior

- Break

- construir

- Prédio

- construídas em

- negócio

- mas a

- by

- chamado

- CAN

- capacidades

- casas

- alterar

- acusações

- verificar

- Escolha

- escolha

- igreja

- Limpeza

- código

- Coluna

- comprometido

- comum

- compatível

- completar

- Completa

- Configuração

- cônsul

- consumida

- Containers

- contém

- conversas

- Correspondente

- poderia

- crio

- criado

- cria

- Criar

- crítico

- Atual

- cliente

- Clientes

- dados,

- Data Exchange

- Os pontos de dados

- Preparação de dados

- informática

- orientado por dados

- conjuntos de dados

- dia

- decidir

- defaults

- definido

- definição

- mergulhar

- demonstraram

- implantar

- Implantação

- desenvolvimento

- projetado

- concepção

- destino

- detalhes

- Determinar

- Desenvolvimento

- diferente

- discutir

- distribuído

- Sistemas distribuídos

- do

- down

- durante

- cada

- Mais cedo

- facilidade

- mais fácil

- fácil

- ecossistemas

- eficiência

- eficiente

- eficientemente

- esforço

- ou

- abraços

- permite

- permitindo

- end-to-end

- Ponto final

- engenheiro

- Engenharia

- aumentar

- Melhorias

- Melhora

- Entrar

- Todo

- Meio Ambiente

- Equivalente

- especialmente

- SEMPRE

- Cada

- todo dia

- tudo

- exemplo

- exemplos

- exchange

- esperando

- vasta experiência

- experimentar

- experimentos

- exploração

- explorar

- exportar

- exportações

- extensão

- extrato

- Característica

- Funcionalidades

- poucos

- Envie o

- Arquivos

- Encontre

- Flexibilidade

- fluxo

- Fluxos

- Foco

- seguir

- seguinte

- Escolha

- formulário

- formato

- amigos

- da

- cheio

- mais distante

- gerar

- gerado

- ter

- grandemente

- tinha

- manipular

- Ter

- ter

- he

- ajuda

- Alta

- Destacando

- ele

- sua

- Como funciona o dobrador de carta de canal

- Como Negociar

- HTML

- HTTPS

- i

- idêntico

- identificador

- if

- imagem

- imediatamente

- importar

- importador

- melhorar

- in

- inclui

- Incluindo

- INFORMAÇÕES

- inovar

- entrada

- insights

- instância

- instruções

- integração

- Pretendido

- interagir

- interagindo

- interativo

- Interface

- para dentro

- intuitivo

- IT

- ESTÁ

- JavaScript

- Trabalho

- jpg

- json

- Julho

- apenas por

- Chave

- Idiomas

- grande

- Sobrenome

- mais tarde

- mais recente

- lançamento

- aprendizagem

- deixar

- Nível

- como

- Limitado

- LINK

- Lista

- Escuta

- listas

- localização

- olhar

- máquina

- aprendizado de máquina

- fazer

- Fazendo

- gerencia

- manual

- Posso..

- Menu

- metadados

- método

- poder

- milhão

- Minutos

- desaparecido

- ML

- MLOps

- modelo

- modelos

- EQUIPAMENTOS

- modificada

- mais

- mais eficiente

- múltiplo

- Música

- devo

- nome

- Nomeado

- nomeadamente

- nativo

- necessário

- você merece...

- Cria

- Novo

- Novos Recursos

- recentemente

- Próximo

- não

- nó

- caderno

- agora

- número

- objeto

- objetos

- of

- on

- ONE

- só

- operacional

- ideal

- Otimize

- Opção

- Opções

- or

- Outros

- A Nossa

- Fora

- saída

- lado de fora

- próprio

- parâmetro

- parâmetros

- passou

- caminho

- para

- Realizar

- escolher

- oleoduto

- platão

- Inteligência de Dados Platão

- PlatãoData

- mais

- ponto

- pontos

- Publique

- potencial

- poder

- predizer

- previsto

- preparação

- Preparar

- preparado

- bastante

- anteriormente

- Diretor

- processo

- Processado

- em processamento

- Produto

- Opiniões

- Produção

- Programático

- Programação

- linguagens de programação

- projeto

- fornecer

- fornecendo

- Python

- Leitura

- em tempo real

- receber

- recomendar

- reduzir

- reduz

- liberar

- relevante

- remover

- representar

- representando

- solicitar

- requerer

- recurso

- resultando

- Resultados

- rever

- Opinões

- certo

- Tipo

- é executado

- s

- sábio

- Inferência do SageMaker

- Pipelines SageMaker

- mesmo

- serra

- escalável

- desatado

- sem problemas

- Seção

- Vejo

- selecionando

- doadores,

- Serviços

- de servir

- Sessão

- conjunto

- Configurações

- vários

- rede de apoio social

- mostrar

- Encerre

- assinar

- simples

- simplificada

- simplificar

- simplificando

- solteiro

- Tamanho

- pequeno

- menor

- So

- Software

- desenvolvimento de software

- solução

- Soluções

- especificamente

- divisão

- começo

- começado

- Passo

- Passos

- armazenamento

- armazenadas

- simplificar

- racionalização

- mais forte,

- estruturada

- enviar

- apresentado

- tal

- ajuda

- suportes

- certo

- sistemas

- Tire

- toma

- Target

- que

- A

- as informações

- deles

- então

- Lá.

- Este

- isto

- aqueles

- Através da

- tempo

- intitulado

- para

- hoje

- também

- ferramenta

- ferramentas

- Total

- Trem

- treinado

- Training

- Transformar

- Transformação

- transformações

- transformado

- transformações

- Twice

- ui

- para

- destravar

- carregado

- usar

- caso de uso

- usava

- utilização

- Valioso

- valor

- Valores

- muito

- via

- Ver

- visualização

- queremos

- querido

- we

- web

- serviços web

- sites

- semanas

- BEM

- quando

- qual

- largamente

- precisarão

- de

- Atividades:

- de gestão de documentos

- fluxos de trabalho

- trabalhar

- Vocês

- investimentos

- zefirnet