Construir uma plataforma de operações de aprendizado de máquina (MLOps) no cenário em rápida evolução da inteligência artificial (IA) e do aprendizado de máquina (ML) para as organizações é essencial para preencher perfeitamente a lacuna entre a experimentação e a implantação da ciência de dados e, ao mesmo tempo, atender aos requisitos em torno do desempenho do modelo, segurança e conformidade.

Para cumprir os requisitos regulamentares e de conformidade, os principais requisitos ao projetar tal plataforma são:

- Desvio de dados de endereço

- Monitore o desempenho do modelo

- Facilite o retreinamento automático do modelo

- Fornecer um processo para aprovação do modelo

- Mantenha os modelos em um ambiente seguro

Nesta postagem, mostramos como criar uma estrutura MLOps para atender a essas necessidades usando uma combinação de serviços AWS e conjuntos de ferramentas de terceiros. A solução envolve uma configuração multiambiente com retreinamento automatizado de modelos, inferência em lote e monitoramento com Monitor de modelo do Amazon SageMaker, versionamento de modelo com Registro de modelo do SageMakere um pipeline de CI/CD para facilitar a promoção de códigos e pipelines de ML em ambientes usando Amazon Sage Maker, Amazon Event Bridge, Serviço de notificação simples da Amazon (Amazon S3), HashiCorp Terraforma, GitHub e Jenkins CI/CD. Construímos um modelo para prever a gravidade (benigna ou maligna) de uma lesão mamográfica de massa treinada com o Algoritmo XGBoost usando o disponível publicamente Massa de Mamografia UCI conjunto de dados e implantá-lo usando a estrutura MLOps. As instruções completas com código estão disponíveis no Repositório GitHub.

Visão geral da solução

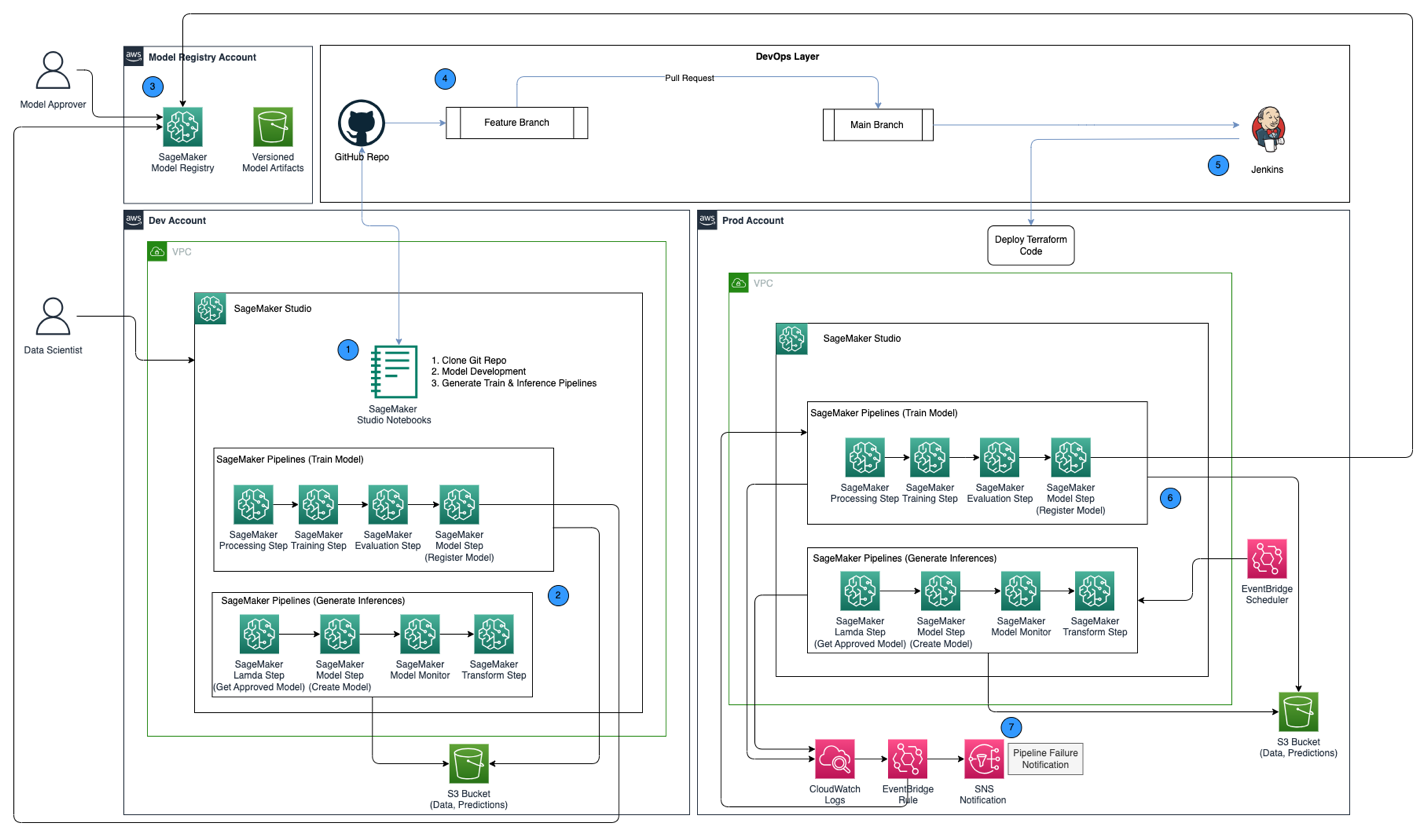

O diagrama de arquitetura a seguir mostra uma visão geral da estrutura MLOps com os seguintes componentes principais:

- Estratégia multicontas – Dois ambientes diferentes (dev e prod) são configurados em duas contas diferentes da AWS seguindo as práticas recomendadas do AWS Well-Architected, e uma terceira conta é configurada no registro de modelo central:

- ambiente de desenvolvimento – Onde um Domínio do Amazon SageMaker Studio é configurado para permitir o desenvolvimento de modelos, treinamento de modelos e testes de pipelines de ML (treinamento e inferência), antes que um modelo esteja pronto para ser promovido para ambientes superiores.

- Ambiente de produção – Onde os pipelines de ML do dev são promovidos como uma primeira etapa e agendados e monitorados ao longo do tempo.

- Registro de modelo central - Registro de modelos do Amazon SageMaker é configurado em uma conta AWS separada para rastrear versões de modelo geradas nos ambientes de desenvolvimento e produção.

- CI/CD e controle de origem – A implantação de pipelines de ML em ambientes é feita por meio de CI/CD configurado com Jenkins, juntamente com o controle de versão feito por meio do GitHub. As alterações de código mescladas no ambiente correspondente git branch acionam um fluxo de trabalho de CI/CD para fazer alterações apropriadas no ambiente de destino determinado.

- Previsões de lote com monitoramento de modelo – O pipeline de inferência construído com Pipelines Amazon SageMaker é executado de forma programada para gerar previsões junto com o monitoramento de modelo usando o SageMaker Model Monitor para detectar desvios de dados.

- Mecanismo de reciclagem automatizado – O pipeline de treinamento criado com SageMaker Pipelines é acionado sempre que um desvio de dados é detectado no pipeline de inferência. Depois de treinado, o modelo é registrado no registro central de modelos para ser aprovado por um aprovador de modelo. Quando aprovado, a versão atualizada do modelo é usada para gerar previsões por meio do pipeline de inferência.

- Infraestrutura como código – A infraestrutura como código (IaC), criada usando HashiCorp Terraforma, suporta o agendamento do pipeline de inferência com EventBridge, acionando o pipeline de trem com base em um Regra EventBridge e enviar notificações usando Serviço de notificação simples da Amazon (Amazon SNS) Tópicos.

O fluxo de trabalho MLOps inclui as seguintes etapas:

- Acesse o domínio do SageMaker Studio na conta de desenvolvimento, clone o repositório GitHub, passe pelo processo de desenvolvimento do modelo usando o modelo de amostra fornecido e gere os pipelines de treinamento e inferência.

- Execute o pipeline de treinamento na conta de desenvolvimento, que gera os artefatos do modelo para a versão do modelo treinado e registra o modelo no SageMaker Model Registry na conta central de registro do modelo.

- Aprove o modelo no SageMaker Model Registry na conta central de registro de modelo.

- Envie o código (pipelines de treinamento e inferência e o código Terraform IaC para criar o cronograma do EventBridge, a regra do EventBridge e o tópico SNS) em uma ramificação de recurso do repositório GitHub. Crie uma solicitação pull para mesclar o código na ramificação principal do repositório GitHub.

- Acione o pipeline Jenkins CI/CD, que é configurado com o repositório GitHub. O pipeline de CI/CD implanta o código na conta prod para criar os pipelines de treinamento e inferência junto com o código Terraform para provisionar a programação do EventBridge, a regra do EventBridge e o tópico SNS.

- O pipeline de inferência está programado para ser executado diariamente, enquanto o pipeline de trem é configurado para ser executado sempre que um desvio de dados for detectado no pipeline de inferência.

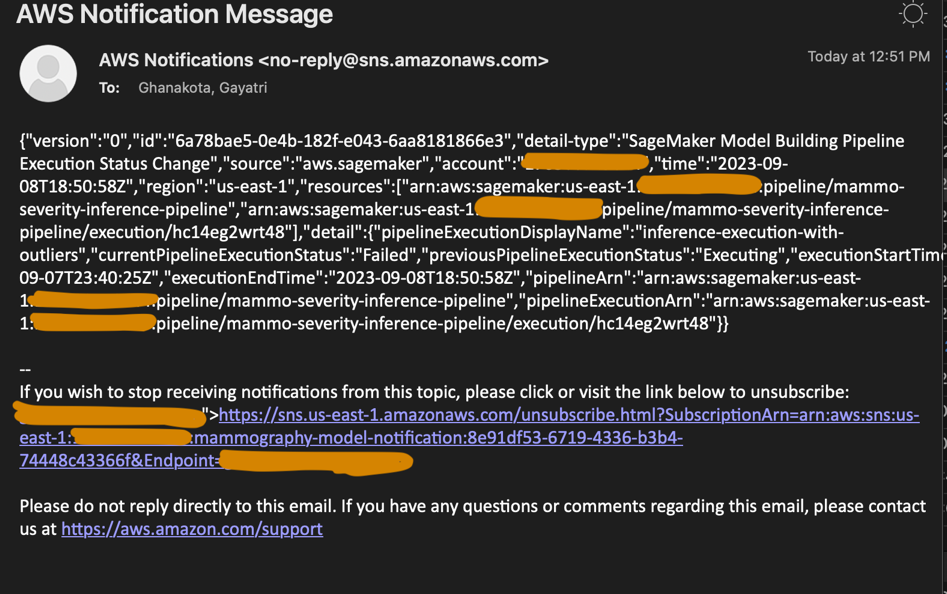

- As notificações são enviadas por meio do tópico SNS sempre que há uma falha no trem ou no pipeline de inferência.

Pré-requisitos

Para esta solução, você deve ter os seguintes pré-requisitos:

- Três contas da AWS (contas de desenvolvimento, produção e registro de modelo central)

- Um domínio do SageMaker Studio configurado em cada uma das três contas AWS (consulte Integrado ao Amazon SageMaker Studio ou assista ao video Integre rapidamente no Amazon SageMaker Studio para obter instruções de configuração)

- Jenkins (usamos Jenkins 2.401.1) com privilégios administrativos instalados na AWS

- Terraform versão 1.5.5 ou posterior instalado no servidor Jenkins

Para este post, trabalhamos no us-east-1 Região para implantar a solução.

Provisionar chaves KMS em contas de desenvolvimento e produção

Nosso primeiro passo é criar Serviço de gerenciamento de chaves AWS (AWS KMS) nas contas dev e prod.

Crie uma chave KMS na conta de desenvolvimento e conceda acesso à conta de produção

Conclua as etapas a seguir para criar uma chave KMS na conta de desenvolvimento:

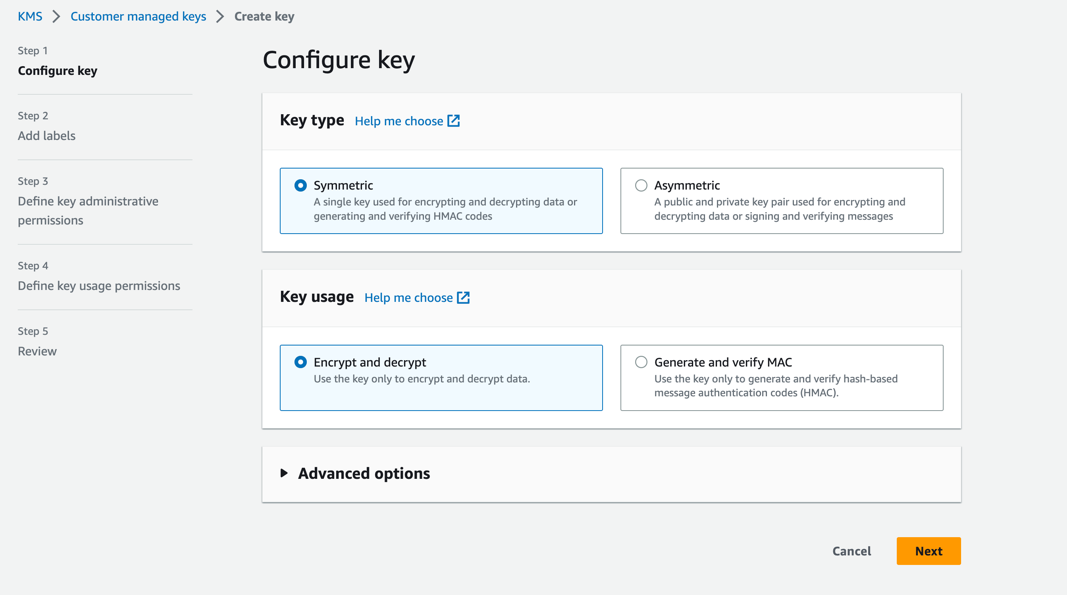

- No console do AWS KMS, escolha Chaves gerenciadas pelo cliente no painel de navegação.

- Escolha Criar chave.

- Escolha Tipo de chave, selecione Simétrico.

- Escolha Uso da chave, selecione Criptografar e descriptografar.

- Escolha Próximo.

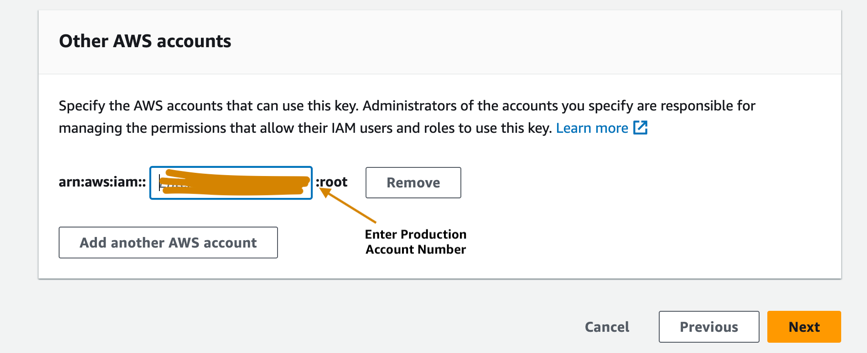

- Insira o número da conta de produção para conceder à conta de produção acesso à chave KMS provisionada na conta de desenvolvimento. Essa é uma etapa obrigatória porque na primeira vez que o modelo é treinado na conta de desenvolvimento, os artefatos do modelo são criptografados com a chave KMS antes de serem gravados no bucket S3 na conta central de registro do modelo. A conta de produção precisa de acesso à chave KMS para descriptografar os artefatos do modelo e executar o pipeline de inferência.

- Escolha Próximo e termine de criar sua chave.

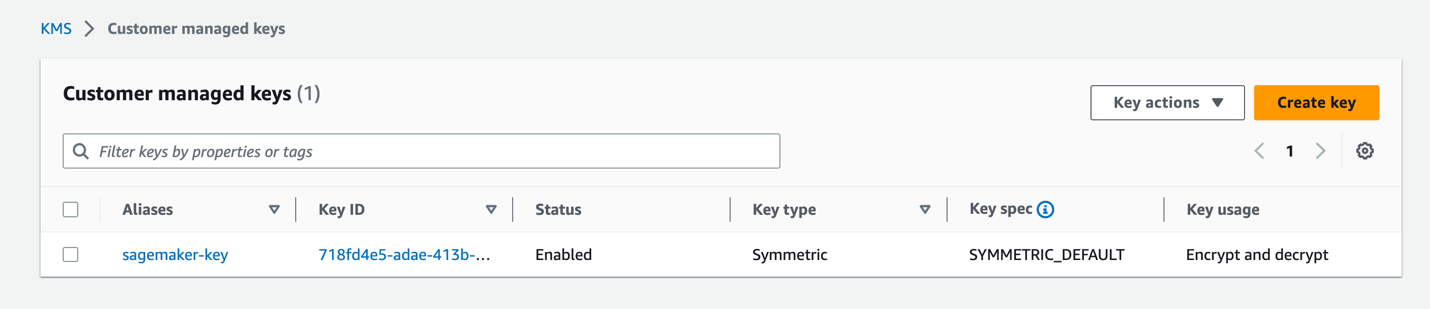

Depois que a chave for provisionada, ela deverá ficar visível no console do AWS KMS.

Crie uma chave KMS na conta de produção

Siga as mesmas etapas da seção anterior para criar uma chave KMS gerenciada pelo cliente na conta de produção. Você pode pular a etapa de compartilhar a chave KMS com outra conta.

Configurar um bucket S3 de artefatos de modelo na conta de registro de modelo central

Crie um bucket S3 de sua escolha com a string sagemaker na convenção de nomenclatura como parte do nome do bucket na conta de registro do modelo central e atualize a política de bucket no bucket S3 para conceder permissões das contas dev e prod para ler e gravar artefatos de modelo no bucket S3.

O código a seguir é a política de bucket a ser atualizada no bucket S3:

Configure funções do IAM em suas contas da AWS

O próximo passo é configurar Gerenciamento de acesso e identidade da AWS (IAM) em suas contas da AWS com permissões para AWS Lambda, SageMaker e Jenkins.

Função de execução do Lambda

Estabelecer Funções de execução do Lambda nas contas dev e prod, que serão usadas pela função Lambda executada como parte do Etapa Lambda do SageMaker Pipelines. Esta etapa será executada a partir do pipeline de inferência para buscar o modelo aprovado mais recente, usando o qual as inferências são geradas. Crie funções do IAM nas contas dev e prod com a convenção de nomenclatura arn:aws:iam::<account-id>:role/lambda-sagemaker-role e anexe as seguintes políticas do IAM:

- Política 1 – Crie uma política em linha chamada

cross-account-model-registry-access, que dá acesso ao pacote de modelos configurado no cadastro de modelos na conta central: - Política 2 – Anexar AmazonSageMakerFullAccess, que é um política gerenciada pela AWS que concede acesso total ao SageMaker. Ele também fornece acesso selecionado a serviços relacionados, como Escalabilidade automática de aplicativos AWS, Amazon S3, Registro do Amazon Elastic Container (Amazon ECR) e Logs do Amazon CloudWatch.

- Política 3 – Anexar AWSLambda_FullAccess, que é uma política gerenciada pela AWS que concede acesso total ao Lambda, aos recursos do console do Lambda e a outros serviços relacionados da AWS.

- Política 4 – Use a seguinte política de confiança do IAM para a função do IAM:

Função de execução do SageMaker

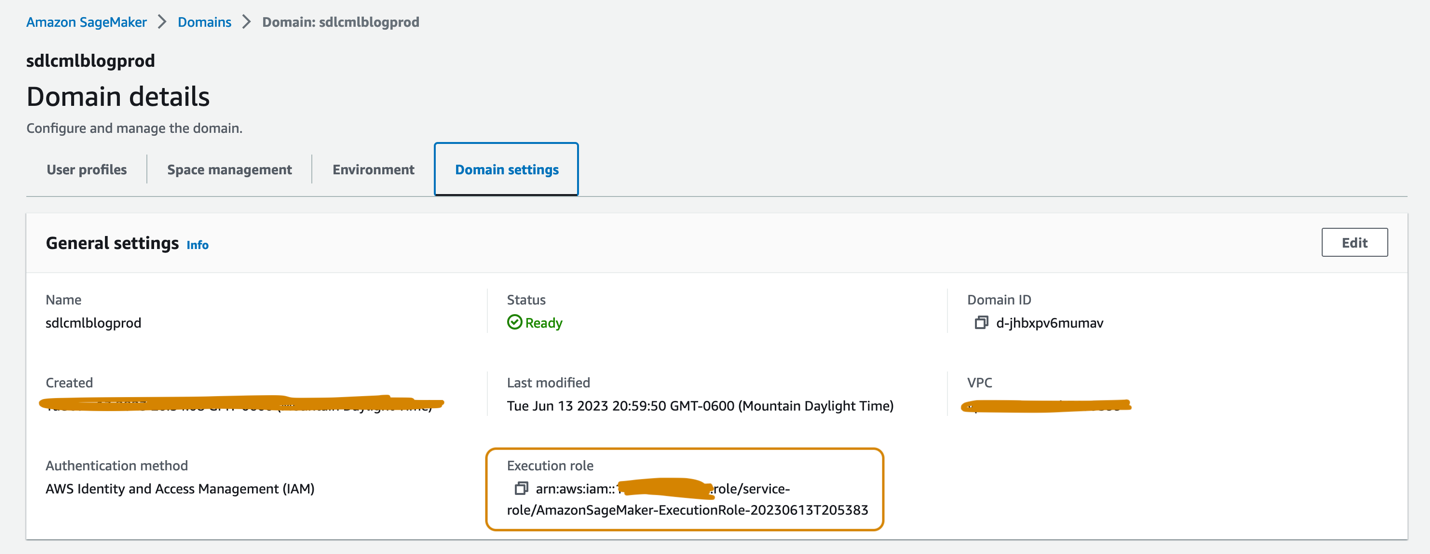

Os domínios do SageMaker Studio configurados nas contas dev e prod devem ter, cada um, uma função de execução associada, que pode ser encontrada na página Configurações de domínio guia na página de detalhes do domínio, conforme mostrado na captura de tela a seguir. Esta função é usada para executar trabalhos de treinamento, trabalhos de processamento e muito mais no domínio do SageMaker Studio.

Adicione as seguintes políticas à função de execução do SageMaker em ambas as contas:

- Política 1 – Crie uma política em linha chamada

cross-account-model-artifacts-s3-bucket-access, que dá acesso ao bucket S3 na conta central de registro do modelo, que armazena os artefatos do modelo: - Política 2 – Crie uma política em linha chamada

cross-account-model-registry-access, que dá acesso ao pacote de modelo no registro de modelo na conta central de registro de modelo: - Política 3 – Crie uma política em linha chamada

kms-key-access-policy, que dá acesso à chave KMS criada na etapa anterior. Forneça o ID da conta na qual a política está sendo criada e o ID da chave KMS criada nessa conta. - Política 4 – Anexar AmazonSageMakerFullAccess, que é um política gerenciada pela AWS que concede acesso total ao SageMaker e acesso selecionado a serviços relacionados.

- Política 5 – Anexar AWSLambda_FullAccess, que é uma política gerenciada pela AWS que concede acesso total ao Lambda, aos recursos do console do Lambda e a outros serviços relacionados da AWS.

- Política 6 – Anexar CloudWatchEventsFullAccess, que é uma política gerenciada pela AWS que concede acesso total ao CloudWatch Events.

- Política 7 – Adicione a seguinte política de confiança do IAM para a função do IAM de execução do SageMaker:

- Política 8 (específica para a função de execução do SageMaker na conta de produção) – Crie uma política em linha chamada

cross-account-kms-key-access-policy, que dá acesso à chave KMS criada na conta de desenvolvimento. Isso é necessário para que o pipeline de inferência leia artefatos de modelo armazenados na conta de registro de modelo central, onde os artefatos de modelo são criptografados usando a chave KMS da conta de desenvolvimento quando a primeira versão do modelo é criada a partir da conta de desenvolvimento.

Função do Jenkins entre contas

Configure uma função IAM chamada cross-account-jenkins-role na conta prod, que Jenkins assumirá para implantar pipelines de ML e infraestrutura correspondente na conta prod.

Adicione as seguintes políticas gerenciadas do IAM à função:

CloudWatchFullAccessAmazonS3FullAccessAmazonSNSFullAccessAmazonSageMakerFullAccessAmazonEventBridgeFullAccessAWSLambda_FullAccess

Atualize a relação de confiança na função para conceder permissões à conta da AWS que hospeda o servidor Jenkins:

Atualizar permissões na função IAM associada ao servidor Jenkins

Supondo que o Jenkins tenha sido configurado na AWS, atualize a função IAM associada ao Jenkins para adicionar as seguintes políticas, que darão ao Jenkins acesso para implantar os recursos na conta prod:

- Política 1 – Crie a seguinte política em linha chamada

assume-production-role-policy: - Política 2 – Anexe o

CloudWatchFullAccesspolítica de IAM gerenciada.

Configure o grupo de pacotes de modelo na conta central do registro de modelo

No domínio do SageMaker Studio na conta de registro de modelo central, crie um grupo de pacotes de modelo chamado mammo-severity-model-package usando o seguinte trecho de código (que você pode executar usando um notebook Jupyter):

Configurar o acesso ao pacote de modelo para funções do IAM nas contas dev e prod

Provisione acesso às funções de execução do SageMaker criadas nas contas dev e prod para que você possa registrar versões de modelo no pacote de modelo mammo-severity-model-package no registro modelo central de ambas as contas. No domínio do SageMaker Studio na conta de registro do modelo central, execute o seguinte código em um notebook Jupyter:

Configurar o Jenkins

Nesta seção, configuramos o Jenkins para criar os pipelines de ML e a infraestrutura Terraform correspondente na conta prod por meio do pipeline de CI/CD do Jenkins.

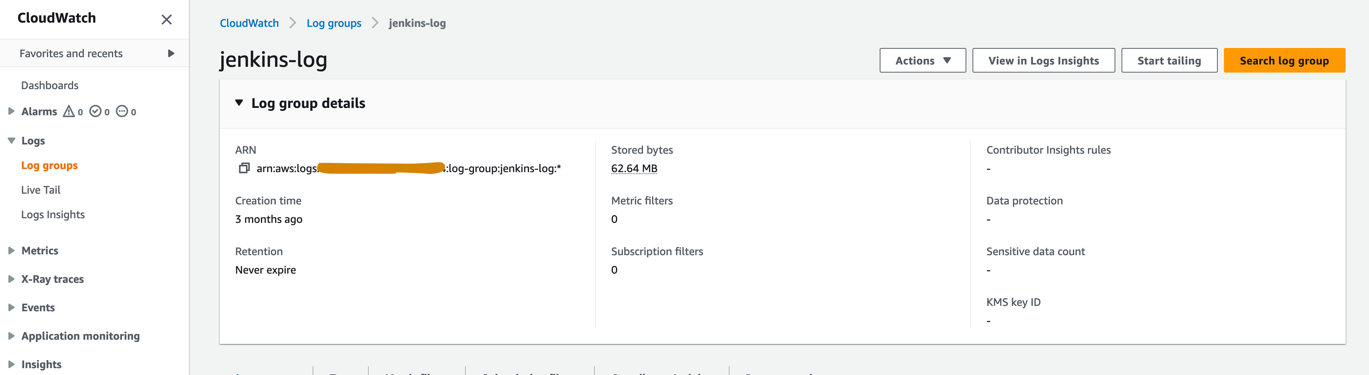

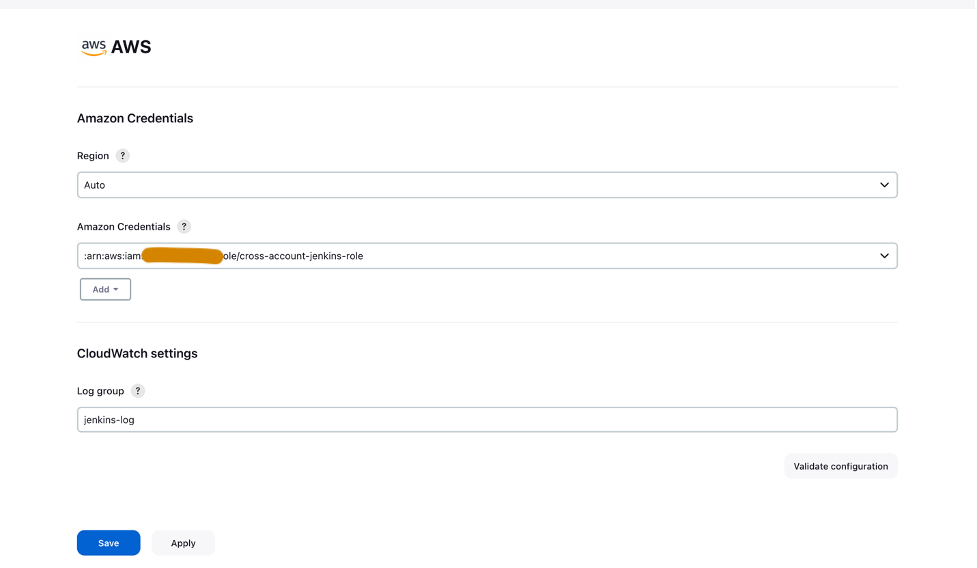

- No console do CloudWatch, crie um grupo de logs chamado

jenkins-logdentro da conta de produção para a qual Jenkins enviará os logs do pipeline de CI/CD. O grupo de logs deve ser criado na mesma região onde o servidor Jenkins está configurado.

- Instale os seguintes plug-ins no seu servidor Jenkins:

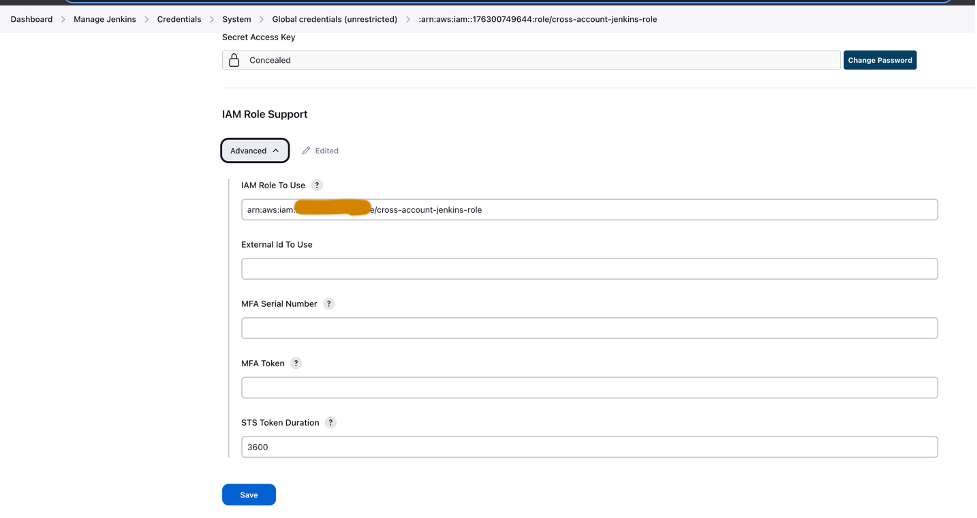

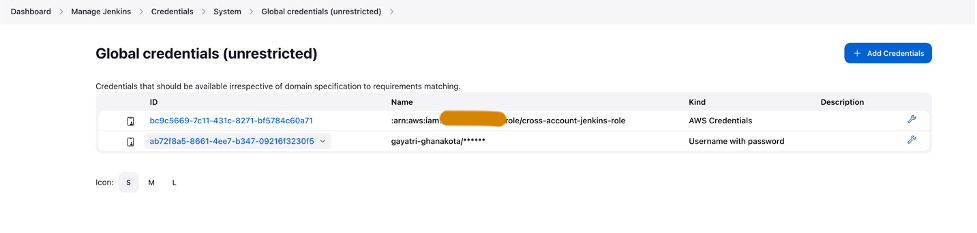

- Configure as credenciais da AWS no Jenkins usando a função IAM entre contas (

cross-account-jenkins-role) provisionado na conta de produção.

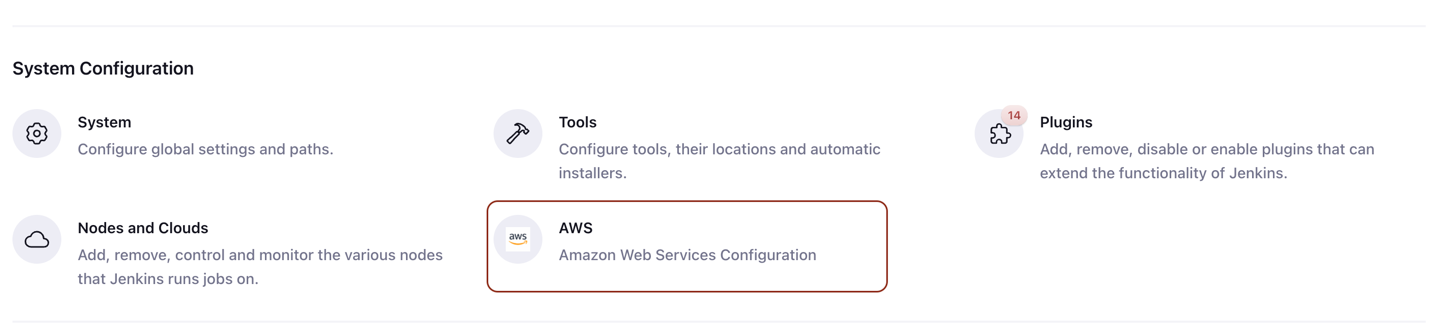

- Escolha Configuração do sistema, escolha AWS.

- Forneça as credenciais e o grupo de logs do CloudWatch que você criou anteriormente.

- Configure as credenciais do GitHub no Jenkins.

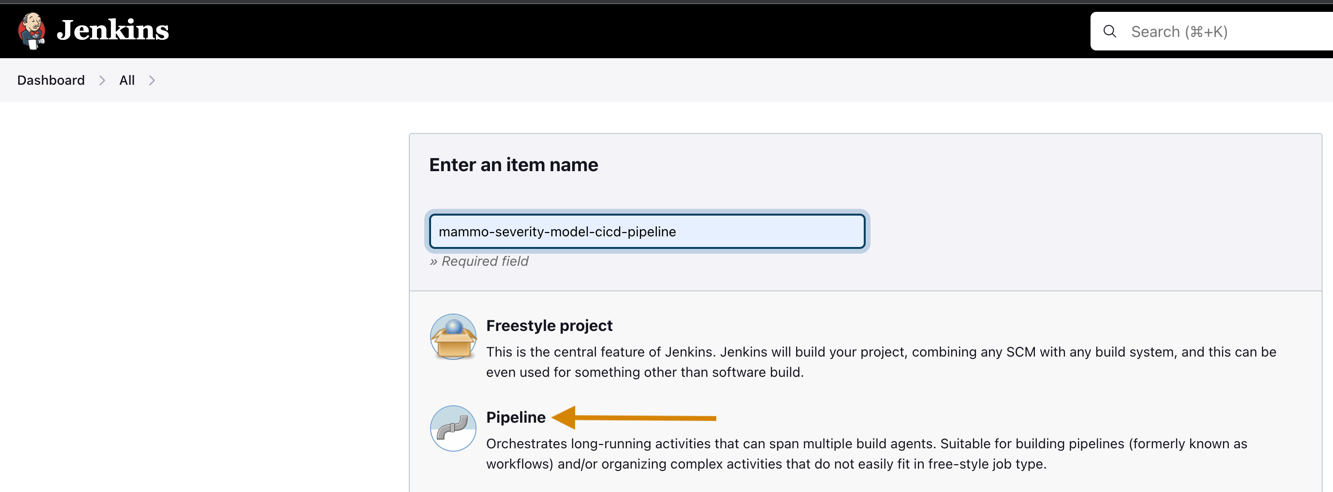

- Crie um novo projeto no Jenkins.

- Digite um nome de projeto e escolha Pipeline.

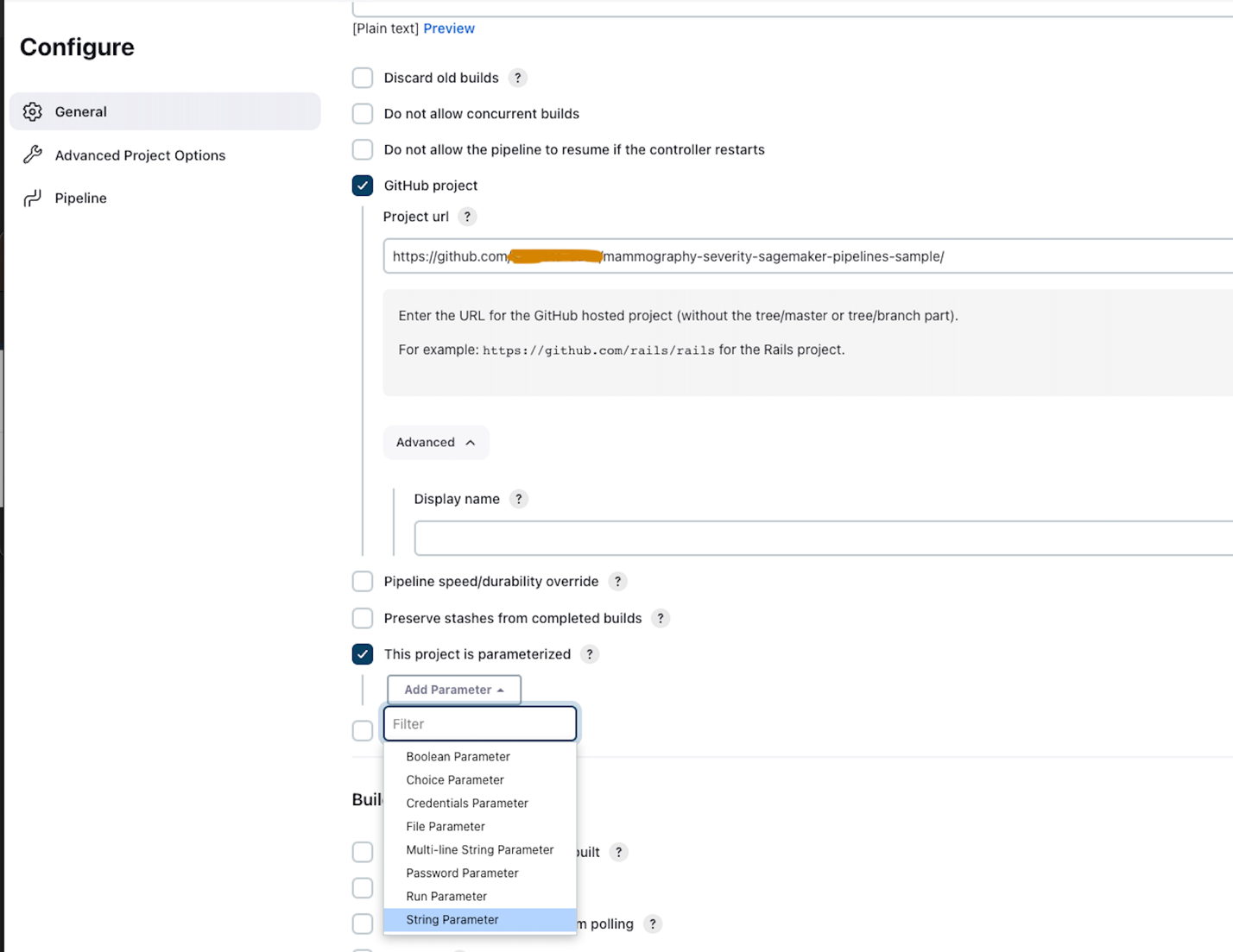

- No Geral guia, selecione Projeto GitHub e entre no bifurcado Repositório GitHub URL.

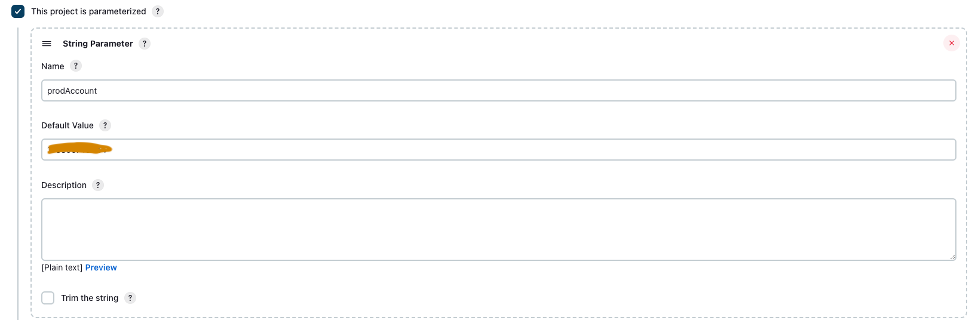

- Selecionar Este projeto é parametrizado.

- No Adicionar parâmetro menu, escolha Parâmetro de sequência.

- Escolha Nome, entrar

prodAccount. - Escolha Valor padrão, insira o ID da conta de produção.

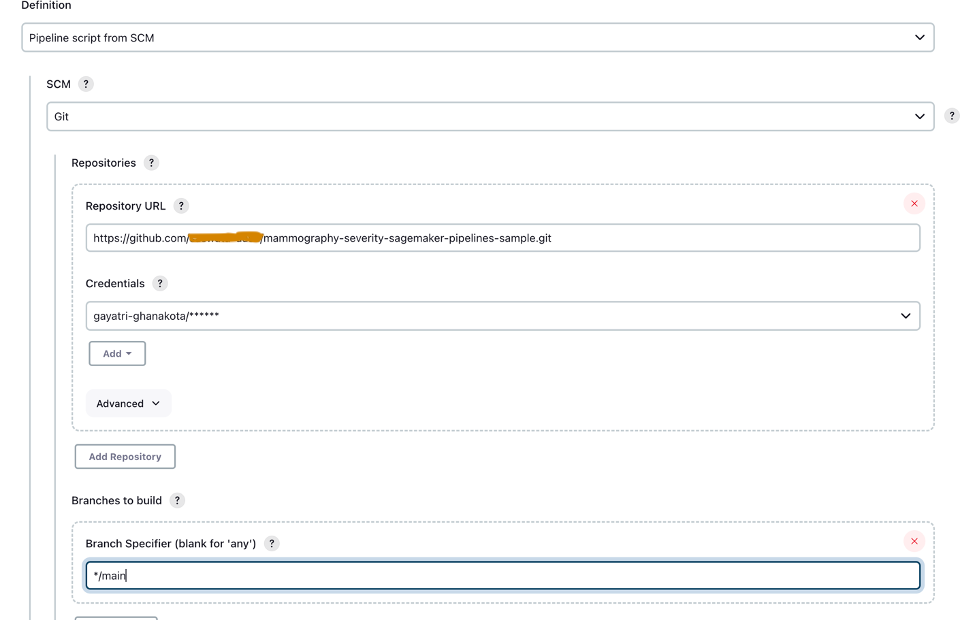

- Debaixo Opções avançadas de projeto, Por Definição, selecione Script de pipeline do SCM.

- Escolha SCM, escolha Git.

- Escolha URL do repositório, insira o bifurcado Repositório GitHub URL.

- Escolha Credenciais, insira as credenciais do GitHub salvas no Jenkins.

- Entrar

mainno Filiais para construir seção, com base na qual o pipeline de CI/CD será acionado.

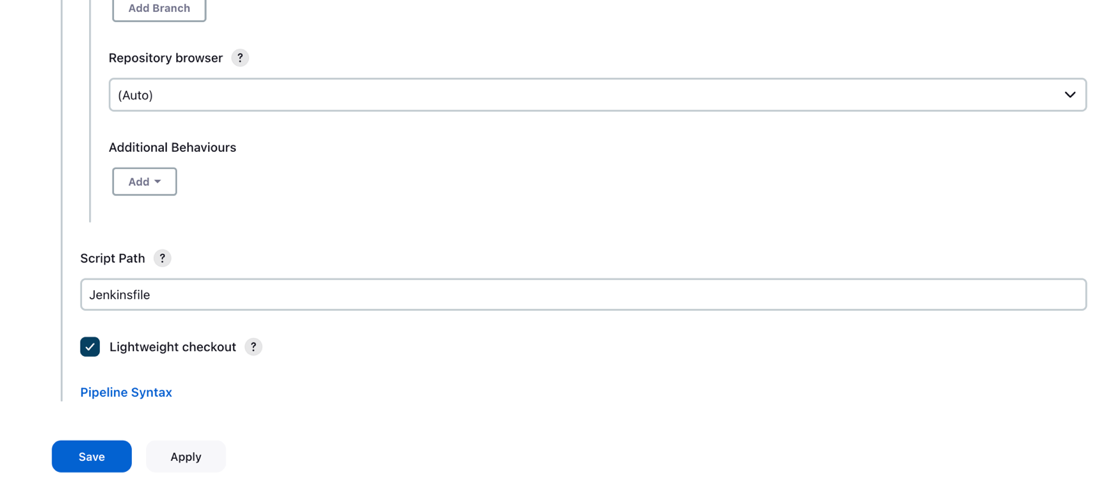

- Escolha Caminho do script, entrar

Jenkinsfile. - Escolha Salvar.

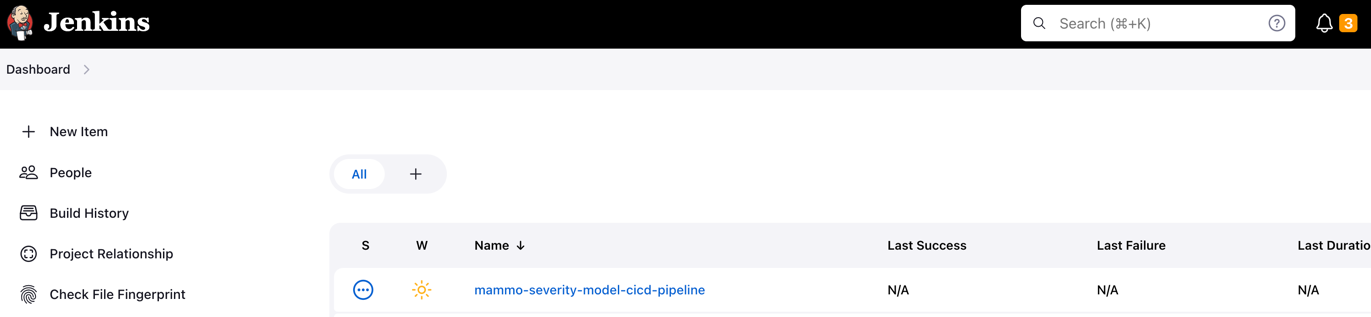

O pipeline Jenkins deve ser criado e visível em seu painel.

Provisione buckets S3, colete e prepare dados

Conclua as etapas a seguir para configurar seus buckets e dados do S3:

- Crie um bucket S3 de sua escolha com a string

sagemakerna convenção de nomenclatura como parte do nome do bucket nas contas dev e prod para armazenar conjuntos de dados e artefatos de modelo. - Configure um bucket S3 para manter o estado do Terraform na conta de produção.

- Baixe e salve o disponível publicamente Massa de Mamografia UCI conjunto de dados para o bucket S3 que você criou anteriormente na conta de desenvolvimento.

- Bifurque e clone o Repositório GitHub dentro do domínio SageMaker Studio na conta dev. O repositório possui a seguinte estrutura de pastas:

- /environments – Script de configuração para ambiente de produção

- /mlops-infra – Código para implantação de serviços AWS usando código Terraform

- /pipelines – Código para componentes de pipeline do SageMaker

- Arquivo Jenkins – Script para implantar através do pipeline Jenkins CI/CD

- setup.py – Necessário para instalar os módulos Python necessários e criar o comando run-pipeline

- modelagem de gravidade de mamografia.ipynb – Permite criar e executar o fluxo de trabalho de ML

- Crie uma pasta chamada data dentro da pasta clonada do repositório GitHub e salve uma cópia do arquivo disponível publicamente Massa de Mamografia UCI conjunto de dados.

- Siga o bloco de notas Jupyter

mammography-severity-modeling.ipynb. - Execute o código a seguir no notebook para pré-processar o conjunto de dados e carregá-lo no bucket S3 na conta de desenvolvimento:

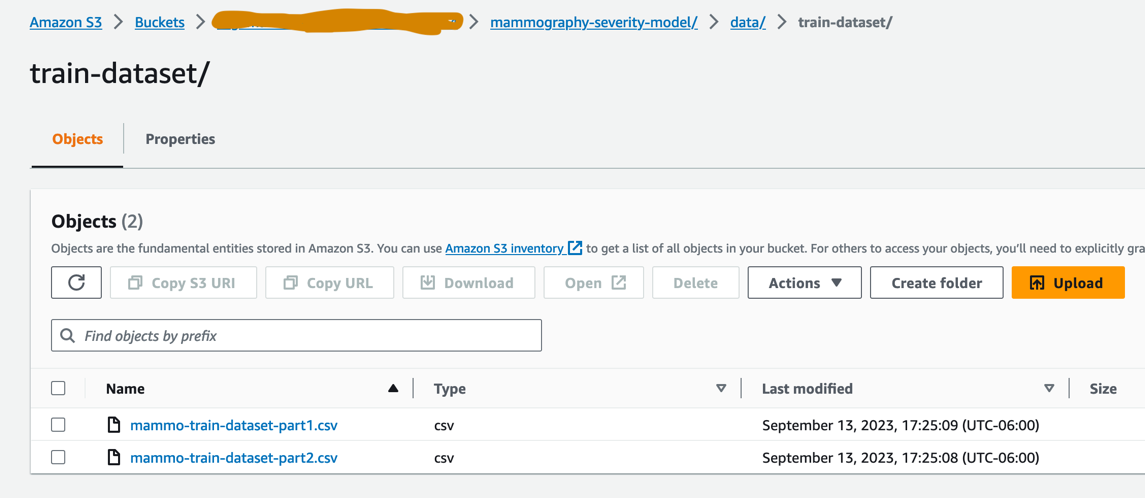

O código irá gerar os seguintes conjuntos de dados:

-

- dados/ mammo-train-dataset-part1.csv – Será utilizado para treinar a primeira versão do modelo.

- dados/ mammo-train-dataset-part2.csv – Será usado para treinar a segunda versão do modelo junto com o conjunto de dados mammo-train-dataset-part1.csv.

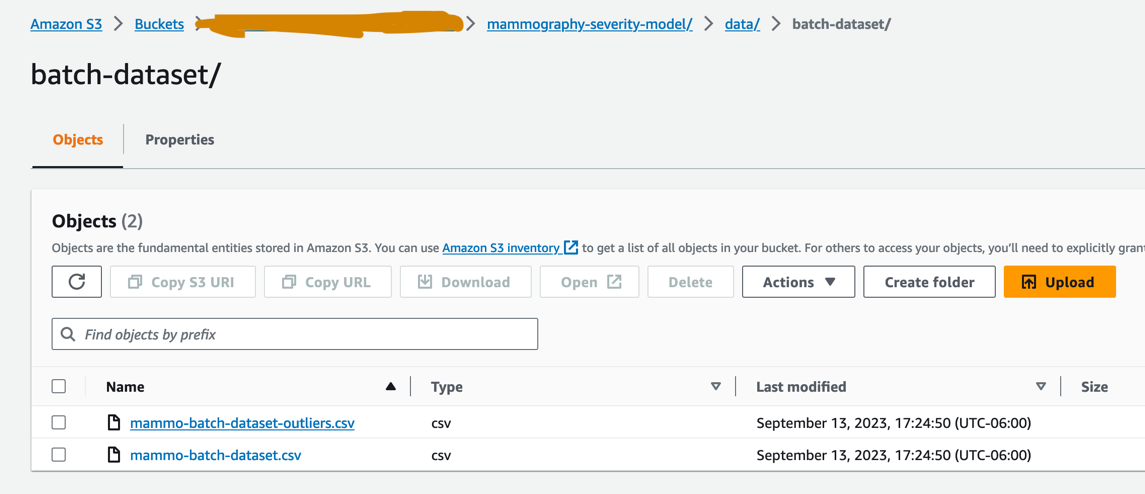

- dados/mammo-batch-dataset.csv – Será usado para gerar inferências.

- dados/mammo-batch-dataset-outliers.csv – Introduzirá valores discrepantes no conjunto de dados para falhar no pipeline de inferência. Isso nos permitirá testar o padrão para acionar o retreinamento automatizado do modelo.

- Carregar o conjunto de dados

mammo-train-dataset-part1.csvsob o prefixomammography-severity-model/train-datasete carregue os conjuntos de dadosmammo-batch-dataset.csvemammo-batch-dataset-outliers.csvpara o prefixomammography-severity-model/batch-datasetdo bucket S3 criado na conta dev: - Carregar os conjuntos de dados

mammo-train-dataset-part1.csvemammo-train-dataset-part2.csvsob o prefixomammography-severity-model/train-datasetno bucket S3 criado na conta prod por meio do console do Amazon S3.

- Carregar os conjuntos de dados

mammo-batch-dataset.csvemammo-batch-dataset-outliers.csvpara o prefixomammography-severity-model/batch-datasetdo bucket S3 na conta prod.

Execute o pipeline do trem

Debaixo <project-name>/pipelines/train, você pode ver os seguintes scripts Python:

- scripts/raw_preprocess.py – Integra-se com o SageMaker Processing para engenharia de recursos

- scripts/avaliar_model.py – Permite cálculo de métricas do modelo, neste caso

auc_score - train_pipeline.py – Contém o código para o pipeline de treinamento do modelo

Conclua as seguintes etapas:

- Faça upload dos scripts no Amazon S3:

- Obtenha a instância do pipeline de trem:

- Envie o pipeline do trem e execute-o:

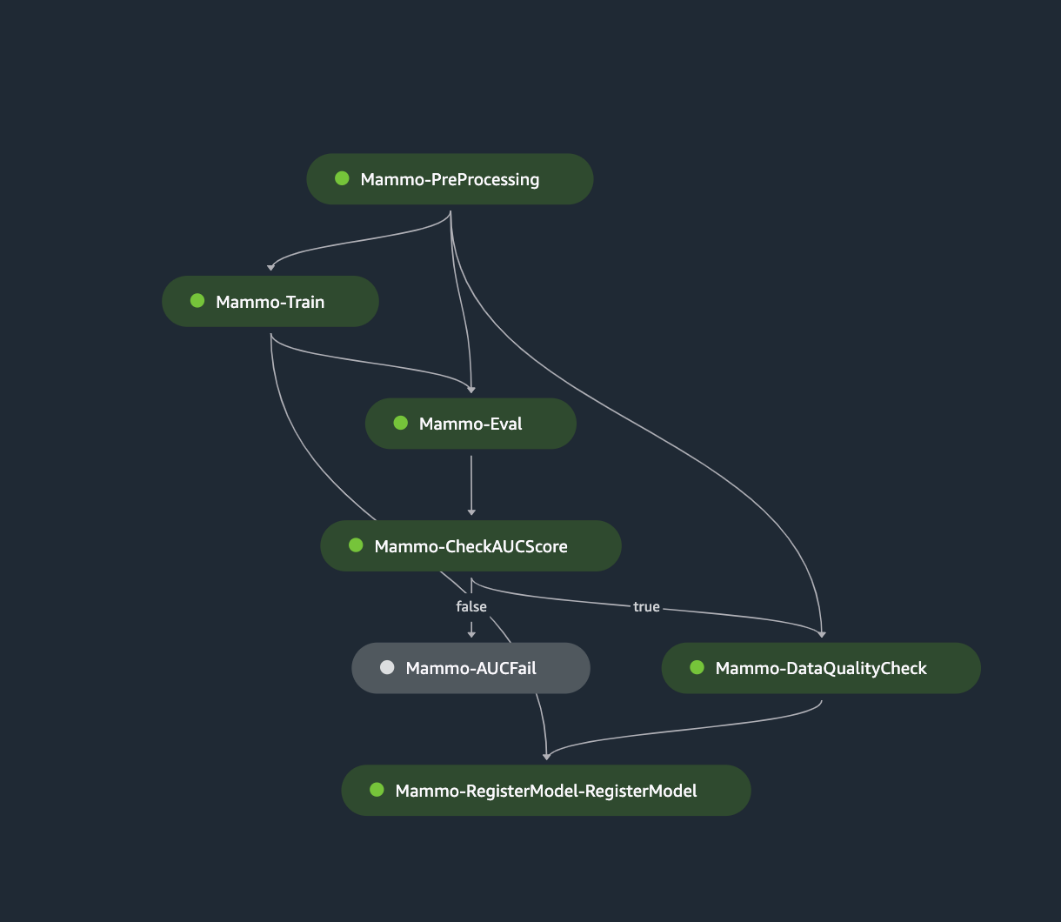

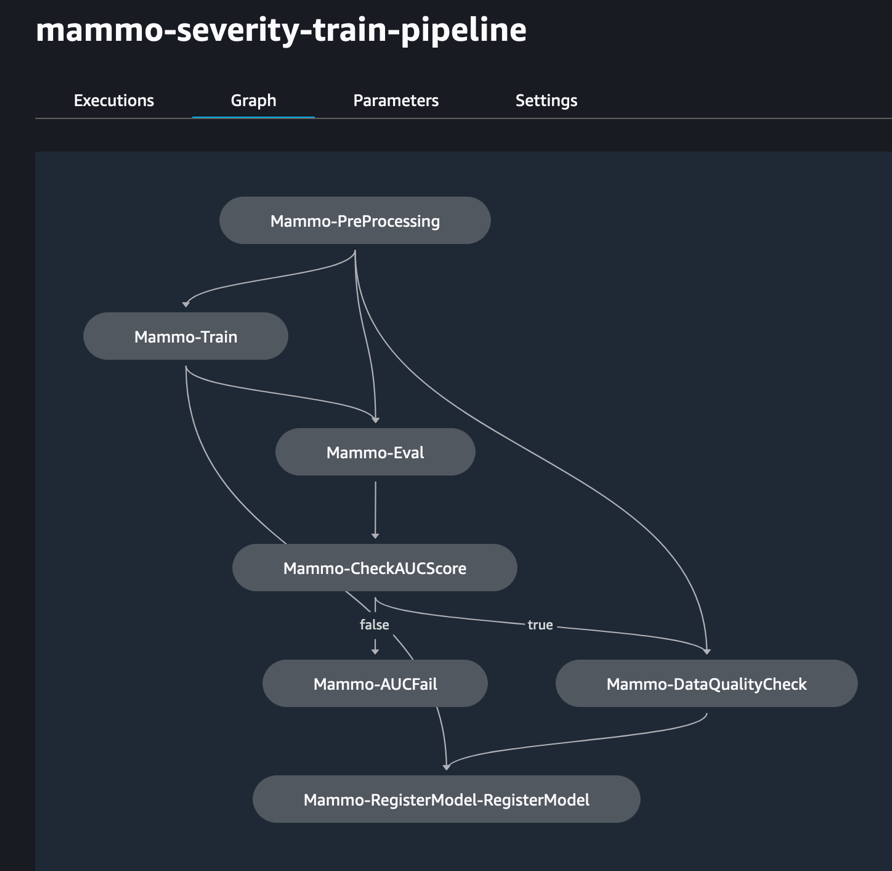

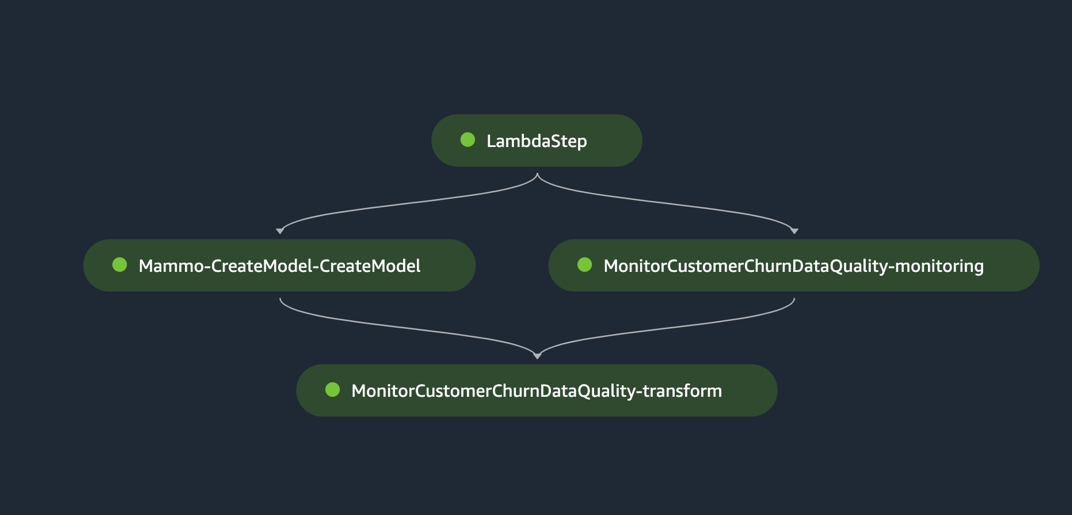

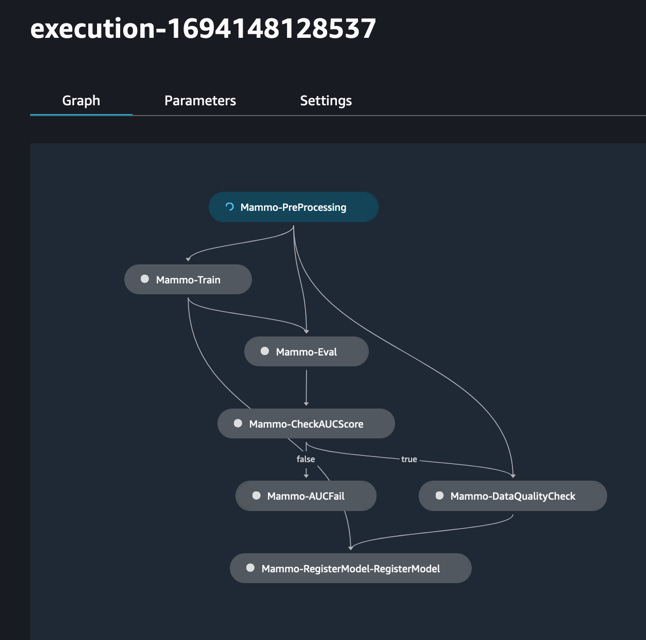

A figura a seguir mostra uma execução bem-sucedida do pipeline de treinamento. A etapa final do pipeline registra o modelo na conta central de registro de modelos.

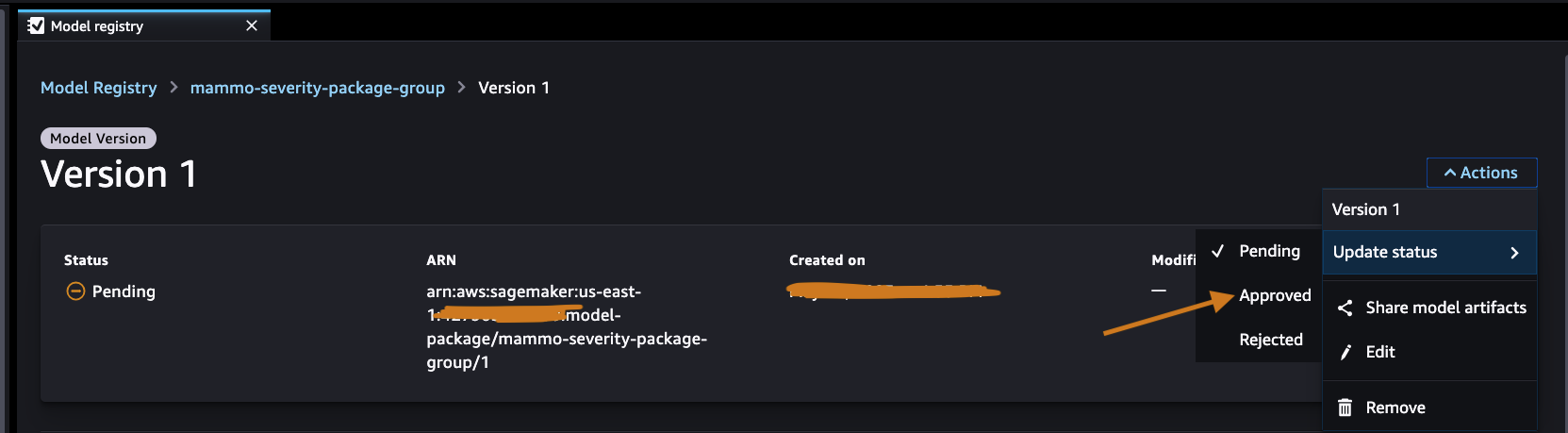

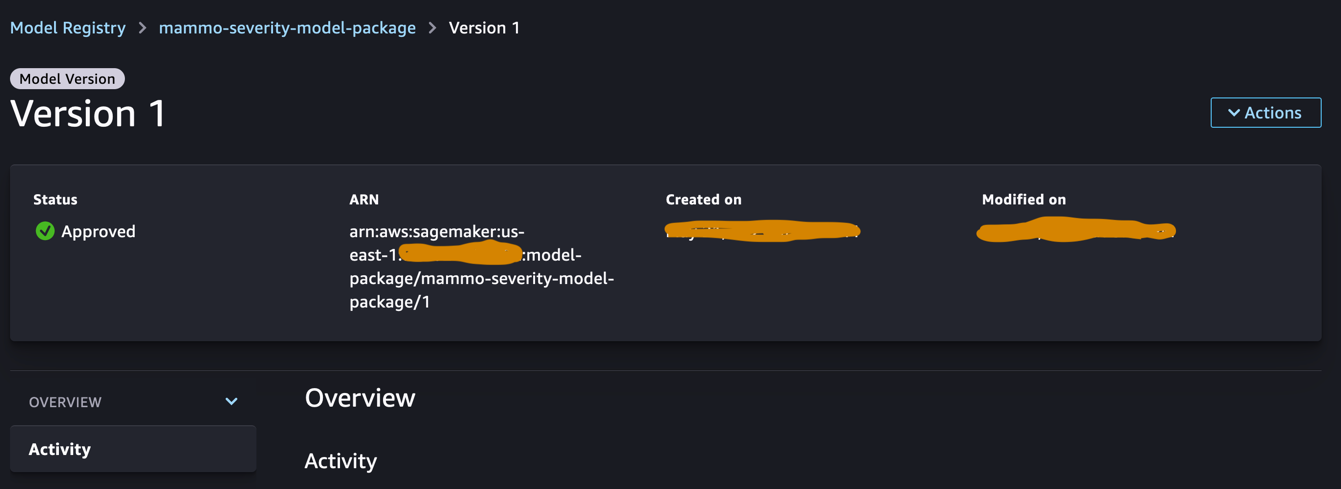

Aprovar o modelo no registro central de modelos

Faça login na conta de registro de modelo central e acesse o registro de modelo do SageMaker no domínio do SageMaker Studio. Altere o status da versão do modelo para Aprovado.

Depois de aprovado, o status deverá ser alterado na versão do modelo.

Execute o pipeline de inferência (opcional)

Esta etapa não é obrigatória, mas você ainda pode executar o pipeline de inferência para gerar previsões na conta de desenvolvimento.

Debaixo <project-name>/pipelines/inference, você pode ver os seguintes scripts Python:

- scripts/lambda_helper.py – Extrai a versão mais recente do modelo aprovado da conta de registro de modelo central usando uma etapa SageMaker Pipelines Lambda

- inference_pipeline.py – Contém o código para o pipeline de inferência do modelo

Conclua as seguintes etapas:

- Faça upload do script para o bucket S3:

- Obtenha a instância do pipeline de inferência usando o conjunto de dados em lote normal:

- Envie o pipeline de inferência e execute-o:

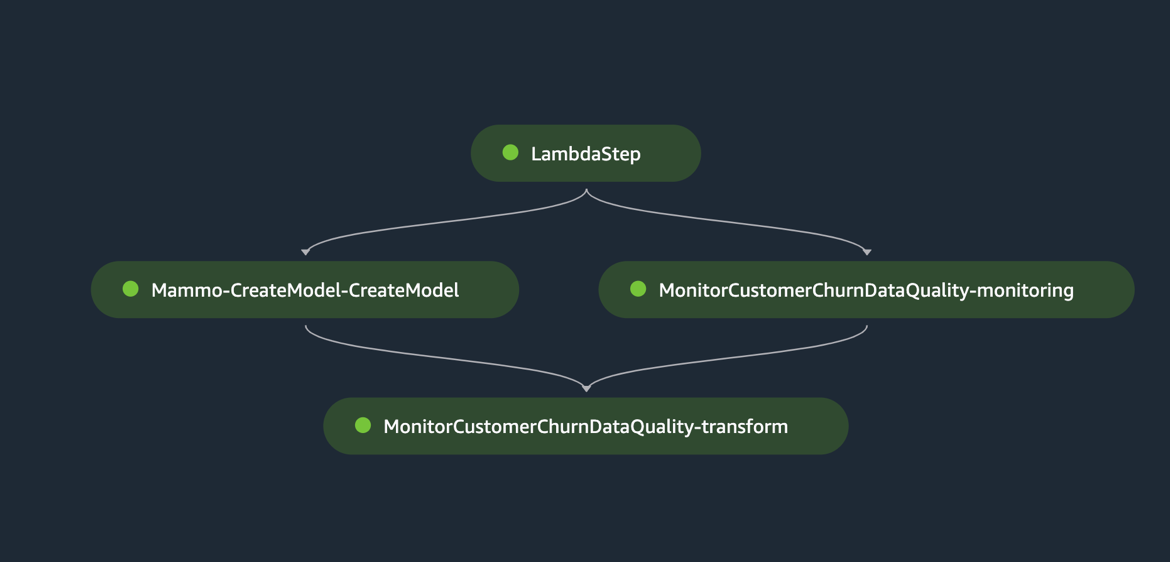

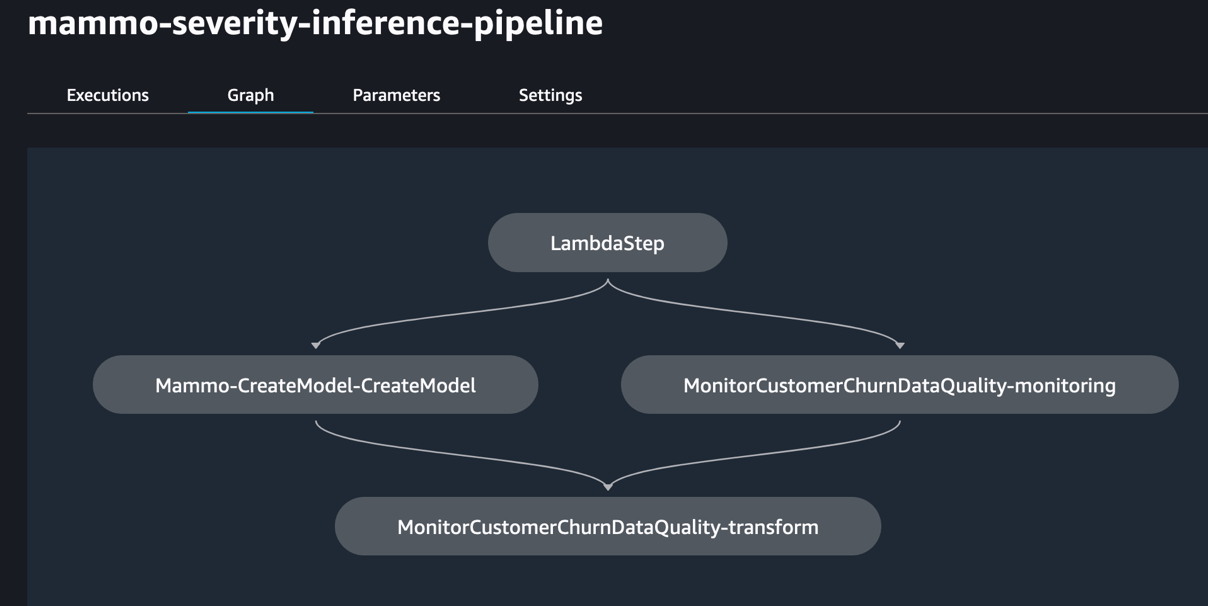

A figura a seguir mostra uma execução bem-sucedida do pipeline de inferência. A etapa final do pipeline gera as previsões e as armazena no bucket S3. Nós usamos MonitorBatchTransformStep para monitorar as entradas na tarefa de transformação em lote. Se houver algum valor discrepante, o pipeline de inferência entrará em estado de falha.

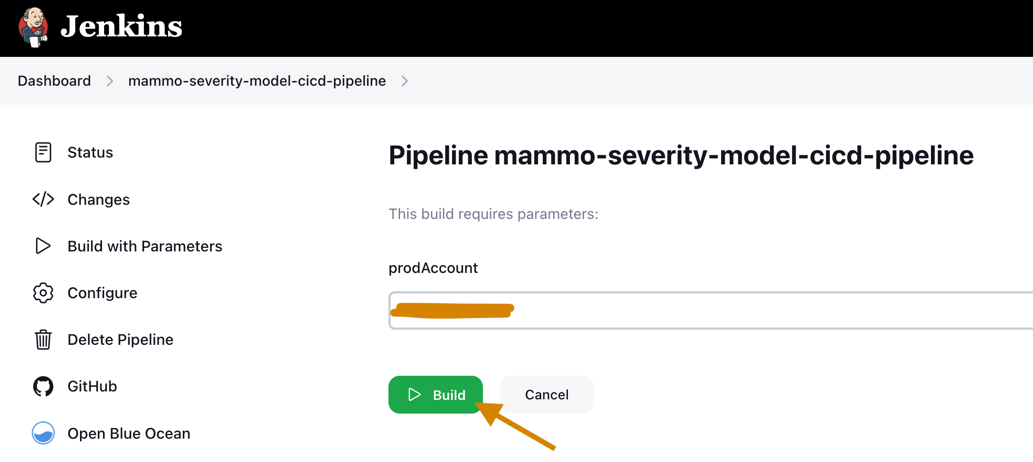

Execute o pipeline Jenkins

A environment/ pasta dentro do repositório GitHub contém o script de configuração para a conta prod. Conclua as etapas a seguir para acionar o pipeline do Jenkins:

- Atualize o script de configuração

prod.tfvars.jsoncom base nos recursos criados nas etapas anteriores: - Depois de atualizado, envie o código para o repositório GitHub bifurcado e mescle o código na ramificação principal.

- Vá para a IU do Jenkins, escolha Construir com parâmetrose acione o pipeline de CI/CD criado nas etapas anteriores.

Quando a construção for concluída e bem-sucedida, você poderá fazer login na conta prod e ver os pipelines de treinamento e inferência no domínio do SageMaker Studio.

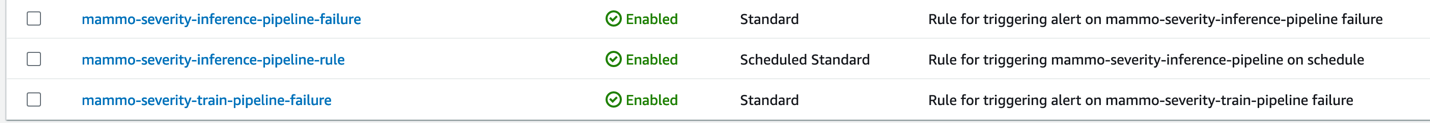

Além disso, você verá três regras do EventBridge no console do EventBridge na conta prod:

- Programe o pipeline de inferência

- Envie uma notificação de falha no pipeline do trem

- Quando o pipeline de inferência não aciona o pipeline de trem, envie uma notificação

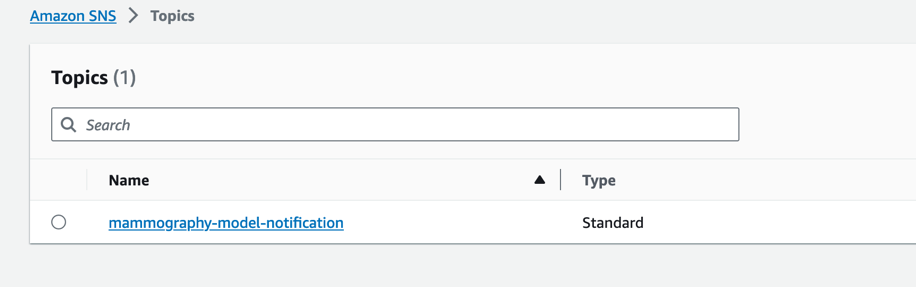

Por fim, você verá um tópico de notificação do SNS no console do Amazon SNS que envia notificações por email. Você receberá um e-mail solicitando a confirmação da aceitação desses e-mails de notificação.

Teste o pipeline de inferência usando um conjunto de dados em lote sem valores discrepantes

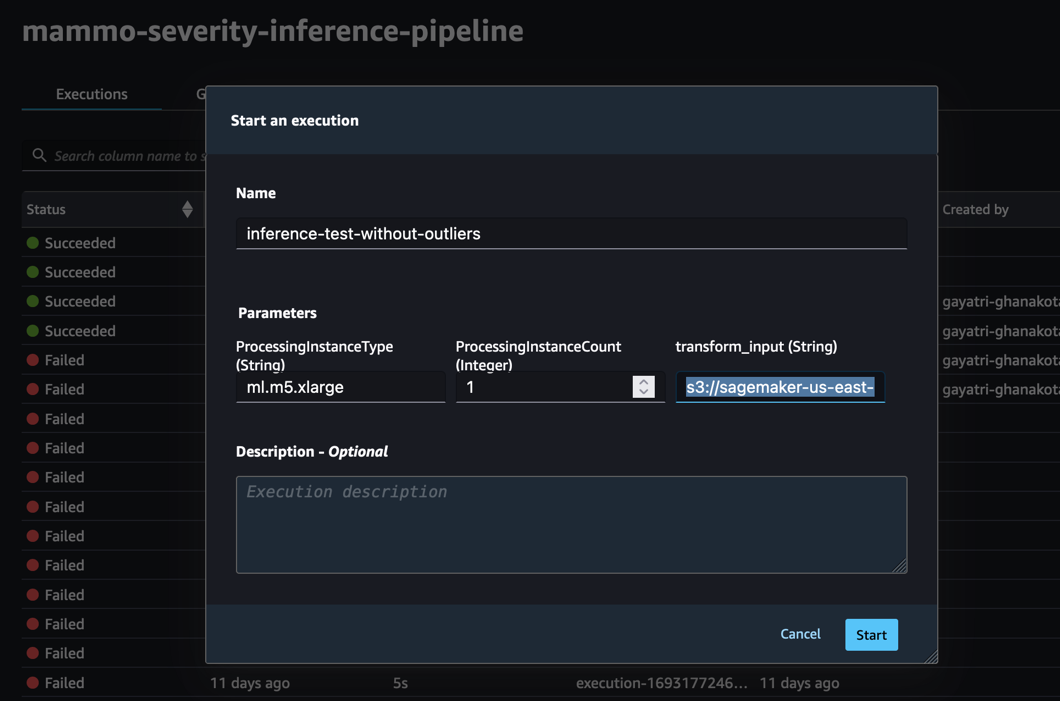

Para testar se o pipeline de inferência está funcionando conforme esperado na conta prod, podemos fazer login na conta prod e acionar o pipeline de inferência usando o conjunto de dados em lote sem valores discrepantes.

Execute o pipeline por meio do console do SageMaker Pipelines no domínio do SageMaker Studio da conta prod, onde o transform_input será o URI S3 do conjunto de dados sem valores discrepantes (s3://<s3-bucket-in-prod-account>/mammography-severity-model/data/mammo-batch-dataset.csv).

O pipeline de inferência é bem-sucedido e grava as previsões de volta no bucket S3.

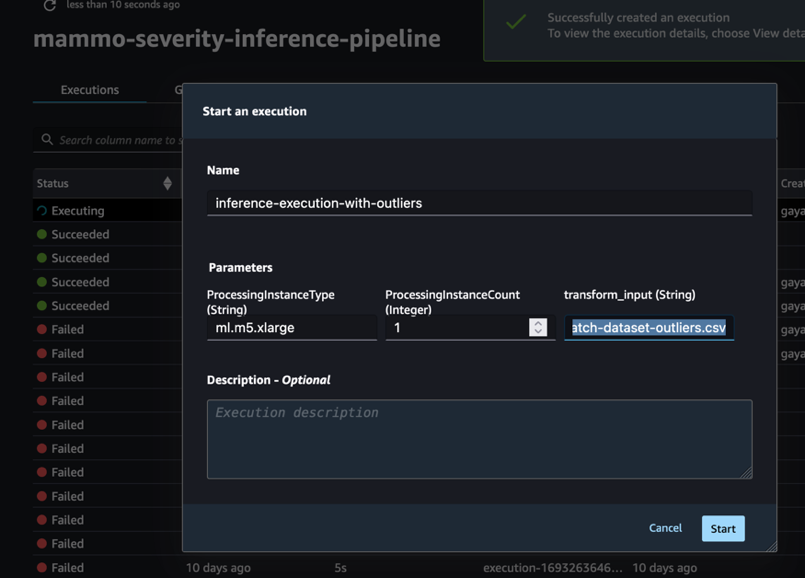

Teste o pipeline de inferência usando um conjunto de dados em lote com valores discrepantes

Você pode executar o pipeline de inferência usando o conjunto de dados em lote com valores discrepantes para verificar se o mecanismo de retreinamento automatizado funciona conforme o esperado.

Execute o pipeline por meio do console do SageMaker Pipelines no domínio do SageMaker Studio da conta prod, onde o transform_input será o URI S3 do conjunto de dados com valores discrepantes (s3://<s3-bucket-in-prod-account>/mammography-severity-model/data/mammo-batch-dataset-outliers.csv).

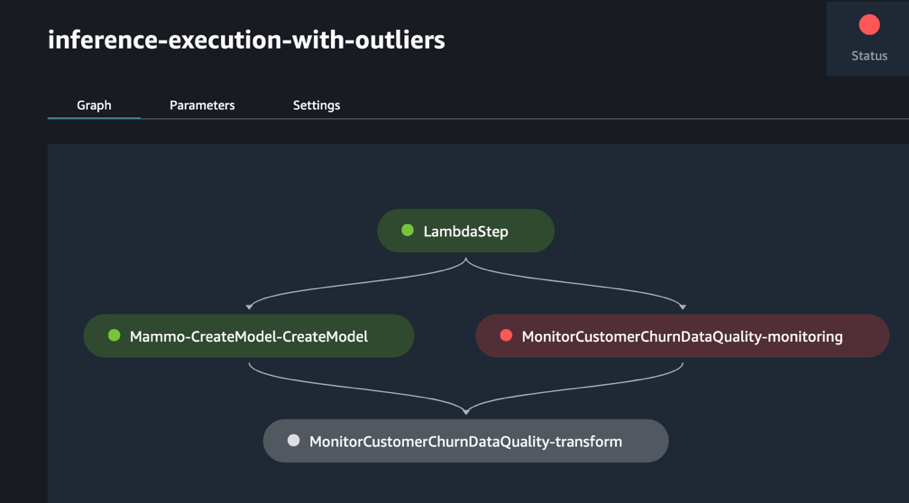

O pipeline de inferência falha conforme esperado, o que aciona a regra EventBridge, que por sua vez aciona o pipeline de trem.

Depois de alguns momentos, você deverá ver uma nova execução do pipeline do trem no console do SageMaker Pipelines, que coleta os dois conjuntos de dados de trem diferentes (mammo-train-dataset-part1.csv e mammo-train-dataset-part2.csv) carregado no bucket S3 para treinar novamente o modelo.

Você também verá uma notificação enviada para o e-mail inscrito no tópico SNS.

Para usar a versão atualizada do modelo, faça login na conta central de registro do modelo e aprove a versão do modelo, que será selecionada durante a próxima execução do pipeline de inferência acionado por meio da regra agendada do EventBridge.

Embora os pipelines de treinamento e inferência usem uma URL de conjunto de dados estático, você pode fazer com que a URL do conjunto de dados seja passada para os pipelines de treinamento e inferência como variáveis dinâmicas para usar conjuntos de dados atualizados para treinar novamente o modelo e gerar previsões em um cenário do mundo real.

limpar

Para evitar cobranças futuras, conclua as etapas a seguir:

- Remova o domínio SageMaker Studio em todas as contas AWS.

- Exclua todos os recursos criados fora do SageMaker, incluindo os buckets S3, funções IAM, regras do EventBridge e tópicos SNS configurados por meio do Terraform na conta de produção.

- Exclua os pipelines do SageMaker criados em contas usando o Interface de linha de comando da AWS (AWSCL).

Conclusão

Muitas vezes, as organizações precisam se alinhar com conjuntos de ferramentas de toda a empresa para permitir a colaboração entre diferentes áreas funcionais e equipes. Essa colaboração garante que sua plataforma MLOps possa se adaptar às necessidades de negócios em evolução e acelera a adoção de ML entre as equipes. Esta postagem explicou como criar uma estrutura MLOps em uma configuração de vários ambientes para permitir o retreinamento automatizado de modelos, inferência em lote e monitoramento com Amazon SageMaker Model Monitor, controle de versão de modelo com SageMaker Model Registry e promoção de código e pipelines de ML em ambientes com um Pipeline de CI/CD. Apresentamos esta solução usando uma combinação de serviços AWS e conjuntos de ferramentas de terceiros. Para obter instruções sobre como implementar esta solução, consulte o Repositório GitHub. Você também pode estender essa solução trazendo suas próprias fontes de dados e estruturas de modelagem.

Sobre os autores

Gayatri Ganakota é engenheiro sênior de aprendizado de máquina com AWS Professional Services. Ela é apaixonada por desenvolver, implantar e explicar soluções de IA/ML em vários domínios. Antes dessa função, ela liderou várias iniciativas como cientista de dados e engenheira de ML com as principais empresas globais no espaço financeiro e de varejo. Ela possui mestrado em Ciência da Computação com especialização em Ciência de Dados pela University of Colorado, Boulder.

Gayatri Ganakota é engenheiro sênior de aprendizado de máquina com AWS Professional Services. Ela é apaixonada por desenvolver, implantar e explicar soluções de IA/ML em vários domínios. Antes dessa função, ela liderou várias iniciativas como cientista de dados e engenheira de ML com as principais empresas globais no espaço financeiro e de varejo. Ela possui mestrado em Ciência da Computação com especialização em Ciência de Dados pela University of Colorado, Boulder.

Sunita Koppar é arquiteto sênior de Data Lake na AWS Professional Services. Ela é apaixonada por resolver os problemas dos clientes, processando big data e fornecendo soluções escaláveis de longo prazo. Antes dessa função, ela desenvolveu produtos nos domínios de internet, telecomunicações e automotivo e foi cliente da AWS. Ela possui mestrado em Ciência de Dados pela Universidade da Califórnia, Riverside.

Sunita Koppar é arquiteto sênior de Data Lake na AWS Professional Services. Ela é apaixonada por resolver os problemas dos clientes, processando big data e fornecendo soluções escaláveis de longo prazo. Antes dessa função, ela desenvolveu produtos nos domínios de internet, telecomunicações e automotivo e foi cliente da AWS. Ela possui mestrado em Ciência de Dados pela Universidade da Califórnia, Riverside.

Saswata Dash é consultor de DevOps da AWS Professional Services. Ela trabalhou com clientes nas áreas de saúde e ciências biológicas, aviação e manufatura. Ela é apaixonada por tudo relacionado à automação e tem ampla experiência em projetar e construir soluções para clientes em escala empresarial na AWS. Fora do trabalho, ela segue sua paixão pela fotografia e pelo nascer do sol.

Saswata Dash é consultor de DevOps da AWS Professional Services. Ela trabalhou com clientes nas áreas de saúde e ciências biológicas, aviação e manufatura. Ela é apaixonada por tudo relacionado à automação e tem ampla experiência em projetar e construir soluções para clientes em escala empresarial na AWS. Fora do trabalho, ela segue sua paixão pela fotografia e pelo nascer do sol.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/promote-pipelines-in-a-multi-environment-setup-using-amazon-sagemaker-model-registry-hashicorp-terraform-github-and-jenkins-ci-cd/

- :tem

- :é

- :não

- :onde

- $UP

- 1

- 10

- 100

- 12

- 13

- 14

- 16

- 17

- 19

- 23

- 27

- 31

- 320

- 7

- 8

- 9

- a

- Sobre

- acelera

- aceitação

- Acesso

- Conta

- Contas

- em

- Açao Social

- adaptar

- adicionar

- endereço

- administrativo

- Adoção

- Depois de

- idade

- AI

- alinhar

- Todos os Produtos

- permitir

- permite

- juntamente

- tb

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- an

- e

- Outro

- qualquer

- Aplicação

- apropriado

- aprovar

- aprovou

- arquitetura

- SOMOS

- áreas

- por aí

- artificial

- inteligência artificial

- Inteligência artificial (AI)

- AS

- pergunta

- associado

- assumir

- anexar

- auto

- Automatizado

- Automático

- Automação

- automotivo

- disponível

- aviação

- evitar

- AWS

- Cliente AWS

- Serviços Profissionais AWS

- em caminho duplo

- baseado

- base

- BE

- Porque

- sido

- antes

- ser

- MELHOR

- melhores práticas

- entre

- Grande

- Big Data

- ambos

- Ramo

- ponte

- Trazendo

- construir

- Prédio

- construído

- negócio

- mas a

- by

- Cálculo

- Califórnia

- chamado

- CAN

- casas

- central

- alterar

- mudado

- Alterações

- acusações

- verificar

- escolha

- Escolha

- código

- colaboração

- coletar

- Colorado

- Coluna

- colunas

- COM

- combinação

- completar

- compliance

- componentes

- compreensivo

- computador

- Ciência da Computação

- condição

- Configuração

- Confirmar

- cônsul

- consultor

- Recipiente

- contém

- ao controle

- Convenção

- converter

- Correspondente

- crio

- criado

- Criar

- Credenciais

- Atravessar

- cliente

- Soluções para clientes

- Clientes

- diariamente

- painel de instrumentos

- dados,

- lago data

- ciência de dados

- cientista de dados

- conjuntos de dados

- Descifrar

- Padrão

- Grau

- implantar

- Implantação

- desenvolvimento

- implanta

- concepção

- detalhes

- descobrir

- detectou

- Dev

- desenvolvido

- em desenvolvimento

- Desenvolvimento

- DICT

- diferente

- domínio

- domínios

- durante

- dinâmico

- cada

- Mais cedo

- efeito

- ou

- e-mails

- permitir

- criptografada

- engenheiro

- garante

- Entrar

- Meio Ambiente

- ambientes

- essencial

- eventos

- evolução

- execução

- esperado

- vasta experiência

- explicado

- explicando

- estender

- facilitar

- FALHA

- fracassado

- falha

- Falha

- Característica

- Funcionalidades

- poucos

- Figura

- Envie o

- final

- financeiro

- acabamento

- empresas

- Primeiro nome

- primeira vez

- seguinte

- Escolha

- encontrado

- Quadro

- enquadramentos

- da

- Cumprir

- cheio

- função

- funcional

- futuro

- lacuna

- gerar

- gerado

- gera

- ter

- Git

- GitHub

- OFERTE

- dado

- dá

- Global

- Go

- vai

- subsídios

- Grupo

- Ter

- saúde

- sua experiência

- superior

- detém

- hospedagem

- Como funciona o dobrador de carta de canal

- Como Negociar

- HTML

- http

- HTTPS

- ID

- Identidade

- if

- implementação

- importar

- in

- inclui

- Incluindo

- índice

- Infraestrutura

- inicialmente

- iniciativas

- inputs

- instalar

- instalado

- instância

- instruções

- Integra-se

- Inteligência

- Internet

- para dentro

- introduzir

- IT

- Trabalho

- Empregos

- jpg

- json

- Chave

- chaves

- O rótulo

- lago

- paisagem

- mais tarde

- mais recente

- aprendizagem

- levou

- alavancado

- vida

- Ciências da Vida

- Line

- log

- longo prazo

- máquina

- aprendizado de máquina

- a Principal

- a manter

- fazer

- gerenciados

- de grupos

- fabrica

- Margem

- Massa

- mestre

- mecanismo

- reunião

- Menu

- ir

- Métrica

- desaparecido

- ML

- MLOps

- modelo

- modelagem

- modelos

- modificar

- Módulos

- momentos

- Monitore

- monitorados

- monitoração

- mais

- múltiplo

- nome

- Nomeado

- nomeando

- Navegação

- você merece...

- necessário

- Cria

- Novo

- Próximo

- normal

- caderno

- notificação

- notificações

- número

- numpy

- of

- frequentemente

- on

- ONE

- Operações

- or

- ordem

- organizações

- Outros

- Fora

- lado de fora

- Acima de

- Visão geral

- próprio

- pacote

- página

- Dor

- pandas

- pão

- parte

- peças

- passou

- paixão

- apaixonado

- padrão

- atuação

- permissões

- fotografia

- escolhido

- Picks

- oleoduto

- plataforma

- platão

- Inteligência de Dados Platão

- PlatãoData

- pontos

- políticas

- Privacidade

- Publique

- práticas

- predizer

- Previsões

- Preparar

- pré-requisitos

- anterior

- Diretor

- Prévio

- privilégios

- processo

- em processamento

- Produção

- Produtos

- profissional

- projeto

- a promover

- Promovido

- promoção

- fornecer

- fornecido

- fornece

- fornecendo

- provisão

- publicamente

- Pullover

- Perseguições

- Empurrar

- Python

- rapidamente

- rapidamente

- Cru

- Leia

- pronto

- mundo real

- região

- cadastre-se

- registrado

- registradores

- registro

- reguladores

- relacionado

- relacionamento

- remover

- repositório

- solicitar

- requeridos

- Requisitos

- recurso

- Recursos

- resposta

- varejo

- retorno

- Ribeira

- Tipo

- papéis

- raiz

- Regra

- regras

- Execute

- é executado

- sábio

- Pipelines SageMaker

- mesmo

- Salvar

- salvo

- escalável

- cenário

- cronograma

- programado

- agendamento

- Ciência

- CIÊNCIAS

- Cientista

- escrita

- Scripts

- sem problemas

- Segundo

- Seção

- seguro

- segurança

- Vejo

- enviar

- envio

- envia

- enviei

- separado

- servidor

- serviço

- Serviços

- conjunto

- Configurações

- instalação

- Shape

- Partilhar

- ela

- rede de apoio social

- mostrar

- mostrada

- mostrando

- Shows

- simples

- fragmento

- So

- solução

- Soluções

- Resolvendo

- fonte

- Fontes

- Espaço

- especializado

- específico

- divisão

- Estado

- Declaração

- estático

- Status

- Passo

- Passos

- Ainda

- loja

- armazenadas

- lojas

- Tanga

- estrutura

- estudo

- bem sucedido

- tal

- suportes

- Target

- equipes

- telecom

- Terraform

- teste

- ensaio

- que

- A

- Eles

- então

- Lá.

- Este

- coisas

- Terceiro

- De terceiros

- isto

- três

- Através da

- tempo

- para

- conjuntos de ferramentas

- topo

- tópico

- pista

- Trem

- treinado

- Training

- Transformar

- desencadear

- desencadeado

- desencadeando

- verdadeiro

- Confiança

- VIRAR

- dois

- ui

- para

- universidade

- Universidade da Califórnia

- Atualizar

- Atualizada

- carregado

- URL

- us

- usar

- usava

- utilização

- utilidade

- Valores

- vário

- versão

- versões

- via

- Vídeo

- visível

- Assistir

- we

- web

- serviços web

- quando

- sempre que

- enquanto que

- qual

- enquanto

- precisarão

- de

- dentro

- sem

- Atividades:

- trabalhou

- de gestão de documentos

- trabalhar

- trabalho

- escrever

- escrito

- Vocês

- investimentos

- Youtube

- zefirnet