No cenário atual de interações individuais com os clientes para fazer pedidos, a prática predominante continua a depender de atendentes humanos, mesmo em ambientes como cafeterias drive-thru e estabelecimentos de fast-food. Esta abordagem tradicional apresenta vários desafios: depende fortemente de processos manuais, luta para escalar de forma eficiente com as crescentes demandas dos clientes, introduz o potencial para erros humanos e opera dentro de horas específicas de disponibilidade. Além disso, em mercados competitivos, as empresas que aderem apenas a processos manuais podem ter dificuldade em fornecer serviços eficientes e competitivos. Apesar dos avanços tecnológicos, o modelo centrado no ser humano permanece profundamente enraizado no processamento de pedidos, levando a estas limitações.

A perspectiva de utilizar tecnologia para assistência individual no processamento de pedidos já está disponível há algum tempo. No entanto, as soluções existentes podem muitas vezes enquadrar-se em duas categorias: sistemas baseados em regras que exigem tempo e esforço substanciais para configuração e manutenção, ou sistemas rígidos que carecem da flexibilidade necessária para interações humanas com os clientes. Como resultado, as empresas e organizações enfrentam desafios na implementação rápida e eficiente de tais soluções. Felizmente, com o advento IA generativa e modelos de linguagem grande (LLMs), agora é possível criar sistemas automatizados que possam lidar com a linguagem natural de forma eficiente e com um cronograma de aceleração acelerado.

Rocha Amazônica é um serviço totalmente gerenciado que oferece uma escolha de modelos básicos (FMs) de alto desempenho de empresas líderes de IA como AI21 Labs, Anthropic, Cohere, Meta, Stability AI e Amazon por meio de uma única API, juntamente com um amplo conjunto de recursos que você pode usar. necessidade de construir aplicações generativas de IA com segurança, privacidade e IA responsável. Além do Amazon Bedrock, você pode usar outros serviços AWS como JumpStart do Amazon SageMaker e Amazon-Lex para criar agentes de processamento de pedidos de IA generativos totalmente automatizados e facilmente adaptáveis.

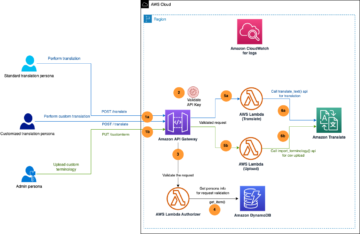

Nesta postagem, mostramos como criar um agente de processamento de pedidos com capacidade de fala usando Amazon Lex, Amazon Bedrock e AWS Lambda.

Visão geral da solução

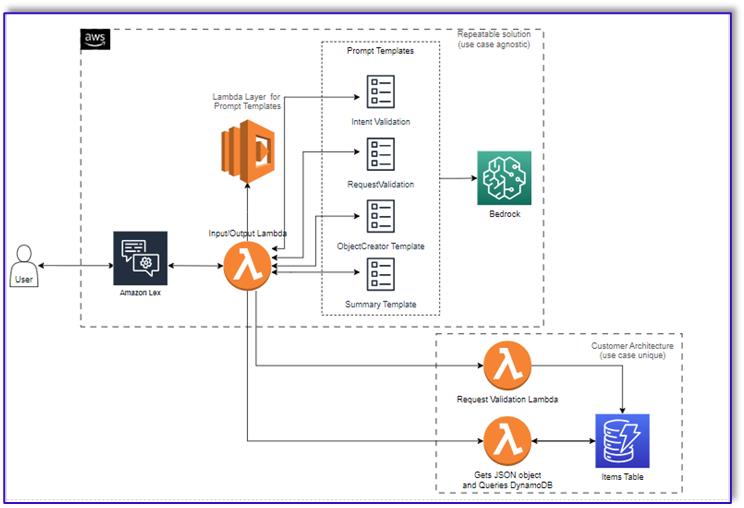

O diagrama a seguir ilustra nossa arquitetura de solução.

O fluxo de trabalho consiste nas seguintes etapas:

- Um cliente faz o pedido usando o Amazon Lex.

- O bot do Amazon Lex interpreta as intenções do cliente e aciona um

DialogCodeHook. - Uma função Lambda extrai o modelo de prompt apropriado da camada Lambda e formata os prompts do modelo adicionando a entrada do cliente no modelo de prompt associado.

- A

RequestValidationO prompt verifica o pedido com o item de menu e informa ao cliente, por meio do Amazon Lex, se há algo que ele deseja pedir que não faz parte do menu e fornecerá recomendações. O prompt também realiza uma validação preliminar da conclusão do pedido. - A

ObjectCreatorprompt converte as solicitações de linguagem natural em uma estrutura de dados (formato JSON). - A função Lambda validadora do cliente verifica os atributos necessários para o pedido e confirma se todas as informações necessárias estão presentes para processar o pedido.

- Uma função Lambda do cliente usa a estrutura de dados como entrada para processar o pedido e passa o total do pedido de volta para a função Lambda de orquestração.

- A função de orquestração do Lambda chama o endpoint do Amazon Bedrock LLM para gerar um resumo final do pedido, incluindo o total do pedido do sistema de banco de dados do cliente (por exemplo, Amazon DynamoDB).

- O resumo do pedido é comunicado ao cliente por meio do Amazon Lex. Após o cliente confirmar o pedido, o pedido será processado.

Pré-requisitos

Esta postagem pressupõe que você tenha uma conta AWS ativa e familiaridade com os seguintes conceitos e serviços:

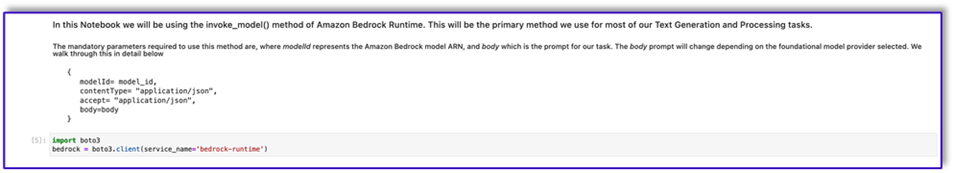

Além disso, para acessar o Amazon Bedrock a partir das funções do Lambda, você precisa garantir que o tempo de execução do Lambda tenha as seguintes bibliotecas:

- boto3>=1.28.57

- awscli>=1.29.57

- botocore>=1.31.57

Isso pode ser feito com um camada lambda ou usando uma AMI específica com as bibliotecas necessárias.

Além disso, essas bibliotecas são necessárias ao chamar a API Amazon Bedrock de Estúdio Amazon SageMaker. Isso pode ser feito executando uma célula com o seguinte código:

Por fim, você cria a seguinte política e posteriormente a anexa a qualquer função que acessa o Amazon Bedrock:

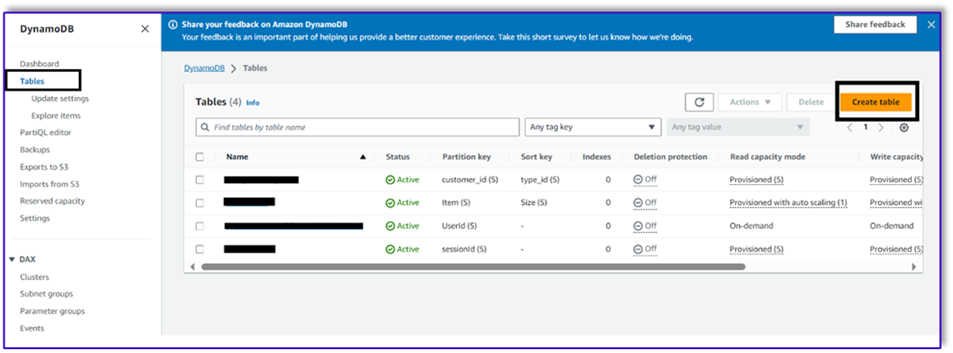

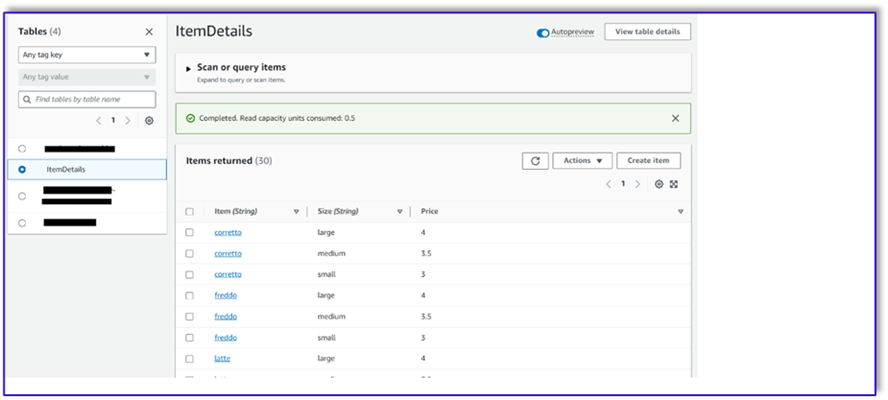

Crie uma tabela DynamoDB

Em nosso cenário específico, criamos uma tabela DynamoDB como nosso sistema de banco de dados de clientes, mas você também pode usar Serviço de banco de dados relacional da Amazon (Amazon RDS). Conclua as etapas a seguir para provisionar sua tabela do DynamoDB (ou personalize as configurações conforme necessário para seu caso de uso):

- No console do DynamoDB, escolha Tabelas no painel de navegação.

- Escolha Criar tabela.

- Escolha Nome da mesa, insira um nome (por exemplo,

ItemDetails). - Escolha Chave de partição, insira uma chave (para esta postagem, usamos

Item). - Escolha Chave de classificação, insira uma chave (para esta postagem, usamos

Size). - Escolha Criar tabela.

Agora você pode carregar os dados na tabela do DynamoDB. Para esta postagem, usamos um arquivo CSV. Você pode carregar os dados na tabela DynamoDB usando código Python em um notebook SageMaker.

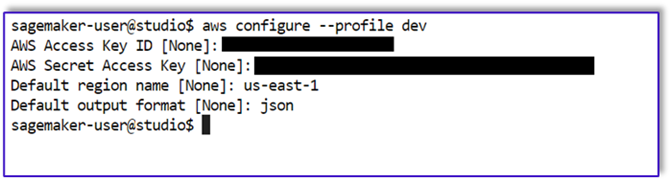

Primeiro, precisamos configurar um perfil chamado dev.

- Abra um novo terminal no SageMaker Studio e execute o seguinte comando:

Este comando solicitará que você insira o ID da chave de acesso da AWS, a chave de acesso secreta, a região padrão da AWS e o formato de saída.

- Retorne ao notebook SageMaker e escreva um código Python para configurar uma conexão com o DynamoDB usando a biblioteca Boto3 em Python. Este snippet de código cria uma sessão usando um perfil específico da AWS chamado dev e, em seguida, cria um cliente DynamoDB usando essa sessão. A seguir está o exemplo de código para carregar os dados:

Alternativamente, você pode usar Bancada de trabalho NoSQL ou outras ferramentas para carregar rapidamente os dados em sua tabela do DynamoDB.

A seguir está uma captura de tela após os dados de amostra serem inseridos na tabela.

Crie modelos em um notebook SageMaker usando a API de invocação do Amazon Bedrock

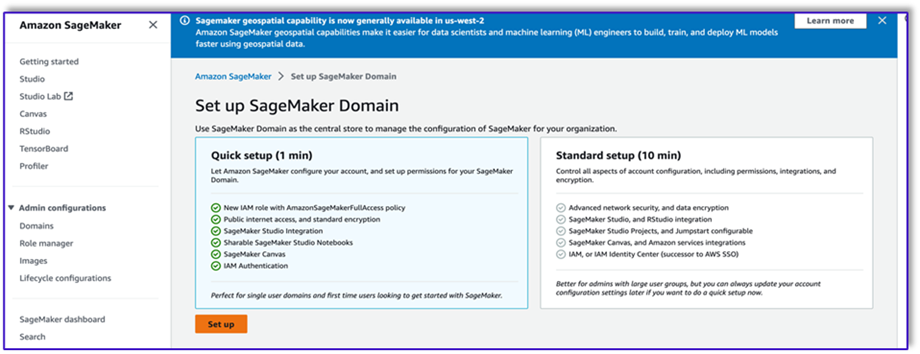

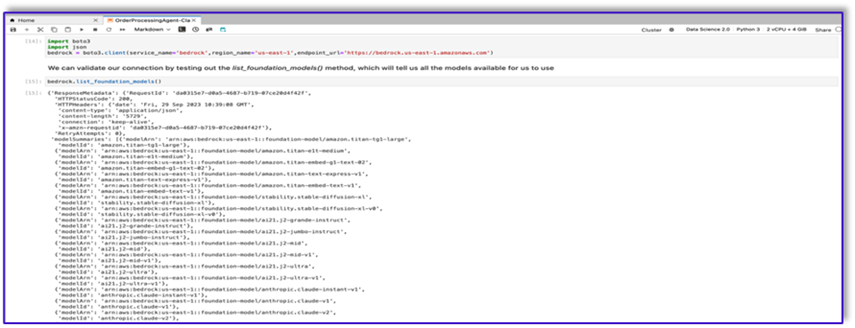

Para criar nosso modelo de prompt para este caso de uso, usamos Amazon Bedrock. Você pode acessar o Amazon Bedrock no Console de gerenciamento da AWS e por meio de invocações de API. Em nosso caso, acessamos o Amazon Bedrock via API a partir da conveniência de um notebook SageMaker Studio para criar não apenas nosso modelo de prompt, mas nosso código completo de invocação de API que podemos usar posteriormente em nossa função Lambda.

- No console do SageMaker, acesse um domínio existente do SageMaker Studio ou crie um novo para acessar o Amazon Bedrock a partir de um notebook SageMaker.

- Depois de criar o domínio e o usuário do SageMaker, escolha o usuário e escolha Apresentação livro e Studio. Isso abrirá um ambiente JupyterLab.

- Quando o ambiente JupyterLab estiver pronto, abra um novo notebook e comece a importar as bibliotecas necessárias.

Existem muitos FMs disponíveis por meio do Amazon Bedrock Python SDK. Neste caso, usamos Claude V2, um poderoso modelo fundamental desenvolvido pela Anthropic.

O agente de processamento de pedidos precisa de alguns modelos diferentes. Isso pode mudar dependendo do caso de uso, mas criamos um fluxo de trabalho geral que pode ser aplicado a diversas configurações. Para este caso de uso, o modelo Amazon Bedrock LLM realizará o seguinte:

- Valide a intenção do cliente

- Valide a solicitação

- Crie a estrutura de dados do pedido

- Passe um resumo do pedido ao cliente

- Para invocar o modelo, crie um objeto bedrock-runtime do Boto3.

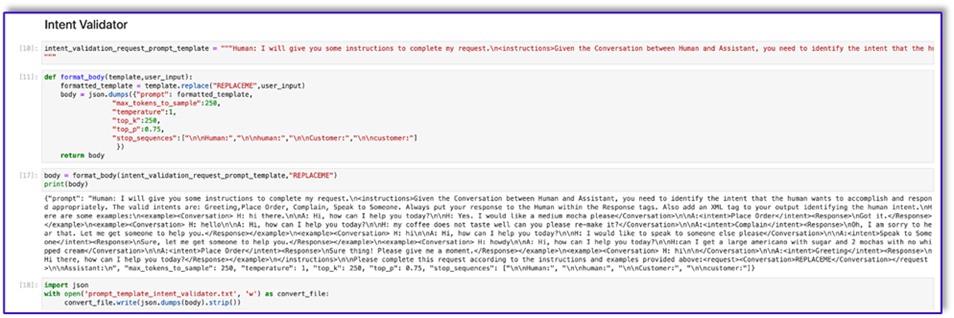

Vamos começar trabalhando no modelo de prompt do validador de intent. Este é um processo iterativo, mas graças ao guia de engenharia de prompt da Anthropic, você pode criar rapidamente um prompt que pode realizar a tarefa.

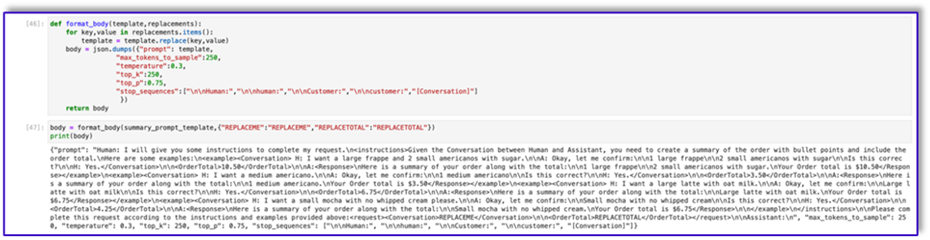

- Crie o primeiro modelo de prompt junto com uma função utilitária que ajudará a preparar o corpo para as invocações da API.

A seguir está o código para prompt_template_intent_validator.txt:

- Salve este modelo em um arquivo para fazer upload no Amazon S3 e chamar a partir da função Lambda quando necessário. Salve os modelos como strings serializadas JSON em um arquivo de texto. A captura de tela anterior mostra o exemplo de código para fazer isso também.

- Repita os mesmos passos com os outros modelos.

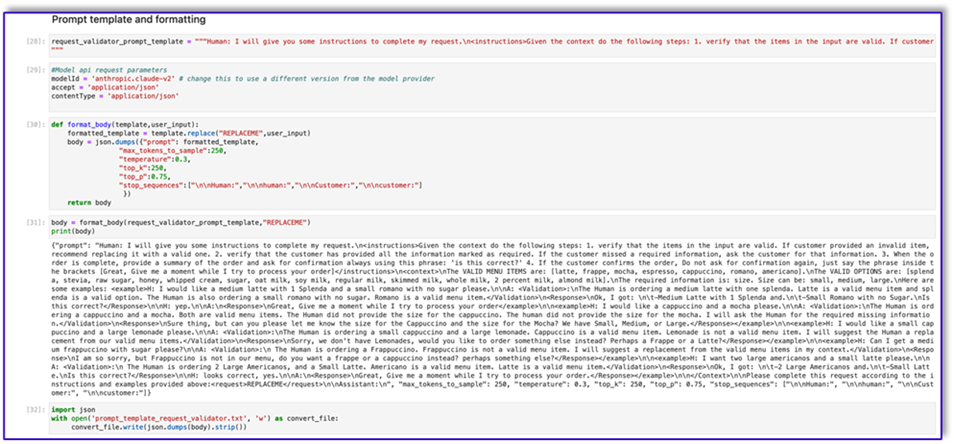

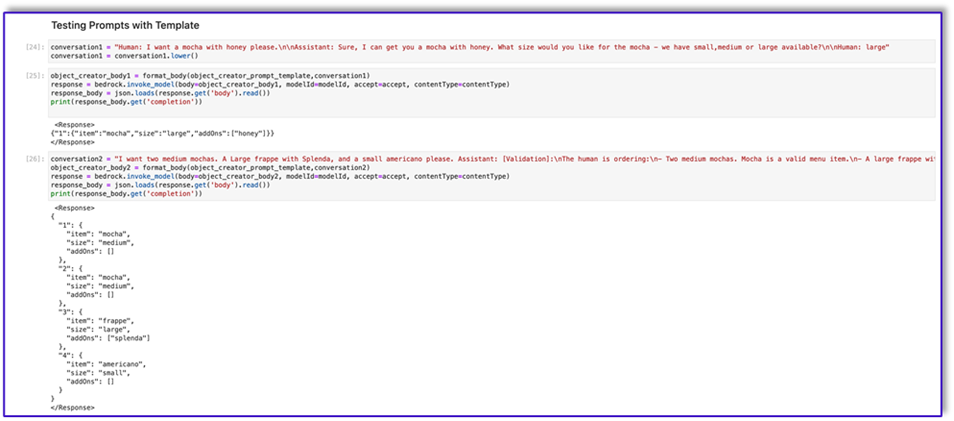

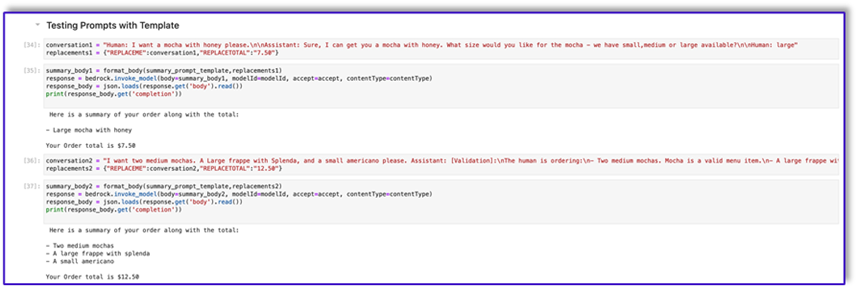

A seguir estão algumas capturas de tela dos outros modelos e os resultados ao chamar o Amazon Bedrock com alguns deles.

A seguir está o código para prompt_template_request_validator.txt:

A seguir está nossa resposta do Amazon Bedrock usando este modelo.

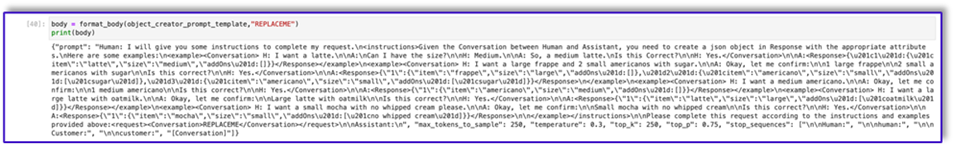

Segue o código para prompt_template_object_creator.txt:

A seguir está o código para prompt_template_order_summary.txt:

Como você pode ver, usamos nossos modelos de prompt para validar itens de menu, identificar informações necessárias ausentes, criar uma estrutura de dados e resumir o pedido. Os modelos básicos disponíveis no Amazon Bedrock são muito poderosos, então você pode realizar ainda mais tarefas por meio desses modelos.

Você concluiu a engenharia dos prompts e salvou os modelos em arquivos de texto. Agora você pode começar a criar o bot do Amazon Lex e as funções do Lambda associadas.

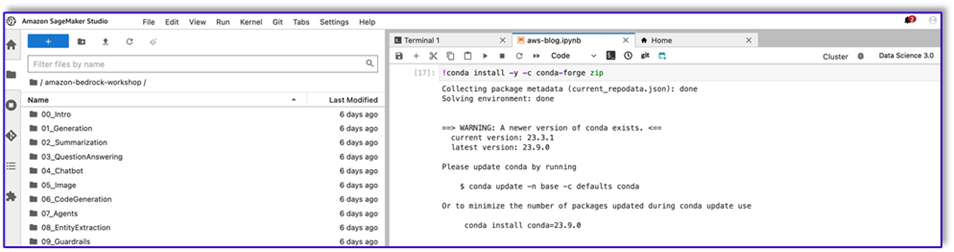

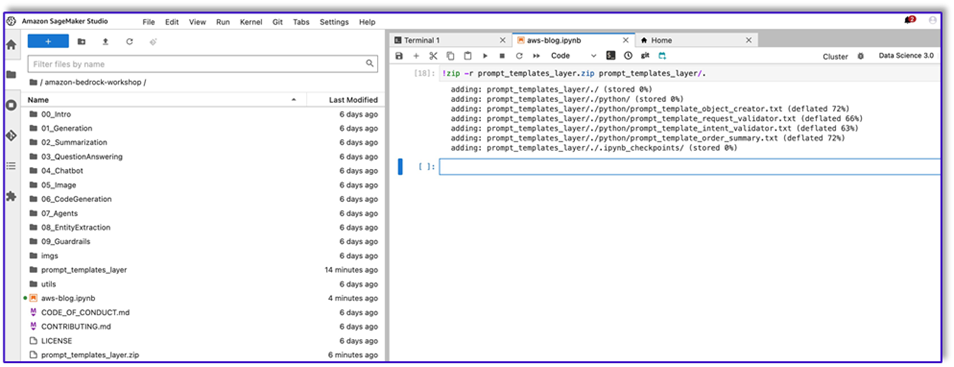

Crie uma camada Lambda com os modelos de prompt

Conclua as etapas a seguir para criar sua camada Lambda:

- No SageMaker Studio, crie uma nova pasta com uma subpasta chamada

python. - Copie seus arquivos de prompt para o

pythonpasta.

- Você pode adicionar a biblioteca ZIP à instância do notebook executando o comando a seguir.

- Agora, execute o seguinte comando para criar o arquivo ZIP para upload na camada Lambda.

- Depois de criar o arquivo ZIP, você pode fazer download do arquivo. Vá para Lambda, crie uma nova camada fazendo upload do arquivo diretamente ou fazendo upload primeiro para o Amazon S3.

- Em seguida, anexe essa nova camada à função Lambda de orquestração.

Agora, seus arquivos de modelo de prompt estão armazenados localmente no ambiente de execução do Lambda. Isso irá acelerar o processo durante a execução do bot.

Crie uma camada Lambda com as bibliotecas necessárias

Conclua as etapas a seguir para criar sua camada Lambda com as bibliotecas necessárias:

- Abra uma Nuvem AWS9 ambiente de instância, crie uma pasta com uma subpasta chamada

python. - Abra um terminal dentro do

pythonpasta. - Execute os seguintes comandos no terminal:

- Execute

cd ..e posicione-se dentro de sua nova pasta onde você também tem opythonsubpasta. - Execute o seguinte comando:

- Depois de criar o arquivo ZIP, você pode fazer download do arquivo. Vá para Lambda, crie uma nova camada fazendo upload do arquivo diretamente ou fazendo upload primeiro para o Amazon S3.

- Em seguida, anexe essa nova camada à função Lambda de orquestração.

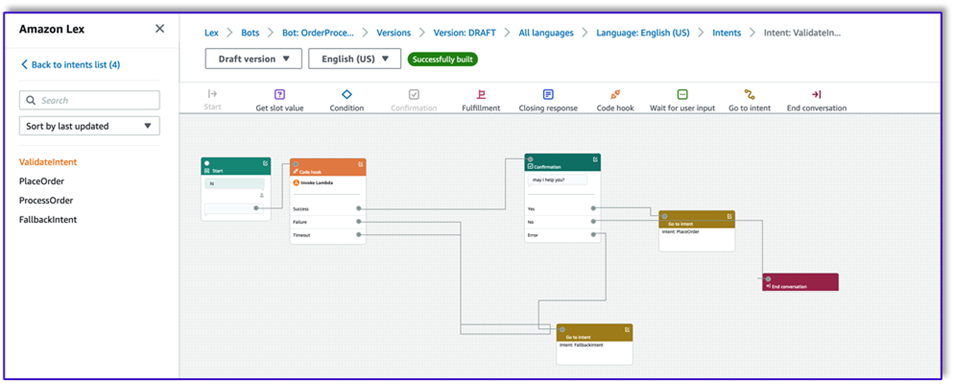

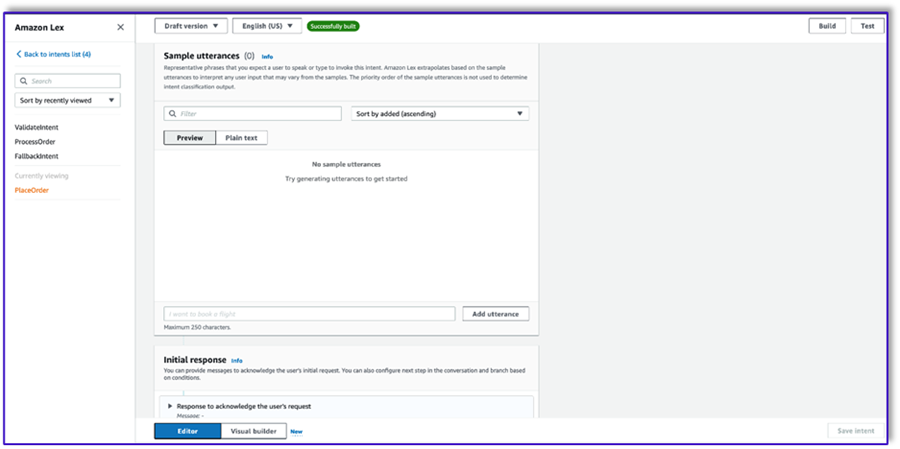

Crie o bot no Amazon Lex v2

Para este caso de uso, construímos um bot Amazon Lex que pode fornecer uma interface de entrada/saída para a arquitetura a fim de chamar o Amazon Bedrock usando voz ou texto de qualquer interface. Como o LLM cuidará da conversa desse agente de processamento de pedidos e o Lambda orquestrará o fluxo de trabalho, você pode criar um bot com três intenções e sem slots.

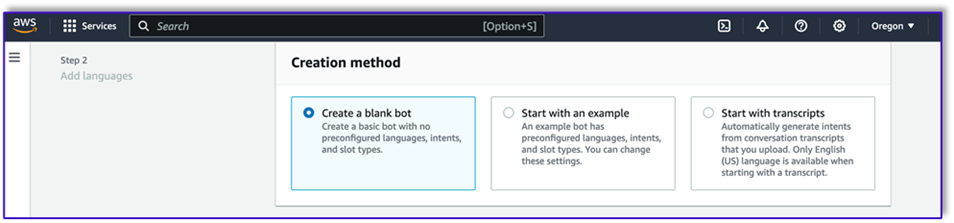

- No console do Amazon Lex, crie um novo bot com o método Crie um bot em branco.

Agora você pode adicionar uma intenção com qualquer expressão inicial apropriada para que os usuários finais iniciem a conversa com o bot. Usamos saudações simples e adicionamos uma resposta inicial do bot para que os usuários finais possam fornecer suas solicitações. Ao criar o bot, certifique-se de usar um gancho de código Lambda com as intenções; isso acionará uma função Lambda que orquestrará o fluxo de trabalho entre o cliente, o Amazon Lex e o LLM.

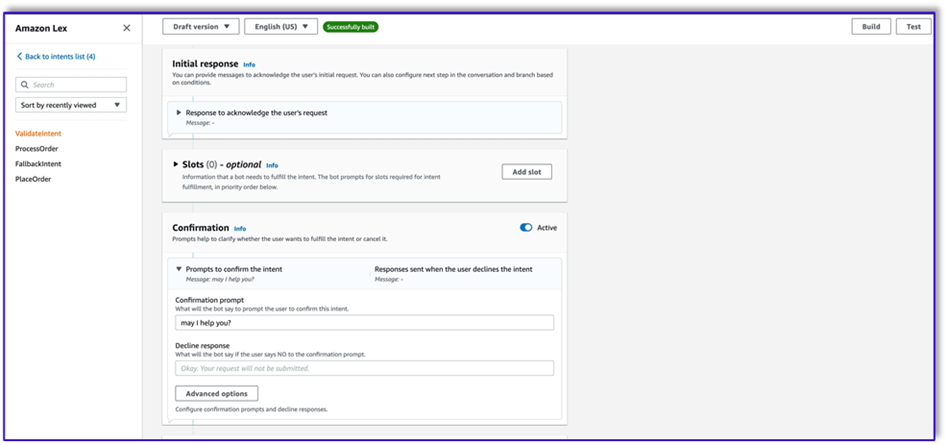

- Adicione sua primeira intenção, que aciona o fluxo de trabalho e usa o modelo de prompt de validação de intenção para chamar o Amazon Bedrock e identificar o que o cliente está tentando realizar. Adicione algumas declarações simples para os usuários finais iniciarem uma conversa.

Você não precisa usar nenhum slot ou leitura inicial em nenhuma das intenções do bot. Na verdade, você não precisa adicionar enunciados à segunda ou terceira intenções. Isso ocorre porque o LLM orientará o Lambda durante todo o processo.

- Adicione um prompt de confirmação. Você pode personalizar essa mensagem na função Lambda posteriormente.

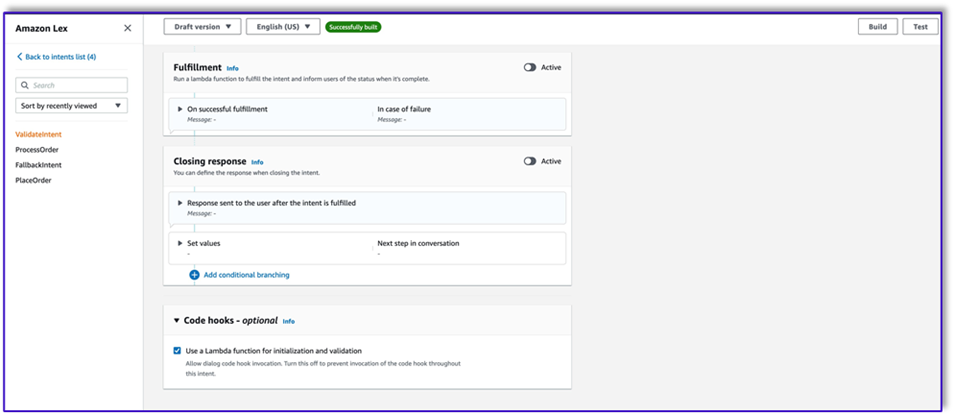

- Debaixo Ganchos de código, selecione Use uma função Lambda para inicialização e validação.

- Crie uma segunda intenção sem expressão e sem resposta inicial. Isto é o

PlaceOrderintenção.

Quando o LLM identifica que o cliente está tentando fazer um pedido, a função Lambda acionará essa intenção e validará a solicitação do cliente no menu, garantindo que nenhuma informação necessária esteja faltando. Lembre-se de que tudo isso está nos modelos de prompt, portanto você pode adaptar esse fluxo de trabalho para qualquer caso de uso alterando os modelos de prompt.

- Não adicione nenhum espaço, mas adicione um prompt de confirmação e recuse a resposta.

- Selecionar Use uma função Lambda para inicialização e validação.

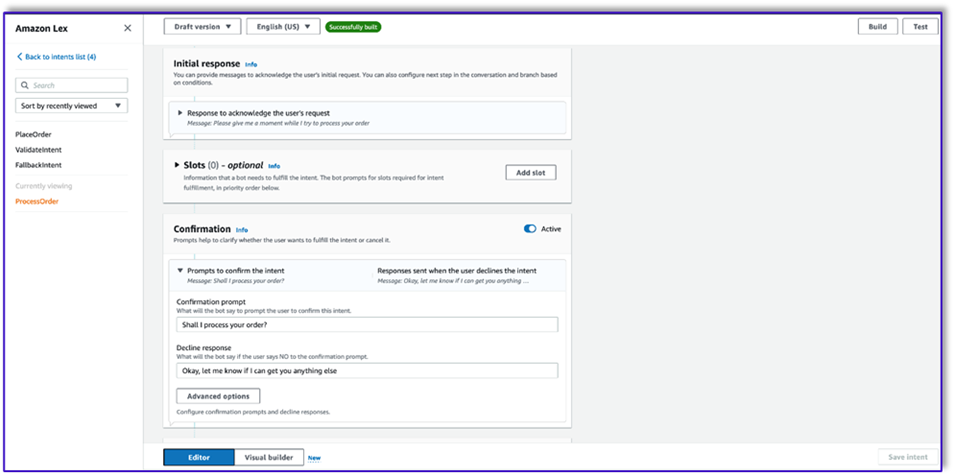

- Crie uma terceira intenção chamada

ProcessOrdersem declarações de amostra e sem slots. - Adicione uma resposta inicial, um prompt de confirmação e uma resposta de recusa.

Após o LLM validar a solicitação do cliente, a função Lambda aciona a terceira e última intenção de processar o pedido. Aqui, o Lambda usará o modelo de criador de objeto para gerar a estrutura de dados JSON do pedido para consultar a tabela do DynamoDB e, em seguida, usará o modelo de resumo do pedido para resumir todo o pedido junto com o total para que o Amazon Lex possa passá-lo ao cliente.

- Selecionar Use uma função Lambda para inicialização e validação. Isso pode usar qualquer função Lambda para processar o pedido após o cliente ter dado a confirmação final.

- Depois de criar todas as três intenções, acesse o construtor Visual para o

ValidateIntent, adicione uma etapa de intenção de acesso e conecte a saída da confirmação positiva a essa etapa. - Depois de adicionar a intenção de acesso, edite-a e escolha a intenção PlaceOrder como o nome da intenção.

- Da mesma forma, para acessar o construtor Visual do

PlaceOrderintenção e conecte a saída da confirmação positiva aoProcessOrderintenção de ir. Nenhuma edição é necessária para oProcessOrderintenção. - Agora você precisa criar a função Lambda que orquestra o Amazon Lex e chama a tabela DynamoDB, conforme detalhado na seção a seguir.

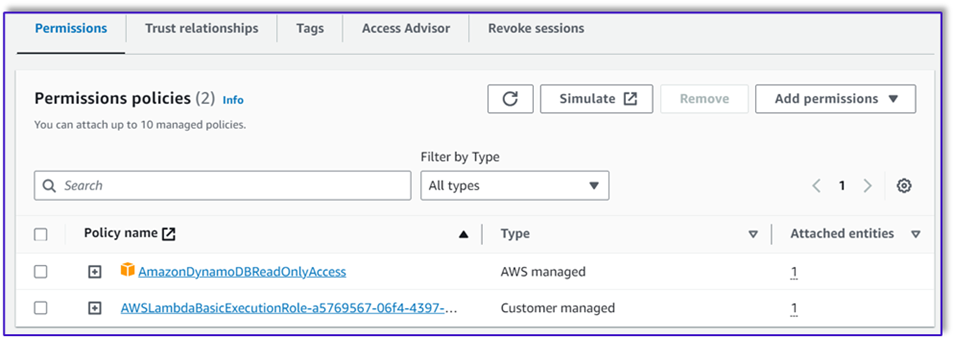

Crie uma função Lambda para orquestrar o bot do Amazon Lex

Agora você pode criar a função Lambda que orquestra o bot e o fluxo de trabalho do Amazon Lex. Conclua as seguintes etapas:

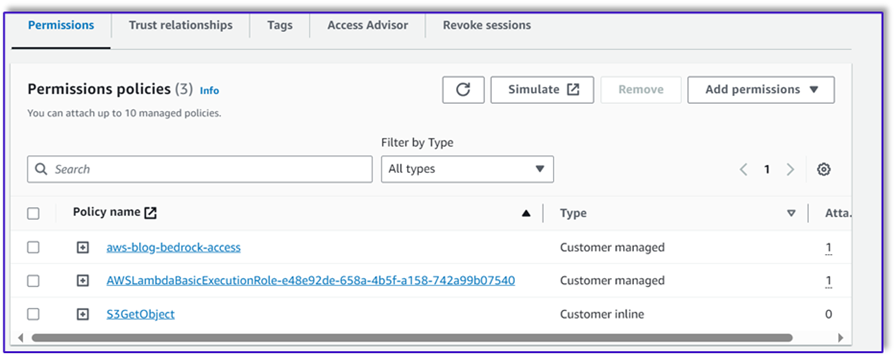

- Crie uma função Lambda com a política de execução padrão e deixe o Lambda criar uma função para você.

- Na janela de código da sua função, adicione algumas funções utilitárias que ajudarão: formate os prompts adicionando o contexto lex ao modelo, chame a API Amazon Bedrock LLM, extraia o texto desejado das respostas e muito mais. Veja o seguinte código:

- Anexe a camada Lambda que você criou anteriormente a esta função.

- Além disso, anexe a camada aos modelos de prompt que você criou.

- Na função de execução do Lambda, anexe a política de acesso ao Amazon Bedrock, que foi criada anteriormente.

A função de execução do Lambda deve ter as seguintes permissões.

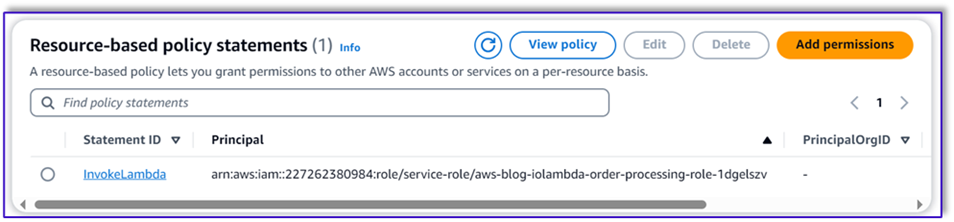

Anexe a função Orchestration Lambda ao bot do Amazon Lex

- Depois de criar a função na seção anterior, retorne ao console do Amazon Lex e navegue até o bot.

- Debaixo Idiomas no painel de navegação, escolha Inglês.

- Escolha fonte, escolha seu bot de processamento de pedidos.

- Escolha Versão da função Lambda ou alias, escolha $ LATEST.

- Escolha Salvar.

Crie funções auxiliares do Lambda

Conclua as etapas a seguir para criar funções Lambda adicionais:

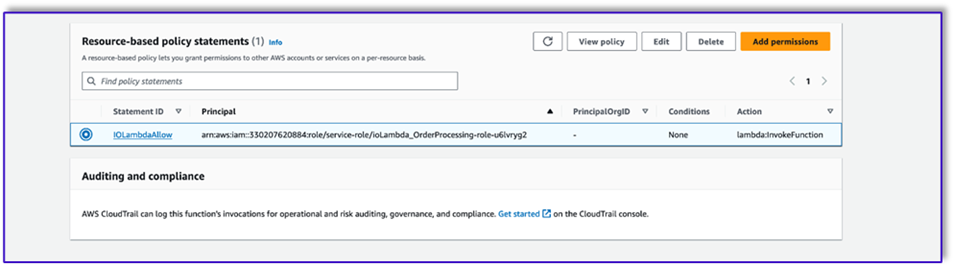

- Crie uma função Lambda para consultar a tabela do DynamoDB criada anteriormente:

- Navegue até a Configuração guia na função Lambda e escolha Permissões.

- Anexe uma declaração de política baseada em recursos que permita que a função Lambda de processamento de pedidos invoque essa função.

- Navegue até a função de execução do IAM para esta função do Lambda e adicione uma política para acessar a tabela do DynamoDB.

- Crie outra função Lambda para validar se todos os atributos necessários foram passados do cliente. No exemplo a seguir, validamos se o atributo size é capturado para um pedido:

- Navegue até a Configuração guia na função Lambda e escolha Permissões.

- Anexe uma declaração de política baseada em recursos que permita que a função Lambda de processamento de pedidos invoque essa função.

Teste a solução

Agora podemos testar a solução com exemplos de pedidos que os clientes fazem por meio do Amazon Lex.

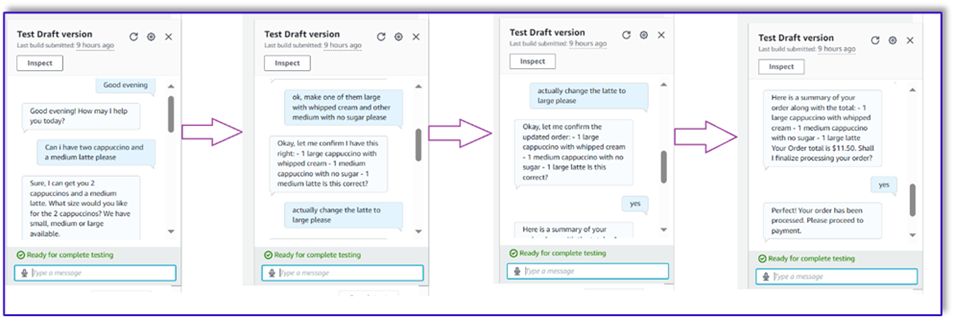

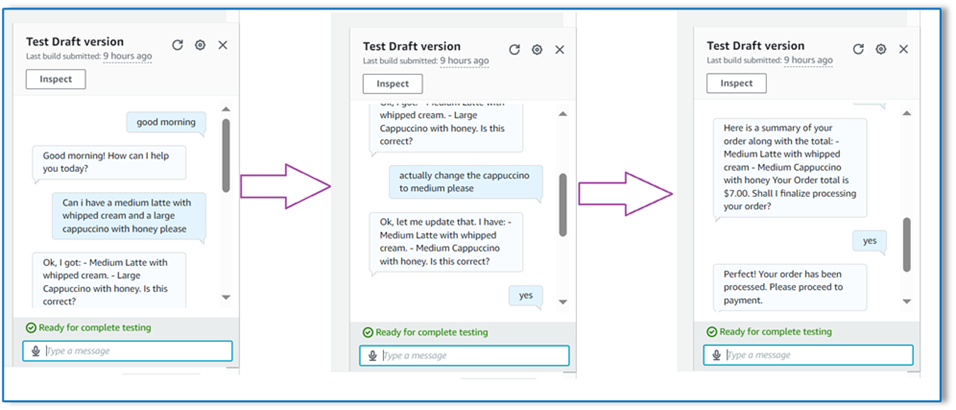

No nosso primeiro exemplo, o cliente pediu um frappuccino, que não está no cardápio. O modelo valida com a ajuda do modelo de validador de pedidos e sugere algumas recomendações com base no menu. Depois que o cliente confirma seu pedido, ele é notificado sobre o total e o resumo do pedido. A encomenda será processada com base na confirmação final do cliente.

Em nosso próximo exemplo, o cliente está pedindo um cappuccino grande e depois modificando o tamanho de grande para médio. O modelo captura todas as alterações necessárias e solicita ao cliente a confirmação do pedido. O modelo apresenta o total e o resumo do pedido, e processa o pedido com base na confirmação final do cliente.

Para nosso exemplo final, o cliente fez um pedido de vários itens e falta o tamanho de alguns itens. O modelo e a função Lambda verificarão se todos os atributos necessários estão presentes para processar o pedido e então solicitarão ao cliente que forneça as informações que faltam. Depois que o cliente fornece as informações que faltam (neste caso, o tamanho do café), é mostrado o total e o resumo do pedido. A encomenda será processada com base na confirmação final do cliente.

Limitações do LLM

Os resultados do LLM são estocásticos por natureza, o que significa que os resultados do nosso LLM podem variar em formato ou mesmo na forma de conteúdo falso (alucinações). Portanto, os desenvolvedores precisam contar com uma boa lógica de tratamento de erros em todo o seu código para lidar com esses cenários e evitar uma experiência degradada do usuário final.

limpar

Se você não precisar mais desta solução, poderá excluir os seguintes recursos:

- Funções lambda

- Caixa Amazon Lex

- Mesa DynamoDB

- Caçamba S3

Além disso, encerre a instância do SageMaker Studio se o aplicativo não for mais necessário.

Avaliação de custos

Para obter informações sobre preços dos principais serviços utilizados por esta solução, consulte o seguinte:

Observe que você pode usar o Claude v2 sem a necessidade de provisionamento, portanto, os custos gerais permanecem mínimos. Para reduzir ainda mais os custos, você pode configurar a tabela do DynamoDB com a configuração sob demanda.

Conclusão

Esta postagem demonstrou como criar um agente de processamento de pedidos de IA habilitado para fala usando Amazon Lex, Amazon Bedrock e outros serviços da AWS. Mostramos como a engenharia rápida com um poderoso modelo de IA generativo como o Claude pode permitir uma compreensão robusta da linguagem natural e fluxos de conversação para processamento de pedidos sem a necessidade de extensos dados de treinamento.

A arquitetura da solução usa componentes sem servidor como Lambda, Amazon S3 e DynamoDB para permitir uma implementação flexível e escalável. Armazenar os modelos de prompt no Amazon S3 permite personalizar a solução para diferentes casos de uso.

Os próximos passos podem incluir a expansão das capacidades do agente para lidar com uma gama mais ampla de solicitações de clientes e casos extremos. Os modelos de prompt fornecem uma maneira de melhorar iterativamente as habilidades do agente. Personalizações adicionais podem envolver a integração dos dados do pedido com sistemas de back-end, como estoque, CRM ou POS. Por fim, o agente pode ser disponibilizado em vários pontos de contato com o cliente, como aplicativos móveis, drive-thru, quiosques e muito mais, usando os recursos multicanais do Amazon Lex.

Para saber mais, consulte os seguintes recursos relacionados:

- Implantando e gerenciando bots multicanais:

- Engenharia imediata para Claude e outros modelos:

- Padrões de arquitetura sem servidor para assistentes de IA escaláveis:

Sobre os autores

Moumita Dutta é arquiteto de soluções parceiras na Amazon Web Services. Na sua função, ela colabora estreitamente com parceiros para desenvolver ativos escaláveis e reutilizáveis que agilizam as implementações na nuvem e melhoram a eficiência operacional. Ela é membro da comunidade de IA/ML e especialista em IA generativa na AWS. Nos tempos livres, gosta de jardinagem e de andar de bicicleta.

Moumita Dutta é arquiteto de soluções parceiras na Amazon Web Services. Na sua função, ela colabora estreitamente com parceiros para desenvolver ativos escaláveis e reutilizáveis que agilizam as implementações na nuvem e melhoram a eficiência operacional. Ela é membro da comunidade de IA/ML e especialista em IA generativa na AWS. Nos tempos livres, gosta de jardinagem e de andar de bicicleta.

Fernando Lammoglia é arquiteto de soluções parceiras na Amazon Web Services e trabalha em estreita colaboração com parceiros da AWS para liderar o desenvolvimento e a adoção de soluções de IA de ponta em unidades de negócios. Um líder estratégico com experiência em arquitetura de nuvem, IA generativa, aprendizado de máquina e análise de dados. Ele é especialista na execução de estratégias de entrada no mercado e no fornecimento de soluções de IA impactantes alinhadas com os objetivos organizacionais. Nas horas vagas adora ficar com a família e viajar para outros países.

Fernando Lammoglia é arquiteto de soluções parceiras na Amazon Web Services e trabalha em estreita colaboração com parceiros da AWS para liderar o desenvolvimento e a adoção de soluções de IA de ponta em unidades de negócios. Um líder estratégico com experiência em arquitetura de nuvem, IA generativa, aprendizado de máquina e análise de dados. Ele é especialista na execução de estratégias de entrada no mercado e no fornecimento de soluções de IA impactantes alinhadas com os objetivos organizacionais. Nas horas vagas adora ficar com a família e viajar para outros países.

Mitul Patel é arquiteto de soluções sênior na Amazon Web Services. Em sua função de facilitador de tecnologia em nuvem, ele trabalha com os clientes para entender seus objetivos e desafios e fornece orientação prescritiva para atingir seus objetivos com as ofertas da AWS. Ele é membro da comunidade de IA/ML e embaixador de IA generativa na AWS. Nas horas vagas gosta de fazer caminhadas e jogar futebol.

Mitul Patel é arquiteto de soluções sênior na Amazon Web Services. Em sua função de facilitador de tecnologia em nuvem, ele trabalha com os clientes para entender seus objetivos e desafios e fornece orientação prescritiva para atingir seus objetivos com as ofertas da AWS. Ele é membro da comunidade de IA/ML e embaixador de IA generativa na AWS. Nas horas vagas gosta de fazer caminhadas e jogar futebol.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/transform-one-on-one-customer-interactions-build-speech-capable-order-processing-agents-with-aws-and-generative-ai/

- :tem

- :é

- :não

- :onde

- $3

- $UP

- 1

- 10

- 100

- 11

- 12

- 13

- 15%

- 173

- 200

- 24

- 250

- 28

- 29

- 31

- 320

- 385

- 40

- 400

- 500

- 7

- 75

- 8

- 9

- 900

- a

- acima

- acelerado

- ACEITAR

- Acesso

- acessando

- realizar

- Segundo

- Conta

- Alcançar

- em

- Açao Social

- ativo

- adaptar

- adicionar

- adicionado

- acrescentando

- Adição

- Adicional

- Adicionalmente

- aderente

- ajustar

- Adoção

- avanços

- advento

- Depois de

- novamente

- contra

- Agente

- agentes

- AI

- AI / ML

- alinhado

- Todos os Produtos

- permitir

- Permitindo

- permite

- juntamente

- tb

- sempre

- am

- Amazon

- Amazon-Lex

- Amazon RDS

- Amazon Web Services

- Embaixadora

- an

- analítica

- e

- Outro

- Antrópico

- qualquer

- api

- Aplicação

- aplicações

- Aplicar

- abordagem

- apropriado

- adequadamente

- Aplicativos

- arquitetônico

- arquitetura

- SOMOS

- AS

- perguntar

- Ativos

- Assistência

- Assistente

- assistentes

- ajudando

- associado

- assume

- At

- anexar

- Atendentes

- atributos

- Automatizado

- disponibilidade

- disponível

- evitar

- AWS

- em caminho duplo

- Backend

- baseado

- BE

- Porque

- sido

- começar

- entre

- corpo

- Bot

- ambos

- bots

- amplo

- construir

- construtor

- negócio

- negócios

- mas a

- by

- calcular

- chamada

- chamado

- chamada

- chamadas

- CAN

- capacidades

- capturados

- capturas

- casas

- casos

- Categorias

- célula

- desafios

- desafiante

- alterar

- Alterações

- mudança

- caracteres

- verificar

- escolha

- Escolha

- cliente

- Fechar

- de perto

- Na nuvem

- TECNOLOGIA DE NUVEM

- código

- Café

- colabora

- coletar

- comunicada

- comunidade

- Empresas

- competitivo

- completar

- Efetuado

- completando

- realização

- componentes

- conceitos

- Confirmar

- confirmação

- CONFIRMADO

- Contato

- da conexão

- consiste

- cônsul

- conteúdo

- contexto

- continua

- facilidade

- Conversa

- converter

- correta

- custos

- poderia

- países

- Casal

- crio

- criado

- cria

- Criar

- criação

- criador

- CRM

- Atual

- personalizadas

- cliente

- Clientes

- personalizar

- ponta

- dados,

- Análise de Dados

- Estrutura de dados

- banco de dados

- Rejeitar

- profundamente

- Padrão

- definir

- entregar

- entregando

- Demanda

- demandas

- demonstraram

- negado

- Dependendo

- depende

- Implantações

- projetado

- desejado

- Apesar de

- detalhado

- Dev

- desenvolver

- desenvolvido

- desenvolvedores

- Desenvolvimento

- diagrama

- DID

- diferente

- diretamente

- expedição

- do

- parece

- domínio

- don

- feito

- não

- down

- download

- durante

- e

- cada

- Mais cedo

- facilmente

- borda

- efeito

- eficiência

- eficiente

- eficientemente

- esforço

- outro

- permitir

- enabler

- Ponto final

- Engenharia

- aumentar

- Entrar

- Meio Ambiente

- erro

- erros

- Mesmo

- Evento

- exemplo

- exemplos

- Exceto

- exceção

- executando

- execução

- existente

- Saindo

- expansão

- vasta experiência

- especialista

- experiência

- extenso

- extrato

- Rosto

- fato

- Cair

- Familiaridade

- família

- poucos

- Envie o

- Arquivos

- final

- finalizar

- Encontre

- Primeiro nome

- Flexibilidade

- flexível

- Fluxos

- seguinte

- Escolha

- formulário

- formato

- Felizmente

- encontrado

- Foundation

- Fundacional

- Gratuito

- da

- totalmente

- função

- funções

- mais distante

- Geral

- gerar

- generativo

- IA generativa

- ter

- OFERTE

- dado

- Go

- Ir ao mercado

- Objetivos

- Bom estado, com sinais de uso

- tem

- grande

- ótimo

- cumprimento

- saudações

- orientações

- guia

- manipular

- Manipulação

- Ter

- ter

- he

- ouvir

- fortemente

- ajudar

- sua experiência

- SUA PARTICIPAÇÃO FAZ A DIFERENÇA

- hi

- Alta performance

- sua

- Mel

- HORÁRIO

- Como funciona o dobrador de carta de canal

- Como Negociar

- Contudo

- HTML

- http

- HTTPS

- humano

- i

- ID

- identifica

- identificar

- identificar

- if

- ilustra

- impactante

- implementação

- implementação

- importar

- importador

- melhorar

- in

- incluir

- Incluindo

- Entrada

- aumentando

- índice

- INFORMAÇÕES

- arraigado

- do estado inicial,

- entrada

- inputs

- dentro

- instalar

- instância

- em vez disso

- instruções

- Integração

- intenção

- interações

- Interface

- para dentro

- Introduz

- inventário

- envolver

- IT

- Unid

- jpg

- json

- apenas por

- Guarda

- Chave

- quiosques

- Saber

- Laboratório

- Falta

- paisagem

- língua

- grande

- Sobrenome

- por último

- mais tarde

- camada

- líder

- principal

- APRENDER

- aprendizagem

- limonada

- deixar

- Permite

- bibliotecas

- Biblioteca

- como

- limitações

- Lista

- LLM

- carregar

- localmente

- logging

- lógica

- mais

- OLHARES

- ama

- máquina

- aprendizado de máquina

- moldadas

- a Principal

- fazer

- gerenciados

- de grupos

- gestão

- manual

- muitos

- marcado

- Mercados

- me

- significa

- média

- membro

- Menu

- mensagem

- mensagens

- Meta

- método

- poder

- leite

- mínimo

- perdido

- desaparecido

- Móvel Esteira

- aplicativos móveis

- modelo

- modelos

- modificada

- modificar

- momento

- mais

- múltiplo

- my

- nome

- Nomeado

- natural

- Natureza

- Navegar

- Navegação

- necessário

- você merece...

- necessário

- Cria

- Novo

- Próximo

- não

- nenhum

- caderno

- agora

- objeto

- objetivo

- ocorreu

- of

- Ofertas

- Oferece

- frequentemente

- OK

- on

- Sob demanda

- ONE

- só

- aberto

- opera

- operacional

- Opção

- Opções

- or

- orquestrando

- orquestração

- ordem

- ordens

- organizacional

- organizações

- Outros

- A Nossa

- saída

- outputs

- global

- pão

- parâmetros

- parte

- parceiro

- Parceiros

- passar

- passou

- passes

- caminho

- padrões

- pagamento

- por cento

- executa

- possivelmente

- permissões

- peça

- Lugar

- Locais

- colocação

- platão

- Inteligência de Dados Platão

- PlatãoData

- jogar

- por favor

- pontos

- Privacidade

- PoS

- coloca

- posição

- positivo

- possível

- Publique

- potencial

- poderoso

- prática

- preliminares

- Preparar

- Prepara

- preparação

- presente

- presentes

- anterior

- preço

- preços

- política de privacidade

- prosseguir

- processo

- Processado

- processos

- em processamento

- Perfil

- solicita

- prospecto

- fornecer

- fornecido

- provedor

- fornece

- provisão

- Pullover

- colocar

- Python

- pergunta

- rapidamente

- R

- aumentar

- alcance

- Cru

- RE

- Leia

- Leitura

- pronto

- recomendar

- recomendações

- reduzir

- referir

- região

- regular

- relacionado

- depender

- permanecem

- permanece

- lembrar

- removendo

- substituição

- solicitar

- pedidos

- requeridos

- recurso

- Recursos

- Responder

- resposta

- respostas

- responsável

- resultar

- Resultados

- retorno

- Retorna

- reutilizável

- rígido

- uma conta de despesas robusta

- Tipo

- Rota

- LINHA

- Execute

- corrida

- é executado

- tempo de execução

- s

- sábio

- mesmo

- amostra

- Salvar

- salvo

- dizer

- escalável

- Escala

- cenário

- cenários

- screenshots

- Sdk

- Segundo

- Segredo

- Seção

- segurança

- Vejo

- selecionar

- senior

- Serverless

- serviço

- Serviços

- Sessão

- conjunto

- contexto

- Configurações

- instalação

- vários

- ela

- concha

- lojas

- rede de apoio social

- mostrar

- mostrou

- mostrando

- Shows

- fechar

- Encerre

- simples

- solteiro

- Tamanho

- Habilidades

- ranhura

- caça-níqueis

- pequeno

- fragmento

- So

- futebol

- unicamente

- solução

- Soluções

- alguns

- Alguém

- algo

- falar

- encabeçando

- especial

- especializada

- específico

- velocidade

- gastar

- Estabilidade

- padrão

- começo

- Comece

- Estado

- Declaração

- Passo

- Passos

- armazenadas

- armazenar

- Estratégico

- estratégias

- simplificar

- estrutura

- Lutas

- estudo

- substancial

- entraram com sucesso

- tal

- açúcar

- sugerir

- Sugere

- resumir

- RESUMO

- Suportado

- certo

- rapidamente

- .

- sistemas

- mesa

- TAG

- toma

- Tarefa

- tarefas

- gosto

- tecnológica

- Equipar

- modelo

- modelos

- terminal

- teste

- texto

- obrigado

- que

- A

- as informações

- deles

- Eles

- então

- Lá.

- assim sendo

- Este

- deles

- coisa

- Terceiro

- isto

- três

- Através da

- todo

- tempo

- linha do tempo

- para

- hoje

- hoje

- ferramentas

- Total

- tradicional

- Training

- Transformar

- viagens

- desencadear

- problema

- tentar

- tentando

- dois

- tipo

- compreender

- compreensão

- unidades

- Upload

- usar

- caso de uso

- usava

- Utilizador

- usos

- utilização

- utilidade

- Utilizando

- válido

- VALIDAR

- validado

- validação

- Validador

- valor

- Valores

- variável

- vário

- variar

- verificar

- versão

- muito

- via

- visual

- voz

- queremos

- quer

- foi

- Caminho..

- we

- web

- serviços web

- BEM

- foram

- O Quê

- quando

- qual

- enquanto

- inteiro

- mais largo

- precisarão

- janela

- de

- dentro

- sem

- de gestão de documentos

- trabalhar

- trabalho

- seria

- escrever

- XML

- sim

- Vocês

- investimentos

- você mesmo

- zefirnet

- Zip